AI generatif (GenAI) dan model bahasa besar (LLM), seperti yang segera tersedia melalui Batuan Dasar Amazon dan Titan Amazon mengubah cara pengembang dan perusahaan dapat memecahkan tantangan tradisional yang rumit terkait dengan pemrosesan dan pemahaman bahasa alami. Beberapa manfaat yang ditawarkan oleh LLM termasuk kemampuan untuk menciptakan pengalaman AI percakapan yang lebih mampu dan menarik untuk aplikasi layanan pelanggan, dan meningkatkan produktivitas karyawan melalui respons yang lebih intuitif dan akurat.

Namun, untuk kasus penggunaan ini, aplikasi GenAI yang mengimplementasikan pengalaman percakapan harus memenuhi dua kriteria utama: membatasi respons terhadap data perusahaan, sehingga mengurangi halusinasi model (pernyataan salah), dan memfilter respons sesuai dengan akses konten pengguna akhir. izin.

Untuk membatasi respons aplikasi GenAI hanya pada data perusahaan, kita perlu menggunakan teknik yang disebut Retrieval Augmented Generation (RAG). Aplikasi yang menggunakan pendekatan RAG mengambil informasi yang paling relevan dengan permintaan pengguna dari basis pengetahuan atau konten perusahaan, menggabungkannya sebagai konteks bersama dengan permintaan pengguna sebagai perintah, lalu mengirimkannya ke LLM untuk mendapatkan respons GenAI. LLM memiliki batasan dalam jumlah kata maksimum untuk prompt input, oleh karena itu memilih bagian yang tepat di antara ribuan atau jutaan dokumen di perusahaan, berdampak langsung pada akurasi LLM.

Dalam merancang RAG yang efektif, pengambilan konten merupakan langkah penting untuk memastikan LLM menerima konteks yang paling relevan dan ringkas dari konten perusahaan untuk menghasilkan respons yang akurat. Di sinilah yang didukung oleh pembelajaran mesin (ML) yang sangat akurat pencarian cerdas in AmazonKendra memainkan peran penting. Amazon Kendra adalah layanan terkelola penuh yang menyediakan kemampuan pencarian semantik siap pakai untuk pemeringkatan dokumen dan bagian yang canggih. Anda dapat menggunakan pencarian akurasi tinggi di Amazon Kendra untuk mendapatkan konten dan dokumen yang paling relevan untuk memaksimalkan kualitas muatan RAG Anda, menghasilkan respons LLM yang lebih baik daripada menggunakan solusi pencarian konvensional atau berbasis kata kunci. Amazon Kendra menawarkan model pencarian pembelajaran mendalam yang mudah digunakan yang dilatih sebelumnya di 14 domain dan tidak memerlukan keahlian ML apa pun, sehingga tidak perlu berurusan dengan penyematan kata, pemotongan dokumen, dan kompleksitas tingkat rendah lainnya yang biasanya diperlukan untuk implementasi RAG. Amazon Kendra juga dilengkapi dengan konektor siap pakai ke sumber data populer seperti Layanan Penyimpanan Sederhana Amazon (Amazon S3), SharePoint, Confluence, dan situs web, serta mendukung format dokumen umum seperti HTML, Word, PowerPoint, PDF, Excel, dan file teks murni. Untuk memfilter respons hanya berdasarkan dokumen yang diizinkan oleh izin pengguna akhir, Amazon Kendra menawarkan konektor dengan dukungan daftar kontrol akses (ACL). Amazon Kendra juga menawarkan Identitas AWS dan Manajemen Akses (IAM) dan Pusat Identitas AWS IAM (penerus AWS Single Sign-On) integrasi untuk sinkronisasi informasi grup pengguna dengan penyedia identitas pelanggan seperti Okta dan Azure AD.

Dalam postingan ini, kami mendemonstrasikan cara menerapkan alur kerja RAG dengan menggabungkan kemampuan Amazon Kendra dengan LLM untuk membuat aplikasi GenAI canggih yang menyediakan pengalaman percakapan melalui konten perusahaan Anda. Setelah Batuan Dasar Amazon diluncurkan, kami akan menerbitkan postingan lanjutan yang menunjukkan cara mengimplementasikan aplikasi GenAI serupa menggunakan Amazon Bedrock, jadi nantikan terus.

Ikhtisar solusi

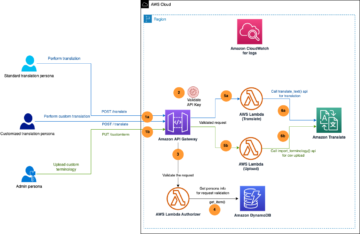

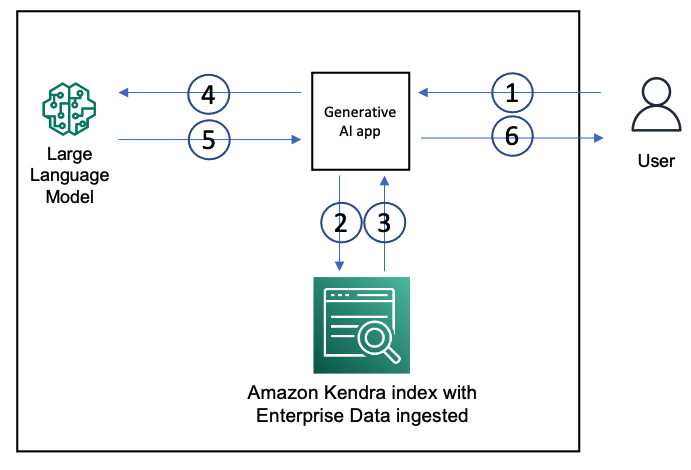

Diagram berikut menunjukkan arsitektur aplikasi GenAI dengan pendekatan RAG.

Kami menggunakan indeks Amazon Kendra untuk menyerap data tidak terstruktur perusahaan dari sumber data seperti halaman wiki, situs MS SharePoint, Atlassian Confluence, dan repositori dokumen seperti Amazon S3. Saat pengguna berinteraksi dengan aplikasi GenAI, alurnya adalah sebagai berikut:

- Pengguna membuat permintaan ke aplikasi GenAI.

- Aplikasi mengeluarkan permintaan pencarian ke indeks Amazon Kendra berdasarkan permintaan pengguna.

- Indeks mengembalikan hasil pencarian dengan kutipan dokumen yang relevan dari data perusahaan yang diserap.

- Aplikasi mengirimkan permintaan pengguna dan bersama dengan data yang diambil dari indeks sebagai konteks di prompt LLM.

- LLM mengembalikan respons singkat terhadap permintaan pengguna berdasarkan data yang diambil.

- Tanggapan dari LLM dikirim kembali ke pengguna.

Dengan arsitektur ini, Anda dapat memilih LLM yang paling cocok untuk kasus penggunaan Anda. Opsi LLM mencakup mitra kami Hugging Face, AI21 Labs, Cohere, dan lainnya yang dihosting di sebuah Amazon SageMaker titik akhir, serta model oleh perusahaan seperti Antropik dan OpenAI. Dengan Batuan Dasar Amazon, Anda akan dapat memilih Titan Amazon, LLM Amazon sendiri, atau mitra LLM seperti dari AI21 Labs dan Anthropic dengan API secara aman tanpa perlu data Anda keluar dari ekosistem AWS. Manfaat tambahan yang akan ditawarkan Amazon Bedrock mencakup arsitektur tanpa server, API tunggal untuk memanggil LLM yang didukung, dan layanan terkelola untuk merampingkan alur kerja pengembang.

Untuk hasil terbaik, aplikasi GenAI perlu merekayasa prompt berdasarkan permintaan pengguna dan LLM spesifik yang digunakan. Aplikasi AI percakapan juga perlu mengelola riwayat obrolan dan konteksnya. Pengembang aplikasi GenAI dapat menggunakan kerangka kerja sumber terbuka seperti LangChain yang menyediakan modul untuk diintegrasikan dengan LLM pilihan, dan alat orkestrasi untuk aktivitas seperti manajemen riwayat obrolan dan rekayasa cepat. Kami telah menyediakan KendraIndexRetriever kelas yang mengimplementasikan a Retriever LangChain antarmuka, yang dapat digunakan aplikasi bersama dengan antarmuka LangChain lainnya seperti rantai untuk mengambil data dari indeks Amazon Kendra. Kami juga telah menyediakan beberapa contoh aplikasi di GitHub repo. Anda dapat menerapkan solusi ini di akun AWS Anda menggunakan panduan langkah demi langkah di postingan ini.

Prasyarat

Untuk tutorial ini, Anda memerlukan terminal bash dengan Python 3.9 atau lebih tinggi yang diinstal di Linux, Mac, atau Windows Subsystem untuk Linux, dan akun AWS. Kami juga merekomendasikan menggunakan AWS Cloud9 contoh atau Cloud komputasi elastis Amazon (Amazon EC2) contoh.

Terapkan alur kerja RAG

Untuk mengonfigurasi alur kerja RAG Anda, selesaikan langkah-langkah berikut:

- Gunakan yang disediakan Formasi AWS Cloud Template untuk membuat indeks Amazon Kendra baru.

Template ini menyertakan data sampel yang berisi dokumentasi online AWS untuk Amazon Kendra, AmazonLex, dan Amazon SageMaker. Bergantian, jika Anda memiliki indeks Amazon Kendra dan telah mengindeks kumpulan data Anda sendiri, Anda dapat menggunakannya. Meluncurkan tumpukan membutuhkan sekitar 30 menit diikuti sekitar 15 menit untuk menyinkronkannya dan menyerap data dalam indeks. Oleh karena itu, tunggu sekitar 45 menit setelah meluncurkan tumpukan. Catat ID indeks dan Wilayah AWS di tumpukan Output Tab.

- Untuk pengalaman GenAI yang ditingkatkan, kami sarankan untuk meminta Peningkatan kuota layanan Amazon Kendra untuk maksimum

DocumentExcerptukuran, sehingga Amazon Kendra memberikan kutipan dokumen yang lebih besar untuk meningkatkan konteks semantik untuk LLM. - Instal SDK AWS untuk Python pada antarmuka baris perintah pilihan Anda.

- Jika Anda ingin menggunakan contoh aplikasi web yang dibangun menggunakan merampingkan, Anda harus terlebih dahulu instal Streamlit. Langkah ini bersifat opsional jika Anda hanya ingin menjalankan versi baris perintah dari aplikasi sampel.

- Instal LangChain.

- Contoh aplikasi yang digunakan dalam tutorial ini mengharuskan Anda memiliki akses ke satu atau lebih LLM dari Flan-T5-XL, Flan-T5-XXL, Anthropic Claud-V1, dan OpenAI-text-davinci-003.

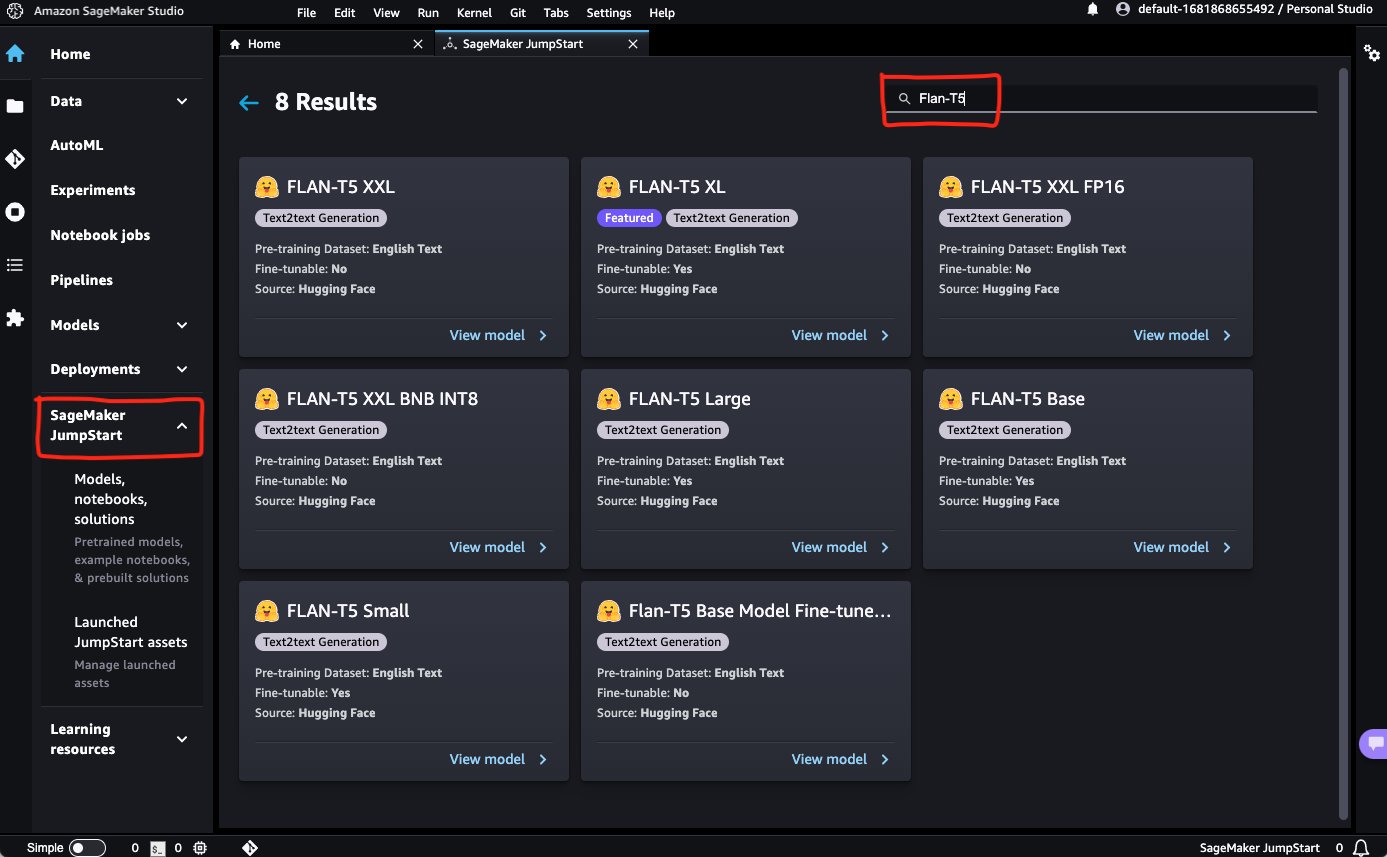

- Jika Anda ingin menggunakan Flan-T5-XL atau Flan-T5-XXL, sebarkan ke titik akhir untuk inferensi menggunakan Jumpstart Amazon SageMaker Studio.

- Jika Anda ingin bekerja dengan Anthropic Claud-V1 atau OpenAI-da-vinci-003, dapatkan kunci API untuk LLM yang Anda minati dari https://www.anthropic.com/ dan https://openai.com/, Masing-masing.

- Jika Anda ingin menggunakan Flan-T5-XL atau Flan-T5-XXL, sebarkan ke titik akhir untuk inferensi menggunakan Jumpstart Amazon SageMaker Studio.

- Ikuti instruksi di GitHub repo untuk menginstal

KendraIndexRetrieverantarmuka dan contoh aplikasi. - Sebelum Anda menjalankan aplikasi sampel, Anda perlu mengatur variabel lingkungan dengan detail indeks Amazon Kendra dan kunci API LLM pilihan Anda atau titik akhir SageMaker penerapan Anda untuk Flan-T5-XL atau Flan-T5-XXL. Berikut ini adalah contoh skrip untuk mengatur variabel lingkungan:

- Di jendela baris perintah, ubah ke

samplessubdirektori tempat Anda mengkloning repositori GitHub. Anda dapat menjalankan aplikasi baris perintah dari baris perintah sebagaipython <sample-file-name.py>. Anda dapat menjalankan aplikasi web streamlit dengan mengubah direktori menjadisamplesdan berlaristreamlit run app.py <anthropic|flanxl|flanxxl|openai>. - Buka file sampel

kendra_retriever_flan_xxl.pydi editor pilihan Anda.

Perhatikan pernyataan result = run_chain(chain, "What's SageMaker?"). Ini adalah kueri pengguna (“Apa itu SageMaker?”) yang dijalankan melalui rantai yang menggunakan Flan-T-XXL sebagai LLM dan Amazon Kendra sebagai pengambil. Saat file ini dijalankan, Anda dapat mengamati hasilnya sebagai berikut. Rantai mengirim kueri pengguna ke indeks Amazon Kendra, mengambil tiga kutipan hasil teratas, dan mengirimkannya sebagai konteks dalam prompt bersama dengan kueri, yang ditanggapi oleh LLM dengan jawaban singkat. Itu juga menyediakan sumbernya, (URL ke dokumen yang digunakan untuk menghasilkan jawaban).

- Sekarang mari kita jalankan aplikasi web

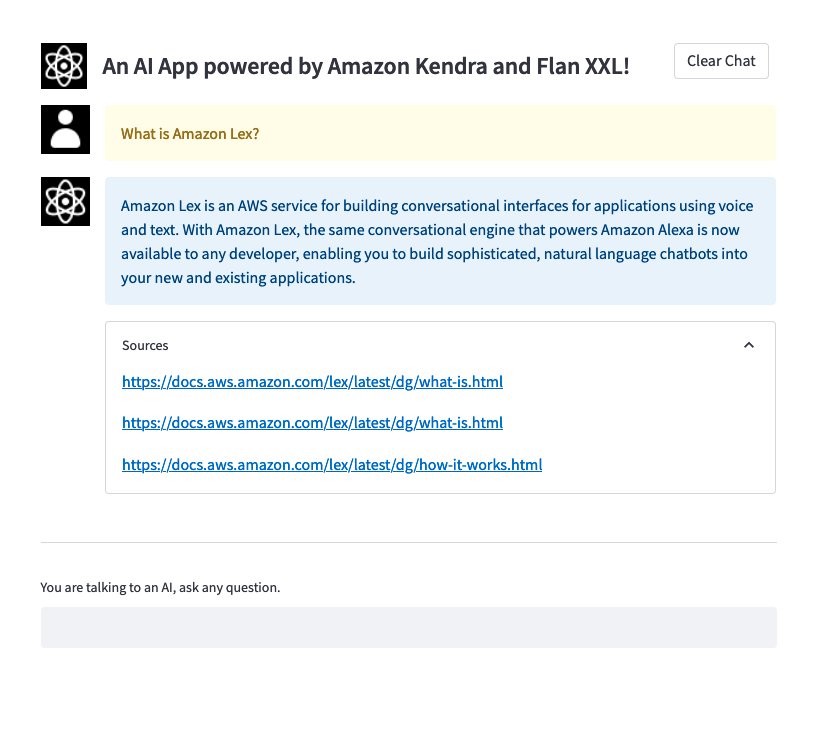

app.pyasstreamlit run app.py flanxxl. Untuk proses khusus ini, kami menggunakan model Flan-T-XXL sebagai LLM.

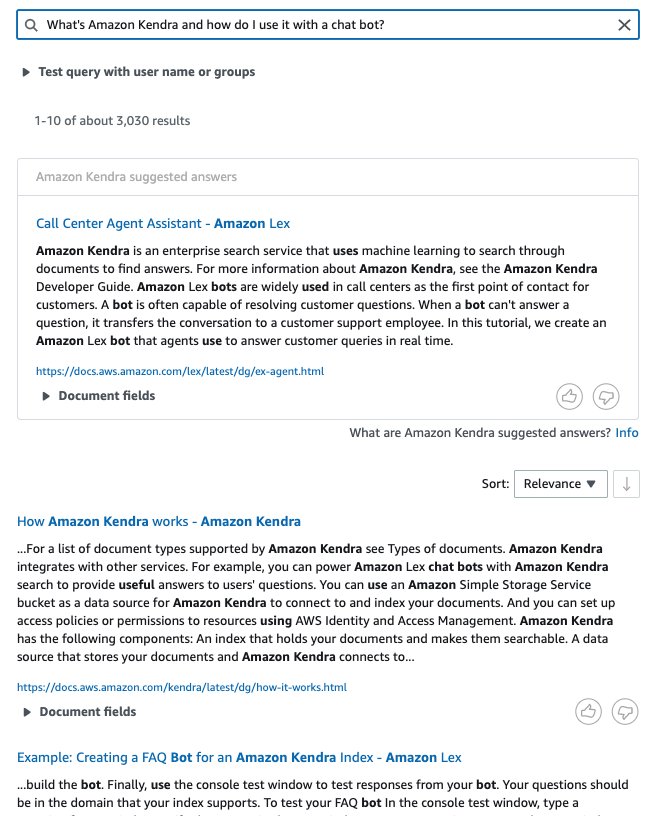

Ini membuka jendela browser dengan antarmuka web. Anda dapat memasukkan kueri, yang dalam hal ini adalah "Apa itu Amazon Lex?" Seperti yang terlihat pada tangkapan layar berikut, aplikasi merespons dengan jawaban, dan sumber bagian memberikan URL ke dokumen yang kutipannya diambil dari indeks Amazon Kendra dan dikirim ke LLM di prompt sebagai konteks bersama dengan kueri.

- Sekarang ayo lari

app.pylagi dan rasakan pengalaman percakapan menggunakanstreamlit run app.py anthropic. Di sini LLM dasar yang digunakan adalah Anthropic Claud-V1.

Seperti yang dapat Anda lihat di video berikut, LLM memberikan jawaban mendetail atas permintaan pengguna berdasarkan dokumen yang diambil dari indeks Amazon Kendra dan kemudian mendukung jawaban dengan URL ke dokumen sumber yang digunakan untuk menghasilkan jawaban. Perhatikan bahwa kueri selanjutnya tidak secara eksplisit menyebutkan Amazon Kendra; Namun, ConversationalRetrievalChain (sejenis rantai yang merupakan bagian dari kerangka LangChain dan menyediakan mekanisme yang mudah untuk mengembangkan informasi berbasis aplikasi percakapan yang diambil dari instance retriever, yang digunakan dalam aplikasi LangChain ini), mengelola riwayat obrolan dan konteks untuk mendapatkan respons yang sesuai.

Perhatikan juga bahwa dalam tangkapan layar berikut, Amazon Kendra menemukan jawaban ekstraktif untuk kueri dan menciutkan dokumen teratas dengan kutipan. Kemudian LLM dapat menghasilkan jawaban yang lebih ringkas berdasarkan kutipan yang diambil ini.

Di bagian berikut, kami menjelajahi dua kasus penggunaan untuk menggunakan AI Generatif dengan Amazon Kendra.

Kasus penggunaan 1: AI generatif untuk perusahaan jasa keuangan

Organisasi keuangan membuat dan menyimpan data di berbagai repositori data, termasuk laporan keuangan, dokumen hukum, dan whitepaper. Mereka harus mematuhi peraturan dan pengawasan pemerintah yang ketat, yang berarti karyawan perlu menemukan informasi yang relevan, akurat, dan dapat dipercaya dengan cepat. Selain itu, mencari dan menggabungkan wawasan di berbagai sumber data tidak praktis dan rawan kesalahan. Dengan AI Generatif di AWS, pengguna dapat dengan cepat menghasilkan jawaban dari berbagai sumber dan jenis data, menyintesis jawaban yang akurat pada skala perusahaan.

Kami memilih solusi menggunakan Jurassic-21 Jumbo Instruct LLM dari Amazon Kendra dan AI2 Lab. Dengan Amazon Kendra, Anda dapat dengan mudah menyerap data dari berbagai sumber data seperti Amazon S3, situs web, dan ServiceNow. Kemudian Amazon Kendra menggunakan Jurassic-21 Jumbo Instruct LLM AI2 Lab untuk melakukan aktivitas inferensi pada data perusahaan seperti peringkasan data, pembuatan laporan, dan lainnya. Amazon Kendra menambah LLM untuk memberikan informasi yang akurat dan dapat diverifikasi kepada pengguna akhir, yang mengurangi masalah halusinasi dengan LLM. Dengan solusi yang diusulkan, analis keuangan dapat membuat keputusan lebih cepat dengan menggunakan data yang akurat untuk membangun portofolio yang terperinci dan komprehensif dengan cepat. Kami berencana untuk menyediakan solusi ini sebagai proyek sumber terbuka dalam waktu dekat.

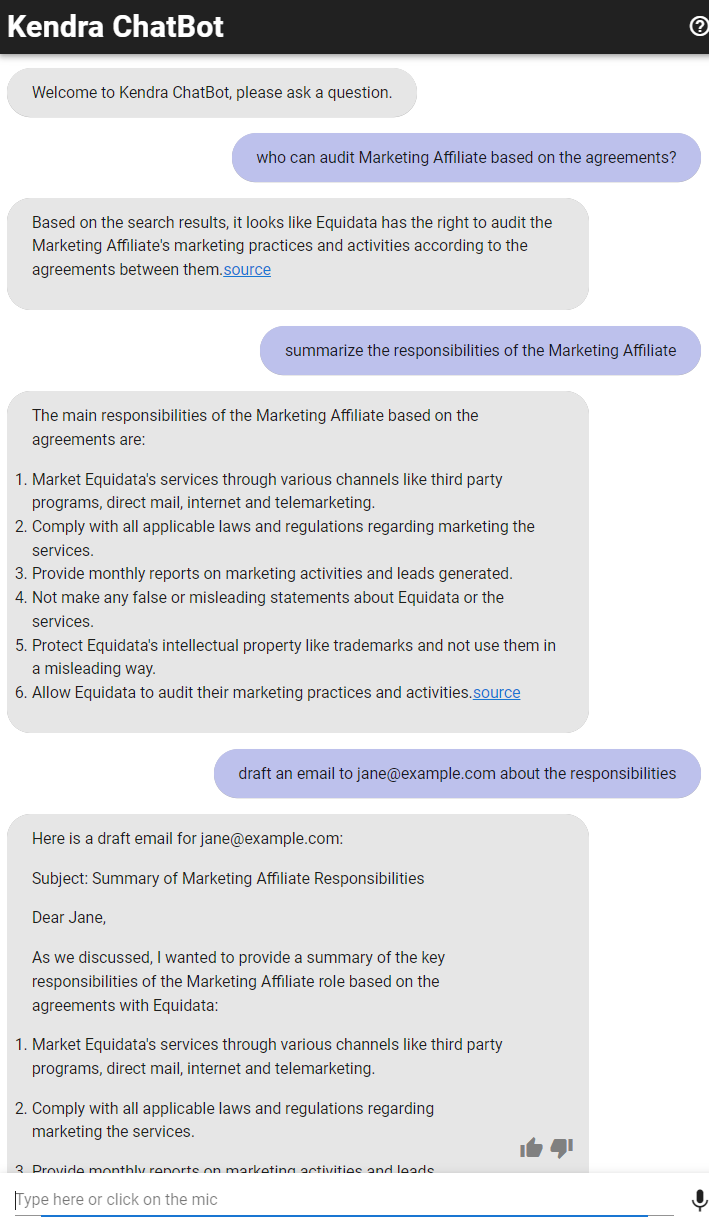

Contoh

Dengan menggunakan solusi Kendra Chatbot, analis keuangan dan auditor dapat berinteraksi dengan data perusahaan mereka (laporan dan perjanjian keuangan) untuk menemukan jawaban yang andal atas pertanyaan terkait audit. Kendra ChatBot memberikan jawaban beserta tautan sumber dan memiliki kemampuan untuk meringkas jawaban yang lebih panjang. Tangkapan layar berikut menunjukkan contoh percakapan dengan Kendra ChatBot.

Tinjauan arsitektur

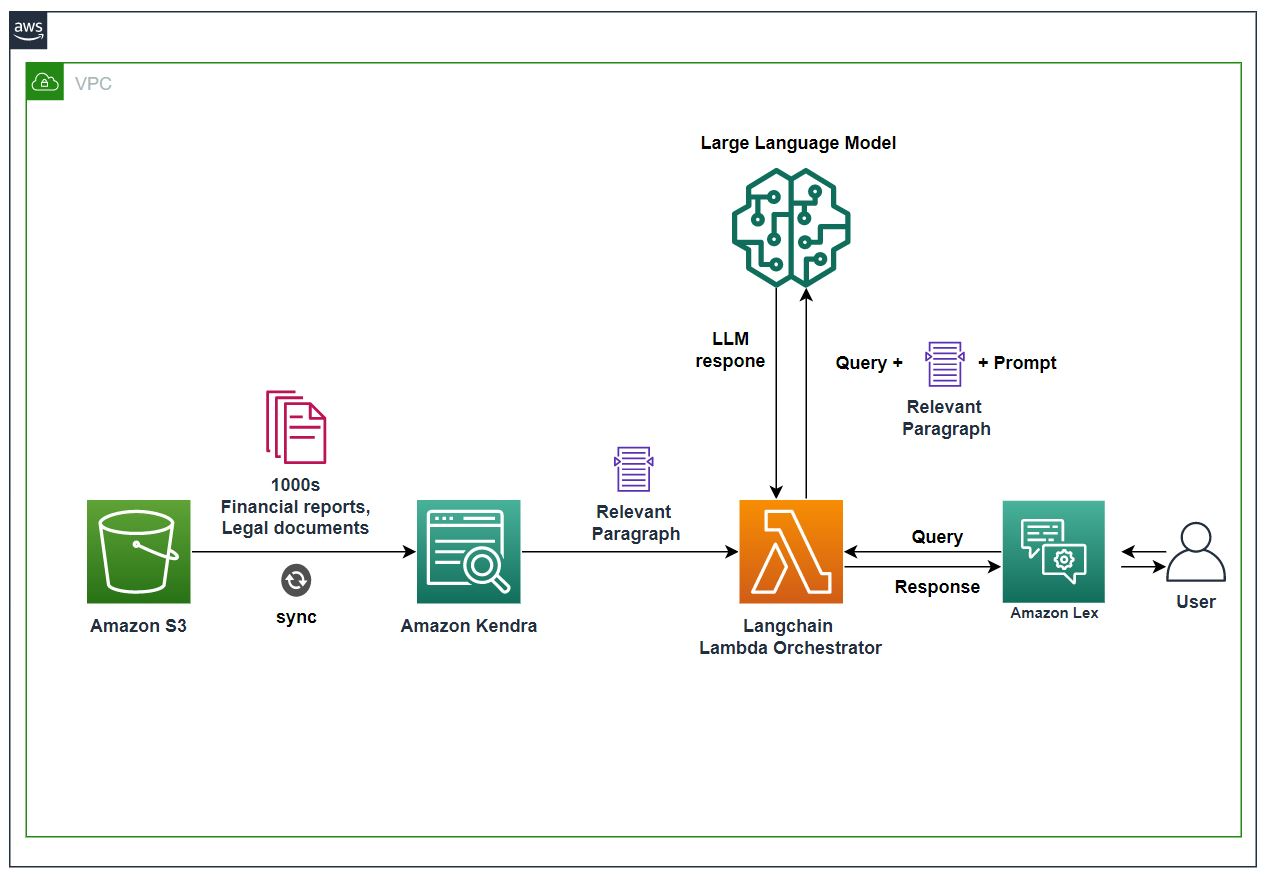

Diagram berikut menggambarkan arsitektur solusi.

Alur kerja meliputi langkah-langkah berikut:

- Dokumen dan perjanjian keuangan disimpan di Amazon S3, dan diserap ke indeks Amazon Kendra menggunakan konektor sumber data S3.

- LLM dihosting di titik akhir SageMaker.

- Chatbot Amazon Lex digunakan untuk berinteraksi dengan pengguna melalui UI web Amazon Lex.

- Penyelesaiannya menggunakan an AWS Lambda berfungsi dengan LangChain untuk mengatur antara Amazon Kendra, Amazon Lex, dan LLM.

- Saat pengguna meminta chatbot Amazon Lex untuk mendapatkan jawaban dari dokumen keuangan, Amazon Lex memanggil orkestra LangChain untuk memenuhi permintaan tersebut.

- Berdasarkan kueri, orkestra LangChain menarik catatan dan paragraf keuangan yang relevan dari Amazon Kendra.

- Orkestra LangChain memberikan catatan yang relevan ini ke LLM bersama dengan kueri dan prompt yang relevan untuk melakukan aktivitas yang diperlukan.

- LLM memproses permintaan dari orkestra LangChain dan mengembalikan hasilnya.

- Orkestra LangChain mendapatkan hasil dari LLM dan mengirimkannya ke pengguna akhir melalui chatbot Amazon Lex.

Kasus penggunaan 2: AI generatif untuk peneliti dan dokter kesehatan

Dokter dan peneliti sering menganalisis ribuan artikel dari jurnal medis atau situs web kesehatan pemerintah sebagai bagian dari penelitian mereka. Lebih penting lagi, mereka menginginkan sumber data tepercaya yang dapat mereka gunakan untuk memvalidasi dan memperkuat temuan mereka. Prosesnya membutuhkan berjam-jam penelitian intensif, analisis, dan sintesis data, memperpanjang waktu untuk nilai dan inovasi. Dengan AI Generatif di AWS, Anda dapat terhubung ke sumber data tepercaya dan menjalankan kueri bahasa natural untuk menghasilkan wawasan di seluruh sumber data tepercaya ini dalam hitungan detik. Anda juga dapat meninjau sumber yang digunakan untuk menghasilkan respons dan memvalidasi keakuratannya.

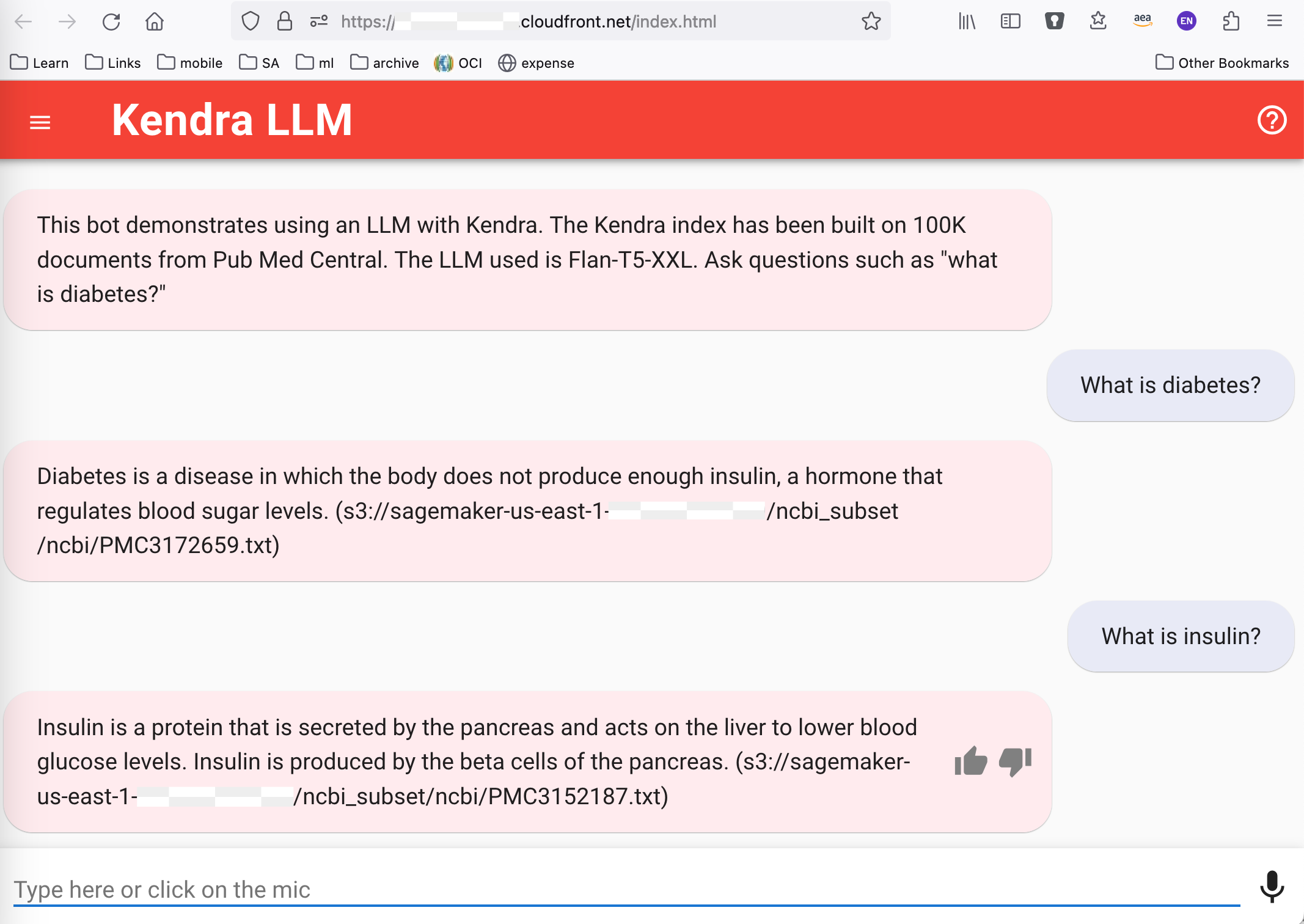

Kami memilih solusi menggunakan Amazon Kendra dan Flan-T5-XXL dari Hugging Face. Pertama, kami menggunakan Amazon Kendra untuk mengidentifikasi cuplikan teks dari dokumen yang relevan secara semantik di seluruh korpus. Kemudian kami menggunakan kekuatan LLM seperti Flan-T5-XXL untuk menggunakan cuplikan teks dari Amazon Kendra sebagai konteks dan mendapatkan jawaban bahasa alami yang ringkas. Dalam pendekatan ini, indeks Amazon Kendra berfungsi sebagai komponen pengambil bagian dalam mekanisme RAG. Terakhir, kami menggunakan Amazon Lex untuk mendukung ujung depan, memberikan pengalaman yang mulus dan responsif kepada pengguna akhir. Kami berencana untuk menyediakan solusi ini sebagai proyek sumber terbuka dalam waktu dekat.

Contoh

Tangkapan layar berikut berasal dari UI web yang dibuat untuk solusi menggunakan templat yang tersedia di GitHub. Teks berwarna merah muda adalah tanggapan dari sistem Amazon Kendra LLM, dan teks berwarna biru adalah pertanyaan pengguna.

Tinjauan arsitektur

Alur kerja arsitektur dan solusi untuk solusi ini mirip dengan use case 1.

Membersihkan

Untuk menghemat biaya, hapus semua sumber daya yang Anda gunakan sebagai bagian dari tutorial. Jika Anda meluncurkan tumpukan CloudFormation, Anda dapat menghapusnya melalui konsol AWS CloudFormation. Demikian pula, Anda dapat menghapus semua titik akhir SageMaker yang mungkin telah Anda buat melalui konsol SageMaker.

Kesimpulan

AI generatif yang didukung oleh model bahasa besar mengubah cara orang memperoleh dan menerapkan wawasan dari informasi. Namun, untuk kasus penggunaan perusahaan, wawasan harus dihasilkan berdasarkan konten perusahaan agar jawaban tetap dalam domain dan mengurangi halusinasi, menggunakan pendekatan Retrieval Augmented Generation. Dalam pendekatan RAG, kualitas wawasan yang dihasilkan oleh LLM bergantung pada relevansi semantik dari informasi yang diambil yang menjadi dasarnya, sehingga semakin perlu menggunakan solusi seperti Amazon Kendra yang memberikan hasil pencarian semantik berakurasi tinggi dari kotak. Dengan ekosistem konektor sumber data yang komprehensif, dukungan untuk format file umum, dan keamanan, Anda dapat dengan cepat mulai menggunakan solusi AI Generatif untuk kasus penggunaan perusahaan dengan Amazon Kendra sebagai mekanisme pengambilan.

Untuk informasi selengkapnya tentang bekerja dengan AI Generatif di AWS, lihat Mengumumkan Alat Baru untuk Membangun dengan AI Generatif di AWS. Anda dapat mulai bereksperimen dan membuat bukti konsep (POC) RAG untuk aplikasi GenAI perusahaan Anda, menggunakan metode yang dijelaskan di blog ini. Seperti disebutkan sebelumnya, sekali Batuan Dasar Amazon tersedia, kami akan menerbitkan blog tindak lanjut yang menunjukkan bagaimana Anda dapat membuat RAG menggunakan Amazon Bedrock.

Tentang penulis

Abhinav Jawadekar adalah Arsitek Solusi Utama yang berfokus pada Amazon Kendra dalam tim layanan bahasa AI/ML di AWS. Abhinav bekerja dengan pelanggan dan mitra AWS untuk membantu mereka membangun solusi pencarian cerdas di AWS.

Abhinav Jawadekar adalah Arsitek Solusi Utama yang berfokus pada Amazon Kendra dalam tim layanan bahasa AI/ML di AWS. Abhinav bekerja dengan pelanggan dan mitra AWS untuk membantu mereka membangun solusi pencarian cerdas di AWS.

Jean-Pierre Dodel adalah Manajer Produk Utama untuk Amazon Kendra dan memimpin kapabilitas produk strategis utama dan prioritas peta jalan. Dia membawa pengalaman Enterprise Search dan ML/AI yang ekstensif ke tim, dengan peran utama sebelumnya di Autonomy, HP, dan startup pencarian sebelum bergabung dengan Amazon 7 tahun lalu.

Jean-Pierre Dodel adalah Manajer Produk Utama untuk Amazon Kendra dan memimpin kapabilitas produk strategis utama dan prioritas peta jalan. Dia membawa pengalaman Enterprise Search dan ML/AI yang ekstensif ke tim, dengan peran utama sebelumnya di Autonomy, HP, dan startup pencarian sebelum bergabung dengan Amazon 7 tahun lalu.

Mithil Shah adalah Spesialis ML/AI di AWS. Saat ini dia membantu pelanggan sektor publik meningkatkan kehidupan masyarakat dengan membangun solusi Pembelajaran Mesin di AWS.

Mithil Shah adalah Spesialis ML/AI di AWS. Saat ini dia membantu pelanggan sektor publik meningkatkan kehidupan masyarakat dengan membangun solusi Pembelajaran Mesin di AWS.

Firaz Akmal adalah Manajer Produk Senior untuk Amazon Kendra di AWS. Dia adalah advokat pelanggan, membantu pelanggan memahami kasus penggunaan AI pencarian dan generatif mereka dengan Kendra di AWS. Di luar pekerjaan, Firaz senang menghabiskan waktu di pegunungan PNW atau menjelajahi dunia melalui sudut pandang putrinya.

Firaz Akmal adalah Manajer Produk Senior untuk Amazon Kendra di AWS. Dia adalah advokat pelanggan, membantu pelanggan memahami kasus penggunaan AI pencarian dan generatif mereka dengan Kendra di AWS. Di luar pekerjaan, Firaz senang menghabiskan waktu di pegunungan PNW atau menjelajahi dunia melalui sudut pandang putrinya.

Abhishek Maligehalli Shivalingaiah adalah Arsitek Solusi Layanan AI Senior di AWS dengan fokus pada Amazon Kendra. Dia bersemangat membangun aplikasi menggunakan Amazon Kendra, AI Generatif, dan NLP. Dia memiliki sekitar 10 tahun pengalaman dalam membangun solusi Data & AI untuk menciptakan nilai bagi pelanggan dan perusahaan. Dia telah membangun chatbot (pribadi) untuk bersenang-senang menjawab pertanyaan tentang karier dan perjalanan profesionalnya. Di luar pekerjaan, dia senang membuat potret keluarga & teman, dan suka membuat karya seni.

Abhishek Maligehalli Shivalingaiah adalah Arsitek Solusi Layanan AI Senior di AWS dengan fokus pada Amazon Kendra. Dia bersemangat membangun aplikasi menggunakan Amazon Kendra, AI Generatif, dan NLP. Dia memiliki sekitar 10 tahun pengalaman dalam membangun solusi Data & AI untuk menciptakan nilai bagi pelanggan dan perusahaan. Dia telah membangun chatbot (pribadi) untuk bersenang-senang menjawab pertanyaan tentang karier dan perjalanan profesionalnya. Di luar pekerjaan, dia senang membuat potret keluarga & teman, dan suka membuat karya seni.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/quickly-build-high-accuracy-generative-ai-applications-on-enterprise-data-using-amazon-kendra-langchain-and-large-language-models/

- :memiliki

- :adalah

- :Di mana

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 30

- 7

- 9

- a

- kemampuan

- Sanggup

- Tentang Kami

- mengakses

- Menurut

- Akun

- ketepatan

- tepat

- memperoleh

- di seluruh

- kegiatan

- kegiatan

- Ad

- Tambahan

- Selain itu

- mengikuti

- pengacara

- Setelah

- lagi

- agregasi

- silam

- perjanjian

- AI

- Layanan AI

- AI / ML

- Semua

- mengizinkan

- sepanjang

- juga

- Amazon

- Amazon EC2

- AmazonKendra

- AmazonLex

- antara

- an

- analisis

- Analis

- menganalisa

- dan

- menjawab

- jawaban

- Apa pun

- api

- KUNCI API

- Lebah

- aplikasi

- Aplikasi

- aplikasi

- Mendaftar

- pendekatan

- sesuai

- aplikasi

- arsitektur

- ADALAH

- sekitar

- artikel

- karya seni

- AS

- At

- auditor

- ditambah

- tersedia

- AWS

- Formasi AWS Cloud

- Biru langit

- kembali

- mendasarkan

- berdasarkan

- menampar

- BE

- makhluk

- Manfaat

- TERBAIK

- Lebih baik

- antara

- Blog

- Biru

- Kotak

- Membawa

- Browser

- membangun

- Bangunan

- dibangun di

- bundel

- by

- panggilan

- bernama

- Panggilan

- CAN

- kemampuan

- mampu

- Lowongan Kerja

- membawa

- kasus

- kasus

- rantai

- tantangan

- perubahan

- mengubah

- ChatBot

- pilihan

- Pilih

- memilih

- memilih

- Warga

- kelas

- menggabungkan

- datang

- Umum

- Perusahaan

- perusahaan

- menarik

- lengkap

- kompleks

- kompleksitas

- komponen

- luas

- menghitung

- konsep

- Terhubung

- konsul

- Konten

- konteks

- kontrol

- konvensional

- Percakapan

- percakapan

- AI percakapan

- Biaya

- membuat

- dibuat

- membuat

- kriteria

- kritis

- Sekarang

- pelanggan

- Layanan Pelanggan

- pelanggan

- data

- transaksi

- keputusan

- mendalam

- belajar mendalam

- mendemonstrasikan

- tergantung

- menyebarkan

- dikerahkan

- penyebaran

- merancang

- terperinci

- rincian

- mengembangkan

- Pengembang

- pengembang

- langsung

- dokumen

- dokumentasi

- dokumen

- domain

- Dont

- Terdahulu

- mudah

- Mudah

- mudah digunakan

- ekosistem

- editor

- Efektif

- Karyawan

- karyawan

- akhir

- Titik akhir

- insinyur

- Teknik

- memastikan

- Enter

- Enterprise

- perusahaan

- Seluruh

- Lingkungan Hidup

- kesalahan

- contoh

- Excel

- pengalaman

- Pengalaman

- mengalami

- keahlian

- menyelidiki

- ekspor

- luas

- Menghadapi

- keluarga

- lebih cepat

- merasa

- beberapa

- File

- File

- menyaring

- keuangan

- servis keuangan

- Menemukan

- menemukan

- Pertama

- aliran

- Fokus

- terfokus

- mengikuti

- diikuti

- berikut

- berikut

- Untuk

- Kerangka

- kerangka

- teman

- dari

- depan

- Ujung depan

- Memenuhi

- sepenuhnya

- kesenangan

- fungsi

- fungsi

- masa depan

- menghasilkan

- dihasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- mendapatkan

- GitHub

- Pemerintah

- membimbing

- Memiliki

- he

- Kesehatan

- kesehatan

- membantu

- membantu

- membantu

- di sini

- lebih tinggi

- sangat

- -nya

- sejarah

- host

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- ID

- mengenali

- identitas

- if

- menggambarkan

- Dampak

- melaksanakan

- mengimplementasikan

- mengimplementasikan

- penting

- memperbaiki

- ditingkatkan

- meningkatkan

- in

- memasukkan

- termasuk

- Termasuk

- makin

- indeks

- informasi

- Innovation

- memasukkan

- wawasan

- install

- diinstal

- contoh

- instruksi

- mengintegrasikan

- integrasi

- Cerdas

- berinteraksi

- interaktif

- bunga

- Antarmuka

- interface

- intuitif

- masalah

- IT

- NYA

- bergabung

- perjalanan

- jpg

- Menjaga

- kunci

- kunci-kunci

- pengetahuan

- Labs

- bahasa

- besar

- lebih besar

- diluncurkan

- meluncurkan

- peluncuran

- terkemuka

- Memimpin

- pengetahuan

- Meninggalkan

- Informasi

- 'like'

- MEMBATASI

- keterbatasan

- baris

- link

- linux

- Daftar

- hidup

- LLM

- lagi

- mac

- mesin

- Mesin belajar

- membuat

- MEMBUAT

- Membuat

- mengelola

- berhasil

- pengelolaan

- manajer

- mengelola

- Maksimalkan

- maksimum

- Mungkin..

- cara

- mekanisme

- medis

- Pelajari

- tersebut

- metode

- jutaan

- menit

- Mengurangi

- meringankan

- ML

- model

- model

- Modul

- lebih

- paling

- MS

- beberapa

- harus

- Alam

- Pengolahan Bahasa alami

- Dekat

- perlu

- Perlu

- kebutuhan

- New

- nLP

- tidak

- mengamati

- memperoleh

- of

- menawarkan

- ditawarkan

- Penawaran

- sering

- Oke

- on

- sekali

- ONE

- secara online

- hanya

- open source

- membuka

- Opsi

- or

- teknik mengatur musik

- organisasi

- Lainnya

- Lainnya

- kami

- di luar

- diuraikan

- keluaran

- di luar

- lebih

- Kelalaian

- sendiri

- bagian

- pasangan

- rekan

- bergairah

- Konsultan Ahli

- Izin

- pribadi

- perspektif

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- memainkan

- Populer

- portofolio

- Pos

- kekuasaan

- didukung

- disukai

- Utama

- Sebelumnya

- penentuan prioritas

- proses

- proses

- pengolahan

- Produk

- manajer produk

- produktifitas

- profesional

- proyek

- bukti

- diusulkan

- memberikan

- disediakan

- penyedia

- menyediakan

- menyediakan

- publik

- menerbitkan

- Menarik

- Ular sanca

- kualitas

- query

- Pertanyaan

- segera

- Peringkat

- menerima

- sarankan

- arsip

- mengurangi

- wilayah

- peraturan

- terkait

- relevansi

- relevan

- dapat diandalkan

- melaporkan

- laporan

- gudang

- permintaan

- membutuhkan

- wajib

- membutuhkan

- penelitian

- peneliti

- Sumber

- masing-masing

- tanggapan

- tanggapan

- responsif

- membatasi

- mengakibatkan

- Hasil

- Pengembalian

- ulasan

- peta jalan

- Peran

- peran

- Run

- berjalan

- s

- pembuat bijak

- Save

- Skala

- SDK

- mulus

- Pencarian

- mencari

- detik

- bagian

- sektor

- aman

- keamanan

- melihat

- terlihat

- mengirimkan

- senior

- Tanpa Server

- layanan

- Layanan

- set

- Pertunjukkan

- mirip

- Demikian pula

- Sederhana

- tunggal

- Situs

- Ukuran

- So

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- sumber

- sumber

- spesialis

- tertentu

- Pengeluaran

- tumpukan

- awal

- Startups

- state-of-the-art

- Pernyataan

- Laporan

- tinggal

- Langkah

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- Strategis

- mempersingkat

- Ketat

- studio

- selanjutnya

- seperti itu

- cocok

- meringkaskan

- mendukung

- Didukung

- Mendukung

- sistem

- tim

- Template

- terminal

- dari

- bahwa

- Grafik

- Sumber

- Dunia

- mereka

- Mereka

- kemudian

- dengan demikian

- karena itu

- Ini

- mereka

- ini

- itu

- ribuan

- tiga

- Melalui

- waktu

- untuk

- alat

- puncak

- secara tradisional

- mengubah

- Terpercaya

- terpercaya

- tutorial

- dua

- mengetik

- jenis

- khas

- ui

- pokok

- memahami

- pemahaman

- menggunakan

- gunakan case

- kasus penggunaan

- bekas

- Pengguna

- Pengguna

- menggunakan

- MENGESAHKAN

- nilai

- berbagai

- diverifikasi

- melalui

- Video

- menunggu

- ingin

- Cara..

- we

- jaringan

- situs web

- BAIK

- adalah

- Apa

- ketika

- yang

- Kertas putih

- akan

- Windows

- dengan

- tanpa

- Word

- Kerja

- kerja

- bekerja

- dunia

- yaml

- tahun

- penurut

- Kamu

- Anda

- zephyrnet.dll