Amazon SageMaker menyediakan berbagai pilihan infrastruktur machine learning (ML) dan opsi penerapan model untuk membantu memenuhi kebutuhan inferensi ML Anda. Ini adalah layanan yang dikelola sepenuhnya dan terintegrasi dengan alat MLOps sehingga Anda dapat bekerja untuk menskalakan penerapan model, mengurangi biaya inferensi, mengelola model secara lebih efektif dalam produksi, dan mengurangi beban operasional. SageMaker menyediakan banyak pilihan inferensi sehingga Anda dapat memilih opsi yang paling sesuai dengan beban kerja Anda.

CPU generasi baru menawarkan peningkatan kinerja yang signifikan dalam inferensi ML berkat instruksi bawaan khusus. Dalam posting ini, kami fokus pada bagaimana Anda dapat memanfaatkannya AWS Graviton3berbasis Amazon Elastic Compute Cloud (EC2) Instans C7g untuk membantu mengurangi biaya inferensi hingga 50% relatif terhadap instans EC2 yang sebanding untuk inferensi waktu-nyata di Amazon SageMaker. Kami menunjukkan bagaimana Anda dapat mengevaluasi kinerja inferensi dan mengalihkan beban kerja ML Anda ke instans AWS Graviton hanya dalam beberapa langkah.

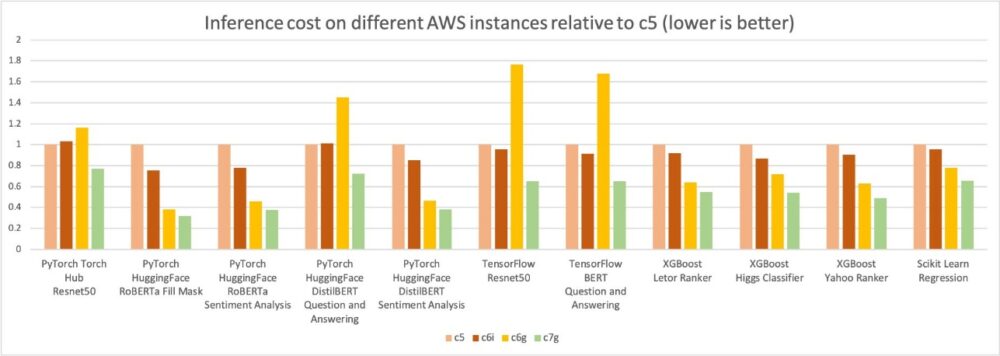

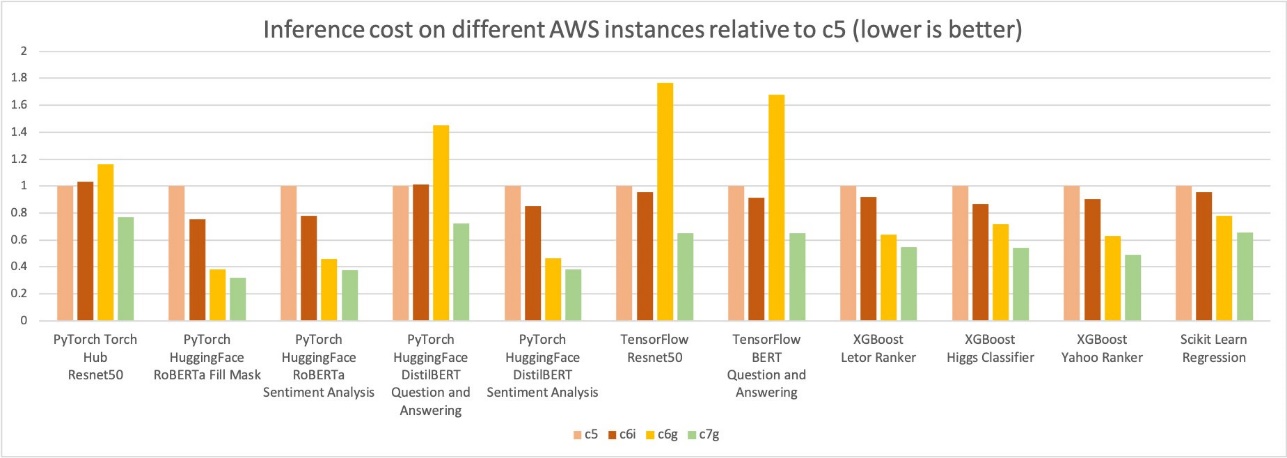

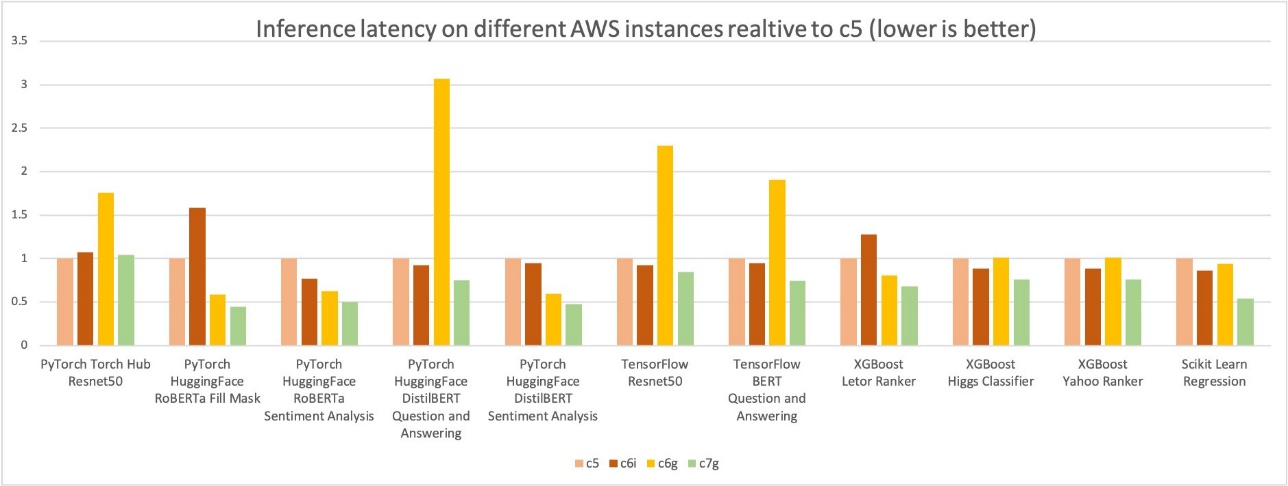

Untuk mencakup berbagai aplikasi pelanggan yang populer dan luas, dalam postingan ini kami membahas kinerja inferensi kerangka kerja PyTorch, TensorFlow, XGBoost, dan scikit-learn. Kami mencakup visi komputer (CV), pemrosesan bahasa alami (NLP), klasifikasi, dan skenario pemeringkatan untuk model dan contoh ml.c6g, ml.c7g, ml.c5, dan ml.c6i SageMaker untuk pembandingan.

Hasil benchmark

AWS mengukur penghematan biaya hingga 50% untuk PyTorch, TensorFlow, XGBoost, dan inferensi model scikit-learn dengan instans EC3 C2g berbasis AWS Graviton7 relatif terhadap instans EC2 yang sebanding di Amazon SageMaker. Pada saat yang sama, latensi inferensi juga berkurang.

Sebagai perbandingan, kami menggunakan empat jenis instans yang berbeda:

Keempat instans memiliki 16 vCPU dan memori 32 GiB.

Dalam grafik berikut, kami mengukur biaya per juta inferensi untuk empat jenis instans. Kami selanjutnya menormalkan biaya per juta hasil inferensi ke instans c5.4xlarge, yang diukur sebagai 1 pada sumbu Y bagan. Anda dapat melihat bahwa untuk model XGBoost, inferensi biaya per juta untuk c7g.4xlarge (AWS Graviton3) adalah sekitar 50% dari c5.4xlarge dan 40% dari c6i.4xlarge; untuk model NLP PyTorch, penghematan biaya sekitar 30–50% dibandingkan dengan instans c5 dan c6i.4xlarge. Untuk model dan kerangka kerja lain, kami mengukur penghematan biaya setidaknya 30% dibandingkan dengan instans c5 dan c6i.4xlarge.

Mirip dengan grafik perbandingan biaya inferensi sebelumnya, grafik berikut menunjukkan latensi model p90 untuk empat jenis instans yang sama. Kami selanjutnya menormalkan hasil latensi ke instans c5.4xlarge, yang diukur sebagai 1 pada sumbu Y bagan. Latensi inferensi model c7g.4xlarge (AWS Graviton3) hingga 50% lebih baik daripada latensi yang diukur pada c5.4xlarge dan c6i.4xlarge.

Bermigrasi ke instans AWS Graviton

Untuk menerapkan model Anda ke instans AWS Graviton, Anda dapat menggunakan Kontainer Pembelajaran Jauh AWS (DLC) atau bawa wadah sendiri yang kompatibel dengan arsitektur ARMv8.2.

Migrasi (atau penerapan baru) model Anda ke instans AWS Graviton sangat mudah karena AWS tidak hanya menyediakan wadah untuk menghosting model dengan PyTorch, TensorFlow, scikit-learn, dan XGBoost, tetapi modelnya juga agnostik secara arsitektural. Anda juga dapat membawa pustaka sendiri, tetapi pastikan penampung Anda dibuat dengan lingkungan yang mendukung arsitektur ARMv8.2. Untuk informasi lebih lanjut, lihat Membangun wadah algoritme Anda sendiri.

Anda harus menyelesaikan tiga langkah untuk menerapkan model Anda:

- Buat model SageMaker. Ini akan berisi, antara lain, informasi tentang lokasi file model, wadah yang akan digunakan untuk penerapan, dan lokasi skrip inferensi. (Jika Anda memiliki model yang sudah diterapkan dalam instans inferensi yang dioptimalkan komputasi, Anda dapat melewati langkah ini.)

- Buat konfigurasi titik akhir. Ini akan berisi informasi tentang jenis instans yang Anda inginkan untuk titik akhir (misalnya, ml.c7g.xlarge untuk AWS Graviton3), nama model yang Anda buat di langkah sebelumnya, dan jumlah instans per titik akhir.

- Luncurkan titik akhir dengan konfigurasi titik akhir yang dibuat pada langkah sebelumnya.

Untuk petunjuk rinci, lihat Jalankan beban kerja inferensi pembelajaran mesin pada instans berbasis AWS Graviton dengan Amazon SageMaker

Metodologi pembandingan

Kami menggunakan Rekomendasi Inferensi Amazon SageMaker untuk mengotomatiskan pembandingan kinerja di berbagai instans. Layanan ini membandingkan performa model ML Anda dalam hal latensi dan biaya pada berbagai instans serta merekomendasikan instans dan konfigurasi yang memberikan performa terbaik dengan biaya terendah. Kami telah mengumpulkan data kinerja tersebut menggunakan Inference Recommender. Untuk detail lebih lanjut, lihat GitHub repo.

Anda dapat menggunakan buku catatan sampel untuk menjalankan tolok ukur dan mereproduksi hasilnya. Kami menggunakan model berikut untuk pembandingan:

Kesimpulan

AWS mengukur penghematan biaya hingga 50% untuk PyTorch, TensorFlow, XGBoost, dan inferensi model scikit-learn dengan instans EC3 C2g berbasis AWS Graviton7 relatif terhadap instans EC2 yang sebanding di Amazon SageMaker. Anda dapat memigrasikan kasus penggunaan inferensi yang ada atau menerapkan model ML baru di AWS Graviton dengan mengikuti langkah-langkah yang diberikan dalam postingan ini. Anda juga dapat merujuk ke Panduan Teknis AWS Graviton, yang menyediakan daftar pustaka yang dioptimalkan dan praktik terbaik yang akan membantu Anda mencapai manfaat biaya dengan instans AWS Graviton di berbagai beban kerja.

Jika Anda menemukan kasus penggunaan di mana perolehan kinerja serupa tidak terlihat di AWS Graviton, harap hubungi kami. Kami akan terus menambahkan lebih banyak peningkatan kinerja untuk menjadikan AWS Graviton sebagai prosesor tujuan umum yang paling hemat biaya dan efisien untuk inferensi ML.

Tentang penulis

Sunita Nadampalli adalah Manajer Pengembangan Perangkat Lunak di AWS. Dia memimpin pengoptimalan kinerja perangkat lunak Graviton untuk pembelajaran mesin, HPC, dan beban kerja multimedia. Dia bersemangat tentang pengembangan sumber terbuka dan memberikan solusi perangkat lunak yang hemat biaya dengan Arm SoCs.

Sunita Nadampalli adalah Manajer Pengembangan Perangkat Lunak di AWS. Dia memimpin pengoptimalan kinerja perangkat lunak Graviton untuk pembelajaran mesin, HPC, dan beban kerja multimedia. Dia bersemangat tentang pengembangan sumber terbuka dan memberikan solusi perangkat lunak yang hemat biaya dengan Arm SoCs.

Jaymin Desai adalah Insinyur Pengembangan Perangkat Lunak dengan tim Inferensi Amazon SageMaker. Dia bersemangat membawa AI ke khalayak ramai dan meningkatkan kegunaan aset AI canggih dengan memproduksinya menjadi fitur dan layanan. Di waktu luangnya, ia menikmati menjelajahi musik dan bepergian.

Jaymin Desai adalah Insinyur Pengembangan Perangkat Lunak dengan tim Inferensi Amazon SageMaker. Dia bersemangat membawa AI ke khalayak ramai dan meningkatkan kegunaan aset AI canggih dengan memproduksinya menjadi fitur dan layanan. Di waktu luangnya, ia menikmati menjelajahi musik dan bepergian.

Mike Schneider adalah Pengembang Sistem, berbasis di Phoenix AZ. Dia adalah anggota wadah Deep Learning, mendukung berbagai gambar wadah Framework, termasuk Inferensi Graviton. Dia berdedikasi pada efisiensi dan stabilitas infrastruktur.

Mike Schneider adalah Pengembang Sistem, berbasis di Phoenix AZ. Dia adalah anggota wadah Deep Learning, mendukung berbagai gambar wadah Framework, termasuk Inferensi Graviton. Dia berdedikasi pada efisiensi dan stabilitas infrastruktur.

Mohan Gandhi adalah Insinyur Perangkat Lunak Senior di AWS. Dia telah bersama AWS selama 10 tahun terakhir dan telah bekerja di berbagai layanan AWS seperti EMR, EFA, dan RDS. Saat ini, dia berfokus pada peningkatan Pengalaman Inferensi SageMaker. Di waktu luangnya, ia menikmati hiking dan maraton.

Mohan Gandhi adalah Insinyur Perangkat Lunak Senior di AWS. Dia telah bersama AWS selama 10 tahun terakhir dan telah bekerja di berbagai layanan AWS seperti EMR, EFA, dan RDS. Saat ini, dia berfokus pada peningkatan Pengalaman Inferensi SageMaker. Di waktu luangnya, ia menikmati hiking dan maraton.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Ia menerima gelar Ph.D. dalam Operations Research setelah ia memecahkan rekening dana penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dijanjikannya. Saat ini ia membantu pelanggan dalam layanan keuangan dan industri asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, ia suka membaca dan mengajar.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Ia menerima gelar Ph.D. dalam Operations Research setelah ia memecahkan rekening dana penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dijanjikannya. Saat ini ia membantu pelanggan dalam layanan keuangan dan industri asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, ia suka membaca dan mengajar.

Wayne Toh adalah Arsitek Solusi Spesialis untuk Graviton di AWS. Dia berfokus untuk membantu pelanggan mengadopsi arsitektur ARM untuk beban kerja kontainer berskala besar. Sebelum bergabung dengan AWS, Wayne bekerja untuk beberapa vendor perangkat lunak besar, termasuk IBM dan Red Hat.

Wayne Toh adalah Arsitek Solusi Spesialis untuk Graviton di AWS. Dia berfokus untuk membantu pelanggan mengadopsi arsitektur ARM untuk beban kerja kontainer berskala besar. Sebelum bergabung dengan AWS, Wayne bekerja untuk beberapa vendor perangkat lunak besar, termasuk IBM dan Red Hat.

Lauren Mullennex adalah Arsitek Solusi yang berbasis di Denver, CO. Dia bekerja dengan pelanggan untuk membantu mereka merancang solusi di AWS. Di waktu luangnya, dia menikmati hiking dan memasak masakan Hawaii.

Lauren Mullennex adalah Arsitek Solusi yang berbasis di Denver, CO. Dia bekerja dengan pelanggan untuk membantu mereka merancang solusi di AWS. Di waktu luangnya, dia menikmati hiking dan memasak masakan Hawaii.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoAiStream. Kecerdasan Data Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Beli dan Jual Saham di Perusahaan PRE-IPO dengan PREIPO®. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 7

- 98

- a

- Tentang Kami

- Akun

- Mencapai

- di seluruh

- menambahkan

- mengambil

- Keuntungan

- Setelah

- AI

- algoritma

- sudah

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- antara

- an

- dan

- aplikasi

- arsitektur

- ADALAH

- ARM

- AS

- Aktiva

- At

- mengotomatisasikan

- AWS

- berdasarkan

- BE

- karena

- menjadi

- benchmarking

- Benchmark

- Manfaat

- TERBAIK

- Praktik Terbaik

- Lebih baik

- membawa

- luas

- Broke

- membangun

- dibangun di

- built-in

- beban

- tapi

- by

- CAN

- kasus

- Grafik

- klasifikasi

- awan

- CO

- sebanding

- dibandingkan

- perbandingan

- cocok

- lengkap

- menghitung

- komputer

- Visi Komputer

- konfigurasi

- mengandung

- Wadah

- Wadah

- terus

- Biaya

- penghematan biaya

- hemat biaya

- Biaya

- menutupi

- dibuat

- Sekarang

- pelanggan

- pelanggan

- data

- dedicated

- mendalam

- belajar mendalam

- menyampaikan

- mengantarkan

- Denver

- menyebarkan

- dikerahkan

- penyebaran

- terperinci

- rincian

- Pengembang

- Pengembangan

- berbeda

- membahas

- tidak

- dua

- efektif

- efisiensi

- efisien

- antara

- Titik akhir

- insinyur

- Lingkungan Hidup

- mengevaluasi

- contoh

- ada

- pengalaman

- Menjelajahi

- Gagal

- Fitur

- beberapa

- File

- keuangan

- servis keuangan

- Menemukan

- Fokus

- terfokus

- berfokus

- berikut

- Untuk

- empat

- Kerangka

- kerangka

- Gratis

- lebih lanjut

- Keuntungan

- tujuan umum

- Generasi

- memberikan

- memberikan

- grafik

- topi

- Memiliki

- he

- membantu

- membantu

- membantu

- dia

- -nya

- tuan rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HPC

- HTML

- HTTPS

- IBM

- if

- gambar

- perbaikan

- perbaikan

- meningkatkan

- in

- memasukkan

- Termasuk

- industri

- informasi

- Infrastruktur

- contoh

- instruksi

- asuransi

- Terintegrasi

- ke

- bergabung

- jpg

- hanya

- bahasa

- besar

- Terakhir

- Latensi

- Memimpin

- pengetahuan

- paling sedikit

- perpustakaan

- 'like'

- 'like

- Daftar

- tempat

- terendah

- mesin

- Mesin belajar

- membuat

- mengelola

- manajer

- massa

- Pelajari

- anggota

- Memori

- bermigrasi

- migrasi

- juta

- ML

- MLOps

- model

- model

- lebih

- paling

- multimedia

- beberapa

- musik

- nama

- Alam

- Pengolahan Bahasa alami

- Perlu

- kebutuhan

- New

- nLP

- Penghargaan Nobel

- jumlah

- of

- menawarkan

- on

- hanya

- open source

- operasional

- Operasi

- dioptimalkan

- pilihan

- Opsi

- or

- urutan

- Lainnya

- di luar

- sendiri

- parameter

- bergairah

- prestasi

- phoenix

- memilih

- plato

- Kecerdasan Data Plato

- Data Plato

- silahkan

- Populer

- Pos

- praktek

- sebelumnya

- Sebelumnya

- hadiah

- pengolahan

- Prosesor

- Produksi

- dijanjikan

- memberikan

- disediakan

- menyediakan

- pytorch

- jarak

- Peringkat

- mencapai

- Bacaan

- diterima

- merekomendasikan

- Merah

- Red Hat

- menurunkan

- mengurangi

- penelitian

- Hasil

- Run

- pembuat bijak

- Inferensi SageMaker

- sama

- Tabungan

- Skala

- skenario

- scikit-belajar

- melihat

- seleksi

- senior

- layanan

- Layanan

- beberapa

- dia

- Menunjukkan

- Pertunjukkan

- penting

- mirip

- So

- Perangkat lunak

- pengembangan perangkat lunak

- Software Engineer

- Solusi

- spesialis

- khusus

- Stabilitas

- state-of-the-art

- Langkah

- Tangga

- mudah

- pendukung

- Mendukung

- Beralih

- sistem

- Mengambil

- pengambilan

- Pengajaran

- tim

- Teknis

- tensorflow

- istilah

- dari

- bahwa

- Grafik

- informasi

- Mereka

- ini

- tiga

- waktu

- untuk

- alat

- Perjalanan

- mengetik

- jenis

- us

- kegunaan

- menggunakan

- bekas

- menggunakan

- berbagai

- vendor

- penglihatan

- ingin

- we

- jaringan

- layanan web

- BAIK

- yang

- akan

- dengan

- Kerja

- bekerja

- bekerja

- XGBoost

- tahun

- Kamu

- Anda

- zephyrnet.dll