Ini adalah postingan tamu yang ditulis bersama dengan tim kepemimpinan Iambic Therapeutics.

Terapi Iambik adalah startup penemuan obat dengan misi untuk menciptakan teknologi inovatif berbasis AI untuk memberikan obat-obatan yang lebih baik kepada pasien kanker, dengan lebih cepat.

Alat kecerdasan buatan (AI) generatif dan prediktif kami yang canggih memungkinkan kami mencari kemungkinan molekul obat dalam ruang yang luas dengan lebih cepat dan efektif. Teknologi kami serbaguna dan dapat diterapkan di seluruh bidang terapi, kelas protein, dan mekanisme aksi. Selain menciptakan alat AI yang berbeda, kami telah membangun platform terintegrasi yang menggabungkan perangkat lunak AI, data berbasis cloud, infrastruktur komputasi yang dapat diskalakan, dan kemampuan kimia dan biologi dengan throughput tinggi. Platform ini memungkinkan AI kami—dengan menyediakan data untuk menyempurnakan model kami—dan diaktifkan olehnya, memanfaatkan peluang untuk pengambilan keputusan dan pemrosesan data secara otomatis.

Kami mengukur keberhasilan dengan kemampuan kami menghasilkan kandidat klinis unggul untuk memenuhi kebutuhan pasien yang mendesak, dengan kecepatan yang belum pernah terjadi sebelumnya: kami berkembang dari peluncuran program menjadi kandidat klinis hanya dalam waktu 24 bulan, jauh lebih cepat dibandingkan pesaing kami.

Dalam posting ini, kami fokus pada cara kami menggunakannya tukang kayu on Layanan Amazon Elastic Kubernetes (Amazon EKS) untuk meningkatkan pelatihan dan inferensi AI, yang merupakan elemen inti dari platform penemuan Iambic.

Perlunya pelatihan dan inferensi AI yang terukur

Setiap minggu, Iambic melakukan inferensi AI pada lusinan model dan jutaan molekul, melayani dua kasus penggunaan utama:

- Ahli kimia obat dan ilmuwan lain menggunakan aplikasi web kami, Insight, untuk menjelajahi ruang kimia, mengakses dan menafsirkan data eksperimen, dan memprediksi sifat molekul yang baru dirancang. Semua pekerjaan ini dilakukan secara interaktif dan real-time, sehingga menciptakan kebutuhan akan inferensi dengan latensi rendah dan throughput sedang.

- Pada saat yang sama, model AI generatif kami secara otomatis merancang molekul yang menargetkan peningkatan di berbagai properti, mencari jutaan kandidat, dan memerlukan throughput yang sangat besar serta latensi sedang.

Dipandu oleh teknologi AI dan ahli pemburu obat-obatan, platform eksperimental kami menghasilkan ribuan molekul unik setiap minggunya, dan masing-masing molekul diuji secara biologis. Titik data yang dihasilkan secara otomatis diproses dan digunakan untuk menyempurnakan model AI kami setiap minggu. Awalnya, penyempurnaan model kami memerlukan waktu CPU berjam-jam, jadi kerangka kerja untuk penskalaan penyempurnaan model pada GPU sangat penting.

Model pembelajaran mendalam kami memiliki persyaratan yang tidak sepele: model tersebut berukuran gigabyte, banyak dan heterogen, serta memerlukan GPU untuk inferensi dan penyesuaian yang cepat. Dalam kaitannya dengan infrastruktur cloud, kami memerlukan sistem yang memungkinkan kami mengakses GPU, meningkatkan dan menurunkan skala dengan cepat untuk menangani beban kerja yang rumit dan heterogen, serta menjalankan image Docker berukuran besar.

Kami ingin membangun sistem yang skalabel untuk mendukung pelatihan dan inferensi AI. Kami menggunakan Amazon EKS dan mencari solusi terbaik untuk menskalakan node pekerja kami secara otomatis. Kami memilih Karpenter untuk penskalaan otomatis node Kubernetes karena sejumlah alasan:

- Kemudahan integrasi dengan Kubernetes, menggunakan semantik Kubernetes untuk menentukan persyaratan node dan spesifikasi pod untuk penskalaan

- Peningkatan skala node dengan latensi rendah

- Kemudahan integrasi dengan infrastruktur kami sebagai perkakas kode (Terraform)

Penyedia node mendukung integrasi yang mudah dengan Amazon EKS dan sumber daya AWS lainnya seperti Cloud komputasi elastis Amazon (Amazon EC2) instans dan Toko Blok Elastis Amazon volume. Semantik Kubernetes yang digunakan oleh penyedia mendukung penjadwalan terarah menggunakan konstruksi Kubernetes seperti noda atau toleransi dan spesifikasi afinitas atau anti-afinitas; mereka juga memfasilitasi kontrol atas jumlah dan jenis instans GPU yang mungkin dijadwalkan oleh Karpenter.

Ikhtisar solusi

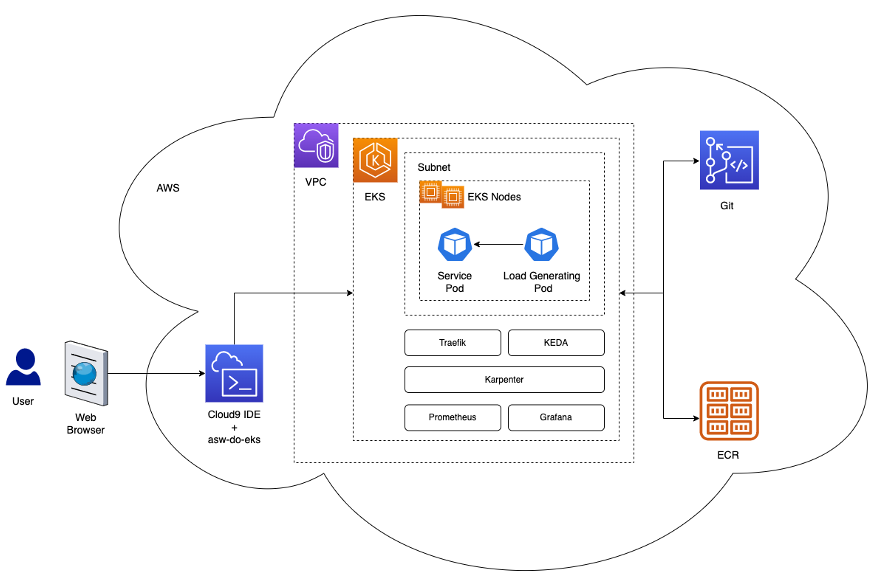

Di bagian ini, kami menyajikan arsitektur umum yang mirip dengan yang kami gunakan untuk beban kerja kami sendiri, yang memungkinkan penerapan model secara elastis menggunakan penskalaan otomatis yang efisien berdasarkan metrik khusus.

Diagram berikut menggambarkan arsitektur solusi.

Arsitektur menyebarkan a layanan sederhana di pod Kubernetes dalam an klaster EKS. Ini bisa berupa inferensi model, simulasi data, atau layanan dalam container lainnya, yang dapat diakses melalui permintaan HTTP. Layanan ini diekspos di balik penggunaan proxy terbalik Traefik. Proksi terbalik mengumpulkan metrik tentang panggilan ke layanan dan memaparkannya melalui API metrik standar Prometheus. Penskala Otomatis Berbasis Peristiwa Kubernetes (KEDA) dikonfigurasi untuk secara otomatis menskalakan jumlah pod layanan, berdasarkan metrik khusus yang tersedia di Prometheus. Di sini kami menggunakan jumlah permintaan per detik sebagai metrik khusus. Pendekatan arsitektur yang sama berlaku jika Anda memilih metrik yang berbeda untuk beban kerja Anda.

Karpenter memantau setiap pod tertunda yang tidak dapat berjalan karena kurangnya sumber daya yang memadai di cluster. Jika pod tersebut terdeteksi, Karpenter menambahkan lebih banyak node ke cluster untuk menyediakan sumber daya yang diperlukan. Sebaliknya, jika terdapat lebih banyak node dalam klaster daripada yang dibutuhkan oleh pod terjadwal, Karpenter akan menghapus beberapa node pekerja dan pod akan dijadwal ulang, sehingga mengkonsolidasikannya pada instance yang lebih sedikit. Jumlah permintaan HTTP per detik dan jumlah node dapat divisualisasikan menggunakan a grafana dasbor. Untuk mendemonstrasikan penskalaan otomatis, kami menjalankan satu atau beberapa pod penghasil beban sederhana, yang mengirim permintaan HTTP ke layanan menggunakan keriting.

Penerapan solusi

Dalam majalah panduan langkah demi langkah, kita gunakan AWS Cloud9 sebagai lingkungan untuk menyebarkan arsitektur. Ini memungkinkan semua langkah diselesaikan dari browser web. Anda juga dapat menyebarkan solusi dari komputer lokal atau instans EC2.

Untuk menyederhanakan penerapan dan meningkatkan reproduktifitas, kami mengikuti prinsip-prinsip kerangka kerja dan struktur templat bergantung pada buruh pelabuhan. Kami mengkloning aws-do-eks proyek dan, menggunakan Buruh pelabuhan, kami membuat gambar container yang dilengkapi dengan peralatan dan skrip yang diperlukan. Di dalam container, kami menjalankan semua langkah penelusuran end-to-end, mulai dari membuat cluster EKS dengan Karpenter hingga penskalaan instans EC2.

Untuk contoh pada postingan ini, kami menggunakan yang berikut ini Manifes klaster EKS:

apiVersion: eksctl.io/v1alpha5

kind: ClusterConfig

metadata:

name: do-eks-yaml-karpenter

version: '1.28'

region: us-west-2

tags:

karpenter.sh/discovery: do-eks-yaml-karpenter

iam:

withOIDC: true

addons:

- name: aws-ebs-csi-driver

version: v1.26.0-eksbuild.1

wellKnownPolicies:

ebsCSIController: true

managedNodeGroups:

- name: c5-xl-do-eks-karpenter-ng

instanceType: c5.xlarge

instancePrefix: c5-xl

privateNetworking: true

minSize: 0

desiredCapacity: 2

maxSize: 10

volumeSize: 300

iam:

withAddonPolicies:

cloudWatch: true

ebs: trueManifes ini mendefinisikan sebuah cluster bernama do-eks-yaml-karpenter dengan driver EBS CSI diinstal sebagai add-on. Grup simpul terkelola dengan dua c5.xlarge node disertakan untuk menjalankan pod sistem yang dibutuhkan oleh cluster. Node pekerja dihosting di subnet privat, dan titik akhir API klaster bersifat publik secara default.

Anda juga dapat menggunakan klaster EKS yang sudah ada daripada membuatnya. Kami menerapkan Karpenter dengan mengikuti instruksi dalam dokumentasi Karpenter, atau dengan menjalankan yang berikut ini naskah, yang mengotomatiskan instruksi penerapan.

Kode berikut menunjukkan konfigurasi Karpenter yang kita gunakan dalam contoh ini:

apiVersion: karpenter.sh/v1beta1

kind: NodePool

metadata:

name: default

spec:

template:

metadata: null

labels:

cluster-name: do-eks-yaml-karpenter

annotations:

purpose: karpenter-example

spec:

nodeClassRef:

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

name: default

requirements:

- key: karpenter.sh/capacity-type

operator: In

values:

- spot

- on-demand

- key: karpenter.k8s.aws/instance-category

operator: In

values:

- c

- m

- r

- g

- p

- key: karpenter.k8s.aws/instance-generation

operator: Gt

values:

- '2'

disruption:

consolidationPolicy: WhenUnderutilized

#consolidationPolicy: WhenEmpty

#consolidateAfter: 30s

expireAfter: 720h

---

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

metadata:

name: default

spec:

amiFamily: AL2

subnetSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

securityGroupSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

role: "KarpenterNodeRole-do-eks-yaml-karpenter"

tags:

app: autoscaling-test

blockDeviceMappings:

- deviceName: /dev/xvda

ebs:

volumeSize: 80Gi

volumeType: gp3

iops: 10000

deleteOnTermination: true

throughput: 125

detailedMonitoring: trueKami mendefinisikan Karpenter NodePool default dengan persyaratan berikut:

- Karpenter dapat meluncurkan instance dari keduanya

spotdanon-demandkumpulan kapasitas - Instance harus berasal dari “

c” (komputasi dioptimalkan), “m" (tujuan umum), "r” (memori dioptimalkan), atau “g"Dan"p” (akselerasi GPU) keluarga komputasi - Pembuatan instans harus lebih besar dari 2; Misalnya,

g3bisa diterima, tapig2tidak

NodePool default juga menentukan kebijakan gangguan. Node yang kurang dimanfaatkan akan dihapus sehingga pod dapat dikonsolidasikan agar berjalan pada node yang lebih sedikit atau lebih kecil. Alternatifnya, kita dapat mengonfigurasi node kosong untuk dihapus setelah jangka waktu yang ditentukan. Itu expireAfter pengaturan menentukan masa pakai maksimum node mana pun, sebelum dihentikan dan diganti jika perlu. Hal ini membantu mengurangi kerentanan keamanan serta menghindari masalah yang umum terjadi pada node dengan waktu aktif yang lama, seperti fragmentasi file atau kebocoran memori.

Secara default, Karpenter menyediakan node dengan volume root kecil, yang mungkin tidak cukup untuk menjalankan beban kerja AI atau pembelajaran mesin (ML). Beberapa image container deep learning mungkin berukuran puluhan GB, dan kita perlu memastikan terdapat cukup ruang penyimpanan pada node untuk menjalankan pod menggunakan image ini. Untuk melakukan itu, kami mendefinisikan EC2NodeClass dengan blockDeviceMappings, seperti yang ditunjukkan pada kode sebelumnya.

Karpenter bertanggung jawab atas penskalaan otomatis di tingkat cluster. Untuk mengonfigurasi penskalaan otomatis di tingkat pod, kami menggunakan KEDA untuk menentukan sumber daya khusus yang disebut ScaledObject, seperti yang ditunjukkan pada kode berikut:

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

name: keda-prometheus-hpa

namespace: hpa-example

spec:

scaleTargetRef:

name: php-apache

minReplicaCount: 1

cooldownPeriod: 30

triggers:

- type: prometheus

metadata:

serverAddress: http://prometheus- server.prometheus.svc.cluster.local:80

metricName: http_requests_total

threshold: '1'

query: rate(traefik_service_requests_total{service="hpa-example-php-apache-80@kubernetes",code="200"}[2m])Manifes sebelumnya mendefinisikan a ScaledObject bernama keda-prometheus-hpa, yang bertanggung jawab untuk menskalakan penerapan php-apache dan selalu menjaga setidaknya satu replika tetap berjalan. Ini menskalakan pod penerapan ini berdasarkan metrik http_requests_total tersedia di Prometheus yang diperoleh berdasarkan kueri yang ditentukan, dan menargetkan untuk meningkatkan skala pod sehingga setiap pod melayani tidak lebih dari satu permintaan per detik. Ini menurunkan skala replika setelah beban permintaan berada di bawah ambang batas selama lebih dari 30 detik.

Grafik spesifikasi penerapan untuk contoh layanan kami berisi yang berikut ini permintaan dan batasan sumber daya:

resources:

limits:

cpu: 500m

nvidia.com/gpu: 1

requests:

cpu: 200m

nvidia.com/gpu: 1Dengan konfigurasi ini, setiap pod layanan akan menggunakan satu GPU NVIDIA. Saat pod baru dibuat, pod tersebut akan berada dalam status Tertunda hingga GPU tersedia. Karpenter menambahkan node GPU ke cluster sesuai kebutuhan untuk mengakomodasi pod yang tertunda.

A pod penghasil beban mengirimkan permintaan HTTP ke layanan dengan frekuensi yang telah ditentukan sebelumnya. Kami meningkatkan jumlah permintaan dengan meningkatkan jumlah replika di penyebaran generator beban.

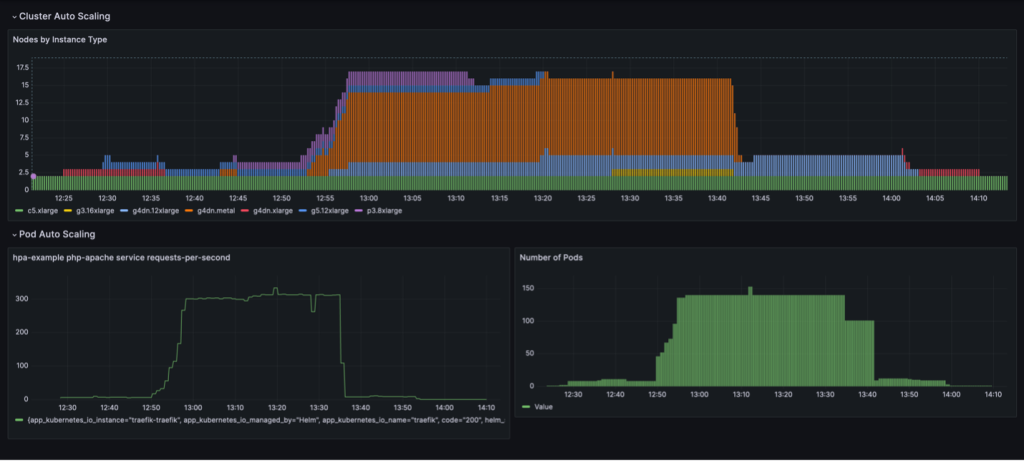

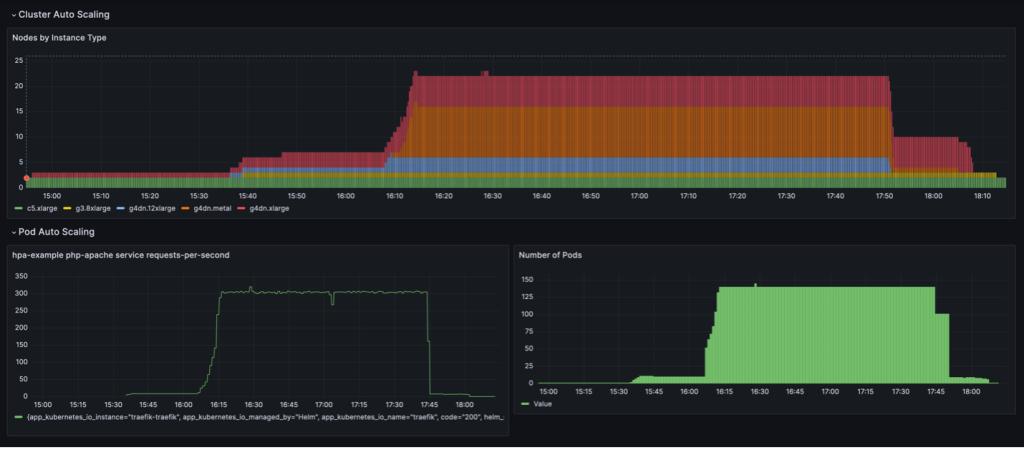

Siklus penskalaan penuh dengan konsolidasi node berbasis pemanfaatan divisualisasikan di dasbor Grafana. Dasbor berikut menunjukkan jumlah node dalam cluster berdasarkan jenis instance (atas), jumlah permintaan per detik (kiri bawah), dan jumlah pod (kanan bawah).

Kita mulai hanya dengan dua instance CPU c5.xlarge yang digunakan untuk membuat cluster. Lalu kami menerapkan satu instance layanan, yang memerlukan satu GPU. Karpenter menambahkan instance g4dn.xlarge untuk mengakomodasi kebutuhan ini. Kami kemudian menerapkan generator beban, yang menyebabkan KEDA menambahkan lebih banyak pod layanan dan Karpenter menambahkan lebih banyak instance GPU. Setelah pengoptimalan, status ditetapkan pada satu instans p3.8xlarge dengan 8 GPU dan satu instans g5.12xlarge dengan 4 GPU.

Saat kami menskalakan penerapan penghasil beban menjadi 40 replika, KEDA membuat pod layanan tambahan untuk mempertahankan beban permintaan yang diperlukan per pod. Karpenter menambahkan node g4dn.metal dan g4dn.12xlarge ke cluster guna menyediakan GPU yang diperlukan untuk pod tambahan. Dalam keadaan berskala, cluster berisi 16 node GPU dan melayani sekitar 300 permintaan per detik. Saat kami menurunkan skala generator beban menjadi 1 replika, proses sebaliknya terjadi. Setelah periode cooldown, KEDA mengurangi jumlah service pod. Kemudian ketika lebih sedikit pod yang berjalan, Karpenter menghapus node yang kurang dimanfaatkan dari cluster dan pod layanan dikonsolidasikan agar berjalan pada lebih sedikit node. Ketika pod generator beban dihapus, satu pod layanan pada satu instance g4dn.xlarge dengan 1 GPU tetap berjalan. Saat kami menghapus pod layanan juga, cluster akan dibiarkan dalam keadaan awal dengan hanya dua node CPU.

Kita dapat mengamati perilaku ini ketika NodePool memiliki pengaturannya consolidationPolicy: WhenUnderutilized.

Dengan pengaturan ini, Karpenter secara dinamis mengonfigurasi cluster dengan node sesedikit mungkin, sekaligus menyediakan sumber daya yang cukup untuk menjalankan semua pod dan juga meminimalkan biaya.

Perilaku penskalaan yang ditampilkan di dasbor berikut diamati ketika NodePool kebijakan konsolidasi ditetapkan ke WhenEmpty, bersama consolidateAfter: 30s.

Dalam skenario ini, node dihentikan hanya ketika tidak ada pod yang berjalan pada node tersebut setelah periode jeda. Kurva penskalaan tampak mulus, dibandingkan dengan kebijakan konsolidasi berbasis pemanfaatan; namun, dapat dilihat bahwa lebih banyak node yang digunakan dalam keadaan berskala (22 vs. 16).

Secara keseluruhan, menggabungkan penskalaan otomatis pod dan cluster memastikan bahwa cluster melakukan penskalaan secara dinamis sesuai dengan beban kerja, mengalokasikan sumber daya saat diperlukan dan menghapusnya saat tidak digunakan, sehingga memaksimalkan pemanfaatan dan meminimalkan biaya.

Hasil

Iambic menggunakan arsitektur ini untuk memungkinkan penggunaan GPU yang efisien di AWS dan memigrasikan beban kerja dari CPU ke GPU. Dengan menggunakan instans yang didukung GPU EC2, Amazon EKS, dan Karpenter, kami dapat mengaktifkan inferensi yang lebih cepat untuk model berbasis fisika dan waktu iterasi eksperimen yang cepat bagi ilmuwan terapan yang mengandalkan pelatihan sebagai layanan.

Tabel berikut merangkum beberapa metrik waktu migrasi ini.

| tugas | CPU | GPU |

| Inferensi menggunakan model difusi untuk model ML berbasis fisika | 3,600 detik |

100 detik (karena batching GPU yang melekat) |

| Pelatihan model ML sebagai layanan | 180 menit | 4 menit |

Tabel berikut merangkum beberapa metrik waktu dan biaya kami.

| tugas | Kinerja/Biaya | |

| CPU | GPU | |

| Pelatihan model ML |

240 menit rata-rata $0.70 per tugas pelatihan |

20 menit rata-rata $0.38 per tugas pelatihan |

Kesimpulan

Dalam postingan ini, kami menunjukkan bagaimana Iambic menggunakan Karpenter dan KEDA untuk menskalakan infrastruktur Amazon EKS kami guna memenuhi persyaratan latensi beban kerja inferensi dan pelatihan AI kami. Karpenter dan KEDA adalah alat sumber terbuka canggih yang membantu menskalakan kluster EKS dan beban kerja yang berjalan secara otomatis. Hal ini membantu mengoptimalkan biaya komputasi sekaligus memenuhi persyaratan kinerja. Anda dapat memeriksa kode dan menerapkan arsitektur yang sama di lingkungan Anda sendiri dengan mengikuti panduan lengkap di sini GitHub repo.

Tentang Penulis

Matius Welborn adalah direktur Pembelajaran Mesin di Iambic Therapeutics. Dia dan timnya memanfaatkan AI untuk mempercepat identifikasi dan pengembangan terapi baru, sehingga memberikan obat-obatan yang dapat menyelamatkan nyawa pasien dengan lebih cepat.

Matius Welborn adalah direktur Pembelajaran Mesin di Iambic Therapeutics. Dia dan timnya memanfaatkan AI untuk mempercepat identifikasi dan pengembangan terapi baru, sehingga memberikan obat-obatan yang dapat menyelamatkan nyawa pasien dengan lebih cepat.

Paul Whittemore adalah Insinyur Utama di Iambic Therapeutics. Dia mendukung penyediaan infrastruktur untuk platform penemuan obat yang digerakkan oleh AI Iambic.

Paul Whittemore adalah Insinyur Utama di Iambic Therapeutics. Dia mendukung penyediaan infrastruktur untuk platform penemuan obat yang digerakkan oleh AI Iambic.

Alex Iankoulski adalah Arsitek Solusi Utama, ML/AI Frameworks, yang berfokus membantu pelanggan mengatur beban kerja AI mereka menggunakan container dan mempercepat infrastruktur komputasi di AWS.

Alex Iankoulski adalah Arsitek Solusi Utama, ML/AI Frameworks, yang berfokus membantu pelanggan mengatur beban kerja AI mereka menggunakan container dan mempercepat infrastruktur komputasi di AWS.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/scale-ai-training-and-inference-for-drug-discovery-through-amazon-eks-and-karpenter/

- :memiliki

- :adalah

- :bukan

- ][P

- $NAIK

- 1

- 10

- 100

- 125

- 16

- 200

- 200m

- 22

- 24

- 26%

- 28

- 30

- 300

- 40

- 600

- 7

- 70

- 8

- 80

- a

- kemampuan

- Sanggup

- Tentang Kami

- mempercepat

- dipercepat

- diterima

- mengakses

- dapat diakses

- menampung

- di seluruh

- Tindakan

- menambahkan

- Tambahan

- Tambahan

- alamat

- Menambahkan

- maju

- afinitas

- Setelah

- AI

- Model AI

- Pelatihan AI

- Semua

- memungkinkan

- sepanjang

- juga

- selalu

- Amazon

- Amazon EC2

- Amazon Web Services

- an

- dan

- Apa pun

- api

- aplikasi

- muncul

- berlaku

- Aplikasi

- terapan

- berlaku

- pendekatan

- arsitektur

- arsitektur

- ADALAH

- daerah

- buatan

- kecerdasan buatan

- Kecerdasan buatan (AI)

- AS

- At

- mobil

- Otomatis

- mengotomatiskan

- secara otomatis

- tersedia

- menghindari

- AWS

- berdasarkan

- pengelompokan

- BE

- menjadi

- sebelum

- laku

- di belakang

- di bawah

- TERBAIK

- Lebih baik

- Luar

- biologi

- Memblokir

- kedua

- Bawah

- membawa

- Membawa

- Browser

- membangun

- tapi

- by

- bernama

- Panggilan

- CAN

- Kanker

- calon

- kemampuan

- Kapasitas

- memanfaatkan

- kasus

- penyebab

- memeriksa

- kimia

- kimia

- Pilih

- memilih

- kelas-kelas

- Klinis

- awan

- infrastruktur cloud

- Kelompok

- kode

- mengumpulkan

- menggabungkan

- dibandingkan

- pesaing

- lengkap

- Lengkap

- komputasi

- menghitung

- komputer

- komputasi

- konfigurasi

- dikonfigurasi

- konsolidasi

- konsolidasi

- konstruksi

- Wadah

- Wadah

- mengandung

- kontrol

- sebaliknya

- tenang

- Core

- Biaya

- Biaya

- bisa

- membuat

- dibuat

- menciptakan

- membuat

- CSI

- melengkung

- adat

- pelanggan

- siklus

- dasbor

- data

- titik data

- pengolahan data

- Pengambilan Keputusan

- mendalam

- belajar mendalam

- Default

- menetapkan

- Mendefinisikan

- pengiriman

- mendemonstrasikan

- menyebarkan

- penyebaran

- menyebarkan

- Mendesain

- dirancang

- terdeteksi

- Pengembangan

- diagram

- berbeda

- dibedakan

- Difusi

- diarahkan

- Kepala

- penemuan

- Gangguan

- do

- Buruh pelabuhan

- dokumentasi

- dilakukan

- turun

- puluhan

- didorong

- pengemudi

- obat

- dua

- dinamis

- setiap

- efektif

- efisien

- tanpa usaha

- elemen

- aktif

- diaktifkan

- memungkinkan

- ujung ke ujung

- Titik akhir

- insinyur

- besar sekali

- cukup

- Lingkungan Hidup

- lengkap

- mapan

- Acara

- Setiap

- persis

- contoh

- ada

- eksperimen

- eksperimental

- ahli

- menyelidiki

- terkena

- memudahkan

- FAST

- lebih cepat

- beberapa

- sedikit

- File

- Fokus

- berfokus

- mengikuti

- berikut

- Untuk

- fragmentasi

- Kerangka

- kerangka

- Frekuensi

- dari

- penuh

- Umum

- dihasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- generator

- mendapatkan

- GPU

- GPU

- lebih besar

- Kelompok

- Tamu

- tamu Post

- menangani

- Memiliki

- he

- membantu

- membantu

- membantu

- di sini

- -nya

- host

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- http

- HTTPS

- Identifikasi

- if

- menggambarkan

- gambar

- gambar

- imperatif

- memperbaiki

- perbaikan

- in

- termasuk

- Meningkatkan

- meningkatkan

- Infrastruktur

- inheren

- mulanya

- mulanya

- inovatif

- wawasan

- diinstal

- contoh

- sebagai gantinya

- instruksi

- terpadu

- integrasi

- Intelijen

- menafsirkan

- masalah

- IT

- perulangan

- jpg

- hanya

- terus

- kunci

- Jenis

- Label

- Kekurangan

- besar

- Latensi

- jalankan

- Kepemimpinan

- kebocoran

- pengetahuan

- paling sedikit

- meninggalkan

- Tingkat

- Leverage

- seumur hidup

- batas

- memuat

- lokal

- Panjang

- lagi

- mencari

- Rendah

- mesin

- Mesin belajar

- memelihara

- membuat

- MEMBUAT

- berhasil

- memaksimalkan

- maksimum

- Mungkin..

- mengukur

- mekanisme

- medium

- Pelajari

- pertemuan

- Memori

- bergabung

- Metadata

- logam

- metrik

- Metrik

- bermigrasi

- migrasi

- jutaan

- meminimalkan

- Misi

- ML

- model

- model

- monitor

- bulan

- lebih

- beberapa

- harus

- nama

- Bernama

- perlu

- Perlu

- dibutuhkan

- New

- baru saja

- tidak

- simpul

- node

- novel

- jumlah

- banyak sekali

- Nvidia

- mengamati

- diperoleh

- of

- on

- Sesuai Permintaan

- ONE

- hanya

- Buka

- open source

- operator

- Peluang

- optimasi

- Optimize

- dioptimalkan

- or

- Lainnya

- kami

- di luar

- lebih

- sendiri

- pasien

- pasien

- tertunda

- untuk

- prestasi

- melakukan

- periode

- Tempat

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- poin

- Kebijakan

- kebijaksanaan

- mungkin

- Pos

- didukung

- kuat

- mendahului

- meramalkan

- menyajikan

- primer

- Utama

- prinsip-prinsip

- swasta

- proses

- Diproses

- pengolahan

- menghasilkan

- program

- proyek

- properties

- Protein

- memberikan

- menyediakan

- wakil

- publik

- tujuan

- pertanyaan

- segera

- R

- nyata

- real-time

- alasan

- menurunkan

- mengurangi

- memperhalus

- wilayah

- mengandalkan

- sisa

- menghapus

- Dihapus

- menghapus

- menghapus

- diganti

- menjawab

- permintaan

- permintaan

- membutuhkan

- wajib

- Persyaratan

- membutuhkan

- sumber

- Sumber

- tanggung jawab

- membalikkan

- benar

- Peran

- akar

- Run

- berjalan

- sama

- terukur

- Skala

- skala ai

- diskalakan

- sisik

- skala

- skenario

- dijadwalkan

- penjadwalan

- ilmuwan

- script

- Pencarian

- mencari

- Kedua

- detik

- Bagian

- keamanan

- terlihat

- semantik

- mengirim

- mengirimkan

- Server

- melayani

- layanan

- Layanan

- porsi

- set

- pengaturan

- mengendap

- dipamerkan

- ditunjukkan

- Pertunjukkan

- signifikan

- mirip

- menyederhanakan

- simulasi

- tunggal

- Ukuran

- kecil

- lebih kecil

- kelancaran

- So

- Perangkat lunak

- larutan

- Solusi

- beberapa

- sumber

- Space

- spesifikasi

- ditentukan

- spesifikasi

- kecepatan

- Spot

- standar

- awal

- startup

- Negara

- Tangga

- terhenti

- penyimpanan

- struktur

- subnet

- sukses

- seperti itu

- cukup

- unggul

- memasok

- mendukung

- Mendukung

- yakin

- svc

- sistem

- tabel

- Dibutuhkan

- penargetan

- target

- tim

- Teknologi

- Template

- memiliki

- Terraform

- dari

- bahwa

- Grafik

- Negara

- mereka

- Mereka

- kemudian

- terapi

- Sana.

- dengan demikian

- Ini

- mereka

- ini

- ribuan

- ambang

- Melalui

- keluaran

- waktu

- kali

- untuk

- mengambil

- alat

- puncak

- Pelatihan

- benar

- dua

- mengetik

- jenis

- khas

- unik

- belum pernah terjadi sebelumnya

- sampai

- waktu aktif

- mendesak

- us

- menggunakan

- bekas

- menggunakan

- v1

- Nilai - Nilai

- Luas

- serba guna

- versi

- melalui

- volume

- volume

- vs

- Kerentanan

- walkthrough

- ingin

- adalah

- we

- jaringan

- aplikasi web

- web browser

- layanan web

- minggu

- BAIK

- adalah

- Apa

- Apa itu

- ketika

- yang

- sementara

- SIAPA

- akan

- dengan

- dalam

- Kerja

- pekerja

- yaml

- Kamu

- Anda

- zephyrnet.dll