KEBUN BINATANG Digital menyediakan layanan lokalisasi dan media menyeluruh untuk mengadaptasi konten TV dan film asli ke berbagai bahasa, wilayah, dan budaya. Hal ini membuat globalisasi lebih mudah bagi para pembuat konten terbaik dunia. Dipercaya oleh nama-nama besar di dunia hiburan, ZOO Digital menghadirkan layanan lokalisasi dan media berkualitas tinggi dalam skala besar, termasuk sulih suara, subtitle, pembuatan skrip, dan kepatuhan.

Alur kerja pelokalan pada umumnya memerlukan diarisasi speaker manual, yang mana aliran audio disegmentasi berdasarkan identitas pembicara. Proses yang memakan waktu ini harus diselesaikan sebelum konten dapat disulihsuarakan ke bahasa lain. Dengan metode manual, episode berdurasi 30 menit dapat memerlukan waktu antara 1–3 jam untuk dilokalisasi. Melalui otomatisasi, ZOO Digital bertujuan untuk mencapai lokalisasi dalam waktu kurang dari 30 menit.

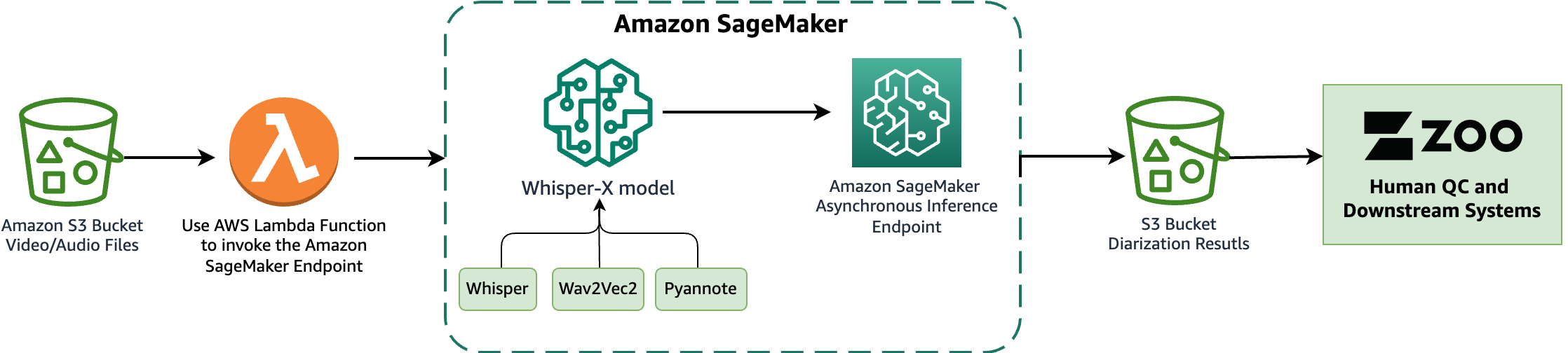

Dalam postingan ini, kami membahas penerapan model pembelajaran mesin (ML) yang dapat diskalakan untuk menggunakan konten media diarisasi Amazon SageMaker, dengan fokus pada BisikanX Model.

Latar Belakang

Visi ZOO Digital adalah menyediakan perputaran konten lokal yang lebih cepat. Tujuan ini terhambat oleh sifat intensif dari latihan yang dilakukan secara manual, ditambah dengan sedikitnya tenaga kerja yang terdiri dari orang-orang terampil yang dapat melokalisasi konten secara manual. ZOO Digital bekerja dengan lebih dari 11,000 pekerja lepas dan melokalkan lebih dari 600 juta kata pada tahun 2022 saja. Namun, pasokan tenaga terampil terbatas karena meningkatnya permintaan akan konten, sehingga memerlukan otomatisasi untuk membantu alur kerja pelokalan.

Dengan tujuan untuk mempercepat pelokalan alur kerja konten melalui pembelajaran mesin, ZOO Digital melibatkan AWS Prototyping, sebuah program investasi dari AWS untuk membangun beban kerja bersama dengan pelanggan. Keterlibatan ini berfokus pada pemberian solusi fungsional untuk proses pelokalan, sekaligus memberikan pelatihan langsung kepada pengembang ZOO Digital tentang SageMaker, Amazon Transkripsikan, dan Amazon Terjemahan.

Tantangan pelanggan

Setelah judul (film atau episode serial TV) ditranskripsi, pembicara harus ditetapkan ke setiap segmen pidato sehingga mereka dapat ditugaskan dengan benar ke artis suara yang berperan untuk memainkan karakter tersebut. Proses ini disebut diarisasi pembicara. ZOO Digital menghadapi tantangan untuk membuat harian konten dalam skala besar namun tetap layak secara ekonomi.

Ikhtisar solusi

Dalam prototipe ini, kami menyimpan file media asli di tempat yang ditentukan Layanan Penyimpanan Sederhana Amazon (Amazon S3) ember. Bucket S3 ini dikonfigurasi untuk memunculkan peristiwa ketika file baru terdeteksi di dalamnya, sehingga memicu AWS Lambda fungsi. Untuk petunjuk tentang cara mengonfigurasi pemicu ini, lihat tutorial Menggunakan pemicu Amazon S3 untuk memanggil fungsi Lambda. Selanjutnya, fungsi Lambda memanggil titik akhir SageMaker untuk inferensi menggunakan Klien Runtime Boto3 SageMaker.

Grafik BisikanX model, berdasarkan Bisikan OpenAI, melakukan transkripsi dan diarisasi untuk aset media. Itu dibangun di atas Bisikan Lebih Cepat implementasi ulang, menawarkan transkripsi hingga empat kali lebih cepat dengan penyelarasan stempel waktu tingkat kata yang lebih baik dibandingkan dengan Whisper. Selain itu, ia memperkenalkan diarisasi speaker, yang tidak ada pada model Whisper asli. WhisperX menggunakan model Whisper untuk transkripsi, yaitu Gelombang2Vec2 model untuk meningkatkan penyelarasan stempel waktu (memastikan sinkronisasi teks yang ditranskripsi dengan stempel waktu audio), dan catatan kecil model untuk diarisasi. FFmpeg digunakan untuk memuat audio dari media sumber, berbagai pendukung format media. Arsitektur model yang transparan dan modular memungkinkan fleksibilitas, karena setiap komponen model dapat ditukar sesuai kebutuhan di masa depan. Namun, penting untuk dicatat bahwa WhisperX tidak memiliki fitur manajemen penuh dan bukan merupakan produk tingkat perusahaan. Tanpa pemeliharaan dan dukungan, ini mungkin tidak cocok untuk penerapan produksi.

Dalam kolaborasi ini, kami menerapkan dan mengevaluasi WhisperX di SageMaker, menggunakan titik akhir inferensi asinkron untuk menampung model tersebut. Titik akhir asinkron SageMaker mendukung ukuran unggahan hingga 1 GB dan menggabungkan fitur penskalaan otomatis yang secara efisien memitigasi lonjakan lalu lintas dan menghemat biaya selama waktu di luar jam sibuk. Titik akhir asinkron sangat cocok untuk memproses file besar, seperti film dan serial TV dalam kasus penggunaan kami.

Diagram berikut mengilustrasikan elemen inti eksperimen yang kami lakukan dalam kolaborasi ini.

Di bagian berikut, kami mempelajari detail penerapan model WhisperX di SageMaker, dan mengevaluasi kinerja diarisasi.

Unduh model dan komponennya

WhisperX adalah sistem yang mencakup beberapa model untuk transkripsi, penyelarasan paksa, dan diarisasi. Untuk kelancaran operasi SageMaker tanpa perlu mengambil artefak model selama inferensi, semua artefak model harus diunduh terlebih dahulu. Artefak ini kemudian dimuat ke dalam wadah penyajian SageMaker selama inisiasi. Karena model ini tidak dapat diakses secara langsung, kami menawarkan deskripsi dan kode contoh dari sumber WhisperX, yang memberikan petunjuk tentang cara mengunduh model dan komponennya.

WhisperX menggunakan enam model:

Sebagian besar model ini dapat diperoleh dari Wajah Memeluk menggunakan perpustakaan huggingface_hub. Kami menggunakan yang berikut ini download_hf_model() berfungsi untuk mengambil artefak model ini. Token akses dari Hugging Face, yang dihasilkan setelah menerima perjanjian pengguna untuk model pyannote berikut, diperlukan:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Model VAD diambil dari Amazon S3, dan model Wav2Vec2 diambil dari modul torchaudio.pipelines. Berdasarkan kode berikut, kita dapat mengambil semua artefak model, termasuk artefak dari Hugging Face, dan menyimpannya ke direktori model lokal yang ditentukan:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Pilih AWS Deep Learning Container yang sesuai untuk menyajikan model

Setelah artefak model disimpan menggunakan kode sampel sebelumnya, Anda dapat memilih yang dibuat sebelumnya Kontainer Pembelajaran Jauh AWS (DLC) dari berikut ini GitHub repo. Saat memilih image Docker, pertimbangkan pengaturan berikut: kerangka kerja (Hugging Face), tugas (inferensi), versi Python, dan perangkat keras (misalnya, GPU). Kami merekomendasikan menggunakan gambar berikut: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 Gambar ini memiliki semua paket sistem yang diperlukan yang sudah diinstal sebelumnya, seperti ffmpeg. Ingatlah untuk mengganti [REGION] dengan Wilayah AWS yang Anda gunakan.

Untuk paket Python lain yang diperlukan, buat a requirements.txt file dengan daftar paket dan versinya. Paket-paket ini akan diinstal ketika AWS DLC dibuat. Berikut ini adalah paket tambahan yang diperlukan untuk menghosting model WhisperX di SageMaker:

Buat skrip inferensi untuk memuat model dan menjalankan inferensi

Selanjutnya kita membuat custom inference.py skrip untuk menguraikan bagaimana model WhisperX dan komponennya dimuat ke dalam kontainer dan bagaimana proses inferensi harus dijalankan. Skrip berisi dua fungsi: model_fn dan transform_fn. itu model_fn fungsi dipanggil untuk memuat model dari lokasinya masing-masing. Selanjutnya, model-model ini diteruskan ke transform_fn berfungsi selama inferensi, di mana proses transkripsi, penyelarasan, dan diarisasi dilakukan. Berikut ini adalah contoh kode untuk inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

Dalam direktori model, di samping requirements.txt file, pastikan keberadaan inference.py dalam subdirektori kode. Itu models direktori harus menyerupai berikut ini:

Buat tarball model

Setelah Anda membuat model dan direktori kode, Anda dapat menggunakan baris perintah berikut untuk mengompresi model menjadi tarball (file .tar.gz) dan mengunggahnya ke Amazon S3. Pada saat penulisan, dengan menggunakan model Large V2 yang berbisik lebih cepat, tarball yang dihasilkan yang mewakili model SageMaker berukuran 3 GB. Untuk informasi lebih lanjut, lihat Modelkan pola hosting di Amazon SageMaker, Bagian 2: Memulai penerapan model waktu nyata di SageMaker.

Buat model SageMaker dan terapkan titik akhir dengan prediktor asinkron

Sekarang Anda dapat membuat model SageMaker, konfigurasi titik akhir, dan titik akhir asinkron dengan Prediktor Asinkron menggunakan model tarball yang dibuat pada langkah sebelumnya. Untuk instruksi, lihat Buat Titik Akhir Inferensi Asinkron.

Evaluasi kinerja diarisasi

Untuk menilai kinerja diarisasi model WhisperX dalam berbagai skenario, kami memilih masing-masing tiga episode dari dua judul berbahasa Inggris: satu judul drama yang terdiri dari episode berdurasi 30 menit, dan satu judul dokumenter yang terdiri dari episode berdurasi 45 menit. Kami menggunakan perangkat metrik pyannote, pyannote.metrik, untuk menghitung tingkat kesalahan diarisasi (DER). Dalam evaluasi tersebut, transkrip yang ditranskrip secara manual dan diary yang disediakan oleh ZOO berfungsi sebagai kebenaran dasar.

Kami mendefinisikan DER sebagai berikut:

Total adalah durasi video kebenaran dasar. FA (Alarm Palsu) adalah panjang segmen yang dianggap sebagai ucapan dalam prediksi, namun tidak dalam kebenaran dasar. Kehilangan adalah panjang segmen yang dianggap sebagai ucapan dalam kebenaran dasar, namun tidak dalam prediksi. error, Juga disebut Kebingungan, adalah panjang segmen yang ditetapkan ke pembicara berbeda dalam prediksi dan kebenaran dasar. Semua unit diukur dalam hitungan detik. Nilai umum DER dapat bervariasi bergantung pada aplikasi spesifik, kumpulan data, dan kualitas sistem diarisasi. Perhatikan bahwa DER bisa lebih besar dari 1.0. DER yang lebih rendah lebih baik.

Untuk dapat menghitung DER suatu media, diperlukan diarisasi kebenaran dasar serta keluaran yang ditranskrip dan diary dari WhisperX. Ini harus diuraikan dan menghasilkan daftar tupel yang berisi label pembicara, waktu mulai segmen pidato, dan waktu berakhir segmen pidato untuk setiap segmen pidato di media. Label pembicara tidak harus cocok antara WhisperX dan diarisasi kebenaran dasar. Hasilnya sebagian besar didasarkan pada waktu segmen. pyannote.metrics mengambil tupel diarisasi kebenaran dasar dan diarisasi keluaran (disebut dalam dokumentasi pyannote.metrics sebagai referensi dan hipotesa) untuk menghitung DER. Tabel berikut merangkum hasil kami.

| Jenis Video | DER | Benar | Kehilangan | error | Alarm Salah |

| Drama | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Dokumenter | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Biasa saja | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Hasil ini menunjukkan perbedaan performa yang signifikan antara judul drama dan film dokumenter, dengan model yang mencapai hasil yang jauh lebih baik (menggunakan DER sebagai metrik agregat) untuk episode drama dibandingkan dengan judul dokumenter. Analisis lebih dekat terhadap judul-judul tersebut memberikan wawasan tentang faktor-faktor potensial yang berkontribusi terhadap kesenjangan kinerja ini. Salah satu faktor kuncinya adalah seringnya kehadiran musik latar yang tumpang tindih dengan ucapan dalam judul dokumenter. Meskipun pra-pemrosesan media untuk meningkatkan akurasi diarisasi, seperti menghilangkan kebisingan latar belakang untuk mengisolasi ucapan, berada di luar cakupan prototipe ini, hal ini membuka jalan untuk pekerjaan di masa depan yang berpotensi meningkatkan kinerja WhisperX.

Kesimpulan

Dalam postingan ini, kami mengeksplorasi kemitraan kolaboratif antara AWS dan ZOO Digital, menggunakan teknik pembelajaran mesin dengan SageMaker dan model WhisperX untuk meningkatkan alur kerja diarisasi. Tim AWS memainkan peran penting dalam membantu ZOO dalam membuat prototipe, mengevaluasi, dan memahami penerapan model ML kustom yang efektif, yang dirancang khusus untuk diarisasi. Ini termasuk menggabungkan penskalaan otomatis untuk skalabilitas menggunakan SageMaker.

Memanfaatkan AI untuk diarisasi akan menghasilkan penghematan besar baik dalam biaya maupun waktu saat membuat konten lokal untuk ZOO. Dengan membantu penyalin transkripsi dalam membuat dan mengidentifikasi pembicara dengan cepat dan tepat, teknologi ini mengatasi sifat tugas yang biasanya memakan waktu dan rawan kesalahan. Proses konvensional sering kali melibatkan beberapa kali melewati video dan langkah-langkah kontrol kualitas tambahan untuk meminimalkan kesalahan. Penerapan AI untuk diarisasi memungkinkan pendekatan yang lebih tepat sasaran dan efisien, sehingga meningkatkan produktivitas dalam jangka waktu yang lebih singkat.

Kami telah menguraikan langkah-langkah penting untuk menerapkan model WhisperX pada titik akhir asinkron SageMaker, dan mendorong Anda untuk mencobanya sendiri menggunakan kode yang disediakan. Untuk wawasan lebih lanjut tentang layanan dan teknologi ZOO Digital, kunjungi Situs resmi ZOO Digital. Untuk detail tentang penerapan model OpenAI Whisper di SageMaker dan berbagai opsi inferensi, lihat Host Model Whisper di Amazon SageMaker: menjelajahi opsi inferensi. Jangan ragu untuk membagikan pemikiran Anda di komentar.

Tentang Penulis

Ying Hou, PhD, adalah Arsitek Prototipe Pembelajaran Mesin di AWS. Bidang minat utamanya mencakup Pembelajaran Mendalam, dengan fokus pada GenAI, Computer Vision, NLP, dan prediksi data deret waktu. Di waktu luangnya, dia menikmati menghabiskan momen berkualitas bersama keluarganya, menyelami novel, dan hiking di taman nasional Inggris.

Ying Hou, PhD, adalah Arsitek Prototipe Pembelajaran Mesin di AWS. Bidang minat utamanya mencakup Pembelajaran Mendalam, dengan fokus pada GenAI, Computer Vision, NLP, dan prediksi data deret waktu. Di waktu luangnya, dia menikmati menghabiskan momen berkualitas bersama keluarganya, menyelami novel, dan hiking di taman nasional Inggris.

Ethan Cumberland adalah Insinyur Riset AI di ZOO Digital, tempat dia bekerja menggunakan AI dan Pembelajaran Mesin sebagai teknologi bantu untuk meningkatkan alur kerja dalam ucapan, bahasa, dan pelokalan. Dia memiliki latar belakang rekayasa perangkat lunak dan penelitian di bidang keamanan dan kepolisian, dengan fokus pada penggalian informasi terstruktur dari web dan memanfaatkan model ML sumber terbuka untuk menganalisis dan memperkaya data yang dikumpulkan.

Ethan Cumberland adalah Insinyur Riset AI di ZOO Digital, tempat dia bekerja menggunakan AI dan Pembelajaran Mesin sebagai teknologi bantu untuk meningkatkan alur kerja dalam ucapan, bahasa, dan pelokalan. Dia memiliki latar belakang rekayasa perangkat lunak dan penelitian di bidang keamanan dan kepolisian, dengan fokus pada penggalian informasi terstruktur dari web dan memanfaatkan model ML sumber terbuka untuk menganalisis dan memperkaya data yang dikumpulkan.

Gaurav Kaila memimpin tim AWS Prototyping untuk Inggris & Irlandia. Timnya bekerja dengan pelanggan di berbagai industri untuk membuat ide & bersama-sama mengembangkan beban kerja penting bisnis dengan mandat untuk mempercepat adopsi layanan AWS.

Gaurav Kaila memimpin tim AWS Prototyping untuk Inggris & Irlandia. Timnya bekerja dengan pelanggan di berbagai industri untuk membuat ide & bersama-sama mengembangkan beban kerja penting bisnis dengan mandat untuk mempercepat adopsi layanan AWS.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Sanggup

- mempercepat

- menerima

- mengakses

- dapat diakses

- ketepatan

- Mencapai

- mencapai

- di seluruh

- menyesuaikan

- Tambahan

- Selain itu

- alamat

- Adopsi

- Setelah

- agregat

- perjanjian

- AI

- ai penelitian

- tujuan

- bertujuan

- alarm

- meluruskan

- yang sejalan

- penjajaran

- Semua

- memungkinkan

- sendirian

- di samping

- juga

- Meskipun

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- Menganalisa

- analisis

- dan

- Lain

- Aplikasi

- pendekatan

- sesuai

- arsitektur

- ADALAH

- daerah

- Seniman

- AS

- menilai

- Aktiva

- ditugaskan

- membantu

- membantu

- At

- audio

- berwenang

- mobil

- Otomatisasi

- jalan

- AWS

- latar belakang

- berdasarkan

- BE

- karena

- menjadi

- sebelum

- makhluk

- TERBAIK

- Lebih baik

- antara

- Luar

- Terbesar

- BIN

- kedua

- dibangun di

- bisnis

- tapi

- by

- menghitung

- bernama

- CAN

- kasus

- menantang

- karakter

- Pilih

- lebih dekat

- kode

- kolaborasi

- kolaboratif

- komentar

- dibandingkan

- Lengkap

- pemenuhan

- komponen

- komponen

- diperparah

- komputer

- Visi Komputer

- dilakukan

- dikonfigurasi

- mengkonfigurasi

- Mempertimbangkan

- dianggap

- Terdiri dari

- Wadah

- mengandung

- Konten

- pencipta konten

- berkontribusi

- kontrol

- konvensional

- Core

- benar

- Biaya

- Biaya

- bisa

- membuat

- dibuat

- membuat

- pencipta

- kritis

- budaya

- adat

- pelanggan

- data

- mendalam

- belajar mendalam

- didefinisikan

- mengantarkan

- memberikan

- menggali

- Permintaan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- dirancang

- rincian

- terdeteksi

- pengembang

- alat

- diagram

- DICT

- perbedaan

- berbeda

- digital

- Digital

- langsung

- direktori

- direktori

- membahas

- beberapa

- Buruh pelabuhan

- dokumenter

- dokumentasi

- domain

- Dont

- Download

- download

- Drama

- dijuluki

- selama

- setiap

- mudah

- Efektif

- efisien

- efisien

- elemen

- lain

- embedding

- mempekerjakan

- memungkinkan

- mencakup

- mendorong

- akhir

- ujung ke ujung

- Titik akhir

- bertunangan

- interaksi

- insinyur

- Teknik

- Inggris

- mempertinggi

- memperkaya

- memastikan

- memastikan

- tingkat perusahaan

- Menghibur

- episode

- kesalahan

- kesalahan

- penting

- mengevaluasi

- dievaluasi

- mengevaluasi

- evaluasi

- Acara

- Setiap

- contoh

- Latihan

- eksperimen

- Dieksplorasi

- Menjelajahi

- Menghadapi

- wajah

- faktor

- faktor

- palsu

- keluarga

- lebih cepat

- Fitur

- merasa

- Sudah diambil

- File

- File

- keluwesan

- Fokus

- terfokus

- berfokus

- berikut

- berikut

- Untuk

- terpaksa

- empat

- Kerangka

- Gratis

- sering

- dari

- penuh

- fungsi

- fungsionil

- fungsi

- lebih lanjut

- masa depan

- celah

- genai

- dihasilkan

- menghasilkan

- mendapatkan

- GitHub

- globalisasi

- tujuan

- GPU

- Tanah

- hands-on

- Perangkat keras

- he

- dia

- berkualitas tinggi

- -nya

- tuan rumah

- tuan

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTML

- http

- HTTPS

- MemelukWajah

- mengidentifikasi

- identitas

- if

- menggambarkan

- gambar

- mengimpor

- memperbaiki

- ditingkatkan

- in

- termasuk

- termasuk

- Termasuk

- menggabungkan

- menggabungkan

- meningkatkan

- industri

- informasi

- inisiasi

- wawasan

- diinstal

- instruksi

- bunga

- ke

- Memperkenalkan

- investasi

- dipanggil

- melibatkan

- Irlandia

- IT

- NYA

- jpg

- json

- kunci

- faktor utama

- label

- Label

- bahasa

- Bahasa

- besar

- lebih besar

- memimpin

- Memimpin

- pengetahuan

- Panjang

- leveraging

- Perpustakaan

- baris

- Daftar

- daftar

- memuat

- pemuatan

- lokal

- Lokalisasi

- lokal

- lokasi

- mencatat

- penebangan

- Panjang

- menurunkan

- mesin

- Mesin belajar

- pemeliharaan

- MEMBUAT

- pengelolaan

- Mandat

- panduan

- manual

- Cocok

- Mungkin..

- Media

- Metadata

- metode

- metrik

- Metrik

- juta

- memperkecil

- menit

- Mengurangi

- ML

- model

- model

- modular

- Modul

- Waktu

- lebih

- kebanyakan

- film

- bioskop

- beberapa

- musik

- harus

- nama

- nama

- nasional

- Alam

- perlu

- Perlu

- dibutuhkan

- New

- nLP

- Kebisingan

- terutama

- mencatat

- diperoleh

- of

- menawarkan

- menawarkan

- resmi

- sering

- on

- ONE

- open source

- OpenAI

- membuka

- operasi

- Opsi

- or

- asli

- OS

- Lainnya

- kami

- di luar

- garis besar

- diuraikan

- keluaran

- output

- lebih

- paket

- bagian

- khususnya

- Kemitraan

- Lulus

- melewati

- path

- jalan

- pola

- Konsultan Ahli

- Melakukan

- prestasi

- dilakukan

- melakukan

- bagian

- pipa saluran

- sangat penting

- plato

- Kecerdasan Data Plato

- Data Plato

- Bermain

- dimainkan

- kepolisian

- Pos

- potensi

- berpotensi

- mendahului

- tepat

- ramalan

- Prediksi

- kehadiran

- menyajikan

- sebelumnya

- primer

- proses

- proses

- pengolahan

- Produk

- Produksi

- produktifitas

- program

- prototipe

- prototyping

- memberikan

- disediakan

- menyediakan

- menyediakan

- Ular sanca

- kualitas

- R

- Penilaian

- Baca

- nyata

- real-time

- sarankan

- lihat

- disebut

- wilayah

- daerah

- ingat

- menghapus

- menggantikan

- mewakili

- permintaan

- membutuhkan

- wajib

- Persyaratan

- penelitian

- itu

- mengakibatkan

- dihasilkan

- Hasil

- kembali

- Pengembalian

- mengungkapkan

- Peran

- Run

- berjalan

- runtime

- s

- pembuat bijak

- mencicipi

- Save

- disimpan

- Tabungan

- Skalabilitas

- terukur

- Skala

- skala

- skenario

- cakupan

- naskah

- detik

- bagian

- keamanan

- ruas

- segmentasi

- segmen

- terpilih

- memilih

- Seri

- yang telah dilayani

- Layanan

- porsi

- pengaturan

- Share

- dia

- harus

- penting

- Sederhana

- ENAM

- Ukuran

- ukuran

- terampil

- kecil

- kelancaran

- So

- Perangkat lunak

- rekayasa Perangkat Lunak

- larutan

- sumber

- Pembicara

- speaker

- tertentu

- Secara khusus

- ditentukan

- pidato

- Pengeluaran

- sepatu berduri

- awal

- mulai

- Langkah

- Tangga

- penyimpanan

- tersimpan

- Cerita

- aliran

- mempersingkat

- tersusun

- Kemudian

- besar

- seperti itu

- cocok

- menyediakan

- mendukung

- pendukung

- ditukar

- dengan cepat

- sinkronisasi

- sistem

- tabel

- Mengambil

- Dibutuhkan

- ditargetkan

- tugas

- tim

- teknik

- Teknologi

- Teknologi

- sementara

- teks

- dari

- bahwa

- Grafik

- Masa depan

- Inggris

- mereka

- Mereka

- kemudian

- dengan demikian

- Ini

- mereka

- ini

- itu

- tiga

- Melalui

- waktu

- Seri waktu

- membuang-buang waktu

- jangka waktu

- kali

- timestamp

- pengaturan waktu

- Judul

- judul

- untuk

- token

- mengambil

- toolkit

- obor

- secara tradisional

- lalu lintas

- Pelatihan

- jelas

- memicu

- memicu

- Terpercaya

- kebenaran

- mencoba

- tutorial

- tv

- dua

- khas

- Uk

- bawah

- selama 30

- pemahaman

- unit

- Memperbarui

- atas

- menggunakan

- gunakan case

- bekas

- Pengguna

- kegunaan

- menggunakan

- dimanfaatkan

- memanfaatkan

- Nilai - Nilai

- berbagai

- berbeda

- versi

- Versi

- giat

- Video

- penglihatan

- Mengunjungi

- Suara

- W

- adalah

- we

- jaringan

- layanan web

- BAIK

- ketika

- sementara

- Berbisik

- akan

- dengan

- dalam

- tanpa

- kata

- Kerja

- alur kerja

- Alur kerja

- Tenaga kerja

- bekerja

- dunia

- penulisan

- yaml

- Kamu

- Anda

- diri

- zephyrnet.dll

- KEBUN BINATANG