In questo post, mostriamo come configurare una nuova funzionalità di autenticazione basata su OAuth per l'utilizzo Fiocco di neve in Gestore di dati di Amazon SageMaker. Snowflake è una piattaforma di dati cloud che fornisce soluzioni di dati per il data warehousing alla scienza dei dati. Il fiocco di neve è un Partner dell'AWS con più accreditamenti AWS, comprese le competenze AWS in machine learning (ML), vendita al dettaglio, dati e analisi.

Data Wrangler semplifica la preparazione dei dati e il processo di progettazione delle funzionalità, riducendo il tempo necessario da settimane a minuti fornendo un'unica interfaccia visiva per i data scientist per selezionare e pulire i dati, creare funzionalità e automatizzare la preparazione dei dati nei flussi di lavoro ML senza scrivere alcun codice. È possibile importare dati da più origini dati, ad esempio Servizio di archiviazione semplice Amazon (Amazon S3), Amazzone Atena, Amazon RedShift, Amazon EMRe Fiocco di neve. Con questa nuova funzionalità, puoi utilizzare il tuo provider di identità (IdP) come Okta, Azure AD, o Ping Federato per connettersi a Snowflake tramite Data Wrangler.

Panoramica della soluzione

Nelle sezioni seguenti, forniamo i passaggi per un amministratore per configurare IdP, Snowflake e Studio. Descriviamo inoltre in dettaglio i passaggi che i data scientist possono eseguire per configurare il flusso di dati, analizzare la qualità dei dati e aggiungere trasformazioni dei dati. Infine, viene mostrato come esportare il flusso di dati e addestrare un modello utilizzando Pilota automatico SageMaker.

Prerequisiti

Per questa procedura dettagliata, è necessario disporre dei seguenti prerequisiti:

- Per l'amministratore:

- Un utente Snowflake con autorizzazioni per creare integrazioni di archiviazione e integrazioni di sicurezza in Snowflake.

- Un account AWS con autorizzazioni per la creazione Gestione dell'identità e dell'accesso di AWS (IAM) politiche e ruoli.

- Accesso e autorizzazioni per configurare IDP per registrare l'applicazione Data Wrangler e configurare il server di autorizzazione o l'API.

- Per il data scientist:

Configurazione dell'amministratore

Invece di chiedere agli utenti di inserire direttamente le proprie credenziali Snowflake in Data Wrangler, puoi fargli utilizzare un IdP per accedere a Snowflake.

I seguenti passaggi sono necessari per abilitare l'accesso OAuth di Data Wrangler a Snowflake:

- Configurare l'IdP.

- Configura fiocco di neve.

- Configura SageMaker Studio.

Configurare l'IdP

Per configurare il tuo IdP, devi registrare l'applicazione Data Wrangler e configurare il tuo server di autorizzazione o API.

Registrare l'applicazione Data Wrangler all'interno dell'IdP

Fare riferimento alla seguente documentazione per gli IdP supportati da Data Wrangler:

Utilizza la documentazione fornita dal tuo IdP per registrare la tua applicazione Data Wrangler. Le informazioni e le procedure presenti in questa sezione ti aiutano a comprendere come utilizzare correttamente la documentazione fornita dal tuo IdP.

Nelle sottosezioni sono richiamate personalizzazioni specifiche oltre ai passaggi nelle rispettive guide.

- Selezionare la configurazione che avvia il processo di registrazione di Data Wrangler come applicazione.

- Fornire agli utenti all'interno dell'IdP l'accesso a Data Wrangler.

- Abilita l'autenticazione del client OAuth archiviando le credenziali del client come segreto di Secrets Manager.

- Specifica un URL di reindirizzamento utilizzando il seguente formato:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Stai specificando l'ID dominio SageMaker e la regione AWS che stai utilizzando per eseguire Data Wrangler. Devi registrare un URL per ogni dominio e regione in cui esegui Data Wrangler. Gli utenti di un dominio e di una regione che non dispongono di URL di reindirizzamento configurati per loro non saranno in grado di autenticarsi con l'IdP per accedere alla connessione Snowflake.

- Assicurati che il codice di autorizzazione e i tipi di concessione del token di aggiornamento siano consentiti per la tua applicazione Data Wrangler.

Configurare il server di autorizzazione o l'API all'interno dell'IdP

All'interno del tuo IdP, devi configurare un server di autorizzazione o un'API (Application Programming Interface). Per ogni utente, il server di autorizzazione o l'API invia i token a Data Wrangler con Snowflake come destinatario.

Snowflake usa il concetto di ruoli distinti dai ruoli IAM utilizzati in AWS. È necessario configurare l'IdP per utilizzare ANY Role per utilizzare il ruolo predefinito associato all'account Snowflake. Ad esempio, se un utente ha systems administrator come ruolo predefinito nel loro profilo Snowflake, utilizza la connessione da Data Wrangler a Snowflake systems administrator come il ruolo.

Utilizza la seguente procedura per configurare il server di autorizzazione o l'API all'interno del tuo IdP:

- Dal tuo IdP, inizia il processo di configurazione del server o dell'API.

- Configurare il server di autorizzazione per utilizzare il codice di autorizzazione e aggiornare i tipi di concessione token.

- Specificare la durata del token di accesso.

- Imposta il timeout di inattività del token di aggiornamento.

Il timeout di inattività è il tempo in cui il token di aggiornamento scade se non viene utilizzato. Se stai pianificando lavori in Data Wrangler, ti consigliamo di aumentare il tempo di timeout di inattività rispetto alla frequenza del lavoro di elaborazione. In caso contrario, alcuni processi di elaborazione potrebbero non riuscire perché il token di aggiornamento è scaduto prima che potessero essere eseguiti. Quando il token di aggiornamento scade, l'utente deve eseguire nuovamente l'autenticazione accedendo alla connessione che ha effettuato a Snowflake tramite Data Wrangler.

Tieni presente che Data Wrangler non supporta la rotazione dei token di aggiornamento. L'utilizzo di token di aggiornamento rotanti potrebbe comportare errori di accesso o la necessità per gli utenti di accedere frequentemente.

Se il token di aggiornamento scade, gli utenti devono eseguire nuovamente l'autenticazione accedendo alla connessione che hanno effettuato a Snowflake tramite Data Wrangler.

- Specificare

session:role-anycome nuovo campo di applicazione.

Per Azure AD è necessario specificare anche un identificatore univoco per l'ambito.

Dopo aver configurato il provider OAuth, fornisci a Data Wrangler le informazioni necessarie per connettersi al provider. Puoi utilizzare la documentazione del tuo IdP per ottenere i valori per i seguenti campi:

- URL token – L'URL del token che l'IdP invia a Data Wrangler

- URL di autorizzazione – L'URL del server di autorizzazione dell'IdP

- ID cliente – L'ID dell'IdP

- Segreto del cliente – Il segreto riconosciuto solo dal server di autorizzazione o dall'API

- Ambito OAuth – Questo è solo per Azure AD

Configura fiocco di neve

Per configurare Snowflake, completare le istruzioni in Importa i dati da Snowflake.

Utilizza la documentazione di Snowflake per il tuo IdP per configurare un'integrazione OAuth esterna in Snowflake. Vedere la sezione precedente Registrare l'applicazione Data Wrangler all'interno dell'IdP per ulteriori informazioni su come configurare un'integrazione OAuth esterna.

Quando configuri l'integrazione della sicurezza in Snowflake, assicurati di attivarla external_oauth_any_role_mode.

Configura SageMaker Studio

Memorizzi i campi e i valori in un segreto di Secrets Manager e lo aggiungi alla configurazione del ciclo di vita di Studio che stai utilizzando per Data Wrangler. Una configurazione del ciclo di vita è uno script di shell che carica automaticamente le credenziali memorizzate nel segreto quando l'utente accede a Studio. Per informazioni sulla creazione di segreti, vedere Sposta i segreti hardcoded in AWS Secrets Manager. Per informazioni sull'utilizzo delle configurazioni del ciclo di vita in Studio, vedere Utilizza le configurazioni del ciclo di vita con Amazon SageMaker Studio.

Crea un segreto per le credenziali di Snowflake

Per creare il tuo segreto per le credenziali Snowflake, completa i seguenti passaggi:

- Nella console di Secrets Manager, selezionare Memorizza un nuovo segreto.

- Nel Tipo segreto, selezionare Altro tipo di segreto.

- Specifica i dettagli del tuo segreto come coppie chiave-valore.

I nomi delle chiavi richiedono lettere minuscole a causa della distinzione tra maiuscole e minuscole. Data Wrangler emette un avviso se uno di questi viene immesso in modo errato. Inserisci i valori segreti come coppie chiave-valore Chiave/valore, se lo desideri, oppure utilizza il plaintext opzione.

Di seguito è riportato il formato del segreto utilizzato per Okta. Se usi Azure AD, devi aggiungere il file datasource_oauth_scope campo.

- Aggiorna i valori precedenti con la tua scelta di IdP e le informazioni raccolte dopo la registrazione dell'applicazione.

- Scegli Avanti.

- Nel Nome segreto, aggiungi il prefisso

AmazonSageMaker(ad esempio, il nostro segreto èAmazonSageMaker-DataWranglerSnowflakeCreds). - Nel tag sezione, aggiungi un tag con la chiave

SageMakere valoretrue. - Scegli Avanti.

- Il resto dei campi è facoltativo; scegliere Avanti finché non avrai la possibilità di scegliere Negozio per conservare il segreto.

Dopo aver archiviato il segreto, si torna alla console Secrets Manager.

- Scegli il segreto appena creato, quindi recupera l'ARN del segreto.

- Memorizzalo nel tuo editor di testo preferito per utilizzarlo in seguito quando crei l'origine dati Data Wrangler.

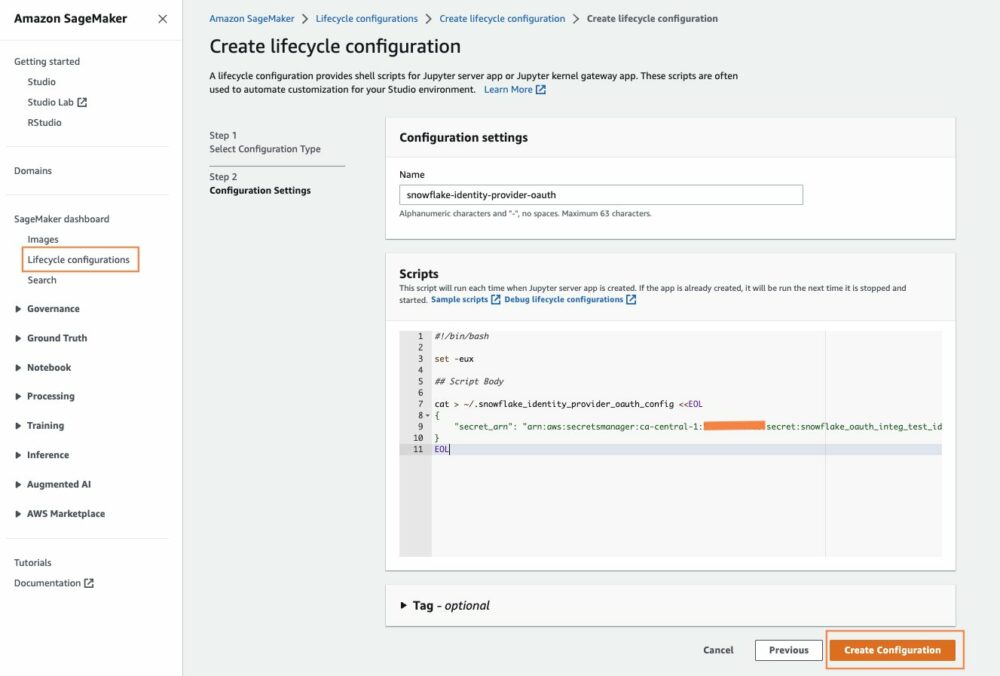

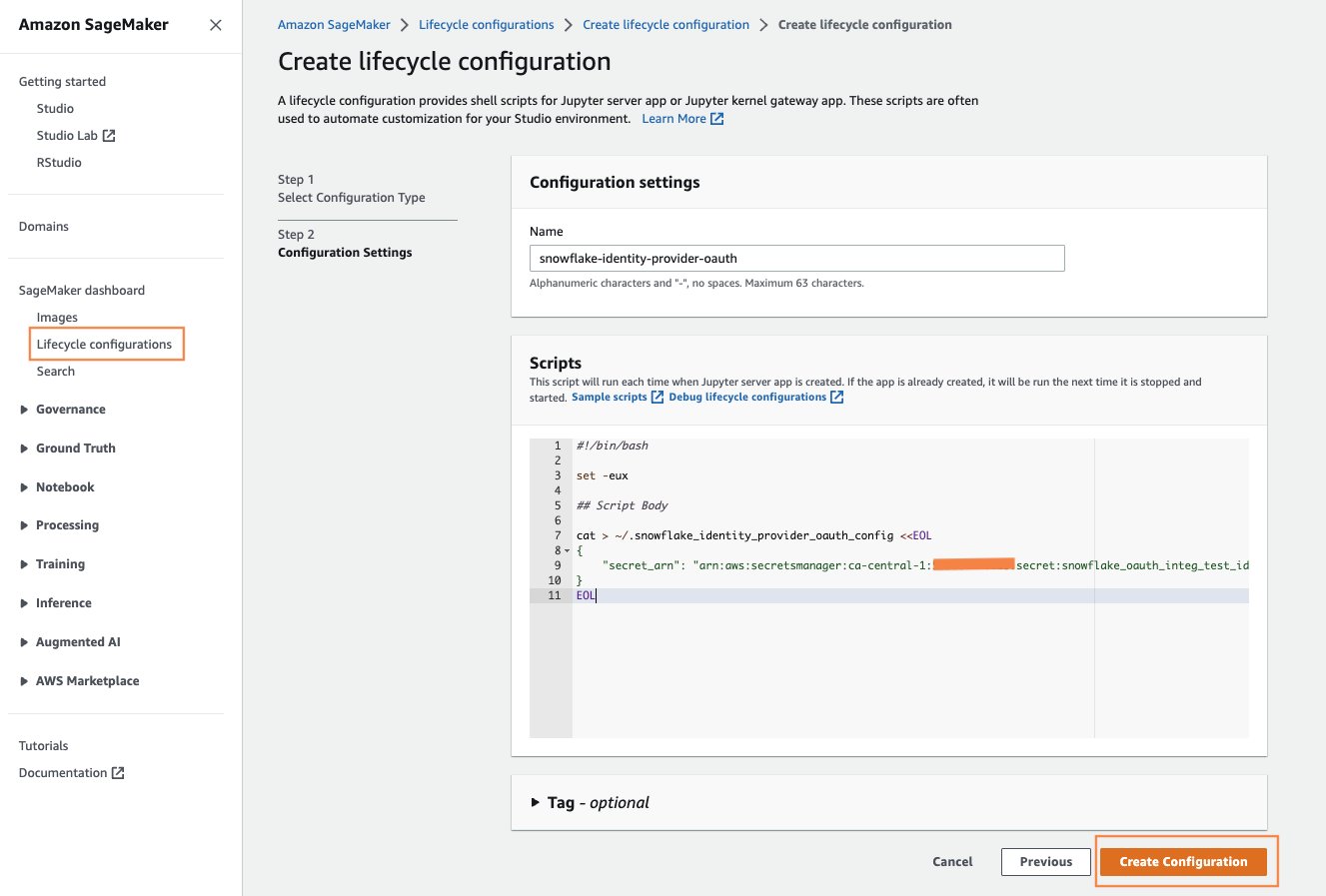

Crea una configurazione del ciclo di vita di Studio

Per creare una configurazione del ciclo di vita in Studio, completa i seguenti passaggi:

- Sulla console di SageMaker, scegli Configurazioni del ciclo di vita nel pannello di navigazione.

- Scegli Crea configurazione.

- Scegli Applicazione server Jupyter.

- Crea una nuova configurazione del ciclo di vita o aggiungine una esistente con il seguente contenuto:

La configurazione crea un file con il nome ".snowflake_identity_provider_oauth_config", contenente il segreto nella cartella Inizio dell'utente.

- Scegli Crea configurazione.

Imposta la configurazione del ciclo di vita predefinita

Completa i seguenti passaggi per impostare la configurazione del ciclo di vita appena creata come predefinita:

- Sulla console di SageMaker, scegli Domini nel pannello di navigazione.

- Scegli il dominio di Studio che utilizzerai per questo esempio.

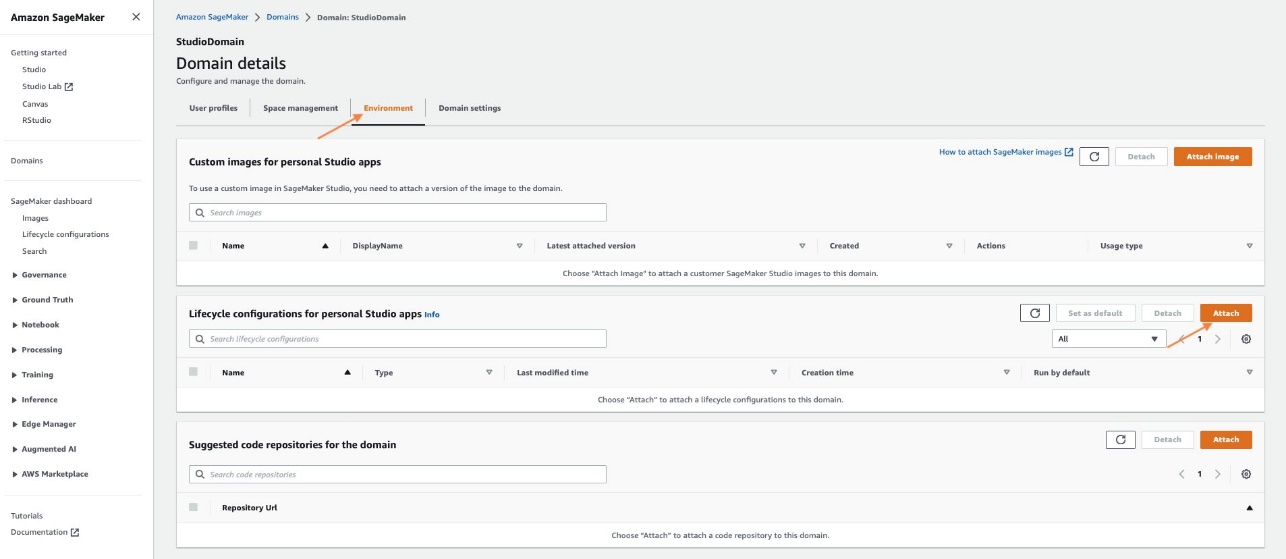

- Sulla Ambiente scheda, nel Configurazioni del ciclo di vita per le app personali di Studio sezione, scegliere allegare.

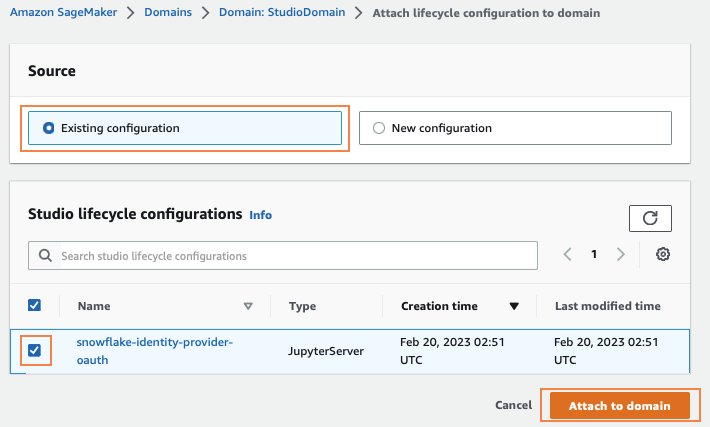

- Nel Fonte, selezionare Configurazione esistente.

- Seleziona la configurazione che hai appena creato, quindi scegli Allega al dominio.

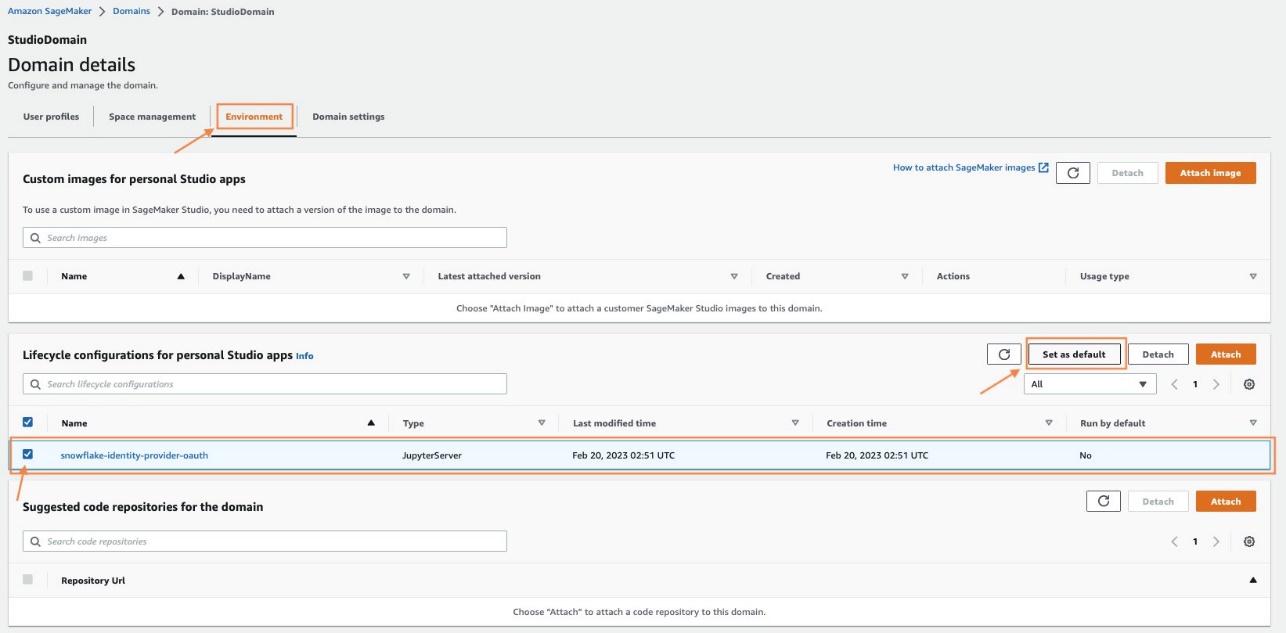

- Seleziona la nuova configurazione e scegli Imposta come predefinito, Quindi scegliere Imposta come predefinito di nuovo nel messaggio pop-up.

Le tue nuove impostazioni dovrebbero ora essere visibili sotto Configurazioni del ciclo di vita per le app personali di Studio come predefinito.

- Chiudi l'app Studio e riavviala per rendere effettive le modifiche.

Esperienza di data scientist

In questa sezione, spieghiamo come i data scientist possono connettersi a Snowflake come origine dati in Data Wrangler e preparare i dati per ML.

Crea un nuovo flusso di dati

Per creare il tuo flusso di dati, completa i seguenti passaggi:

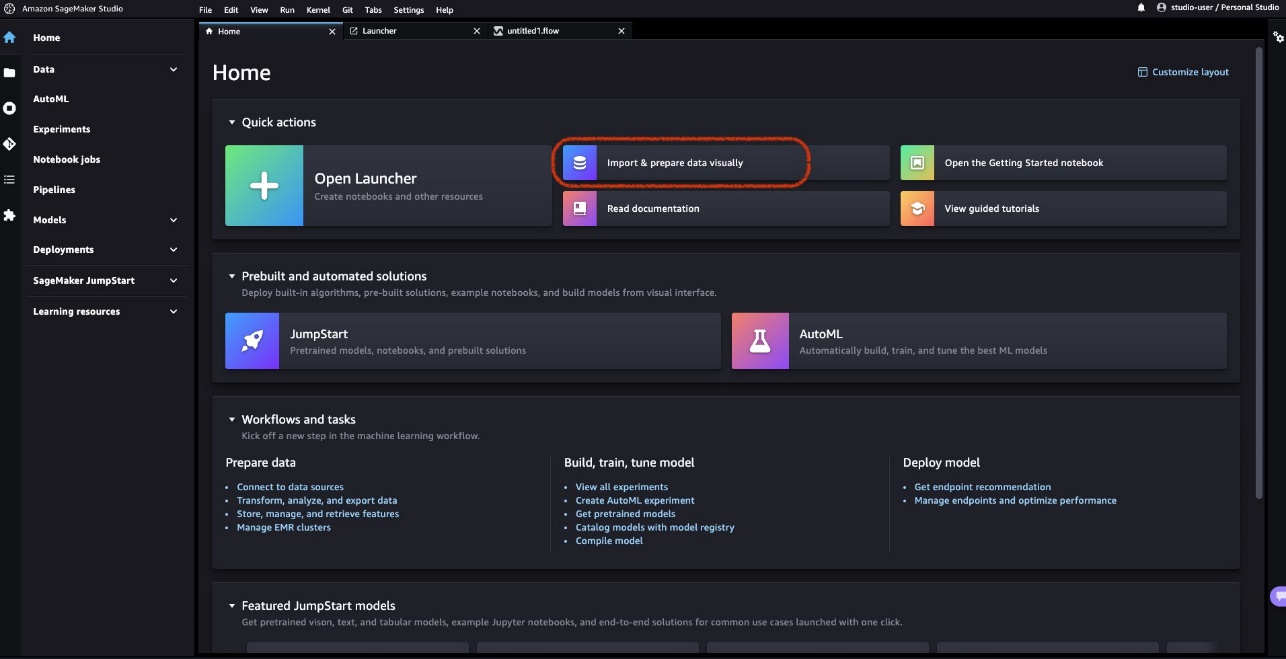

- Sulla console di SageMaker, scegli Amazon Sage Maker Studio nel pannello di navigazione.

- Scegli Apri Studio.

- Sullo Studio Casa pagina, scegli Importa e prepara visivamente i dati. In alternativa, sul Compila il menu a discesa, scegli New, Quindi scegliere SageMaker Data Wrangler Flusso.

La creazione di un nuovo flusso può richiedere alcuni minuti.

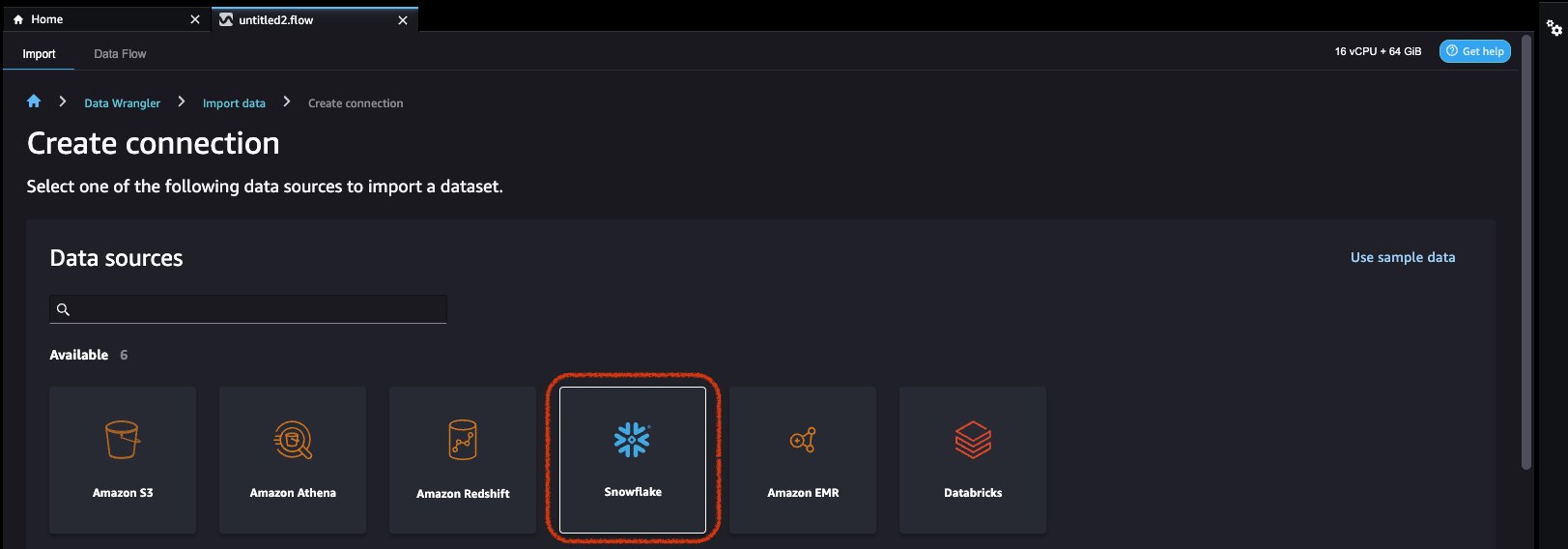

- Sulla Importa le date pagina, scegli Crea connessione.

- Scegli Fiocco di neve dall'elenco delle origini dati.

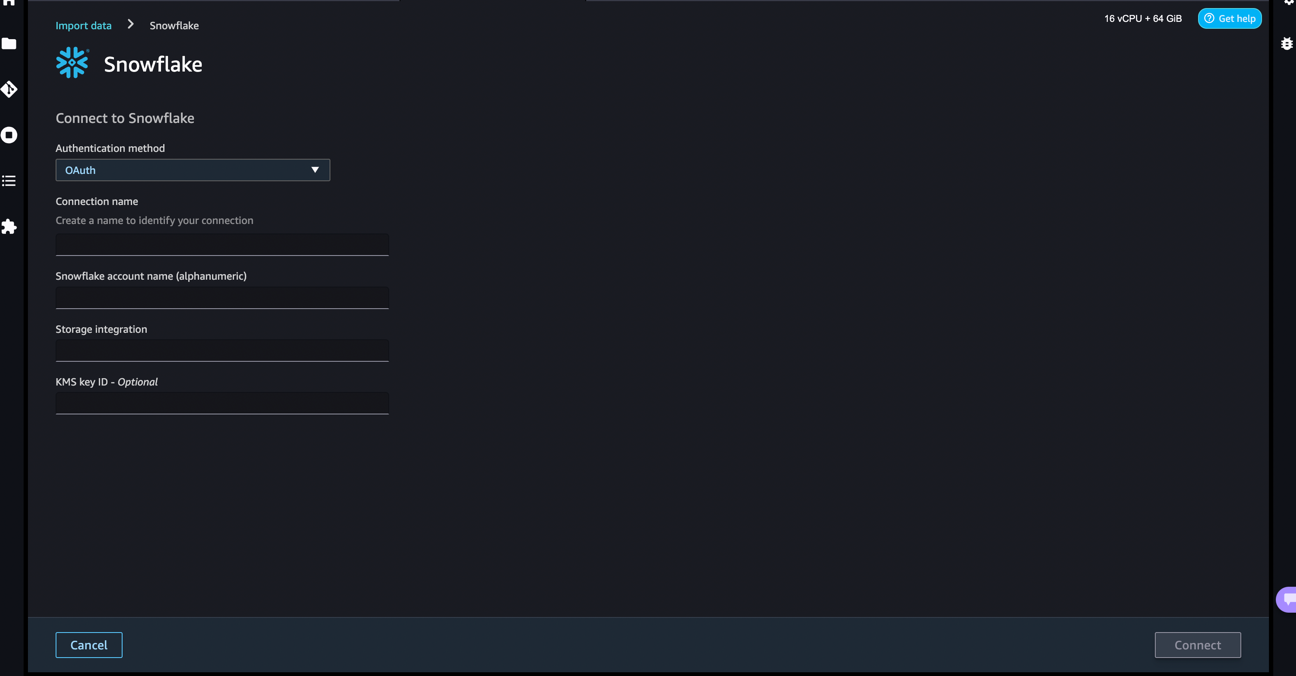

- Nel Metodo di autenticazionescegli OAuth.

Se non vedi OAuth, verifica i passaggi precedenti della configurazione del ciclo di vita.

- Inserisci i dettagli per Nome dell'account Snowflake ed Integrazione di archiviazione.

- Immettere un nome per la connessione e scegliere Connettiti.

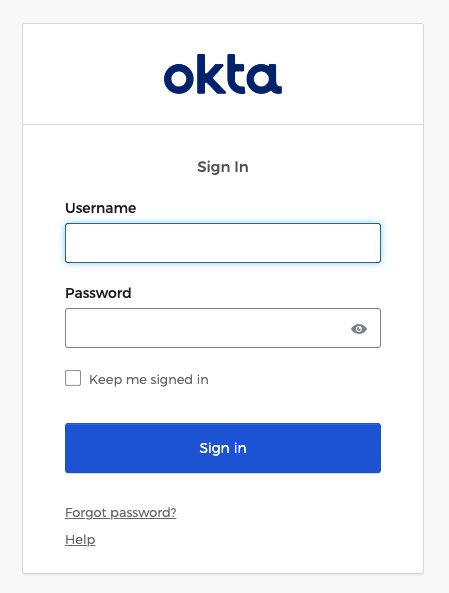

Verrai reindirizzato a una pagina di autenticazione IdP. Per questo esempio, stiamo usando Okta.

- Immettere il nome utente e la password, quindi scegliere Accedi.

Una volta completata l'autenticazione, verrai reindirizzato alla pagina del flusso di dati di Studio.

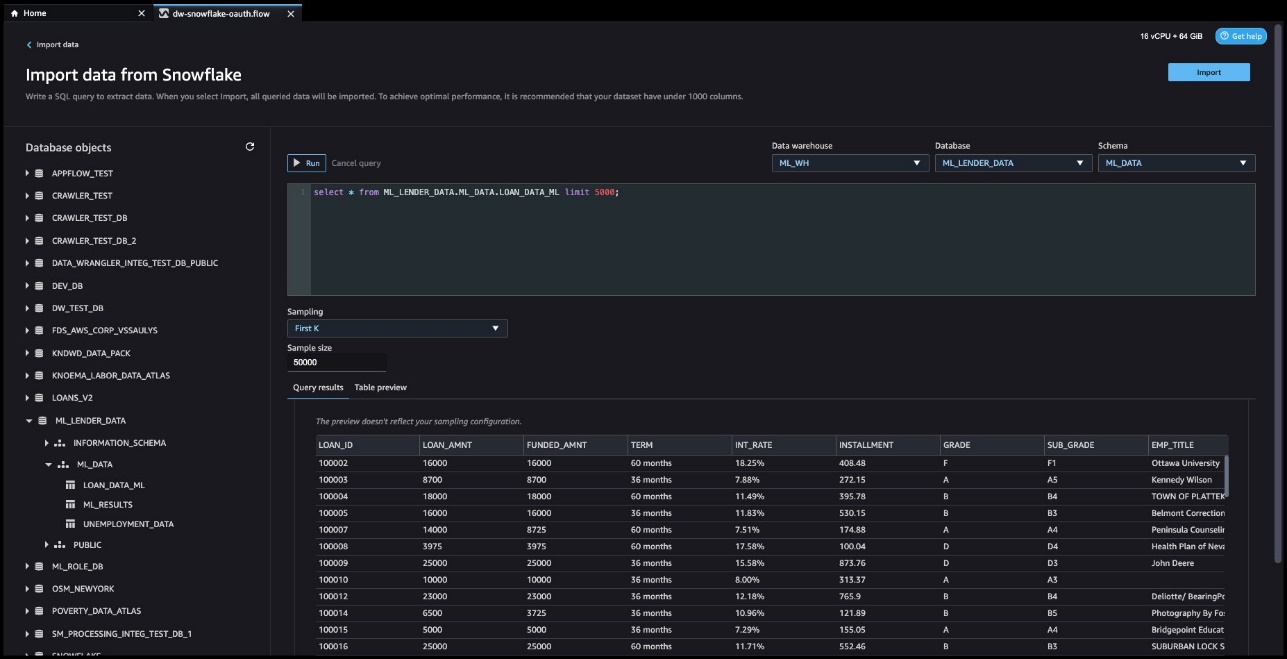

- Sulla Importa i dati da Snowflake pagina, sfogliare gli oggetti del database o eseguire una query per i dati di destinazione.

- Nell'editor di query, inserisci una query e visualizza in anteprima i risultati.

Nell'esempio seguente, carichiamo Dati di prestito e recuperare tutte le colonne da 5,000 righe.

- Scegli Importare.

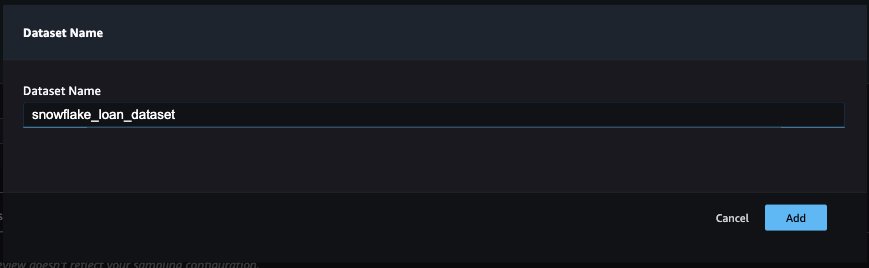

- Inserisci un nome per il set di dati (per questo post, usiamo

snowflake_loan_dataset) e scegli Aggiungi.

Sei reindirizzato al Preparare page, in cui è possibile aggiungere trasformazioni e analisi ai dati.

Data Wrangler semplifica l'inserimento dei dati e l'esecuzione di attività di preparazione dei dati come l'analisi esplorativa dei dati, la selezione delle funzionalità e l'ingegnerizzazione delle funzionalità. Abbiamo trattato solo alcune delle funzionalità di Data Wrangler in questo post sulla preparazione dei dati; è possibile utilizzare Data Wrangler per un'analisi dei dati più avanzata come l'importanza delle caratteristiche, la perdita di target e la spiegabilità del modello utilizzando un'interfaccia utente semplice e intuitiva.

Analizzare la qualità dei dati

Usa il Rapporto sulla qualità dei dati e sugli approfondimenti per eseguire un'analisi dei dati importati in Data Wrangler. Data Wrangler crea il rapporto dai dati campionati.

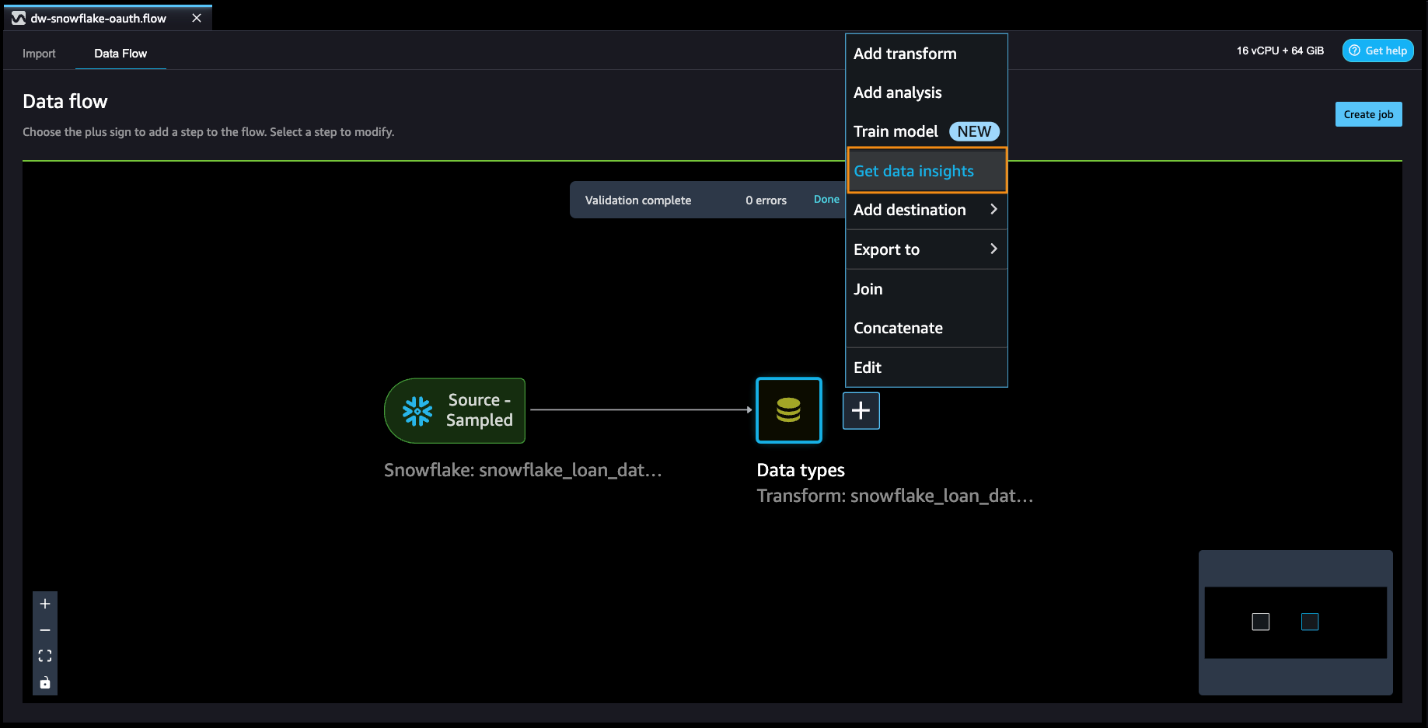

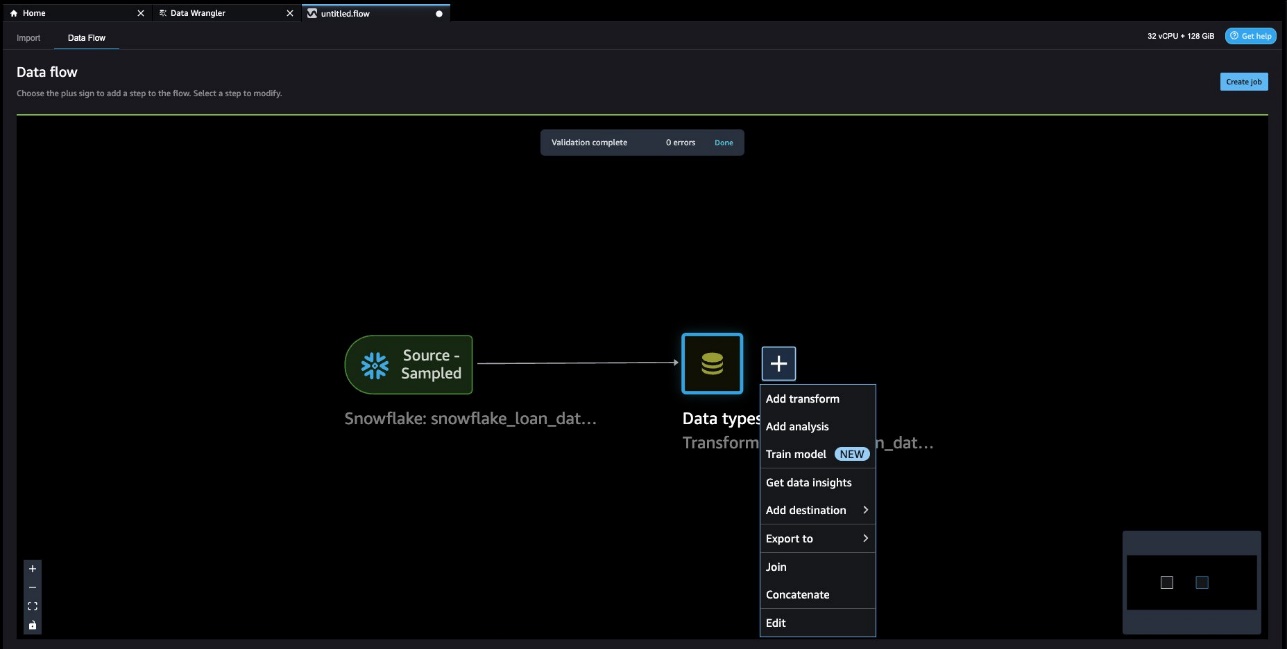

- Nella pagina del flusso di Data Wrangler, scegli il segno più accanto a Tipi di dati, Quindi scegliere Ottieni informazioni dettagliate sui dati.

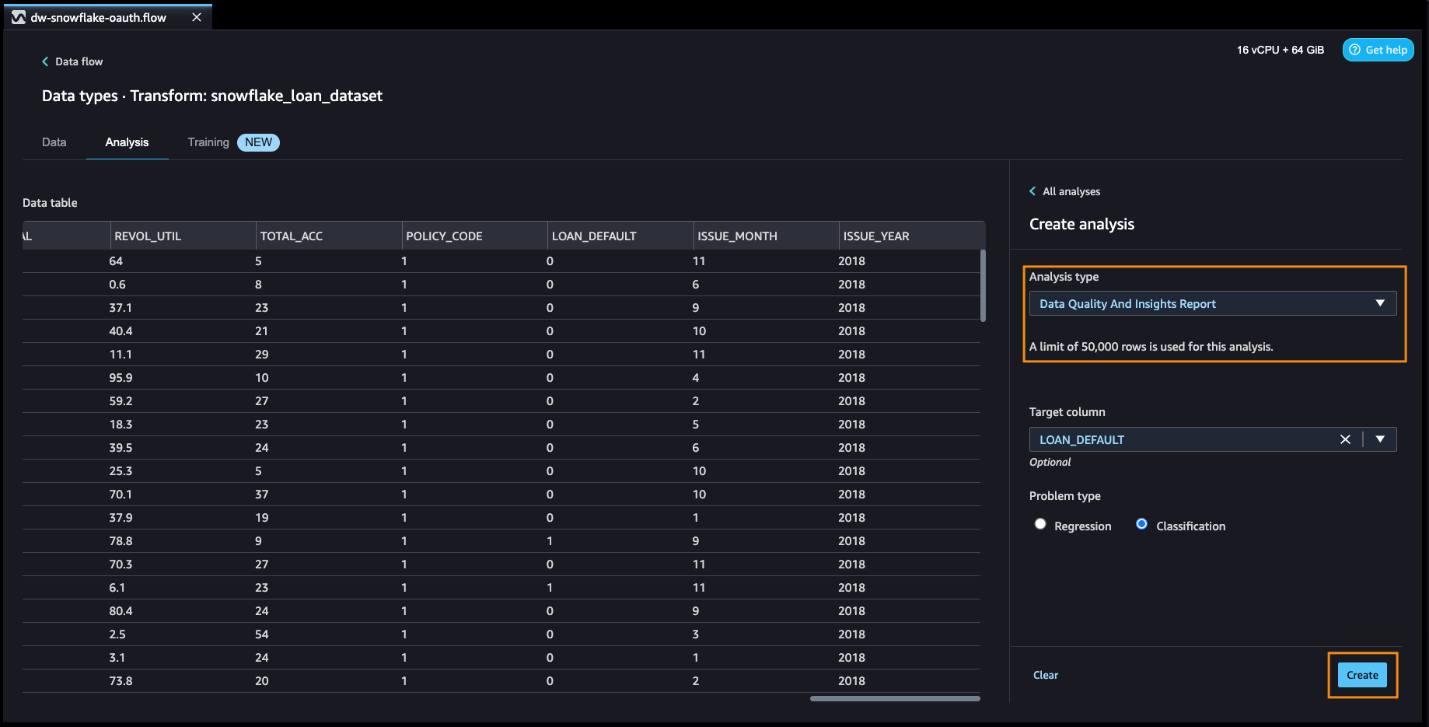

- Scegli Rapporto sulla qualità dei dati e approfondimenti per Tipo di analisi.

- Nel Colonna di destinazione, scegli la colonna di destinazione.

- Nel Tipo di problema, selezionare Classificazione.

- Scegli Creare.

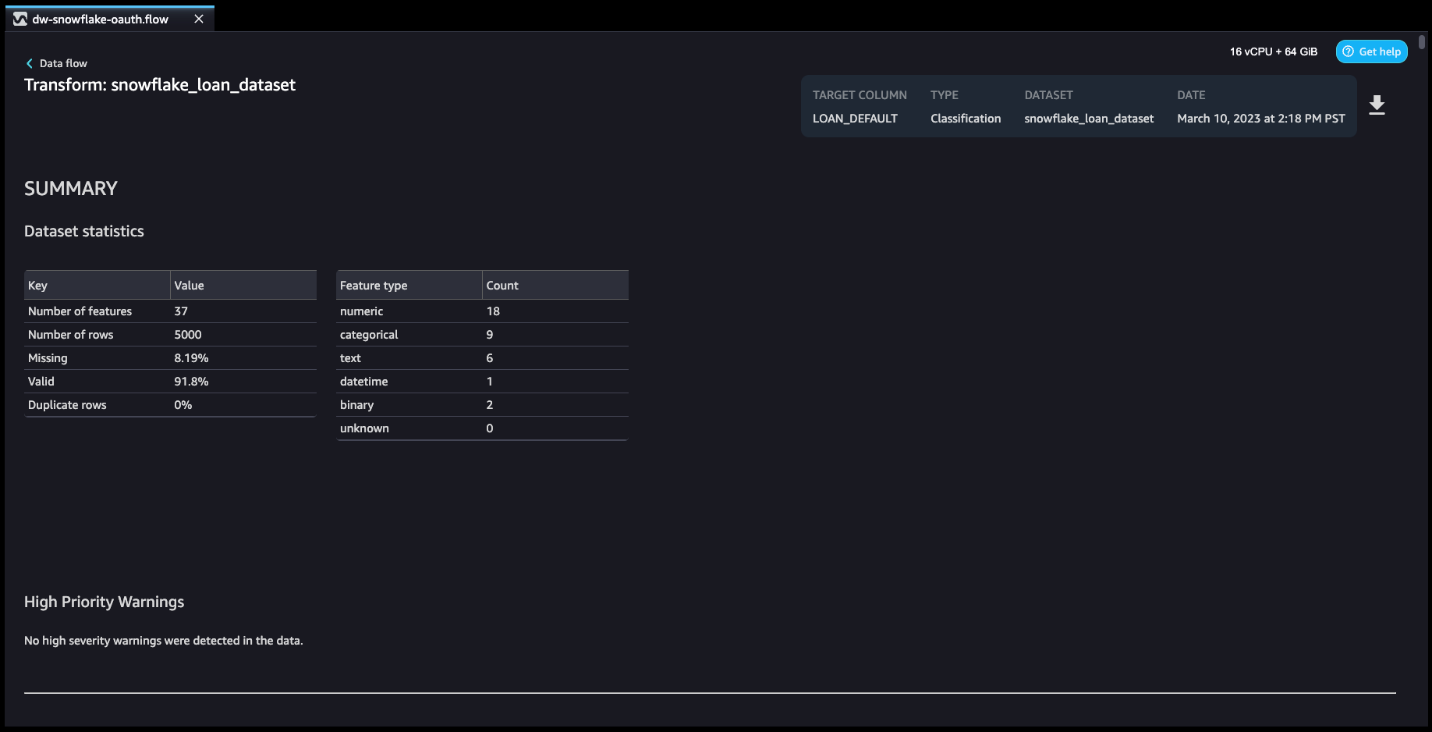

Il rapporto sugli approfondimenti contiene un breve riepilogo dei dati, che include informazioni generali come valori mancanti, valori non validi, tipi di funzionalità, conteggi anomali e altro ancora. Puoi scaricare il rapporto o visualizzarlo online.

Aggiungere trasformazioni ai dati

Data Wrangler ha oltre 300 trasformazioni integrate. In questa sezione, utilizziamo alcune di queste trasformazioni per preparare il set di dati per un modello ML.

- Nella pagina del flusso di Data Wrangler, scegli il segno più, quindi scegli Aggiungi trasformazione.

Se stai seguendo i passaggi nel post, verrai indirizzato qui automaticamente dopo aver aggiunto il tuo set di dati.

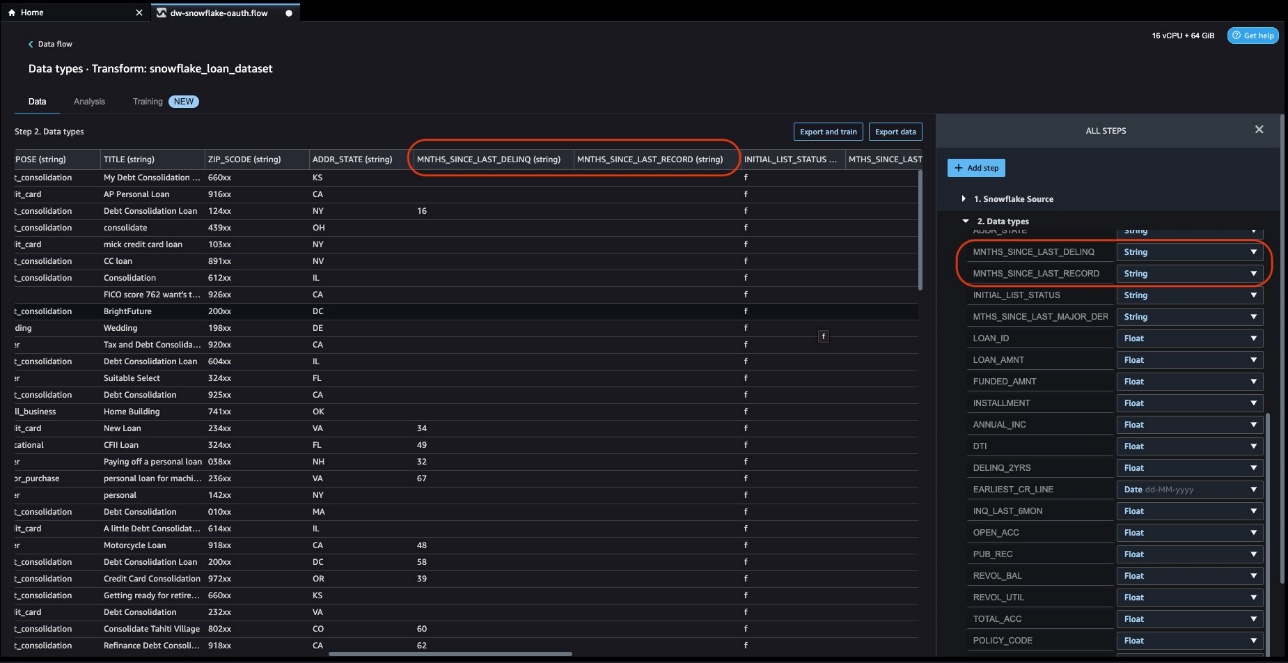

- Verificare e modificare il tipo di dati delle colonne.

Guardando attraverso le colonne, lo identifichiamo MNTHS_SINCE_LAST_DELINQ ed MNTHS_SINCE_LAST_RECORD molto probabilmente dovrebbe essere rappresentato come un tipo numerico piuttosto che come una stringa.

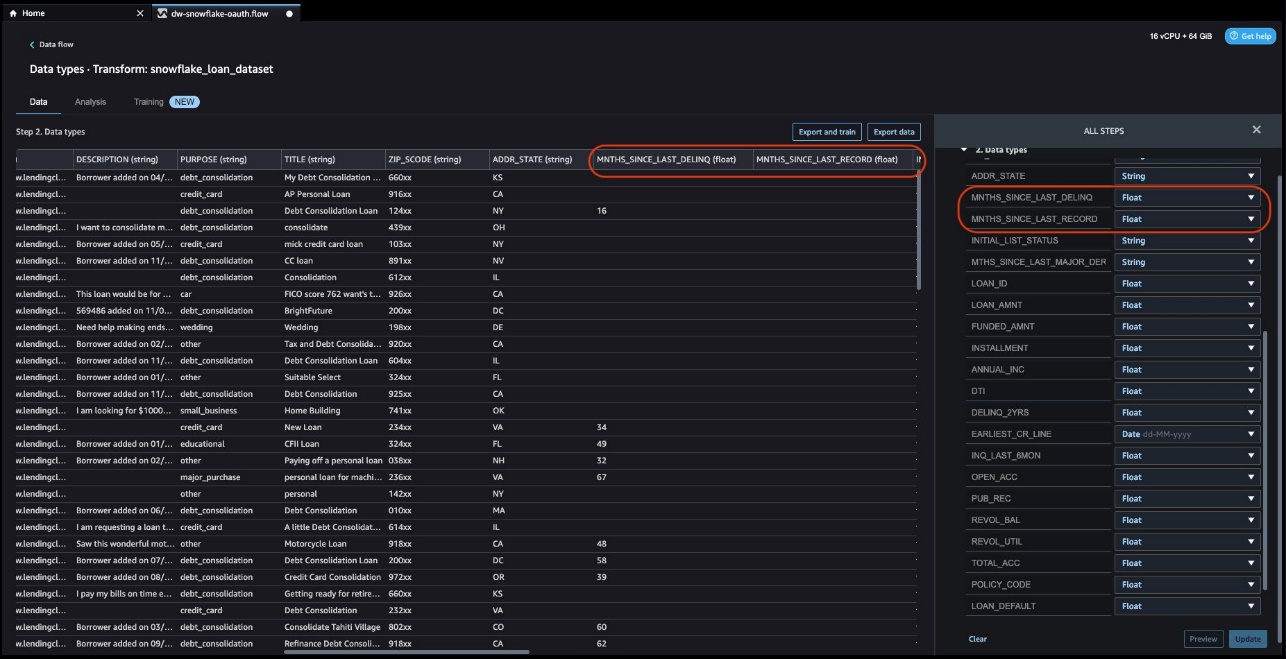

- Dopo aver applicato le modifiche e aggiunto il passaggio, puoi verificare che il tipo di dati della colonna sia cambiato in float.

Guardando attraverso i dati, possiamo vedere che i campi EMP_TITLE, URL, DESCRIPTIONe TITLE probabilmente non fornirà valore al nostro modello nel nostro caso d'uso, quindi possiamo eliminarli.

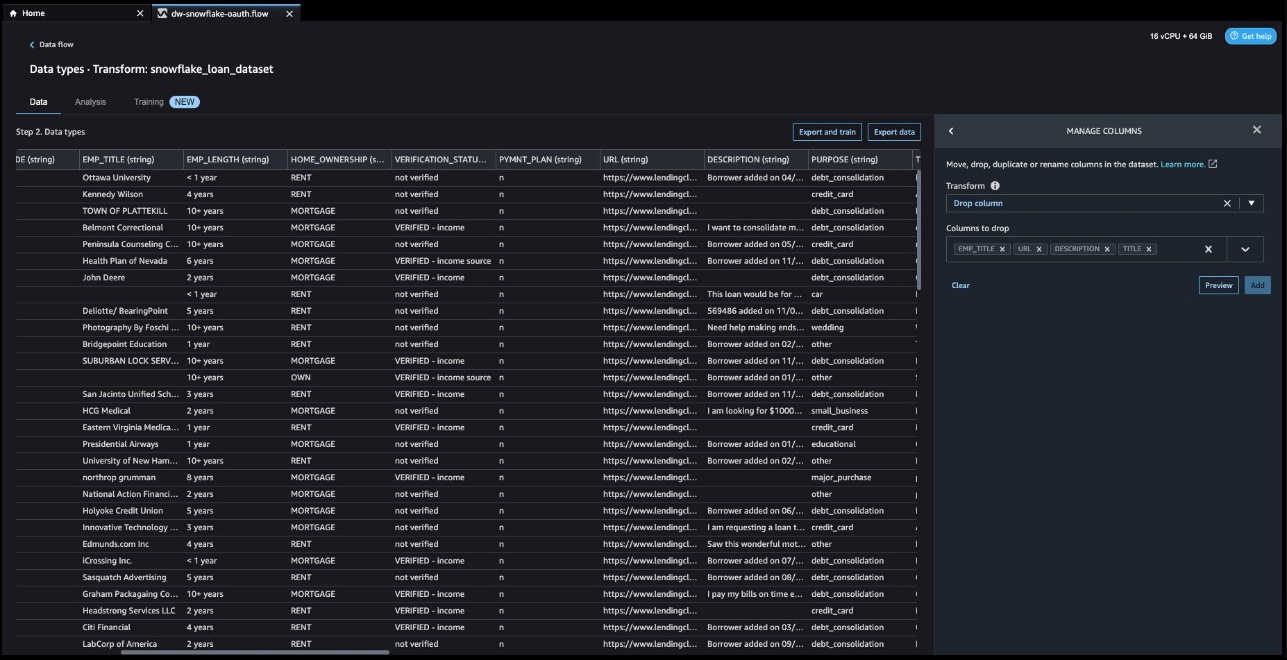

- Scegli Aggiungi passaggio, Quindi scegliere Gestisci colonne.

- Nel Trasformarescegli Colonna di rilascio.

- Nel Colonna da eliminare, specificare

EMP_TITLE,URL,DESCRIPTIONeTITLE. - Scegli Anteprima ed Aggiungi.

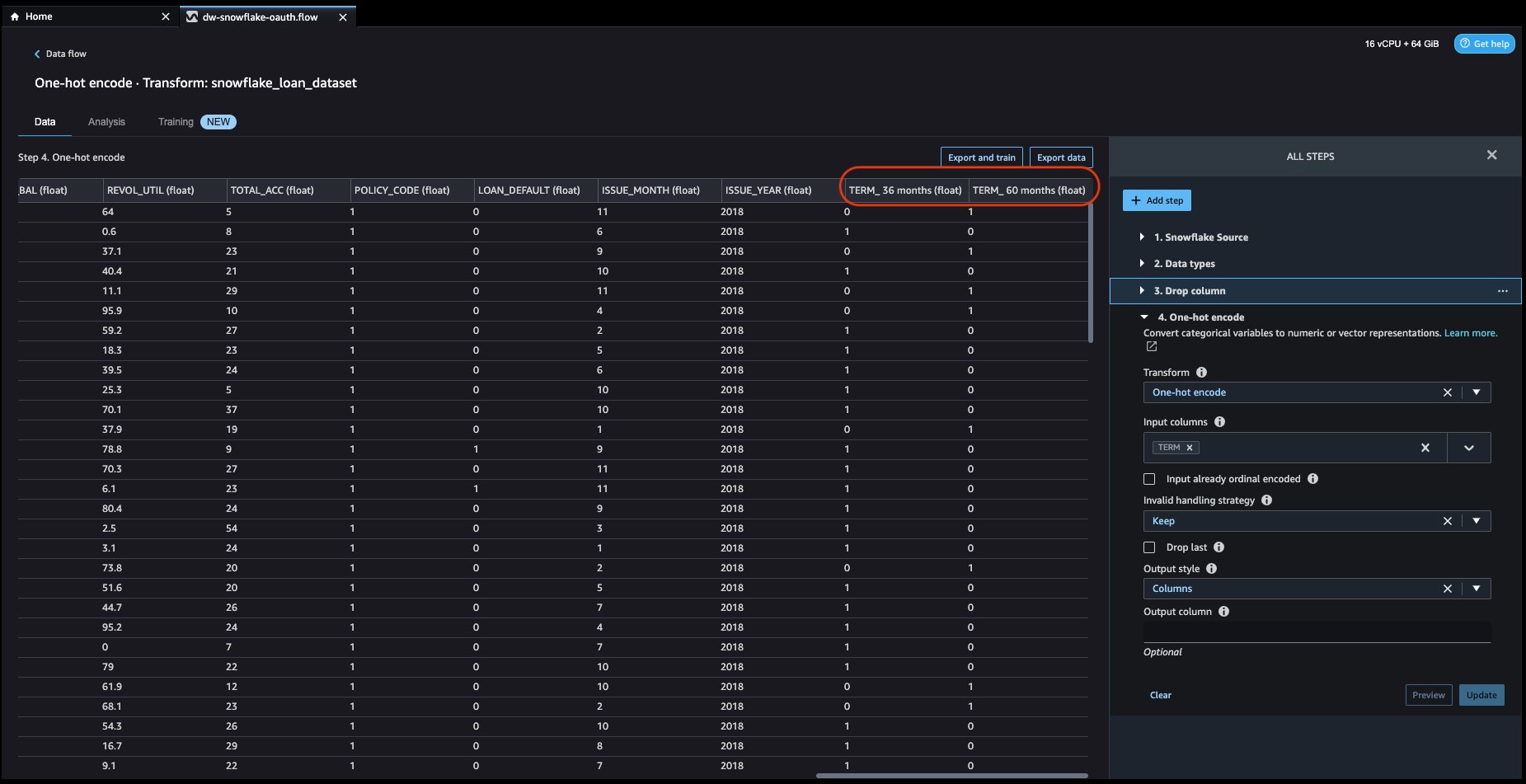

Successivamente, vogliamo cercare dati categorici nel nostro set di dati. Data Wrangler ha una funzionalità integrata per codificare i dati categorici utilizzando codifiche ordinali e one-hot. Guardando il nostro set di dati, possiamo vedere che il file TERM, HOME_OWNERSHIPe PURPOSE tutte le colonne sembrano essere di natura categorica.

- Aggiungi un altro passaggio e scegli Codifica categoriale.

- Nel Trasformarescegli Codifica a caldo.

- Nel Colonna di inputscegli

TERM. - Nel Stile di outputscegli colonne.

- Lascia tutte le altre impostazioni come predefinite, quindi scegli Anteprima ed Aggiungi.

Il HOME_OWNERSHIP colonna ha quattro possibili valori: RENT, MORTGAGE, OWN, e altro.

- Ripetere i passaggi precedenti per applicare un approccio di codifica one-hot su questi valori.

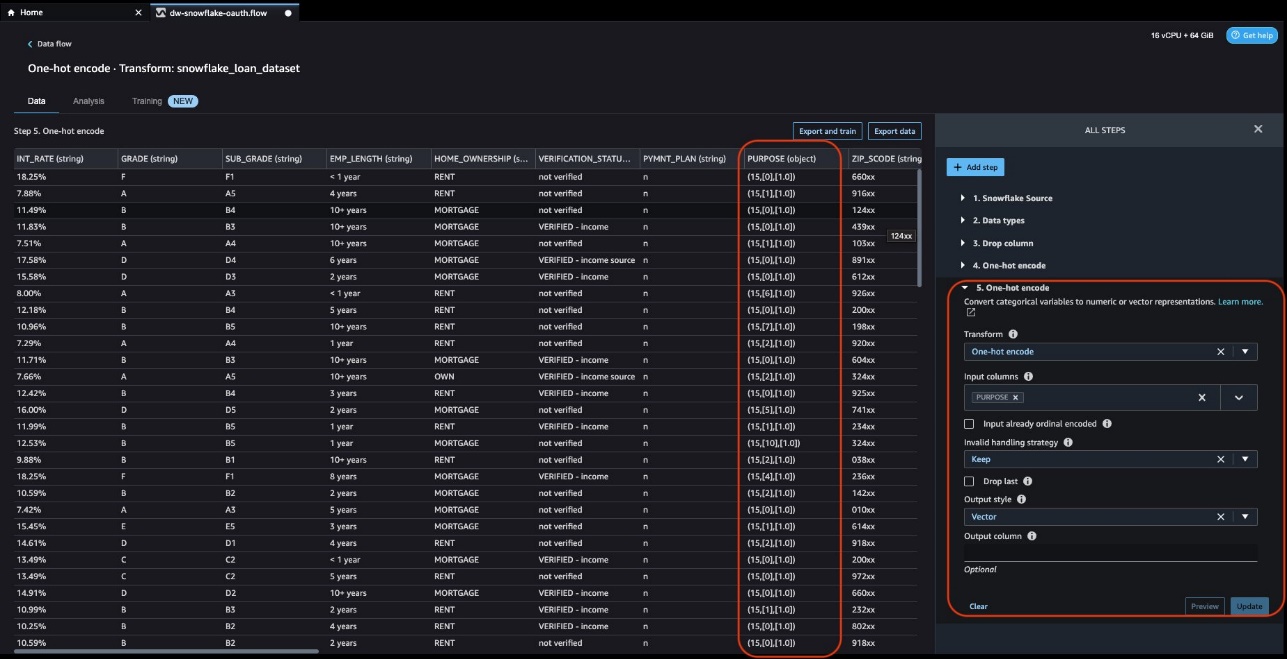

Infine, il PURPOSE colonna ha diversi valori possibili. Per questi dati, utilizziamo anche un approccio di codifica one-hot, ma impostiamo l'output su un vettore anziché su colonne.

- Nel Trasformarescegli Codifica a caldo.

- Nel Colonna di inputscegli

PURPOSE. - Nel Stile di outputscegli vettore.

- Nel Colonna di output, chiamiamo questa colonna

PURPOSE_VCTR.

Ciò mantiene l'originale PURPOSE colonna, se decidiamo di usarla in seguito.

- Lascia tutte le altre impostazioni come predefinite, quindi scegli Anteprima ed Aggiungi.

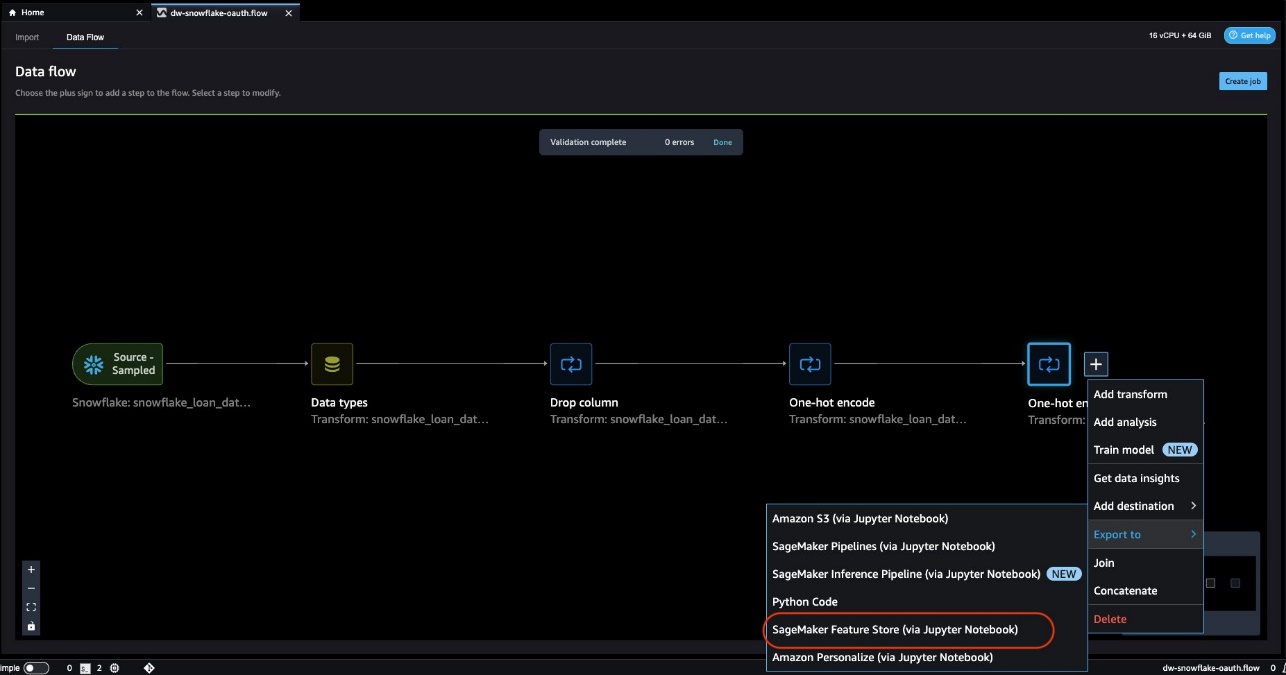

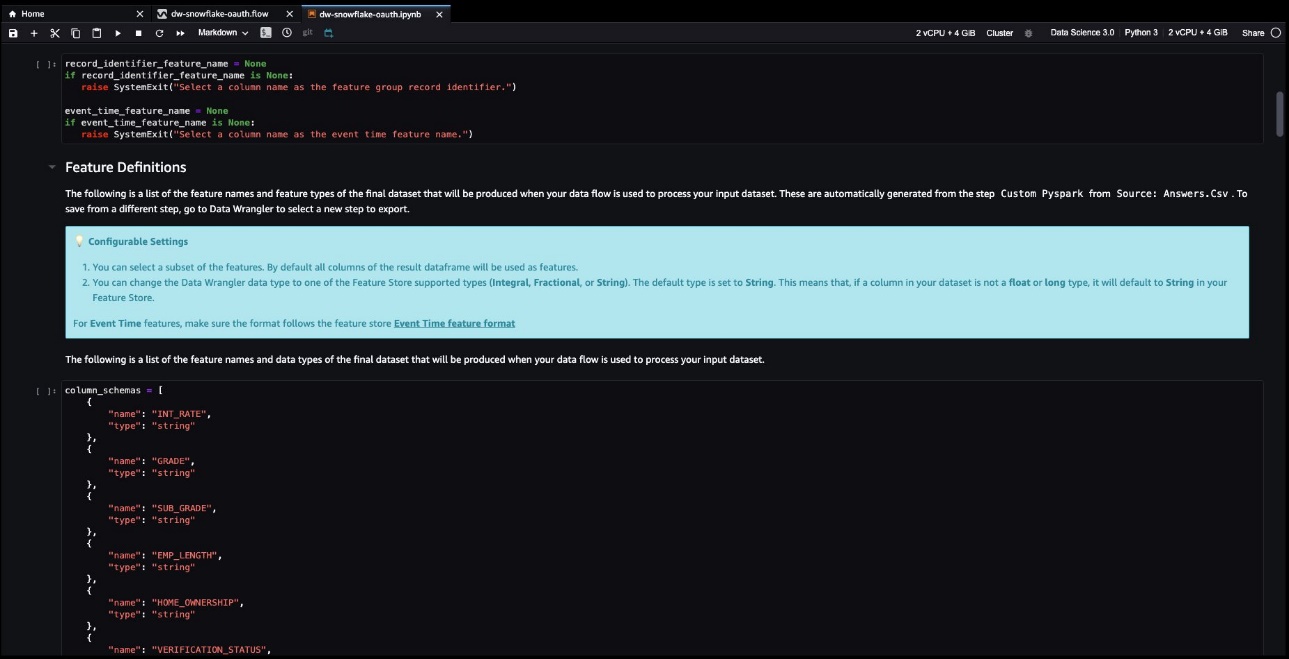

Esporta il flusso di dati

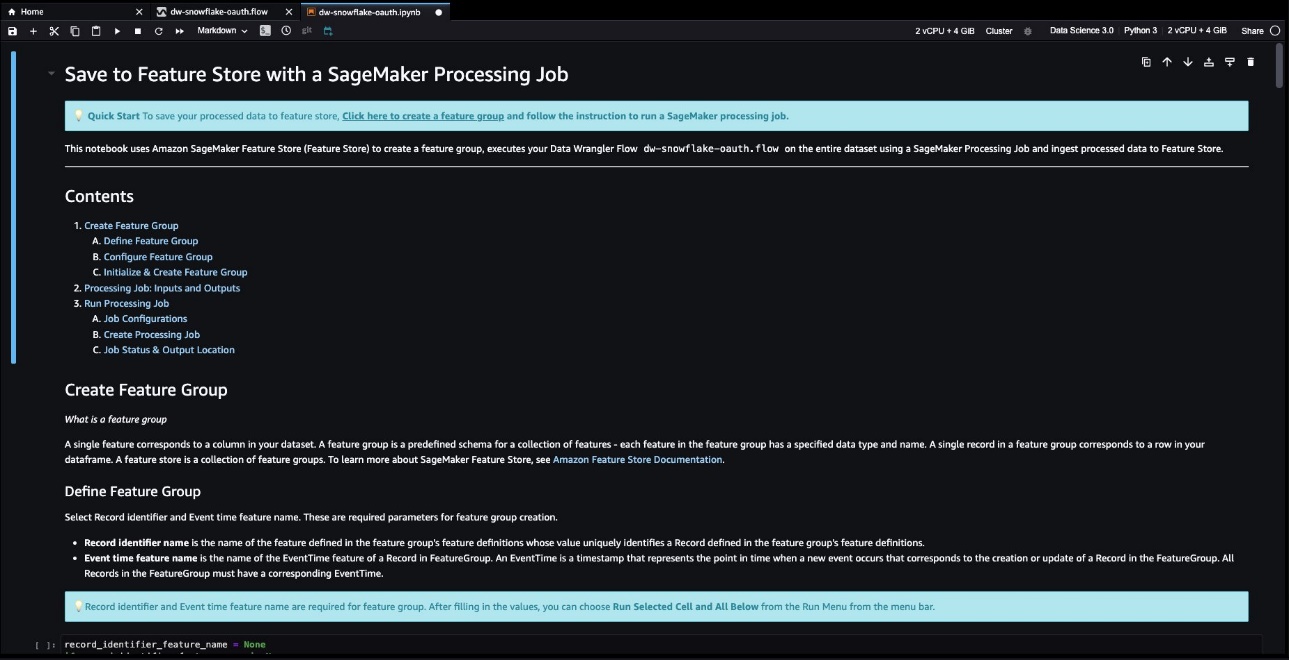

Infine, esportiamo l'intero flusso di dati in un feature store con un processo di elaborazione SageMaker, che crea un notebook Jupyter con il codice precompilato.

- Nella pagina del flusso di dati scegliere il segno più e Esporta a.

- Scegli dove esportare. Per il nostro caso d'uso, scegliamo Feature Store di SageMaker.

Il notebook esportato è ora pronto per essere eseguito.

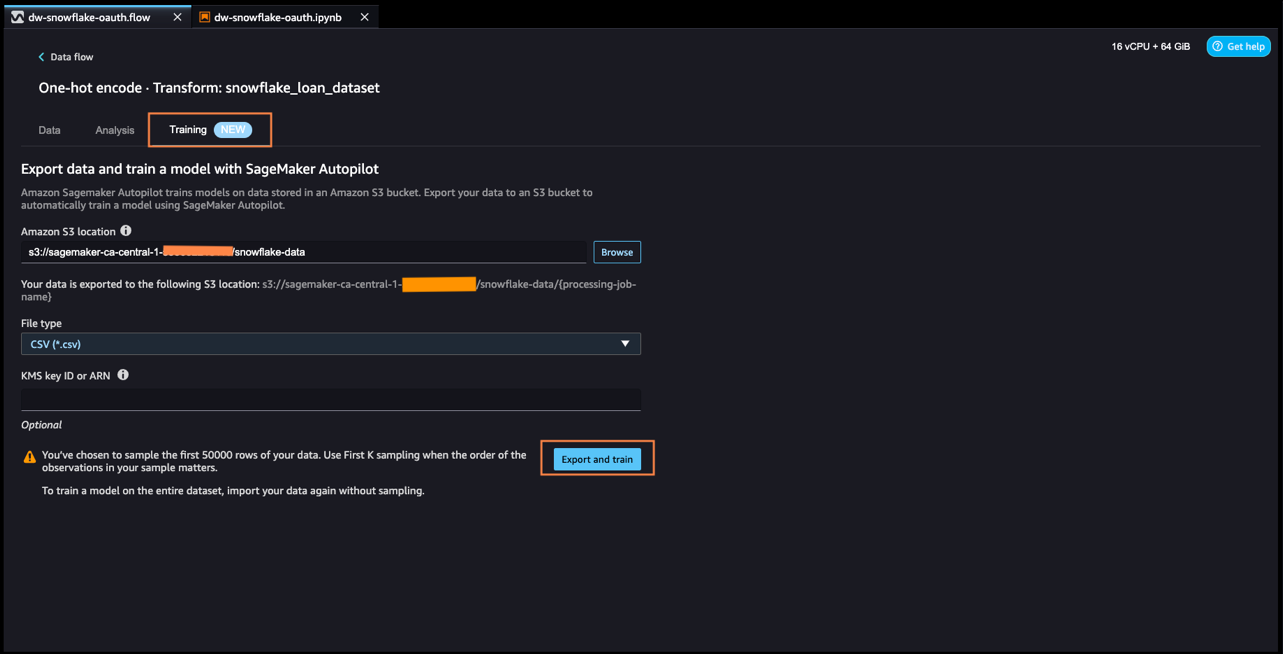

Esporta i dati e addestra un modello con Autopilot

Ora possiamo addestrare il modello usando Pilota automatico Amazon SageMaker.

- Nella pagina del flusso di dati scegliere il file Training scheda.

- Nel Posizione Amazon S3, immettere una posizione in cui salvare i dati.

- Scegli Esporta e forma.

- Specificare le impostazioni nel file Obiettivo e caratteristiche, Metodo di allenamento, Distribuzione e impostazioni avanzatee Rivedi e crea .

- Scegli Crea esperimento per trovare il modello migliore per il tuo problema.

ripulire

Se il tuo lavoro con Data Wrangler è completo, chiudi la tua istanza di Data Wrangler per evitare di incorrere in costi aggiuntivi.

Conclusione

In questo post, abbiamo dimostrato la connessione Data Wrangler a Snowflake utilizzando OAuth, trasformando e analizzando un set di dati e infine esportandolo nel flusso di dati in modo che possa essere utilizzato in un notebook Jupyter. In particolare, abbiamo creato una pipeline per la preparazione dei dati senza dover scrivere alcun codice.

Per iniziare con Data Wrangler, vedere Prepara i dati ML con Amazon SageMaker Data Wrangler.

Circa gli autori

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

Ajjay Govindaram è Senior Solutions Architect presso AWS. Lavora con clienti strategici che utilizzano AI/ML per risolvere problemi aziendali complessi. La sua esperienza risiede nel fornire indicazioni tecniche e assistenza alla progettazione per distribuzioni di applicazioni AI/ML da modeste a grandi dimensioni. Le sue conoscenze spaziano dall'architettura delle applicazioni ai big data, all'analisi e all'apprendimento automatico. Gli piace ascoltare la musica mentre riposa, vivere la vita all'aria aperta e passare il tempo con i suoi cari.

BoscoAlbuquerque è Sr. Partner Solutions Architect presso AWS e ha oltre 20 anni di esperienza nella collaborazione con prodotti di database e analisi di fornitori di database aziendali e fornitori di servizi cloud. Ha aiutato grandi aziende tecnologiche a progettare soluzioni di analisi dei dati e ha guidato team di ingegneri nella progettazione e implementazione di piattaforme di analisi dei dati e prodotti di dati.

BoscoAlbuquerque è Sr. Partner Solutions Architect presso AWS e ha oltre 20 anni di esperienza nella collaborazione con prodotti di database e analisi di fornitori di database aziendali e fornitori di servizi cloud. Ha aiutato grandi aziende tecnologiche a progettare soluzioni di analisi dei dati e ha guidato team di ingegneri nella progettazione e implementazione di piattaforme di analisi dei dati e prodotti di dati.

Matteo Marzillo è un Senior Partner Sales Engineer presso Snowflake. Ha 10 anni di esperienza in ruoli di data science e machine learning sia nella consulenza che con le organizzazioni del settore. Matt ha esperienza nello sviluppo e nell'implementazione di modelli AI e ML in molte organizzazioni diverse in aree come marketing, vendite, operazioni, clinica e finanza, oltre a fornire consulenza in ruoli di consulenza.

Matteo Marzillo è un Senior Partner Sales Engineer presso Snowflake. Ha 10 anni di esperienza in ruoli di data science e machine learning sia nella consulenza che con le organizzazioni del settore. Matt ha esperienza nello sviluppo e nell'implementazione di modelli AI e ML in molte organizzazioni diverse in aree come marketing, vendite, operazioni, clinica e finanza, oltre a fornire consulenza in ruoli di consulenza.

Huong Nguyen è un leader di prodotto per Amazon SageMaker Data Wrangler presso AWS. Ha 15 anni di esperienza nella creazione di prodotti ossessionati dai clienti e basati sui dati sia per le aziende che per i consumatori. Nel tempo libero le piacciono gli audiolibri, il giardinaggio, le escursioni e passa il tempo con la famiglia e gli amici.

Huong Nguyen è un leader di prodotto per Amazon SageMaker Data Wrangler presso AWS. Ha 15 anni di esperienza nella creazione di prodotti ossessionati dai clienti e basati sui dati sia per le aziende che per i consumatori. Nel tempo libero le piacciono gli audiolibri, il giardinaggio, le escursioni e passa il tempo con la famiglia e gli amici.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :È

- $ SU

- 000

- 10

- 100

- 15 anni

- 20 anni

- 7

- 8

- 9

- a

- capace

- WRI

- accesso

- Accesso ai dati

- Accedendo

- Il mio account

- operanti in

- Ad

- aggiunta

- aggiuntivo

- Admin

- avanzare

- Avanzate

- consulenza

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- AI / ML

- Tutti

- Amazon

- Amazon Sage Maker

- Gestore di dati di Amazon SageMaker

- Analisi

- .

- analitica

- analizzare

- l'analisi

- ed

- Un altro

- api

- App

- apparire

- Applicazioni

- APPLICA

- AMMISSIONE

- approccio

- applicazioni

- architettura

- SONO

- aree

- AS

- Assistenza

- associato

- At

- allegare

- pubblico

- Audio

- autenticare

- Autenticazione

- autorizzazione

- automatizzare

- automaticamente

- AWS

- azzurro

- BE

- perché

- prima

- iniziare

- MIGLIORE

- Big

- Big Data

- stile di vita

- Libri

- incassato

- affari

- by

- chiamata

- detto

- Materiale

- funzionalità

- Custodie

- CAT

- Modifiche

- scegliere

- Scegli

- cliente

- Info su

- Cloud

- codice

- Colonna

- colonne

- Aziende

- completamento di una

- complesso

- concetto

- Configurazione

- Connettiti

- Collegamento

- veloce

- consolle

- consulting

- Consumer

- contenuto

- potuto

- coprire

- coperto

- creare

- creato

- crea

- Creazione

- Credenziali

- Clienti

- dati

- analisi dei dati

- Dati Analytics

- Piattaforma dati

- Preparazione dei dati

- scienza dei dati

- scienziato di dati

- data-driven

- Banca Dati

- decide

- Predefinito

- dimostrato

- distribuzione

- implementazioni

- Design

- progettazione

- dettaglio

- dettagli

- in via di sviluppo

- diverso

- direzione

- direttamente

- distinto

- documentazione

- non

- dominio

- Dont

- giù

- scaricare

- Cadere

- ogni

- editore

- effetto

- o

- enable

- ingegnere

- Ingegneria

- entrare

- Impresa

- Ambiente

- esempio

- esistente

- esperienza

- sperimentare

- Analisi dei dati esplorativi

- export

- esterno

- FAIL

- famiglia

- caratteristica

- Caratteristiche

- Costi

- pochi

- campo

- campi

- Compila il

- Infine

- finanziare

- Trovate

- galleggiante

- flusso

- i seguenti

- Nel

- formato

- Frequenza

- frequentemente

- amici

- da

- funzionalità

- Generale

- ottenere

- dà

- concedere

- maggiore

- Guide

- Avere

- avendo

- Aiuto

- aiutato

- qui

- Casa

- Come

- Tutorial

- HTML

- http

- HTTPS

- ID

- identificatore

- identificare

- Identità

- Idle

- Implementazione

- importare

- importanza

- in

- inclusi

- Compreso

- in modo non corretto

- industria

- informazioni

- ingresso

- intuizione

- intuizioni

- istruzioni

- integrazione

- integrazioni

- Interfaccia

- intuitivo

- coinvolto

- IT

- Lavoro

- Offerte di lavoro

- jpg

- Le

- conoscenze

- grandi

- larga scala

- leader

- apprendimento

- Guidato

- si trova

- ciclo di vita

- tutta la vita

- piace

- probabile

- Lista

- Ascolto

- caricare

- carichi

- località

- Guarda

- cerca

- amato

- macchina

- machine learning

- fatto

- make

- FA

- Fare

- direttore

- molti

- Marketing

- messaggio

- forza

- Minuti

- mancante

- ML

- modello

- modelli

- modificare

- Scopri di più

- maggior parte

- multiplo

- Musica

- Nome

- nomi

- Natura

- Navigazione

- Bisogno

- che necessitano di

- esigenze

- New

- GENERAZIONE

- segnatamente

- taccuino

- numero

- OAuth

- oggetti

- of

- OTTA

- on

- ONE

- online

- Operazioni

- Opzione

- organizzazioni

- i

- Altro

- altrimenti

- all'aperto

- produzione

- proprio

- pagina

- coppie

- vetro

- partner

- Password

- Eseguire

- permessi

- cronologia

- conduttura

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- più

- Termini e Condizioni

- pop-up

- possibile

- Post

- preferito

- Preparare

- prerequisiti

- Anteprima

- precedente

- Problema

- problemi

- procedure

- processi

- lavorazione

- Prodotto

- Prodotti

- Profilo

- Programmazione

- propriamente

- fornire

- purché

- fornitore

- fornitori

- fornisce

- fornitura

- qualità

- piuttosto

- pronto

- raccomandare

- reindirizzare

- riducendo

- regione

- registro

- registrazione

- Iscrizione

- rilancio

- rapporto

- rappresentato

- richiedere

- quelli

- REST

- colpevole

- Risultati

- nello specifico retail

- Ruolo

- ruoli

- Correre

- running

- sagemaker

- vendite

- programmazione

- Scienze

- Scienziato

- scienziati

- portata

- Segreto

- Sezione

- sezioni

- problemi di

- prodotti

- anziano

- Sensibilità

- set

- regolazione

- impostazioni

- alcuni

- Conchiglia

- dovrebbero

- mostrare attraverso le sue creazioni

- segno

- Un'espansione

- singolo

- So

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- fonti

- spazi

- Spendere

- iniziato

- inizio

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- memorizzare

- Strategico

- Corda

- studio

- di successo

- tale

- SOMMARIO

- supporto

- supporti

- TAG

- Fai

- prende

- Target

- mirata

- task

- le squadre

- Consulenza

- Tecnologia

- società tecnologiche

- che

- Il

- le informazioni

- loro

- Li

- Strumenti Bowman per analizzare le seguenti finiture:

- Attraverso

- tempo

- a

- token

- Tokens

- Treni

- Trasformare

- trasformazioni

- trasformazione

- Tipi di

- per

- capire

- unico

- Aggiornanento

- URL

- uso

- caso d'uso

- Utente

- Interfaccia utente

- utenti

- APPREZZIAMO

- Valori

- fornitori

- verificare

- via

- Visualizza

- visibile

- walkthrough

- identificazione dei warning

- Settimane

- WELL

- quale

- while

- OMS

- tutto

- volere

- con

- entro

- senza

- Lavora

- flussi di lavoro

- lavoro

- lavori

- scrivere

- scrittura

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro