Gli editori digitali sono continuamente alla ricerca di modi per semplificare e automatizzare i propri flussi di lavoro multimediali al fine di generare e pubblicare nuovi contenuti il più rapidamente possibile.

Molti editori dispongono di una vasta libreria di immagini stock che utilizzano per i propri articoli. Queste immagini possono essere riutilizzate molte volte per storie diverse, specialmente quando l'editore ha immagini di celebrità. Molto spesso, un giornalista potrebbe dover ritagliare una celebrità desiderata da un'immagine da utilizzare per la sua prossima storia. Questa è un'attività manuale e ripetitiva che dovrebbe essere automatizzata. A volte, un autore potrebbe voler utilizzare l'immagine di una celebrità, ma contiene due persone e la celebrità principale deve essere ritagliata dall'immagine. Altre volte, le immagini delle celebrità potrebbero dover essere riformattate per essere pubblicate su una varietà di piattaforme come dispositivi mobili, social media o notizie digitali. Inoltre, un autore potrebbe dover modificare le proporzioni dell'immagine o mettere a fuoco la celebrità.

In questo post, dimostriamo come utilizzare Rekognition di Amazon per eseguire l'analisi delle immagini. Amazon Rekognition semplifica l'aggiunta di questa funzionalità alle tue applicazioni senza alcuna esperienza di machine learning (ML) e viene fornito con varie API per soddisfare casi d'uso come il rilevamento di oggetti, la moderazione dei contenuti, il rilevamento e l'analisi dei volti e il riconoscimento di testo e celebrità, che noi utilizzare in questo esempio.

Il funzione di riconoscimento delle celebrità in Rekognition di Amazon riconosce automaticamente decine di migliaia di personaggi noti in immagini e video utilizzando ML. Il riconoscimento delle celebrità può rilevare non solo la presenza della celebrità in questione, ma anche la posizione all'interno dell'immagine.

Panoramica della soluzione

In questo post, dimostriamo come possiamo passare una foto, il nome di una celebrità e le proporzioni dell'immagine generata per poter generare un'immagine ritagliata della celebrità data catturando il suo volto al centro.

Quando si lavora con API di rilevamento delle celebrità di Amazon Rekognition, molti elementi vengono restituiti nella risposta. Di seguito sono riportati alcuni elementi chiave della risposta:

- Partita Fiducia – Un punteggio di affidabilità della corrispondenza che può essere utilizzato per controllare il comportamento dell'API. Ti consigliamo di applicare una soglia adeguata a questo punteggio nella tua applicazione per scegliere il tuo punto operativo preferito. Ad esempio, impostando una soglia del 99%, puoi eliminare i falsi positivi ma potresti perdere alcune potenziali corrispondenze.

- Nome, ID e URL – Il nome della celebrità, un ID Amazon Rekognition univoco e un elenco di URL come il collegamento IMDb o Wikipedia della celebrità per ulteriori informazioni.

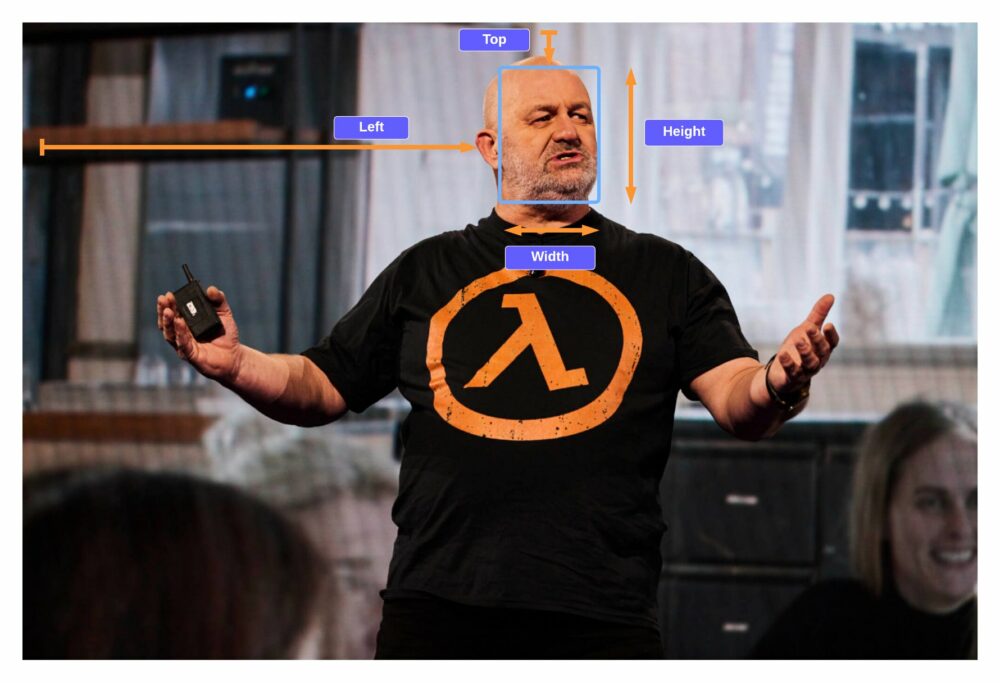

- Rettangolo di selezione – Coordinate della posizione del riquadro di delimitazione rettangolare per ciascun volto di celebrità riconosciuto.

- Genere conosciuto – Identità di genere nota per ogni celebrità riconosciuta.

- Emozioni – Emozione espressa sul volto della celebrità, ad esempio felice, triste o arrabbiata.

- Posa – Posa del volto della celebrità, utilizzando tre assi di rollio, beccheggio e imbardata.

- Sorriso – Se la celebrità sta sorridendo o meno.

Parte della risposta API di Amazon Rekognition include il seguente codice:

In questo esercizio dimostriamo come utilizzare l'elemento del riquadro di delimitazione per identificare la posizione del volto, come mostrato nell'immagine di esempio seguente. Tutte le dimensioni sono rappresentate come rapporti della dimensione complessiva dell'immagine, quindi i numeri nella risposta sono compresi tra 0 e 1. Ad esempio, nella risposta API di esempio, la larghezza del riquadro di delimitazione è 0.1, il che implica che la larghezza della faccia è il 10% della larghezza totale dell'immagine.

Con questo riquadro di delimitazione, ora siamo in grado di usare la logica per assicurarci che il volto rimanga all'interno dei bordi della nuova immagine che creiamo. Possiamo applicare un po' di padding attorno a questo riquadro di delimitazione per mantenere la faccia al centro.

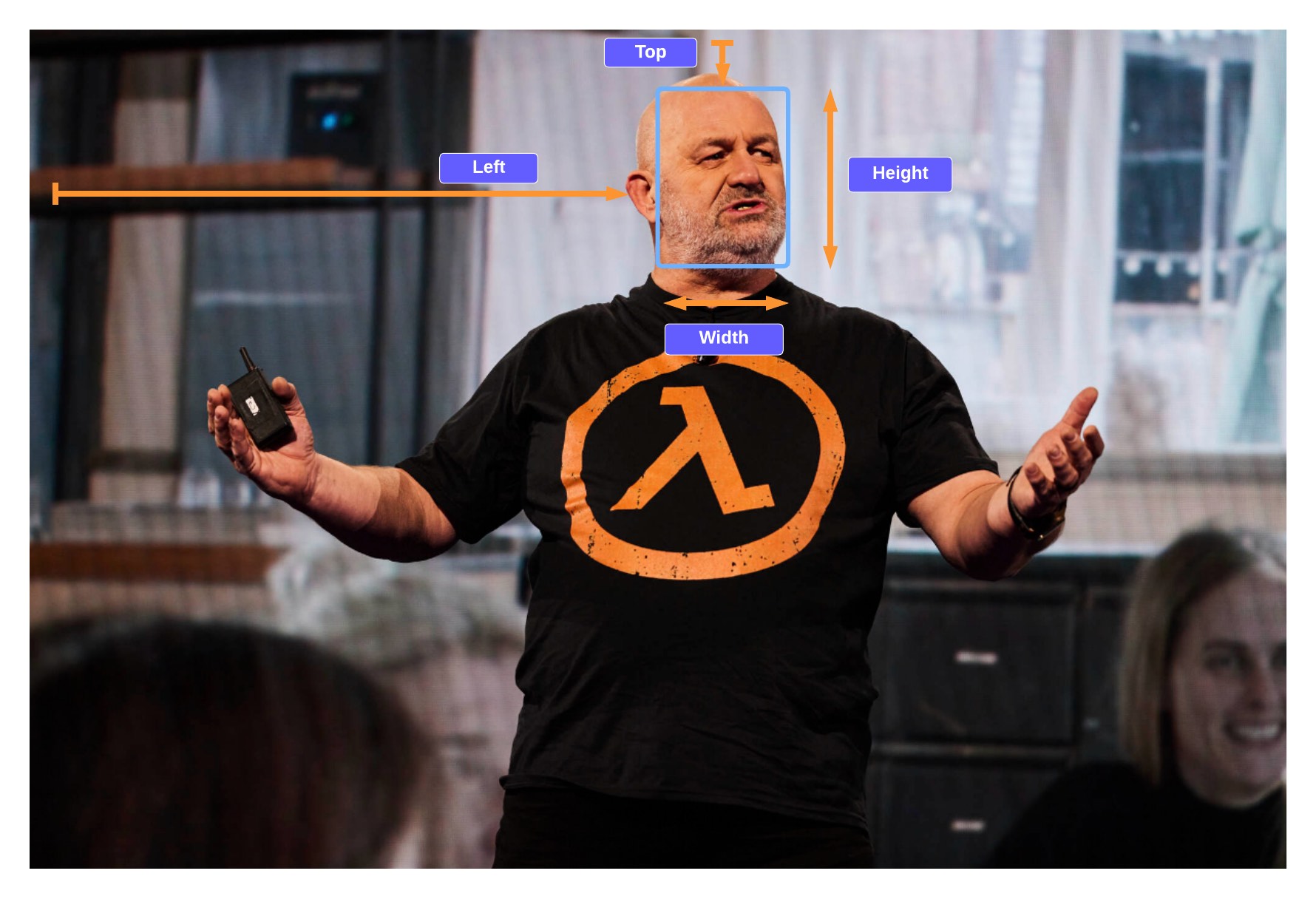

Nelle sezioni seguenti, mostriamo come creare il seguente output di immagine ritagliata con Werner Vogels a fuoco nitido.

Lanciamo un Amazon Sage Maker notebook, che fornisce un ambiente Python in cui è possibile eseguire il codice per passare un'immagine ad Amazon Rekognition e quindi modificare automaticamente l'immagine con la celebrità in primo piano.

Il codice esegue i seguenti passaggi di alto livello:

- Fai una richiesta al

recognize_celebritiesAPI con l'immagine e il nome della celebrità specificati. - Filtrare la risposta per le informazioni del riquadro di delimitazione.

- Aggiungi un po 'di riempimento al riquadro di delimitazione in modo tale da catturare parte dello sfondo.

Prerequisiti

Per questa procedura dettagliata, è necessario disporre dei seguenti prerequisiti:

Carica l'immagine di esempio

Carica la tua immagine campione di celebrità nel tuo bucket S3.

Esegui il codice

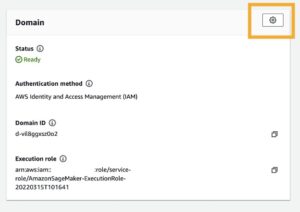

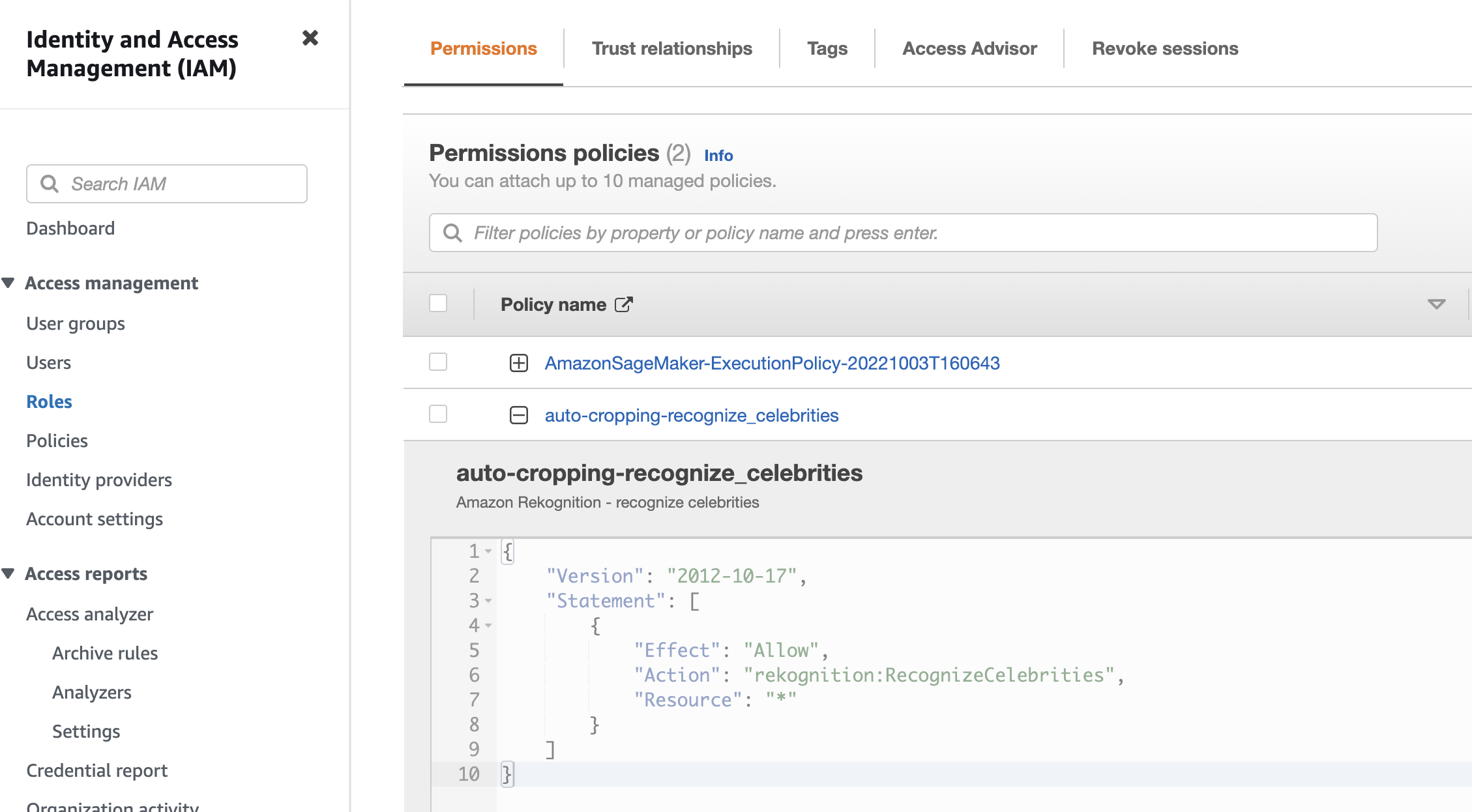

Per eseguire il codice, utilizziamo un notebook SageMaker, tuttavia qualsiasi IDE funzionerebbe anche dopo aver installato Python, pillow e Boto3. Creiamo un taccuino SageMaker così come il Gestione dell'identità e dell'accesso di AWS (IAM) con le autorizzazioni richieste. Completa i seguenti passaggi:

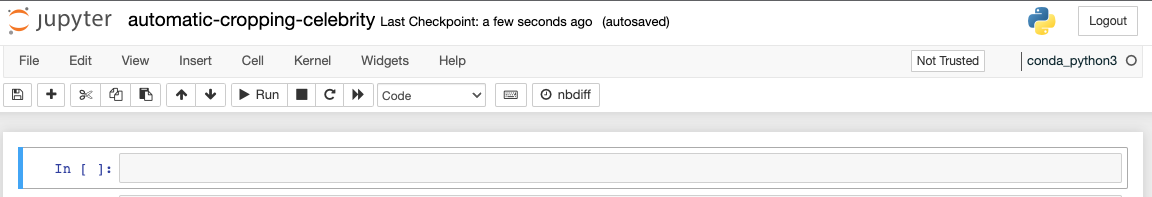

- Crea il taccuino e nominalo

automatic-cropping-celebrity.

La policy di esecuzione predefinita, che è stata creata durante la creazione del notebook SageMaker, ha una policy semplice che concede al ruolo le autorizzazioni per interagire con Amazon S3.

- Aggiorna il

Resourcevincolo con il nome del bucket S3:

- Crea un'altra policy da aggiungere al ruolo IAM del notebook SageMaker per poter chiamare il Riconosci le celebrità API:

- Sulla console di SageMaker, scegli Istanze di notebook nel pannello di navigazione.

- individuare il

automatic-cropping-celebritytaccuino e scegli Apri Jupyter. - Scegli New ed conda_python3 come kernel per il tuo notebook.

Per i passaggi seguenti, copia i blocchi di codice nel notebook Jupyter ed eseguili scegliendo Correre.

- Innanzitutto, importiamo le funzioni e le librerie di supporto:

- Imposta variabili

- Creare un client di servizio

- Funzione per riconoscere le celebrità

- Funzione per ottenere il riquadro di delimitazione della data celebrità:

- Funzione per aggiungere un po' di riempimento al riquadro di delimitazione, quindi catturiamo uno sfondo attorno al viso

- Funzione per salvare l'immagine nello storage del notebook e in Amazon S3

- Usa il Python

main()funzione per combinare le funzioni precedenti per completare il flusso di lavoro di salvataggio di una nuova immagine ritagliata della nostra celebrità:

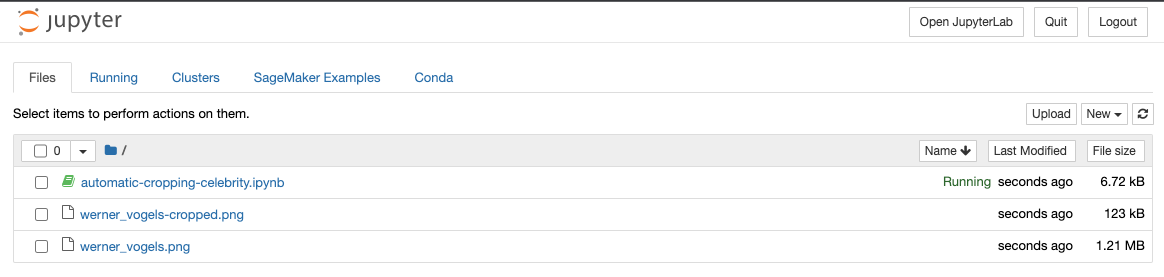

Quando esegui questo blocco di codice, puoi vedere che abbiamo trovato Werner Vogels e creato una nuova immagine con la sua faccia al centro.

L'immagine verrà salvata nel notebook e caricata anche nel bucket S3.

Potresti includere questa soluzione in un file flusso di lavoro più ampio; ad esempio, una casa editrice potrebbe voler pubblicare questa funzionalità come endpoint per riformattare e ridimensionare le immagini al volo durante la pubblicazione di articoli di celebrità su più piattaforme.

Pulire

Per evitare di incorrere in addebiti futuri, eliminare le risorse:

- Sulla console SageMaker, seleziona il tuo notebook e sul Azioni menù, scegliere Fermare.

- Dopo che il notebook è stato fermato, sul Azioni menù, scegliere Elimina.

- Sulla console IAM, elimina il ruolo di esecuzione SageMaker che hai creato.

- Sulla console Amazon S3, elimina l'immagine di input e tutti i file di output dal tuo bucket S3.

Conclusione

In questo post, abbiamo mostrato come utilizzare Amazon Rekognition per automatizzare un'attività altrimenti manuale di modifica delle immagini per supportare i flussi di lavoro multimediali. Ciò è particolarmente importante nel settore dell'editoria, dove la velocità è importante per ottenere nuovi contenuti rapidamente e su più piattaforme.

Per ulteriori informazioni sull'utilizzo delle risorse multimediali, fare riferimento a L'intelligenza multimediale è appena diventata più intelligente con Media2Cloud 3.0

L'autore

Marco Watkins è un architetto di soluzioni all'interno del team Media e intrattenimento. Aiuta i clienti a creare soluzioni AI/ML che risolvono le loro sfide aziendali utilizzando AWS. Ha lavorato a diversi progetti AI/ML relativi a visione artificiale, elaborazione del linguaggio naturale, personalizzazione, ML all'edge e altro ancora. Lontano dalla vita professionale, ama passare il tempo con la sua famiglia e guardare crescere i suoi due piccoli.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/automatic-image-cropping-with-amazon-rekognition/

- :È

- $ SU

- 1

- 10

- 100

- 11

- 7

- 8

- 9

- a

- capace

- WRI

- accesso

- Action

- Inoltre

- Dopo shavasana, sedersi in silenzio; saluti;

- AI / ML

- Tutti

- Amazon

- Rekognition di Amazon

- .

- ed

- Un altro

- api

- API

- Applicazioni

- applicazioni

- APPLICA

- AMMISSIONE

- SONO

- in giro

- news

- AS

- aspetto

- Attività

- At

- autore

- automatizzare

- Automatizzata

- Automatico

- automaticamente

- AWS

- ASSI

- sfondo

- BE

- fra

- Bloccare

- Blocchi

- Scatola

- scatole

- affari

- by

- chiamata

- Materiale

- catturare

- Catturare

- casi

- Celeb

- celebrità

- Celebrità

- centro

- sfide

- il cambiamento

- oneri

- Scegli

- la scelta

- codice

- combinare

- azienda

- completamento di una

- computer

- Visione computerizzata

- fiducia

- consolle

- contiene

- contenuto

- continuamente

- di controllo

- potuto

- creare

- creato

- Creazione

- raccolto

- Clienti

- Predefinito

- dimostrare

- desiderato

- rilevato

- rivelazione

- diverso

- digitale

- dimensioni

- Dsiplay

- scaricare

- e

- ogni

- bordo

- effetto

- elemento

- elementi

- eliminato

- endpoint

- Intrattenimento

- Ambiente

- particolarmente

- esempio

- esecuzione

- Esercitare

- competenza

- espresso

- Faccia

- facce

- famiglia

- famoso

- Compila il

- File

- Focus

- i seguenti

- Nel

- formato

- essere trovato

- fresco

- da

- function

- funzioni

- ulteriormente

- futuro

- Sesso

- generare

- ottenere

- ottenere

- dato

- dà

- Crescita

- contento

- Avere

- altezza

- aiuta

- alto livello

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- ID

- identificare

- Identità

- Immagine

- immagini

- importare

- importante

- in

- includere

- inclusi

- industria

- informazioni

- ingresso

- installazione

- Intelligence

- interagire

- IT

- giornalista

- jpg

- mantenere

- Le

- conosciuto

- Lingua

- grandi

- lanciare

- apprendimento

- biblioteche

- Biblioteca

- Vita

- piace

- LINK

- Lista

- piccolo

- locale

- località

- cerca

- macchina

- machine learning

- make

- FA

- Manuale

- molti

- partita

- Matters

- Media

- Menu

- forza

- ML

- Mobile

- moderazione

- modificare

- Scopri di più

- multiplo

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Navigazione

- Bisogno

- esigenze

- New

- notizie

- taccuino

- numeri

- oggetto

- Rilevazione dell'oggetto

- of

- on

- operativo

- minimo

- Altro

- altrimenti

- produzione

- complessivo

- vetro

- particolarmente

- sentiero

- Persone

- Eseguire

- esegue

- permessi

- Personalità

- personalizzazione

- Intonazione

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- politica

- Post

- potenziale

- preferito

- prerequisiti

- presenza

- primario

- lavorazione

- professionale

- progetti

- fornisce

- pubblicare

- editore

- editori

- editoriale

- metti

- Python

- rapidamente

- aumentare

- rapidamente

- rapporto

- riconoscimento

- riconoscere

- riconosciuto

- riconosce

- raccomandare

- relazionato

- resti

- ripetitivo

- rappresentato

- richiesta

- necessario

- risorsa

- Risorse

- risposta

- colpevole

- Risultati

- ritorno

- ROI

- Ruolo

- Rotolo

- Correre

- sagemaker

- Risparmi

- risparmio

- Punto

- sezioni

- servizio

- regolazione

- alcuni

- dovrebbero

- mostrare attraverso le sue creazioni

- mostrato

- Un'espansione

- Taglia

- più intelligente

- So

- Social

- Social Media

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- velocità

- Spendere

- quadrato

- dichiarazione

- Passi

- azione

- fermato

- conservazione

- Storie

- Storia

- snellire

- tale

- adatto

- supporto

- Task

- team

- che

- Il

- loro

- Li

- Strumenti Bowman per analizzare le seguenti finiture:

- migliaia

- tre

- soglia

- tempo

- volte

- a

- top

- Totale

- unico

- imminenti

- caricato

- uso

- varietà

- vario

- versione

- Video

- visione

- walkthrough

- guardare

- modi

- WELL

- noto

- se

- quale

- larghezza

- wikipedia

- volere

- con

- entro

- senza

- Lavora

- flussi di lavoro

- lavoro

- sarebbe

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro