I moduli organizzativi fungono da strumento aziendale primario in tutti i settori, dai servizi finanziari, all'assistenza sanitaria e altro ancora. Si consideri, ad esempio, i moduli di dichiarazione dei redditi nel settore della gestione fiscale, in cui ogni anno escono nuovi moduli con in gran parte le stesse informazioni. I clienti AWS di tutti i settori devono elaborare e archiviare le informazioni in moduli come parte della loro pratica aziendale quotidiana. Questi moduli spesso servono come mezzo principale per far fluire le informazioni in un'organizzazione in cui i mezzi tecnologici di acquisizione dei dati sono impraticabili.

Oltre a utilizzare moduli per acquisire informazioni, nel corso degli anni di offerta Testo Amazon, abbiamo osservato che i clienti AWS eseguono spesso le versioni dei moduli organizzativi in base alle modifiche strutturali apportate, ai campi aggiunti o modificati o ad altre considerazioni come il cambio dell'anno o la versione del modulo.

Quando la struttura o il contenuto di un modulo cambia, spesso ciò può causare problemi ai sistemi OCR tradizionali o avere un impatto sugli strumenti a valle utilizzati per acquisire informazioni, anche quando è necessario acquisire le stesse informazioni anno dopo anno e aggregare i dati per l'uso indipendentemente dal formato del documento.

Per risolvere questo problema, in questo post mostriamo come creare e distribuire una pipeline di analisi di documenti multiformato, serverless e basata su eventi con Amazon Textract.

Panoramica della soluzione

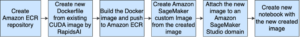

Il diagramma seguente illustra l'architettura della nostra soluzione:

Innanzitutto, la soluzione offre l'utilizzo dell'acquisizione della pipeline Servizio di archiviazione semplice Amazon (Amazon S3), Notifiche di eventi Amazon S3 e an Servizio Amazon Simple Queue (Amazon SQS) in modo che l'elaborazione inizi quando un modulo arriva nella partizione Amazon S3 di destinazione. Un evento su Amazon EventBridge viene creato e inviato a un AWS Lambda destinazione che attiva un processo Amazon Texttract.

Puoi utilizzare servizi AWS serverless come Lambda e Funzioni AWS Step per creare integrazioni di servizi asincroni tra i servizi di intelligenza artificiale di AWS e i servizi di analisi e database di AWS per il magazzino, l'analisi e l'intelligenza artificiale e l'apprendimento automatico (ML). In questo post, dimostriamo come utilizzare Step Functions per controllare e mantenere in modo asincrono lo stato delle richieste alle API asincrone di Amazon Textract. Ciò si ottiene utilizzando una macchina a stati per la gestione delle chiamate e delle risposte. Utilizziamo Lambda all'interno della macchina a stati per unire i dati di risposta dell'API impaginata da Amazon Textract in un singolo oggetto JSON contenente dati di testo semistrutturati estratti tramite OCR.

Quindi filtriamo diversi moduli utilizzando un approccio standardizzato per aggregare questi dati OCR in un formato strutturato comune utilizzando Amazzone Atena e un JSON SQL Amazon Texttract SerDe.

È possibile tracciare i passaggi eseguiti attraverso questa pipeline utilizzando Step Functions serverless per tenere traccia dello stato di elaborazione e conservare l'output di ogni stato. Questo è qualcosa che i clienti in alcuni settori preferiscono fare quando lavorano con i dati in cui è necessario conservare i risultati di tutte le previsioni di servizi come Amazon Textract per promuovere la spiegabilità dei risultati della pipeline a lungo termine.

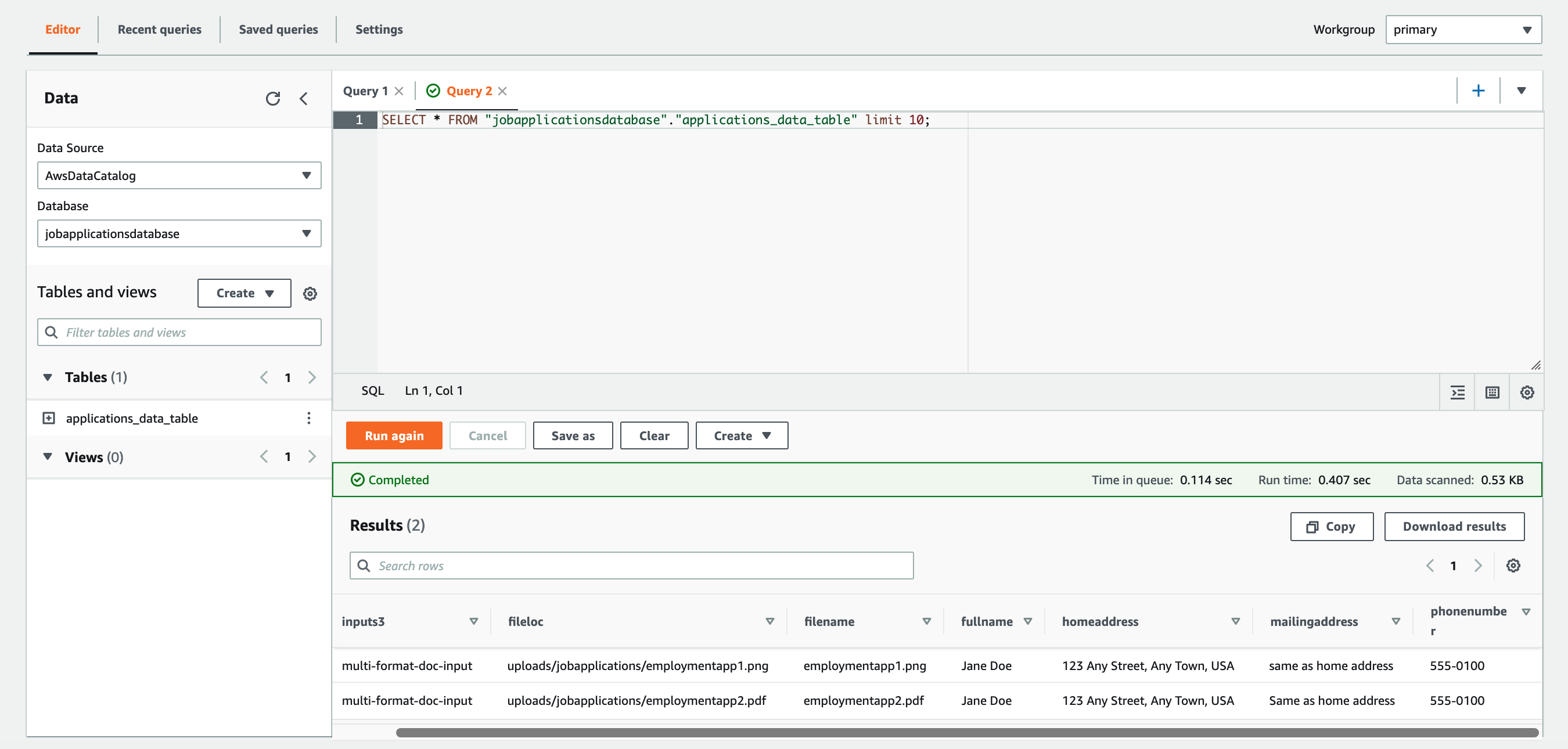

Infine, puoi interrogare i dati estratti nelle tabelle Athena.

Nelle sezioni seguenti, ti guideremo attraverso l'impostazione della pipeline utilizzando AWS CloudFormazione, testare la pipeline e aggiungere nuove versioni dei moduli. Questa pipeline fornisce una soluzione gestibile perché ogni componente (acquisizione, estrazione del testo, elaborazione del testo) è indipendente e isolato.

Definisci i parametri di input predefiniti per gli stack CloudFormation

Per definire i parametri di input per gli stack CloudFormation, apri default.properties sotto il params cartella e inserire il seguente codice:

Distribuisci la soluzione

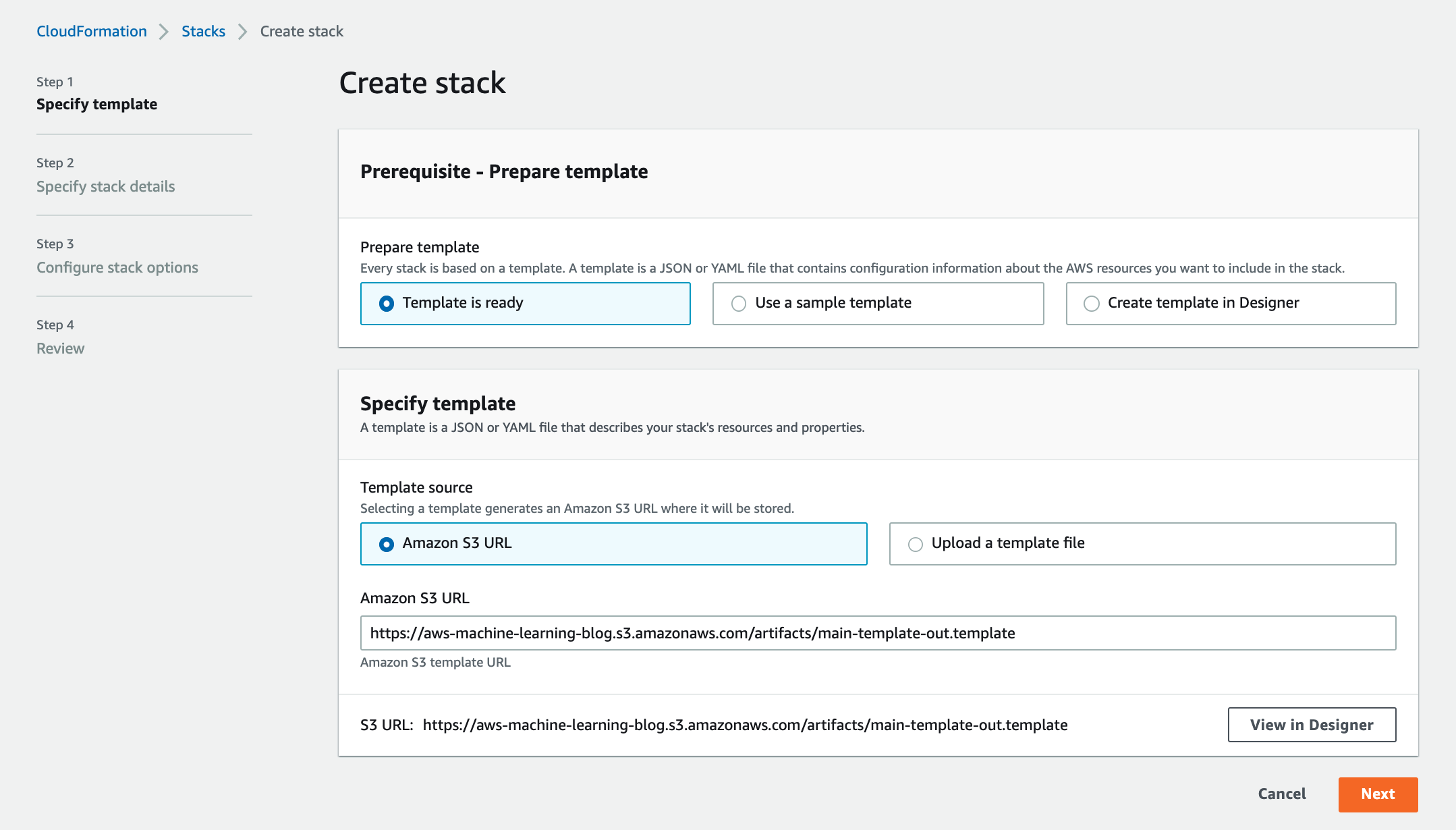

Per distribuire la pipeline, completare i seguenti passaggi:

- Scegli Avvia Stack:

- Scegli Avanti.

- Specifica i dettagli dello stack come mostrato nella schermata seguente e scegli Avanti.

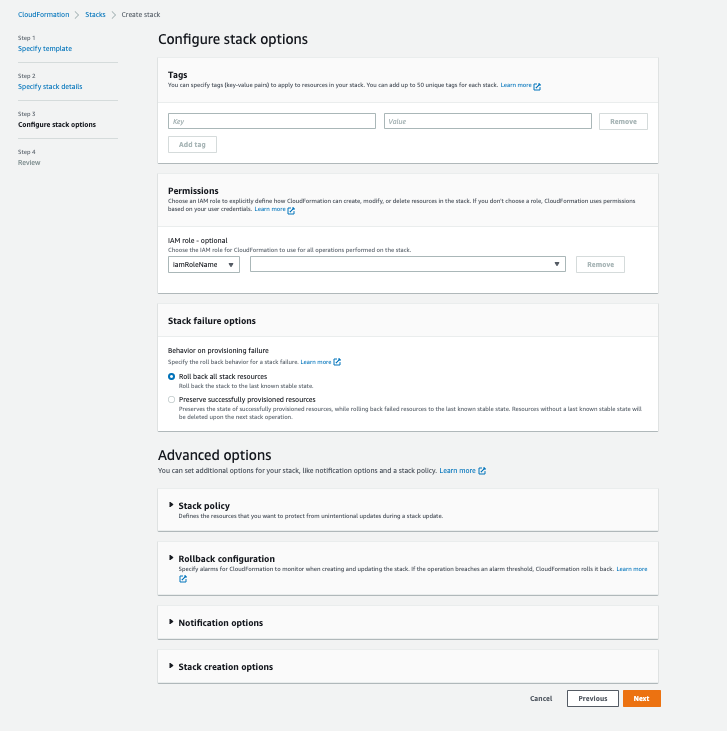

- Nel Configura le opzioni di stack sezione, aggiungi tag opzionali, autorizzazioni e altre impostazioni avanzate.

- Scegli Avanti.

- Rivedi i dettagli dello stack e seleziona Riconosco che AWS CloudFormation potrebbe creare risorse IAM con nomi personalizzati.

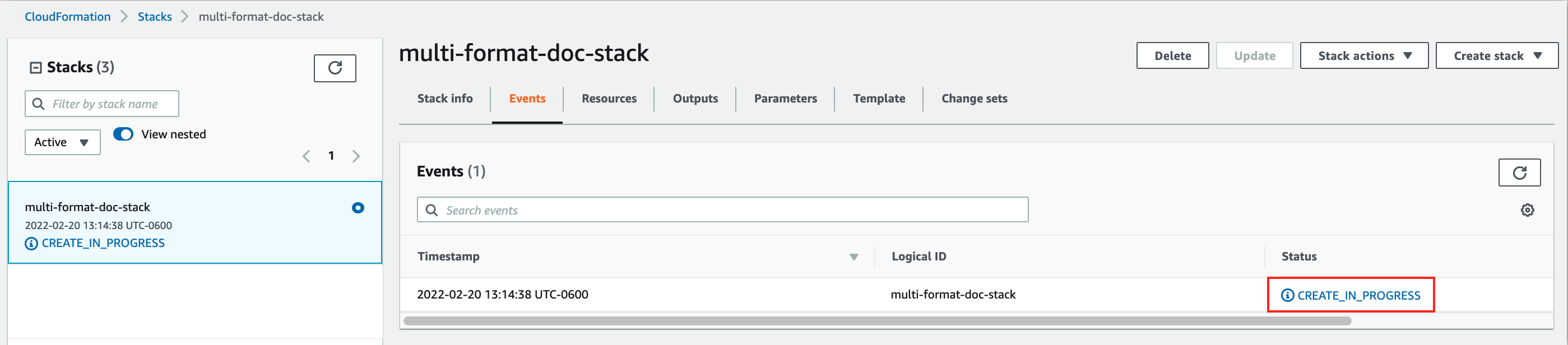

- Scegli Crea stack.

Questo avvia la distribuzione dello stack nel tuo account AWS.

Dopo che lo stack è stato distribuito correttamente, puoi iniziare a testare la pipeline come descritto nella sezione successiva.

Testare la pipeline

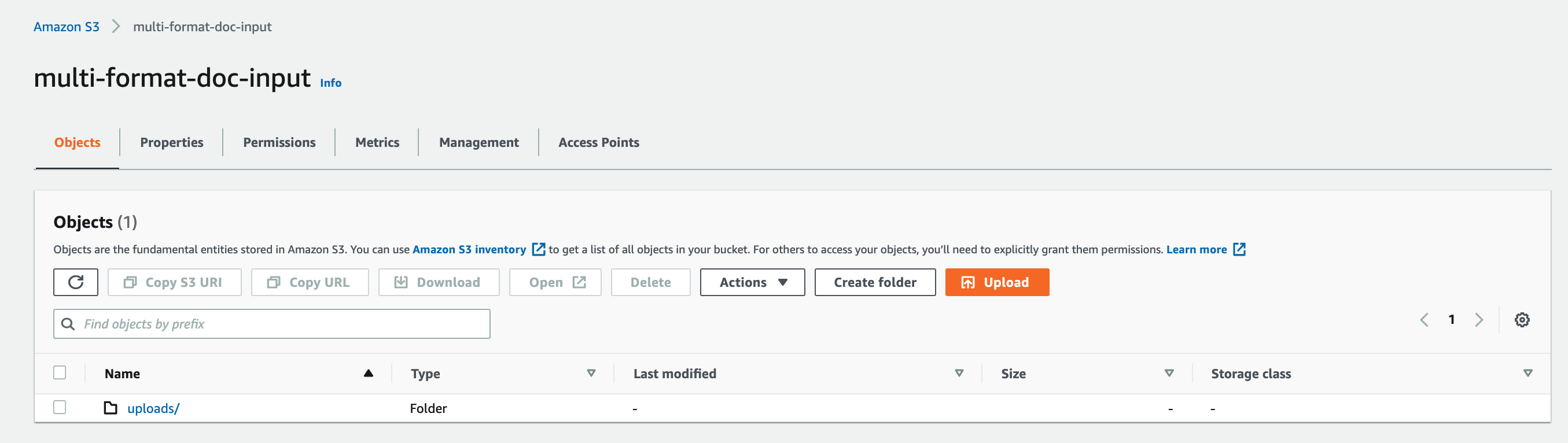

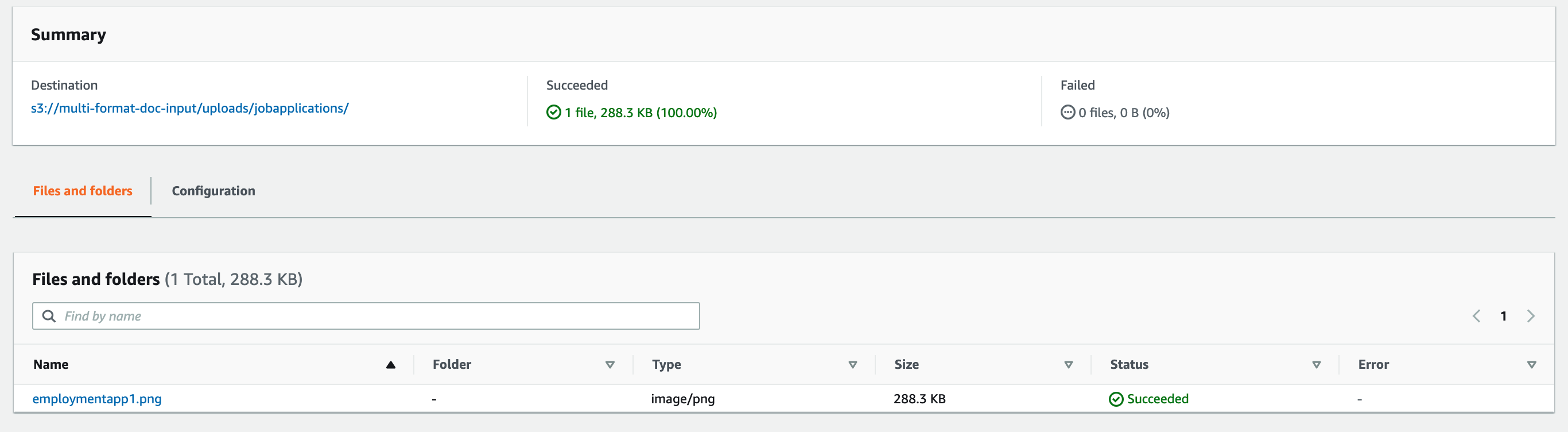

Dopo una distribuzione riuscita, completa i seguenti passaggi per testare la pipeline:

- Scarica la file di esempio sul tuo computer.

- Creare un

/uploadscartella (partizione) nel bucket S3 di input appena creato.

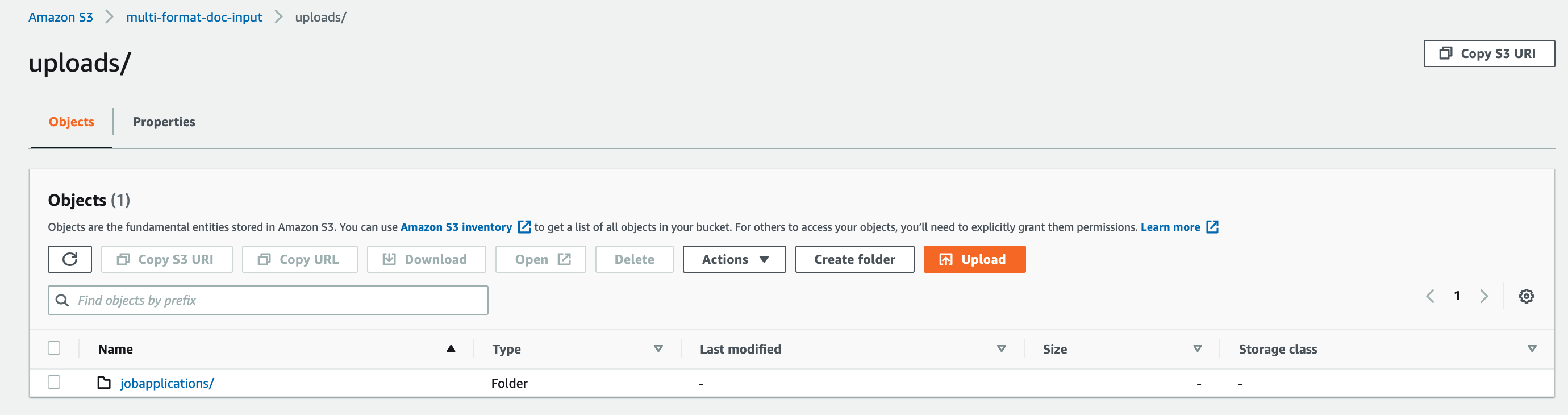

- Crea le cartelle separate (partizioni) come

jobapplicationsper/uploads.

- Carica la prima versione della domanda di lavoro dalla cartella dei documenti di esempio in

/uploads/jobapplicationspartizione.

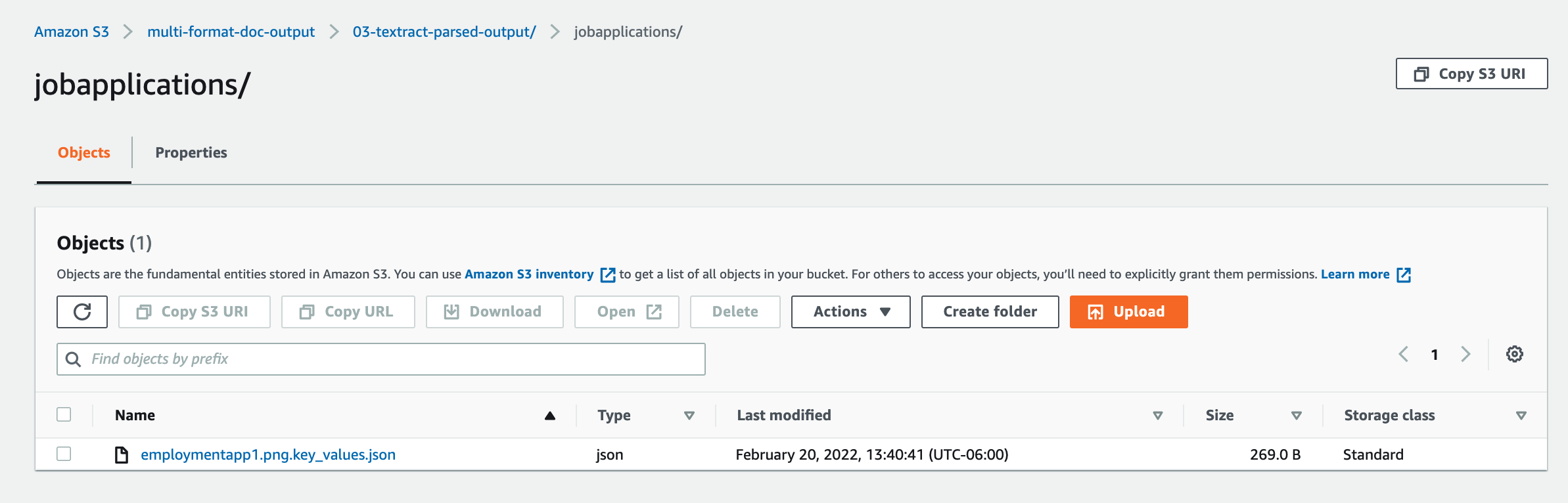

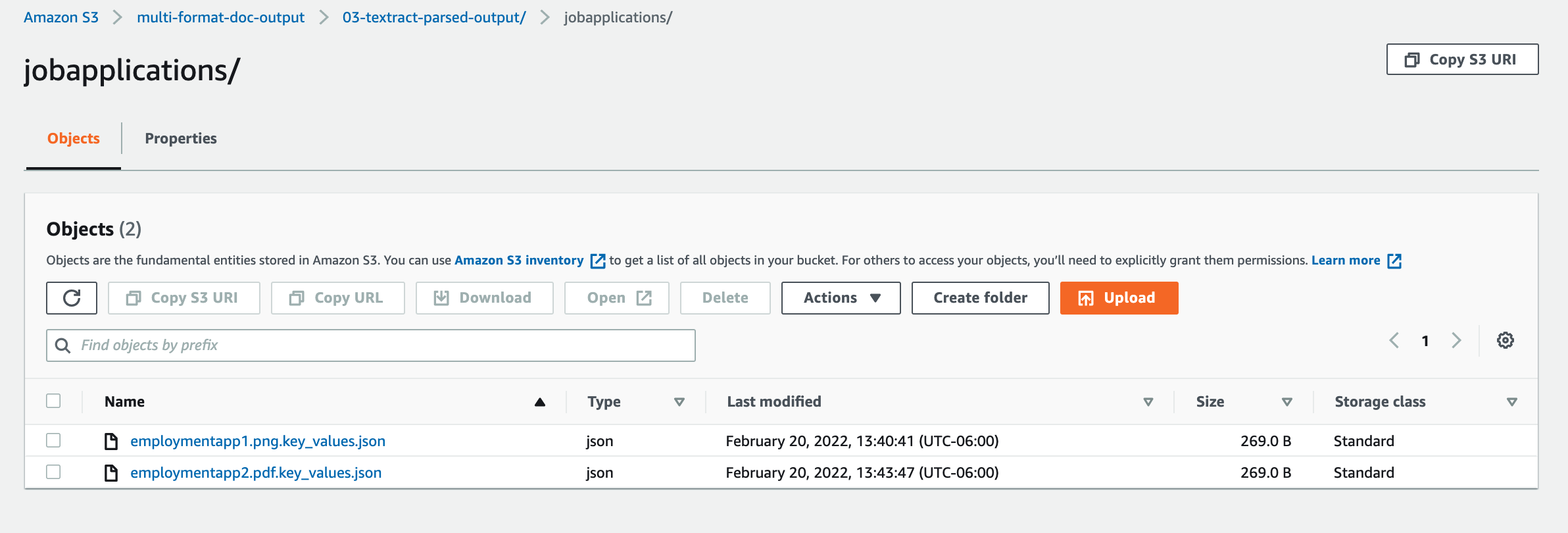

Quando la pipeline è completa, puoi trovare il valore-chiave estratto per questa versione del documento in /OuputS3/03-textract-parsed-output/jobapplications sulla console Amazon S3.

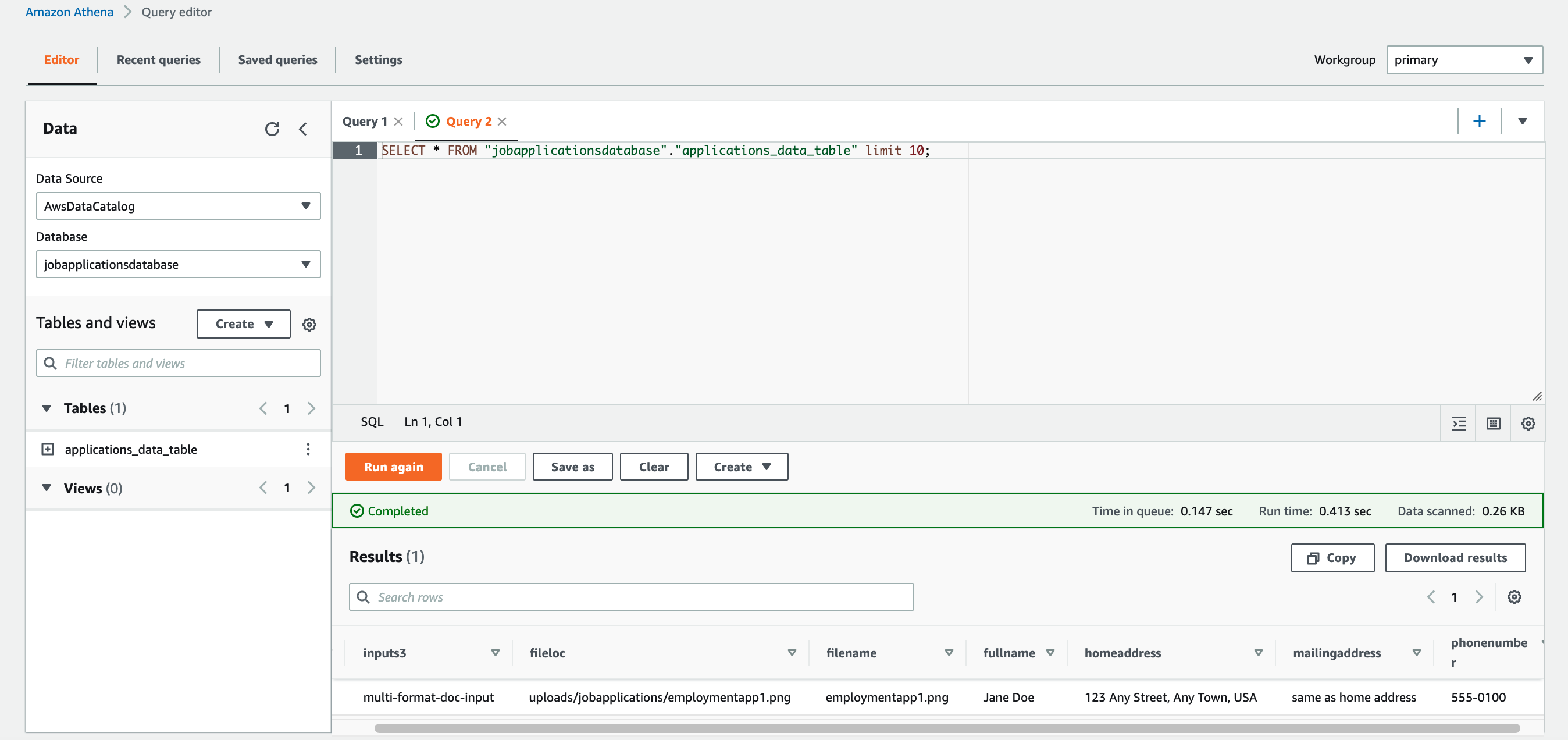

Puoi trovarlo anche nella tabella Athena (applications_data_table) sul Banca Dati menu (jobapplicationsdatabase).

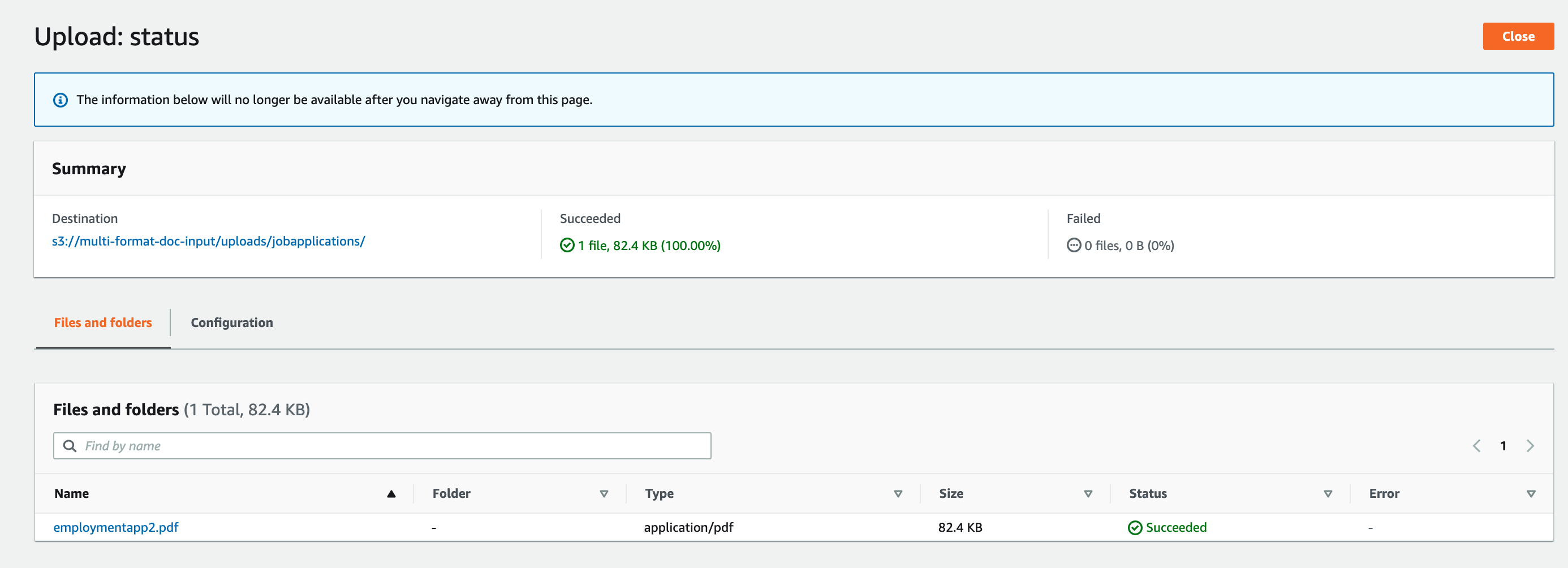

- Carica la seconda versione della domanda di lavoro dalla cartella dei documenti di esempio in

/uploads/jobapplicationspartizione.

Quando la pipeline è completa, puoi trovare il valore-chiave estratto per questa versione in /OuputS3/03-textract-parsed-output/jobapplications sulla console Amazon S3.

Puoi trovarlo anche nella tabella Athena (applications_data_table) sul Banca Dati menu (jobapplicationsdatabase).

Hai finito! Hai distribuito con successo la tua pipeline.

Aggiungi nuove versioni dei moduli

L'aggiornamento della soluzione per una nuova versione del modulo è semplice: ogni versione del modulo deve essere aggiornata solo testando le query nello stack di elaborazione.

Dopo aver effettuato gli aggiornamenti, puoi ridistribuire la pipeline aggiornata utilizzando le API di AWS CloudFormation ed elaborare nuovi documenti, arrivando agli stessi punti dati standard per il tuo schema con interruzioni e sforzi di sviluppo minimi necessari per apportare modifiche alla pipeline. Questa flessibilità, ottenuta separando il comportamento di analisi ed estrazione e utilizzando la funzionalità JSON SerDe in Athena, rende questa pipeline una soluzione gestibile per qualsiasi numero di versioni dei moduli che l'organizzazione deve elaborare per raccogliere informazioni.

Durante l'esecuzione della soluzione di acquisizione, i dati dei moduli in arrivo vengono inseriti automaticamente in Athena con le informazioni sui file e gli input ad essi associati. Quando i dati nei moduli passano da dati non strutturati a dati strutturati, sono pronti per l'uso per applicazioni a valle come analisi, modellazione ML e altro ancora.

ripulire

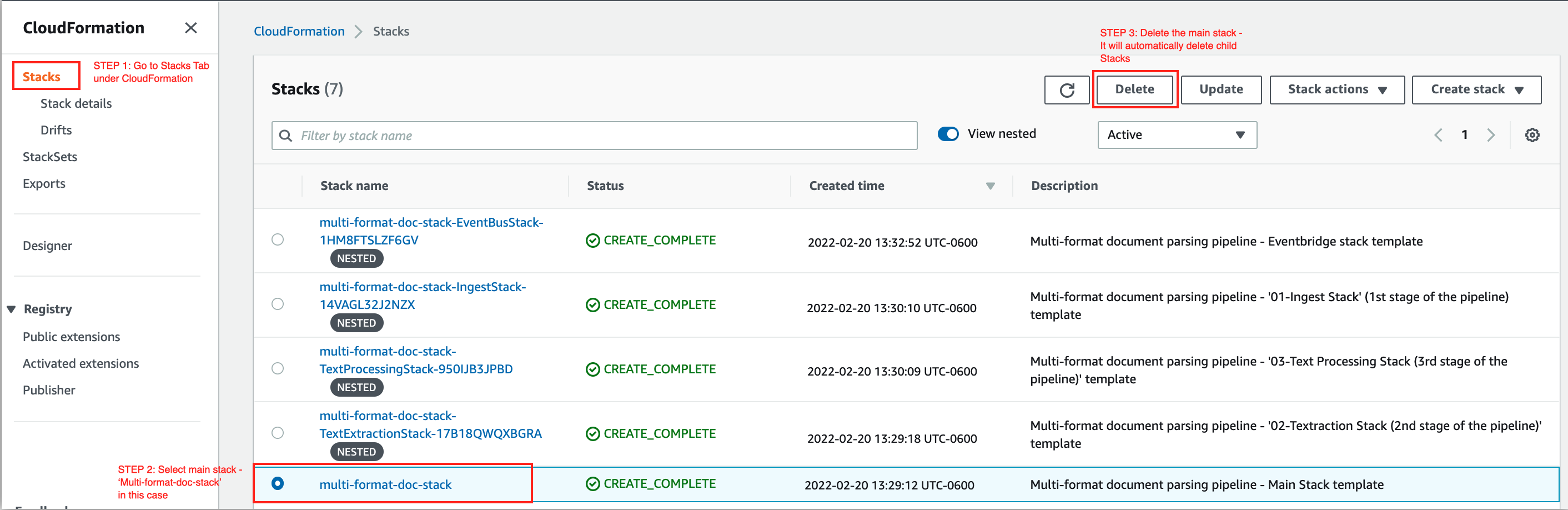

Per evitare di incorrere in spese correnti, elimina le risorse che hai creato come parte di questa soluzione quando hai finito.

- Sulla console Amazon S3, elimina manualmente i bucket che hai creato come parte dello stack CloudFormation.

- Nella console AWS CloudFormation, scegli Stacks nel pannello di navigazione.

- Seleziona la pila principale e scegli Elimina.

Questo elimina automaticamente le pile nidificate.

Conclusione

In questo post, abbiamo dimostrato come i clienti che cercano di tracciare e personalizzare l'elaborazione dei documenti possono creare e distribuire una pipeline di analisi dei documenti multiformato, serverless e basata su eventi con Amazon Textract. Questa pipeline fornisce una soluzione gestibile perché ogni componente (acquisizione, estrazione del testo, elaborazione del testo) è indipendente e isolato, consentendo alle organizzazioni di rendere operative le proprie soluzioni per soddisfare diverse esigenze di elaborazione.

Prova la soluzione oggi e lascia il tuo feedback nella sezione commenti.

Informazioni sugli autori

Emily Soward è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science con Distinction in Artificial Intelligence presso l'Università di Edimburgo in Scozia, Regno Unito, con enfasi sull'elaborazione del linguaggio naturale (NLP). Emily ha ricoperto ruoli scientifici e ingegneristici applicati incentrati su ricerca e sviluppo di prodotti abilitati all'IA, eccellenza operativa e governance per i carichi di lavoro dell'IA in esecuzione presso organizzazioni del settore pubblico e privato. Contribuisce alla guida dei clienti come relatore senior di AWS e, di recente, come autrice di AWS Well-Architected in the Machine Learning Lens.

Emily Soward è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science con Distinction in Artificial Intelligence presso l'Università di Edimburgo in Scozia, Regno Unito, con enfasi sull'elaborazione del linguaggio naturale (NLP). Emily ha ricoperto ruoli scientifici e ingegneristici applicati incentrati su ricerca e sviluppo di prodotti abilitati all'IA, eccellenza operativa e governance per i carichi di lavoro dell'IA in esecuzione presso organizzazioni del settore pubblico e privato. Contribuisce alla guida dei clienti come relatore senior di AWS e, di recente, come autrice di AWS Well-Architected in the Machine Learning Lens.

Sandeep Singh è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science in Information Systems con specializzazione in AI e Data Science presso la San Diego State University (SDSU), California. È un Data Scientist completo con un forte background in informatica e consulente di fiducia con specializzazione in AI Systems and Control design. È appassionato di aiutare i clienti a portare i loro progetti ad alto impatto nella giusta direzione, consigliandoli e guidandoli nel loro viaggio nel cloud e costruendo soluzioni abilitate per AI/ML all'avanguardia.

Sandeep Singh è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science in Information Systems con specializzazione in AI e Data Science presso la San Diego State University (SDSU), California. È un Data Scientist completo con un forte background in informatica e consulente di fiducia con specializzazione in AI Systems and Control design. È appassionato di aiutare i clienti a portare i loro progetti ad alto impatto nella giusta direzione, consigliandoli e guidandoli nel loro viaggio nel cloud e costruendo soluzioni abilitate per AI/ML all'avanguardia.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-a-traceable-custom-multi-format-document-parsing-pipeline-with-amazon-textract/

- "

- 100

- Chi siamo

- Il mio account

- raggiunto

- operanti in

- indirizzo

- Avanzate

- AI

- Servizi di intelligenza artificiale

- Tutti

- Consentire

- Amazon

- analitica

- api

- API

- Applicazioni

- applicazioni

- approccio

- architettura

- artificiale

- intelligenza artificiale

- AWS

- sfondo

- sistema

- costruire

- Costruzione

- affari

- California

- Causare

- sfide

- il cambiamento

- oneri

- Cloud

- codice

- Commenti

- Uncommon

- componente

- Informatica

- concentrazione

- consolle

- contenuto

- di controllo

- Clienti

- dati

- scienza dei dati

- scienziato di dati

- Banca Dati

- dimostrato

- schierare

- deployment

- Design

- Mercato

- diverso

- Rottura

- documenti

- Ingegneria

- Evento

- esempio

- feedback

- campi

- finanziario

- servizi finanziari

- Nome

- Flessibilità

- flusso

- concentrato

- i seguenti

- modulo

- formato

- forme

- pieno

- funzionalità

- la governance

- assistenza sanitaria

- Alta

- detiene

- Come

- Tutorial

- HTTPS

- Impact

- industrie

- industria

- informazioni

- integrazioni

- Intelligence

- IT

- Lavoro

- Regno

- Lingua

- apprendimento

- Lasciare

- Lunghi

- macchina

- machine learning

- mantenere

- gestione

- gestione

- manualmente

- ML

- Naturale

- Navigazione

- numero

- offerta

- Offerte

- aprire

- organizzazione

- organizzativa

- organizzazioni

- Altro

- pratica

- Previsioni

- primario

- un bagno

- Problema

- processi

- Prodotto

- professionale

- progetti

- fornisce

- la percezione

- riparazioni

- ricerca e sviluppo

- Risorse

- risposta

- Risultati

- Correre

- running

- San

- Scienze

- Scienziato

- settore

- Settori

- cerca

- serverless

- servizio

- Servizi

- set

- regolazione

- Un'espansione

- So

- soluzione

- Soluzioni

- RISOLVERE

- qualcosa

- Speaker

- pila

- inizia a

- Regione / Stato

- state-of-the-art

- conservazione

- Tornare al suo account

- forte

- di successo

- Con successo

- SISTEMI DI TRATTAMENTO

- Target

- imposta

- test

- Testing

- Attraverso

- oggi

- strumenti

- pista

- tradizionale

- Unito

- UK

- Università

- Aggiornamenti

- uso

- APPREZZIAMO

- entro

- lavoro

- anno

- anni