Stiamo assistendo a un rapido aumento dell’adozione di modelli linguistici di grandi dimensioni (LLM) che alimentano le applicazioni di intelligenza artificiale generativa in tutti i settori. Gli LLM sono in grado di svolgere una varietà di attività, come generare contenuti creativi, rispondere a richieste tramite chatbot, generare codice e altro ancora.

Le organizzazioni che desiderano utilizzare LLM per potenziare le proprie applicazioni sono sempre più diffidenti nei confronti della privacy dei dati per garantire che la fiducia e la sicurezza siano mantenute all'interno delle loro applicazioni di intelligenza artificiale generativa. Ciò include la corretta gestione dei dati personali identificabili (PII) dei clienti. Include anche la prevenzione della propagazione di contenuti offensivi e non sicuri ai LLM e il controllo che i dati generati dai LLM seguano gli stessi principi.

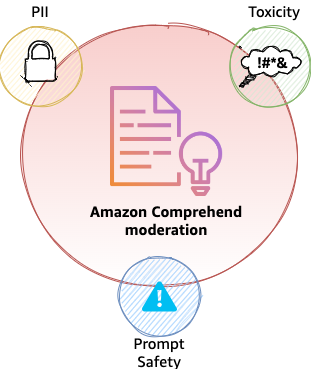

In questo post, discutiamo delle nuove funzionalità fornite da Amazon Comprehend che consentono un’integrazione perfetta per garantire la privacy dei dati, la sicurezza dei contenuti e la protezione rapida nelle applicazioni di intelligenza artificiale generativa nuove ed esistenti.

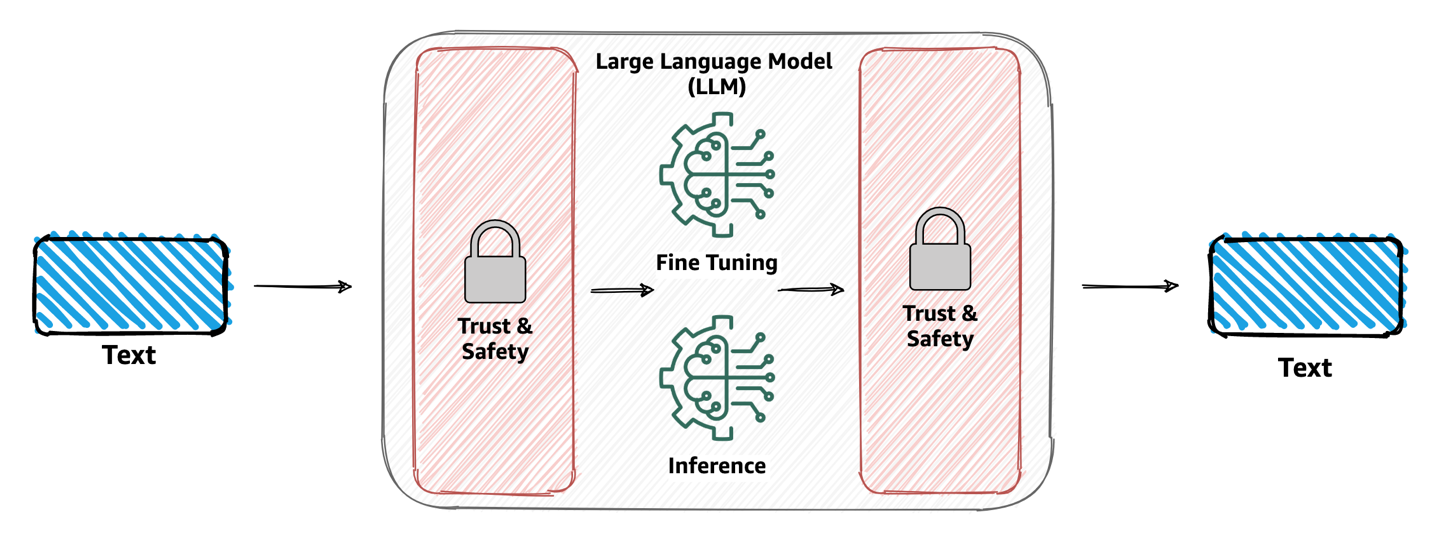

Amazon Comprehend è un servizio di elaborazione del linguaggio naturale (NLP) che utilizza l'apprendimento automatico (ML) per scoprire informazioni in dati e testo non strutturati all'interno dei documenti. In questo post, discutiamo perché la fiducia e la sicurezza con i LLM sono importanti per i tuoi carichi di lavoro. Approfondiremo inoltre il modo in cui queste nuove funzionalità di moderazione vengono utilizzate con il popolare framework di sviluppo dell'intelligenza artificiale generativa LangChain per introdurre un meccanismo di fiducia e sicurezza personalizzabile per il tuo caso d'uso.

Perché la fiducia e la sicurezza con i LLM sono importanti

Fiducia e sicurezza sono fondamentali quando si lavora con LLM a causa del loro profondo impatto su un'ampia gamma di applicazioni, dai chatbot di assistenza clienti alla generazione di contenuti. Poiché questi modelli elaborano grandi quantità di dati e generano risposte simili a quelle umane, aumenta il rischio di abusi o di risultati non desiderati. Garantire che questi sistemi di intelligenza artificiale operino entro limiti etici e affidabili è fondamentale, non solo per la reputazione delle aziende che li utilizzano, ma anche per preservare la fiducia degli utenti finali e dei clienti.

Inoltre, man mano che i LLM diventano sempre più integrati nelle nostre esperienze digitali quotidiane, la loro influenza sulle nostre percezioni, convinzioni e decisioni cresce. Garantire fiducia e sicurezza con gli LLM va oltre le semplici misure tecniche; parla della più ampia responsabilità dei professionisti e delle organizzazioni dell’IA nel sostenere gli standard etici. Dando priorità alla fiducia e alla sicurezza, le organizzazioni non solo proteggono i propri utenti, ma garantiscono anche una crescita sostenibile e responsabile dell’intelligenza artificiale nella società. Può anche contribuire a ridurre il rischio di generazione di contenuti dannosi e a rispettare i requisiti normativi.

Nell'ambito della fiducia e della sicurezza, la moderazione dei contenuti è un meccanismo che affronta vari aspetti, inclusi ma non limitati a:

- Privacy – Gli utenti possono inavvertitamente fornire testo che contiene informazioni sensibili, mettendo a repentaglio la loro privacy. Rilevare e oscurare qualsiasi PII è essenziale.

- Tossicità – Riconoscere e filtrare contenuti dannosi, come incitamento all’odio, minacce o abusi, è della massima importanza.

- Intenzione dell'utente – Identificare se l'input dell'utente (prompt) è sicuro o non sicuro è fondamentale. Le richieste non sicure possono esprimere in modo esplicito o implicito intenti dannosi, come la richiesta di informazioni personali o private e la generazione di contenuti offensivi, discriminatori o illegali. I suggerimenti possono anche esprimere o richiedere implicitamente consigli di natura medica, legale, politica, controversa, personale o finanziaria

Moderazione dei contenuti con Amazon Comprehend

In questa sezione, discutiamo i vantaggi della moderazione dei contenuti con Amazon Comprehend.

Affrontare la privacy

Amazon Comprehend si occupa già della privacy attraverso le sue capacità esistenti di rilevamento e redazione delle PII tramite il Rileva PIIEntities ed Contiene entità PIIE API. Queste due API sono supportate da modelli NLP in grado di rilevare un gran numero di entità PII come numeri di previdenza sociale (SSN), numeri di carte di credito, nomi, indirizzi, numeri di telefono e così via. Per un elenco completo delle entità, fare riferimento a Tipi di entità universali PII. DetectPII fornisce anche la posizione a livello di carattere dell'entità PII all'interno di un testo; ad esempio, la posizione del carattere iniziale dell'entità NAME (John Doe) nella frase “Il mio nome è Joh, falloe" è 12 e la posizione del carattere finale è 19. Questi offset possono essere utilizzati per eseguire il mascheramento o la redazione dei valori, riducendo così i rischi di propagazione dei dati privati nei LLM.

Affrontare la tossicità e garantire la sicurezza immediata

Oggi annunciamo due nuove funzionalità di Amazon Comprehend sotto forma di API: Rilevamento della tossicità tramite DetectToxicContent API e rapida classificazione della sicurezza tramite ClassifyDocument API. Si noti che DetectToxicContent è una nuova API, mentre ClassifyDocument è un'API esistente che ora supporta la classificazione rapida della sicurezza.

Rilevamento della tossicità

Con il rilevamento della tossicità di Amazon Comprehend, puoi identificare e segnalare contenuti che potrebbero essere dannosi, offensivi o inappropriati. Questa funzionalità è particolarmente preziosa per le piattaforme in cui gli utenti generano contenuti, come siti di social media, forum, chatbot, sezioni di commenti e applicazioni che utilizzano LLM per generare contenuti. L’obiettivo principale è mantenere un ambiente positivo e sicuro prevenendo la diffusione di contenuti tossici.

Fondamentalmente, il modello di rilevamento della tossicità analizza il testo per determinare la probabilità che contenga contenuti che incitano all'odio, minacce, oscenità o altre forme di testo dannoso. Il modello viene addestrato su vasti set di dati contenenti esempi di contenuti sia tossici che non tossici. L'API sulla tossicità valuta una determinata parte di testo per fornire la classificazione della tossicità e il punteggio di confidenza. Le applicazioni di intelligenza artificiale generativa possono quindi utilizzare queste informazioni per intraprendere azioni appropriate, come impedire la propagazione del testo ai LLM. Al momento della stesura di questo documento, le etichette rilevate dall'API di rilevamento della tossicità lo sono HATE_SPEECH, GRAPHIC, HARRASMENT_OR_ABUSE, SEXUAL, VIOLENCE_OR_THREAT, INSULTe PROFANITY. Il codice seguente dimostra la chiamata API con Python Boto3 per il rilevamento della tossicità di Amazon Comprehend:

Classificazione di sicurezza rapida

La classificazione di sicurezza dei prompt con Amazon Comprehend aiuta a classificare un prompt di testo di input come sicuro o non sicuro. Questa funzionalità è fondamentale per applicazioni come chatbot, assistenti virtuali o strumenti di moderazione dei contenuti in cui la comprensione della sicurezza di un prompt può determinare risposte, azioni o propagazione del contenuto agli LLM.

In sostanza, la classificazione tempestiva della sicurezza analizza l'input umano per qualsiasi intento dannoso esplicito o implicito, come la richiesta di informazioni personali o private e la generazione di contenuti offensivi, discriminatori o illegali. Segnala inoltre le richieste di consulenza su argomenti medici, legali, politici, controversi, personali o finanziari. La classificazione rapida restituisce due classi, UNSAFE_PROMPT ed SAFE_PROMPT, per un testo associato, con un punteggio di confidenza associato per ciascuno. Il punteggio di confidenza varia tra 0 e 1 e la somma complessiva darà come risultato 1. Ad esempio, in un chatbot dell'assistenza clienti, il testo "Come faccio a reimpostare la mia password?” segnala l'intenzione di richiedere assistenza sulle procedure di reimpostazione della password ed è etichettato come SAFE_PROMPT. Allo stesso modo, un’affermazione come “Vorrei che ti accadesse qualcosa di brutto" può essere contrassegnato per avere un intento potenzialmente dannoso ed etichettato come UNSAFE_PROMPT. È importante notare che la classificazione della sicurezza dei prompt si concentra principalmente sul rilevamento delle intenzioni provenienti da input umani (prompt), piuttosto che da testo generato dalla macchina (output LLM). Il codice seguente illustra come accedere alla funzionalità di classificazione di sicurezza rapida con ClassifyDocument API:

Si noti che endpoint_arn nel codice precedente è un file fornito da AWS Numero di risorsa Amazon (ARN) del modello arn:aws:comprehend:<region>:aws:document-classifier-endpoint/prompt-safety, Dove <region> è la regione AWS di tua scelta dove Amazon Comprende è disponibile.

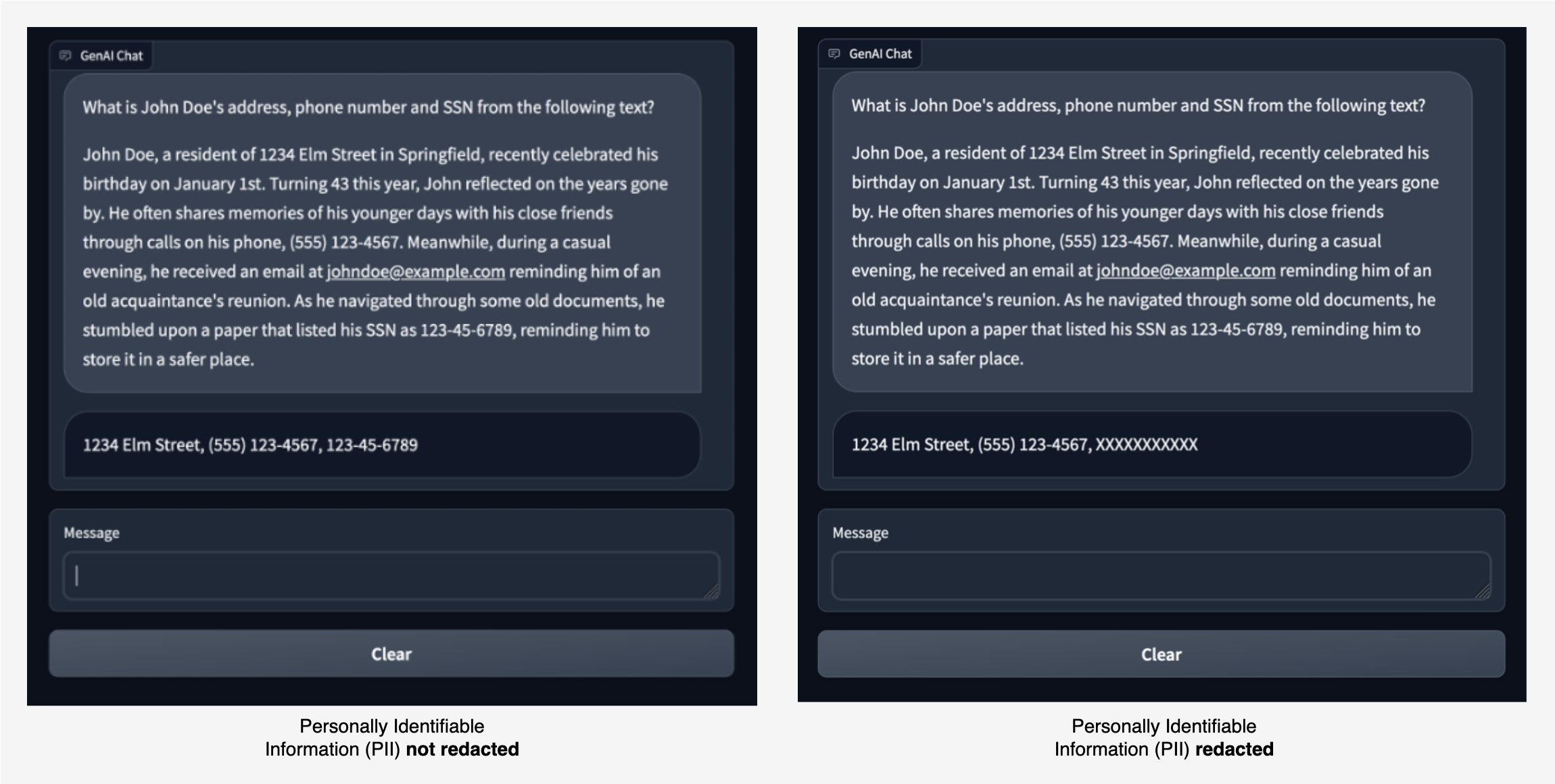

Per dimostrare queste funzionalità, abbiamo creato un'applicazione di chat di esempio in cui chiediamo a un LLM di estrarre entità PII come indirizzo, numero di telefono e SSN da un determinato pezzo di testo. LLM trova e restituisce le entità PII appropriate, come mostrato nell'immagine a sinistra.

Con la moderazione di Amazon Comprehend, possiamo redigere l'input per LLM e l'output da LLM. Nell'immagine a destra, il valore SSN può essere passato a LLM senza oscuramento. Tuttavia, qualsiasi valore SSN nella risposta di LLM viene oscurato.

Di seguito è riportato un esempio di come è possibile impedire del tutto che un prompt contenente informazioni PII raggiunga LLM. Questo esempio mostra un utente che pone una domanda che contiene informazioni PII. Utilizziamo la moderazione di Amazon Comprehend per rilevare le entità PII nel prompt e mostrare un errore interrompendo il flusso.

Gli esempi di chat precedenti mostrano come la moderazione di Amazon Comprehend applica restrizioni sui dati inviati a un LLM. Nelle sezioni seguenti, spieghiamo come questo meccanismo di moderazione viene implementato utilizzando LangChain.

Integrazione con LangChain

Con le infinite possibilità di applicazione degli LLM in vari casi d’uso, è diventato altrettanto importante semplificare lo sviluppo di applicazioni di intelligenza artificiale generativa. LangChain è un popolare framework open source che semplifica lo sviluppo di applicazioni di intelligenza artificiale generativa. La moderazione di Amazon Comprehend estende il framework LangChain per offrire identificazione e redazione delle PII, rilevamento di tossicità e funzionalità di classificazione rapida della sicurezza tramite AmazonComprehendModerationChain.

AmazonComprehendModerationChain è un'implementazione personalizzata di Catena base LangChain interfaccia. Ciò significa che le applicazioni possono utilizzare questa catena con la propria Catene LLM per applicare la moderazione desiderata al prompt di input e al testo di output da LLM. Le catene possono essere costruite unendo numerose catene o mescolando catene con altri componenti. Puoi usare AmazonComprehendModerationChain con altre catene LLM per sviluppare applicazioni AI complesse in modo modulare e flessibile.

Per spiegarlo ulteriormente, forniamo alcuni esempi nelle sezioni seguenti. Il codice sorgente per il AmazonComprehendModerationChain l'implementazione può essere trovata all'interno del file Repository open source LangChain. Per la documentazione completa dell'interfaccia API, fare riferimento alla documentazione dell'API LangChain per Catena di moderazione di Amazon Comprehend. Usare questa catena di moderazione è semplice come inizializzare un'istanza della classe con configurazioni predefinite:

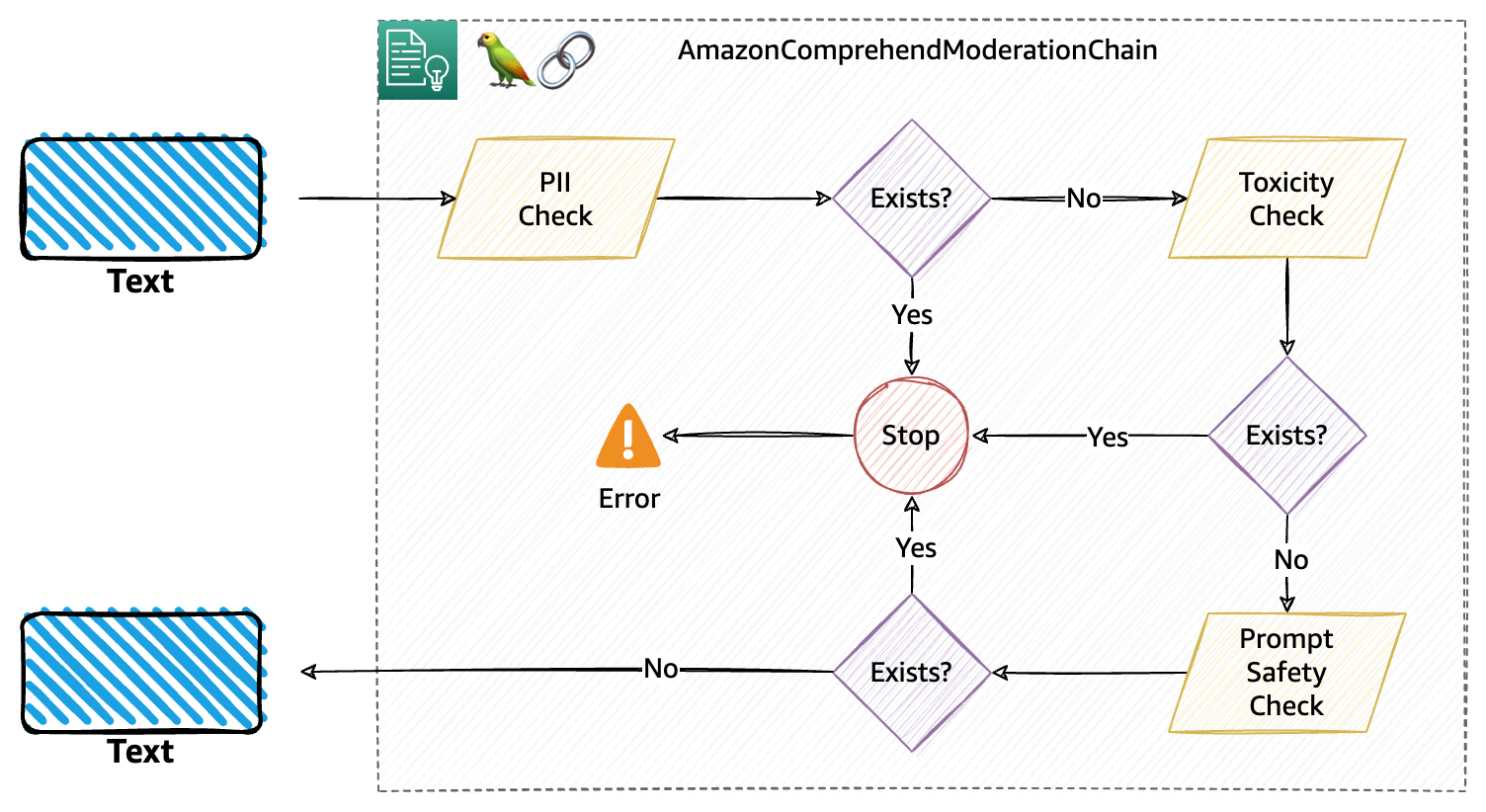

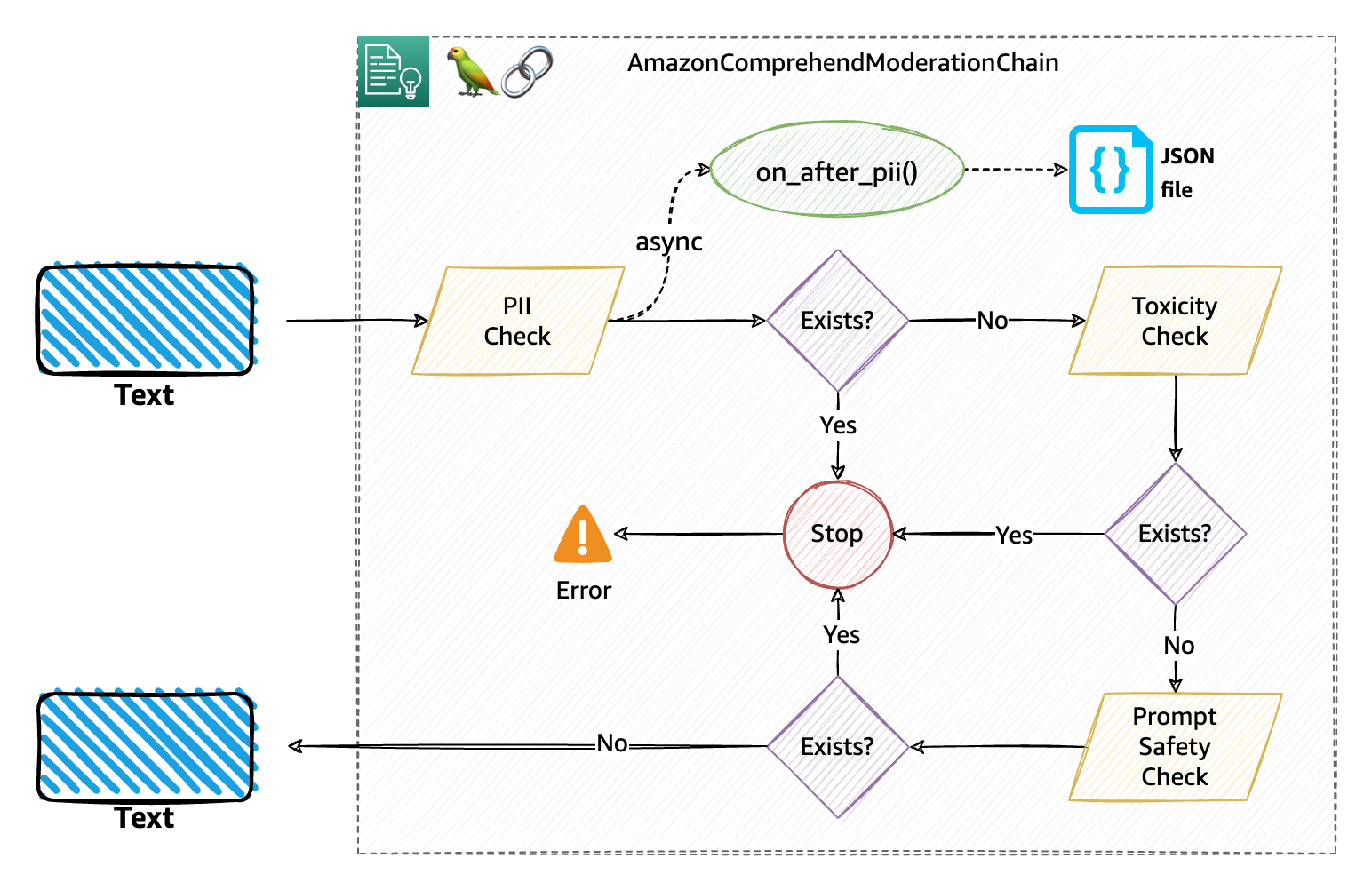

Dietro le quinte, la catena di moderazione esegue tre controlli di moderazione consecutivi, ovvero PII, tossicità e sicurezza immediata, come spiegato nel diagramma seguente. Questo è il flusso predefinito per la moderazione.

Il seguente frammento di codice mostra un semplice esempio di utilizzo della catena di moderazione con il file Amazon FalconLite LLM (che è una versione quantizzata del Modello Falcon 40B SFT OASST-TOP1) ospitato in Hugging Face Hub:

Nell'esempio precedente, aumentiamo la nostra catena con comprehend_moderation sia per il testo che entra nel LLM sia per il testo generato dal LLM. Ciò eseguirà la moderazione predefinita che controllerà le informazioni personali, la tossicità e la classificazione di sicurezza immediata in quella sequenza.

Personalizza la tua moderazione con le configurazioni dei filtri

È possibile utilizzare il AmazonComprehendModerationChain con configurazioni specifiche, che ti danno la possibilità di controllare quali moderazioni desideri eseguire nella tua applicazione generativa basata sull'intelligenza artificiale. Al centro della configurazione, sono disponibili tre configurazioni di filtro.

- ModerazionePiiConfig – Utilizzato per configurare il filtro PII.

- ModerazioneTossicitàConfig – Utilizzato per configurare il filtro del contenuto tossico.

- ModerationIntentConfig – Utilizzato per configurare il filtro dell'intento.

Puoi utilizzare ciascuna di queste configurazioni di filtro per personalizzare il comportamento delle tue moderazioni. Le configurazioni di ciascun filtro hanno alcuni parametri comuni e alcuni parametri univoci con cui possono essere inizializzate. Dopo aver definito le configurazioni, utilizzare il file BaseModerationConfig classe per definire la sequenza in cui i filtri devono essere applicati al testo. Ad esempio, nel codice seguente, definiamo prima le tre configurazioni di filtro e successivamente specifichiamo l'ordine in cui devono essere applicate:

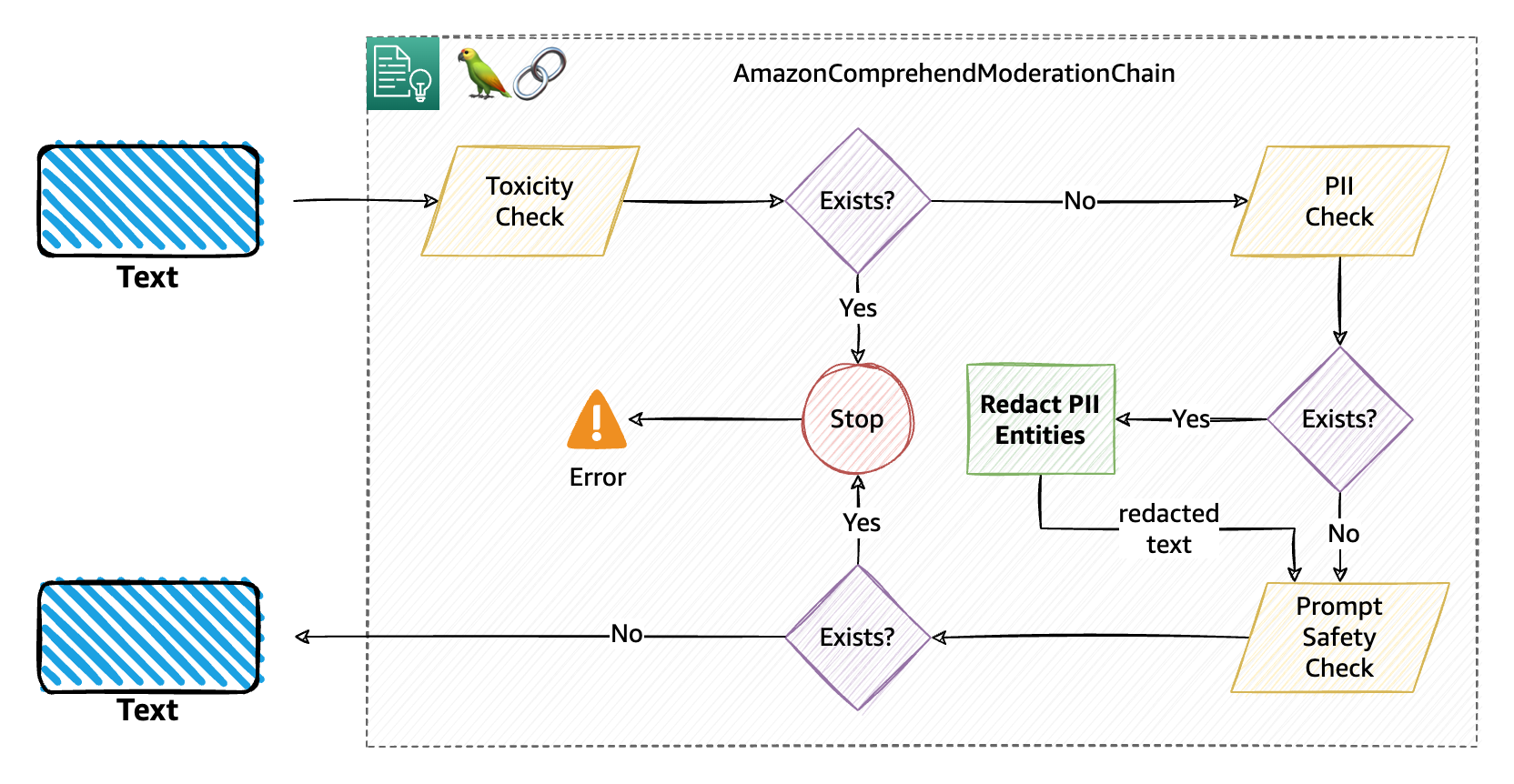

Andiamo un po' più a fondo per capire cosa ottiene questa configurazione:

- Innanzitutto, per il filtro di tossicità, abbiamo specificato una soglia di 0.6. Ciò significa che se il testo contiene una qualsiasi delle etichette o entità tossiche disponibili con un punteggio superiore alla soglia, l'intera catena verrà interrotta.

- Se nel testo non è stato trovato alcun contenuto tossico, è necessario eseguire un controllo PII. In questo caso, siamo interessati a verificare se il testo contiene valori SSN. Perché il

redactparametro è impostato suTrue, la catena maschererà i valori SSN rilevati (se presenti) dove il punteggio di confidenza dell'entità SSN è maggiore o uguale a 0.5, con il carattere della maschera specificato (X). Seredactè impostato suFalse, la catena verrà interrotta per qualsiasi SSN rilevato. - Infine, la catena esegue una tempestiva classificazione di sicurezza e impedisce al contenuto di propagarsi ulteriormente lungo la catena se il contenuto viene classificato con

UNSAFE_PROMPTcon un punteggio di confidenza maggiore o uguale a 0.8.

Il diagramma seguente illustra questo flusso di lavoro.

In caso di interruzioni della catena di moderazione (in questo esempio applicabile per i filtri di classificazione di tossicità e di tempestiva sicurezza), la catena solleverà un Eccezione Python, essenzialmente arrestando la catena in corso e consentendoti di catturare l'eccezione (in un blocco try-catch) ed eseguire qualsiasi azione rilevante. I tre possibili tipi di eccezione sono:

ModerationPIIErrorModerationToxicityErrorModerationPromptSafetyError

È possibile configurare uno o più filtri utilizzando BaseModerationConfig. Puoi anche avere lo stesso tipo di filtro con configurazioni diverse all'interno della stessa catena. Ad esempio, se il tuo caso d'uso riguarda solo le PII, puoi specificare una configurazione che deve interrompere la catena nel caso in cui venga rilevato un SSN; in caso contrario, deve eseguire la redazione dell'età e denominare le entità PII. Una configurazione per questo può essere definita come segue:

Utilizzo di callback e identificatori univoci

Se hai familiarità con il concetto di flussi di lavoro, potresti avere familiarità anche con callback. I callback all'interno dei flussi di lavoro sono parti di codice indipendenti che vengono eseguite quando vengono soddisfatte determinate condizioni all'interno del flusso di lavoro. Una richiamata può essere bloccante o non bloccante per il flusso di lavoro. Le catene LangChain sono, in sostanza, flussi di lavoro per LLM. AmazonComprehendModerationChain consente di definire le proprie funzioni di callback. Inizialmente, l'implementazione è limitata solo alle funzioni di callback asincrone (non bloccanti).

Ciò significa effettivamente che se si utilizzano i callback con la catena di moderazione, verranno eseguiti indipendentemente dall'esecuzione della catena senza bloccarla. Per la catena di moderazione, hai la possibilità di eseguire parti di codice, con qualsiasi logica aziendale, dopo l'esecuzione di ogni moderazione, indipendentemente dalla catena.

Facoltativamente, puoi anche fornire una stringa identificativa univoca arbitraria durante la creazione di un file AmazonComprehendModerationChain per abilitare la registrazione e l'analisi in un secondo momento. Ad esempio, se gestisci un chatbot basato su un LLM, potresti voler tenere traccia degli utenti che sono costantemente offensivi o che espongono deliberatamente o inconsapevolmente informazioni personali. In questi casi, diventa necessario tracciare l'origine di tali richieste e magari memorizzarle in un database o registrarle in modo appropriato per ulteriori azioni. È possibile passare un ID univoco che identifichi distintamente un utente, ad esempio il nome utente o l'e-mail, oppure il nome dell'applicazione che sta generando il prompt.

La combinazione di callback e identificatori univoci fornisce un modo potente per implementare una catena di moderazione che si adatta al tuo caso d'uso in modo molto più coeso con meno codice e più facile da mantenere. Il gestore di callback è disponibile tramite il file BaseModerationCallbackHandler, con tre callback disponibili: on_after_pii(), on_after_toxicity()e on_after_prompt_safety(). Ognuna di queste funzioni di callback viene chiamata in modo asincrono dopo aver eseguito il rispettivo controllo di moderazione all'interno della catena. Queste funzioni ricevono anche due parametri predefiniti:

- moderation_beacon – Un dizionario contenente dettagli come il testo su cui è stata eseguita la moderazione, l'output JSON completo dell'API Amazon Comprehend, il tipo di moderazione e se le etichette fornite (nella configurazione) sono state trovate o meno all'interno del testo

- ID_univoco – L'ID univoco assegnato durante l'inizializzazione di un'istanza di

AmazonComprehendModerationChain.

Di seguito è riportato un esempio di come funziona un'implementazione con callback. In questo caso, abbiamo definito un singolo callback che vogliamo che la catena esegua dopo l'esecuzione del controllo PII:

Usiamo quindi il my_callback oggetto durante l'inizializzazione della catena di moderazione e passa anche a unique_id. Puoi utilizzare callback e identificatori univoci con o senza configurazione. Quando sottoclassi BaseModerationCallbackHandler, è necessario implementare uno o tutti i metodi di callback a seconda dei filtri che si intende utilizzare. Per brevità, l'esempio seguente mostra un modo per utilizzare i callback e unique_id senza alcuna configurazione:

Il diagramma seguente spiega come funziona questa catena di moderazione con callback e identificatori univoci. Nello specifico, abbiamo implementato la callback PII che dovrebbe scrivere un file JSON con i dati disponibili nel file moderation_beacon e la unique_id superato (l'e-mail dell'utente in questo caso).

Nella seguente Taccuino Python, abbiamo compilato alcuni modi diversi per configurare e utilizzare la catena di moderazione con vari LLM, ad esempio LLM ospitati con JumpStart di Amazon SageMaker e ospitato in Hub per il viso che abbraccia. Abbiamo incluso anche l'applicazione di chat di esempio di cui abbiamo discusso in precedenza con quanto segue Taccuino Python.

Conclusione

Il potenziale trasformativo dei grandi modelli linguistici e dell’intelligenza artificiale generativa è innegabile. Tuttavia, il loro utilizzo responsabile ed etico dipende dalla risposta alle preoccupazioni relative alla fiducia e alla sicurezza. Riconoscendo le sfide e implementando attivamente misure per mitigare i rischi, gli sviluppatori, le organizzazioni e la società in generale possono sfruttare i vantaggi di queste tecnologie preservando la fiducia e la sicurezza che sono alla base della loro integrazione di successo. Utilizza Amazon Comprehend ContentModerationChain per aggiungere funzionalità di affidabilità e sicurezza a qualsiasi flusso di lavoro LLM, inclusi i flussi di lavoro di Retrieval Augmented Generation (RAG) implementati in LangChain.

Per informazioni sulla creazione di soluzioni basate su RAG utilizzando LangChain e la tecnologia altamente accurata e basata sul machine learning (ML) di Amazon Kendra ricerca intelligente, Vedere - Crea rapidamente applicazioni di intelligenza artificiale generativa ad alta precisione sui dati aziendali utilizzando Amazon Kendra, LangChain e modelli di linguaggio di grandi dimensioni. Come passaggio successivo, fare riferimento a campioni di codice che abbiamo creato per utilizzare la moderazione di Amazon Comprehend con LangChain. Per la documentazione completa dell'API della catena di moderazione Amazon Comprehend, fare riferimento a LangChain Documentazione delle API.

Circa gli autori

Wrick Talukdar è un Senior Architect del team Amazon Comprehend Service. Lavora con i clienti AWS per aiutarli ad adottare il machine learning su larga scala. Al di fuori del lavoro, ama leggere e fotografare.

Wrick Talukdar è un Senior Architect del team Amazon Comprehend Service. Lavora con i clienti AWS per aiutarli ad adottare il machine learning su larga scala. Al di fuori del lavoro, ama leggere e fotografare.

Anjan Biswas è un Senior AI Services Solutions Architect con un focus su AI/ML e Data Analytics. Anjan fa parte del team di servizi AI a livello mondiale e lavora con i clienti per aiutarli a comprendere e sviluppare soluzioni ai problemi aziendali con AI e ML. Anjan ha oltre 14 anni di esperienza di lavoro con organizzazioni globali di supply chain, produzione e vendita al dettaglio e sta attivamente aiutando i clienti a iniziare e scalare i servizi AWS AI.

Anjan Biswas è un Senior AI Services Solutions Architect con un focus su AI/ML e Data Analytics. Anjan fa parte del team di servizi AI a livello mondiale e lavora con i clienti per aiutarli a comprendere e sviluppare soluzioni ai problemi aziendali con AI e ML. Anjan ha oltre 14 anni di esperienza di lavoro con organizzazioni globali di supply chain, produzione e vendita al dettaglio e sta attivamente aiutando i clienti a iniziare e scalare i servizi AWS AI.

Nikhil Jha è un Senior Technical Account Manager presso Amazon Web Services. Le sue aree di interesse includono AI/ML e analisi. Nel tempo libero, gli piace giocare a badminton con sua figlia ed esplorare la vita all'aria aperta.

Nikhil Jha è un Senior Technical Account Manager presso Amazon Web Services. Le sue aree di interesse includono AI/ML e analisi. Nel tempo libero, gli piace giocare a badminton con sua figlia ed esplorare la vita all'aria aperta.

Mento Rane è un architetto di soluzioni specializzato in AI/ML presso Amazon Web Services. È appassionata di matematica applicata e machine learning. Si concentra sulla progettazione di soluzioni intelligenti per l'elaborazione dei documenti per i clienti AWS. Al di fuori del lavoro, le piace ballare la salsa e la bachata.

Mento Rane è un architetto di soluzioni specializzato in AI/ML presso Amazon Web Services. È appassionata di matematica applicata e machine learning. Si concentra sulla progettazione di soluzioni intelligenti per l'elaborazione dei documenti per i clienti AWS. Al di fuori del lavoro, le piace ballare la salsa e la bachata.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-trust-and-safety-for-generative-ai-applications-with-amazon-comprehend-and-langchain/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 100

- 11

- 12

- 14

- 15%

- 17

- 19

- 500

- 7

- 8

- 9

- a

- abilità

- capacità

- WRI

- abuso

- accesso

- Il mio account

- preciso

- Realizza

- operanti in

- Action

- azioni

- attivamente

- aggiungere

- indirizzo

- indirizzi

- indirizzamento

- aderire

- adottare

- Adozione

- consigli

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- Servizi di intelligenza artificiale

- Sistemi di intelligenza artificiale

- AI / ML

- Tutti

- permesso

- Consentire

- consente

- già

- anche

- del tutto

- Amazon

- Amazon Comprehend

- Amazon Kendra

- Amazon Web Services

- importi

- an

- analitica

- analisi

- ed

- annunciando

- rispondere

- in qualsiasi

- api

- API

- applicabile

- Applicazioni

- applicazioni

- applicato

- si applica

- APPLICA

- opportuno

- appropriatamente

- SONO

- aree

- AS

- chiedere

- chiedendo

- aspetti

- addetto

- assistenti

- associato

- At

- aumentare

- aumentata

- disponibile

- AWS

- Backed

- Vasca

- base

- basato

- BE

- perché

- diventare

- diventa

- comportamento

- essendo

- credenze

- vantaggi

- fra

- Al di là di

- Bloccare

- blocco

- entrambi

- confini

- più ampia

- costruire

- costruire fiducia

- Costruzione

- costruito

- affari

- aziende

- ma

- by

- chiamata

- callback

- detto

- Materiale

- funzionalità

- capacità

- capace

- capitale

- carta

- Custodie

- casi

- lotta

- certo

- catena

- Catene

- sfide

- carattere

- chatbot

- chatbots

- dai un'occhiata

- verifica

- Controlli

- mento

- scegliere

- classe

- classi

- classificazione

- classificato

- classificare

- cliente

- codice

- coesivo

- COM

- combinazione

- combinato

- commento

- Uncommon

- complesso

- componenti

- comprendere

- concetto

- interessato

- preoccupazioni

- condizioni

- fiducia

- Configurazione

- consecutivo

- costantemente

- contiene

- contenuto

- Generazione di contenuti

- di controllo

- controverso

- Nucleo

- creato

- Creazione

- Creative

- credito

- carta di credito

- critico

- cruciale

- costume

- cliente

- Assistenza clienti

- Clienti

- personalizzabile

- personalizzare

- alle lezioni

- Danza

- dati

- Dati Analytics

- privacy dei dati

- Banca Dati

- dataset

- decisioni

- più profondo

- Predefinito

- definire

- definito

- scavare

- dimostrare

- dimostra

- Dipendente

- progettazione

- desiderato

- dettagli

- individuare

- rilevato

- rivelazione

- Determinare

- sviluppare

- sviluppatori

- Mercato

- diverso

- digitale

- discutere

- discusso

- distintamente

- immersione

- do

- documento

- documentazione

- documenti

- daino

- giù

- dovuto

- e

- ogni

- In precedenza

- più facile

- in maniera efficace

- senza sforzo

- o

- altro

- enable

- fine

- Senza fine

- garantire

- assicurando

- Impresa

- entità

- entità

- Ambiente

- pari

- Allo stesso modo

- errore

- essenza

- essential

- essenzialmente

- etico

- esempio

- Esempi

- Tranne

- eccezione

- esistente

- esperienza

- Esperienze

- Spiegare

- ha spiegato

- Spiega

- espressamente

- Esplorare

- esprimere

- si estende

- estratto

- Faccia

- familiare

- caratteristica

- Caratteristiche

- pochi

- Compila il

- filtro

- filtraggio

- filtri

- finanziario

- Trovate

- trova

- Nome

- contrassegnato

- bandiere

- flessibile

- flusso

- Focus

- concentrato

- si concentra

- i seguenti

- segue

- Nel

- modulo

- formato

- forme

- forum

- essere trovato

- Contesto

- Francia

- da

- pieno

- funzioni

- ulteriormente

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- gif

- Dare

- dato

- dà

- globali

- scopo

- va

- andando

- buono

- maggiore

- cresce

- Crescita

- guida

- Manovrabilità

- accade

- dannoso

- cintura da arrampicata

- odio

- Avere

- avendo

- he

- Aiuto

- aiutare

- aiuta

- vivamente

- cerniere

- il suo

- ospitato

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- Hub

- umano

- umano

- i

- ID

- Identificazione

- identificatore

- identificatori

- identifica

- identificare

- identificazione

- if

- Illegale

- illustra

- Immagine

- Impact

- realizzare

- implementazione

- implementato

- Implementazione

- importare

- importanza

- importante

- in

- inavvertitamente

- includere

- incluso

- inclusi

- Compreso

- Aumento

- Aumenta

- sempre più

- studente indipendente

- indipendentemente

- industrie

- influenza

- informazioni

- inizialmente

- ingresso

- Ingressi

- Richieste

- esempio

- integrato

- integrazione

- Intelligente

- Elaborazione intelligente dei documenti

- intendono

- intento

- interessato

- Interfaccia

- sospeso

- ai miglioramenti

- introdurre

- IT

- SUO

- John

- JOHN DOE

- jpg

- json

- ad appena

- per il tuo brand

- Lingua

- grandi

- dopo

- apprendimento

- a sinistra

- Legale

- meno

- piace

- probabilità

- Limitato

- Lista

- piccolo

- un po' più profondo

- LLM

- ceppo

- registrazione

- logica

- cerca

- macchina

- machine learning

- mantenere

- FA

- direttore

- modo

- consigliato per la

- mask

- matematica

- Importanza

- Maggio..

- me

- si intende

- analisi

- meccanismo

- Media

- medicale

- fusione

- di cartone

- metodi

- uso improprio

- Ridurre la perdita dienergia con una

- Miscelazione

- ML

- modello

- modelli

- moderazione

- componibile

- Scopri di più

- molti

- devono obbligatoriamente:

- my

- Nome

- cioè

- nomi

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- New

- Nuove funzionalità

- GENERAZIONE

- nlp

- no

- adesso

- numero

- numeri

- numerose

- oggetto

- of

- offensivo

- offrire

- offset

- on

- ONE

- esclusivamente

- aprire

- open source

- operare

- operativo

- Opzioni

- or

- minimo

- organizzazioni

- origine

- Altro

- altrimenti

- nostro

- su

- risultati

- all'aperto

- produzione

- uscite

- al di fuori

- ancora

- proprio

- parametro

- parametri

- supremo

- parte

- particolarmente

- passare

- Passato

- appassionato

- Password

- reimpostazione della password

- Cartamodello

- Eseguire

- eseguita

- esegue

- Forse

- cronologia

- Personalmente

- telefono

- fotografia

- pezzo

- pezzi

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- politico

- Popolare

- posizione

- positivo

- possibilità

- possibile

- Post

- potenziale

- potenzialmente

- energia

- alimentato

- potente

- preservare

- prevenzione

- principalmente

- primario

- principi

- prioritizzazione

- Privacy

- un bagno

- informazioni riservate

- problemi

- procedure

- processi

- lavorazione

- profonda

- Progressi

- propriamente

- protegge

- fornire

- fornisce

- Python

- domanda

- aumentare

- gamma

- gamme

- veloce

- piuttosto

- raggiungendo

- Lettura

- regno

- ricevere

- riconoscendo

- ridurre

- riducendo

- riferimento

- regione

- normativo

- pertinente

- affidabile

- reputazione

- richiesta

- Requisiti

- risorsa

- quelli

- risposta

- risposte

- responsabilità

- responsabile

- restrizioni

- nello specifico retail

- problemi

- destra

- Rischio

- rischi

- Correre

- s

- sicura

- Sicurezza

- sagemaker

- stesso

- Scala

- Scene

- Punto

- senza soluzione di continuità

- Sezione

- sezioni

- problemi di

- vedere

- Cercare

- AUTO

- anziano

- delicata

- inviato

- condanna

- Sequenza

- servizio

- Servizi

- set

- lei

- dovrebbero

- mostrare attraverso le sue creazioni

- vetrina

- mostrato

- Spettacoli

- Segnali

- Allo stesso modo

- Un'espansione

- semplificare

- singolo

- Siti

- frammento

- So

- Social

- Social Media

- Società

- Soluzioni

- alcuni

- qualcosa

- Fonte

- codice sorgente

- Parla

- specialista

- specifico

- in particolare

- specificato

- discorso

- standard

- inizia a

- iniziato

- dichiarazione

- step

- Fermare

- sosta

- Tornare al suo account

- Corda

- Successivamente

- di successo

- tale

- in dotazione

- fornire

- supply chain

- supporto

- supporti

- sostenibile

- SISTEMI DI TRATTAMENTO

- Fai

- task

- team

- Consulenza

- Tecnologie

- modello

- testo

- di

- che

- Il

- La capitale

- L’ORIGINE

- loro

- Li

- poi

- Là.

- in tal modo

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- minacce

- tre

- soglia

- Attraverso

- tempo

- a

- strumenti

- pista

- allenato

- trasformativa

- Affidati ad

- prova

- seconda

- Digitare

- Tipi di

- scoprire

- innegabile

- sostegno

- capire

- e una comprensione reciproca

- unico

- universale

- sostenere

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilizzare

- utilizzati

- Prezioso

- APPREZZIAMO

- Valori

- varietà

- vario

- Fisso

- versione

- via

- virtuale

- W

- volere

- Prima

- Modo..

- modi

- we

- sito web

- servizi web

- WELL

- sono stati

- Che

- Che cosa è l'

- quando

- mentre

- se

- quale

- while

- OMS

- tutto

- perché

- largo

- Vasta gamma

- volere

- desiderio

- con

- entro

- senza

- testimoniando

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- scrivere

- scrittura

- X

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro