La saga di Clearview AI continua!

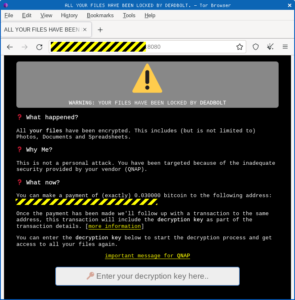

Se non hai mai sentito parlare di questa azienda prima, ecco un molto riassunto chiaro e conciso dal regolatore francese della privacy, CNIL (Commissione nazionale per l'informatica e le libertà), che ha pubblicato molto facilmente i suoi risultati e le sue sentenze in questa lunga storia sia in francese che in inglese:

Clearview AI raccoglie fotografie da molti siti Web, inclusi i social media. Raccoglie tutte le fotografie che sono direttamente accessibili su queste reti (cioè che possono essere visualizzate senza accedere a un account). Le immagini vengono estratte anche dai video disponibili online su tutte le piattaforme.

Pertanto, l'azienda ha raccolto oltre 20 miliardi di immagini in tutto il mondo.

Grazie a questa raccolta, l'azienda commercializza l'accesso al proprio database di immagini sotto forma di un motore di ricerca in cui è possibile cercare una persona utilizzando una fotografia. L'azienda offre questo servizio alle forze dell'ordine al fine di identificare autori o vittime di reati.

La tecnologia di riconoscimento facciale viene utilizzata per interrogare il motore di ricerca e trovare una persona in base alla sua fotografia. Per fare ciò, l'azienda costruisce un “modello biometrico”, ovvero una rappresentazione digitale delle caratteristiche fisiche di una persona (il volto in questo caso). Questi dati biometrici sono particolarmente sensibili, soprattutto perché legati alla nostra identità fisica (ciò che siamo) e ci permettono di identificarci in un modo unico.

La stragrande maggioranza delle persone le cui immagini vengono raccolte nel motore di ricerca non sono a conoscenza di questa funzione.

Clearview AI ha attirato in vari modi le ire di aziende, organizzazioni per la privacy e autorità di regolamentazione negli ultimi anni, tra cui:

- Reclami e azioni collettive depositata in Illinois, Vermont, New York e California.

- Una sfida legale dal American Civil Liberties Union (ACLU).

- Ordini di cessate e desistere da Facebook, Google e YouTube, che lo ritenevano Clearview attività di raschiatura violato i loro termini e condizioni.

- Azione repressiva e sanzioni in Australia e Regno Unito.

- Una sentenza che ne dichiara illegittima l'operazione nel 2021, dal suddetto francese regolatore.

Nessun interesse legittimo

Nel dicembre 2021, la CNIL ha dichiarato: abbastanza senza mezzi termini, quella:

[T]sua azienda non ottiene il consenso delle persone interessate a raccogliere e utilizzare le loro fotografie per fornire il proprio software.

Clearview AI non ha nemmeno un legittimo interesse a raccogliere e utilizzare questi dati, in particolare data la natura invadente e massiccia del processo, che consente di recuperare le immagini presenti su Internet di diverse decine di milioni di utenti Internet in Francia. Queste persone, le cui fotografie o video sono accessibili su vari siti Web, inclusi i social media, non si aspettano ragionevolmente che le loro immagini vengano elaborate dalla società per fornire un sistema di riconoscimento facciale che potrebbe essere utilizzato dagli Stati per scopi di contrasto.

La gravità di questa violazione ha portato il presidente della CNIL a ordinare a Clearview AI di cessare, per mancanza di una base giuridica, la raccolta e l'uso di dati da persone sul territorio francese, nel contesto del funzionamento del software di riconoscimento facciale che commercializza.

Inoltre, la CNIL ha espresso l'opinione che Clearview AI non sembra preoccuparsi molto del rispetto delle norme europee sulla raccolta e il trattamento dei dati personali:

Le denunce ricevute dalla CNIL hanno rivelato le difficoltà incontrate dai denuncianti nell'esercizio dei propri diritti con Clearview AI.

Da un lato, la società non facilita l'esercizio del diritto di accesso dell'interessato:

- limitando l'esercizio di tale diritto ai dati raccolti nei dodici mesi precedenti la richiesta;

- limitando l'esercizio di tale diritto a due volte l'anno, senza giustificazione;

- rispondendo solo a determinate richieste dopo un numero eccessivo di richieste della stessa persona.

La società, invece, non risponde efficacemente alle richieste di accesso e cancellazione. Fornisce risposte parziali o non risponde affatto alle richieste.

La CNIL ha persino pubblicato un'infografica che riassume la sua decisione e il suo processo decisionale:

I Commissari informativi australiani e britannici sono giunti a conclusioni simili, con risultati simili per Clearview AI: lo scraping dei dati è illegale nelle nostre giurisdizioni; devi smettere di farlo qui.

Tuttavia, come abbiamo detto nel maggio 2022, quando il Regno Unito ha riferito che avrebbe multato Clearview AI circa £ 7,500,000 (in basso dal £ 17 milioni di multa prima proposta) e ordinando alla società di non raccogliere più dati sui cittadini britannici, "come questo sarà sorvegliato, per non parlare dell'applicazione, non è chiaro".

Potremmo essere in procinto di scoprire come verrà controllata l'azienda in futuro, con la CNIL perdere la pazienza con Clearview AI per non aver rispettato la sua sentenza di interrompere la raccolta dei dati biometrici dei francesi...

…e annunciando una multa di € 20,000,000:

A seguito di un avviso formale rimasto senza indirizzo, la CNIL ha imposto una sanzione di 20 milioni di euro e ordinato a CLEARVIEW AI di interrompere la raccolta e l'utilizzo di dati su persone fisiche in Francia senza una base giuridica e di cancellare i dati già raccolti.

Cosa accadrà?

Come abbiamo scritto in precedenza, Clearview AI sembra non solo essere felice di ignorare le decisioni normative emesse contro di essa, ma anche aspettarsi che le persone si sentano dispiaciute per questo allo stesso tempo, e in effetti sia dalla sua parte per fornire ciò che pensa è un servizio vitale per la società.

Nella sentenza del Regno Unito, in cui l'autorità di regolamentazione ha adottato una linea simile alla CNIL in Francia, alla società è stato detto che il suo comportamento era illegale, indesiderato e doveva cessare immediatamente.

Ma i rapporti dell'epoca suggerivano che, lungi dal mostrare umiltà, il CEO di Clearview Hoan Ton-That ha reagito con un sentimento di apertura non sarebbe fuori luogo in una tragica canzone d'amore:

Mi spezza il cuore il fatto che Clearview AI non sia stata in grado di fornire assistenza quando ha ricevuto richieste urgenti dalle forze dell'ordine del Regno Unito che cercano di utilizzare questa tecnologia per indagare su casi di grave abuso sessuale di bambini nel Regno Unito.

Come abbiamo suggerito nel maggio 2022, la società potrebbe trovare numerosi avversari che rispondono con i testi delle loro canzoni:

Cry me A river. (Non comportarti come se non lo sapessi.)

Cosa ne pensi?

Clearview AI fornisce davvero un servizio vantaggioso e socialmente accettabile alle forze dell'ordine?

O sta calpestando casualmente la nostra privacy e la nostra presunzione di innocenza raccogliendo dati biometrici illegalmente e commercializzandoli a fini di tracciamento investigativo senza consenso (e, apparentemente, senza limiti)?

Facci sapere nei commenti qui sotto... potresti rimanere anonimo.

- blockchain

- Vista chiara

- chiara visione AI

- geniale

- portafogli di criptovaluta

- cryptoexchange

- sicurezza informatica

- i criminali informatici

- Cybersecurity

- raccolta dati

- Dipartimento di Sicurezza Nazionale

- portafogli digitali

- riconoscimento facciale

- firewall

- Kaspersky

- Legge e ordine

- il malware

- Mcafee

- Sicurezza nuda

- NextBLOC

- Platone

- platone ai

- Platone Data Intelligence

- Gioco di Platone

- PlatoneDati

- gioco di plato

- Privacy

- VPN

- sicurezza del sito Web

- zefiro

![S3 Ep118: Indovina la tua password? Non serve se è già stato rubato! [Audio + testo] S3 Ep118: Indovina la tua password? Non serve se è già stato rubato! [Audio + testo]](https://platoblockchain.com/wp-content/uploads/2023/01/s3-ep118-guess-your-password-no-need-if-its-stolen-already-audio-text-360x188.png)