Per condividere la magia di DALL E 2 con un pubblico vasto, dovevamo ridurre i rischi associati a potenti modelli di generazione di immagini. A tal fine, mettiamo vari guardrail in atto per evitare che le immagini generate violino i nostri politica dei contenuti. Questo post si concentra su mitigazioni pre-allenamento, un sottoinsieme di questi guardrail che modificano direttamente i dati da cui DALL·E 2 apprende. In particolare, DALL·E 2 viene addestrato su centinaia di milioni di immagini con didascalie da Internet e rimuoviamo e riponderiamo alcune di queste immagini per modificare ciò che apprende il modello.

Questo post è organizzato in tre sezioni, ciascuna delle quali descrive una diversa mitigazione pre-formazione:

- Nella prima sezione, descriviamo come abbiamo filtrato le immagini violente e sessuali dal set di dati di addestramento di DALL·E 2. Senza questa mitigazione, il modello imparerebbe a produrre immagini grafiche o esplicite quando richiesto e potrebbe persino restituire tali immagini involontariamente in risposta a suggerimenti apparentemente innocui.

- Nella seconda sezione, scopriamo che il filtraggio dei dati di addestramento può amplificare i pregiudizi e descriviamo la nostra tecnica per mitigare questo effetto. Ad esempio, senza questa mitigazione, abbiamo notato che i modelli addestrati su dati filtrati a volte generavano più immagini raffiguranti uomini e meno immagini raffiguranti donne rispetto ai modelli addestrati sul set di dati originale.

- Nella sezione finale, ci occupiamo della questione della memorizzazione, scoprendo che modelli come DALL·E 2 a volte possono riprodurre immagini su cui sono stati addestrati anziché creare nuove immagini. In pratica, abbiamo scoperto che questo rigurgito di immagini è causato da immagini replicate più volte nel set di dati e mitiga il problema rimuovendo immagini visivamente simili ad altre immagini nel set di dati.

Ridurre i dati di training grafici ed espliciti

Poiché i dati di training modellano le capacità di qualsiasi modello appreso, il filtraggio dei dati è un potente strumento per limitare le capacità indesiderate del modello. Abbiamo applicato questo approccio a due categorie (immagini raffiguranti violenza esplicita e contenuti sessuali) utilizzando classificatori per filtrare le immagini di queste categorie dal set di dati prima dell'addestramento di DALL·E 2. Abbiamo addestrato questi classificatori di immagini internamente e stiamo continuando a studiare le effetti del filtraggio del set di dati sul nostro modello addestrato.

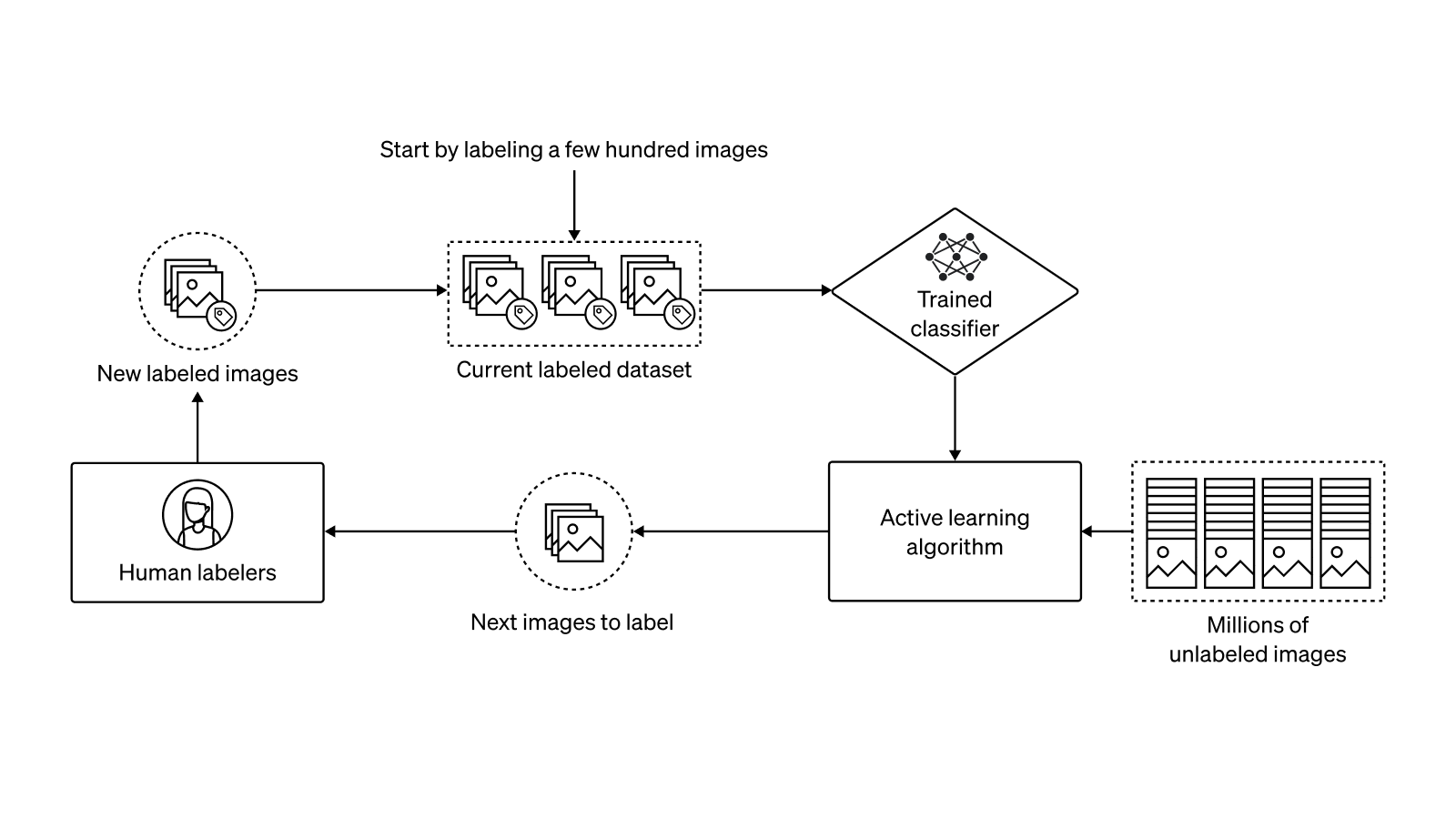

Per addestrare i nostri classificatori di immagini, abbiamo riutilizzato un approccio precedentemente utilizzato per filtrare i dati di addestramento SCIVOLARE. I passaggi fondamentali per questo approccio sono i seguenti: in primo luogo, creiamo una specifica per le categorie di immagini che vorremmo etichettare; in secondo luogo, raccogliamo alcune centinaia di esempi positivi e negativi per ciascuna categoria; in terzo luogo, utilizziamo una procedura di apprendimento attivo per raccogliere più dati e migliorare il compromesso precisione/richiamo; infine, eseguiamo il classificatore risultante sull'intero set di dati con una soglia di classificazione conservativa per favorire il richiamo rispetto alla precisione. Per impostare queste soglie, abbiamo dato la priorità al filtraggio di tutti i male dati in uscita in tutti i buono dati. Questo perché possiamo sempre perfezionare il nostro modello con più dati in un secondo momento per insegnargli nuove cose, ma è molto più difficile fare in modo che il modello dimentichi qualcosa che ha già imparato.

Durante la fase di apprendimento attivo, abbiamo migliorato in modo iterativo i nostri classificatori raccogliendo etichette umane per immagini potenzialmente difficili o classificate erroneamente. In particolare, abbiamo utilizzato due tecniche di apprendimento attivo per scegliere le immagini dal nostro set di dati (che contiene centinaia di milioni di immagini senza etichetta) da presentare agli esseri umani per l’etichettatura. Innanzitutto, per ridurre il tasso di falsi positivi del nostro classificatore (cioè la frequenza con cui classifica erroneamente un'immagine benigna come violenta o sessuale), abbiamo assegnato etichette umane alle immagini che il modello attuale classificava come positive. Affinché questo passaggio funzioni bene, abbiamo ottimizzato la nostra soglia di classificazione per un ricordo quasi del 100% ma un tasso elevato di falsi positivi; in questo modo, i nostri etichettatori etichettavano per lo più casi veramente negativi. Anche se questa tecnica aiuta a ridurre i falsi positivi e riduce la necessità per gli etichettatori di guardare immagini potenzialmente dannose, non aiuta a trovare più casi positivi che attualmente mancano nel modello.

Per ridurre il tasso di falsi negativi del nostro classificatore, abbiamo utilizzato una seconda tecnica di apprendimento attivo: la ricerca del vicino più vicino. In particolare, abbiamo eseguito numerose validazioni incrociate per trovare campioni positivi nel nostro attuale set di dati etichettati che il modello tendeva a classificare erroneamente come negativi (per fare ciò, abbiamo letteralmente addestrato centinaia di versioni del classificatore con diverse suddivisioni della convalida del treno). Abbiamo quindi scansionato la nostra vasta raccolta di immagini senza etichetta per i vicini più prossimi di questi campioni in uno spazio di caratteristiche percettive e abbiamo assegnato etichette umane alle immagini scoperte. Grazie alla nostra infrastruttura di elaborazione, è stato banale estendere sia l'addestramento del classificatore che la ricerca del vicino più vicino a molte GPU, consentendo alla fase di apprendimento attivo di svolgersi in un numero di minuti anziché in ore o giorni.

Per verificare l'efficacia dei nostri filtri dati, abbiamo addestrato due modelli GLIDE con gli stessi iperparametri: uno sui dati non filtrati e uno sul set di dati dopo il filtraggio. Ci riferiamo al modello precedente come modello non filtrato, e quest'ultimo come il modello filtrato. Come previsto, abbiamo scoperto che il modello non filtrato generalmente produceva contenuti meno espliciti o grafici in risposta alle richieste di questo tipo di contenuti. Tuttavia, abbiamo anche riscontrato un effetto collaterale inaspettato del filtraggio dei dati: ha creato o amplificato i pregiudizi del modello verso determinati dati demografici.

Correggere i bias introdotti dai filtri dati

I modelli generativi tentano di far corrispondere la distribuzione dei dati di addestramento, inclusi eventuali pregiudizi in essi contenuti. Di conseguenza, il filtraggio dei dati di addestramento può potenzialmente creare o amplificare distorsioni nei modelli a valle. In generale, correggere i bias nel set di dati originale è un compito sociotecnico difficile che continuiamo a studiare e va oltre lo scopo di questo post. Il problema che affrontiamo qui è l’amplificazione dei pregiudizi causati specificamente dal filtraggio dei dati stesso. Con il nostro approccio miriamo a evitare che il modello filtrato venga creato Scopri di più distorto rispetto al modello non filtrato, riducendo sostanzialmente lo spostamento della distribuzione causato dal filtraggio dei dati.

Come esempio concreto di amplificazione dei bias dovuta al filtraggio, si consideri il prompt “a ceo”. Quando il nostro modello non filtrato generava immagini per questo prompt, tendeva a produrre più immagini di uomini che di donne e ci aspettiamo che la maggior parte di questo pregiudizio rifletta i nostri attuali dati di addestramento. Tuttavia, quando abbiamo eseguito lo stesso prompt attraverso il nostro modello filtrato, la distorsione sembrava essere amplificata; le generazioni erano quasi esclusivamente immagini di uomini.

Ipotizziamo che questo particolare caso di amplificazione dei pregiudizi provenga da due motivi: in primo luogo, anche se donne e uomini hanno una rappresentanza più o meno uguale nel set di dati originale, il set di dati potrebbe essere distorto nel presentare le donne in contesti più sessualizzati; e in secondo luogo, i nostri stessi classificatori potrebbero essere distorti a causa dell'implementazione o della definizione della classe, nonostante i nostri sforzi per garantire che ciò non fosse il caso durante le fasi di raccolta e convalida dei dati. A causa di entrambi questi effetti, il nostro filtro potrebbe rimuovere più immagini di donne che di uomini, il che modifica il rapporto di genere osservato dal modello durante l'allenamento.

Per studiare in modo più approfondito la distorsione indotta dai filtri, volevamo un modo per misurare in che misura i nostri filtri di dati influenzavano la distorsione verso vari concetti. In particolare, i nostri filtri per contenuti violenti e sessuali sono puramente basati su immagini, ma la natura multimodale del nostro set di dati ci consente di misurare direttamente gli effetti di questi filtri sul testo. Poiché ogni immagine è accompagnata da una didascalia di testo, siamo stati in grado di osservare la frequenza relativa delle parole chiave selezionate manualmente nel set di dati filtrati e non filtrati per stimare quanto i filtri influenzassero un dato concetto.

Per mettere in pratica tutto ciò, abbiamo utilizzato Apache Spark per calcolare le frequenze di una manciata di parole chiave (ad esempio, "genitore", "donna", "bambino") su tutte le didascalie nei nostri set di dati filtrati e non filtrati. Anche se il nostro set di dati contiene centinaia di milioni di coppie testo-immagine, il calcolo di queste frequenze di parole chiave ha richiesto solo pochi minuti utilizzando il nostro cluster di calcolo.

Dopo aver calcolato le frequenze delle parole chiave, siamo stati in grado di confermare che i nostri filtri del set di dati avevano effettivamente distorto le frequenze di alcune parole chiave più di altre. Ad esempio, i filtri hanno ridotto la frequenza della parola “donna” del 14%, mentre la frequenza della parola “uomo” è stata ridotta solo del 6%. Ciò ha confermato, su larga scala, ciò che avevamo già osservato aneddoticamente campionando i modelli GLIDE addestrati su entrambi i set di dati.

Ora che avevamo un proxy per misurare la distorsione indotta dal filtro, avevamo bisogno di un modo per mitigarla. Per affrontare questo problema, abbiamo mirato a riponderare il set di dati filtrati in modo che la sua distribuzione corrispondesse meglio alla distribuzione delle immagini non filtrate. Come esempio giocattolo per illustrare questa idea, supponiamo che il nostro set di dati sia composto per il 50% da foto di gatti e per il 50% da foto di cani, ma che i nostri filtri di dati rimuovano il 75% dei cani ma solo il 50% dei gatti. Il set di dati finale sarebbe composto da ⅔ gatti e ⅓ cani, e un modello generativo basato sulla verosimiglianza addestrato su questo set di dati genererebbe probabilmente più immagini di gatti che di cani. Possiamo correggere questo squilibrio moltiplicando per 2 la perdita di allenamento di ogni immagine di un cane, emulando l'effetto di ripetere due volte l'immagine di ogni cane. Si scopre che possiamo adattare questo approccio ai nostri set di dati e modelli reali in un modo in gran parte automatico, ovvero senza dover selezionare manualmente le funzionalità che vogliamo riponderare.

Calcoliamo i pesi per le immagini nel set di dati filtrati utilizzando le probabilità di un classificatore speciale, simile all'approccio utilizzato da Choi et al. (2019). Per addestrare questo classificatore, campioniamo uniformemente le immagini da entrambi i set di dati e prevediamo da quale set di dati proviene l'immagine. In particolare, questo modello prevede P(non filtrato|immagine), dato un precedente P(non filtrato) = 0.5. In pratica, non vogliamo che questo modello sia troppo potente, altrimenti potrebbe apprendere in primo luogo l'esatta funzione implementata dai nostri filtri. Vogliamo invece che il modello sia più fluido rispetto ai nostri filtri di dati originali, catturando ampie categorie interessate dai filtri pur non essendo sicuri se una particolare immagine verrà filtrata o meno. A tal fine, abbiamo addestrato una sonda lineare sopra una piccola CLIP modello.

Una volta che abbiamo un classificatore che prevede la probabilità che un'immagine provenga dal set di dati non filtrato, dobbiamo ancora convertire questa previsione in un peso per l'immagine. Ad esempio, supponiamo che P(non filtrato|immagine) = 0.8. Ciò significa che il campione ha 4 volte più probabilità di essere trovato nei dati non filtrati rispetto ai dati filtrati e un peso pari a 4 dovrebbe correggere lo squilibrio. Più in generale, possiamo utilizzare il peso P(non filtrato|immagine)/P(filtrato|immagine).,

In che misura questo schema di riponderazione riesce effettivamente a mitigare la distorsione amplificata? Quando abbiamo perfezionato il nostro precedente modello filtrato con il nuovo schema di ponderazione, il comportamento del modello perfezionato corrispondeva molto più da vicino al modello non filtrato sugli esempi distorti che avevamo trovato in precedenza. Sebbene ciò fosse incoraggiante, volevamo anche valutare questa mitigazione in modo più approfondito utilizzando la nostra euristica della distorsione basata su parole chiave. Per misurare le frequenze delle parole chiave tenendo conto del nostro nuovo schema di ponderazione, possiamo semplicemente ponderare ogni istanza di una parola chiave nel set di dati filtrato in base al peso del campione che la contiene. In questo modo, otteniamo un nuovo set di frequenze di parole chiave che riflettono i pesi del campione nel set di dati filtrato.

Nella maggior parte delle parole chiave da noi controllate, lo schema di riponderazione ha ridotto la variazione di frequenza indotta dal filtraggio. Per i nostri precedenti esempi di “uomo” e “donna”, le riduzioni relative della frequenza sono diventate dell’1% e del –1%, mentre i loro valori precedenti erano rispettivamente del 14% e del 6%. Sebbene questa metrica sia solo un indicatore dell'effettivo bias di filtraggio, è rassicurante che il nostro schema di riponderazione basato su immagini migliori effettivamente una metrica basata su testo in modo così significativo.

Stiamo continuando a indagare sui pregiudizi rimanenti in DALL·E 2, in parte attraverso valutazioni più ampie del comportamento del modello e indagini su come il filtraggio abbia influenzato i pregiudizi e lo sviluppo delle capacità.

Prevenire il rigurgito delle immagini

Abbiamo osservato che i nostri predecessori interni a DALL·E 2 a volte riproducono alla lettera le immagini di training. Questo comportamento era indesiderabile, poiché vorremmo che DALL·E 2 creasse immagini originali e uniche per impostazione predefinita e non semplicemente “cucisse insieme” pezzi di immagini esistenti. Inoltre, la riproduzione letterale delle immagini di addestramento può sollevare questioni legali relative alla violazione del copyright, alla proprietà e alla privacy (se le foto delle persone erano presenti nei dati di addestramento).

Per comprendere meglio il problema del rigurgito delle immagini, abbiamo raccolto un set di dati di suggerimenti che spesso risultavano in immagini duplicate. A tale scopo, abbiamo utilizzato un modello addestrato per campionare immagini per 50,000 prompt dal nostro set di dati di addestramento e abbiamo ordinato i campioni in base alla somiglianza percettiva con l'immagine di addestramento corrispondente. Infine, abbiamo ispezionato manualmente le migliori corrispondenze, trovando solo poche centinaia di coppie vere duplicate su un totale di 50 richieste. Anche se il tasso di rigurgito sembrava essere inferiore all'1%, abbiamo ritenuto necessario abbassare il tasso a 0 per le ragioni sopra indicate.

Quando abbiamo studiato il nostro set di dati di immagini rigurgitate, abbiamo notato due modelli. Innanzitutto, le immagini erano quasi tutte semplici grafiche vettoriali, probabilmente facili da memorizzare a causa del loro basso contenuto informativo. In secondo luogo, e cosa ancora più importante, tutte le immagini avevano molti quasi duplicati nel set di dati di addestramento. Ad esempio, potrebbe esserci un'immagine vettoriale che assomiglia a un orologio che mostra l'ora 1, ma poi scopriremmo un campione di addestramento contenente lo stesso orologio che mostra le 2, poi le 3, ecc. ce ne siamo resi conto, abbiamo utilizzato una ricerca distribuita del vicino più vicino per verificare che, in effetti, tutte le immagini rigurgitate avessero duplicati percettivamente simili nel set di dati. Altro lavori hanno osservato un fenomeno simile in modelli linguistici di grandi dimensioni, scoprendo che la duplicazione dei dati è fortemente legata alla memorizzazione.

La scoperta di cui sopra suggerisce che, se deduplicassimo il nostro set di dati, potremmo risolvere il problema del rigurgito. Per raggiungere questo obiettivo, abbiamo pianificato di utilizzare una rete neurale per identificare gruppi di immagini che sembravano simili e quindi rimuovere tutte le immagini tranne una da ciascun gruppo., Tuttavia, ciò richiederebbe il controllo, per ciascuna immagine, se si tratta di un duplicato di ogni altra immagine nel set di dati. Poiché il nostro intero set di dati contiene centinaia di milioni di immagini, dovremmo ingenuamente controllare centinaia di quadrilioni di coppie di immagini per trovare tutti i duplicati. Sebbene ciò sia tecnicamente a portata di mano, soprattutto su un cluster di elaborazione di grandi dimensioni, abbiamo trovato un'alternativa molto più efficiente che funziona quasi altrettanto bene a una piccola frazione del costo.

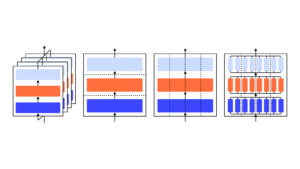

Considera cosa succede se raggruppiamo il nostro set di dati prima di eseguire la deduplicazione. Poiché i campioni vicini spesso rientrano nello stesso cluster, la maggior parte delle coppie duplicate non oltrepasserebbe i confini decisionali del cluster. Potremmo quindi deduplicare i campioni all'interno di ciascun cluster senza verificare la presenza di duplicati all'esterno del cluster, perdendo solo una piccola frazione di tutte le coppie duplicate. Questo è molto più veloce dell’approccio ingenuo, poiché non dobbiamo più controllare ogni singola coppia di immagini., Quando abbiamo testato empiricamente questo approccio su un piccolo sottoinsieme dei nostri dati, è stato rilevato l'85% di tutte le coppie duplicate quando si utilizzava K = 1024 cluster.

Per migliorare il tasso di successo dell'algoritmo di cui sopra, abbiamo sfruttato un'osservazione chiave: quando si raggruppano diversi sottoinsiemi casuali di un set di dati, i limiti decisionali del cluster risultanti sono spesso piuttosto diversi. Pertanto, se una coppia duplicata attraversa il limite di un cluster per un clustering dei dati, la stessa coppia potrebbe rientrare in un singolo cluster in un clustering diverso. Più clustering provi, maggiore è la probabilità di scoprire una determinata coppia duplicata. In pratica abbiamo optato per l'utilizzo di cinque clustering, ovvero cerchiamo i duplicati di ciascuna immagine nell'unione di cinque cluster diversi. In pratica, questo ha trovato il 97% di tutte le coppie duplicate su un sottoinsieme dei nostri dati.

Sorprendentemente, quasi un quarto del nostro set di dati è stato rimosso dalla deduplicazione. Quando abbiamo esaminato le coppie quasi duplicate trovate, molte di esse includevano cambiamenti significativi. Ricordiamo l'esempio dell'orologio visto sopra: il set di dati potrebbe includere molte immagini dello stesso orologio in momenti diversi della giornata. Anche se è probabile che queste immagini inducano il modello a memorizzare l'aspetto di questo particolare orologio, potrebbero anche aiutare il modello a imparare a distinguere le ore del giorno su un orologio. Considerata la quantità di dati rimossi, temevamo che la rimozione di immagini come questa avrebbe potuto compromettere le prestazioni del modello.

Per testare l'effetto della deduplicazione sui nostri modelli, abbiamo addestrato due modelli con iperparametri identici: uno sul set di dati completo e uno sulla versione deduplicata del set di dati. Per confrontare i modelli, abbiamo utilizzato le stesse valutazioni umane che abbiamo utilizzato per valutare il nostro modello GLIDE originale. Sorprendentemente, abbiamo scoperto che i valutatori umani leggermente preferito il modello si è addestrato su dati deduplicati, suggerendo che la grande quantità di immagini ridondanti nel set di dati stava effettivamente danneggiando le prestazioni.

Una volta addestrato un modello sui dati deduplicati, abbiamo eseguito nuovamente la ricerca del rigurgito che avevamo eseguito in precedenza su oltre 50 prompt dal set di dati di addestramento. Abbiamo scoperto che il nuovo modello non rigurgitava mai un'immagine di addestramento quando riceveva la richiesta esatta dell'immagine dal set di dati di addestramento. Per fare un ulteriore passo avanti con questo test, abbiamo anche eseguito una ricerca del vicino più vicino sull'intero set di dati di addestramento per ciascuna delle 50 immagini generate. In questo modo, abbiamo pensato che avremmo potuto sorprendere il modello a rigurgitare un'immagine diversa da quella associata a un determinato prompt. Anche con questo controllo più approfondito non abbiamo mai riscontrato un caso di rigurgito dell'immagine.

Passi successivi

Sebbene tutte le mitigazioni discusse sopra rappresentino un progresso significativo verso il nostro obiettivo di ridurre i rischi associati a DALL·E 2, ciascuna mitigazione ha ancora spazio per migliorare:

- Filtri di pre-addestramento migliori potrebbero consentirci di addestrare DALL·E 2 su più dati e potenzialmente ridurre ulteriormente le distorsioni nel modello. I nostri attuali filtri sono ottimizzati per un basso tasso di errori, al costo di molti falsi positivi. Di conseguenza, abbiamo filtrato circa il 5% del nostro intero set di dati, anche se la maggior parte di queste immagini filtrate non viola affatto la nostra politica sui contenuti. Migliorare i nostri filtri potrebbe consentirci di recuperare alcuni di questi dati di addestramento.

- I pregiudizi vengono introdotti e potenzialmente amplificati in molte fasi dello sviluppo e dell’implementazione del sistema. Valutare e mitigare il bias in sistemi come DALL·E 2 e il danno indotto da questo bias è un importante problema interdisciplinare che continuiamo a studiare a OpenAI come parte della nostra missione più ampia. Il nostro lavoro a questo riguardo include la creazione di valutazioni per comprendere meglio il problema, la cura di nuovi set di dati e l’applicazione di tecniche come il feedback umano e la messa a punto per costruire tecnologie più robuste e rappresentative.

- È anche fondamentale continuare a studiare la memorizzazione e la generalizzazione nei sistemi di deep learning. Sebbene la deduplicazione sia un buon primo passo verso la prevenzione della memorizzazione, non ci dice tutto quello che c'è da sapere sul perché o sul come modelli come DALL·E 2 memorizzano i dati di addestramento.

- 000

- 2019

- a

- Chi siamo

- Il mio account

- Raggiungere

- operanti in

- attivo

- indirizzo

- che interessano

- algoritmo

- Tutti

- Consentire

- consente

- già

- alternativa

- sempre

- quantità

- Un altro

- apparso

- applicato

- AMMISSIONE

- approccio

- in giro

- addetto

- associato

- pubblico

- perché

- prima

- essendo

- Meglio

- fra

- Al di là di

- costruire

- Costruzione

- funzionalità

- didascalie

- Custodie

- casi

- lotta

- Categoria

- ha causato

- certo

- il cambiamento

- verifica

- Scegli

- classe

- classificazione

- classificato

- Orologio

- collezione

- rispetto

- Calcolare

- informatica

- concetto

- Prendere in considerazione

- contiene

- contenuto

- contesti

- continua

- copyright

- violazione del copyright

- Corrispondente

- potuto

- creare

- creato

- Creazione

- cruciale

- Corrente

- Attualmente

- dati

- giorno

- Giorni

- decisione

- deep

- Dati Demografici

- deployment

- descrivere

- Nonostante

- Mercato

- diverso

- difficile

- direttamente

- scopri

- scoperto

- distanza

- distribuito

- distribuzione

- giù

- duplicati

- durante

- ogni

- effetto

- in maniera efficace

- efficacia

- effetti

- efficiente

- sforzi

- incoraggiando

- particolarmente

- essenzialmente

- stima

- eccetera

- valutare

- qualunque cosa

- esempio

- Esempi

- esclusivamente

- esistente

- attenderti

- previsto

- più veloce

- caratteristica

- Caratteristiche

- feedback

- figura

- filtraggio

- filtri

- Infine

- ricerca

- Nome

- Fissare

- si concentra

- segue

- essere trovato

- da

- pieno

- function

- ulteriormente

- raccolta

- Sesso

- Generale

- generalmente

- generare

- generato

- ELETTRICA

- generazioni

- generativo

- scopo

- buono

- GPU

- grafiche

- Gruppo

- Gruppo

- garantito

- manciata

- Aiuto

- aiuta

- qui

- Alta

- Come

- Tuttavia

- HTTPS

- umano

- Gli esseri umani

- centinaia

- idea

- identificare

- Immagine

- immagini

- implementazione

- implementato

- importante

- competenze

- migliorata

- miglioramento

- includere

- incluso

- inclusi

- Compreso

- informazioni

- Infrastruttura

- esempio

- Internet

- indagare

- problema

- IT

- stessa

- Le

- Discografica

- etichettatura

- per il tuo brand

- Lingua

- grandi

- superiore, se assunto singolarmente.

- IMPARARE

- imparato

- apprendimento

- Legale

- probabile

- Guarda

- guardò

- make

- marchio

- partita

- significativo

- si intende

- misurare

- di misura

- Uomo

- forza

- Militare

- milioni

- Missione

- modello

- modelli

- Scopri di più

- maggior parte

- moltiplicando

- Natura

- necessaria

- negativo.

- Rete

- numero

- minimo

- Organizzato

- i

- Altro

- proprietà

- parte

- particolare

- performance

- esecuzione

- fase

- pezzi

- previsto

- politica

- positivo

- possibile

- potenziale

- potente

- pratica

- predire

- predizione

- presenti

- prevenzione

- precedente

- Privacy

- sonda

- Problema

- processi

- produrre

- Prodotto

- protesta

- delega

- Trimestre

- aumentare

- raggiungere

- realizzato

- motivi

- ridurre

- Ridotto

- riducendo

- riflettere

- riflessione

- rimanente

- rimozione

- rappresentare

- rappresentazione

- rappresentante

- richieste

- richiedere

- richiede

- risposta

- risultante

- ritorno

- rischi

- Correre

- stesso

- Scala

- schema

- Cerca

- set

- forme

- Condividi

- spostamento

- significativa

- simile

- Un'espansione

- da

- singolo

- Taglia

- piccole

- So

- RISOLVERE

- alcuni

- qualcosa

- lo spazio

- la nostra speciale

- in particolare

- specificazione

- Si divide

- tappe

- inizia a

- ha dichiarato

- Ancora

- Studio

- il successo

- sistema

- SISTEMI DI TRATTAMENTO

- presa

- tecniche

- Tecnologie

- test

- I

- perciò

- cose

- a fondo

- tre

- soglia

- Attraverso

- tempo

- volte

- top

- verso

- Treni

- Training

- capire

- unione

- unico

- us

- uso

- convalida

- vario

- verificare

- versione

- ricercato

- Che

- se

- while

- entro

- senza

- Donna

- Lavora

- lavori

- preoccupato

- sarebbe

- X