L’aumento delle attività sociali online come i social network o i giochi online è spesso caratterizzato da comportamenti ostili o aggressivi che possono portare a manifestazioni non richieste di incitamento all’odio, cyberbullismo o molestie. Ad esempio, molte comunità di gioco online offrono funzionalità di chat vocale per facilitare la comunicazione tra i propri utenti. Sebbene la chat vocale spesso supporti battute amichevoli e chiacchiere indecenti, può anche portare a problemi come incitamento all'odio, cyberbullismo, molestie e truffe. La segnalazione di linguaggio dannoso aiuta le organizzazioni a mantenere le conversazioni civili e a mantenere un ambiente online sicuro e inclusivo in cui gli utenti possano creare, condividere e partecipare liberamente. Oggi molte aziende si affidano esclusivamente a moderatori umani per esaminare i contenuti tossici. Tuttavia, ridimensionare i moderatori umani per soddisfare queste esigenze con una qualità e una velocità sufficienti è costoso. Di conseguenza, molte organizzazioni rischiano di dover affrontare elevati tassi di abbandono degli utenti, danni alla reputazione e sanzioni normative. Inoltre, i moderatori sono spesso colpiti psicologicamente dalla revisione del contenuto tossico.

Amazon Transcribe è un servizio di riconoscimento vocale automatico (ASR) che consente agli sviluppatori di aggiungere facilmente funzionalità di sintesi vocale alle loro applicazioni. Oggi siamo entusiasti di annunciarlo Rilevamento della tossicità di Amazon Transcribe, una funzionalità basata sull'apprendimento automatico (ML) che utilizza segnali audio e testuali per identificare e classificare contenuti tossici basati sulla voce in sette categorie, tra cui molestie sessuali, incitamento all'odio, minacce, abusi, volgarità, insulti e linguaggio grafico . Oltre al testo, il rilevamento della tossicità utilizza segnali vocali come toni e intonazione per individuare l'intento tossico nel parlato.

Si tratta di un miglioramento rispetto ai sistemi di moderazione dei contenuti standard progettati per concentrarsi solo su termini specifici, senza tenere conto delle intenzioni. La maggior parte delle aziende ha uno SLA di 7-15 giorni per rivedere i contenuti segnalati dagli utenti perché i moderatori devono ascoltare lunghi file audio per valutare se e quando la conversazione è diventata tossica. Con Amazon Transcribe Toxicity Detection, i moderatori esaminano solo la parte specifica del file audio contrassegnata per contenuti tossici (rispetto all'intero file audio). Il contenuto che i moderatori umani devono rivedere è ridotto del 95%, consentendo ai clienti di ridurre il loro SLA a poche ore, oltre a consentire loro di moderare in modo proattivo più contenuti oltre a quelli segnalati dagli utenti. Permetterà alle aziende di rilevare e moderare automaticamente i contenuti su larga scala, fornire un ambiente online sicuro e inclusivo e agire prima che ciò possa causare abbandono degli utenti o danni alla reputazione. I modelli utilizzati per il rilevamento dei contenuti tossici vengono gestiti da Amazon Transcribe e aggiornati periodicamente per mantenerne l'accuratezza e la pertinenza.

In questo post imparerai come:

- Identifica i contenuti dannosi nel parlato con il rilevamento della tossicità di Amazon Transcribe

- Utilizza la console Amazon Transcribe per il rilevamento della tossicità

- Crea un lavoro di trascrizione con rilevamento della tossicità utilizzando il file Interfaccia della riga di comando di AWS (AWS CLI) e SDK Python

- Utilizza la risposta API di rilevamento della tossicità di Amazon Transcribe

Rileva la tossicità nella chat audio con Amazon Transcribe Toxicity Detection

Amazon Transcribe ora fornisce una soluzione semplice basata su ML per segnalare linguaggio dannoso nelle conversazioni parlate. Questa funzionalità è particolarmente utile per i social media, i giochi e le esigenze generali, eliminando la necessità per i clienti di fornire i propri dati per addestrare il modello ML. Il rilevamento della tossicità classifica i contenuti audio tossici nelle seguenti sette categorie e fornisce un punteggio di confidenza (0–1) per ciascuna categoria:

- profanità – Discorso che contiene parole, frasi o acronimi scortesi, volgari o offensivi.

- Discorso dell'odio – Discorso che critica, insulta, denuncia o disumanizza una persona o un gruppo sulla base di un’identità (come razza, etnia, genere, religione, orientamento sessuale, abilità e origine nazionale).

- Sessuale – Discorso che indica interesse, attività o eccitazione sessuale utilizzando riferimenti diretti o indiretti a parti del corpo, tratti fisici o sesso.

- Insulti – Discorso che include un linguaggio umiliante, umiliante, beffardo, offensivo o sminuente. Questo tipo di linguaggio è anche etichettato come bullismo.

- Violenza o minaccia – Discorso che include minacce che cercano di infliggere dolore, lesioni o ostilità verso una persona o un gruppo.

- Grafico – Discorso che utilizza immagini visivamente descrittive e spiacevolmente vivide. Questo tipo di linguaggio è spesso intenzionalmente prolisso per amplificare il disagio del destinatario.

- Molestie o abusi – Discorso inteso a influenzare il benessere psicologico del destinatario, compresi termini umilianti e oggettivanti.

Puoi accedere al rilevamento di tossicità tramite la console Amazon Transcribe o chiamando direttamente le API utilizzando l'AWS CLI o gli SDK AWS. Sulla console Amazon Transcribe puoi caricare i file audio di cui desideri testare la tossicità e ottenere risultati in pochi clic. Amazon Transcribe identificherà e classificherà i contenuti tossici, come molestie, incitamento all'odio, contenuti di natura sessuale, violenza, insulti e linguaggio volgare. Amazon Transcribe fornisce inoltre un punteggio di affidabilità per ciascuna categoria, fornendo informazioni preziose sul livello di tossicità del contenuto. Il rilevamento della tossicità è attualmente disponibile nell'API standard di Amazon Transcribe per l'elaborazione batch e supporta la lingua inglese statunitense.

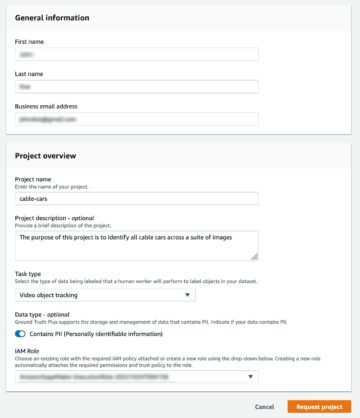

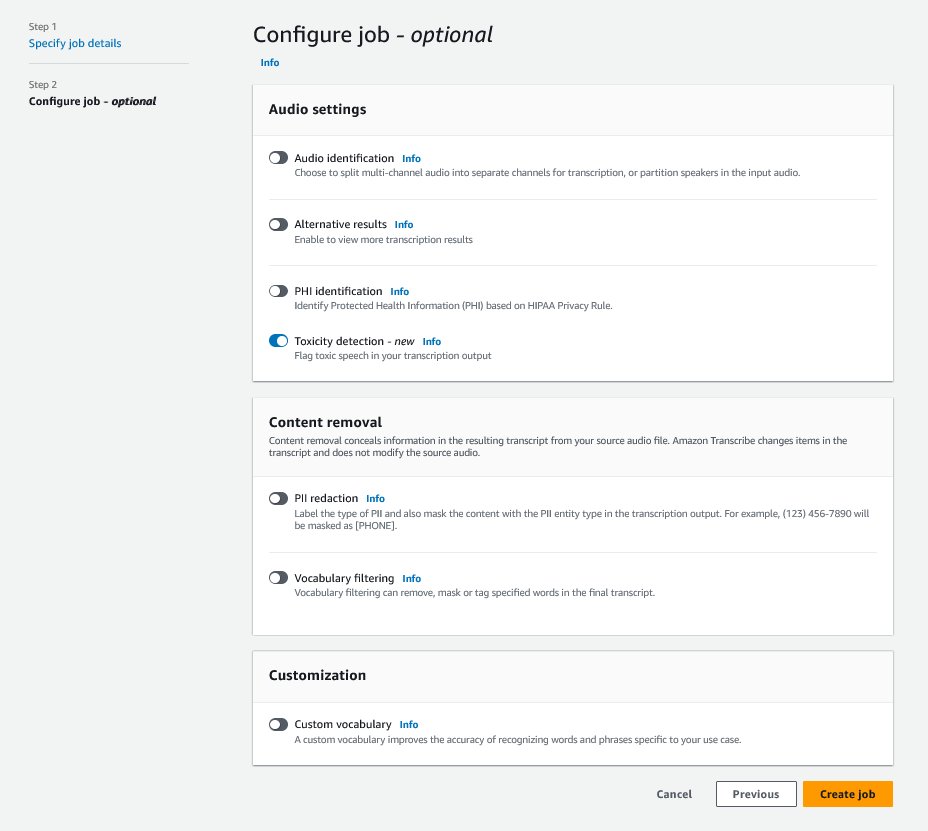

Procedura dettagliata sulla console Amazon Transcribe

Per iniziare, accedi a Console di gestione AWS e vai su Amazon Transcribe. Per creare un nuovo lavoro di trascrizione, devi caricare i file registrati in un file Servizio di archiviazione semplice Amazon (Amazon S3) prima che possano essere elaborati. Nella pagina delle impostazioni audio, come mostrato nello screenshot seguente, abilita Rilevamento della tossicità e procedere con la creazione del nuovo lavoro. Amazon Transcribe elaborerà il processo di trascrizione in background. Man mano che il lavoro avanza, puoi aspettarti che lo stato cambi in COMPLETATO quando il processo è terminato.

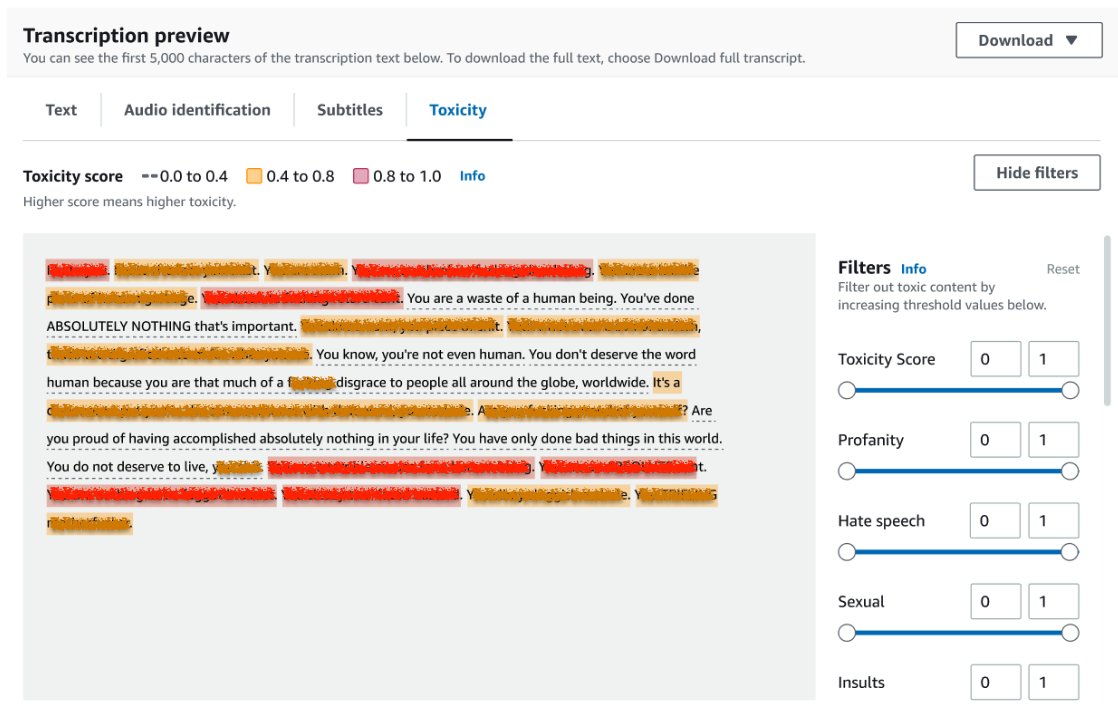

Per rivedere i risultati di un lavoro di trascrizione, scegli il lavoro dall'elenco dei lavori per aprirlo. Scorri verso il basso fino a Anteprima della trascrizione sezione per verificare i risultati su Tossicità scheda. L'interfaccia utente mostra segmenti di trascrizione codificati a colori per indicare il livello di tossicità, determinato dal punteggio di confidenza. Per personalizzare la visualizzazione, è possibile utilizzare le barre di attivazione/disattivazione nel Filtri Pannello. Queste barre consentono di regolare le soglie e filtrare di conseguenza le categorie di tossicità.

Lo screenshot seguente ha coperto parti del testo della trascrizione a causa della presenza di informazioni sensibili o tossiche.

API di trascrizione con una richiesta di rilevamento della tossicità

In questa sezione ti guidiamo attraverso la creazione di un lavoro di trascrizione con rilevamento della tossicità utilizzando le interfacce di programmazione. Se il file audio non è già in un bucket S3, caricalo per garantire l'accesso da parte di Amazon Transcribe. Analogamente alla creazione di un lavoro di trascrizione sulla console, quando si richiama il lavoro, è necessario fornire i seguenti parametri:

- TranscriptionJobName – Specificare un nome lavoro univoco.

- MediaFileUri – Inserisci la posizione URI del file audio su Amazon S3. Amazon Transcribe supporta i seguenti formati audio: MP3, MP4, WAV, FLAC, AMR, OGG o WebM

- Codice Lingua - Impostato

en-US. Al momento della stesura di questo documento, il rilevamento della tossicità supporta solo la lingua inglese americana. - Categorie di tossicità - Passa il

ALLvalore per includere tutte le categorie di rilevamento della tossicità supportate.

Di seguito sono riportati esempi di avvio di un lavoro di trascrizione con rilevamento della tossicità abilitato utilizzando Python3:

Puoi richiamare lo stesso processo di trascrizione con rilevamento della tossicità utilizzando il seguente comando AWS CLI:

API di trascrizione con risposta di rilevamento della tossicità

L'output JSON del rilevamento della tossicità di Amazon Transcribe includerà i risultati della trascrizione nel campo dei risultati. L'abilitazione del rilevamento della tossicità aggiunge un campo aggiuntivo chiamato toxicityDetection sotto il campo dei risultati. toxicityDetection include un elenco di elementi trascritti con i seguenti parametri:

- testo – Il testo grezzo trascritto

- tossicità – Un punteggio di confidenza del rilevamento (un valore compreso tra 0 e 1)

- categoria – Un punteggio di confidenza per ciascuna categoria di discorso tossico

- Ora di inizio – La posizione iniziale del rilevamento nel file audio (secondi)

- Tempo scaduto – La posizione finale del rilevamento nel file audio (secondi)

Di seguito è riportato un esempio di risposta abbreviata al rilevamento della tossicità che è possibile scaricare dalla console:

Sommario

In questo post, abbiamo fornito una panoramica della nuova funzionalità di rilevamento della tossicità di Amazon Transcribe. Abbiamo anche descritto come analizzare l'output JSON del rilevamento della tossicità. Per ulteriori informazioni, consulta la console Amazon Transcribe e prova l'API di trascrizione con rilevamento della tossicità.

Amazon Transcribe Toxicity Detection è ora disponibile nelle seguenti regioni AWS: Stati Uniti orientali (Ohio), Stati Uniti orientali (Virginia settentrionale), Stati Uniti occidentali (Oregon), Asia Pacifico (Sydney), Europa (Irlanda) ed Europa (Londra). Per saperne di più, visita Amazon Transcribe.

Scopri moderazione dei contenuti su AWS e il nostro casi d'uso ML di moderazione dei contenuti. Fai il primo passo verso semplificando le operazioni di moderazione dei contenuti con AWS.

Circa l'autore

Lana Zhang è Senior Solutions Architect presso il team AWS WWSO AI Services, specializzato in AI e ML per la moderazione dei contenuti, la visione artificiale e l'elaborazione del linguaggio naturale. Con la sua esperienza, si dedica alla promozione delle soluzioni AWS AI/ML e assiste i clienti nella trasformazione delle loro soluzioni aziendali in diversi settori, tra cui social media, giochi, e-commerce, pubblicità e marketing.

Lana Zhang è Senior Solutions Architect presso il team AWS WWSO AI Services, specializzato in AI e ML per la moderazione dei contenuti, la visione artificiale e l'elaborazione del linguaggio naturale. Con la sua esperienza, si dedica alla promozione delle soluzioni AWS AI/ML e assiste i clienti nella trasformazione delle loro soluzioni aziendali in diversi settori, tra cui social media, giochi, e-commerce, pubblicità e marketing.

Sumit Kumar è un Senior Product Manager, tecnico presso il team AWS AI Language Services. Ha 10 anni di esperienza nella gestione dei prodotti in una varietà di domini ed è appassionato di AI/ML. Al di fuori del lavoro, Sumit ama viaggiare e si diverte a giocare a cricket e tennis su prato.

Sumit Kumar è un Senior Product Manager, tecnico presso il team AWS AI Language Services. Ha 10 anni di esperienza nella gestione dei prodotti in una varietà di domini ed è appassionato di AI/ML. Al di fuori del lavoro, Sumit ama viaggiare e si diverte a giocare a cricket e tennis su prato.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/flag-harmful-language-in-spoken-conversations-with-amazon-transcribe-toxicity-detection/

- :ha

- :È

- :non

- 10

- 100

- 16

- 17

- 20

- 24

- 7

- 95%

- a

- capacità

- Chi siamo

- abuso

- accesso

- di conseguenza

- Contabilità

- precisione

- operanti in

- Action

- attività

- attività

- aggiungere

- aggiunta

- Aggiunge

- Pubblicità

- aggressivo

- AI

- Servizi di intelligenza artificiale

- AI / ML

- Tutti

- consentire

- già

- anche

- Sebbene il

- Amazon

- Amazon Transcribe

- Amazon Web Services

- tra

- an

- ed

- Annunciare

- api

- API

- applicazioni

- SONO

- AS

- Asia

- asia pacifico

- assistere

- At

- logoramento

- Audio

- Automatico

- automaticamente

- disponibile

- AWS

- sfondo

- bar

- base

- BE

- è diventato

- perché

- prima

- comportamento

- fra

- Al di là di

- stile di vita

- entrambi

- Rompere

- bullismo

- affari

- by

- detto

- chiamata

- Materiale

- capacità

- categoria

- Categoria

- Causare

- il cambiamento

- dai un'occhiata

- Scegli

- classificare

- Comunicazione

- Comunità

- Aziende

- completamento di una

- Completato

- computer

- Visione computerizzata

- fiducia

- consolle

- contiene

- contenuto

- Conversazione

- Conversazioni

- coperto

- creare

- Creazione

- cricket

- critica

- Attualmente

- Clienti

- personalizzare

- dati

- Giorni

- dedicato

- descritta

- progettato

- individuare

- rivelazione

- determinato

- sviluppatori

- dirette

- direttamente

- Dsiplay

- paesaggio differenziato

- domini

- giù

- scaricare

- dovuto

- e-commerce

- ogni

- est

- facile

- o

- eliminando

- enable

- abilitato

- consentendo

- fine

- Inglese

- garantire

- entrare

- aziende

- Intero

- Ambiente

- particolarmente

- etnia

- Europa

- valutare

- esempio

- Esempi

- eccitato

- attenderti

- costoso

- esperienza

- competenza

- extra

- facilitare

- di fronte

- fallito

- caratteristica

- pochi

- campo

- Compila il

- File

- filtro

- fine

- Nome

- contrassegnato

- Focus

- i seguenti

- Nel

- amichevole

- da

- funzionalità

- gaming

- Sesso

- Generale

- ottenere

- Go

- va

- Grafico

- Gruppo

- guida

- dannoso

- Avere

- he

- aiuta

- suo

- qui

- Alta

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- umano

- identificare

- Identità

- if

- impattato

- importare

- miglioramento

- in

- includere

- inclusi

- Compreso

- Inclusivo

- Aumento

- indicare

- indica

- industrie

- informazioni

- intuizioni

- Insulto

- destinato

- intento

- Intenzione

- apposta

- interesse

- interfacce

- ai miglioramenti

- Irlanda

- IT

- elementi

- Lavoro

- jpg

- json

- ad appena

- mantenere

- Lingua

- portare

- IMPARARE

- apprendimento

- Livello

- linea

- Lista

- località

- Londra

- ama

- macchina

- machine learning

- mantenere

- FA

- gestione

- direttore

- molti

- Marketing

- Media

- Soddisfare

- ML

- modello

- modelli

- moderazione

- Scopri di più

- maggior parte

- devono obbligatoriamente:

- Nome

- il

- Naturale

- Elaborazione del linguaggio naturale

- Bisogno

- esigenze

- internazionale

- New

- adesso

- of

- offrire

- di frequente

- Ohio

- on

- online

- il gioco online

- esclusivamente

- aprire

- Operazioni

- or

- Oregon

- organizzazioni

- origine

- nostro

- su

- produzione

- al di fuori

- panoramica

- proprio

- Pacifico

- pagina

- Dolore

- parametri

- partecipare

- Ricambi

- passare

- appassionato

- persona

- Frasi

- Fisico

- Intonazione

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioco

- porzione

- posizione

- Post

- presenza

- problemi

- processi

- Elaborato

- lavorazione

- Prodotto

- gestione del prodotto

- product manager

- PROFANITÀ

- Programmazione

- promuovere

- fornire

- purché

- fornisce

- fornitura

- Python

- qualità

- Gara

- Crudo

- pronto

- riconoscimento

- registrato

- ridurre

- Ridotto

- Riferimenti

- regioni

- normativo

- rilevanza

- religione

- fare affidamento

- Segnalati

- risposta

- colpevole

- Risultati

- recensioni

- revisione

- Rischio

- sicura

- stesso

- Scala

- scala

- truffe

- Punto

- scorrere

- sdk

- secondo

- Sezione

- cerca

- segmento

- segmenti

- anziano

- delicata

- servizio

- Servizi

- set

- impostazioni

- Sette

- Sesso

- Sessuale

- Condividi

- lei

- mostrato

- Spettacoli

- segno

- simile

- Un'espansione

- Social

- Social Media

- Il social networking

- unicamente

- soluzione

- Soluzioni

- specializzata

- specifico

- discorso

- Riconoscimento vocale

- sintesi vocale

- velocità

- parlato

- Standard

- inizia a

- iniziato

- Di partenza

- Stato dei servizi

- step

- conservazione

- tale

- sufficiente

- supportato

- supporti

- sydney

- SISTEMI DI TRATTAMENTO

- Fai

- parlando

- team

- Consulenza

- condizioni

- test

- che

- I

- loro

- Li

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- minacce

- Attraverso

- tempo

- a

- oggi

- verso

- verso

- Treni

- trasformazione

- viaggiare

- vero

- prova

- Digitare

- ui

- per

- unico

- Unsolicited

- aggiornato

- us

- uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- Prezioso

- APPREZZIAMO

- varietà

- via

- Violenza

- Virginia

- visione

- Visita

- Voce

- vs

- Volgare

- aspettare

- volere

- we

- sito web

- servizi web

- WELL

- ovest

- quando

- while

- volere

- con

- senza

- parole

- Lavora

- scrittura

- anni

- ancora

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro