Oggi siamo entusiasti di annunciare che il Gemma il modello è ora disponibile per i clienti che utilizzano JumpStart di Amazon SageMaker. Gemma è una famiglia di modelli linguistici basato sui modelli Gemini di Google, addestrato su un massimo di 6 trilioni di token di testo. La famiglia Gemma è composta da due dimensioni: un modello da 7 miliardi di parametri e un modello da 2 miliardi di parametri. Ora puoi utilizzare i modelli Gemma 2B e Gemma 7B preaddestrati e ottimizzati con istruzioni all'interno SageMaker JumpStart. JumpStart è l'hub di machine learning (ML) di SageMaker che fornisce l'accesso ai modelli di base oltre agli algoritmi integrati e ai modelli di soluzioni end-to-end per aiutarti a iniziare rapidamente con il machine learning.

In questo post, spieghiamo come distribuire il modello Gemma e ottimizzarlo per i tuoi casi d'uso in SageMaker JumpStart. Il taccuino completo è disponibile su GitHub.

Modello Gemma

Gemma è una famiglia di prodotti leggeri e all'avanguardia modelli costruito dalla stessa ricerca e tecnologia utilizzata per creare il Gemini Modelli. Sviluppato da Google DeepMind e altri team di Google, Gemma si ispira ai Gemelli. Gemma mostra forti capacità generaliste nei domini testuali e capacità di comprensione e ragionamento all'avanguardia su larga scala. Raggiunge prestazioni migliori rispetto ad altri modelli disponibili al pubblico su scala simile o più ampia in diversi ambiti, tra cui la risposta alle domande, il ragionamento basato sul buon senso, la matematica, la scienza e la codifica. Gemma ha rilasciato i pesi dei modelli per supportare l'innovazione degli sviluppatori utilizzando i modelli Gemma. Gemma è stata lanciata con una nuova Toolkit di intelligenza artificiale generativa responsabile che fornisce indicazioni e strumenti essenziali per creare applicazioni IA più sicure con Gemma.

Modelli di fondazione in SageMaker

JumpStart fornisce l'accesso a una gamma di modelli da hub di modelli popolari tra cui Hugging Face, PyTorch Hub e TensorFlow Hub, che puoi utilizzare all'interno del tuo flusso di lavoro di sviluppo ML in SageMaker. I recenti progressi nel machine learning hanno dato origine a una nuova classe di modelli noti come modelli di fondazione, che in genere sono addestrati su miliardi di parametri e sono adattabili a un'ampia categoria di casi d'uso, come il riepilogo del testo, la generazione di arte digitale e la traduzione linguistica. Poiché questi modelli sono costosi da addestrare, i clienti desiderano utilizzare i modelli di base pre-addestrati esistenti e perfezionarli secondo necessità, piuttosto che addestrare questi modelli da soli. SageMaker fornisce un elenco curato di modelli tra cui puoi scegliere sulla console SageMaker.

Ora puoi trovare modelli di fondazione di diversi fornitori di modelli all'interno di JumpStart, consentendoti di iniziare rapidamente con i modelli di fondazione. È possibile trovare modelli di base basati su attività o fornitori di modelli diversi ed esaminare le caratteristiche del modello e i termini di utilizzo. Puoi anche provare questi modelli utilizzando un widget dell'interfaccia utente di prova. Se desideri utilizzare un modello di base su larga scala, puoi farlo senza uscire da SageMaker utilizzando notebook predefiniti dei fornitori di modelli. Poiché i modelli sono ospitati e distribuiti su AWS, i tuoi dati, sia che vengano utilizzati per valutare il modello o su larga scala, non vengono mai condivisi con terze parti.

Esploriamo come utilizzare il modello Llama Guard in JumpStart.

Esplora il modello Gemma in Jumpstart

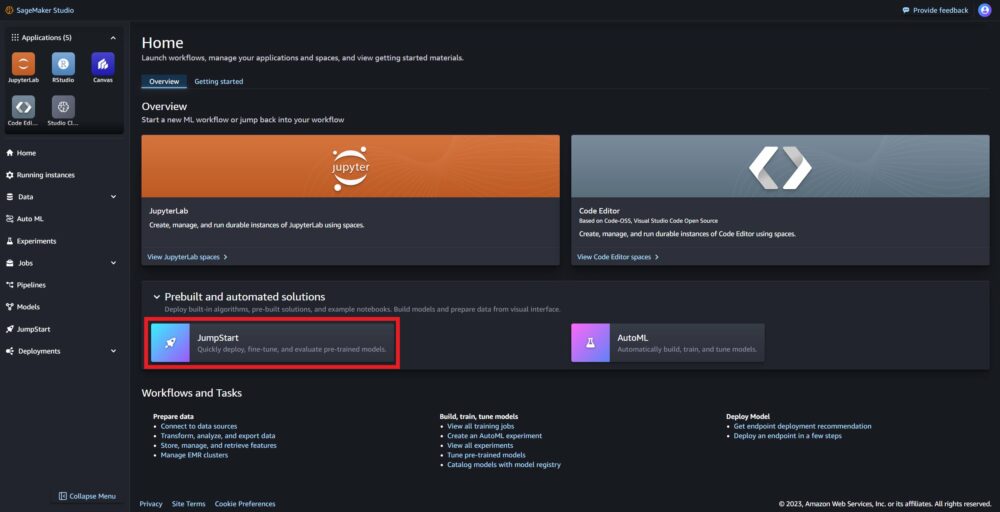

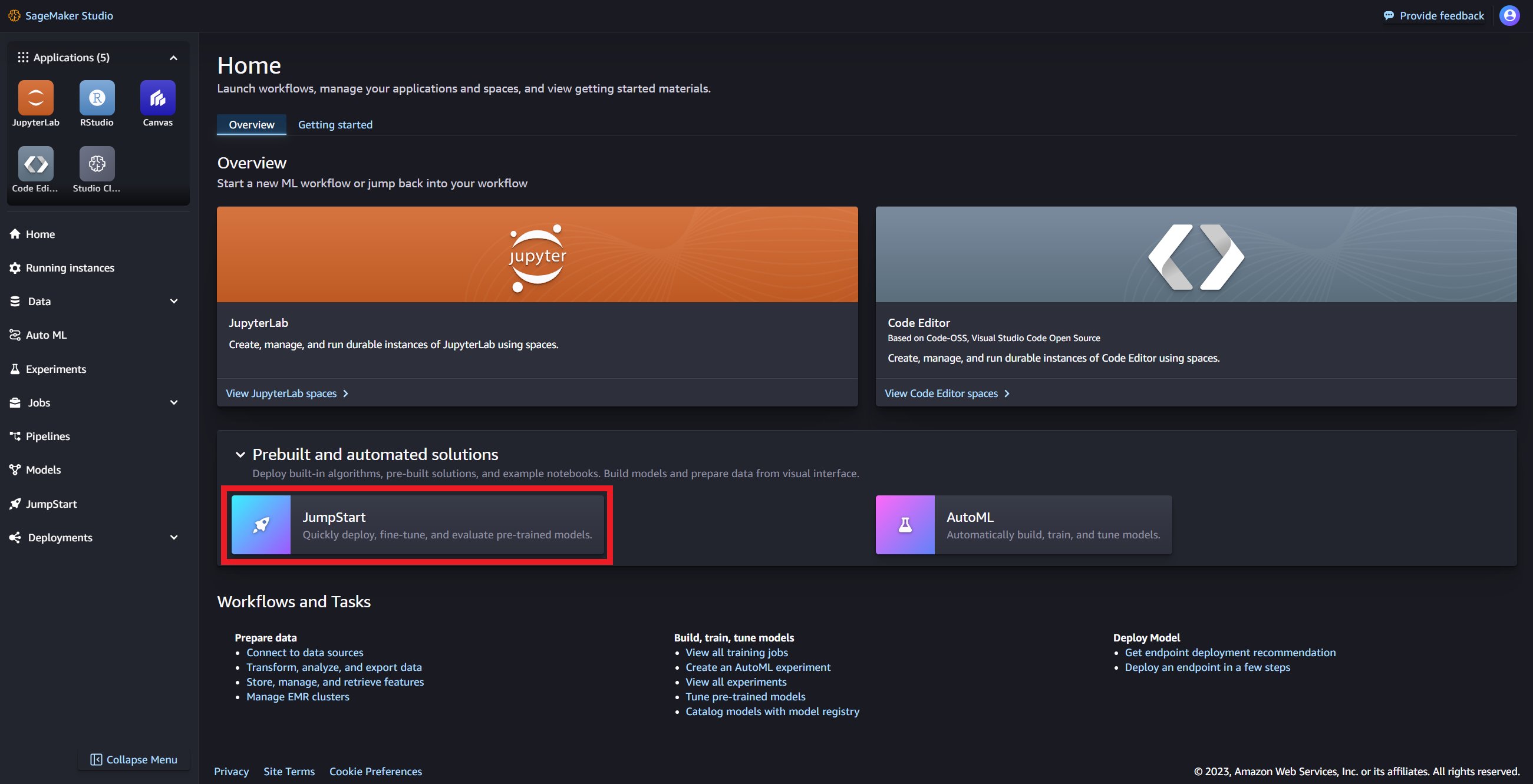

Puoi accedere ai modelli della fondazione Gemma tramite SageMaker JumpStart nell'interfaccia utente di SageMaker Studio e nell'SDK Python di SageMaker. In questa sezione, esamineremo come scoprire i modelli in SageMaker Studio.

SageMaker Studio è un ambiente di sviluppo integrato (IDE) che fornisce un'unica interfaccia visiva basata sul Web in cui è possibile accedere a strumenti specifici per eseguire tutte le fasi di sviluppo ML, dalla preparazione dei dati alla creazione, formazione e distribuzione dei modelli ML. Per ulteriori dettagli su come iniziare e configurare SageMaker Studio, vedere Amazon Sage Maker Studio.

Nella Console di gestione AWS per SageMaker Studio, vai a SageMaker JumpStart sotto Soluzioni predefinite e automatizzate. Jumpstart contiene modelli preaddestrati, notebook e soluzioni predefinite.

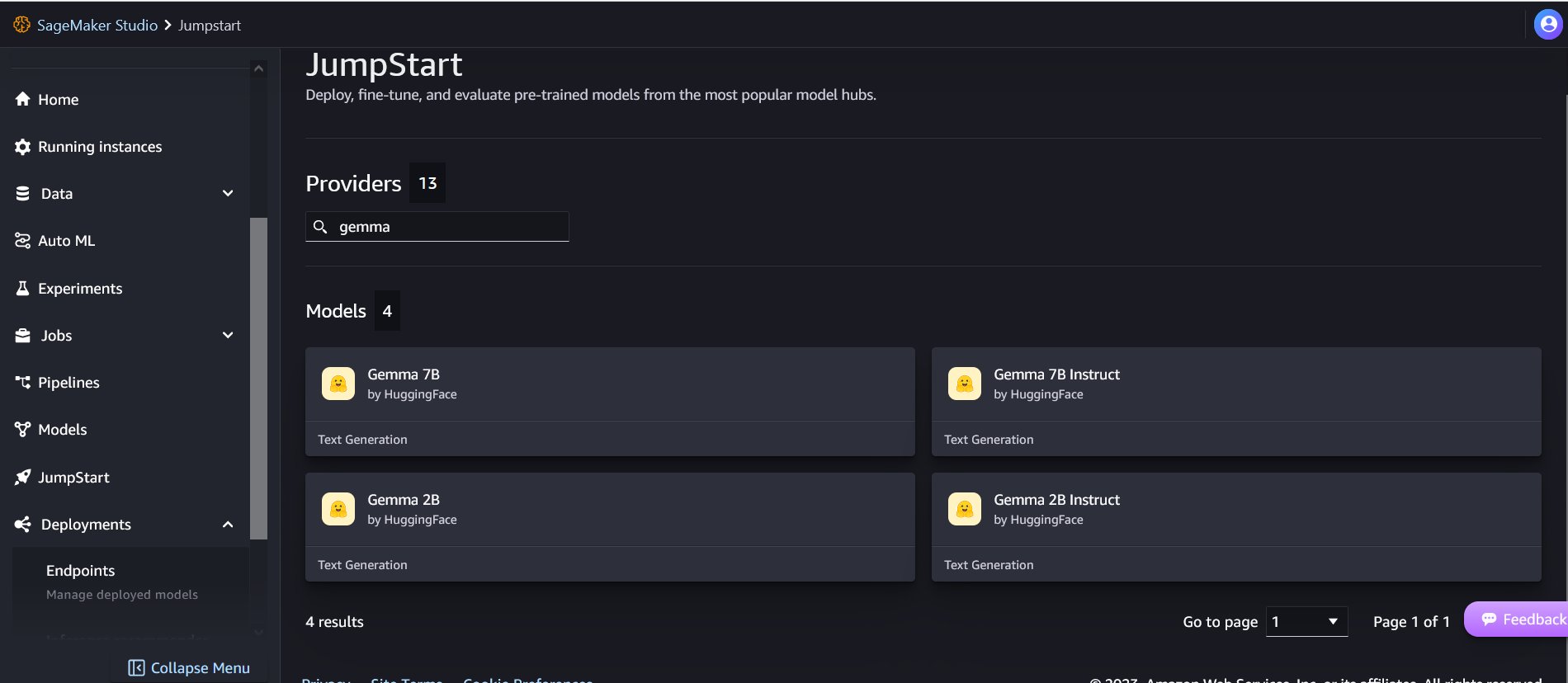

Nella pagina di destinazione JumpStart di SageMaker, puoi trovare il modello Gemma cercando Gemma.

È quindi possibile scegliere tra una varietà di varianti del modello Gemma, tra cui Gemma 2B, Gemma 7B, Gemma 2B istruisce e Gemma 7B istruisce.

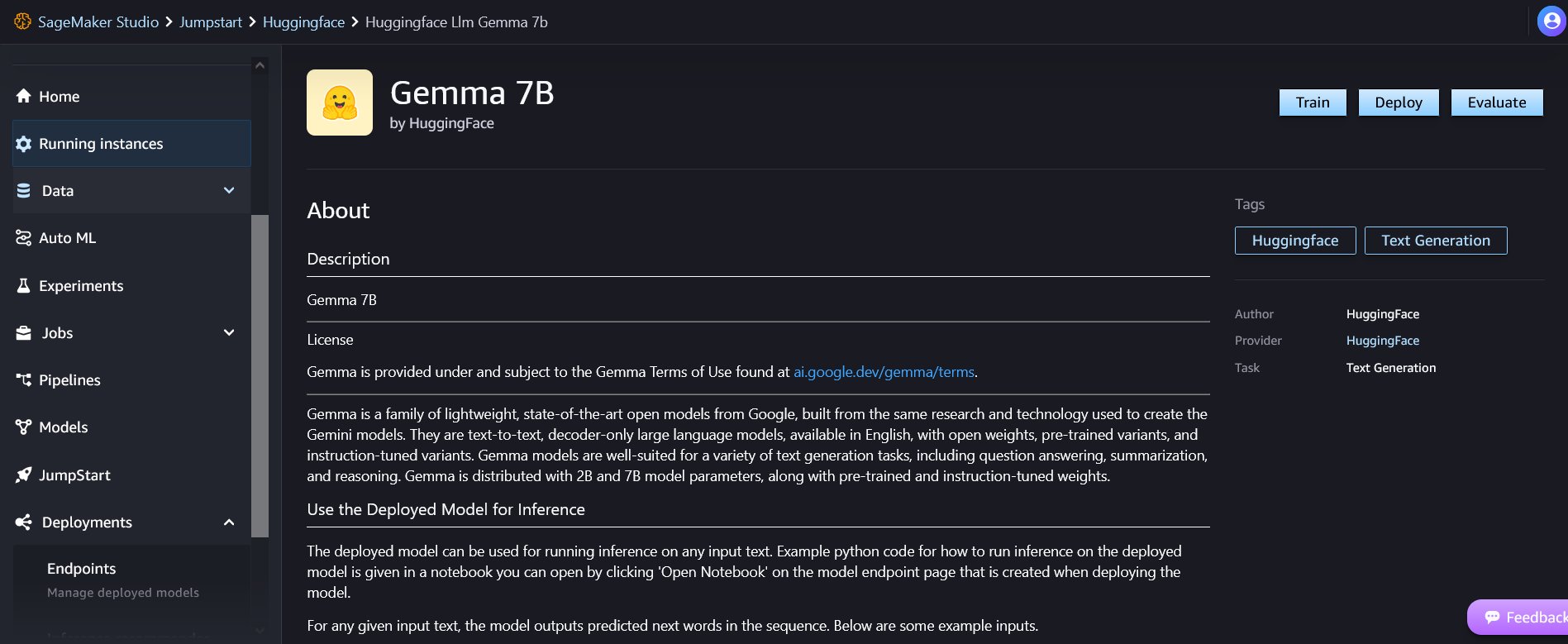

Scegli la scheda del modello per visualizzare i dettagli sul modello come la licenza, i dati utilizzati per l'addestramento e come utilizzare il modello. Troverai anche un Schierare pulsante, che ti porta a una pagina di destinazione in cui puoi testare l'inferenza con un payload di esempio.

Distribuisci Gemma con SageMaker Python SDK

Puoi trovare il codice che mostra la distribuzione di Gemma su JumpStart e un esempio di come utilizzare il modello distribuito in questo taccuino GitHub.

Inizia selezionando l'ID modello SageMaker Model Hub e la versione del modello da utilizzare durante la distribuzione di Gemma.

Scegli un ID modello dalla tabella seguente, che descrive in dettaglio le opzioni di configurazione predefinite per la distribuzione JumpStart. A causa delle grandi dimensioni del vocabolario di 256mila token, Gemma 7B può adattarsi solo a una singola GPU A10G quando supporta una lunghezza di contesto di 1mila. Per questo motivo, JumpStart utilizza un'istanza predefinita più grande per Gemma 7B.

| ID modello | Istanza di inferenza predefinita | Grado parallelo del tensore | Lunghezza del contesto supportato |

| abbracciandoface-llm-gemma-2b | ml.g5.xgrande | 1 | 8k |

| abbracciandoface-llm-gemma-2b-istruire | ml.g5.xgrande | 1 | 8k |

| abbracciandoface-llm-gemma-7b | ml.g5.12xgrande | 4 | 8k |

| abbracciandoface-llm-gemma-7b-istruire | ml.g5.12xgrande | 4 | 8k |

Ora puoi distribuire il modello utilizzando SageMaker JumpStart. Il codice seguente utilizza l'istanza predefinita ml.g5.12xlarge per l'endpoint di inferenza È possibile distribuire il modello su altri tipi di istanza passando instance_type nel JumpStartModel classe. La distribuzione potrebbe richiedere 5-10 minuti.

Per una distribuzione corretta, è necessario modificare manualmente il file accept_eula argomento nel metodo di distribuzione del modello a True. Questo modello viene distribuito utilizzando il contenitore di deep learning TGI (text- generation-inference).

Richiamare l'endpoint

È possibile recuperare a livello di codice payload di esempio da JumpStartModel oggetto. Ciò ti aiuterà a iniziare osservando i prompt di istruzioni preformattati che Gemma può acquisire.

Prima di esaminare istruzioni specifiche, consideriamo il modello di chat per i modelli Gemma Instruct.

Qui, inserisci il tuo prompt nel file [USER_PROMPT] posizione. Non c'è supporto per un'istruzione di sistema; è invece possibile anteporre l'istruzione desiderata al prompt dell'utente. Inoltre, se hai una conversazione a più turni, il prompt del modello può alternarsi tra utente e assistente secondo necessità.

Consideriamo ora alcuni esempi di istruzioni. Qui chiedi a Gemma di scrivere un programma Hello World.

Quello che segue è l'output previsto:

Successivamente, invoca Gemma per il compito creativo di scrivere una poesia.

Quello che segue è l'output:

Sembra piuttosto buono!

Ora esaminiamo il benchmarking delle prestazioni di latenza e throughput per la fornitura di modelli con la configurazione di distribuzione JumpStart predefinita. Qui mostriamo come le prestazioni del modello potrebbero differire per il carico di lavoro tipico dell'endpoint. Nelle tabelle seguenti è possibile osservare che le query di piccole dimensioni (256 parole di input e 256 token di output) sono abbastanza performanti con un numero elevato di utenti simultanei, raggiungendo una velocità effettiva dei token dell'ordine di mille o duemila token al secondo. Tuttavia, quando il numero di parole di input si avvicina alla lunghezza massima del contesto supportata da Gemma di ottomila token, l'endpoint satura la sua capacità di batching (il numero di richieste simultanee che possono essere elaborate simultaneamente) a causa dei vincoli legati alla memoria dell'istanza.

Per ulteriori informazioni su come considerare queste informazioni e adattare le configurazioni di distribuzione per il tuo caso d'uso specifico, consulta Confronta e ottimizza la distribuzione degli endpoint in Amazon SageMaker JumpStart.

| . | Throughput (token/s) | ||||||||||

| Utenti concorrenti | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modello | Tipo di istanza | Inserisci le parole | Gettoni di uscita | . | . | . | . | . | . | . | . |

| gemma-2b-istruire | ml.g5.xgrande | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-istruire | ml.g5.12xgrande | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | Latenza P50 (ms/token) | ||||||||||

| Utenti concorrenti | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modello | Tipo di istanza | Inserisci le parole | Gettoni di uscita | . | . | . | . | . | . | . | . |

| gemma-2b-istruire | ml.g5.xgrande | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-istruire | ml.g5.12xgrande | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

Perfeziona Gemma utilizzando SageMaker Python SDK

Successivamente, ti mostriamo come ottimizzare il modello di istruzioni Gemma 7B su un set di dati in formato conversazionale utilizzando QLoRA tecnica. Come accennato in precedenza, a causa dell'ampia dimensione del vocabolario di 256 e della lunghezza del contesto di 8, JumpStart offre le seguenti configurazioni predefinite per la regolazione fine di QLoRA.

| ID modello | Istanza di training predefinita | Lunghezza massima della sequenza di input | Dimensioni del batch di addestramento per dispositivo | Passaggi di accumulo del gradiente |

| abbracciandoface-llm-gemma-2b | ml.g5.2xgrande | 1024 | 1 | 4 |

| abbracciandoface-llm-gemma-2b-istruire | ml.g5.2xgrande | 1024 | 1 | 4 |

| abbracciandoface-llm-gemma-7b | ml.g5.12xgrande | 2048 | 1 | 4 |

| abbracciandoface-llm-gemma-7b-istruire | ml.g5.12xgrande | 2048 | 1 | 4 |

Carichiamo ed elaboriamo il set di dati in formato conversazionale. Il set di dati di esempio per questa dimostrazione è I TOP-1 thread di conversazione di OpenAssistant.

I dati di addestramento devono essere formulati in righe JSON (.jsonl), dove ogni riga è un dizionario che rappresenta un insieme di conversazioni. Di seguito è mostrato un esempio all'interno del file delle linee JSON. Per dettagli su come elaborare il set di dati, vedere il notebook in GitHub.

Alla base degli script di formazione, JumpStart utilizza HuggingFace SFTTrainer con QLoRA ed FlashAttenzione. Flash Attention consente di scalare l'efficienza, garantendo training e inferenza più rapidi. Oltre alla messa a punto basata sulla chat, JumpStart supporta anche la messa a punto delle istruzioni e dell'adattamento del dominio con QLoRA. Per i dettagli consultare il quaderno in GitHub.

Dopo la messa a punto, puoi distribuire il modello ottimizzato su un endpoint SageMaker.

Puoi scegliere di distribuire il modello ottimizzato sui dati di conversazione nell'endpoint SageMaker con Funzionalità API dei messaggi HuggingFace come approccio alternativo. Il vantaggio dell'utilizzo della funzionalità API dei messaggi è che consente agli utenti di passare gli esempi di query in formato non elaborato come mostrato nella tabella seguente e chat_template all'interno dell'endpoint convertirà gli esempi di query nel formato corretto prima di inviarli al modello. Per i dettagli, vedere la sezione relativa alla distribuzione dopo la messa a punto nel file taccuino.

Dopo aver distribuito il modello ottimizzato in un endpoint, è possibile confrontare le risposte di output dei modelli Gemma preaddestrati e ottimizzati. Gli esempi vengono raccolti dai dati di test, che rappresentano un insieme di elementi di controllo dai dati di training. I parametri di inferenza sono max_tokens come 512, top_p come 0.9, temperature come 0.4, e top_k come 50.

Come puoi vedere dai risultati della messa a punto, le risposte dell'agente sono più precise.

Per valutare ulteriormente i tuoi modelli ottimizzati, puoi esplorare Valutazione FM con Amazon SageMaker Clarify per vedere come si comporta il tuo modello ottimizzato rispetto al modello di base.

| ingressi | Verità basilare | Risposta da base modello | Risposta dal modello ottimizzato | |

| 1 |

Utente: Voglio lavorare sul mio vocabolario, puoi darmi alcuni semplici modi in cui posso trovare nuove parole da utilizzare per aumentare la diversità delle mie frasi? Assistente: Certamente! Migliorare il tuo vocabolario è un processo continuo, ma ecco alcuni semplici modi per trovare nuove parole e aumentare la diversità delle tue frasi: 1. Leggi ampiamente: leggere libri, articoli e blog di generi e argomenti diversi ti espone a nuove parole e frasi. Annota tutte le parole sconosciute che incontri e cerca il loro significato. 2. Utilizza un dizionario dei sinonimi: ogni volta che scrivi o leggi, utilizza un dizionario dei sinonimi per trovare sinonimi delle parole di uso comune. Questo non solo ti aiuta a imparare nuove parole, ma migliora anche la tua comprensione delle loro sottili differenze di significato. 3. Calendari o app di Word-a-day: iscriviti a un'e-mail di Word-a-day o scarica un'app per lo sviluppo del vocabolario. Questi strumenti ti introducono ogni giorno a una nuova parola, insieme al suo significato, pronuncia ed esempi di utilizzo. 4. Partecipa a un club del libro o a un gruppo di discussione: impegnarsi in conversazioni e discussioni su libri, articoli o qualsiasi altro argomento ti espone a prospettive diverse e nuovo vocabolario. Ascolta attentamente gli altri e prova a usare nuove parole nel contesto. 5. Gioca a giochi di parole: giochi come Scrabble, Boggle e cruciverba mettono alla prova le tue abilità di vocabolario e ti aiutano a imparare nuove parole in modo divertente. 6. Guarda film, programmi TV o documentari: i media visivi utilizzano spesso linguaggi, slang e gerghi diversi. Guardare film, programmi TV o documentari con i sottotitoli può aiutarti a comprendere e ricordare meglio le nuove parole. 7. Esercitati a scrivere: scrivere regolarmente storie, saggi o voci di diario ti incoraggia a usare nuove parole e frasi. Sperimenta stili e generi di scrittura diversi per espandere il tuo vocabolario. 8. Impara l'etimologia di una nuova parola: comprendere l'origine e la storia di una parola può renderla più facile da ricordare e da usare correttamente. La ricerca dell’etimologia ti espone anche a parole e concetti correlati. 9. Usa flashcard o software di ripetizione distanziata: crea flashcard con nuove parole, i loro significati e frasi di esempio. Rivedili regolarmente o utilizza software di ripetizione distanziata come Anki per ottimizzare il tuo apprendimento. 10. Stabilisci obiettivi personali: stabilisci obiettivi realizzabili, come imparare cinque nuove parole a settimana. Tieni traccia dei tuoi progressi e premiati per aver raggiunto i tuoi obiettivi. Incorporando costantemente queste strategie nella tua routine quotidiana, costruirai gradualmente un vocabolario vario e solido. Utente: Hm, mi piace molto l'idea di leggere. Potete consigliarmi un bel thriller di fantascienza che potrei leggere? |

Assistente: Certamente! Ecco alcuni consigli per i thriller di fantascienza che potrebbero piacerti: 1. “Il problema dei tre corpi” di Liu Cixin – Questo romanzo pluripremiato esplora il primo contatto tra l'umanità e una civiltà aliena e le ramificazioni politiche e personali che ne derivano. È una lettura avvincente e stimolante che approfondisce domande profonde sulla natura dell'esistenza e dell'universo. 2. “Annihilation” di Jeff Vandermeer – Questo romanzo segue un gruppo di scienziati mentre si avventurano in un'area misteriosa conosciuta come “Area X”, dove incontrano fenomeni strani e inquietanti. Man mano che approfondiscono l'area, iniziano a scoprire oscuri segreti sulla natura della realtà e sul mondo che li circonda. 3. “Dark Matter” di Blake Crouch – Questo romanzo segue un brillante fisico di nome Jason Dessen, che viene rapito e trasportato in un universo parallelo. Mentre cerca di ritrovare la strada per tornare alla propria realtà, deve affrontare le proprie scelte e le conseguenze delle sue azioni. 4. “The Andromeda Strain” di Michael Crichton – Questo romanzo classico segue un team di scienziati mentre cercano di contenere e studiare un microbo extraterrestre mortale che è atterrato sulla Terra. Mentre corrono contro il tempo per trovare un modo per neutralizzare il microbo, devono anche affrontare intrighi politici e conflitti personali. 5. “Ready Player One” di Ernest Cline – Questo romanzo è ambientato in un futuro distopico in cui la maggior parte della popolazione trascorre il proprio tempo in un mondo di realtà virtuale noto come OASIS. Quando il creatore di OASIS muore e lascia dietro di sé una sfida per trovare un uovo di Pasqua nascosto, un giovane protagonista intraprende un'emozionante ricerca che cambierà la sua vita per sempre. Spero che uno di questi consigli susciti il tuo interesse! |

Assistente: Il testo non contiene informazioni sulle tue preferenze o interessi di lettura, pertanto non posso consigliare un libro. |

Assistente: Certo, ecco alcuni consigli sui thriller di fantascienza che potrebbero piacerti: – “Dune” di Frank Herbert: questo epico romanzo di fantascienza è ambientato sul pianeta deserto di Arrakis, dove un giovane principe di nome Paul Atreides deve affrontare le sfide di un ambiente ostile e di un panorama politico insidioso. – “The Martian” di Andy Weir: questo avvincente thriller fantascientifico segue la storia di Mark Watney, un astronauta bloccato su Marte dopo una tempesta di sabbia, mentre usa il suo ingegno e la sua intraprendenza per sopravvivere e alla fine tornare sulla Terra. – “The Time Machine” di HG Wells: questo classico romanzo di fantascienza adotta un approccio filosofico al concetto di viaggio nel tempo, esplorando le conseguenze dell’alterazione del passato e del futuro. – “The Blade Runner” di Philip K. Dick: questo romanzo di fantascienza neo-noir, ambientato in una Los Angeles futuristica, esplora l’intersezione tra intelligenza umana e artificiale e la sua influenza sulla società e sulla natura della realtà. – “The Androids” di Isaac Asimov: questo romanzo di fantascienza esplora il concetto di intelligenza artificiale e le sue potenziali conseguenze, in particolare quando gli esseri umani sviluppano androidi avanzati che sfidano i valori e le credenze umane tradizionali. Questi sono solo alcuni suggerimenti e, in definitiva, il libro migliore per te dipenderà dalle tue preferenze personali e dal tipo di esperienza che stai cercando in un thriller di fantascienza. Ma spero che questi consigli ti forniscano un buon punto di partenza per esplorare il genere. Per favore, fammi sapere se hai ulteriori domande o se c'è qualcosa in cui posso aiutarti. |

| 2 |

Utente: scrivere un programma Hello World in VB.NET Assistente: Ecco qua: “`vbnet Utente: fai in modo che prenda input da $ e poi dica "Ciao, $" invece di "Ciao, mondo!" |

Assistente: modulo pubblico HelloWorld Sottoprincipale pubblico() System.Console.WriteLine("Qual è il tuo nome?") Dim nome As String = System.Console.ReadLine() System.Console.WriteLine("Ciao, " & nome & "!") End Sub Modulo finale |

Assistente: “`vbnet Modulo pubblico HelloWorld Sottoprincipale pubblico() Dim nome As String = Console.ReadLine() Console.WriteLine("Ciao", e nome) End Sub Modulo finale |

Assistente: Certo! Ecco un esempio: “`vbnet |

| 3 |

Utente: dammi un elenco di cose da fare quando avvii un progetto per addestrare un modello linguistico di grandi dimensioni in grado di comprendere e rispondere alle domande umane Assistente: i passaggi seguenti sono un elenco condensato di passaggi da eseguire quando si avvia un progetto per addestrare un modello linguistico di grandi dimensioni in grado di comprendere e rispondere alle domande umane: 1. Stabilire la portata e gli obiettivi del progetto, il pubblico target. Questo dovrebbe darti un'idea di base di quali sono i passaggi richiesti. Devo entrare più nel dettaglio su uno dei punti? Utente: Queste attività devono essere ulteriormente suddivise, potresti fornire un elenco aggiornato di cose da fare con una ripartizione più dettagliata delle attività future |

Assistente: ecco una ripartizione più dettagliata di ogni passaggio: 1. Stabilire l'ambito e gli obiettivi del progetto: è importante definire chiaramente gli obiettivi del progetto e qual è il pubblico target. Ciò ti aiuterà a prendere decisioni su quale tipo di dati raccogliere e quale architettura del modello è appropriata. 2. Raccogliere e preelaborare i dati: questo è un passo importante poiché la qualità e la diversità dei dati avranno un impatto diretto sulle prestazioni del modello. La preelaborazione può comportare la pulizia dei dati, la tokenizzazione del testo e la conversione delle parole in rappresentazioni numeriche. 3. Selezionare l'architettura del modello: sono disponibili molti tipi diversi di modelli tra cui scegliere, comprese le reti neurali ricorrenti (RNN), i modelli di trasformazione e le reti neurali convoluzionali (CNN). La scelta dipenderà dai requisiti specifici del progetto e dalla quantità di dati disponibili. 4. Dividere il set di dati e implementare l'aumento dei dati: dividere i dati in sottoinsiemi di training, validazione e test è importante per monitorare le prestazioni del modello durante il training. L’aumento dei dati può essere utilizzato per aumentare artificialmente la dimensione del set di dati e migliorare la robustezza del modello. 5. Addestrare il modello e monitorare l'avanzamento: questo passaggio prevede l'addestramento del modello sui dati di addestramento, utilizzando il set di convalida per monitorare l'avanzamento e regolare gli iperparametri secondo necessità. Potrebbe essere necessario ripetere questo processo più volte finché il modello non funziona bene sul set di validazione. 6. Valutare il modello su un set di test: una volta addestrato il modello, è importante valutare le sue prestazioni su un set di test separato per avere un'idea della sua capacità di generalizzazione. Ciò può essere fatto confrontando le previsioni del modello con i risultati effettivi e analizzando gli errori. 7. Ottimizzazione per attività o domini specifici: questa fase prevede un ulteriore addestramento del modello su dati specifici dell'attività per migliorarne le prestazioni per un particolare dominio. Ciò può essere fatto tramite l'apprendimento del trasferimento, in cui un modello pre-addestrato viene ottimizzato su nuovi dati, o attraverso l'ottimizzazione, in cui il modello viene addestrato da zero sui nuovi dati. 8. Creare un'interfaccia per l'input dell'utente: ciò comporta la progettazione di un'interfaccia che consenta agli utenti di inserire domande o richieste e ricevere risposte dal modello. 9. Test in un ambiente controllato: prima di distribuire il modello in un ambiente reale, è importante testarlo in un ambiente controllato e raccogliere feedback dagli utenti. Ciò aiuterà a identificare eventuali errori o distorsioni nel modello e fornirà opportunità di miglioramento. 10. Monitorare e migliorare continuamente le prestazioni: infine, è importante monitorare continuamente le prestazioni del modello e apportare aggiornamenti e miglioramenti secondo necessità. Ciò potrebbe comportare la riqualificazione del modello su nuovi dati, la messa a punto degli iperparametri o l'aggiornamento dell'architettura. |

Assistente: ## Elenco di cose da fare per la formazione di un modello linguistico di grandi dimensioni per la risposta alle domande **1. Ambito e obiettivi del progetto:** * Definire gli obiettivi del progetto e le funzionalità desiderate. **2. Acquisizione e preelaborazione dei dati:** * Identificare le fonti per i dati di addestramento e raccogliere un set di dati di testo diversificato. **3. Selezione e configurazione del modello:** * Selezionare un'architettura del modello appropriata in base alla complessità dell'attività e alle prestazioni desiderate. **4. Formazione e valutazione:** * Dividere i dati di addestramento in sottoinsiemi di addestramento, convalida e test. **5. Messa a punto e sviluppo dell'interfaccia:** * Perfezionare il modello per attività o domini specifici attraverso l'apprendimento del trasferimento. **6. Test e miglioramenti:** * Testare il modello in un ambiente controllato con vari scenari di input. **Considerazioni aggiuntive:** * Stabilisci una tempistica e un budget per il progetto. **Nota:** questo elenco non è esaustivo e potrebbe essere necessario adattarlo in base ai requisiti specifici del progetto. |

Assistente: Certo, ecco una ripartizione più dettagliata dei compiti coinvolti nell'addestramento di un ampio modello linguistico per comprendere e rispondere alle domande umane: **1. Stabilire l'ambito e gli obiettivi del progetto** **2. Raccogli e preelabora un set di dati di testo completo/diversificato** **3. Seleziona un'architettura del modello appropriata, regola gli iperparametri per precisione/velocità** **4. Dividere il set di dati in sottoinsiemi di formazione, convalida, test, implementare l'aumento dei dati** **5. Addestrare il modello, monitorare l'avanzamento del set di convalida, apportare modifiche secondo necessità** **6. Valuta il modello sul set di test, confronta con i benchmark, analizza errori e bias** **7. Ottimizzazione per attività o domini specifici tramite trasferimento di apprendimento o ottimizzazione** **8. Crea un'interfaccia per l'input dell'utente e la risposta del modello** **9. Testare in un ambiente controllato, raccogliere feedback per il miglioramento** **10. Monitorare e migliorare continuamente le prestazioni attraverso la riqualificazione e il perfezionamento** Questi sono i passaggi coinvolti nella formazione di un ampio modello linguistico per comprendere e rispondere alle domande umane. Per favore fatemi sapere se avete domande. |

ripulire

Dopo aver testato gli endpoint, elimina gli endpoint di inferenza SageMaker e il modello per evitare di incorrere in addebiti.

Conclusione

In questo post ti abbiamo mostrato come iniziare con Gemma in SageMaker Studio e distribuire il modello per l'inferenza. Ti abbiamo anche mostrato come ottimizzare i modelli Gemma su SageMaker Jumpstart.

Poiché i modelli di base sono pre-addestrati, possono contribuire a ridurre i costi di formazione e infrastruttura e consentire la personalizzazione per il tuo caso d'uso. Visita subito SageMaker JumpStart in SageMaker Studio per iniziare.

Questa guida è solo a scopo informativo. Dovresti comunque eseguire la tua valutazione indipendente e adottare misure per assicurarti di rispettare le tue specifiche pratiche e standard di controllo della qualità e le norme, le leggi, i regolamenti, le licenze e i termini di utilizzo locali che si applicano a te, ai tuoi contenuti e il modello di terze parti a cui si fa riferimento in questa guida. AWS non ha alcun controllo o autorità sul modello di terze parti a cui si fa riferimento in questa guida e non rilascia alcuna dichiarazione o garanzia che il modello di terze parti sia sicuro, privo di virus, operativo o compatibile con l'ambiente di produzione e gli standard. AWS non rilascia alcuna dichiarazione o garanzia che qualsiasi informazione contenuta in questa guida si tradurrà in un particolare risultato o risultato.

Circa gli autori

Dottor Kyle Ulrich è uno scienziato applicato con il Algoritmi integrati di Amazon SageMaker squadra. I suoi interessi di ricerca includono algoritmi di machine learning scalabili, visione artificiale, serie storiche, bayesiani non parametrici e processi gaussiani. Il suo dottorato di ricerca è presso la Duke University e ha pubblicato articoli su NeurIPS, Cell e Neuron.

Dottor Kyle Ulrich è uno scienziato applicato con il Algoritmi integrati di Amazon SageMaker squadra. I suoi interessi di ricerca includono algoritmi di machine learning scalabili, visione artificiale, serie storiche, bayesiani non parametrici e processi gaussiani. Il suo dottorato di ricerca è presso la Duke University e ha pubblicato articoli su NeurIPS, Cell e Neuron.

Dott. Xin Huang è Senior Applied Scientist per gli algoritmi integrati di Amazon SageMaker JumpStart e Amazon SageMaker. Si concentra sullo sviluppo di algoritmi di apprendimento automatico scalabili. I suoi interessi di ricerca riguardano l'elaborazione del linguaggio naturale, il deep learning spiegabile su dati tabulari e l'analisi solida del clustering spazio-temporale non parametrico. Ha pubblicato molti articoli nelle conferenze ACL, ICDM, KDD e Royal Statistical Society: Series A.

Dott. Xin Huang è Senior Applied Scientist per gli algoritmi integrati di Amazon SageMaker JumpStart e Amazon SageMaker. Si concentra sullo sviluppo di algoritmi di apprendimento automatico scalabili. I suoi interessi di ricerca riguardano l'elaborazione del linguaggio naturale, il deep learning spiegabile su dati tabulari e l'analisi solida del clustering spazio-temporale non parametrico. Ha pubblicato molti articoli nelle conferenze ACL, ICDM, KDD e Royal Statistical Society: Series A.

Rachna Chada è Principal Solution Architect AI/ML in Strategic Accounts presso AWS. Rachna è un’ottimista che crede che l’uso etico e responsabile dell’intelligenza artificiale possa migliorare la società in futuro e portare prosperità economica e sociale. Nel suo tempo libero, Rachna ama trascorrere del tempo con la sua famiglia, fare escursioni e ascoltare musica.

Rachna Chada è Principal Solution Architect AI/ML in Strategic Accounts presso AWS. Rachna è un’ottimista che crede che l’uso etico e responsabile dell’intelligenza artificiale possa migliorare la società in futuro e portare prosperità economica e sociale. Nel suo tempo libero, Rachna ama trascorrere del tempo con la sua famiglia, fare escursioni e ascoltare musica.

Evan Kravitz è un ingegnere del software presso Amazon Web Services, che lavora su SageMaker JumpStart. Gli piace cucinare e correre a New York City.

Evan Kravitz è un ingegnere del software presso Amazon Web Services, che lavora su SageMaker JumpStart. Gli piace cucinare e correre a New York City.

Dottor Ashish Khetan è un Senior Applied Scientist con algoritmi integrati di Amazon SageMaker e aiuta a sviluppare algoritmi di machine learning. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois Urbana-Champaign. È un ricercatore attivo nell'apprendimento automatico e nell'inferenza statistica e ha pubblicato numerosi articoli nelle conferenze NeurIPS, ICML, ICLR, JMLR, ACL e EMNLP.

Dottor Ashish Khetan è un Senior Applied Scientist con algoritmi integrati di Amazon SageMaker e aiuta a sviluppare algoritmi di machine learning. Ha conseguito il dottorato di ricerca presso l'Università dell'Illinois Urbana-Champaign. È un ricercatore attivo nell'apprendimento automatico e nell'inferenza statistica e ha pubblicato numerosi articoli nelle conferenze NeurIPS, ICML, ICLR, JMLR, ACL e EMNLP.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- capacità

- Chi siamo

- sopra

- Accetta

- accesso

- accessibilità

- Il mio account

- conti

- accumulazione

- precisione

- preciso

- realizzabile

- Realizza

- acquisizione

- operanti in

- azioni

- attivo

- presenti

- adattamento

- aggiunta

- Inoltre

- regolare

- Avanzate

- avanzamenti

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- Agente

- AI

- AI / ML

- aereo

- Algoritmi

- alieno

- Tutti

- consentire

- permesso

- consente

- lungo

- anche

- alternativa

- Amazon

- Amazon Sage Maker

- JumpStart di Amazon SageMaker

- Amazon Web Services

- quantità

- an

- .

- analizzare

- analisi

- l'analisi

- ed

- e infrastruttura

- Andromeda

- Angeles

- Annunciare

- rispondere

- rispondere

- risposte

- in qualsiasi

- nulla

- api

- App

- applicazioni

- applicato

- APPLICA

- approccio

- approcci

- opportuno

- applicazioni

- architettura

- SONO

- RISERVATA

- aree

- argomento

- in giro

- Arte

- news

- artificiale

- intelligenza artificiale

- AS

- chiedere

- valutazione

- Assistant

- astronauta

- At

- pubblico

- autorità

- Automatizzata

- disponibile

- evitare

- premiata

- AWS

- Console di gestione AWS

- precedente

- balanced

- base

- basato

- basic

- dosaggio

- bayesiano

- BE

- perché

- prima

- iniziare

- dietro

- essendo

- credenze

- crede

- sotto

- analisi comparativa

- parametri di riferimento

- beneficio

- oltre a

- MIGLIORE

- Meglio

- fra

- pregiudizio

- pregiudizi

- Miliardo

- miliardi

- LAMA

- Bloccare

- Blog

- blog

- Fioritura

- stile di vita

- libro

- Libri

- Guasto

- brillante

- portare

- Portare

- Porta

- Rotto

- budget limitato.

- costruire

- Costruzione

- costruito

- incassato

- ma

- pulsante

- by

- calendari

- chiamata

- detto

- Materiale

- non può

- tela

- funzionalità

- capace

- carta

- Custodie

- casi

- Categoria

- cautela

- cella

- Challenge

- sfide

- il cambiamento

- caratteristiche

- oneri

- chiacchierare

- Controlli

- scegliere

- scelte

- Scegli

- Città

- Civilization

- classe

- classico

- cavedano

- Pulizia

- chiaramente

- clicca

- club

- il clustering

- codice

- codifica

- collaborazione

- viene

- comunemente

- confrontare

- rispetto

- confronto

- confronto

- compatibile

- completamento di una

- complessità

- complessità

- ottemperare

- computer

- Visione computerizzata

- concetto

- concetti

- concorrente

- conferenze

- Configurazione

- conflitti

- Conseguenze

- Prendere in considerazione

- Considerazioni

- considerando

- costantemente

- consiste

- consolle

- costante

- vincoli

- contatti

- contenere

- Contenitore

- contiene

- contendere

- contenuto

- contesto

- continuamente

- di controllo

- controllata

- Conversazione

- discorsivo

- Conversazioni

- convertire

- conversione

- Froids

- correttamente

- Costi

- potuto

- creare

- Creazione

- Creative

- Creatore

- cruciverba

- a cura

- curioso

- Corrente

- Clienti

- personalizzazione

- alle lezioni

- danza

- Scuro

- dati

- dataset

- giorno

- decisioni

- deep

- apprendimento profondo

- più profondo

- DeepMind

- Predefinito

- definire

- definisce

- scavare

- scava

- dimostrazione

- dipendere

- schierare

- schierato

- distribuzione

- deployment

- DESERTO

- Design

- progettazione

- desiderato

- dettaglio

- dettagliati

- dettagli

- Determinare

- sviluppare

- sviluppato

- Costruttori

- in via di sviluppo

- Mercato

- dispositivo

- diagnosi

- dialogo

- differire

- differenze

- diverso

- digitale

- Arte digitale

- direttamente

- elenco

- scopri

- discussione

- discussioni

- malattie

- immersione

- paesaggio differenziato

- Diversità

- dividere

- do

- documento

- documentari

- effettua

- dominio

- domini

- fatto

- giù

- scaricare

- dovuto

- Duca

- Università del Duca

- durante

- Polvere

- distopico

- ogni

- terra

- più facile

- efficienza

- otto

- Impero

- enable

- Abilita

- consentendo

- incontrare

- incoraggia

- da un capo all'altro

- endpoint

- impegnandosi

- ingegnere

- Migliora

- godere

- piacevole

- garantire

- Ambiente

- EPIC

- errori

- essential

- stabilire

- etico

- valutare

- la valutazione

- valutazione

- alla fine

- Ogni

- esempio

- Esempi

- eccitato

- globale

- mostre

- esistenza

- esistente

- Espandere

- previsto

- costoso

- esperienza

- esperimento

- esperti

- esplora

- esplora

- Esplorare

- Faccia

- equità

- falso

- famiglia

- più veloce

- caratteristica

- feedback

- Piedi

- pochi

- campo

- combattere

- Compila il

- Infine

- Trovare

- I risultati

- sottile

- Nome

- primo contatto

- in forma

- cinque

- Cromatografia

- volo

- si concentra

- i seguenti

- segue

- Nel

- per sempre

- formato

- Fondazione

- Contesto

- franco

- da

- function

- funzionalità

- funzionalità

- funzionamento

- ulteriormente

- futuro

- futuristico

- Giochi

- raccogliere

- Gemini

- la generazione di

- generativo

- AI generativa

- genere

- generi

- ottenere

- GitHub

- Dare

- dato

- Go

- Obiettivi

- andando

- buono

- ha ottenuto

- GPU

- grazia

- gradualmente

- grande

- grande potere

- Gruppo

- garanzie

- Guardia

- guida

- guida

- guidare

- cura

- cintura da arrampicata

- Avere

- he

- altezza

- Ciao

- Aiuto

- aiuta

- suo

- qui

- nascosto

- il suo

- storia

- speranza

- ospitato

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- Hub

- mozzi

- abbracciare il viso

- umano

- Umanità

- Gli esseri umani

- i

- ID

- idea

- identificare

- if

- Illinois

- immagini

- Impact

- realizzare

- implementazione

- importare

- importante

- competenze

- miglioramento

- miglioramenti

- miglioramento

- in

- includere

- Compreso

- incorporando

- Aumento

- studente indipendente

- industria

- standard di settore

- influenza

- informazioni

- Informativo

- Infrastruttura

- ingegnosità

- Innovazione

- ingresso

- Ingressi

- Richieste

- intuizioni

- fonte di ispirazione

- esempio

- invece

- integrare

- integrato

- Intelligence

- intento

- interazione

- interessi

- Interfaccia

- intersezione

- ai miglioramenti

- introdurre

- intuitivo

- coinvolgere

- coinvolto

- comporta

- IT

- elementi

- SUO

- gergo

- join

- rivista

- viaggio

- jpg

- json

- ad appena

- mantenere

- Genere

- Sapere

- conoscenze

- conosciuto

- kyle

- atterraggio

- paesaggio

- Lingua

- grandi

- superiore, se assunto singolarmente.

- Latenza

- lanciato

- Legislazione

- principale

- IMPARARE

- apprendimento

- impara

- partenza

- Lunghezza

- lasciare

- Livello

- Leva

- Licenza

- licenze

- Vita

- fulmine

- Velocita della luce

- leggero

- piace

- piace

- linea

- Linee

- Lista

- ascolta

- Ascolto

- ascolta

- Lama

- caricare

- locale

- località

- Guarda

- cerca

- SEMBRA

- dei

- Los Angeles

- inferiore

- macchina

- machine learning

- Maggioranza

- make

- maligno

- gestione

- manualmente

- molti

- marchio

- marzo

- matematica

- massimo

- Maggio..

- me

- significato

- significati

- analisi

- Media

- medicina

- incontro

- menzionato

- messaggio

- messaggi

- metodo

- Michael

- forza

- mente

- Minuti

- ML

- modello

- modelli

- Moduli

- Monitorare

- monitoraggio

- Scopri di più

- maggior parte

- Film

- Musica

- devono obbligatoriamente:

- my

- misterioso

- Nome

- Detto

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- necessaria

- Bisogno

- di applicazione

- esigenze

- reti

- neurale

- reti neurali

- mai

- New

- New York

- New York City

- notte

- no

- Nota

- taccuino

- romanzo

- adesso

- numero

- Oasi

- oggetto

- Obiettivi d'Esame

- osservare

- of

- Offerte

- di frequente

- on

- una volta

- ONE

- in corso

- esclusivamente

- operativa

- Opportunità

- ottimizzazione

- OTTIMIZZA

- Opzioni

- or

- minimo

- origine

- OS

- Altro

- Altri

- su

- Risultato

- risultati

- produzione

- ancora

- proprio

- pagina

- documenti

- Parallel

- parametro

- parametri

- particolare

- particolarmente

- parti

- passare

- Di passaggio

- passato

- sentiero

- modelli

- Paul

- Persone

- per

- Eseguire

- performance

- esecuzione

- esegue

- cronologia

- prospettive

- phd

- Frasi

- fisico

- pilota

- posto

- pianeta

- piani

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- giocatore

- per favore

- punto

- punti

- politico

- Popolare

- popolazione

- Post

- potenziale

- energia

- pratica

- pratiche

- Previsioni

- Predictor

- preferenze

- preparazione

- piuttosto

- in precedenza

- Principe

- Direttore

- stampe

- processi

- Elaborato

- i processi

- lavorazione

- Produzione

- Programma

- Progressi

- progetto

- istruzioni

- corretto

- prosperità

- fornire

- fornitori

- fornisce

- la percezione

- pubblicamente

- pubblicato

- fini

- Puzzle

- Python

- pytorch

- qualità

- query

- domanda

- ricerca

- domanda

- Domande

- rapidamente

- abbastanza

- Gara

- ramificazioni

- gamma

- piuttosto

- Crudo

- raggiungendo

- Leggi

- Lettura

- mondo reale

- Realtà

- veramente

- regno

- ragione

- ricevere

- recente

- Consigli

- raccomandazioni

- raccomandando

- ricorrente

- riferimento

- riferimento

- riflette

- regolarmente

- normativa

- relazionato

- rilasciato

- pertinente

- ricorda

- ripetere

- che rappresenta

- richieste

- necessario

- Requisiti

- riparazioni

- ricercatore

- Rispondere

- risponde

- risposta

- risposte

- responsabilità

- responsabile

- colpevole

- Risultati

- recensioni

- Premiare

- Aumento

- robusto

- robustezza

- Ruolo

- routine

- reale

- norme

- Correre

- corre

- s

- più sicuro

- sagemaker

- Inferenza di SageMaker

- stesso

- Risparmi

- dire

- scalabile

- Scala

- bilancia

- scala

- Scenari

- fantascienza

- Scienze

- Scienziato

- scienziati

- portata

- graffiare

- copione

- script

- sdk

- senza soluzione di continuità

- ricerca

- Secondo

- segreti

- Sezione

- sicuro

- vedere

- select

- selezionato

- Selezione

- prodotti

- invio

- anziano

- separato

- Sequenza

- Serie

- Serie A

- Servizi

- servizio

- Sessione

- set

- Set

- regolazione

- alcuni

- condiviso

- dovrebbero

- mostrare attraverso le sue creazioni

- ha mostrato

- mostra

- mostrato

- Spettacoli

- lato

- simile

- Un'espansione

- singolo

- Taglia

- Dimensioni

- abilità

- So

- Social

- Società

- Software

- Software Engineer

- soluzione

- Soluzioni

- alcuni

- fonti

- Sparks

- specifico

- velocità

- Spendere

- spende

- stare in piedi

- standard

- iniziato

- Di partenza

- Regione / Stato

- state-of-the-art

- dichiarazione

- statistiche

- step

- Passi

- Ancora

- Storie

- Tempesta

- Storia

- strano

- Strategico

- strategie

- Corda

- forte

- studio

- Studio

- sottoscrivi

- sottotitoli

- di successo

- tale

- adatto

- supporto

- supportato

- Supporto

- supporti

- sicuro

- sopravvivere

- sistema

- tavolo

- Fai

- prende

- racconto

- Target

- obiettivi

- Task

- task

- team

- le squadre

- per l'esame

- tecniche

- Tecnologia

- modello

- modelli

- tensorflow

- condizioni

- test

- testato

- Testing

- testo

- di

- che

- I

- L'area

- Il futuro

- il mondo

- loro

- Li

- si

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Terza

- terzi

- di parti terze standard

- questo

- quelli

- pensiero

- stimolante

- mille

- eccitante

- Attraverso

- portata

- tempo

- Serie storiche

- tempo di percorrenza

- time line

- volte

- a

- token

- creazione di token

- Tokens

- detto

- strumenti

- argomento

- Totale

- pista

- tradizionale

- Treni

- allenato

- Training

- trasferimento

- Trasferimento

- trasformatore

- Traduzione

- viaggiare

- Trilione

- vero

- prova

- sintonizzare

- sintonizzato

- sintonia

- tv

- seconda

- Digitare

- Tipi di

- tipico

- tipicamente

- ui

- in definitiva

- scoprire

- per

- capire

- e una comprensione reciproca

- sconosciuto

- Universo

- Università

- impareggiabile

- fino a quando

- scoprimento

- aggiornato

- Aggiornamenti

- aggiornamento

- us

- usabilità

- Impiego

- uso

- caso d'uso

- utilizzato

- Utente

- user-friendly

- utenti

- usa

- utilizzando

- convalida

- Valori

- varietà

- vario

- impresa

- versione

- Visualizza

- virtuale

- La realtà virtuale

- visione

- Visita

- visivo

- media visivi

- volume

- camminare

- volere

- garanzie

- Prima

- Orologio

- guardare

- Modo..

- modi

- we

- sito web

- servizi web

- Web-basata

- settimana

- WELL

- Wells

- Che

- Che cosa è l'

- quando

- ogni volta che

- se

- quale

- OMS

- largo

- ampiamente

- widget di

- volere

- saggezza

- con

- entro

- senza

- Word

- parole

- Lavora

- flusso di lavoro

- lavoro

- mondo

- scrivere

- scrittura

- X

- York

- Tu

- giovane

- Trasferimento da aeroporto a Sharm

- te stesso

- zefiro