Video Il più grande modello di linguaggio AI di Google sta aiutando i robot a essere più flessibili nella comprensione e nell'interpretazione dei comandi umani, secondo l'ultima ricerca del gigante del web.

Le macchine in genere rispondono meglio a richieste molto specifiche: le richieste aperte a volte possono respingerle e portare a risultati che gli utenti non avevano in mente. Le persone imparano a interagire con i robot in modo rigido, come fare domande in un modo particolare per ottenere la risposta desiderata.

L'ultimo sistema di Google, soprannominato PaLM-SayCan, tuttavia, promette di essere più intelligente. Il dispositivo fisico di Everyday Robots - una startup nata da Google X - ha telecamere per occhi nella testa e un braccio con una tenaglia nascosto dietro il suo corpo lungo e dritto, che si trova sopra una serie di ruote.

Puoi guardare il robot in azione nel video qui sotto:

Chiedere al robot, qualcosa del tipo "Mi sono appena allenato, puoi portarmi uno spuntino sano?" lo spingerà a prendere una mela. "PaLM-SayCan [è] un approccio interpretabile e generale per sfruttare la conoscenza dei modelli linguistici che consente a un robot di seguire istruzioni testuali di alto livello per eseguire attività fisicamente radicate", ricercatori del team Brain di Google ha spiegato.

Google ha introdotto il suo più grande modello linguistico Palma ad aprile di quest'anno. PaLM è stato addestrato sui dati prelevati da Internet, ma invece di vomitare risposte di testo aperte, il sistema è stato adattato per generare un elenco di istruzioni che il robot doveva seguire.

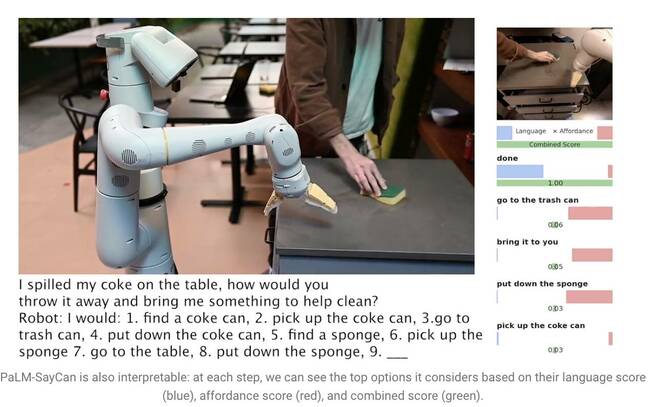

Dire "Ho rovesciato la mia Coca Cola sul tavolo, come la butti via e mi porti qualcosa per aiutare a pulire?", spinge PaLM a comprendere la domanda e a generare un elenco di passaggi che il robot può seguire per completare l'attività, come andare oltre raccogliere la lattina, gettarla in un cestino e prendere una spugna.

I modelli linguistici di grandi dimensioni (LLM) come PaLM, tuttavia, non comprendono il significato di ciò che dicono. Per questo motivo, i ricercatori hanno addestrato un modello separato utilizzando l'apprendimento per rinforzo per radicare il linguaggio astratto in rappresentazioni e azioni visive. In questo modo il robot impara ad associare la parola "Coca Cola" all'immagine di una lattina di bibita gassata.

PaLM-SayCan apprende anche le cosiddette "funzioni di convenienza", un metodo che classifica la possibilità di completare un'azione specifica data oggetti nel suo ambiente. È più probabile che il robot raccolga una spugna rispetto a un aspirapolvere, ad esempio, se rileva una spugna ma nessun aspirapolvere vicino ad essa.

"Il nostro metodo, SayCan, estrae e sfrutta le conoscenze all'interno degli LLM in attività fisicamente radicate", ha spiegato il team in un documento di ricerca. “Il LLM (Say) fornisce una base del compito per determinare le azioni utili per un obiettivo di alto livello e le funzioni di affordance appresa (Can) forniscono una base globale per determinare cosa è possibile eseguire sul piano. Usiamo l'apprendimento per rinforzo (RL) come un modo per apprendere le funzioni di valore condizionate dal linguaggio che forniscono le possibilità di ciò che è possibile nel mondo".

Per impedire al robot di deviare dall'attività, è addestrato a selezionare le azioni solo tra 101 istruzioni diverse. Google lo ha addestrato per adattarsi a una cucina: PaLM-SayCan può ottenere snack, bevande ed eseguire semplici attività di pulizia. I ricercatori ritengono che gli LLM siano il primo passo per convincere i robot a svolgere compiti più complessi in modo sicuro con istruzioni astratte.

“I nostri esperimenti su una serie di compiti robotici del mondo reale dimostrano la capacità di pianificare e completare istruzioni in linguaggio naturale, astratte e a lungo orizzonte con un alto tasso di successo. Riteniamo che l'interpretabilità di PaLM-SayCan consenta un'interazione sicura dell'utente nel mondo reale con i robot", hanno concluso. ®

- AI

- oh arte

- generatore d'arte

- un robot

- intelligenza artificiale

- certificazione di intelligenza artificiale

- intelligenza artificiale nel settore bancario

- robot di intelligenza artificiale

- robot di intelligenza artificiale

- software di intelligenza artificiale

- blockchain

- conferenza blockchain ai

- geniale

- intelligenza artificiale conversazionale

- criptoconferenza ai

- dall's

- apprendimento profondo

- google ai

- machine learning

- Platone

- platone ai

- Platone Data Intelligence

- Gioco di Platone

- PlatoneDati

- gioco di plato

- scala ai

- sintassi

- Il registro

- zefiro