I modelli linguistici di grandi dimensioni (LLM) con la loro ampia conoscenza possono generare testi simili a quelli umani su quasi tutti gli argomenti. Tuttavia, la loro formazione su enormi quantità di dati limita anche la loro utilità per compiti specializzati. Senza un apprendimento continuo, questi modelli rimangono ignari dei nuovi dati e delle tendenze che emergono dopo la loro formazione iniziale. Inoltre, il costo per la formazione di nuovi LLM può rivelarsi proibitivo per molti contesti aziendali. Tuttavia, è possibile incrociare la risposta del modello con il contenuto specializzato originale, evitando così la necessità di addestrare un nuovo modello LLM, utilizzando il Retrieval-Augmented Generation (RAG).

RAG conferisce potere ai LLM dando loro la capacità di recuperare e incorporare conoscenza esterna. Invece di fare affidamento esclusivamente sulle conoscenze pre-addestrate, RAG consente ai modelli di estrarre dati da documenti, database e altro ancora. Il modello quindi integra abilmente queste informazioni esterne nel testo generato. Recuperando dati rilevanti per il contesto, il modello può fornire risposte informate e aggiornate su misura per il tuo caso d'uso. L'aumento della conoscenza riduce anche la probabilità di allucinazioni e testi imprecisi o privi di senso. Con RAG, i modelli di base diventano esperti adattabili che si evolvono man mano che la tua base di conoscenza cresce.

Oggi siamo entusiasti di svelare tre demo di intelligenza artificiale generativa, concesse in licenza con Licenza MIT-0:

- Amazon Kendra con LLM fondamentale – Utilizza le funzionalità di ricerca approfondita di Amazon Kendra combinato con la vasta conoscenza dei LLM. Questa integrazione fornisce risposte precise e sensibili al contesto a domande complesse attingendo da una vasta gamma di fonti.

- Modello di incorporamenti con LLM fondamentale – Unisce il potere degli incorporamenti, una tecnica per catturare significati semantici di parole e frasi, con la vasta base di conoscenza dei LLM. Questa sinergia consente una modellazione degli argomenti, una raccomandazione dei contenuti e funzionalità di ricerca semantica più accurati.

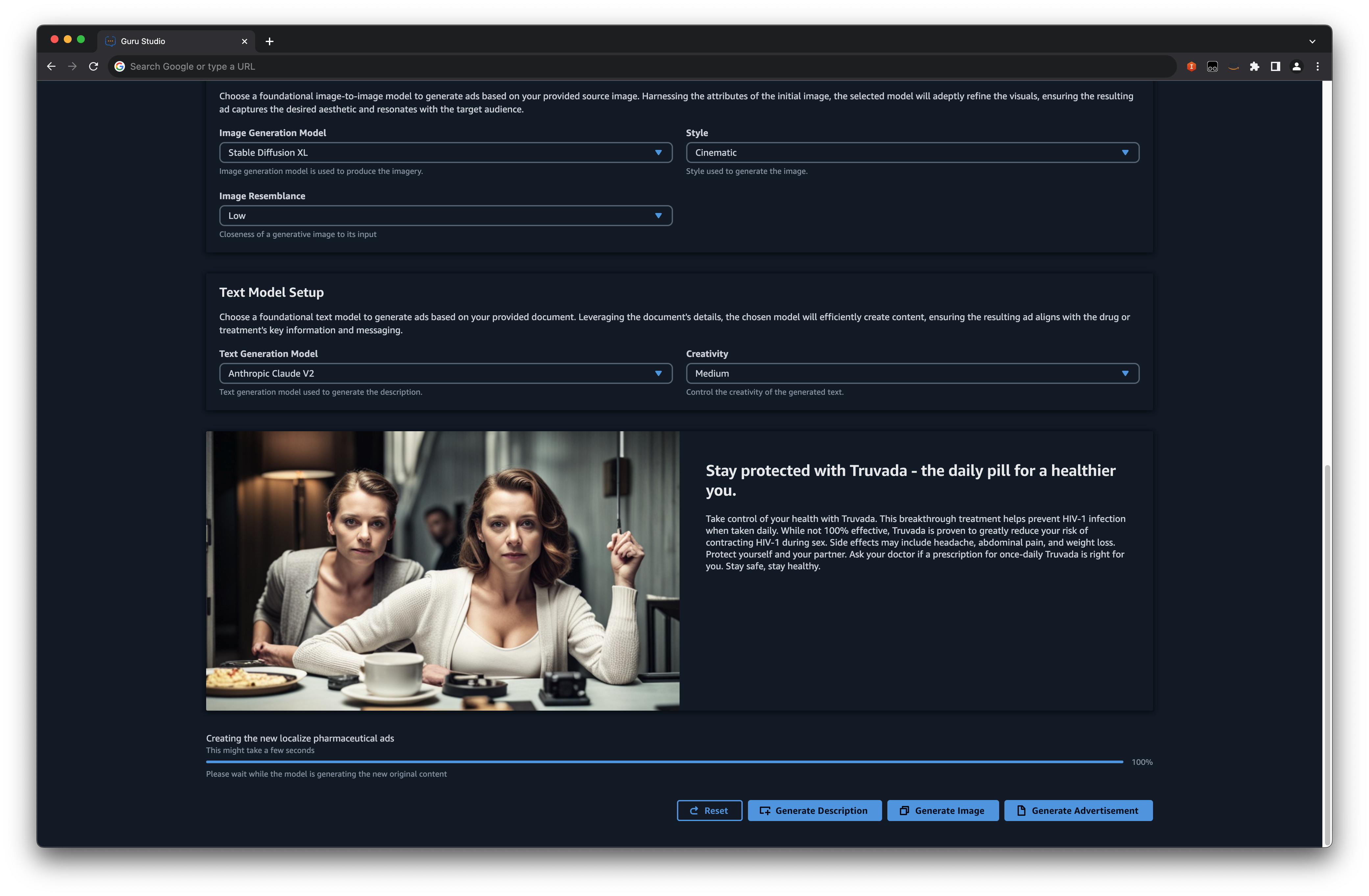

- Generatore di annunci farmaceutici di Foundation Models – Un'applicazione specializzata su misura per l'industria farmaceutica. Sfruttando le capacità generative dei modelli fondamentali, questo strumento crea pubblicità farmaceutiche convincenti e conformi, garantendo che i contenuti aderiscano agli standard e alle normative del settore.

Queste demo possono essere distribuite senza problemi nel tuo account AWS, offrendo approfondimenti fondamentali e indicazioni sull'utilizzo dei servizi AWS per creare domande di intelligenza artificiale generativa LLM all'avanguardia e rispondere a bot e generazione di contenuti.

In questo post esploriamo come RAG combinato con Amazon Kendra o gli incorporamenti personalizzati possono superare queste sfide e fornire risposte raffinate alle query in linguaggio naturale.

Panoramica della soluzione

Adottando questa soluzione è possibile ottenere i seguenti vantaggi:

- Migliore accesso alle informazioni – RAG consente ai modelli di estrarre informazioni da vaste fonti esterne, il che può essere particolarmente utile quando la conoscenza del modello pre-addestrato è obsoleta o incompleta.

- Scalabilità – Invece di addestrare un modello su tutti i dati disponibili, RAG consente ai modelli di recuperare le informazioni rilevanti al volo. Ciò significa che non appena diventano disponibili nuovi dati, è possibile aggiungerli al database di recupero senza dover riqualificare l'intero modello.

- Efficienza della memoria – Gli LLM richiedono una memoria significativa per archiviare i parametri. Con RAG il modello può essere più piccolo perché non è necessario memorizzare tutti i dettagli; può recuperarli quando necessario.

- Aggiornamento dinamico delle conoscenze – A differenza dei modelli convenzionali con un endpoint di conoscenza prestabilito, il database esterno di RAG può essere sottoposto ad aggiornamenti regolari, garantendo al modello l’accesso a informazioni aggiornate. La funzione di recupero può essere ottimizzata per attività distinte. Ad esempio, un'attività di diagnostica medica può reperire dati da riviste mediche, garantendo che il modello raccolga approfondimenti esperti e pertinenti.

- Attenuazione del bias – La capacità di attingere da un database ben curato offre il potenziale per ridurre al minimo i pregiudizi garantendo fonti esterne equilibrate e imparziali.

Prima di immergersi nell'integrazione di Amazon Kendra con i LLM di base, è fondamentale dotarsi degli strumenti e dei requisiti di sistema necessari. Avere la giusta configurazione è il primo passo verso una distribuzione senza interruzioni delle demo.

Prerequisiti

Devi avere i seguenti prerequisiti:

Sebbene sia possibile configurare e distribuire l'infrastruttura descritta in questo tutorial dal tuo computer locale, AWS Cloud9 offre una comoda alternativa. Pre-equipaggiato con strumenti come AWS CLI, AWS CDK e Docker, AWS Cloud9 può funzionare come workstation di distribuzione. Per utilizzare questo servizio, semplicemente impostare l'ambiente tramite Console AWS Cloud9.

Una volta eliminati i prerequisiti, approfondiamo le caratteristiche e le capacità di Amazon Kendra con i LLM di base.

Amazon Kendra con LLM fondamentale

Amazon Kendra è un servizio di ricerca aziendale avanzato potenziato dal machine learning (ML) che fornisce funzionalità di ricerca semantica pronte all'uso. Utilizzando l'elaborazione del linguaggio naturale (NLP), Amazon Kendra comprende sia il contenuto dei documenti che l'intento sottostante delle query degli utenti, posizionandolo come strumento di recupero dei contenuti per soluzioni basate su RAG. Utilizzando il contenuto di ricerca ad alta precisione di Kendra come payload RAG, puoi ottenere risposte LLM migliori. L'utilizzo di Amazon Kendra in questa soluzione consente inoltre la ricerca personalizzata filtrando le risposte in base alle autorizzazioni di accesso ai contenuti dell'utente finale.

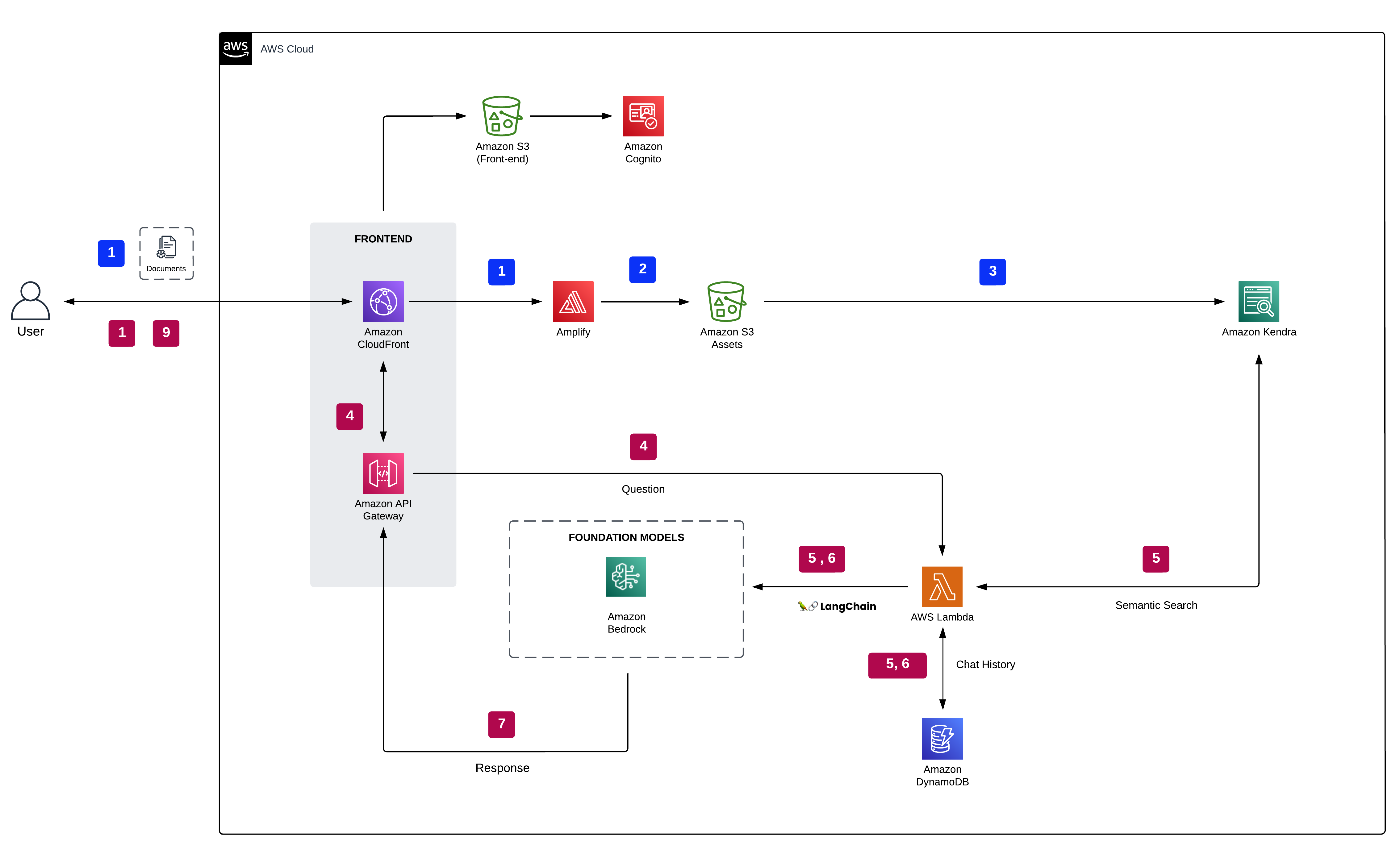

Il diagramma seguente mostra l'architettura di un'applicazione di intelligenza artificiale generativa utilizzando l'approccio RAG.

I documenti vengono elaborati e indicizzati da Amazon Kendra tramite il file Servizio di archiviazione semplice Amazon (Amazon S3) connettore. Le richieste dei clienti e i dati contestuali di Amazon Kendra sono indirizzati a un Roccia Amazzonica modello di fondazione. La demo ti consente di scegliere tra i modelli Titan di Amazon, Jurassic di AI21 e Claude di Anthropic supportati da Amazon Bedrock. La cronologia delle conversazioni viene salvata in Amazon DynamoDB, offrendo un contesto aggiuntivo affinché il LLM possa generare risposte.

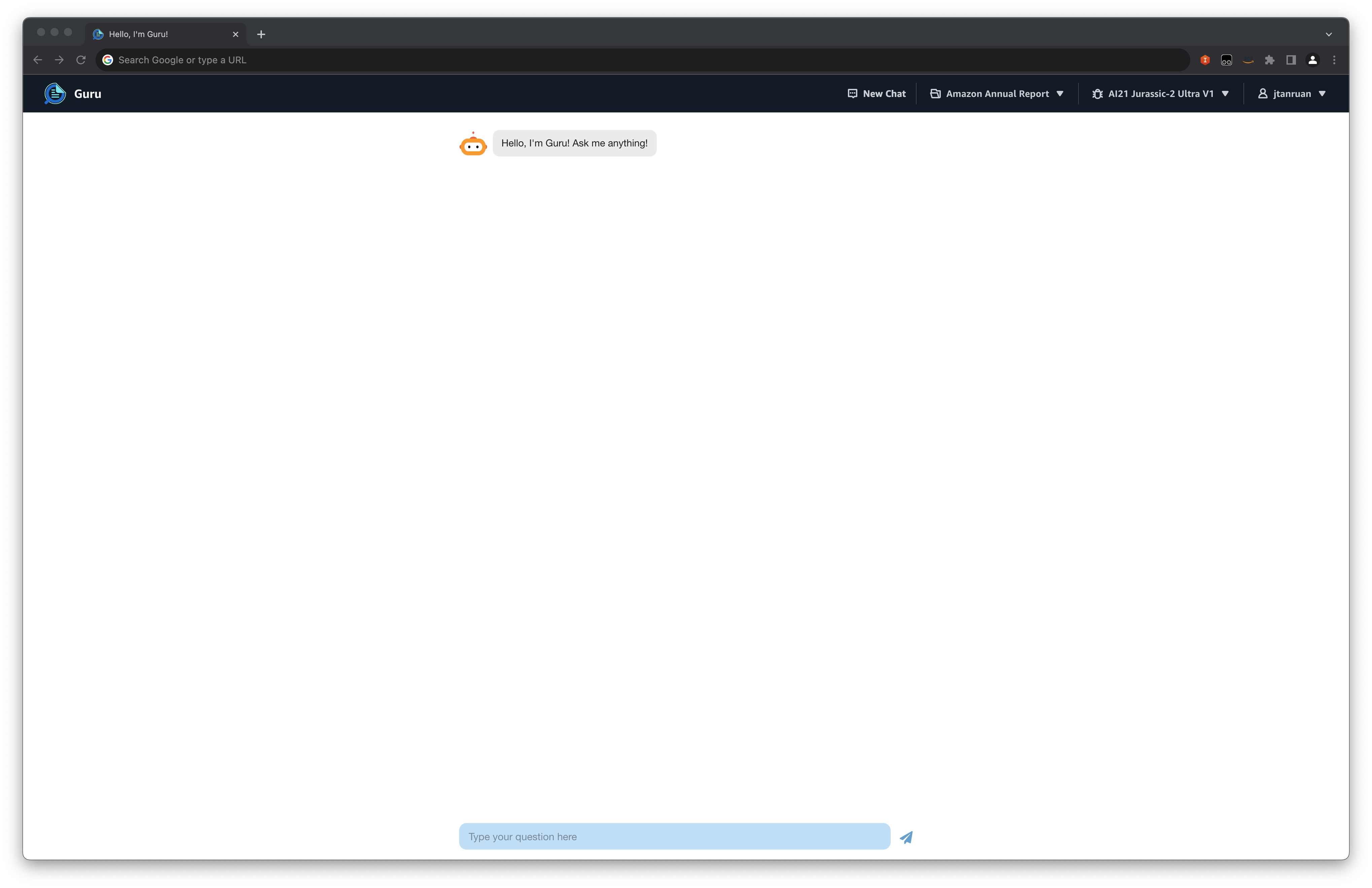

Abbiamo fornito questa demo nel file Repository GitHub. Fai riferimento alle istruzioni di distribuzione all'interno del file Leggimi per distribuirlo nel tuo account AWS.

I passaggi seguenti descrivono il processo in cui un utente interagisce con l'app di intelligenza artificiale generativa:

- L'utente accede all'app Web autenticato da Amazzonia Cognito.

- L'utente carica uno o più documenti in Amazon S3.

- L'utente esegue un processo di sincronizzazione Amazon Kendra per importare documenti S3 nell'indice Amazon Kendra.

- La domanda dell'utente viene instradata tramite un'API WebSocket sicura ospitata su Gateway API Amazon supportato da a AWS Lambda funzione.

- La funzione Lambda, potenziata dal LangChain framework, uno strumento versatile progettato per creare applicazioni guidate da modelli linguistici di intelligenza artificiale, si connette all'endpoint Amazon Bedrock per riformulare la domanda dell'utente in base alla cronologia della chat. Dopo la riformulazione, la domanda viene inoltrata ad Amazon Kendra utilizzando l'API Retrieve. In risposta, l’indice Amazon Kendra mostra i risultati della ricerca, fornendo estratti di documenti pertinenti provenienti dai dati acquisiti dall’azienda.

- La domanda dell'utente insieme ai dati recuperati dall'indice vengono inviati come contesto nel prompt LLM. La risposta da LLM viene archiviata come cronologia chat all'interno di DynamoDB.

- Infine, la risposta dell'LLM viene inviata all'utente.

Flusso di lavoro di indicizzazione dei documenti

Di seguito la procedura per l'elaborazione e l'indicizzazione dei documenti:

- Gli utenti inviano documenti tramite l'interfaccia utente (UI).

- I documenti vengono trasferiti in un bucket S3 utilizzando il file AWS Amplifica API.

- Amazon Kendra indicizza i nuovi documenti nel bucket S3 tramite il connettore Amazon Kendra S3.

Benefici

L'elenco seguente evidenzia i vantaggi di questa soluzione:

- Recupero a livello aziendale – Amazon Kendra è progettato per la ricerca aziendale, rendendolo adatto alle organizzazioni con grandi quantità di dati strutturati e non strutturati.

- Comprensione semantica – Le funzionalità ML di Amazon Kendra garantiscono che il recupero sia basato su una profonda comprensione semantica e non solo sulle corrispondenze di parole chiave.

- Scalabilità – Amazon Kendra è in grado di gestire origini dati su larga scala e fornisce risultati di ricerca rapidi e pertinenti.

- Flessibilità – Il modello fondazionale può generare risposte basate su un’ampia gamma di contesti, garantendo che il sistema rimanga versatile.

- Capacità di integrazione – Amazon Kendra può essere integrato con vari servizi AWS e origini dati, rendendolo adattabile alle diverse esigenze organizzative.

Modello di incorporamenti con LLM fondamentale

An incorporamento è un vettore numerico che rappresenta l'essenza principale di diversi tipi di dati, inclusi testo, immagini, audio e documenti. Questa rappresentazione non solo cattura il significato intrinseco dei dati, ma lo adatta anche a un’ampia gamma di applicazioni pratiche. I modelli di incorporamento, un ramo del ML, trasformano dati complessi, come parole o frasi, in spazi vettoriali continui. Questi vettori colgono intrinsecamente le connessioni semantiche tra i dati, consentendo confronti più profondi e approfonditi.

RAG combina perfettamente i punti di forza dei modelli fondamentali, come i trasformatori, con la precisione degli incorporamenti per vagliare vasti database alla ricerca di informazioni pertinenti. Dopo aver ricevuto una query, il sistema utilizza gli incorporamenti per identificare ed estrarre sezioni rilevanti da un ampio corpo di dati. Il modello fondazionale formula quindi una risposta contestualmente precisa basata su queste informazioni estratte. Questa perfetta sinergia tra il recupero dei dati e la generazione di risposte consente al sistema di fornire risposte approfondite, attingendo alla vasta conoscenza archiviata in ampi database.

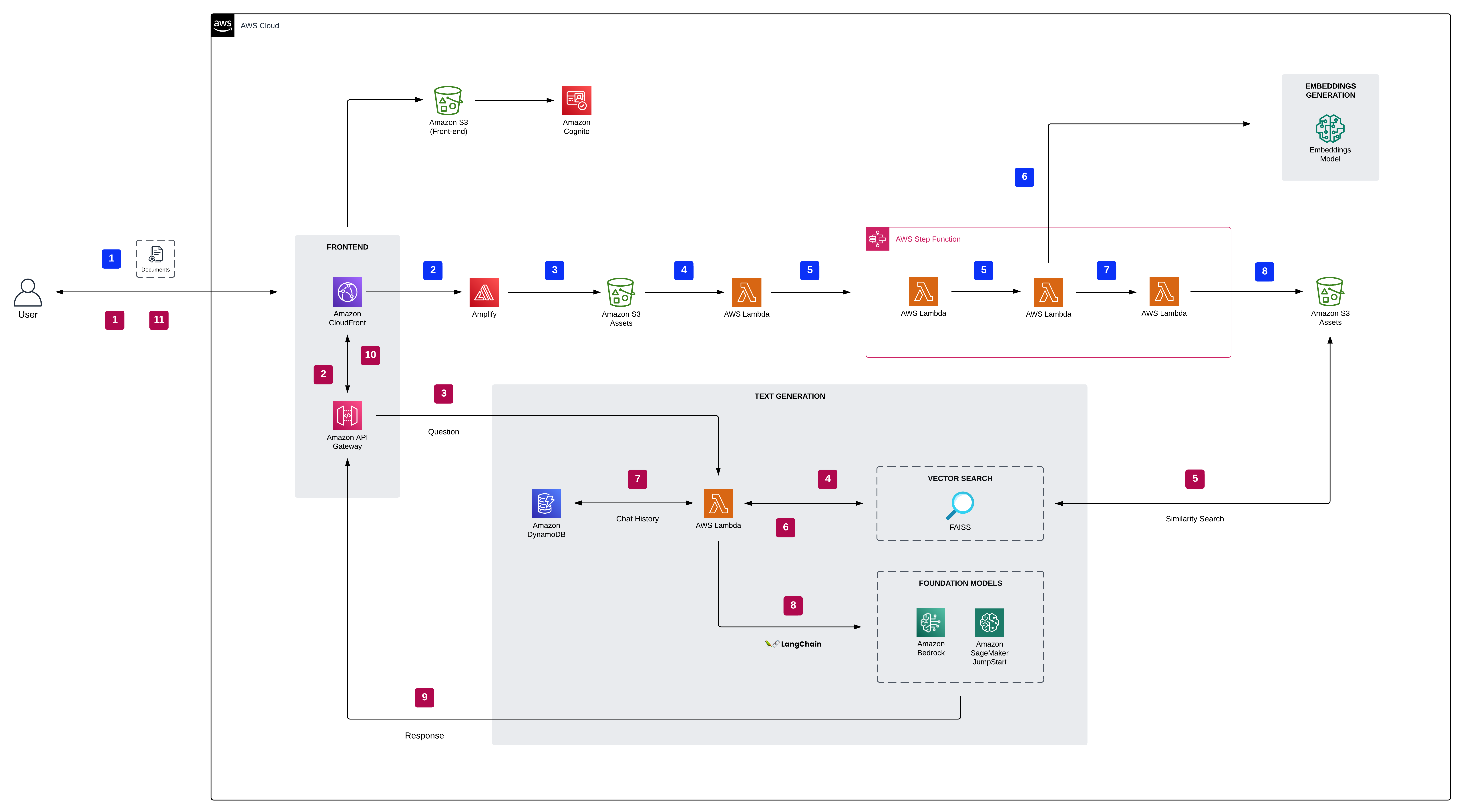

Nel layout architettonico, in base alla selezione dell'interfaccia utente, gli utenti vengono guidati ad Amazon Bedrock o JumpStart di Amazon SageMaker modelli di fondazione. I documenti vengono sottoposti a elaborazione e gli incorporamenti vettoriali vengono prodotti dal modello di incorporamenti. Questi incorporamenti vengono quindi indicizzati utilizzando FAISS per consentire una ricerca semantica efficiente. Le cronologie delle conversazioni vengono conservate in DynamoDB, arricchendo il contesto affinché LLM possa creare risposte.

Il diagramma seguente illustra l'architettura della soluzione e il flusso di lavoro.

Abbiamo fornito questa demo nel file Repository GitHub. Fai riferimento alle istruzioni di distribuzione all'interno del file Leggimi per distribuirlo nel tuo account AWS.

Modello degli incastri

Le responsabilità del modello di incorporamento sono le seguenti:

- Questo modello è responsabile della conversione del testo (come documenti o passaggi) in rappresentazioni vettoriali dense, comunemente note come incorporamenti.

- Questi incorporamenti catturano il significato semantico del testo, consentendo confronti efficienti e semanticamente significativi tra diverse parti di testo.

- Il modello di incorporamento può essere addestrato sullo stesso vasto corpus del modello fondamentale o può essere specializzato per domini specifici.

Flusso di lavoro di domande e risposte

I seguenti passaggi descrivono il flusso di lavoro della risposta alle domande sui documenti:

- L'utente accede all'app Web autenticata da Amazon Cognito.

- L'utente carica uno o più documenti su Amazon S3.

- Al momento del trasferimento del documento, una notifica di evento S3 attiva una funzione Lambda, che quindi chiama l'endpoint del modello di incorporamento SageMaker per generare incorporamenti per il nuovo documento. Il modello degli embedding converte la domanda in una rappresentazione vettoriale densa (embedding). Il file vettoriale risultante viene archiviato in modo sicuro nel bucket S3.

- Il recuperatore FAISS confronta questa domanda di incorporamento con gli incorporamenti di tutti i documenti o passaggi nel database per trovare i passaggi più rilevanti.

- I passaggi, insieme alla domanda dell'utente, vengono forniti come contesto al modello fondamentale. La funzione Lambda utilizza la libreria LangChain e si connette all'endpoint Amazon Bedrock o SageMaker JumpStart con una query ricca di contesto.

- La risposta da LLM viene archiviata in DynamoDB insieme alla query dell'utente, al timestamp, a un identificatore univoco e ad altri identificatori arbitrari per l'elemento come la categoria della domanda. La memorizzazione della domanda e della risposta come elementi distinti consente alla funzione Lambda di ricreare facilmente la cronologia delle conversazioni di un utente in base al momento in cui sono state poste le domande.

- Infine, la risposta viene inviata all'utente tramite una richiesta HTTP tramite la risposta di integrazione API WebSocket di API Gateway.

Benefici

L'elenco seguente descrive i vantaggi di questa soluzione:

- Comprensione semantica – Il modello di incorporamento garantisce che il retriever selezioni i passaggi in base a una profonda comprensione semantica, non solo alle corrispondenze di parole chiave.

- Scalabilità – Gli incorporamenti consentono efficienti confronti di somiglianza, rendendo possibile la ricerca rapida in vasti database di documenti.

- Flessibilità – Il modello fondazionale può generare risposte basate su un’ampia gamma di contesti, garantendo che il sistema rimanga versatile.

- Adattabilità del dominio – Il modello di incorporamento può essere addestrato o messo a punto per domini specifici, consentendo al sistema di essere adattato a varie applicazioni.

Generatore di annunci farmaceutici di Foundation Models

Nel frenetico settore farmaceutico di oggi, una pubblicità efficiente e localizzata è più cruciale che mai. È qui che entra in gioco una soluzione innovativa, che sfrutta la potenza dell’intelligenza artificiale generativa per creare annunci farmaceutici localizzati da immagini e PDF originali. Oltre a velocizzare semplicemente il processo di generazione degli annunci, questo approccio semplifica il processo di revisione legale medica (MLR). MLR è un meccanismo di revisione rigoroso in cui team medici, legali e normativi valutano meticolosamente i materiali promozionali per garantirne l'accuratezza, il supporto scientifico e la conformità normativa. I metodi tradizionali di creazione dei contenuti possono essere complicati e spesso richiedono aggiustamenti manuali e revisioni approfondite per garantire l’allineamento con la conformità e la pertinenza regionale. Tuttavia, con l’avvento dell’intelligenza artificiale generativa, ora possiamo automatizzare la creazione di annunci che siano realmente in sintonia con il pubblico locale, il tutto rispettando standard e linee guida rigorosi.

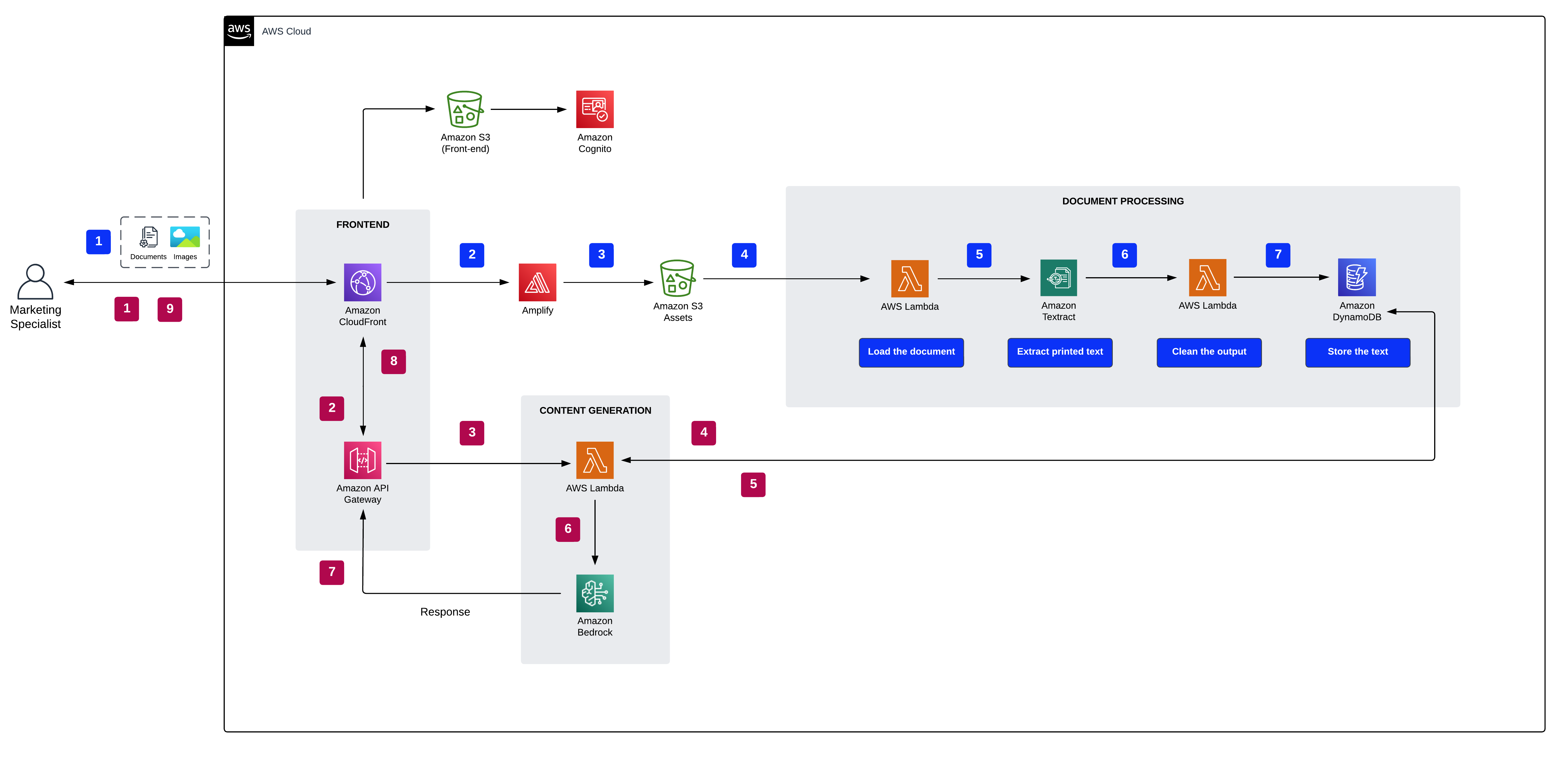

Il diagramma seguente illustra l'architettura della soluzione.

Nel layout architettonico, in base al modello selezionato e alle preferenze degli annunci, gli utenti vengono guidati senza problemi ai modelli di fondazione Amazon Bedrock. Questo approccio semplificato garantisce che i nuovi annunci vengano generati esattamente in base alla configurazione desiderata. Come parte del processo, i documenti vengono gestiti in modo efficiente da Testo Amazon, con il testo risultante archiviato in modo sicuro in DynamoDB. Una caratteristica distintiva è il design modulare per la generazione di immagini e testo, che garantisce la flessibilità di rigenerare in modo indipendente qualsiasi componente secondo necessità.

Abbiamo fornito questa demo nel file Repository GitHub. Fai riferimento alle istruzioni di distribuzione all'interno del file Leggimi per distribuirlo nel tuo account AWS.

Flusso di lavoro per la generazione di contenuti

I seguenti passaggi descrivono il processo di generazione del contenuto:

- L'utente sceglie il documento, l'immagine di origine, il posizionamento dell'annuncio, la lingua e lo stile dell'immagine.

- L'accesso sicuro all'applicazione web è garantito tramite l'autenticazione di Amazon Cognito.

- Il front-end dell'applicazione web è ospitato tramite Amplify.

- Un'API WebSocket, gestita da API Gateway, facilita le richieste degli utenti. Queste richieste vengono autenticate tramite Gestione dell'identità e dell'accesso di AWS (SONO).

- L'integrazione con Amazon Bedrock include i seguenti passaggi:

- Una funzione Lambda utilizza la libreria LangChain per connettersi all'endpoint Amazon Bedrock utilizzando una query ricca di contesto.

- Il modello fondamentale da testo a testo crea un annuncio contestualmente appropriato in base al contesto e alle impostazioni forniti.

- Il modello fondamentale da testo a immagine crea un'immagine su misura, influenzata dall'immagine sorgente, dallo stile scelto e dalla posizione.

- L'utente riceve la risposta tramite una richiesta HTTPS tramite l'API WebSocket API Gateway integrata.

Flusso di lavoro per l'elaborazione di documenti e immagini

Di seguito la procedura per l'elaborazione di documenti e immagini:

- L'utente carica le risorse tramite l'interfaccia utente specificata.

- L'API Amplify trasferisce i documenti a un bucket S3.

- Dopo che la risorsa è stata trasferita su Amazon S3, viene eseguita una delle seguenti azioni:

- Se si tratta di un documento, una funzione Lambda utilizza Amazon Textract per elaborare ed estrarre il testo per la generazione di annunci.

- Se si tratta di un'immagine, la funzione Lambda la converte nel formato base64, adatto al modello Diffusione Stabile per creare una nuova immagine dalla sorgente.

- Il testo estratto o la stringa immagine base64 vengono salvati in modo sicuro in DynamoDB.

Benefici

L'elenco seguente descrive i vantaggi di questa soluzione:

- EFFICIENZA – L’uso dell’intelligenza artificiale generativa accelera significativamente il processo di generazione degli annunci, eliminando la necessità di aggiustamenti manuali.

- Aderenza alla conformità – La soluzione garantisce che gli annunci generati rispettino linee guida e normative specifiche, come le linee guida della FDA per il marketing.

- Economicamente vantaggioso – Automatizzando la creazione di annunci personalizzati, le aziende possono ridurre significativamente i costi associati alla produzione e alle revisioni degli annunci.

- Processo MLR semplificato – La soluzione semplifica il processo MLR, riducendo i punti di attrito e garantendo revisioni più fluide.

- Risonanza localizzata – L’intelligenza artificiale generativa produce annunci che hanno risonanza con il pubblico locale, garantendo rilevanza e impatto in diverse regioni.

- Standardizzazione – La soluzione mantiene gli standard e le linee guida necessari, garantendo la coerenza tra tutti gli annunci generati.

- Scalabilità – L’approccio basato sull’intelligenza artificiale può gestire vasti database di immagini sorgente e PDF, rendendolo fattibile per la generazione di annunci su larga scala.

- Ridotto intervento manuale – L’automazione riduce la necessità di intervento umano, minimizzando gli errori e garantendo coerenza.

Puoi distribuire l'infrastruttura in questo tutorial dal tuo computer locale oppure puoi utilizzare AWS Cloud9 come workstation di distribuzione. AWS Cloud9 viene fornito precaricato con AWS CLI, AWS CDK e Docker. Se opti per AWS Cloud9, creare l'ambiente dal Console AWS Cloud9.

ripulire

Per evitare costi inutili, ripulisci tutta l'infrastruttura creata tramite la console AWS CloudFormation o eseguendo il seguente comando sulla tua workstation:

Inoltre, ricorda di arrestare qualsiasi endpoint SageMaker avviato tramite la console SageMaker. Ricorda, l'eliminazione di un indice Amazon Kendra non rimuove i documenti originali dal tuo spazio di archiviazione.

Conclusione

L’intelligenza artificiale generativa, incarnata dagli LLM, annuncia un cambiamento di paradigma nel modo in cui accediamo e generiamo informazioni. Questi modelli, sebbene potenti, sono spesso limitati dai confini dei dati di addestramento. RAG affronta questa sfida, garantendo che la vasta conoscenza di questi modelli sia costantemente arricchita con approfondimenti pertinenti e attuali.

Le nostre demo basate su RAG ne forniscono una testimonianza tangibile. Mostrano la perfetta sinergia tra Amazon Kendra, incorporamenti di vettori e LLM, creando un sistema in cui le informazioni non sono solo vaste ma anche accurate e tempestive. Mentre ti immergi in queste demo, esplorerai in prima persona il potenziale di trasformazione derivante dall'unione di conoscenze pre-addestrate con le capacità dinamiche di RAG, ottenendo risultati affidabili e personalizzati per i contenuti aziendali.

Sebbene l’intelligenza artificiale generativa basata sugli LLM apra un nuovo modo di ottenere informazioni approfondite, queste informazioni devono essere affidabili e limitate ai contenuti aziendali utilizzando l’approccio RAG. Queste demo basate su RAG ti consentono di disporre di approfondimenti accurati e aggiornati. La qualità di queste informazioni dipende dalla pertinenza semantica, che è abilitata utilizzando Amazon Kendra e gli incorporamenti di vettori.

Se sei pronto per esplorare ulteriormente e sfruttare la potenza dell'intelligenza artificiale generativa, ecco i prossimi passi:

- Interagisci con le nostre demo – L’esperienza pratica è preziosa. Esplora le funzionalità, comprendi le integrazioni e familiarizza con l'interfaccia.

- Approfondisci la tua conoscenza – Sfruttare le risorse disponibili. AWS offre documentazione approfondita, tutorial e supporto della community per aiutarti nel tuo percorso verso l'intelligenza artificiale.

- Avviare un progetto pilota – Prendi in considerazione l’idea di iniziare con un’implementazione su piccola scala dell’intelligenza artificiale generativa nella tua azienda. Ciò fornirà informazioni sulla praticità e sull’adattabilità del sistema nel tuo contesto specifico.

Per ulteriori informazioni sulle applicazioni di intelligenza artificiale generativa su AWS, fare riferimento a quanto segue:

Ricorda, il panorama dell’intelligenza artificiale è in continua evoluzione. Rimani aggiornato, resta curioso e sii sempre pronto ad adattarti e innovare.

Riguardo agli Autori

Jin Tan Ruan è uno sviluppatore di prototipi all'interno del team PACE (AWS Industries Prototyping and Customer Engineering), specializzato in PNL e intelligenza artificiale generativa. Con un background nello sviluppo di software e nove certificazioni AWS, Jin apporta una vasta esperienza per assistere i clienti AWS nel concretizzare le loro visioni di IA/ML e IA generativa utilizzando la piattaforma AWS. Ha conseguito un master in Informatica e ingegneria del software presso l'Università di Syracuse. Fuori dal lavoro, Jin ama giocare ai videogiochi e immergersi nell'emozionante mondo dei film horror.

Jin Tan Ruan è uno sviluppatore di prototipi all'interno del team PACE (AWS Industries Prototyping and Customer Engineering), specializzato in PNL e intelligenza artificiale generativa. Con un background nello sviluppo di software e nove certificazioni AWS, Jin apporta una vasta esperienza per assistere i clienti AWS nel concretizzare le loro visioni di IA/ML e IA generativa utilizzando la piattaforma AWS. Ha conseguito un master in Informatica e ingegneria del software presso l'Università di Syracuse. Fuori dal lavoro, Jin ama giocare ai videogiochi e immergersi nell'emozionante mondo dei film horror.

Aravind Kodandaramaiah è uno sviluppatore di soluzioni full stack di prototipazione senior all'interno del team PACE (AWS Industries Prototyping and Customer Engineering). Il suo obiettivo è aiutare i clienti AWS a trasformare idee innovative in soluzioni con risultati misurabili e piacevoli. È appassionato di una vasta gamma di argomenti, tra cui sicurezza cloud, DevOps e AI/ML, e di solito lo si trova ad armeggiare con queste tecnologie.

Aravind Kodandaramaiah è uno sviluppatore di soluzioni full stack di prototipazione senior all'interno del team PACE (AWS Industries Prototyping and Customer Engineering). Il suo obiettivo è aiutare i clienti AWS a trasformare idee innovative in soluzioni con risultati misurabili e piacevoli. È appassionato di una vasta gamma di argomenti, tra cui sicurezza cloud, DevOps e AI/ML, e di solito lo si trova ad armeggiare con queste tecnologie.

Arjun Shakdher è uno sviluppatore del team AWS Industries Prototyping (PACE) con la passione di fondere la tecnologia nel tessuto della vita. Con un master presso la Purdue University, il ruolo attuale di Arjun ruota attorno all'architettura e alla costruzione di prototipi all'avanguardia che abbracciano una vasta gamma di domini, attualmente in primo piano quelli dell'intelligenza artificiale/ML e dell'IoT. Quando non sei immerso nel codice e nei paesaggi digitali, troverai Arjun che si abbandona al mondo del caffè, esplora gli intricati meccanismi dell'orologeria o si diletta nell'arte delle automobili.

Arjun Shakdher è uno sviluppatore del team AWS Industries Prototyping (PACE) con la passione di fondere la tecnologia nel tessuto della vita. Con un master presso la Purdue University, il ruolo attuale di Arjun ruota attorno all'architettura e alla costruzione di prototipi all'avanguardia che abbracciano una vasta gamma di domini, attualmente in primo piano quelli dell'intelligenza artificiale/ML e dell'IoT. Quando non sei immerso nel codice e nei paesaggi digitali, troverai Arjun che si abbandona al mondo del caffè, esplora gli intricati meccanismi dell'orologeria o si diletta nell'arte delle automobili.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :È

- :non

- :Dove

- $ SU

- 100

- 150

- 7

- a

- capacità

- WRI

- accelera

- accesso

- Secondo

- Il mio account

- precisione

- preciso

- operanti in

- azioni

- Ad

- adattare

- adatta

- aggiunto

- indirizzi

- aderire

- regolazioni

- Adottando

- Ads - Annunci

- Avanzate

- Vantaggio

- vantaggi

- Avvento

- Pubblicità

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- AI / ML

- aiuto

- allineamento

- Tutti

- consentire

- Consentire

- consente

- quasi

- lungo

- anche

- alternativa

- sempre

- Amazon

- Amazzonia Cognito

- Amazon Kendra

- Testo Amazon

- Amazon Web Services

- importi

- amplificare

- an

- ed

- rispondere

- risposte

- in qualsiasi

- api

- App

- Applicazioni

- applicazioni

- approccio

- opportuno

- architettonico

- architettura

- SONO

- in giro

- Italia

- abilità artistica

- AS

- attività

- Attività

- assistere

- associato

- udienze

- Audio

- autenticato

- Autenticazione

- automatizzare

- Automatizzare

- Automazione

- disponibile

- evitare

- evitando

- AWS

- AWS Cloud9

- AWS CloudFormazione

- precedente

- Backed

- sfondo

- sostegno

- base

- basato

- BE

- perché

- diventare

- diventa

- vantaggi

- Meglio

- fra

- Al di là di

- pregiudizi

- mescolanza

- stile di vita

- Bot

- entrambi

- Branch di società

- Porta

- ampio

- costruttore

- Costruzione

- ma

- by

- Bandi

- Materiale

- Può ottenere

- funzionalità

- catturare

- cattura

- Custodie

- Categoria

- certificazioni

- Challenge

- sfide

- Scegli

- scelto

- cavedano

- Cloud

- Cloud Security

- Cloud9

- codice

- Caffè

- combinato

- combina

- viene

- comunemente

- comunità

- Aziende

- confronto

- complesso

- conformità

- compiacente

- componente

- comprende

- computer

- Informatica

- Configurazione

- Connettiti

- Connessioni

- collega

- Prendere in considerazione

- costantemente

- consolle

- costantemente

- contenuto

- Generazione di contenuti

- creazione di contenuti

- contesto

- contesti

- contestuale

- continua

- continuo

- Comodo

- convenzionale

- Conversazione

- conversione

- Nucleo

- Costo

- Costi

- artigianali

- creare

- creato

- crea

- Creazione

- creazione

- cruciale

- ingombrante

- curioso

- Corrente

- costume

- cliente

- Clienti

- bordo tagliente

- dati

- Banca Dati

- banche dati

- dataset

- Data

- deep

- più profondo

- Laurea

- delizioso

- dimostrazione

- Demos

- dipendente

- schierare

- schierato

- distribuzione

- deployment

- descrivere

- Design

- progettato

- desiderato

- distruggere

- dettagliati

- dettagli

- Costruttori

- Mercato

- diagnostica

- diverso

- Emittente

- digitale

- indirizzato

- display

- distinto

- immersione

- paesaggio differenziato

- immersione

- docker

- documento

- documentazione

- documenti

- non

- domini

- disegnare

- disegno

- spinto

- dinamico

- facilmente

- efficienza

- efficiente

- in modo efficiente

- o

- eliminando

- incorporamento

- emergere

- impiega

- il potere

- Potenzia

- enable

- abilitato

- Abilita

- consentendo

- fine

- endpoint

- Ingegneria

- migliorata

- arricchendo

- garantire

- assicurato

- assicura

- assicurando

- Impresa

- Intero

- attrezzato

- errori

- particolarmente

- essenza

- valutare

- Evento

- EVER

- evolvere

- evoluzione

- esempio

- eccitato

- espansivo

- esperienza

- esperto

- esperti

- esplora

- Esplorare

- estensivo

- esterno

- estratto

- tessuto

- facilita

- familiarizzare

- fast-paced

- FB

- fattibile

- caratteristica

- Caratteristiche

- Grazie

- Compila il

- filtraggio

- Trovate

- Nome

- Flessibilità

- si concentra

- i seguenti

- segue

- Nel

- formato

- essere trovato

- Fondazione

- attrito

- da

- anteriore

- Fine frontale

- pieno

- Stack completo

- function

- funzionalità

- ulteriormente

- Inoltre

- Guadagno

- guadagnando

- Giochi

- porta

- generare

- generato

- ELETTRICA

- generativo

- AI generativa

- generatore

- ottenere

- dato

- Dare

- rilascio

- afferrala

- cresce

- di garanzia

- guida

- guidata

- linee guida

- maniglia

- mani su

- cintura da arrampicata

- Sfruttamento

- Avere

- avendo

- he

- aiutare

- araldi

- qui

- evidenzia

- lui stesso

- storie

- storia

- possesso

- detiene

- orrore

- ospitato

- Come

- Tuttavia

- HTML

- http

- HTTPS

- umano

- idee

- identificatore

- identificatori

- identificare

- Identità

- if

- illustra

- Immagine

- immagini

- immersa

- Impact

- implementazione

- in

- Uno sguardo approfondito sui miglioramenti dei pneumatici da corsa di Bridgestone.

- impreciso

- inclusi

- Compreso

- incorporare

- indipendentemente

- Index

- indicizzati

- indici

- industrie

- industria

- standard di settore

- influenzato

- informazioni

- informati

- Infrastruttura

- intrinsecamente

- inizialmente

- avviato

- innovare

- creativi e originali

- perspicace

- intuizioni

- invece

- istruzioni

- integrato

- Integra

- integrazione

- integrazioni

- intento

- interagisce

- Interfaccia

- intervento

- ai miglioramenti

- intrinseco

- inestimabile

- IoT

- IT

- elementi

- SUO

- Lavoro

- viaggio

- jpg

- ad appena

- conoscenze

- conosciuto

- paesaggio

- Lingua

- grandi

- larga scala

- disposizione

- apprendimento

- Legale

- Consente di

- Biblioteca

- Autorizzato

- Vita

- piace

- probabilità

- Limitato

- limiti

- Lista

- LLM

- locale

- località

- macchina

- machine learning

- mantiene

- Fare

- gestito

- Manuale

- molti

- Marketing

- massiccio

- master

- fiammiferi

- Materiale

- significato

- significativo

- significati

- si intende

- meccanica

- meccanismo

- medicale

- Memorie

- semplicemente

- unioni

- fusione

- metodi

- meticolosamente

- minimizzando

- attenuazione

- ML

- modello

- modellismo

- modelli

- componibile

- Scopri di più

- maggior parte

- Film

- devono obbligatoriamente:

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- Bisogno

- di applicazione

- che necessitano di

- esigenze

- New

- GENERAZIONE

- nove

- nlp

- notifica

- adesso

- of

- offerta

- Offerte

- di frequente

- on

- ONE

- esclusivamente

- apre

- or

- organizzativa

- organizzazioni

- i

- Altro

- nostro

- su

- risultati

- contorno

- uscite

- al di fuori

- ancora

- Superare

- Pace

- paradigma

- parametri

- parte

- appassionato

- perfetta

- permessi

- Personalizzata

- Pharma

- Pharmaceutical

- Frasi

- pezzi

- pilota

- progetto pilota

- posto

- collocamento

- piattaforma

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- gioco

- punti

- posizionamento

- possibile

- Post

- potenziale

- energia

- alimentato

- potente

- Pratico

- bisogno

- precisamente

- Precisione

- preferenze

- prerequisiti

- attualmente

- procedura

- processi

- Elaborato

- lavorazione

- Prodotto

- produce

- Produzione

- progetto

- promozionale

- prototipi

- prototipazione

- Dimostra

- fornire

- purché

- fornisce

- fornitura

- qualità

- query

- domanda

- Domande

- Presto

- rapidamente

- gamma

- pronto

- regni

- riceve

- ricevente

- Consigli

- ridurre

- riduce

- riducendo

- riferimento

- raffinato

- regionale

- regioni

- Basic

- normativa

- normativo

- Conformità normativa

- rilevanza

- pertinente

- basandosi

- rimanere

- resti

- ricorda

- rimuovere

- riformulare

- rappresentazione

- rappresenta

- richiesta

- richieste

- richiedere

- necessario

- Requisiti

- Risuonare

- Risorse

- risposta

- risposte

- responsabilità

- responsabile

- risultante

- risultante

- Risultati

- recensioni

- Recensioni

- gira

- destra

- rigoroso

- Ruolo

- running

- corre

- sagemaker

- stesso

- salvato

- Scienze

- scientifico

- senza soluzione di continuità

- senza soluzione di continuità

- Cerca

- sezioni

- sicuro

- in modo sicuro

- problemi di

- selezionato

- prodotti

- anziano

- inviato

- servizio

- Servizi

- set

- impostazioni

- flessibile.

- spostamento

- vetrina

- Spettacoli

- Vagliare

- significativa

- significativamente

- Un'espansione

- semplicemente

- inferiore

- più liscia

- Software

- lo sviluppo del software

- Ingegneria del software

- unicamente

- soluzione

- Soluzioni

- Fonte

- source

- fonti

- Reperimento

- spazi

- campata

- specializzata

- specializzata

- specifico

- specificato

- stabile

- pila

- standard

- Di partenza

- state-of-the-art

- soggiorno

- step

- Passi

- Fermare

- conservazione

- Tornare al suo account

- memorizzati

- memorizzare

- aerodinamico

- punti di forza

- Corda

- rigoroso

- strutturato

- style

- inviare

- tale

- adatto

- supporto

- supportato

- sinergia

- sistema

- su misura

- Fai

- prende

- tangibile

- Task

- task

- team

- le squadre

- per l'esame

- Tecnologie

- Tecnologia

- testamento

- testo

- di

- che

- Il

- Il paesaggio

- L’ORIGINE

- il mondo

- loro

- Li

- poi

- in tal modo

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- tre

- eccitante

- Attraverso

- tempo

- tempestivo

- timestamp

- titano

- a

- di oggi

- strumenti

- argomento

- Argomenti

- verso

- tradizionale

- Treni

- allenato

- Training

- trasferimento

- trasferito

- trasferimenti

- Trasformare

- trasformazionale

- trasformatori

- tendenze

- veramente

- affidabili sul mercato

- TURNO

- lezione

- esercitazioni

- Tipi di

- ui

- subire

- sottostante

- capire

- e una comprensione reciproca

- unico

- Università

- a differenza di

- inutile

- svelare

- up-to-date

- Aggiornanento

- aggiornato

- Aggiornamenti

- mantenimento

- su

- uso

- caso d'uso

- Utente

- Interfaccia utente

- utenti

- usa

- utilizzando

- generalmente

- utilizza

- Utilizzando

- vario

- Fisso

- versatile

- via

- Video

- video games

- visioni

- Modo..

- we

- Ricchezza

- sito web

- applicazione web

- servizi web

- presa web

- sono stati

- quando

- quale

- while

- OMS

- largo

- Vasta gamma

- volere

- con

- entro

- senza

- parole

- Lavora

- flusso di lavoro

- stazione di lavoro

- mondo

- Tu

- Trasferimento da aeroporto a Sharm

- te stesso

- zefiro