Questo post è stato co-scritto da Jyoti Sharma e Sharmo Sarkar di Vericast.

Per qualsiasi problema di machine learning (ML), il data scientist inizia lavorando con i dati. Ciò include la raccolta, l'esplorazione e la comprensione degli aspetti aziendali e tecnici dei dati, insieme alla valutazione di eventuali manipolazioni che potrebbero essere necessarie per il processo di costruzione del modello. Un aspetto di questa preparazione dei dati è l'ingegnerizzazione delle funzionalità.

Ingegneria delle funzionalità si riferisce al processo in cui le variabili rilevanti vengono identificate, selezionate e manipolate per trasformare i dati grezzi in forme più utili e utilizzabili da utilizzare con l'algoritmo ML utilizzato per addestrare un modello ed eseguire l'inferenza su di esso. L'obiettivo di questo processo è aumentare le prestazioni dell'algoritmo e del modello predittivo risultante. Il processo di progettazione delle funzionalità prevede diverse fasi, tra cui la creazione delle funzionalità, la trasformazione dei dati, l'estrazione delle funzionalità e la selezione delle funzionalità.

La creazione di una piattaforma per la progettazione di funzionalità generalizzate è un'attività comune per i clienti che devono produrre molti modelli ML con set di dati diversi. Questo tipo di piattaforma include la creazione di un processo programmatico per produrre dati finalizzati e progettati per le funzionalità, pronti per l'addestramento del modello con un intervento umano minimo. Tuttavia, la generalizzazione dell'ingegneria delle funzionalità è impegnativa. Ogni problema aziendale è diverso, ogni set di dati è diverso, i volumi di dati variano enormemente da cliente a cliente e la qualità dei dati e spesso la cardinalità di una determinata colonna (nel caso di dati strutturati) potrebbero svolgere un ruolo significativo nella complessità dell'ingegnerizzazione delle funzionalità processi. Inoltre, la natura dinamica dei dati di un cliente può comportare anche una grande variazione dei tempi di elaborazione e delle risorse necessarie per completare in modo ottimale l'ingegnerizzazione delle funzionalità.

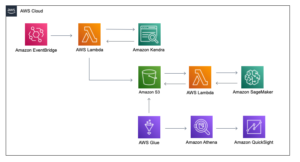

Cliente AWS vericast è una società di soluzioni di marketing che prende decisioni basate sui dati per aumentare il ROI del marketing per i propri clienti. La piattaforma di apprendimento automatico basata su cloud interna di Vericast, basata sul processo CRISP-ML(Q), utilizza vari servizi AWS, tra cui Amazon Sage Maker, Elaborazione di Amazon SageMaker, AWS Lambdae Funzioni AWS Step, per produrre i migliori modelli possibili adattati ai dati specifici del cliente. Questa piattaforma mira a catturare la ripetibilità dei passaggi necessari per creare vari flussi di lavoro ML e raggrupparli in moduli di flusso di lavoro generalizzabili standard all'interno della piattaforma.

In questo post, condividiamo come Vericast ha ottimizzato l'ingegnerizzazione delle funzionalità utilizzando SageMaker Processing.

Panoramica della soluzione

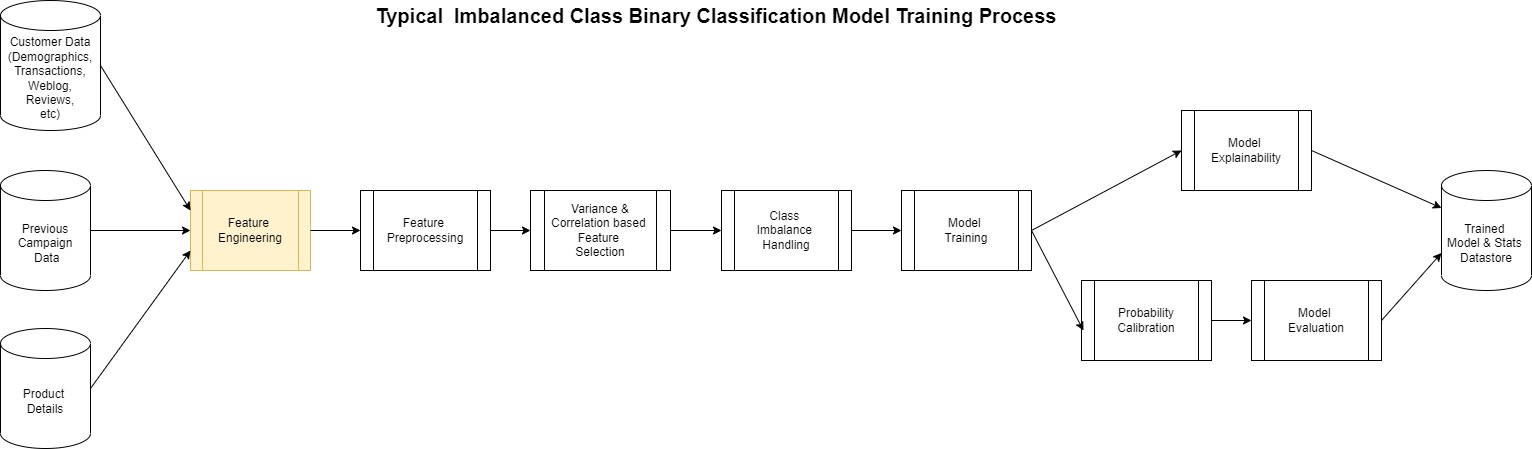

La piattaforma di apprendimento automatico di Vericast aiuta a implementare più rapidamente nuovi modelli di business basati su flussi di lavoro esistenti o ad attivare più rapidamente modelli esistenti per nuovi clienti. Ad esempio, un modello che prevede la propensione alla posta diretta è molto diverso da un modello che prevede la sensibilità dei buoni sconto dei clienti di un cliente Vericast. Risolvono diversi problemi aziendali e quindi hanno scenari di utilizzo diversi nella progettazione di una campagna di marketing. Tuttavia, dal punto di vista del machine learning, entrambi possono essere interpretati come modelli di classificazione binaria e pertanto potrebbero condividere molti passaggi comuni da una prospettiva del flusso di lavoro ML, tra cui l'ottimizzazione e l'addestramento del modello, la valutazione, l'interpretabilità, la distribuzione e l'inferenza.

Poiché questi modelli sono problemi di classificazione binaria (in termini ML), stiamo separando i clienti di un'azienda in due classi (binarie): quelli che risponderebbero positivamente alla campagna e quelli che non lo farebbero. Inoltre, questi esempi sono considerati una classificazione squilibrata perché i dati utilizzati per addestrare il modello non conterrebbero un numero uguale di clienti che risponderebbero e non risponderebbero favorevolmente.

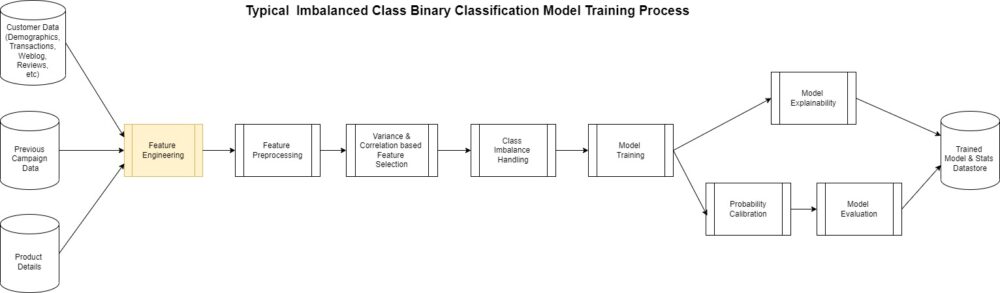

L'effettiva creazione di un modello come questo segue il modello generalizzato mostrato nel diagramma seguente.

La maggior parte di questo processo è la stessa per qualsiasi classificazione binaria, ad eccezione della fase di progettazione delle funzionalità. Questa è forse la fase più complicata ma a volte trascurata del processo. I modelli ML dipendono in gran parte dalle funzionalità utilizzate per crearlo.

La piattaforma di Machine Learning nativa per il cloud di Vericast mira a generalizzare e automatizzare le fasi di progettazione delle funzionalità per vari flussi di lavoro ML e ottimizzare le loro prestazioni in base a una metrica di costo rispetto al tempo utilizzando le seguenti funzionalità:

- La libreria di ingegneria delle funzionalità della piattaforma – Consiste in un insieme di trasformazioni in continua evoluzione che sono state testate per produrre funzionalità generalizzabili di alta qualità basate su concetti specifici del cliente (ad esempio, dati demografici del cliente, dettagli del prodotto, dettagli della transazione e così via).

- Ottimizzatori di risorse intelligenti – La piattaforma utilizza la capacità dell'infrastruttura on-demand di AWS per creare il tipo più ottimale di risorse di elaborazione per il particolare lavoro di ingegneria delle funzionalità in base alla complessità prevista del passaggio e alla quantità di dati che deve elaborare.

- Ridimensionamento dinamico dei lavori di ingegneria delle funzionalità – Per questo viene utilizzata una combinazione di vari servizi AWS, ma in particolare SageMaker Processing. Ciò garantisce che la piattaforma produca funzionalità di alta qualità in modo economico e tempestivo.

Questo post è incentrato sul terzo punto di questo elenco e mostra come ottenere il ridimensionamento dinamico dei processi di elaborazione SageMaker per ottenere un framework di elaborazione dati più gestito, performante e conveniente per grandi volumi di dati.

SageMaker Processing abilita i carichi di lavoro che eseguono passaggi per la pre-elaborazione o la post-elaborazione dei dati, la progettazione delle funzionalità, la convalida dei dati e la valutazione del modello su SageMaker. Fornisce inoltre un ambiente gestito e rimuove la complessità del lavoro pesante indifferenziato necessario per impostare e mantenere l'infrastruttura necessaria per eseguire i carichi di lavoro. Inoltre, SageMaker Processing fornisce un'interfaccia API per l'esecuzione, il monitoraggio e la valutazione del carico di lavoro.

L'esecuzione dei lavori di SageMaker Processing avviene interamente all'interno di un cluster SageMaker gestito, con i singoli lavori inseriti nei contenitori delle istanze in fase di esecuzione. Il cluster gestito, le istanze e i contenitori segnalano le metriche a Amazon Cloud Watch, incluso l'utilizzo di GPU, CPU, memoria, memoria GPU, metriche del disco e registrazione degli eventi.

Queste funzionalità offrono vantaggi ai data engineer e agli scienziati di Vericast, assistendo nello sviluppo di flussi di lavoro di pre-elaborazione generalizzati e astraendo la difficoltà di mantenere gli ambienti generati in cui eseguirli. Tuttavia, possono sorgere problemi tecnici, data la natura dinamica dei dati e le loro varie caratteristiche che possono essere inserite in una soluzione così generale. Il sistema deve fare un'ipotesi iniziale plausibile sulla dimensione del cluster e sulle istanze che lo compongono. Questa ipotesi deve valutare i criteri dei dati e dedurre i requisiti di CPU, memoria e disco. Questa ipotesi può essere del tutto appropriata e funzionare adeguatamente per il lavoro, ma in altri casi potrebbe non esserlo. Per un determinato set di dati e un lavoro di preelaborazione, la CPU potrebbe essere sottodimensionata, con il risultato di prestazioni di elaborazione massime e tempi di completamento lunghi. Peggio ancora, la memoria potrebbe diventare un problema, causando scarse prestazioni o eventi di memoria insufficiente che causano il fallimento dell'intero processo.

Con questi ostacoli tecnici in mente, Vericast ha deciso di creare una soluzione. Dovevano rimanere di natura generale e adattarsi al quadro più ampio del flusso di lavoro di pre-elaborazione essendo flessibili nelle fasi coinvolte. Era anche importante risolvere sia la potenziale necessità di scalare l'ambiente nei casi in cui le prestazioni fossero compromesse sia di riprendersi con garbo da un tale evento o quando un lavoro terminava prematuramente per qualsiasi motivo.

La soluzione creata da Vericast per risolvere questo problema utilizza diversi servizi AWS che lavorano insieme per raggiungere i loro obiettivi di business. È stato progettato per riavviare e ridimensionare il cluster SageMaker Processing in base alle metriche delle prestazioni osservate utilizzando le funzioni Lambda che monitorano i lavori. Per non perdere il lavoro quando si verifica un evento di ridimensionamento o per recuperare da un arresto imprevisto del lavoro, è stato messo in atto un servizio basato su checkpoint che utilizza Amazon DynamoDB e memorizza i dati parzialmente elaborati in Servizio di archiviazione semplice Amazon (Amazon S3) man mano che i passaggi vengono completati. Il risultato finale è una soluzione a scalabilità automatica, robusta e monitorata dinamicamente.

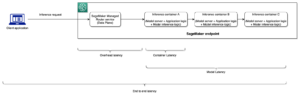

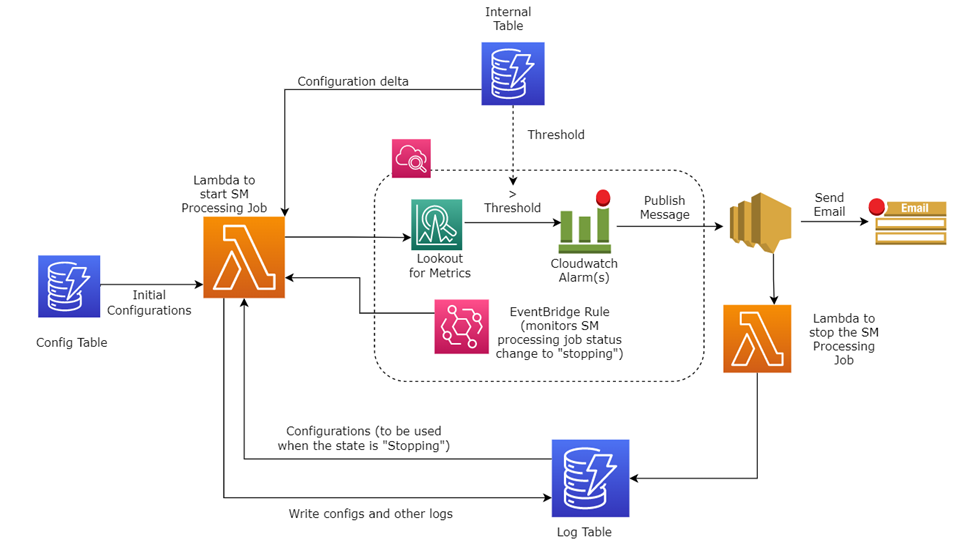

Il diagramma seguente mostra una panoramica di alto livello del funzionamento del sistema.

Nelle sezioni seguenti, discuteremo i componenti della soluzione in modo più dettagliato.

Inizializzazione della soluzione

Il sistema presuppone che un processo separato avvii la soluzione. Al contrario, questo design non è progettato per funzionare da solo perché non produrrà alcun artefatto o output, ma fungerà piuttosto da implementazione collaterale per uno dei sistemi che utilizzano i processi di elaborazione SageMaker. Nel caso di Vericast, la soluzione viene avviata mediante una chiamata da un passaggio di Step Functions avviato in un altro modulo del sistema più ampio.

Una volta avviata la soluzione e avviata una prima esecuzione, una configurazione standard di base viene letta da una tabella DynamoDB. Questa configurazione viene utilizzata per impostare i parametri per il processo di elaborazione SageMaker e prevede i presupposti iniziali delle esigenze dell'infrastruttura. Il lavoro SageMaker Processing è ora avviato.

Monitoraggio dei metadati e dell'output

Quando il processo viene avviato, una funzione Lambda scrive i metadati di elaborazione del processo (la configurazione del processo corrente e altre informazioni di registro) nella tabella di registro di DynamoDB. Questi metadati e le informazioni di registro mantengono una cronologia del lavoro, la sua configurazione iniziale e continua e altri dati importanti.

In determinati punti, al completamento delle fasi del lavoro, i dati del punto di controllo vengono aggiunti alla tabella di log di DynamoDB. I dati di output elaborati vengono spostati su Amazon S3 per un ripristino rapido, se necessario.

Questa funzione Lambda imposta anche un Amazon EventBridge regola che controlla il lavoro in esecuzione per il suo stato. Nello specifico, questa regola controlla il lavoro per osservare se lo stato del lavoro cambia in stopping o è in a stopped stato. Questa regola EventBridge svolge un ruolo importante nel riavvio di un processo se si verifica un errore o si verifica un evento di ridimensionamento automatico pianificato.

Monitoraggio dei parametri CloudWatch

La funzione Lambda imposta anche un allarme CloudWatch basato su un'espressione matematica metrica sul processo di elaborazione, che monitora i parametri di tutte le istanze per l'utilizzo della CPU, dell'utilizzo della memoria e dell'utilizzo del disco. Questo tipo di allarme (metrica) utilizza le soglie di allarme di CloudWatch. L'allarme genera eventi in base al valore della metrica o dell'espressione relativa alle soglie in un certo numero di periodi di tempo.

Nel caso d'uso di Vericast, l'espressione di soglia è progettata per considerare le istanze del driver e dell'esecutore come separate, con metriche monitorate individualmente per ciascuna. Avendoli separati, Vericast sa quale sta causando l'allarme. Questo è importante per decidere come ridimensionare di conseguenza:

- Se le metriche dell'esecutore superano la soglia, è consigliabile ridimensionare orizzontalmente

- Se le metriche del driver superano la soglia, il ridimensionamento orizzontale probabilmente non sarà d'aiuto, quindi dobbiamo ridimensionare verticalmente

Espressione delle metriche di allarme

Vericast può accedere alle seguenti metriche nella sua valutazione per il ridimensionamento e il fallimento:

- Utilizzo CPU – La somma dell'utilizzo di ogni singolo core della CPU

- Utilizzo della memoria – La percentuale di memoria utilizzata dai contenitori su un'istanza

- Utilizzo del disco – La percentuale di spazio su disco utilizzata dai contenitori su un'istanza

- Utilizzo della GPU – La percentuale di unità GPU utilizzate dai container su un'istanza

- Utilizzo della memoria GPU – La percentuale di memoria GPU utilizzata dai container su un'istanza

Al momento della stesura di questo documento, Vericast considera solo CPUUtilization, MemoryUtilizatione DiskUtilization. In futuro, intendono prendere in considerazione GPUUtilization ed GPUMemoryUtilization come pure.

Il codice seguente è un esempio di allarme CloudWatch basato su un'espressione matematica metrica per il dimensionamento automatico di Vericast:

Questa espressione illustra che l'allarme CloudWatch sta prendendo in considerazione DriverMemoryUtilization (memoryDriver), CPUUtilization (cpuDriver), DiskUtilization (diskDriver), ExecutorMemoryUtilization (memoryExec), CPUUtilization (cpuExec)e DiskUtilization (diskExec) come metriche di monitoraggio. Il numero 80 nell'espressione precedente rappresenta il valore di soglia.

Qui, IF((cpuDriver) > 80, 1, 0 implica che se l'utilizzo della CPU del driver supera l'80%, 1 viene assegnato come soglia altrimenti 0. IF(AVG(METRICS("memoryExec")) > 80, 1, 0 implica che tutte le metriche con string memoryExec in esso vengono considerati e su questo viene calcolata una media. Se la percentuale media di utilizzo della memoria supera 80, 1 viene assegnato come soglia altrimenti 0.

L'operatore logico OR viene utilizzato nell'espressione per unificare tutti gli utilizzi nell'espressione: se uno qualsiasi degli utilizzi raggiunge la sua soglia, attiva l'allarme.

Per ulteriori informazioni sull'utilizzo degli allarmi dei parametri di CloudWatch basati su espressioni matematiche dei parametri, fare riferimento a Creazione di un allarme CloudWatch basato su un'espressione matematica metrica.

Limitazioni degli allarmi di CloudWatch

CloudWatch limita il numero di parametri per allarme a 10. Ciò può causare limitazioni se devi considerare più parametri di questo.

Per superare questa limitazione, Vericast ha impostato allarmi basati sulla dimensione complessiva del cluster. Viene creato un allarme per tre istanze (per tre istanze, ci sarà un allarme perché ciò aggiungerebbe fino a nove metriche). Supponendo che l'istanza del driver debba essere considerata separatamente, viene creato un altro allarme separato per l'istanza del driver. Pertanto, il numero totale di allarmi creati è approssimativamente equivalente a un terzo del numero di nodi esecutori e uno aggiuntivo per l'istanza del driver. In ogni caso, il numero di metriche per allarme è inferiore al limite di 10 metriche.

Cosa succede quando si è in uno stato di allarme

Se viene raggiunta una soglia predeterminata, l'allarme passa a an alarm stato, che utilizza Servizio di notifica semplice Amazon (Amazon SNS) per inviare notifiche. In questo caso, invia una notifica e-mail a tutti gli iscritti con i dettagli sull'allarme nel messaggio.

Amazon SNS viene utilizzato anche come trigger per una funzione Lambda che interrompe il processo di elaborazione SageMaker attualmente in esecuzione perché sappiamo che il processo probabilmente fallirà. Questa funzione registra anche i log nella tabella dei log relativi all'evento.

La regola EventBridge impostata all'avvio del lavoro noterà che il lavoro è andato in a stopping stato pochi secondi dopo. Questa regola quindi esegue nuovamente la prima funzione Lambda per riavviare il processo.

Il processo di ridimensionamento dinamico

La prima funzione Lambda dopo l'esecuzione due o più volte saprà che un lavoro precedente era già stato avviato e ora si è interrotto. La funzione eseguirà un processo simile per ottenere la configurazione di base dal lavoro originale nella tabella di log DynamoDB e recupererà anche la configurazione aggiornata dalla tabella interna. Questa configurazione aggiornata è una configurazione delta delle risorse impostata in base al tipo di ridimensionamento. Il tipo di ridimensionamento è determinato dai metadati dell'allarme come descritto in precedenza.

La configurazione originale più il delta delle risorse vengono utilizzati perché una nuova configurazione e un nuovo processo di elaborazione SageMaker vengono avviati con le maggiori risorse.

Questo processo continua fino a quando il processo non viene completato correttamente e può comportare più riavvii in base alle necessità, aggiungendo più risorse ogni volta.

Il risultato di Vericast

Questa soluzione di ridimensionamento automatico personalizzata è stata fondamentale per rendere la piattaforma di machine learning di Vericast più robusta e tollerante ai guasti. La piattaforma può ora gestire con garbo carichi di lavoro di diversi volumi di dati con un intervento umano minimo.

Prima di implementare questa soluzione, la stima dei requisiti delle risorse per tutti i moduli basati su Spark nella pipeline era uno dei maggiori colli di bottiglia del processo di onboarding del nuovo client. I flussi di lavoro fallirebbero se il volume di dati del cliente aumentasse o il costo sarebbe ingiustificabile se il volume di dati diminuisse in produzione.

Con questo nuovo modulo, i fallimenti del flusso di lavoro dovuti a vincoli di risorse sono stati ridotti di quasi l'80%. I pochi errori rimanenti sono principalmente dovuti ai vincoli dell'account AWS e oltre il processo di ridimensionamento automatico. La più grande vittoria di Vericast con questa soluzione è la facilità con cui possono integrare nuovi clienti e flussi di lavoro. Vericast prevede di accelerare il processo di almeno il 60-70%, con dati ancora da raccogliere per un numero definitivo.

Sebbene questo sia visto come un successo da Vericast, c'è un costo che ne deriva. In base alla natura di questo modulo e al concetto di ridimensionamento dinamico nel suo insieme, i flussi di lavoro tendono a richiedere circa il 30% in più (caso medio) rispetto a un flusso di lavoro con un cluster personalizzato per ogni modulo nel flusso di lavoro. Vericast continua a ottimizzare in quest'area, cercando di migliorare la soluzione incorporando l'inizializzazione delle risorse basata sull'euristica per ciascun modulo client.

Sharmo Sarkar, Senior Manager, Machine Learning Platform presso Vericast, afferma: "Mentre continuiamo a espandere il nostro utilizzo di AWS e SageMaker, volevo dedicare un momento per evidenziare l'incredibile lavoro del nostro team AWS Client Services, dedicato AWS Solutions Architects, e AWS Professional Services con cui lavoriamo. La loro profonda conoscenza di AWS e SageMaker ci ha permesso di progettare una soluzione che soddisfacesse tutte le nostre esigenze e ci ha fornito la flessibilità e la scalabilità di cui avevamo bisogno. Siamo così grati di avere un team di supporto così talentuoso e competente dalla nostra parte”.

Conclusione

In questo post, abbiamo condiviso come SageMaker e SageMaker Processing hanno consentito a Vericast di creare un framework di elaborazione dei dati gestito, performante e conveniente per grandi volumi di dati. Combinando la potenza e la flessibilità di SageMaker Processing con altri servizi AWS, possono facilmente monitorare il processo di ingegnerizzazione delle funzionalità generalizzate. Possono rilevare automaticamente potenziali problemi generati dalla mancanza di calcolo, memoria e altri fattori e implementare automaticamente il ridimensionamento verticale e orizzontale secondo necessità.

SageMaker e i suoi strumenti possono aiutare anche il tuo team a raggiungere i suoi obiettivi ML. Per saperne di più su SageMaker Processing e su come può aiutarti nei tuoi carichi di lavoro di elaborazione dei dati, fai riferimento a Dati di processo. Se hai appena iniziato con il machine learning e cerchi esempi e indicazioni, JumpStart di Amazon SageMaker può farti iniziare. JumpStart è un hub ML da cui puoi accedere ad algoritmi integrati con modelli di base preaddestrati per aiutarti a eseguire attività come il riepilogo di articoli e la generazione di immagini e soluzioni predefinite per risolvere casi d'uso comuni.

Infine, se questo post ti aiuta o ti ispira a risolvere un problema, ci piacerebbe saperlo! Si prega di condividere commenti e feedback.

Informazioni sugli autori

Anthony McClure è Senior Partner Solutions Architect del team AWS SaaS Factory. Anthony ha anche un forte interesse per l'apprendimento automatico e l'intelligenza artificiale e collabora con la comunità tecnica sul campo AWS ML/AI per aiutare i clienti a trasformare in realtà le loro soluzioni di apprendimento automatico.

Anthony McClure è Senior Partner Solutions Architect del team AWS SaaS Factory. Anthony ha anche un forte interesse per l'apprendimento automatico e l'intelligenza artificiale e collabora con la comunità tecnica sul campo AWS ML/AI per aiutare i clienti a trasformare in realtà le loro soluzioni di apprendimento automatico.

Jyoti Sharma è un Data Science Engineer con il team della piattaforma di machine learning di Vericast. È appassionata di tutti gli aspetti della scienza dei dati e si è concentrata sulla progettazione e l'implementazione di una piattaforma di apprendimento automatico altamente scalabile e distribuita.

Jyoti Sharma è un Data Science Engineer con il team della piattaforma di machine learning di Vericast. È appassionata di tutti gli aspetti della scienza dei dati e si è concentrata sulla progettazione e l'implementazione di una piattaforma di apprendimento automatico altamente scalabile e distribuita.

Sharmo Sarkar è Senior Manager presso Vericast. Dirige i team di ricerca e sviluppo ML di Cloud Machine Learning Platform e Marketing Platform presso Vericast. Ha una vasta esperienza in Big Data Analytics, Distributed Computing e Natural Language Processing. Al di fuori del lavoro, ama andare in moto, fare escursioni e andare in bicicletta sui sentieri di montagna.

Sharmo Sarkar è Senior Manager presso Vericast. Dirige i team di ricerca e sviluppo ML di Cloud Machine Learning Platform e Marketing Platform presso Vericast. Ha una vasta esperienza in Big Data Analytics, Distributed Computing e Natural Language Processing. Al di fuori del lavoro, ama andare in moto, fare escursioni e andare in bicicletta sui sentieri di montagna.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-vericast-optimized-feature-engineering-using-amazon-sagemaker-processing/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 15%

- 7

- a

- WRI

- accesso

- di conseguenza

- Il mio account

- Raggiungere

- Attivazione

- atti

- aggiungere

- aggiunto

- l'aggiunta di

- aggiuntivo

- adeguatamente

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AIDS

- mira

- allarme

- algoritmo

- Algoritmi

- Tutti

- da solo

- lungo

- già

- anche

- Amazon

- Amazon Sage Maker

- quantità

- an

- analitica

- ed

- Un altro

- Anthony

- in qualsiasi

- api

- opportuno

- architettura

- SONO

- RISERVATA

- in giro

- articolo

- artificiale

- intelligenza artificiale

- AS

- aspetto

- aspetti

- addetto

- assistere

- At

- auto

- automatizzare

- automaticamente

- media

- AWS

- Servizi professionali AWS

- base

- basato

- BE

- perché

- diventare

- stato

- essendo

- vantaggi

- MIGLIORE

- Al di là di

- Big

- Big Data

- Maggiore

- Incremento

- entrambi

- Portare

- costruire

- Costruzione

- costruito

- incassato

- affari

- ma

- by

- calcolato

- chiamata

- Campagna

- Materiale

- Può ottenere

- Catturare

- Custodie

- casi

- Causare

- causando

- certo

- impegnativo

- Modifiche

- classe

- classi

- classificazione

- cliente

- onboarding del cliente

- clienti

- Cloud

- Cluster

- codice

- Colonna

- combinazione

- combinando

- viene

- Commenti

- Uncommon

- comunità

- azienda

- completamento di una

- Completa

- complessità

- complicato

- componenti

- Compromissione

- Calcolare

- informatica

- concetto

- concetti

- Configurazione

- Prendere in considerazione

- considerato

- considerando

- ritiene

- vincoli

- contenere

- Tecnologie Container

- continua

- continua

- Costo

- costo effettivo

- potuto

- coupon

- creare

- creato

- creazione

- criteri

- Cross

- Corrente

- Attualmente

- costume

- cliente

- Clienti

- dati

- Dati Analytics

- Preparazione dei dati

- elaborazione dati

- scienza dei dati

- scienziato di dati

- data-driven

- dataset

- decide

- decisioni

- dedicato

- deep

- Delta

- Dati Demografici

- dipendente

- deployment

- descritta

- Design

- progettato

- progettazione

- dettaglio

- dettagli

- determinato

- Mercato

- diverso

- A differenza

- Livello di difficoltà

- dirette

- Codice Sconto

- discutere

- distribuito

- calcolo distribuito

- spinto

- autista

- dovuto

- dinamico

- dinamicamente

- ogni

- In precedenza

- alleviare

- facilmente

- o

- abilitato

- Abilita

- ingegnere

- Ingegneria

- Ingegneri

- assicura

- Intero

- Ambiente

- ambienti

- pari

- Equivalente

- valutare

- la valutazione

- valutazione

- Evento

- eventi

- esempio

- Esempi

- Tranne

- esistente

- Espandere

- previsto

- aspetta

- esperienza

- Esplorare

- espressioni

- estensivo

- Conclamata Esperienza

- Fattori

- fabbrica

- FAIL

- Fallimento

- caratteristica

- Caratteristiche

- Federale

- feedback

- pochi

- campo

- finale

- finalizzato

- Nome

- in forma

- Flessibilità

- flessibile

- concentrato

- i seguenti

- segue

- Nel

- forme

- Fondazione

- Contesto

- da

- completamente

- function

- funzioni

- Inoltre

- futuro

- raccolta

- Generale

- generato

- genera

- ELETTRICA

- ottenere

- ottenere

- dato

- Go

- scopo

- Obiettivi

- va

- buono

- GPU

- grato

- guida

- ha avuto

- maniglia

- accade

- Avere

- avendo

- he

- sentire

- pesante

- sollevamento pesante

- Aiuto

- aiuta

- alto livello

- alta qualità

- Highlight

- vivamente

- storia

- Orizzontale

- orizzontalmente

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- Hub

- umano

- ostacoli

- i

- identificato

- if

- illustra

- Immagine

- realizzare

- implementazione

- Implementazione

- importante

- competenze

- in

- In altre

- inclusi

- Compreso

- incorporando

- Aumento

- è aumentato

- incredibile

- individuale

- Individualmente

- informazioni

- Infrastruttura

- inizialmente

- iniziati

- esempio

- strumentale

- Intelligence

- intendono

- interesse

- Interfaccia

- interno

- intervento

- ai miglioramenti

- coinvolto

- problema

- sicurezza

- IT

- SUO

- Lavoro

- Offerte di lavoro

- jpg

- ad appena

- Genere

- Sapere

- Dipingere

- Lingua

- grandi

- maggiormente

- superiore, se assunto singolarmente.

- dopo

- Leads

- IMPARARE

- apprendimento

- meno

- Biblioteca

- di sollevamento

- limitazione

- limiti

- limiti

- Lista

- piccolo

- ceppo

- registrazione

- logico

- più a lungo

- cerca

- perdere

- amore

- macchina

- machine learning

- mantenere

- Mantenere

- mantiene

- make

- FA

- Fare

- gestito

- direttore

- manipolata

- modo

- molti

- Marketing

- matematica

- Maggio..

- Soddisfare

- Memorie

- messaggio

- Metadati

- metrico

- Metrica

- forza

- mente

- minimo

- ML

- modello

- modelli

- Moduli

- moduli

- momento

- Monitorare

- monitorati

- monitoraggio

- monitor

- Scopri di più

- maggior parte

- soprattutto

- La Montagna

- multiplo

- devono obbligatoriamente:

- Naturale

- Elaborazione del linguaggio naturale

- Natura

- Bisogno

- di applicazione

- che necessitano di

- esigenze

- New

- nodi

- segnatamente

- Avviso..

- notifica

- notifiche

- adesso

- numero

- Obiettivi d'Esame

- osservare

- of

- di frequente

- on

- On-Demand

- Onboard

- Procedura di Onboarding

- ONE

- in corso

- esclusivamente

- operatore

- ottimale

- OTTIMIZZA

- ottimizzati

- or

- i

- Altro

- nostro

- su

- Risultato

- produzione

- al di fuori

- ancora

- complessivo

- Superare

- panoramica

- parametri

- parte

- particolare

- partner

- Di passaggio

- appassionato

- Cartamodello

- percentuale

- Eseguire

- performance

- Forse

- periodi

- prospettiva

- immagine

- conduttura

- posto

- previsto

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- Giocare

- gioca

- per favore

- più

- punto

- punti

- povero

- possibile

- Post

- potenziale

- energia

- previsione

- precedente

- probabilmente

- Problema

- problemi

- processi

- Elaborato

- lavorazione

- produrre

- Prodotto

- Produzione

- professionale

- fornire

- purché

- fornisce

- metti

- qualità

- Presto

- più veloce

- R&D

- piuttosto

- Crudo

- raggiungere

- Leggi

- pronto

- Realtà

- ragione

- record

- Recuperare

- recupero

- Ridotto

- si riferisce

- relazionato

- pertinente

- rimanere

- rimanente

- rapporto

- necessario

- Requisiti

- risorsa

- Risorse

- Rispondere

- colpevole

- risultante

- robusto

- Ruolo

- approssimativamente

- Regola

- Correre

- running

- SaaS

- sagemaker

- stesso

- dice

- Scalabilità

- scalabile

- Scala

- scala

- Soluzione di ridimensionamento

- Scenari

- Scienze

- Scienziato

- scienziati

- secondo

- sezioni

- selezionato

- prodotti

- inviare

- invia

- anziano

- Sensibilità

- separato

- separazione

- servizio

- Servizi

- set

- Set

- alcuni

- Condividi

- condiviso

- Sharma

- lei

- mostrato

- Spettacoli

- lato

- significativa

- simile

- Un'espansione

- Taglia

- So

- soluzione

- Soluzioni

- RISOLVERE

- lo spazio

- specifico

- in particolare

- velocità

- Spin

- tappe

- Standard

- si

- inizia a

- iniziato

- inizio

- Regione / Stato

- Stato dei servizi

- step

- Passi

- Ancora

- fermato

- sosta

- Interrompe

- conservazione

- negozi

- Corda

- forte

- strutturato

- iscritti

- il successo

- Con successo

- tale

- supporto

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- su misura

- Fai

- prende

- talento

- Task

- task

- team

- le squadre

- Consulenza

- condizioni

- di

- che

- Il

- Il futuro

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Terza

- questo

- quelli

- tre

- soglia

- Attraverso

- tempo

- volte

- a

- insieme

- strumenti

- Totale

- Treni

- Training

- delle transazioni

- Dettagli di Transazione

- Trasformare

- Trasformazione

- trasformazioni

- innescare

- innescato

- seconda

- Digitare

- tipico

- per

- e una comprensione reciproca

- unità

- fino a quando

- aggiornato

- us

- utilizzabile

- Impiego

- uso

- caso d'uso

- utilizzato

- utilizzando

- convalida

- APPREZZIAMO

- vario

- verticale

- volume

- volumi

- vs

- ricercato

- Prima

- guardare

- Modo..

- we

- WELL

- quando

- quale

- OMS

- tutto

- interamente

- volere

- vincere

- con

- entro

- Lavora

- flussi di lavoro

- lavoro

- lavori

- peggio

- sarebbe

- scrittura

- ancora

- dare la precedenza

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro