Per le aziende moderne che gestiscono enormi volumi di documenti come contratti, fatture, curriculum e report, l'elaborazione e il recupero efficienti dei dati pertinenti sono fondamentali per mantenere un vantaggio competitivo. Tuttavia, i metodi tradizionali di archiviazione e ricerca dei documenti possono richiedere molto tempo e spesso comportano un grande sforzo per trovare un documento specifico, soprattutto quando includono la scrittura a mano. E se esistesse un modo per elaborare i documenti in modo intelligente e renderli ricercabili con elevata precisione?

Ciò è reso possibile con Testo Amazon, il servizio di elaborazione intelligente dei documenti di AWS, abbinato alle funzionalità di ricerca rapida di OpenSearch. In questo post ti accompagneremo in un viaggio per creare e distribuire rapidamente una soluzione di indicizzazione della ricerca di documenti che aiuti la tua organizzazione a sfruttare ed estrarre informazioni approfondite dai documenti.

Che tu sia un responsabile delle Risorse umane alla ricerca di clausole specifiche nei contratti dei dipendenti o un analista finanziario che vaglia una montagna di fatture per estrarre i dati di pagamento, questa soluzione è personalizzata per consentirti di accedere alle informazioni di cui hai bisogno con una velocità e una precisione senza precedenti.

Con la soluzione proposta, i tuoi documenti vengono automaticamente acquisiti, il loro contenuto analizzato e successivamente indicizzato in un indice OpenSearch altamente reattivo e scalabile.

Parleremo di come tecnologie come Amazon Textract, AWS Lambda, Servizio di archiviazione semplice Amazon (Amazon S3) e Servizio Amazon OpenSearch può essere integrato in un flusso di lavoro che elabora i documenti senza problemi. Quindi approfondiremo l'indicizzazione di questi dati in OpenSearch e dimostreremo le funzionalità di ricerca che diventano disponibili a portata di mano.

Che la tua organizzazione stia muovendo i primi passi nell'era della trasformazione digitale o sia un colosso affermato che cerca di potenziare il recupero delle informazioni, questa guida è la tua bussola per esplorare le opportunità offerte da AWS Intelligent Document Processing e OpenSearch.

Il implementazione utilizzato in questo post utilizza il file Costrutti CDK di Amazon Texttract IDP – Componenti AWS Cloud Development Kit (CDK) per definire l'infrastruttura per i flussi di lavoro IDP (Intelligent Document Processing), che consentono di creare flussi di lavoro IDP personalizzabili specifici per casi d'uso. I costrutti e gli esempi IDP CDK sono una raccolta di componenti per consentire la definizione di processi IDP su AWS e pubblicati su GitHub. I concetti principali utilizzati sono l'AWS Kit di sviluppo cloud (CDK) costrutti, il reale Stack CDK ed Funzioni AWS Step. L'officina Utilizza il machine learning per automatizzare ed elaborare documenti su larga scala è un buon punto di partenza per saperne di più sulla personalizzazione dei flussi di lavoro e sull'utilizzo degli altri flussi di lavoro di esempio come base per i propri.

Panoramica della soluzione

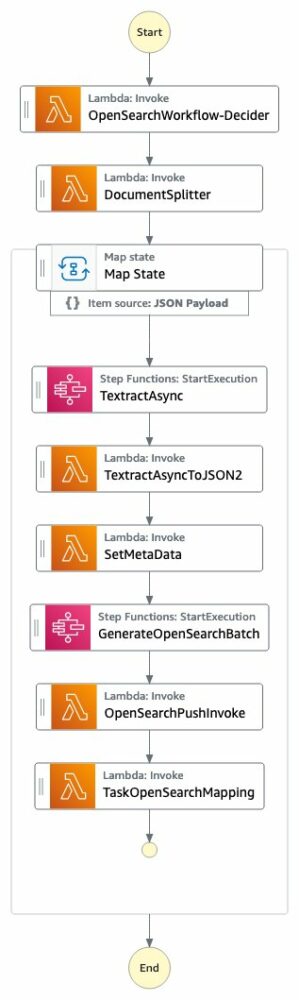

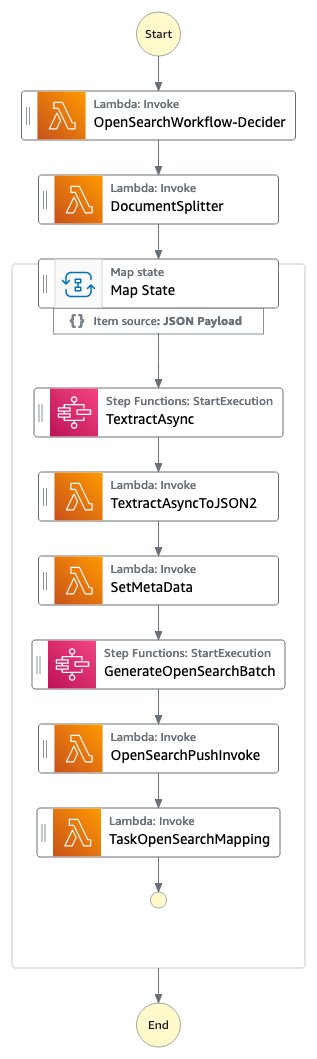

In questa soluzione, ci concentriamo sull'indicizzazione dei documenti in un indice OpenSearch per la ricerca e il recupero rapidi di informazioni e documenti. I documenti in formato PDF, TIFF, JPEG o PNG vengono inseriti in un Amazon Simple Storage Service (Amazon S3) bucket e successivamente indicizzato in OpenSearch utilizzando questo flusso di lavoro Step Functions.

Figura 1: il flusso di lavoro OpenSearch di Step Functions

Il OpenSearchWorkflow-Decider esamina il documento e verifica che sia uno dei tipi MIME supportati (PDF, TIFF, PNG o JPEG). È composto da uno AWS Lambda funzione.

Il DocumentSplitter genera un blocco massimo di 2500 pagine dai documenti. Ciò significa che anche se Amazon Textract supporta documenti fino a 3000 pagine, puoi passare documenti con molte più pagine e il processo funziona comunque correttamente, inserisce le pagine in OpenSearch e crea numeri di pagina corretti. IL DocumentSplitter è implementato come una funzione AWS Lambda.

Il Stato della mappa elabora ogni pezzo in parallelo.

Il TextAsync l'attività chiama Amazon Textract utilizzando il metodo asincrono Application Programming Interface (API) seguente best practice con Amazon Simple Notification Service (AmazonSNS) notifiche e Configurazione uscita per archiviare l'output JSON di Amazon Textract in un bucket Amazon S3 del cliente. È costituito da due funzioni Amazon Lambda: una per inviare il documento per l'elaborazione e l'altra per l'attivazione della notifica Amazon SNS.

Perché il TextAsyL'attività nc può produrre più file di output impaginati, il file TexttractAsyncToJSON2 il processo li combina in un unico file JSON.

Il contesto Step Functions si arricchisce di informazioni che dovrebbero essere ricercabili anche nell'indice OpenSearch nel file ImpostaMetaData fare un passo. L'implementazione di esempio aggiunge ORIGIN_FILE_NAME, START_PAGE_NUMBERe ORIGIN_FILE_URI. Puoi aggiungere qualsiasi informazione per arricchire l'esperienza di ricerca, come informazioni provenienti da altri sistemi backend, ID specifici o informazioni sulla classificazione.

Il GeneraOpenSearchBatch prende l'output JSON di Amazon Textract generato, lo combina con le informazioni dal contesto impostato da SetMetaData e prepara un file ottimizzato per l'importazione batch in OpenSearch.

Nel OpenSearchPushInvoke, questo file di importazione batch viene inviato all'indice OpenSearch e disponibile per la ricerca. Questa funzione AWS Lambda è connessa a aws-lambda-opensearch costruire da Soluzioni AWS libreria utilizzando le istanze m6g.large.search, OpenSearch versione 2.7 e configurato Amazon Elastic Block Service (AmazonEBS) dimensioni del volume conformi a General Purpose 2 (GP2) con 200 GB. Puoi modificare la configurazione di OpenSearch in base alle tue esigenze.

La finale TaskOpenSearchMapping passo chiarisce il contesto, che altrimenti potrebbe superare il Quota funzioni passo of Dimensione massima di input o output per un'attività, uno stato o un'esecuzione.

Prerequisiti

Per distribuire gli esempi, è necessario un account AWS, il Kit di sviluppo cloud AWS (AWS CDK), sono richiesti una versione corrente di Python e Docker. Sono necessarie le autorizzazioni per distribuire i modelli AWS CloudFormation, inviali al file Registro dei contenitori Amazon Elastic (Amazon ECR), creare Gestione dell'identità e degli accessi di Amazon (AWS IAM), funzioni Amazon Lambda, bucket Amazon S3, Amazon Step Functions, cluster Amazon OpenSearch e un Amazzonia Cognito pool di utenti. Assicurati che il tuo L'ambiente AWS CLI è configurato con le dovute autorizzazioni.

Puoi anche far girare a AWS Cloud9 istanza con AWS CDK, Python e Docker preinstallati per avviare la distribuzione.

Soluzione

Distribuzione

- Dopo aver impostato i prerequisiti, devi prima clonare il repository:

- Quindi inserisci la cartella del repository e installa le dipendenze:

- Distribuisci lo stack OpenSearchWorkflow:

La distribuzione richiede circa 25 minuti con le impostazioni di configurazione predefinite degli esempi GitHub e crea un flusso di lavoro Step Functions, che viene richiamato quando un documento viene inserito in un bucket/prefisso Amazon S3 e successivamente viene elaborato finché il contenuto del documento non viene indicizzato in un cluster OpenSearch.

Di seguito è riportato un output di esempio che include collegamenti utili e informazioni generate dacdk deploy OpenSearchWorkflowcomando:

Queste informazioni sono disponibili anche nella console AWS CloudFormation.

Quando un nuovo documento viene inserito sotto il file OpenSearchWorkflow.DocumentUploadLocation, viene avviato un nuovo flusso di lavoro Step Functions per questo documento.

Per verificare lo stato di questo documento, il OpenSearchWorkflow.StepFunctionFlowLink fornisce un collegamento all'elenco delle esecuzioni StepFunction nella Console di gestione AWS, visualizzando lo stato dell'elaborazione dei documenti per ciascun documento caricato su Amazon S3. Il tutorial Visualizzazione e debug delle esecuzioni sulla console Step Functions fornisce una panoramica dei componenti e delle visualizzazioni nella console AWS.

Testing

- Primo test utilizzando un file di esempio.

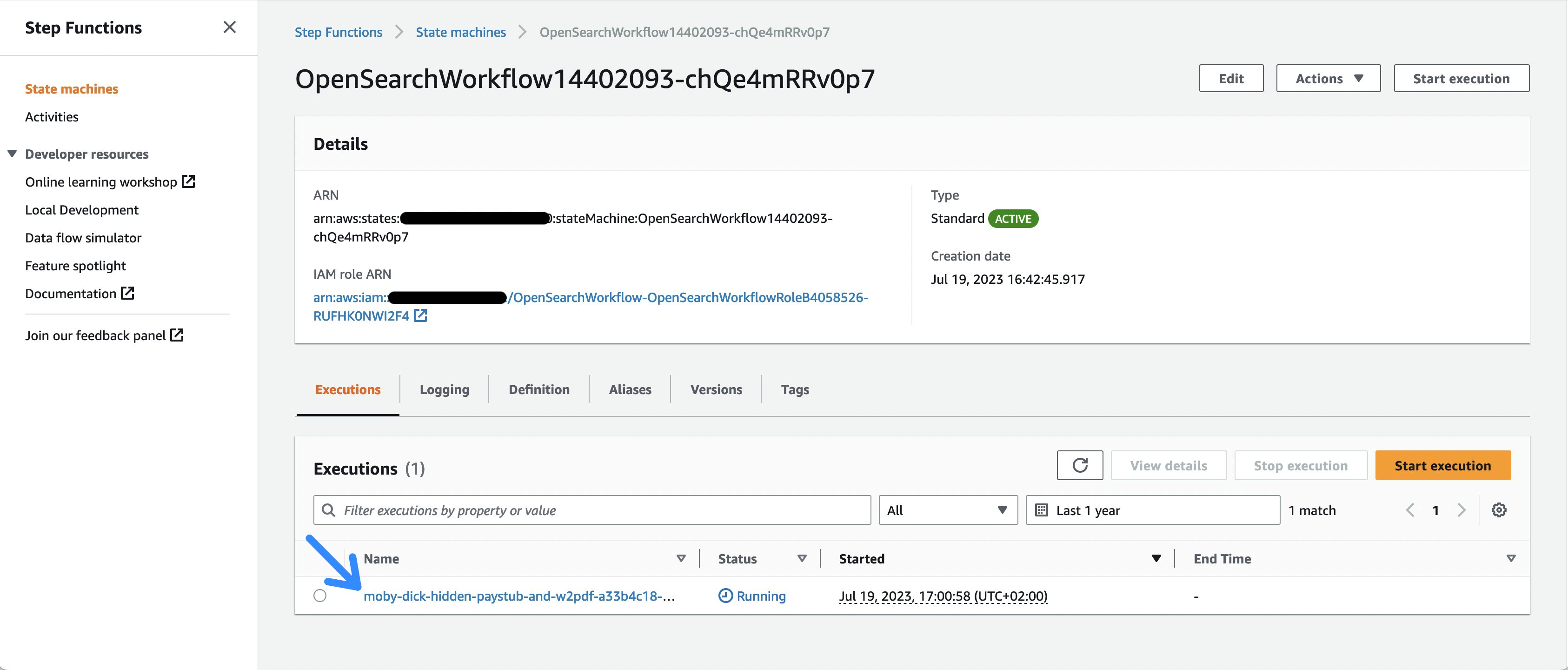

- Dopo aver selezionato il collegamento al flusso di lavoro StepFunction o aver aperto la Console di gestione AWS e aver visitato la pagina del servizio Step Functions, puoi esaminare le diverse invocazioni del flusso di lavoro.

Figura 2: elenco delle esecuzioni di Step Functions

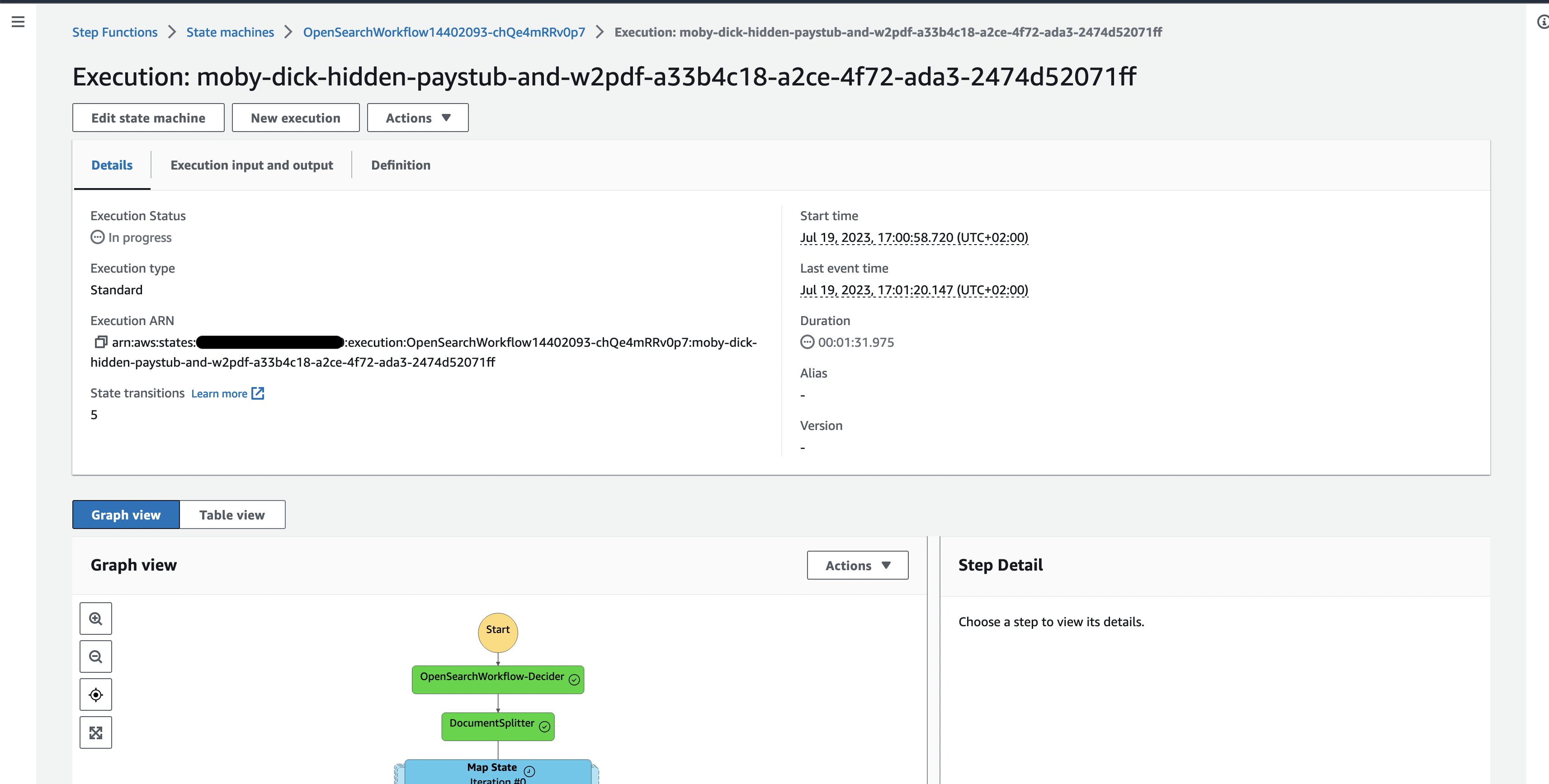

- Dai un'occhiata all'esecuzione del documento di esempio attualmente in esecuzione, dove puoi seguire l'esecuzione delle singole attività del flusso di lavoro.

Figura 3: esecuzione del flusso di lavoro delle funzioni passo-passo di un documento

Cerca

Una volta terminato il processo, possiamo verificare che il documento sia indicizzato nell'indice OpenSearch.

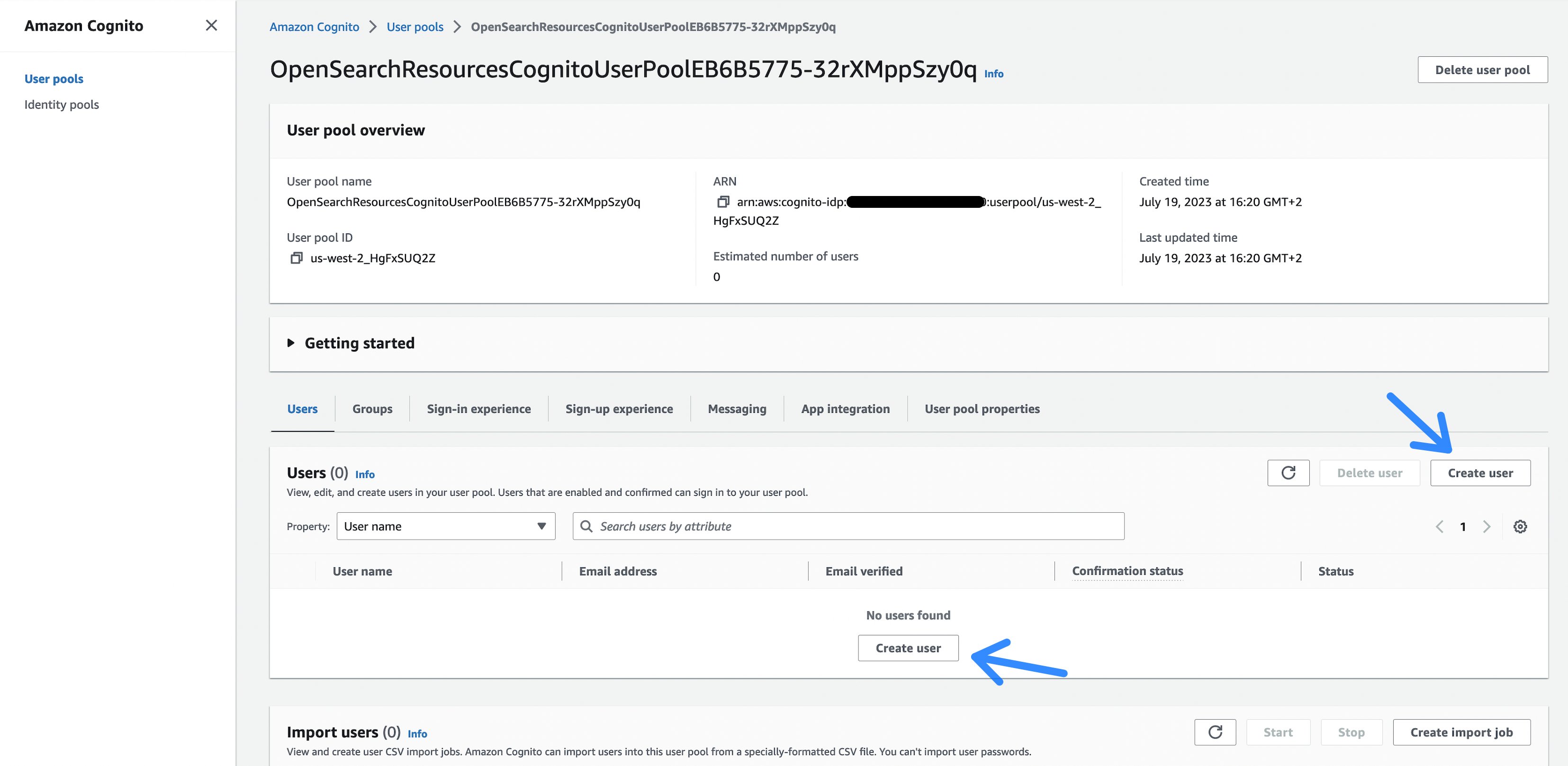

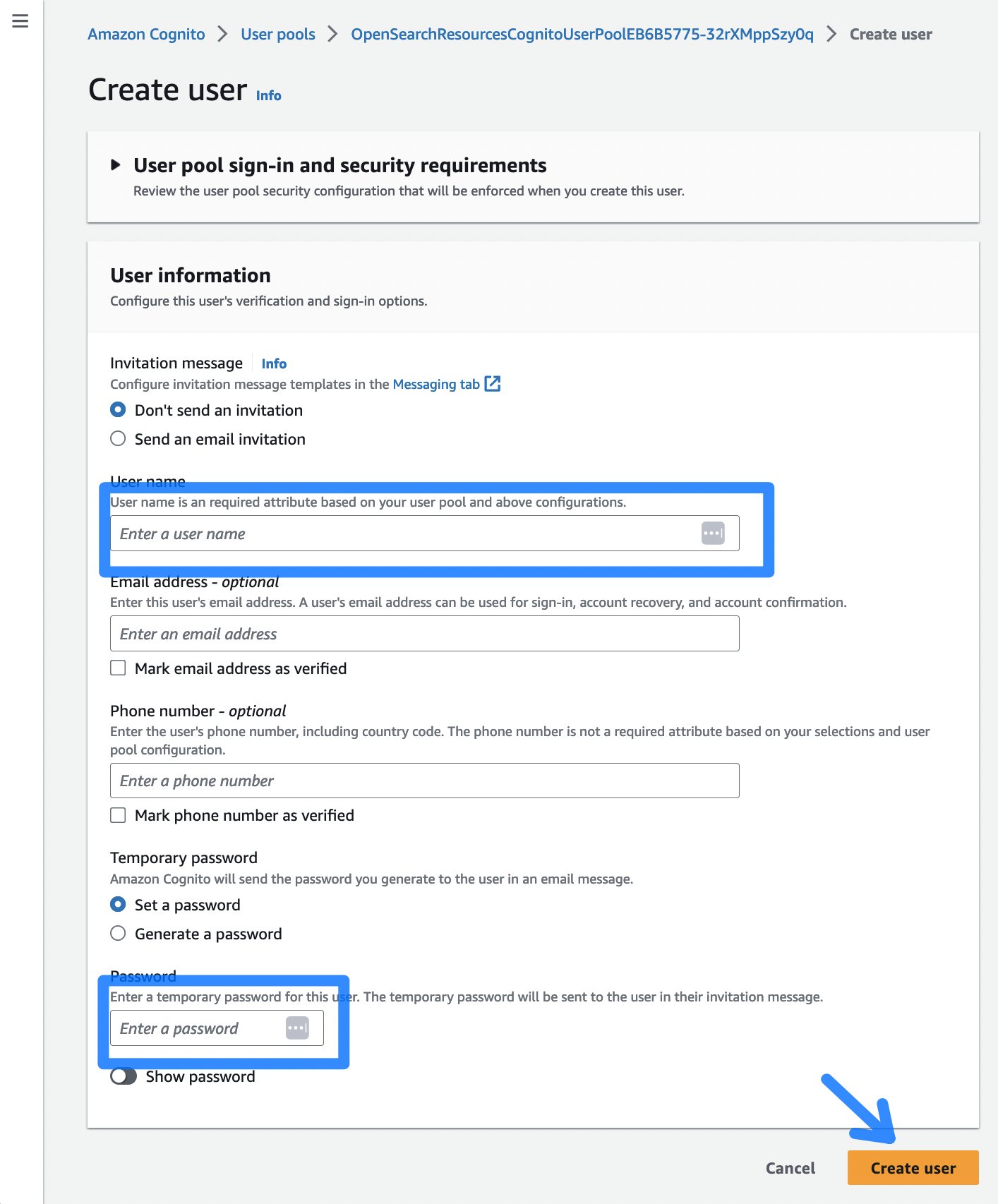

- Per fare ciò, creiamo prima un utente Amazon Cognito. Amazon Cognito viene utilizzato per l'autenticazione degli utenti rispetto all'indice OpenSearch. Seleziona il collegamento nell'output del cdk deploy (o guarda il file AWS CloudFormazione output nella Console di gestione AWS) denominato OpenSearchWorkflow.CognitoUserPoolLink.

Figura 4: il pool di utenti Cognito

- Quindi, selezionare il Creare un utente pulsante, che ti indirizza a una pagina per inserire un nome utente e una password per accedere alla dashboard di OpenSearch.

Figura 5: la finestra di dialogo per la creazione dell'utente di Cognito

- Dopo aver scelto Creare un utente, puoi continuare alla dashboard di OpenSearch facendo clic su OpenSearchWorkflow.OpenSearchDashboard dall'output della distribuzione CDK. Accedi utilizzando il nome utente e la password precedentemente creati. La prima volta che accedi devi cambiare la password.

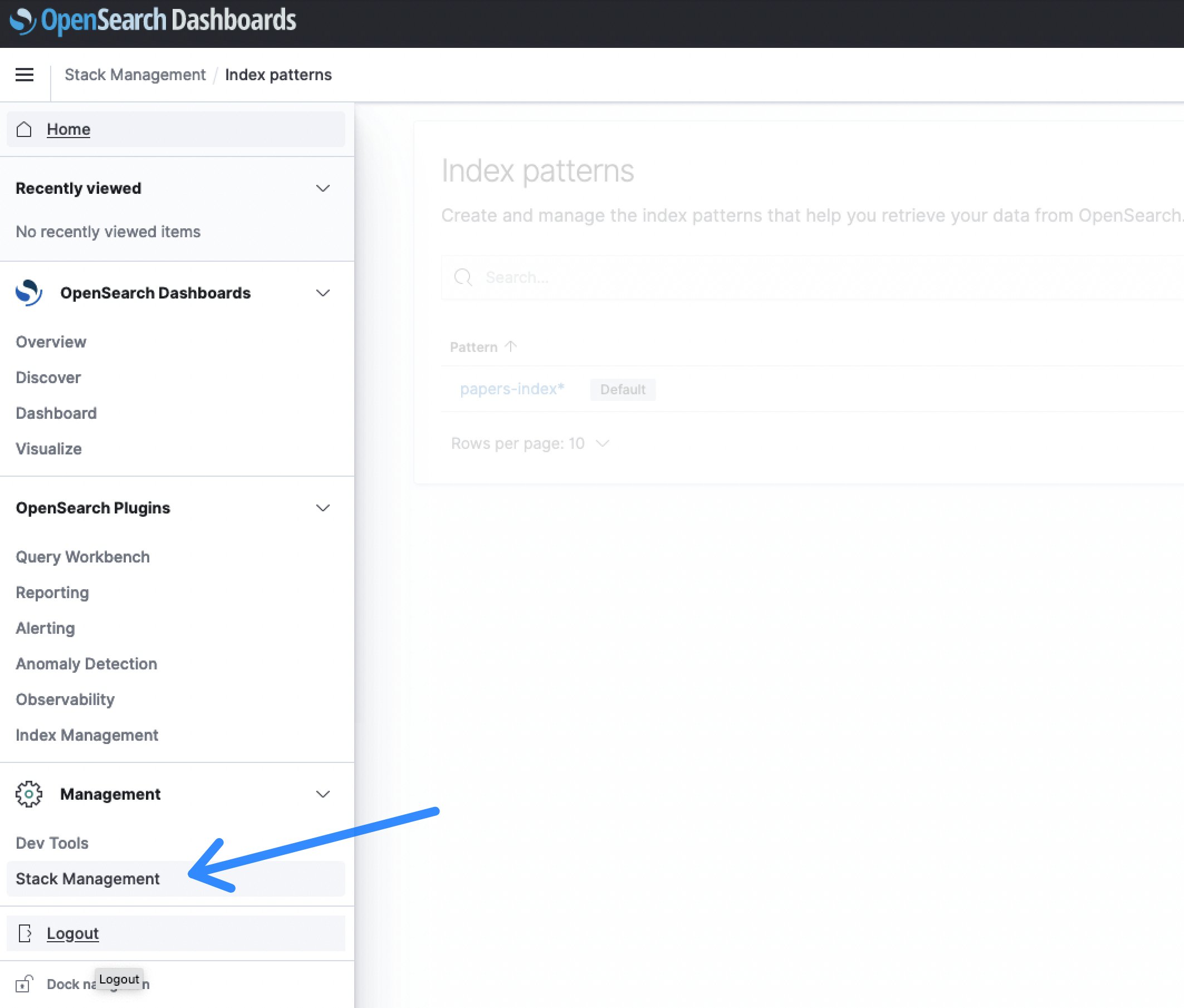

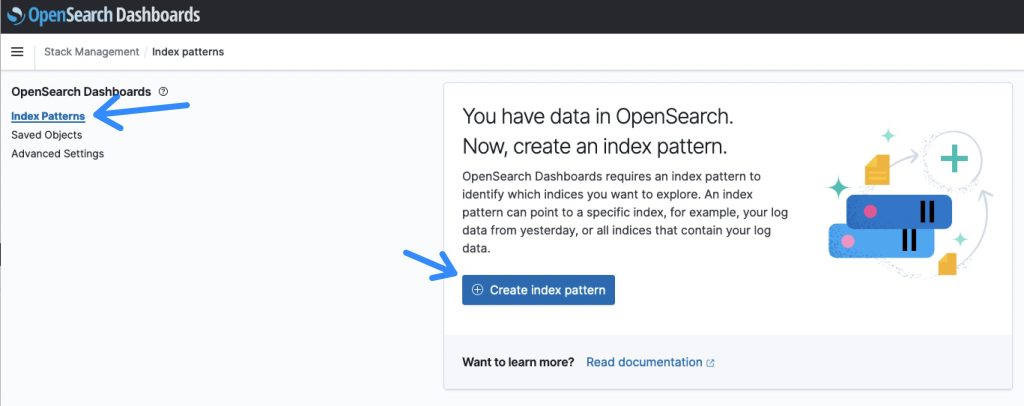

- Una volta effettuato l'accesso alla dashboard di OpenSearch, seleziona Gestione della pila sezione, seguita da Modello di indices per creare un indice di ricerca.

Figura 6: gestione dello stack di dashboard OpenSearch

Figura 7: panoramica dei modelli di indice OpenSearch

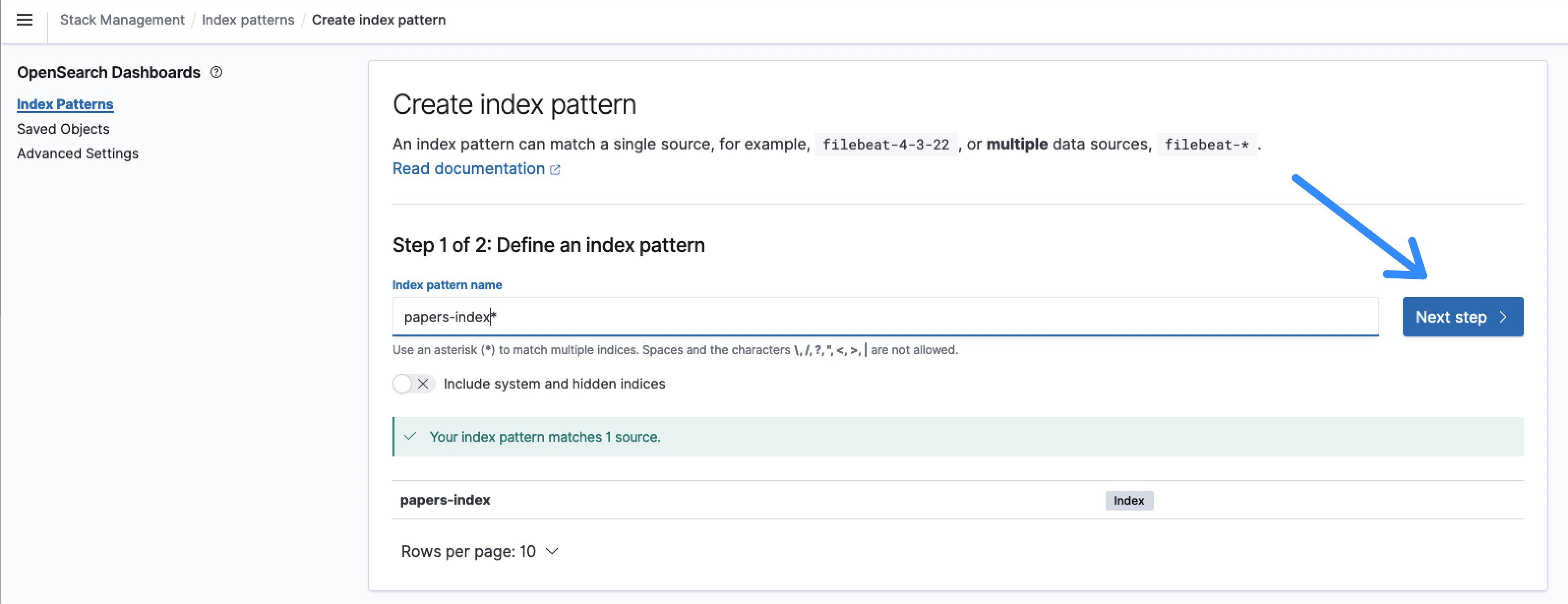

- Il nome predefinito per l'indice è indice dei documenti e un nome di modello di indice di indice dei documenti* corrisponderà a quello.

Figura 8: definizione del modello di indice OpenSearch

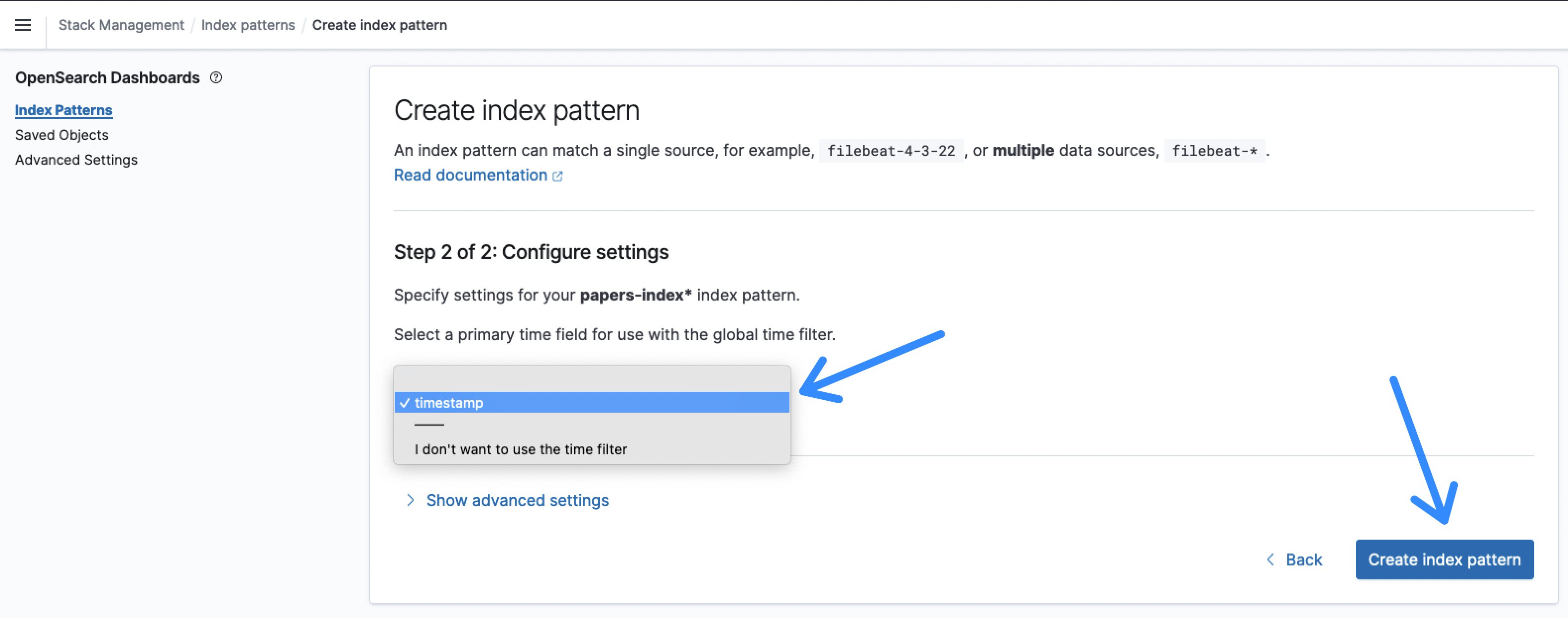

- dopo aver fatto clic Passo successivo, selezionare timestamp la Campo ora ed Crea modello di indice.

Figura 9: campo temporale del modello di indice OpenSearch

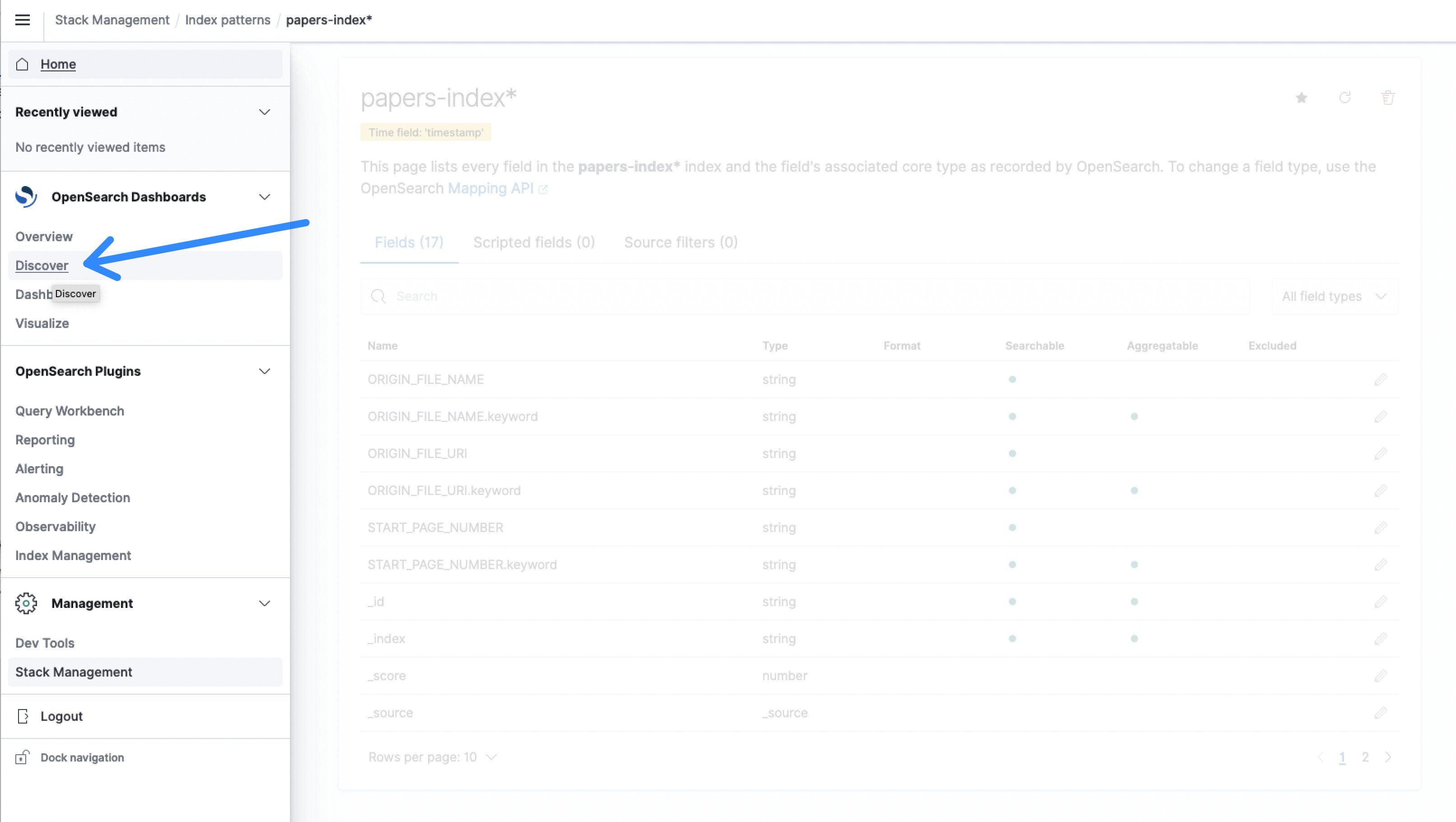

- Ora, dal menu, seleziona Scoprire.

Figura 10: OpenSearch Discover

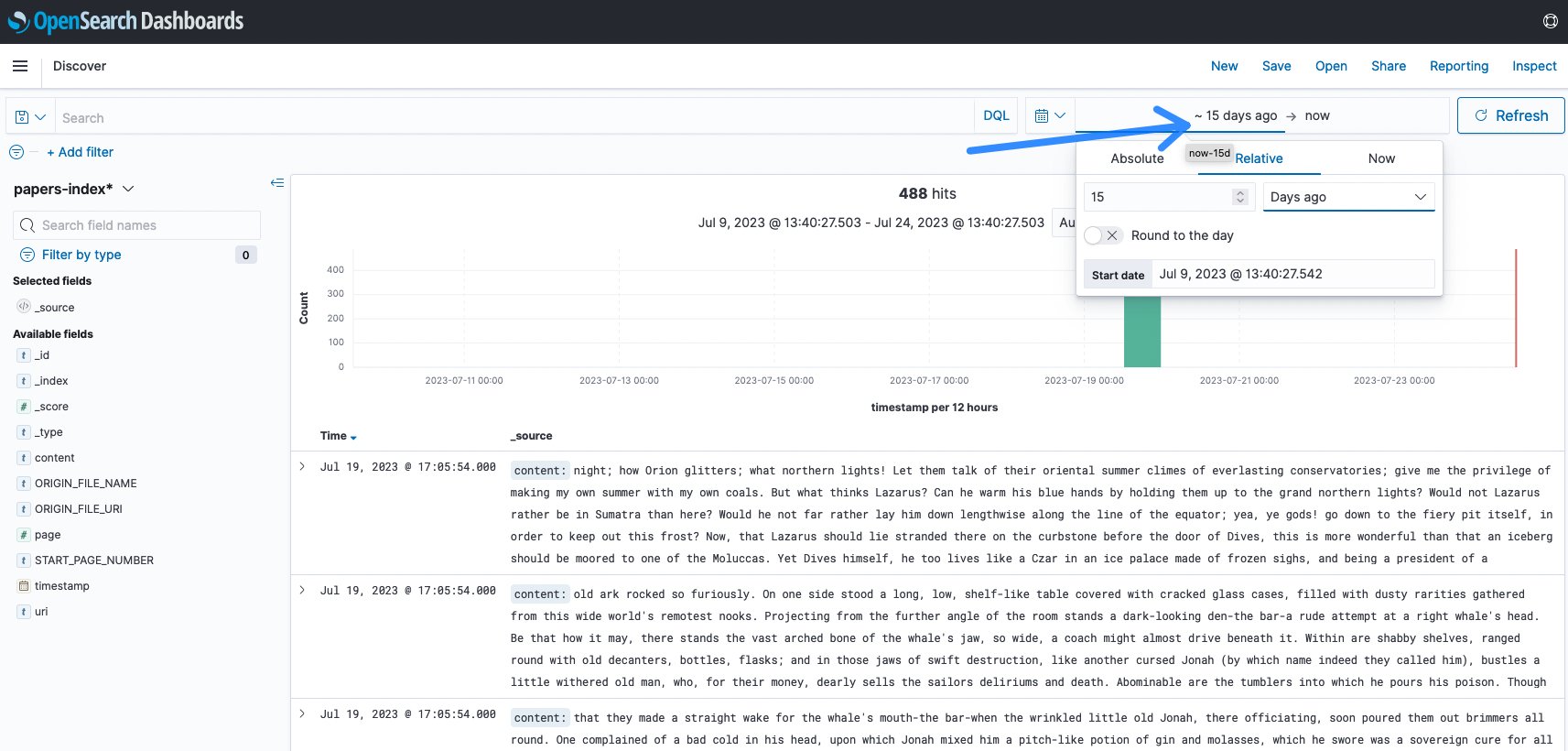

Nella maggior parte dei casi, è necessario modificare l'intervallo di tempo in base all'ultima acquisizione. Il valore predefinito è 15 minuti e spesso non è stata rilevata alcuna attività negli ultimi 15 minuti. In questo esempio, sono passati a 15 giorni per visualizzare l'acquisizione.

Figura 11: modifica dell'intervallo temporale di OpenSearch

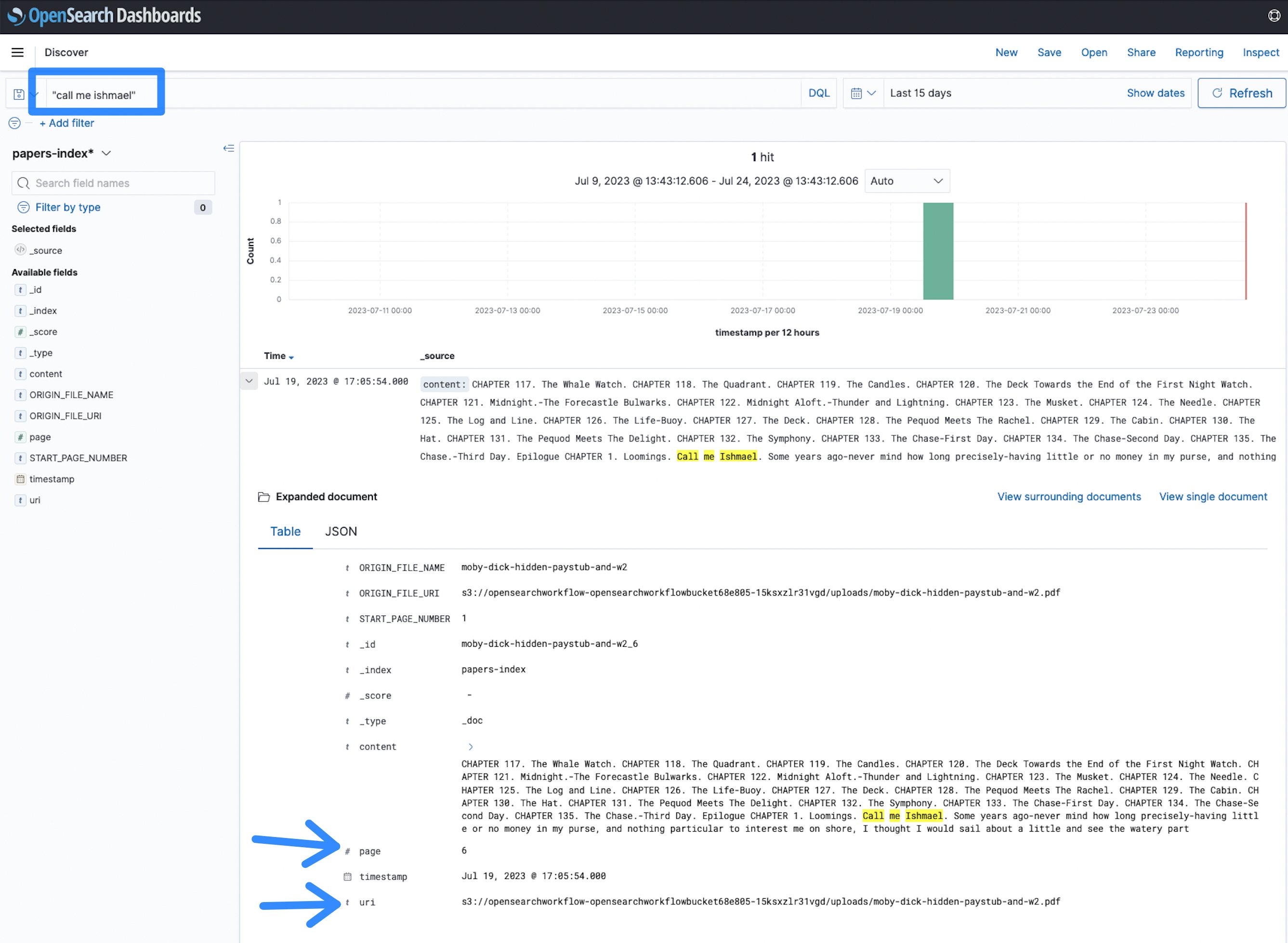

- Ora puoi iniziare a cercare. Un romanzo è stato indicizzato, puoi cercare qualsiasi termine come chiamami Ismaele e vedere i risultati.

Figura 12: termine di ricerca OpenSearch

In questo caso, il termine chiamami Ismaele appare a pagina 6 del documento in corrispondenza dell'URI (Uniform Resource Identifier) specificato, che punta alla posizione del file Amazon S3. Ciò rende più veloce identificare i documenti e trovare informazioni in un ampio corpus di documenti PDF, TIFF o immagini, rispetto a saltarli manualmente.

Esecuzione su larga scala

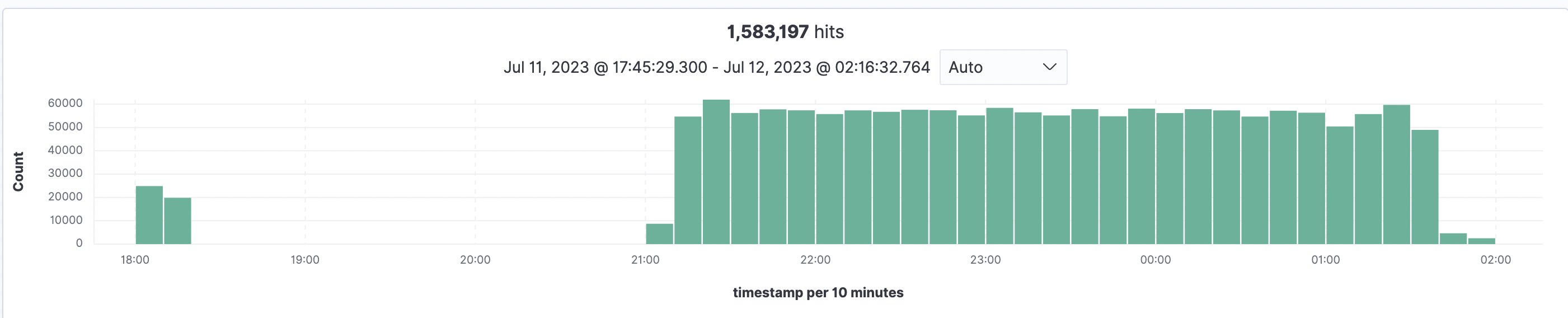

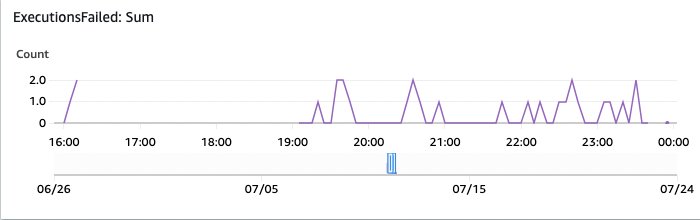

Per stimare la portata e la durata di un processo di indicizzazione, l'implementazione è stata testata con 93,997 documenti e una somma totale di 1,583,197 pagine (in media 16.84 pagine/documento e il file più grande con 3755 pagine), che sono state tutte indicizzate in OpenSearch. L'elaborazione di tutti i file e la loro indicizzazione in OpenSearch ha richiesto 5.5 ore nella regione degli Stati Uniti orientali (Virginia settentrionale – us-east-1) utilizzando l'impostazione predefinita Quote del servizio Amazon Textract. Il grafico seguente mostra un test iniziale alle 18:00 seguito dall'acquisizione principale alle 21:00 e il tutto completato entro le 2:30.

Figura 13: panoramica dell'indicizzazione di OpenSearch

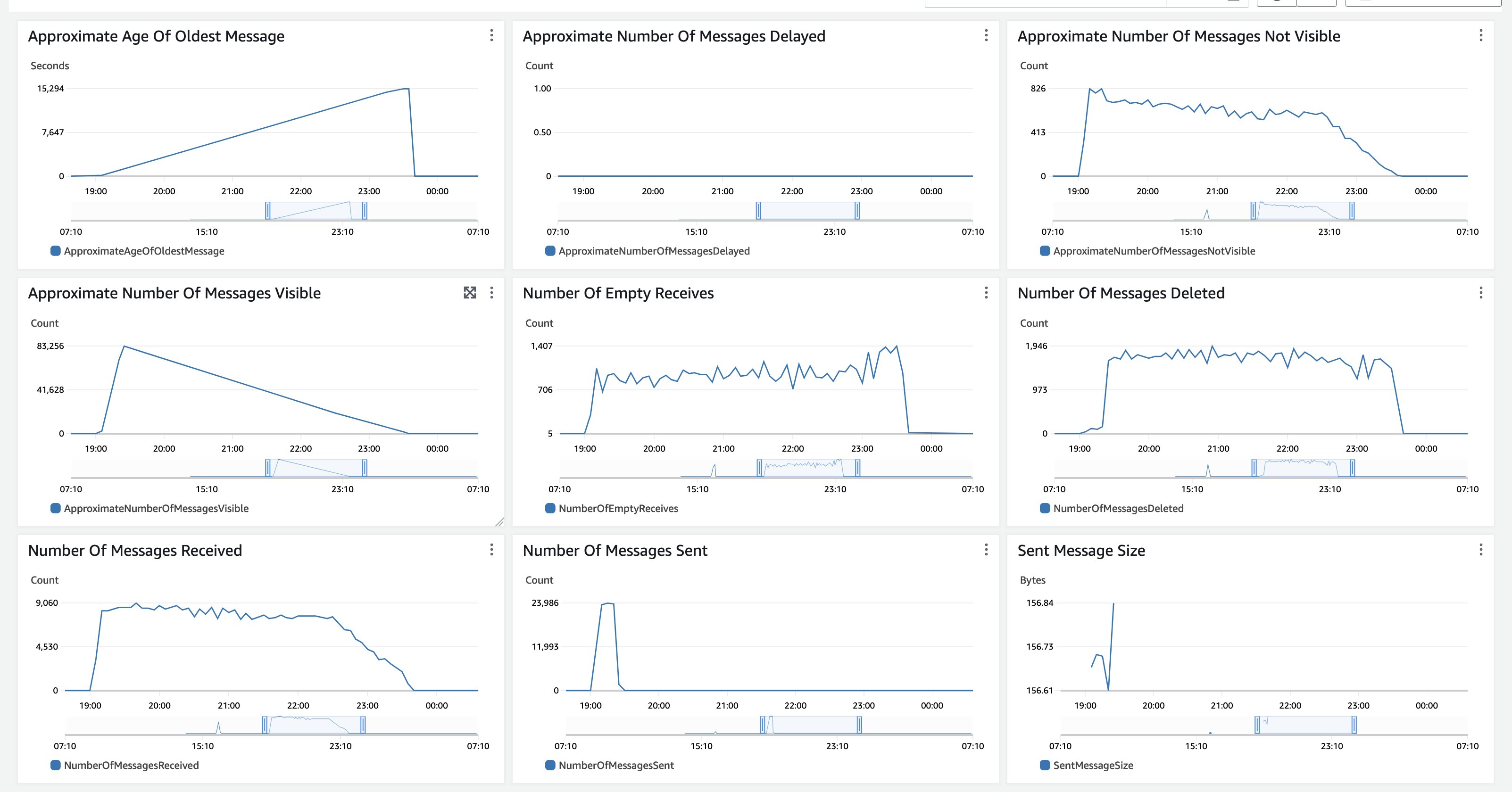

Per l'elaborazione, il tcdk.SFExecutionsStartThrottle era impostato su un executions_concurrency_threshold=550, il che significa che i flussi di lavoro di elaborazione documenti simultanei sono limitati a 550 e le richieste in eccesso vengono accodate a un Amazon SQS Coda FIFO (Fist-In-First-Out), che viene successivamente svuotata al termine dei flussi di lavoro correnti. La soglia di 550 si basa sulla quota Textract Service di 600 nella regione us-east-1. Pertanto, la profondità della coda e l'età del messaggio più vecchio sono parametri che vale la pena monitorare.

Figura 14: monitoraggio di Amazon SQS

In questo test, tutti i documenti sono stati caricati su Amazon S3 contemporaneamente, quindi il file Numero approssimativo di messaggi visibili ha un forte aumento e poi un lento declino poiché non vengono acquisiti nuovi documenti. IL Età approssimativa del messaggio più vecchio aumenta finché tutti i messaggi non vengono elaborati. L'Amazzonia SQS Periodo di conservazione del messaggio è fissato a 14 giorni. Per un'elaborazione del backlog molto lunga che potrebbe superare i 14 giorni di elaborazione, iniziare con l'elaborazione di un sottoinsieme più piccolo di documenti rappresentativi e monitorare la durata dell'esecuzione per stimare quanti documenti è possibile trasferire prima di superare i 14 giorni. I parametri Amazon SQS CloudWatch sembrano simili per un caso d'uso di elaborazione di un ampio backlog di documenti, che viene acquisito immediatamente e quindi elaborato completamente. Se il tuo caso d'uso è un flusso costante di documenti, entrambe le metriche, il Numero approssimativo di messaggi visibili e la Età approssimativa del messaggio più vecchio sarà più lineare. È inoltre possibile utilizzare il parametro soglia per combinare un carico costante con l'elaborazione del backlog e allocare la capacità in base alle proprie esigenze di elaborazione.

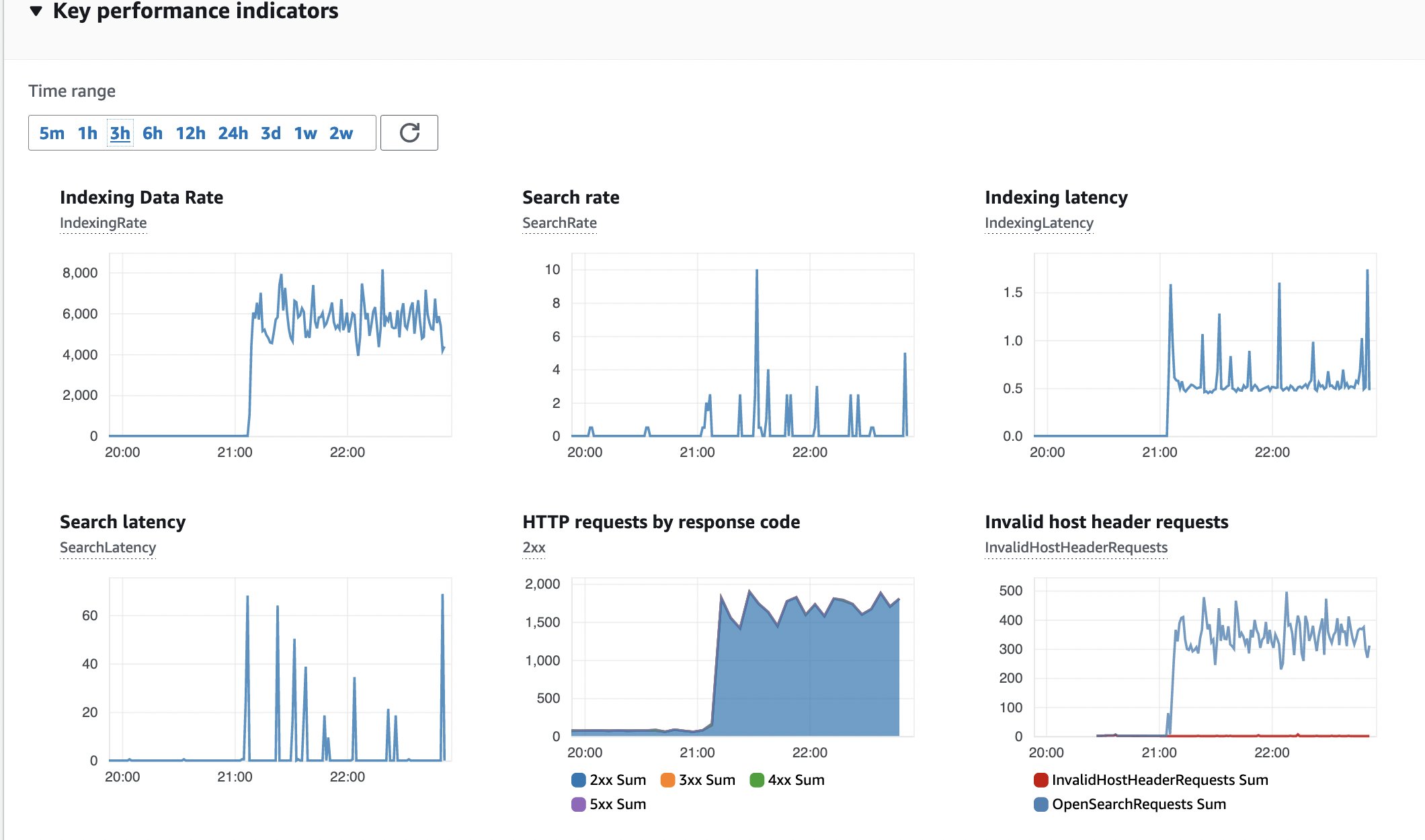

Un altro parametro da monitorare è lo stato del cluster OpenSearch, che dovresti impostare in base al Best practice operative per Amazon OpenSearch Service. La distribuzione predefinita utilizza istanze m6g.large.search.

Figura 15: monitoraggio OpenSearch

Ecco un'istantanea degli indicatori chiave di prestazione (KPI) per il cluster OpenSearch. Nessun errore, velocità dati e latenza di indicizzazione costanti.

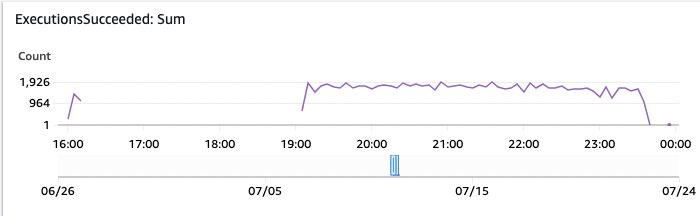

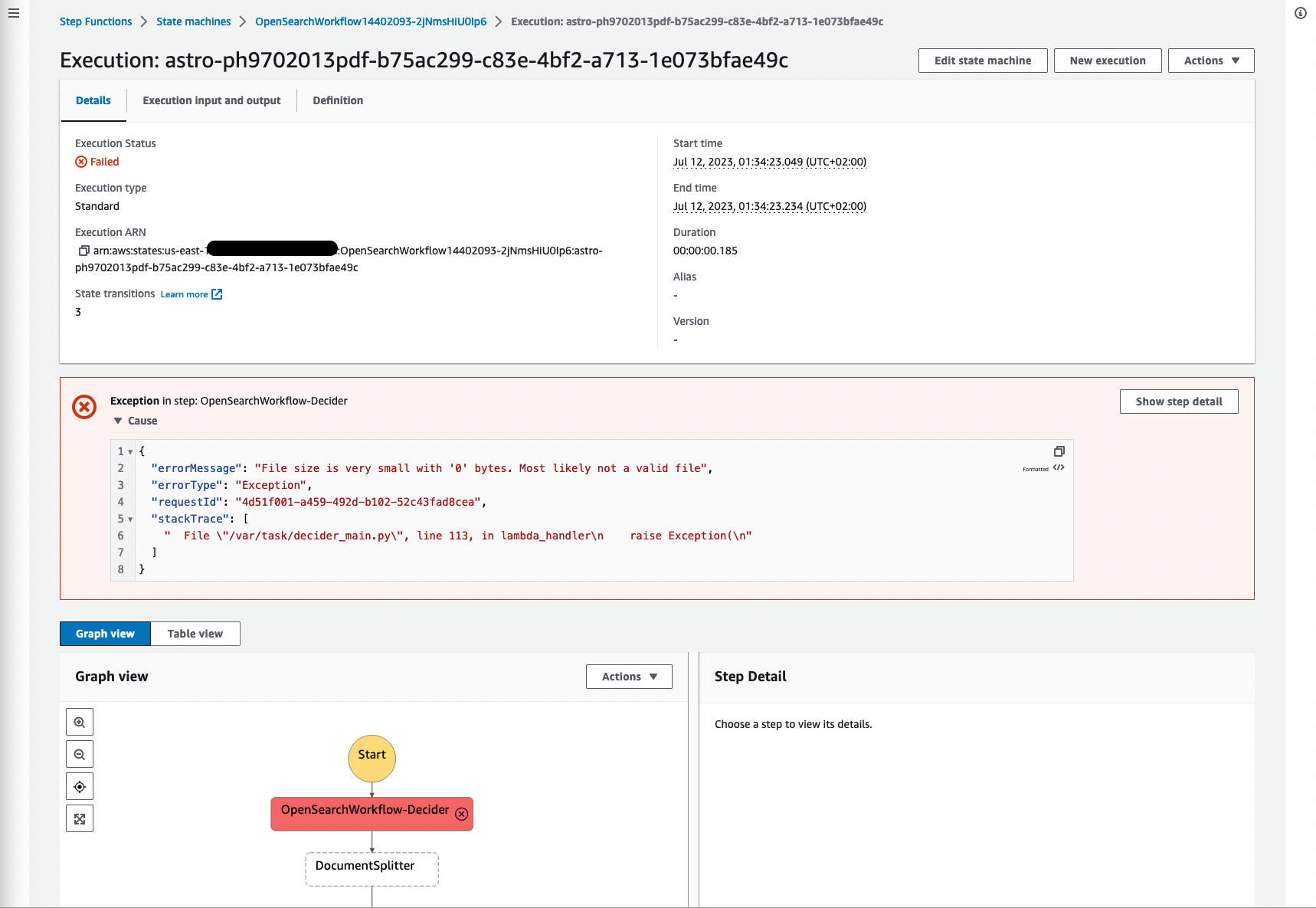

Le esecuzioni del flusso di lavoro Step Functions mostrano lo stato di elaborazione per ogni singolo documento. Se vedi esecuzioni in fallito stato, quindi seleziona i dettagli. Un buon parametro da monitorare è l'AWS Dashboard automatica di CloudWatch per Step Functions, che espone alcuni dei file Passaggio Funzioni dei parametri CloudWatch.

Figura 16: funzioni di passaggio che monitorano le esecuzioni riuscite

In questo grafico della dashboard di AWS CloudWatch puoi vedere le esecuzioni riuscite di Step Functions nel tempo.

Figura 17: esecuzioni di monitoraggio di OpenSearch non riuscite

E questo mostra le esecuzioni fallite. Vale la pena esaminarli attraverso la panoramica delle funzioni Step della console AWS.

La schermata seguente mostra un esempio di esecuzione non riuscita a causa della dimensione del file di origine pari a 0, il che ha senso perché il file non ha contenuto e non può essere elaborato. È importante filtrare i processi non riusciti e visualizzare gli errori, in modo da poter tornare al documento di origine e convalidare la causa principale.

Figura 18: flusso di lavoro Step Functions non riuscito

Altri errori potrebbero includere documenti che non sono di tipo MIME: application/pdf, image/png, image/jpeg o image/tiff perché altri tipi di documenti non sono supportati da Amazon Textract.

Costo

Il costo totale dell'acquisizione di 1,583,278 pagine è stato suddiviso tra i servizi AWS utilizzati per l'implementazione. L'elenco seguente funge da numeri approssimativi, poiché i costi effettivi e la durata dell'elaborazione variano a seconda delle dimensioni dei documenti, del numero di pagine per documento, della densità delle informazioni nei documenti e della regione AWS. Amazon DynamoDB consumava $ 0.55, Amazon S3 $ 3.33, OpenSearch Service $ 14.71, Step Functions $ 17.92, AWS Lambda $ 28.95 e Amazon Textract $ 1,849.97. Inoltre, tieni presente che il cluster Amazon OpenSearch Service distribuito viene fatturato su base oraria e accumulerà costi più elevati se eseguito per un periodo di tempo.

modifiche

Molto probabilmente, desideri modificare l'implementazione e personalizzarla in base al tuo caso d'uso e ai tuoi documenti. L'officina Utilizza il machine learning per automatizzare ed elaborare documenti su larga scala presenta una buona panoramica su come manipolare i flussi di lavoro effettivi, modificando il flusso e aggiungendo nuovi componenti. Per aggiungere campi personalizzati all'indice OpenSearch, guarda il file ImpostaMetaData attività nel flusso di lavoro utilizzando il file set-manifest-meta-data-opensearch Funzione AWS Lambda per aggiungere metadati al contesto, che verrà aggiunto come campo all'indice OpenSearch. Qualsiasi informazione sui metadati diventerà parte dell'indice.

Pulire

Elimina le risorse di esempio se non ti servono più, per evitare di incorrere in costi futuri utilizzando il comando seguente:

nello stesso ambiente del cdk deploy comando. Fai attenzione perché questo rimuove tutto, incluso il cluster OpenSearch, tutti i documenti e il bucket Amazon S3. Se desideri conservare tali informazioni, esegui il backup del tuo bucket Amazon S3 e crea uno snapshot dell'indice dal tuo cluster OpenSearch. Se hai elaborato molti file, potresti dover prima svuotare il bucket Amazon S3 utilizzando la Console di gestione AWS (ovvero, dopo aver eseguito un backup o sincronizzato i file con un bucket diverso se desideri conservare le informazioni), poiché la funzione di pulizia può scadere e quindi distruggere lo stack AWS CloudFormation.

Conclusione

In questo post, ti abbiamo mostrato come distribuire una soluzione full stack per inserire un gran numero di documenti in un indice OpenSearch, pronti per essere utilizzati per casi d'uso di ricerca. Sono stati discussi i singoli componenti dell'implementazione, nonché considerazioni sulla scalabilità, i costi e le opzioni di modifica. Tutto il codice è accessibile come OpenSource su GitHub as Esempi di CDK IDP e come Costrutti IDP CDK per costruire le tue soluzioni da zero. Come passaggio successivo puoi iniziare a modificare il flusso di lavoro, aggiungere informazioni ai documenti nell'indice di ricerca ed esplorare il file Laboratorio IDP. Commenta di seguito la tua esperienza e le tue idee per espandere la soluzione attuale.

L'autore

Martin Schade è una Senior ML Product SA con il team di Amazon Texttract. Ha oltre 20 anni di esperienza con tecnologie, soluzioni ingegneristiche e di architettura relative a Internet. È entrato in AWS nel 2014, prima guidando alcuni dei più grandi clienti AWS sull'uso più efficiente e scalabile dei servizi AWS, e successivamente si è concentrato su AI/ML con particolare attenzione alla visione artificiale. Attualmente è ossessionato dall'estrazione di informazioni dai documenti.

Martin Schade è una Senior ML Product SA con il team di Amazon Texttract. Ha oltre 20 anni di esperienza con tecnologie, soluzioni ingegneristiche e di architettura relative a Internet. È entrato in AWS nel 2014, prima guidando alcuni dei più grandi clienti AWS sull'uso più efficiente e scalabile dei servizi AWS, e successivamente si è concentrato su AI/ML con particolare attenzione alla visione artificiale. Attualmente è ossessionato dall'estrazione di informazioni dai documenti.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/implement-smart-document-search-index-with-amazon-textract-and-amazon-opensearch/

- :ha

- :È

- :non

- :Dove

- $3

- $ SU

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 17

- 20

- 20 anni

- 200

- 2014

- 216

- 220

- 25

- 30

- 3000

- 32

- 33

- 7

- 700

- 8

- 820

- 84

- 9

- a

- WRI

- accesso

- accessibile

- Accedendo

- Secondo

- Il mio account

- Accumulare

- precisione

- operanti in

- attività

- presenti

- aggiungere

- aggiunto

- l'aggiunta di

- Aggiunge

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- AI / ML

- Tutti

- assegnare

- consentire

- anche

- Amazon

- Amazzonia Cognito

- Servizio Amazon OpenSearch

- Testo Amazon

- Amazon Web Services

- an

- analista

- ed

- in qualsiasi

- api

- appare

- approssimativo

- SONO

- in giro

- AS

- At

- Autenticazione

- automatizzare

- Automatico

- automaticamente

- disponibile

- media

- evitare

- AWS

- AWS CloudFormazione

- AWS Lambda

- Console di gestione AWS

- precedente

- BACKEND

- di riserva

- base

- basato

- BE

- perché

- diventare

- prima

- essendo

- sotto

- MIGLIORE

- best practice

- Meglio

- Guardarsi da

- Bloccare

- entrambi

- costruire

- pulsante

- by

- Bandi

- Materiale

- funzionalità

- Ultra-Grande

- Custodie

- casi

- Causare

- CD

- il cambiamento

- cambiato

- cambiando

- dai un'occhiata

- la scelta

- classificazione

- Cloud

- Cluster

- codice

- collezione

- combina

- commento

- Aziende

- rispetto

- Bussola

- competitivo

- componenti

- computer

- Visione computerizzata

- concetti

- concorrente

- Configurazione

- configurato

- collegato

- Considerazioni

- consiste

- consolle

- costante

- costruire

- Contenitore

- contenuto

- contesto

- continua

- contratti

- correggere

- Costo

- Costi

- potuto

- accoppiato

- coprire

- creare

- creato

- crea

- critico

- Corrente

- Attualmente

- costume

- cliente

- Clienti

- personalizzabile

- personalizzare

- cruscotto

- cruscotti

- dati

- Giorni

- affare

- Rifiuta

- Predefinito

- definire

- definizione

- dimostrare

- dipendenze

- Dipendente

- schierare

- schierato

- deployment

- profondità

- distruggere

- dettagli

- Mercato

- dialogo

- diverso

- digitale

- DIGITAL TRANSFORMATION

- scopri

- discusso

- visualizzazione

- immersione

- do

- docker

- documento

- documenti

- fatto

- drenato

- dovuto

- durata

- e

- ogni

- est

- bordo

- efficiente

- in modo efficiente

- sforzo

- Dipendente

- e potenza

- enable

- Ingegneria

- enorme

- arricchire

- arricchito

- entrare

- Ambiente

- epoca

- errori

- particolarmente

- sviluppate

- stima

- Anche

- qualunque cosa

- esempio

- superare

- superiore

- eccesso

- esecuzione

- Espandere

- esperienza

- esplora

- estratto

- fallito

- FAST

- più veloce

- campo

- campi

- figura

- Compila il

- File

- filtro

- finale

- finanziario

- Trovate

- sottile

- punta delle dita

- finire

- Nome

- primi passi

- prima volta

- flusso

- Focus

- concentrato

- seguire

- seguito

- i seguenti

- Nel

- formato

- da

- pieno

- Stack completo

- completamente

- function

- funzioni

- futuro

- Generale

- generato

- genera

- ottenere

- gigante

- GitHub

- dato

- Go

- andando

- buono

- grafico

- guida

- cintura da arrampicata

- Avere

- avendo

- he

- Salute e benessere

- aiuta

- Alta

- superiore

- vivamente

- ora

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- umano

- Risorse umane

- i

- idee

- identificatore

- identificare

- Identità

- ids

- if

- Immagine

- realizzare

- implementazione

- implementato

- importare

- importante

- in

- includere

- Compreso

- Aumento

- Aumenta

- Index

- indicizzati

- individuale

- informazioni

- Infrastruttura

- inizialmente

- avviare

- ingresso

- intuizioni

- install

- esempio

- integrato

- Intelligente

- Elaborazione intelligente dei documenti

- ai miglioramenti

- indagando

- invocato

- IT

- congiunto

- viaggio

- jpg

- json

- mantenere

- Le

- grandi

- maggiore

- Cognome

- Latenza

- dopo

- IMPARARE

- apprendimento

- Biblioteca

- piace

- probabile

- LINK

- Collegamento

- Lista

- caricare

- località

- registrati

- accesso

- Lunghi

- più a lungo

- Guarda

- cerca

- SEMBRA

- macchina

- machine learning

- fatto

- Principale

- mantenere

- Mantenere

- make

- FA

- gestione

- manualmente

- molti

- partita

- massimo

- Maggio..

- me

- si intende

- Menu

- messaggio

- messaggi

- metodi

- metrico

- Metrica

- forza

- mente

- Minuti

- scelta

- ML

- moderno

- modificare

- Monitorare

- monitoraggio

- Scopri di più

- maggior parte

- La Montagna

- multiplo

- Nome

- Detto

- navigazione

- Bisogno

- esigenze

- New

- GENERAZIONE

- no

- notifica

- notifiche

- romanzo

- numero

- numeri

- of

- offrire

- di frequente

- il più vecchio

- on

- una volta

- ONE

- aprire

- opensource

- Opportunità

- ottimizzati

- Opzioni

- or

- minimo

- organizzazione

- origine

- Altro

- altrimenti

- su

- produzione

- ancora

- panoramica

- proprio

- pagina

- pagine

- Parallel

- parametro

- parte

- passare

- Password

- Cartamodello

- modelli

- Pagamento

- per

- performance

- periodo

- permessi

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- punto

- punti

- pool

- possibile

- Post

- pratiche

- prepara

- prerequisiti

- presents

- in precedenza

- processi

- Elaborato

- i processi

- lavorazione

- produrre

- Prodotto

- Programmazione

- proposto

- fornisce

- pubblicato

- scopo

- Spingi

- metti

- mette

- Python

- Presto

- rapidamente

- tasso

- pronto

- regione

- Report

- deposito

- rappresentante

- richieste

- necessario

- Requisiti

- risorsa

- Risorse

- di risposta

- colpevole

- Risultati

- conservare

- ruoli

- radice

- Correre

- running

- SA

- stesso

- scalabile

- Scala

- scala

- graffiare

- senza soluzione di continuità

- Cerca

- ricerca

- Sezione

- vedere

- cerca

- Selezione

- anziano

- senso

- inviato

- serve

- servizio

- Servizi

- set

- impostazioni

- flessibile.

- dovrebbero

- mostrare attraverso le sue creazioni

- ha mostrato

- Spettacoli

- simile

- Un'espansione

- Taglia

- rallentare

- inferiore

- smart

- Istantanea

- So

- soluzione

- Soluzioni

- alcuni

- Fonte

- specifico

- velocità

- Spin

- dividere

- pila

- inizia a

- iniziato

- Di partenza

- Regione / Stato

- stati

- Stato dei servizi

- costante

- step

- Passi

- Ancora

- conservazione

- Tornare al suo account

- memorizzare

- inviare

- Successivamente

- di successo

- tale

- supportato

- supporti

- sicuro

- SISTEMI DI TRATTAMENTO

- su misura

- Fai

- prende

- presa

- Task

- task

- team

- Tecnologie

- modelli

- termine

- condizioni

- test

- testato

- testo

- che

- Il

- Il grafo

- le informazioni

- L’ORIGINE

- Lo Stato

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- anche se?

- soglia

- Attraverso

- a

- tempo

- richiede tempo

- a

- ha preso

- Totale

- tradizionale

- Trasformazione

- innescato

- lezione

- seconda

- Digitare

- Tipi di

- per

- inaudito

- fino a quando

- caricato

- us

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilizza

- CONVALIDARE

- APPREZZIAMO

- versione

- molto

- visualizzazioni

- Virginia

- visione

- visualizzare

- volume

- volumi

- volere

- Prima

- Modo..

- we

- sito web

- servizi web

- WELL

- sono stati

- Che

- quando

- quale

- volere

- con

- flusso di lavoro

- flussi di lavoro

- lavori

- laboratorio

- Corsi

- valore

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro