By Kenna Hughes-Castleberry pubblicato il 02 dicembre 2022

Grazie ai progressi della tecnologia, sta diventando sempre più difficile distinguere cosa è reale e cosa no. Questo problema è peggiorato con l'uso della tecnologia deepfake—audio e video che utilizzano l'intelligenza artificiale per sostituire gli individui o le loro voci. Mentre molti deepfake sono stati usati con successo per l'intrattenimento (come if Nicholas Cage era nel I predatori dell'arca perduta) o giochi (come in Atleti Fifa), una grande percentuale di essi è stata creata per più ragioni sinistre. Man mano che diventa più facile creare questi video ritoccati, molti esperti sperano che il calcolo quantistico possa aiutare a superare le potenziali minacce di questa tecnologia in ascesa.

Come funziona la tecnologia Deepfake?

Per creare un video deepfake di successo, è necessario machine learning algoritmi. "Gli algoritmi di deep learning insegnano a se stessi come risolvere i problemi da grandi set di dati, e poi vengono utilizzati per scambiare volti attraverso video e altri contenuti digitali", ha spiegato Post-quantistico CEO Andersen Cheng. Post-Quantum è una delle principali società di sicurezza informatica il cui focus è su quanto-resistente sicurezza, anche contro i deepfake. "Esistono diversi metodi per creare questi deepfake", ha affermato Cheng, "ma il più popolare è l'utilizzo di reti neurali profonde che coinvolgono gli autoencoder. Un codificatore automatico è un programma di intelligenza artificiale di deep learning che studia i video clip per capire come appare una persona da più angolazioni e dall'ambiente circostante, quindi mappa quella persona sull'individuo trovando caratteristiche comuni.

Una tecnologia deepfake installata (PC Wikimedia Commons)

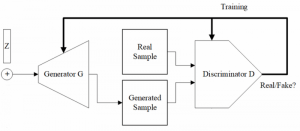

Per garantire che l'autoencoder funzioni correttamente, è necessario analizzare più clip video del volto del soggetto per fornire un pool di dati più ampio. Quindi l'autoencoder può aiutare a creare un video composito scambiando l'individuo originale con il nuovo soggetto. Un secondo tipo di machine learning chiamato General Adversarial Network (GAN) rileverà e migliorerà i difetti nel nuovo video composito. Secondo a Articolo del 2022: "I GAN addestrano un 'generatore' per creare nuove immagini dalla rappresentazione latente dell'immagine sorgente e un 'discriminatore' per valutare il realismo dei materiali generati." Questo processo si verifica più volte fino a quando il discriminatore non è in grado di stabilire se il video è falsificato e il deepfake è completo.

La minaccia della tecnologia Deepfake

Attualmente, ci sono molti software open source o app gratuite che le persone possono utilizzare per creare deepfake. Anche se questo può sembrare vantaggioso per molti, specialmente quelli dell'industria dell'intrattenimento, ha portato ad alcuni seri problemi, persino criminali. Secondo a Rapporto Deeptrace, il 96% dei video deepfake online nel 2019 erano, non a caso, pornografia. Mentre molti di questi video illeciti sono stati realizzati per vendicarsi di un ex, altri sono stati utilizzati per creare scandali per celebrità femminili e persino politici. Nel 2018 è stato rilasciato un video deepfake da a Partito politico belga mostra l'allora presidente Trump che discute degli accordi sul clima di Parigi. Con le notizie false che stanno già diventando un problema per il grande pubblico, i video deepfake potrebbero essere la goccia che fa traboccare il vaso. Persino audio profondo sta scatenando il caos, come un file audio falsificato dal CEO di un'azienda tecnologica ha contribuito a commettere un atto fraudolento. Per Cheng, questi tipi di media possono logorare la fiducia del pubblico piuttosto rapidamente. "Abbiamo la questione più ampia della fiducia della società: come il pubblico sarà in grado di discernere tra ciò che è reale e ciò che è un deepfake", ha aggiunto Cheng. "Come abbiamo visto, ci sono persino prove che i deepfake vengono utilizzati per aggirare misure protettive come l'autenticazione biometrica". Con queste crescenti preoccupazioni, Cheng e il suo team di Post-Quantum credono di avere una soluzione sotto forma di Nomidio, un software specializzato per la massima sicurezza.

Preparazione per le minacce della tecnologia DeepFake

Considerando le molteplici minacce poste dal calcolo quantistico e dai deepfake, Cheng e questo team hanno creato Nomidio per garantire che le identità di accesso e persino l'autenticazione biometrica rimangano sicure. "Nomidio è un servizio biometrico multifattoriale (MFB) biometrico senza password che consente l'autenticazione sicura con un'esperienza utente semplice e intuitiva", ha affermato Cheng. "Sostituisce l'accesso basato su nome utente/password e single sign-on, con gli utenti che vengono autenticati dietro le quinte in base al loro profilo biometrico con l'autenticazione a più fattori (MFA)." Poiché Cheng è un esperto di sicurezza informatica da molti anni, si è assicurato che anche Nomidio potesse essere protetto dai deepfake. “La nostra filosofia di base durante la creazione era quella di utilizzare quanti più input aggiuntivi possibili e una vera autenticazione a più fattori (ovvero con più di due fattori), quindi è di fatto la soluzione ideale per affrontare qualsiasi sviluppo futuro nella tecnologia deepfake. Ciò è in definitiva dovuto al fatto che l'MFA tradizionale è insufficiente, ma l'MFB può rendere praticamente impossibili gli attacchi in tempo reale. Cioè, una combinazione di, ad esempio, voce, volto e un codice PIN è altamente sicura dal fatto che ogni singolo fattore può essere falsificato, ma falsificarli tutti e tre nella stessa istanza è praticamente impossibile. Con Nomidio, una combinazione di biometria vocale e facciale, riconoscimento vocale, dati dipendenti dal contesto e persino analisi comportamentale può essere combinata in un unico sistema di autenticazione. "

Sebbene Nomidio stesso non sfrutti il calcolo quantistico per superare le minacce di deepfake, i computer quantistici potrebbero potenzialmente funzionare contro questi file multimediali falsi. Come computer quantistici spesso sfruttano gli algoritmi di apprendimento automatico per lavorare più velocemente e in modo più efficiente, potrebbero essere in grado di rilevare video falsi o file audio a una velocità maggiore. Mentre la tecnologia è ancora in fase di sviluppo e pochi considerano i deepfake un potenziale caso d'uso per i computer quantistici, queste macchine di livello superiore potrebbero essere utilizzate in futuro per rendere i nostri media più veritieri e accurati.

Con le minacce della tecnologia deepfake che diventano sempre più evidenti, molti governi e aziende stanno già cercando di trovare modi per combatterla. Nel 2021, Facebook ha lanciato il Deepfake Detection Challenge, con un premio di $ 500,000 per coloro che creano nuove tecnologie per rilevare i deepfake. Negli Stati Uniti, stati come la California, il Texas e la Virginia hanno leggi che vietano l'uso del deepfake sia per la pornografia che per la politica. Il Parlamento europeo ha anche stabilito più regolamenti sui deepfake, modificando il Digital Services Act per imporre l'uso di etichette sui video deepfake. Sebbene questa legislazione non sarà effettiva fino al 2024, mostra la gravità della minaccia della tecnologia deepfake.

Kenna Hughes-Castleberry è una scrittrice presso Inside Quantum Technology e Science Communicator presso JILA (una partnership tra l'Università del Colorado Boulder e il NIST). I suoi ritmi di scrittura includono la tecnologia profonda, il metaverso e la tecnologia quantistica.