Nell'era dell'informazione di oggi, gli enormi volumi di dati contenuti in innumerevoli documenti rappresentano sia una sfida che un'opportunità per le aziende. I metodi tradizionali di elaborazione dei documenti spesso non sono all’altezza in termini di efficienza e precisione, lasciando spazio all’innovazione, all’efficienza dei costi e alle ottimizzazioni. L'elaborazione dei documenti ha visto progressi significativi con l'avvento dell'elaborazione intelligente dei documenti (IDP). Con IDP, le aziende possono trasformare i dati non strutturati provenienti da vari tipi di documenti in informazioni strutturate e utilizzabili, migliorando notevolmente l'efficienza e riducendo gli sforzi manuali. Tuttavia, il potenziale non finisce qui. Integrando l’intelligenza artificiale generativa (AI) nel processo, possiamo migliorare ulteriormente le capacità degli IDP. L’intelligenza artificiale generativa non solo introduce funzionalità migliorate nell’elaborazione dei documenti, ma introduce anche un’adattabilità dinamica al cambiamento dei modelli di dati. Questo post illustra la sinergia tra IDP e intelligenza artificiale generativa, svelando come rappresentano la prossima frontiera nell'elaborazione dei documenti.

Parleremo in dettaglio dell'IDP nella nostra serie Elaborazione intelligente dei documenti con i servizi AWS AI (Parte 1 ed Parte 2). In questo post, discutiamo come estendere un'architettura IDP nuova o esistente con modelli linguistici di grandi dimensioni (LLM). Più specificamente, discutiamo di come possiamo integrarci Testo Amazon con LangChain come caricatore di documenti e Roccia Amazzonica per estrarre dati da documenti e utilizzare capacità di intelligenza artificiale generativa all’interno delle varie fasi dell’IDP.

Amazon Textract è un servizio di machine learning (ML) che estrae automaticamente testo, grafia e dati dai documenti scansionati. Amazon Bedrock è un servizio completamente gestito che offre una scelta di modelli di fondazione (FM) ad alte prestazioni tramite API facili da utilizzare.

Il diagramma seguente è un'architettura di riferimento di alto livello che spiega come migliorare ulteriormente un flusso di lavoro IDP con modelli di base. È possibile utilizzare gli LLM in una o tutte le fasi dell'IDP a seconda del caso d'uso e del risultato desiderato.

Nelle sezioni seguenti, approfondiamo il modo in cui Amazon Textract è integrato nei flussi di lavoro di intelligenza artificiale generativa utilizzando LangChain per elaborare i documenti per ciascuna di queste attività specifiche. I blocchi di codice forniti qui sono stati ridotti per brevità. Fare riferimento al ns Repository GitHub per notebook Python dettagliati e una procedura dettagliata.

L'estrazione del testo dai documenti è un aspetto cruciale quando si tratta di elaborare documenti con LLM. Puoi utilizzare Amazon Textract per estrarre testo non strutturato dai documenti e preservare gli oggetti semistrutturati o strutturati originali come coppie chiave-valore e tabelle presenti nel documento. I pacchetti di documenti come le richieste di indennizzi sanitari e assicurativi o i mutui sono costituiti da moduli complessi che contengono molte informazioni in formati strutturati, semi-strutturati e non strutturati. L'estrazione dei documenti è un passo importante in questo caso perché i LLM traggono vantaggio dalla ricchezza di contenuti per generare risposte più accurate e pertinenti, che altrimenti potrebbero influire sulla qualità dell'output dei LLM.

LangChain è un potente framework open source per l'integrazione con LLM. I LLM in generale sono versatili ma possono avere difficoltà con attività specifiche del dominio in cui sono necessari un contesto più profondo e risposte sfumate. LangChain consente agli sviluppatori in tali scenari di creare agenti in grado di suddividere attività complesse in attività secondarie più piccole. Le attività secondarie possono quindi introdurre contesto e memoria nei LLM collegando e concatenando i prompt LLM.

Offerte LangChain caricatori di documenti in grado di caricare e trasformare i dati dai documenti. Puoi usarli per strutturare i documenti nei formati preferiti che possono essere elaborati dai LLM. IL AmazonTextractPDFLoader è un tipo di caricatore di servizi di caricamento di documenti che fornisce un modo rapido per automatizzare l'elaborazione dei documenti utilizzando Amazon Textract in combinazione con LangChain. Per maggiori dettagli su AmazonTextractPDFLoader, fare riferimento a LangChain documentazione. Per utilizzare il caricatore di documenti Amazon Textract, inizia importandolo dalla libreria LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Puoi anche archiviare documenti in Amazon S3 e fare riferimento ad essi utilizzando il modello URL s3://, come spiegato in Accesso a un bucket utilizzando S3://e passa questo percorso S3 al caricatore PDF di Amazon Textract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Un documento multipagina conterrà più pagine di testo, a cui sarà possibile accedere tramite l'oggetto documenti, che è un elenco di pagine. Il codice seguente scorre le pagine nell'oggetto documenti e stampa il testo del documento, che è disponibile tramite il file page_content attributo:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend e LLM possono essere utilizzati efficacemente per la classificazione dei documenti. Amazon Comprehend è un servizio di elaborazione del linguaggio naturale (NLP) che utilizza il machine learning per estrarre informazioni dettagliate dal testo. Amazon Comprehend supporta inoltre la formazione su modelli di classificazione personalizzati con consapevolezza del layout su documenti come PDF, Word e formati immagine. Per ulteriori informazioni sull'utilizzo del classificatore di documenti Amazon Comprehend, fare riferimento a Il classificatore di documenti Amazon Comprehend aggiunge il supporto del layout per una maggiore precisione.

Se abbinata ai LLM, la classificazione dei documenti diventa un approccio potente per la gestione di grandi volumi di documenti. Gli LLM sono utili nella classificazione dei documenti perché possono analizzare il testo, i modelli e gli elementi contestuali nel documento utilizzando la comprensione del linguaggio naturale. Puoi anche ottimizzarli per classi di documenti specifiche. Quando un nuovo tipo di documento introdotto nella pipeline IDP necessita di classificazione, LLM può elaborare il testo e classificare il documento in base a un insieme di classi. Di seguito è riportato un codice di esempio che utilizza il caricatore di documenti LangChain fornito da Amazon Textract per estrarre il testo dal documento e utilizzarlo per classificare il documento. Noi usiamo il Claude antropico v2 modello tramite Amazon Bedrock per eseguire la classificazione.

Nell'esempio seguente, estraiamo innanzitutto il testo da un rapporto di dimissione del paziente e utilizziamo un LLM per classificarlo in base a un elenco di tre diversi tipi di documenti:DISCHARGE_SUMMARY, RECEIPTe PRESCRIPTION. Lo screenshot seguente mostra il nostro report.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Il riepilogo implica condensare un determinato testo o documento in una versione più breve conservandone le informazioni chiave. Questa tecnica è utile per un recupero efficiente delle informazioni, che consente agli utenti di cogliere rapidamente i punti chiave di un documento senza leggerne l'intero contenuto. Sebbene Amazon Textract non esegua direttamente il riepilogo del testo, fornisce le funzionalità fondamentali per estrarre l'intero testo dai documenti. Questo testo estratto funge da input per il nostro modello LLM per l'esecuzione di attività di riepilogo del testo.

Utilizzando lo stesso rapporto di dimissione del campione, utilizziamo AmazonTextractPDFLoader per estrarre il testo da questo documento. Come prima, utilizziamo il modello Claude v2 tramite Amazon Bedrock e lo inizializziamo con un prompt che contiene le istruzioni su cosa fare con il testo (in questo caso, riepilogo). Infine, eseguiamo la catena LLM passando il testo estratto dal caricatore di documenti. Questo esegue un'azione di inferenza su LLM con il prompt che consiste nelle istruzioni da riepilogare e nel testo del documento contrassegnato da Document. Vedi il seguente codice:

Il codice genera il riepilogo di un report riepilogativo di dimissione del paziente:

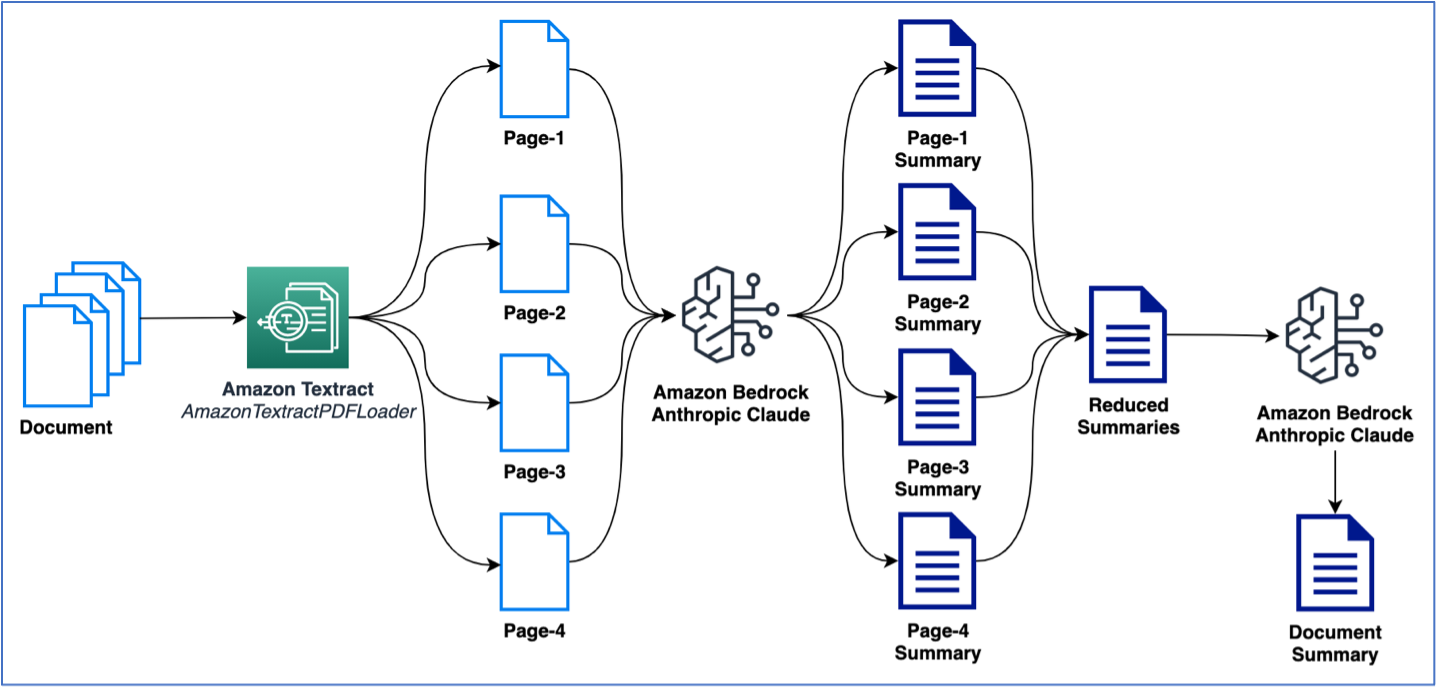

L'esempio precedente utilizzava un documento a pagina singola per eseguire il riepilogo. Tuttavia, probabilmente avrai a che fare con documenti contenenti più pagine che necessitano di riepilogo. Un modo comune per eseguire il riepilogo su più pagine consiste nel generare innanzitutto riepiloghi su porzioni di testo più piccole e quindi combinare i riepiloghi più piccoli per ottenere un riepilogo finale del documento. Tieni presente che questo metodo richiede più chiamate a LLM. La logica di ciò può essere creata facilmente; tuttavia, LangChain fornisce una catena di riepilogo incorporata in grado di riassumere testi di grandi dimensioni (da documenti di più pagine). Il riepilogo può avvenire sia tramite map_reduce o con stuff opzioni, disponibili come opzioni per gestire più chiamate al LLM. Nell'esempio seguente utilizziamo map_reduce per riassumere un documento di più pagine. La figura seguente illustra il nostro flusso di lavoro.

Iniziamo innanzitutto estraendo il documento e vediamo il conteggio totale dei token per pagina e il numero totale di pagine:

Successivamente, utilizziamo il built-in di LangChain load_summarize_chain per riassumere l'intero documento:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Standardizzazione e domande e risposte

In questa sezione verranno discusse le attività di standardizzazione e domande e risposte.

Standardizzazione

La standardizzazione dell'output è un'attività di generazione di testo in cui gli LLM vengono utilizzati per fornire una formattazione coerente del testo di output. Questa attività è particolarmente utile per l'automazione dell'estrazione delle entità chiave che richiede l'allineamento dell'output con i formati desiderati. Ad esempio, possiamo seguire le migliori pratiche di prompt engineering per ottimizzare un LLM per formattare le date nel formato MM/GG/AAAA, che potrebbe essere compatibile con una colonna DATE del database. Il seguente blocco di codice mostra un esempio di come ciò venga eseguito utilizzando un LLM e il prompt engineering. Non solo standardizziamo il formato di output per i valori delle date, ma chiediamo anche al modello di generare l'output finale in un formato JSON in modo che sia facilmente utilizzabile nelle nostre applicazioni downstream. Noi usiamo Linguaggio di espressione LangChain (LCEL) per concatenare due azioni. La prima azione richiede a LLM di generare un output in formato JSON contenente solo le date del documento. La seconda azione accetta l'output JSON e standardizza il formato della data. Si noti che questa azione in due passaggi può anche essere eseguita in un unico passaggio con un'adeguata ingegneria di prompt, come vedremo nella normalizzazione e nel template.

L'output dell'esempio di codice precedente è una struttura JSON con le date 07/09/2020 e 08/09/2020, che sono nel formato GG/MM/AAAA e rappresentano rispettivamente la data di ricovero e di dimissione del paziente dall'ospedale, secondo alla relazione riepilogativa di dimissione.

Domande e risposte con la generazione aumentata di recupero

È noto che gli LLM conservano informazioni fattuali, spesso definite conoscenza del mondo o visione del mondo. Se messi a punto, possono produrre risultati all’avanguardia. Tuttavia, esistono vincoli sull'efficacia con cui un LLM può accedere e manipolare questa conoscenza. Di conseguenza, nelle attività che fanno molto affidamento su conoscenze specifiche, le loro prestazioni potrebbero non essere ottimali per determinati casi d’uso. Ad esempio, negli scenari di domande e risposte, è essenziale che il modello aderisca rigorosamente al contesto fornito nel documento senza fare affidamento esclusivamente sulla sua conoscenza del mondo. Deviare da questo può portare a false dichiarazioni, inesattezze o persino risposte errate. Il metodo più comunemente utilizzato per risolvere questo problema è noto come Recupero generazione aumentata (STRACCIO). Questo approccio mette in sinergia i punti di forza sia dei modelli di recupero che dei modelli linguistici, migliorando la precisione e la qualità delle risposte generate.

Gli LLM possono anche imporre limitazioni sui token a causa dei vincoli di memoria e delle limitazioni dell'hardware su cui vengono eseguiti. Per gestire questo problema, vengono utilizzate tecniche come il suddivisione in blocchi per dividere documenti di grandi dimensioni in porzioni più piccole che rientrano nei limiti dei token dei LLM. D’altro canto, gli incorporamenti vengono impiegati nella PNL principalmente per catturare il significato semantico delle parole e le loro relazioni con altre parole in uno spazio ad alta dimensione. Questi incorporamenti trasformano le parole in vettori, consentendo ai modelli di elaborare e comprendere in modo efficiente i dati testuali. Comprendendo le sfumature semantiche tra parole e frasi, gli incorporamenti consentono agli LLM di generare output coerenti e contestualmente rilevanti. Tieni presente i seguenti termini chiave:

- chunking – Questo processo scompone grandi quantità di testo dai documenti in porzioni di testo più piccole e significative.

- incastri – Queste sono trasformazioni vettoriali a dimensione fissa di ciascun pezzo che conservano le informazioni semantiche dai pezzi. Questi incorporamenti vengono successivamente caricati in un database vettoriale.

- Banca dati vettoriale – Questo è un database di incorporamenti di parole o vettori che rappresentano il contesto delle parole. Funziona come una fonte di conoscenza che aiuta le attività di PNL nelle pipeline di elaborazione dei documenti. Il vantaggio del database vettoriale in questo caso è che consente di fornire ai LLM solo il contesto necessario durante la generazione del testo, come spiegheremo nella sezione seguente.

RAG sfrutta la potenza degli incorporamenti per comprendere e recuperare segmenti di documenti rilevanti durante la fase di recupero. In questo modo, RAG può funzionare entro i limiti dei token dei LLM, garantendo che le informazioni più pertinenti vengano selezionate per la generazione, ottenendo risultati più accurati e contestualmente rilevanti.

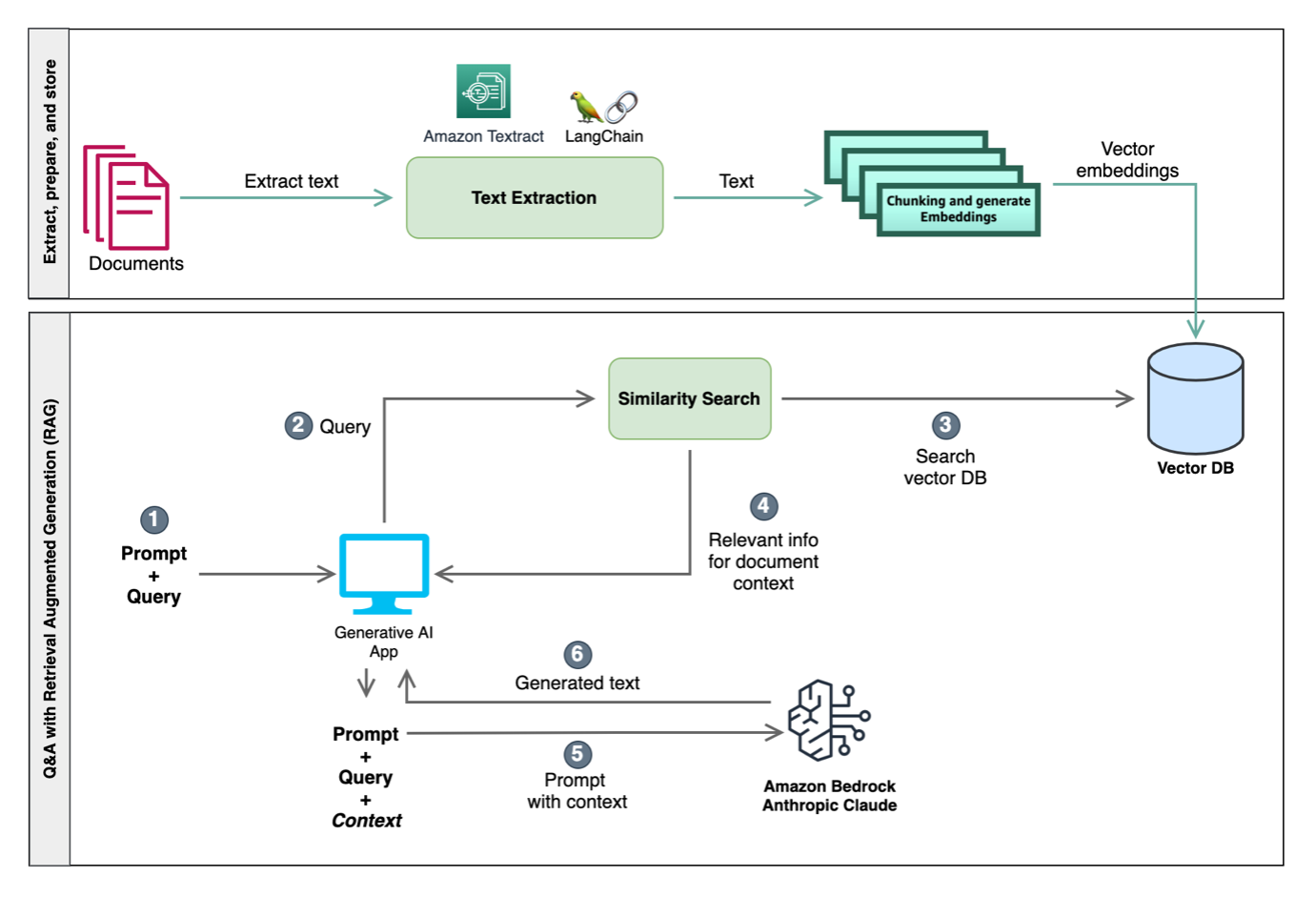

Il diagramma seguente illustra l'integrazione di queste tecniche per creare input per i LLM, migliorando la loro comprensione contestuale e consentendo risposte contestuali più rilevanti. Un approccio prevede la ricerca di similarità, utilizzando sia un database vettoriale che il suddivisione in blocchi. Il database vettoriale memorizza incorporamenti che rappresentano informazioni semantiche e la suddivisione in blocchi divide il testo in sezioni gestibili. Utilizzando questo contesto dalla ricerca di similarità, gli LLM possono eseguire attività come la risposta a domande e operazioni specifiche del dominio come la classificazione e l'arricchimento.

Per questo post utilizziamo un approccio basato su RAG per eseguire domande e risposte contestualizzate sui documenti. Nel seguente esempio di codice, estraiamo il testo da un documento e quindi dividiamo il documento in porzioni di testo più piccole. Il suddivisione è necessario perché potremmo avere documenti di più pagine di grandi dimensioni e i nostri LLM potrebbero avere limiti di token. Questi blocchi vengono quindi caricati nel database vettoriale per eseguire la ricerca di somiglianza nei passaggi successivi. Nell'esempio seguente, utilizziamo il modello Amazon Titan Embed Text v1, che esegue gli incorporamenti vettoriali dei blocchi di documento:

Il codice crea un contesto rilevante per LLM utilizzando i blocchi di testo restituiti dall'azione di ricerca di similarità dal database vettoriale. Per questo esempio, utilizziamo un file open source Negozio di vettori FAISS come database vettoriale di esempio per memorizzare gli incorporamenti vettoriali di ogni porzione di testo. Definiamo quindi il database vettoriale come a Il cane da riporto LangChain, che viene passato nel RetrievalQA catena. Questo esegue internamente una query di ricerca di somiglianza sul database vettoriale che restituisce i primi n (dove n=3 nel nostro esempio) blocchi di testo rilevanti per la domanda. Infine, la catena LLM viene eseguita con il contesto pertinente (un gruppo di blocchi di testo rilevanti) e la domanda a cui il LLM deve rispondere. Per una procedura dettagliata sul codice di domande e risposte con RAG, fare riferimento al notebook Python su GitHub.

In alternativa a FAISS è possibile utilizzare anche Funzionalità del database vettoriale di Amazon OpenSearch Service, Amazon Relational Database Service (Amazon RDS) per PostgreSQL con la pgvettore estensione come database vettoriali o database Chroma open source.

Domande e risposte con dati tabellari

I dati tabulari all'interno dei documenti possono essere difficili da elaborare per i LLM a causa della loro complessità strutturale. Amazon Textract può essere integrato con LLM perché consente di estrarre tabelle da documenti in un formato nidificato di elementi come pagina, tabella e celle. L'esecuzione di domande e risposte con dati tabulari è un processo in più fasi e può essere ottenuto tramite interrogarsi su se stessi. Di seguito è riportata una panoramica dei passaggi:

- Estrai tabelle da documenti utilizzando Amazon Textract. Con Amazon Textract, la struttura tabellare (righe, colonne, intestazioni) può essere estratta da un documento.

- Archiviare i dati tabulari in un database vettoriale insieme alle informazioni sui metadati, come i nomi delle intestazioni e la descrizione di ciascuna intestazione.

- Utilizzare la richiesta per costruire una query strutturata, utilizzando un LLM, per derivare i dati dalla tabella.

- Utilizzare la query per estrarre i dati della tabella rilevanti dal database vettoriale.

Ad esempio, in un estratto conto, alla richiesta "Quali sono le transazioni con più di $ 1000 in depositi", LLM completerebbe i seguenti passaggi:

- Crea una query, ad esempio

“Query: transactions” , “filter: greater than (Deposit$)”. - Convertire la query in una query strutturata.

- Applica la query strutturata al database vettoriale in cui sono archiviati i dati della nostra tabella.

Per una procedura dettagliata del codice di esempio di domande e risposte con tabelle, fare riferimento al notebook Python in GitHub.

Templateing e normalizzazioni

In questa sezione esamineremo come utilizzare le tecniche di prompt engineering e il meccanismo integrato di LangChain per generare un output con estrazioni da un documento in uno schema specificato. Eseguiamo anche una certa standardizzazione sui dati estratti, utilizzando le tecniche discusse in precedenza. Iniziamo definendo un modello per l'output desiderato. Questo servirà da schema e incapsulerà i dettagli su ciascuna entità che vogliamo estrarre dal testo del documento.

Tieni presente che per ciascuna entità utilizziamo la descrizione per spiegare cos'è quell'entità per aiutare il LLM a estrarre il valore dal testo del documento. Nel seguente codice di esempio, utilizziamo questo modello per creare il nostro prompt per LLM insieme al testo estratto dal documento utilizzando AmazonTextractPDFLoader e successivamente eseguire l'inferenza con il modello:

Come si può vedere, la {keys} parte del prompt sono le chiavi del nostro modello e il file {details} sono le chiavi insieme alla loro descrizione. In questo caso, non chiediamo esplicitamente al modello il formato dell'output se non specificando nell'istruzione di generare l'output in formato JSON. Questo funziona per la maggior parte; tuttavia, poiché l'output degli LLM è una generazione di testo non deterministica, si desidera specificare esplicitamente il formato come parte dell'istruzione nel prompt. Per risolvere questo problema, possiamo usare LangChain parser di output strutturato modulo per sfruttare l'ingegneria automatizzata dei prompt che aiuta a convertire il nostro modello in un prompt di istruzioni sul formato. Utilizziamo il modello definito in precedenza per generare il prompt delle istruzioni di formato come segue:

Utilizziamo quindi questa variabile all'interno del nostro prompt originale come istruzione per LLM in modo che estragga e formatti l'output nello schema desiderato apportando una piccola modifica al nostro prompt:

Finora abbiamo estratto i dati dal documento solo nello schema desiderato. Tuttavia, dobbiamo ancora eseguire una certa standardizzazione. Ad esempio, vogliamo che la data di ricovero e la data di dimissione del paziente vengano estratte nel formato GG/MM/AAAA. In questo caso, aumentiamo il description della chiave con l'istruzione di formattazione:

Fare riferimento al taccuino Python in GitHub per una guida dettagliata e una spiegazione completa.

Controlli ortografici e correzioni

Gli LLM hanno dimostrato notevoli capacità nella comprensione e nella generazione di testi simili a quelli umani. Una delle applicazioni meno discusse ma estremamente utili degli LLM è il loro potenziale nei controlli grammaticali e nella correzione delle frasi nei documenti. A differenza dei tradizionali correttori grammaticali che si basano su una serie di regole predefinite, gli LLM utilizzano modelli identificati da grandi quantità di dati di testo per determinare cosa costituisce un linguaggio corretto o fluente. Ciò significa che possono rilevare sfumature, contesto e sottigliezze che i sistemi basati su regole potrebbero non cogliere.

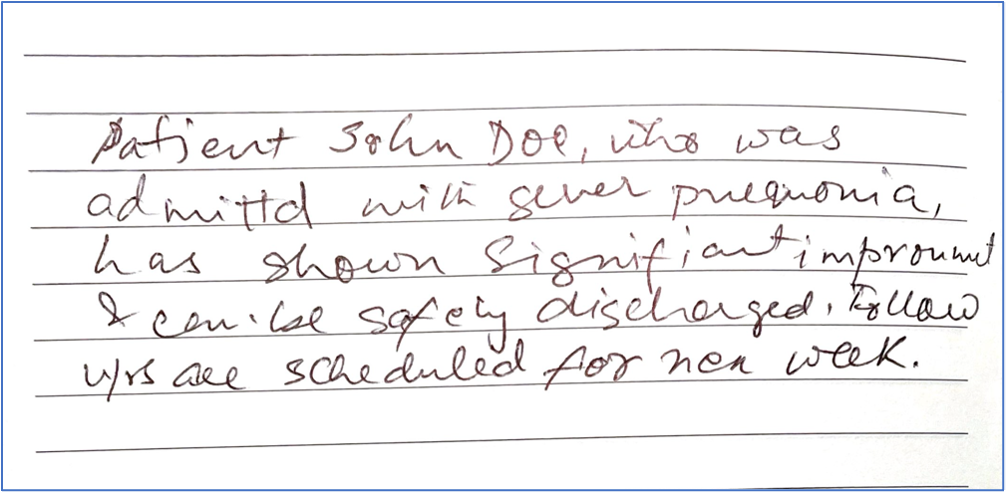

Immaginate il testo estratto dal riepilogo della dimissione di un paziente che recita “Il paziente Jon Doe, ricoverato con una grave polmonite, ha mostrato un miglioramento significativo e può essere dimesso in sicurezza. I controlli sono previsti per la prossima settimana”. Un correttore ortografico tradizionale potrebbe riconoscere "ammesso", "polmonite", "miglioramento" e "nex" come errori. Tuttavia, il contesto di questi errori potrebbe portare a ulteriori errori o suggerimenti generici. Un LLM, dotato della sua vasta formazione, potrebbe suggerire: “Il paziente John Doe, ricoverato per una grave polmonite, ha mostrato un miglioramento significativo e può essere dimesso in sicurezza. I controlli sono previsti per la prossima settimana”.

Quello che segue è un documento di esempio scritto male con lo stesso testo spiegato in precedenza.

Estraiamo il documento con un caricatore di documenti Amazon Textract e quindi istruiamo il LLM, tramite ingegneria tempestiva, a rettificare il testo estratto per correggere eventuali errori di ortografia e/o grammaticali:

L'output del codice precedente mostra il testo originale estratto dal caricatore di documenti seguito dal testo corretto generato da LLM:

Tieni presente che, per quanto potenti siano i LLM, è essenziale considerare i loro suggerimenti proprio come suggerimenti. Sebbene catturino straordinariamente bene le complessità del linguaggio, non sono infallibili. Alcuni suggerimenti potrebbero modificare il significato o il tono previsto del testo originale. Pertanto, è fondamentale che i revisori umani utilizzino le correzioni generate da LLM come guida, non come valore assoluto. La collaborazione dell'intuizione umana con le capacità LLM promette un futuro in cui la nostra comunicazione scritta non sarà solo priva di errori, ma anche più ricca e sfumata.

Conclusione

L'intelligenza artificiale generativa sta cambiando il modo in cui è possibile elaborare i documenti con IDP per ricavare informazioni approfondite. Nella posta Miglioramento dell'elaborazione intelligente dei documenti di AWS con l'intelligenza artificiale generativa, abbiamo discusso delle varie fasi della pipeline e di come il cliente AWS Ricoh sta migliorando la propria pipeline IDP con LLM. In questo post, abbiamo discusso vari meccanismi per aumentare il flusso di lavoro IDP con LLM tramite Amazon Bedrock, Amazon Textract e il popolare framework LangChain. Puoi iniziare oggi stesso con il nuovo caricatore di documenti Amazon Textract con LangChain utilizzando i taccuini di esempio disponibili nel nostro Repository GitHub. Per ulteriori informazioni sull'utilizzo dell'intelligenza artificiale generativa su AWS, fare riferimento a Annuncio di nuovi strumenti per creare con l'IA generativa su AWS.

Informazioni sugli autori

Sonali Sahu guida l'elaborazione intelligente dei documenti con il team dei servizi AI/ML in AWS. È un'autrice, leader di pensiero e appassionata tecnologa. La sua area di interesse principale è AI e ML e parla spesso a conferenze e incontri di AI e ML in tutto il mondo. Ha un'ampia e profonda esperienza nella tecnologia e nel settore tecnologico, con competenze nel settore sanitario, finanziario e assicurativo.

Sonali Sahu guida l'elaborazione intelligente dei documenti con il team dei servizi AI/ML in AWS. È un'autrice, leader di pensiero e appassionata tecnologa. La sua area di interesse principale è AI e ML e parla spesso a conferenze e incontri di AI e ML in tutto il mondo. Ha un'ampia e profonda esperienza nella tecnologia e nel settore tecnologico, con competenze nel settore sanitario, finanziario e assicurativo.

Anjan Biswas è un Senior AI Services Solutions Architect con un focus su AI/ML e Data Analytics. Anjan fa parte del team di servizi AI a livello mondiale e lavora con i clienti per aiutarli a comprendere e sviluppare soluzioni ai problemi aziendali con AI e ML. Anjan ha oltre 14 anni di esperienza di lavoro con organizzazioni globali di supply chain, produzione e vendita al dettaglio e sta attivamente aiutando i clienti a iniziare e scalare i servizi AWS AI.

Anjan Biswas è un Senior AI Services Solutions Architect con un focus su AI/ML e Data Analytics. Anjan fa parte del team di servizi AI a livello mondiale e lavora con i clienti per aiutarli a comprendere e sviluppare soluzioni ai problemi aziendali con AI e ML. Anjan ha oltre 14 anni di esperienza di lavoro con organizzazioni globali di supply chain, produzione e vendita al dettaglio e sta attivamente aiutando i clienti a iniziare e scalare i servizi AWS AI.

Chinmayee Rane è un AI/ML Specialist Solutions Architect presso Amazon Web Services. È appassionata di matematica applicata e machine learning. Si concentra sulla progettazione di soluzioni di elaborazione intelligente dei documenti e di intelligenza artificiale generativa per i clienti AWS. Al di fuori del lavoro, le piace ballare la salsa e la bachata.

Chinmayee Rane è un AI/ML Specialist Solutions Architect presso Amazon Web Services. È appassionata di matematica applicata e machine learning. Si concentra sulla progettazione di soluzioni di elaborazione intelligente dei documenti e di intelligenza artificiale generativa per i clienti AWS. Al di fuori del lavoro, le piace ballare la salsa e la bachata.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :ha

- :È

- :non

- :Dove

- .nex

- $1000

- $ SU

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- abilità

- WRI

- Assoluta

- accesso

- accessibile

- Secondo

- precisione

- preciso

- raggiunto

- operanti in

- Action

- azioni

- attivamente

- attività

- atti

- Ad

- indirizzo

- Aggiunge

- aderire

- ammettere

- ammesso

- avanzamenti

- Vantaggio

- Avvento

- agenti

- AI

- Servizi di intelligenza artificiale

- AI / ML

- Allineati

- Tutti

- Consentire

- consente

- lungo

- anche

- alternativa

- Sebbene il

- Amazon

- Amazon Comprehend

- Amazon RDS

- Testo Amazon

- Amazon Web Services

- importi

- an

- analitica

- analizzare

- ed

- rispondere

- Antropico

- in qualsiasi

- API

- applicazioni

- applicato

- appuntamenti

- approccio

- architettura

- SONO

- RISERVATA

- in giro

- Arte

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- AS

- aspetto

- assistere

- Assistant

- At

- aumentare

- aumentata

- autore

- automatizzare

- Automatizzata

- automaticamente

- Automazione

- disponibile

- consapevolezza

- AWS

- Cliente AWS

- Banca

- BE

- perché

- diventa

- stato

- prima

- benefico

- beneficio

- MIGLIORE

- best practice

- fra

- Bloccare

- Blocchi

- entrambi

- ampiezza

- Rompere

- pause

- costruire

- Costruzione

- incassato

- affari

- aziende

- ma

- by

- Bandi

- Materiale

- Può ottenere

- funzionalità

- catturare

- Custodie

- casi

- Celle

- certo

- catena

- Catene

- Challenge

- impegnativo

- il cambiamento

- Modifiche

- cambiando

- Controlli

- scegliere

- classe

- classi

- classificazione

- classificare

- codice

- COERENTE

- collaborazione

- Colonna

- colonne

- combinazione

- combinare

- viene

- Uncommon

- comunemente

- Comunicazione

- compatibile

- completamento di una

- complesso

- complessità

- comprendere

- conciso

- conferenze

- Collegamento

- coerente

- consiste

- vincoli

- costruire

- contenere

- contenute

- contiene

- contenuto

- contesto

- contestuale

- convertire

- Nucleo

- correggere

- corretto

- Correzioni

- potuto

- artigianali

- artigianale

- crea

- cruciale

- costume

- cliente

- Clienti

- Danza

- dati

- Dati Analytics

- Banca Dati

- banche dati

- Data

- Date

- affare

- deep

- più profondo

- definire

- definito

- definizione

- dimostrato

- Dipendente

- depositi

- profondità

- descritta

- descrizione

- progettazione

- desiderato

- dettaglio

- dettagliati

- dettagli

- individuare

- Determinare

- sviluppare

- sviluppatori

- Dieta

- diverso

- direttamente

- discutere

- discusso

- immersione

- dividere

- divide

- do

- Medico

- documento

- documentazione

- documenti

- daino

- non

- fare

- don

- fatto

- Dont

- giù

- drammaticamente

- dovuto

- durante

- dinamico

- e

- ogni

- In precedenza

- facilmente

- facile da usare

- in maniera efficace

- efficienza

- efficiente

- in modo efficiente

- sforzi

- o

- elementi

- incastrare

- occupato

- Potenzia

- enable

- Abilita

- consentendo

- fine

- Ingegneria

- accrescere

- migliorata

- migliorando

- garantire

- assicurando

- Intero

- entità

- entità

- attrezzato

- errori

- essential

- Anche

- esempio

- Tranne

- eccezione

- esistente

- esperienza

- competenza

- Spiegare

- ha spiegato

- Spiega

- spiegazione

- espressamente

- espressione

- estendere

- estensione

- estensivo

- estratto

- estrazione

- estratti

- Autunno

- falso

- lontano

- fatica

- campi

- figura

- finale

- Infine

- finanziario

- Settore finanziario

- Nome

- in forma

- Focus

- si concentra

- seguire

- seguito

- i seguenti

- segue

- Nel

- formato

- forme

- essere trovato

- Fondazione

- Contesto

- Gratis

- frequentemente

- da

- Frontier

- pieno

- completamente

- ulteriormente

- futuro

- Generale

- generare

- generato

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- Dare

- dato

- globali

- grammatica

- afferrala

- maggiore

- Gruppo

- guida

- cura

- maniglia

- accadere

- Happening

- Hardware

- Avere

- intestazioni

- assistenza sanitaria

- pesantemente

- Aiuto

- utile

- aiutare

- aiuta

- suo

- qui

- alto livello

- ad alte prestazioni

- superiore

- detiene

- ospedale

- Come

- Tutorial

- Tuttavia

- HTML

- HTTPS

- umano

- i

- ID

- identificato

- if

- illustra

- Immagine

- immensamente

- Impact

- importare

- importante

- importazione

- imporre

- miglioramento

- in

- Compreso

- Index

- industria

- informazioni

- Era dell'informazione

- Innovazione

- ingresso

- intuizioni

- esempio

- istruzioni

- assicurazione

- integrare

- integrato

- Integrazione

- integrazione

- Intelligence

- Intelligente

- Elaborazione intelligente dei documenti

- destinato

- internamente

- ai miglioramenti

- complessità

- introdurre

- introdotto

- Introduce

- IT

- SUO

- Jackson

- John

- JOHN DOE

- jon

- jpg

- json

- ad appena

- Le

- Tasti

- Sapere

- conoscenze

- conosciuto

- Lingua

- grandi

- disposizione

- portare

- leader

- principale

- apprendimento

- partenza

- Biblioteca

- piace

- probabile

- limiti

- limiti

- Lista

- LLM

- caricare

- caricatore

- logica

- Guarda

- lotto

- macchina

- machine learning

- Fare

- gestire

- maneggevole

- gestito

- gestione

- Manuale

- consigliato per la

- segnato

- matematica

- Maggio..

- me

- significato

- significativo

- si intende

- meccanismo

- meccanismi di

- Meetups

- Memorie

- Meta

- Metadati

- metodo

- metodi

- forza

- mente

- perdere

- errori

- ML

- modello

- modelli

- Moduli

- Scopri di più

- Ipoteche

- maggior parte

- multiplo

- Nome

- nomi

- Naturale

- Elaborazione del linguaggio naturale

- necessaria

- Bisogno

- di applicazione

- esigenze

- New

- GENERAZIONE

- la prossima settimana

- nlp

- taccuino

- adesso

- ombreggiatura

- numero

- oggetto

- oggetti

- of

- Offerte

- di frequente

- on

- ONE

- esclusivamente

- open source

- Operazioni

- Opportunità

- ottimale

- Opzioni

- or

- organizzazioni

- i

- Altro

- altrimenti

- nostro

- su

- Risultato

- produzione

- uscite

- al di fuori

- ancora

- panoramica

- Packages

- pagina

- pagine

- Dolore

- accoppiato

- coppie

- parte

- particolarmente

- passare

- Passato

- Di passaggio

- appassionato

- sentiero

- paziente

- Cartamodello

- modelli

- per

- Eseguire

- performance

- eseguita

- esecuzione

- esegue

- fase

- phd

- Frasi

- conduttura

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- polmonite

- punti

- Popolare

- possibile

- Post

- potenziale

- energia

- alimentato

- potente

- pratiche

- precisamente

- Precisione

- preferito

- presenti

- in precedenza

- principalmente

- Stampa

- stampe

- Problema

- problemi

- processi

- Elaborato

- lavorazione

- produrre

- promette

- corretto

- fornire

- purché

- fornitore

- fornisce

- Python

- Domande e risposte

- qualità

- domanda

- Presto

- rapidamente

- Crudo

- Lettura

- riconoscere

- riducendo

- riferimento

- riferimento

- di cui

- Relazioni

- pertinente

- fare affidamento

- basandosi

- notevole

- rapporto

- rappresentare

- che rappresenta

- necessario

- richiede

- rispettivamente

- risposte

- restrizioni

- colpevole

- risultante

- Risultati

- nello specifico retail

- conservare

- di ritegno

- problemi

- Ricco

- Prenotazione sale

- norme

- Correre

- corre

- s

- tranquillamente

- stesso

- dire

- Scala

- Scenari

- in programma

- Cerca

- Secondo

- Sezione

- sezioni

- settore

- vedere

- segmenti

- selezionato

- anziano

- condanna

- Serie

- servire

- serve

- servizio

- Servizi

- set

- grave

- lei

- Corti

- dovrebbero

- mostrato

- Spettacoli

- significativa

- singolo

- piccole

- inferiore

- frammento

- So

- unicamente

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- lo spazio

- Parla

- specialista

- specifico

- in particolare

- specificato

- ortografia

- dividere

- tappe

- standardizzazione

- inizia a

- iniziato

- state-of-the-art

- dichiarazione

- step

- Passi

- Ancora

- Tornare al suo account

- memorizzati

- negozi

- punti di forza

- Corda

- strutturale

- La struttura

- strutturato

- Lotta

- successivo

- Successivamente

- tale

- suggerire

- riassumere

- SOMMARIO

- fornire

- supply chain

- supporto

- supporti

- sinergia

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- prende

- Task

- task

- team

- per l'esame

- tecniche

- tecnologo

- Tecnologia

- modello

- condizioni

- testo

- testuale

- di

- che

- Il

- il mondo

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- pensiero

- tre

- Attraverso

- titano

- a

- oggi

- di oggi

- insieme

- token

- Tokens

- TONE

- strumenti

- top

- Totale

- tradizionale

- Trailing

- Training

- Le transazioni

- Trasformare

- trasformazioni

- vero

- prova

- seconda

- Digitare

- Tipi di

- capire

- e una comprensione reciproca

- a differenza di

- scoprimento

- URL

- uso

- caso d'uso

- utilizzato

- utenti

- usa

- utilizzando

- utilizzati

- Utilizzando

- v1

- APPREZZIAMO

- Valori

- variabile

- vario

- Fisso

- versatile

- versione

- via

- Visualizza

- volumi

- walkthrough

- volere

- Prima

- Modo..

- we

- sito web

- servizi web

- settimana

- WELL

- Che

- quando

- quale

- while

- OMS

- volere

- con

- entro

- senza

- assistito

- Word

- parole

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- mondo

- sarebbe

- scritto

- X

- anni

- Tu

- zefiro