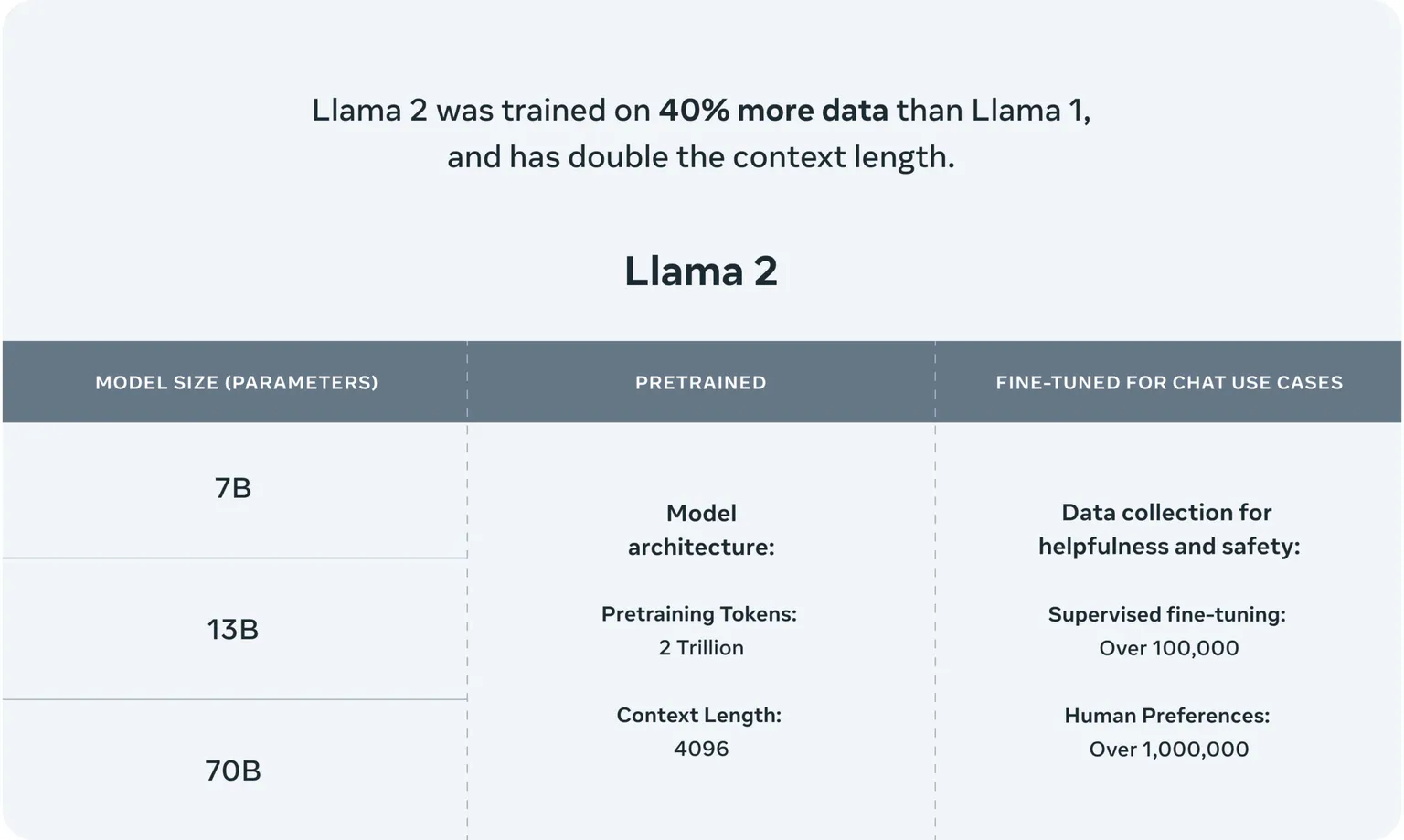

Sentito per caso in un social Meta GenAI:

"Abbiamo i calcoli per addestrare Llama 3 e 4. Il piano è che Llama-3 sia buono quanto GPT-4."

"Wow, se Llama-3 è buono come GPT-4, lo fareste ancora come open source?"

“Sì, lo faremo. Mi dispiace, gente dell'allineamento.

— Jason (@agikoala) 25 Agosto 2023

Rimani aggiornato sulle notizie crittografiche, ricevi aggiornamenti quotidiani nella tua casella di posta.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://decrypt.co/205436/llama-3-release-date-rumored-meta-ai-challenger

- :ha

- :È

- :non

- $ SU

- 1

- 10

- 13

- 15%

- 16

- 2022

- 2023

- 2024

- 25

- 32

- 7

- 70

- a

- capacità

- WRI

- Assoluta

- Secondo

- operanti in

- avanzamento

- AI

- allineamento

- Tutti

- anche

- sempre

- an

- .

- ed

- Un altro

- anticipazione

- nulla

- architettura

- SONO

- Italia

- artificiale

- intelligenza artificiale

- AS

- At

- disponibile

- precedente

- sfondo

- BE

- stato

- dietro

- essendo

- creduto

- fra

- Big

- Miliardo

- Po

- Bloccare

- Blocchi

- vanta

- entrambi

- Costruzione

- Mazzo

- ma

- by

- funzionalità

- centro

- chatbots

- pulire campo

- impegno

- comunità

- azienda

- competere

- competitivo

- complessità

- globale

- computazionale

- potenza computazionale

- Calcolare

- computer

- CONFERMATO

- Consumer

- Prodotti di consumo

- contesti

- continua

- di controllo

- Conversazione

- Aziende

- correlando

- potuto

- critico

- crypto

- Notizie Cripto

- cicli

- alle lezioni

- Scuro

- dati

- Banca dati

- decrypt

- definire

- profondità

- Mercato

- Dominare

- don

- durante

- ogni

- desideroso

- Presto

- bordo

- Impresa

- sviluppate

- di preciso

- Eccellenza

- Eccitazione

- estensivo

- esterno

- pochi

- Nome

- in forma

- concentrato

- i seguenti

- Nel

- via

- forum

- Fondazione

- amichevole

- da

- futuro

- Gambetto

- ingranaggi

- si prepara

- generare

- generativo

- ottenere

- giganti

- andando

- buono

- basi

- Metà

- Hardware

- Avere

- he

- storico

- detiene

- Come

- HTTPS

- i

- if

- in

- industria

- informazioni

- intuizioni

- Intelligence

- intenzioni

- interno

- intersezione

- Colloquio

- ai miglioramenti

- Investimenti

- IT

- iterazione

- SUO

- Gennaio

- Luglio

- Sapere

- paesaggio

- Lingua

- grandi

- maggiormente

- dopo

- lanciare

- lanciato

- a sinistra

- livelli

- leggera

- piace

- probabile

- Lama

- incombente

- make

- FA

- molti

- marchio

- segna zuckerberg

- mercato

- significare

- Meta

- modello

- modelli

- Scopri di più

- maggior parte

- movimento

- cambiano

- Nome

- NARRATIVA

- Navigare

- Bisogno

- neurale

- New

- notizie

- GENERAZIONE

- adesso

- numero

- Nvidia

- of

- offerta

- Ufficialmente

- di frequente

- on

- ONE

- esclusivamente

- aprire

- open source

- OpenAI

- or

- Altro

- produzione

- ancora

- palpabile

- parametri

- Partnership

- modelli

- Persone

- cronologia

- dati personali

- pezzi

- Intonazione

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- plausibile

- Podcast

- potenziale

- energia

- potente

- centrale elettrica

- potenze

- priorità

- processi

- Prodotti

- proposto

- metti

- qualità

- domanda

- Gara

- RE

- raggiungendo

- pronto

- recente

- recentemente

- Rosso

- parente

- rilasciare

- rilasciato

- resti

- necessario

- ricercatore

- di risposta

- destra

- robusto

- Rumors

- s

- sicura

- Suddetto

- sega

- scena

- Scienziato

- ricerca

- problemi di

- senso

- servire

- servito

- Servizi

- regolazione

- a forma di

- condiviso

- capannone

- vetrina

- avvolto

- segno

- Segni

- So

- Social

- alcuni

- raffinatezza

- Fonte

- lo spazio

- speculazione

- Stage

- posta in gioco

- stare in piedi

- Di partenza

- Ancora

- Strategico

- il successo

- Completo

- team

- Tech

- testo

- che

- Il

- Il futuro

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- questo

- tempo

- time line

- volte

- titano

- a

- insieme

- top

- Treni

- allenato

- Training

- Trilione

- Verità

- Underpinning

- capire

- fino a quando

- Aggiornamenti

- Utente

- variando

- versioni

- we

- WELL

- Che

- quando

- while

- mulinello

- largo

- volere

- con

- lavoro

- lavori

- sarebbe

- wow

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- Zuckerberg