Questo è un guest post di Carter Huffman, CTO e co-fondatore di Modulate.

Modulare è una startup con sede a Boston con la missione di creare esperienze di gioco online più ricche, più sicure e più inclusive per tutti. Siamo un team di esperti audio, giocatori, alleati e futuristi di livello mondiale desiderosi di costruire un mondo online migliore e rendere la chat vocale più sicura per tutti i giocatori. Lo stiamo facendo con ToxMod, la nostra piattaforma di moderazione proattiva nativa vocale. Gli editori e gli sviluppatori di giochi utilizzano ToxMod per moderare in modo proattivo la chat vocale nei loro giochi in base alle proprie politiche sui contenuti, codici di condotta e linee guida della community.

Abbiamo scelto AWS per la scalabilità e l'elasticità di cui la nostra applicazione aveva bisogno, oltre che per l'ottimo servizio clienti che offre. Usando Cloud di calcolo elastico di Amazon (Amazon EC2) istanze G5g con le GPU NVIDIA T4G Tensor Core come infrastruttura per ToxMod ci ha aiutato a ridurre i nostri costi di un fattore 5 (rispetto alle istanze G4dn) raggiungendo i nostri obiettivi in termini di throughput e latenza. In qualità di startup agile, possiamo reinvestire questi risparmi sui costi in ulteriore innovazione per contribuire a servire la nostra missione. In questo post, trattiamo il nostro caso d'uso, le sfide e i percorsi alternativi e una breve panoramica della nostra soluzione utilizzando AWS.

Il metaverso in evoluzione e la necessità di ToxMod

I moderni giochi online e le piattaforme del metaverso sono diventati molto più social dei loro predecessori. Storicamente, i giochi si sono concentrati sulla fornitura di un'esperienza specifica e curata ai giocatori. Oggi si sono evoluti per essere più uno spazio comune, dove i giocatori e i loro amici possono riunirsi e scegliere una varietà di esperienze a cui partecipare. Con questa evoluzione, la tossicità e l'abuso verbale possono spesso rovinare esperienze online altrimenti fantastiche.

In effetti, secondo a recente studio dal Anti-Defamation League, la tossicità nei giochi è peggiore che mai: l'esposizione alle ideologie della supremazia bianca nei giochi è più che raddoppiata nel 2022. Oltre tre quarti dei giocatori adulti hanno riferito di aver subito gravi molestie nei giochi online. Più di 17 milioni di giovani giocatori sono stati esposti a danni e molestie nell'ultimo anno. Il problema sta solo peggiorando e con normative imminenti che richiederà agli studi di assumere un ruolo più attivo nella gestione e nella segnalazione della tossicità, la necessità di una moderazione vocale proattiva è più urgente che mai.

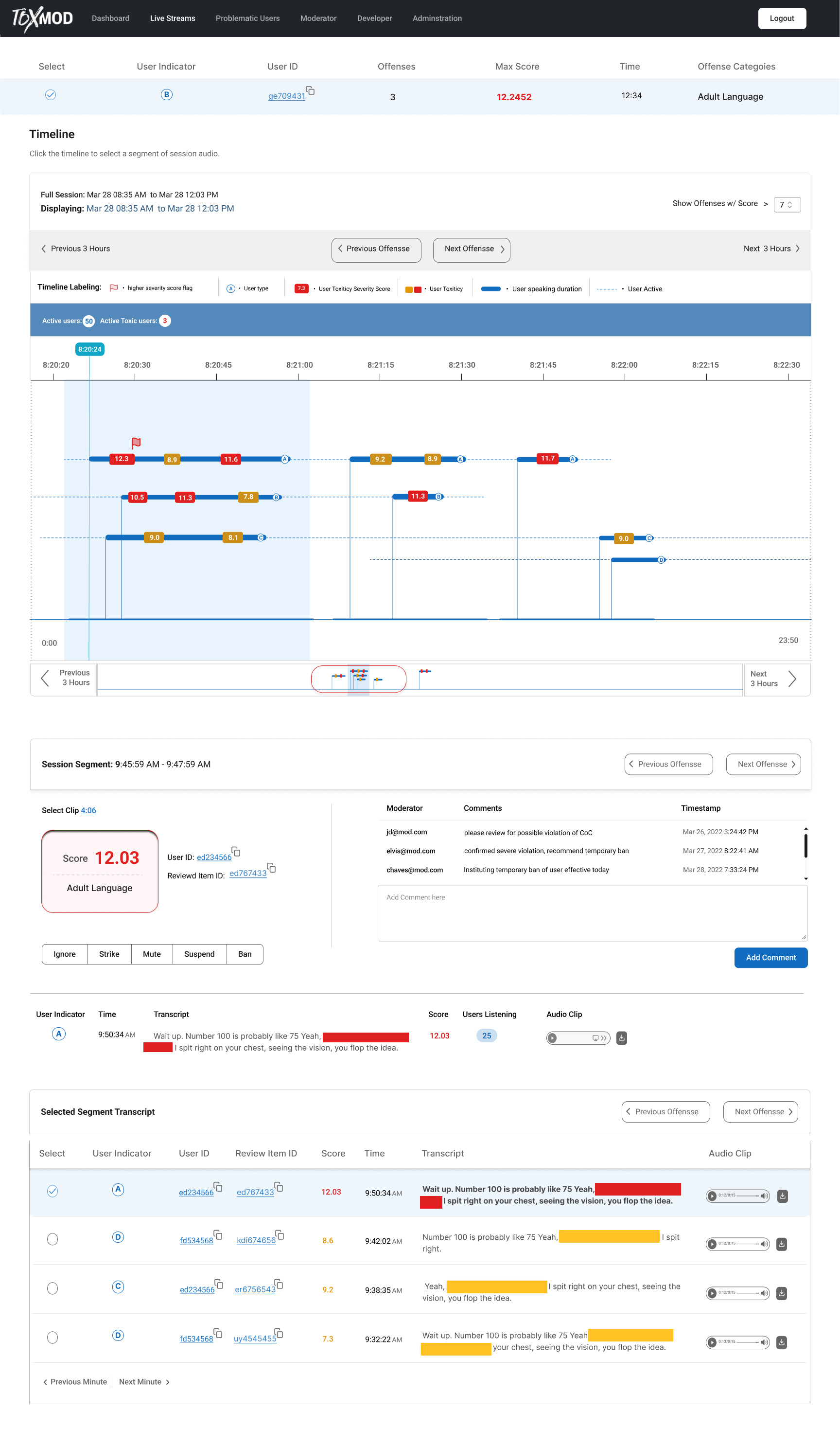

ToxMod aiuta gli editori e le piattaforme di giochi a moderare in modo proattivo la loro chat vocale in base alle proprie politiche e linee guida, mantenendo le loro comunità sicure e positive. ToxMod esegue una serie di modelli di machine learning (ML) che analizzano gli aspetti emotivi, testuali e conversazionali delle conversazioni vocali per determinare se vi sono violazioni delle norme sui contenuti dell'editore o della piattaforma. Le violazioni vengono segnalate ai moderatori umani che possono agire contro i malintenzionati. I nostri modelli ML includono il rilevamento delle emozioni, la trascrizione e l'analisi conversazionale basata sulla PNL che classifica le violazioni e fornisce un punteggio di classificazione per determinare quanto sia sicuro che si sia verificata una violazione. Questi rilevamenti si verificano in tempo reale e consentono agli editori di giochi di moderare in modo proattivo le proprie comunità man mano che si verifica la tossicità, prevenendo l'escalation di danni ai giocatori e conversazioni pericolose.

Considerazioni economiche e tecniche

Abbiamo due tipi di vincoli: economici e tecnici. Dal punto di vista economico, il nostro problema è la domanda variabile e la scala incerta dell'infrastruttura di calcolo richiesta. Nel settore dei giochi, gli sviluppatori e gli editori lanciano giochi con margini minimi e aumentano solo quando il gioco ha più successo. Questo successo può significare che i nostri maggiori clienti elaborano milioni di ore di chat vocale al mese. I costi di ToxMod si adattano al numero di ore di audio elaborato, che è molto dinamico in base al comportamento dei giocatori e ai fattori esterni che influenzano la popolarità di un gioco. Gestire i nostri server per alimentare ToxMod è proibitivo in termini sia di costi che di larghezza di banda del team. I server on-premise mancano di questa scalabilità e spesso verrebbero sottoutilizzati, il che significa che la scelta giusta per ToxMod è il cloud. Con AWS, possiamo scalare dinamicamente per soddisfare la domanda dei nostri clienti mantenendo i costi al minimo.

Dal punto di vista tecnico, come per la creazione di qualsiasi applicazione di elaborazione vocale, dobbiamo trovare un equilibrio tra latenza e throughput. Alcuni dei nostri utenti desiderano la possibilità di affrontare situazioni che potrebbero sorgere nelle loro comunità entro un minuto o due dal loro verificarsi. Per soddisfare i nostri budget di latenza, andiamo al livello più basso possibile. Abbiamo molta esperienza con i dispositivi ARM perché gran parte del codice ToxMod viene eseguito su dispositivi lato client che spesso funzionano su un processore ARM. Le istanze EC2 G5g alimentate da GPU NVIDIA T4G Tensor Core e caratterizzate AWS Gravitone2 i processori erano una scelta naturale per parte del codice di inferenza della rete neurale personalizzato che era stato sviluppato per l'utilizzo lato client.

Istanze EC2 G5g per convenienza economica e affidabilità AWS

Con queste considerazioni, abbiamo deciso di utilizzare le istanze G5g come infrastruttura per ToxMod perché sono convenienti e forniscono ambienti familiari per testare e distribuire i nostri modelli. Questa scelta alla fine ci ha aiutato a ridurre i nostri costi di un fattore 5 (rispetto alle istanze G4dn). Per essere in grado di eseguire iterazioni rapidamente, avevamo bisogno di un ambiente di elaborazione familiare ai nostri data scientist e ingegneri ML. Siamo stati in grado di ottenere l'immagine della nostra macchina con tutti i driver, le librerie e le variabili di ambiente pertinenti in esecuzione su istanze G5g in un giorno. Abbiamo iniziato con le istanze G4dn e i nostri test iniziali su G5g ci hanno permesso di ridurre i costi del 40%. Molti dei nostri modelli più costosi da eseguire sono legati alla GPU, quindi siamo stati in grado di ottimizzare ulteriormente i nostri costi ridimensionando correttamente le dimensioni dell'istanza che ci hanno consentito di massimizzare l'utilizzo della CPU pur avendo accesso a una singola GPU.

Oltre alle istanze G5g che funzionano particolarmente bene per la nostra configurazione, sapevamo di poter contare sul supporto tecnico e sulla gestione degli account di AWS per aiutarci a risolvere rapidamente i problemi e mantenere un tempo di attività estremamente elevato pur sperimentando un carico altamente variabile. Quando abbiamo iniziato, spendevamo meno della doppia cifra al mese, eppure una persona reale ci ha contattato per conoscere il nostro caso d'uso e un team di persone ha lavorato con noi per far funzionare la nostra applicazione non solo, ma anche nel modo più economico. modo efficiente.

Panoramica della nostra soluzione

La soluzione di ToxMod inizia con l'acquisizione dell'audio, che si ottiene attraverso l'integrazione del nostro SDK nell'infrastruttura di chat vocale di un gioco o di una piattaforma. L'uso di un SDK (su un'API o un'altra interfaccia) è fondamentale perché quando elabori l'audio, devi essere estremamente efficiente in termini di risorse. Per ogni singolo flusso audio, dobbiamo elaborarlo e restituirlo rapidamente al resto del sistema o i clienti riscontreranno problemi nell'audio, che è qualcosa che vogliamo evitare a tutti i costi. Molte cose possono causare anomalie, tra cui l'allocazione della memoria, la raccolta dei rifiuti e le chiamate di sistema, quindi abbiamo sviluppato l'SDK ToxMod per garantire l'elaborazione audio più fluida possibile.

Dall'SDK, le chat vocali vengono codificate in brevi buffer e inviate su Internet. Per quanto riguarda l'importazione, eseguiamo il buffering di un paio di secondi di audio e proviamo a trovare punti di interruzione naturali nelle conversazioni vocali prima di inviare il pacchetto al cloud AWS, dove salviamo i dati in arrivo tramite AWS Lambda funzioni. Da lì, l'analisi della conversazione audio viene eseguita tramite l'elaborazione su istanze G5g che eseguono la nostra varietà di modelli audio ML. Riduciamo al minimo l'overhead raggruppando in batch tutti i pacchetti che riceviamo e inviandoli alle GPU nelle istanze G5g. Le istanze G5g vengono alimentate attraverso code di clip audio da elaborare, che abbiamo collegato a gruppi di ridimensionamento automatico che aumentano o diminuiscono in modo efficiente al variare del traffico durante il giorno.

Guardando al futuro

ToxMod è progettato per studi di tutte le dimensioni, dai piccoli team di sviluppo indipendente agli sviluppatori ed editori AAA, multi-team. Oggi, siamo nella posizione migliore che mai per fornire il livello di supporto, lo sviluppo del prodotto e le solide funzionalità che i team aziendali dei più grandi studi si aspettano dai loro partner software. Con il supporto multilingue per 18 lingue, il supporto di livello aziendale 24 ore su 7, XNUMX giorni su XNUMX, le licenze single-tenant disponibili per gli studi con più giochi e il supporto dell'infrastruttura ML scalabile fornita da AWS, siamo qui per aiutare gli studi AAA a rendere sicura la chat vocale per i propri giocatori.

Se vuoi saperne di più su come le istanze EC2 G5g possono aiutarti a distribuire a costi contenuti i tuoi carichi di lavoro ML, fai riferimento a Istanze Amazon EC2 G5g.

Informazioni sugli autori

Carter Huffmann è il CTO e co-fondatore di Modulate, una startup di tecnologia vocale che mira a combattere la tossicità online e migliorare la comunicazione vocale nei giochi. Ha un background in fisica, apprendimento automatico e analisi dei dati e in precedenza ha lavorato presso il Jet Propulsion Laboratory della NASA. È appassionato di comprendere e manipolare il linguaggio umano utilizzando reti neurali profonde. Si è laureato al MIT con un Bachelor of Science in Fisica.

Carter Huffmann è il CTO e co-fondatore di Modulate, una startup di tecnologia vocale che mira a combattere la tossicità online e migliorare la comunicazione vocale nei giochi. Ha un background in fisica, apprendimento automatico e analisi dei dati e in precedenza ha lavorato presso il Jet Propulsion Laboratory della NASA. È appassionato di comprendere e manipolare il linguaggio umano utilizzando reti neurali profonde. Si è laureato al MIT con un Bachelor of Science in Fisica.

Shruti Koparkar è Senior Product Marketing Manager presso AWS. Aiuta i clienti a esplorare, valutare e adottare l'infrastruttura di elaborazione accelerata EC2 per le loro esigenze di machine learning.

Shruti Koparkar è Senior Product Marketing Manager presso AWS. Aiuta i clienti a esplorare, valutare e adottare l'infrastruttura di elaborazione accelerata EC2 per le loro esigenze di machine learning.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/modulate-makes-voice-chat-safer-while-reducing-infrastructure-costs-by-a-factor-of-5-with-amazon-ec2-g5g-instances/

- :È

- $ SU

- 100

- 17 milioni

- 2022

- 7

- a

- AAA

- capacità

- capace

- WRI

- abuso

- accelerata

- accesso

- compiuto

- Secondo

- Il mio account

- gestione contabile

- il raggiungimento

- Action

- attivo

- attori

- indirizzo

- adottare

- Adulto

- che interessano

- contro

- mira

- Tutti

- assegnazione

- alternativa

- Amazon

- Amazon EC2

- .

- analizzare

- ed

- api

- Applicazioni

- SONO

- ARM

- AS

- aspetti

- At

- Audio

- auto

- disponibile

- AWS

- precedente

- sfondo

- Vasca

- Equilibrio

- Larghezza di banda

- base

- basato

- BE

- perché

- diventare

- diventa

- prima

- Meglio

- fra

- Rompere

- Per i bilanci

- bufferizzare

- costruire

- Costruzione

- costruito

- by

- Materiale

- Custodie

- Causare

- sfide

- cambiando

- scegliere

- Scegli

- ha scelto

- clip

- Cloud

- Co-fondatore

- codice

- base del codice

- collezione

- Comunicazione

- Comunità

- comunità

- rispetto

- Calcolare

- informatica

- Segui il codice di Condotta

- fiducioso

- Configurazione

- Considerazioni

- vincoli

- contenuto

- Conversazione

- discorsivo

- Conversazioni

- Nucleo

- Costo

- risparmi

- costo effettivo

- Costi

- potuto

- Coppia

- coprire

- critico

- CTO

- a cura

- costume

- cliente

- Servizio clienti

- Clienti

- Pericoloso

- dati

- analisi dei dati

- giorno

- deciso

- deep

- Richiesta

- schierare

- rivelazione

- Determinare

- Dev

- sviluppato

- sviluppatori

- Mercato

- dispositivi

- cifre

- fare

- doppio

- doppie cifre

- raddoppiato

- giù

- driver

- dinamico

- dinamicamente

- Economico

- in modo efficiente

- enable

- abilitato

- Ingegneri

- garantire

- Impresa

- di livello enterprise

- Ambiente

- ambienti

- valutare

- EVER

- tutti

- evoluzione

- si è evoluta

- attenderti

- costoso

- esperienza

- Esperienze

- sperimentare

- esperti

- esplora

- esposto

- Esposizione

- esterno

- estremamente

- Fattori

- familiare

- Caratteristiche

- Grazie

- Federale

- combattere

- Trovate

- in forma

- contrassegnato

- concentrato

- Nel

- amici

- da

- funzioni

- ulteriormente

- gioco

- Gamers

- Giochi

- industria dei giochi

- gaming

- ottenere

- ottenere

- Go

- Obiettivi

- GPU

- GPU

- grande

- Gruppo

- GUEST

- Ospite Messaggio

- linee guida

- cura

- accadere

- Happening

- Avere

- avendo

- Aiuto

- aiutato

- aiuta

- qui

- Alta

- vivamente

- storicamente

- ORE

- Come

- http

- HTTPS

- umano

- ideologie

- Immagine

- in

- includere

- Inclusivo

- In arrivo

- industria

- Infrastruttura

- inizialmente

- Innovazione

- esempio

- integrazione

- Interfaccia

- Internet

- sicurezza

- IT

- jpg

- conservazione

- di laboratorio

- Dipingere

- Le Lingue

- maggiore

- Latenza

- lanciare

- IMPARARE

- apprendimento

- Livello

- biblioteche

- licenze

- piace

- caricare

- lotto

- Basso

- macchina

- machine learning

- mantenere

- make

- FA

- gestione

- direttore

- gestione

- manipolazione

- modo

- molti

- margini

- Marketing

- partita

- Massimizzare

- Maggio..

- significato

- Soddisfare

- Memorie

- metaverse

- piattaforme metaverse

- milione

- milioni

- minimo

- ordine

- minuto

- Missione

- CON

- ML

- modelli

- moderazione

- Mese

- Scopri di più

- maggior parte

- multiplo

- più giochi

- Naturale

- Bisogno

- esigenze

- Rete

- reti

- rete neurale

- reti neurali

- numero

- Nvidia

- si è verificato

- of

- Offerte

- on

- online

- il gioco online

- operativo

- OTTIMIZZA

- Altro

- altrimenti

- panoramica

- proprio

- pacchetto

- pacchetti

- particolarmente

- partner

- appassionato

- passato

- Persone

- persona

- Fisica

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- giocatori

- punti

- Termini e Condizioni

- popolarità

- posizionato

- positivo

- possibile

- Post

- energia

- alimentato

- prevenzione

- in precedenza

- Proactive

- Problema

- processi

- Elaborato

- lavorazione

- Processore

- processori

- Prodotto

- sviluppo del prodotto

- propulsione

- fornire

- fornisce

- fornitura

- editori

- rapidamente

- a raggiunto

- di rose

- tempo reale

- ricevere

- riducendo

- reinvestire

- pertinente

- Segnalati

- Reportistica

- richiedere

- necessario

- REST

- robusto

- Ruolo

- rovina

- Correre

- running

- sicura

- più sicuro

- Risparmi

- Risparmio

- Scalabilità

- scalabile

- Scala

- scala

- Scienze

- scienziati

- Punto

- sdk

- secondo

- invio

- anziano

- Serie

- servire

- Server

- servizio

- grave

- Corti

- lato

- singolo

- situazioni

- Taglia

- Dimensioni

- piccole

- So

- Social

- Software

- soluzione

- alcuni

- qualcosa

- lo spazio

- specifico

- discorso

- Spendere

- iniziato

- startup

- Ancora

- ruscello

- sciopero

- studios

- il successo

- di successo

- supporto

- sistema

- Fai

- team

- le squadre

- Consulenza

- Tecnologia

- condizioni

- test

- test

- che

- Il

- loro

- Li

- Strumenti Bowman per analizzare le seguenti finiture:

- cose

- Attraverso

- per tutto

- portata

- tempo

- a

- oggi

- traffico

- Tipi di

- in definitiva

- Incerto

- e una comprensione reciproca

- uptime

- urgente

- us

- Impiego

- uso

- caso d'uso

- utenti

- varietà

- via

- VIOLAZIONE

- Violazioni

- Voce

- WELL

- quale

- while

- bianca

- OMS

- volere

- con

- entro

- Lavora

- lavorato

- lavoro

- mondo

- classe mondiale

- sarebbe

- anno

- Tu

- giovane

- Trasferimento da aeroporto a Sharm

- zefiro