Il mese scorso il programma NITRD (Rete e Information Technology Research and Development) ha commemorato il suo 30° anniversario a Washington DC Puoi leggere il riepilogo completo dell'evento qui. Nel tentativo di evidenziare l'impatto che gli investimenti federali hanno avuto sulla comunità di ricerca informatica, l'evento è stato caratterizzato da cinque pannelli in cui i partecipanti hanno discusso i risultati chiave nel campo negli ultimi dieci anni e le direzioni future per il futuro. Ciascun panel si è concentrato su un'importante sottoarea della ricerca informatica: informatica su larga scala, reti e sicurezza, intelligenza artificiale/apprendimento automatico, privacy e Internet delle cose e informatica socialmente responsabile.

La privacy è diventata un importante argomento di conversazione non solo nella comunità di ricerca informatica, ma in tutte le discipline, sia nel mondo accademico che nell’industria. Gli effetti negativi sulla privacy derivanti dalla disponibilità di set di dati su larga scala si stanno moltiplicando sensori, dispositivi e attuatori interconnessi che compongono l’Internet delle cose (IoT). Moderato da Charles (“Chuck”) Romine (NIST) e gli esperti sul campo Ed Felten (Princeton), Marc Groman (Groman Consulting), Katerina Megas (NIST) e Sunoo Park (Cornell), Panel 4: Privacy e IoT discute argomenti importanti come i compromessi tra utilizzo dei dati e privacy e potenziali obiettivi di ricerca per aiutare a raggiungere soluzioni politiche efficaci.

Romine ha iniziato evidenziando un filo conduttore in tutti i panel: “parlando sia dei benefici che delle straordinarie capacità offerte attraverso gli investimenti dei finanziamenti federali, insieme ai rischi associati”. L'IoT non è diverso: offre alle persone l'accesso a informazioni insormontabili, consente campagne pubblicitarie di successo e adatta la tecnologia ai propri gusti personali, ma mette anche a repentaglio la privacy degli utenti.

Come ha sottolineato Megas, "Il motivo principale per cui stiamo intraprendendo questo sforzo è perché vogliamo essere in grado di vedere effettivamente riconosciuto l'IoT e consentire alla società di trarne i benefici". Ha continuato condividendo i potenziali vantaggi e l'importanza di poter condividere i dati attraverso l'IoT. Esiste una scala “fenomenale” di dispositivi nell’IoT che può essere utilizzata per identificare problemi tra set di dati, apprendere cose che hanno un alto potenziale di impatto per gli individui e la società, addestrare le tecnologie di intelligenza artificiale e consentire alle piccole aziende innovative di testare i propri dispositivi. Romine ha chiesto ai relatori quali siano effettivamente i rischi per la privacy associati in questo contesto di IoT e condivisione delle informazioni.

Groman ha risposto spiegando innanzitutto l'interazione tra privacy e IoT. Il lato privacy dell’IoT è un sottoinsieme di dati raccolti all’interno di un insieme più ampio, che riguarda o è relativo alle persone. Le persone sanno che vengono raccolti dati su di loro? Esiste un'interfaccia dove è possibile interagire con il dispositivo, scoprire cosa sta raccogliendo o modificarlo? Le persone comprendono quali informazioni vengono raccolte o quali deduzioni vengono fatte dal dispositivo o dall'azienda dai dati raccolti? A causa della struttura degli incentivi monetari e della “vasta” quantità di denaro che le aziende possono ricavare capitalizzando su tali dati, Groman ha esortato le persone a rivolgersi alla politica per trovare una soluzione.

“L’obiettivo qui è massimizzare i benefici e minimizzare i danni. In questo paese non abbiamo un quadro politico, legale o normativo che produca incentivi per raggiungere questo obiettivo” – Marc Groman

Contrastando la posizione di Groman, Romine ha chiesto alla giuria quali sono le potenzialità di una soluzione tecnologica.

Felten ha suggerito di iniziare cercando di comprendere e applicare meglio il controllo statistico delle informazioni e di creare strumenti che consentano alle persone di interagire con i propri dati e mitigare gli impatti negativi. Park, che nutre un particolare interesse per gli strumenti crittografici per la privacy, ha citato diversi modi in cui la crittografia potrebbe aiutare in questo senso.

"La crittografia fornisce un kit di strumenti per costruire sistemi che abbiano configurazioni di flussi di informazioni e includano un controllo più capillare sull'accesso". – Parco Sunoo

Uno degli strumenti potrebbero essere le prove a conoscenza zero, che consentono la condivisione parziale dei dati mantenendo segreti altri aspetti alle entità. Ha fatto l'esempio di un buttafuori che controlla i documenti d'identità per entrare in un bar: attraverso prove a conoscenza zero potresti dimostrare di avere 21 anni senza condividere anche il tuo indirizzo o la data di nascita elencati sul documento d'identità.

Park ha avvertito che, sebbene la crittografia fornisca “uno spazio di soluzioni più ampio che possiamo utilizzare per costruire la privacy”, non risponde alla domanda su che tipo di cose dovremmo costruire utilizzando questi strumenti o quali forme di informazioni riteniamo appropriate o desiderabili condividere. Questo è qualcosa che dobbiamo risolvere come società ed è una questione politica.

Infine, ai relatori è stato chiesto perché le persone dovrebbero interessarsene. E se non avessero nulla da nascondere? Guadagnandosi una risata dalla folla, Felten ha scherzato dicendo che tutti hanno qualcosa da nascondere. In una nota più seria, ha continuato evidenziando il potenziale danno nella profilazione dei dati.

"Le persone là fuori stanno costruendo un modello completo di chi sei e di cosa potresti fare." – Ed Felten

Già un pensiero terrificante, questi presupposti possono essere sbagliati e talvolta limitare le opportunità e la “libertà di azione” in futuro. Groman ha sottolineato un altro filo conduttore in tutte le discussioni dei panel: l'importanza di rendersi conto che alcune comunità subiscono un impatto sproporzionato. La posta in gioco può essere più alta per mantenere privati alcuni dati, che si tratti di orientamento sessuale, genere, razza o donne o bambini vittime di abusi.

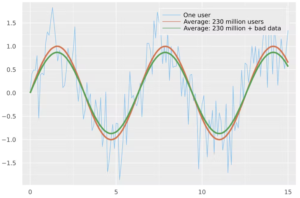

Durante le domande e risposte, l'ex relatore del panel 3, Ben Zorn, è tornato sui vantaggi dell'utilizzo dei dati per addestrare l'intelligenza artificiale. Ha chiesto cosa si potrebbe fare in caso di fuga di informazioni private attraverso i set di dati utilizzati per addestrare l’intelligenza artificiale.

Felten ha sottolineato che, a meno che non si utilizzi un metodo rigoroso per fermare intenzionalmente il flusso di informazioni, allora le informazioni fluiranno. Questo è il motivo per cui è così importante concentrarsi sulla creazione di metodi rigorosi e dimostrabili come l’apprendimento automatico che preservi la privacy e le interfacce per controllare l’effetto a cascata.

Megas lo ha riassunto perfettamente, dicendo che alla fine non possiamo formare tutti, ma possiamo fornire alle persone un quadro che consenta loro di pensare al rischio e fornire loro strumenti per dare loro un maggiore controllo sui propri dati. Puoi guardare la registrazione completa su Pagina web del CCC oppure Il canale YouTube di NITRD.

Tieni d'occhio il blog finale della serie, Panel 5: Come la tecnologia può apportare benefici alla società: ampliare le prospettive nella ricerca fondamentale.