Questo è il secondo post di una serie in quattro parti che spiega in dettaglio come Gruppo NatWest, un importante istituto di servizi finanziari, ha collaborato con Servizi professionali AWS per creare una nuova piattaforma per le operazioni di machine learning (MLOps). In questo post, condividiamo come il Gruppo NatWest ha utilizzato AWS per consentire l'implementazione self-service della propria piattaforma MLOps standardizzata, sicura e conforme utilizzando Catalogo dei servizi AWS ed Amazon Sage Maker. Ciò ha portato a una riduzione del tempo necessario per il provisioning di nuovi ambienti da giorni a poche ore.

Riteniamo che i decisori possano trarre vantaggio da questo contenuto. CTO, CDAO, data scientist senior e ingegneri cloud senior possono seguire questo schema per fornire soluzioni innovative per i loro team di data science e ingegneria.

Leggi l'intera serie:

|

Tecnologia al NatWest Group

NatWest Group è una banca di relazioni per un mondo digitale che fornisce servizi finanziari a oltre 19 milioni di clienti in tutto il Regno Unito. Il Gruppo dispone di un portafoglio tecnologico diversificato, in cui le soluzioni alle sfide aziendali vengono spesso fornite utilizzando design su misura e con tempistiche lunghe.

Di recente, NatWest Group ha adottato una strategia cloud-first, che ha consentito all'azienda di utilizzare servizi gestiti per fornire risorse di calcolo e storage on-demand. Questa mossa ha portato a un miglioramento della stabilità generale, della scalabilità e delle prestazioni delle soluzioni aziendali, riducendo i costi e accelerando la cadenza di consegna. Inoltre, il passaggio al cloud consente a NatWest Group di semplificare il proprio stack tecnologico applicando una serie di progetti di soluzioni coerenti, ripetibili e preapprovati per soddisfare i requisiti normativi e operare in modo controllato.

Le sfide

Le fasi pilota dell'adozione di un approccio cloud-first hanno coinvolto diverse fasi di sperimentazione e valutazione utilizzando un'ampia varietà di servizi di analisi su AWS. Le prime iterazioni della piattaforma cloud di NatWest Group per i carichi di lavoro di data science hanno affrontato le sfide con il provisioning di ambienti cloud coerenti, sicuri e conformi. Il processo di creazione di nuovi ambienti ha richiesto da pochi giorni a settimane o addirittura mesi. La dipendenza dai team della piattaforma centrale per la creazione, il provisioning, la protezione, la distribuzione e la gestione dell'infrastruttura e delle origini dati ha reso difficile l'integrazione di nuovi team per lavorare nel cloud.

A causa della disparità nella configurazione dell'infrastruttura tra gli account AWS, i team che hanno deciso di migrare i propri carichi di lavoro nel cloud hanno dovuto sottoporsi a un elaborato processo di conformità. Ciascun componente dell'infrastruttura doveva essere analizzato separatamente, il che ha aumentato le tempistiche degli audit di sicurezza.

Iniziare con lo sviluppo in AWS ha comportato la lettura di una serie di guide alla documentazione scritte dai team della piattaforma. I passaggi iniziali della configurazione dell'ambiente includevano la gestione delle chiavi pubbliche e private per l'autenticazione, la configurazione delle connessioni ai servizi remoti tramite il Interfaccia della riga di comando di AWS (AWS CLI) o SDK da ambienti di sviluppo locali ed esecuzione di script personalizzati per collegare gli IDE locali ai servizi cloud. Le sfide tecniche spesso rendevano difficile l'inserimento di nuovi membri del team. Dopo che gli ambienti di sviluppo sono stati configurati, il percorso per il rilascio del software in produzione è stato altrettanto complesso e lungo.

Come descritto nella parte 1 di questa serie, il team di progetto congiunto ha raccolto grandi quantità di feedback sull'esperienza utente e sui requisiti dai team di NatWest Group prima di creare la nuova piattaforma di data science e MLOps. Un tema comune in questo feedback era la necessità di automazione e standardizzazione come precursore di una consegna rapida ed efficiente dei progetti su AWS. La nuova piattaforma utilizza i servizi gestiti da AWS per ottimizzare i costi, ridurre gli sforzi di configurazione della piattaforma e ridurre l'impronta di carbonio derivante dall'esecuzione di lavori di elaborazione di grandi dimensioni inutilmente. La standardizzazione è incorporata nel cuore della piattaforma, con componenti dell'infrastruttura preapprovati, completamente configurati, sicuri, conformi e riutilizzabili condivisibili tra i team di dati e analisi.

Perché SageMaker Studio?

La squadra ha scelto Amazon Sage Maker Studio come strumento principale per la creazione e la distribuzione di pipeline ML. Studio fornisce un'unica interfaccia basata sul Web che offre agli utenti accesso, controllo e visibilità completi in ogni fase richiesta per creare, addestrare e distribuire modelli. La maturità dell'IDE di Studio (ambiente di sviluppo integrato) per lo sviluppo del modello, il monitoraggio dei metadati, la gestione degli artefatti e l'implementazione sono state tra le caratteristiche che hanno attirato fortemente il team di NatWest Group.

I data scientist del NatWest Group lavorano con i notebook SageMaker all'interno di Studio durante le fasi iniziali dello sviluppo del modello per eseguire l'analisi dei dati, la disputa dei dati e l'ingegneria delle funzionalità. Dopo che gli utenti sono soddisfatti dei risultati di questo lavoro iniziale, il codice viene facilmente convertito in funzioni componibili per la trasformazione dei dati, l'addestramento del modello, l'inferenza, la registrazione e gli unit test in modo che sia in uno stato pronto per la produzione.

Le fasi successive del ciclo di vita di sviluppo del modello implicano l'uso di Pipeline di Amazon SageMaker, che può essere ispezionato visivamente e monitorato in Studio. Le pipeline vengono visualizzate in un DAG (Directed Acyclic Graph) che codifica a colori i passaggi in base al loro stato durante l'esecuzione della pipeline. Inoltre, una sintesi di Log di Amazon CloudWatch viene visualizzato accanto al DAG per facilitare il debug dei passaggi non riusciti. Ai data scientist viene fornito un modello di codice costituito da tutti i passaggi fondamentali in una pipeline SageMaker. Ciò fornisce un framework standardizzato (coerente tra tutti gli utenti della piattaforma per facilitare la collaborazione e la condivisione delle conoscenze) in cui gli sviluppatori possono aggiungere la logica personalizzata e il codice dell'applicazione specifico per la sfida aziendale che stanno risolvendo.

Gli sviluppatori eseguono le pipeline all'interno dell'IDE di Studio per garantire che le modifiche al codice si integrino correttamente con altri passaggi della pipeline. Dopo che le modifiche al codice sono state esaminate e approvate, queste pipeline vengono create ed eseguite automaticamente in base a un trigger di ramo del repository Git principale. Durante l'addestramento del modello, le metriche di valutazione del modello vengono archiviate e monitorate in SageMaker Experiments, che può essere utilizzato per l'ottimizzazione degli iperparametri. Dopo che un modello è stato addestrato, l'artefatto del modello viene archiviato in Registro dei modelli SageMaker, insieme ai metadati relativi ai contenitori del modello, ai dati utilizzati durante l'addestramento, alle funzionalità del modello e al codice del modello. Il registro del modello svolge un ruolo chiave nel processo di distribuzione del modello perché racchiude tutte le informazioni sul modello e consente l'automazione della promozione del modello negli ambienti di produzione.

Gli ingegneri di MLOps distribuiscono gestiti Lavori di trasformazione batch di SageMaker, che scalano per soddisfare le richieste del carico di lavoro. Sia i lavori di inferenza batch offline che i modelli online serviti tramite un endpoint utilizzano la funzionalità di inferenza gestita di SageMaker. Ciò avvantaggia sia i team delle applicazioni aziendali che quelli della piattaforma perché gli ingegneri della piattaforma non dedicano più tempo alla configurazione dei componenti dell'infrastruttura per l'inferenza del modello e i team delle applicazioni aziendali non scrivono codice standard aggiuntivo per configurare e interagire con le istanze di calcolo.

Perché AWS Service Catalog?

Il team ha scelto AWS Service Catalog per creare un catalogo di modelli di infrastruttura sicuri, conformi e preapprovati. I componenti dell'infrastruttura in un prodotto AWS Service Catalog sono preconfigurati per soddisfare i requisiti di sicurezza del gruppo NatWest. La gestione dell'accesso ai ruoli, le policy delle risorse, la configurazione di rete e le policy di controllo centrale sono configurate per ogni risorsa contenuta in un prodotto AWS Service Catalog. I prodotti vengono sottoposti a versionamento e condivisi con i team delle applicazioni seguendo un processo standard che consente ai team di data science e ingegneria di eseguire autonomamente e distribuire l'infrastruttura subito dopo aver ottenuto l'accesso ai propri account AWS.

I team di sviluppo della piattaforma possono facilmente evolvere i prodotti AWS Service Catalog nel tempo per consentire l'implementazione di nuove funzionalità in base ai requisiti aziendali. Le modifiche iterative ai prodotti vengono apportate con l'aiuto del controllo delle versioni dei prodotti di AWS Service Catalog. Quando viene rilasciata una nuova versione del prodotto, il team della piattaforma unisce le modifiche al codice al ramo Git principale e incrementa la versione del prodotto AWS Service Catalog. C'è un certo grado di autonomia e flessibilità nell'aggiornamento dell'infrastruttura perché gli account delle applicazioni aziendali possono utilizzare versioni precedenti dei prodotti prima della migrazione alla versione più recente.

Panoramica della soluzione

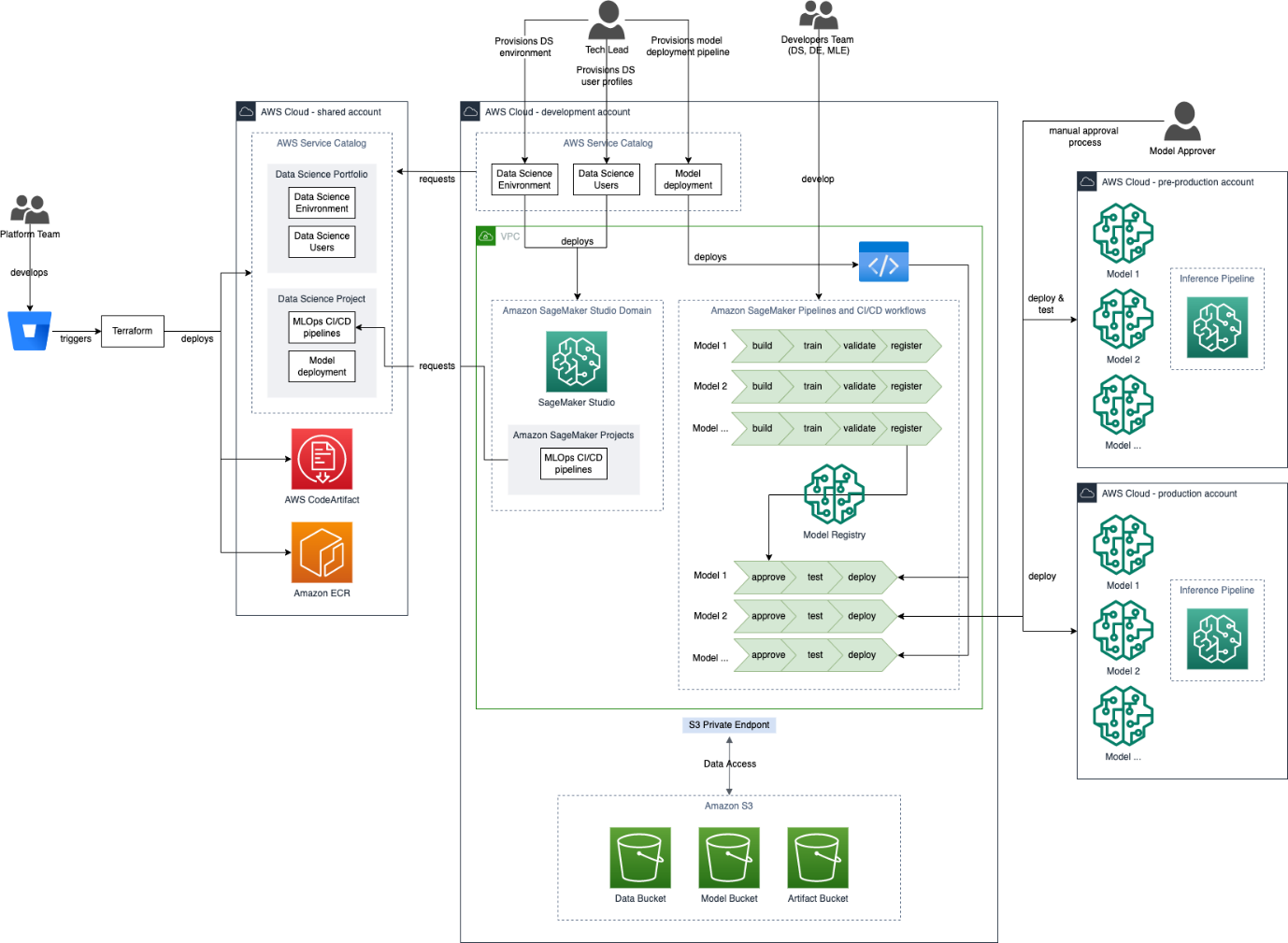

Il seguente diagramma dell'architettura di alto livello mostra come viene distribuito un tipico caso d'uso di un'applicazione aziendale su AWS. Le sezioni seguenti approfondiscono i dettagli relativi all'architettura dell'account, alla modalità di distribuzione dell'infrastruttura, alla gestione dell'accesso degli utenti e al modo in cui i diversi servizi AWS vengono utilizzati per creare soluzioni di machine learning.

Come mostrato nel diagramma dell'architettura, gli account seguono un modello hub e spoke. Un account di piattaforma condivisa funge da account hub, in cui le risorse richieste dagli account del team di applicazioni aziendali (spoke) sono ospitate dal team della piattaforma. Queste risorse includono quanto segue:

- Una libreria di prodotti di infrastruttura sicuri e standardizzati utilizzati per implementazioni di infrastrutture self-service, ospitate da AWS Service Catalog

- Immagini Docker, archiviate in Registro dei contenitori Amazon Elastic (Amazon ECR), che vengono utilizzati durante l'esecuzione dei passaggi della pipeline SageMaker e l'inferenza del modello

- Codice AWS Artefatto repository, che ospitano pacchetti Python preapprovati

Queste risorse vengono condivise automaticamente con gli account spoke tramite la funzionalità di condivisione e importazione del portfolio di AWS Service Catalog e Gestione dell'identità e dell'accesso di AWS (IAM) policy di attendibilità sia nel caso di Amazon ECR che di CodeArtifact.

A ogni team di applicazioni aziendali vengono forniti tre account AWS nell'ambiente dell'infrastruttura del gruppo NatWest: sviluppo, pre-produzione e produzione. I nomi dell'ambiente si riferiscono al ruolo previsto dell'account nel ciclo di vita dello sviluppo della scienza dei dati. L'account di sviluppo viene utilizzato per eseguire l'analisi dei dati e la disputa, scrivere il modello e il codice della pipeline del modello, addestrare i modelli e attivare le distribuzioni dei modelli negli ambienti di pre-produzione e produzione tramite SageMaker Studio. L'account di pre-produzione rispecchia la configurazione dell'account di produzione e viene usato per testare le distribuzioni di modelli e i processi di trasformazione in batch prima che vengano rilasciati in produzione. L'account di produzione ospita modelli ed esegue carichi di lavoro di inferenza di produzione.

Gestione degli utenti

NatWest Group dispone di rigidi processi di governance per imporre la separazione dei ruoli degli utenti. Sono stati creati cinque ruoli IAM separati per ogni persona utente.

Il team della piattaforma utilizza i seguenti ruoli:

- Ingegnere di supporto della piattaforma – Questo ruolo contiene le autorizzazioni per le attività normali e una vista di sola lettura del resto dell'ambiente per il monitoraggio e il debug della piattaforma.

- Ingegnere di correzione della piattaforma – Questo ruolo è stato creato con autorizzazioni elevate. Viene utilizzato se ci sono problemi con la piattaforma che richiedono un intervento manuale. Questo ruolo è assunto solo in modo approvato e limitato nel tempo.

I team di sviluppo delle applicazioni aziendali hanno tre ruoli distinti:

- Responsabile tecnico – Questo ruolo è assegnato al responsabile del team dell'applicazione, spesso un data scientist senior. Questo utente dispone dell'autorizzazione per distribuire e gestire i prodotti AWS Service Catalog, attivare i rilasci in produzione e rivedere lo stato dell'ambiente, ad esempio AWS Code Pipeline stati e registri. Questo ruolo non dispone dell'autorizzazione per approvare un modello nel registro dei modelli di SageMaker.

- Costruttori – Questo ruolo viene assegnato a tutti i membri del team che lavorano con SageMaker Studio, che include ingegneri, data scientist e spesso il team leader. Questo ruolo dispone delle autorizzazioni per aprire Studio, scrivere codice ed eseguire e distribuire pipeline SageMaker. Come il responsabile tecnico, questo ruolo non dispone dell'autorizzazione per approvare un modello nel registro modelli.

- Approvatore di modelli – Questo ruolo dispone di autorizzazioni limitate relative alla visualizzazione, all'approvazione e al rifiuto dei modelli nel registro dei modelli. Il motivo di questa separazione è impedire a tutti gli utenti in grado di creare e addestrare modelli di approvare e rilasciare i propri modelli in ambienti escalation.

Vengono creati profili utente Studio separati per sviluppatori e approvatori di modelli. La soluzione utilizza una combinazione di istruzioni di policy IAM e tag del profilo utente SageMaker in modo che gli utenti possano solo aprire un profilo utente che corrisponda al loro tipo di utente. Ciò garantisce che all'utente venga assegnato il ruolo IAM di esecuzione SageMaker corretto (e quindi le autorizzazioni) quando apre l'IDE di Studio.

Distribuzioni self-service con AWS Service Catalog

Gli utenti finali utilizzano AWS Service Catalog per distribuire prodotti di infrastruttura di data science, come i seguenti:

- Un ambiente Studio

- Profili utente di Studio

- Pipeline di distribuzione del modello

- Condutture di formazione

- Condutture di inferenza

- Un sistema di monitoraggio e allerta

Gli utenti finali distribuiscono questi prodotti direttamente tramite l'interfaccia utente di AWS Service Catalog, il che significa che c'è meno affidamento sui team della piattaforma centrale per il provisioning degli ambienti. Ciò ha notevolmente ridotto il tempo necessario agli utenti per accedere a nuovi ambienti cloud, da più giorni a poche ore, il che ha portato a un significativo miglioramento del time-to-value. L'utilizzo di un set comune di prodotti AWS Service Catalog supporta la coerenza all'interno dei progetti in tutta l'azienda e riduce le barriere per la collaborazione e il riutilizzo.

Poiché tutta l'infrastruttura della scienza dei dati viene ora distribuita tramite un catalogo di prodotti dell'infrastruttura sviluppato centralmente, è stata prestata attenzione a creare ciascuno di questi prodotti tenendo conto della sicurezza. I servizi sono stati configurati per comunicare all'interno Cloud privato virtuale di Amazon (Amazon VPC) in modo che il traffico non attraversi la rete Internet pubblica. I dati vengono crittografati in transito e inattivi utilizzando Servizio di gestione delle chiavi AWS (AWS KMS). I ruoli IAM sono stati inoltre impostati per seguire il principio del privilegio minimo.

Infine, con AWS Service Catalog, è facile per il team della piattaforma rilasciare continuamente nuovi prodotti e servizi man mano che diventano disponibili o richiesti dai team delle applicazioni aziendali. Questi possono assumere la forma di nuovi prodotti infrastrutturali, ad esempio fornendo la possibilità agli utenti finali di implementare i propri Amazon EMR cluster o aggiornamenti ai prodotti dell'infrastruttura esistenti. Perché AWS Service Catalog supporta il controllo delle versioni dei prodotti e utilizza AWS CloudFormazione dietro le quinte, gli aggiornamenti sul posto possono essere utilizzati quando vengono rilasciate nuove versioni di prodotti esistenti. Ciò consente ai team della piattaforma di concentrarsi sulla creazione e sul miglioramento dei prodotti, anziché sullo sviluppo di complessi processi di aggiornamento.

Integrazione con il software IaC esistente di NatWest

AWS Service Catalog viene utilizzato per le distribuzioni self-service dell'infrastruttura di data science. Inoltre, lo strumento IaC (Infrastructure as Code) standard di NatWest, Terraform, viene utilizzato per creare l'infrastruttura negli account AWS. Terraform viene utilizzato dai team della piattaforma durante il processo di configurazione iniziale dell'account per distribuire risorse infrastrutturali prerequisite come VPC, gruppi di sicurezza, Gestore di sistemi AWS parametri, chiavi KMS e controlli di sicurezza standard. Anche l'infrastruttura nell'account hub, come i portfolio AWS Service Catalog e le risorse utilizzate per creare immagini Docker, viene definita utilizzando Terraform. Tuttavia, i prodotti AWS Service Catalog stessi vengono creati utilizzando modelli CloudFormation standard.

Miglioramento della produttività degli sviluppatori e della qualità del codice con i progetti SageMaker

Progetti SageMaker fornire a sviluppatori e data scientist l'accesso a progetti di avvio rapido senza uscire da SageMaker Studio. Questi progetti di avvio rapido consentono di distribuire più risorse dell'infrastruttura contemporaneamente in pochi clic. Questi includono un repository Git contenente un modello di progetto standardizzato per il tipo di modello selezionato, Servizio di archiviazione semplice Amazon Bucket (Amazon S3) per l'archiviazione di dati, modelli serializzati e artefatti e pipeline CodePipeline di addestramento del modello e inferenza.

L'introduzione di architetture e strumenti di base di codice standardizzati ora consentono ai data scientist e agli ingegneri di spostarsi facilmente tra i progetti e garantire che la qualità del codice rimanga elevata. Ad esempio, le best practice di ingegneria del software come i controlli di linting e formattazione (eseguiti sia come controlli automatizzati che come hook pre-commit), unit test e report di copertura sono ora automatizzati come parte delle pipeline di formazione, fornendo la standardizzazione in tutti i progetti. Ciò ha migliorato la manutenibilità dei progetti ML e semplificherà lo spostamento di questi progetti in produzione.

Automatizzare le implementazioni dei modelli

Il processo di addestramento del modello è orchestrato utilizzando SageMaker Pipelines. Dopo che i modelli sono stati addestrati, vengono archiviati nel registro dei modelli di SageMaker. Gli utenti a cui è stato assegnato il ruolo di approvatore del modello possono aprire il registro del modello e trovare informazioni relative al processo di formazione, ad esempio quando il modello è stato addestrato, i valori dell'iperparametro e le metriche di valutazione. Queste informazioni aiutano l'utente a decidere se approvare o rifiutare un modello. Il rifiuto di un modello impedisce la distribuzione del modello in un ambiente escalation, mentre l'approvazione di un modello attiva una pipeline di promozione del modello tramite CodePipeline che copia automaticamente il modello nell'account AWS di pre-produzione, pronto per il test del carico di lavoro di inferenza. Dopo che il team ha confermato che il modello funziona correttamente in pre-produzione, viene approvato un passaggio manuale nella stessa pipeline e il modello viene automaticamente copiato nell'account di produzione, pronto per i carichi di lavoro di inferenza della produzione.

Risultati

Uno degli obiettivi principali di questo progetto di collaborazione tra NatWest e AWS era ridurre il tempo necessario per fornire e distribuire ambienti cloud di data science e modelli ML in produzione. Ciò è stato raggiunto: NatWest ora può eseguire il provisioning di ambienti AWS nuovi, scalabili e sicuri nel giro di poche ore, rispetto a giorni o addirittura settimane. I data scientist e gli ingegneri possono ora distribuire e gestire autonomamente l'infrastruttura della scienza dei dati utilizzando AWS Service Catalog, riducendo la dipendenza dai team centralizzati della piattaforma. Inoltre, l'uso dei progetti SageMaker consente agli utenti di iniziare la codifica e i modelli di formazione in pochi minuti, fornendo anche strutture e strumenti di progetto standardizzati.

Poiché AWS Service Catalog funge da metodo centrale per distribuire l'infrastruttura di data science, la piattaforma può essere facilmente ampliata e aggiornata in futuro. Nuovi servizi AWS possono essere offerti rapidamente agli utenti finali quando se ne presenta la necessità e i prodotti AWS Service Catalog esistenti possono essere aggiornati per sfruttare le nuove funzionalità.

Infine, il passaggio ai servizi gestiti su AWS significa che le risorse di calcolo vengono fornite e chiuse su richiesta. Ciò ha fornito risparmi sui costi e flessibilità, allineandosi anche con L'ambizione di NatWest di essere a zero entro il 2050 a causa di una riduzione stimata del 75% di CO2 emissioni.

Conclusione

L'adozione di una strategia cloud-first in NatWest Group ha portato alla creazione di una solida soluzione AWS in grado di supportare un gran numero di team di applicazioni aziendali in tutta l'organizzazione. La gestione dell'infrastruttura con AWS Service Catalog ha migliorato notevolmente il processo di onboarding del cloud utilizzando blocchi predefiniti dell'infrastruttura sicuri, conformi e preapprovati che possono essere facilmente espansi. I componenti dell'infrastruttura SageMaker gestiti hanno migliorato il processo di sviluppo del modello e accelerato la consegna dei progetti ML.

Per saperne di più sul processo di creazione di modelli ML pronti per la produzione in NatWest Group, dai un'occhiata al resto di questa serie in quattro parti sulla collaborazione strategica tra NatWest Group e AWS Professional Services:

- Parte 1 spiega come NatWest Group ha collaborato con AWS Professional Services per creare una piattaforma MLOps scalabile, sicura e sostenibile

- Parte 3 fornisce una panoramica di come NatWest Group utilizza i servizi SageMaker per creare modelli ML verificabili, riproducibili e spiegabili

- Parte 4 descrive in dettaglio come i team di data science NatWest migrano i loro modelli esistenti alle architetture SageMaker

Informazioni sugli autori

Junaid Baba è Consulente DevOps presso Servizi professionali AWS Sfrutta la sua esperienza in Kubernetes, calcolo distribuito, AI/MLOP per accelerare l'adozione del cloud da parte dei clienti del settore dei servizi finanziari del Regno Unito. Junaid è in AWS da giugno 2018. In precedenza, Junaid ha lavorato con numerose start-up finanziarie guidando le pratiche DevOps. Al di fuori del lavoro si interessa di trekking, arte moderna e fotografia.

Junaid Baba è Consulente DevOps presso Servizi professionali AWS Sfrutta la sua esperienza in Kubernetes, calcolo distribuito, AI/MLOP per accelerare l'adozione del cloud da parte dei clienti del settore dei servizi finanziari del Regno Unito. Junaid è in AWS da giugno 2018. In precedenza, Junaid ha lavorato con numerose start-up finanziarie guidando le pratiche DevOps. Al di fuori del lavoro si interessa di trekking, arte moderna e fotografia.

Yordanka Ivanova è un Data Engineer presso NatWest Group. Ha esperienza nella creazione e fornitura di soluzioni dati per aziende nel settore dei servizi finanziari. Prima di entrare in NatWest, Yordanka ha lavorato come consulente tecnico dove ha acquisito esperienza nell'utilizzo di un'ampia varietà di servizi cloud e tecnologie open source per fornire risultati aziendali su più piattaforme cloud. Nel tempo libero, Yordanka ama allenarsi, viaggiare e suonare la chitarra.

Yordanka Ivanova è un Data Engineer presso NatWest Group. Ha esperienza nella creazione e fornitura di soluzioni dati per aziende nel settore dei servizi finanziari. Prima di entrare in NatWest, Yordanka ha lavorato come consulente tecnico dove ha acquisito esperienza nell'utilizzo di un'ampia varietà di servizi cloud e tecnologie open source per fornire risultati aziendali su più piattaforme cloud. Nel tempo libero, Yordanka ama allenarsi, viaggiare e suonare la chitarra.

Michele Inghilterra è un ingegnere del software nel team Data Science and Innovation di NatWest Group. È appassionato di sviluppo di soluzioni per l'esecuzione di carichi di lavoro di Machine Learning su larga scala nel cloud. Prima di entrare a far parte del gruppo NatWest, Michael ha lavorato e guidato team di ingegneria del software sviluppando applicazioni critiche nei servizi finanziari e nei settori dei viaggi. Nel tempo libero ama suonare la chitarra, viaggiare ed esplorare la campagna in bicicletta.

Michele Inghilterra è un ingegnere del software nel team Data Science and Innovation di NatWest Group. È appassionato di sviluppo di soluzioni per l'esecuzione di carichi di lavoro di Machine Learning su larga scala nel cloud. Prima di entrare a far parte del gruppo NatWest, Michael ha lavorato e guidato team di ingegneria del software sviluppando applicazioni critiche nei servizi finanziari e nei settori dei viaggi. Nel tempo libero ama suonare la chitarra, viaggiare ed esplorare la campagna in bicicletta.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-compliant-self-service-mlops-platform-using-aws-service- catalog-and-amazon-sagemaker/

- "

- 100

- Chi siamo

- accelerata

- accelerando

- accesso

- Il mio account

- operanti in

- aggiunta

- aggiuntivo

- Adozione

- Vantaggio

- Tutti

- Amazon

- tra

- quantità

- importi

- .

- analitica

- Applicazioni

- applicazioni

- approccio

- approvare

- architettura

- Arte

- addetto

- revisione

- Autenticazione

- Automatizzata

- Automazione

- Automazione e standardizzazione

- disponibile

- AWS

- Banca

- diventare

- dietro le quinte

- essendo

- beneficio

- vantaggi

- MIGLIORE

- best practice

- costruire

- Costruzione

- affari

- carbonio

- che

- centralizzata

- Challenge

- sfide

- Controlli

- Cloud

- cloud Platform

- servizi cloud

- codice

- codifica

- collaborazione

- combinazione

- Uncommon

- Aziende

- azienda

- rispetto

- complesso

- conformità

- compiacente

- componente

- Calcolare

- informatica

- Configurazione

- Connessioni

- consulente

- Contenitore

- Tecnologie Container

- contiene

- contenuto

- continuamente

- di controllo

- creato

- Creazione

- creazione

- critico

- costume

- Clienti

- dati

- analisi dei dati

- scienza dei dati

- scienziato di dati

- consegnato

- consegna

- consegna

- Richiesta

- richieste

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- descritta

- disegni

- dettaglio

- dettagli

- sviluppato

- Costruttori

- sviluppatori

- in via di sviluppo

- Mercato

- diverso

- difficile

- digitale

- direttamente

- distribuito

- calcolo distribuito

- docker

- non

- giù

- guida

- facilmente

- efficiente

- sforzi

- Elaborare

- enable

- endpoint

- ingegnere

- Ingegneria

- Ingegneri

- Impresa

- Ambiente

- stimato

- valutazione

- evolvere

- esempio

- esecuzione

- esistente

- esperienza

- caratteristica

- Caratteristiche

- feedback

- finanziario

- servizi finanziari

- Nome

- Fissare

- Flessibilità

- Focus

- seguire

- i seguenti

- Orma

- modulo

- Contesto

- funzionalità

- futuro

- Idiota

- la governance

- Gruppo

- Gruppo

- Guide

- contento

- Aiuto

- aiuta

- Alta

- Come

- HTTPS

- Identità

- implementazione

- migliorata

- includere

- incluso

- inclusi

- è aumentato

- industrie

- industria

- informazioni

- Infrastruttura

- Innovazione

- creativi e originali

- Istituzione

- integrare

- integrato

- interessi

- Interfaccia

- Internet

- coinvolto

- sicurezza

- IT

- Offerte di lavoro

- Le

- Tasti

- conoscenze

- grandi

- con i più recenti

- portare

- IMPARARE

- apprendimento

- Guidato

- leveraggi

- leveraging

- Biblioteca

- Limitato

- linea

- collegamento

- locale

- macchina

- machine learning

- fatto

- maggiore

- FA

- gestire

- gestito

- gestione

- gestione

- modo

- Manuale

- Importanza

- maturità

- significato

- Utenti

- Metrica

- milione

- mente

- ML

- modello

- modelli

- monitoraggio

- mese

- Scopri di più

- cambiano

- in movimento

- multiplo

- nomi

- internazionale

- Nuove funzionalità

- Nuova piattaforma

- nuovo prodotto

- prodotti nuovi

- numero

- offerto

- offline

- Procedura di Onboarding

- online

- aprire

- Operazioni

- OTTIMIZZA

- organizzazione

- Altro

- complessivo

- proprio

- particolare

- collaborato

- appassionato

- Cartamodello

- performance

- fotografia

- pilota

- piattaforma

- Piattaforme

- gioco

- Termini e Condizioni

- politica

- lavori

- portafogli

- principio

- un bagno

- Chiavi private

- processi

- i processi

- Prodotto

- Produzione

- della produttività

- Prodotti

- professionale

- Profilo

- Profili

- progetto

- progetti

- promozione

- fornire

- fornisce

- fornitura

- la percezione

- qualità

- Presto

- rapidamente

- Lettura

- ridurre

- riducendo

- normativo

- rapporto

- rilasciare

- rilasciato

- Uscite

- fiducia

- Report

- deposito

- richiedere

- necessario

- Requisiti

- risorsa

- Risorse

- REST

- Risultati

- recensioni

- strada

- Correre

- running

- Scalabilità

- scalabile

- Scala

- Scene

- Scienze

- Scienziato

- scienziati

- sdk

- sicuro

- problemi di

- selezionato

- Serie

- servizio

- Servizi

- set

- flessibile.

- Condividi

- condiviso

- significativa

- Allo stesso modo

- Un'espansione

- So

- Software

- Software Engineer

- Ingegneria del software

- soluzione

- Soluzioni

- spendere

- Stabilità

- pila

- Standard

- start-up

- iniziato

- Regione / Stato

- dichiarazioni

- Stato dei servizi

- conservazione

- Strategico

- Strategia

- studio

- supporto

- supporti

- sostenibile

- sistema

- SISTEMI DI TRATTAMENTO

- task

- team

- Consulenza

- Tecnologie

- Tecnologia

- modelli

- test

- Testing

- test

- il giunto

- tema

- perciò

- Attraverso

- tempo

- verso

- Tracking

- traffico

- Training

- Trasformare

- Trasformazione

- transito

- viaggiare

- Di viaggio

- Affidati ad

- ui

- Uk

- Aggiornamenti

- uso

- utenti

- utilizzare

- Utilizzando

- varietà

- Visualizza

- virtuale

- visibilità

- Web-basata

- se

- while

- OMS

- entro

- senza

- Lavora

- lavorato

- lavoro

- risolvendo

- lavori

- mondo