L'adozione della tecnologia cloud AWS presso NatWest Group significa spostare i nostri carichi di lavoro di machine learning (ML) su una soluzione più solida e scalabile, riducendo al tempo stesso il tempo necessario per fornire i migliori prodotti e servizi ai nostri clienti.

In questo percorso di adozione del cloud, abbiamo selezionato il modello Customer Lifetime Value (CLV) per migrare ad AWS. Il modello ci consente di comprendere meglio i nostri clienti e di fornire soluzioni personalizzate. Il modello CLV è costituito da una serie di modelli ML separati riuniti in un'unica pipeline. Ciò richiede una soluzione scalabile, data la quantità di dati che elabora.

Questo è l'ultimo post di una serie in quattro parti che spiega in dettaglio come Gruppo NatWest hanno collaborato con Servizi professionali AWS per costruire una piattaforma MLOps scalabile, sicura e sostenibile. Questo post è destinato a ingegneri ML, data scientist e dirigenti di livello C che desiderano capire come creare soluzioni complesse utilizzando Amazon Sage Maker. Dimostra la flessibilità della piattaforma dimostrando come, dati alcuni modelli di codice iniziale, è possibile fornire un caso d'uso complesso e scalabile in modo rapido e ripetibile.

Leggi l'intera serie:

|

Le sfide

NatWest Group, nella sua missione di soddisfare i propri clienti rimanendo in linea con gli obblighi normativi, ha collaborato con AWS per creare una soluzione standardizzata e sicura per implementare e produrre carichi di lavoro ML. Le implementazioni precedenti nell'organizzazione hanno portato a silos di dati e tempi lunghi per l'avvio e il rallentamento degli ambienti. Ciò ha portato anche a risorse di elaborazione sottoutilizzate. Per contribuire a migliorare questo aspetto, AWS e NatWest hanno collaborato per sviluppare una serie di modelli di progetti e ambienti ML utilizzando i servizi AWS.

NatWest Group utilizza il machine learning per ricavare nuove informazioni in modo da poter prevedere e adattare le future esigenze bancarie dei nostri clienti nelle operazioni commerciali, di vendita al dettaglio e patrimoniali della banca. Quando si sviluppa un modello e lo si implementa in produzione, è necessario prendere in considerazione molte considerazioni per garantire la conformità agli standard della banca. Questi includono requisiti sulla spiegabilità del modello, sui bias, sulla qualità dei dati e sul monitoraggio della deriva. I modelli sviluppati attraverso questa collaborazione incorporano funzionalità per valutare questi punti e sono ora utilizzati dai team NatWest per integrare e produrre i propri casi d'uso in una configurazione multi-account sicura utilizzando SageMaker.

I modelli incorporano standard per flussi di lavoro ML pronti per la produzione incorporando le best practice AWS utilizzando le funzionalità MLOps in SageMaker. Includono inoltre una serie di distribuzioni di infrastrutture self-service, sicure e multi-account per servizi AWS ML e servizi dati tramite Servizio di archiviazione semplice Amazon (Amazon S3).

I modelli aiutano a utilizzare i team dedicati ai casi all'interno di NatWest per eseguire le seguenti operazioni:

- Costruire capacità in linea con il modello di maturità NatWest MLOps

- Implementa le best practice AWS per le funzionalità MLOps nei servizi SageMaker

- Crea e utilizza standard basati su modelli per sviluppare flussi di lavoro ML pronti per la produzione

- Fornisci una distribuzione dell'infrastruttura self-service e sicura per i servizi AWS ML

- Riduci i tempi di attivazione e disattivazione degli ambienti per i progetti utilizzando un approccio gestito

- Riduci i costi di manutenzione grazie alla standardizzazione dei processi, all'automazione e all'elaborazione on-demand

- Productionize code, che consente la migrazione di modelli esistenti in cui il codice è funzionalmente scomposto per sfruttare le architetture cloud on-demand migliorando al tempo stesso la leggibilità del codice ed eliminando il debito tecnico

- Utilizzare l'integrazione continua, la distribuzione e la formazione per la prova di concetto (PoC) e lo sviluppo di casi d'uso, nonché abilitare funzionalità MLOps aggiuntive (monitoraggio del modello, spiegabilità e passaggi delle condizioni)

Le sezioni seguenti illustrano come NatWest utilizza questi modelli per migrare progetti esistenti o crearne di nuovi.

Modelli e architettura SageMaker personalizzati

NatWest e AWS hanno creato modelli di progetto personalizzati con le funzionalità dei modelli di progetto SageMaker esistenti e li hanno integrati con modelli di infrastruttura per distribuirli negli ambienti di produzione. Questa configurazione contiene già pipeline di esempio per l'addestramento e l'inferenza e consente agli utenti NatWest di utilizzare immediatamente la distribuzione su più account.

La configurazione multi-account mantiene sicuri gli ambienti di sviluppo consentendo al tempo stesso il test in un ambiente di tipo produzione. Ciò consente ai team di progetto di concentrarsi sui carichi di lavoro ML. I modelli di progetto si occupano dell'infrastruttura, del provisioning delle risorse, della sicurezza, della verificabilità, della riproducibilità e della spiegabilità. Consentono inoltre flessibilità in modo che gli utenti possano estendere il modello in base ai requisiti specifici del caso d'uso.

Panoramica della soluzione

Per iniziare come team di casi d'uso presso NatWest, sono richiesti i seguenti passaggi in base ai modelli creati da NatWest e forniti tramite Catalogo dei servizi AWS:

- Il proprietario del progetto fornisce nuovi account AWS e il team operativo configura l'infrastruttura prerequisita MLOps per questi nuovi account.

- Il proprietario del progetto crea un file Amazon Sage Maker Studio ambiente di scienza dei dati utilizzando AWS Service Catalog.

- Il responsabile del data scientist avvia un nuovo progetto e crea utenti SageMaker Studio tramite i modelli forniti in AWS Service Catalog.

- Il team di progetto lavora al progetto, aggiornando la struttura delle cartelle del modello per facilitare il proprio caso d'uso.

La figura seguente mostra come abbiamo adattato l'architettura del modello per soddisfare le esigenze dei nostri casi d'uso CLV. Mostra come vengono sviluppate ed eseguite più pipeline di formazione all'interno di un ambiente di sviluppo. I modelli distribuiti possono quindi essere testati e messi in produzione negli ambienti di pre-produzione e produzione.

Il modello CLV è una sequenza di modelli diversi, che include diversi modelli basati su alberi e una configurazione di inferenza che combina tutti gli output di questi. I dati utilizzati in questo carico di lavoro ML vengono raccolti da varie fonti e ammontano a oltre mezzo miliardo di righe e quasi 1,900 funzionalità. Tutte le attività di elaborazione, progettazione delle funzionalità, formazione dei modelli e inferenza in locale sono state eseguite utilizzando PySpark o Python.

Modelli di pipeline SageMaker

CLV è composto da più modelli costruiti in sequenza. Ogni modello si alimenta con un altro, quindi abbiamo bisogno di una pipeline di formazione dedicata per ciascuno di essi. Pipeline di Amazon SageMaker ci consente di addestrare e registrare più modelli utilizzando il registro dei modelli SageMaker. Per ciascuna pipeline, il codice NatWest esistente è stato sottoposto a refactoring per adattarsi a SageMaker Pipelines, garantendo al tempo stesso che i componenti logici di elaborazione, ingegneria delle funzionalità e training del modello rimanessero gli stessi.

Inoltre, il codice per applicare i modelli per eseguire l'inferenza consecutivamente è stato sottoposto a refactoring in un'unica pipeline dedicata all'inferenza. Pertanto, il caso d'uso richiedeva più pipeline di addestramento ma solo una pipeline di inferenza.

Ogni pipeline di addestramento comporta la creazione di un modello ML. Per distribuire questo modello, è necessaria l'approvazione dell'approvatore del modello (un ruolo definito per i casi d'uso ML in NatWest). Dopo la distribuzione, il modello è disponibile per Pipeline di inferenza SageMaker. La pipeline di inferenza applica i modelli addestrati in sequenza ai nuovi dati. Questa inferenza viene eseguita in batch e le previsioni vengono combinate per fornire il valore della vita del cliente finale per ciascun cliente.

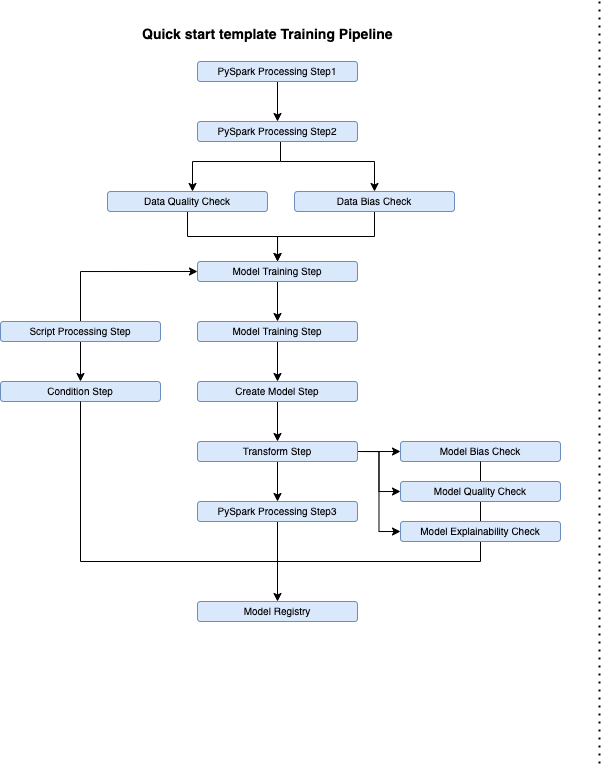

Il modello contiene un esempio MLOps standard con i seguenti passaggi:

- Elaborazione PySpark

- Controllo della qualità dei dati e controllo della distorsione dei dati

- Modello di formazione

- Condizione

- Crea modello

- Registro dei modelli

- Trasformare

- Controllo della distorsione del modello, controllo della spiegabilità e controllo della qualità

Questa pipeline è descritta in maggior dettaglio nella Parte 3: Come NatWest Group ha creato modelli ML udibili, riproducibili e spiegabili con Amazon SageMaker.

La figura seguente mostra la progettazione della pipeline di esempio fornita dal modello.

I dati vengono preelaborati e suddivisi in set di training, test e convalida (fase di elaborazione) prima del training del modello (Training). Dopo la distribuzione del modello (Crea modello), viene utilizzato per creare previsioni batch (Trasformazione). Le previsioni vengono quindi postelaborate e archiviate in Amazon S3 (elaborazione).

I controlli sulla qualità e sulla distorsione dei dati forniscono informazioni di base sui dati utilizzati per la formazione. La distorsione del modello, la spiegabilità e i controlli di qualità utilizzano previsioni sui dati di test per indagare ulteriormente il comportamento del modello. Queste informazioni e le metriche del modello derivanti dalla valutazione del modello (elaborazione) vengono successivamente visualizzate nel registro del modello. Il modello viene registrato solo quando viene soddisfatta una determinata condizione relativa ai migliori modelli precedenti (fase Condizione).

Tutti gli artefatti e i set di dati creati durante l'esecuzione di una pipeline vengono salvati in Amazon S3 utilizzando i bucket creati automaticamente durante il provisioning del modello.

Personalizzazione delle condutture

Avevamo bisogno di personalizzare il modello per garantire la migrazione dei componenti logici della codebase esistente.

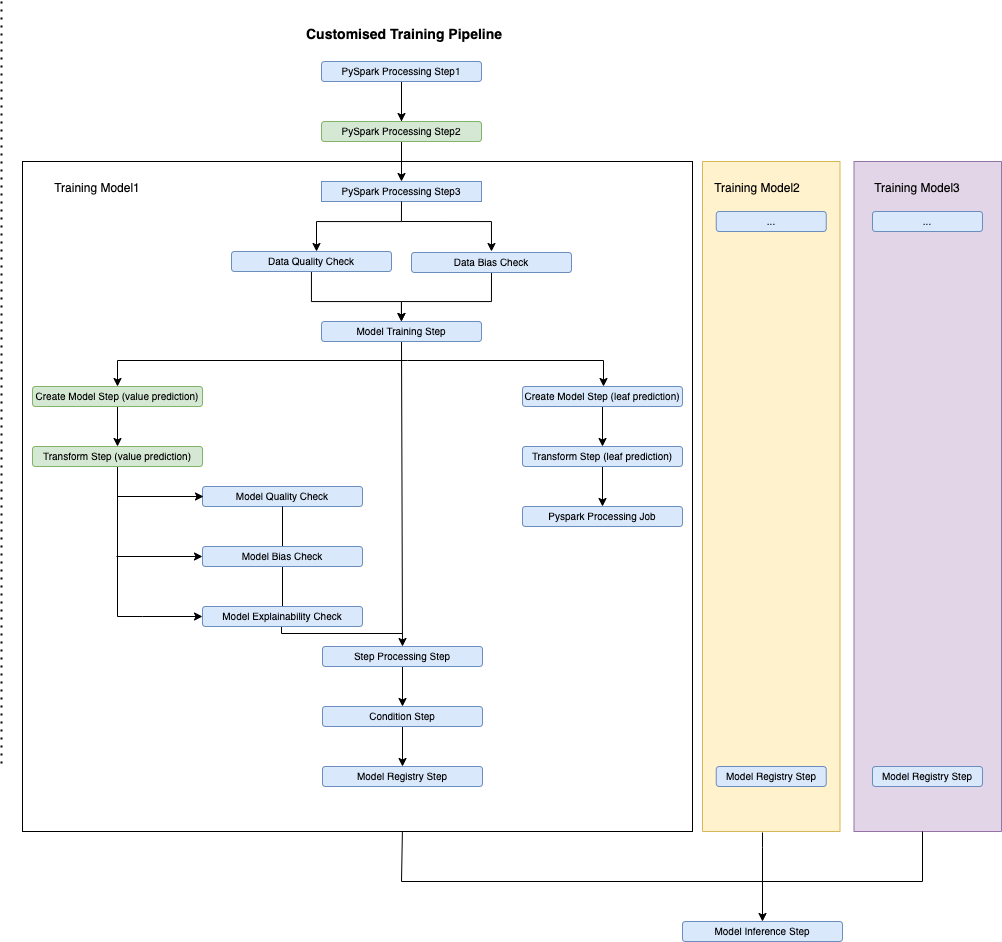

Abbiamo usato il LuceGBM quadro generale nella costruzione dei nostri modelli. Il primo dei modelli creati in questo caso d'uso è un semplice albero decisionale per applicare determinate suddivisioni di funzionalità durante l'addestramento del modello. Inoltre, dividiamo i dati in base a una determinata caratteristica. Questa procedura ha effettivamente portato alla formazione di due modelli di alberi decisionali separati.

Possiamo utilizzare gli alberi per applicare due tipi di previsioni: valore e foglia. Nel nostro caso, utilizziamo le previsioni dei valori sul set di test per calcolare le metriche personalizzate per la valutazione del modello e utilizziamo la previsione delle foglie per l'inferenza.

Pertanto, era necessario aggiungere specifiche alla pipeline di addestramento e inferenza fornita dal modello. Per tenere conto della complessità fornita dal modello del caso d'uso e per mostrare la flessibilità del modello, abbiamo aggiunto ulteriori passaggi alla pipeline e personalizzato i passaggi per applicare il codice richiesto.

La figura seguente mostra il nostro modello aggiornato. Dimostra inoltre come è possibile avere tutti i modelli distribuiti di cui si ha bisogno, che è possibile passare alla pipeline di inferenza.

Il nostro primo modello rafforza la conoscenza aziendale e suddivide i dati su una determinata funzionalità. Per questa pipeline di addestramento, abbiamo dovuto registrare due diversi modelli LightGBM per ciascun set di dati.

I passaggi necessari per addestrarli erano quasi identici. Pertanto, tutti i passaggi sono stati eseguiti due volte per ciascuna suddivisione dei dati rispetto al modello standard, ad eccezione dei primi passaggi di elaborazione. Viene applicata una seconda fase di elaborazione per soddisfare modelli diversi con set di dati univoci.

Nelle sezioni seguenti, discuteremo i passaggi personalizzati in modo più dettagliato.

Processando

Ogni fase di elaborazione viene fornito con un'istanza del processore, che gestisce le attività di elaborazione di SageMaker. Questo caso d'uso utilizza due tipi di processori per eseguire il codice Python:

- Processore PySpark – Ogni lavoro di elaborazione con un processore PySpark utilizza il proprio set di configurazioni Spark per ottimizzare il lavoro.

- Processore di script – Utilizziamo il codice Python esistente dal caso d'uso per generare parametri personalizzati basati sulle previsioni e sui dati effettivi forniti e formattare l'output da visualizzare successivamente nel registro del modello (JSON). Utilizziamo un'immagine personalizzata creata dal modello.

In ogni caso, possiamo modificare il tipo di istanza, il numero di istanze e la dimensione in GB del file Negozio di blocchi elastici di Amazon (Amazon EBS) per adattarlo alle esigenze della pipeline di formazione. Inoltre, applichiamo immagini di contenitori personalizzate create dal modello e, se necessario, possiamo estendere le librerie predefinite.

Allenamento modello

SageMaker fasi di formazione supportare la formazione gestita e l'inferenza per una varietà di framework ML. Nel nostro caso utilizziamo il file immagine personalizzata per l'apprendimento di Scikit fornito utilizzando Amazon ECR in combinazione con il file Stimatore Scikit-learn per addestrare i nostri due modelli LightGBM.

Il progetto precedente per il modello dell'albero decisionale prevedeva una classe personalizzata, che era complicata e doveva essere semplificata adattando alberi decisionali separati a sezioni filtrate dei dati. Abbiamo raggiunto questo obiettivo implementando due fasi di formazione con diversi parametri e input di dati richiesti per ciascun modello.

Condizione

Passaggi condizionali in SageMaker Pipelines supportano la ramificazione condizionale nell'esecuzione dei passaggi. Se tutte le condizioni nell'elenco delle condizioni restituiscono True, i passaggi "se" vengono contrassegnati come pronti per l'esecuzione. Altrimenti, i passaggi “else” vengono contrassegnati come pronti per l'esecuzione. Per il nostro caso d'uso, utilizziamo due passaggi condizionali (ConditionLessThan) per determinare se i parametri personalizzati correnti per ciascun modello (ad esempio l'errore medio assoluto calcolato su un set di test) sono inferiori a una soglia prestazionale. In questo modo, registriamo i modelli solo quando la qualità del modello è accettabile.

Crea modello

Il creare il passaggio del modello aiuta a rendere disponibili i modelli per le attività di inferenza ed eredita anche il codice da utilizzare per creare previsioni. Poiché il nostro caso d'uso necessita di previsioni di valore e foglia per due modelli diversi, le pipeline di addestramento hanno quattro diverse fasi di creazione del modello.

A ogni passaggio viene assegnato un file del punto di ingresso a seconda che il passaggio di trasformazione consecutivo debba prevedere una foglia o un valore su determinati dati.

Trasformare

Ogni passo di trasformazione utilizza un modello (creato dalla fase di creazione del modello) per restituire le previsioni. Nel nostro caso, ne abbiamo uno per ogni modello creato, per un totale di quattro passaggi di trasformazione. Ciascuno di questi passaggi restituisce previsioni foglia o valore per ciascuno dei modelli. L'output viene personalizzato in base al passaggio successivo della pipeline. Ad esempio, una fase di trasformazione per le previsioni dei valori ha diversi filtri di output per creare un input specifico richiesto per le seguenti fasi di verifica del modello nella pipeline.

Registro dei modelli

Infine, entrambi i rami del modello all'interno della pipeline di addestramento hanno un file unique fase di registrazione del modello. Come la configurazione standard, ogni passaggio del registro del modello prende le informazioni specifiche del modello da tutti i passaggi del controllo (qualità, spiegabilità e bias), nonché metriche personalizzate e artefatti del modello. Ogni modello è registrato con un unico gruppo pacchetto modello.

Durante l'applicazione delle modifiche specifiche del caso d'uso alla codebase di esempio, le pipeline sono state eseguite utilizzando le configurazioni della cache per ogni passaggio della pipeline per migliorare l'esperienza di debug. I passaggi di memorizzazione nella cache sono utili durante lo sviluppo di pipeline SageMaker perché riducono i costi e fanno risparmiare tempo durante il test delle pipeline.

Possiamo ottimizzare le impostazioni di ogni passaggio che richiede un tipo e un conteggio di istanze (e, se applicabile, un volume EBS) per le istanze on-demand in base alle esigenze del caso d'uso.

Benefici

La collaborazione AWS-NatWest ha portato innovazione nell'implementazione di modelli ML tramite pipeline SageMaker e best practice MLOps. NatWest Group utilizza ora una soluzione standardizzata e sicura per implementare e produrre carichi di lavoro ML su AWS, tramite modelli personalizzati flessibili. Inoltre, la migrazione del modello descritta in questo post ha creato molteplici vantaggi aziendali immediati e continuativi.

Innanzitutto, abbiamo ridotto la complessità tramite la standardizzazione:

- Possiamo integrare modelli personalizzati di terze parti in SageMaker in modo altamente modulare per creare una soluzione riutilizzabile

- Possiamo creare pipeline non standard utilizzando modelli e questi modelli sono supportati in un ambiente di produzione MLOps standardizzato

Abbiamo riscontrato i seguenti vantaggi nell'ingegneria del software e delle infrastrutture:

- Possiamo personalizzare i modelli in base ai casi d'uso individuali

- La scomposizione e il refactoring funzionale del codice del modello originale ci consente di riprogettare, rimuovere un significativo debito tecnico causato dal codice legacy e spostare le nostre pipeline in un ambiente di esecuzione on-demand gestito

- Possiamo utilizzare le funzionalità aggiuntive disponibili tramite i modelli standardizzati per aggiornare e standardizzare la spiegabilità del modello, nonché verificare la qualità e i bias dei dati e del modello

- Il team di progetto NatWest ha il potere di fornire ambienti, implementare modelli e produrre modelli in un ambiente quasi completamente self-service

Infine, abbiamo ottenuto una maggiore produttività e minori costi di manutenzione:

- Time-to-live ridotto per i progetti ML – Ora possiamo avviare progetti con modelli generici che implementano standard di codice, test unitari e pipeline CI/CD per lo sviluppo di casi d'uso pronti per la produzione fin dall'inizio di un progetto. La nuova standardizzazione significa che possiamo aspettarci tempi ridotti per l’integrazione dei casi d’uso futuri.

- Costi ridotti per l'esecuzione di flussi di lavoro ML nel cloud – Ora possiamo eseguire flussi di lavoro di elaborazione dati e ML con un’architettura gestita e adattare l’infrastruttura sottostante ai requisiti dei casi d’uso utilizzando modelli standardizzati.

- Maggiore collaborazione tra i team di progetto – Lo sviluppo standardizzato dei modelli significa che abbiamo aumentato la riusabilità delle funzioni del modello sviluppate dai singoli team. Ciò crea un'opportunità per implementare strategie di miglioramento continuo sia nello sviluppo che nelle operazioni.

- Consegna senza confini – Questa soluzione ci consente di rendere disponibile la nostra infrastruttura elastica on-demand 24 ore su 7, XNUMX giorni su XNUMX.

- Integrazione, distribuzione e test continui – La riduzione dei tempi di implementazione tra il completamento dello sviluppo e la disponibilità della produzione porta ai seguenti vantaggi:

- Possiamo ottimizzare la configurazione della nostra infrastruttura e del software per l'addestramento del modello e il runtime di inferenza.

- I costi correnti di manutenzione vengono ridotti grazie alla standardizzazione dei processi, all'automazione e all'elaborazione su richiesta. Pertanto, in produzione, sosteniamo costi di runtime solo una volta al mese durante la riqualificazione e l'inferenza.

Conclusione

Con SageMaker e l'assistenza della leadership dell'innovazione di AWS, NatWest ha creato un circolo virtuoso di produttività ML. I modelli, il codice modulare e riutilizzabile e la standardizzazione hanno liberato il team di progetto dai vincoli di consegna esistenti. Inoltre, l'automazione di MLOps ha liberato gli sforzi di supporto per consentire al team di lavorare su altri casi d'uso e progetti o di migliorare modelli e processi esistenti.

Questo è il quarto post di una serie in quattro parti sulla collaborazione strategica tra NatWest Group e AWS Professional Services. Dai un'occhiata al resto della serie per i seguenti argomenti:

- Parte 1 spiega come NatWest Group ha collaborato con AWS Professional Services per creare una piattaforma MLOps scalabile, sicura e sostenibile

- Parte 2 descrive come NatWest Group ha utilizzato AWS Service Catalog e SageMaker per distribuire la propria piattaforma MLOps conforme e self-service

- Parte 3 fornisce una panoramica di come NatWest Group utilizza i servizi SageMaker per creare modelli ML verificabili, riproducibili e spiegabili

Informazioni sugli autori

Paolino Ting è Data Scientist nel team dei Servizi Professionali di AWS. Supporta i clienti dei settori finanziario, sportivo e dei media nel raggiungimento e nell'accelerazione dei risultati aziendali sviluppando soluzioni AI/ML. Nel tempo libero, Pauline ama viaggiare, fare surf e provare nuovi posti dove mangiare dolci.

Paolino Ting è Data Scientist nel team dei Servizi Professionali di AWS. Supporta i clienti dei settori finanziario, sportivo e dei media nel raggiungimento e nell'accelerazione dei risultati aziendali sviluppando soluzioni AI/ML. Nel tempo libero, Pauline ama viaggiare, fare surf e provare nuovi posti dove mangiare dolci.

Maren Suilmann è un data scientist presso AWS Professional Services. Lavora con clienti di tutti i settori svelando la potenza dell'intelligenza artificiale/ML per raggiungere i loro risultati aziendali. Nel tempo libero le piace fare kickboxing, fare escursioni verso panorami meravigliosi e serate di giochi da tavolo.

Maren Suilmann è un data scientist presso AWS Professional Services. Lavora con clienti di tutti i settori svelando la potenza dell'intelligenza artificiale/ML per raggiungere i loro risultati aziendali. Nel tempo libero le piace fare kickboxing, fare escursioni verso panorami meravigliosi e serate di giochi da tavolo.

Craig Sim è un Senior Data Scientist presso NatWest Group con una passione per la ricerca sulla scienza dei dati, in particolare nel dominio dell'apprendimento automatico dei grafici e per l'ottimizzazione del processo di sviluppo dei modelli utilizzando le migliori pratiche MLOps. Craig ha inoltre una vasta esperienza nell'ingegneria del software e nella gestione dei programmi tecnici nell'ambito dei servizi finanziari. Craig ha un Master in Data Science, PGDip in Ingegneria del software e un BEng (Hons) in Ingegneria meccanica ed elettrica. Al di fuori del lavoro Craig è un appassionato giocatore di golf, avendo giocato a livello di contea junior e senior. Craig ha avuto la fortuna di poter integrare il suo interesse per il golf con la scienza dei dati, collaborando con il PGA European Tour e il World Golf Rankings per la sua tesi di Master in Data Science. Craig ama anche il tennis e lo sci ed è sposato e padre di tre figli, ormai adulti.

Craig Sim è un Senior Data Scientist presso NatWest Group con una passione per la ricerca sulla scienza dei dati, in particolare nel dominio dell'apprendimento automatico dei grafici e per l'ottimizzazione del processo di sviluppo dei modelli utilizzando le migliori pratiche MLOps. Craig ha inoltre una vasta esperienza nell'ingegneria del software e nella gestione dei programmi tecnici nell'ambito dei servizi finanziari. Craig ha un Master in Data Science, PGDip in Ingegneria del software e un BEng (Hons) in Ingegneria meccanica ed elettrica. Al di fuori del lavoro Craig è un appassionato giocatore di golf, avendo giocato a livello di contea junior e senior. Craig ha avuto la fortuna di poter integrare il suo interesse per il golf con la scienza dei dati, collaborando con il PGA European Tour e il World Golf Rankings per la sua tesi di Master in Data Science. Craig ama anche il tennis e lo sci ed è sposato e padre di tre figli, ormai adulti.

Shoaib Khan è un Data Scientist presso NatWest Group. La sua passione è risolvere i problemi aziendali, in particolare nel campo del valore della vita del cliente e dei prezzi utilizzando le migliori pratiche di MLOps. È ben attrezzato per gestire una vasta base di codici di machine learning ed è sempre entusiasta di testare nuovi strumenti e pacchetti. Ama educare gli altri intorno a lui poiché gestisce un canale YouTube chiamato convergeML. Nel tempo libero ama fare lunghe passeggiate e viaggiare.

Shoaib Khan è un Data Scientist presso NatWest Group. La sua passione è risolvere i problemi aziendali, in particolare nel campo del valore della vita del cliente e dei prezzi utilizzando le migliori pratiche di MLOps. È ben attrezzato per gestire una vasta base di codici di machine learning ed è sempre entusiasta di testare nuovi strumenti e pacchetti. Ama educare gli altri intorno a lui poiché gestisce un canale YouTube chiamato convergeML. Nel tempo libero ama fare lunghe passeggiate e viaggiare.

- Coinsmart. Il miglior scambio di bitcoin e criptovalute d'Europa.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. ACCESSO LIBERO.

- Criptofalco. Radar Altcoin. Prova gratuita.

- Fonte: https://aws.amazon.com/blogs/machine-learning/part-4-how-natwest-group-migrated-ml-models-to-amazon-sagemaker-architectures/

- "

- &

- 100

- Assoluta

- accelerando

- Secondo

- Il mio account

- raggiunto

- operanti in

- aggiunta

- aggiuntivo

- Adozione

- Vantaggio

- Tutti

- Consentire

- già

- Amazon

- quantità

- importi

- Un altro

- applicabile

- AMMISSIONE

- architettura

- in giro

- Automazione

- disponibilità

- disponibile

- AWS

- Settore bancario

- Linea di base

- Inizio

- vantaggi

- MIGLIORE

- best practice

- Miliardo

- Bloccare

- tavola

- costruire

- Costruzione

- affari

- funzionalità

- che

- casi

- ha causato

- certo

- Controlli

- Bambini

- Cerchio

- classe

- Cloud

- TECNOLOGIA NUVOLA

- codice

- collaborando

- collaborazione

- combinazione

- combinato

- rispetto

- completamente

- complesso

- conformità

- compiacente

- composto

- Calcolare

- concetto

- condizione

- Configurazione

- consecutivo

- Contenitore

- contiene

- Costi

- contea

- creare

- creato

- crea

- creazione

- Corrente

- costume

- cliente

- Clienti

- dati

- elaborazione dati

- scienza dei dati

- scienziato di dati

- Debito

- dedicato

- consegna

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- descritta

- Design

- dettaglio

- dettagliati

- Determinare

- sviluppare

- sviluppato

- in via di sviluppo

- Mercato

- diverso

- discutere

- dominio

- giù

- educare

- sforzo

- enable

- Ingegneria

- Ingegneri

- assicurando

- Ambiente

- attrezzato

- europeo

- valutare

- valutazione

- esempio

- esecuzione

- dirigenti

- esistente

- attenderti

- esperienza

- estendere

- estensivo

- caratteristica

- Caratteristiche

- figura

- filtri

- finanziario

- servizi finanziari

- Nome

- in forma

- Flessibilità

- flessibile

- Focus

- i seguenti

- formato

- Contesto

- ulteriormente

- futuro

- gioco

- generare

- grande

- Gruppo

- avendo

- Aiuto

- aiuta

- vivamente

- Come

- Tutorial

- HTTPS

- Immagine

- immediato

- realizzare

- implementazione

- Implementazione

- competenze

- migliorata

- includere

- inclusi

- è aumentato

- individuale

- industrie

- informazioni

- Infrastruttura

- Innovazione

- ingresso

- intuizioni

- integrare

- integrato

- integrazione

- interesse

- indagare

- coinvolto

- IT

- Lavoro

- conoscenze

- grandi

- portare

- Leadership

- apprendimento

- Guidato

- Eredità

- Livello

- tutta la vita

- linea

- Lista

- Lunghi

- macchina

- machine learning

- gestito

- gestione

- gestione

- maturità

- Media

- Metrica

- Missione

- ML

- modello

- modelli

- componibile

- monitoraggio

- Mese

- Scopri di più

- cambiano

- in movimento

- multiplo

- obblighi

- in corso

- Operazioni

- Opportunità

- OTTIMIZZA

- organizzazione

- Altro

- altrimenti

- proprio

- proprietario

- particolarmente

- collaborato

- appassionato

- performance

- piattaforma

- PoC

- punto

- punti

- energia

- predire

- predizione

- Previsioni

- precedente

- prezzi

- problemi

- processi

- i processi

- lavorazione

- Processore

- Produzione

- della produttività

- Prodotti

- professionale

- Programma

- progetto

- progetti

- prova

- prova del concetto

- dimostra

- fornire

- fornisce

- qualità

- rapidamente

- riducendo

- registro

- registrato

- normativo

- rimanente

- richiedere

- necessario

- Requisiti

- riparazioni

- risorsa

- Risorse

- REST

- Risultati

- nello specifico retail

- ritorno

- problemi

- Correre

- running

- scalabile

- Scienze

- Scienziato

- scienziati

- sicuro

- problemi di

- selezionato

- Serie

- servizio

- Servizi

- set

- flessibile.

- significativa

- Un'espansione

- Taglia

- So

- Software

- Ingegneria del software

- soluzione

- Soluzioni

- alcuni

- Specifiche tecniche

- Spin

- dividere

- Si divide

- Sports

- Standard

- standard

- inizia a

- iniziato

- inizio

- conservazione

- Strategico

- strategie

- studio

- supporto

- supportato

- supporti

- sostenibile

- presa

- task

- team

- Consulenza

- Tecnologia

- modelli

- test

- Testing

- test

- perciò

- di parti terze standard

- Attraverso

- tempo

- insieme

- strumenti

- Argomenti

- Training

- Trasformare

- viaggiare

- Di viaggio

- capire

- unico

- us

- uso

- utenti

- convalida

- APPREZZIAMO

- varietà

- vario

- volume

- Ricchezza

- se

- while

- OMS

- entro

- Lavora

- lavoro

- lavori

- mondo

- youtube