Riteniamo che l’intelligenza artificiale generativa abbia il potenziale per trasformare nel tempo praticamente ogni esperienza del cliente che conosciamo. Il numero di aziende che lanciano applicazioni di IA generativa su AWS è notevole e cresce rapidamente, tra cui adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy e LexisNexis Legal & Professional, solo per citarne alcune. Startup innovative come Perplexity AI puntano tutto su AWS per l'intelligenza artificiale generativa. Le principali aziende di intelligenza artificiale come Anthropic hanno scelto AWS come principale fornitore di servizi cloud per carichi di lavoro mission-critical e come luogo in cui addestrare i loro modelli futuri. E i fornitori di servizi e soluzioni globali come Accenture stanno raccogliendo i vantaggi delle applicazioni di intelligenza artificiale generativa personalizzate poiché danno ai propri sviluppatori interni la possibilità di Amazon Code Whisperer.

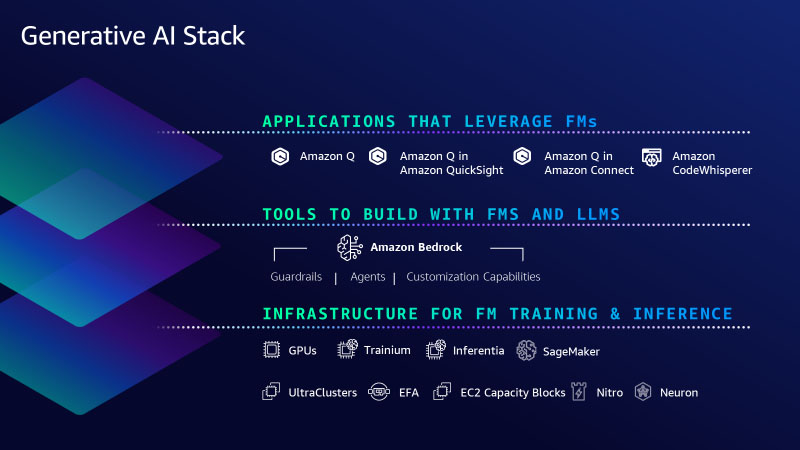

Questi clienti scelgono AWS perché siamo concentrati nel fare ciò che abbiamo sempre fatto: adottare una tecnologia complessa e costosa in grado di trasformare le esperienze dei clienti e le aziende e democratizzarla per clienti di tutte le dimensioni e capacità tecniche. Per fare ciò, stiamo investendo e innovando rapidamente per fornire il set più completo di funzionalità sui tre livelli dello stack di intelligenza artificiale generativa. Lo strato inferiore è l'infrastruttura per addestrare Large Language Models (LLM) e altri Foundation Models (FM) e produrre inferenze o previsioni. Il livello intermedio è un facile accesso a tutti i modelli e gli strumenti di cui i clienti hanno bisogno per creare e scalare applicazioni di intelligenza artificiale generativa con la stessa sicurezza, controllo degli accessi e altre funzionalità che i clienti si aspettano da un servizio AWS. E, soprattutto, abbiamo investito in applicazioni rivoluzionarie in aree chiave come la codifica generativa basata sull'intelligenza artificiale. Oltre a offrire loro scelta e, come si aspettano da noi, ampiezza e profondità di funzionalità su tutti i livelli, i clienti ci dicono anche che apprezzano il nostro approccio incentrato sui dati e confidano nel fatto che abbiamo costruito tutto da zero con la tecnologia aziendale. sicurezza e privacy di livello.

Questa settimana abbiamo fatto un grande passo avanti, annunciando molte nuove funzionalità significative su tutti e tre i livelli dello stack per rendere semplice e pratico per i nostri clienti l’utilizzo pervasivo dell’intelligenza artificiale generativa nelle loro attività.

Livello inferiore dello stack: AWS Trainium2 è l'ultima aggiunta a fornire l'infrastruttura cloud più avanzata per l'intelligenza artificiale generativa

Lo strato inferiore dello stack è l'infrastruttura (elaborazione, rete, framework, servizi) necessaria per addestrare ed eseguire LLM e altri FM. AWS innova per offrire l'infrastruttura più avanzata per il machine learning. Grazie alla nostra collaborazione di lunga data con NVIDIA, AWS è stato il primo a portare le GPU nel cloud più di 12 anni fa e, più recentemente, siamo stati il primo grande fornitore di servizi cloud a rendere disponibili le GPU NVIDIA H100 con le nostre istanze P5. Continuiamo a investire in innovazioni uniche che rendono AWS il miglior cloud per eseguire GPU, compresi i vantaggi in termini di rapporto prezzo-prestazioni del sistema di virtualizzazione più avanzato (AWS Nitro), potente rete su scala petabit con Elastic Fabric Adapter (EFA) e hyper- scalabilità del clustering con Amazon EC2 UltraClusters (migliaia di istanze accelerate co-localizzate in una zona di disponibilità e interconnesse in una rete non bloccante in grado di fornire fino a 3,200 Gbps per la formazione ML su vasta scala). Stiamo inoltre rendendo più semplice per tutti i clienti l'accesso alla tanto ricercata capacità di elaborazione GPU per l'intelligenza artificiale generativa con Amazon EC2 Capacità Blocks for ML, il primo e unico modello di consumo nel settore che consente ai clienti di riservare GPU per un uso futuro (fino a 500 distribuito in EC2 UltraClusters) per carichi di lavoro ML di breve durata.

Diversi anni fa, ci siamo resi conto che per continuare a spingere al massimo in termini di performance in termini di prezzo avremmo dovuto innovare fino al silicio e abbiamo iniziato a investire nei nostri chip. Nello specifico, per il ML, abbiamo iniziato con AWS Inferentia, il nostro chip di inferenza appositamente creato. Oggi siamo alla seconda generazione di AWS Inferentia con istanze Inf2 di Amazon EC2 ottimizzate specificamente per applicazioni di intelligenza artificiale generativa su larga scala con modelli contenenti centinaia di miliardi di parametri. Le istanze Inf2 offrono il costo più basso per l'inferenza nel cloud, offrendo allo stesso tempo un throughput fino a quattro volte superiore e una latenza fino a dieci volte inferiore rispetto alle istanze Inf1. Alimentate da un massimo di 12 chip Inferentia2, Inf2 sono le uniche istanze EC2 ottimizzate per l'inferenza che dispongono di connettività ad alta velocità tra gli acceleratori in modo che i clienti possano eseguire l'inferenza in modo più rapido ed efficiente (a costi inferiori) senza sacrificare prestazioni o latenza distribuendo modelli ultra-grandi attraverso più acceleratori. Clienti come Adobe, Deutsche Telekom e Leonardo.ai hanno ottenuto ottimi risultati iniziali e sono entusiasti di implementare i loro modelli su larga scala su Inf2.

Dal punto di vista della formazione, le istanze Trn1, basate sul chip di formazione ML appositamente creato da AWS, AWS Trainium, sono ottimizzate per distribuire la formazione su più server collegati alla rete EFA. Clienti come Ricoh hanno formato un LLM giapponese con miliardi di parametri in pochi giorni. Databricks offre un rapporto prezzo-prestazioni fino al 40% migliore con le istanze basate su Trainium per addestrare modelli di deep learning su larga scala. Ma con nuovi modelli più capaci che escono praticamente ogni settimana, continuiamo a superare i limiti in termini di prestazioni e dimensioni e siamo entusiasti di annunciare AWSTrainium2, progettato per offrire un rapporto prezzo/prestazioni ancora migliore per modelli di addestramento con centinaia di miliardi o trilioni di parametri. Trainium2 dovrebbe fornire prestazioni di addestramento fino a quattro volte più veloci rispetto al Trainium di prima generazione e, se utilizzato negli UltraClusters EC2, dovrebbe fornire fino a 65 exaflop di calcolo aggregato. Ciò significa che i clienti saranno in grado di addestrare un LLM da 300 miliardi di parametri in settimane anziché in mesi. Le prestazioni, la scalabilità e l'efficienza energetica di Trainium2 sono alcuni dei motivi per cui Anthropic ha scelto di addestrare i suoi modelli su AWS e utilizzerà Trainium2 per i suoi modelli futuri. E stiamo collaborando con Anthropic per una continua innovazione sia con Trainium che con Inferentia. Prevediamo che le nostre prime istanze Trainium2 saranno disponibili per i clienti nel 2024.

Abbiamo anche raddoppiato la catena di strumenti software per il nostro silicio ML, in particolare sviluppando AWS Neuron, il kit di sviluppo software (SDK) che aiuta i clienti a ottenere le massime prestazioni da Trainium e Inferentia. Dall'introduzione di Neuron nel 2019, abbiamo effettuato investimenti sostanziali in tecnologie di compilazione e framework e oggi Neuron supporta molti dei modelli più popolari disponibili al pubblico, tra cui Llama 2 di Meta, MPT di Databricks e Stable Diffusion di Stability AI, nonché 93 dei 100 migliori modelli nel popolare archivio di modelli Hugging Face. Neuron si collega ai più diffusi framework ML come PyTorch e TensorFlow e il supporto per JAX arriverà all'inizio del prossimo anno. I clienti ci dicono che Neuron ha reso loro semplice il passaggio delle pipeline di training e inferenza dei modelli esistenti a Trainium e Inferentia con solo poche righe di codice.

Nessun altro offre la stessa combinazione di scelta dei migliori chip ML, reti superveloci, virtualizzazione e cluster su vasta scala. Pertanto, non sorprende che alcune delle startup di intelligenza artificiale generativa più note come AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway e Stability AI funzionino su AWS. Tuttavia, sono comunque necessari gli strumenti giusti per sfruttare in modo efficace questo calcolo per creare, addestrare ed eseguire LLM e altri FM in modo efficiente ed economico. E per molte di queste startup, Amazon Sage Maker è la risposta. Che si tratti di costruire e addestrare un nuovo modello proprietario da zero o di iniziare con uno dei tanti modelli popolari disponibili al pubblico, la formazione è un'impresa complessa e costosa. Inoltre, non è facile gestire questi modelli in modo economicamente vantaggioso. I clienti devono acquisire grandi quantità di dati e prepararli. Ciò in genere comporta molto lavoro manuale per pulire i dati, rimuovere i duplicati, arricchirli e trasformarli. Quindi devono creare e mantenere grandi cluster di GPU/acceleratori, scrivere codice per distribuire in modo efficiente l'addestramento del modello tra i cluster, effettuare frequentemente checkpoint, mettere in pausa, ispezionare e ottimizzare il modello e intervenire manualmente e risolvere i problemi hardware nel cluster. Molte di queste sfide non sono nuove, ma sono solo alcune delle ragioni per cui abbiamo lanciato SageMaker sei anni fa: per abbattere le numerose barriere coinvolte nella formazione e nell'implementazione dei modelli e offrire agli sviluppatori una soluzione molto più semplice. Decine di migliaia di clienti utilizzano Amazon SageMaker e un numero crescente di loro, come LG AI Research, Perplexity AI, AI21, Hugging Face e Stability AI, stanno formando LLM e altri FM su SageMaker. Proprio di recente, il Technology Innovation Institute (i creatori del popolare Falcon LLM) ha addestrato il più grande modello disponibile al pubblico, Falcon 180B, su SageMaker. Con l'aumento delle dimensioni e della complessità dei modelli, è cresciuto anche l'ambito di SageMaker.

Nel corso degli anni, abbiamo aggiunto ad Amazon SageMaker più di 380 caratteristiche e capacità rivoluzionarie, tra cui ottimizzazione automatica dei modelli, formazione distribuita, opzioni flessibili di distribuzione dei modelli, strumenti per OP ML, strumenti per la preparazione dei dati, archivi di funzionalità, notebook, integrazione perfetta con valutazioni human-in-the-loop durante tutto il ciclo di vita del machine learning e funzionalità integrate per un'intelligenza artificiale responsabile. Continuiamo a innovare rapidamente per garantire che i clienti SageMaker siano in grado di continuare a creare, addestrare ed eseguire inferenza per tutti i modelli, inclusi LLM e altri FM. Inoltre, stiamo rendendo ancora più semplice ed economico per i clienti l'addestramento e l'implementazione di modelli di grandi dimensioni con due nuove funzionalità. Innanzitutto, per semplificare la formazione siamo l'introduzione di Amazon SageMaker HyperPod che automatizza la maggior parte dei processi richiesti per la formazione distribuita con tolleranza agli errori su larga scala (ad esempio, configurazione di librerie di formazione distribuite, scalabilità dei carichi di lavoro di formazione su migliaia di acceleratori, rilevamento e riparazione di istanze difettose), accelerando la formazione fino al 40%. Di conseguenza, clienti come Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid e altri utilizzano SageMaker HyperPod per costruire, addestrare o evolvere modelli. Secondo, stiamo introducendo nuove funzionalità per rendere l'inferenza più conveniente riducendo al tempo stesso la latenza. SageMaker ora aiuta i clienti a distribuire più modelli nella stessa istanza in modo che possano condividere le risorse di elaborazione, riducendo i costi di inferenza del 50% (in media). SageMaker monitora inoltre attivamente le istanze che stanno elaborando le richieste di inferenza e instrada in modo intelligente le richieste in base alle istanze disponibili, ottenendo una latenza di inferenza inferiore del 20% (in media). Conjecture, Salesforce e Slack stanno già utilizzando SageMaker per ospitare modelli grazie a queste ottimizzazioni di inferenza.

Livello intermedio dello stack: Amazon Bedrock aggiunge nuovi modelli e un'ondata di nuove funzionalità che rendono ancora più semplice per i clienti creare e scalare in modo sicuro applicazioni di intelligenza artificiale generativa

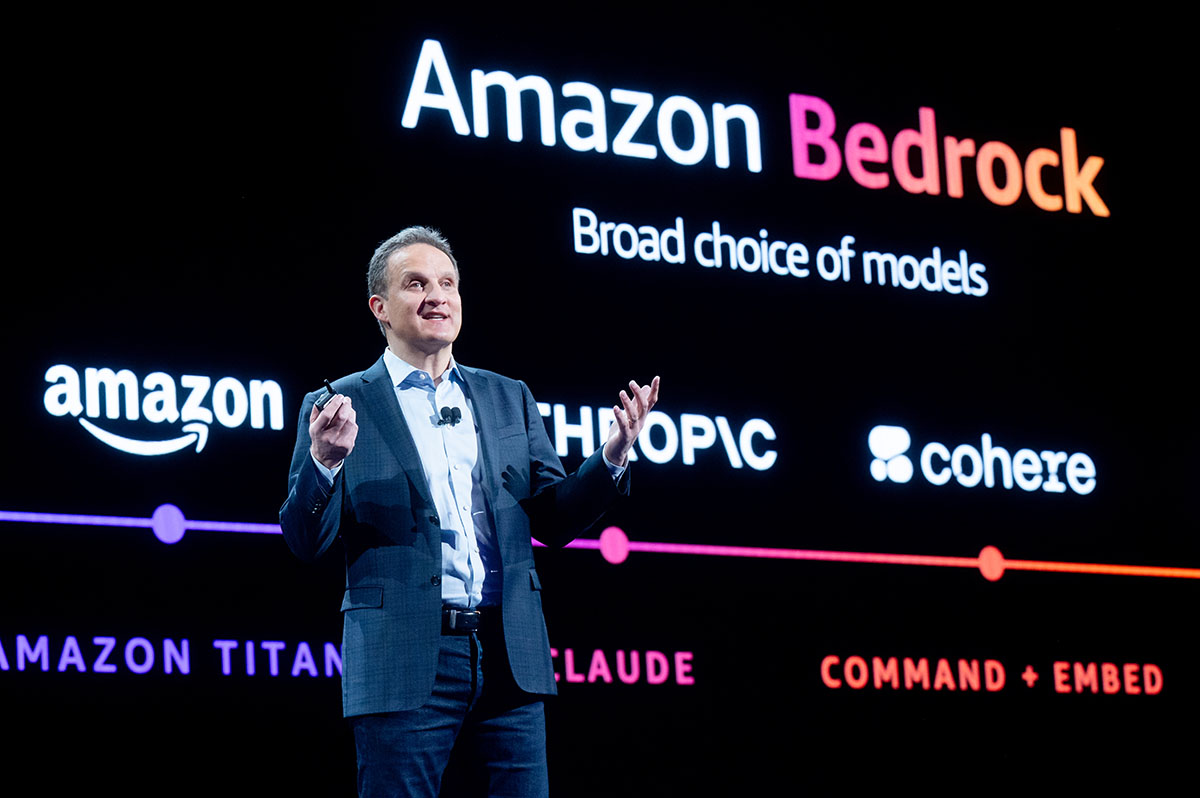

Mentre un certo numero di clienti costruirà i propri LLM e altri FM o svilupperà un numero qualsiasi di opzioni disponibili al pubblico, molti non vorranno spendere risorse e tempo per farlo. Per loro, lo strato intermedio dello stack offre questi modelli come servizio. La nostra soluzione qui, Roccia Amazzonica, consente ai clienti di scegliere tra modelli leader del settore tra cui Anthropic, Stability AI, Meta, Cohere, AI21 e Amazon, personalizzarli con i propri dati e sfruttare tutti gli stessi livelli di sicurezza, controlli di accesso e funzionalità leader a cui sono abituati in AWS, il tutto tramite un servizio gestito. Abbiamo reso Amazon Bedrock disponibile a livello generale alla fine di settembre e la risposta dei clienti è stata estremamente positiva. I clienti di tutto il mondo e praticamente di ogni settore sono entusiasti di utilizzare Amazon Bedrock. adidas consente agli sviluppatori di ottenere risposte rapide su tutto, dalle informazioni "introduttive" alle domande tecniche più approfondite. Booking.com intende utilizzare l'intelligenza artificiale generativa per scrivere consigli di viaggio su misura per ogni cliente. Bridgewater Associates sta sviluppando un assistente analista degli investimenti basato su LLM per aiutare a generare grafici, calcolare indicatori finanziari e riepilogare i risultati. Carrier sta rendendo accessibili ai clienti analisi e approfondimenti energetici più precisi in modo da ridurre il consumo di energia e ridurre le emissioni di carbonio. Clariant offre ai membri del suo team un chatbot interno con intelligenza artificiale generativa per accelerare i processi di ricerca e sviluppo, supportare i team di vendita nella preparazione delle riunioni e automatizzare le e-mail dei clienti. GoDaddy aiuta i clienti a avviare facilmente la propria attività online utilizzando l'intelligenza artificiale generativa per creare siti Web, trovare fornitori, connettersi con i clienti e altro ancora. Lexis Nexis Legal & Professional sta trasformando il lavoro legale degli avvocati e aumentandone la produttività con le funzionalità di ricerca conversazionale, riepilogo e redazione e analisi di documenti di Lexis+ AI. Il Nasdaq sta contribuendo ad automatizzare i flussi di lavoro investigativi sulle transazioni sospette e a rafforzare le proprie capacità di sorveglianza e lotta alla criminalità finanziaria. Tutte queste, e molte altre, diverse applicazioni di intelligenza artificiale generativa sono in esecuzione su AWS.

Siamo entusiasti dello slancio di Amazon Bedrock, ma siamo ancora agli inizi. Ciò che abbiamo visto lavorando con i clienti è che tutti si muovono velocemente, ma l’evoluzione dell’intelligenza artificiale generativa continua a un ritmo rapido con nuove opzioni e innovazioni che si verificano praticamente ogni giorno. I clienti stanno scoprendo che esistono diversi modelli che funzionano meglio per diversi casi d'uso o su diversi set di dati. Alcuni modelli sono ottimi per il riepilogo, altri sono ottimi per il ragionamento e l'integrazione e altri ancora hanno un supporto linguistico davvero eccezionale. E poi c'è la generazione di immagini, i casi d'uso della ricerca e altro ancora, tutti provenienti sia da modelli proprietari che da modelli pubblicamente disponibili a chiunque. E in tempi in cui c’è così tanto di inconoscibile, la capacità di adattamento è probabilmente lo strumento più prezioso di tutti. Non ci sarà un modello in grado di governarli tutti. E certamente non solo un’azienda tecnologica che fornisce i modelli utilizzati da tutti. I clienti devono provare diversi modelli. Devono essere in grado di passare da uno all'altro o di combinarli all'interno dello stesso caso d'uso. Ciò significa che hanno bisogno di una reale scelta dei fornitori modello (cosa che gli eventi degli ultimi dieci giorni hanno reso ancora più evidente). Questo è il motivo per cui abbiamo inventato Amazon Bedrock, perché ha una risonanza così profonda tra i clienti e perché continuiamo a innovare e iterare rapidamente per rendere la costruzione con (e lo spostamento tra) una gamma di modelli facile come una chiamata API, mettere le tecniche più recenti per la personalizzazione del modello nelle mani di tutti gli sviluppatori e per garantire la sicurezza dei clienti e la riservatezza dei loro dati. Siamo entusiasti di introdurre diverse nuove funzionalità che renderanno ancora più semplice per i clienti creare e scalare applicazioni di intelligenza artificiale generativa:

- Scelta di modelli in espansione con Anthropic Claude 2.1, Meta Llama 2 70B e aggiunte alla famiglia Amazon Titan. In questi primi giorni, i clienti stanno ancora imparando e sperimentando diversi modelli per determinare quali desiderano utilizzare per vari scopi. Vogliono poter provare facilmente i modelli più recenti e anche testarli per vedere quali capacità e caratteristiche forniranno loro i migliori risultati e caratteristiche di costo per i loro casi d'uso. Con Amazon Bedrock, i clienti sono a una sola chiamata API di distanza da un nuovo modello. Alcuni dei risultati più impressionanti che i clienti hanno riscontrato in questi ultimi mesi provengono da LLM come Il modello Claude di Anthropic, che eccelle in un'ampia gamma di attività, da dialoghi sofisticati e generazione di contenuti a ragionamenti complessi, pur mantenendo un elevato grado di affidabilità e prevedibilità. I clienti segnalano che Claude ha molte meno probabilità di produrre output dannosi, è più facile conversare e più gestibile rispetto ad altri FM, quindi gli sviluppatori possono ottenere l'output desiderato con meno sforzo. Il modello all'avanguardia di Anthropic, Claude 2, ottiene un punteggio superiore al 90° percentile negli esami di lettura e scrittura GRE e, allo stesso modo, nel ragionamento quantitativo. E ora, il modello Claude 2.1 appena rilasciato è disponibile su Amazon Bedrock. Claude 2.1 offre funzionalità chiave per le aziende, come una finestra di contesto dei token leader del settore da 200 (il doppio del contesto di Claude 2), tassi ridotti di allucinazioni e miglioramenti significativi nella precisione, anche con contesti di durata molto lunga. Claude 2.0 include anche prompt di sistema migliorati, ovvero istruzioni modello che forniscono un'esperienza migliore agli utenti finali, riducendo al tempo stesso il costo dei prompt e dei completamenti del 2.1%.

Per un numero crescente di clienti che desiderano utilizzare una versione gestita del modello Llama 2 di Meta disponibile al pubblico, Amazon Bedrock offre Llama 2 13B e stiamo aggiungendo Llama 2 70B. Llama 2 70B è adatto per attività su larga scala come la modellazione del linguaggio, la generazione di testi e i sistemi di dialogo. I modelli Llama disponibili pubblicamente sono stati scaricati più di 30 milioni di volte e i clienti apprezzano il fatto che Amazon Bedrock li offra come parte di un servizio gestito in cui non devono preoccuparsi dell'infrastruttura o avere una profonda esperienza ML nei loro team. Inoltre, per la generazione di immagini, Stability AI offre una suite di popolari modelli da testo a immagine. Stable Diffusion XL 1.0 (SDXL 1.0) è il più avanzato di questi ed è ora generalmente disponibile su Amazon Bedrock. L'ultima edizione di questo popolare modello di immagine ha una maggiore precisione, un migliore fotorealismo e una risoluzione più elevata.

Anche i clienti utilizzano Titano Amazzonico modelli creati e preaddestrati da AWS per offrire funzionalità potenti con grandi vantaggi economici per una varietà di casi d'uso. Amazon vanta 25 anni di esperienza nel machine learning e nell'intelligenza artificiale, tecnologie che utilizziamo in tutte le nostre attività, e abbiamo imparato molto sulla creazione e l'implementazione di modelli. Abbiamo scelto con cura il modo in cui addestriamo i nostri modelli e i dati che utilizziamo per farlo. Indennizziamo i clienti da eventuali affermazioni secondo cui i nostri modelli o i loro risultati violano il diritto d'autore di chiunque. Abbiamo introdotto i nostri primi modelli Titan nell'aprile di quest'anno. Titan Testo Lite-ora generalmente disponibile— è un modello conciso ed economico per casi d'uso come chatbot, riepilogo di testo o copywriting ed è anche interessante da perfezionare. Titan Text Express: anch'esso ora disponibile a livello generale— è più ampio e può essere utilizzato per una gamma più ampia di attività basate su testo, come la generazione di testo a tempo indeterminato e la chat conversazionale. Offriamo queste opzioni di modelli di testo per offrire ai clienti la possibilità di ottimizzare precisione, prestazioni e costi in base al caso d'uso e ai requisiti aziendali. Clienti come Nexxiot, PGA Tour e Ryanair utilizzano i nostri due modelli Titan Text. Disponiamo anche di un modello di incorporamento, Titan Text Embeddings, per casi d'uso di ricerca e personalizzazione. Clienti come Nasdaq stanno ottenendo ottimi risultati utilizzando Titan Text Embeddings per migliorare le capacità di Nasdaq IR Insight di generare approfondimenti da oltre 9,000 documenti di aziende globali per team di sostenibilità, legali e contabili. E continueremo ad aggiungere altri modelli alla famiglia Titan nel tempo. Stiamo introducendo un nuovo modello di incorporamenti, Titan Multimodal Embeddings, per potenziare esperienze di ricerca e raccomandazione multimodali per gli utenti che utilizzano immagini e testo (o una combinazione di entrambi) come input. E noi siamo introducendo un nuovo modello da testo a immagine, Amazon Titan Image Generator. Con Titan Image Generator, i clienti di settori quali pubblicità, e-commerce, media e intrattenimento possono utilizzare un input di testo per generare immagini realistiche di qualità professionale in grandi volumi e a basso costo. Siamo entusiasti di come i clienti stanno rispondendo a Titan Models e puoi aspettarti che continueremo a innovare qui.

- Nuove funzionalità per personalizzare in modo sicuro la tua applicazione di intelligenza artificiale generativa con i tuoi dati proprietari: Una delle funzionalità più importanti di Amazon Bedrock è la facilità con cui è possibile personalizzare un modello. Ciò diventa davvero entusiasmante per i clienti perché è qui che l'intelligenza artificiale generativa incontra il loro principale elemento di differenziazione: i dati. Tuttavia, è davvero importante che i loro dati rimangano sicuri, che ne abbiano il controllo lungo il percorso e che i miglioramenti del modello siano privati. Esistono alcuni modi per farlo e Amazon Bedrock offre la più ampia selezione di opzioni di personalizzazione su più modelli). Il primo è la messa a punto. La messa a punto di un modello in Amazon Bedrock è semplice. Basta selezionare il modello e Amazon Bedrock ne crea una copia. Quindi indichi alcuni esempi etichettati (ad esempio, una serie di buone coppie domanda-risposta) che memorizzi in Amazon Simple Storage Service (Amazon S3) e Amazon Bedrock "addestra in modo incrementale" (potenzia il modello copiato con le nuove informazioni) su questi esempi e il risultato è un modello privato, più accurato e perfezionato che fornisce risposte più pertinenti e personalizzate. Siamo lieti di annunciare che la regolazione fine è generalmente disponibile per Cohere Command, Meta Llama 2, Amazon Titan Text (Lite ed Express), Amazon Titan Multimodal Embeddings e in anteprima per Amazon Titan Image Generator. Inoltre, attraverso la nostra collaborazione con Anthropic, forniremo presto ai clienti AWS l'accesso anticipato a funzionalità uniche per la personalizzazione del modello e la messa a punto del suo modello all'avanguardia Claude.

Una seconda tecnica per personalizzare LLM e altri FM per la tua azienda è la generazione aumentata di recupero (RAG), che ti consente di personalizzare le risposte di un modello ampliando le tue richieste con dati provenienti da più fonti, inclusi repository di documenti, database e API. A settembre abbiamo introdotto una funzionalità RAG, Knowledge Bases for Amazon Bedrock, che collega in modo sicuro i modelli alle tue origini dati proprietarie per integrare le tue richieste con più informazioni in modo che le tue applicazioni forniscano risposte più pertinenti, contestuali e accurate. Basi di conoscenza è ora generalmente disponibile con un'API che esegue l'intero flusso di lavoro RAG dal recupero del testo necessario per aumentare un prompt, all'invio del prompt al modello, alla restituzione della risposta. Knowledge Base supporta database con funzionalità vettoriali che memorizzano rappresentazioni numeriche dei dati (incorporamenti) che i modelli utilizzano per accedere a questi dati per RAG, incluso Amazon OpenSearch Service e altri database popolari come Pinecone e Redis Enterprise Cloud (supporto vettoriale Amazon Aurora e MongoDB in arrivo Presto).

Il terzo modo per personalizzare i modelli in Amazon Bedrock è la formazione preliminare continua. Con questo metodo, il modello si basa sulla sua pre-formazione originale per la comprensione della lingua generale per apprendere il linguaggio e la terminologia specifici del dominio. Questo approccio è rivolto ai clienti che dispongono di grandi quantità di informazioni specifiche del dominio senza etichetta e desiderano consentire ai propri LLM di comprendere la lingua, le frasi, le abbreviazioni, i concetti, le definizioni e il gergo unici del loro mondo (e della loro attività). A differenza del fine tuning, che richiede una quantità piuttosto ridotta di dati, il pre-addestramento continuo viene eseguito su insiemi di dati di grandi dimensioni (ad esempio, migliaia di documenti di testo). Ora, le funzionalità di pre-formazione sono disponibili in Amazon Bedrock per Titan Text Lite e Titan Text Express.

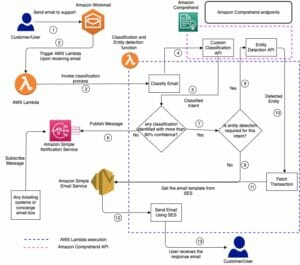

- Disponibilità generale di Agenti per Amazon Bedrock per aiutare a eseguire attività in più fasi utilizzando sistemi, origini dati e conoscenza dell'azienda. Gli LLM sono ottimi per conversare e generare contenuti, ma i clienti vogliono che le loro applicazioni siano in grado di farlo do ancora di più, come intraprendere azioni, risolvere problemi e interagire con una serie di sistemi per completare attività in più fasi come prenotare viaggi, presentare richieste di indennizzi assicurativi o ordinare parti di ricambio. E Amazon Bedrock può aiutare in questa sfida. Con gli agenti, gli sviluppatori selezionano un modello, scrivono alcune istruzioni di base come "sei un allegro agente del servizio clienti" e "controlla la disponibilità del prodotto nel sistema di inventario", indirizzano il modello selezionato alle giuste origini dati e sistemi aziendali (ad esempio, CRM o applicazioni ERP) e scrivere alcune funzioni AWS Lambda per eseguire le API (ad esempio, verificare la disponibilità di un articolo nell'inventario ERP). Amazon Bedrock analizza automaticamente la richiesta e la suddivide in una sequenza logica utilizzando le capacità di ragionamento del modello selezionato per determinare quali informazioni sono necessarie, quali API chiamare e quando chiamarle per completare un passaggio o risolvere un'attività. Ora disponibili a livello generale, gli agenti possono pianificare ed eseguire la maggior parte delle attività aziendali, dal rispondere alle domande dei clienti sulla disponibilità dei prodotti alla presa dei loro ordini, e gli sviluppatori non devono avere familiarità con l'apprendimento automatico, i suggerimenti tecnici, il training di modelli o la connessione manuale dei sistemi. E Bedrock fa tutto questo in modo sicuro e privato, e clienti come Druva e Athene li stanno già utilizzando per migliorare la precisione e la velocità di sviluppo delle loro applicazioni di intelligenza artificiale generativa.

- Presentiamo Guardrail per Amazon Bedrock in modo da poter applicare protezioni in base ai requisiti del caso d'uso e alle politiche di IA responsabile. I clienti vogliono essere sicuri che le interazioni con le loro applicazioni di intelligenza artificiale siano sicure, evitino linguaggio tossico o offensivo, rimangano pertinenti per la loro attività e siano in linea con le loro politiche di intelligenza artificiale responsabile. Con i guardrail, i clienti possono specificare gli argomenti da evitare e Amazon Bedrock fornirà agli utenti solo le risposte approvate alle domande che rientrano in tali categorie limitate. Ad esempio, è possibile impostare un'applicazione bancaria online per evitare di fornire consulenza sugli investimenti e rimuovere contenuti inappropriati (come incitamento all'odio e violenza). All'inizio del 2024, i clienti potranno anche oscurare le informazioni di identificazione personale (PII) nelle risposte del modello. Ad esempio, dopo che un cliente ha interagito con un agente del call center, la conversazione del servizio clienti viene spesso riepilogata per la tenuta dei registri e i guardrail possono rimuovere le informazioni personali da tali riepiloghi. I guardrail possono essere utilizzati su tutti i modelli in Amazon Bedrock (compresi i modelli ottimizzati) e con gli agenti per Amazon Bedrock in modo che i clienti possano offrire un livello coerente di protezione a tutte le loro applicazioni di intelligenza artificiale generativa.

Livello superiore: l'innovazione continua rende l'intelligenza artificiale generativa accessibile a un numero maggiore di utenti

Al livello più alto dello stack ci sono le applicazioni che sfruttano LLM e altri FM in modo da poter sfruttare l'intelligenza artificiale generativa sul lavoro. Un’area in cui l’intelligenza artificiale generativa sta già cambiando le regole del gioco è la codifica. L'anno scorso abbiamo introdotto Amazon CodeWhisperer, che ti aiuta a creare applicazioni in modo più rapido e sicuro generando suggerimenti e consigli sul codice quasi in tempo reale. Clienti come Accenture, Boeing, Bundesliga, The Cigna Group, Kone e Warner Music Group utilizzano CodeWhisperer per aumentare la produttività degli sviluppatori e Accenture sta abilitando fino a 50,000 dei loro sviluppatori software e professionisti IT con Amazon CodeWhisperer. Vogliamo che il maggior numero possibile di sviluppatori sia in grado di ottenere i vantaggi in termini di produttività dell'intelligenza artificiale generativa, motivo per cui CodeWhisperer offre consigli gratuitamente a tutti gli individui.

Tuttavia, sebbene gli strumenti di codifica AI facciano molto per semplificare la vita degli sviluppatori, i loro vantaggi in termini di produttività sono limitati dalla loro mancanza di conoscenza delle basi di codice interne, delle API interne, delle librerie, dei pacchetti e delle classi. Un modo di pensare a questo è che se assumi un nuovo sviluppatore, anche se è di livello mondiale, non sarà così produttivo nella tua azienda finché non capirà le tue migliori pratiche e il tuo codice. Gli strumenti di codifica odierni basati sull'intelligenza artificiale sono come quello sviluppatore neoassunto. Per aiutare in questo, abbiamo recentemente presentato in anteprima un nuovo capacità di personalizzazione in Amazon CodeWhisperer che sfrutta in modo sicuro la codebase interna del cliente per fornire consigli sul codice più pertinenti e utili. Con questa funzionalità, CodeWhisperer è un esperto il tuo codice e fornisce consigli più pertinenti per risparmiare ancora più tempo. In uno studio condotto con Persistent, una società globale di ingegneria digitale e modernizzazione aziendale, abbiamo scoperto che le personalizzazioni aiutano gli sviluppatori a completare le attività fino al 28% più velocemente rispetto alle funzionalità generali di CodeWhisperer. Ora uno sviluppatore di un’azienda di tecnologia sanitaria può chiedere a CodeWhisperer di “importare immagini MRI associate all’ID cliente e di eseguirle attraverso il classificatore di immagini” per rilevare anomalie. Poiché CodeWhisperer ha accesso alla codebase, può fornire suggerimenti molto più pertinenti che includono le posizioni di importazione delle immagini MRI e degli ID cliente. CodeWhisperer mantiene le personalizzazioni completamente private e il FM sottostante non le utilizza per la formazione, proteggendo la preziosa proprietà intellettuale dei clienti. AWS è l'unico grande fornitore di servizi cloud che offre una funzionalità come questa a tutti.

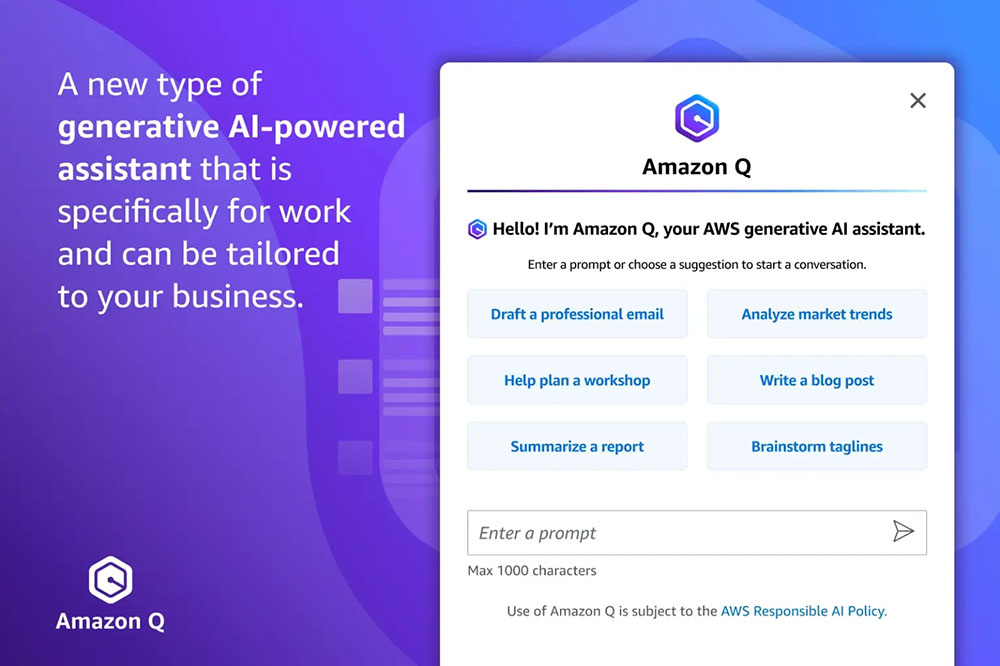

Presentiamo Amazon Q, l'assistente generativo basato sull'intelligenza artificiale su misura per il lavoro

Gli sviluppatori non sono certamente gli unici a mettere le mani sull'intelligenza artificiale generativa: milioni di persone utilizzano applicazioni di chat con intelligenza artificiale generativa. Ciò che i primi fornitori hanno fatto in questo ambito è entusiasmante e molto utile per i consumatori, ma in molti modi non "funzionano" del tutto sul lavoro. Le loro conoscenze e capacità generali sono ottime, ma non conoscono la tua azienda, i tuoi dati, i tuoi clienti, le tue operazioni o la tua attività. Ciò limita quanto possono aiutarti. Inoltre, non sanno molto del tuo ruolo: che lavoro svolgi, con chi lavori, quali informazioni usi e a cosa hai accesso. Queste limitazioni sono comprensibili perché questi assistenti non hanno accesso alle informazioni private della tua azienda e non sono stati progettati per soddisfare i requisiti di privacy e sicurezza dei dati di cui le aziende hanno bisogno per fornire loro questo accesso. È difficile attivare la sicurezza dopo il fatto e aspettarsi che funzioni bene. Pensiamo di avere un modo migliore, che consentirà a ogni persona in ogni organizzazione di utilizzare l’intelligenza artificiale generativa in modo sicuro nel proprio lavoro quotidiano.

WSiamo entusiasti di presentarvi Amazon Q, un nuovo tipo di assistente generativo basato sull'intelligenza artificiale, specifico per il lavoro e personalizzabile in base alla tua attività. Q può aiutarti a ottenere risposte rapide e pertinenti a domande urgenti, risolvere problemi, generare contenuti e intraprendere azioni utilizzando i dati e le competenze presenti nei repository di informazioni, nel codice e nei sistemi aziendali della tua azienda. Quando chatti con Amazon Q, fornisce informazioni e consigli immediati e pertinenti per semplificare le attività, accelerare il processo decisionale e contribuire a stimolare la creatività e l'innovazione sul lavoro. Abbiamo creato Amazon Q per essere sicuro e privato, in grado di comprendere e rispettare le identità, i ruoli e le autorizzazioni esistenti e utilizzare queste informazioni per personalizzare le proprie interazioni. Se un utente non dispone dell'autorizzazione per accedere a determinati dati senza Q, non potrà accedervi nemmeno utilizzando Q. Abbiamo progettato Amazon Q per soddisfare i rigorosi requisiti dei clienti aziendali fin dal primo giorno: nessuno dei loro contenuti viene utilizzato per migliorare i modelli sottostanti.

Amazon Q è il tuo assistente esperto per costruire su AWS: Abbiamo formato Amazon Q avvalendoci di 17 anni di conoscenza ed esperienza di AWS in modo che possa trasformare il modo in cui crei, distribuisci e gestisci applicazioni e carichi di lavoro su AWS. Amazon Q dispone di un'interfaccia di chat nella Console di gestione AWS e nella documentazione, nel tuo IDE (tramite CodeWhisperer) e nelle chat room del tuo team su Slack o altre app di chat. Amazon Q può aiutarti a esplorare nuove funzionalità AWS, iniziare più rapidamente, apprendere tecnologie sconosciute, progettare soluzioni, risolvere problemi, eseguire aggiornamenti e molto altro ancora: è un esperto in modelli ben architettati, best practice, documentazione e implementazioni di soluzioni AWS. Ecco alcuni esempi di cosa puoi fare con il tuo nuovo assistente esperto AWS:

- Ottieni risposte chiare e indicazioni su funzionalità, servizi e soluzioni AWS: Chiedi ad Amazon Q di "Parlarmi degli agenti per Amazon Bedrock" e Q ti fornirà una descrizione della funzionalità oltre a collegamenti a materiali pertinenti. Puoi anche porre ad Amazon Q praticamente qualsiasi domanda sul funzionamento di un servizio AWS (ad esempio, "Quali sono i limiti di scalabilità su una tabella DynamoDB?" "Che cos'è Redshift Managed Storage?") o su come progettare al meglio un numero qualsiasi di soluzioni ( “Quali sono le migliori pratiche per costruire architetture guidate dagli eventi?”). E Amazon Q metterà insieme risposte concise e citerà sempre (e collegherà a) le sue fonti.

- Scegli il miglior servizio AWS per il tuo caso d'uso e inizia rapidamente: Chiedi ad Amazon D "Quali sono i modi per creare un'app Web su AWS?" "E fornirà un elenco di potenziali servizi come AWS Amplifica, AWS Lambdae Amazon EC2 con i vantaggi di ciascuno. Da lì puoi restringere le opzioni aiutando Q a comprendere i tuoi requisiti, preferenze e vincoli (ad esempio, "Quale di questi sarebbe il migliore se voglio utilizzare i contenitori?" o "Devo utilizzare un database relazionale o non relazionale? "). Concludi con "Come posso iniziare?" e Amazon Q illustrerà alcuni passaggi fondamentali e ti indicherà risorse aggiuntive.

- Ottimizza le tue risorse di calcolo: Amazon Q può aiutarti a selezionare le istanze Amazon EC2. Se chiedi "Aiutami a trovare l'istanza EC2 giusta per distribuire un carico di lavoro di codifica video per la mia app di gioco con le prestazioni più elevate", Q ti fornirà un elenco di famiglie di istanze con i motivi per ciascun suggerimento. Inoltre, puoi porre qualsiasi numero di domande di follow-up per aiutarti a trovare la scelta migliore per il tuo carico di lavoro.

- Ottieni assistenza per il debug, il test e l'ottimizzazione del tuo codice: Se riscontri un errore durante la codifica nel tuo IDE, puoi chiedere aiuto ad Amazon Q dicendo: "Il mio codice presenta un errore IO, puoi fornire una correzione?" e Q genererà il codice per te. Se ti piace il suggerimento, puoi chiedere ad Amazon Q di aggiungere la correzione alla tua applicazione. Poiché Amazon Q è nel tuo IDE, capisce il codice su cui stai lavorando e sa dove inserire la correzione. Amazon Q può anche creare unit test ("Scrivi unit test per la funzione selezionata") che può inserire nel tuo codice ed eseguire. Infine, Amazon Q può indicarti come ottimizzare il tuo codice per ottenere prestazioni più elevate. Chiedi a Q di "Ottimizzare la query DynamoDB selezionata" e utilizzerà la sua comprensione del tuo codice per fornire un suggerimento in linguaggio naturale su cosa correggere insieme al codice di accompagnamento che puoi implementare con un clic.

- Diagnosticare e risolvere i problemi: Se riscontri problemi nella Console di gestione AWS, come errori di autorizzazione EC2 o errori di configurazione di Amazon S3, puoi semplicemente premere il pulsante "Risoluzione dei problemi con Amazon Q" e utilizzerà la sua comprensione del tipo di errore e del servizio in cui si trova l'errore per darti suggerimenti per una soluzione. Puoi anche chiedere ad Amazon Q di risolvere i problemi della tua rete (ad esempio, "Perché non riesco a connettermi alla mia istanza EC2 utilizzando SSH?") e Q analizzerà la tua configurazione end-to-end e fornirà una diagnosi (ad esempio, "Questa istanza sembra essere in una sottorete privata, quindi potrebbe essere necessario stabilire l'accessibilità pubblica").

- Sviluppa una nuova base di codice in pochissimo tempo: Quando chatti con Amazon Q nel tuo IDE, combina la sua esperienza nella creazione di software con la comprensione del tuo codice: un abbinamento potente! In precedenza, se prendevi in carico un progetto di qualcun altro o eri nuovo nel team, potresti dover passare ore a rivedere manualmente il codice e la documentazione per capire come funziona e cosa fa. Ora, poiché Amazon Q comprende il codice nel tuo IDE, puoi semplicemente chiedere ad Amazon Q di spiegare il codice ("Forniscimi una descrizione di cosa fa questa applicazione e come funziona") e Q ti fornirà dettagli come quali servizi offre utilizza il codice e cosa fanno le diverse funzioni (ad esempio, Q potrebbe rispondere con qualcosa del tipo "Questa applicazione sta creando un sistema di ticket di supporto di base utilizzando Python Flask e AWS Lambda" e proseguire descrivendo ciascuna delle sue funzionalità principali, come sono implementate, e altro ancora).

- Cancella più velocemente il backlog delle tue funzionalità: Puoi anche chiedere ad Amazon Q di guidarti e automatizzare gran parte del processo end-to-end di aggiunta di una funzionalità alla tua applicazione in Amazon CodeCatalyst, il nostro servizio unificato di sviluppo software per i team. Per fare ciò, devi semplicemente assegnare a Q un'attività arretrata dal tuo elenco di problemi, proprio come faresti con un compagno di squadra, e Q genera un piano passo passo su come costruirà e implementerà la funzionalità. Una volta approvato il piano, Q scriverà il codice e ti presenterà le modifiche suggerite come revisione del codice. Puoi richiedere una rielaborazione (se necessario), approvare e/o distribuire!

- Aggiorna il tuo codice in una frazione del tempo: La maggior parte degli sviluppatori in realtà dedica solo una frazione del proprio tempo alla scrittura di nuovo codice e alla creazione di nuove applicazioni. Trascorrono gran parte dei loro cicli in aree dolorose e lente come la manutenzione e gli aggiornamenti. Accetta gli aggiornamenti della versione linguistica. Un gran numero di clienti continua a utilizzare le versioni precedenti di Java perché ci vorranno mesi, se non anni, e migliaia di ore di lavoro da parte degli sviluppatori per eseguire l'aggiornamento. Rimandare questa soluzione comporta costi e rischi reali: si perdono miglioramenti delle prestazioni e si è vulnerabili a problemi di sicurezza. Pensiamo che Amazon Q possa cambiare le regole del gioco in questo caso e ne siamo entusiasti Trasformazione del codice Q di Amazon, una funzionalità che può eliminare gran parte di questo lavoro pesante e ridurre il tempo necessario per aggiornare le applicazioni da giorni a minuti. Apri semplicemente il codice che desideri aggiornare nel tuo IDE e chiedi ad Amazon Q di "/trasformare" il tuo codice. Amazon Q analizzerà l'intero codice sorgente dell'applicazione, genererà il codice nella lingua e nella versione di destinazione ed eseguirà i test, aiutandoti a realizzare i miglioramenti in termini di sicurezza e prestazioni delle versioni linguistiche più recenti. Di recente, un team molto ristretto di sviluppatori Amazon ha utilizzato Amazon Q Code Transformation per aggiornare 1,000 applicazioni di produzione da Java 8 a Java 17 in soli due giorni. Il tempo medio per applicazione è stato inferiore a 10 minuti. Oggi Amazon Q Code Transformation esegue aggiornamenti del linguaggio Java da Java 8 o Java 11 a Java 17. Il prossimo passo (e presto) sarà la possibilità di trasformare .NET Framework in .NET multipiattaforma (con ancora più trasformazioni da seguire in futuro) .

Amazon Q è il tuo esperto aziendale: puoi connettere Amazon Q ai dati, alle informazioni e ai sistemi aziendali in modo che possa sintetizzare tutto e fornire assistenza su misura per aiutare le persone a risolvere problemi, generare contenuti e intraprendere azioni rilevanti per la tua attività. Portare Amazon Q nella tua azienda è facile. Dispone di oltre 40 connettori integrati per i sistemi aziendali più diffusi come Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive e Zendesk. Può anche connettersi alla tua intranet interna, ai wiki e ai libri e, con l'SDK Amazon Q, puoi creare una connessione a qualsiasi applicazione interna desideri. Punta Amazon Q su questi repository e "accelererà" la tua attività, acquisendo e comprendendo le informazioni semantiche che rendono unica la tua azienda. Quindi, ottieni la tua applicazione web Amazon Q semplice e intuitiva in modo che i dipendenti della tua azienda possano interagire con l'interfaccia conversazionale. Amazon Q si connette anche al tuo provider di identità per comprendere un utente, il suo ruolo e a quali sistemi è consentito accedere in modo che gli utenti possano porre domande dettagliate e sfumate e ottenere risultati personalizzati che includano solo le informazioni che sono autorizzati a vedere. Amazon Q genera risposte e approfondimenti accurati e fedeli al materiale e alle conoscenze forniti e puoi limitare argomenti sensibili, bloccare parole chiave o filtrare domande e risposte inappropriate. Ecco alcuni esempi di cosa puoi fare con il nuovo assistente esperto della tua azienda:

- Ottieni risposte nitide ed estremamente pertinenti basate sui dati e sulle informazioni della tua azienda: I dipendenti possono chiedere ad Amazon Q qualsiasi cosa abbiano dovuto cercare in precedenza tra tutti i tipi di fonti. Chiedi "Quali sono le ultime linee guida per l'utilizzo del logo?" o "Come posso richiedere una carta di credito aziendale?", e Amazon Q sintetizzerà tutti i contenuti pertinenti che trova e restituirà risposte rapide oltre a collegamenti ai relativi contenuti. fonti (ad esempio, portali di marchi e archivi di loghi, politiche T&E aziendali e richieste di carte).

- Semplifica le comunicazioni quotidiane: Basta chiedere e Amazon Q può generare contenuti ("Crea un post sul blog e tre titoli sui social media che annuncino il prodotto descritto in questa documentazione"), creare riepiloghi esecutivi ("Scrivi un riepilogo della trascrizione della nostra riunione con un elenco puntato di azioni da intraprendere" ), fornire aggiornamenti via email ("Stendere un'email che evidenzi i nostri programmi di formazione del terzo trimestre per i clienti in India") e aiutare a strutturare le riunioni ("Creare un ordine del giorno della riunione per parlare dell'ultimo rapporto sulla soddisfazione del cliente").

- Compiti completi: Amazon Q può aiutare a completare determinate attività, riducendo la quantità di tempo che i dipendenti dedicano a lavori ripetitivi come l'archiviazione di ticket. Chiedi ad Amazon Q di "Riepilogare il feedback dei clienti sulla nuova offerta di prezzi in Slack", quindi chiedi a Q di prendere tali informazioni e di aprire un ticket in Jira per aggiornare il team di marketing. Puoi chiedere a Q di "Riepilogare la trascrizione della chiamata", quindi di "Aprire un nuovo caso per il cliente A in Salesforce". Amazon Q supporta altri popolari strumenti di automazione del lavoro come Zendesk e Service Now.

Amazon Q è in Amazon QuickSight: Con Amazon Q in QuickSight, il servizio di business intelligence di AWS, gli utenti possono porre domande sulla dashboard come "Perché il numero di ordini è aumentato lo scorso mese?" e ottenere visualizzazioni e spiegazioni dei fattori che hanno influenzato l'aumento. Inoltre, gli analisti possono utilizzare Amazon Q per ridurre il tempo necessario per creare dashboard da giorni a minuti con un semplice messaggio come "Mostrami le vendite per regione per mese come grafico a barre in pila". Q torna subito con quel diagramma e puoi facilmente aggiungerlo a una dashboard o chattare ulteriormente con Q per perfezionare la visualizzazione (ad esempio, "Cambia il grafico a barre in un diagramma Sankey" o "Mostra paesi anziché regioni"). Amazon Q in QuickSight semplifica inoltre l'utilizzo dei dashboard esistenti per informare le parti interessate aziendali, distillare informazioni chiave e semplificare il processo decisionale utilizzando storie di dati. Ad esempio, gli utenti possono chiedere ad Amazon Q di "Costruire una storia su come è cambiata l'azienda nell'ultimo mese per una revisione aziendale con la leadership senior" e in pochi secondi Amazon Q fornisce una storia basata sui dati che è visivamente avvincente ed è completamente personalizzabile. Queste storie possono essere condivise in modo sicuro in tutta l'organizzazione per aiutare ad allineare le parti interessate e prendere decisioni migliori.

Amazon Q è in Amazon Connect: In Amazon Connect, il nostro servizio di contact center, Amazon Q aiuta gli agenti del servizio clienti a fornire un servizio clienti migliore. Amazon Q sfrutta i repository di conoscenze che gli agenti utilizzano solitamente per ottenere informazioni per i clienti, quindi gli agenti possono chattare con Amazon Q direttamente in Connect per ottenere risposte che li aiutino a rispondere più rapidamente alle richieste dei clienti senza dover cercare essi stessi nella documentazione. E, anche se chattare con Amazon Q per ottenere risposte superveloci è fantastico, nel servizio clienti non esiste la velocità troppo elevata. Ecco perché Amazon QInConnesso trasforma una conversazione dal vivo del cliente con un agente in un prompt e fornisce automaticamente all'agente possibili risposte, azioni suggerite e collegamenti a risorse. Ad esempio, Amazon Q può rilevare che un cliente sta contattando una società di noleggio auto per modificare la prenotazione, generare una risposta affinché l'agente possa comunicare rapidamente come si applicano le politiche tariffarie di modifica della società e guidare l'agente attraverso i passaggi necessari per aggiornare la prenotazione. prenotazione.

Amazon Q è nella catena di fornitura AWS (disponibile a breve): In AWS Supply Chain, il nostro servizio di analisi della catena di fornitura, Amazon Q aiuta i pianificatori della domanda e dell'offerta, i gestori dell'inventario e i partner commerciali a ottimizzare la catena di fornitura riepilogando ed evidenziando potenziali rischi di esaurimento o scorte eccessive e visualizzando scenari per risolvere il problema. Gli utenti possono chiedere ad Amazon Q domande "cosa", "perché" e "cosa succederebbe se" sui dati della catena di fornitura e chattare attraverso scenari complessi e i compromessi tra le diverse decisioni sulla catena di fornitura. Ad esempio, un cliente potrebbe chiedere: "Cosa sta causando il ritardo nelle mie spedizioni e come posso accelerare le cose?" a cui Amazon Q potrebbe rispondere: “Il 90% dei tuoi ordini è sulla costa orientale e una grande tempesta nel sud-est sta causando un ritardo di 24 ore. Se spedisci al porto di New York anziché a Miami, velocizzerai le consegne e ridurrai i costi del 50%.”

I nostri clienti stanno adottando rapidamente l'intelligenza artificiale generativa: stanno formando modelli innovativi su AWS, stanno sviluppando applicazioni di intelligenza artificiale generativa a velocità record utilizzando Amazon Bedrock e stanno distribuendo applicazioni rivoluzionarie nelle loro organizzazioni come Amazon Q. Con i nostri ultimi annunci, AWS sta offrendo ai clienti ancora più prestazioni, scelta e innovazione a ogni livello dello stack. L'impatto combinato di tutte le funzionalità che offriamo a re:Invent segna un'importante pietra miliare verso il raggiungimento di un obiettivo entusiasmante e significativo: stiamo rendendo l'intelligenza artificiale generativa accessibile a clienti di tutte le dimensioni e capacità tecniche in modo che possano reinventare e trasformare ciò che è possibile.

Risorse

L'autore

Swami Shivasubramanian è vicepresidente dei dati e dell'apprendimento automatico presso AWS. In questo ruolo, Swami supervisiona tutti i servizi AWS Database, Analytics e AI e Machine Learning. La missione del suo team è aiutare le organizzazioni a far funzionare i propri dati con una soluzione di dati end-to-end completa per archiviare, accedere, analizzare, visualizzare e prevedere.

Swami Shivasubramanian è vicepresidente dei dati e dell'apprendimento automatico presso AWS. In questo ruolo, Swami supervisiona tutti i servizi AWS Database, Analytics e AI e Machine Learning. La missione del suo team è aiutare le organizzazioni a far funzionare i propri dati con una soluzione di dati end-to-end completa per archiviare, accedere, analizzare, visualizzare e prevedere.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :ha

- :È

- :non

- :Dove

- $ SU

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- abilità

- capacità

- capace

- WRI

- sopra

- accelerare

- accelerata

- acceleratori

- Accenture

- accesso

- accessibilità

- accessibile

- Contabilità

- precisione

- preciso

- acquisire

- operanti in

- Action

- azioni

- attivamente

- effettivamente

- adattare

- aggiungere

- aggiunto

- l'aggiunta di

- aggiunta

- aggiuntivo

- Inoltre

- integrazioni

- Aggiunge

- Adidas

- Adobe

- Adottando

- Avanzate

- avanzando

- Vantaggio

- vantaggi

- Pubblicità

- consigli

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- ordine del giorno

- Agente

- agenti

- aggregato

- fa

- AI

- AI e apprendimento automatico

- AI chatbot

- ricerca ai

- AI-alimentato

- allineare

- Tutti

- consentire

- consente

- lungo

- già

- anche

- sempre

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Servizio Amazon OpenSearch

- Amazon QuickSight

- Amazon Sage Maker

- Amazon Web Services

- quantità

- importi

- an

- .

- analista

- Gli analisti

- analitica

- analizzare

- analisi

- ed

- Annunciare

- Annunci

- annunciando

- anomalie

- rispondere

- risposte

- Antropico

- in qualsiasi

- chiunque

- nulla

- api

- API

- App

- appare

- Applicazioni

- applicazioni

- APPLICA

- apprezzare

- approccio

- approvare

- approvato

- applicazioni

- Aprile

- SONO

- RISERVATA

- aree

- discutibilmente

- in giro

- AS

- chiedere

- Assistenza

- Assistant

- assistenti

- associato

- soci

- At

- aumentare

- aumentata

- aumenti

- Aurora

- autorizzato

- automatizzare

- automatizza

- Automatico

- automaticamente

- Automazione

- settore automobilistico

- disponibilità

- disponibile

- media

- evitare

- lontano

- AWS

- AWS Inferenza

- AWS Lambda

- Console di gestione AWS

- precedente

- Settore bancario

- bar

- barriere

- base

- basato

- basic

- BE

- perché

- diventa

- stato

- ha iniziato

- CREDIAMO

- vantaggi

- MIGLIORE

- best practice

- Meglio

- fra

- Big

- Miliardo

- miliardi

- Bloccare

- Blocchi

- Blog

- Boeing

- Bolt

- riunioni

- Booking.com

- Libri

- entrambi

- Parte inferiore

- confini

- marca

- Rompere

- pause

- portare

- Portare

- costruire

- Costruzione

- costruisce

- costruito

- incassato

- affari

- business intelligence

- aziende

- ma

- pulsante

- by

- chiamata

- call center

- Materiale

- Può ottenere

- funzionalità

- capacità

- capace

- Ultra-Grande

- Catturare

- auto

- carbonio

- le emissioni di carbonio

- carta

- attentamente

- Custodie

- casi

- categoria

- causando

- centro

- certo

- certamente

- catena

- Challenge

- sfide

- il cambiamento

- cambiato

- Changer

- Modifiche

- cambiando

- caratteristiche

- Grafico

- Grafici

- chat

- chatbot

- chatbots

- chat

- dai un'occhiata

- patata fritta

- Chips

- scegliere

- Scegli

- la scelta

- scelto

- classi

- Pulizia

- pulire campo

- clicca

- Cloud

- infrastruttura cloud

- Cluster

- il clustering

- Costa

- codice

- base del codice

- Revisione del codice

- codifica

- collaborando

- collaborazione

- COM

- combinazione

- combinare

- combinato

- combina

- Venire

- viene

- arrivo

- presto disponibile

- comunicare

- Comunicazioni

- Aziende

- azienda

- Società

- rispetto

- avvincente

- completamento di una

- completamente

- complesso

- complessità

- globale

- Calcolare

- concetti

- Configurazione

- configurazione

- congetturare

- Connettiti

- collegato

- veloce

- Connettività

- collega

- coerente

- consolle

- vincoli

- Consumatori

- consumo

- contatti

- centralino

- Tecnologie Container

- contenuto

- Generazione di contenuti

- contesto

- contestuale

- continua

- continua

- continua

- continua

- di controllo

- controlli

- Conversazione

- discorsivo

- Conversazioni

- copyright

- copy professionale

- Nucleo

- Costo

- costo effettivo

- Costi

- paesi

- Cox

- creare

- creato

- la creatività

- creatori

- credito

- carta di credito

- crimine

- CRM

- cliente

- esperienza del cliente

- Soddisfazione del cliente

- Servizio clienti

- Clienti

- personalizzabile

- personalizzazione

- personalizzare

- personalizzate

- taglio

- cicli

- alle lezioni

- cruscotto

- cruscotti

- dati

- Preparazione dei dati

- privacy dei dati

- Privacy e sicurezza dei dati

- set di dati

- data-driven

- Banca Dati

- banche dati

- giorno

- giorno per giorno

- Giorni

- Decision Making

- decisioni

- deep

- apprendimento profondo

- più profondo

- definizioni

- Laurea

- ritardo

- consegnare

- Consegne

- consegna

- fornisce un monitoraggio

- Richiesta

- democratizzare

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- profondità

- descrivere

- descritta

- descrizione

- progettato

- desiderato

- dettagliati

- dettagli

- individuare

- Determinare

- DEUTSCHE TELECOM

- Costruttori

- sviluppatori

- in via di sviluppo

- Mercato

- diagnosi

- dialogo

- Dialogo

- DID

- diverso

- Emittente

- digitale

- direttamente

- distribuire

- distribuito

- formazione distribuita

- distribuzione

- do

- documento

- documentazione

- documenti

- effettua

- non

- fare

- fatto

- Dont

- raddoppio

- giù

- guidare

- dovuto

- duplicati

- durata

- e

- e-commerce

- ogni

- Presto

- più facile

- facilmente

- est

- facile

- Economia

- edizione

- in maniera efficace

- efficienza

- in modo efficiente

- sforzo

- o

- altro

- emissioni

- dipendenti

- e potenza

- che abilita

- enable

- consentendo

- codifica

- fine

- da un capo all'altro

- energia

- Consumo di energia

- ingegnere

- Ingegneria

- accrescere

- miglioramenti

- arricchendo

- Impresa

- di livello enterprise

- aziende

- Intrattenimento

- Intero

- busta

- epoca

- ERP

- errore

- errori

- valutazioni

- Anche

- eventi

- EVER

- Ogni

- tutti

- qualunque cosa

- evoluzione

- evolvere

- esempio

- Esempi

- eccitato

- coinvolgenti

- eseguire

- esecutivo

- esistente

- espansivo

- attenderti

- affrettare

- costoso

- esperienza

- esperto

- Esperienze

- esperto

- competenza

- Spiegare

- esplora

- esprimere

- tessuto

- Faccia

- fatto

- Fattori

- abbastanza

- fedele

- Autunno

- familiare

- famiglie

- famiglia

- FAST

- più veloce

- difettoso

- caratteristica

- Caratteristiche

- tassa

- feedback

- pochi

- Limatura

- filtro

- Infine

- finanziario

- Trovate

- ricerca

- trova

- sottile

- finire

- Nome

- Fissare

- flessibile

- concentrato

- seguire

- Nel

- Per i consumatori

- Avanti

- essere trovato

- Fondazione

- quattro

- frazione

- Contesto

- quadri

- Gratis

- frequentemente

- amichevole

- da

- funzioni

- ulteriormente

- futuro

- gioco

- game-changer

- gaming

- Generale

- generalmente

- generare

- genera

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- generatore

- ottenere

- ottenere

- Dare

- globali

- digitale globale

- Go

- scopo

- andando

- buono

- GPU

- GPU

- grande

- Terra

- innovativo

- Gruppo

- Crescita

- cresciuto

- guida

- guida

- linee guida

- ha avuto

- Mani

- Happening

- Hard

- Hardware

- dannoso

- odio

- Avere

- avendo

- Notizie

- assistenza sanitaria

- pesante

- sollevamento pesante

- Aiuto

- aiutare

- aiuta

- qui

- Alta

- superiore

- massimo

- mettendo in evidenza

- vivamente

- assumere

- il suo

- di hosting

- ORE

- Come

- Tutorial

- Tuttavia

- HTTPS

- centinaia

- i

- ID

- identità

- Identità

- ids

- if

- Immagine

- immagini

- immediato

- Impact

- realizzare

- implementazioni

- implementato

- importare

- importante

- impressionante

- competenze

- migliorata

- miglioramenti

- in

- includere

- inclusi

- Compreso

- Aumento

- è aumentato

- crescente

- individui

- industrie

- industria

- leader del settore

- influenzato

- info

- far sapere

- informazioni

- Infrastruttura

- innovare

- innovare

- Innovazione

- innovazioni

- creativi e originali

- ingresso

- Ingressi

- intuizione

- intuizioni

- esempio

- invece

- Istituto

- istruzioni

- assicurazione

- integrazione

- intellettuale

- proprietà intellettuale

- Intelligence

- intende

- interagire

- interazioni

- interagisce

- interconnesso

- Interfaccia

- interno

- intervenire

- ai miglioramenti

- introdurre

- introdotto

- l'introduzione di

- Inventato

- inventario

- Investire

- investigativo

- investire

- investimento

- Investimenti

- coinvolto

- sicurezza

- IT

- SUO

- Giapponese

- gergo

- Java

- jpg

- ad appena

- solo uno

- mantenere

- conservazione

- continua

- Le

- Aree chiave

- parole chiave

- Corredo (SDK)

- Sapere

- conoscenze

- conosce

- Labs

- Dipingere

- Lingua

- grandi

- larga scala

- maggiore

- Cognome

- L'anno scorso

- In ritardo

- Latenza

- con i più recenti

- lanciato

- lancio

- avvocati

- strato

- galline ovaiole

- Leadership

- principale

- IMPARARE

- imparato

- apprendimento

- Legale

- meno

- Consente di

- Livello

- Leva

- leveraggi

- LexisNexis

- LG

- biblioteche

- ciclo di vita

- di sollevamento

- piace

- probabile

- limiti

- Limitato

- limiti

- Linee

- LINK

- Collegamento

- Lista

- vivere

- Lives

- Lama

- LLM

- collocato

- posizioni

- logico

- logo

- Lunghi

- Di vecchia data

- lotto

- amore

- Basso

- inferiore

- minore

- macchina

- machine learning

- fatto

- mantenere

- Mantenere

- manutenzione

- maggiore

- make

- FA

- Fare

- gestito

- gestione

- I gestori

- Manuale

- lavoro manuale

- manualmente

- molti

- Marketing

- materiale

- Materiale

- massimo

- Maggio..

- me

- significativo

- si intende

- Media

- Soddisfare

- incontro

- incontri

- Soddisfa

- Utenti

- semplice

- Meta

- metodo

- Miami

- Microsoft

- In mezzo

- forza

- pietra miliare

- Minuti

- perdere

- Missione

- ML

- modello

- modellismo

- modelli

- Impulso

- MongoDB

- monitor

- Mese

- mese

- Scopri di più

- maggior parte

- Più popolare

- in movimento

- MRI

- molti

- multiplo

- Musica

- devono obbligatoriamente:

- my

- Nome

- stretto

- Nasdaq

- Naturale

- Vicino

- necessaria

- Bisogno

- di applicazione

- che necessitano di

- rete

- Rete

- internazionale

- New

- New York

- recentemente

- GENERAZIONE

- Nitro

- no

- adesso

- numero

- Nvidia

- of

- MENO

- offensivo

- offrire

- offerta

- Offerte

- di frequente

- maggiore

- on

- una volta

- ONE

- quelli

- online

- online banking

- esclusivamente

- aprire

- operare

- Operazioni

- OTTIMIZZA

- ottimizzati

- ottimizzazione

- Opzioni

- or

- ordini

- organizzazione

- organizzazioni

- i

- Altro

- Altri

- nostro

- su

- contorno

- produzione

- uscite

- ancora

- rifornire in quantità eccessiva

- schiacciante

- proprio

- Pace

- Packages

- doloroso

- coppie

- parametro

- parametri

- parte

- partner

- Ricambi

- passato

- modelli

- pausa

- Persone

- per

- Eseguire

- performance

- eseguita

- esegue

- autorizzazione

- permessi

- persona

- personalizzazione

- personalizzare

- Personalmente

- Tour PGA

- Frasi

- posto

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- più

- punto

- Termini e Condizioni

- Popolare

- positivo

- possibile

- Post

- potenziale

- energia

- alimentato

- potente

- Pratico

- in pratica

- pratiche

- bisogno

- predire

- Previsioni

- preferenze

- preparazione

- Preparare

- presenti

- Presidente

- stampa

- premendo

- Anteprima

- in precedenza

- prezzo

- prezzi

- primario

- Privacy

- Privacy e sicurezza

- un bagno

- informazioni riservate

- Problema

- problemi

- processi

- i processi

- lavorazione

- produrre

- Prodotto

- Produzione

- produttivo

- della produttività

- professionale

- Scelto dai professionisti

- Programmi

- progetto

- istruzioni

- proprietà

- proprio

- proteggere

- protezione

- fornire

- fornitore

- fornitori

- fornisce

- fornitura

- la percezione

- pubblicamente

- fini

- Spingi

- spingendo

- metti

- Mettendo

- Python

- pytorch

- Q3

- quantitativo

- domanda

- Domande

- Presto

- rapidamente

- abbastanza

- R&D

- gamma

- veloce

- rapidamente

- RE

- Lettura

- di rose

- tempo reale

- realistico

- rendersi conto

- realizzato

- veramente

- mietendo

- motivi

- recentemente

- Consigli

- raccomandazioni

- record

- ridurre

- Ridotto

- riducendo

- raffinare

- regione

- rilasciato

- pertinente

- problemi di

- resti

- rimuovere

- rimozione

- riparazione

- ripetitivo

- sostituzione

- rispondere

- rapporto

- deposito

- richiesta

- richieste

- necessario

- Requisiti

- riparazioni

- prenotazione

- Prenotare

- Risoluzione

- risuona

- Risorse

- rispetto

- Rispondere

- risponde

- risposta

- risposte

- responsabile

- limitare

- limitato

- colpevole

- Risultati

- di ritorno

- recensioni

- revisione

- destra

- rischi

- Ruolo

- ruoli

- Camere

- percorsi

- Regola

- Correre

- running

- pista

- sacrificando

- sicura

- garanzie

- tranquillamente

- sagemaker

- vendite

- forza di vendita

- stesso

- soddisfazione

- Risparmi

- detto

- Scala

- scala

- Scenari

- portata

- graffiare

- sdk

- senza soluzione di continuità

- Cerca

- Secondo

- Seconda generazione

- secondo

- sicuro

- in modo sicuro

- problemi di

- vedere

- vedendo

- visto

- select

- selezionato

- prodotti

- invio

- anziano

- dirigenza senior

- delicata

- Settembre

- Sequenza

- Serie

- Server

- servizio

- Servizi

- set

- Set

- alcuni

- Condividi

- condiviso

- NAVE

- Corti

- dovrebbero

- lato

- significativa

- Silicio

- Allo stesso modo

- Un'espansione

- semplificare

- semplicemente

- da

- SIX

- Dimensioni

- allentato

- piccole

- So

- Social

- Social Media

- Software

- Sviluppatori di software

- lo sviluppo del software

- kit di sviluppo software

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- Qualcuno

- qualcosa

- presto

- sofisticato

- Fonte

- codice sorgente

- fonti

- sud-est

- lo spazio

- Scintilla

- in particolare

- discorso

- velocità

- spendere

- Stabilità

- stabile

- pila

- impilato

- stakeholder

- iniziato

- Di partenza

- Startup

- state-of-the-art

- soggiorno

- step

- Passi

- Ancora

- conservazione

- Tornare al suo account

- negozi

- Storie

- Tempesta

- Storia

- snellire

- Rafforza

- rigoroso

- La struttura

- Studio

- sottorete

- sostanziale

- tale

- adatto

- suite

- riassumere

- SOMMARIO

- Super

- integrare

- fornitori

- fornire

- Domanda e offerta

- supply chain

- supporto

- supporti

- sicuro

- sorprendente

- sorveglianza

- sospettoso

- Sostenibilità

- Interruttore

- sintetizzare

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- su misura

- Fai

- prende

- presa

- Parlare

- Target

- Task

- task

- team

- Membri del team

- le squadre

- Consulenza

- per l'esame

- tecniche

- Tecnologie

- Tecnologia

- Innovazione tecnologica

- dire

- raccontare

- carnagione

- decine

- tensorflow

- terminologia

- test

- Testing

- test

- testo

- di

- che

- Il

- Il futuro

- il mondo

- loro

- Li

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cosa

- cose

- think

- Terza

- questo

- quest'anno

- quelli

- migliaia

- tre

- Attraverso

- per tutto

- portata

- biglietto

- biglietti

- tempo

- volte

- titano

- a

- oggi

- di oggi

- insieme

- token

- pure

- ha preso

- strumenti

- top

- Argomenti

- Tour

- verso

- verso

- pista

- track record

- Trading

- Treni

- allenato

- Training

- Le transazioni

- Trascrizione

- Trasformare

- Trasformazione

- trasformazioni

- trasformazione

- viaggiare

- triliardi

- viaggio

- veramente

- Affidati ad

- prova

- cerca

- sintonia

- si

- seconda

- Digitare

- tipicamente

- sottostante

- capire

- comprensibile

- e una comprensione reciproca

- capisce

- sconosciuto

- unificato

- unico

- unità

- a differenza di

- fino a quando

- Aggiornanento

- Aggiornamenti

- upgrade

- Upgrades

- us

- Impiego

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- Prezioso

- varietà

- vario

- versione

- versioni

- contro

- molto

- via

- vice

- Vicepresidente

- Video

- Violenza

- potenzialmente

- visualizzazione

- visualizzare

- visivamente

- volumi

- Vulnerabile

- volere

- Ammonitore

- Gruppo musicale avvisatore

- Prima

- Wave

- Modo..

- modi

- we

- sito web

- applicazione web

- servizi web

- siti web

- settimana

- Settimane

- il benvenuto

- WELL

- noto

- sono stati

- Che

- Che cosa è l'

- quando

- se

- quale

- while

- OMS

- perché

- largo

- Vasta gamma

- più ampia

- volere

- finestra

- con

- entro

- senza

- Lavora

- lavorato

- flussi di lavoro

- lavoro

- lavori

- mondo

- classe mondiale

- preoccuparsi

- valore

- sarebbe

- scrivere

- scrivere codice

- scrittura

- anno

- anni

- York

- Tu

- Trasferimento da aeroporto a Sharm

- Zendesk

- zefiro