Dai primi rumori di clamore per gli ultimi strumenti di intelligenza artificiale rivoluzionari, gli sviluppatori e gli appassionati di programmazione li hanno utilizzati per generare codice con il semplice tocco di un pulsante. Gli esperti di sicurezza hanno subito sottolineato che, in molti casi, il codice prodotto lo era scarsa qualità e vulnerabili e, nelle mani di chi ha poca consapevolezza della sicurezza, potrebbe provocare una valanga di app non sicure e sviluppo Web colpire i consumatori ignari.

E poi ci sono quelli che hanno abbastanza conoscenze in materia di sicurezza per usarle, beh, per scopi malvagi. Per ogni strabiliante impresa dell'intelligenza artificiale, sembra che ci sia un contrattacco della stessa tecnologia utilizzata scopi nefasti. Phishing, video di truffe finte, creazione di malware, imbrogli generali di script kiddie: queste attività dirompenti sono ora realizzabili molto più velocemente, con barriere all'ingresso più basse.

Ci sono sicuramente molti clickbait che pubblicizzano questo strumento come rivoluzionario, o almeno che risulta vincitore se abbinato all'abilità umana "media". Anche se sembra inevitabile che la tecnologia di intelligenza artificiale in stile Large Language Models (LLM) cambierà il modo in cui affrontiamo molti aspetti del lavoro, non solo lo sviluppo di software, dobbiamo fare un passo indietro e considerare i rischi oltre i titoli dei giornali.

E come compagno di programmazione, i suoi difetti sono forse la sua caratteristica più “umana”.

Modelli di codifica scadenti dominano le sue soluzioni di riferimento

Con ChatGPT addestrato su decenni di codice e basi di conoscenza esistenti, non sorprende che, nonostante tutta la sua meraviglia e mistero, anch'esso soffra delle stesse insidie comuni che le persone affrontano durante la navigazione nel codice. I modelli di codifica inadeguati sono la soluzione ideale e ci vuole comunque un driver attento alla sicurezza per generare esempi di codifica sicuri ponendo le domande giuste e fornendo la giusta progettazione tempestiva.

Anche in questo caso, non vi è alcuna garanzia che i frammenti di codice forniti siano accurati e funzionali dal punto di vista della sicurezza; la tecnologia è persino incline alle allucinazioni costituire biblioteche inesistenti quando viene richiesto di eseguire alcune operazioni JSON specifiche. Ciò potrebbe portare a "allucinazioni abusive" da parte degli autori delle minacce, che sarebbero fin troppo felici di creare malware mascherati da librerie fabbricate consigliate con piena fiducia da ChatGPT.

In definitiva, dobbiamo affrontare la realtà che, in generale, non ci aspettiamo che gli sviluppatori siano sufficientemente attenti alla sicurezza, né come settore li abbiamo adeguatamente preparati a scrivere codice sicuro come stato predefinito. Ciò sarà evidente nell’enorme quantità di dati di addestramento immessi in ChatGPT e possiamo aspettarci risultati di sicurezza simili poco brillanti dal suo output, almeno inizialmente. Gli sviluppatori dovrebbero essere in grado di identificare i bug di sicurezza e risolverli da soli o progettare suggerimenti migliori per un risultato più affidabile.

Il primo studio sugli utenti su larga scala l’esame del modo in cui gli utenti interagiscono con un assistente di codifica AI per risolvere una varietà di funzioni relative alla sicurezza – condotto da ricercatori della Stanford University – supporta questa nozione.

Tra questo e le inevitabili minacce portate dall’intelligenza artificiale che permeeranno il nostro futuro, gli sviluppatori, ora più che mai, devono affinare le proprie capacità di sicurezza e alzare il livello della qualità del codice, indipendentemente dalla sua origine.

La strada verso un disastro legato alla violazione dei dati è lastricata di buone intenzioni

Non dovrebbe sorprendere che i compagni di codifica AI siano popolari, soprattutto perché gli sviluppatori si trovano ad affrontare responsabilità crescenti, scadenze più strette e le ambizioni di innovazione di un'azienda che gravano sulle loro spalle. Tuttavia, anche con le migliori intenzioni, la mancanza di consapevolezza della sicurezza quando si utilizza l’intelligenza artificiale per la codifica porterà inevitabilmente a evidenti problemi di sicurezza. Tutti gli sviluppatori con strumenti AI/ML genereranno più codice e il livello di rischio per la sicurezza dipenderà dal loro livello di abilità. Le organizzazioni devono essere profondamente consapevoli che le persone non addestrate genereranno sicuramente il codice più velocemente, ma aumenteranno anche la velocità del debito di sicurezza tecnica.

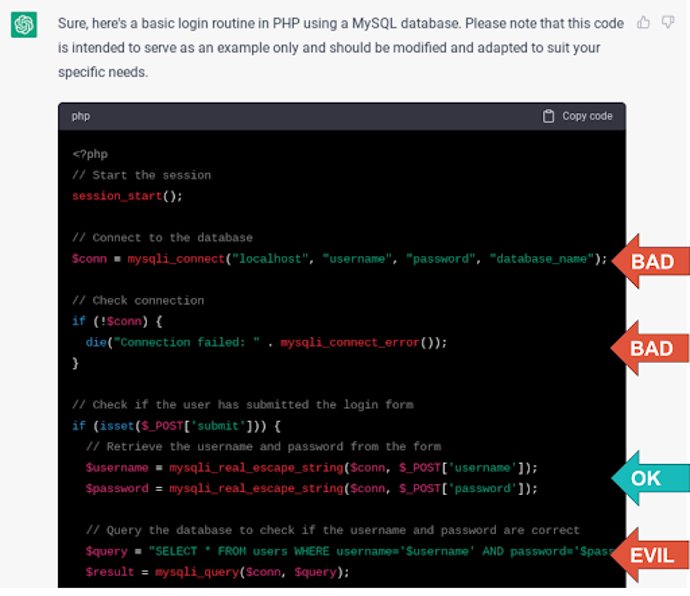

Anche il nostro test preliminare con ChatGPT in aprile ha rivelato che genererà errori basilari che potrebbero avere conseguenze devastanti. Quando gli abbiamo chiesto di creare una routine di accesso in PHP utilizzando un database MySQL, il codice funzionale è stato generato rapidamente. Tuttavia, per impostazione predefinita memorizzava le password in testo normale in un database, memorizzava le credenziali di connessione al database nel codice e utilizzava un modello di codifica che poteva comportare un'iniezione SQL (sebbene eseguisse un certo livello di filtraggio sui parametri di input e sputasse errori del database ). Tutti gli errori da principiante in qualsiasi misura:

Ulteriori suggerimenti hanno assicurato che gli errori fossero corretti, ma per correggerli sono necessarie conoscenze significative in materia di sicurezza. L'uso incontrollato e diffuso di questi strumenti non è meglio che scatenare sviluppatori junior nei tuoi progetti, e se questo codice sta costruendo infrastrutture sensibili o elaborando dati personali, allora siamo di fronte a una bomba a orologeria.

Naturalmente, proprio come gli sviluppatori junior aumentano senza dubbio le loro competenze nel tempo, ci aspettiamo che le capacità di intelligenza artificiale/ML migliorino. Tra un anno, potrebbe non commettere errori di sicurezza così evidenti e semplici. Tuttavia, ciò avrà l’effetto di aumentare notevolmente le competenze di sicurezza necessarie per individuare gli errori di sicurezza più gravi, nascosti e non banali che si correrà ancora il rischio di produrre.

Rimaniamo impreparati a individuare e risolvere le vulnerabilità della sicurezza e l’intelligenza artificiale amplia il divario

Anche se da molti anni si parla molto di “spostamento a sinistra”, resta il fatto che, per la maggior parte delle organizzazioni, c’è una significativa mancanza di conoscenze pratiche in materia di sicurezza tra i membri del gruppo di sviluppo, e dobbiamo lavorare di più per fornire gli strumenti e la formazione adeguati per aiutarli nel loro cammino.

Allo stato attuale, non siamo preparati ai bug di sicurezza che già incontriamo, per non parlare dei nuovi problemi legati all'intelligenza artificiale come l'iniezione rapida e l'allucinazione che rappresentano vettori di attacco completamente nuovi destinati a decollare a macchia d'olio. Gli strumenti di codifica basati sull'intelligenza artificiale rappresentano il futuro dell'arsenale di codifica di uno sviluppatore, ma la formazione per maneggiare in sicurezza queste armi di produttività deve arrivare ora.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://www.darkreading.com/vulnerabilities-threats/when-it-comes-to-secure-coding-chatgpt-is-quintessentially-human

- :ha

- :È

- :non

- $ SU

- 7

- a

- capace

- preciso

- attività

- attori

- adeguatamente

- AI

- AI / ML

- nello stesso modo

- Tutti

- già

- Sebbene il

- ambizioni

- tra

- quantità

- an

- ed

- in qualsiasi

- approccio

- applicazioni

- Aprile

- SONO

- Arsenal

- AS

- aspetti

- Assistant

- At

- attacco

- Avalanche

- media

- consapevole

- consapevolezza

- precedente

- bar

- barriere

- basic

- BE

- stato

- essendo

- MIGLIORE

- Meglio

- Al di là di

- bomba

- violazione

- bug

- costruire

- Costruzione

- ma

- pulsante

- by

- Materiale

- funzionalità

- casi

- Causare

- certamente

- il cambiamento

- ChatGPT

- clickbait

- codice

- codifica

- Coorte

- Venire

- viene

- arrivo

- Uncommon

- compagno

- compagni

- azienda

- condotto

- fiducia

- veloce

- Conseguenze

- Prendere in considerazione

- Consumatori

- potuto

- Portata

- creazione

- Credenziali

- PERICOLO

- dati

- violazione di dati

- Banca Dati

- Debito

- decenni

- deep

- Deep Fake

- Predefinito

- consegna

- Design

- devastante

- Costruttori

- sviluppatori

- Mercato

- DID

- disastro

- dirompente

- do

- Dominare

- giù

- drammaticamente

- autista

- Istruzione

- effetto

- o

- Ingegneria

- enorme

- abbastanza

- interamente

- iscrizione

- errori

- particolarmente

- Anche

- EVER

- Ogni

- evidente

- esaminando

- Esempi

- esistente

- attenderti

- previsto

- esperti

- Faccia

- di fronte

- fatto

- falso

- più veloce

- impresa

- Federale

- filtraggio

- Trovate

- Nome

- Fissare

- difetti

- Nel

- da

- pieno

- funzionale

- funzioni

- futuro

- Generale

- generare

- generato

- dato

- buono

- di garanzia

- Mani

- contento

- Avere

- Notizie

- Aiuto

- nascosto

- Colpire

- Come

- Tuttavia

- HTTPS

- umano

- Montatura

- identificare

- if

- competenze

- in

- Aumento

- crescente

- industria

- inevitabile

- inevitabilmente

- Infrastruttura

- inizialmente

- Innovazione

- ingresso

- intenzioni

- interagire

- ai miglioramenti

- sicurezza

- IT

- SUO

- json

- ad appena

- conoscenze

- Dipingere

- lackluster

- Lingua

- grandi

- con i più recenti

- portare

- meno

- a sinistra

- Livello

- Biblioteca

- piace

- piccolo

- LLM

- accesso

- cerca

- lotto

- inferiore

- make

- il malware

- Malwarebytes

- molti

- meraviglia

- abbinato

- Importanza

- max-width

- Maggio..

- misurare

- errori

- Scopri di più

- maggior parte

- molti

- devono obbligatoriamente:

- mysql

- Mistero

- navigazione

- Bisogno

- New

- no

- inesistente

- Nozione

- adesso

- ovvio

- of

- MENO

- on

- Operazioni

- or

- organizzazioni

- origine

- nostro

- su

- Risultato

- produzione

- ancora

- parametri

- Le password

- Cartamodello

- modelli

- Persone

- Eseguire

- Forse

- cronologia

- dati personali

- prospettiva

- phishing

- PHP

- Platone

- Platone Data Intelligence

- PlatoneDati

- povero

- Popolare

- Pratico

- preparato

- problemi

- lavorazione

- Prodotto

- produzione

- della produttività

- progetti

- qualità

- Domande

- rapidamente

- aumentare

- RE

- Realtà

- raccomandato

- rimanere

- resti

- rappresentare

- necessario

- ricercatori

- responsabilità

- riposo

- colpevole

- Risultati

- Rivelato

- rivoluzionario

- destra

- Rischio

- rischi

- strada

- robusto

- s

- tranquillamente

- stesso

- Truffa

- sicuro

- problemi di

- Consapevolezza della sicurezza

- sembra

- delicata

- grave

- set

- MUTEVOLE

- dovrebbero

- significativa

- simile

- Un'espansione

- abilità

- abilità

- So

- Software

- lo sviluppo del software

- RISOLVERE

- alcuni

- specifico

- velocità

- Spin

- si

- stanford

- Università di Stanford

- Regione / Stato

- step

- Ancora

- memorizzare

- tale

- soffre

- supporti

- sorpresa

- Fai

- prende

- Parlare

- Consulenza

- Tecnologia

- test

- di

- che

- Il

- Il futuro

- loro

- Li

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- minaccia

- attori della minaccia

- minacce

- ticchettio

- stretto

- tempo

- a

- pure

- strumenti

- top

- toccare

- pista

- allenato

- Training

- indubbiamente

- Università

- uso

- utilizzato

- Utente

- utenti

- utilizzando

- varietà

- molto

- Video

- vulnerabilità

- Prima

- Modo..

- we

- Armi

- sito web

- WELL

- sono stati

- quando

- while

- OMS

- molto diffuso

- volere

- con

- Lavora

- sarebbe

- scrivere

- anno

- anni

- Trasferimento da aeroporto a Sharm

- zefiro