Questo post è stato scritto in collaborazione con Ankur Goyal e Karthikeyan Chokappa del settore Cloud & Digital di PwC Australia.

L’intelligenza artificiale (AI) e l’apprendimento automatico (ML) stanno diventando parte integrante di sistemi e processi, consentendo decisioni in tempo reale, favorendo così miglioramenti sia a livello di profitti che di profitti in tutte le organizzazioni. Tuttavia, mettere in produzione un modello ML su larga scala è impegnativo e richiede una serie di best practice. Molte aziende dispongono già di data scientist e ingegneri ML in grado di creare modelli all'avanguardia, ma portare i modelli in produzione e mantenerli su larga scala rimane una sfida. I flussi di lavoro manuali limitano le operazioni del ciclo di vita ML per rallentare il processo di sviluppo, aumentare i costi e compromettere la qualità del prodotto finale.

Le operazioni di machine learning (MLOps) applicano i principi DevOps ai sistemi ML. Proprio come DevOps combina sviluppo e operazioni per l'ingegneria del software, MLOps combina ingegneria ML e operazioni IT. Con la rapida crescita dei sistemi ML e nel contesto dell'ingegneria ML, MLOps fornisce le funzionalità necessarie per gestire le complessità uniche dell'applicazione pratica dei sistemi ML. Nel complesso, i casi d'uso ML richiedono una soluzione integrata prontamente disponibile per industrializzare e semplificare il processo che porta un modello ML dallo sviluppo alla distribuzione della produzione su larga scala utilizzando MLOps.

Per affrontare queste sfide dei clienti, PwC Australia ha sviluppato Machine Learning Ops Accelerator come un insieme di processi standardizzati e funzionalità tecnologiche per migliorare l’operatività dei modelli AI/ML che consentono la collaborazione interfunzionale tra i team durante le operazioni del ciclo di vita ML. PwC Machine Learning Ops Accelerator, basato sui servizi nativi AWS, offre una soluzione adatta allo scopo che si integra facilmente nei casi d'uso ML per i clienti di tutti i settori. In questo post, ci concentreremo sulla creazione e distribuzione di un caso d'uso ML che integri vari componenti del ciclo di vita di un modello ML, consentendo l'integrazione continua (CI), la distribuzione continua (CD), la formazione continua (CT) e il monitoraggio continuo (CM).

Panoramica della soluzione

In MLOps, un viaggio di successo dai dati ai modelli ML fino alle raccomandazioni e previsioni nei sistemi e nei processi aziendali comporta diversi passaggi cruciali. Si tratta di prendere il risultato di un esperimento o di un prototipo e trasformarlo in un sistema di produzione con controlli, qualità e cicli di feedback standard. È molto più che semplice automazione. Si tratta di migliorare le pratiche organizzative e di fornire risultati ripetibili e riproducibili su larga scala.

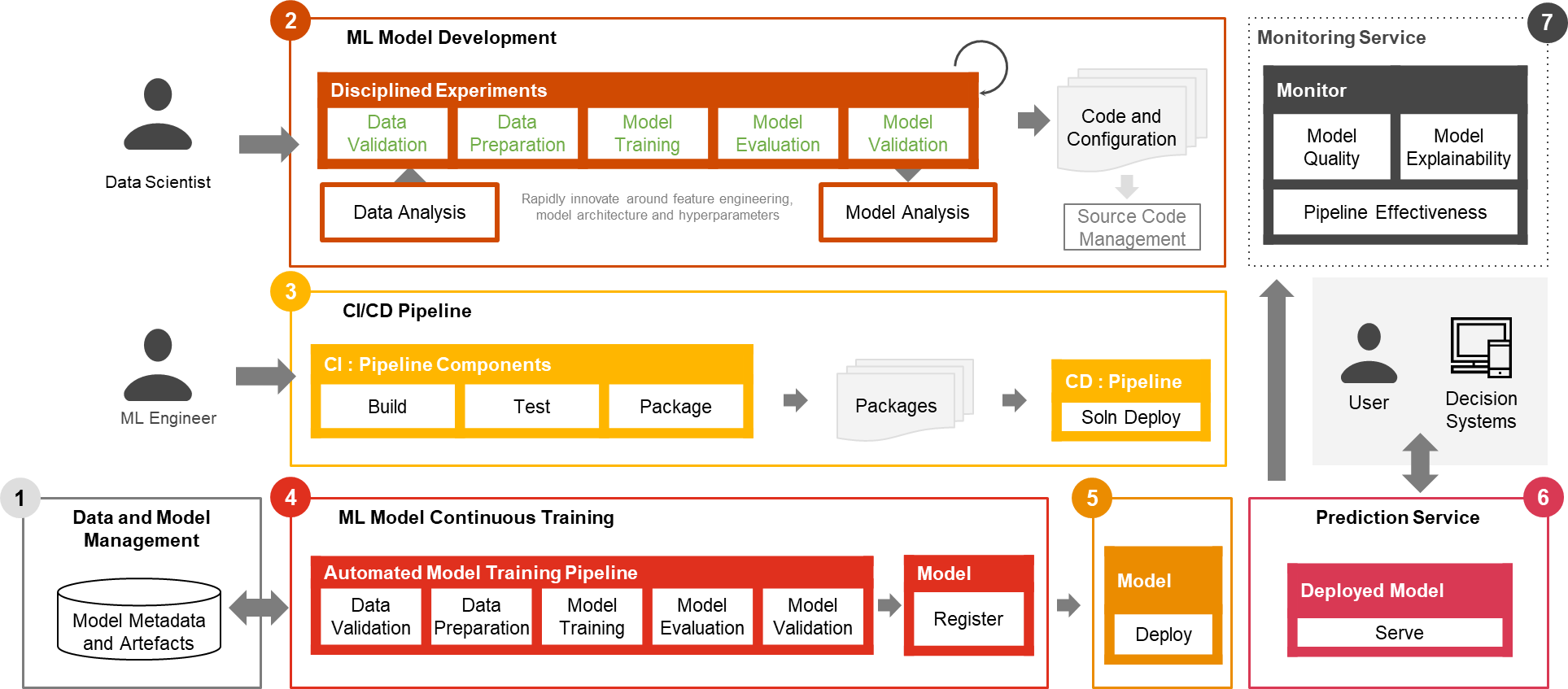

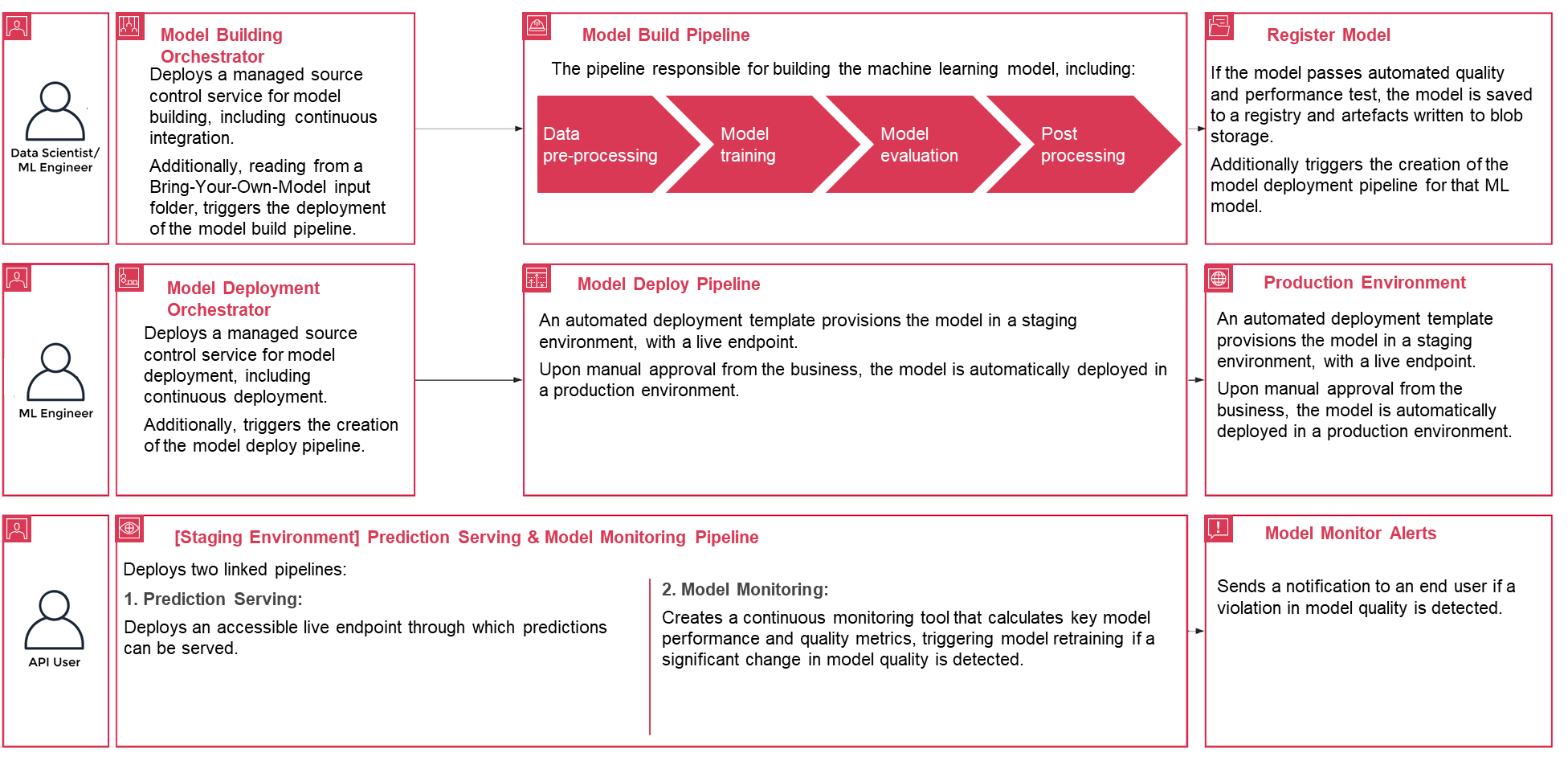

Solo una piccola parte di un caso d'uso di ML nel mondo reale comprende il modello stesso. I vari componenti necessari per creare una funzionalità ML avanzata integrata e gestirla continuamente su larga scala sono mostrati nella Figura 1. Come illustrato nel diagramma seguente, PwC MLOps Accelerator comprende sette funzionalità chiave integrate e passaggi iterativi che consentono CI, CD, CT e CM di un caso d'uso ML. La soluzione sfrutta le funzionalità native di AWS da Amazon Sage Maker, costruendo attorno a questo un quadro flessibile ed estensibile.

Figura 1 – Funzionalità di PwC Machine Learning Ops Accelerator

In uno scenario aziendale reale, potrebbero esistere ulteriori passaggi e fasi di test per garantire una convalida e un'implementazione rigorose dei modelli in ambienti diversi.

- Gestione dei dati e dei modelli fornire una funzionalità centrale che governa gli artefatti ML durante tutto il loro ciclo di vita. Consente verificabilità, tracciabilità e conformità. Promuove inoltre la condivisibilità, la riutilizzabilità e la rilevabilità delle risorse ML.

- Sviluppo di modelli ML consente a vari soggetti di sviluppare una pipeline di addestramento del modello solida e riproducibile, che comprende una sequenza di passaggi, dalla convalida e trasformazione dei dati all'addestramento e alla valutazione del modello.

- Integrazione/consegna continua facilita la creazione, il test e il confezionamento automatizzati della pipeline di addestramento del modello e la sua distribuzione nell'ambiente di esecuzione di destinazione. Le integrazioni con flussi di lavoro CI/CD e il controllo delle versioni dei dati promuovono le migliori pratiche MLOps come la governance e il monitoraggio per lo sviluppo iterativo e il controllo delle versioni dei dati.

- Formazione continua del modello ML la capacità esegue la pipeline di formazione in base ai trigger di riqualificazione; cioè, quando diventano disponibili nuovi dati o le prestazioni del modello scendono al di sotto di una soglia preimpostata. Registra il modello addestrato se si qualifica come candidato modello di successo e archivia gli artefatti di addestramento e i metadati associati.

- Distribuzione del modello consente l'accesso al modello addestrato registrato per la revisione e l'approvazione per il rilascio di produzione e consente il confezionamento, il test e la distribuzione del modello nell'ambiente del servizio di previsione per il servizio di produzione.

- Servizio di previsione la capacità avvia il modello distribuito per fornire previsioni tramite modelli online, batch o streaming. Il runtime di elaborazione acquisisce inoltre i log di elaborazione dei modelli per il monitoraggio e i miglioramenti continui.

- Il monitoraggio continuo monitora l'efficacia predittiva del modello per rilevare il decadimento del modello e l'efficacia del servizio (latenza, pipeline ed errori di esecuzione)

Architettura PwC Machine Learning Ops Accelerator

La soluzione si basa sui servizi nativi AWS utilizzando Amazon SageMaker e la tecnologia serverless per mantenere prestazioni e scalabilità elevate e costi di gestione bassi.

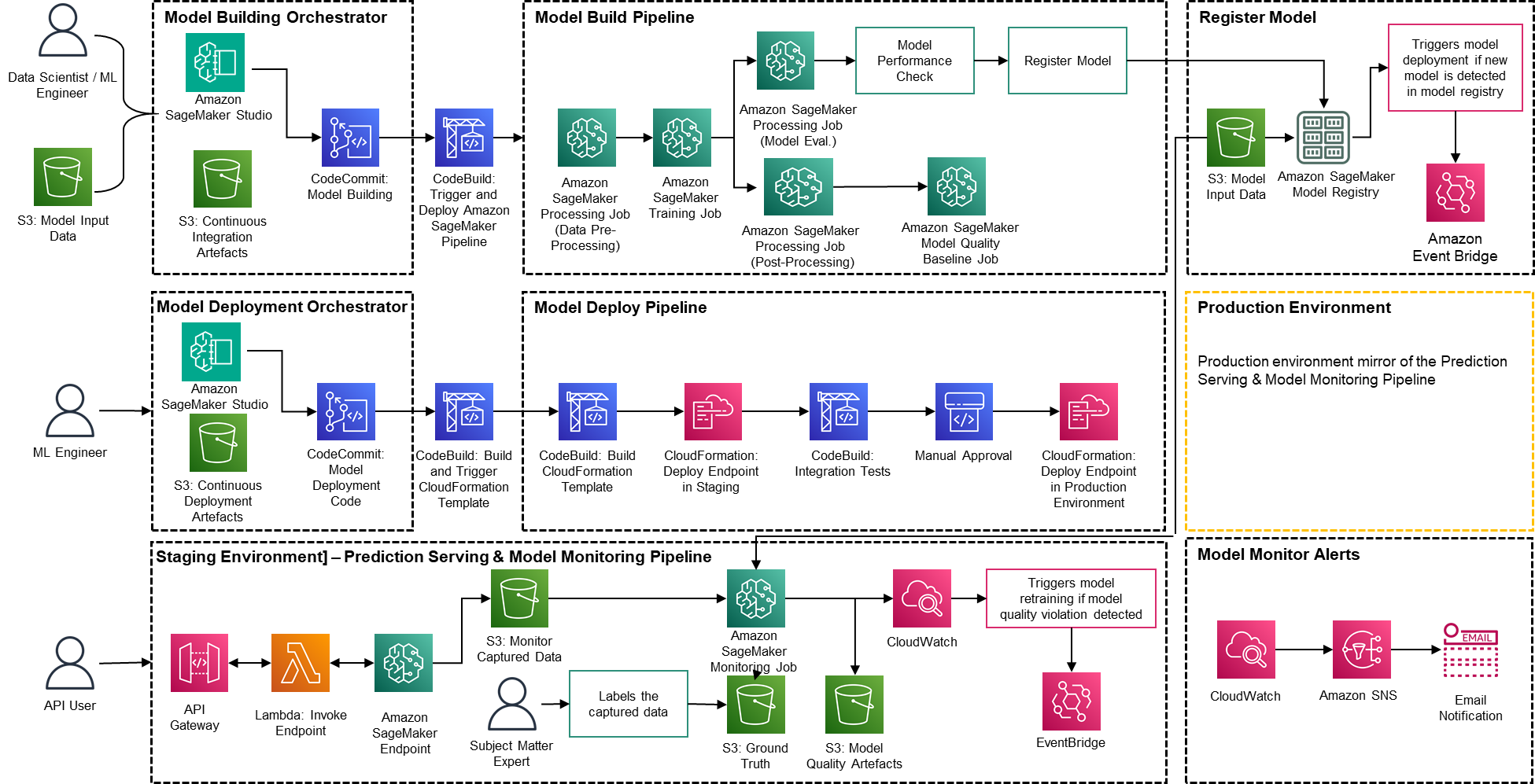

Figura 2 – Architettura PwC Machine Learning Ops Accelerator

- PwC Machine Learning Ops Accelerator fornisce un diritto di accesso basato sulla persona per la creazione, l'utilizzo e le operazioni che consente agli ingegneri ML e ai data scientist di automatizzare la distribuzione delle pipeline (formazione e servizio) e di rispondere rapidamente ai cambiamenti di qualità del modello. Gestore ruoli di Amazon SageMaker viene utilizzato per implementare l'attività ML basata sui ruoli e Amazon S3 viene utilizzato per archiviare dati di input e artefatti.

- La soluzione utilizza le risorse di creazione di modelli esistenti del cliente e crea un framework flessibile ed estensibile attorno a questo utilizzando i servizi nativi AWS. Sono state create integrazioni tra Amazon S3, Git e AWS CodeCommit che consentono il controllo delle versioni dei set di dati con una gestione futura minima.

- Il modello AWS CloudFormation viene generato utilizzando Kit di sviluppo cloud AWS (AWS CDK). AWS CDK offre la possibilità di gestire le modifiche per la soluzione completa. La pipeline automatizzata include passaggi per l'archiviazione di modelli pronti all'uso e il monitoraggio delle metriche.

- PwC MLOps Accelerator è progettato per essere modulare e fornito come infrastruttura come codice (IaC) per consentire distribuzioni automatiche. Il processo di distribuzione utilizza AWS CodeCommit, AWSCodeBuild, AWS Code Pipelinee il modello AWS CloudFormation. La soluzione end-to-end completa per rendere operativo un modello ML è disponibile come codice distribuibile.

- Attraverso una serie di modelli IaC, vengono distribuiti tre componenti distinti: creazione del modello, distribuzione del modello e monitoraggio del modello e servizio di previsione, utilizzando Pipeline di Amazon SageMaker

- La pipeline di creazione del modello automatizza il processo di addestramento e valutazione del modello e consente l'approvazione e la registrazione del modello addestrato.

- La pipeline di distribuzione del modello fornisce l'infrastruttura necessaria per distribuire il modello ML per l'inferenza batch e in tempo reale.

- La pipeline di monitoraggio e previsione dei modelli distribuisce l'infrastruttura necessaria per fornire previsioni e monitorare le prestazioni del modello.

- PwC MLOps Accelerator è progettato per essere indipendente dai modelli ML, dai framework ML e dagli ambienti runtime. La soluzione consente l'uso familiare di linguaggi di programmazione come Python e R, strumenti di sviluppo come Jupyter Notebook e framework ML tramite un file di configurazione. Questa flessibilità rende semplice per i data scientist perfezionare continuamente i modelli e distribuirli utilizzando il linguaggio e l'ambiente preferiti.

- La soluzione dispone di integrazioni integrate per utilizzare strumenti predefiniti o personalizzati per assegnare le attività di etichettatura Amazon SageMaker verità fondamentale per set di dati di addestramento per fornire formazione e monitoraggio continui.

- La pipeline ML end-to-end è progettata utilizzando le funzionalità native di SageMaker (Amazon Sage Maker Studio , Condutture per la costruzione di modelli Amazon SageMaker, Esperimenti Amazon SageMakere Endpoint Amazon SageMaker).

- La soluzione utilizza le funzionalità integrate di Amazon SageMaker per il controllo delle versioni dei modelli, il monitoraggio della derivazione dei modelli, la condivisione dei modelli e l'inferenza serverless con Registro dei modelli di Amazon SageMaker.

- Una volta che il modello è in produzione, la soluzione monitora continuamente la qualità dei modelli ML in tempo reale. Monitor modello Amazon SageMaker viene utilizzato per monitorare continuamente i modelli in produzione. Amazon CloudWatch Logs viene utilizzato per raccogliere file di log che monitorano lo stato del modello e le notifiche vengono inviate tramite Amazon SNS quando la qualità del modello raggiunge determinate soglie. Logger nativi come (boto3) vengono utilizzati per acquisire lo stato dell'esecuzione per accelerare la risoluzione dei problemi.

Soluzione dettagliata

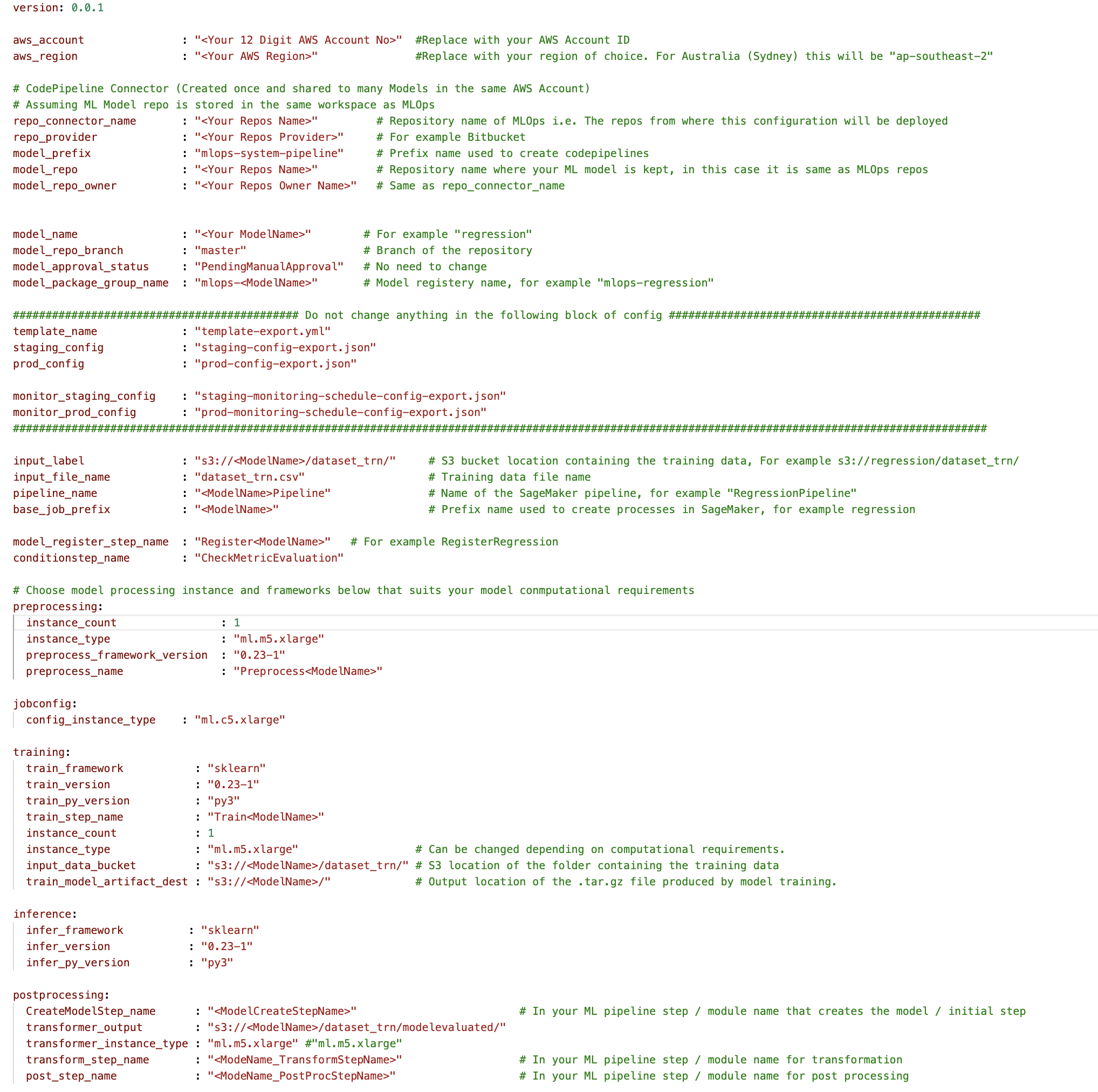

La seguente procedura dettagliata illustra i passaggi standard per creare il processo MLOps per un modello utilizzando PwC MLOps Accelerator. Questa procedura dettagliata descrive il caso d'uso di un tecnico MLOps che desidera distribuire la pipeline per un modello ML sviluppato di recente utilizzando un file di definizione/configurazione semplice e intuitivo.

Figura 3 – Ciclo di vita del processo PwC Machine Learning Ops Accelerator

- Per iniziare, iscriviti Acceleratore PwC MLOps per ottenere l'accesso agli artefatti della soluzione. L'intera soluzione è guidata da un file YAML di configurazione (

config.yaml) per modello. Tutti i dettagli richiesti per eseguire la soluzione sono contenuti nel file di configurazione e archiviati insieme al modello in un repository Git. Il file di configurazione fungerà da input per automatizzare le fasi del flusso di lavoro esternalizzando parametri e impostazioni importanti all'esterno del codice. - L'ingegnere ML deve compilare

config.yamlfile e attiva la pipeline MLOps. I clienti possono configurare un account AWS, il repository, il modello, i dati utilizzati, il nome della pipeline, il framework di addestramento, il numero di istanze da utilizzare per l'addestramento, il framework di inferenza e qualsiasi fase di pre e post-elaborazione e molti altri configurazioni per verificare la qualità, la distorsione e la spiegabilità del modello.

Figura 4 – Configurazione YAML di Machine Learning Ops Accelerator

- Un semplice file YAML viene utilizzato per configurare i requisiti di formazione, distribuzione, monitoraggio e runtime di ciascun modello. Una volta che

config.yamlè configurato in modo appropriato e salvato insieme al modello nel proprio repository Git, viene richiamato l'orchestratore di creazione del modello. Può anche leggere da un Bring-Your-Own-Model che può essere configurato tramite YAML per attivare la distribuzione della pipeline di creazione del modello. - Dopo questo punto, tutto viene automatizzato dalla soluzione e non richiede il coinvolgimento né dell'ingegnere ML né del data scientist. La pipeline responsabile della creazione del modello ML include la preelaborazione dei dati, l'addestramento del modello, la valutazione del modello e l'elaborazione ost. Se il modello supera i test automatizzati di qualità e prestazioni, viene salvato in un registro e gli artefatti vengono scritti nello storage Amazon S3 in base alle definizioni nei file YAML. Ciò attiva la creazione della pipeline di distribuzione del modello per quel modello ML.

Figura 5 – Esempio di flusso di lavoro di distribuzione del modello

- Successivamente, un modello di distribuzione automatizzata effettua il provisioning del modello in un ambiente di staging con un endpoint attivo. Dopo l'approvazione, il modello viene automaticamente distribuito nell'ambiente di produzione.

- La soluzione distribuisce due pipeline collegate. La pubblicazione delle previsioni distribuisce un endpoint live accessibile attraverso il quale è possibile fornire le previsioni. Il monitoraggio del modello crea uno strumento di monitoraggio continuo che calcola le prestazioni chiave del modello e i parametri di qualità, attivando la riqualificazione del modello se viene rilevato un cambiamento significativo nella qualità del modello.

- Ora che hai completato la creazione e la distribuzione iniziale, l'ingegnere MLOps può configurare gli avvisi di errore per essere avvisato in caso di problemi, ad esempio quando una pipeline non riesce a svolgere il lavoro previsto.

- MLOps non riguarda più il confezionamento, il test e la distribuzione di componenti del servizio cloud in modo simile a una tradizionale distribuzione CI/CD; è un sistema che dovrebbe distribuire automaticamente un altro servizio. Ad esempio, la pipeline di addestramento del modello distribuisce automaticamente la pipeline di distribuzione del modello per abilitare il servizio di previsione, che a sua volta abilita il servizio di monitoraggio del modello.

Conclusione

In sintesi, MLOps è fondamentale per qualsiasi organizzazione che mira a distribuire modelli ML nei sistemi di produzione su larga scala. PwC ha sviluppato un acceleratore per automatizzare la creazione, l'implementazione e la manutenzione di modelli ML integrando gli strumenti DevOps nel processo di sviluppo del modello.

In questo post, abbiamo esplorato come la soluzione PwC sia alimentata dai servizi ML nativi di AWS e aiuti ad adottare pratiche MLOps in modo che le aziende possano accelerare il loro percorso verso l'intelligenza artificiale e ottenere più valore dai loro modelli ML. Abbiamo illustrato i passaggi che un utente dovrebbe eseguire per accedere a PwC Machine Learning Ops Accelerator, eseguire le pipeline e distribuire un caso d'uso ML che integra vari componenti del ciclo di vita di un modello ML.

Per iniziare il tuo percorso MLOps su AWS Cloud su larga scala ed eseguire i tuoi carichi di lavoro di produzione ML, iscriviti Operazioni di machine learning di PwC.

Informazioni sugli autori

Kiran Kumar Ballari è Principal Solutions Architect presso Amazon Web Services (AWS). È un evangelista che ama aiutare i clienti a sfruttare le nuove tecnologie e costruire soluzioni di settore ripetibili per risolvere i loro problemi. È particolarmente appassionato di ingegneria del software, intelligenza artificiale generativa e aiuto alle aziende con lo sviluppo di prodotti AI/ML.

Kiran Kumar Ballari è Principal Solutions Architect presso Amazon Web Services (AWS). È un evangelista che ama aiutare i clienti a sfruttare le nuove tecnologie e costruire soluzioni di settore ripetibili per risolvere i loro problemi. È particolarmente appassionato di ingegneria del software, intelligenza artificiale generativa e aiuto alle aziende con lo sviluppo di prodotti AI/ML.

Ankur Goyal è un direttore della pratica Cloud e Digital di PwC Australia, focalizzata su dati, analisi e intelligenza artificiale. Ankur ha una vasta esperienza nel supportare le organizzazioni del settore pubblico e privato nella guida delle trasformazioni tecnologiche e nella progettazione di soluzioni innovative sfruttando risorse di dati e tecnologie.

Ankur Goyal è un direttore della pratica Cloud e Digital di PwC Australia, focalizzata su dati, analisi e intelligenza artificiale. Ankur ha una vasta esperienza nel supportare le organizzazioni del settore pubblico e privato nella guida delle trasformazioni tecnologiche e nella progettazione di soluzioni innovative sfruttando risorse di dati e tecnologie.

Karthikeyan Chokappa (KC) è un manager nella pratica cloud e digitale di PwC Australia, focalizzata su dati, analisi e intelligenza artificiale. KC è appassionato di progettazione, sviluppo e implementazione di soluzioni di analisi end-to-end che trasformano i dati in preziose risorse decisionali per migliorare le prestazioni e l'utilizzo e ridurre il costo totale di proprietà degli oggetti connessi e intelligenti.

Karthikeyan Chokappa (KC) è un manager nella pratica cloud e digitale di PwC Australia, focalizzata su dati, analisi e intelligenza artificiale. KC è appassionato di progettazione, sviluppo e implementazione di soluzioni di analisi end-to-end che trasformano i dati in preziose risorse decisionali per migliorare le prestazioni e l'utilizzo e ridurre il costo totale di proprietà degli oggetti connessi e intelligenti.

Rama Lankalapalli è un Sr. Partner Solutions Architect presso AWS e collabora con PwC per accelerare le migrazioni e le modernizzazioni dei propri clienti in AWS. Lavora in diversi settori per accelerare l'adozione di AWS Cloud. La sua esperienza risiede nell'architettura di soluzioni cloud efficienti e scalabili, nella promozione dell'innovazione e della modernizzazione delle applicazioni dei clienti sfruttando i servizi AWS e nella creazione di basi cloud resilienti.

Rama Lankalapalli è un Sr. Partner Solutions Architect presso AWS e collabora con PwC per accelerare le migrazioni e le modernizzazioni dei propri clienti in AWS. Lavora in diversi settori per accelerare l'adozione di AWS Cloud. La sua esperienza risiede nell'architettura di soluzioni cloud efficienti e scalabili, nella promozione dell'innovazione e della modernizzazione delle applicazioni dei clienti sfruttando i servizi AWS e nella creazione di basi cloud resilienti.

Jeejee Unwalla è un Senior Solutions Architect presso AWS a cui piace guidare i clienti nella risoluzione delle sfide e nel pensare in modo strategico. È appassionato di tecnologia, dati e innovazione.

Jeejee Unwalla è un Senior Solutions Architect presso AWS a cui piace guidare i clienti nella risoluzione delle sfide e nel pensare in modo strategico. È appassionato di tecnologia, dati e innovazione.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/driving-advanced-analytics-outcomes-at-scale-using-amazon-sagemaker-powered-pwcs-machine-learning-ops-accelerator/

- :ha

- :È

- :non

- $ SU

- 1

- 100

- 1951

- 2024

- 32

- 33

- 7

- a

- capacità

- Chi siamo

- accelerare

- acceleratore

- accesso

- accessibile

- Il mio account

- operanti in

- attività

- aggiuntivo

- indirizzo

- adottare

- Adozione

- Avanzate

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- AI / ML

- mira

- Avvisi

- Tutti

- consentire

- consente

- lungo

- a fianco di

- già

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analitica

- ed

- Un altro

- in qualsiasi

- Applicazioni

- applicazioni

- si applica

- appropriatamente

- approvazione

- approvare

- architettura

- SONO

- in giro

- AS

- Attività

- associato

- At

- verificabilità

- Australia

- automatizzare

- Automatizzata

- automatizza

- Automatico

- automaticamente

- Automazione

- disponibile

- AWS

- AWS CloudFormazione

- basato

- BE

- diventa

- diventando

- stato

- sotto

- MIGLIORE

- best practice

- fra

- pregiudizio

- costruire

- costruire

- Costruzione

- costruisce

- costruito

- incassato

- affari

- aziende

- ma

- by

- calcola

- Materiale

- candidato

- funzionalità

- capacità

- catturare

- cattura

- Custodie

- casi

- CD

- centrale

- certo

- Challenge

- sfide

- impegnativo

- il cambiamento

- Modifiche

- dai un'occhiata

- Cloud

- codice

- collaborazione

- raccogliere

- combina

- Aziende

- completamento di una

- complessità

- conformità

- componenti

- incluso

- compromesso

- Configurazione

- configurato

- collegato

- contenute

- contesto

- continuo

- continuamente

- controlli

- Costo

- Costi

- creare

- crea

- creazione

- critico

- cruciale

- costume

- cliente

- Clienti

- dati

- scienziato di dati

- dataset

- decisione

- decisioni

- definizioni

- consegnato

- consegna

- fornisce un monitoraggio

- consegna

- schierare

- schierato

- distribuzione

- deployment

- implementazioni

- Distribuisce

- progettato

- progettazione

- dettagli

- individuare

- rilevato

- sviluppare

- sviluppato

- in via di sviluppo

- Mercato

- strumenti di sviluppo

- diverso

- digitale

- Direttore

- distinto

- paesaggio differenziato

- do

- effettua

- giù

- spinto

- guida

- ogni

- alleviare

- facilmente

- efficacia

- efficiente

- o

- enable

- Abilita

- consentendo

- da un capo all'altro

- endpoint

- ingegnere

- Ingegneria

- Ingegneri

- garantire

- Impresa

- Intero

- Diritto

- Ambiente

- ambienti

- errori

- particolarmente

- stabilire

- valutazione

- Evangelista

- esempio

- esegue

- esecuzione

- esistere

- esistente

- affrettare

- esperienza

- esperimento

- competenza

- Esplorazione

- estensivo

- Conclamata Esperienza

- fallisce

- Fallimento

- familiare

- Caratteristiche

- feedback

- figura

- Compila il

- File

- finale

- Flessibilità

- flessibile

- Focus

- concentrato

- i seguenti

- Nel

- Fondazioni

- frazione

- Contesto

- quadri

- da

- futuro

- Guadagno

- generato

- generativo

- AI generativa

- ottenere

- Idiota

- andato

- la governance

- governa

- Terra

- Crescita

- maniglia

- Avere

- he

- Aiuto

- aiutare

- aiuta

- Alta

- il suo

- Visualizzazioni

- Come

- Tuttavia

- HTML

- HTTPS

- if

- realizzare

- importante

- competenze

- miglioramenti

- miglioramento

- in

- inclusi

- Aumento

- industrie

- industria

- Infrastruttura

- inizialmente

- Innovazione

- creativi e originali

- ingresso

- integrale

- integrato

- Integra

- Integrazione

- integrazione

- integrazioni

- Intelligence

- Intelligente

- destinato

- ai miglioramenti

- intuitivo

- invocato

- coinvolgimento

- sicurezza

- IT

- SUO

- stessa

- Lavoro

- viaggio

- jpg

- ad appena

- mantenere

- Le

- Kumar

- etichettatura

- Lingua

- Le Lingue

- Latenza

- apprendimento

- Leva

- leveraging

- si trova

- ciclo di vita

- piace

- LIMITE

- lignaggio

- connesso

- vivere

- ceppo

- più a lungo

- ama

- Basso

- macchina

- machine learning

- Mantenere

- FA

- gestire

- gestione

- direttore

- Manuale

- molti

- Maggio..

- Metadati

- metrico

- Metrica

- minimo

- ML

- MLOp

- modello

- modelli

- componibile

- Monitorare

- monitoraggio

- monitor

- Scopri di più

- molti

- Nome

- nativo

- necessaria

- Bisogno

- di applicazione

- New

- Nuove tecnologie

- no

- taccuino

- notifiche

- numero

- of

- on

- una volta

- ONE

- online

- operare

- Operazioni

- or

- organizzazione

- organizzazioni

- Altro

- risultati

- al di fuori

- complessivo

- proprio

- proprietà

- imballaggio

- parametri

- parte

- partner

- Passi

- appassionato

- modelli

- per

- performance

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- Post

- alimentato

- Pratico

- pratica

- pratiche

- predizione

- Previsioni

- preferito

- Direttore

- principi

- un bagno

- settore privato

- problemi

- processi

- i processi

- Prodotto

- sviluppo del prodotto

- Produzione

- Programmazione

- linguaggi di programmazione

- promuoverlo

- promuove

- prototipo

- fornire

- fornisce

- la percezione

- Mettendo

- PWC

- Python

- qualità

- R

- veloce

- rapidamente

- Leggi

- prontamente

- di rose

- mondo reale

- tempo reale

- recentemente

- raccomandazioni

- ridurre

- raffinare

- registrato

- registri

- Iscrizione

- registro

- rilasciare

- resti

- ripetibile

- deposito

- richiedere

- necessario

- Requisiti

- richiede

- elastico

- Rispondere

- responsabile

- colpevole

- recensioni

- rigoroso

- robusto

- Ruolo

- Correre

- running

- runtime

- sagemaker

- salvato

- Scalabilità

- scalabile

- Scala

- scenario

- Scienziato

- scienziati

- settore

- anziano

- inviato

- Sequenza

- Serie

- servire

- servito

- serverless

- servizio

- Servizi

- servizio

- set

- impostazioni

- Sette

- alcuni

- compartecipazione

- dovrebbero

- mostrato

- significativa

- simile

- Un'espansione

- rallentare

- piccole

- So

- Software

- Ingegneria del software

- soluzione

- Soluzioni

- RISOLVERE

- Soluzione

- velocità

- tappe

- messa in scena

- Standard

- iniziato

- inizio

- state-of-the-art

- Stato dei servizi

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- negozi

- lineare

- strategicamente

- Streaming

- snellire

- di successo

- tale

- SOMMARIO

- Supporto

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- presa

- Target

- task

- le squadre

- Tech

- Tecnologie

- Tecnologia

- modello

- modelli

- Testing

- test

- di

- che

- I

- loro

- Li

- in tal modo

- Strumenti Bowman per analizzare le seguenti finiture:

- cose

- Pensiero

- questo

- tre

- soglia

- Attraverso

- per tutto

- tempo

- a

- strumenti

- top

- Totale

- Tracciabilità

- Tracking

- tradizionale

- allenato

- Training

- Trasformare

- Trasformazione

- trasformazioni

- innescare

- innescando

- TURNO

- Svolta

- seconda

- unico

- su

- Impiego

- uso

- caso d'uso

- utilizzato

- Utente

- usa

- utilizzando

- convalida

- Prezioso

- APPREZZIAMO

- vario

- via

- camminava

- walkthrough

- vuole

- Prima

- we

- sito web

- servizi web

- quando

- quale

- OMS

- volere

- con

- entro

- flusso di lavoro

- flussi di lavoro

- lavoro

- lavori

- sarebbe

- scritto

- YAML

- Trasferimento da aeroporto a Sharm

- zefiro