Si prevede che i deepfake dell’intelligenza artificiale elettorale travolgeranno le autorità di regolamentazione dell’UE poiché oltre 10 paesi della regione si recheranno alle urne nel 2024 sullo sfondo di governi impreparati.

Nel 2024, si prevede che il continente vedrà un afflusso di deepfake a sfondo politico sotto forma di video, audio e immagini. Con strumenti come Midjourney versione 6, che creano un “fotorealismo incredibile”, sarà facile prendere di mira persone reali o scene di rivolte e movimenti di migranti.

Elezioni multiple dell’UE

Secondo Segnali di Bruxelles, Austria, Finlandia, Croazia, Belgio, Lituania, Islanda, Portogallo, Romania e Slovacchia terranno elezioni nazionali il prossimo anno.

Altrove, Germania, Irlanda, Malta e Polonia hanno elezioni locali, mentre la Spagna ha due elezioni regionali.

A livello globale, circa il 25% della popolazione mondiale vive in un paese che terrà le elezioni nel 2024, ad esempio gli Stati Uniti.

Il periodo elettorale è arrivato anche in un momento in cui il mondo sta assistendo a un boom economico IA generativa seguendo la storia di successo di ChatGPT, lanciata nel novembre 2022.

Pertanto, Henry Ajder, fondatore di una startup di intelligenza artificiale generativa a Cambridge, afferma che l’anno 2024 vedrà “la maggior parte delle persone andare alle elezioni e, allo stesso tempo, stiamo assistendo a un’evoluzione e all’implementazione dell’intelligenza artificiale piuttosto rapide. "

Leggi anche: Il governo sudcoreano nega il diritto d'autore per i contenuti AI

Scarsa preparazione

Sara Ibrahim, avvocato presso la Gatehouse Chambers di Londra che lavora e scrive spesso sull’intelligenza artificiale, sostiene che le prossime elezioni dovranno affrontare minacce legate all’intelligenza artificiale a causa dell’impreparazione dei regolatori dell’UE ad affrontare l’uso dell’intelligenza artificiale durante il periodo elettorale.

Secondo lei, la regione è attualmente caratterizzata da “una tempesta perfetta di governi impreparati e da una possibilità su larga scala di inganni e frodi, che diffondono rapidamente la disinformazione”.

I tribunali europei hanno già avuto un assaggio dell’impatto dell’intelligenza artificiale generativa, e questo funge da segnale di allarme precoce.

Il sistema legale, secondo Ibrahim, “sta già sperimentando persone che citano casi inventati e allucinati da ChatGPT, quindi un vero stress per le risorse pubbliche in un momento in cui l’economia non è affatto solida”.

Fermare la diffusione dei deepfake attraverso la regolamentazione potrebbe essere un compito arduo per l’UE adesso.

"I regolatori non possono impedire a una persona sul proprio computer di utilizzare uno strumento incredibilmente accessibile per generare audio o video, condividerlo su Twitter in un momento opportuno o diffonderlo sui gruppi Discord", afferma Ajder.

Nonostante abbia il Legge sui servizi digitali nell’UE, la sua efficacia è “ancora da dimostrare”, secondo Oxford Analytica.

L'intelligenza artificiale ingannevole

Sebbene sia stata pubblicizzata come un punto di svolta per le sue capacità di trasformazione, il mondo è già stato testimone delle insidie dell’intelligenza artificiale generativa. Le immagini, i video e l'audio generati dall'intelligenza artificiale stanno diventando "perfetti" e difficili da distinguere da quelli reali, lasciando gli utenti in difficoltà.

A settembre, durante le elezioni in Bangladesh, un canale di notizie noto come BD Politico ha trasmesso un video sulla piattaforma X con filmati di disordini dovuti all’ingerenza dei diplomatici statunitensi nelle elezioni del paese.

Ma il video è stato creato utilizzando Ehi Gen, un generatore video AI. Il conduttore televisivo nel filmato, "Edward", è uno dei tanti avatar che il generatore di video offre agli utenti con una quota di abbonamento di 24 dollari al mese.

Un altro esempio è quello di una registrazione audio con Sir Keir Starmer abusa verbalmente i suoi collaboratori durante la conferenza di settembre del Partito laburista britannico. La clip ha avuto 1.5 milioni di visualizzazioni.

Nello stesso mese, un'altra clip di Il sindaco di Londra Sadiq Khan È stata ampiamente diffusa la richiesta di riprogrammare il giorno dell'armistizio a causa di una marcia filo-palestinese.

Secondo Bruxelles Signal, le clip hanno dimostrato che erano generate dall’intelligenza artificiale.

[Contenuto incorporato]

Politici vulnerabili

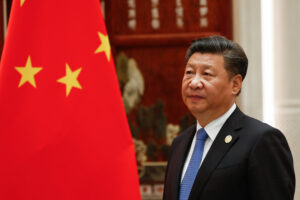

A causa delle posizioni che ricoprono, politici e individui di alto profilo sono diventati obiettivi dei deepfake basati sull’intelligenza artificiale, soprattutto con le elezioni dietro l’angolo in tutto il mondo.

Ajder concorda sul fatto che i politici “sono particolarmente vulnerabili”.

"Ci sono molti dati sull'allenamento nei loro filmati, e stare sul podio o sedersi alla scrivania è qualcosa che è particolarmente facile da falsificare", ha detto Ajder.

Recentemente, quello del Pakistan Imran Khan aveva una voce generata dall'intelligenza artificiale in cui chiedeva sostegno mentre era in prigione in una manifestazione virtuale di sette ore.

Anche i videoclip dei conflitti di Gaza e dell’Ucraina hanno raffigurato bambini insanguinati e abbandonati, ma questi non erano reali. Uno sguardo più attento ha rivelato dita arricciate in “modi anatomicamente impossibili o colori degli occhi innaturali”, secondo Imran Ahmed, amministratore delegato del Center for Countering Digital Hate con sede a Washington, DC.

Cosa si può fare?

Anche se produrre e trasmettere materiale estremista può essere costoso, la frequenza con cui tale contenuto appare su piattaforme come X è elevata.

Secondo Ahmed, l’intelligenza artificiale non regolamentata “darà il massimo all’odio e alla disinformazione”.

Sebbene al momento le autorità di regolamentazione possano fare ben poco, secondo Ajder è necessario garantire la divulgazione di qualsiasi contenuto generato dall’intelligenza artificiale da parte dei politici.

"O almeno ne è consentito l'uso senza divulgazione solo quando è incredibilmente chiaro al pubblico che non è reale ed è una parodia", dice.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://metanews.com/election-ai-deepfakes-will-eu-regulators-cope/

- :ha

- :È

- :non

- 1

- 10

- 2022

- 2024

- 7

- 8

- a

- abilità

- Chi siamo

- accessibile

- Secondo

- ahmed

- AI

- Tutti

- già

- anche

- Tra

- an

- Presentatrice

- ed

- Un altro

- in qualsiasi

- appare

- SONO

- in giro

- AS

- At

- udienze

- Audio

- Austria

- avatars

- fondale

- Bangladesh

- BD

- BE

- perché

- diventando

- stato

- Belgio

- Sanguinoso

- boom

- Broadcasting

- Bruxelles

- ma

- by

- chiamata

- cambridge

- Materiale

- casi

- centro

- Changer

- caratterizzato

- ChatGPT

- capo

- Amministratore Delegato

- pulire campo

- clip

- più vicino

- Venire

- arrivo

- computer

- Convegno

- conflitti

- contenuto

- continente

- copyright

- Angolo

- contrastare

- paesi

- nazione

- Paese del

- Corti

- creato

- Creazione

- Croazia

- Attualmente

- dati

- giorno

- DC-based

- affare

- inganno

- deepfakes

- deployment

- Scrivanie

- difficile

- digitale

- diplomatici

- Rivelazione

- discordia

- Le disinformazioni sanitarie

- distinguere

- do

- fatto

- dovuto

- durante

- Presto

- facile

- EC

- economia

- efficacia

- Elezione

- Elezioni

- incorporato

- garantire

- particolarmente

- EU

- Europa

- Europa

- evoluzione

- esempio

- esecutivo

- previsto

- sperimentare

- occhio

- Faccia

- falso

- notizie false

- Grazie

- tassa

- Finlandia

- Fissare

- i seguenti

- Nel

- modulo

- fondatore

- frode

- Frequenza

- da

- gioco

- game-changer

- generare

- generativo

- AI generativa

- generatore

- Germania

- Go

- andando

- Enti Pubblici

- I governi

- Gruppo

- ha avuto

- odio

- Avere

- avendo

- he

- henry

- Alta

- alto profilo

- lui stesso

- il suo

- tenere

- possesso

- detiene

- HTTPS

- Islanda

- immagini

- Impact

- impossibile

- in

- incredibilmente

- individui

- afflusso

- esempio

- Irlanda

- IT

- SUO

- carcere

- conosciuto

- Coreano

- Lavoro

- larga scala

- lanciato

- meno

- partenza

- Legale

- piace

- Lituania

- piccolo

- Lives

- locale

- Guarda

- lotto

- Malta

- molti

- Marzo

- materiale

- Maggio..

- Sindaco

- Mezzo viaggio

- migrante

- milione

- Disinformazione

- momento

- Mese

- maggior parte

- motivato

- movimenti

- Nationwide

- Bisogno

- notizie

- no

- Novembre

- adesso

- of

- Offerte

- di frequente

- on

- ONE

- quelli

- esclusivamente

- tempestivo

- or

- outlet

- ancora

- Oxford

- Parodia

- Persone

- perfetta

- periodo

- persona

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- Polonia

- politicamente

- Politici

- sondaggi

- popolazione

- Portogallo

- posizioni

- possibilità

- piuttosto

- produzione

- dimostrato

- comprovata

- la percezione

- radunare

- Leggi

- di rose

- vero affare

- registrazione

- regione

- regionale

- Regolamento

- Regolatori

- Risorse

- Reuters

- Rivelato

- destra

- robusto

- Romania

- Suddetto

- stesso

- dice

- Scene

- vedere

- vedendo

- Settembre

- serve

- Servizi

- Condividi

- segno

- Signal

- Seduta

- So

- qualcosa

- Spagna

- velocità

- diffondere

- Diffondere

- in piedi

- startup

- Fermare

- Tempesta

- Storia

- stress

- sottoscrizione

- il successo

- storia di successo

- tale

- supporto

- sistema

- Target

- obiettivi

- Task

- chiavi

- che

- I

- Regno Unito

- il mondo

- loro

- Li

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- pensa

- questo

- minacce

- tempo

- a

- strumenti

- propagandato

- Training

- trasformativa

- seconda

- Uk

- Ucraina

- imminenti

- sollecitando

- us

- uso

- utilizzato

- utenti

- utilizzando

- versione

- molto

- Video

- Video

- visualizzazioni

- virtuale

- Voce

- Vulnerabile

- identificazione dei warning

- Prima

- Washington

- modi

- sono stati

- quando

- quale

- while

- OMS

- ampiamente

- volere

- con

- senza

- assistito

- lavori

- mondo

- Il mondo di

- X

- anno

- youtube

- zefiro