AutoML ti consente di ricavare informazioni rapide e generali dai tuoi dati proprio all'inizio del ciclo di vita di un progetto di machine learning (ML). Comprendere in anticipo quali tecniche di preelaborazione e tipi di algoritmi forniscono i migliori risultati riduce il tempo necessario per sviluppare, addestrare e distribuire il modello giusto. Svolge un ruolo cruciale nel processo di sviluppo di ogni modello e consente ai data scientist di concentrarsi sulle tecniche ML più promettenti. Inoltre, AutoML fornisce un modello di prestazioni di base che può fungere da punto di riferimento per il team di data science.

Uno strumento AutoML applica una combinazione di diversi algoritmi e varie tecniche di preelaborazione ai tuoi dati. Ad esempio, può ridimensionare i dati, eseguire la selezione di funzionalità univariate, condurre PCA a diversi livelli di soglia di varianza e applicare il clustering. Tali tecniche di preelaborazione potrebbero essere applicate singolarmente o combinate in una pipeline. Successivamente, uno strumento AutoML addestrerà diversi tipi di modelli, come regressione lineare, Elastic-Net o Random Forest, su diverse versioni del set di dati preelaborati ed eseguirà l'ottimizzazione degli iperparametri (HPO). Pilota automatico Amazon SageMaker elimina il lavoro pesante legato alla creazione di modelli ML. Dopo aver fornito il set di dati, SageMaker Autopilot esplora automaticamente diverse soluzioni per trovare il modello migliore. Ma cosa succede se desideri distribuire la tua versione personalizzata di un flusso di lavoro AutoML?

Questo post mostra come creare un flusso di lavoro AutoML personalizzato su Amazon Sage Maker utilizzando Ottimizzazione automatica del modello di Amazon SageMaker con codice di esempio disponibile in a Repository GitHub.

Panoramica della soluzione

Per questo caso d'uso, supponiamo che tu faccia parte di un team di data science che sviluppa modelli in un dominio specializzato. Hai sviluppato una serie di tecniche di preelaborazione personalizzate e selezionato una serie di algoritmi che in genere prevedi funzionino bene con il tuo problema di machine learning. Quando lavori su nuovi casi d'uso ML, vorresti prima eseguire un'esecuzione AutoML utilizzando le tecniche e gli algoritmi di preelaborazione per restringere l'ambito delle potenziali soluzioni.

Per questo esempio non utilizzerai un set di dati specializzato; lavorerai invece con il set di dati California Housing da cui importerai Servizio di archiviazione semplice Amazon (Amazon S3). L'obiettivo è dimostrare l'implementazione tecnica della soluzione utilizzando SageMaker HPO, che successivamente potrà essere applicata a qualsiasi set di dati e dominio.

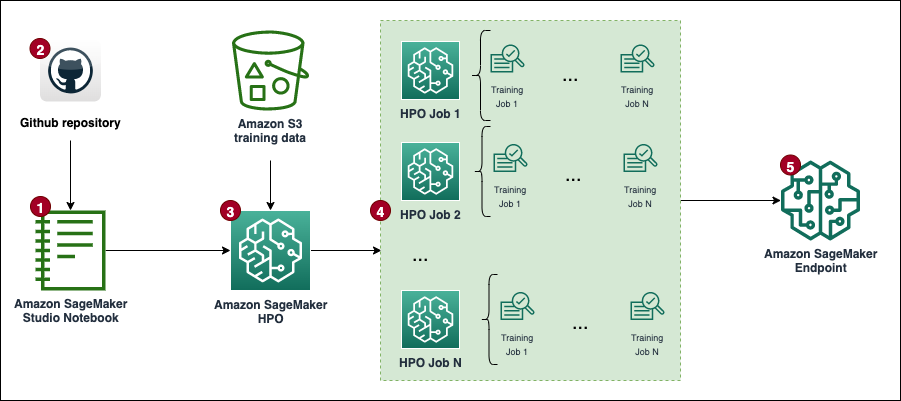

Il diagramma seguente presenta il flusso di lavoro complessivo della soluzione.

Prerequisiti

Di seguito sono riportati i prerequisiti per completare la procedura dettagliata in questo post:

Implementa la soluzione

Il codice completo è disponibile nel file Repository GitHub.

I passaggi per implementare la soluzione (come indicato nel diagramma del flusso di lavoro) sono i seguenti:

- Creare un'istanza di blocco note e specificare quanto segue:

- Nel Tipo di istanza del notebookscegli ml.t3.medio.

- Nel Inferenza elasticascegli nessuna.

- Nel Identificatore della piattaformascegli Amazon Linux 2, Jupyter Lab 3.

- Nel Ruolo IAM, scegli l'impostazione predefinita

AmazonSageMaker-ExecutionRole. Se non esiste, creane uno nuovo Gestione dell'identità e dell'accesso di AWS (IAM) e allega il file Policy IAM AmazonSageMakerFullAccess.

Tieni presente che dovresti creare un ruolo di esecuzione e una policy con ambito minimo in produzione.

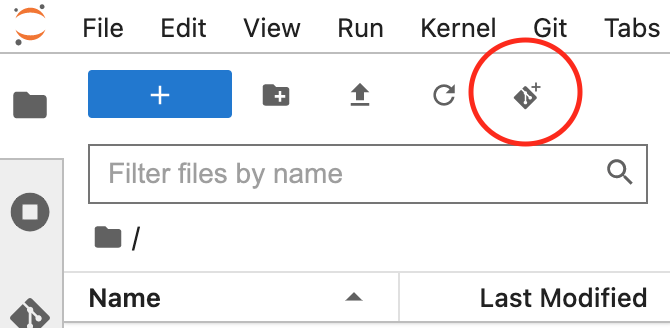

- Apri l'interfaccia JupyterLab per l'istanza del tuo notebook e clona il repository GitHub.

Puoi farlo avviando una nuova sessione terminale ed eseguendo il file git clone <REPO> comando o utilizzando la funzionalità dell'interfaccia utente, come mostrato nello screenshot seguente.

- Aprire il

automl.ipynbnotebook, selezionare il fileconda_python3kernel e seguire le istruzioni per attivare a insieme di lavori HPO.

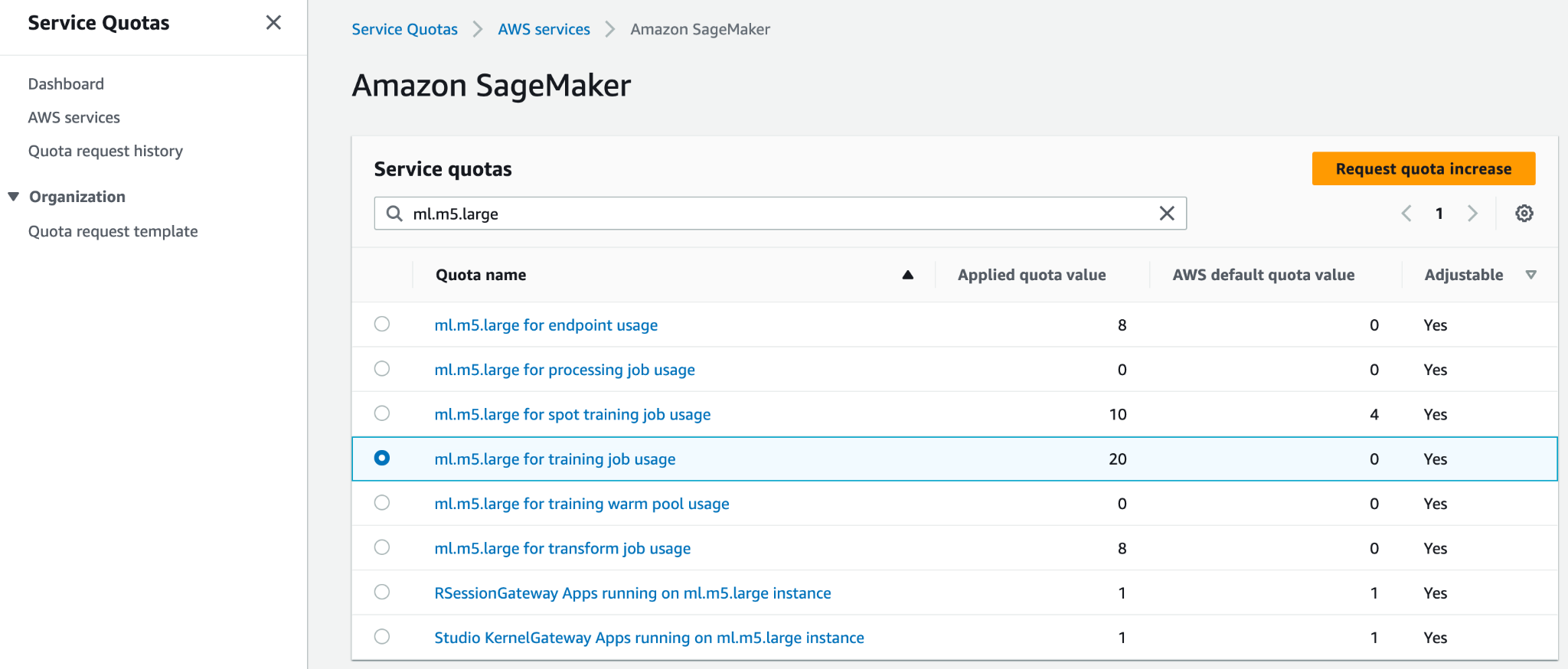

Per eseguire il codice senza alcuna modifica, è necessario aumentare la quota del servizio per ml.m5.large per l'utilizzo del lavoro di formazione ed Numero di istanze in tutti i processi di formazione. AWS consente per impostazione predefinita solo 20 processi di formazione SageMaker paralleli per entrambe le quote. È necessario richiedere un aumento della quota a 30 per entrambi. Entrambe le modifiche alle quote dovrebbero in genere essere approvate entro pochi minuti. Fare riferimento a Richiesta di un aumento della quota per maggiori informazioni.

Se non vuoi cambiare la quota, puoi semplicemente modificare il valore di MAX_PARALLEL_JOBS variabile nello script (ad esempio, a 5).

- Ogni lavoro HPO completerà una serie di lavoro di formazione prove e indicare il modello con iperparametri ottimali.

- Analizzare i risultati e implementare il modello più performante.

Questa soluzione comporterà costi nel tuo account AWS. Il costo di questa soluzione dipenderà dal numero e dalla durata dei lavori di formazione HPO. Man mano che questi aumentano, aumenterà anche il costo. Puoi ridurre i costi limitando i tempi di formazione e configurazione TuningJobCompletionCriteriaConfig secondo le istruzioni discusse più avanti in questo post. Per informazioni sui prezzi, fare riferimento a Prezzi di Amazon SageMaker.

Nelle sezioni seguenti, discutiamo il notebook in modo più dettagliato con esempi di codice e passaggi per analizzare i risultati e selezionare il modello migliore.

Configurazione iniziale

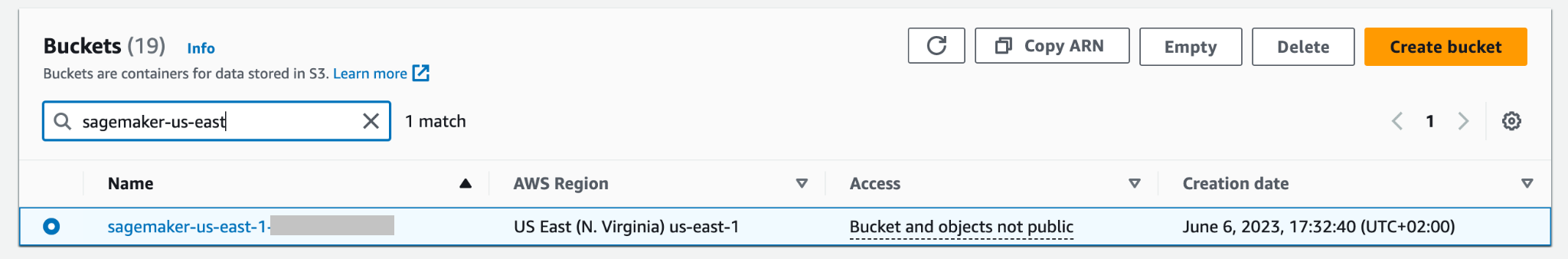

Iniziamo con l'esecuzione di Importazioni e configurazione sezione in custom-automl.ipynb taccuino. Installa e importa tutte le dipendenze richieste, crea un'istanza di una sessione e di un client SageMaker e imposta la regione predefinita e il bucket S3 per l'archiviazione dei dati.

Preparazione dei dati

Scarica il set di dati California Housing e preparalo eseguendo il file Scarica i dati sezione del taccuino. Il set di dati viene suddiviso in frame di dati di training e test e caricato nel bucket S3 predefinito della sessione SageMaker.

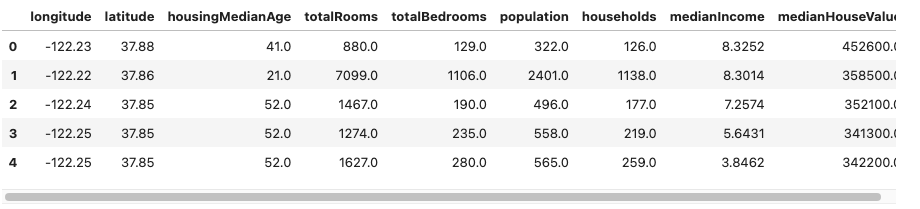

L'intero set di dati contiene 20,640 record e 9 colonne in totale, inclusa la destinazione. L'obiettivo è prevedere il valore medio di una casa (medianHouseValue colonna). La schermata seguente mostra le righe superiori del set di dati.

Modello di script di formazione

Il flusso di lavoro AutoML in questo post è basato su scikit-impara pipeline e algoritmi di preelaborazione. L'obiettivo è generare un'ampia combinazione di diverse pipeline e algoritmi di preelaborazione per trovare la configurazione con le migliori prestazioni. Iniziamo con la creazione di uno script di training generico, che viene mantenuto localmente sull'istanza del notebook. In questo script sono presenti due blocchi di commenti vuoti: uno per l'inserimento degli iperparametri e l'altro per l'oggetto pipeline del modello di preelaborazione. Verranno iniettati dinamicamente per ciascun candidato modello di preelaborazione. Lo scopo di avere uno script generico è mantenere l'implementazione DRY (non ripeterti).

Crea combinazioni di preelaborazione e modello

I preprocessors Il dizionario contiene una specifica delle tecniche di preelaborazione applicate a tutte le funzionalità di input del modello. Ogni ricetta è definita utilizzando a Pipeline o FeatureUnion oggetto da scikit-learn, che concatena le singole trasformazioni dei dati e le impila insieme. Per esempio, mean-imp-scale è una ricetta semplice che garantisce che i valori mancanti vengano imputati utilizzando i valori medi delle rispettive colonne e che tutte le funzionalità vengano ridimensionate utilizzando il metodo StandardScaler. Al contrario, il mean-imp-scale-pca la ricetta concatena alcune altre operazioni:

- Assegna i valori mancanti nelle colonne con la relativa media.

- Applicare il ridimensionamento delle funzionalità utilizzando la media e la deviazione standard.

- Calcola PCA sopra i dati di input a un valore di soglia di varianza specificato e uniscilo insieme alle funzionalità di input imputate e ridimensionate.

In questo post, tutte le funzionalità di input sono numeriche. Se nel set di dati di input sono presenti più tipi di dati, è necessario specificare una pipeline più complicata in cui diversi rami di preelaborazione vengono applicati a diversi set di tipi di funzionalità.

I models Il dizionario contiene le specifiche dei diversi algoritmi a cui adattare il set di dati. Ogni tipo di modello viene fornito con la seguente specifica nel dizionario:

- output_script – Indica la posizione dello script di addestramento utilizzato dallo stimatore. Questo campo viene compilato dinamicamente quando il file

modelsdizionario è combinato con ilpreprocessorsdizionario. - inserimenti – Definisce il codice che verrà inserito nel file

script_draft.pye successivamente salvato sottoscript_output. Il tasto“preprocessor”viene lasciato intenzionalmente vuoto perché questa posizione è riempita con uno dei preprocessori per creare più combinazioni modello-preprocessore. - iperparametri – Un set di iperparametri ottimizzati dal lavoro HPO.

- include_cls_metadata – Ulteriori dettagli di configurazione richiesti da SageMaker

Tunerclasse.

Un esempio completo di models dizionario è disponibile nel repository GitHub.

Successivamente, iteriamo attraverso il file preprocessors ed models dizionari e creare tutte le combinazioni possibili. Ad esempio, se il tuo preprocessors Il dizionario contiene 10 ricette e hai 5 definizioni di modello nel file models dizionario, il dizionario delle pipeline appena creato contiene 50 pipeline del modello preprocessore che vengono valutate durante HPO. Tieni presente che i singoli script della pipeline non sono ancora stati creati a questo punto. Il blocco di codice successivo (cella 9) del notebook Jupyter esegue l'iterazione di tutti gli oggetti del modello del preprocessore nel pipelines dizionario, inserisce tutte le parti di codice rilevanti e rende persistente una versione specifica della pipeline dello script localmente nel notebook. Tali script vengono utilizzati nei passaggi successivi durante la creazione di stimatori individuali da collegare al processo HPO.

Definire gli stimatori

Ora puoi lavorare sulla definizione degli stimatori SageMaker che il lavoro HPO utilizza dopo che gli script sono pronti. Iniziamo con la creazione di una classe wrapper che definisce alcune proprietà comuni per tutti gli stimatori. Eredita da SKLearn class e specifica il ruolo, il numero di istanze e il tipo, nonché quali colonne vengono utilizzate dallo script come funzionalità e la destinazione.

Costruiamo il estimators dizionario eseguendo l'iterazione di tutti gli script generati in precedenza e situati nel file scripts directory. Si crea un'istanza di un nuovo stimatore utilizzando il metodo SKLearnBase classe, con un nome di stima univoco e uno degli script. Si noti che il estimators dizionario ha due livelli: il livello più alto definisce a pipeline_family. Questo è un raggruppamento logico in base alla tipologia di modelli da valutare ed è pari alla lunghezza del models dizionario. Il secondo livello contiene i singoli tipi di preprocessore combinati con quelli indicati pipeline_family. Questo raggruppamento logico è richiesto durante la creazione del lavoro HPO.

Definire gli argomenti del sintonizzatore HPO

Per ottimizzare il passaggio degli argomenti nell'HPO Tuner classe, il HyperparameterTunerArgs la classe dati viene inizializzata con gli argomenti richiesti dalla classe HPO. Viene fornito con una serie di funzioni che garantiscono che gli argomenti HPO vengano restituiti nel formato previsto quando si distribuiscono più definizioni di modello contemporaneamente.

Il successivo blocco di codice utilizza quello introdotto in precedenza HyperparameterTunerArgs classe di dati. Crei un altro dizionario chiamato hp_args e generare una serie di parametri di input specifici per ciascuno estimator_family dal estimators dizionario. Questi argomenti vengono utilizzati nel passaggio successivo durante l'inizializzazione dei lavori HPO per ciascuna famiglia di modelli.

Creare oggetti sintonizzatore HPO

In questo passaggio creerai sintonizzatori individuali per ogni estimator_family. Perché crei tre lavori HPO separati invece di lanciarne solo uno per tutti gli stimatori? IL HyperparameterTuner La classe è limitata a 10 definizioni di modello ad essa allegate. Pertanto, ogni HPO è responsabile della ricerca del preprocessore con le migliori prestazioni per una determinata famiglia di modelli e dell'ottimizzazione degli iperparametri di quella famiglia di modelli.

Di seguito sono riportati alcuni altri punti riguardanti la configurazione:

- La strategia di ottimizzazione è bayesiana, il che significa che l'HPO monitora attivamente le prestazioni di tutte le prove e indirizza l'ottimizzazione verso combinazioni di iperparametri più promettenti. L'arresto anticipato dovrebbe essere impostato su sconto or Automatico quando si lavora con una strategia bayesiana, che gestisce quella logica stessa.

- Ciascun lavoro HPO viene eseguito per un massimo di 100 lavori e ne vengono eseguiti 10 in parallelo. Se hai a che fare con set di dati più grandi, potresti voler aumentare il numero totale di lavori.

- Inoltre, potresti voler utilizzare impostazioni che controllano la durata dell'esecuzione di un lavoro e il numero di lavori che il tuo HPO sta attivando. Un modo per farlo è impostare il tempo di esecuzione massimo in secondi (per questo post lo impostiamo su 1 ora). Un altro è utilizzare il file rilasciato di recente

TuningJobCompletionCriteriaConfig. Offre una serie di impostazioni che monitorano l'avanzamento dei tuoi lavori e decidono se è probabile che più lavori migliorino il risultato. In questo post impostiamo a 20 il numero massimo di lavori di formazione che non migliorano. In questo modo, se il punteggio non migliora (ad esempio dalla quarantesima prova), non dovrai pagare per le prove rimanenti fino a quandomax_jobsè raggiunto.

Ora iteriamo attraverso il file tuners ed hp_args dizionari e attivare tutti i processi HPO in SageMaker. Nota l'utilizzo dell'argomento wait impostato su False, il che significa che il kernel non aspetterà fino al completamento dei risultati e potrai attivare tutti i lavori contemporaneamente.

È probabile che non tutti i lavori di formazione verranno completati e alcuni di essi potrebbero essere interrotti dal lavoro HPO. La ragione di ciò è la TuningJobCompletionCriteriaConfig—l'ottimizzazione termina se viene soddisfatto uno qualsiasi dei criteri specificati. In questo caso, quando i criteri di ottimizzazione non migliorano per 20 lavori consecutivi.

Analizza i risultati

La cella 15 del notebook controlla se tutti i lavori HPO sono stati completati e combina tutti i risultati sotto forma di frame di dati panda per ulteriori analisi. Prima di analizzare i risultati in dettaglio, diamo uno sguardo ad alto livello alla console SageMaker.

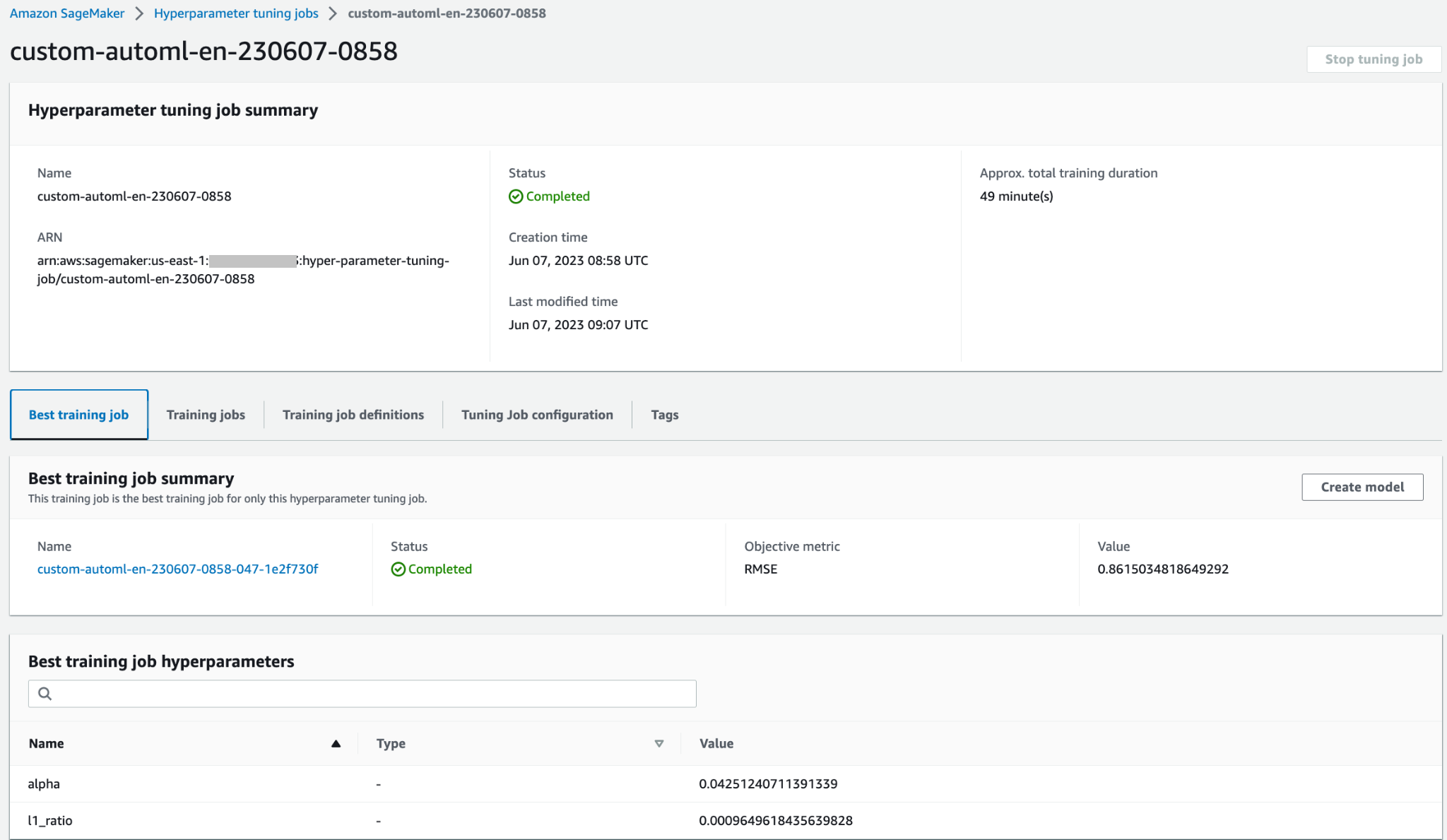

Nella parte superiore della Lavori di ottimizzazione degli iperparametri pagina, puoi vedere i tuoi tre lavori HPO avviati. Tutti hanno terminato presto e non hanno svolto tutti i 100 lavori di formazione. Nello screenshot seguente puoi vedere che la famiglia di modelli Elastic-Net ha completato il maggior numero di prove, mentre altre non hanno avuto bisogno di così tanti lavori di formazione per trovare il risultato migliore.

È possibile aprire il lavoro HPO per accedere a maggiori dettagli, come i singoli lavori di formazione, la configurazione del lavoro e le informazioni e le prestazioni del miglior lavoro di formazione.

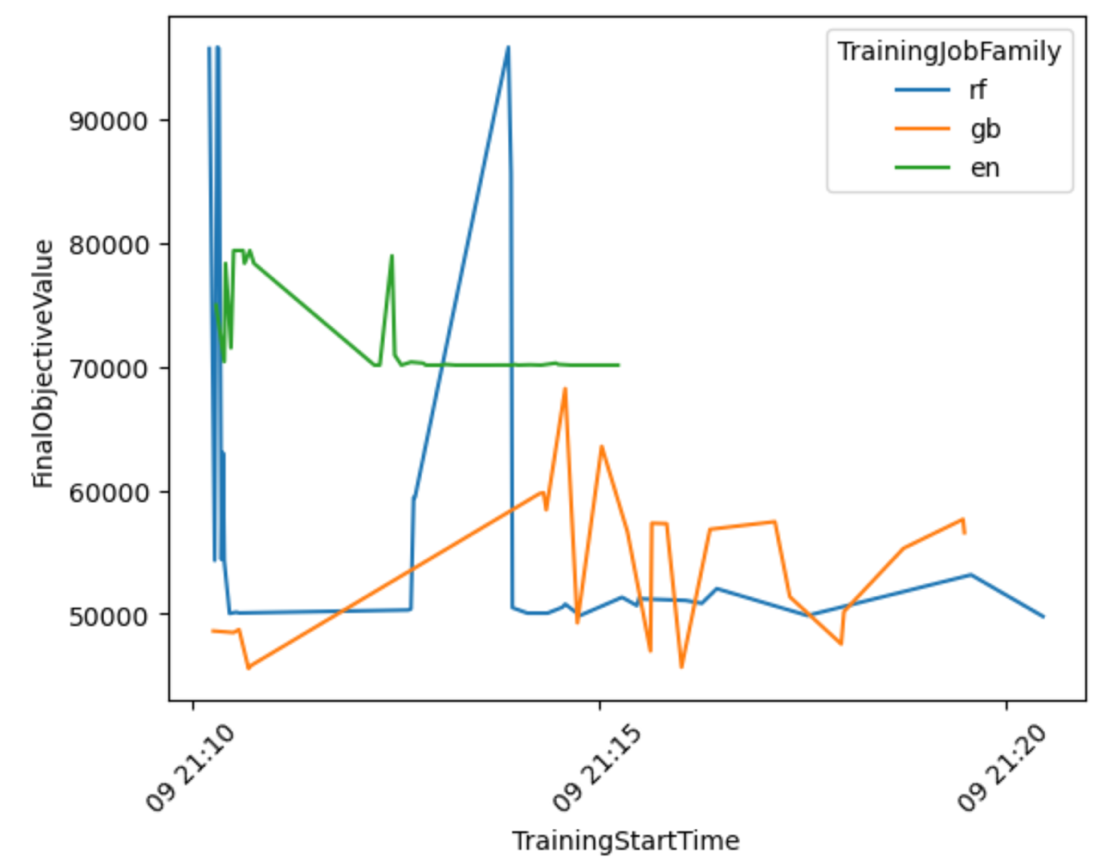

Produciamo una visualizzazione basata sui risultati per ottenere maggiori informazioni sulle prestazioni del flusso di lavoro AutoML in tutte le famiglie di modelli.

Dal grafico seguente si può concludere che Elastic-Net le prestazioni del modello oscillavano tra 70,000 e 80,000 RMSE e alla fine si sono bloccate, poiché l'algoritmo non è stato in grado di migliorare le sue prestazioni nonostante abbia provato varie tecniche di preelaborazione e valori di iperparametri. Sembra anche questo RandomForest le prestazioni variavano molto a seconda del set di iperparametri esplorato da HPO, ma nonostante molte prove non riuscivano a scendere sotto l'errore 50,000 RMSE. GradientBoosting ha ottenuto la migliore performance già da subito scendendo sotto i 50,000 RMSE. HPO ha provato a migliorare ulteriormente questo risultato, ma non è riuscita a ottenere prestazioni migliori con altre combinazioni di iperparametri. Una conclusione generale per tutti i lavori HPO è che non sono stati necessari così tanti lavori per trovare il set di iperparametri con le migliori prestazioni per ciascun algoritmo. Per migliorare ulteriormente il risultato, dovresti sperimentare la creazione di più funzionalità e l'esecuzione di ulteriori attività di ingegneria delle funzionalità.

È inoltre possibile esaminare una visualizzazione più dettagliata della combinazione modello-preprocessore per trarre conclusioni sulle combinazioni più promettenti.

Seleziona il modello migliore e distribuiscilo

Il seguente frammento di codice seleziona il modello migliore in base al valore obiettivo raggiunto più basso. È quindi possibile distribuire il modello come endpoint SageMaker.

ripulire

Per evitare addebiti indesiderati sul tuo account AWS, ti consigliamo di eliminare le risorse AWS utilizzate in questo post:

- Nella console Amazon S3, svuota i dati dal bucket S3 in cui sono stati archiviati i dati di training.

- Sulla console SageMaker, arresta l'istanza del notebook.

- Elimina l'endpoint del modello se lo hai distribuito. Gli endpoint devono essere eliminati quando non sono più in uso, perché vengono fatturati in base al tempo di distribuzione.

Conclusione

In questo post, abbiamo mostrato come creare un lavoro HPO personalizzato in SageMaker utilizzando una selezione personalizzata di algoritmi e tecniche di preelaborazione. In particolare, questo esempio dimostra come automatizzare il processo di generazione di numerosi script di training e come utilizzare le strutture di programmazione Python per una distribuzione efficiente di più lavori di ottimizzazione paralleli. Ci auguriamo che questa soluzione costituisca l'impalcatura di qualsiasi lavoro di ottimizzazione del modello personalizzato che distribuirai utilizzando SageMaker per ottenere prestazioni più elevate e accelerare i flussi di lavoro ML.

Consulta le seguenti risorse per approfondire ulteriormente la tua conoscenza su come utilizzare SageMaker HPO:

Informazioni sugli autori

Konrad Semsch è un Senior ML Solutions Architect presso il team Data Lab di Amazon Web Services. Aiuta i clienti a utilizzare l'apprendimento automatico per risolvere le loro sfide aziendali con AWS. Gli piace inventare e semplificare per offrire ai clienti soluzioni semplici e pragmatiche per i loro progetti AI/ML. È particolarmente appassionato di MlOps e della scienza dei dati tradizionale. Fuori dal lavoro è un grande appassionato di windsurf e kitesurf.

Konrad Semsch è un Senior ML Solutions Architect presso il team Data Lab di Amazon Web Services. Aiuta i clienti a utilizzare l'apprendimento automatico per risolvere le loro sfide aziendali con AWS. Gli piace inventare e semplificare per offrire ai clienti soluzioni semplici e pragmatiche per i loro progetti AI/ML. È particolarmente appassionato di MlOps e della scienza dei dati tradizionale. Fuori dal lavoro è un grande appassionato di windsurf e kitesurf.

Tonno Ersoy è un Senior Solutions Architect presso AWS. Il suo obiettivo principale è aiutare i clienti del settore pubblico ad adottare le tecnologie cloud per i loro carichi di lavoro. Ha esperienza nello sviluppo di applicazioni, nell'architettura aziendale e nelle tecnologie dei contact center. I suoi interessi includono architetture serverless e AI/ML.

Tonno Ersoy è un Senior Solutions Architect presso AWS. Il suo obiettivo principale è aiutare i clienti del settore pubblico ad adottare le tecnologie cloud per i loro carichi di lavoro. Ha esperienza nello sviluppo di applicazioni, nell'architettura aziendale e nelle tecnologie dei contact center. I suoi interessi includono architetture serverless e AI/ML.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :ha

- :È

- :non

- :Dove

- $ SU

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- capace

- Chi siamo

- accesso

- Secondo

- Il mio account

- Raggiungere

- raggiunto

- operanti in

- attivamente

- aggiuntivo

- Inoltre

- adottare

- Dopo shavasana, sedersi in silenzio; saluti;

- AI / ML

- puntare

- algoritmo

- Algoritmi

- Tutti

- Consentire

- consente

- già

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- .

- analizzare

- l'analisi

- ed

- Un altro

- in qualsiasi

- Applicazioni

- Sviluppo di applicazioni

- applicato

- si applica

- APPLICA

- approvato

- architettura

- SONO

- argomento

- argomenti

- AS

- assumere

- At

- allegare

- auto

- automatizzare

- Automatico

- automaticamente

- AutoML

- disponibile

- AWS

- sfondo

- base

- basato

- Linea di base

- bayesiano

- BE

- perché

- prima

- Inizio

- sotto

- MIGLIORE

- Meglio

- fra

- Big

- Bloccare

- Blocchi

- entrambi

- rami

- costruire

- Costruzione

- affari

- ma

- pulsante

- by

- California

- chiamata

- detto

- Materiale

- candidato

- Custodie

- casi

- centro

- Catene

- sfide

- il cambiamento

- Modifiche

- oneri

- Controlli

- Scegli

- classe

- CLF

- cliente

- Cloud

- Cluster

- il clustering

- codice

- Colonna

- colonne

- combinazione

- combinazioni

- combinato

- combina

- viene

- commento

- Uncommon

- completamento di una

- Completato

- completando

- complicato

- concludere

- conclusione

- Segui il codice di Condotta

- Configurazione

- consecutivo

- consolle

- contatti

- centralino

- contiene

- contrasto

- di controllo

- Costo

- Costi

- potuto

- creare

- creato

- Creazione

- criteri

- cruciale

- Attualmente

- costume

- Clienti

- dati

- scienza dei dati

- dataset

- trattare

- decide

- Approfondire

- Predefinito

- definito

- definisce

- definizione

- definizioni

- dimostrare

- dimostra

- dipendere

- dipendenze

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- derivare

- Nonostante

- dettaglio

- dettagliati

- dettagli

- sviluppare

- sviluppato

- Mercato

- sviluppa

- deviazione

- DITT

- diverso

- directory

- discutere

- discusso

- do

- non

- dominio

- Dont

- giù

- disegnare

- asciugare

- durata

- durante

- dinamicamente

- ogni

- Presto

- efficiente

- elimina

- enable

- endpoint

- Ingegneria

- garantire

- assicura

- Impresa

- Intero

- interamente

- pari

- errore

- valutare

- valutato

- alla fine

- Ogni

- esaminare

- esempio

- Esempi

- esecuzione

- esistere

- attenderti

- previsto

- esperimento

- ha spiegato

- Esplorazione

- esplora

- falso

- famiglie

- famiglia

- fan

- caratteristica

- Caratteristiche

- pochi

- campo

- Compila il

- pieno

- Trovare

- ricerca

- Nome

- in forma

- cinque

- Focus

- seguire

- i seguenti

- segue

- Nel

- foresta

- modulo

- formato

- TELAIO

- da

- anteriore

- pieno

- function

- funzionalità

- funzioni

- ulteriormente

- Generale

- generare

- generato

- la generazione di

- ottenere

- Idiota

- GitHub

- dato

- Go

- scopo

- andando

- grafico

- cura

- Maniglie

- Avere

- avendo

- he

- pesante

- sollevamento pesante

- aiutare

- aiuta

- suo

- alto livello

- superiore

- massimo

- speranza

- ora

- Casa

- famiglie

- alloggiamento

- Come

- Tutorial

- HTML

- http

- HTTPS

- Ottimizzazione dell'iperparametro

- Sintonia iperparametro

- Identità

- if

- realizzare

- implementazione

- importare

- importazioni

- competenze

- miglioramento

- in

- includere

- Compreso

- Aumento

- indicare

- individuale

- Individualmente

- informazioni

- ingresso

- Ingressi

- Inserti

- intuizioni

- esempio

- invece

- istruzioni

- integrazione

- apposta

- interessi

- Interfaccia

- ai miglioramenti

- introdotto

- IT

- SUO

- stessa

- Lavoro

- Offerte di lavoro

- jpg

- ad appena

- solo uno

- mantenere

- Le

- conoscenze

- laboratorio

- grandi

- superiore, se assunto singolarmente.

- dopo

- lanciato

- lancio

- apprendimento

- a sinistra

- Lunghezza

- Livello

- livelli

- ciclo di vita

- di sollevamento

- piace

- probabile

- limitativo

- linux

- caricare

- a livello locale

- collocato

- località

- logica

- logico

- Lunghi

- più a lungo

- Guarda

- lotto

- minore

- macchina

- machine learning

- molti

- massimo

- Maggio..

- significare

- si intende

- Unire

- di cartone

- Metrica

- forza

- Minuti

- mancante

- ML

- MLOp

- modello

- modelli

- modificare

- Monitorare

- monitor

- Scopri di più

- maggior parte

- multiplo

- Nome

- stretto

- naviga

- Bisogno

- New

- recentemente

- GENERAZIONE

- no

- Nessuna

- taccuino

- noto

- adesso

- numero

- numpy

- oggetto

- obiettivo

- oggetti

- of

- MENO

- Offerte

- on

- una volta

- ONE

- esclusivamente

- aprire

- Operazioni

- ottimale

- ottimizzazione

- OTTIMIZZA

- ottimizzati

- or

- minimo

- OS

- Altro

- Altri

- su

- produzione

- al di fuori

- ancora

- complessivo

- pagina

- panda

- Parallel

- parametri

- parte

- particolare

- Di passaggio

- appassionato

- sentiero

- Paga le

- Eseguire

- performance

- esecuzione

- persiste

- pezzi

- conduttura

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- spina

- punto

- punti

- politica

- popolazione

- possibile

- Post

- potenziale

- pragmatico

- predire

- Predictor

- Preparare

- prerequisiti

- regali

- prevenire

- in precedenza

- prezzi

- primario

- Stampa

- Problema

- processi

- produrre

- Produzione

- Programmazione

- Progressi

- progetto

- progetti

- promettente

- proprietà

- fornire

- fornisce

- fornitura

- la percezione

- scopo

- Python

- casuale

- veloce

- a raggiunto

- pronto

- ragione

- recentemente

- ricetta

- raccomandare

- record

- ridurre

- riduce

- riferimento

- riferimento

- per quanto riguarda

- regex

- regione

- rilasciato

- pertinente

- rimanente

- rimuovere

- ripetere

- deposito

- richiesta

- richiedere

- necessario

- Risorse

- quelli

- responsabile

- limitato

- colpevole

- Risultati

- ritorno

- destra

- Ruolo

- Correre

- running

- corre

- runtime

- sagemaker

- Sintonizzazione automatica del modello SageMaker

- salvato

- Scala

- scala

- Scienze

- scienziati

- scikit-impara

- portata

- Punto

- copione

- script

- Secondo

- secondo

- Sezione

- sezioni

- settore

- vedere

- sembra

- selezionato

- prodotti

- AUTO

- anziano

- separato

- servire

- serverless

- servizio

- Servizi

- Sessione

- set

- Set

- impostazioni

- flessibile.

- lei

- dovrebbero

- in mostra

- mostrato

- Spettacoli

- Un'espansione

- semplificando

- semplicemente

- frammento

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- specializzata

- specifico

- specificazione

- Specifiche tecniche

- specificato

- velocità

- dividere

- pila

- Standard

- inizia a

- Di partenza

- Stato dei servizi

- step

- Passi

- Fermare

- fermato

- sosta

- conservazione

- memorizzati

- memorizzare

- Strategia

- La struttura

- strutture

- Successivamente

- tale

- supportato

- tavolo

- su misura

- Fai

- Target

- team

- Consulenza

- tecniche

- Tecnologie

- terminal

- test

- Testing

- che

- I

- loro

- Li

- poi

- Là.

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- tre

- soglia

- Attraverso

- tempo

- a

- insieme

- top

- Totale

- verso

- tradizionale

- Treni

- Training

- trasformazioni

- prova

- studi clinici

- provato

- innescare

- innescato

- innescando

- cerca

- sintonia

- seconda

- Digitare

- Tipi di

- tipicamente

- ui

- per

- e una comprensione reciproca

- unico

- fino a quando

- non desiderato

- caricato

- Impiego

- uso

- caso d'uso

- utilizzato

- usa

- utilizzando

- CONVALIDARE

- APPREZZIAMO

- Valori

- variabile

- vario

- vario

- versione

- versioni

- Visualizza

- visualizzazione

- W

- aspettare

- walkthrough

- volere

- Prima

- Modo..

- we

- sito web

- servizi web

- WELL

- sono stati

- Che

- quando

- mentre

- se

- quale

- perché

- volere

- con

- entro

- senza

- Lavora

- flusso di lavoro

- flussi di lavoro

- lavoro

- sarebbe

- scrivere

- ancora

- Tu

- Trasferimento da aeroporto a Sharm

- te stesso

- zefiro