Generative AI (GenAI) e large language models (LLM), come quelli presto disponibili tramite Roccia Amazzonica ed Titano Amazzonico stanno trasformando il modo in cui gli sviluppatori e le imprese sono in grado di risolvere sfide tradizionalmente complesse legate all'elaborazione e alla comprensione del linguaggio naturale. Alcuni dei vantaggi offerti dagli LLM includono la capacità di creare esperienze di AI conversazionali più capaci e avvincenti per le applicazioni del servizio clienti e il miglioramento della produttività dei dipendenti attraverso risposte più intuitive e accurate.

Per questi casi d'uso, tuttavia, è fondamentale che le applicazioni GenAI che implementano le esperienze conversazionali soddisfino due criteri chiave: limitare le risposte ai dati aziendali, mitigando così le allucinazioni del modello (dichiarazioni errate) e filtrare le risposte in base all'accesso al contenuto dell'utente finale autorizzazioni.

Per limitare le risposte dell'applicazione GenAI ai soli dati aziendali, è necessario utilizzare una tecnica chiamata Retrieval Augmented Generation (RAG). Un'applicazione che utilizza l'approccio RAG recupera le informazioni più rilevanti per la richiesta dell'utente dalla knowledge base o dal contenuto aziendale, le raggruppa come contesto insieme alla richiesta dell'utente come prompt e quindi le invia al LLM per ottenere una risposta GenAI. Gli LLM hanno limitazioni sul numero massimo di parole per il prompt di input, pertanto la scelta dei passaggi giusti tra migliaia o milioni di documenti nell'azienda ha un impatto diretto sull'accuratezza dell'LLM.

Nella progettazione di un RAG efficace, il recupero dei contenuti è un passaggio fondamentale per garantire che l'LLM riceva il contesto più pertinente e conciso dai contenuti aziendali per generare risposte accurate. È qui che si basa l'elevata precisione, basata sull'apprendimento automatico (ML). ricerca intelligente in Amazon Kendra gioca un ruolo importante. Amazon Kendra è un servizio completamente gestito che fornisce funzionalità di ricerca semantica pronte all'uso per una classificazione all'avanguardia di documenti e passaggi. Puoi utilizzare la ricerca ad alta precisione in Amazon Kendra per reperire i contenuti e i documenti più pertinenti per massimizzare la qualità del tuo payload RAG, ottenendo risposte LLM migliori rispetto all'utilizzo di soluzioni di ricerca convenzionali o basate su parole chiave. Amazon Kendra offre modelli di ricerca di deep learning di facile utilizzo che sono pre-addestrati su 14 domini e non richiedono alcuna esperienza di ML, quindi non è necessario occuparsi di incorporamenti di parole, suddivisione in blocchi di documenti e altre complessità di livello inferiore tipicamente richieste per implementazioni RAG. Amazon Kendra viene inoltre fornito con connettori predefiniti per origini dati popolari come Servizio di archiviazione semplice Amazon (Amazon S3), SharePoint, Confluence e siti Web e supporta formati di documenti comuni come HTML, Word, PowerPoint, PDF, Excel e file di testo puro. Per filtrare le risposte in base solo ai documenti consentiti dalle autorizzazioni dell'utente finale, Amazon Kendra offre connettori con supporto dell'elenco di controllo di accesso (ACL). Amazon Kendra offre anche Gestione dell'identità e dell'accesso di AWS (IAM) e Centro di identità AWS IAM (successore di AWS Single Sign-On) per la sincronizzazione delle informazioni sui gruppi di utenti con provider di identità dei clienti come Okta e Azure AD.

In questo post, dimostriamo come implementare un flusso di lavoro RAG combinando le funzionalità di Amazon Kendra con LLM per creare applicazioni GenAI all'avanguardia che forniscono esperienze di conversazione sui tuoi contenuti aziendali. Dopo Roccia Amazzonica lanci, pubblicheremo un post di follow-up che mostra come implementare applicazioni GenAI simili utilizzando Amazon Bedrock, quindi rimanete sintonizzati.

Panoramica della soluzione

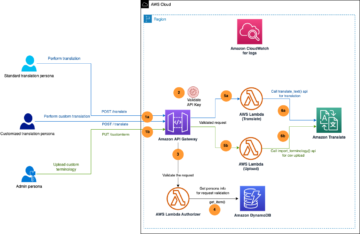

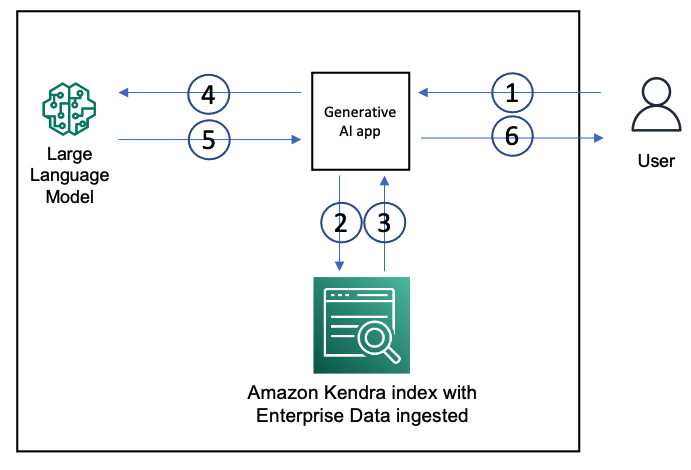

Il diagramma seguente mostra l'architettura di un'applicazione GenAI con un approccio RAG.

Utilizziamo un indice Amazon Kendra per importare dati aziendali non strutturati da origini dati come pagine wiki, siti MS SharePoint, Atlassian Confluence e repository di documenti come Amazon S3. Quando un utente interagisce con l'app GenAI, il flusso è il seguente:

- L'utente effettua una richiesta all'app GenAI.

- L'app invia una query di ricerca all'indice Amazon Kendra in base alla richiesta dell'utente.

- L'indice restituisce i risultati della ricerca con estratti di documenti pertinenti dai dati aziendali importati.

- L'app invia la richiesta dell'utente e insieme ai dati recuperati dall'indice come contesto nel prompt LLM.

- LLM restituisce una risposta succinta alla richiesta dell'utente in base ai dati recuperati.

- La risposta dell'LLM viene inviata all'utente.

Con questa architettura, puoi scegliere l'LLM più adatto al tuo caso d'uso. Le opzioni LLM includono i nostri partner Hugging Face, AI21 Labs, Cohere e altri ospitati su un Amazon Sage Maker endpoint, nonché modelli di aziende come Antropico ed OpenAI. Con Roccia Amazzonica, potrai scegliere Titano Amazzonico, LLM di Amazon o LLM di partner come quelli di AI21 Labs e Anthropic con API in modo sicuro senza la necessità che i tuoi dati lascino l'ecosistema AWS. I vantaggi aggiuntivi offerti da Amazon Bedrock includono un'architettura senza server, un'unica API per chiamare gli LLM supportati e un servizio gestito per semplificare il flusso di lavoro dello sviluppatore.

Per ottenere i migliori risultati, un'app GenAI deve progettare il prompt in base alla richiesta dell'utente e allo specifico LLM utilizzato. Le app AI conversazionali devono anche gestire la cronologia della chat e il contesto. Gli sviluppatori di app GenAI possono utilizzare framework open source come LangChain che forniscono moduli da integrare con l'LLM preferito e strumenti di orchestrazione per attività come la gestione della cronologia delle chat e il prompt engineering. Abbiamo fornito il KendraIndexRetriever class, che implementa a Il cane da riporto LangChain interface, che le applicazioni possono utilizzare insieme ad altre interfacce LangChain come Catene per recuperare dati da un indice Amazon Kendra. Abbiamo anche fornito alcune applicazioni di esempio in Repository GitHub. Puoi distribuire questa soluzione nel tuo account AWS utilizzando la guida dettagliata in questo post.

Prerequisiti

Per questo tutorial, avrai bisogno di un terminale bash con Python 3.9 o versioni successive installato su Linux, Mac o sottosistema Windows per Linux e un account AWS. Si consiglia inoltre di utilizzare un AWS Cloud9 istanza o an Cloud di calcolo elastico di Amazon (Amazon EC2).

Implementare un flusso di lavoro RAG

Per configurare il tuo flusso di lavoro RAG, completa i seguenti passaggi:

- Usa il fornito AWS CloudFormazione modello per creare un nuovo indice Amazon Kendra.

Questo modello include dati di esempio contenenti la documentazione online AWS per Amazon Kendra, Amazon-Lexe Amazon Sage Maker. In alternativa, se disponi di un indice Amazon Kendra e hai indicizzato il tuo set di dati, puoi utilizzarlo. L'avvio dello stack richiede circa 30 minuti seguiti da circa 15 minuti per la sincronizzazione e l'inserimento dei dati nell'indice. Pertanto, attendere circa 45 minuti dopo l'avvio dello stack. Prendi nota dell'ID indice e della regione AWS sullo stack Uscite scheda.

- Per una migliore esperienza GenAI, ti consigliamo di richiedere un Aumento della quota del servizio Amazon Kendra per il massimo

DocumentExcerptdimensione, in modo che Amazon Kendra fornisca estratti di documenti più grandi per migliorare il contesto semantico per il LLM. - installare il SDK AWS per Python sull'interfaccia della riga di comando di tua scelta.

- Se si desidera utilizzare le app Web di esempio create utilizzando Snello, prima devi installare Streamlit. Questo passaggio è facoltativo se si desidera eseguire solo le versioni della riga di comando delle applicazioni di esempio.

- Installa LangChain.

- Le applicazioni di esempio utilizzate in questo tutorial richiedono l'accesso a uno o più LLM da Flan-T5-XL, Flan-T5-XXL, Anthropic Claud-V1 e OpenAI-text-davinci-003.

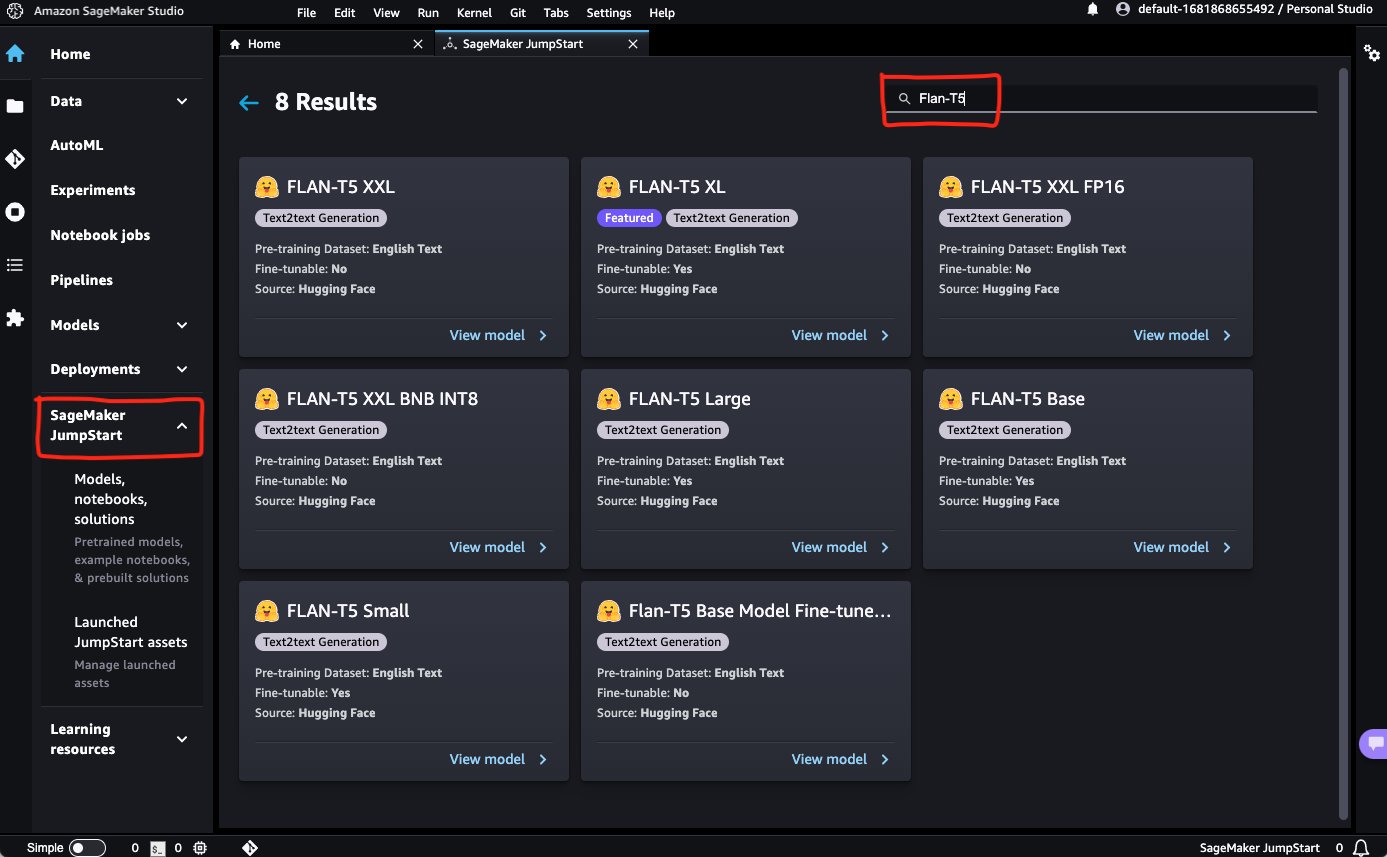

- Se desideri utilizzare Flan-T5-XL o Flan-T5-XXL, distribuiscili a un endpoint per l'inferenza utilizzando Avvia Amazon SageMaker Studio.

- Se vuoi lavorare con Anthropic Claud-V1 o OpenAI-da-vinci-003, acquisisci le chiavi API per i tuoi LLM di tuo interesse da https://www.anthropic.com/ ed https://openai.com/, Rispettivamente.

- Se desideri utilizzare Flan-T5-XL o Flan-T5-XXL, distribuiscili a un endpoint per l'inferenza utilizzando Avvia Amazon SageMaker Studio.

- Segui le istruzioni in Repository GitHub per installare il

KendraIndexRetrieverinterfaccia e applicazioni di esempio. - Prima di eseguire le applicazioni di esempio, devi impostare le variabili di ambiente con i dettagli dell'indice Amazon Kendra e le chiavi API del tuo LLM preferito o gli endpoint SageMaker delle tue distribuzioni per Flan-T5-XL o Flan-T5-XXL. Di seguito è riportato uno script di esempio per impostare le variabili di ambiente:

- In una finestra della riga di comando, passare a

samplessottodirectory di dove hai clonato il repository GitHub. Puoi eseguire le app della riga di comando dalla riga di comando comepython <sample-file-name.py>. È possibile eseguire l'app Web ottimizzata modificando la directory insamplese in esecuzionestreamlit run app.py <anthropic|flanxl|flanxxl|openai>. - Apri il file di esempio

kendra_retriever_flan_xxl.pyin un editor a tua scelta.

Osserva la dichiarazione result = run_chain(chain, "What's SageMaker?"). Questa è la query dell'utente ("Cos'è SageMaker?") che viene eseguita attraverso la catena che utilizza Flan-T-XXL come LLM e Amazon Kendra come retriever. Quando questo file viene eseguito, è possibile osservare l'output come segue. La catena ha inviato la query dell'utente all'indice Amazon Kendra, ha recuperato i primi tre estratti dei risultati e li ha inviati come contesto in un prompt insieme alla query, a cui l'LLM ha risposto con una risposta succinta. Ha anche fornito le fonti (gli URL dei documenti utilizzati per generare la risposta).

- Ora eseguiamo l'app Web

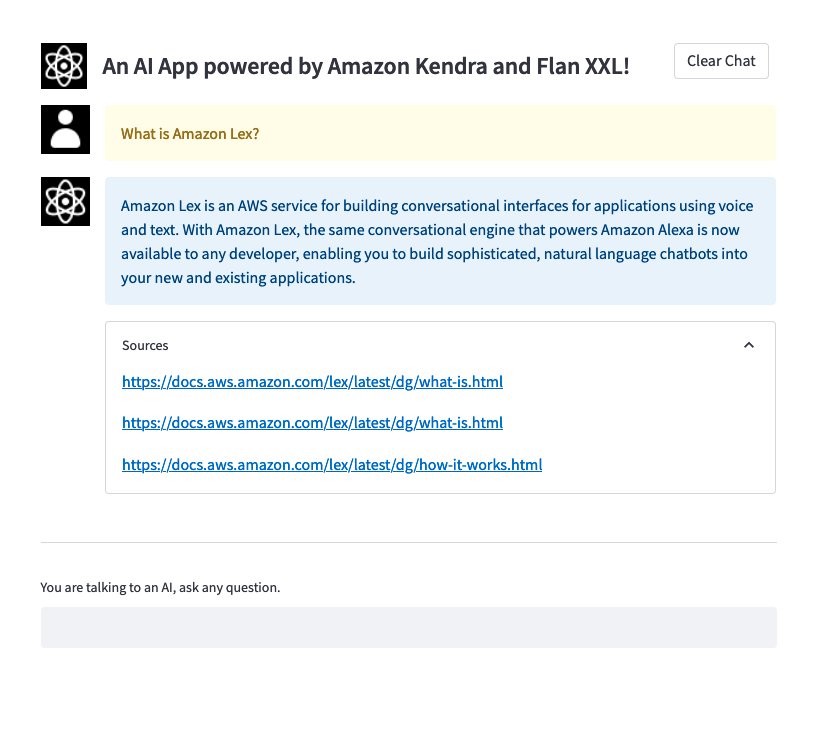

app.pyasstreamlit run app.py flanxxl. Per questa corsa specifica, stiamo usando un modello Flan-T-XXL come LLM.

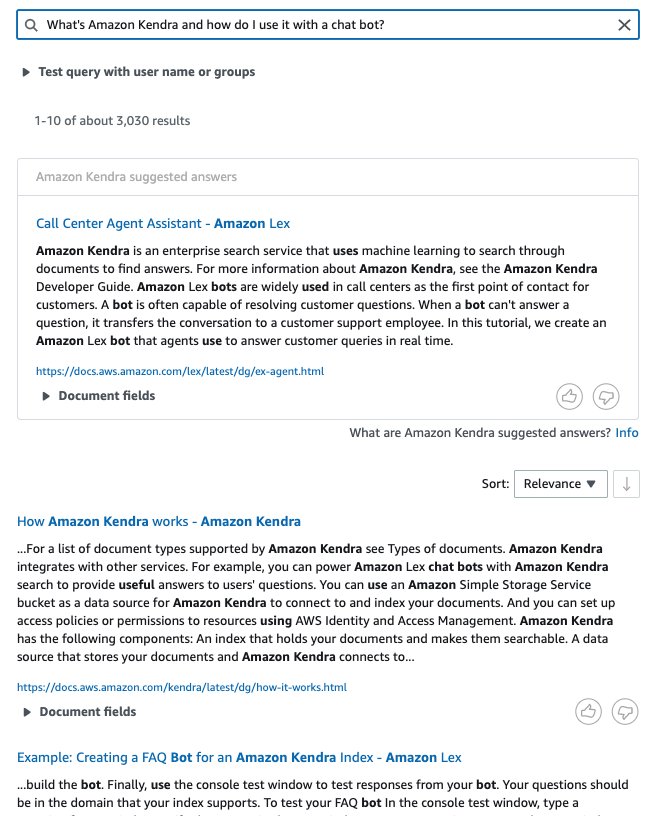

Apre una finestra del browser con l'interfaccia web. Puoi inserire una query, che in questo caso è "Cos'è Amazon Lex?" Come mostrato nello screenshot seguente, l'applicazione risponde con una risposta e il file fonti La sezione fornisce gli URL dei documenti da cui gli estratti sono stati recuperati dall'indice Amazon Kendra e inviati all'LLM nel prompt come contesto insieme alla query.

- Ora corriamo

app.pydi nuovo e fatti un'idea dell'esperienza di conversazione usandostreamlit run app.py anthropic. Qui l'LLM sottostante utilizzato è Anthropic Claud-V1.

Come puoi vedere nel video seguente, LLM fornisce una risposta dettagliata alla domanda dell'utente in base ai documenti recuperati dall'indice Amazon Kendra e quindi supporta la risposta con gli URL dei documenti di origine che sono stati utilizzati per generare la risposta. Si noti che le query successive non menzionano esplicitamente Amazon Kendra; comunque, il ConversationalRetrievalChain (un tipo di catena che fa parte del framework LangChain e fornisce un meccanismo semplice per sviluppare informazioni conversazionali basate su applicazioni recuperate da istanze retriever, utilizzate in questa applicazione LangChain), gestisce la cronologia della chat e il contesto per ottenere una risposta appropriata.

Si noti inoltre che nello screenshot seguente, Amazon Kendra trova la risposta estrattiva alla query e seleziona i documenti principali con estratti. Quindi il LLM è in grado di generare una risposta più succinta basata su questi estratti recuperati.

Nelle sezioni seguenti, esploriamo due casi d'uso per l'utilizzo dell'IA generativa con Amazon Kendra.

Caso d'uso 1: IA generativa per società di servizi finanziari

Le organizzazioni finanziarie creano e archiviano i dati in vari repository di dati, inclusi report finanziari, documenti legali e white paper. Devono rispettare rigide normative e controlli governativi, il che significa che i dipendenti devono trovare rapidamente informazioni pertinenti, accurate e affidabili. Inoltre, la ricerca e l'aggregazione di informazioni in varie fonti di dati è complicata e soggetta a errori. Con l'IA generativa su AWS, gli utenti possono generare rapidamente risposte da varie fonti e tipi di dati, sintetizzando risposte accurate su scala aziendale.

Abbiamo scelto una soluzione utilizzando Amazon Kendra e Jurassic-21 Jumbo Instruct LLM di AI2 Lab. Con Amazon Kendra, puoi importare facilmente dati da più origini dati come Amazon S3, siti Web e ServiceNow. Quindi Amazon Kendra utilizza Jurassic-21 Jumbo Instruct LLM di AI2 Lab per svolgere attività di inferenza sui dati aziendali come il riepilogo dei dati, la generazione di report e altro ancora. Amazon Kendra potenzia gli LLM per fornire informazioni accurate e verificabili agli utenti finali, riducendo i problemi di allucinazione con gli LLM. Con la soluzione proposta, gli analisti finanziari possono prendere decisioni più rapide utilizzando dati accurati per creare rapidamente portafogli dettagliati e completi. Abbiamo in programma di rendere disponibile questa soluzione come progetto open source nel prossimo futuro.

Esempio

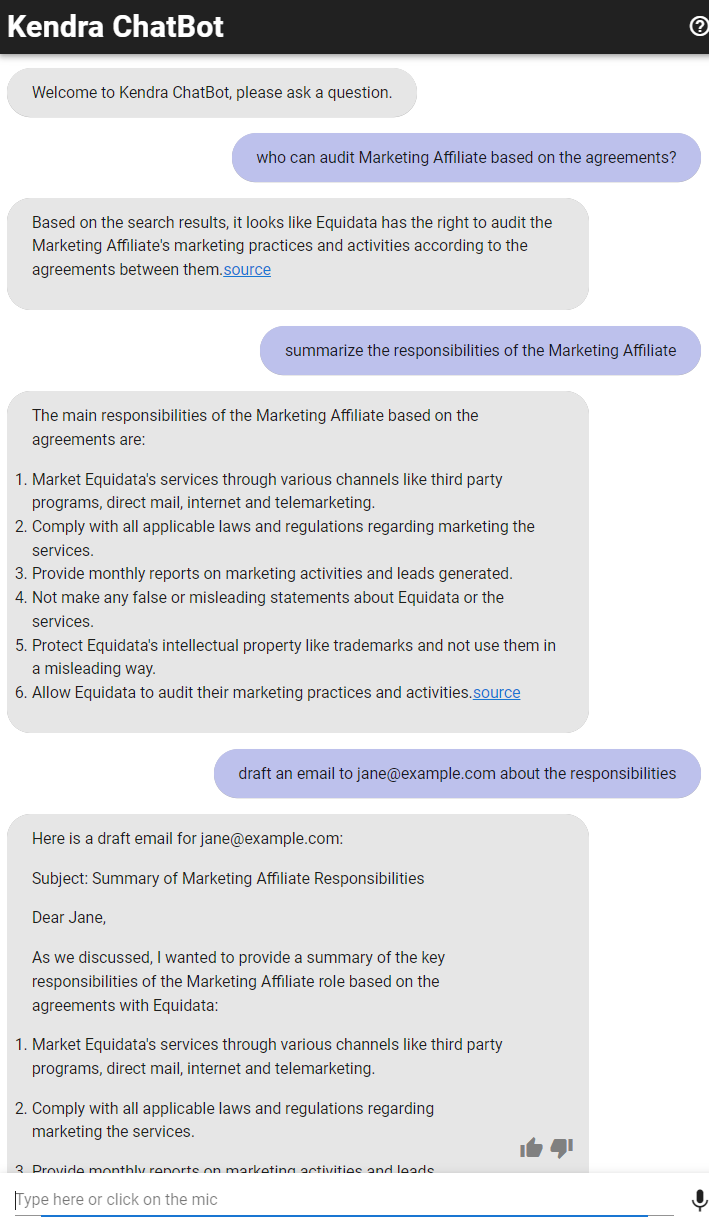

Utilizzando la soluzione Kendra Chatbot, gli analisti finanziari e i revisori possono interagire con i propri dati aziendali (rapporti finanziari e accordi) per trovare risposte affidabili alle domande relative all'audit. Kendra ChatBot fornisce risposte insieme a collegamenti di origine e ha la capacità di riassumere risposte più lunghe. Lo screenshot seguente mostra un esempio di conversazione con Kendra ChatBot.

Panoramica sull'architettura

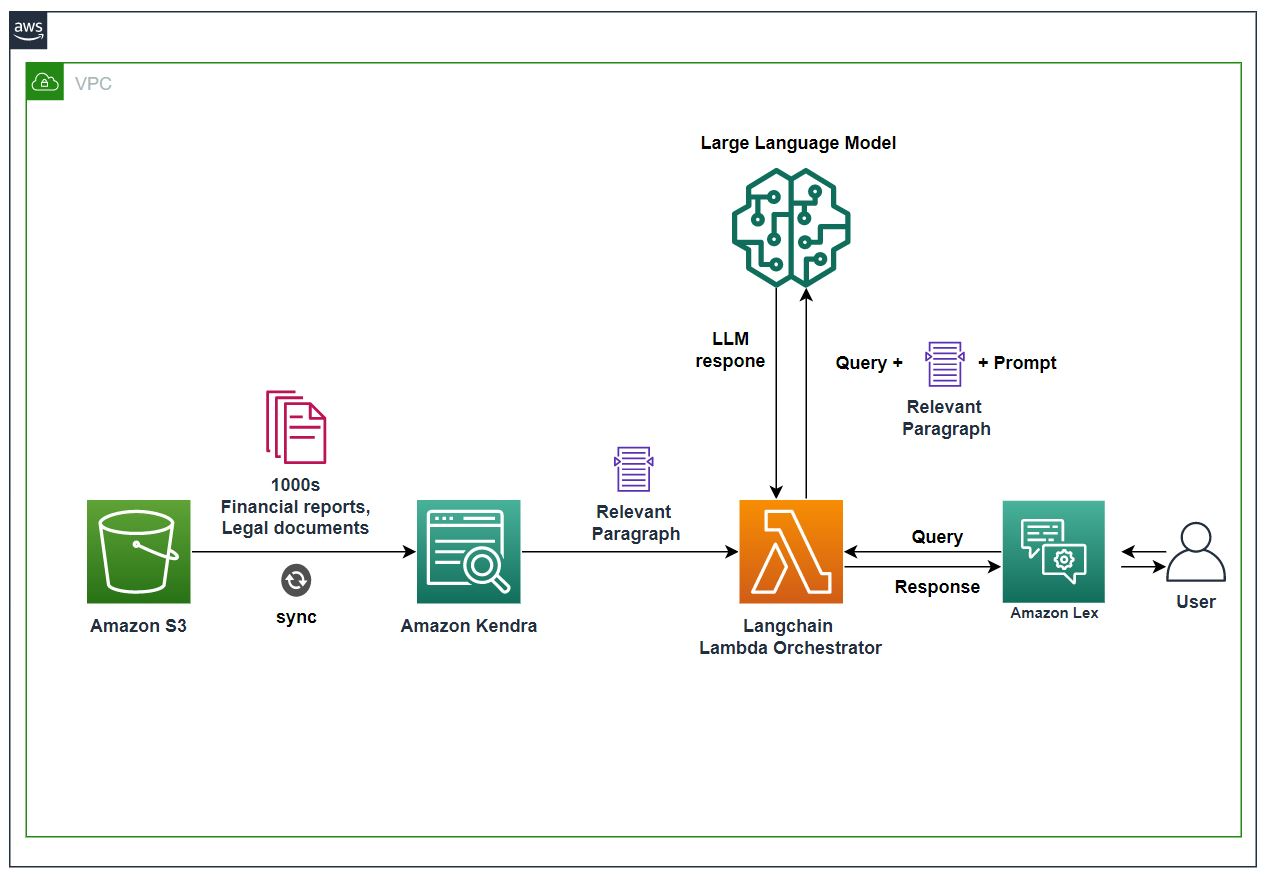

Il diagramma seguente illustra l'architettura della soluzione.

Il flusso di lavoro include i seguenti passaggi:

- I documenti e gli accordi finanziari vengono archiviati su Amazon S3 e acquisiti in un indice Amazon Kendra utilizzando il connettore dell'origine dati S3.

- LLM è ospitato su un endpoint SageMaker.

- Un chatbot di Amazon Lex viene utilizzato per interagire con l'utente tramite il Interfaccia utente Web di Amazon Lex.

- La soluzione usa un AWS Lambda funzione con LangChain per orchestrare tra Amazon Kendra, Amazon Lex e LLM.

- Quando gli utenti chiedono al chatbot di Amazon Lex risposte da un documento finanziario, Amazon Lex chiama l'orchestratore di LangChain per soddisfare la richiesta.

- In base alla query, l'orchestratore di LangChain estrae i record e i paragrafi finanziari pertinenti da Amazon Kendra.

- L'orchestratore di LangChain fornisce questi record pertinenti all'LLM insieme alla query e alla richiesta pertinente per svolgere l'attività richiesta.

- L'LLM elabora la richiesta dell'orchestratore LangChain e restituisce il risultato.

- L'orchestratore di LangChain ottiene il risultato dal LLM e lo invia all'utente finale tramite il chatbot di Amazon Lex.

Caso d'uso 2: IA generativa per ricercatori e clinici nel settore sanitario

Clinici e ricercatori spesso analizzano migliaia di articoli di riviste mediche o siti web sanitari governativi come parte della loro ricerca. Ancora più importante, vogliono fonti di dati affidabili che possono utilizzare per convalidare e comprovare le loro scoperte. Il processo richiede ore di intensa ricerca, analisi e sintesi dei dati, allungando i tempi per il valore e l'innovazione. Con l'IA generativa su AWS, puoi connetterti a fonti di dati affidabili ed eseguire query in linguaggio naturale per generare insight su queste fonti di dati affidabili in pochi secondi. Puoi anche esaminare le fonti utilizzate per generare la risposta e convalidarne l'accuratezza.

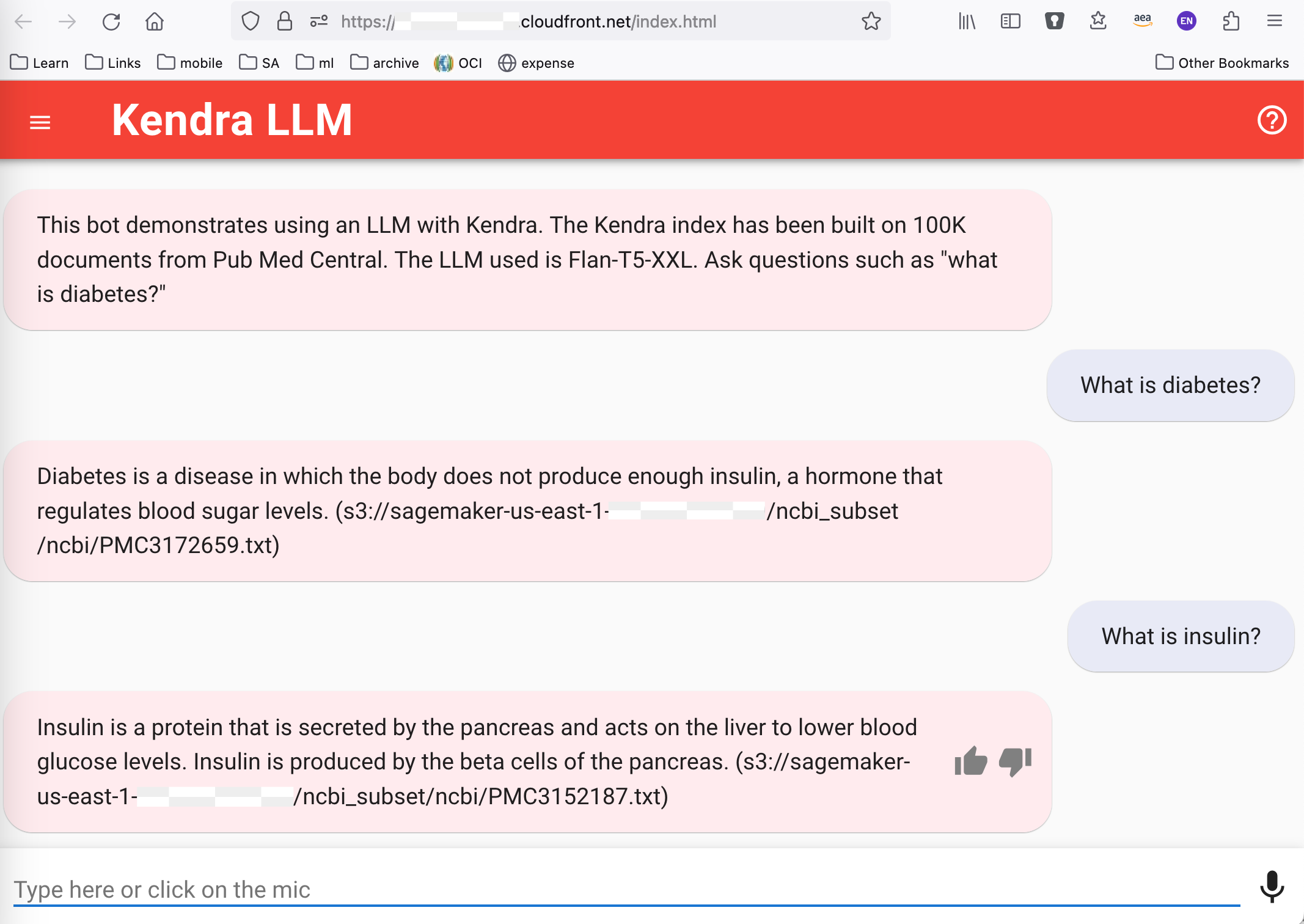

Abbiamo scelto una soluzione utilizzando Amazon Kendra e Flan-T5-XXL di Hugging Face. Innanzitutto, utilizziamo Amazon Kendra per identificare frammenti di testo da documenti semanticamente rilevanti nell'intero corpus. Quindi utilizziamo la potenza di un LLM come Flan-T5-XXL per utilizzare i frammenti di testo di Amazon Kendra come contesto e ottenere una risposta concisa in linguaggio naturale. In questo approccio, l'indice Amazon Kendra funge da componente di recupero del passaggio nel meccanismo RAG. Infine, utilizziamo Amazon Lex per potenziare il front-end, fornendo un'esperienza fluida e reattiva agli utenti finali. Prevediamo di rendere disponibile questa soluzione come progetto open source nel prossimo futuro.

Esempio

Lo screenshot seguente proviene da un'interfaccia utente Web creata per la soluzione utilizzando il modello disponibile su GitHub. Il testo in rosa sono le risposte dal sistema Amazon Kendra LLM e il testo in blu sono le domande degli utenti.

Panoramica sull'architettura

L'architettura e il flusso di lavoro della soluzione per questa soluzione sono simili a quelli del caso d'uso 1.

ripulire

Per risparmiare sui costi, elimina tutte le risorse che hai distribuito come parte del tutorial. Se hai avviato lo stack CloudFormation, puoi eliminarlo tramite la console AWS CloudFormation. Allo stesso modo, puoi eliminare qualsiasi endpoint SageMaker che potresti aver creato tramite la console SageMaker.

Conclusione

L'intelligenza artificiale generativa alimentata da modelli linguistici di grandi dimensioni sta cambiando il modo in cui le persone acquisiscono e applicano gli insight dalle informazioni. Tuttavia, per i casi d'uso aziendali, gli insight devono essere generati in base ai contenuti aziendali per mantenere le risposte all'interno del dominio e mitigare le allucinazioni, utilizzando l'approccio Retrieval Augmented Generation. Nell'approccio RAG, la qualità degli insight generati dal LLM dipende dalla rilevanza semantica delle informazioni recuperate su cui si basa, rendendo sempre più necessario l'utilizzo di soluzioni come Amazon Kendra che forniscono risultati di ricerca semantica ad alta precisione su la scatola. Con il suo ecosistema completo di connettori di origine dati, supporto per formati di file comuni e sicurezza, puoi iniziare rapidamente a utilizzare le soluzioni di intelligenza artificiale generativa per casi d'uso aziendali con Amazon Kendra come meccanismo di recupero.

Per ulteriori informazioni sull'utilizzo dell'IA generativa su AWS, fare riferimento a Annuncio di nuovi strumenti per creare con l'IA generativa su AWS. Puoi iniziare a sperimentare e creare RAG proof of concept (POC) per le tue app GenAI aziendali, utilizzando il metodo descritto in questo blog. Come accennato in precedenza, una volta Roccia Amazzonica è disponibile, pubblicheremo un blog di follow-up che mostra come è possibile creare RAG utilizzando Amazon Bedrock.

Circa gli autori

Abhinav Jawadekar è un Principal Solutions Architect focalizzato su Amazon Kendra nel team di servizi linguistici AI/ML di AWS. Abhinav collabora con clienti e partner AWS per aiutarli a creare soluzioni di ricerca intelligenti su AWS.

Abhinav Jawadekar è un Principal Solutions Architect focalizzato su Amazon Kendra nel team di servizi linguistici AI/ML di AWS. Abhinav collabora con clienti e partner AWS per aiutarli a creare soluzioni di ricerca intelligenti su AWS.

Jean Pierre Dodel è il Principal Product Manager per Amazon Kendra e guida le principali capacità strategiche del prodotto e l'assegnazione delle priorità alla roadmap. Porta al team una vasta esperienza di Enterprise Search e ML/AI, con precedenti ruoli di leadership presso Autonomy, HP e start-up di ricerca prima di entrare in Amazon 7 anni fa.

Jean Pierre Dodel è il Principal Product Manager per Amazon Kendra e guida le principali capacità strategiche del prodotto e l'assegnazione delle priorità alla roadmap. Porta al team una vasta esperienza di Enterprise Search e ML/AI, con precedenti ruoli di leadership presso Autonomy, HP e start-up di ricerca prima di entrare in Amazon 7 anni fa.

Mithil Shah è uno specialista ML/AI presso AWS. Attualmente aiuta i clienti del settore pubblico a migliorare la vita dei cittadini costruendo soluzioni di Machine Learning su AWS.

Mithil Shah è uno specialista ML/AI presso AWS. Attualmente aiuta i clienti del settore pubblico a migliorare la vita dei cittadini costruendo soluzioni di Machine Learning su AWS.

Firaz Akmal è Sr. Product Manager per Amazon Kendra presso AWS. È un sostenitore dei clienti e aiuta i clienti a comprendere i loro casi d'uso di ricerca e intelligenza artificiale generativa con Kendra su AWS. Al di fuori del lavoro, Firaz ama passare il tempo tra le montagne del PNW o vivere il mondo attraverso la prospettiva di sua figlia.

Firaz Akmal è Sr. Product Manager per Amazon Kendra presso AWS. È un sostenitore dei clienti e aiuta i clienti a comprendere i loro casi d'uso di ricerca e intelligenza artificiale generativa con Kendra su AWS. Al di fuori del lavoro, Firaz ama passare il tempo tra le montagne del PNW o vivere il mondo attraverso la prospettiva di sua figlia.

Abhishek Maligehalli Shivalingaiah è Senior AI Services Solution Architect presso AWS con focus su Amazon Kendra. È appassionato di creare applicazioni utilizzando Amazon Kendra, Generative AI e NLP. Ha circa 10 anni di esperienza nella creazione di soluzioni Data & AI per creare valore per clienti e aziende. Ha creato un chatbot (personale) per divertimento per rispondere a domande sulla sua carriera e sul suo percorso professionale. Al di fuori del lavoro si diverte a fare ritratti di familiari e amici e ama creare opere d'arte.

Abhishek Maligehalli Shivalingaiah è Senior AI Services Solution Architect presso AWS con focus su Amazon Kendra. È appassionato di creare applicazioni utilizzando Amazon Kendra, Generative AI e NLP. Ha circa 10 anni di esperienza nella creazione di soluzioni Data & AI per creare valore per clienti e aziende. Ha creato un chatbot (personale) per divertimento per rispondere a domande sulla sua carriera e sul suo percorso professionale. Al di fuori del lavoro si diverte a fare ritratti di familiari e amici e ama creare opere d'arte.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/quickly-build-high-accuracy-generative-ai-applications-on-enterprise-data-using-amazon-kendra-langchain-and-large-language-models/

- :ha

- :È

- :Dove

- $ SU

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 30

- 7

- 9

- a

- capacità

- capace

- Chi siamo

- accesso

- Secondo

- Il mio account

- precisione

- preciso

- acquisire

- operanti in

- attività

- attività

- Ad

- aggiuntivo

- Inoltre

- aderire

- avvocato

- Dopo shavasana, sedersi in silenzio; saluti;

- ancora

- aggregando

- fa

- accordi

- AI

- Servizi di intelligenza artificiale

- AI / ML

- Tutti

- consentire

- lungo

- anche

- Amazon

- Amazon EC2

- Amazon Kendra

- Amazon-Lex

- tra

- an

- .

- Gli analisti

- analizzare

- ed

- rispondere

- risposte

- in qualsiasi

- api

- CHIAVI API

- API

- App

- Applicazioni

- applicazioni

- APPLICA

- approccio

- opportuno

- applicazioni

- architettura

- SONO

- in giro

- news

- opere d'arte

- AS

- At

- revisori dei conti

- aumentata

- disponibile

- AWS

- AWS CloudFormazione

- azzurro

- precedente

- base

- basato

- bash

- BE

- essendo

- vantaggi

- MIGLIORE

- Meglio

- fra

- Blog

- Blu

- Scatola

- Porta

- del browser

- costruire

- Costruzione

- costruito

- pachetti sconto

- by

- chiamata

- detto

- Bandi

- Materiale

- funzionalità

- capace

- Career

- trasportare

- Custodie

- casi

- catena

- sfide

- il cambiamento

- cambiando

- chatbot

- scegliere

- Scegli

- la scelta

- ha scelto

- cittadini

- classe

- combinando

- viene

- Uncommon

- Aziende

- azienda

- avvincente

- completamento di una

- complesso

- complessità

- componente

- globale

- Calcolare

- concetto

- Connettiti

- consolle

- contenuto

- contesto

- di controllo

- convenzionale

- Conversazione

- discorsivo

- AI conversazionale

- Costi

- creare

- creato

- Creazione

- criteri

- critico

- Attualmente

- cliente

- Servizio clienti

- Clienti

- dati

- affare

- decisioni

- deep

- apprendimento profondo

- dimostrare

- dipende

- schierare

- schierato

- implementazioni

- progettazione

- dettagliati

- dettagli

- sviluppare

- Costruttori

- sviluppatori

- dirette

- documento

- documentazione

- documenti

- domini

- Dont

- In precedenza

- facilmente

- facile

- facile da usare

- ecosistema

- editore

- Efficace

- Dipendente

- dipendenti

- fine

- endpoint

- ingegnere

- Ingegneria

- garantire

- entrare

- Impresa

- aziende

- Intero

- Ambiente

- errore

- esempio

- Excel

- esperienza

- Esperienze

- sperimentare

- competenza

- esplora

- export

- estensivo

- Faccia

- famiglia

- più veloce

- sentire

- pochi

- Compila il

- File

- filtro

- finanziario

- servizio finanziario

- Trovare

- trova

- Nome

- flusso

- Focus

- concentrato

- seguire

- seguito

- i seguenti

- segue

- Nel

- Contesto

- quadri

- amici

- da

- anteriore

- Fine frontale

- Adempiere

- completamente

- ti divertirai

- function

- funzioni

- futuro

- generare

- generato

- la generazione di

- ELETTRICA

- generativo

- AI generativa

- ottenere

- GitHub

- Enti Pubblici

- guida

- Avere

- he

- Salute e benessere

- assistenza sanitaria

- Aiuto

- aiutare

- aiuta

- qui

- superiore

- vivamente

- il suo

- storia

- ospitato

- ORE

- Come

- Tutorial

- Tuttavia

- HTML

- http

- HTTPS

- ID

- identificare

- Identità

- if

- illustra

- Impact

- realizzare

- Implementazione

- attrezzi

- importante

- competenze

- migliorata

- miglioramento

- in

- includere

- inclusi

- Compreso

- sempre più

- Index

- informazioni

- Innovazione

- ingresso

- intuizioni

- install

- installato

- esempio

- istruzioni

- integrare

- integrazione

- Intelligente

- interagire

- interagisce

- interesse

- Interfaccia

- interfacce

- intuitivo

- sicurezza

- IT

- SUO

- accoppiamento

- viaggio

- jpg

- mantenere

- Le

- Tasti

- conoscenze

- Labs

- Lingua

- grandi

- superiore, se assunto singolarmente.

- lanciato

- lancia

- lancio

- principale

- Leads

- apprendimento

- Lasciare

- Legale

- piace

- LIMITE

- limiti

- linea

- Collegamento

- linux

- Lista

- Lives

- LLM

- più a lungo

- Mac

- macchina

- machine learning

- make

- FA

- Fare

- gestire

- gestito

- gestione

- direttore

- gestisce

- Massimizzare

- massimo

- Maggio..

- si intende

- meccanismo

- medicale

- Soddisfare

- menzionato

- metodo

- milioni

- Minuti

- Ridurre la perdita dienergia con una

- attenuante

- ML

- modello

- modelli

- moduli

- Scopri di più

- maggior parte

- MS

- multiplo

- devono obbligatoriamente:

- Naturale

- Elaborazione del linguaggio naturale

- Vicino

- necessaria

- Bisogno

- esigenze

- New

- nlp

- no

- osservare

- ottenere

- of

- offrire

- offerto

- Offerte

- di frequente

- OTTA

- on

- una volta

- ONE

- online

- esclusivamente

- open source

- apre

- Opzioni

- or

- orchestrazione

- organizzazioni

- Altro

- Altri

- nostro

- su

- delineato

- produzione

- al di fuori

- ancora

- svista

- proprio

- parte

- partner

- partner

- appassionato

- Persone

- permessi

- cronologia

- prospettiva

- piano

- Platone

- Platone Data Intelligence

- PlatoneDati

- gioca

- Popolare

- portafogli

- Post

- energia

- alimentato

- preferito

- Direttore

- Precedente

- prioritizzazione

- processi

- i processi

- lavorazione

- Prodotto

- product manager

- della produttività

- professionale

- progetto

- prove

- proposto

- fornire

- purché

- fornitori

- fornisce

- fornitura

- la percezione

- pubblicare

- Maglioni

- Python

- qualità

- query

- Domande

- rapidamente

- Posizione

- riceve

- raccomandare

- record

- riduce

- regione

- normativa

- relazionato

- rilevanza

- pertinente

- affidabile

- rapporto

- Report

- deposito

- richiesta

- richiedere

- necessario

- richiede

- riparazioni

- ricercatori

- Risorse

- rispettivamente

- risposta

- risposte

- di risposta

- limitare

- colpevole

- Risultati

- problemi

- recensioni

- tabella di marcia

- Ruolo

- ruoli

- Correre

- running

- s

- sagemaker

- Risparmi

- Scala

- sdk

- senza soluzione di continuità

- Cerca

- ricerca

- secondo

- sezioni

- settore

- in modo sicuro

- problemi di

- vedere

- visto

- invia

- anziano

- serverless

- servizio

- Servizi

- set

- Spettacoli

- simile

- Allo stesso modo

- Un'espansione

- singolo

- Siti

- Taglia

- So

- soluzione

- Soluzioni

- RISOLVERE

- alcuni

- Fonte

- fonti

- specialista

- specifico

- Spendere

- pila

- inizia a

- Startup

- state-of-the-art

- dichiarazione

- dichiarazioni

- soggiorno

- step

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- Strategico

- snellire

- Strict

- studio

- successivo

- tale

- adatto

- riassumere

- supporto

- supportato

- supporti

- sistema

- team

- modello

- terminal

- di

- che

- I

- L’ORIGINE

- il mondo

- loro

- Li

- poi

- in tal modo

- perciò

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- quelli

- migliaia

- tre

- Attraverso

- tempo

- a

- strumenti

- top

- tradizionalmente

- trasformazione

- di fiducia

- affidabili sul mercato

- lezione

- seconda

- Digitare

- Tipi di

- tipicamente

- ui

- sottostante

- capire

- e una comprensione reciproca

- uso

- caso d'uso

- casi d'uso

- utilizzato

- Utente

- utenti

- utilizzando

- CONVALIDARE

- APPREZZIAMO

- vario

- verificabile

- via

- Video

- aspettare

- volere

- Modo..

- we

- sito web

- siti web

- WELL

- sono stati

- Che

- quando

- quale

- Fogli bianchi

- volere

- finestre

- con

- senza

- Word

- Lavora

- lavoro

- lavori

- mondo

- YAML

- anni

- cedevole

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro