Amazon Sage Maker offre un'ampia selezione di infrastrutture di machine learning (ML) e opzioni di distribuzione del modello per soddisfare le tue esigenze di inferenza ML. È un servizio completamente gestito e si integra con gli strumenti MLOps in modo da poter lavorare per ridimensionare la distribuzione del modello, ridurre i costi di inferenza, gestire i modelli in modo più efficace nella produzione e ridurre il carico operativo. SageMaker fornisce più opzioni di inferenza così puoi scegliere l'opzione che meglio si adatta al tuo carico di lavoro.

Le nuove generazioni di CPU offrono un significativo miglioramento delle prestazioni nell'inferenza ML grazie a istruzioni incorporate specializzate. In questo post, ci concentriamo su come puoi sfruttare il AWS Gravitone3basato su Amazon Elastic Compute Cloud (EC2) istanze C7g per aiutare a ridurre i costi di inferenza fino al 50% rispetto a istanze EC2 comparabili per inferenza in tempo reale su Amazon SageMaker. Mostriamo come puoi valutare le prestazioni dell'inferenza e passare i tuoi carichi di lavoro ML alle istanze AWS Graviton in pochi passaggi.

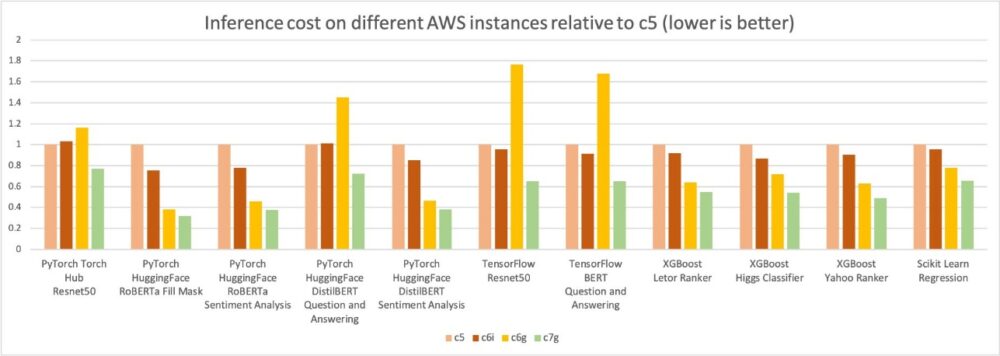

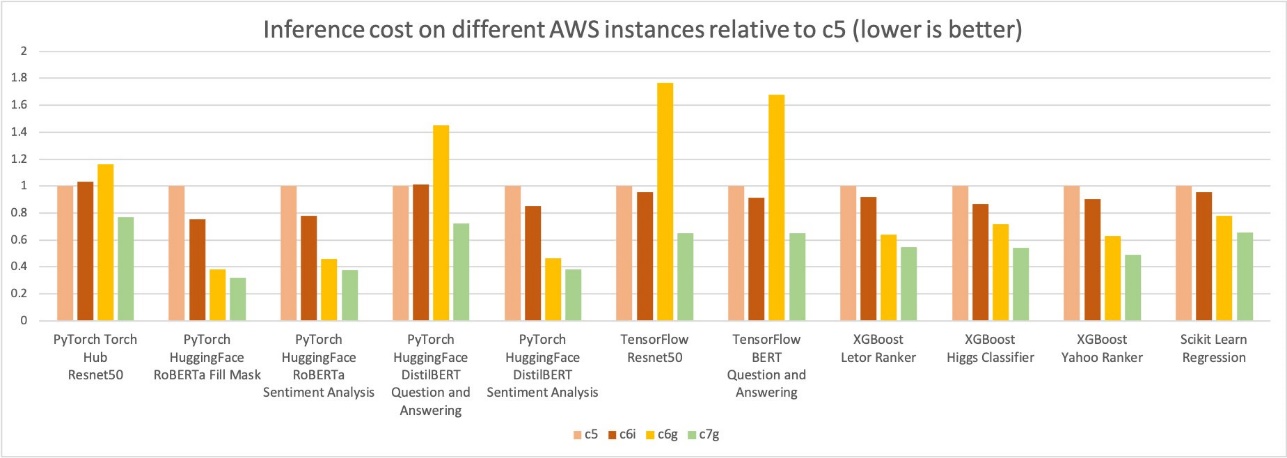

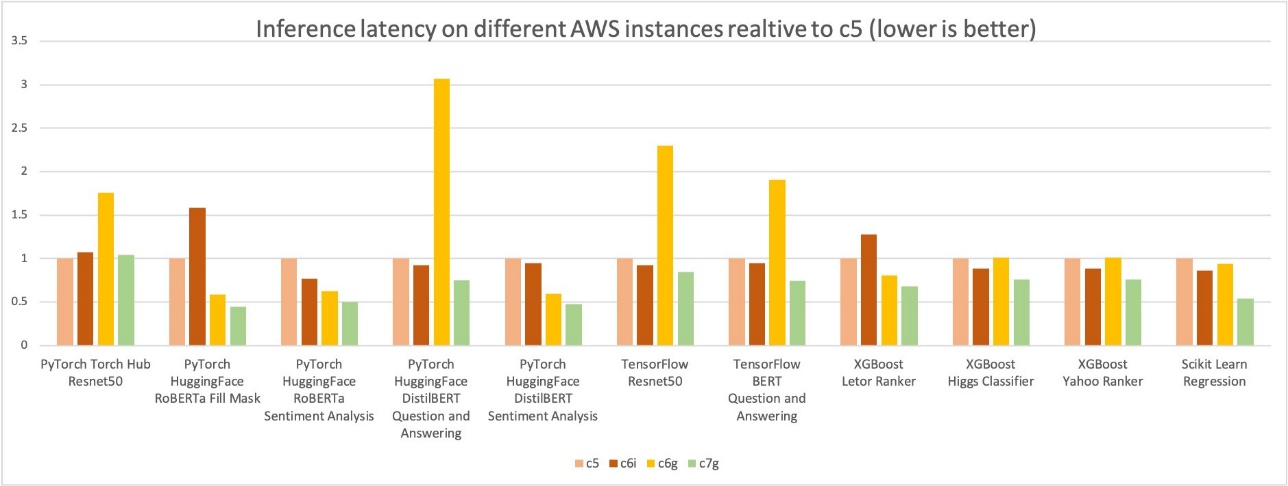

Per coprire la vasta e popolare gamma di applicazioni dei clienti, in questo post discutiamo le prestazioni di inferenza di PyTorch, TensorFlow, XGBoost e i framework scikit-learn. Copriamo scenari di visione artificiale (CV), elaborazione del linguaggio naturale (NLP), classificazione e classificazione per modelli e istanze ml.c6g, ml.c7g, ml.c5 e ml.c6i SageMaker per il benchmarking.

Risultati comparativi

AWS ha misurato fino al 50% di risparmio sui costi per PyTorch, TensorFlow, XGBoost e l'inferenza del modello scikit-learn con istanze EC3 C2g basate su AWS Graviton7 rispetto a istanze EC2 comparabili su Amazon SageMaker. Allo stesso tempo, viene ridotta anche la latenza dell'inferenza.

Per confronto, abbiamo utilizzato quattro diversi tipi di istanza:

Tutte e quattro le istanze hanno 16 vCPU e 32 GiB di memoria.

Nel grafico seguente, abbiamo misurato l'inferenza del costo per milione per i quattro tipi di istanza. Abbiamo ulteriormente normalizzato i risultati dell'inferenza del costo per milione a un'istanza c5.4xlarge, misurata come 1 sull'asse Y del grafico. Puoi vedere che per i modelli XGBoost, l'inferenza del costo per milione per c7g.4xlarge (AWS Graviton3) è circa il 50% di c5.4xlarge e il 40% di c6i.4xlarge; per i modelli PyTorch NLP, il risparmio sui costi è di circa il 30-50% rispetto alle istanze c5 e c6i.4xlarge. Per altri modelli e framework, abbiamo misurato almeno il 30% di risparmio sui costi rispetto alle istanze c5 e c6i.4xlarge.

Analogamente al precedente grafico di confronto dei costi di inferenza, il grafico seguente mostra la latenza p90 del modello per gli stessi quattro tipi di istanza. Abbiamo ulteriormente normalizzato i risultati della latenza all'istanza c5.4xlarge, che viene misurata come 1 nell'asse Y del grafico. La latenza di inferenza del modello c7g.4xlarge (AWS Graviton3) è fino al 50% migliore rispetto alle latenze misurate su c5.4xlarge e c6i.4xlarge.

Migra alle istanze AWS Graviton

Per distribuire i tuoi modelli alle istanze AWS Graviton, puoi utilizzare Contenitori per l'apprendimento profondo AWS (DLC) o porta i tuoi contenitori compatibili con l'architettura ARMv8.2.

La migrazione (o nuova distribuzione) dei tuoi modelli alle istanze AWS Graviton è semplice perché non solo AWS fornisce container per ospitare modelli con PyTorch, TensorFlow, scikit-learn e XGBoost, ma i modelli sono anche indipendenti dall'architettura. Puoi anche portare le tue librerie, ma assicurati che il tuo contenitore sia costruito con un ambiente che supporti l'architettura ARMv8.2. Per ulteriori informazioni, vedere Costruire il proprio contenitore di algoritmi.

Dovrai completare tre passaggi per distribuire il tuo modello:

- Crea un modello SageMaker. Questo conterrà, tra gli altri parametri, le informazioni sulla posizione del file del modello, il contenitore che verrà utilizzato per la distribuzione e la posizione dello script di inferenza. (Se disponi di un modello esistente già distribuito in un'istanza di inferenza ottimizzata per il calcolo, puoi saltare questo passaggio).

- Creare una configurazione dell'endpoint. Questo conterrà informazioni sul tipo di istanza che desideri per l'endpoint (ad esempio, ml.c7g.xlarge per AWS Graviton3), il nome del modello che hai creato nella fase precedente e il numero di istanze per endpoint.

- Avvia l'endpoint con la configurazione dell'endpoint creata nel passaggio precedente.

Per istruzioni dettagliate, fare riferimento a Esegui carichi di lavoro di inferenza di machine learning su istanze basate su AWS Graviton con Amazon SageMaker

Metodologia di benchmarking

Abbiamo usato Raccomandatore di inferenza Amazon SageMaker per automatizzare il benchmarking delle prestazioni tra diverse istanze. Questo servizio confronta le prestazioni del tuo modello ML in termini di latenza e costo su diverse istanze e consiglia l'istanza e la configurazione che offre le migliori prestazioni al minor costo. Abbiamo raccolto i suddetti dati sulle prestazioni utilizzando Inference Recommender. Per maggiori dettagli, consultare il Repository GitHub.

È possibile utilizzare il taccuino di esempio per eseguire i benchmark e riprodurre i risultati. Abbiamo utilizzato i seguenti modelli per il benchmarking:

Conclusione

AWS ha misurato fino al 50% di risparmio sui costi per PyTorch, TensorFlow, XGBoost e l'inferenza del modello scikit-learn con istanze EC3 C2g basate su AWS Graviton7 rispetto a istanze EC2 comparabili su Amazon SageMaker. Puoi migrare i tuoi casi d'uso di inferenza esistenti o distribuire nuovi modelli ML su AWS Graviton seguendo i passaggi forniti in questo post. Puoi anche fare riferimento al Guida tecnica di AWS Graviton, che fornisce l'elenco delle librerie ottimizzate e delle best practice che ti aiuteranno a ottenere vantaggi in termini di costi con le istanze AWS Graviton su diversi carichi di lavoro.

Se trovi casi d'uso in cui non si osservano miglioramenti delle prestazioni simili su AWS Graviton, contattaci. Continueremo ad aggiungere ulteriori miglioramenti delle prestazioni per rendere AWS Graviton il processore per uso generico più conveniente ed efficiente per l'inferenza ML.

Circa gli autori

Sunita Nadampalli è un Software Development Manager presso AWS. Dirige le ottimizzazioni delle prestazioni del software Graviton per carichi di lavoro di machine learning, HPC e multimediali. È appassionata dello sviluppo open source e della fornitura di soluzioni software convenienti con i SoC Arm.

Sunita Nadampalli è un Software Development Manager presso AWS. Dirige le ottimizzazioni delle prestazioni del software Graviton per carichi di lavoro di machine learning, HPC e multimediali. È appassionata dello sviluppo open source e della fornitura di soluzioni software convenienti con i SoC Arm.

Jaymin Desai è un Software Development Engineer del team di Amazon SageMaker Inference. È appassionato di portare l'intelligenza artificiale alle masse e migliorare l'usabilità delle risorse di intelligenza artificiale all'avanguardia trasformandole in funzionalità e servizi. Nel tempo libero ama esplorare la musica e viaggiare.

Jaymin Desai è un Software Development Engineer del team di Amazon SageMaker Inference. È appassionato di portare l'intelligenza artificiale alle masse e migliorare l'usabilità delle risorse di intelligenza artificiale all'avanguardia trasformandole in funzionalità e servizi. Nel tempo libero ama esplorare la musica e viaggiare.

Mike Schneider è uno sviluppatore di sistemi, con sede a Phoenix AZ. È membro dei container Deep Learning, che supportano varie immagini di container Framework, tra cui Graviton Inference. Si dedica all'efficienza e alla stabilità delle infrastrutture.

Mike Schneider è uno sviluppatore di sistemi, con sede a Phoenix AZ. È membro dei container Deep Learning, che supportano varie immagini di container Framework, tra cui Graviton Inference. Si dedica all'efficienza e alla stabilità delle infrastrutture.

Mohan Gandhi è Senior Software Engineer presso AWS. È stato con AWS negli ultimi 10 anni e ha lavorato su vari servizi AWS come EMR, EFA e RDS. Attualmente, è concentrato sul miglioramento dell'esperienza di inferenza di SageMaker. Nel tempo libero ama fare escursioni e maratone.

Mohan Gandhi è Senior Software Engineer presso AWS. È stato con AWS negli ultimi 10 anni e ha lavorato su vari servizi AWS come EMR, EFA e RDS. Attualmente, è concentrato sul miglioramento dell'esperienza di inferenza di SageMaker. Nel tempo libero ama fare escursioni e maratone.

QingweiLi è uno specialista dell'apprendimento automatico di Amazon Web Services. Ha ricevuto il suo dottorato di ricerca. in Operations Research dopo aver rotto il conto di borsa di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che ha promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a sviluppare soluzioni di machine learning su AWS. Nel suo tempo libero, gli piace leggere e insegnare.

QingweiLi è uno specialista dell'apprendimento automatico di Amazon Web Services. Ha ricevuto il suo dottorato di ricerca. in Operations Research dopo aver rotto il conto di borsa di ricerca del suo consulente e non è riuscito a consegnare il premio Nobel che ha promesso. Attualmente aiuta i clienti nel settore dei servizi finanziari e assicurativi a sviluppare soluzioni di machine learning su AWS. Nel suo tempo libero, gli piace leggere e insegnare.

Wayne To è Specialist Solutions Architect per Graviton presso AWS. Si concentra sull'aiutare i clienti ad adottare l'architettura ARM per carichi di lavoro di container su larga scala. Prima di entrare in AWS, Wayne ha lavorato per diversi grandi fornitori di software, tra cui IBM e Red Hat.

Wayne To è Specialist Solutions Architect per Graviton presso AWS. Si concentra sull'aiutare i clienti ad adottare l'architettura ARM per carichi di lavoro di container su larga scala. Prima di entrare in AWS, Wayne ha lavorato per diversi grandi fornitori di software, tra cui IBM e Red Hat.

Lauren Mullenx è una Solutions Architect con sede a Denver, CO. Lavora con i clienti per aiutarli a progettare soluzioni su AWS. Nel tempo libero le piace fare escursioni e cucinare la cucina hawaiana.

Lauren Mullenx è una Solutions Architect con sede a Denver, CO. Lavora con i clienti per aiutarli a progettare soluzioni su AWS. Nel tempo libero le piace fare escursioni e cucinare la cucina hawaiana.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoAiStream. Intelligenza dei dati Web3. Conoscenza amplificata. Accedi qui.

- Coniare il futuro con Adryenn Ashley. Accedi qui.

- Acquista e vendi azioni in società PRE-IPO con PREIPO®. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 7

- 98

- a

- Chi siamo

- Il mio account

- Raggiungere

- operanti in

- aggiungere

- adottare

- Vantaggio

- Dopo shavasana, sedersi in silenzio; saluti;

- AI

- algoritmo

- già

- anche

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- tra

- an

- ed

- applicazioni

- architettura

- SONO

- ARM

- AS

- Attività

- At

- automatizzare

- AWS

- basato

- BE

- perché

- stato

- analisi comparativa

- parametri di riferimento

- vantaggi

- MIGLIORE

- best practice

- Meglio

- portare

- ampio

- Rotto

- costruire

- costruito

- incassato

- onere

- ma

- by

- Materiale

- casi

- Grafico

- classificazione

- Cloud

- CO

- paragonabile

- rispetto

- confronto

- compatibile

- completamento di una

- Calcolare

- computer

- Visione computerizzata

- Configurazione

- contenere

- Contenitore

- Tecnologie Container

- continua

- Costo

- risparmi

- costo effettivo

- Costi

- coprire

- creato

- Attualmente

- cliente

- Clienti

- dati

- dedicato

- deep

- apprendimento profondo

- consegnare

- consegna

- Denver

- schierare

- schierato

- deployment

- dettagliati

- dettagli

- Costruttori

- Mercato

- diverso

- discutere

- effettua

- dovuto

- in maniera efficace

- efficienza

- efficiente

- o

- endpoint

- ingegnere

- Ambiente

- valutare

- esempio

- esistente

- esperienza

- Esplorare

- fallito

- Caratteristiche

- pochi

- Compila il

- finanziario

- servizio finanziario

- Trovare

- Focus

- concentrato

- si concentra

- i seguenti

- Nel

- quattro

- Contesto

- quadri

- Gratis

- ulteriormente

- Guadagni

- scopo generale

- generazioni

- dà

- concedere

- grafico

- ha

- Avere

- he

- Aiuto

- aiutare

- aiuta

- suo

- il suo

- host

- Come

- hpc

- HTML

- HTTPS

- IBM

- if

- immagini

- miglioramento

- miglioramenti

- miglioramento

- in

- includere

- Compreso

- industria

- informazioni

- Infrastruttura

- esempio

- istruzioni

- assicurazione

- Integra

- ai miglioramenti

- accoppiamento

- jpg

- ad appena

- Lingua

- grandi

- Cognome

- Latenza

- Leads

- apprendimento

- meno

- biblioteche

- piace

- piace

- Lista

- località

- minore

- macchina

- machine learning

- make

- gestire

- direttore

- masse

- Soddisfare

- membro

- Memorie

- migrare

- migrazione

- milione

- ML

- MLOp

- modello

- modelli

- Scopri di più

- maggior parte

- Multimedia

- multiplo

- Musica

- Nome

- Naturale

- Elaborazione del linguaggio naturale

- Bisogno

- esigenze

- New

- nlp

- premio Nobel

- numero

- of

- offrire

- on

- esclusivamente

- open source

- operativa

- Operazioni

- ottimizzati

- Opzione

- Opzioni

- or

- minimo

- Altro

- su

- proprio

- parametri

- appassionato

- performance

- fenice

- scegliere

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- Popolare

- Post

- pratiche

- precedente

- Precedente

- premio

- lavorazione

- Processore

- Produzione

- promesso

- fornire

- purché

- fornisce

- pytorch

- gamma

- Posizione

- raggiungere

- Lettura

- ricevuto

- raccomanda

- Rosso

- Red Hat

- ridurre

- Ridotto

- riparazioni

- Risultati

- Correre

- sagemaker

- Inferenza di SageMaker

- stesso

- Risparmio

- Scala

- Scenari

- scikit-impara

- vedere

- prodotti

- anziano

- servizio

- Servizi

- alcuni

- lei

- mostrare attraverso le sue creazioni

- Spettacoli

- significativa

- simile

- So

- Software

- lo sviluppo del software

- Software Engineer

- Soluzioni

- specialista

- specializzata

- Stabilità

- state-of-the-art

- step

- Passi

- lineare

- Supporto

- supporti

- Interruttore

- SISTEMI DI TRATTAMENTO

- Fai

- presa

- Insegnamento

- team

- Consulenza

- tensorflow

- condizioni

- di

- che

- I

- le informazioni

- Li

- questo

- tre

- tempo

- a

- strumenti

- Di viaggio

- Digitare

- Tipi di

- us

- usabilità

- uso

- utilizzato

- utilizzando

- vario

- fornitori

- visione

- volere

- we

- sito web

- servizi web

- WELL

- quale

- volere

- con

- Lavora

- lavorato

- lavori

- XGBoost

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro