כיצד גבולות תחתונים בסבירות גבוהה (HPLBs) על מרחק הווריאציה הכולל יכולים להוביל לסטטיסטיקה משולבת של מבחן מושך בבדיקות A/B

תורמים: לוריס מישל, ג'פרי נאף

השלבים הקלאסיים של מבחן A/B כללי, כלומר להחליט אם שתי קבוצות של תצפיות מגיעות מהתפלגויות שונות (נניח P ו-Q), הם:

- נניח השערת אפס והשערה חלופית (כאן, בהתאמה, P=Q ו-P≠Q);

- הגדר רמת מובהקות אלפא;

- בניית מבחן סטטיסטי (החלטה בינארית הדוחה את האפס או לא);

- גזור נתון מבחן T;

- השג ערך p מהתפלגות האפס המשוערת/אסימפטוטית/מדויק של T.

עם זאת, כאשר מבחן כזה דוחה את האפס, כלומר כאשר ערך ה-p משמעותי (ברמה נתונה) עדיין חסר לנו מדד עד כמה חזק ההבדל בין P ל-Q. למעשה, מצב הדחייה של בדיקה יכול להתברר כמידע חסר תועלת ביישומים מודרניים (נתונים מורכבים) מכיוון שעם מספיק גודל מדגם (בהנחה של רמה קבועה והספק) כל בדיקה תטה לדחות את ה-null (מכיוון שהוא רק לעתים נדירות בדיוק נָכוֹן). לדוגמה, זה יכול להיות מעניין לקבל מושג כמה נקודות נתונים תומכות בהפרש התפלגות.

לכן, בהתבסס על דגימות סופיות מ-P ו-Q, שאלה עדינה יותר מאשר "האם P שונה מ-Q?" ניתן לקבוע כ"מהו גבול תחתון הסתברותי לשבריר התצפיות λ התומך למעשה בהבדל בהתפלגות בין P ו-Q?". זה יתורגם רשמית לבניית אומדן λˆ המספק את λˆ ≤ λ בהסתברות גבוהה (נניח 1-אלפא). אנו קוראים לאומדן כזה an סבירות גבוהה גבול תחתון (HPLB) על λ.

בסיפור זה אנו רוצים להניע את השימוש ב-HPLBs בבדיקות A/B ולתת טיעון מדוע הרעיון הנכון עבור λ הוא מרחק וריאציה כולל בין P ל-Q, כלומר TV(P, Q). את ההסבר והפרטים על בניית HPLB כזה נשמור למאמר נוסף. אתה תמיד יכול לבדוק את שלנו פאפr לקבלת פרטים נוספים.

למה מרחק השינוי הכולל?

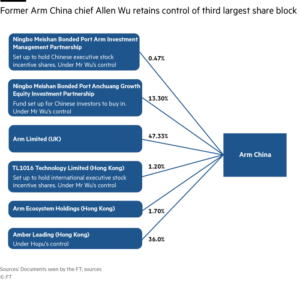

מרחק השונות הכולל הוא מדד חזק (עדין) להסתברויות. המשמעות היא שאם שתי התפלגויות הסתברות שונות אז מרחק השונות הכולל שלהן יהיה לא אפס. זה מוגדר בדרך כלל כחוסר הסכמה מקסימלי של הסתברויות על קבוצות. עם זאת, הוא נהנה מייצוג אינטואיטיבי יותר כהעברה בדידה של מידה בין ההסתברויות P ו-Q (ראה איור 2):

מרחק השונות הכולל בין מדדי ההסתברות P ו-Q הוא חלק ממסת ההסתברות שצריך לשנות/להזיז מ-P כדי לקבל את מדד ההסתברות Q (או להיפך).

מבחינה מעשית, מרחק השונות הכולל מייצג את חלק הנקודות השונות בין P ל-Q, שזה בדיוק הרעיון הנכון עבור λ.

כיצד להשתמש ב-HPLB והיתרון שלו?

האומדן λˆ מושך עבור בדיקת A/B מכיוון שמספר בודד זה כולל גם את מובהקות סטטיסטית (כפי שעושה ערך p) וה- גודל השפעה אוּמדָן. ניתן להשתמש בו באופן הבא:

- הגדר רמת ביטחון (1-אלפא);

- בנה את HPLB λˆ על סמך שתי הדגימות;

- אם λˆ הוא אפס אז אל תדחה את האפס, אחרת אם λˆ > 0, דוחה את האפס ומסיק ש- λ (השבר השונה) הוא לפחות λˆ בהסתברות 1-אלפא.

כמובן שהמחיר שצריך לשלם הוא שהערך של λˆ תלוי ברמת הביטחון הנבחרת (1-אלפא) בעוד שערך p אינו תלוי בה. עם זאת, בפועל רמת הביטחון אינה משתנה הרבה (בדרך כלל מוגדרת ל-95%).

שקול את הדוגמה של גודל ההשפעה ברפואה. לתרופה חדשה צריכה להיות השפעה משמעותית בקבוצת הניסוי, בהשוואה לקבוצת פלצבו, שלא קיבלה את התרופה. אבל זה גם משנה כמה גדול ההשפעה. ככזה, לא צריך לדבר רק על ערכי p, אלא גם לתת מידה מסוימת של גודל האפקט. זה מוכר כיום במחקר רפואי טוב. ואכן, גישה המשתמשת בגישה אינטואיטיבית יותר לחישוב TV(P,Q) שימשה בהגדרה החד-משתנית כדי לתאר את ההבדל בין קבוצות טיפול וביקורת. גישת ה-HPLB שלנו מספקת גם מדד של מובהקות וגם גודל אפקט. הבה נמחיש זאת בדוגמה:

בואו נעשה דוגמה

אנו מדמים שתי התפלגויות P ו-Q בשני ממדים. לפיכך, P יהיה רק נורמלי רב-משתני, בעוד ש-Q הוא a תַעֲרוֹבֶת בין P לנורמל רב משתני עם ממוצע מוזז.

library(mvtnorm)

ספרייה (HPLB)set.seed(1)

n<-2000

p<-2#דלתא גדולה יותר -> יותר הבדל בין P ו-Q

#דלתא קטנה יותר -> פחות הבדל בין P ו-Q

דלתא<-0# הדמיית X~P ו-Y~Q עבור דלתא נתונה

U<-runif(n)

X<-rmvnorm(n=n, sig=diag(p))

Y<- (U <=delta)*rmvnorm(n=n, mean=rep(2,p), sig=diag(p))+ (1-(U <=delta))*rmvnorm(n=n, sig=diag(p))plot(Y, cex=0.8, col="darkblue")

points(X, cex=0.8, col="red")

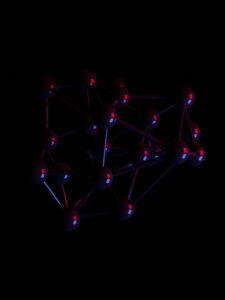

דלתא משקל התערובת שולטת עד כמה חזקות שתי ההתפלגות שונות. משתנה בדלתא מ-0 ל-0.9 זה נראה כך:

לאחר מכן נוכל לחשב את ה-HPLB עבור כל אחד מהתרחישים הבאים:

#הערך HPLB עבור כל מקרה (שנה דלתא והפעל מחדש את הקוד)

t.train<- c(rep(0,n/2), rep(1,n/2) )

xy.train <-rbind(X[1:(n/2),], Y[1:(n/2),])

t.test<- c(rep(0,n/2), rep(1,n/2) )

xy.test <-rbind(X[(n/2+1):n,], Y[(n/2+1):n,])

rf <- ranger::ranger(t~., data.frame(t=t.train,x=xy.train))

rho <- predict(rf, data.frame(t=t.test,x=xy.test))$predictionstvhat <- HPLB(t = t.test, rho = rho, estimator.type = "adapt")

tvhat

אם נעשה את זה עם הזרע שהוגדר למעלה, אנחנו

כך ה-HPLB מצליח (i) לזהות מתי אכן אין שינוי בשתי ההתפלגויות, כלומר הוא אפס כאשר הדלתא היא אפס, (ii) לזהות כבר את ההבדל הקטן ביותר כאשר הדלתא היא רק 0.05 ו-(iii) לזהות כי ההבדל גדול יותר ככל שהדלתא גדולה יותר. שוב, הדבר החשוב שיש לזכור לגבי הערכים האלה הוא שהם באמת אומרים משהו - הערך 0.64 יהיה גבול תחתון עבור הטלוויזיה האמיתית עם סבירות גבוהה. בפרט, כל אחד מהמספרים שגדולים יותר מאפס פירושו מבחן ש-P=Q נדחה ברמה של 5%.

סיכום:

כאשר מדובר בבדיקת A/B (בדיקת שני מדגמים) ההתמקדות היא לרוב במצב הדחייה של מבחן סטטיסטי. כאשר מבחן דוחה את התפלגות האפס, עם זאת שימושי בפועל לקבל מדד אינטנסיביות של הפרש ההתפלגות. באמצעות בניית גבולות תחתונים בעלי הסתברות גבוהה על מרחק השונות הכולל, נוכל לבנות גבול תחתון על שבריר התצפיות הצפויות להיות שונות ובכך לתת מענה משולב להבדל בהתפלגות ובעוצמת השינוי. .

כתב ויתור ומשאבים: אנו מודעים לכך שהשארנו פרטים רבים (יעילות, בניית HPLBs, לימודי כוח,...) אך מקווים שפתחנו אופק חשיבה. Mניתן למצוא פרטים על עפרות והשוואה לבדיקות קיימות אצלנו פאפr ובדוק R-package HPLB ב-CRAN.

חלופה ל-p-values בבדיקת A/B פורסם מחדש ממקור https://towardsdatascience.com/an-alternative-to-p-values-in-ab-testing-44f1406d3f91?source=rss—-7f60cf5620c9—4 דרך https ://towardsdatascience.com/feed

<!–

->