על מנת לחלוק את הקסם של DALL E 2 עם קהל רחב, היינו צריכים להפחית את הסיכונים הקשורים למודלים רבי עוצמה ליצירת תמונות. לשם כך, שמנו שונים מעקות במקום כדי למנוע מתמונות שנוצרו להפר את שלנו מדיניות התוכן. פוסט זה מתמקד ב הפחתות לפני אימון, תת-קבוצה של מעקות הבטיחות האלה שמשנים ישירות את הנתונים ש-DALL·E 2 לומד מהם. במיוחד, DALL·E 2 מאומן על מאות מיליוני תמונות כתוביות מהאינטרנט, ואנו מסירים ומשקללים מחדש חלק מהתמונות הללו כדי לשנות את מה שהמודל לומד.

פוסט זה מאורגן בשלושה חלקים, שכל אחד מהם מתאר הפחתה שונה לפני ההכשרה:

- בחלק הראשון, אנו מתארים כיצד סיננו תמונות אלימות ומיניות ממערך ההדרכה של DALL·E 2. ללא הפחתה זו, המודל ילמד לייצר תמונות גרפיות או מפורשות כאשר תתבקש להן, ואולי אף יחזיר תמונות כאלה ללא כוונה בתגובה להנחיות לכאורה תמימות.

- בסעיף השני, אנו מוצאים שסינון נתוני אימון יכול להגביר הטיות, ולתאר את הטכניקה שלנו למתן השפעה זו. לדוגמה, ללא הקלה זו, שמנו לב שמודלים שהוכשרו על פי נתונים מסוננים יצרו לפעמים יותר תמונות המתארות גברים ופחות תמונות המתארות נשים בהשוואה למודלים שהוכשרו במערך הנתונים המקורי.

- בחלק האחרון, אנו פונים לסוגיית השינון, ומגלים שדגמים כמו DALL·E 2 יכולים לפעמים לשחזר תמונות שעליהן הוכשרו במקום ליצור תמונות חדשות. בפועל, גילינו שזה רגורגיטציה של תמונה נגרמת על ידי תמונות המשוכפלות פעמים רבות במערך הנתונים, ומפחיתה את הבעיה על ידי הסרת תמונות הדומות מבחינה ויזואלית לתמונות אחרות במערך הנתונים.

צמצום נתוני הדרכה גרפיים ומפורשים

מכיוון שנתוני אימון מעצבים את היכולות של כל מודל שנלמד, סינון נתונים הוא כלי רב עוצמה להגבלת יכולות מודל לא רצויות. יישמנו גישה זו על שתי קטגוריות - תמונות המתארות אלימות גרפית ותוכן מיני - על ידי שימוש במסווגים כדי לסנן תמונות בקטגוריות אלו מתוך מערך הנתונים לפני אימון DALL·E 2. אימנו את מסווגי התמונות הללו בעצמנו וממשיכים ללמוד את השפעות של סינון נתונים על המודל המאומן שלנו.

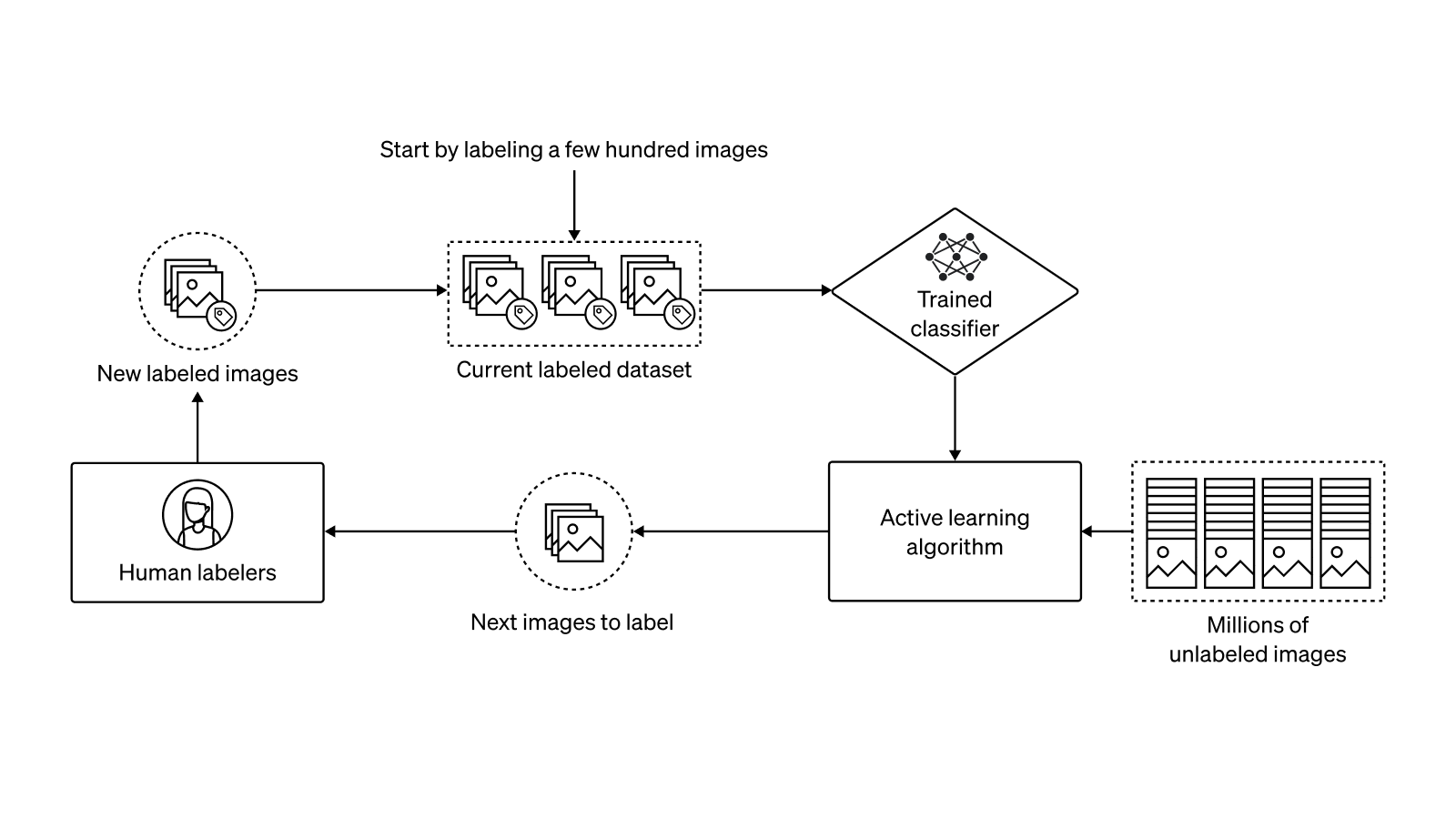

כדי להכשיר את מסווגי התמונות שלנו, השתמשנו מחדש בגישה שהשתמשנו בה בעבר כדי לסנן את נתוני ההדרכה לִדאוֹת. השלבים הבסיסיים לגישה זו הם כדלקמן: ראשית, אנו יוצרים מפרט עבור קטגוריות התמונות שנרצה לתייג; שנית, אנו אוספים כמה מאות דוגמאות חיוביות ושליליות לכל קטגוריה; שלישית, אנו משתמשים בהליך למידה פעיל כדי לאסוף נתונים נוספים ולשפר את הפשרה בין הדיוק/היזכרות; ולבסוף, אנו מריצים את המסווג המתקבל על כל מערך הנתונים עם סף סיווג שמרני כדי להעדיף זכירה על פני דיוק. כדי להגדיר את הספים האלה, העדפנו לסנן את כל רע נתונים על השארת בכל טוב נתונים. הסיבה לכך היא שתמיד נוכל לכוונן את המודל שלנו עם יותר נתונים מאוחר יותר כדי ללמד אותו דברים חדשים, אבל הרבה יותר קשה לגרום למודל לשכוח משהו שהוא כבר למד.

במהלך שלב הלמידה הפעילה, שיפרנו באופן איטרטיבי את המסווגים שלנו על ידי איסוף תוויות אנושיות לתמונות שעלולות להיות קשות או לא מסווגות. יש לציין, השתמשנו בשתי טכניקות למידה אקטיביות כדי לבחור תמונות מתוך מערך הנתונים שלנו (המכיל מאות מיליוני תמונות ללא תווית) כדי להציג לבני אדם לתיוג. ראשית, כדי להפחית את שיעור החיובים השגויים של המסווג שלנו (כלומר, התדירות שבה הוא מסווג באופן שגוי תמונה שפירה כאלימה או מינית), הקצינו תוויות אנושיות לתמונות שהמודל הנוכחי סיווג כחיוביות. כדי שהשלב הזה יעבוד היטב, כיוונו את סף הסיווג שלנו לכמעט 100% ריקול אך שיעור חיובי שגוי גבוה; בדרך זו, המתייגים שלנו תייגו בעיקר מקרים שליליים באמת. אמנם טכניקה זו מסייעת להפחית תוצאות חיוביות כוזבות ומפחיתה את הצורך במתייגים להסתכל על תמונות שעלולות להיות מזיקות, אבל היא לא עוזרת למצוא מקרים חיוביים יותר שהדגם חסר כרגע.

כדי להפחית את שיעור השלילי השגוי של המסווג שלנו, השתמשנו בטכניקת למידה אקטיבית שנייה: חיפוש השכן הקרוב ביותר. בפרט, הרצנו אימות צולב רב-פעמי כדי למצוא דגימות חיוביות במערך הנתונים הנוכחי שלנו עם התווית, שהמודל נטה לסווג בצורה שגויה כשלילית (כדי לעשות זאת, ממש אימנו מאות גרסאות של המסווגן עם פיצולי אימות רכבת שונים). לאחר מכן סרקנו את האוסף הגדול שלנו של תמונות ללא תווית עבור השכנים הקרובים ביותר של דגימות אלה במרחב תפיסתי, והקצנו תוויות אנושיות לתמונות שהתגלו. הודות לתשתית המחשוב שלנו, זה היה טריוויאלי להגדיל הן את הכשרת המסווגים והן את חיפוש השכנים הקרובים למעבדי GPU רבים, מה שמאפשר לשלב הלמידה האקטיבי להתרחש על פני מספר דקות ולא שעות או ימים.

כדי לוודא את היעילות של מסנני הנתונים שלנו, אימנו שני מודלים של GLIDE עם אותם הפרמטרים: אחד על נתונים לא מסוננים ואחד על מערך הנתונים לאחר הסינון. אנו מתייחסים לדגם הקודם כאל דגם לא מסונן, והאחרונים כמו ה דגם מסונן. כצפוי, מצאנו שהמודל הבלתי מסונן בדרך כלל הפיק פחות תוכן מפורש או גרפי בתגובה לבקשות לתוכן מסוג זה. עם זאת, מצאנו גם תופעת לוואי בלתי צפויה של סינון נתונים: הוא יצר או הגביר את ההטיות של המודל כלפי נתונים דמוגרפיים מסוימים.

תיקון הטיה שהוכנסה על ידי מסנני נתונים

מודלים גנרטיביים מנסים להתאים את התפלגות נתוני האימון שלהם, כולל כל ההטיות שבהם. כתוצאה מכך, לסינון נתוני האימון יש פוטנציאל ליצור או להגביר הטיות במודלים במורד הזרם. באופן כללי, תיקון הטיות במערך הנתונים המקורי הוא משימה סוציו-טכנית קשה שאנו ממשיכים לחקור, והיא מעבר להיקף הפוסט הזה. הבעיה שאנו מטפלים בה היא הגברה של הטיות הנגרמות במיוחד על ידי סינון הנתונים עצמו. עם הגישה שלנו, אנו שואפים למנוע מהמודל המסונן להתקיים יותר מוטה מהמודל הבלתי מסונן, מה שמפחית בעצם את שינוי ההפצה שנגרם על ידי סינון נתונים.

כדוגמה קונקרטית להגברת הטיה עקב סינון, שקול את ההנחיה "מנכ"ל". כאשר המודל הלא מסונן שלנו יצר תמונות עבור הנחיה זו, הוא נוטה לייצר יותר תמונות של גברים מאשר נשים, ואנו מצפים שרוב ההטיה הזו היא שיקוף של נתוני האימונים הנוכחיים שלנו. עם זאת, כאשר הרצנו את אותה הנחיה דרך המודל המסונן שלנו, נראה היה שההטיה מוגברת; הדורות היו כמעט רק תמונות של גברים.

אנו משערים שהמקרה הספציפי הזה של הגברה הטיה מגיע משני מקומות: ראשית, גם אם לנשים ולגברים יש ייצוג שווה בערך במערך הנתונים המקורי, מערך הנתונים עשוי להיות מוטה להצגת נשים בהקשרים מיניים יותר; ושנית, המסווגים שלנו עצמם עשויים להיות מוטים בשל יישום או הגדרת מחלקה, למרות המאמצים שלנו להבטיח שזה לא היה המקרה במהלך שלבי איסוף הנתונים והאימות. עקב שתי ההשפעות הללו, המסנן שלנו עשוי להסיר יותר תמונות של נשים מאשר גברים, מה שמשנה את היחס בין המינים שהדוגמנית צופה באימון.

כדי לחקור את ההטיה הנגרמת מסננים בצורה יסודית יותר, רצינו דרך למדוד עד כמה מסנני הנתונים שלנו משפיעים על ההטיה כלפי מושגים שונים. יש לציין כי מסנני האלימות והתוכן המיני שלנו מבוססים על תמונה בלבד, אך האופי הרב-מודאלי של מערך הנתונים שלנו מאפשר לנו למדוד ישירות את ההשפעות של מסננים אלו על טקסט. מכיוון שכל תמונה מלווה בכיתוב טקסט, הצלחנו להסתכל על התדירות היחסית של מילות מפתח שנבחרו ביד על פני מערך הנתונים המסונן והלא מסונן כדי להעריך עד כמה המסננים השפיעו על כל מושג נתון.

To put this into practice, we used Apache Spark to compute the frequencies of a handful of keywords (e.g., "parent", “woman”, “kid”) over all of the captions in both our filtered and unfiltered datasets. Even though our dataset contains hundreds of millions of text-image pairs, computing these keyword frequencies only took a few minutes using our compute cluster.

לאחר חישוב תדירויות של מילות מפתח, הצלחנו לאשר שמסנני הנתונים שלנו אכן הטיבו את התדרים של מילות מפתח מסוימות יותר מאחרות. לדוגמה, המסננים הפחיתו את תדירות המילה "אישה" ב-14%, בעוד שכיחות המילה "גבר" הצטמצמה רק ב-6%. זה אישר, בקנה מידה גדול, את מה שכבר צפינו באופן אנקדוטי על ידי דגימה מדגמי GLIDE שהוכשרו על שני מערכי הנתונים.

כעת, כשהיה לנו פרוקסי למדידת הטיה הנגרמת מסנן, היינו צריכים דרך למתן אותה. כדי להתמודד עם בעיה זו, שאפנו לשקלל מחדש את מערך הנתונים המסונן כך שההפצה שלו תתאים יותר להפצה של תמונות לא מסוננות. כדוגמה לצעצוע להמחשת רעיון זה, נניח שמערך הנתונים שלנו מורכב מ-50% תמונות חתולים ו-50% תמונות של כלבים, אבל מסנני הנתונים שלנו מסירים 75% מהכלבים אך רק 50% מהחתולים. מערך הנתונים הסופי יהיה ⅔ חתולים ו- ⅓ כלבים, ומודל מחולל מבוסס-סבירות שיאומן על מערך נתונים זה יפיק יותר תמונות של חתולים מאשר כלבים. אנחנו יכולים לתקן את חוסר האיזון הזה על ידי הכפלת אובדן האימון של כל תמונה של כלב ב-2, תוך חיקוי ההשפעה של חזרה על כל תמונה של כלב פעמיים. מסתבר שאנחנו יכולים להרחיב את הגישה הזו למערך הנתונים והמודלים האמיתיים שלנו בצורה שהיא ברובה אוטומטית - כלומר, אנחנו לא צריכים לבחור ידנית את התכונות שאנחנו רוצים לשקול מחדש.

אנו מחשבים משקלים עבור תמונות במערך הנתונים המסונן באמצעות הסתברויות ממסווג מיוחד, בדומה לגישה בה משתמשים צ'וי ואח '. (2019). כדי להכשיר את המסווג הזה, אנו דוגמים תמונות באופן אחיד משני מערכי הנתונים וחוזים מאיזה מערך נתונים הגיעה התמונה. בפרט, מודל זה מנבא P(לא מסונן|תמונה), נתון קודם P(לא מסונן) = 0.5. בפועל, אנחנו לא רוצים שהמודל הזה יהיה חזק מדי, אחרת הוא עשוי ללמוד את הפונקציה המדויקת המיושמת על ידי המסננים שלנו מלכתחילה. במקום זאת, אנו רוצים שהמודל יהיה חלק יותר ממסנני הנתונים המקוריים שלנו, וילכוד קטגוריות רחבות המושפעות מהפילטרים, תוך כדי אי-וודאות אם תמונה מסוימת תסונן או לא. לשם כך, אימנו בדיקה ליניארית על גבי קטן CLIP מודל.

ברגע שיש לנו מסווג שמנבא את ההסתברות שתמונה היא ממערך הנתונים הלא מסונן, אנחנו עדיין צריכים להמיר את החיזוי הזה למשקל לתמונה. למשל, נניח ש P(לא מסונן|תמונה) = 0.8. המשמעות היא שהסבירות שהדגימה תימצא בנתונים הלא מסוננים גבוהה פי 4 מהנתונים המסוננים, ומשקל של 4 אמור לתקן את חוסר האיזון. באופן כללי יותר, אנו יכולים להשתמש במשקל P(unfiltered|image)/P(filtered|image).[1]

עד כמה תכנית הניפוח הזו מפחיתה למעשה את ההטיה המוגברת? כשכווננו עדין את המודל המסונן הקודם שלנו עם ערכת הניפוח החדשה, ההתנהגות של המודל המכוונן תאמה הרבה יותר את המודל הלא מסונן על הדוגמאות המוטה שמצאנו קודם לכן. למרות שזה היה מעודד, רצינו גם להעריך את ההפחתה הזו בצורה יסודית יותר באמצעות היוריסטית ההטיה המבוססת על מילות מפתח שלנו. כדי למדוד תדירויות של מילות מפתח תוך התחשבות בסכימת הניפוח החדשה שלנו, אנחנו יכולים פשוט לשקלל כל מופע של מילת מפתח במערך הנתונים המסונן לפי משקל המדגם שמכיל אותה. אם נעשה זאת, אנו מקבלים קבוצה חדשה של תדירויות מילות מפתח המשקפות את משקלי הדגימה במערך הנתונים המסונן.

על פני רוב מילות המפתח שבדקנו, ערכת הניפוח מחדש הפחיתה את השינוי בתדירות שנגרם על ידי הסינון. עבור הדוגמאות הקודמות שלנו של "גבר" ו"אישה", הפחתת התדירות היחסית הפכה ל-1% ו-1%, בעוד שהערכים הקודמים שלהם היו 14% ו-6%, בהתאמה. בעוד שמדד זה הוא רק פרוקסי להטיית סינון בפועל, זה מרגיע שסכימת הניפוח המבוסס על התמונה שלנו למעשה משפרת מדד מבוסס טקסט בצורה כה משמעותית.

אנו ממשיכים לחקור את ההטיות הנותרות ב-DALL·E 2, בין השאר באמצעות הערכות גדולות יותר של התנהגות המודל וחקירות כיצד הסינון השפיע על הטיות ופיתוח יכולות.

מניעת רגורגיטציה של תמונה

ראינו שקודמינו הפנימיים ל-DALL·E 2 ישחזרו לפעמים תמונות אימון מילה במילה. התנהגות זו לא הייתה רצויה, מכיוון שהיינו רוצים ש-DALL·E 2 ייצור תמונות מקוריות וייחודיות כברירת מחדל, ולא רק "תתפור יחד" חלקים של תמונות קיימות. בנוסף, שחזור תמונות אימון מילה במילה יכול לעורר שאלות משפטיות בנוגע להפרת זכויות יוצרים, בעלות ופרטיות (אם תמונות של אנשים היו נוכחות בנתוני ההדרכה).

כדי להבין טוב יותר את הנושא של חזרת תמונה, אספנו מערך נתונים של הנחיות שהביאו לעתים קרובות לתמונות כפולות. לשם כך, השתמשנו במודל מאומן כדי לדגום תמונות עבור 50,000 הנחיות ממערך ההדרכה שלנו, ומינו את הדגימות לפי דמיון תפיסתי לתמונת האימון המתאימה. לבסוף, בדקנו את ההתאמות המובילות ביד, ומצאנו רק כמה מאות זוגות כפולים אמיתיים מתוך 50 אלף ההנחיות הכוללות. למרות שנראה ששיעור הרגורגיטציה נמוך מ-1%, הרגשנו שיש צורך להוריד את השיעור ל-0 מהסיבות שצוינו לעיל.

כאשר למדנו את מערך הנתונים שלנו של תמונות מוחזרות, הבחנו בשני דפוסים. ראשית, התמונות היו כמעט כולן גרפיקה וקטורית פשוטה, שסביר להניח שקל לשנן אותה בשל תכולת המידע הנמוכה שלהן. שנית, וחשוב מכך, לכל התמונות היו כמעט כפילויות רבות במערך ההדרכה. לדוגמה, ייתכן שיש גרפיקה וקטורית שנראית כמו שעון המראה את השעה 1 בצהריים - אבל אז נגלה דגימת אימון המכילה את אותו שעון שמראה את השעה 2, ולאחר מכן 3 בצהריים וכו'. פעם אחת הבנו את זה, השתמשנו בחיפוש מבוזר של השכנים הקרובים ביותר כדי לוודא שאכן, לכל התמונות שהוחזרו היו כפילויות דומות מבחינה תפיסתית במערך הנתונים. אחר עובד צפו בתופעה דומה במודלים של שפות גדולות, ומצאו ששכפול נתונים קשור מאוד לשינון.

הממצא שלעיל הציע שאם נבטל את הכפילות של מערך הנתונים שלנו, נוכל לפתור את בעיית הרגורגיטציה. כדי להשיג זאת, תכננו להשתמש ברשת עצבית כדי לזהות קבוצות של תמונות שנראות דומות, ולאחר מכן להסיר מכל קבוצה את כל התמונה מלבד אחת.[2] However, this would require checking, for each image, whether it is a duplicate of every other image in the dataset. Since our whole dataset contains hundreds of millions of images, we would naively need to check hundreds of quadrillions of image pairs to find all the duplicates. While this is technically within reach, especially on a large compute cluster, we found a much more efficient alternative that works almost as well at a small fraction of the cost.

Consider what happens if we cluster our dataset before performing deduplication. Since nearby samples often fall into the same cluster, most of the duplicate pairs would not cross cluster decision boundaries. We could then deduplicate samples within each cluster without checking for duplicates outside of the cluster, while only missing a small fraction of all duplicate pairs. This is much faster than the naive approach, since we no longer have to check every single pair of images.[3] כאשר בדקנו גישה זו באופן אמפירי על תת-קבוצה קטנה של הנתונים שלנו, היא מצאה 85% מכל הזוגות הכפולים בעת שימוש K = 1024 אשכולות.

כדי לשפר את שיעור ההצלחה של האלגוריתם הנ"ל, מינפנו תצפית מרכזית אחת: כאשר אתה מקבץ תת-קבוצות אקראיות שונות של מערך נתונים, גבולות ההחלטה המתקבלים של אשכולות הם לעתים קרובות שונים למדי. לכן, אם זוג כפול חוצה גבול אשכול עבור אשכול אחד של הנתונים, אותו זוג עלול ליפול בתוך אשכול בודד בצביר אחר. ככל שתנסה יותר אשכולות, כך גדל הסיכוי שתגלה זוג כפול נתון. בפועל, הסתפקנו בשימוש בחמישה אשכולות, כלומר אנחנו מחפשים כפילויות של כל תמונה באיחוד של חמישה אשכולות שונים. בפועל, זה מצא 97% מכל הזוגות הכפולים בקבוצת משנה של הנתונים שלנו.

באופן מפתיע, כמעט רבע ממאגר הנתונים שלנו הוסר על ידי מניעת כפילויות. כאשר הסתכלנו על הזוגות הכמעט-כפולים שנמצאו, רבים מהם כללו שינויים משמעותיים. זכור את דוגמת השעון מלמעלה: מערך הנתונים עשוי לכלול תמונות רבות של אותו שעון בשעות שונות של היום. בעוד שתמונות אלו עשויות לגרום לדגם לשנן את המראה הספציפי של השעון הזה, הן עשויות גם לעזור לדגם ללמוד להבחין בין שעות היום בשעון. בהתחשב בכמות הנתונים שהוסרו, חששנו שהסרת תמונות כמו זו עלולה לפגוע בביצועי הדגם.

כדי לבדוק את ההשפעה של מניעת כפילויות על המודלים שלנו, הכשרנו שני מודלים עם הפרמטרים זהים: אחד על מערך הנתונים המלא ואחד על הגרסה המשוכפלת של מערך הנתונים. כדי להשוות בין המודלים, השתמשנו באותן הערכות אנושיות בהן השתמשנו כדי להעריך את מודל ה-GLIDE המקורי שלנו. באופן מפתיע, מצאנו שמעריכים אנושיים מעט מועדף המודל התאמן על נתונים משוכפלים, מה שמרמז שהכמות הגדולה של תמונות מיותרות במערך הנתונים למעשה פוגעת בביצועים.

ברגע שהיה לנו מודל מאומן על נתונים משוכפלים, הרצנו מחדש את חיפוש ה-regurgitation שעשינו בעבר מעל 50 הנחיות ממערך ההדרכה. מצאנו שהמודל החדש מעולם לא העלה תמונת אימון כאשר קיבל את ההנחיה המדויקת לתמונה מתוך מערך האימון. כדי לקחת את הבדיקה הזו צעד נוסף קדימה, ביצענו גם חיפוש שכן הקרוב ביותר בכל מערך הנתונים של ההדרכה עבור כל אחת מ-50 אלף התמונות שנוצרו. בדרך זו, חשבנו שאולי נתפוס את הדגם מחזיר תמונה שונה מזו המשויכת להנחיה נתונה. אפילו עם בדיקה יסודית יותר זו, מעולם לא מצאנו מקרה של חזרת תמונה.

השלבים הבא

אמנם כל ההפחתות שנדונו לעיל מייצגות התקדמות משמעותית לקראת המטרה שלנו להפחית את הסיכונים הקשורים ל-DALL·E 2, בכל מקרה של הפחתה עדיין יש מקום לשיפור:

- מסנני טרום אימון טובים יותר יכולים לאפשר לנו לאמן את DALL·E 2 על נתונים נוספים ואפשר להפחית עוד יותר את ההטיה במודל. המסננים הנוכחיים שלנו מכוונים לשיעור פספוס נמוך במחיר של הרבה תוצאות שגויות. כתוצאה מכך, סיננו בערך 5% מכל מערך הנתונים שלנו למרות שרוב התמונות המסוננות הללו אינן מפרות את מדיניות התוכן שלנו כלל. שיפור המסננים שלנו יכול לאפשר לנו להחזיר חלק מנתוני ההדרכה הללו.

- הטיה מוצגת ועשויה להגביר בשלבים רבים של פיתוח ופריסה של המערכת. הערכה והפחתת ההטיה במערכות כמו DALL·E 2 והנזק הנגרם מהטיה זו היא בעיה בינתחומית חשובה שאנו ממשיכים ללמוד ב-OpenAI כחלק מהמשימה הרחבה יותר שלנו. העבודה שלנו בנושא זה כוללת בניית הערכות כדי להבין טוב יותר את הבעיה, אצור מערכי נתונים חדשים ויישום טכניקות כמו משוב אנושי וכיוונון עדין לבניית טכנולוגיות חזקות ומייצגות יותר.

- זה גם חיוני שנמשיך ללמוד שינון והכללה במערכות למידה עמוקה. אמנם מניעת כפילות היא צעד ראשון טוב לקראת מניעת שינון, אבל זה לא אומר לנו כל מה שצריך ללמוד על הסיבה או איך מודלים כמו DALL·E 2 משננים נתוני אימון.

- 000

- 2019

- a

- אודות

- חֶשְׁבּוֹן

- להשיג

- לרוחב

- פעיל

- כתובת

- משפיע

- אַלגוֹרִיתְם

- תעשיות

- מאפשר

- מאפשר

- כְּבָר

- חלופה

- תמיד

- כמות

- אחר

- נראה

- יישומית

- מריחה

- גישה

- סביב

- שהוקצה

- המשויך

- קהל מאזינים

- כי

- לפני

- להיות

- מוטב

- בֵּין

- מעבר

- לִבנוֹת

- בִּניָן

- יכולות

- כיתובים

- מקרה

- מקרים

- היאבקות

- קטגוריה

- גרם

- מסוים

- שינוי

- בדיקה

- בחרו

- בכיתה

- מיון

- מְסוּוָג

- שעון

- אוסף

- לעומת

- לחשב

- מחשוב

- מושג

- לשקול

- מכיל

- תוכן

- הקשרים

- להמשיך

- זכויות יוצרים

- הפרת זכויות יוצרים

- תוֹאֵם

- יכול

- לִיצוֹר

- נוצר

- יוצרים

- מכריע

- נוֹכְחִי

- כיום

- נתונים

- יְוֹם

- ימים

- החלטה

- עמוק

- דמוגרפיה

- פריסה

- לתאר

- למרות

- צעצועי התפתחות

- אחר

- קשה

- ישירות

- לגלות

- גילה

- מרחק

- מופץ

- הפצה

- מטה

- כפילויות

- בְּמַהֲלָך

- כל אחד

- השפעה

- יעילות

- יְעִילוּת

- תופעות

- יעיל

- מַאֲמָצִים

- מעודד

- במיוחד

- למעשה

- לְהַעֲרִיך

- וכו '

- להעריך

- הכל

- דוגמה

- דוגמאות

- אך ורק

- קיימים

- לצפות

- צפוי

- מהר יותר

- מאפיין

- תכונות

- מָשׁוֹב

- תרשים

- סינון

- מסננים

- בסופו של דבר

- מציאת

- ראשון

- לסדר

- מתמקד

- כדלקמן

- מצא

- החל מ-

- מלא

- פונקציה

- נוסף

- איסוף

- מין

- כללי

- בדרך כלל

- ליצור

- נוצר

- דור

- דורות

- גנרטטיבית

- מטרה

- טוב

- GPUs

- גרפיקה

- קְבוּצָה

- קבוצה

- מובטח

- קומץ

- לעזור

- עוזר

- כאן

- גָבוֹהַ

- איך

- אולם

- HTTPS

- בן אנוש

- בני אדם

- מאות

- רעיון

- לזהות

- תמונה

- תמונות

- הפעלה

- יושם

- חשוב

- לשפר

- משופר

- שיפור

- לכלול

- כלול

- כולל

- כולל

- מידע

- תשתית

- למשל

- אינטרנט

- לחקור

- סוגיה

- IT

- עצמו

- מפתח

- תווית

- תיוג

- תוויות

- שפה

- גָדוֹל

- גדול יותר

- לִלמוֹד

- למד

- למידה

- משפטי

- סביר

- נראה

- נראה

- לעשות

- סימן

- להתאים

- משמעותי

- אומר

- למדוד

- מדידת

- גברים

- יכול

- צבאי

- מיליונים

- משימה

- מודל

- מודלים

- יותר

- רוב

- מכפילים

- טבע

- הכרחי

- שלילי

- רשת

- מספר

- להזמין

- מאורגן

- מְקוֹרִי

- אחר

- בעלות

- חלק

- מסוים

- ביצועים

- ביצוע

- שלב

- חתיכות

- מתוכנן

- מדיניות

- חיובי

- אפשרי

- פוטנציאל

- חזק

- תרגול

- לחזות

- נבואה

- להציג

- מניעה

- קודם

- פְּרָטִיוּת

- בדיקה

- בעיה

- תהליך

- לייצר

- מיוצר

- מחאה

- פרוקסי

- רובע

- להעלות

- לְהַגִיעַ

- הבין

- סיבות

- להפחית

- מופחת

- הפחתה

- לשקף

- השתקפות

- נותר

- הסרת

- לייצג

- נציגות

- נציג

- בקשות

- לדרוש

- דורש

- תגובה

- וכתוצאה מכך

- לַחֲזוֹר

- סיכונים

- הפעלה

- אותו

- סולם

- תכנית

- חיפוש

- סט

- צורות

- שיתוף

- משמרת

- משמעותי

- דומה

- פָּשׁוּט

- since

- יחיד

- מידה

- קטן

- So

- לפתור

- כמה

- משהו

- מֶרחָב

- מיוחד

- במיוחד

- מפרט

- פיצולים

- שלבים

- התחלה

- אמור

- עוד

- לימוד

- הצלחה

- מערכת

- מערכות

- נטילת

- טכניקות

- טכנולוגיות

- מבחן

- השמיים

- לכן

- דברים

- בִּיסוֹדִיוּת

- שְׁלוֹשָׁה

- סף

- דרך

- זמן

- פִּי

- כלי

- חלק עליון

- לקראת

- רכבת

- הדרכה

- להבין

- התאחדות

- ייחודי

- us

- להשתמש

- אימות

- שונים

- לאמת

- גרסה

- רציתי

- מה

- אם

- בזמן

- בתוך

- לְלֹא

- נשים

- תיק עבודות

- עובד

- מודאג

- היה

- X