למרות האימוץ הבלתי ניתן לעצירה לכאורה של תכניות לימודים לתעשיות שונות, הן מהוות מרכיב אחד באקוסיסטם טכנולוגי רחב יותר שמניע את גל הבינה המלאכותית החדש. מקרים רבים של שימוש בבינה מלאכותית לשיחה דורשים LLMs כמו Llama 2, Flan T5 ו-Bloom כדי להגיב לשאילתות משתמשים. מודלים אלה מסתמכים על ידע פרמטרי כדי לענות על שאלות. המודל לומד ידע זה במהלך האימון ומצפין אותו לפרמטרים של המודל. על מנת לעדכן את הידע הזה, עלינו להכשיר מחדש את ה-LLM, דבר שלוקח הרבה זמן וכסף.

למרבה המזל, אנו יכולים גם להשתמש בידע מקור כדי ליידע את ה-LLMs שלנו. ידע מקור הוא מידע המוזן ל-LLM באמצעות הנחית קלט. גישה פופולרית אחת לאספקת ידע מקור היא Retrieval Augmented Generation (RAG). באמצעות RAG, אנו שואבים מידע רלוונטי ממקור נתונים חיצוני ומזינים מידע זה לתוך ה-LLM.

בפוסט זה בבלוג, נחקור כיצד לפרוס LLMs כגון Llama-2 באמצעות Amazon Sagemaker JumpStart ולשמור על LLMs שלנו מעודכנים במידע רלוונטי באמצעות Retrieval Augmented Generation (RAG) באמצעות מסד הנתונים הווקטוריים Pinecone על מנת למנוע הזיות AI .

Generation Augmented של אחזור (RAG) באמזון SageMaker

Pinecone יטפל ברכיב האחזור של RAG, אבל אתה צריך עוד שני רכיבים קריטיים: איפשהו כדי להפעיל את מסקנת ה-LLM ואיפשהו כדי להפעיל את מודל ההטמעה.

Amazon SageMaker Studio סביבת פיתוח משולבת (IDE) המספקת ממשק חזותי מבוסס אינטרנט בודד שבו אתה יכול לגשת לכלים ייעודיים לביצוע כל פיתוח למידת מכונה (ML). הוא מספק את SageMaker JumpStart שהוא מרכז מודל שבו משתמשים יכולים לאתר, להציג תצוגה מקדימה ולהשיק דגם מסוים בחשבון SageMaker משלהם. הוא מספק מודלים מאומנים מראש, זמינים לציבור וקנייניים עבור מגוון רחב של סוגי בעיות, כולל מודלים של בסיס.

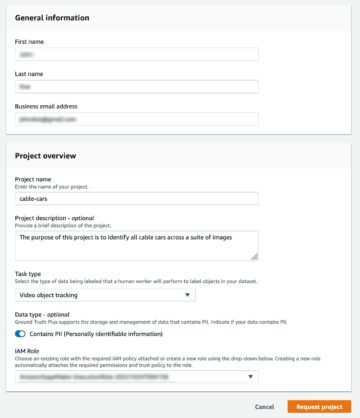

Amazon SageMaker Studio מספק את הסביבה האידיאלית לפיתוח צינורות LLM התומכים ב-RAG. ראשית, באמצעות קונסולת AWS, עבור אל Amazon SageMaker וצור דומיין של SageMaker Studio ופתח מחברת Jupyter Studio.

תנאים מוקדמים

השלם את השלבים המוקדמים הבאים:

- הגדר את Amazon SageMaker Studio.

- על הסיפון לדומיין של אמזון SageMaker.

- הירשם למסד נתונים של Pinecone Vector.

- ספריות דרוש: SageMaker Python SDK, Pinecone Client

הדרכה לפתרון

באמצעות מחברת SageMaker Studio, אנו צריכים קודם כל להתקין ספריות דרישות מוקדמות:

פריסת LLM

בפוסט זה, אנו דנים בשתי גישות לפריסת LLM. הראשון הוא דרך ה HuggingFaceModel לְהִתְנַגֵד. אתה יכול להשתמש בזה בעת פריסת LLMs (והטמעת דגמים) ישירות ממרכז המודלים של Hugging Face.

לדוגמה, אתה יכול ליצור תצורה הניתנת לפריסה עבור google/flan-t5-xl דגם כפי שמוצג בצילום המסך הבא:

בעת פריסת דגמים ישירות מ-Huging Face, אתחל את my_model_configuration עם העוקבים:

- An

envconfig אומר לנו באיזה דגם אנחנו רוצים להשתמש ולאיזו משימה. - ביצוע SageMaker שלנו

roleנותן לנו הרשאות לפרוס את המודל שלנו. - An

image_uriהוא תצורת תמונה במיוחד לפריסת LLMs מ-Huging Face.

לחלופין, ל- SageMaker יש סט של דגמים התואמים ישירות עם פשוט יותר JumpStartModel לְהִתְנַגֵד. LLMs פופולריים רבים כמו Llama 2 נתמכים על ידי דגם זה, אותו ניתן לאתחל כפי שמוצג בצילום המסך הבא:

עבור שתי הגרסאות של my_model, פרוס אותם כפי שמוצג בצילום המסך הבא:

עם נקודת הקצה ה-LLM המותאמת שלנו, אתה יכול להתחיל לבצע שאילתות. הפורמט של השאילתות שלנו עשוי להשתנות (במיוחד בין לימודי LLM לשיחה ללא שיחה), אבל התהליך הוא בדרך כלל זהה. עבור דגם החיבוק, בצע את הפעולות הבאות:

אתה יכול למצוא את הפתרון ב מאגר GitHub.

התשובה שנוצרה שאנו מקבלים כאן אינה הגיונית במיוחד - זו הזיה.

מתן הקשר נוסף ל-LLM

לאמה 2 מנסה לענות על השאלה שלנו על סמך ידע פרמטרי פנימי בלבד. ברור שהפרמטרים של המודל אינם מאחסנים ידע באילו מקרים אנו יכולים עם אימון נקודתי מנוהל ב- SageMaker.

כדי לענות נכון על שאלה זו, עלינו להשתמש בידע מקור. כלומר, אנו נותנים מידע נוסף ל-LLM באמצעות ההנחיה. בואו נוסיף את המידע הזה ישירות כהקשר נוסף עבור המודל.

כעת אנו רואים את התשובה הנכונה לשאלה; זה היה קל! עם זאת, לא סביר שמשתמש יוסיף הקשרים להנחיות שלו, הוא כבר ידע את התשובה לשאלתו.

במקום להוסיף ידנית הקשר בודד, זהה אוטומטית מידע רלוונטי ממסד נתונים נרחב יותר של מידע. לשם כך, תזדקק ל-Retrieval Augmented Generation.

אחזור דור מוגבר

עם Retrieval Augmented Generation, אתה יכול לקודד מסד נתונים של מידע למרחב וקטור שבו הקרבה בין הוקטורים מייצגת את הרלוונטיות/הדמיון הסמנטי שלהם. עם מרחב וקטור זה כבסיס ידע, אתה יכול להמיר שאילתת משתמש חדשה, לקודד אותה לאותו מרחב וקטור, ולאחזר את הרשומות הרלוונטיות ביותר שנוספו בעבר לאינדקס.

לאחר אחזור הרשומות הרלוונטיות הללו, בחר כמה מהם וכלול אותם בהנחיית ה-LLM כהקשר נוסף, כדי לספק ל-LLM ידע מקור רלוונטי ביותר. זהו תהליך דו-שלבי שבו:

- יצירת אינדקס מאכלסת את האינדקס הווקטורי במידע ממערך נתונים.

- השליפה מתרחשת במהלך שאילתה והיא המקום שבו אנו שואבים מידע רלוונטי מהאינדקס הווקטורי.

שני השלבים דורשים מודל הטמעה כדי לתרגם את הטקסט הפשוט הניתן לקריאה אנושית למרחב וקטור סמנטי. השתמש בשנאי המשפטים היעיל ביותר של MiniLM מבית Hugging Face כפי שמוצג בצילום המסך הבא. דגם זה אינו LLM ולכן אינו מאותחל באותו אופן כמו דגם ה-Llama 2 שלנו.

ב hub_config, ציין את מזהה הדגם כפי שמוצג בצילום המסך למעלה, אך עבור המשימה, השתמש בחילוץ תכונה מכיוון שאנו מייצרים הטמעות וקטוריות ולא טקסט כמו ה-LLM שלנו. לאחר מכן, אתחל את תצורת המודל עם HuggingFaceModel כמו קודם, אבל הפעם ללא תמונת LLM ועם כמה פרמטרים של גרסה.

אתה יכול לפרוס את המודל שוב עם deploy, באמצעות המופע הקטן יותר (מעבד בלבד) של ml.t2.large. דגם ה-MiniLM הוא זעיר, כך שהוא אינו דורש הרבה זיכרון ואינו זקוק ל-GPU מכיוון שהוא יכול ליצור הטבעות במהירות אפילו על מעבד. אם תעדיף, תוכל להריץ את הדגם מהר יותר ב-GPU.

כדי ליצור הטבעות, השתמש ב- predict שיטה ולהעביר רשימה של הקשרים לקידוד באמצעות inputs מפתח כפי שמוצג:

שני הקשרי קלט מועברים, ומחזירים שתי הטבעות וקטוריות של הקשר כפי שמוצג:

len(out)

2

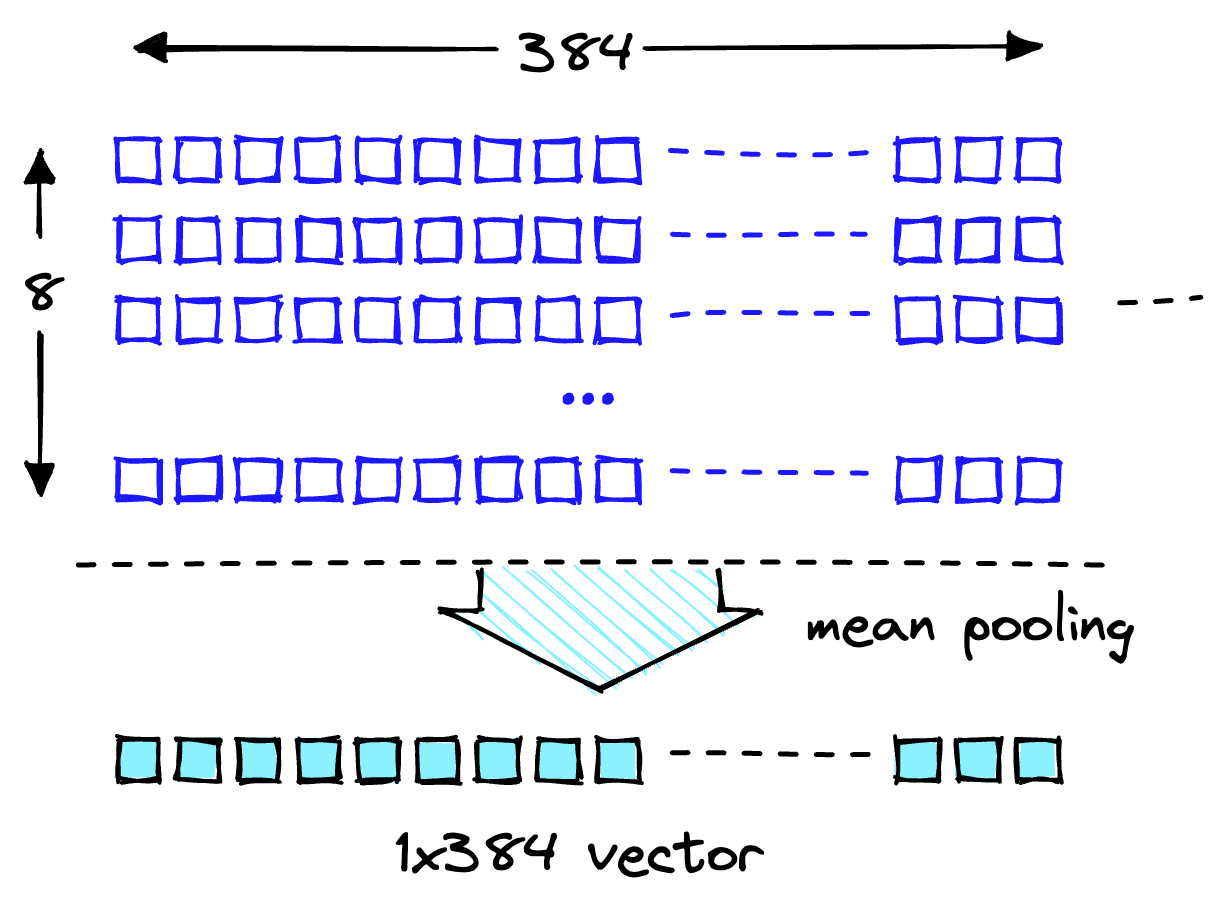

הממדיות ההטמעת של מודל MiniLM היא 384 מה שאומר שלכל וקטור הטמעת פלטי MiniLM צריכה להיות ממדיות של 384. עם זאת, בהסתכלות על אורך ההטבעות שלנו, תראה את הדברים הבאים:

len(out[0]), len(out[1])

(8, 8)

שתי רשימות מכילות שמונה פריטים כל אחת. MiniLM מעבד תחילה טקסט בשלב טוקניזציה. אסימון זה הופך את הטקסט הפשוט הניתן לקריאה אנושית לרשימה של מזהי אסימון הניתנים לקריאה במודל. בתכונות הפלט של הדגם, אתה יכול לראות את ההטמעות ברמת האסימון. אחת ההטבעות הללו מציגה את הממדיות הצפויה של 384 כפי שמוצג:

len(out[0][0])

384

הפוך את ההטבעות הללו ברמת האסימון להטבעות ברמת המסמך על ידי שימוש בערכים הממוצעים על פני כל ממד וקטור, כפי שמוצג באיור הבא.

ממוצע פעולת איגום כדי לקבל וקטור יחיד של 384 מימדים.

עם שתי הטבעות וקטוריות 384 מימדיות, אחת לכל טקסט קלט. כדי להקל על חיינו, עטפו את תהליך הקידוד לפונקציה אחת כפי שמוצג בצילום המסך הבא:

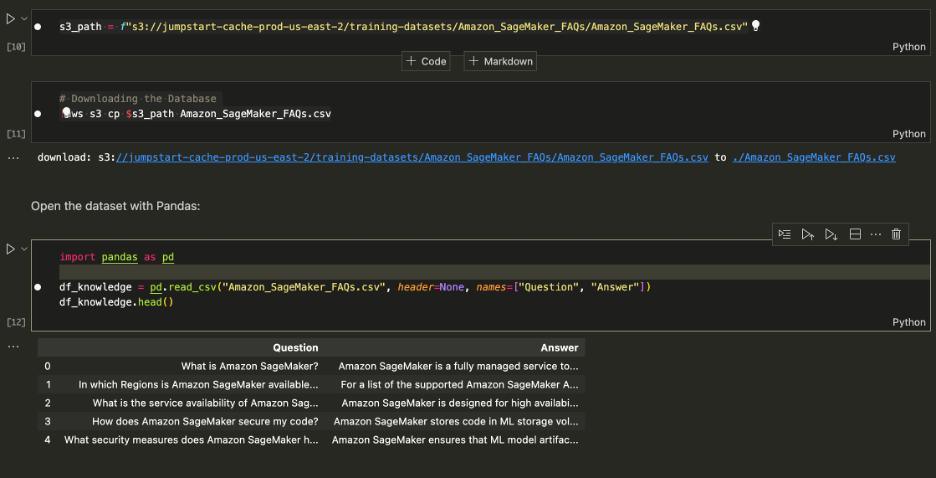

הורדת מערך הנתונים

הורד את השאלות הנפוצות של Amazon SageMaker כבסיס הידע כדי לקבל את הנתונים המכילים עמודות שאלות ותשובות.

הורד את השאלות הנפוצות של Amazon SageMaker

בעת ביצוע החיפוש, חפש תשובות בלבד, כדי שתוכל לשחרר את העמודה 'שאלה'. ראה מחברת לפרטים.

מערך הנתונים שלנו וצינור ההטמעה מוכנים. עכשיו כל מה שאנחנו צריכים זה איפה לאחסן את ההטבעות האלה.

מפתוח

מסד הנתונים הווקטוריים של Pinecone מאחסן הטמעות וקטוריות ומחפש אותן ביעילות בקנה מידה. כדי ליצור מסד נתונים, תזדקק למפתח API בחינם מ- Pinecone.

לאחר שהתחברתם למסד הנתונים הווקטוריים של Pinecone, צרו אינדקס וקטור יחיד (בדומה לטבלה ב-DBs מסורתיים). תן שם לאינדקס retrieval-augmentation-aws ויישר את המדד dimension ו metric פרמטרים עם אלה הנדרשים על ידי מודל ההטמעה (MiniLM במקרה זה).

כדי להתחיל בהכנסת נתונים, הפעל את הפעולות הבאות:

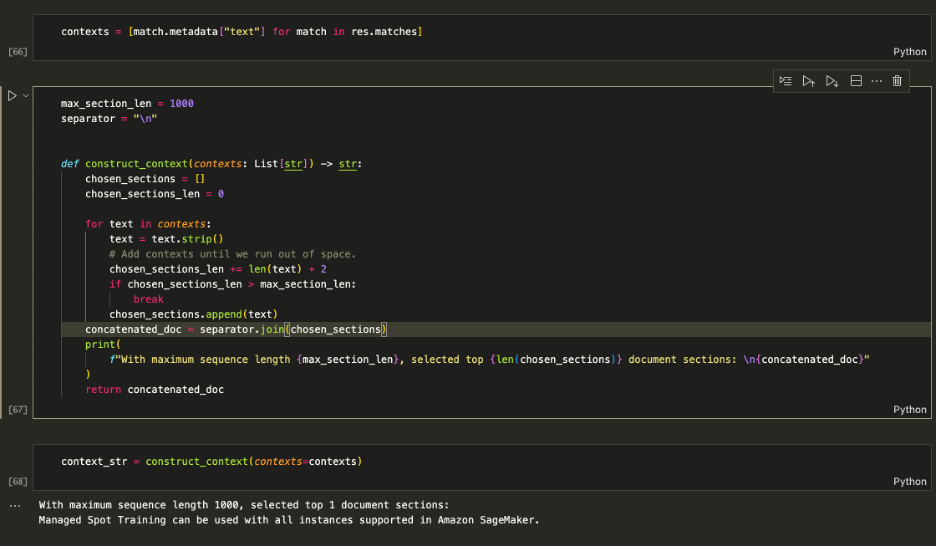

אתה יכול להתחיל לשאול את האינדקס עם השאלה מקודם בפוסט זה.

הפלט שלמעלה מראה שאנחנו מחזירים הקשרים רלוונטיים כדי לעזור לנו לענות על השאלה שלנו. מאז שאנחנו top_k = 1, index.query החזיר את התוצאה העליונה לצד המטא נתונים שקוראים Managed Spot Training can be used with all instances supported in Amazon.

הגדלת ההנחיה

השתמש בהקשרים שאוחזרו כדי להגביר את ההנחיה ולהחליט על כמות מרבית של הקשר להזנה ל-LLM. להשתמש ב 1000 תווים מוגבלים כדי להוסיף באופן איטרטיבי כל הקשר שהוחזר להנחיה עד שתחרוג מאורך התוכן.

הגדלת ההנחיה

הזן את context_str לתוך שורת LLM כפי שמוצג בצילום המסך הבא:

[קלט]: באילו מופעים אוכל להשתמש עם Managed Spot Training ב- SageMaker? [פלט]: בהתבסס על ההקשר שסופק, אתה יכול להשתמש ב-Managed Spot Training עם כל המופעים הנתמכים באמזון SageMaker. לכן, התשובה היא: כל המופעים נתמכים באמזון SageMaker.

ההיגיון עובד, אז עטפו אותו בפונקציה אחת כדי לשמור על דברים נקיים.

כעת תוכל לשאול שאלות כמו אלה המוצגות בסעיף הבא:

לנקות את

כדי להפסיק לגבות חיובים לא רצויים, מחק את הדגם ואת נקודת הקצה.

סיכום

בפוסט זה, הכרנו לכם את RAG עם LLMs בגישה פתוחה ב- SageMaker. הראינו גם כיצד לפרוס דגמי אמזון SageMaker Jumpstart עם Llama 2, Hugging Face LLMs עם Flan T5, והטמעת דגמים עם MiniLM.

הטמענו צינור RAG שלם מקצה לקצה באמצעות מודלים של גישה פתוחה שלנו ואינדקס וקטור Pinecone. באמצעות זה, הראינו כיצד למזער הזיות, ולשמור על הידע של LLM עדכני, ובסופו של דבר לשפר את חווית המשתמש והאמון במערכות שלנו.

כדי להריץ את הדוגמה הזו בעצמך, שכפל מאגר GitHub זה ועבור על השלבים הקודמים באמצעות מחברת תשובות לשאלות ב-GitHub.

על המחברים

וודנט ג'יין הוא מומחה בינה מלאכותית/ML, שעובד על יוזמות אסטרטגיות של AI. לפני הצטרפותו ל-AWS, Vedant כיהן בתפקידי ML/Data Science Specialty בחברות שונות כגון Databricks, Hortonworks (כיום Cloudera) ו-JP Morgan Chase. מחוץ לעבודתו, Vedant מתלהב מיצירת מוזיקה, טיפוס צוקים, שימוש במדע כדי לנהל חיים משמעותיים ולחקור מאכלים מכל העולם.

וודנט ג'יין הוא מומחה בינה מלאכותית/ML, שעובד על יוזמות אסטרטגיות של AI. לפני הצטרפותו ל-AWS, Vedant כיהן בתפקידי ML/Data Science Specialty בחברות שונות כגון Databricks, Hortonworks (כיום Cloudera) ו-JP Morgan Chase. מחוץ לעבודתו, Vedant מתלהב מיצירת מוזיקה, טיפוס צוקים, שימוש במדע כדי לנהל חיים משמעותיים ולחקור מאכלים מכל העולם.

ג'יימס בריגס הוא עורך דין למפתחי צוות ב- Pinecone, המתמחה בחיפוש וקטור ובינה מלאכותית/ML. הוא מדריך מפתחים ועסקים בפיתוח פתרונות GenAI משלהם באמצעות חינוך מקוון. לפני פיינקון ג'יימס עבד על בינה מלאכותית עבור סטארט-אפים טכנולוגיים קטנים ועד לתאגידי פיננסים מבוססים. מחוץ לעבודה, לג'יימס יש תשוקה לטייל ולאמץ הרפתקאות חדשות, החל מגלישה וצלילה ועד Muay Thai ו-BJJ.

ג'יימס בריגס הוא עורך דין למפתחי צוות ב- Pinecone, המתמחה בחיפוש וקטור ובינה מלאכותית/ML. הוא מדריך מפתחים ועסקים בפיתוח פתרונות GenAI משלהם באמצעות חינוך מקוון. לפני פיינקון ג'יימס עבד על בינה מלאכותית עבור סטארט-אפים טכנולוגיים קטנים ועד לתאגידי פיננסים מבוססים. מחוץ לעבודה, לג'יימס יש תשוקה לטייל ולאמץ הרפתקאות חדשות, החל מגלישה וצלילה ועד Muay Thai ו-BJJ.

שין הואנג הוא מדען יישומי בכיר עבור האלגוריתמים המובנים של Amazon SageMaker JumpStart ו-Amazon SageMaker. הוא מתמקד בפיתוח אלגוריתמים של למידת מכונה ניתנים להרחבה. תחומי העניין שלו במחקר הם בתחום של עיבוד שפה טבעית, למידה עמוקה הניתנת להסבר על נתונים טבלאיים וניתוח חזק של צבירת מרחב-זמן לא פרמטרית. הוא פרסם מאמרים רבים בכנסים של ACL, ICDM, KDD וב-Royal Statistic Society: Series A.

שין הואנג הוא מדען יישומי בכיר עבור האלגוריתמים המובנים של Amazon SageMaker JumpStart ו-Amazon SageMaker. הוא מתמקד בפיתוח אלגוריתמים של למידת מכונה ניתנים להרחבה. תחומי העניין שלו במחקר הם בתחום של עיבוד שפה טבעית, למידה עמוקה הניתנת להסבר על נתונים טבלאיים וניתוח חזק של צבירת מרחב-זמן לא פרמטרית. הוא פרסם מאמרים רבים בכנסים של ACL, ICDM, KDD וב-Royal Statistic Society: Series A.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- אודות

- מֵעַל

- גישה

- פי

- חֶשְׁבּוֹן

- לרוחב

- להוסיף

- נוסף

- מידע נוסף

- אימוץ

- הרפתקאות

- עו"ד

- שוב

- AI

- מקרי שימוש

- AI / ML

- אלגוריתמים

- ליישר

- תעשיות

- לאורך

- כְּבָר

- גם

- אמזון בעברית

- אמזון SageMaker

- אמזון SageMaker JumpStart

- סטודיו SageMaker של אמזון

- אמזון שירותי אינטרנט

- כמות

- an

- אנליזה

- ו

- לענות

- תשובות

- כל

- API

- האפליקציה

- יישומית

- גישה

- גישות

- ARE

- AREA

- סביב

- AS

- לשאול

- At

- ניסיונות

- לְהַגדִיל

- מוגבר

- המכונית

- באופן אוטומטי

- זמין

- AWS

- בסיס

- מבוסס

- BE

- כי

- לפני

- להתחיל

- בֵּין

- בלוג

- לִפְרוֹחַ

- שניהם

- רחב

- לִבנוֹת

- מובנה

- עסקים

- אבל

- by

- CAN

- ללכוד

- מקרה

- מקרים

- תווים

- חיובים

- מרדף

- לְנַקוֹת

- בבירור

- טיפוס

- קלודרה

- קיבוץ

- טור

- עמודות

- חברות

- תואם

- להשלים

- רְכִיב

- רכיבים

- כנסים

- מחובר

- קונסול

- להכיל

- מכיל

- תוכן

- הקשר

- הקשרים

- שיחה

- AI שיחה

- להמיר

- תאגידים

- לתקן

- צורה נכונה

- לִיצוֹר

- קריטי

- כיום

- נתונים

- מסד נתונים

- תַאֲרִיך

- .די .בי אס

- להחליט

- עמוק

- למידה עמוקה

- לפרוס

- פריסה

- מפתח

- מפתחים

- מתפתח

- צעצועי התפתחות

- מֵמַד

- ישירות

- לדון

- do

- עושה

- לא איכפת

- לא

- תחום

- דון

- ירידה

- בְּמַהֲלָך

- כל אחד

- מוקדם יותר

- קל יותר

- המערכת האקולוגית

- חינוך

- יעיל

- יעילות

- הטבעה

- מחבק

- הַצפָּנָה

- סוף

- מקצה לקצה

- נקודת קצה

- להגביר את

- סביבה

- נוסד

- אֲפִילוּ

- דוגמה

- עולה על

- הוצאת להורג

- צפוי

- ניסיון

- לחקור

- היכרות

- נרחב

- חיצוני

- תמצית

- פָּנִים

- מהר יותר

- תכונות

- הפד

- מעטים

- לממן

- גימור

- ראשון

- לָצוּף

- מתמקד

- הבא

- בעד

- פוּרמָט

- קרן

- חופשי

- החל מ-

- פונקציה

- בדרך כלל

- נוצר

- יצירת

- דור

- גנרטטיבית

- AI Generative

- לקבל

- GitHub

- לתת

- נתן

- נותן

- Go

- Goes

- GPU

- מדריך

- לטפל

- קורה

- יש

- he

- הוחזק

- לעזור

- כאן

- מאוד

- שֶׁלוֹ

- איך

- איך

- אולם

- HTTPS

- huang

- טבור

- חיבוק פנים

- קריא אדם

- i

- ID

- אידאל

- לזהות

- מזהה

- if

- תמונה

- יושם

- לייבא

- in

- לכלול

- כולל

- להגדיל

- מדד

- -

- תעשיות

- לְהוֹדִיעַ

- מידע

- יוזמות

- קלט

- תשומות

- להתקין

- למשל

- משולב

- אינטרסים

- מִמְשָׁק

- פנימי

- אל תוך

- הציג

- IT

- פריטים

- ג'יימס

- הצטרפות

- jp

- JP מורגן

- ג'יי.פי מורגן צ'ייס

- jpg

- שמור

- מפתח

- לדעת

- ידע

- שפה

- גָדוֹל

- גדול יותר

- לשגר

- עוֹפֶרֶת

- למידה

- לומד

- אורך

- ספריות

- החיים

- כמו

- להגביל

- רשימה

- רשימות

- חי

- לאמה

- LLM

- הגיון

- נראה

- הסתכלות

- מגרש

- מכונה

- למידת מכונה

- לעשות

- עשייה

- הצליח

- באופן ידני

- רב

- להתאים

- גפרורים

- מקסימום

- כמות מקסימלית

- מאי..

- אומר

- משמעותי

- אומר

- זכרון

- מידע נוסף

- שיטה

- להקל

- ML

- מודל

- מודלים

- כסף

- יותר

- מורגן

- רוב

- הרבה

- מספר

- כלי נגינה

- צריך

- שם

- טבעי

- עיבוד שפה טבעית

- צורך

- צרכי

- חדש

- הבא

- NLP

- מחברה

- עַכשָׁיו

- קהות

- אובייקט

- of

- on

- ONE

- באינטרנט

- רק

- לפתוח

- מבצע

- or

- להזמין

- OS

- אַחֶרֶת

- שלנו

- הַחוּצָה

- תפוקה

- פלטים

- בחוץ

- שֶׁלוֹ

- ניירות

- פרמטרים

- מסוים

- במיוחד

- לעבור

- עבר

- תשוקה

- לוהט

- לְבַצֵעַ

- ביצוע

- הרשאות

- תמונה

- צינור

- מישור

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- פופולרי

- עמדות

- הודעה

- כוח

- נבואה

- התחזיות

- חיזוי

- מועדף

- למנוע

- תצוגה מקדימה

- קודם

- קוֹדֶם

- קודם

- בעיה

- תהליך

- תהליכים

- תהליך

- פּרוֹפִיל

- הנחיות

- קניינית

- ובלבד

- מספק

- מתן

- בפומבי

- לאור

- פיתון

- פיטורך

- שאילתות

- שאלה

- שאלות

- מהירות

- רכס

- טִוּוּחַ

- מוכן

- קבלה

- רשום

- אזורים

- רלוונטי

- לסמוך

- מאגר

- מייצג

- לדרוש

- נדרש

- מחקר

- להגיב

- תוצאה

- תוצאות

- לַחֲזוֹר

- חוזר

- חָסוֹן

- סלע

- תפקיד

- מלכותי

- הפעלה

- פועל

- בעל חכמים

- אותו

- לומר

- להרחבה

- סולם

- מדע

- מַדְעָן

- ציון

- מסך

- Sdk

- חיפוש

- חיפושים

- לִרְאוֹת

- לִכאוֹרָה

- בחר

- לחצני מצוקה לפנסיונרים

- תחושה

- משפט

- סדרה

- סדרה א '

- שירותים

- סט

- צריך

- לְהַצִיג

- הראה

- הראה

- הופעות

- צד

- דומה

- פשוט יותר

- since

- יחיד

- מידה

- קטן

- קטן יותר

- So

- חֶברָה

- אך ורק

- פִּתָרוֹן

- פתרונות

- כמה

- אי שם

- מָקוֹר

- מֶרחָב

- מומחה

- מתמחה

- התמחות

- במיוחד

- מסחרי

- סגל

- חברות סטארט

- סטטיסטי

- שלב

- צעדים

- עצור

- חנות

- חנויות

- אסטרטגי

- מחרוזת

- סטודיו

- כזה

- תמיכה

- נתמך

- תומך

- מערכת

- מערכות

- שולחן

- לוקח

- המשימות

- טק

- סטארט-אפים טכניים

- טכנולוגיה

- אומר

- טֶקסט

- תאילנדי

- מֵאֲשֶׁר

- זֶה

- השמיים

- האזור

- העולם

- שֶׁלָהֶם

- אותם

- לכן

- אלה

- הֵם

- דברים

- זֶה

- אלה

- דרך

- זמן

- ל

- אסימון

- טוקניזציה

- גַם

- כלים

- חלק עליון

- מסורתי

- הדרכה

- שנאי

- רוֹבּוֹטרִיקִים

- התמרות

- לתרגם

- נסיעה

- סומך

- שתיים

- סוגים

- בסופו של דבר

- לא סביר

- בלתי ניתנים לעצירה.

- עד

- לא רצוי

- עדכון

- us

- להשתמש

- מְשׁוּמָשׁ

- משתמש

- חוויית משתמש

- משתמשים

- באמצעות

- ערכים

- שונים

- גרסה

- גירסאות

- באמצעות

- חזותי

- לחכות

- בהדרכה

- רוצה

- היה

- גל

- דֶרֶך..

- we

- אינטרנט

- שירותי אינטרנט

- המבוסס על האינטרנט

- מה

- מתי

- אשר

- בזמן

- רָחָב

- טווח רחב

- יצטרך

- עם

- לְלֹא

- תיק עבודות

- עבד

- עובד

- עובד

- עוֹלָם

- היה

- לעטוף

- X

- כן

- אתה

- זפירנט