יישומי למידת מכונה (ML) מורכבים לפריסה ולעתים קרובות דורשים יכולת להרחיב קנה מידה, ויש להם דרישות חביון נמוכות במיוחד ותקציבי עלויות מחמירים. מקרי שימוש כגון זיהוי הונאה, המלצות למוצרים וחיזוי תנועה הם דוגמאות שבהן אלפיות השנייה חשובות והן קריטיות להצלחת העסק. יש לעמוד בהסכמי רמת שירות (SLA) קפדניים, ובקשה טיפוסית עשויה לדרוש מספר שלבים כגון עיבוד מקדים, טרנספורמציה של נתונים, הנדסת תכונות, לוגיקה של בחירת מודל, צבירת מודל ועיבוד לאחר.

פריסת מודלים של ML בקנה מידה עם עלות אופטימלית ויעילות מחשוב יכולה להיות משימה מרתיעה ומסורבלת. לכל דגם יש יתרונות ותלות משלו בהתבסס על מקורות הנתונים החיצוניים, כמו גם סביבת זמן ריצה כגון כוח CPU/GPU של משאבי המחשוב הבסיסיים. יישום עשוי לדרוש מספר דגמי ML כדי לשרת בקשת הסקה אחת. בתרחישים מסוימים, בקשה עשויה לזרום על פני מספר דגמים. אין גישה אחת שמתאימה לכולם, וחשוב לעוסקים ב-ML לחפש שיטות מוכחות להתמודדות עם אתגרי אירוח חוזרים ונשנים של ML. זה הוביל לאבולוציה של דפוסי עיצוב עבור אירוח דגמי ML.

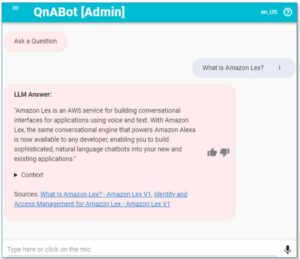

בפוסט זה, אנו בוחנים דפוסי עיצוב נפוצים לבניית יישומי ML עליהם אמזון SageMaker.

עיצוב תבניות לבניית יישומי ML

בואו נסתכל על דפוסי העיצוב הבאים לשימוש עבור אירוח יישומי ML.

יישומי ML מבוססי דגם יחיד

זוהי אפשרות מצוינת כאשר מקרה השימוש ב-ML שלך מצריך דגם יחיד כדי להגיש בקשה. המודל נפרס על תשתית מחשוב ייעודית עם יכולת קנה מידה על סמך תעבורת הקלט. אפשרות זו אידיאלית גם כאשר ליישום הלקוח יש דרישת הסקת השהייה נמוכה (בסדר של אלפיות שניות או שניות).

יישומי ML מבוססי ריבוי דגמים

כדי להפוך את האירוח לחסכוני יותר, דפוס עיצוב זה מאפשר לך לארח מספר דגמים על אותה תשתית דייר. דגמי ML מרובים יכולים לחלוק את משאבי המארח או המכולה, כולל אחסון במטמון של דגמי ה-ML הנפוצים ביותר בזיכרון, וכתוצאה מכך ניצול טוב יותר של משאבי הזיכרון והמחשוב. בהתאם לסוגי הדגמים שבחרת לפרוס, אירוח משותף של מודלים עשוי להשתמש בשיטות הבאות:

- אירוח רב דגמים - אפשרות זו מאפשרת לך לארח מספר דגמים באמצעות מיכל הגשה משותף בנקודת קצה אחת. תכונה זו אידיאלית כאשר יש לך מספר רב של דגמים דומים שתוכל להגיש באמצעות מיכל הגשה משותף ואין צורך לגשת לכל הדגמים בו זמנית.

- אירוח ריבוי מכולות – אפשרות זו אידיאלית כאשר יש לך מספר דגמים הפועלים על ערימות הגשה שונות עם צורכי משאבים דומים, וכאשר למודלים בודדים אין מספיק תעבורה כדי לנצל את מלוא הקיבולת של מופעי נקודות הקצה. אירוח ריבוי מכולות מאפשר לך לפרוס קונטיינרים מרובים המשתמשים במודלים או מסגרות שונות בנקודת קצה אחת. הדגמים יכולים להיות הטרוגניים לחלוטין, עם ערימת הגשה עצמאית משלהם.

- הרכבי דוגמניות - במקרים רבים של שימוש בייצור, לעתים קרובות יכולים להיות מודלים רבים במעלה הזרם המזינים תשומות למודל נתון במורד הזרם. זה המקום שבו הרכבים שימושיים. דפוסי אנסמבל כוללים ערבוב פלט מדגם בסיס אחד או יותר על מנת לצמצם את שגיאת הכללה של התחזית. דגמי הבסיס יכולים להיות מגוונים ומאומנים על ידי אלגוריתמים שונים. הרכבי מודל יכולים להעלות ביצועים גבוהים יותר ממודלים בודדים מכיוון ששגיאת החיזוי של המודל פוחתת כאשר נעשה שימוש בגישת האנסמבל.

להלן מקרי שימוש נפוצים של דפוסי אנסמבל ודיאגרמות דפוסי העיצוב התואמות להם:

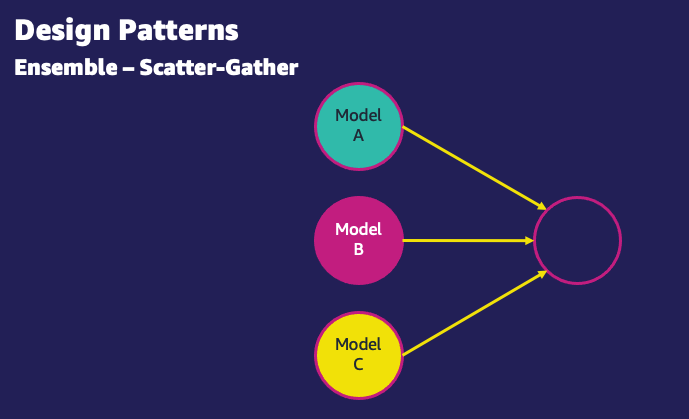

- פיזור-לאסוף – בתבנית פיזור-איסוף, בקשה להסקת מסקנות מנותבת למספר דגמים. לאחר מכן נעשה שימוש בצבר כדי לאסוף את התגובות ולזקק אותן לתגובת מסקנות אחת. לדוגמה, מקרה שימוש בסיווג תמונה עשוי להשתמש בשלושה מודלים שונים לביצוע המשימה. דפוס הפיזור מאפשר לך לשלב תוצאות ממסקנות המופעלות בשלושה מודלים שונים ולבחור את מודל הסיווג הסביר ביותר.

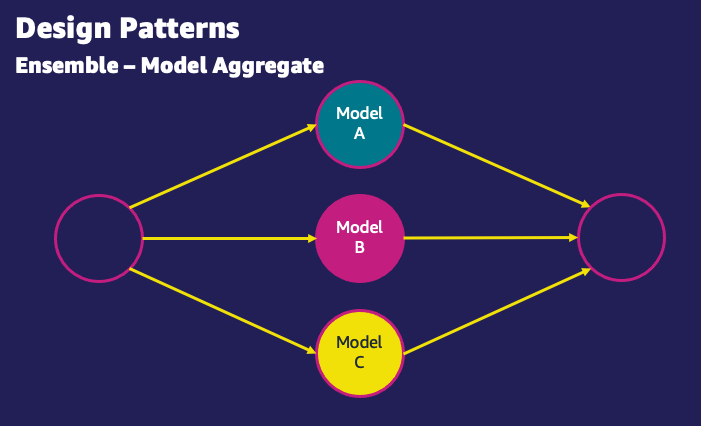

- מצטבר דגם – בדפוס צבירה, ממוצעים של תפוקות ממספר מודלים. עבור מודלים של סיווג, תחזיות של מודלים מרובים מוערכות כדי לקבוע את הכיתה שקיבלה את מירב ההצבעות ומטופלת כאל הפלט הסופי של ההרכב. לדוגמה, בבעיית סיווג דו-מחלקה לסווג קבוצה של פירות כתפוזים או תפוחים, אם שני דגמים מצביעים לתפוז ודגם אחד מצביע לתפוח, אז התפוקה המצטברת תהיה תפוז. אגרגציה עוזרת להילחם באי דיוק במודלים בודדים והופכת את הפלט למדויק יותר.

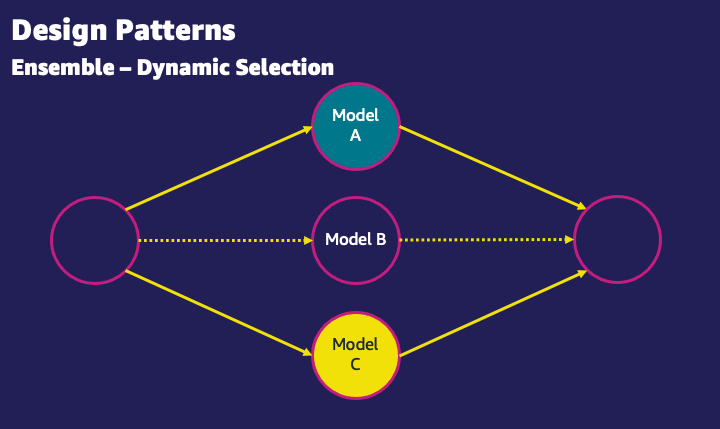

- בחירה דינמית - דפוס נוסף עבור מודלים של אנסמבל הוא לבצע באופן דינמי בחירת מודל עבור תכונות הקלט הנתונות. לדוגמה, בקלט נתון של תמונות של פירות, אם הקלט מכיל תפוז, דגם A ישמש מכיוון שהוא מתמחה לתפוזים. אם הקלט מכיל תפוח, דגם B ישמש מכיוון שהוא מתמחה לתפוחים.

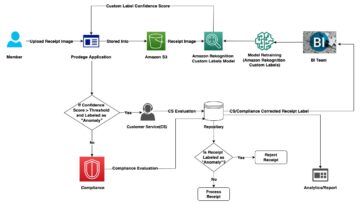

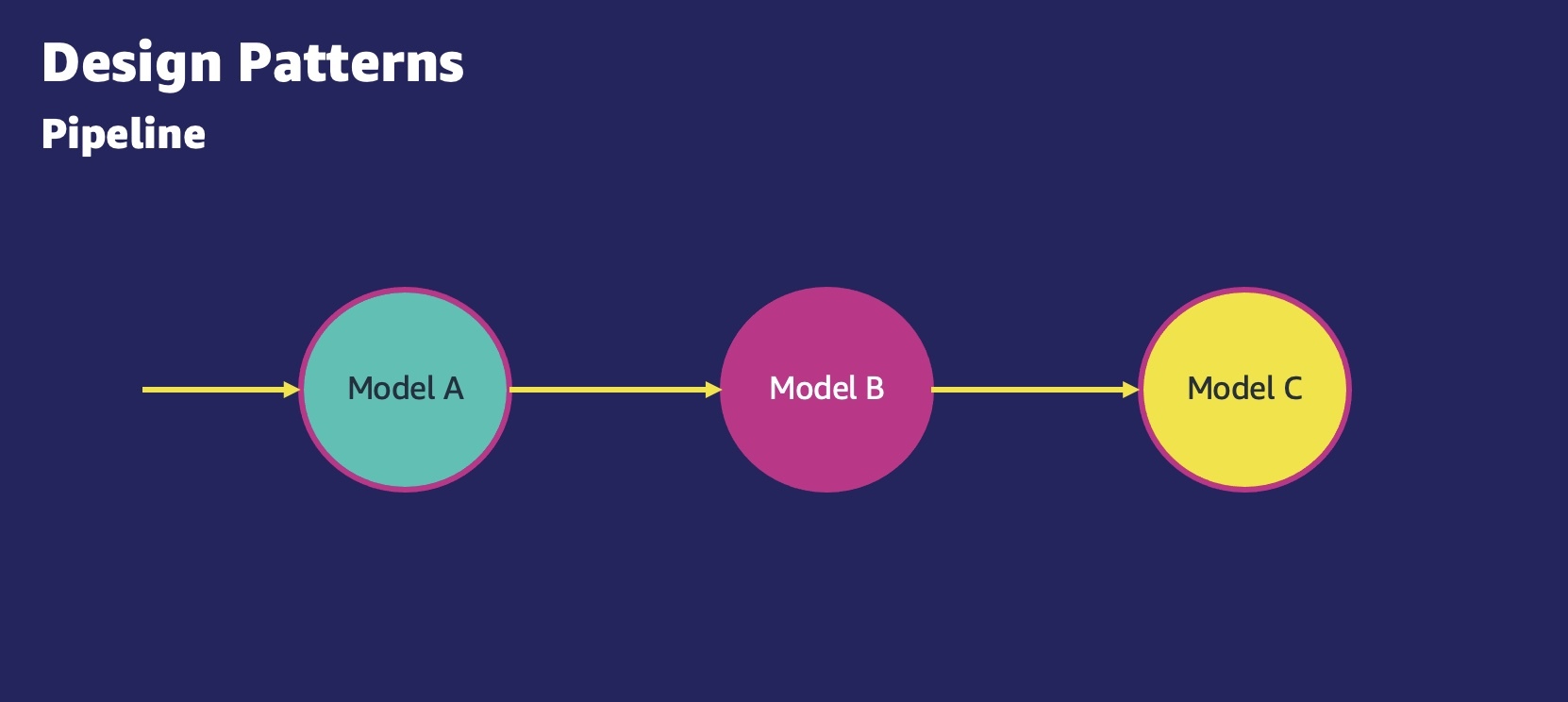

- יישומי ML מסקנות סדרתיות - עם דפוס היסק סדרתי, המכונה גם צינור מסקנות, למקרי שימוש יש דרישות לעיבוד מוקדם של נתונים נכנסים לפני הפעלת מודל ML מיומן מראש להפקת מסקנות. בנוסף, במקרים מסוימים, ייתכן שיהיה צורך לעבד את המסקנות שנוצרו, כך שניתן יהיה לצרוך אותן בקלות על ידי יישומים במורד הזרם. צינור מסקנות מאפשר לך לעשות שימוש חוזר באותו קוד עיבוד מקדים המשמש במהלך אימון המודלים כדי לעבד את נתוני בקשת ההסקה המשמשים לחיזויים.

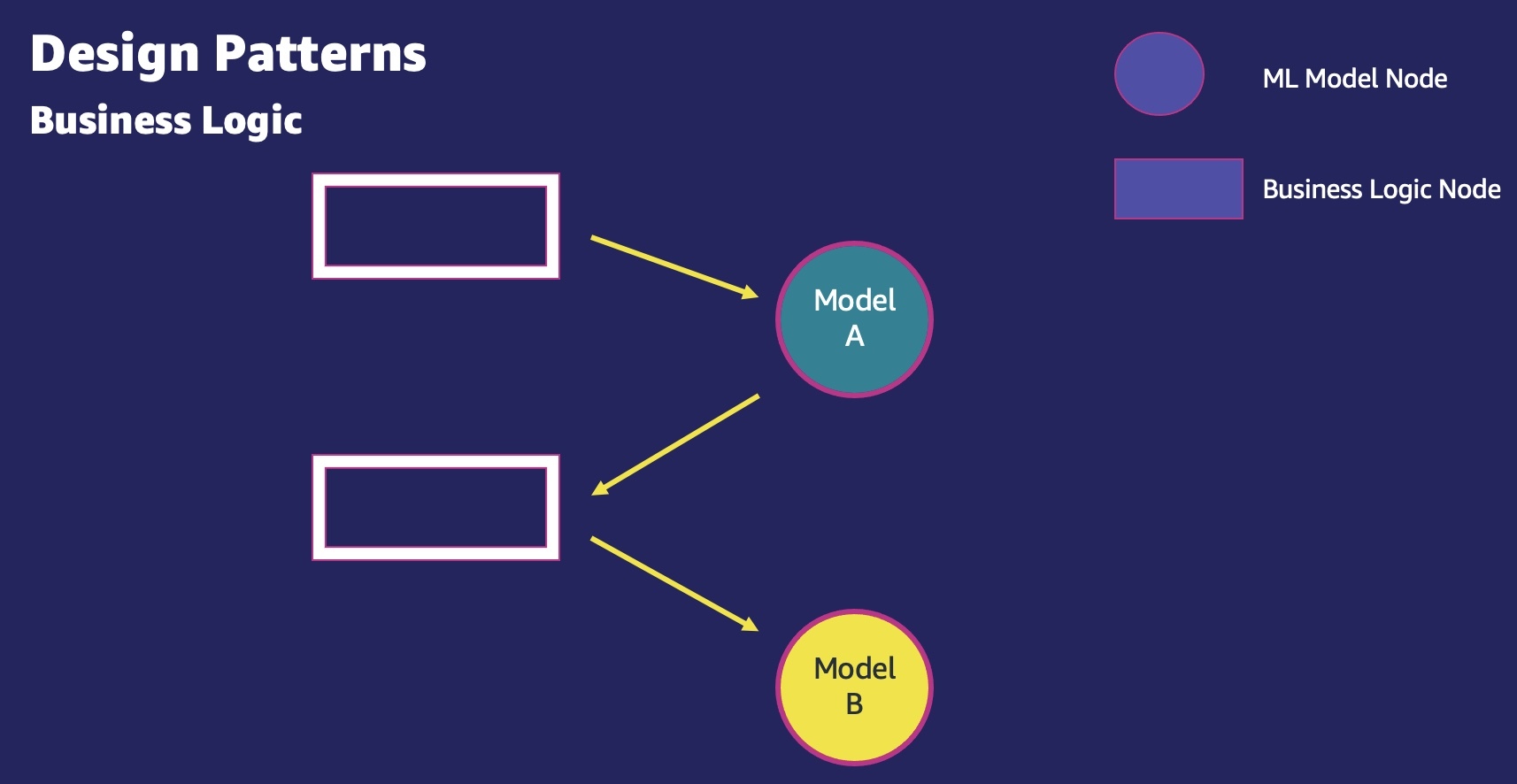

- היגיון עסקי - ייצור ML תמיד כרוך בהיגיון עסקי. דפוסי לוגיקה עסקית כוללים את כל מה שנדרש לביצוע משימת ML שאינה מסקנת מודל ML. זה כולל טעינת הדגם מ שירות אחסון פשוט של אמזון (Amazon S3), למשל, חיפושי מסד נתונים כדי לאמת את הקלט, השגת תכונות מחושבות מראש מחנות הפיצ'רים וכן הלאה. לאחר השלמת שלבי ההיגיון העסקי הללו, התשומות מועברות למודלים של ML.

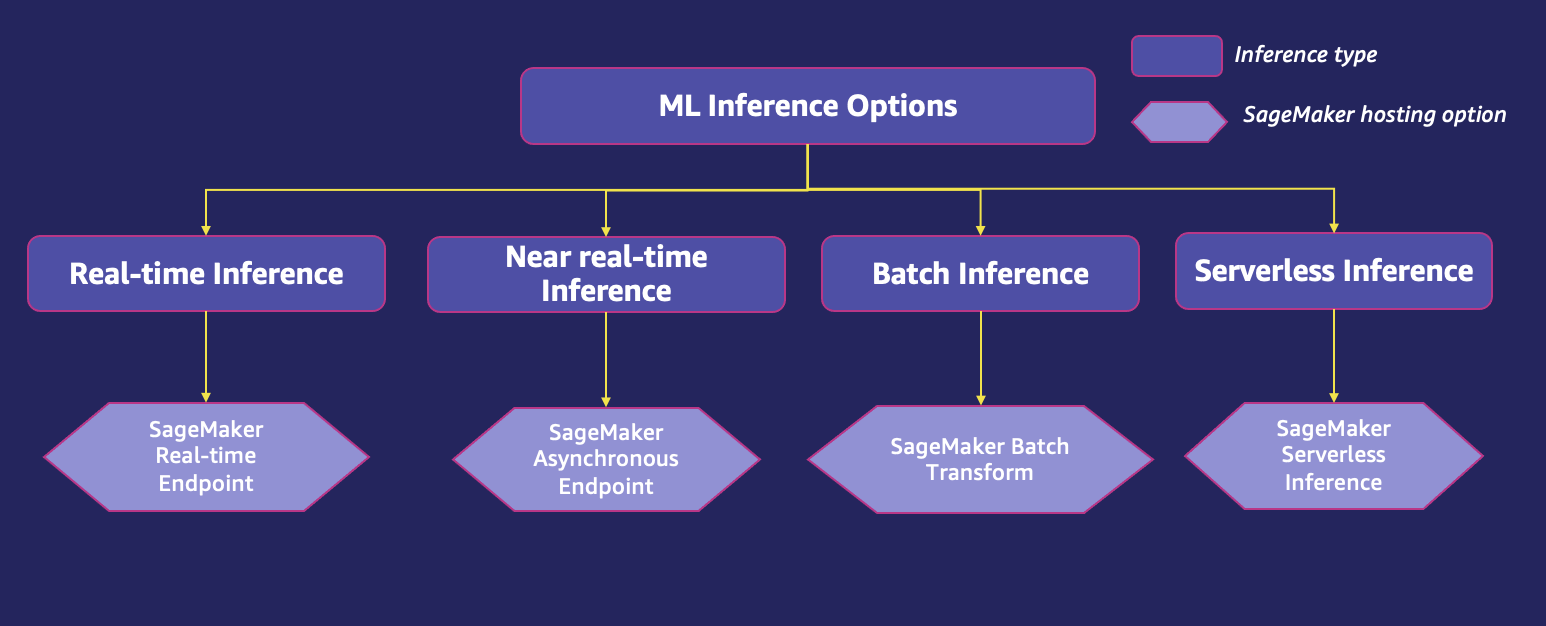

אפשרויות מסקנות ML

עבור פריסת מודל, חשוב לעבוד אחורה ממקרה השימוש שלך. מהי תדירות החיזוי? האם אתה מצפה לתעבורה חיה לאפליקציה שלך ולתגובה בזמן אמת ללקוחות שלך? האם יש לך מודלים רבים שהוכשרו עבור תת-קבוצות שונות של נתונים עבור אותו מקרה שימוש? האם תעבורת החיזוי משתנה? האם חביון של מסקנות מעורר דאגה? בהתבסס על פרטים אלה, ניתן ליישם את כל דפוסי העיצוב הקודמים באמצעות אפשרויות הפריסה הבאות:

- הסקה בזמן אמת - הסקת מסקנות בזמן אמת היא אידיאלית לעומסי עבודה של הסקת מסקנות שבהן יש לך דרישות בזמן אמת, אינטראקטיביות עם זמן אחזור נמוך. עומסי עבודה של הסקת ML בזמן אמת עשויים לכלול יישום ML מבוסס מודל יחיד, כאשר יישום דורש רק מודל ML אחד כדי לשרת בקשה בודדת, או יישום ML מבוסס ריבוי דגמים, כאשר יישום דורש מספר דגמי ML כדי לשרת יחידה אחת. בַּקָשָׁה.

- מסקנות כמעט בזמן אמת (אסינכרוני). - עם הסקת מסקנות בזמן אמת, אתה יכול לעמוד בתור בקשות נכנסות. זה יכול לשמש להפעלת הסקת מסקנות על כניסות של מאות MBs. הוא פועל כמעט בזמן אמת ומאפשר למשתמשים להשתמש בקלט להסקת מסקנות, ולקרוא את הפלט מנקודת הקצה מתוך דלי S3. זה יכול להיות שימושי במיוחד במקרים עם NLP וראייה ממוחשבת, שבהם יש עומסים גדולים הדורשים זמני עיבוד מקדים ארוכים יותר.

- הסקת אצווה - ניתן להשתמש בהסקת אצווה להפעלת הסקה במצב לא מקוון על מערך נתונים גדול. מכיוון שהוא פועל במצב לא מקוון, הסקת אצווה אינה מציעה את השהיה הנמוכה ביותר. כאן, בקשת ההסקה מעובדת עם טריגר מתוזמן או מבוסס אירועים של עבודת הסקת אצווה.

- מסקנות ללא שרת - הסקת שרת ללא שרת היא אידיאלית לעומסי עבודה שיש להם תקופות סרק בין פרצי תנועה ויכולים לסבול כמה שניות נוספות של חביון (התחלה קרה) עבור הפניה הראשונה לאחר תקופת סרק. לדוגמה, שירות צ'טבוט או אפליקציה לעיבוד טפסים או ניתוח נתונים ממסמכים. במקרה זה, ייתכן שתרצה אפשרות להסקת מסקנות מקוונת המסוגלת לספק ולהתאים אוטומטית את קיבולת המחשוב בהתבסס על נפח בקשות ההסקה. ובזמן סרק, הוא אמור להיות מסוגל לכבות לחלוטין את קיבולת המחשוב כך שלא תיטען. הסקת מסקנות ללא שרת מסירה את ההרמה הכבדה הבלתי מובחנת של בחירה וניהול שרתים על ידי השקה אוטומטית של משאבי מחשוב והרחבה שלהם פנימה והחוצה בהתאם לתעבורה.

השתמש בפונקציות כושר כדי לבחור באפשרות הנכונה להסקת ML

ההחלטה על אפשרות האירוח הנכונה היא חשובה מכיוון שהיא משפיעה על משתמשי הקצה המוצגים על ידי היישומים שלך. למטרה זו, אנו שואלים את המושג של פונקציות כושר, אשר נטבע על ידי ניל פורד ועמיתיו מ-AWS Partner ThoughtWorks בעבודתם בניית ארכיטקטורות אבולוציוניות. פונקציות הכושר מספקות הערכה מחייבת של אפשרויות אירוח שונות בהתבסס על יעדי הלקוח. פונקציות הכושר עוזרות לך להשיג את הנתונים הדרושים כדי לאפשר את ההתפתחות המתוכננת של הארכיטקטורה שלך. הם קובעים ערכים מדידים כדי להעריך עד כמה הפתרון שלך קרוב להשגת היעדים שהגדרת. ניתן וצריך להתאים את פונקציות הכושר ככל שהארכיטקטורה מתפתחת כדי להנחות תהליך שינוי רצוי. זה מספק לאדריכלים כלי להנחות את הצוותים שלהם תוך שמירה על אוטונומיה של הצוות.

ישנן חמש פונקציות כושר עיקריות שהלקוחות דואגים להן בבואם לבחור באפשרות הנכונה להסקת ML לאירוח דגמי ויישומי ה-ML שלהם.

| פונקציית כושר | תיאור |

| עלות |

לפרוס ולתחזק מודל ML ויישום ML על מסגרת ניתנת להרחבה הוא תהליך עסקי קריטי, והעלויות עשויות להשתנות מאוד בהתאם לבחירות שנעשו לגבי תשתית אירוח מודל, אפשרות אירוח, מסגרות ML, מאפייני מודל ML, אופטימיזציות, מדיניות קנה מידה, ועוד. עומסי העבודה חייבים לנצל את תשתית החומרה בצורה מיטבית כדי להבטיח שהעלות תישאר בשליטה. פונקציית כושר זו מתייחסת ספציפית לעלות התשתית, שהיא חלק מהעלות הכוללת של בעלות (TCO). עלויות התשתית הן העלויות המשולבות עבור אחסון, רשת ומחשוב. זה גם קריטי להבין מרכיבים אחרים של TCO, כולל עלויות תפעול ועלויות אבטחה ותאימות. עלויות תפעול הן העלויות המשולבות של תפעול, ניטור ותחזוקה של תשתית ה-ML. העלויות התפעוליות מחושבות כמספר המהנדסים הנדרשים בהתבסס על כל תרחיש והשכר השנתי של המהנדסים, מצטבר על פני תקופה מסוימת. לקוחות המשתמשים בפתרונות ML בניהול עצמי ענן מחשוב אלסטי של אמזון (אמזון EC2), שירות מיכלים אלסטי של אמזון (Amazon ECS), ו שירות קוברנט של אמזון (Amazon EKS) צריכים לבנות בעצמם כלים תפעוליים. לקוחות המשתמשים ב- SageMaker מקבלים פחות TCO באופן משמעותי. SageMaker inference הוא שירות מנוהל במלואו ומספק יכולות מחוץ לקופסה לפריסת מודלים של ML להסקת מסקנות. אינך צריך לספק מופעים, לנטר את תקינות המופעים, לנהל עדכוני אבטחה או תיקוני אבטחה, לפלוט מדדי תפעול או לבנות ניטור לעומסי העבודה שלך ב-ML. יש לו יכולות מובנות כדי להבטיח זמינות גבוהה וגמישות. SageMaker תומך באבטחה עם הצפנה מקצה לקצה בזמן מנוחה ובמעבר, כולל הצפנה של נפח השורש ו חנות בלוקים אלסטית של אמזון (Amazon EBS) נפח, ענן וירטואלי פרטי של אמזון תמיכה (Amazon VPC), AWS PrivateLink, מפתחות בניהול לקוחות, AWS זהות וניהול גישה (IAM) בקרת גישה עדינה, AWS CloudTrail ביקורת, הצפנת פנימית להדרכה, בקרת גישה מבוססת תגים, בידוד רשת ו-Interactive Application Proxy. כל תכונות האבטחה הללו מסופקות מהקופסה ב- SageMaker, ויכולות לחסוך לעסקים עשרות חודשי פיתוח של מאמץ הנדסי על פני תקופה של 3 שנים. SageMaker הוא שירות התומך ב-HIPAA, והוא מוסמך לפי PCI, SOC, GDPR ו-ISO. SageMaker תומך גם בנקודות קצה של FIPS. למידע נוסף על TCO, עיין ב עלות הבעלות הכוללת של Amazon SageMaker. |

| חביון מסקנות | מודלים ויישומים רבים של ML הם קריטיים לזמן השהייה, שבהם זמן ההסקה חייב להיות בגבולות המצוינים על ידי יעד רמת שירות. זמן ההסקה תלוי במספר רב של גורמים, כולל גודל ומורכבות המודל, פלטפורמת חומרה, סביבת תוכנה וארכיטקטורת רשת. לדוגמה, מודלים גדולים ומורכבים יותר יכולים להימשך זמן רב יותר להפיק מסקנות. |

| תפוקה (עסקאות בשנייה) | להסקת מודלים, אופטימיזציה של התפוקה חיונית לכוונון הביצועים ולהשגת המטרה העסקית של יישום ML. ככל שאנו ממשיכים להתקדם במהירות בכל ההיבטים של ML, כולל הטמעות ברמה נמוכה של פעולות מתמטיות בתכנון שבבים, ספריות ספציפיות לחומרה ממלאות תפקיד גדול יותר באופטימיזציה של ביצועים. גורמים שונים כגון גודל מטען, דילוגים ברשת, אופי הכשות, תכונות גרף המודל, אופרטורים במודל ופרופיל המעבד, ה-GPU וזיכרון של מופעי אירוח המודל משפיעים על התפוקה של מודל ה-ML. |

| קנה מידה מורכבות של תצורה | זה חיוני למודלים או יישומי ML לרוץ על מסגרת ניתנת להרחבה שיכולה להתמודד עם הביקוש של תעבורה משתנה. זה גם מאפשר ניצול מקסימלי של משאבי CPU ו-GPU ומונע אספקת יתר של משאבי מחשוב. |

| דפוס תנועה צפוי | למודלים או ליישומים של ML יכולים להיות דפוסי תעבורה שונים, החל מתעבורה חיה מתמשכת בזמן אמת ועד לשיאים תקופתיים של אלפי בקשות בשנייה, ומתבניות בקשות נדירות ובלתי צפויות ועד בקשות אצווה לא מקוונות על מערכי נתונים גדולים יותר. מומלץ לעבוד אחורה מדפוס התנועה הצפוי על מנת לבחור את אפשרות האירוח הנכונה עבור דגם ה-ML שלך. |

פריסת מודלים עם SageMaker

SageMaker הוא שירות AWS מנוהל במלואו המספק לכל מפתח ומדען נתונים את היכולת לבנות, לאמן ולפרוס מודלים של ML במהירות בקנה מידה. עם מסקנות של SageMaker, אתה יכול לפרוס את דגמי ה-ML שלך בנקודות קצה מתארחות ולקבל תוצאות מסקנות. SageMaker מספקת מבחר רחב של חומרה ותכונות כדי לעמוד בדרישות עומס העבודה שלך, ומאפשרת לך לבחור למעלה מ-70 סוגי מופעים עם האצת חומרה. SageMaker יכולה גם לספק המלצה על סוג מופע מסקנות באמצעות תכונה חדשה בשם SageMaker Inference Recommender, למקרה שאינך בטוח איזה מהם יהיה האופטימלי ביותר לעומס העבודה שלך.

אתה יכול לבחור אפשרויות פריסה כדי לענות בצורה הטובה ביותר על מקרי השימוש שלך, כגון מסקנות בזמן אמת, אסינכרוני, אצווה ואפילו נקודות קצה ללא שרת. בנוסף, SageMaker מציעה אסטרטגיות פריסה שונות כמו קנרי, כחול ירוק, צל, ובדיקת A/B לפריסת מודל, יחד עם פריסה חסכונית עם נקודות קצה מרובות מודלים, מרובות מכולות, וקנה מידה אלסטי. עם מסקנות של SageMaker, אתה יכול להציג את מדדי הביצועים עבור נקודות הקצה שלך אמזון CloudWatch, קנה מידה אוטומטי של נקודות קצה מבוסס על תעבורה, ועדכן את הדגמים שלך בייצור מבלי לאבד שום זמינות.

SageMaker מציע ארבע אפשרויות לפרוס את המודל שלך כדי שתוכל להתחיל לבצע תחזיות:

- הסקה בזמן אמת - זה מתאים לעומסי עבודה עם דרישות השהייה של אלפיות שניות, גדלי עומס של עד 6 MB וזמני עיבוד של עד 60 שניות.

- הפיכת אצווה - זה אידיאלי עבור תחזיות לא מקוונות על קבוצות גדולות של נתונים הזמינות מראש.

- הסקה אסינכרונית – זה מיועד לעומסי עבודה שאין להם דרישות השהייה של תת-שנייה, גדלי עומס של עד 1 GB וזמני עיבוד של עד 15 דקות.

- מסקנות ללא שרת - עם הסקת מסקנות ללא שרת, אתה יכול לפרוס במהירות מודלים של ML להסקה מבלי שתצטרך להגדיר או לנהל את התשתית הבסיסית. בנוסף, אתה משלם רק עבור קיבולת המחשוב המשמשת לעיבוד בקשות הסקת מסקנות, שהיא אידיאלית לעומסי עבודה לסירוגין.

התרשים הבא יכול לעזור לך להבין את אפשרויות הפריסה של מודל האירוח של SageMaker יחד עם הערכות פונקציית הכושר המשויכות.

הבה נחקור כל אחת מאפשרויות הפריסה ביתר פירוט.

מסקנות בזמן אמת ב- SageMaker

מומלץ להסיק מסקנות בזמן אמת של SageMaker אם יש לך תעבורה מתמשכת ואתה זקוק להשהייה נמוכה ועקבית עבור הבקשות שלך עם גדלי עומס של עד 6 MB וזמני עיבוד של עד 60 שניות. אתה פורס את המודל שלך לשירותי אירוח של SageMaker ומקבל נקודת קצה שניתן להשתמש בה להסקת מסקנות. נקודות קצה אלו מנוהלות באופן מלא ותומכות בקנה מידה אוטומטי. הסקת מסקנות בזמן אמת פופולרית למקרי שימוש שבהם אתה מצפה לתגובה סינכרונית עם אחזור נמוך עם דפוסי תנועה צפויים, כגון המלצות מותאמות אישית למוצרים ושירותים או מקרי שימוש בזיהוי הונאה בעסקאות.

בדרך כלל, יישום לקוח שולח בקשות לנקודת הקצה של SageMaker HTTPS כדי לקבל מסקנות ממודל פרוס. אתה יכול לפרוס גרסאות מרובות של מודל לאותה נקודת קצה של SageMaker HTTPS. זה שימושי לבדיקת וריאציות של מודל בייצור. שינוי קנה מידה אוטומטי מאפשר לך להתאים באופן דינמי את מספר המופעים המוגדרים עבור מודל בתגובה לשינויים בעומס העבודה שלך.

הטבלה הבאה מספקת הנחיות להערכת מסקנות בזמן אמת של SageMaker על סמך פונקציות הכושר.

| פונקציית כושר | תיאור |

| עלות |

נקודות קצה בזמן אמת מציעות תגובה סינכרונית לבקשות להסקת מסקנות. מכיוון שנקודת הקצה פועלת תמיד וזמינה לספק תגובת הסקה סינכרונית בזמן אמת, אתה משלם עבור השימוש במופע. העלויות יכולות להצטבר במהירות בעת פריסת נקודות קצה מרובות, במיוחד אם נקודות הקצה אינן מנצלות באופן מלא את המופעים הבסיסיים. בחירת המופע הנכון עבור הדגם שלך עוזרת להבטיח שיש לך את המופע הביצועי ביותר בעלות הנמוכה ביותר עבור הדגמים שלך. מומלץ לבצע קנה מידה אוטומטי כדי להתאים באופן דינמי את הקיבולת בהתאם לתעבורה כדי לשמור על ביצועים יציבים וצפויים בעלות הנמוכה ביותר האפשרית. SageMaker מרחיב את הגישה למשפחות מופעי ML מבוססות Graviton2 ו-Graviton3. AWS Graviton המעבדים נבנים בהתאמה אישית על ידי Amazon Web Services באמצעות ליבות Arm Neoverse של 64 סיביות כדי לספק את ביצועי המחיר הטובים ביותר לעומסי העבודה שלך בענן הפועלים על Amazon EC2. עם מופעים מבוססי Graviton, יש לך יותר אפשרויות לאופטימיזציה של העלות והביצועים בעת פריסת דגמי ה-ML שלך ב- SageMaker. SageMaker גם תומך מקרים אינפ 1, מתן ביצועים גבוהים והסקת ML חסכונית. עם 1–16 שבבי AWS Inferentia לכל מופע, מופעי Inf1 יכולים להרחיב את הביצועים ולספק עד פי שלושה תפוקה גבוהה יותר ועד 50% עלות נמוכה יותר לכל מסקנות בהשוואה למופעים מבוססי AWS GPU. כדי להשתמש במופעי Inf1 ב- SageMaker, אתה יכול להרכיב את המודלים המאומנים שלך באמצעות אמזון SageMaker Neo ובחר את מופעי Inf1 כדי לפרוס את המודל המהודר ב- SageMaker. אתה יכול גם לחקור תוכניות חיסכון עבור SageMaker ליהנות מחיסכון בעלויות של עד 64% בהשוואה למחיר לפי דרישה. כאשר אתה יוצר נקודת קצה, SageMaker מצרף נפח אחסון EBS לכל מופע מחשוב ML המארח את נקודת הקצה. גודל נפח האחסון תלוי בסוג המופע. עלות נוספת עבור נקודות קצה בזמן אמת כוללת עלות של חודש ג'יגה-בייט של אחסון מסודר, בתוספת נתוני ג'יגה-בייט מעובדים ונתוני ג'יגה-בייט מעובדים מתוך מופע נקודת הקצה. |

| חביון מסקנות | הסקת מסקנות בזמן אמת היא אידיאלית כאשר אתה צריך נקודת קצה מתמשכת עם דרישות השהייה של אלפיות שנייה. הוא תומך בגדלים של מטען של עד 6 מגה-בייט ובזמני עיבוד של עד 60 שניות. |

| התפוקה |

ערך אידיאלי של תפוקת מסקנות הוא סובייקטיבי לגורמים כגון מודל, גודל קלט מודל, גודל אצווה וסוג מופע נקודת קצה. כשיטת עבודה מומלצת, סקור מדדי CloudWatch עבור בקשות קלט וניצול משאבים, ובחר את סוג המופע המתאים כדי להשיג תפוקה אופטימלית. יישום עסקי יכול להיות אופטימיזציה של תפוקה או אופטימיזציה של חביון. לדוגמה, אצווה דינמית יכולה לעזור להגדיל את התפוקה עבור אפליקציות רגישות זמן אחזור תוך שימוש בהסקת זמן אמת. עם זאת, יש מגבלות לגודל אצווה, שבלעדיהן חביון ההסקה עשוי להיות מושפע. זמן ההסקה יגדל ככל שתגדיל את גודל האצווה כדי לשפר את התפוקה. לכן, הסקת מסקנות בזמן אמת היא אופציה אידיאלית עבור יישומים רגישים לאחביון. SageMaker מספקת אפשרויות של הסקה אסינכרונית והמרת אצווה, המותאמות לתת תפוקה גבוהה יותר בהשוואה להסקת זמן אמת אם היישומים העסקיים יכולים לסבול חביון מעט גבוה יותר. |

| קנה מידה מורכבות של תצורה |

תמיכה בנקודות קצה של SageMaker בזמן אמת קנה מידה אוטומטי מחוץ לקופסא. כאשר עומס העבודה גדל, קנה מידה אוטומטי מביא יותר מופעים לאינטרנט. כאשר עומס העבודה יורד, קנה מידה אוטומטי מסיר מופעים מיותרים, ועוזר לך להפחית את עלות המחשוב שלך. ללא שינוי קנה מידה אוטומטי, עליך להקפיד על תנועת שיא או חוסר זמינות של מודל סיכון. אלא אם כן התנועה לדגם שלך תהיה קבועה לאורך כל היום, תהיה קיבולת עודפת שאינה מנוצלת. זה מוביל לניצול נמוך ולבזבוז משאבים. עם SageMaker, אתה יכול להגדיר אפשרויות קנה מידה שונות בהתבסס על דפוס התעבורה הצפוי. קנה מידה פשוט או קנה מידה של מעקב אחר יעדים הוא אידיאלי כאשר ברצונך לבצע קנה מידה על סמך מדד CloudWatch ספציפי. אתה יכול לעשות זאת על ידי בחירת מדד מסוים והגדרת ערכי סף. המדדים המומלצים עבור אפשרות זו הם ממוצעים אם אתה זקוק לתצורה מתקדמת, תוכל להגדיר מדיניות קנה מידה של צעדים כדי להתאים באופן דינמי את מספר המופעים לקנה מידה על סמך גודל הפרת האזעקה. זה עוזר לך להגדיר תגובה אגרסיבית יותר כאשר הביקוש מגיע לרמה מסוימת. אתה יכול להשתמש באפשרות קנה מידה מתוזמן כאשר אתה יודע שהביקוש עוקב אחר לוח זמנים מסוים ביום, בשבוע, בחודש או בשנה. זה עוזר לך לציין לוח זמנים חד פעמי או לוח זמנים חוזר או ביטויי cron יחד עם זמני התחלה וסיום, המהווים את הגבולות של מתי פעולת קנה המידה האוטומטי מתחילה ומפסיקה. לפרטים נוספים עיין ב הגדרת נקודות קצה של הסקת קנה מידה אוטומטי באמזון SageMaker ו טען בדיקה ואופטימיזציה של נקודת קצה של Amazon SageMaker באמצעות קנה מידה אוטומטי. |

| דפוס תנועה | מסקנות בזמן אמת אידיאליות לעומסי עבודה עם דפוס תנועה מתמשך או קבוע. |

הסקה אסינכרונית ב- SageMaker

הסקה אסינכרונית של SageMaker היא יכולת חדשה ב- SageMaker שמעמידה בתור בקשות נכנסות ומעבדת אותן באופן אסינכרוני. אפשרות זו אידיאלית עבור בקשות עם גדלי מטען גדולים (עד 1 GB), זמני עיבוד ארוכים (עד 15 דקות) ודרישות השהייה כמעט בזמן אמת. עומסי עבודה לדוגמה להסקת מסקנות אסינכרוניות כוללות חברות בריאות המעבדות תמונות ביו-רפואיות ברזולוציה גבוהה או סרטונים כמו אקו לב כדי לזהות חריגות. יישומים אלו מקבלים פרצי תעבורה נכנסת בזמנים שונים ביום ודורשים עיבוד כמעט בזמן אמת בעלות נמוכה. זמני העיבוד של בקשות אלו יכולים לנוע בסדר גודל של דקות, מה שמבטל את הצורך להפעיל הסקת מסקנות בזמן אמת. במקום זאת, ניתן לעבד עומסי קלט באופן אסינכרוני מחנות אובייקטים כמו Amazon S3 עם תור אוטומטי וסף מקביל מוגדר מראש. לאחר העיבוד, SageMaker ממקמת את תגובת ההסקה במיקום האמזון S3 שהוחזר בעבר. אתה יכול לבחור לקבל הודעות הצלחה או שגיאה באמצעות שירות התראה פשוט של אמזון (Amazon SNS).

הטבלה הבאה מספקת הנחיות להערכת מסקנות אסינכרוניות של SageMaker על סמך פונקציות הכושר.

| פונקציית כושר | תיאור |

| עלות | הסקה אסינכרונית היא בחירה מצוינת עבור עומסי עבודה רגישים לעלות עם עומסים גדולים ותעבורה מתפרצת. הסקה אסינכרונית מאפשרת לך לחסוך בעלויות על ידי שינוי קנה מידה אוטומטי של ספירת המופעים לאפס כאשר אין בקשות לעיבוד, כך שאתה משלם רק כאשר נקודת הקצה שלך מעבדת בקשות. בקשות המתקבלות כאשר יש אפס מופעים ממוקמות בתור לעיבוד לאחר שנקודת הקצה מגדילה. |

| חביון מסקנות | הסקה אסינכרונית היא אידיאלית עבור דרישות השהייה כמעט בזמן אמת. הבקשות ממוקמות בתור ומעובדות ברגע שהמחשב זמין. זה בדרך כלל מביא לעשרות אלפיות שניות בהשהיה. |

| התפוקה | הסקה אסינכרונית היא אידיאלית עבור מקרי שימוש שאינם רגישים להשהייה, מכיוון שיישומים אינם צריכים להתפשר על התפוקה. בקשות אינן נשמטות במהלך עליות תעבורה מכיוון שנקודת הקצה הא-סינכרונית של ההסקה האסינכרונית מעמידה בתורים בקשות במקום מורידה אותן. |

| קנה מידה מורכבות של תצורה |

SageMaker תומך קנה מידה אוטומטי עבור נקודת קצה אסינכרונית. שלא כמו נקודות קצה מתארחות בזמן אמת, נקודות קצה אסינכרוניות של הסקה תומכות בהקטנת מופעים לאפס על ידי הגדרת הקיבולת המינימלית לאפס. עבור נקודות קצה אסינכרוניות, SageMaker ממליצה בחום ליצור תצורת מדיניות עבור קנה מידה של מעקב אחר יעד עבור מודל פרוס (וריאציה). עבור מקרי שימוש שיכולים לסבול קנס של התחלה קרה של כמה דקות, אתה יכול אופציונלי להקטין את ספירת מופעי נקודות הקצה לאפס כאשר אין בקשות מתקיימות ולהגדיל את קנה המידה עם הגעת בקשות חדשות, כך שאתה משלם רק עבור משך הזמן שבו נקודות הקצה מעבדות בקשות באופן פעיל. |

| דפוס תנועה | נקודות קצה אסינכרוניות מעמידות בתור בקשות נכנסות ומעבדות אותן באופן אסינכרוני. הם אופציה טובה לדפוסי תנועה לסירוגין או נדירים. |

מסקנות אצווה ב- SageMaker

טרנספורמציה אצווה של SageMaker אידיאלית לחיזוי לא מקוון על קבוצות גדולות של נתונים הזמינות מראש. תכונת המרת האצווה היא שיטה בעלת ביצועים גבוהים ותפוקה גבוהה להמרת נתונים ויצירת מסקנות. זה אידיאלי עבור תרחישים שבהם אתה מתמודד עם קבוצות גדולות של נתונים, אינך זקוק להשהייה בתת-שנייה, או צריך גם לעבד מראש וגם לשנות את נתוני האימון. לקוחות בתחומים מסוימים כגון פרסום ושיווק או שירותי בריאות צריכים לעתים קרובות לבצע תחזיות לא מקוונות על מערכי נתונים בקנה מידה גבוה, כאשר תפוקה גבוהה היא לעתים קרובות המטרה של מקרה השימוש והשהייה אינה מהווה דאגה.

כאשר מתחילה עבודת טרנספורמציה אצווה, SageMaker מאתחל מופעי מחשוב ומחלק את עומס העבודה של ההסקות ביניהם. זה משחרר את המשאבים כשהעבודות הסתיימו, כך שאתה משלם רק על מה שהיה בשימוש במהלך עבודתך. בסיום העבודה, SageMaker שומר את תוצאות החיזוי בדלי S3 שתציין. משימות מסקנות אצווה הן בדרך כלל מועמדות טובות לשינוי קנה מידה אופקי. כל עובד בתוך אשכול יכול לפעול על תת-קבוצה שונה של נתונים ללא צורך בהחלפת מידע עם עובדים אחרים. AWS מציעה אפשרויות אחסון ומחשוב מרובות המאפשרות קנה מידה אופקי. עומסי עבודה לדוגמה עבור שינוי אצווה של SageMaker כוללים יישומים לא מקוונים כגון יישומים בנקאיים לחיזוי נטישת לקוחות שבהם ניתן לתזמן עבודה לא מקוונת לפעול מעת לעת.

הטבלה הבאה מספקת הנחיות להערכת שינוי אצווה של SageMaker בהתבסס על פונקציות הכושר.

| פונקציית כושר | תיאור |

| עלות | טרנספורמציה אצווה של SageMaker מאפשרת לך להריץ תחזיות על מערכי נתונים גדולים או קטנים של אצווה. אתה מחויב עבור סוג המופע שתבחר, על סמך משך השימוש. SageMaker מנהלת את אספקת המשאבים בתחילת העבודה ומשחררת אותם בסיום העבודה. אין עלות נוספת לעיבוד נתונים. |

| חביון מסקנות | אתה יכול להשתמש בהזמנה מבוססת אירועים או מתוזמנת. השהיה עשויה להשתנות בהתאם לגודל נתוני ההסקה, במקביליות העבודה, מורכבות המודל וקיבולת מופעי החישוב. |

| התפוקה |

ניתן לבצע עבודות שינוי אצווה במגוון מערכי נתונים, החל מ-petabytes של נתונים ועד מערכי נתונים קטנים מאוד. אין צורך לשנות גודל של מערכי נתונים גדולים יותר לנתחים קטנים של נתונים. אתה יכול להאיץ עבודות טרנספורמציה אצווה על ידי שימוש בערכים אופטימליים עבור פרמטרים כגון MaxPayloadInMB, MaxConcurrentTransforms, או אסטרטגיית אצווה. הערך האידיאלי עבור עיבוד אצווה יכול להגדיל את התפוקה ולמטב את המשאבים שלך מכיוון שהוא עוזר להשלים מספר גדול יותר של מסקנות בפרק זמן מסוים על חשבון השהיה. כדי לייעל את פריסת המודל לתפוקה גבוהה יותר, ההנחיה הכללית היא להגדיל את גודל האצווה עד שתפוקת התפוקה תפחת. |

| קנה מידה מורכבות של תצורה | טרנספורמציה אצווה של SageMaker משמשת להסקת מסקנות לא מקוונות שאינן רגישות לאחביון. |

| דפוס תנועה | להסקת מסקנות לא מקוונות, עבודת טרנספורמציה אצווה מתוזמנת או מתחילה באמצעות טריגר מבוסס אירועים. |

מסקנות ללא שרת ב- SageMaker

הסקת מסקנות ללא שרת של SageMaker מאפשרת לך לפרוס מודלים של ML להסקת מסקנות מבלי שתצטרך להגדיר או לנהל את התשתית הבסיסית. בהתבסס על נפח הבקשות להסקת מסקנות שהדגם שלך מקבל, מסקנות ללא שרת של SageMaker מסדרת באופן אוטומטי, מדרג ומכבה את קיבולת המחשוב. כתוצאה מכך, אתה משלם רק עבור זמן החישוב כדי להפעיל את קוד ההסקה שלך וכמות הנתונים המעובדים, לא עבור זמן סרק. אתה יכול להשתמש באלגוריתמים המובנים של SageMaker ובמכולות המשרתות מסגרת ML כדי לפרוס את המודל שלך לנקודת קצה ללא שרת או לבחור להביא קונטיינר משלך. אם התעבורה הופכת להיות צפויה ויציבה, אתה יכול לעדכן בקלות מנקודת קצה ללא שרת לנקודת קצה של SageMaker בזמן אמת ללא צורך לבצע שינויים בתמונת המכולה שלך. עם מסקנות ללא שרת, אתה גם נהנה מתכונות אחרות של SageMaker, כולל מדדים מובנים כגון ספירת קריאות, תקלות, זמן אחזור, מדדי מארח ושגיאות ב-CloudWatch.

הטבלה הבאה מספקת הנחיות להערכת מסקנות ללא שרת של SageMaker על סמך פונקציות הכושר.

| פונקציית כושר | תיאור |

| עלות | עם מודל תשלום לפי הפעלה, הסקה ללא שרת היא אפשרות חסכונית אם יש לך דפוסי תעבורה נדירים או לסירוגין. אתה משלם רק עבור משך הזמן שבו נקודת הקצה מעבדת את הבקשה, ולכן יכול לחסוך בעלויות אם דפוס התעבורה הוא לסירוגין. |

| חביון מסקנות |

נקודות קצה נטולות שרת מציעות השהיית הסקה נמוכה (בסדר גודל של אלפיות שניות עד שניות), עם יכולת קנה מידה מעשרות לאלפי מסקנות תוך שניות על סמך דפוסי השימוש, מה שהופך אותה לאידיאלית עבור יישומי ML עם תעבורה לסירוגין או בלתי צפויה. מכיוון שנקודות קצה ללא שרת מספקות משאבי מחשוב על פי דרישה, נקודת הקצה שלך עשויה לחוות כמה שניות נוספות של השהייה (התחלה קרה) עבור הפניה הראשונה לאחר תקופת סרק. זמן ההתחלה הקרה תלוי בגודל הדגם שלך, כמה זמן לוקח להוריד את הדגם שלך וזמן ההפעלה של המכולה שלך. |

| התפוקה | בעת קביעת התצורה של נקודת הקצה ללא שרת, אתה יכול לציין את גודל הזיכרון ואת המספר המרבי של הפעלות בו-זמנית. מסקנות ללא שרת של SageMaker מקצה אוטומטית משאבי מחשוב פרופורציונליים לזיכרון שבחרת. אם תבחר בגודל זיכרון גדול יותר, למיכל שלך יש גישה ליותר מעבדי vCPU. ככלל, גודל הזיכרון צריך להיות גדול לפחות כמו גודל הדגם שלך. גדלי הזיכרון שאתה יכול לבחור הם 1024 MB, 2048 MB, 3072 MB, 4096 MB, 5120 MB ו-6144 MB. ללא קשר לגודל הזיכרון שתבחר, לנקודות קצה ללא שרת יש 5 ג'יגה-בייט של אחסון בדיסק זמני. |

| קנה מידה מורכבות של תצורה | נקודות קצה ללא שרת משיקים אוטומטית משאבי מחשוב ומרחיבים אותם פנימה והחוצה בהתאם לתעבורה, ומבטלים את הצורך לבחור סוגי מופעים או לנהל מדיניות קנה מידה. זה מסיר את ההרמה הכבדה הבלתי מובחנת של בחירה וניהול שרתים. |

| דפוס תנועה | הסקה ללא שרת היא אידיאלית לעומסי עבודה עם דפוסי תנועה נדירים או לסירוגין. |

דגמי אירוח עיצוב דפוסי SageMaker

נקודות הקצה של SageMaker משתמשות בקונטיינרים של Docker לאירוח דגמי ML. קונטיינרים מאפשרים לך לארוז תוכנה ליחידות סטנדרטיות הפועלות באופן עקבי בכל פלטפורמה שתומכת ב-Docker. זה מבטיח ניידות בין פלטפורמות, פריסות תשתית בלתי ניתנות לשינוי, וניהול שינויים קל יותר והטמעות CI/CD. SageMaker מספקת קונטיינרים מנוהלים מובנים מראש עבור מסגרות פופולריות כגון Apache MXNet, TensorFlow, PyTorch, Sklearn ו-Huging Face. לרשימה מלאה של תמונות מיכל זמינות של SageMaker, עיין ב תמונות מכולות זמינות למידה עמוקה. במקרה של SageMaker אין קונטיינר נתמך, אתה יכול גם לבנות קונטיינר משלך (BYOC) ולדחוף תמונה מותאמת אישית משלך, תוך התקנת התלות הנחוצות לדגם שלך.

כדי לפרוס מודל ב- SageMaker, אתה צריך קונטיינר (מכלי מסגרת מנוהלים של SageMaker או BYOC) ומופע מחשוב כדי לארח את הקונטיינר. SageMaker תומך במספר אפשרויות מתקדמות לדפוסי עיצוב נפוצים של מודל ML של אירוח, שבהם ניתן לארח דגמים על קונטיינר בודד או לארח במשותף על קונטיינר משותף.

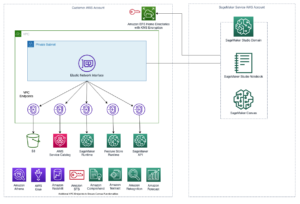

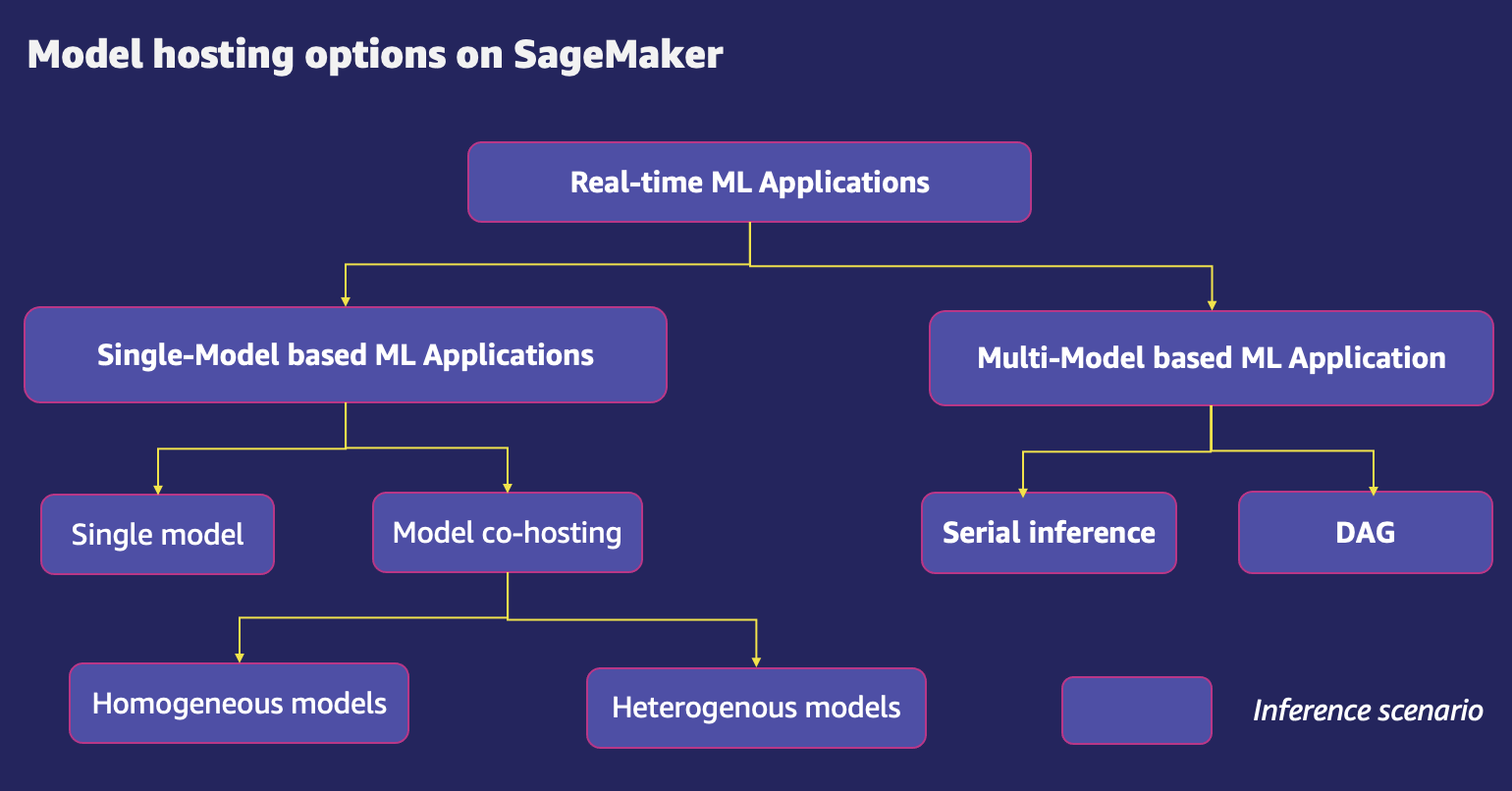

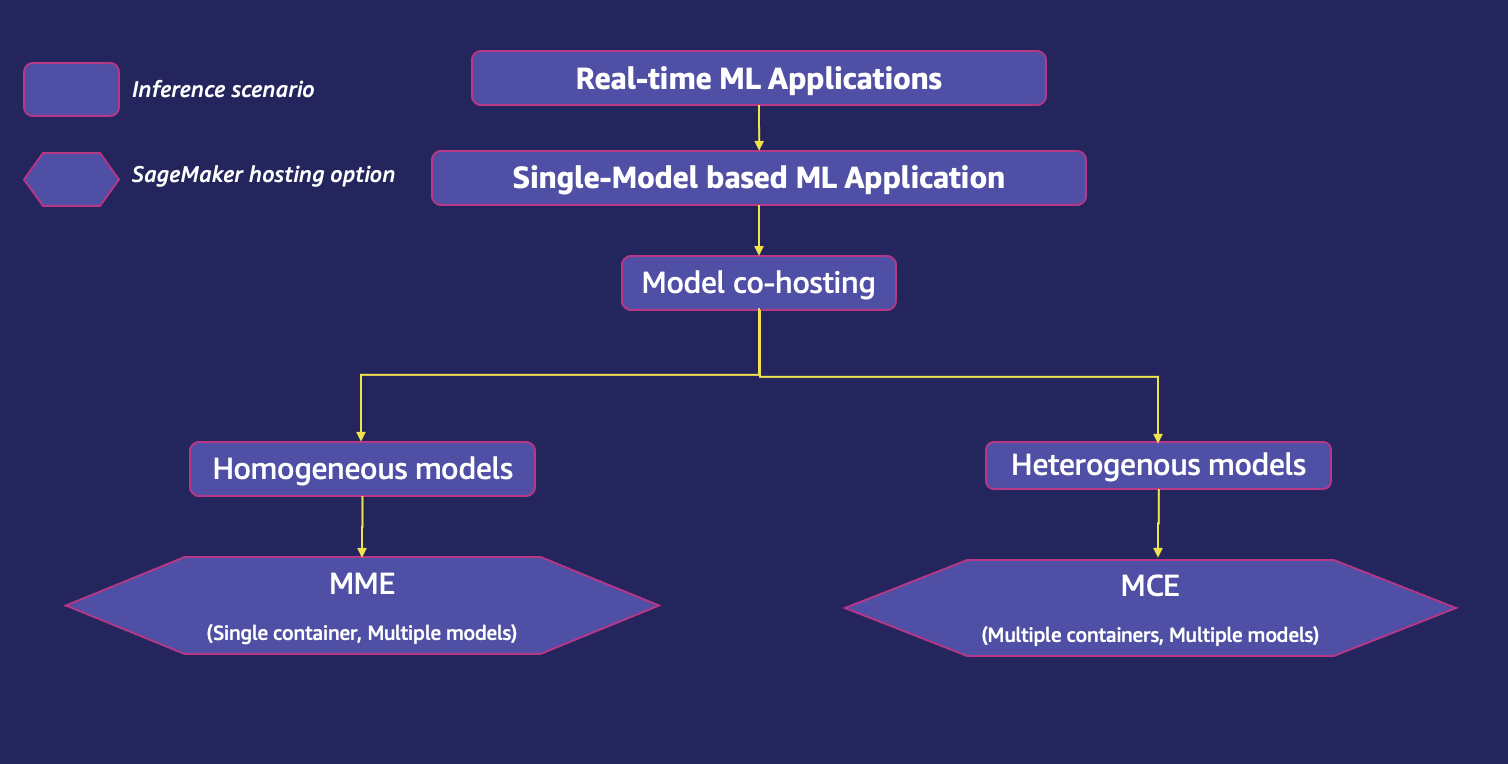

אפליקציית ML בזמן אמת עשויה להשתמש במודל בודד או במספר דגמים כדי לשרת בקשת חיזוי אחת. התרשים הבא מציג תרחישי הסקה שונים עבור יישום ML.

הבה נחקור אפשרות אירוח מתאימה של SageMaker עבור כל אחד מתרחישי ההסקה הקודמים. אתה יכול לעיין בפונקציות הכושר כדי להעריך אם זו האפשרות הנכונה עבור מקרה השימוש הנתון.

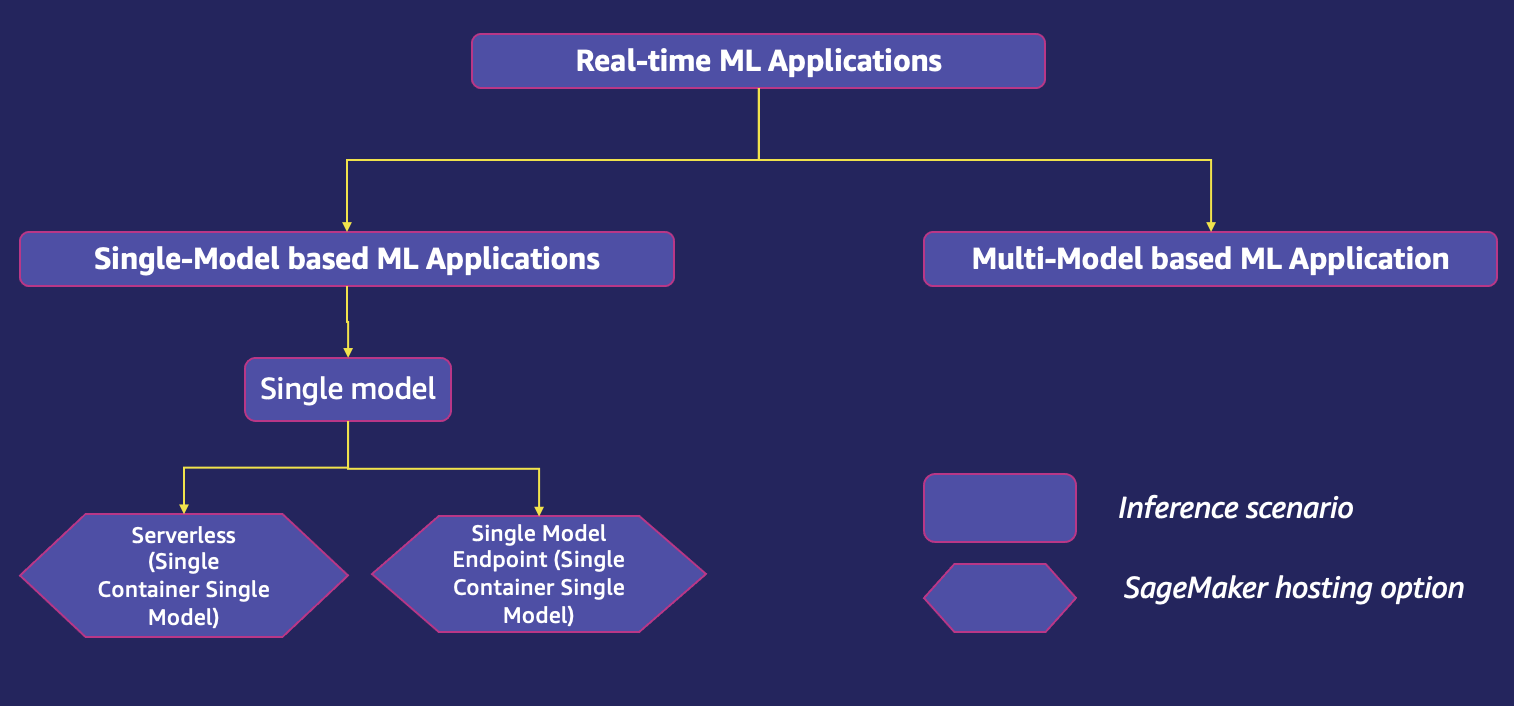

אירוח אפליקציית ML מבוססת דגם בודד

ישנן מספר אפשרויות לארח יישומי ML מבוססי דגם בודד באמצעות שירותי אירוח של SageMaker בהתאם לתרחיש הפריסה.

נקודת קצה של דגם יחיד

נקודות קצה של SageMaker של דגם יחיד מאפשרות לך לארח דגם אחד על קונטיינר המתארח במופעים ייעודיים עבור חביון נמוך ותפוקה גבוהה. נקודות קצה אלו מנוהלות באופן מלא ותומכות בקנה מידה אוטומטי. אתה יכול להגדיר את נקודת הקצה של דגם יחיד כנקודת קצה מסודרת שבה אתה עובר בתצורת תשתית של נקודות קצה כגון סוג המופע וספירת המופעים, או נקודת קצה ללא שרת שבה SageMaker משיק אוטומטית משאבי מחשוב ומרחיב אותם פנימה והחוצה בהתאם לתעבורה, ומבטל את הצורך כדי לבחור סוגי מופעים או לנהל מדיניות קנה מידה. נקודות קצה ללא שרת מיועדות ליישומים עם תעבורה לסירוגין או בלתי צפויה.

התרשים הבא מציג תרחישי הסקת מסקנות של נקודת קצה של מודל יחיד.

הטבלה הבאה מספקת הנחיות להערכת פונקציות כושר עבור נקודת קצה של דגם יחיד. להערכות פונקציית כושר ללא שרת ללא שרת, עיין בסעיף נקודות קצה ללא שרת בפוסט זה.

| פונקציית כושר | תיאור |

| עלות | אתה מחויב עבור שימוש בסוג המופע שתבחר. מכיוון שנקודת הקצה תמיד פועלת וזמינה, העלויות יכולות להצטבר במהירות. בחירת המופע הנכון עבור הדגם שלך עוזרת להבטיח שיש לך את המופע הביצועי ביותר בעלות הנמוכה ביותר עבור הדגמים שלך. מומלץ לבצע קנה מידה אוטומטי כדי להתאים באופן דינמי את הקיבולת בהתאם לתעבורה כדי לשמור על ביצועים יציבים וצפויים בעלות הנמוכה ביותר האפשרית. |

| חביון מסקנות | נקודת קצה של דגם יחיד מספקת הסקה אינטראקטיבית וסינכרונית בזמן אמת עם דרישות השהייה של אלפיות שנייה. |

| התפוקה | התפוקה יכולה להיות מושפעת מגורמים שונים, כגון גודל קלט מודל, גודל אצווה, סוג מופע נקודת קצה וכן הלאה. מומלץ לסקור מדדי CloudWatch עבור בקשות קלט וניצול משאבים, ולבחור את סוג המופע המתאים להשגת תפוקה אופטימלית. SageMaker מספק תכונות לניהול משאבים ואופטימיזציה של ביצועי הסקת מסקנות בעת פריסת מודלים של ML. אתה יכול מטב את ביצועי המודל באמצעות Neo, או השתמש במופעי Inf1 לתפוקה טובה יותר של הדגמים המתארחים ב- SageMaker שלך באמצעות מופע GPU עבור נקודת הקצה שלך. |

| קנה מידה מורכבות של תצורה | קנה מידה אוטומטי נתמך מחוץ לקופסה. SageMaker ממליצה לבחור מתאים תצורת קנה מידה על ידי הופעה בדיקות עומס. |

| דפוס תנועה | נקודת קצה של דגם יחיד אידיאלית לעומסי עבודה עם דפוסי תנועה צפויים. |

אירוח משותף של מספר דגמים

כאשר אתה מתמודד עם מספר רב של דגמים, פריסת כל אחד מהם בנקודת קצה בודדת עם מיכל ומופע ייעודיים יכולה לגרום לעלייה משמעותית בעלות. בנוסף, זה גם הופך להיות קשה לנהל כל כך הרבה דגמים בייצור, במיוחד כאשר אתה לא צריך להפעיל את כל הדגמים בו זמנית אבל עדיין צריך שהם יהיו זמינים בכל עת. אירוח משותף של דגמים מרובים באותם משאבי מחשוב בסיסיים מקל על ניהול פריסות ML בקנה מידה ומוריד את עלויות האירוח שלך באמצעות שימוש מוגבר בנקודת הקצה ובמשאבי המחשוב הבסיסיים שלה. SageMaker תומך באפשרויות אירוח משותף של מודלים מתקדמות כגון נקודת קצה מרובת מודלים (MME) עבור מודלים הומוגניים ונקודת קצה מרובת מכולות (MCE) עבור מודלים הטרוגניים. מודלים הומוגניים משתמשים באותה מסגרת ML במיכל שירות משותף, בעוד שמודלים הטרוגניים מאפשרים לך לפרוס קונטיינרים מרובים לשרת המשתמשים במודלים או מסגרות שונות בנקודת קצה אחת.

התרשים הבא מציג אפשרויות אירוח משותף של מודל באמצעות SageMaker.

נקודות קצה מרובות של SageMaker

SageMaker MMEs מאפשרים לך לארח מספר דגמים באמצעות מיכל הגשה משותף בנקודת קצה אחת. זהו פתרון ניתן להרחבה וחסכוני לפריסת מספר רב של דגמים הנותנים מענה לאותו מקרה שימוש, מסגרת או היגיון מסקנות. MMEs יכולים לשרת באופן דינמי בקשות על סמך המודל שהופעל על ידי המתקשר. זה גם מפחית את תקורה של פריסה מכיוון ש- SageMaker מנהלת טעינת מודלים בזיכרון ומדרגת אותם בהתבסס על דפוסי התעבורה אליהם. תכונה זו אידיאלית כאשר יש לך מספר רב של דגמים דומים שתוכל להגיש באמצעות מיכל הגשה משותף ואין צורך לגשת לכל הדגמים בו זמנית. נקודות קצה מרובות דגמים מאפשרות גם שיתוף זמן של משאבי זיכרון בין הדגמים שלך. זה עובד בצורה הטובה ביותר כאשר המודלים דומים למדי בגודלם ובזמן האחזור של הפניה, מה שמאפשר ל-MME להשתמש במופעים ביעילות בכל המודלים. SageMaker MMEs תומכים באירוח דגמים מגובים של מעבד ו-GPU כאחד. על ידי שימוש במודלים מגובי GPU, אתה יכול להוזיל את עלויות פריסת המודל שלך באמצעות שימוש מוגבר בנקודת הקצה ובמופעי המחשוב המואצים הבסיסיים שלה. למקרה של שימוש בעולם האמיתי של MMEs, עיין ב כיצד להתאים מסקנות למידת מכונה עבור מקרי שימוש ב-SaaS מרובי דיירים.

הטבלה הבאה מספקת הנחיות להערכת פונקציות הכושר עבור MMEs.

| פונקציית כושר | תיאור |

| עלות |

MMEs מאפשרים שימוש במיכל הגשה משותף לארח אלפי דגמים בנקודת קצה אחת. זה מפחית את עלויות האירוח באופן משמעותי על ידי שיפור ניצול נקודות הקצה בהשוואה לשימוש בנקודות קצה של דגם יחיד. לדוגמה, אם יש לך 10 דגמים לפרוס באמצעות מופע ml.c5.large, המבוסס על תמחור SageMaker, העלות של קיום 10 נקודות קצה קבועות בדגם יחיד היא: 10 * $0.102 = $1.02 לשעה. בעוד שעם MME אחד המארח את 10 הדגמים, אנו משיגים חיסכון בעלויות פי 10: 1 * $0.102 = $0.102 לשעה. |

| חביון מסקנות |

כברירת מחדל, רכיבי MME מאחסנים דגמים בשימוש תכוף בזיכרון ובדיסק כדי לספק הסקת השהייה נמוכה. הדגמים המאוחסנים במטמון נפרקים או נמחקים מהדיסק רק כאשר מיכל אוזל בזיכרון או שטח דיסק כדי להכיל דגם ממוקד חדש. MMEs מאפשרים טעינה עצלה של דגמים, כלומר מודלים נטענים לזיכרון כאשר הם מופעלים בפעם הראשונה. זה מייעל את ניצול הזיכרון; עם זאת, זה גורם לעלייה בזמן התגובה בטעינה הראשונה, וכתוצאה מכך לבעיית התחלה קרה. לכן, MMEs מתאימים גם לתרחישים שיכולים לסבול עונשי חביון מזדמנים הקשורים להתחלה קרה המתרחשים בעת הפעלת מודלים בשימוש נדיר. כדי לעמוד ביעדי ההשהיה והתפוקה של יישומי ML, מופעי GPU מועדפים על פני מופעי מעבד (בהתחשב בהצעת ה-GPUs הכוח החישובי). עם תמיכת MME עבור GPU, אתה יכול לפרוס אלפי מודלים של למידה עמוקה מאחורי נקודת קצה אחת של SageMaker. MMEs יכולים להריץ מספר דגמים על ליבת GPU, לשתף מופעי GPU מאחורי נקודת קצה על פני מספר דגמים, ולטעון ולפרוק באופן דינמי מודלים על סמך התעבורה הנכנסת. עם זה, אתה יכול לחסוך משמעותית בעלויות ולהשיג את ביצועי המחיר הטובים ביותר. אם מקרה השימוש שלך דורש עסקאות גבוהות יותר בשנייה (TPS) או דרישות חביון, אנו ממליצים לארח את המודלים בנקודות קצה ייעודיות. |

| התפוקה |

ערך אידיאלי של תפוקת מסקנות MME תלוי בגורמים כגון דגם, גודל מטען וסוג מופע נקודת קצה. כמות גבוהה יותר של זיכרון מופעים מאפשרת לך לטעון יותר דגמים ומוכנים להגיש בקשות מסקנות. אתה לא צריך לבזבז זמן בטעינת הדגם. כמות גבוהה יותר של vCPUs מאפשרת לך להפעיל דגמים ייחודיים יותר במקביל. MMEs טוענים ופורקים באופן דינמי את המודל אל ומזכרון המופעים, מה שעלול להשפיע על ביצועי I/O. SageMaker MMEs עם GPU עובדים באמצעות NVIDIA Triton Inference Server, שהיא תוכנת הגשת מסקנות בקוד פתוח המפשטת את תהליך הגשת ההסקות ומספקת ביצועי מסקנות גבוהים. SageMaker טוען את הדגם לזיכרון של מיכל NVIDIA Triton במופע מואץ של GPU ומשרת את בקשת ההסקה. ליבת ה-GPU משותפת לכל הדגמים במופע אחד. אם הדגם כבר נטען בזיכרון המכולה, הבקשות הבאות מוגשות מהר יותר מכיוון ש- SageMaker לא צריך להוריד ולטעון אותו שוב. מומלץ לבצע בדיקות וניתוח ביצועים נאותים בפריסות ייצור מוצלחות. SageMaker מספקת מדדי CloudWatch עבור נקודות קצה מרובות דגמים, כך שתוכל לקבוע את השימוש בנקודות הקצה ואת קצב הפגיעה במטמון כדי לסייע באופטימיזציה של נקודת הקצה שלך. |

| קנה מידה מורכבות של תצורה | נקודות קצה מרובי דגמי SageMaker תומכות באופן מלא בקנה מידה אוטומטי, המנהלת העתקים של דגמים כדי להבטיח קנה מידה של דגמים על סמך דפוסי תנועה. עם זאת, מומלץ לבצע בדיקת עומס מתאימה כדי לקבוע את הגודל האופטימלי של המופעים עבור קנה מידה אוטומטי של נקודת הקצה. גודל נכון של צי ה-MME חשוב כדי למנוע פריקת דגמים רבים מדי. טעינת מאות דגמים בכמה מופעים גדולים יותר עשויה להוביל למצערת במקרים מסוימים, וניתן להעדיף שימוש במופעים קטנים יותר. כדי לנצל את קנה המידה האוטומטי של מודלים ב- SageMaker, ודא שיש לך הגדרת שינוי קנה מידה אוטומטי של מופע לספק קיבולת מופע נוספת. הגדר את מדיניות קנה המידה שלך ברמת נקודות הקצה עם פרמטרים מותאמים אישית או שיחות לדקה (מומלץ) כדי להוסיף מופעים נוספים לצי נקודות הקצה. שיעורי הפנייה המשמשים להפעלת אירוע קנה מידה אוטומטי מבוססים על קבוצת התחזיות המצטברות על פני קבוצת המודלים המלאה המוגשת על ידי נקודת הקצה. |

| דפוס תנועה | MMEs הם אידיאליים כאשר יש לך מספר רב של דגמים בגודל דומה שאתה יכול להגיש באמצעות מיכל הגשה משותף ולא צריך לגשת לכל הדגמים בו-זמנית. |

נקודות קצה ריבוי מכולות של SageMaker

SageMaker MCEs תמיכה בפריסה של עד 15 קונטיינרים המשתמשים במודלים שונים או במסגרות שונות בנקודת קצה אחת, והפעלתם באופן עצמאי או ברצף להסקת השהייה נמוכה וחיסכון בעלויות. הדגמים יכולים להיות הטרוגניים לחלוטין, עם ערימת הגשה עצמאית משלהם. אירוח מאובטח של מספר דגמים ממסגרות שונות במופע אחד יכול לחסוך לך עד 90% בעלות.

דפוסי ההתקשרות של MCE הם כדלקמן:

- צינורות מסקנות – ניתן להפעיל מיכלים ב-MME ברצף ליניארי, המכונה גם a צינור מסקנות סדרתי. הם משמשים בדרך כלל להפרדת עיבוד מקדים, מסקנות מודל ועיבוד שלאחר למיכלים עצמאיים. הפלט מהמיכל הנוכחי מועבר כקלט למאגר הבא. הם מיוצגים כמודל צינור יחיד ב- SageMaker. ניתן לפרוס צינור מסקנות כ-MME, כאשר אחד מהמכולות בצינור יכול לשרת באופן דינמי בקשות המבוססות על המודל המופעל.

- קריאה ישירה - עם פנייה ישירה, ניתן לשלוח בקשה למיכל היסק ספציפי המתארח ב-MCE.

הטבלה הבאה מספקת הנחיות להערכת פונקציות הכושר עבור MCEs.

| פונקציית כושר | תיאור |

| עלות | MCEs מאפשרים לך להפעיל עד 15 מיכלי ML שונים בנקודת קצה אחת ולהפעיל אותם באופן עצמאי, ובכך לחסוך בעלויות. אפשרות זו אידיאלית כאשר יש לך מודלים מרובים הפועלים על ערימות הגשה שונות עם צורכי משאבים דומים, וכאשר למודלים בודדים אין מספיק תעבורה כדי לנצל את מלוא הקיבולת של מופעי נקודות הקצה. לכן MCEs חסכוניים יותר מנקודת קצה של דגם יחיד. MCEs מציעים תגובת הסקה סינכרונית, מה שאומר שנקודת הקצה זמינה תמיד ואתה משלם עבור זמן הפעולה של המופע. העלות יכולה להסתכם בהתאם למספר וסוג המופעים. |

| חביון מסקנות | MCEs אידיאליים להפעלת יישומי ML עם מסגרות ML שונות ואלגוריתמים שונים עבור כל דגם שניגשים אליהם לעתים רחוקות אך עדיין דורשים הסקת השהייה נמוכה. הדגמים זמינים תמיד להסקת השהייה נמוכה ואין בעיה של התחלה קרה. |

| התפוקה | MCEs מוגבלים לעד 15 מכולות בנקודת קצה מרובת מכולות, והסקת GPU אינה נתמכת עקב מחלוקת משאבים. עבור נקודות קצה מרובות מכולות המשתמשות במצב הפעלה ישירה, SageMaker מספקת לא רק מדדים ברמת המופע כפי שהיא עושה עם נקודות קצה נפוצות אחרות, אלא גם תומך במדדים לכל מיכל. כשיטת עבודה מומלצת, סקור את מדדי CloudWatch עבור בקשות קלט וניצול משאבים, ובחר את סוג המופע המתאים כדי להשיג תפוקה אופטימלית. |

| קנה מידה מורכבות של תצורה | MCEs תומכים בקנה מידה אוטומטי. עם זאת, על מנת להגדיר קנה מידה אוטומטי, מומלץ שהדגם בכל מיכל יציג ניצול מעבד דומה והשהייה בכל בקשת הסקת מסקנות. זה מומלץ מכיוון שאם התעבורה לנקודת הקצה מרובת המכולות עוברת ממודל ניצול מעבד נמוך למודל ניצול מעבד גבוה, אך נפח השיחה הכללי נשאר זהה, נקודת הקצה לא מתרחקת, וייתכן שלא יהיו מספיק מקרים לטפל בכל הבקשות למודל ניצול מעבד גבוה. |

| דפוס תנועה | MCEs אידיאליים לעומסי עבודה עם דפוסי תעבורה מתמשכים או קבועים, לאירוח מודלים על פני מסגרות שונות (כגון TensorFlow, PyTorch או Sklearn) שאולי אין להם מספיק תעבורה כדי להרוות את מלוא הקיבולת של מופע נקודת קצה. |

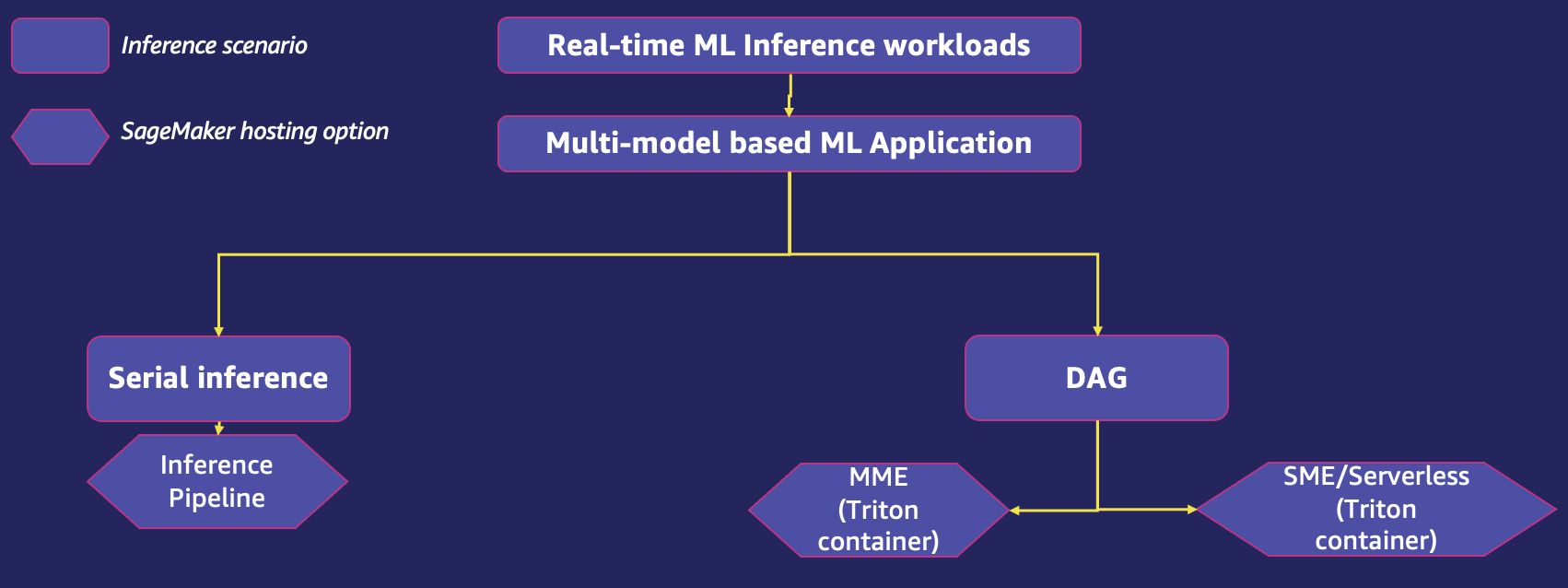

אירוח אפליקציית ML מבוססת ריבוי דגמים

יישומים עסקיים רבים צריכים להשתמש במספר מודלים של ML כדי להגיש בקשת חיזוי אחת לצרכנים שלהם. למשל, חברה קמעונאית שרוצה לתת המלצות למשתמשים שלה. יישום ML במקרה שימוש זה עשוי לרצות להשתמש במודלים מותאמים אישית שונים להמלצה על קטגוריות שונות של מוצרים. אם החברה רוצה להוסיף התאמה אישית להמלצות על ידי שימוש בפרטי משתמש בודדים, מספר הדגמים המותאמים אישית גדל עוד יותר. אירוח של כל דגם מותאם אישית על מופע מחשוב נפרד אינו רק גזעני בעלויות, אלא גם מוביל לחוסר ניצול של משאבי האירוח אם לא נעשה שימוש תדיר בכל הדגמים. SageMaker מציע אפשרויות אירוח יעילות עבור יישומי ML מבוססי ריבוי דגמים.

התרשים הבא מציג אפשרויות אירוח מרובות דגמים עבור נקודת קצה אחת באמצעות SageMaker.

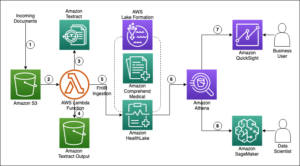

צינור מסקנות סדרתי

צינור מסקנות הוא מודל של SageMaker המורכב מרצף ליניארי של 2-15 מיכלים המעבדים בקשות להסקת מסקנות על נתונים. אתה משתמש בצינור מסקנות כדי להגדיר ולפרוס כל שילוב של אלגוריתמים מובנים של SageMaker מאומנים מראש ואלגוריתמים מותאמים אישית משלך ארוזים בקונטיינרים של Docker. אתה יכול להשתמש בצינור מסקנות כדי לשלב משימות מדעי הנתונים של עיבוד מקדים, חיזויים ואחרי עיבוד. הפלט ממיכל אחד מועבר כקלט למשנהו. כאשר מגדירים את המכולות עבור מודל צנרת, מציינים גם את סדר הפעלת המכולות. הם מיוצגים כמודל צינור יחיד ב- SageMaker. ניתן לפרוס את צינור ההסקה כ-MME, כאשר אחד מהמכולות בצינור יכול לשרת באופן דינמי בקשות המבוססות על המודל המופעל. אתה יכול גם להפעיל את א הפיכת אצווה עבודה עם צינור מסקנות. צינורות מסקנות מנוהלים במלואם.

הטבלה הבאה מספקת הנחיות להערכת פונקציות הכושר עבור אירוח מודל ML באמצעות צינור מסקנות סדרתי.

| פונקציית כושר | תיאור |

| עלות | צינור היסק סדרתי מאפשר לך להריץ עד 15 מיכלי ML שונים בנקודת קצה אחת, מה שמוביל ליעילות העלות של אירוח מיכלי ההסקה. אין עלויות נוספות לשימוש בתכונה זו. אתה משלם רק עבור המקרים הפועלים בנקודת קצה. העלות יכולה להסתכם בהתאם למספר וסוג המופעים. |

| חביון מסקנות | כאשר אפליקציית ML נפרסת כצינור מסקנות, הנתונים בין דגמים שונים לא עוזבים את שטח המכולה. עיבוד תכונות והסקת מסקנות פועלות עם חביון נמוך מכיוון שהמכולות ממוקמות יחד באותם מופעי EC2. |

| התפוקה | בתוך מודל צינור מסקנות, SageMaker מטפל בקריאות כרצף של בקשות HTTP. המכולה הראשונה בצנרת מטפלת בבקשה הראשונית, לאחר מכן תגובת הביניים נשלחת כבקשה למיכל השני וכן הלאה, עבור כל מכולה בצנרת. SageMaker מחזירה את המענה הסופי ללקוח. התפוקה סובייקטיבית לגורמים כגון מודל, גודל קלט של מודל, גודל אצווה וסוג מופע נקודת קצה. כשיטת עבודה מומלצת, סקור מדדי CloudWatch עבור בקשות קלט וניצול משאבים, ובחר את סוג המופע המתאים כדי להשיג תפוקה אופטימלית. |

| קנה מידה מורכבות של תצורה | צינורות היסק סדרתי תומכים בקנה מידה אוטומטי. עם זאת, על מנת להגדיר קנה מידה אוטומטי, מומלץ שהדגם בכל מיכל יציג ניצול מעבד דומה והשהייה בכל בקשת הסקת מסקנות. זה מומלץ מכיוון שאם התעבורה לנקודת הקצה מרובת המכולות עוברת ממודל ניצול מעבד נמוך למודל ניצול מעבד גבוה, אך נפח השיחה הכולל נשאר זהה, נקודת הקצה לא מתרחקת וייתכן שלא יהיו מספיק מקרים כדי לטפל בכל הבקשות למודל ניצול מעבד גבוה. |

דפוס תנועה |

צינורות הסקה סדרתיים הם אידיאליים עבור דפוסי תנועה צפויים עם מודלים הפועלים ברצף על אותה נקודת קצה. |

פריסת הרכבי מודל (Triton DAG):

SageMaker מציע אינטגרציה עם NVIDIA Triton Inference Server דרך Triton Inference Server Containers. מיכלים אלה כוללים NVIDIA Triton Inference Server, תמיכה במסגרות ML נפוצות ומשתני סביבה שימושיים המאפשרים לך לייעל את הביצועים ב- SageMaker. עם תמונות מיכל של NVIDIA Triton, אתה יכול לשרת בקלות דגמי ML ולהפיק תועלת מהאופטימיזציות של ביצועים, אצווה דינמית ותמיכה בריבוי מסגרות שמספק NVIDIA Triton. Triton עוזר למקסם את הניצול של GPU ו-CPU, ולהוזיל עוד יותר את עלות ההסקה.

במקרים של שימוש עסקי שבהם יישומי ML משתמשים במספר מודלים כדי לשרת בקשת חיזוי, אם כל דגם משתמש במסגרת שונה או מתארח במופע נפרד, זה עלול להוביל לעומס עבודה ולעלות מוגברת, כמו גם לעלייה בהשהיה הכוללת. SageMaker NVIDIA Triton Inference Server תומך בפריסה של דגמים מכל המסגרות העיקריות, כגון TensorFlow GraphDef, TensorFlow SavedModel, ONNX, PyTorch TorchScript, TensorRT, ופורמטים של מודל Python/C++ ועוד. אנסמבל מודלים של טריטון מייצג צינור של מודל אחד או יותר או לוגיקה של עיבוד קדם ואחרי עיבוד, והחיבור של טנסורי קלט ופלט ביניהם. בקשת הסקה אחת לאנסמבל מפעילה את הריצה של כל הצינור. ל-Triton יש גם אלגוריתמים מובנים של תזמון ואצווה המשלבים בקשות היסק אינדיבידואליות כדי לשפר את תפוקת ההסקה. החלטות תזמון ואצווה אלו שקופות ללקוח המבקש מסקנות. ניתן להפעיל את הדגמים על מעבדי CPU או GPU לגמישות מרבית ולתמיכה בדרישות מחשוב הטרוגניות.

אירוח מספר דגמים מגובים של GPU בנקודות קצה מרובות דגמים נתמך דרך SageMaker Triton Inference Server. שרת ה-NVIDIA Triton Inference הורחב ליישם א חוזה MME API, כדי להשתלב עם MMEs. אתה יכול להשתמש ב-NVIDIA Triton Inference Server, שיוצר תצורת מאגר מודלים עבור מסגרת עורפית שונה, כדי לפרוס MME עם קנה מידה אוטומטי. תכונה זו מאפשרת לך להרחיב מאות דגמים מותאמים אישית במיוחד המותאמים היטב כדי לספק חוויות ייחודיות של משתמשי קצה ביישומי AI. אתה יכול גם להשתמש בתכונה זו כדי להשיג ביצועי מחיר נחוצים עבור יישום ההסקה שלך באמצעות GPUs חלקיים. למידע נוסף, עיין ב הפעל מספר מודלים של למידה עמוקה ב-GPU עם נקודות קצה מרובי דגמים של Amazon SageMaker.

הטבלה הבאה מספקת הנחיות להערכת פונקציות הכושר עבור אירוח מודל ML באמצעות MMEs עם תמיכה ב-GPU על מיכלי מסקנות של Triton. עבור נקודות קצה של מודל יחיד והערכות תפקוד כושר ללא שרת, עיין בסעיפים המוקדמים יותר בפוסט זה.

| פונקציית כושר | תיאור |

| עלות | SageMaker MMEs עם תמיכת GPU באמצעות Triton Inference Server מספקים דרך מדרגית וחסכונית לפרוס מספר רב של מודלים של למידה עמוקה מאחורי נקודת קצה אחת של SageMaker. עם MME, דגמים מרובים חולקים את מופע ה-GPU מאחורי נקודת קצה. זה מאפשר לך לשבור את העלות הגוברת באופן ליניארי של אירוח דגמים מרובים ושימוש חוזר בתשתית בכל הדגמים. אתה משלם עבור זמן הפעולה של המופע. |

| חביון מסקנות |

SageMaker עם Triton Inference Server נבנה במטרה למקסם את התפוקה ואת ניצול החומרה עם זמן השהייה נמוך במיוחד (מילישניות חד ספרתיות). יש לו מגוון רחב של מסגרות ML נתמכות (כולל TensorFlow, PyTorch, ONNX, XGBoost ו-NVIDIA TensorRT) ותשתיות עורפיות, כולל NVIDIA GPUs, CPUs, ו Afer Inferentia. עם תמיכת MME עבור GPU באמצעות SageMaker Triton Inference Server, אתה יכול לפרוס אלפי מודלים של למידה עמוקה מאחורי נקודת קצה אחת של SageMaker. SageMaker טוען את הדגם לזיכרון של מיכל NVIDIA Triton במופע מואץ של GPU ומשרת את בקשת ההסקה. ליבת ה-GPU משותפת לכל הדגמים במופע אחד. אם הדגם כבר נטען בזיכרון המכולה, הבקשות הבאות מוגשות מהר יותר מכיוון ש- SageMaker לא צריך להוריד ולטעון אותו שוב. |

| התפוקה |

MMEs מציעים יכולות להרצת דגמי למידה עמוקה או ML מרובים על ה-GPU, בו-זמנית, עם Triton Inference Server. זה מאפשר לך להשתמש בקלות בשרת NVIDIA Triton מרובת מסגרות, ביצועים גבוהים, עם פריסת המודל המנוהלת במלואה של SageMaker. Triton תומך בכל ההסקות מבוססות NVIDIA GPU, x86, Arm® CPU ו-AWS Inferentia. הוא מציע אצווה דינמית, ריצות במקביל, תצורת מודל אופטימלית, מכלול מודלים וכניסות אודיו ווידאו הזרמת כדי למקסם את התפוקה והניצול. גורמים אחרים, כגון גודל הרשת והמטען, עשויים למלא תפקיד מינימלי בתקורה הקשורה להסקה. |

| קנה מידה מורכבות של תצורה |

MMEs יכולים לשנות קנה מידה אופקית באמצעות מדיניות קנה מידה אוטומטי, ולספק מופעי מחשוב נוספים של GPU המבוססים על מדדים כגון עם Triton inference server, אתה יכול בקלות לבנות מיכל מותאם אישית הכולל את הדגם שלך עם Triton ולהביא אותו ל- SageMaker. SageMaker Inference יטפל בבקשות ותרחיב אוטומטית את הקונטיינר ככל שהשימוש גדל, מה שיקל על פריסת המודל עם Triton ב-AWS. |

| דפוס תנועה |

MMEs אידיאליים עבור דפוסי תנועה צפויים עם מודלים המופעלים כ-DAG על אותה נקודת קצה. SageMaker דואגת לעיצוב תעבורה לנקודת הקצה של MME ושומרת על עותקי דגם אופטימליים במופעי GPU לביצועי המחיר הטובים ביותר. הוא ממשיך לנתב את התעבורה למופע שבו המודל נטען. אם משאבי המופע מגיעים לקיבולת עקב ניצול גבוה, SageMaker פורק את הדגמים הכי פחות בשימוש מהמיכל כדי לפנות משאבים לטעינת מודלים בשימוש תכוף יותר. |

שיטות עבודה מומלצות

שקול את השיטות המומלצות הבאות:

- לכידות גבוהה וצימוד נמוך בין הדגמים - ארח את הדגמים באותו מיכל בעל לכידות גבוהה (מניע פונקציונליות עסקית יחידה) ועטף אותם יחד כדי להקל על השדרוג והניהול. במקביל, נתק את הדגמים הללו אחד מהשני (ארח אותם במיכל אחר) כך שתוכל לשדרג בקלות דגם אחד מבלי להשפיע על דגמים אחרים. מארח מודלים מרובים שמשתמשים במכולות שונות מאחורי נקודת קצה אחת ומפעילים לאחר מכן באופן עצמאי או הוסיפו לוגיקת עיבוד מקדים של מודל ואחרי עיבוד כצינור מסקנות סדרתי.

- חביון מסקנות - קבץ את הדגמים המונעים על ידי פונקציונליות עסקית יחידה וארח אותם במיכל אחד כדי למזער את מספר הכשות ולכן למזער את ההשהיה הכוללת. יש אזהרות אחרות, כמו אם המודלים המקובצים משתמשים במספר מסגרות; אתה יכול גם לבחור לארח במספר קונטיינרים אבל להפעיל על אותו מארח כדי להפחית את זמן ההשהיה ולמזער את העלות.

- קבץ באופן הגיוני מודלים של ML עם לכידות גבוהה – הקבוצה הלוגית עשויה להיות מורכבת ממודלים הומוגניים (לדוגמה, כל המודלים של XGBoost) או הטרוגניים (לדוגמה, מעט XGBoost ומעט BERT). זה עשוי להיות מורכב ממודלים המשותפים על פני מספר פונקציות עסקיות או עשוי להיות ספציפי למילוי פונקציונליות עסקית אחת בלבד.

- דגמים משותפים - אם הקבוצה הלוגית מורכבת ממודלים משותפים, קלות שדרוג המודלים והשהייה ישחקו תפקיד מרכזי בבניית נקודות הקצה של SageMaker. לדוגמה, אם השהייה היא בראש סדר העדיפויות, עדיף למקם את כל הדגמים במיכל אחד מאחורי נקודת קצה אחת של SageMaker כדי למנוע קפיצות מרובות. החיסרון הוא שאם יש צורך לשדרג את אחד מהדגמים, זה יגרום לשדרוג כל נקודות הקצה הרלוונטיות של SageMaker המארחות את הדגם הזה.

- דגמים לא משותפים - אם הקבוצה הלוגית מורכבת רק ממודלים ספציפיים למאפיינים עסקיים ואינה משותפת עם קבוצות אחרות, מורכבות האריזה וההשהיה יהפכו למפתח להשגה. מומלץ לארח את הדגמים הללו במיכל אחד מאחורי נקודת קצה אחת של SageMaker.

- שימוש יעיל בחומרה (CPU, GPU) - קבץ יחד דגמים מבוססי מעבד וארח אותם על אותו מארח כך שתוכל להשתמש ביעילות במעבד. באופן דומה, קבץ יחד דגמים מבוססי GPU כך שתוכל להשתמש ביעילות ולהגדיל אותם. ישנם עומסי עבודה היברידיים הדורשים גם מעבד ו-GPU באותו מארח. אירוח דגמי המעבד בלבד וה-GPU בלבד על אותו מארח צריך להיות מונע על ידי לכידות גבוהה ודרישות חביון יישומים. בנוסף, עלות, יכולת קנה מידה ורדיוס פיצוץ במקרה של כשל הם הממדים העיקריים שיש לבדוק.

- פונקציות כושר - השתמש בפונקציות כושר כקו מנחה לבחירת אפשרות אירוח ML.

סיכום

כשזה מגיע לאירוח ML, אין גישה מתאימה לכולם. מתרגלי ML צריכים לבחור את דפוס העיצוב הנכון כדי להתמודד עם אתגרי האירוח שלהם ב-ML. הערכת פונקציות הכושר מספקת הדרכה תקינה לגבי בחירת אפשרות האירוח הנכונה של ML.

לפרטים נוספים על כל אחת מאפשרויות האירוח, עיין בפוסטים הבאים בסדרה זו:

על המחברים

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

דוואל פאטל הוא אדריכל ראשי למידת מכונה ב-AWS. הוא עבד עם ארגונים החל מארגונים גדולים ועד סטארט-אפים בינוניים על בעיות הקשורות למחשוב מבוזר ובינה מלאכותית. הוא מתמקד בלמידה עמוקה כולל תחומי NLP ו-Computer Vision. הוא עוזר ללקוחות להשיג מסקנות מודל עם ביצועים גבוהים על SageMaker.

דיפאלי רג'אלה הוא מנהל חשבון טכני מומחה AI/ML בשירותי האינטרנט של אמזון. היא עובדת עם לקוחות ארגוניים ומספקת הדרכה טכנית על הטמעת פתרונות למידת מכונה עם שיטות עבודה מומלצות. בזמנה הפנוי היא נהנית מטיולים, סרטים ובילוי עם משפחה וחברים.

דיפאלי רג'אלה הוא מנהל חשבון טכני מומחה AI/ML בשירותי האינטרנט של אמזון. היא עובדת עם לקוחות ארגוניים ומספקת הדרכה טכנית על הטמעת פתרונות למידת מכונה עם שיטות עבודה מומלצות. בזמנה הפנוי היא נהנית מטיולים, סרטים ובילוי עם משפחה וחברים.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

סאוראב טריקאנדה הוא מנהל מוצר בכיר עבור Amazon SageMaker Inference. הוא נלהב לעבוד עם לקוחות ומוטיבציה היא המטרה של דמוקרטיזציה של למידת מכונה. הוא מתמקד באתגרי ליבה הקשורים לפריסת יישומי ML מורכבים, מודלים של ML מרובי דיירים, אופטימיזציות עלויות והפיכת פריסת מודלים של למידה עמוקה לנגישה יותר. בזמנו הפנוי, סאוראב נהנה לטייל, ללמוד על טכנולוגיות חדשניות, לעקוב אחר TechCrunch ולבלות עם משפחתו.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- Platoblockchain. Web3 Metaverse Intelligence. ידע מוגבר. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/model-hosting-patterns-in-amazon-sagemaker-part-1-common-design-patterns-for-building-ml-applications-on-amazon-sagemaker/

- 1

- 10

- 100

- 11

- 39

- 7

- 70

- a

- יכולת

- יכול

- אודות

- מוּאָץ

- גישה

- נצפה

- נגיש

- להתאים

- חֶשְׁבּוֹן

- מדויק

- להשיג

- השגתי

- לרוחב

- פעולה

- באופן פעיל

- תוספת

- נוסף

- בנוסף

- כתובת

- לקדם

- מתקדם

- יתרון

- פרסום

- להשפיע על

- לאחר

- - צבירה

- צבר

- תוֹקפָּנִי

- הסכמים

- AI

- AI / ML

- אזעקה

- אלגוריתמים

- תעשיות

- מאפשר

- מאפשר

- כְּבָר

- תמיד

- אמזון בעברית

- אמזון

- אמזון SageMaker

- אמזון שירותי אינטרנט

- כמות

- אנליזה

- לנתח

- ו

- תשתיות

- שנתי

- אחר

- אַפָּשׁ

- API

- תפוח עץ

- בקשה

- יישומים

- גישה

- מתאים

- אפליקציות

- ארכיטקטורה

- זרוע

- מלאכותי

- בינה מלאכותית

- היבטים

- הערכה

- המשויך

- תכונות

- אודיו

- ביקורת

- המכונית

- אוטומטי

- מכני עם סלילה אוטומטית

- באופן אוטומטי

- זמינות

- זמין

- מְמוּצָע

- AWS

- בחזרה

- מגובה

- בנקאות

- בסיס

- מבוסס

- כי

- להיות

- הופך להיות

- לפני

- מאחור

- להיות

- תועלת

- הטוב ביותר

- שיטות עבודה מומלצות

- מוטב

- בֵּין

- ביו-רפואי

- לחסום

- הלוואות

- גבולות

- אריזה מקורית

- הפרה

- לשבור

- להביא

- מביא

- תקציבים

- לִבנוֹת

- בִּניָן

- נבנה

- מובנה

- עסקים

- יישומים עסקיים

- תהליך עסקי

- עסקים

- סליק

- מחושב

- שיחה

- נקרא

- שיחה

- מועמדים

- יכולות

- קיבולת

- אשר

- מקרה

- מקרים

- קטגוריות

- גורמים

- מסוים

- מוסמך

- האתגרים

- שינוי

- שינויים

- מאפיינים

- טעון

- chatbot

- לבדוק

- שבב

- בחירה

- בחירות

- בחרו

- בחירה

- בכיתה

- מיון

- לסווג

- לקוחות

- לקוחות

- סְגוֹר

- ענן

- אשכול

- קוד

- טבוע

- עמיתים

- לגבות

- להילחם

- שילוב

- לשלב

- משולב

- Common

- חברות

- חברה

- לעומת

- להשלים

- לחלוטין

- מורכב

- מורכבות

- הענות

- רכיבים

- מורכב

- פשרה

- כוח חישובי

- לחשב

- המחשב

- ראייה ממוחשבת

- מחשוב

- מושג

- דְאָגָה

- במקביל

- תְצוּרָה

- הקשר

- עִקבִי

- מאוכל

- צרכנים

- מכולה

- מכולות

- מכיל

- להמשיך

- ממשיך

- רציף

- לִשְׁלוֹט

- ליבה

- תוֹאֵם

- עלות

- חיסכון עלויות

- עלות תועלת

- עלויות

- יכול

- לִיצוֹר

- יוצר

- קריטי

- מכריע

- נוֹכְחִי

- מנהג

- לקוח

- לקוחות

- DAG

- נתונים

- עיבוד נתונים

- מדע נתונים

- מדען נתונים

- מסד נתונים

- מערכי נתונים

- יְוֹם

- התמודדות

- החלטות

- מוקדש

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- הגדרה

- למסור

- דרישה

- דרישות

- דמוקרטיזציה

- תלוי

- תלוי

- לפרוס

- פרס

- פריסה

- פריסה

- פריסות

- עיצוב

- תבניות עיצוב

- מעוצב

- פרט

- פרטים

- איתור

- לקבוע

- מפתח

- צעצועי התפתחות

- דיאגרמות

- אחר

- קשה

- ממדים

- ישיר

- מובהק

- מופץ

- מחשוב מבוזר

- שונה

- סַוָר

- מסמכים

- לא

- תחומים

- לא

- מטה

- להורדה

- downside

- מונע

- ירד

- נשמט

- בְּמַהֲלָך

- דינמי

- כל אחד

- מוקדם יותר

- קל יותר

- בקלות

- אפקטיבי

- יעילות

- יְעִילוּת

- יעילות

- יעיל

- יעילות

- מאמץ

- או

- חיסול

- לאפשר

- מאפשר

- הצף

- מקצה לקצה

- נקודת קצה

- הנדסה

- מהנדסים

- מספיק

- לְהַבטִיחַ

- מבטיח

- מִפְעָל

- חברות

- שלם

- סביבה

- שגיאה

- שגיאות

- במיוחד

- העריך

- הערכות

- אֲפִילוּ

- אירוע

- הכל

- אבולוציה

- דוגמה

- דוגמאות

- חליפין

- מוצגים

- לצפות

- צפוי

- ניסיון

- חוויות

- לחקור

- ביטויים

- חיצוני

- נוסף

- פָּנִים

- גורמים

- כשלון

- למדי

- משפחות

- משפחה

- מהר יותר

- מאפיין

- תכונות

- האכלה

- מעטים

- סופי

- ראשון

- firsttime

- כושר גופני

- צי

- גמישות

- תזרים

- להשתנות

- מתמקד

- הבא

- כדלקמן

- מַעבָּרָה

- טופס

- צורות

- שברירי

- מסגרת

- מסגרות

- הונאה

- גילוי הונאה

- חופשי

- תדר

- בתדירות גבוהה

- חברים

- החל מ-

- פירות

- מלא

- לגמרי

- פונקציה

- פונקציות

- פונקציונלי

- פונקציות

- נוסף

- GDPR

- כללי

- נוצר

- יצירת

- לקבל

- לתת

- נתן

- מטרה

- שערים

- טוב

- GPU

- GPUs

- גרף

- גדול

- יותר

- מאוד

- קְבוּצָה

- קבוצה

- לגדול

- מדריך

- לטפל

- מטפל

- שימושי

- חומרה

- יש

- בְּרִיאוּת

- בריאות

- לעזור

- עזרה

- עוזר

- כאן

- גָבוֹהַ

- ביצועים גבוהים

- רזולוציה גבוהה

- גבוה יותר

- מכה

- מאוזן

- המארח

- אירח

- אירוח

- עלויות אירוח

- שירותי אירוח

- איך

- אולם

- HTML

- HTTPS

- מאות

- היברידי

- אידאל

- זהות

- להתבטל

- תמונה

- סיווג תמונות

- תמונות

- בלתי ניתן לשינוי

- פְּגִיעָה

- מושפעים

- השפעות

- ליישם

- יושם

- יישום

- חשוב

- לשפר

- שיפור

- in

- לכלול

- כולל

- כולל

- נכנס

- להגדיל

- גדל

- עליות

- גדל

- עצמאי

- באופן עצמאי

- בנפרד

- מידע

- תשתית

- בתחילה

- חדשני

- טכנולוגיות חדשניות

- קלט

- התקנה

- למשל

- במקום

- לשלב

- השתלבות

- מוֹדִיעִין

- אינטראקטיבי

- לערב

- ISO

- בדידות

- IT

- עבודה

- מקומות תעסוקה

- מפתח

- מפתחות

- לדעת

- ידוע

- גָדוֹל

- גדול יותר

- חֶבִיוֹן

- לשגר

- השקות

- השקה

- עוֹפֶרֶת

- מוביל

- מוביל

- לִלמוֹד

- למידה

- יציאה

- הוביל

- רמה

- ספריות

- רמה

- מוגבל

- גבולות

- רשימה

- לחיות

- לִטעוֹן

- טוען

- המון

- מיקום

- ארוך

- עוד

- נראה

- לאבד

- מגרש

- נמוך

- מכונה

- למידת מכונה

- עשוי

- ראשי

- לתחזק

- שומר

- גדול

- לעשות

- עושה

- עשייה

- לנהל

- הצליח

- ניהול

- מנהל

- מצליח

- ניהול

- רב

- שיווק

- מתימטי

- דבר

- לְהַגדִיל

- מקסימום

- אומר

- לִפְגוֹשׁ

- זכרון

- שיטה

- שיטות

- מטרי

- מדדים

- יכול

- מינימלי

- מינימום

- דקות

- ערבוב

- ML

- מצב

- מודל

- מודלים

- צג

- ניטור

- חוֹדֶשׁ

- חודשים

- יותר

- רוב

- מוטיבציה

- סרטים

- נקודת קצה מרובת דגמים

- מספר

- המון

- טבע

- הכרחי

- צורך

- צרכי

- רשת

- חדש

- הבא

- NLP

- הודעה

- הודעות

- מספר

- Nvidia

- אובייקט

- מטרה

- יעדים

- להשיג

- מִקרִי

- הַצָעָה

- המיוחדות שלנו

- לא מחובר

- ONE

- באינטרנט

- קוד פתוח

- להפעיל

- פועל

- פועל

- מבצעי

- תפעול

- מפעילי

- אופטימלי

- אופטימיזציה

- מטב

- אופטימיזציה

- מייעל

- מיטוב

- אפשרות

- אפשרויות

- כָּתוֹם

- להזמין

- ארגונים

- אחר

- בולט

- מקיף

- שֶׁלוֹ

- בעלות

- חבילה

- אריזה

- פרמטרים

- חלק

- מסוים

- שותף

- עבר

- לוהט

- טלאים

- תבנית

- דפוסי

- תשלום

- שִׂיא

- לְבַצֵעַ

- ביצועים

- ביצוע

- תקופה

- תקופתי

- תקופות

- התאמה אישית

- אישית

- לבחור

- צינור

- מקום

- מקומות

- מתוכנן

- תוכניות

- פלטפורמה

- פלטפורמות

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- לְשַׂחֵק

- ועוד

- מדיניות

- מדיניות

- פופולרי

- אפשרי

- הודעה

- הודעות

- כּוֹחַ

- תרגול

- פרקטיקות

- צפוי

- ניבוי

- נבואה

- התחזיות

- מועדף

- קוֹדֶם

- מחיר

- מנהל

- עדיפות

- פְּרָטִי

- בעיה

- בעיות

- תהליך

- מעובד

- תהליכים

- תהליך

- מעבדים

- המוצר

- מנהל מוצר

- הפקה

- מוצרים

- פּרוֹפִיל

- תָקִין

- לספק

- ובלבד

- מספק

- מתן

- אַספָּקָה

- פרוקסי

- מטרה

- דחוף

- פיטורך

- מהירות

- רכס

- טִוּוּחַ

- מהר

- ציון

- תעריפים

- לְהַגִיעַ

- מגיע

- חומר עיוני

- מוכן

- ממשי

- עולם אמיתי

- זמן אמת

- לקבל

- קיבלו

- מקבל

- להמליץ

- המלצה

- המלצות

- מוּמלָץ

- ממליץ

- ממליצה

- חוזר

- להפחית

- מפחית

- מתייחס

- ללא קשר

- רגיל

- קָשׁוּר

- עיתונות

- רלוונטי

- שְׂרִידִים

- מאגר

- מיוצג

- מייצג

- לבקש

- בקשות

- לדרוש

- נדרש

- דרישה

- דרישות

- דורש

- משאב

- משאבים

- תגובה

- REST

- תוצאה

- וכתוצאה מכך

- תוצאות

- קמעוני

- החזרות

- סקירה

- הסיכון

- תפקיד

- שורש

- מסלול

- כלל

- הפעלה

- ריצה

- SaaS

- בעל חכמים

- SageMaker Inference

- משכורת

- אותו

- שמור

- חסכת

- חיסכון

- להרחבה

- סולם

- מאזניים

- דרוג

- תרחישים

- לוח זמנים

- מתוכנן

- מדע

- מַדְעָן

- שְׁנִיָה

- שניות

- סעיף

- סעיפים

- מאובטח

- אבטחה

- בחירה

- מבחר

- לחצני מצוקה לפנסיונרים

- רגיש

- רצף

- סידורי

- סדרה

- לשרת

- ללא שרת

- שרתים

- משמש

- שרות

- שירותים

- הגשה

- סט

- הצבה

- כמה

- מעצבים

- שיתוף

- משותף

- משמרות

- צריך

- הופעות

- משמעותי

- באופן משמעותי

- דומה

- באופן דומה

- פָּשׁוּט

- יחיד

- מידה

- גדל

- קטן

- קטן יותר

- So

- תוכנה

- פִּתָרוֹן

- פתרונות

- כמה

- מקורות

- מֶרחָב

- מומחה

- מיוחד

- ספציפי

- במיוחד

- מפורט

- מְהִירוּת

- הוצאה

- קוצים

- יציב

- לערום

- ערימות

- התחלה

- החל

- התחלות

- סטארט - אפ

- חברות סטארט

- יציב

- שלב

- צעדים

- עוד

- עוצר

- אחסון

- חנות

- אסטרטגיות

- נהירה

- קפדן

- בְּתוֹקֶף

- לאחר מכן

- הצלחה

- מוצלח

- כזה

- מספיק

- מַתְאִים

- תמיכה

- נתמך

- תומך

- לְהִתְנַחְשֵׁל

- שולחן

- לקחת

- לוקח

- יעד

- ממוקד

- המשימות

- משימות

- נבחרת

- צוותי

- TechCrunch

- טכני

- טכנולוגיות

- שׂוֹכֵר

- tensorflow

- מבחן

- בדיקות

- השמיים

- שֶׁלָהֶם

- עצמם

- בכך

- לכן

- אלפים

- שְׁלוֹשָׁה

- סף

- דרך

- בכל

- תפוקה

- זמן

- פִּי

- ל

- יַחַד

- גַם

- כלי

- סה"כ

- Tps

- מעקב

- תְנוּעָה

- רכבת

- מְאוּמָן

- הדרכה

- טרנזקציות

- עסקות

- לשנות

- טרנספורמציה

- הפיכה

- מעבר

- שָׁקוּף

- להפעיל

- טריטון

- תור

- סוגים

- טיפוסי

- בדרך כלל

- תחת

- בְּסִיסִי

- להבין

- ייחודי

- יחידות

- בלתי צפוי

- לא בשימוש

- עדכון

- עדכונים

- שדרוג

- משודרג

- זמן פעולה תקין

- נוֹהָג

- להשתמש

- במקרה להשתמש

- משתמש

- משתמשים

- בְּדֶרֶך כְּלַל

- לנצל

- מנוצל

- לְאַמֵת

- ערך

- ערכים

- גִרְסָה אַחֶרֶת

- שונים

- באמצעות

- וִידֵאוֹ

- וידאו

- לצפיה

- וירטואלי

- חזון

- כֶּרֶך

- הַצבָּעָה

- קולות

- לבזבז

- אינטרנט

- שירותי אינטרנט

- שבוע

- מה

- מה

- אשר

- בזמן

- רָחָב

- טווח רחב

- יצטרך

- בתוך

- לְלֹא

- תיק עבודות

- עבד

- עובד

- עובדים

- עובד

- עובד

- עוֹלָם

- היה

- XGBoost

- שנה

- אתה

- זפירנט

- אפס