מְעוּדכָּן המשטרה הפדרלית של אוסטרליה ואוניברסיטת מונאש מבקשות מגולשים ברשת לשלוח תמונות של האני הצעיר שלהם כדי לאמן אלגוריתם למידת מכונה כדי לזהות התעללות בילדים בתמונות.

חוקרים מחפשים לאסוף תמונות של אנשים בני 17 ומטה בתרחישים בטוחים; הם לא רוצים עירום, אפילו אם זו תמונה תמימה יחסית כמו ילד שמתרחץ. קמפיין מיקור ההמונים, מדובב התמונות שלי חשובות, פתוח לבני 18 ומעלה, שיכולים להסכים לשימוש בתמונות שלהם למטרות מחקר.

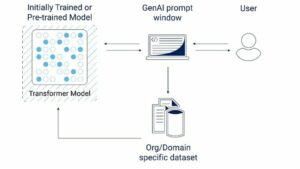

כל התמונות יצטברו לתוך מערך נתונים המנוהל על ידי אנשי אקדמיה של מונש בניסיון להכשיר מודל AI שיבחין בהבדל בין קטין בסביבה רגילה לבין מצב נצלני ולא בטוח. התוכנה יכולה, בתיאוריה, לסייע לאכיפת החוק בצורה אוטומטית ומהירה יותר לאתר חומר של התעללות מינית בילדים (הידוע גם בשם CSAM) בין אלפי על אלפי תצלומים שנמצאים בחקירה, ולהימנע מכך שאנליסטים אנושיים יבדקו כל צילום.

סקירת החומר הנורא הזה יכולה להיות תהליך איטי

השוטר הבכיר המוביל של המשטרה הפדרלית האוסטרלית, ג'ניס דאלינס, אמר כי הבינה המלאכותית שהתקבלה עשויה לעזור לזהות קורבנות ולסמן חומר בלתי חוקי שלא היה ידוע קודם לכן לקצינים.

"בשנת 2021, המרכז האוסטרלי בראשות AFP למלחמה בניצול ילדים קיבל יותר מ-33,000 דיווחים על ניצול ילדים באינטרנט וכל דיווח יכול להכיל כמויות גדולות של תמונות וסרטונים של ילדים מותקפים מינית או מנוצלים לסיפוק עבריינים", הוא אמר השבוע.

דאלינס הוא גם המנהל המשותף של מעבדת AiLECS, שיתוף הפעולה המחקרי בין אקדמאים בפקולטה לטכנולוגיות מידע של מונש ו-AFP שמנהלת את פרויקט My Pictures Matter.

"סקירת החומר הנורא הזה יכולה להיות תהליך איטי והחשיפה המתמדת עלולה לגרום למצוקה פסיכולוגית משמעותית לחוקרים", הוסיף. "היוזמות של מעבדת AiLECS יתמכו בשוטרים ובילדים עליהם אנו מנסים להגן; וחוקרים חשבו על דרך חדשנית לפתח את הטכנולוגיה מאחורי יוזמות כאלה".

הדרך הקלה ביותר להרכיב מערך נתונים גדול של תמונות היא לגרד את האינטרנט הפתוח. אבל, כמו כמה מדגמי הבינה המלאכותית העדכניים ביותר - כמו של OpenAI DALL E 2 ושל גוגל תמונה - הראו שקשה לשלוט באיכות הנתונים הללו. תמונות מוטות או לא מתאימות עלולות לזחול לתוך מערך הנתונים, מה שהופך את המודלים לבעייתיים ועלולים להיות פחות יעילים.

במקום זאת, הצוות ב-AiLECS מאמין שקמפיין מיקור ההמונים שלהם מספק דרך קלה יותר ואתית יותר לאסוף תמונות של ילדים. "כדי לפתח בינה מלאכותית שיכולה לזהות תמונות נצלניות, אנו זקוקים למספר גדול מאוד של צילומי ילדים בהקשרים 'בטוחים' יומיומיים שיכולים לאמן ולהעריך את מודלים הבינה המלאכותית שנועדו להילחם בניצול ילדים", קמפבל ווילסון, מנהל שותף של AiLECS פרופסור חבר באוניברסיטת מונאש, אמר.

על ידי השגת תצלומים ממבוגרים, באמצעות הסכמה מדעת, אנו מנסים לבנות טכנולוגיות אחראיות מבחינה אתית ושקופות

"אבל השגת התמונות האלה מהאינטרנט היא בעייתית כשאין דרך לדעת אם הילדים בתמונות האלה באמת הסכימו להעלות את התמונות שלהם או להשתמש בהן למחקר. על ידי השגת תמונות ממבוגרים, באמצעות הסכמה מדעת, אנו מנסים לבנות טכנולוגיות שהן אחראיות מבחינה אתית ושקופות".

אנשים צריכים לשלוח רק תמונות אישיות וכתובת דוא"ל כחלק מהקמפיין. נינה לואיס, מובילת פרויקט ועמיתת מחקר במעבדה, אמרה שהיא לא מתכוונת לרשום כל סוג אחר של מידע אישי. כתובות האימייל יאוחסנו במסד נתונים נפרד, כך נאמר לנו.

"התמונות והנתונים הקשורים לא יכללו כל מידע מזהה, מה שמבטיח שתמונות בהן משתמשים חוקרים לא יכולות לחשוף מידע אישי על האנשים המתוארים", אמרה. המשתתפים יקבלו עדכונים בכל שלב של הפרויקט, ויכולים לבקש להסיר את התמונות שלהם ממערך הנתונים אם הם רוצים.

המטרות הנאצלות של הפרויקט אינן בלתי אפשריות מבחינה טכנית, והן שאפתניות ביותר, כך שאנו לא יכולים לחכות לראות את התוצאות, לאור האתגרים העומדים בפני מערכות זיהוי תמונות, כגון הטיה ו התקפות נגד בין השאר מגבלות.

הקופה ביקשה מאוניברסיטת מונאש פרטים נוספים. ®

עודכן להוספה ב-6 ביוני

ד"ר לואיס של מונש היה בקשר עם כמה פרטים נוספים. היא אמרה לנו שהמטרה היא לבנות מערך נתונים של 100,000 תמונות ייחודיות כדי לאמן את מודל הבינה המלאכותית.

"נשתמש בתמונות כנתוני אימון ובדיקה עבור אלגוריתמים חדשים וקיימים המזהים ומסווגים תמונות 'בטוחות' של ילדים", הוסיפה. "אנו גם נחקור כיצד ניתן ליישם את הטכנולוגיות הללו כדי להעריך האם קבצים דיגיטליים מכילים תמונות 'לא בטוחות' של ילדים.

"פרויקט My Pictures Matter אינו אימון AI על תמונות של ילדים במצבים לא בטוחים. אנו חוקרים את התרחיש ההפוך: כיצד ליצור מערכי נתונים ממקור אתי והסכמה לשימוש בלמידת מכונה כדי לעזור להתמודד עם הנפח ההולך וגדל של תמונות התעללות בילדים שנוצרות ומופצות באמצעות פלטפורמות מקוונות".

בתגובה לכמה מההערות שלך המעלות חששות לגבי יכולתן של מערכות למידת מכונה, הוסיף ד"ר לואיס: "אנו מכירים בכך שכלים אוטומטיים צריכים להיות יותר ממכשירים קהים, וכי, למשל, נוכחות של שיעור גבוה של גוון העור. בדימוי ויזואלי אינו מעיד כשלעצמו על התעללות".

עבור אלה המודאגים מהגנת הפרטיות על הנתונים, ד"ר לואיס הצביע על הקטע "טיפול בנתונים" ב-mypicturesmatter.org לאחר לחיצה על "בוא נלך", שבו נכתב:

* תמונות וכל מידע אחר שתספק יאוחסן על ידי מעבדת AiLECS באמצעות תשתית IT של אוניברסיטת Monash ו/או שירותי ענן מאובטחים עם שרתים הממוקמים באוסטרליה. מערך הנתונים לא יתארח באף מאגרים 'פתוחים', אולם תיאור של מערך הנתונים עשוי להיות גלוי במאגרי נתונים ציבוריים.

* הגישה תהיה מוגבלת לחברים מורשים בצוות המחקר. חוקרים אחרים עשויים לקבל גישה לתמונות רק בתנאי אישור תהליכי אתיקה פורמליים, שבהם נתת רשות. אתה יכול לעדכן את העדפות שיתוף הנתונים שלך בכל עת על ידי שליחת אימייל לכתובת mypicturesmatter@ailecs.org.

* נתוני המחקר יישמרו לפחות 5 שנים לאחר השלמת כל פרויקט המשתמש במערך הנתונים. רשומות המתעדות הסכמה יישמרו עד למחיקת מערך הנתונים של המחקר.

היא גם הדגישה כי התמונות שנאספו עבור הפרויקט יוחזקו וישמשו את האוניברסיטה, ולא השוטרים ישירות.

"זה לא מערך נתונים של המשטרה, ולא יוחזק או ינוהל על ידי ה-AFP", אמר לנו ד"ר לואיס. "המחקר הזה מבוצע על ידי אוניברסיטת מונאש, עם אישור רשמי של מחקר אנושי לאופן איסוף, שימוש וניהול נתונים."

- AI

- איי אמנות

- מחולל אמנות ai

- איי רובוט

- בינה מלאכותית

- הסמכת בינה מלאכותית

- בינה מלאכותית בבנקאות

- רובוט בינה מלאכותית

- רובוטים של בינה מלאכותית

- תוכנת בינה מלאכותית

- blockchain

- blockchain conference ai

- קוינגניוס

- בינה מלאכותית של שיחה

- קריפטו כנס ai

- של דאל

- למידה עמוקה

- גוגל איי

- למידת מכונה

- אפלטון

- plato ai

- מודיעין אפלטון

- משחק אפלטון

- אפלטון נתונים

- פלטוגיימינג

- סולם ai

- תחביר

- הקופה

- זפירנט