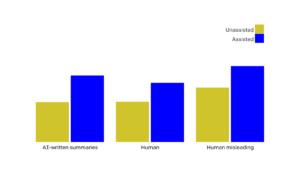

כיום, אנו מיישמים טכניקה חדשה כך ש-DALL·E יוצר תמונות של אנשים המשקפות בצורה מדויקת יותר את המגוון של אוכלוסיית העולם. טכניקה זו מיושמת ברמת המערכת כאשר DALL·E מקבל הנחיה המתארת אדם שאינו מציין גזע או מין, כמו "כבאי".

בהתבסס על ההערכה הפנימית שלנו, משתמשים היו בסבירות גבוהה פי 12 לומר שתמונות DALL·E כללו אנשים עם רקע מגוון לאחר יישום הטכניקה. אנו מתכננים לשפר את הטכניקה הזו לאורך זמן ככל שנאסוף יותר נתונים ומשוב.

ליצור

באפריל, התחלנו להציג תצוגה מקדימה של מחקר DALL·E 2 למספר מצומצם של אנשים, מה שאפשר לנו להבין טוב יותר את היכולות והמגבלות של המערכת ולשפר את מערכות הבטיחות שלנו.

במהלך שלב התצוגה המקדימה הזה, משתמשים מוקדמים סימנו תמונות רגישות ומגמות שעזרו ליידע ולהעריך את ההפחתה החדשה הזו.

אנו ממשיכים לחקור כיצד מערכות בינה מלאכותית, כמו DALL·E, עשויות לשקף הטיות בנתוני ההדרכה שלה ובדרכים שונות שבהן ניתן לטפל בהן.

במהלך התצוגה המקדימה של המחקר נקטנו בצעדים נוספים לשיפור מערכות הבטיחות שלנו, כולל:

- צמצום הסיכון של שימוש לרעה ב-DALL·E ליצירת תוכן מטעה על ידי דחיית העלאות תמונות המכילות פרצופים מציאותיים וניסיונות ליצור דמיון של אישי ציבור, כולל ידוענים ודמויות פוליטיות בולטים.

- הפיכת מסנני התוכן שלנו למדויקים יותר כדי שיהיו יעילים יותר בחסימת הנחיות והעלאות תמונות שמפרות את מדיניות התוכן תוך מתן אפשרות לביטוי יצירתי.

- חידוד מערכות ניטור אוטומטיות ואנושיות כדי להגן מפני שימוש לרעה.

שיפורים אלו עזרו לנו להשיג ביטחון ביכולת להזמין משתמשים נוספים לחוות את DALL·E.

הרחבת הגישה היא חלק חשוב שלנו פריסת מערכות AI בצורה אחראית כי זה מאפשר לנו ללמוד יותר על שימוש בעולם האמיתי ולהמשיך לחזור על מערכות הבטיחות שלנו.

- AI

- איי אמנות

- מחולל אמנות ai

- איי רובוט

- הודעות

- בינה מלאכותית

- הסמכת בינה מלאכותית

- בינה מלאכותית בבנקאות

- רובוט בינה מלאכותית

- רובוטים של בינה מלאכותית

- תוכנת בינה מלאכותית

- blockchain

- blockchain conference ai

- קוינגניוס

- בינה מלאכותית של שיחה

- קריפטו כנס ai

- של דאל

- למידה עמוקה

- גוגל איי

- למידת מכונה

- OpenAI

- אפלטון

- plato ai

- מודיעין אפלטון

- משחק אפלטון

- אפלטון נתונים

- פלטוגיימינג

- סולם ai

- תחביר

- זפירנט