概要

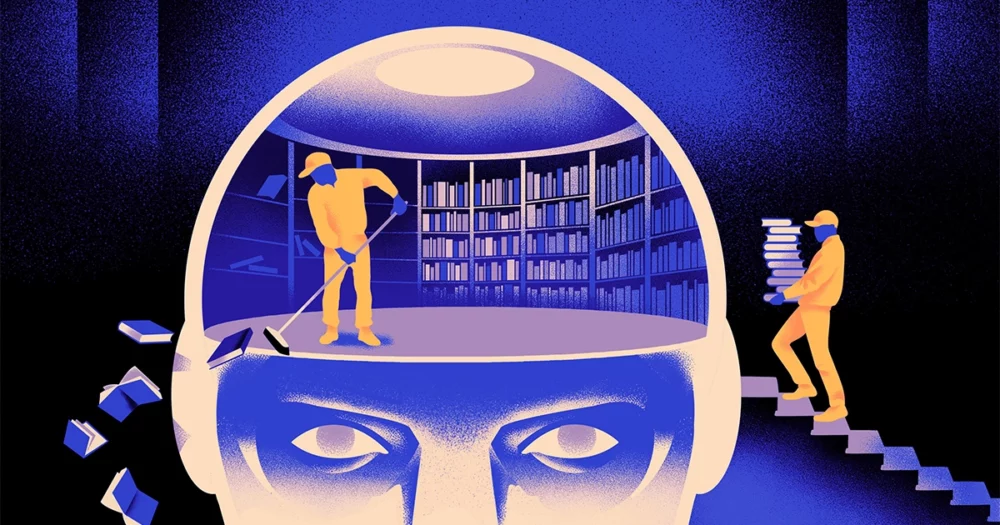

コンピューター科学者のチームが作成した より軽快で柔軟なタイプ 機械学習モデルの。コツ: 知っていることを定期的に忘れる必要があります。そして、この新しいアプローチは、最大のアプリを支える巨大なモデルに取って代わるものではありませんが、これらのプログラムが言語をどのように理解するのかについてより多くのことを明らかにする可能性があります。

新しい研究は「この分野における大きな進歩」を示すものであると同氏は述べた。 ジェ・クォン, 韓国基礎科学研究所のAIエンジニア。

現在使用されている AI 言語エンジンは主に次のようなものを利用しています。 人工神経回路網。ネットワーク内の各「ニューロン」は、他の同様のニューロンから信号を受信し、いくつかの計算を実行し、複数のニューロン層を介して信号を送信する数学関数です。最初は情報の流れは多かれ少なかれランダムですが、トレーニングを通じて、ネットワークがトレーニング データに適応するにつれてニューロン間の情報の流れが改善されます。たとえば、AI 研究者がバイリンガル モデルを作成したい場合、両方の言語の大量のテキストを使用してモデルをトレーニングします。これにより、1 つの言語のテキストを同等の言語に関連付けるようにニューロン間の接続が調整されます。他の言葉。

ただし、このトレーニング プロセスには多くのコンピューティング能力が必要です。モデルがあまりうまく機能しない場合、または後でユーザーのニーズが変化した場合、それを適応させるのは困難です。 「100 の言語を備えたモデルがあるとしますが、必要な XNUMX つの言語がカバーされていないと想像してください。」 ミケル・アルテクス、新しい研究の共著者であり、AI スタートアップ Reka の創設者です。 「最初からやり直すこともできますが、それは理想的ではありません。」

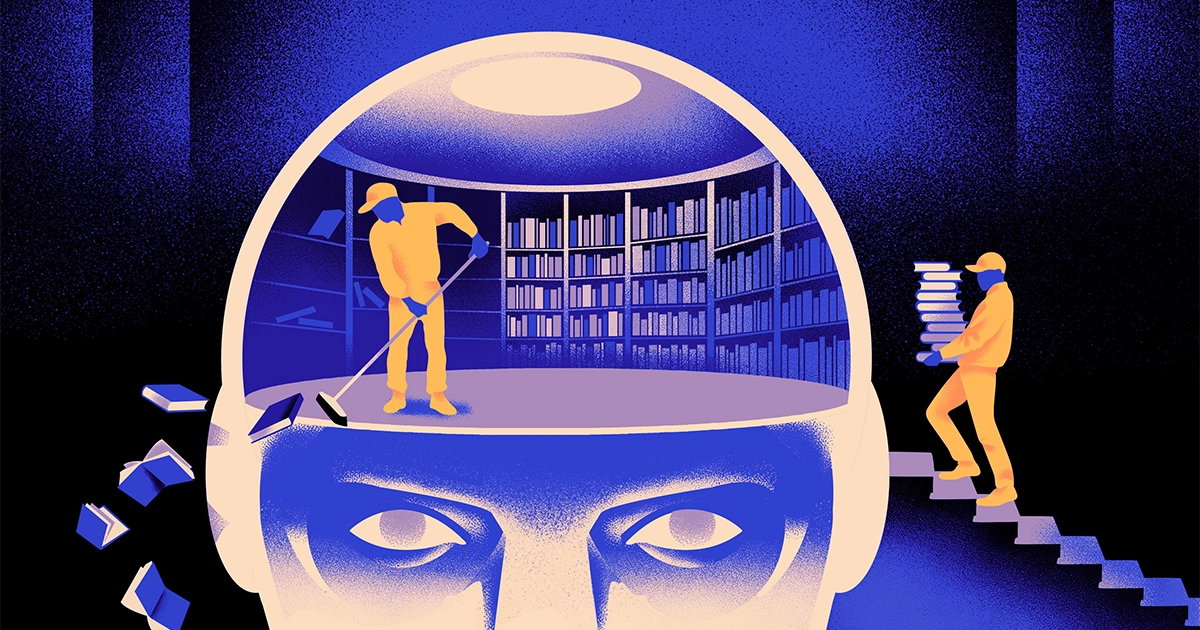

Artetxe と彼の同僚は、これらの制限を回避しようと試みました。 数年前, Artetxeらは、ニューラルネットワークを1つの言語で訓練し、トークンと呼ばれる単語の構成要素について知っている情報を消去した。これらは、埋め込み層と呼ばれるニューラル ネットワークの最初の層に保存されます。モデルの他のレイヤーはすべてそのまま残しました。最初の言語のトークンを消去した後、2 番目の言語でモデルを再トレーニングし、その言語からの新しいトークンで埋め込み層を埋め込みました。

モデルに不一致の情報が含まれていたとしても、再トレーニングは機能し、モデルは新しい言語を学習して処理できました。研究者らは、埋め込み層にはその言語で使用される単語に特有の情報が保存されている一方、ネットワークのより深いレベルには人間の言語の背後にある概念に関するより抽象的な情報が保存されており、それがモデルによる第二言語の学習に役立っているのではないかと推測した。

「私たちは同じ世界に住んでいます。私たちは同じものを異なる言葉で概念化します」と異なる言語で述べた チェン・イーホン、最近の論文の筆頭著者。 「だからこそ、これと同じ高度な推論がモデルに組み込まれているのです。リンゴとは単なる言葉ではなく、甘くてジューシーなものです。」

概要

この忘却アプローチは、すでにトレーニングされたモデルに新しい言語を追加する効果的な方法でしたが、再トレーニングには依然として要求が厳しく、大量の言語データと処理能力が必要でした。 Chen 氏は微調整を提案しました。トレーニングして埋め込み層を消去してから再トレーニングするのではなく、トレーニングの最初のラウンド中に埋め込み層を定期的にリセットする必要があります。 「これを行うことで、モデル全体がリセットに慣れてきます」と Artetxe 氏は言います。 「つまり、モデルを別の言語に拡張したい場合、それがあなたがやってきたことなので、簡単になるということです。」

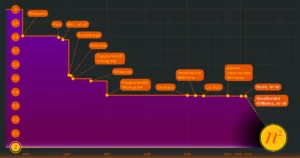

研究者らは、と呼ばれる一般的に使用されている言語モデルを採用しました。 ロベルタらは、周期的忘却手法を使用してモデルをトレーニングし、標準的な非忘却アプローチでトレーニングした場合の同じモデルのパフォーマンスと比較しました。忘却モデルの成績は従来のモデルよりわずかに悪く、言語精度の一般的な尺度の 85.1 つで 86.1 と比較して 5 のスコアを獲得しました。次に、最初のトレーニングで使用した 70 億トークンではなく、わずか 53.3 万トークンのはるかに小さいデータセットを使用して、他の言語でモデルを再トレーニングしました。標準モデルの精度は平均 62.7 まで低下しましたが、忘却モデルは XNUMX までしか低下しませんでした。

また、チームが再トレーニング中に計算制限を課した場合、忘却モデルのパフォーマンスは大幅に向上しました。研究者らがトレーニングの長さを 125,000 ステップからわずか 5,000 ステップに削減したところ、忘却モデルの精度は平均 57.8 に低下しました。一方、標準モデルは 37.2 に急落しました。これはランダムな推測と同等でした。

概要

研究チームは、定期的な忘却により、モデルの言語学習が全般的に向上するようだと結論付けました。 「彼らはトレーニング中に忘れたり再学習したりするので、後からネットワークに新しいことを教えるのが容易になります」と氏は述べた。 エフゲニー・ニキシン、ケベック州のディープラーニング研究センター、Mila の研究者。これは、言語モデルが言語を理解する際、個々の単語の意味だけではなく、より深いレベルで理解していることを示唆しています。

このアプローチは、私たち自身の脳の仕組みと似ています。 「人間の記憶は一般に、大量の詳細な情報を正確に保存するのがあまり得意ではありません。その代わりに、人間は自分の経験の要点を抽象化して外挿して記憶する傾向があります」と述べた。 ベンジャミン・レヴィ、サンフランシスコ大学の神経科学者。 「適応的忘却のような、より人間らしいプロセスを AI に実現することは、より柔軟なパフォーマンスを実現する 1 つの方法です。」

Artetxe は、理解がどのように機能するかについて述べていることに加えて、より柔軟な忘却言語モデルが、最新の AI のブレークスルーをより多くの言語にもたらすのに役立つことを期待しています。 AI モデルは、トレーニング資料が豊富にあるスペイン語と英語という 2 つの言語の処理には優れていますが、彼の母国語であるスペイン北東部特有の現地言語であるバスク語についてはあまり得意ではありません。 「大手ハイテク企業のほとんどのモデルはうまく機能しません」と彼は言う。 「既存のモデルをバスク語に適応させることが最善策です。」

チェン氏も、AIの花がさらに咲く世界を楽しみにしている。 「私は、世界が 1 つの大きな言語モデルを必要としない状況を考えています。たくさんあります」と彼女は言いました。 「言語モデルを製造する工場がある場合、この種のテクノロジーが必要です。新しいドメインにすぐに適応できる 1 つの基本モデルがあります。」

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://www.quantamagazine.org/how-selective-forgetting-can-help-ai-learn-better-20240228/

- :持っている

- :は

- :not

- :どこ

- ][p

- 000

- 1

- 100

- 125

- 7

- 70

- 8

- a

- 私たちについて

- 抽象

- 精度

- 正確にデジタル化

- 適応する

- 適応

- 適応する

- 加えます

- 添加

- 進める

- 後

- AI

- AIモデル

- すべて

- 一人で

- 既に

- また

- 金額

- an

- および

- 別の

- Apple

- アプローチ

- アプリ

- です

- AS

- At

- 著者

- 平均

- ベース

- 基本

- なぜなら

- になる

- き

- 背後に

- より良いです

- の間に

- ビッグ

- ビッグテック

- 最大の

- 10億

- ブロック

- ブルーム

- 両言語で

- ブレークスルー

- 持って来る

- 建物

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 計算

- 呼ばれます

- 缶

- センター

- 変化する

- チェン

- 回避する

- 共著者

- 同僚

- コマンドと

- 一般に

- 企業

- 比べ

- 計算的

- コンピュータ

- コンピューティング

- コンピューティングパワー

- コンセプト

- 終了する

- Connections

- 含まれている

- 従来の

- 可能性

- カバー

- 作ります

- 作成した

- カット

- データ

- データセット

- 減少した

- 深いです

- 深い学習

- より深い

- 厳しい

- 詳細な

- DID

- 異なります

- do

- そうではありません

- すること

- ドメイン

- ドント

- 落とした

- 間に

- 各

- 容易

- 効果的な

- 埋め込み

- エンジニア

- エンジン

- 英語

- 全体

- 同等の

- 例

- 既存の

- エクスペリエンス

- 伸ばす

- 工場

- 少数の

- フィールド

- 埋め

- 名

- フレキシブル

- フロー

- フォワード

- AIとMoku

- フランシスコ

- から

- function

- 一般に

- 取得する

- GitHubの

- Go

- 良い

- ハンドリング

- ハード

- 持ってる

- he

- 助けます

- 助けました

- ハイレベル

- 彼の

- 期待している

- 認定条件

- HTTPS

- 巨大な

- 人間

- 人間らしい

- 人間

- 理想

- if

- 絵

- 課さ

- 向上させる

- in

- 個人

- 情報

- 初期

- 当初

- を取得する必要がある者

- 機関

- IT

- ただ

- キープ

- 種類

- 知っている

- 韓国

- 言語

- ESL, ビジネスESL <br> 中国語/フランス語、その他

- 大

- 後で

- 最新の

- 層

- 層

- つながる

- LEARN

- 学習

- 左

- 長さ

- less

- レベル

- レベル

- ような

- 制限

- 制限

- ライブ

- ローカル

- LOOKS

- たくさん

- 機械

- 機械学習

- マガジン

- make

- 作成

- 多くの

- 材料

- 数学的

- 意味

- 手段

- だけど

- メモリ

- かもしれない

- 百万

- モデル

- 他には?

- 主に

- ずっと

- の試合に

- しなければなりません

- ネイティブ

- 必要

- ニーズ

- ネットワーク

- ニューラル

- ニューラルネットワーク

- ニューロン

- 新作

- いいえ

- of

- on

- ONE

- の

- or

- その他

- その他

- 私たちの

- が

- 自分の

- 紙素材

- パフォーマンス

- periodic

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 沈んだ

- 電力

- パワード

- プロセス

- ラボレーション

- 処理

- 処理能力

- プログラム

- クアンタマガジン

- ケベックシティ

- すぐに

- ランダム

- むしろ

- 受け取り

- 受け入れ

- 最近

- 覚えています

- の提出が必要です

- 研究

- 研究者

- 研究者

- 明らかにする

- 円形

- runs

- 前記

- 同じ

- サン

- サンフランシスコ

- 言う

- 科学

- 科学者たち

- スコア

- スクラッチ

- 二番

- と思われる

- 選択的

- 送る

- セット

- 彼女

- すべき

- 信号

- 重要

- 同様の

- 状況

- より小さい

- So

- 一部

- 何か

- サウス

- 韓国

- スペイン

- スペイン語

- 特定の

- 標準

- start

- スタートアップ

- ステップ

- まだ

- 保存され

- 保存

- そのような

- 提案する

- 甘い

- 取り

- ティーチング

- チーム

- テク

- ハイテク企業

- 技術

- テクノロジー

- 傾向があります

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- 情報

- 世界

- アプリ環境に合わせて

- それら

- その後

- ボーマン

- 彼ら

- 物事

- 考え

- この

- しかし?

- 介して

- 〜へ

- 今日

- トークン

- 取った

- トレーニング

- 訓練された

- トレーニング

- トリック

- 試み

- 微調整

- 2

- わかる

- 理解する

- 大学

- つかいます

- 中古

- 非常に

- 欲しいです

- 望んでいる

- ました

- 仕方..

- we

- webp

- WELL

- この試験は

- いつ

- which

- while

- なぜ

- Word

- 言葉

- 仕事

- 働いていました

- 作品

- 世界

- もっと悪い

- でしょう

- 年

- You

- ゼファーネット