私たちは、人間レベルのロバスト性と英語の音声認識の精度に近づく Whisper と呼ばれるニューラル ネットワークをトレーニングし、オープンソース化しています。

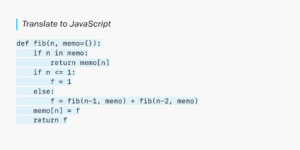

コードを表示

モデルカードを見る

ささやきの例:

Whisper は、Web から収集された 680,000 時間分の多言語およびマルチタスクの教師付きデータでトレーニングされた自動音声認識 (ASR) システムです。 このような大規模で多様なデータセットを使用すると、アクセント、バックグラウンド ノイズ、および専門用語に対する堅牢性が向上することがわかります。 さらに、多言語での文字起こしや、それらの言語から英語への翻訳も可能です。 私たちはモデルと推論コードをオープンソース化し、有用なアプリケーションを構築するための基盤として、また堅牢な音声処理に関するさらなる研究を行っています。

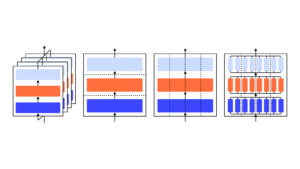

Whisper アーキテクチャは、エンコーダー/デコーダー Transformer として実装された単純なエンド ツー エンドのアプローチです。 入力オーディオは 30 秒のチャンクに分割され、log-Mel スペクトログラムに変換されてからエンコーダに渡されます。 デコーダーは、対応するテキスト キャプションを予測するようにトレーニングされており、言語識別、フレーズ レベルのタイムスタンプ、多言語音声の書き起こし、英語から英語への音声翻訳などのタスクを単一のモデルに実行させる特別なトークンと混合されています。

他の既存のアプローチでは、より小さく、より密接にペアリングされた音声テキスト トレーニング データセットが頻繁に使用されます。、または広範なが教師なしオーディオ事前トレーニングを使用する. Whisper は大規模で多様なデータセットでトレーニングされ、特定のデータセットに合わせて微調整されていないため、音声認識の競合ベンチマークとして有名な LibriSpeech のパフォーマンスに特化したモデルに勝るものはありません。 ただし、多くの多様なデータセットで Whisper のゼロ ショット パフォーマンスを測定すると、これらのモデルよりもはるかに堅牢で、エラーが 50% 少ないことがわかります。

Whisper の音声データセットの約 2 分の XNUMX は英語以外であり、元の言語で書き起こしたり、英語に翻訳したりするタスクが交互に与えられます。 このアプローチは、音声からテキストへの翻訳の学習に特に効果的であり、CoVoSTXNUMX の教師付き SOTA から英語へのゼロショット翻訳よりも優れていることがわかりました。

Whisper の高い精度と使いやすさにより、開発者がより幅広いアプリケーションに音声インターフェイスを追加できるようになることを願っています。 チェックアウト 紙, モデルカード, コード 詳細を知り、Whisper を試してみてください。