Midjourney で生成

2023 月 10 日から 16 日まで活気に満ちた都市ニューオーリンズで開催された NeurIPS XNUMX カンファレンスでは、生成 AI と大規模言語モデル (LLM) に特に重点が置かれていました。この分野における最近の画期的な進歩を考慮すると、これらのトピックが議論の大半を占めたのは驚くべきことではありません。

今年のカンファレンスの中核テーマの XNUMX つは、より効率的な AI システムの探求でした。研究者や開発者は、現在の LLM よりも速く学習するだけでなく、より少ないコンピューティング リソースを消費しながら強化された推論機能を備えた AI を構築する方法を積極的に模索しています。この追求は、汎用人工知能 (AGI) の達成に向けた競争において極めて重要であり、この目標は近い将来にますます達成可能になると思われます。

NeurIPS 2023 での招待講演は、これらのダイナミックかつ急速に進化する関心を反映したものでした。 AI 研究のさまざまな分野の発表者が最新の成果を共有し、最先端の AI 開発への扉を提供しました。この記事では、これらの講演を詳しく掘り下げ、AI イノベーションの現在および将来の状況を理解するために不可欠な重要なポイントと教訓を抽出して説明します。

NextGenAI: スケーリングの妄想と生成 AI の未来

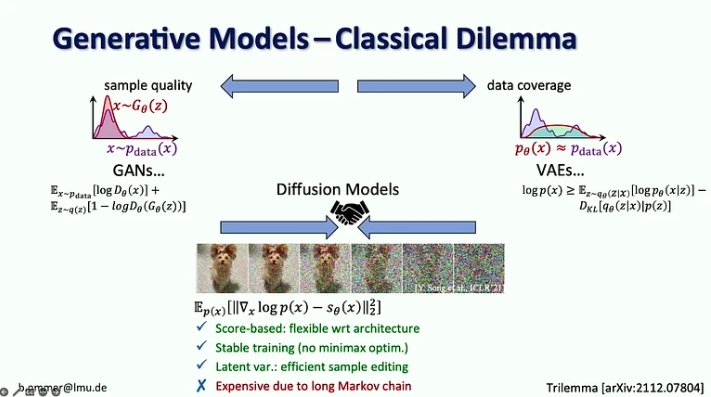

In 彼の話ルートヴィヒ マクシミリアン大学ミュンヘンのコンピューター ビジョンおよび学習グループの責任者であるビョルン オマー氏は、彼の研究室がどのようにして安定拡散を開発するに至ったのか、このプロセスから学んだいくつかの教訓、および拡散モデルとフローマッチング、検索拡張、LoRA 近似など。

主な要点

- 生成 AI の時代では、ビジョン モデルの知覚 (つまり、物体認識) に重点を置くことから、欠落部分の予測 (拡散モデルを使用した画像やビデオの生成など) に移行しました。

- 20 年間、コンピューター ビジョンはベンチマーク研究に焦点を当ててきました。これは、最も顕著な問題に焦点を当てるのに役立ちました。 Generative AI では、最適化するためのベンチマークが存在しないため、誰もが独自の方向に進むことができる分野が開かれました。

- 拡散モデルは、スコアベースで安定したトレーニング手順と効率的なサンプル編集を行うことで、以前の生成モデルの利点を組み合わせていますが、マルコフ連鎖が長いため高価です。

- 強尤度モデルの課題は、ほとんどのビットが人間の目ではほとんど認識できない詳細に含まれるのに対し、最も重要なセマンティクスのエンコードには数ビットしかかからないことです。コンピューティング リソースの需要は GPU 供給の 9 倍の速さで増加しているため、スケーリングだけではこの問題は解決できません。

- 提案されるソリューションは、拡散モデルと ConvNet の長所、特に局所的な詳細を表現するための畳み込みの効率と、長距離コンテキストに対する拡散モデルの表現力を組み合わせることです。

- Björn Ommer は、フローマッチングアプローチを使用して、小さな潜在拡散モデルから高解像度の画像合成を可能にすることも提案しています。

- 画像合成の効率を高めるもう XNUMX つのアプローチは、詳細を埋めるために検索拡張を使用しながら、シーンの構成に焦点を当てることです。

- 最後に、彼は制御された確率的ビデオ合成のための iPoke アプローチを紹介しました。

この詳細な内容がお役に立てば、 AIメーリングリストに登録する 新しい素材がリリースされたときに警告が表示されます。

責任ある AI のさまざまな側面

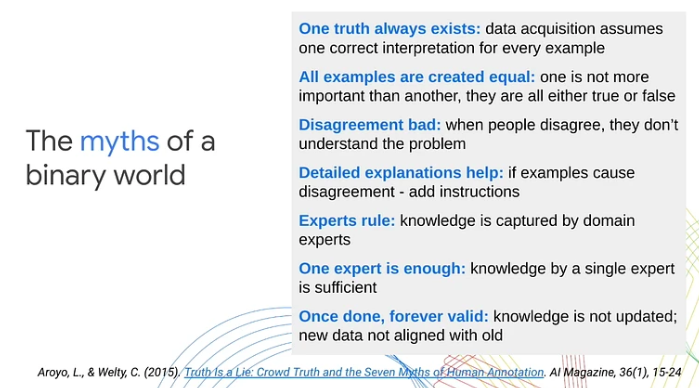

In 彼女のプレゼンテーション, Google Research の研究員である Lora Aroyo 氏は、従来の機械学習アプローチの重要な制限、つまりデータを肯定的な例と否定的な例として二値に分類することに依存していることを強調しました。この過度の単純化は、現実世界のシナリオやコンテンツに内在する複雑な主観性を見落とすことになる、と彼女は主張した。アロヨ氏は、さまざまな使用例を通じて、コンテンツの曖昧さと人間の視点の自然な違いが、しばしば避けられない意見の相違につながることを実証しました。彼女は、これらの意見の相違を単なるノイズではなく、意味のある信号として扱うことの重要性を強調しました。

講演からの重要なポイントは次のとおりです。

- 人間の労働者間の意見の相違は生産的なものになる可能性があります。 Lora Aroyo 氏は、すべての回答を正しいか間違っているかとして扱うのではなく、評価者の意見の不一致を利用してデータの信頼性を評価するための分布的真実のアプローチである「不一致による真実」を導入しました。

- 専門家の間でも群衆の労働者と同じくらい意見が異なるため、データの品質は専門家であっても困難です。こうした意見の相違は、XNUMX 人の専門家からの回答よりもはるかに有益な情報となる可能性があります。

- 安全性評価タスクでは、専門家の意見が 40% の例で一致していません。これらの意見の相違を解決しようとするのではなく、そのような例をさらに収集し、それらをモデルと評価指標の改善に使用する必要があります。

- ローラ・アロヨもプレゼンテーションを行いました。 多様性と安全性 データの内容と誰が注釈を付けたかという観点からデータを精査するための方法。

- この方法により、さまざまな人口統計上の評価者グループ (合計 2.5 万の評価) にわたる LLM 安全性判断のばらつきを含むベンチマーク データセットが生成されました。

- 会話の 20% については、チャットボットの応答が安全か危険かを判断するのは困難でした。これは、チャットボットの応答を安全または安全ではないとラベル付けした回答者の数がほぼ同数だったためです。

- 評価者とデータの多様性は、モデルの評価において重要な役割を果たします。人間の幅広い視点とコンテンツに存在する曖昧さを認識しないと、機械学習のパフォーマンスを現実世界の期待と一致させることが妨げられる可能性があります。

- AI の安全性への取り組みの 80% はすでにかなり優れていますが、残りの 20% では、無限の多様性空間におけるエッジ ケースとすべてのバリアントに対処するために XNUMX 倍の努力が必要です。

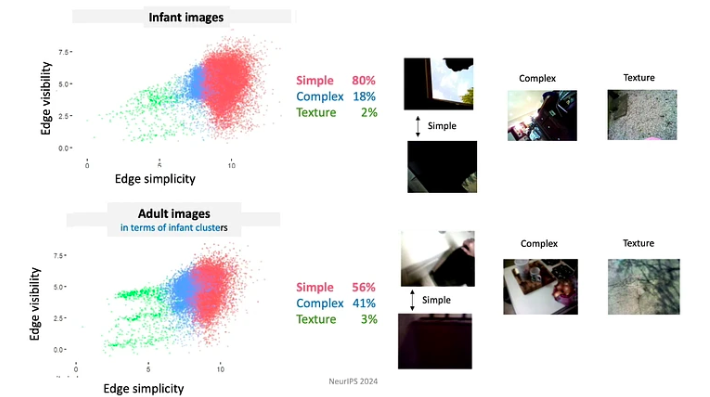

一貫性のある統計、自己生成の経験、そして若い人間が現在の AI よりもはるかに賢い理由

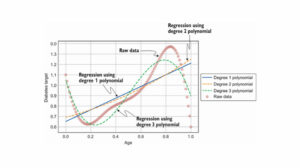

In 彼女の話, インディアナ大学ブルーミントン校の特別教授であるリンダ・スミス氏は、乳児や幼児の学習プロセスにおけるデータの希薄性というテーマを調査しました。彼女は特に物体認識と名前学習に焦点を当て、幼児による自己生成経験の統計がデータの希薄性の課題にどのように潜在的な解決策を提供するかを詳しく掘り下げました。

主な要点

- 16,000 歳までに、子供たちはさまざまな分野を一発で学習できる能力を発達させます。 1,000 歳の誕生日までの XNUMX 時間未満の起床時間で、子どもたちは XNUMX 以上のオブジェクト カテゴリを学習し、母国語の構文をマスターし、環境の文化的および社会的ニュアンスを吸収します。

- リンダ・スミス博士と彼女のチームは、子供たちがそのようなまばらなデータから非常に多くのことを捉えることを可能にする人間の学習の XNUMX つの原則を発見しました。

- 学習者は入力を制御し、入力を形成し、構築する瞬間ごとに入力を制御します。たとえば、生後数か月間、赤ちゃんは単純なエッジを持つ物体をよく見る傾向があります。

- 赤ちゃんは知識と能力において継続的に進化するため、非常に制約されたカリキュラムに従います。彼らがさらされるデータは、非常に重要な方法で編成されています。たとえば、4 か月未満の赤ちゃんは顔を見るのに最も多くの時間を費やし、15 時間あたり約 12 分ですが、20 か月以上の赤ちゃんは主に手に焦点を当て、XNUMX 時間あたり約 XNUMX 分観察します。

- 学習エピソードは、相互に関連した一連の経験で構成されます。空間的および時間的な相関により一貫性が生まれ、その結果、一度限りの出来事から永続的な記憶の形成が促進されます。たとえば、ランダムなおもちゃの組み合わせを与えられると、子供たちはいくつかの「お気に入り」のおもちゃに集中することがよくあります。彼らは反復的なパターンを使用してこれらのおもちゃに取り組みます。これは、オブジェクトのより迅速な学習に役立ちます。

- 一時的(作業)記憶は、感覚入力よりも長く持続します。学習プロセスを強化する特性には、マルチモダリティ、関連付け、予測関係、および過去の記憶の活性化が含まれます。

- 迅速な学習を実現するには、データを生成するメカニズムと学習するメカニズムを連携させる必要があります。

スケッチ: コアツール、学習拡張、適応堅牢性

カリフォルニア大学バークレー校の電気工学およびコンピューターサイエンスの教授であるジェラニ・ネルソン氏は、次のように述べています。 データ「スケッチ」の概念を導入 – 有用なクエリに応答できるデータセットのメモリ圧縮表現。講演はかなり専門的でしたが、最近の進歩を含むいくつかの基本的なスケッチ ツールの優れた概要を提供しました。

重要なポイント:

- コアスケッチツールである CountSketch は、「ヘビーヒッター」の問題に対処するために 2002 年に初めて導入され、指定されたアイテムの流れから最も頻繁に使用されるアイテムの小さなリストを報告しました。 CountSketch は、この目的で使用された最初の既知のサブリニア アルゴリズムです。

- ヘビーヒッターの XNUMX つの非ストリーミング アプリケーションは次のとおりです。

- 内点ベース法 (IPM) は、線形計画法に漸近的に最速の既知のアルゴリズムを提供します。

- LLM で使用される長いコンテキストの複雑さの増大によってもたらされる計算上の課題に対処する HyperAttendant メソッド。

- 最近の研究の多くは、適応型インタラクションに対して堅牢なスケッチの設計に焦点を当てています。主なアイデアは、適応型データ分析からの洞察を使用することです。

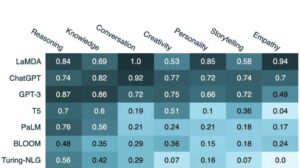

スケーリングを超えたパネル

この 大規模な言語モデルに関する優れたパネル コーネル工科大学の准教授でハギング・フェイスの研究者でもあるアレクサンダー・ラッシュが司会を務めた。他の参加者は次のとおりです。

- Aakanksha Chowdhery – Google DeepMind の研究員で、システム、LLM 事前トレーニング、マルチモダリティに研究関心を持っています。彼女は、PaLM、Gemini、Pathways を開発するチームの一員でした。

- Angela Fan – Meta Generative AI の研究員で、アラインメント、データセンター、多言語に研究関心を持っています。彼女は Llama-2 と Meta AI Assistant の開発に参加しました。

- Percy Liang – クリエイター、オープンソース、生成エージェントを研究するスタンフォード大学の教授。彼はスタンフォード大学基礎モデル研究センター (CRFM) の所長であり、Togetter AI の創設者でもあります。

議論は、(1) アーキテクチャとエンジニアリング、(2) データと調整、(3) 評価と透明性、(4) 作成者と貢献者という XNUMX つの主要なトピックに焦点を当てました。

このパネルからの要点の一部を以下に示します。

- 現在の言語モデルをトレーニングすることは、本質的には難しいことではありません。 Llama-2-7b のようなモデルをトレーニングする際の主な課題は、インフラストラクチャ要件と、複数の GPU、データ センターなどの間で調整する必要があることにあります。ただし、パラメータの数が単一の GPU でトレーニングできるほど十分に小さい場合は、学部生でも管理できます。

- 自己回帰モデルは通常、テキスト生成に使用され、拡散モデルは画像やビデオを生成するために使用されますが、これらのアプローチを逆にする実験も行われています。具体的には、Gemini プロジェクトでは、画像生成に自己回帰モデルが利用されています。テキスト生成に拡散モデルを使用する研究も行われていますが、十分な効果があるとはまだ証明されていません。

- モデルのトレーニングに使用できる英語データが限られているため、研究者は代替アプローチを模索しています。可能性の XNUMX つは、テキスト、ビデオ、画像、オーディオの組み合わせでマルチモーダル モデルをトレーニングすることであり、これらの代替モダリティから学習したスキルがテキストに応用される可能性があることが期待されます。もう XNUMX つのオプションは、合成データの使用です。合成データは実際のデータに混ざることがよくありますが、この統合はランダムではないことに注意することが重要です。オンラインで公開されるテキストは通常、人間によるキュレーションと編集を受けており、これによりモデルのトレーニングに付加価値が付加される可能性があります。

- オープン基盤モデルは、イノベーションには有益であるものの、悪意のある攻撃者によって悪用される可能性があるため、AI の安全性にとって潜在的に有害であると見なされることもよくあります。しかし、パーシー・リャン博士は、オープンモデルも安全性にプラスに寄与すると主張しています。同氏は、アクセス可能であることで、より多くの研究者が AI の安全性研究を実施し、モデルの潜在的な脆弱性を検討する機会を提供できると主張しています。

- 現在、データに注釈を付けるには、XNUMX 年前と比較して、注釈ドメインにおけるより多くの専門知識が必要です。しかし、将来的に AI アシスタントが期待どおりに機能するようになれば、ユーザーからより貴重なフィードバック データを受け取ることができ、アノテーターからの膨大なデータへの依存が軽減されます。

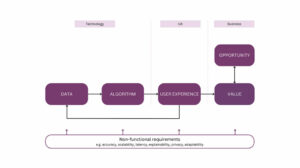

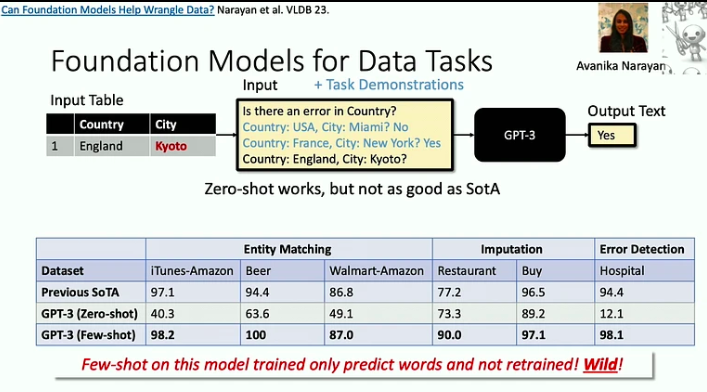

基礎モデルのためのシステム、およびシステムのための基礎モデル

In この話, スタンフォード大学コンピューターサイエンス学部の准教授であるクリストファー・レ氏は、基礎モデルが私たちが構築するシステムをどのように変えたかを示しています。また、データベース システム研究からの洞察を借用して基礎モデルを効率的に構築する方法を検討し、Transformer よりも潜在的に効率的な基礎モデルのアーキテクチャについても説明します。

この講演から得られる重要なポイントは次のとおりです。

- 基礎モデルは、「1000 回切断による死亡」問題に対処するのに効果的です。この問題では、個々のタスクは比較的単純かもしれませんが、タスクの広さと多様性が大きな課題となります。この好例はデータ クリーニングの問題であり、LLM はこの問題をより効率的に解決できるようになりました。

- アクセラレータが高速になるにつれて、メモリがボトルネックとして浮上することがよくあります。これはデータベース研究者が数十年にわたって取り組んできた問題であり、私たちは彼らの戦略の一部を採用することができます。たとえば、フラッシュ アテンション アプローチは、ブロッキングと積極的な融合を通じて入出力フローを最小限に抑えます。つまり、情報にアクセスするたびに、その情報に対して可能な限り多くの操作を実行します。

- 信号処理に根ざした新しいクラスのアーキテクチャがあり、特に長いシーケンスの処理において Transformer モデルよりも効率的になる可能性があります。信号処理は安定性と効率性を提供し、S4 のような革新的なモデルの基礎を築きます。

デジタルヘルス介入におけるオンライン強化学習

In 彼女の話, ハーバード大学の統計およびコンピューターサイエンスの教授であるスーザン・マーフィー氏は、デジタルヘルス介入で使用するオンラインRLアルゴリズムの開発において直面するいくつかの課題に対する最初の解決策を共有しました。

プレゼンテーションの要点をいくつか紹介します。

- スーザン・マーフィー博士は、彼女が取り組んでいる XNUMX つのプロジェクトについて説明しました。

- スマートフォンやウェアラブルトラッカーのデータに基づいてアクティビティを提案する「HeartStep」と、

- 口腔健康コーチングのためのオーラリティクス。電子歯ブラシから受信したエンゲージメント データに基づいて介入が行われました。

- AI エージェントの動作ポリシーを開発する際、研究者は、AI エージェントが自律的であり、より広範な医療システムに実現可能に実装できることを確認する必要があります。これには、個人の関与に必要な時間が妥当であること、および推奨される行動が倫理的に健全で科学的に妥当であることを保証することが含まれます。

- デジタル健康介入のための RL エージェントを開発する際の主な課題には、人々が生活を送り、メッセージに応答したくても常に応答できるとは限らないため、高いノイズレベルに対処することや、強力で遅延する悪影響を管理することが含まれます。 。

ご覧のとおり、NeurIPS 2023 は AI の未来を明るく垣間見せてくれました。招待講演では、より効率的でリソースを意識したモデルへの傾向と、従来のパラダイムを超えた新しいアーキテクチャの探求が強調されました。

この記事をお楽しみください? AIリサーチの最新情報にサインアップしてください。

このような要約記事がさらにリリースされたらお知らせします。

関連記事

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://www.topbots.com/neurips-2023-invited-talks/

- :持っている

- :は

- :not

- :どこ

- $UP

- 000

- 1

- 10

- 10

- 11

- 12

- 12か月間

- 125

- 13

- 14

- 視聴者の38%が

- 154

- 16

- 16

- 17

- 20

- 20年

- 2023

- 32

- 視聴者の38%が

- 41

- 58

- 7

- 70

- 710

- 8

- 9

- a

- 能力

- できる

- 私たちについて

- 加速器

- アクセス

- アクセス可能な

- 実績

- 達成する

- 認める

- 越えて

- 行動

- アクティベーション

- 積極的に

- 活動

- 俳優

- 適応

- 加えます

- NEW

- 住所

- アドレス

- アドレッシング

- 採用

- 進歩

- 利点

- 年齢

- エージェント

- エージェント

- 積極的な

- AGI

- 前

- AI

- AIアシスタント

- 愛の研究

- AIシステム

- エイズ

- アレクサンダー

- アルゴリズム

- アルゴリズム

- アラインメント

- すべて

- アライアンス

- 許す

- 一人で

- 既に

- また

- 代替案

- しかし

- 常に

- 曖昧さ

- 間で

- an

- 分析

- および

- 別の

- どれか

- アプローチ

- アプローチ

- 約

- です

- 主張した

- 主張する

- 記事

- 物品

- 人工の

- 人工総合知能

- AS

- 評価中

- アシスタント

- アシスタント

- 仲間

- 団体

- 品揃え

- At

- 達成できる

- 注意

- オーディオ

- 自律的

- 賃貸条件の詳細・契約費用のお見積り等について

- ベース

- BE

- なぜなら

- になる

- き

- 行動

- さ

- ベンチマーク

- ベンチマーク

- 有益な

- バークリー

- の間に

- 越えて

- ブレンド

- ブロッキング

- 借り入れ

- 両言語で

- 幅

- より広い

- ビルド

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 来ました

- 缶

- 機能

- キャプチャー

- 例

- カテゴリ

- センター

- センター

- チェーン

- 挑戦する

- 課題

- 変更

- チャットボット

- 子供達

- クリストファー

- 市町村

- class

- クリーニング

- コーチング

- 収集する

- 組み合わせ

- 組み合わせる

- 比べ

- 複雑な

- 複雑さ

- 構図

- 計算的

- コンピュータ

- コンピュータサイエンス

- Computer Vision

- コンピューティング

- コンセプト

- プロフェッショナルな方法で

- 講演

- 構築する

- 消費する

- コンテンツ

- コンテキスト

- 文脈

- 継続的に

- 貢献する

- 貢献者

- コントロール

- 制御

- 会話

- 調整する

- 基本

- コーネル

- 正しい

- 相関関係

- 可能性

- 作ります

- クリエイター

- 群衆

- 重大な

- 文化的な

- キュレーション

- 電流プローブ

- カリキュラム

- 最先端

- データ

- データ分析

- データセンター

- データベース

- 取引

- 数十年

- 12月

- 決めます

- ディープマインド

- 遅延

- 掘り下げる

- 需要

- 需要

- 人口動態

- 実証

- 部門

- 設計

- 詳細

- 細部

- 開発する

- 発展した

- 開発者

- 開発

- 開発

- 進展

- 難しい

- デジタル

- デジタルヘルス

- 方向

- 取締役

- 発見

- 議論する

- 議論

- 議論

- 議論

- 優れました

- 多様性

- ドメイン

- ドメイン

- 優勢

- ドント

- 倍増し

- dr

- 原因

- 間に

- ダイナミック

- e

- 各

- エッジ(Edge)

- 効果的な

- 効果

- 効率

- 効率的な

- 効率良く

- 努力

- 努力

- どちら

- エレクトロニック

- 出てくる

- 強調

- 強調

- enable

- 可能

- エンコーディング

- 従事する

- 婚約

- エンジニアリング

- 高めます

- 強化された

- 十分な

- 確保

- 確保する

- 環境

- 等しい

- 特に

- 本質的な

- 等

- 評価します

- 評価

- さらに

- イベント

- 誰も

- 進化

- 進化

- 例

- 例

- 優れた

- 期待

- 期待

- 予想される

- 高価な

- 体験

- エクスペリエンス

- 実験

- エキスパート

- 専門知識

- 専門家

- 搾取

- 探査

- 調査済み

- 探検する

- 探る

- 露出した

- 広範囲

- 目

- 顔

- 顔

- 促進する

- 失敗

- ファン

- 速いです

- 最速

- フィードバック

- 少数の

- より少ない

- フィールド

- 埋める

- 名

- 五

- フラッシュ

- フロー

- 流れ

- フォーカス

- 焦点を当て

- 予見

- 形成

- Foundation

- AIとMoku

- 4

- 第4

- 頻繁な

- 頻繁に

- から

- 基本的な

- 融合

- 未来

- 双子座

- 一般情報

- 生成する

- 生成

- 世代

- 生々しい

- 生成AI

- 与えられた

- 与える

- 垣間見ます

- Go

- 目標

- 良い

- でログイン

- GPU

- GPU

- 画期的な

- グループ

- グループの

- 成長

- 持っていました

- ハンドリング

- ハンド

- 有害な

- 利用する

- ハーバード

- ハーバード大学

- 持ってる

- he

- 健康

- ヘルスケア

- ヘビー

- ヒーロー

- 助けます

- 助けました

- 彼女の

- ハイ

- 高解像度の

- 強調表示された

- 非常に

- 邪魔する

- 彼の

- 時間

- HOURS

- 認定条件

- How To

- しかしながら

- HTTP

- HTTPS

- 人間

- 人間

- i

- アイデア

- if

- 照らす

- 画像

- 画像

- 実装

- 重要性

- 重要

- 改善します

- in

- 綿密な

- include

- 含まれました

- 含めて

- の増加

- ますます

- 個人

- 避けられない

- 無限

- 情報

- 有益な

- インフラ

- 固有の

- 本質的に

- 革新的手法

- 革新的な

- 洞察

- を取得する必要がある者

- 統合

- インテリジェンス

- 相互作用

- 相互接続

- 利益

- 介入

- に

- 導入

- 招聘

- IT

- リーディングシート

- JPG

- 判断

- キー

- 知っている

- 知識

- 既知の

- ラボ

- ラベリング

- 風景

- 言語

- 大

- 持続する

- 最新の

- 敷設

- つながる

- 主要な

- LEARN

- 学んだ

- 学習者

- 学習

- 学ぶ

- Legacy

- less

- レッスン

- う

- レベル

- ある

- 光

- ような

- 尤度

- 制限

- 限定的

- リンダ

- リスト

- 命

- LLM

- ローカル

- 長い

- より長いです

- 見て

- 探して

- 機械

- 機械学習

- 郵送

- メイン

- 管理します

- 管理する

- 多くの

- マスター

- マッチング

- 材料

- 事態

- 最大幅

- 五月..

- 意味のある

- メカニズム

- 思い出

- メモリ

- 単なる

- メッセージ

- Meta

- 方法

- メトリック

- かもしれない

- 百万

- 最小化する

- 分

- 行方不明

- モデル

- 瞬間

- ヶ月

- 他には?

- もっと効率的

- 最も

- 移動

- ずっと

- の試合に

- しなければなりません

- 名

- ネイティブ

- ナチュラル

- 必要

- 負

- 新作

- ニューオーリンズ

- いいえ

- ノイズ

- なし

- 注意

- 小説

- 今

- ニュアンス

- 数

- オブジェクト

- オブジェクト

- of

- 提供

- 提供すること

- オファー

- 頻繁に

- 古い

- on

- ONE

- オンライン

- の

- 開いた

- オープンソース

- 開かれた

- 業務執行統括

- 機会

- 最適化

- オプション

- or

- 口腔衛生

- 整理

- オルレアン

- その他

- その他の参加者

- その他

- 私たちの

- が

- 概要

- 自分の

- ヤシ

- パネル

- パラダイム

- パラメータ

- 部

- 参加者

- 参加

- 特定の

- 特に

- 部品

- 過去

- 経路

- パターン

- のワークプ

- 以下のために

- 知覚

- 実行する

- パフォーマンス

- 視点

- ピース

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- もっともらしい

- 演劇

- 方針

- 提起

- 正の

- 積極的に

- 所持

- 可能性

- 可能

- 潜在的な

- :

- 予測

- 現在

- プレゼンテーション

- PLM platform.

- 前

- 主に

- 主要な

- 原則

- 問題

- 問題

- 手続き

- プロセス

- ラボレーション

- 処理

- 生産された

- 生産性の高い

- 東京大学大学院海洋学研究室教授

- 深く

- プログラミング

- プロジェクト

- プロジェクト(実績作品)

- 著名な

- プロパティ

- 実績のある

- 提供します

- 提供

- 公表

- 目的

- 追求

- 品質

- クエリ

- クエスト

- 非常に

- レース

- ランダム

- 範囲

- 急速な

- 急速に

- むしろ

- 評価

- リアル

- 現実の世界

- 合理的な

- 受け取ります

- 受け

- 最近

- 認識

- 推奨される

- 縮小

- 反射

- 関係

- 相対的に

- リリース

- 信頼性

- 依存

- 残り

- 反復的な

- 各種レポート作成

- 表現

- 表します

- 必要とする

- の提出が必要です

- 要件

- 研究

- 研究者

- 研究者

- 解決する

- リソース

- 反応します

- 回答者

- 応答

- 回答

- 責任

- レビュー

- 堅牢な

- 職種

- 根付いた

- 大体

- ラッシュ

- 安全な

- 安全性

- スケーリング

- シナリオ

- シーン

- 科学

- 科学

- 科学者

- を求める

- と思われる

- 見て

- 意味論

- シリーズ

- シェーピング

- shared

- 彼女

- 作品

- 符号

- シグナル

- 信号

- 重要

- 著しく

- 簡単な拡張で

- スキル

- 小さい

- 賢い

- スマートフォン

- So

- 社会

- 溶液

- ソリューション

- 解決する

- 一部

- 音

- ソース

- スペース

- 空間の

- 特に

- 過ごす

- 安定性

- 安定した

- スタンフォード

- スタンフォード大学

- 統計

- まだ

- 作戦

- 流れ

- 強み

- 強い

- 構造化

- そのような

- 提案する

- 概要

- 供給

- 驚き

- スーザン

- 構文

- 合成

- 合成

- 合成データ

- システム

- まとめ

- 取り

- Talk

- トーク

- 仕事

- タスク

- チーム

- テク

- 技術的

- 傾向があります

- 条件

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- より

- それ

- 未来

- アプリ環境に合わせて

- それら

- テーマ

- そこ。

- ボーマン

- 彼ら

- この

- それらの

- 三

- 介して

- 時間

- 〜へ

- 一緒に

- ツール

- 豊富なツール群

- トップボット

- トピック

- トピック

- トータル

- に向かって

- トラッカー

- 伝統的な

- トレーニング

- 転送

- トランス

- 透明性

- 治療

- トレンド

- 真実

- しよう

- 順番

- 2

- 一般的に

- 下

- 被災者

- 理解する

- 大学

- 更新版

- つかいます

- 中古

- users

- 通常

- 利用された

- 貴重な

- 値

- 多様

- さまざまな

- 活気のある

- ビデオ

- 動画

- 視点

- ビジョン

- 脆弱性

- W3

- ました

- 方法

- we

- ウェアラブルな

- WELL

- した

- この試験は

- いつ

- たびに

- 一方

- かどうか

- which

- while

- 誰

- なぜ

- ワイド

- 広い範囲

- 意志

- ウィンドウを使用して入力ファイルを追加します。

- 希望

- 仕事

- ワーキング

- 間違った

- 年

- まだ

- You

- 若い

- ゼファーネット