IDP(Intelligent Document Processing)는 텍스트, 이미지, 동영상 등 대량의 비정형 데이터를 자동으로 처리하는 기술입니다. IDP는 비용, 오류, 낮은 정확도, 제한된 확장성과 같은 문제를 해결함으로써 수동 방법 및 레거시 광학 문자 인식(OCR) 시스템을 크게 개선하여 궁극적으로 조직과 이해관계자에게 더 나은 결과를 제공합니다.

자연어 처리(NLP)는 정확성과 사용자 경험을 개선한 IDP의 최근 개발 중 하나입니다. 그러나 이러한 발전에도 불구하고 여전히 극복해야 할 과제가 있습니다. 예를 들어, 많은 IDP 시스템은 사용자가 쉽게 채택할 수 있을 만큼 사용자 친화적이거나 직관적이지 않습니다. 또한 여러 기존 솔루션에는 지속적인 개선 및 업데이트를 통해 데이터 소스, 규정 및 사용자 요구 사항의 변화에 적응하는 기능이 부족합니다.

대화를 통해 IDP를 강화하려면 대화 기능을 IDP 시스템에 통합해야 합니다. 부정확한 정보를 조정하거나 작업 자동화를 통해 누락된 정보를 추가하여 다단계 대화를 통해 사용자가 보다 자연스럽고 직관적인 방식으로 IDP 시스템과 상호 작용할 수 있게 함으로써 이러한 시스템은 보다 효율적이고 정확하며 사용자 친화적이 될 수 있습니다.

이 게시물에서는 아마존 재단 모델 및 세이지메이커 점프스타트.

솔루션 개요

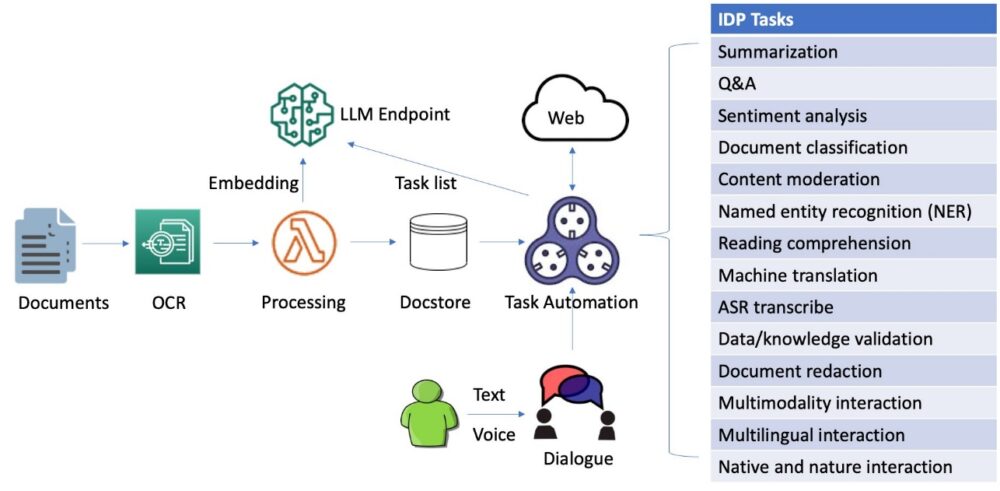

이 혁신적인 솔루션은 정보 추출을 위한 OCR, 대화 및 자율 작업을 위한 로컬 배포 대규모 언어 모델(LLM), 하위 작업 포함을 위한 VectorDB, 외부 데이터 소스와의 통합을 위한 LangChain 기반 작업 자동화를 결합하여 기업이 문서를 처리하고 분석하는 방식을 혁신합니다. 컨텍스트. 조직은 생성 AI 기술을 활용하여 IDP 워크플로를 간소화하고 사용자 경험을 향상하며 전반적인 효율성을 높일 수 있습니다.

다음 비디오는 처리를 통해 대화 안내 IDP 시스템을 강조 표시합니다. 기사 에 의해 저작 연방 준비 제도 이사회, 2023년 XNUMX월 실리콘 밸리 은행의 붕괴에 대해 논의합니다.

이 시스템은 이미지, 대용량 PDF 및 다른 형식의 문서를 처리하고 대화형 텍스트 또는 음성 입력을 통해 콘텐츠에서 파생된 질문에 답할 수 있습니다. 사용자가 문서의 맥락을 넘어서 질문해야 하는 경우 대화 안내 IDP는 텍스트 프롬프트에서 일련의 작업을 생성한 다음 관련 답변을 위해 외부 및 최신 데이터 소스를 참조할 수 있습니다. 또한 다자간 대화를 지원하고 다국어 교환을 수용하며 모두 대화를 통해 관리됩니다.

Amazon 기반 모델을 사용하여 자체 LLM 배포

제너레이티브 AI에서 가장 유망한 개발 중 하나는 LLM을 대화 시스템에 통합하여 보다 직관적이고 의미 있는 교환을 위한 새로운 길을 여는 것입니다. LLM은 인간과 유사한 텍스트를 이해하고 생성하도록 설계된 일종의 AI 모델입니다. 이러한 모델은 방대한 양의 데이터로 학습되고 수십억 개의 매개변수로 구성되어 다양한 언어 관련 작업을 높은 정확도로 수행할 수 있습니다. 이 혁신적인 접근 방식은 보다 자연스럽고 생산적인 상호 작용을 촉진하여 인간의 직관과 기계 지능 사이의 격차를 해소합니다. 로컬 LLM 배포의 주요 이점은 타사 API 외부에 데이터를 제출하지 않고도 데이터 보안을 강화할 수 있다는 것입니다. 또한 도메인별 데이터로 선택한 LLM을 미세 조정할 수 있으므로 보다 정확하고 상황 인식 및 자연어 이해 경험을 얻을 수 있습니다.

AI2 Labs의 Jurassic-21 시리즈는 강사가 튜닝한 178억 개의 매개변수 Jurassic-1 LLM을 기반으로 하며 다음을 통해 사용할 수 있는 Amazon 기초 모델의 필수 부분입니다. 아마존 기반암. Jurassic-2 인스트럭트는 제로 샷, 예가 필요하지 않거나 몇 발. 이 방법은 LLM과 가장 직관적인 상호 작용을 제공하며, 예를 들어 설명하지 않고 작업에 대한 이상적인 출력을 이해하는 가장 좋은 방법입니다. 다음을 사용하여 사전 훈련된 J2-jumbo-instruct 또는 AWS Marketplace에서 사용할 수 있는 기타 Jurassic-2 모델을 자체 Virtual Private Cloud(VPC)에 효율적으로 배포할 수 있습니다. 아마존 세이지 메이커. 다음 코드를 참조하십시오.

import ai21, sagemaker # Define endpoint name

endpoint_name = "sagemaker-soln-j2-jumbo-instruct"

# Define real-time inference instance type. You can also choose g5.48xlarge or p4de.24xlarge instance types

# Please request P instance quota increase via <a href="https://console.aws.amazon.com/servicequotas/home" target="_blank" rel="noopener">Service Quotas console</a> or your account manager

real_time_inference_instance_type = ("ml.p4d.24xlarge") # Create a Sgaemkaer endpoint then deploy a pre-trained J2-jumbo-instruct-v1 model from AWS Market Place.

model_package_arn = "arn:aws:sagemaker:us-east-1:865070037744:model-package/j2-jumbo-instruct-v1-0-20-8b2be365d1883a15b7d78da7217cdeab"

model = ModelPackage(

role=sagemaker.get_execution_role(),

model_package_arn=model_package_arn,

sagemaker_session=sagemaker.Session()

) # Deploy the model

predictor = model.deploy(1, real_time_inference_instance_type,

endpoint_name=endpoint_name,

model_data_download_timeout=3600,

container_startup_health_check_timeout=600,

)엔드포인트가 자체 VPC 내에 성공적으로 배포된 후 추론 작업을 시작하여 배포된 LLM이 예상대로 작동하는지 확인할 수 있습니다.

response_jumbo_instruct = ai21.Completion.execute(

sm_endpoint=endpoint_name,

prompt="Explain deep learning algorithms to 8th graders",

numResults=1,

maxTokens=100,

temperature=0.01 #subject to reduce “hallucination” by using common words.

)문서 처리, 임베딩 및 인덱싱

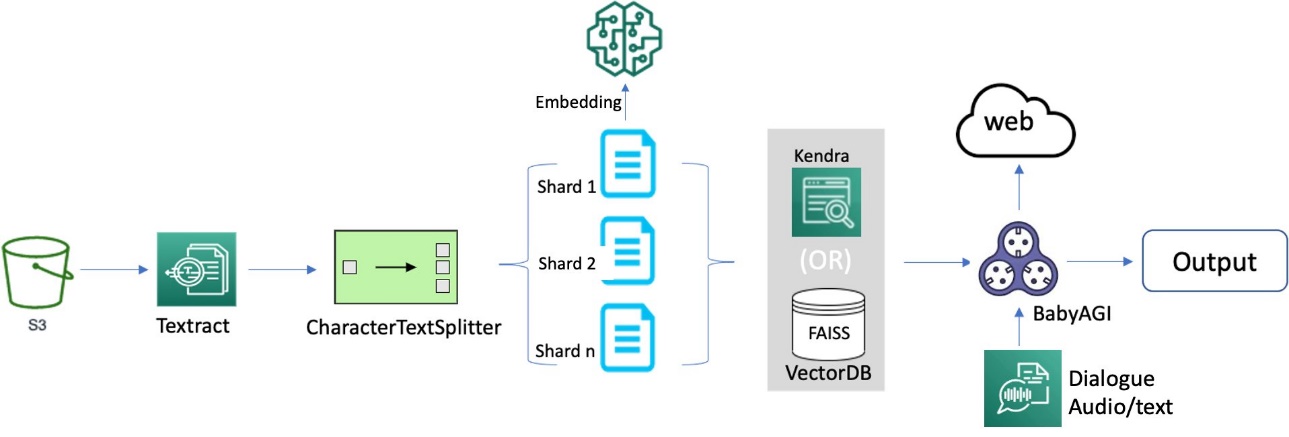

문서 처리를 안내하는 지능적이고 반응이 빠른 대화의 기반을 형성하는 효율적이고 효과적인 검색 색인을 구축하는 과정을 탐구합니다. 먼저 OCR을 사용하여 다양한 형식의 문서를 텍스트 콘텐츠로 변환하고 아마존 텍사스. 그런 다음 이 콘텐츠를 읽고 이상적으로는 각각 문장 크기 정도의 더 작은 조각으로 조각냅니다. 이 세분화된 접근 방식을 사용하면 전체 문서가 아닌 페이지의 개별 세그먼트에 대해 쿼리를 더 잘 일치시킬 수 있으므로 보다 정확하고 관련성 높은 검색 결과를 얻을 수 있습니다. 프로세스를 더욱 향상시키기 위해 다음과 같은 임베딩을 사용합니다. Hugging Face의 문장 변환기 라이브러리, 각 문장의 벡터 표현(인코딩)을 생성합니다. 이러한 벡터는 원본 텍스트의 간결하고 의미 있는 표현 역할을 하여 효율적이고 정확한 의미 일치 기능을 가능하게 합니다. 마지막으로 유사성 검색을 위해 이러한 벡터를 벡터 데이터베이스에 저장합니다. 이러한 기술 조합은 사용자에게 정확하고 직관적인 결과를 제공하는 새로운 문서 처리 프레임워크의 토대를 마련합니다. 다음 다이어그램은 이 워크플로를 보여줍니다.

OCR은 스캔한 문서나 사진에서 텍스트를 검색할 수 있는 솔루션의 중요한 요소 역할을 합니다. Amazon Textract를 사용하여 PDF 또는 이미지 파일에서 텍스트를 추출할 수 있습니다. 이 관리형 OCR 서비스는 송장 및 영수증과 같은 PDF, JPEG 또는 TIFF 형식의 문서를 포함하여 여러 페이지로 된 문서의 텍스트를 식별하고 검사할 수 있습니다. 다중 페이지 문서의 처리는 비동기식으로 발생하므로 광범위한 다중 페이지 문서를 처리하는 데 유리합니다. 다음 코드를 참조하십시오.

def pdf_2_text(input_pdf_file, history):

history = history or []

key = 'input-pdf-files/{}'.format(os.path.basename(input_pdf_file.name))

try:

response = s3_client.upload_file(input_pdf_file.name, default_bucket_name, key)

except ClientError as e:

print("Error uploading file to S3:", e)

s3_object = {'Bucket': default_bucket_name, 'Name': key}

response = textract_client.start_document_analysis(

DocumentLocation={'S3Object': s3_object},

FeatureTypes=['TABLES', 'FORMS']

)

job_id = response['JobId']

while True:

response = textract_client.get_document_analysis(JobId=job_id)

status = response['JobStatus']

if status in ['SUCCEEDED', 'FAILED']:

break

time.sleep(5) if status == 'SUCCEEDED':

with open(output_file, 'w') as output_file_io:

for block in response['Blocks']:

if block['BlockType'] in ['LINE', 'WORD']:

output_file_io.write(block['Text'] + 'n')

with open(output_file, "r") as file:

first_512_chars = file.read(512).replace("n", "").replace("r", "").replace("[", "").replace("]", "") + " [...]"

history.append(("Document conversion", first_512_chars))

return history, history대용량 문서를 처리할 때 더 쉽게 처리할 수 있도록 문서를 더 관리하기 쉬운 조각으로 나누는 것이 중요합니다. LangChain의 경우 이는 각 문서를 더 작은 세그먼트로 나누는 것을 의미합니다(예: 청크당 1,000개의 토큰과 100개의 토큰이 중첩됨). 이를 원활하게 달성하기 위해 LangChain은 이 목적을 위해 특별히 설계된 특수 분할기를 사용합니다.

from langchain.text_splitter import CharacterTextSplitter

from langchain.document_loaders import TextLoader

separator = 'n'

overlap_count = 100. # overlap count between the splits

chunk_size = 1000 # Use a fixed split unit size

loader = TextLoader(output_file)

documents = loader.load()

text_splitter = CharacterTextSplitter(separator=separator, chunk_overlap=overlap_count, chunk_size=chunk_size, length_function=len)

texts = text_splitter.split_documents(documents)포함에 필요한 기간은 문서 크기에 따라 변동될 수 있습니다. 예를 들어 완료하는 데 약 10분이 걸릴 수 있습니다. 이 시간 프레임은 단일 문서를 처리할 때 중요하지 않을 수 있지만 수백 메가바이트가 아니라 수백 기가바이트를 인덱싱할 때 결과가 더 두드러집니다. 임베딩 프로세스를 촉진하기 위해 병렬화를 가능하게 하고 결과적으로 효율성을 향상시키는 샤딩을 구현할 수 있습니다.

from langchain.document_loaders import ReadTheDocsLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from sentence_transformers import SentenceTransformer

import numpy as np

import ray

from embeddings import LocalHuggingFaceEmbeddings # Define number of splits

db_shards = 10 loader = TextLoader(output_file)

text_splitter = RecursiveCharacterTextSplitter(

chunk_size = 1000,

chunk_overlap = 100,

length_function = len,

) @ray.remote()

def process_shard(shard):

embeddings = LocalHuggingFaceEmbeddings('multi-qa-mpnet-base-dot-v1')

result = Chroma.from_documents(shard, embeddings)

return result # Read the doc content and split them into chunks.

chunks = text_splitter.create_documents([doc.page_content for doc in documents], metadatas=[doc.metadata for doc in documents])

# Embed the doc chunks into vectors.

shards = np.array_split(chunks, db_shards)

futures = [process_shard.remote(shards[i]) for i in range(db_shards)]

texts = ray.get(futures)더 작은 세그먼트를 얻었으므로 임베딩을 통해 계속해서 벡터로 나타낼 수 있습니다. NLP의 기술인 임베딩은 텍스트 프롬프트의 벡터 표현을 생성합니다. Embedding 클래스는 다음과 같은 다양한 포함 공급자와 상호 작용하기 위한 통합 인터페이스 역할을 합니다. 세이지 메이커, 코어, 포옹하는 얼굴및 OpenAI, 다양한 플랫폼에서 프로세스를 간소화합니다. 이러한 임베딩은 숫자 시퀀스로 변환된 아이디어의 숫자 묘사이므로 컴퓨터가 이러한 아이디어 간의 연결을 쉽게 이해할 수 있습니다. 다음 코드를 참조하십시오.

# Choose a SageMaker deployed local LLM endpoint for embedding

llm_embeddings = SagemakerEndpointEmbeddings(

endpoint_name=<endpoint_name>,

region_name=<region>,

content_handler=content_handler

)임베딩을 생성한 후 벡터 저장소를 활용하여 벡터를 저장해야 합니다. 같은 벡터 스토어 크로마 나중에 고차원 공간에서 빠른 검색을 위해 인덱스를 구성하도록 특별히 설계되어 우리의 목표에 완벽하게 적합합니다. 대안으로 다음을 사용할 수 있습니다. 파이스, 벡터 저장을 위한 오픈 소스 벡터 클러스터링 솔루션. 다음 코드를 참조하십시오.

from langchain.vectorstores import Chroma

# Store vectors in Chroma vectorDB

docsearch_chroma = Chroma.from_documents(texts, llm_embeddings)

# Alternatively you can choose FAISS vectorstore

from langchain.vectorstores import FAISS

docsearch_faiss = FAISS.from_documents(texts, llm_embeddings)VOUS pouvez의 aussi 사용 아마존 켄드라 엔터프라이즈 콘텐츠를 색인화하고 정확한 답변을 생성합니다. 완전 관리형 서비스인 Amazon Kendra는 고급 문서 및 구절 순위 지정을 위해 바로 사용할 수 있는 시맨틱 검색 기능을 제공합니다. Amazon Kendra의 고정확도 검색을 통해 페이로드의 품질을 최적화하기 위해 가장 적절한 콘텐츠와 문서를 얻을 수 있습니다. 그 결과 기존 또는 키워드 중심 검색 방법에 비해 LLM 응답이 우수합니다. 자세한 내용은 다음을 참조하십시오. Amazon Kendra, LangChain 및 대규모 언어 모델을 사용하여 엔터프라이즈 데이터에서 고정확도의 Generative AI 애플리케이션을 신속하게 구축.

대화형 다국어 음성 입력

대화형 음성 입력을 문서 검색에 통합하면 사용자 경험을 향상시키는 수많은 이점이 있습니다. 사용자가 검색어를 구두로 표현할 수 있게 함으로써 문서 검색이 보다 자연스럽고 직관적이 되어 사용자가 필요한 정보를 더 쉽고 빠르게 찾을 수 있습니다. 음성 입력은 검색어가 철자나 문법 오류의 영향을 덜 받기 때문에 검색 결과의 정확도를 높일 수 있습니다. 대화형 음성 입력은 문서 검색을 더욱 포괄적으로 만들어 다양한 언어 사용자와 문화적 배경을 가진 더 넓은 스펙트럼의 사용자를 수용합니다.

XNUMXD덴탈의 Amazon Transcribe 스트리밍 SDK 오디오 바이트 스트림 및 기본 핸들러와 함께 Amazon Transcribe와 직접 통합하여 오디오-음성 인식을 수행할 수 있습니다. 대안으로 다음을 배포할 수 있습니다. 속삭임 다음을 사용하여 Hugging Face에서 로컬로 모델링 세이지 메이커, 향상된 데이터 보안과 더 나은 성능을 제공합니다. 자세한 내용은 샘플 노트 GitHub 리포지토리에 게시되었습니다.

# Choose ASR using a locally deployed Whisper-large model from Hugging Face

image = sagemaker.image_uris.retrieve(

framework='pytorch',

region=region,

image_scope='inference',

version='1.12',

instance_type='ml.g4dn.xlarge',

) model_name = f'sagemaker-soln-whisper-model-{int(time.time())}'

whisper_model_sm = sagemaker.model.Model(

model_data=model_uri,

image_uri=image,

role=sagemaker.get_execution_role(),

entry_point="inference.py",

source_dir='src',

name=model_name,

) # Audio transcribe

transcribe = whisper_endpoint.predict(audio.numpy())위의 데모 비디오는 텍스트 입력과 함께 음성 명령이 대화형 대화를 통해 문서 요약 작업을 용이하게 하는 방법을 보여줍니다.

다단계 대화를 통한 NLP 작업 안내

언어 모델의 메모리는 사용자의 상호 작용을 통해 상태 개념을 유지합니다. 여기에는 일련의 채팅 메시지를 처리하여 지식을 추출하고 변환하는 작업이 포함됩니다. 메모리 유형은 다양하지만 각각은 독립 실행형 기능을 사용하고 체인 내에서 이해할 수 있습니다. 메모리는 최근 메시지 또는 메시지 요약과 같은 여러 데이터 포인트를 문자열 또는 목록 형식으로 반환할 수 있습니다. 이 게시물은 모든 이전 메시지를 저장하고 모듈식 유틸리티 기능 및 체인과 함께 사용하는 방법을 보여주는 가장 단순한 메모리 형태인 버퍼 메모리에 중점을 둡니다.

랭체인의 채팅메시지내역 클래스는 이전의 모든 채팅 상호 작용을 기억하여 인간 및 AI 메시지를 저장하고 검색하는 편리한 방법을 제공하는 메모리 모듈의 중요한 유틸리티입니다. 체인 외부에서 메모리를 관리하는 데 이상적입니다. 다음 코드는 간단한 개념을 체인에 도입하여 적용한 예입니다. 대화버퍼메모리, 래퍼 ChatMessageHistory. 이 래퍼는 메시지를 변수로 추출하여 문자열로 표시할 수 있도록 합니다.

from langchain.memory import ConversationBufferMemory

memory = ConversationBufferMemory(return_messages=True)LangChain은 AI21 Labs, OpenAI, Cohere, Hugging Face 등과 같은 많은 유명 LLM 제공업체와 협력합니다. 이 예에서는 SageMaker를 사용하여 로컬로 배포된 AI21 Labs의 Jurassic-2 LLM 래퍼를 사용합니다. AI21 Studio는 Jurassic-2 LLM에 대한 API 액세스도 제공합니다.

from langchain import PromptTemplate, SagemakerEndpoint

from langchain.llms.sagemaker_endpoint import ContentHandlerBase

from langchain.chains.question_answering import load_qa_chain prompt= PromptTemplate(

template=prompt_template, input_variables=["context", "question"]

) class ContentHandler(ContentHandlerBase):

content_type = "application/json"

accepts = "application/json"

def transform_input(self, prompt: str, model_kwargs: Dict) -- bytes:

input_str = json.dumps({prompt: prompt, **model_kwargs})

return input_str.encode('utf-8') def transform_output(self, output: bytes) -- str:

response_json = json.loads(output.read().decode("utf-8"))

return response_json[0]["generated_text"]

content_handler = ContentHandler()

llm_ai21=SagemakerEndpoint(

endpoint_name=endpoint_name,

credentials_profile_name=f'aws-credentials-profile-name',

region_name="us-east-1",

model_kwargs={"temperature":0},

content_handler=content_handler) qa_chain = VectorDBQA.from_chain_type(

llm=llm_ai21,

chain_type='stuff',

vectorstore=docsearch,

verbose=True,

memory=ConversationBufferMemory(return_messages=True)

) response = qa_chain(

{'query': query_input},

return_only_outputs=True

)프로세스가 사용자의 문의에 대한 응답으로 원래 문서에서 적절한 응답을 찾을 수 없는 경우 타사 URL 또는 이상적으로는 작업 기반 자율 에이전트를 외부 데이터 소스와 통합하면 시스템의 기능이 크게 향상됩니다. 방대한 정보에 액세스하여 궁극적으로 컨텍스트를 개선하고 보다 정확하고 최신 결과를 제공합니다.

AI21의 사전 구성된 Summarize 실행 방법을 통해 쿼리는 미리 결정된 URL에 액세스하고 내용을 압축한 다음 요약된 정보를 기반으로 질문 및 답변 작업을 수행할 수 있습니다.

# Call AI21 API to query the context of a specific URL for Q&A

ai21.api_key = "<YOUR_API_KEY>"

url_external_source = "<your_source_url>"

response_url = ai21.Summarize.execute(

source=url_external_source,

sourceType="URL" )

context = "<concate_document_and_response_url>"

question = "<query>"

response = ai21.Answer.execute(

context=context,

question=question,

sm_endpoint=endpoint_name,

maxTokens=100,

)추가 세부 정보 및 코드 예제는 다음을 참조하십시오. LangChain LLM 통합 문서 뿐만 아니라 작업별 API 문서 AI21 제공.

BabyAGI를 사용한 작업 자동화

작업 자동화 메커니즘을 통해 시스템은 복잡한 쿼리를 처리하고 관련 응답을 생성할 수 있으므로 문서 처리의 유효성과 신뢰성이 크게 향상됩니다. 랑카인의 BabyAGI 자율적으로 작업을 생성하고 우선순위를 지정하고 실행할 수 있는 강력한 AI 기반 작업 관리 시스템입니다. 주요 기능 중 하나는 웹, 데이터베이스 및 API와 같은 외부 정보 소스와 인터페이스하는 기능입니다. 이 기능을 사용하는 한 가지 방법은 BabyAGI를 세르파피, 검색 엔진에 대한 액세스를 제공하는 검색 엔진 API입니다. 이 통합을 통해 BabyAGI는 작업과 관련된 정보를 웹에서 검색할 수 있으므로 BabyAGI는 입력 문서 이외의 풍부한 정보에 액세스할 수 있습니다.

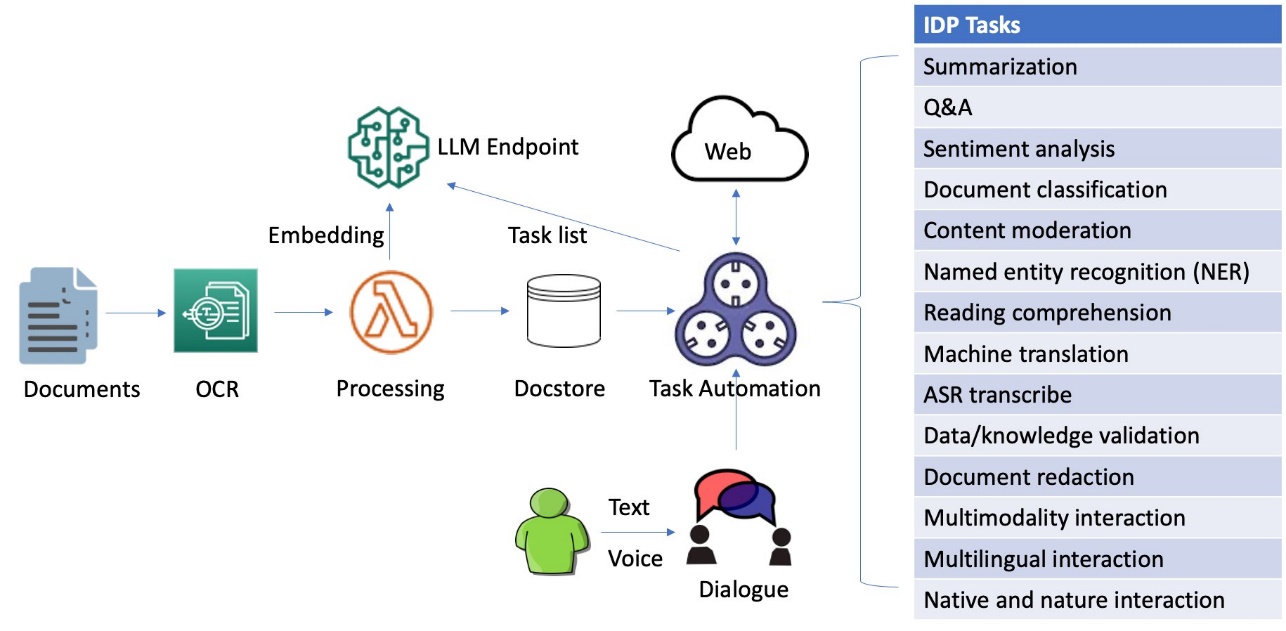

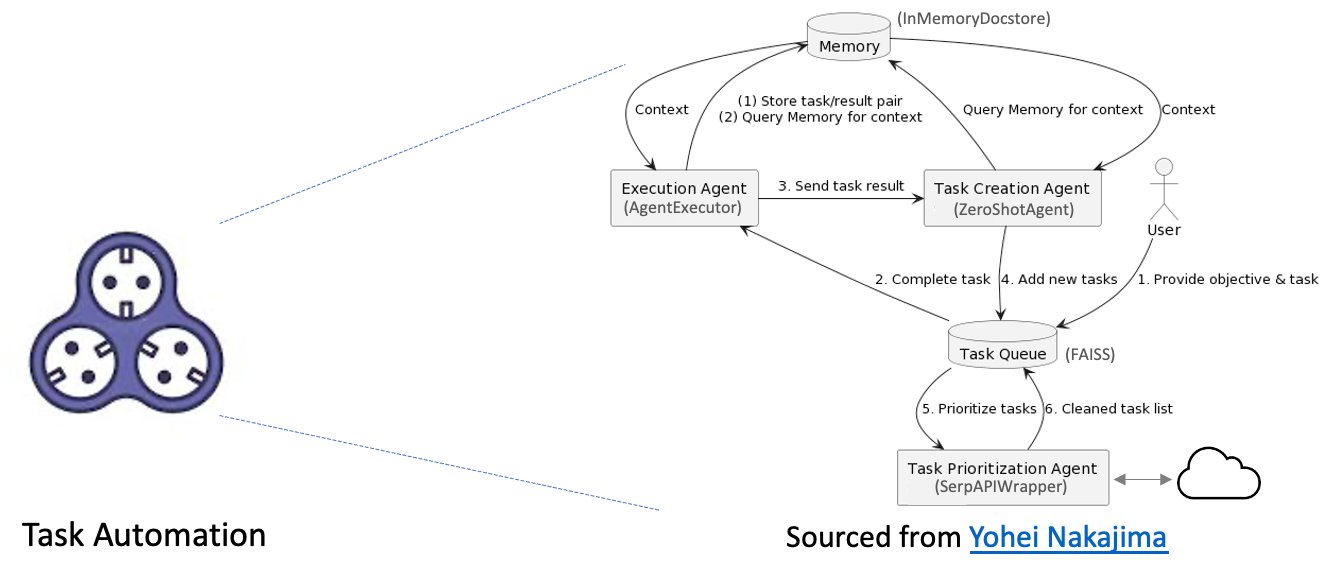

BabyAGI의 자율 작업 기능은 LLM, 벡터 검색 데이터베이스, 외부 링크에 대한 API 래퍼 및 LangChain 프레임워크에 의해 촉진되어 다양한 도메인에서 광범위한 작업을 실행할 수 있습니다. 이를 통해 시스템은 사용자 상호 작용을 기반으로 작업을 능동적으로 수행하고 외부 소스를 통합하는 문서 처리 파이프라인을 간소화하고 보다 효율적이고 원활한 경험을 생성할 수 있습니다. 다음 다이어그램은 작업 자동화 프로세스를 보여줍니다.

이 프로세스에는 다음 구성 요소가 포함됩니다.

- 메모리 – 메모리는 BabyAGI가 작업을 완료하는 데 필요한 모든 정보를 저장합니다. 여기에는 작업 자체와 BabyAGI가 생성한 중간 결과 또는 데이터가 포함됩니다.

- 집행 대리인 – 실행 에이전트는 메모리에 저장된 작업을 수행할 책임이 있습니다. 메모리에 액세스하고 관련 정보를 검색한 다음 작업을 완료하는 데 필요한 단계를 수행하여 이를 수행합니다.

- 작업 생성 에이전트 – 작업 생성 에이전트는 BabyAGI가 완료할 새 작업을 생성하는 역할을 합니다. 이것은 기억의 현재 상태를 분석하고 지식이나 이해의 차이를 식별함으로써 이를 수행합니다. 간격이 식별되면 작업 생성 에이전트는 BabyAGI가 해당 간격을 채우는 데 도움이 되는 새 작업을 생성합니다.

- 작업 대기열 – 작업 대기열은 BabyAGI에 할당된 모든 작업의 목록입니다. 작업은 받은 순서대로 대기열에 추가됩니다.

- 작업 우선 순위 에이전트 – 작업 우선 순위 지정 에이전트는 BabyAGI가 작업을 완료해야 하는 순서를 결정할 책임이 있습니다. 대기열의 작업을 분석하고 가장 중요하거나 긴급한 작업을 식별하여 이를 수행합니다. 가장 중요한 작업은 대기열의 맨 앞에 배치되고 덜 중요한 작업은 대기열의 맨 뒤에 배치됩니다.

다음 코드를 참조하십시오.

from babyagi import BabyAGI

from langchain.docstore import InMemoryDocstore

import faiss

# Set temperatur=0 to generate the most frequent words, instead of more “poetically free” behavior.

new_query = """

What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure? """

# Enable verbose logging and use a fixed embedding size.

verbose = True

embedding_size = 1536 # Using FAISS vector cluster for vectore store

index = faiss.IndexFlatL2(embedding_size)

vectorstore = FAISS(llm_embeddings.embed_query, index, InMemoryDocstore({}), {}) # Choose 1 iteration for demo and 1>N>10 for real. If None, it will loop indefinitely

max_iterations: Optional[int] = 2 # Call bayagi class for task automation

baby_agi = BabyAGI.from_llm(

llm=llm_embedding, vectorstore=vectorstore, verbose=verbose, max_iterations=max_iterations<br />) response = baby_agi({"objective": new_query})사용자의 질문에 대한 응답으로 목표를 달성하기 위해 데모 목적으로 사용되는 단일 반복에서 수집된 작업과 해당 결과를 살펴보겠습니다. BabyAGI는 다음 단계의 연속적인 주기를 통해 작동합니다.

- 작업 생성 에이전트는 새 작업을 공식화합니다.

- 새 작업이 작업 대기열에 통합됩니다.

- 작업 우선 순위 지정 에이전트는 작업을 처리해야 하는 순서를 설정합니다.

- 실행 에이전트가 작업을 수행합니다.

- 작업 결과는 메모리에 저장됩니다.

- 주기가 반복됩니다.

이 반복 프로세스를 통해 BabyAGI는 시간이 지남에 따라 학습하고 개발할 수 있습니다. 점점 더 많은 작업을 성공적으로 완료함에 따라 BabyAGI의 세계에 대한 지식과 이해력이 확장됩니다. 결과적으로 더 복잡하고 고급 작업을 생성하고 효율적으로 실행할 수 있습니다. 반복 횟수를 늘리면 이전 작업의 목표와 결과에 초점을 맞춘 작업 목록의 재구성을 통해 결과를 향상시킬 수 있으며 궁극적으로 더 적절하고 정확한 응답을 얻을 수 있습니다.

다음 예제 출력을 참조하십시오.

*****TASK LIST*****

1: Make a todo list

*****NEXT TASK*****

1: Make a todo list

> Entering new AgentExecutor chain...

Thought: I need to research the First Republic Bank and the FED's action

Action: Search

Action Input: What happened to the First Republic Bank? Will the FED take the same action as it did on SVB's failure?

Observation: First Republic's failure was due to a run on deposits following the collapse of Silicon Valley Bank and Signature Bank. JPMorgan Chase acquired

First Republic Bank on May 1, 2023. If you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

Thought: I need to research the FED's action on SVB's failure

Action: Search

Action Input: What action did the FED take on SVB's failure?

Observation: The Hutchins Center explains how the Federal Reserve has responded to the March 2023 failures of Silicon Valley Bank and Signature Bank.

Thought: I now know the final answer

Final Answer: The FED responded to the March 2023 failures of Silicon Valley Bank and <br />Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.

> Finished chain.

*****TASK RESULT*****

The Federal Reserve responded to the March 2023 failures of Silicon Valley Bank and Signature Bank by providing liquidity to the banking system. It is unclear what action the FED will take in response to the failure of First Republic Bank. ***TASK LIST*** 2: Research the timeline of First Republic Bank's failure.

3: Analyze the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank.

4: Compare the Federal Reserve's response to the failure of Silicon Valley Bank and Signature Bank to the Federal Reserve's response to the failure of First Republic Bank.

5: Investigate the potential implications of the Federal Reserve's response to the failure of First Republic Bank.

6: Identify any potential risks associated with the Federal Reserve's response to the failure of First Republic Bank.<br />*****NEXT TASK***** 2: Research the timeline of First Republic Bank's failure. > Entering new AgentExecutor chain...

Will the FED take the same action as it did on SVB's failure?

Thought: I should search for information about the timeline of First Republic Bank's failure and the FED's action on SVB's failure.

Action: Search

Action Input: Timeline of First Republic Bank's failure and FED's action on SVB's failure

Observation: March 20: The FDIC decides to break up SVB and hold two separate auctions for its traditional deposits unit and its private bank after failing ...

Thought: I should look for more information about the FED's action on SVB's failure.

Action: Search

Action Input: FED's action on SVB's failure

Observation: The Fed blamed failures on mismanagement and supervisory missteps, compounded by a dose of social media frenzy.

Thought: I now know the final answer.

Final Answer: The FED is likely to take similar action on First Republic Bank's failure as it did on SVB's failure, which was to break up the bank and hold two separate auctions for its traditional deposits unit and its private bank.</p><p>> Finished chain. *****TASK RESULT*****

The FED responded to the March 2023 failures of ilicon Valley Bank and Signature Bank by providing liquidity to the banking system. JPMorgan Chase acquired First Republic Bank on May 1, 2023, and if you had insured or uninsured money in First Republic accounts, your funds are safe and now managed by JPMorgan Chase.*****TASK ENDING*****작업 자동화를 위한 BabyAGI를 사용하여 대화 안내 IDP 시스템은 원본 문서의 컨텍스트를 뛰어넘어 2023개월 후인 1년 XNUMX월 말에 발생한 First Republic Bank의 실패와 관련된 연방 준비 은행의 잠재적 조치에 대한 사용자의 질문을 해결함으로써 효율성을 보여주었습니다. 샘플 간행물, SVB의 실패와 비교하여. 이를 위해 시스템은 할 일 목록을 생성하고 작업을 순차적으로 완료했습니다. First Republic Bank의 실패를 둘러싼 상황을 조사하고 연방 준비 은행의 대응과 관련된 잠재적 위험을 정확히 지적했으며 이를 SVB의 실패에 대한 대응과 비교했습니다.

BabyAGI는 여전히 진행 중인 작업이지만 기계 상호 작용, 창의적인 사고 및 문제 해결에 혁명을 가져올 것이라는 약속을 전달합니다. BabyAGI의 학습 및 향상이 지속됨에 따라 더 정확하고 통찰력 있고 독창적인 응답을 생성할 수 있습니다. 기계가 자율적으로 학습하고 진화할 수 있도록 함으로써 BabyAGI는 일상적인 집안일부터 복잡한 문제 해결에 이르기까지 광범위한 작업에서 기계의 지원을 용이하게 할 수 있습니다.

제약 및 제한

대화 안내 IDP는 문서 분석 및 추출의 효율성과 효과를 향상시키는 유망한 접근 방식을 제공합니다. 그러나 우리는 데이터 편향 방지, 환각 완화, 복잡하고 모호한 언어 처리의 어려움, 문맥 이해 또는 긴 대화에서 일관성 유지의 어려움과 같은 현재의 제약과 한계를 인정해야 합니다.

또한 부정확하거나 조작된 정보의 생성으로 이어질 수 있는 AI 생성 응답에서 작화 및 환각을 고려하는 것이 중요합니다. 이러한 문제를 해결하기 위해 지속적인 개발은 더 나은 자연어 이해 기능으로 LLM을 개선하고 도메인별 지식을 통합하며 보다 강력한 상황 인식 모델을 개발하는 데 중점을 두고 있습니다. 처음부터 LLM을 구축하는 것은 비용과 시간이 많이 소요될 수 있습니다. 그러나 기존 모델을 개선하기 위해 몇 가지 전략을 사용할 수 있습니다.

- 보다 정확하고 관련성 높은 출력을 위해 특정 도메인에서 사전 훈련된 LLM 미세 조정

- 향상된 컨텍스트 이해를 위해 추론 중에 안전한 것으로 알려진 외부 데이터 소스 통합

- 모델에서 보다 정확한 응답을 도출하기 위해 더 나은 프롬프트 설계

- 앙상블 모델을 사용하여 여러 LLM의 출력을 결합하여 오류 평균화 및 환각 기회 최소화

- 앱이 정확하고 적절한 정보로 응답하도록 하면서 모델이 원하지 않는 영역으로 방향을 바꾸는 것을 방지하는 가드레일 구축

- 사람의 피드백으로 감독된 미세 조정을 수행하고 정확도를 높이고 환각을 줄이기 위해 모델을 반복적으로 개선합니다.

이러한 접근 방식을 채택함으로써 AI 생성 응답을 보다 안정적이고 가치 있게 만들 수 있습니다.

작업 기반 자율 에이전트는 다양한 애플리케이션에서 상당한 잠재력을 제공하지만 기술을 채택하기 전에 주요 위험을 고려하는 것이 중요합니다. 이러한 위험에는 다음이 포함됩니다.

- 선택한 LLM 공급자 및 vectorDB에 대한 의존으로 인한 데이터 개인 정보 보호 및 보안 위반

- 편향되거나 유해한 콘텐츠 생성으로 인해 발생하는 윤리적 문제

- 비효율적인 작업 완료 또는 원하지 않는 결과로 이어질 수 있는 모델 정확도에 대한 의존성

- 작업 생성이 완료를 앞지르는 경우 시스템 과부하 및 확장성 문제로 인해 적절한 작업 순서 지정 및 병렬 관리가 필요합니다.

- 작업 중요도에 대한 LLM의 이해를 기반으로 한 작업 우선 순위 지정의 잘못된 해석

- 웹에서 받은 데이터의 신뢰성

이러한 위험을 해결하는 것은 책임 있고 성공적인 적용을 위해 매우 중요하며 잠재적인 위험을 최소화하면서 AI 기반 언어 모델의 이점을 극대화할 수 있습니다.

결론

IDP용 대화 안내 솔루션은 OCR, 자동 음성 인식, LLM, 작업 자동화 및 외부 데이터 소스를 통합하여 문서 처리에 대한 획기적인 접근 방식을 제시합니다. 이 포괄적인 솔루션을 통해 기업은 문서 처리 워크플로를 간소화하여 보다 효율적이고 직관적으로 만들 수 있습니다. 이러한 최첨단 기술을 통합함으로써 조직은 문서 관리 프로세스를 혁신할 수 있을 뿐만 아니라 의사 결정 기능을 강화하고 전반적인 생산성을 상당히 높일 수 있습니다. 이 솔루션은 기업이 문서 워크플로의 잠재력을 최대한 활용하여 궁극적으로 제너레이티브 AI 시대의 성장과 성공을 주도할 수 있는 변혁적이고 혁신적인 수단을 제공합니다. 인용하다 SageMaker 점프스타트 다른 솔루션 및 아마존 기반암 추가 생성 AI 모델용.

저자는 Ryan Kilpatrick, Ashish Lal 및 Kristine Pearce가 이 작업에 귀중한 정보를 제공하고 기여한 것에 대해 진심으로 감사를 표합니다. 그들은 또한 Github에서 제공된 코드 샘플에 대해 Clay Elmore를 인정합니다.

저자 소개

알프레드 쉔 AWS의 선임 AI/ML 전문가입니다. 그는 실리콘 밸리에서 일하면서 의료, 금융, 첨단 기술을 포함한 다양한 분야에서 기술 및 관리 직책을 맡았습니다. 그는 CV, NLP 및 다중 양식에 집중하는 응용 AI/ML 전담 연구원입니다. 그의 작업은 EMNLP, ICLR 및 공중 보건과 같은 간행물에 소개되었습니다.

알프레드 쉔 AWS의 선임 AI/ML 전문가입니다. 그는 실리콘 밸리에서 일하면서 의료, 금융, 첨단 기술을 포함한 다양한 분야에서 기술 및 관리 직책을 맡았습니다. 그는 CV, NLP 및 다중 양식에 집중하는 응용 AI/ML 전담 연구원입니다. 그의 작업은 EMNLP, ICLR 및 공중 보건과 같은 간행물에 소개되었습니다.

비벡 마단 박사 Amazon SageMaker JumpStart 팀의 응용 과학자입니다. 그는 일리노이 대학교 어바나 샴페인에서 박사 학위를 받았고 조지아 공대에서 박사후 연구원이었습니다. 그는 기계 학습 및 알고리즘 설계 분야에서 활발한 연구원이며 EMNLP, ICLR, COLT, FOCS 및 SODA 컨퍼런스에 논문을 발표했습니다.

비벡 마단 박사 Amazon SageMaker JumpStart 팀의 응용 과학자입니다. 그는 일리노이 대학교 어바나 샴페인에서 박사 학위를 받았고 조지아 공대에서 박사후 연구원이었습니다. 그는 기계 학습 및 알고리즘 설계 분야에서 활발한 연구원이며 EMNLP, ICLR, COLT, FOCS 및 SODA 컨퍼런스에 논문을 발표했습니다.

리 장 박사 의 수석 제품 관리자-기술자입니다. Amazon SageMaker 점프스타트 및 Amazon SageMaker 내장 알고리즘, 데이터 과학자와 머신 러닝 실무자가 모델 교육 및 배포를 시작하고 사용하는 데 도움이 되는 서비스 강화 학습 Amazon SageMaker로. IBM Research에서 수석 연구원이자 마스터 발명가로 일한 그의 과거 작업은 테스트 오브 타임 페이퍼 어워드 IEEE INFOCOM에서.

리 장 박사 의 수석 제품 관리자-기술자입니다. Amazon SageMaker 점프스타트 및 Amazon SageMaker 내장 알고리즘, 데이터 과학자와 머신 러닝 실무자가 모델 교육 및 배포를 시작하고 사용하는 데 도움이 되는 서비스 강화 학습 Amazon SageMaker로. IBM Research에서 수석 연구원이자 마스터 발명가로 일한 그의 과거 작업은 테스트 오브 타임 페이퍼 어워드 IEEE INFOCOM에서.

마창사 박사 AWS의 AI/ML 전문가입니다. 그녀는 컴퓨터 과학 박사 학위, 교육 심리학 석사 학위, 데이터 과학 및 AI/ML의 독립 컨설팅 분야에서 다년간의 경험을 가진 기술자입니다. 그녀는 기계 및 인간 지능에 대한 방법론적 접근 방식을 연구하는 데 열정적입니다. 직장 밖에서 그녀는 하이킹, 요리, 음식 사냥, 기업가 정신을 위한 대학생 멘토링, 친구 및 가족과 시간을 보내는 것을 좋아합니다.

마창사 박사 AWS의 AI/ML 전문가입니다. 그녀는 컴퓨터 과학 박사 학위, 교육 심리학 석사 학위, 데이터 과학 및 AI/ML의 독립 컨설팅 분야에서 다년간의 경험을 가진 기술자입니다. 그녀는 기계 및 인간 지능에 대한 방법론적 접근 방식을 연구하는 데 열정적입니다. 직장 밖에서 그녀는 하이킹, 요리, 음식 사냥, 기업가 정신을 위한 대학생 멘토링, 친구 및 가족과 시간을 보내는 것을 좋아합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoAiStream. Web3 데이터 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 미래 만들기 w Adryenn Ashley. 여기에서 액세스하십시오.

- PREIPO®로 PRE-IPO 회사의 주식을 사고 팔 수 있습니다. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/dialogue-guided-intelligent-document-processing-with-foundation-models-on-amazon-sagemaker-jumpstart/

- :있다

- :이다

- :아니

- ][피

- $UP

- 000

- 1

- 10

- 100

- 12

- 20

- 2023

- 7

- 8 위

- a

- 능력

- 소개

- 위의

- 수락

- ACCESS

- 액세스

- 달성

- 계정

- 계정

- 정확한

- 달성

- 인정

- 획득한

- 가로질러

- 동작

- 행위

- 활동적인

- 각색하다

- 추가

- 첨가

- 추가

- 또한

- 주소

- 주소 지정

- 채택

- 양자

- 많은

- 발전하다

- 이점

- 유리한

- 장점

- 후

- 반대

- 에이전트

- AI

- AI 기반

- AI / ML

- 연산

- 알고리즘

- All

- 허용

- 수

- 또한

- 대안

- 이기는하지만

- 아마존

- 아마존 켄드라

- 아마존 세이지 메이커

- Amazon SageMaker 점프스타트

- 아마존 텍사스

- 아마존 전사

- Amazon Web Services

- 금액

- an

- 분석

- 분석하다

- 분석하는

- 및

- 답변

- 답변

- 예상

- 어떤

- API를

- API 액세스

- API

- 어플리케이션

- 어플리케이션

- 적용된

- 적용

- 감사

- 접근

- 구혼

- 적당한

- 앱

- Apr

- 있군요

- 지역

- 약

- 배열

- AS

- 할당 된

- 원조

- 관련

- At

- 경매

- 오디오

- 정품

- 작성자

- 오토마타

- Automatic

- 자동화

- 자발적인

- 자율적으로

- 가능

- 평균화

- AWS

- AWS Marketplace

- 뒤로

- 배경

- 은행

- 은행

- 은행 시스템

- 기반으로

- 기본

- BE

- 때문에

- 가

- 된다

- 된

- 전에

- 시작하다

- 혜택

- BEST

- 더 나은

- 사이에

- 그 너머

- 바이어스

- 치우친

- 수십억

- 블록

- 블록

- 판

- 받침

- 후원

- 위반

- 흩어져

- 가교

- 넓은

- 더 넓은

- 버퍼

- 빌드

- 건물

- 내장

- 사업

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- by

- 전화

- CAN

- 기능

- 수

- 생산 능력

- 나르다

- 적재

- 케이스

- 센터

- 체인

- 쇠사슬

- 도전

- 과제

- 변경

- 문자

- 문자 인식

- 추적

- 왼쪽 메뉴에서

- 선택

- 상황

- 수업

- 클라우드

- 클러스터

- 클러스터링

- 암호

- 축소

- 칼리지

- 결합

- 결합

- 결합

- 공통의

- 비교

- 비교

- 비교

- 완전한

- 진행완료

- 완료

- 완성

- 복잡한

- 구성 요소들

- 이해하다

- 포괄적 인

- 컴퓨터

- 컴퓨터 과학

- 컴퓨터

- 개념

- 우려 사항

- 회의

- 연결

- 따라서

- 고려

- 제약

- 구축

- 컨설팅

- 함유량

- 문맥

- 문맥

- 문맥

- 계속

- 끊임없는

- 기부금

- 편리한

- 대화

- 대화

- 매출 상승

- 변하게 하다

- 비용

- 값 비싼

- 수

- 만들

- 만들기

- 창조

- 결정적인

- 문화

- Current

- 현재 상태

- 최첨단

- 주기

- 데이터

- 데이터 바이어스

- 데이터 점수

- 데이터 과학

- 데이터 보안

- 데이터베이스

- 데이터베이스

- 취급

- 의사 결정

- 전용

- 깊은

- 깊은 학습

- 도

- 제공

- 동굴

- 보여줍니다

- 배포

- 배포

- 배치

- 전개

- 매장

- 파생

- 디자인

- 설계

- 무례

- 세부설명

- 결정

- 개발

- 개발

- 개발

- 대화

- DICT

- DID

- 다른

- 어려움

- 직접

- 토론

- 몇몇의

- 문서

- 문서 관리

- 서류

- 하지

- 도메인

- 아래 (down)

- 운전

- 두

- 지속

- ...동안

- e

- 마다

- 쉽게

- 쉽게

- 교육

- 유효한

- 유효성

- 효율성

- 효율적인

- 효율적으로

- 요소

- 포함

- 임베딩

- 힘을 실어

- 가능

- 수

- 가능

- 종점

- 엔진

- 엔진

- 강화

- 강화

- 강화

- 강화

- 충분히

- 보장

- 입력

- Enterprise

- 전체의

- 처음입니다

- 대

- 오류

- 오류

- 개설하다

- 이벤트

- 진화시키다

- 검토하다

- 검사

- 예

- 예

- 외

- 교환

- 실행

- 현존하는

- 펼치기

- 경험

- 설명

- 설명

- 탐험

- 급행

- 광대 한

- 외부

- 외부 적으로

- 추출물

- 추출물

- 페이스메이크업

- 용이하게하다

- 을 용이하게

- 실패한

- 실패

- 고장

- 가족

- fdic

- 특색

- 특징

- 연방 준비 은행

- 연방

- 연방 준비

- 연방 준비 은행

- 피드백

- 입양 부모로서의 귀하의 적합성을 결정하기 위해 미국 이민국에

- 파일

- 채우기

- 최후의

- 최종적으로

- 재원

- Find

- 마무리

- 먼저,

- 고정

- 변동하다

- 집중

- 초점

- 수행원

- 식품

- 럭셔리

- 형태

- 체재

- 양식

- Foundation

- FRAME

- 뼈대

- 광포

- 빈번한

- 친구

- 에

- 앞

- 자극

- 가득 찬

- 충분히

- 기능

- 작동

- 기능

- 자금

- 추가

- 선물

- 갭

- 틈새

- 수집

- 생성

- 생성

- 생성

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 조지아

- 얻을

- GitHub의

- 골

- 가는

- 매우

- 획기적인

- 기초

- 성장

- 안내

- 했다

- 처리

- 일이

- 해로운

- 마구

- 있다

- he

- 건강

- 건강 관리

- 도움

- 도움이

- 높은

- 하이라이트

- 그의

- history

- 보유

- 보유

- 방법

- 그러나

- HTML

- HTTPS

- 사람의

- 인간 지능

- 수백

- 수렵

- i

- IBM

- 이상

- 아이디어

- 확인

- 확인

- 식별

- IEEE

- if

- 일리노이

- 설명하다

- 영상

- 형상

- 구현

- 의미

- import

- 중대한

- 개선

- 개선하는

- 개량

- 개선

- in

- 기타의

- 부정확 한

- 포함

- 포함

- 포함

- 포함한

- Incorporated

- 통합

- 증가

- 증가

- 증가

- 독립

- 색인

- 색인

- 개인

- 정보

- 정보 추출

- 시작

- 혁신적인

- 입력

- 입력

- 묻다

- 문의

- 예

- 를 받아야 하는 미국 여행자

- 명령

- 완전한

- 통합

- 통합

- 완성

- 인텔리전스

- 지능형

- 지능형 문서 처리

- 상호 작용하는

- 상호 작용

- 상호 작용

- 상호 작용

- 대화형

- 인터페이스

- 으로

- 소개

- 직관적인

- 조사

- 문제

- IT

- 되풀이

- 그

- 그 자체

- JPG

- JP 모건

- jpmorgan chase

- JSON

- 다만

- 키

- 알아

- 지식

- 알려진

- 실험실

- 결핍

- 언어

- 넓은

- 늦은

- 후에

- 낳는다

- 리드

- 지도

- 배우다

- 배우기

- 가장 작은

- 유산

- 적게

- Li

- 도서관

- 거짓

- 처럼

- 아마도

- 한계

- 제한된

- 라인

- 모래밭

- 유동성

- 명부

- 기울기

- LLM

- 짐을 싣는 사람

- 지방의

- 장소 상에서

- 로깅

- 이상

- 보기

- loves

- 낮은

- 기계

- 기계 학습

- 기계

- 만든

- 유지 보수

- 유지

- 확인

- 유튜브 영상을 만드는 것은

- 관리

- 관리

- 구축

- 매니저

- 관리의

- 관리

- 조작

- .

- Mar

- 시장

- 시장

- 거대한

- 석사

- 석사

- 어울리는

- 극대화하다

- XNUMX월..

- 의미있는

- 방법

- 기구

- 미디어

- 회원

- 메모리

- 멘토링

- 메시지

- 메시지

- 메타 데이터

- 방법

- 방법

- 최소화

- 회의록

- 누락

- 완화

- ML

- 모델

- 모델

- 모듈러

- 모듈

- 돈

- 달

- 배우기

- 보다 효율적으로

- 또한

- 가장

- 여러

- 절대로 필요한 것

- name

- 자연의

- 필요한

- 필요

- 필요

- 요구

- 신제품

- nlp

- 주목할 만한

- 소설

- 지금

- 번호

- numpy

- 목표

- 목표

- 획득

- 획득

- 발생

- OCR

- of

- 오프

- 제공

- on

- ONE

- 사람

- 지속적으로

- 만

- 오픈 소스

- OpenAI

- 열기

- 운영

- 반대하는

- 광학 문자 인식

- 최적화

- or

- 주문

- 조직

- 실물

- OS

- 기타

- 우리의

- 아웃

- 결과

- 결과

- 출력

- 외부

- 위에

- 전체

- 극복하다

- 자신의

- 페이지

- 서

- 서류

- 평행

- 매개 변수

- 부품

- 열렬한

- 과거

- 통로

- 수행

- 성능

- 영화

- 개

- 관로

- 장소

- 플랫폼

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 부디

- 전철기

- 인기 문서

- 위치

- 게시하다

- 가능성

- 강한

- 정확한

- Precision

- Predictor

- 선물

- 예방

- 너무 이른

- 교장

- 이전에

- 우선 순위

- 우선 순위

- 개인 정보 보호

- 개인 정보 및 보안

- 사설

- 문제

- 문제 해결

- 방법

- 프로세스

- 처리

- 생산

- 프로덕트

- 생산적인

- 생산력

- 진행

- 약속

- 장래가 촉망되는

- 적절한

- 제공

- 공급자

- 제공

- 제공

- 제공

- 심리학

- 공개

- 공중 위생

- 출판물

- 출판

- 목적

- 목적

- 파이 토치

- 질문 게시판

- 품질

- 쿼리

- 문제

- 문의

- 빠른

- 빨리

- 이르기까지

- 순위

- 차라리

- RAY

- 읽기

- 현실

- 실시간

- 영수증

- 접수

- 최근

- 인식

- 감소

- 감소

- 정제

- 규정

- 관련

- 관련된

- 신뢰할 수있는

- 신뢰

- 유적

- 기억

- 렌더링

- 재편 성함

- 대표

- 대표

- 대표되는

- 공화국

- 의뢰

- 요구조건 니즈

- 연구

- 연구원

- 리저브

- 분해능

- 응답

- 응답

- 응답

- 책임

- 반응

- 결과

- 결과

- 결과

- return

- 혁명적 인

- 혁명적 인

- 위험

- 강력한

- 거칠게

- 달리기

- 라이언

- s

- 가장 안전한 따뜻함

- 현자

- 같은

- 찜하기

- 확장성

- 과학

- 과학자

- 과학자

- 할퀴다

- 검색

- 검색 엔진

- 검색 엔진

- 부문

- 보안

- 보안 침해

- 참조

- 세그먼트

- 선택된

- 본인

- 연장자

- 문장

- 별도의

- 순서

- 시퀀싱

- 연속

- 서브

- 봉사하다

- 서비스

- 서비스

- 세트

- 몇몇의

- 샤딩

- 그녀

- 영상을

- 전시

- 쇼

- 상당한

- 크게

- 규소

- 실리콘 밸리

- 실리콘 밸리 은행

- 비슷한

- 단순, 간단, 편리

- 간단히

- 단일

- 크기

- 작은

- 원활하게

- 사회적

- 소셜 미디어

- 해결책

- 솔루션

- 지우면 좋을거같음 . SM

- 공간

- 스피커

- 전문가

- 전문

- 특별히

- 구체적인

- 구체적으로

- 스펙트럼

- 연설

- 음성 인식

- 지출

- 분열

- 스플릿

- 직원

- 이해 관계자

- 독립

- 시작

- 주 정부

- Status

- 단계

- 아직도

- 저장

- 저장

- 상점

- 저장

- 전략들

- 흐름

- 스트리밍

- 유선

- 능률화

- 끈

- 학생들

- 스튜디오

- 실질적인

- 성공

- 성공한

- 성공적으로

- 이러한

- 요약

- 우수한

- 지원

- 주변

- 느끼기 쉬운

- 제발

- 체계

- 시스템은

- 받아

- 복용

- 태스크

- 작업

- 팀

- 기술

- 테크니컬

- 기법

- 기술

- 과학 기술자

- Technology

- 조건

- 보다

- 그

- XNUMXD덴탈의

- 연준

- 정보

- 세계

- 그들의

- 그들

- 그때

- 그곳에.

- Bowman의

- 그들

- 사고력

- 타사

- 이

- 그

- 생각

- 을 통하여

- 도처에

- 묶여

- 시간

- 시간이 많이 걸리는

- 타임 라인

- 에

- 토큰

- 전통적인

- 훈련 된

- 트레이닝

- 변환

- 변형

- 변환

- 변압기

- 참된

- 시도

- 두

- 유형

- 유형

- 궁극적으로

- 할 수 없는

- 이해

- 이해

- 이해 된

- 통일

- 단위

- 대학

- 잠금을 해제

- 최신의

- 업데이트

- 업로드

- 긴급한

- URL

- us

- 용법

- 사용

- 익숙한

- 사용자

- 사용자 경험

- 사용하기 쉬운

- 사용자

- 사용

- 유틸리티

- 활용

- 이용하다

- 골짜기

- 가치 있는

- 여러

- 거대한

- 확인

- 를 통해

- Video

- 동영상

- 온라인

- 필수

- 목소리

- 볼륨

- W

- 였다

- 방법..

- we

- 재산

- 웹

- 웹 서비스

- 잘

- 했다

- 뭐

- 언제

- 어느

- 동안

- 의지

- 과

- 이내

- 없이

- 원

- 워드

- 말

- 작업

- 워크 플로우

- 일하는

- 일

- 세계

- 겠지

- 년

- 항복

- 자신의

- 너의

- 제퍼 넷