Video 구글의 가장 큰 AI 언어 모델은 로봇이 인간의 명령을 더 유연하게 이해하고 해석할 수 있도록 돕는다고 구글의 최신 연구 결과가 나왔다.

기계는 일반적으로 매우 특정한 요구에 가장 잘 응답합니다. 개방형 요청은 때때로 이를 무시하고 사용자가 염두에 두지 않은 결과로 이어질 수 있습니다. 사람들은 원하는 응답을 얻기 위해 특정 방식으로 질문하는 것과 같이 엄격한 방식으로 로봇과 상호 작용하는 방법을 배웁니다.

그러나 PaLM-SayCan이라고 불리는 Google의 최신 시스템은 더 똑똑해질 것을 약속합니다. Google X에서 파생된 신생 기업인 Everyday Robots의 물리적 장치에는 머리에 눈을 위한 카메라가 있고 긴 곧은 몸체 뒤에 집어넣은 집게가 달린 팔이 바퀴 세트 위에 있습니다.

아래 비디오에서 로봇이 작동하는 모습을 볼 수 있습니다.

로봇에게 "방금 운동했는데 건강에 좋은 간식 줄래?"라고 물어보세요. 사과를 가져오도록 유도할 것입니다. "PaLM-SayCan [은] 로봇이 물리적 기반 작업을 수행하기 위해 높은 수준의 텍스트 지침을 따를 수 있도록 하는 언어 모델의 지식을 활용하는 해석 가능하고 일반적인 접근 방식입니다." Google Brain 팀의 연구 과학자 설명.

Google은 가장 큰 언어 모델을 도입했습니다. 손바닥 올해 XNUMX월. PaLM은 인터넷에서 스크랩한 데이터로 교육을 받았지만 개방형 텍스트 응답을 분출하는 대신 로봇이 따라야 할 지침 목록을 생성하도록 시스템이 조정되었습니다.

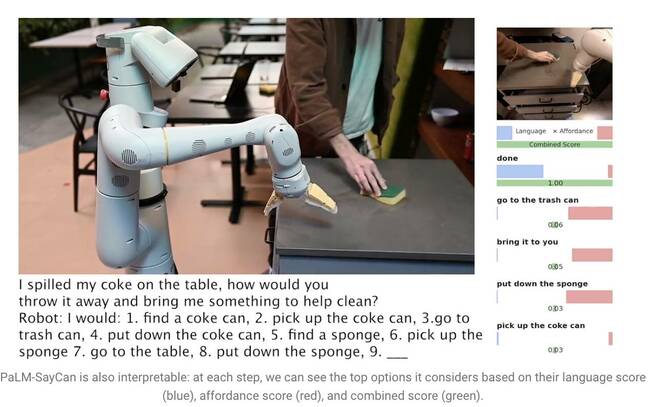

"내가 콜라를 탁자 위에 쏟았는데 어떻게 버리고 청소에 도움이 될 만한 것을 가져다주겠습니까?"라고 말하면 PaLM은 질문을 이해하고 로봇이 작업을 완료하기 위해 따라야 할 단계 목록을 생성합니다 깡통을 집어 쓰레기통에 던지고 스폰지를 얻습니다.

그러나 PaLM과 같은 대규모 언어 모델(LLM)은 그들이 말하는 내용의 의미를 이해하지 못합니다. 이러한 이유로 연구자들은 강화 학습을 사용하여 추상 언어를 시각적 표현과 행동에 적용하는 별도의 모델을 훈련했습니다. 그런 식으로 로봇은 "Coke"라는 단어를 탄산 음료 캔 이미지와 연관시키는 법을 배웁니다.

PaLM-SayCan은 또한 소위 "어포던스 기능(affordance functions)"을 학습합니다. 이 기능은 환경에 있는 개체가 주어진 특정 작업을 완료할 가능성의 순위를 매기는 방법입니다. 예를 들어 로봇이 스폰지를 감지했지만 근처에 진공이 없는 경우 로봇이 진공 청소기보다 스폰지를 집을 가능성이 더 높습니다.

"우리의 방법인 SayCan은 물리적 기반 작업에서 LLM 내의 지식을 추출하고 활용합니다."라고 팀은 설명했습니다. 연구 논문. “LLM(Say)은 높은 수준의 목표에 유용한 작업을 결정하기 위한 작업 기반을 제공하고 학습된 어포던스 기능(Can)은 계획에 따라 실행할 수 있는 것을 결정하기 위한 세계 기반을 제공합니다. 우리는 세계에서 가능한 것에 대한 어포던스를 제공하는 언어 조건 값 기능을 학습하는 방법으로 강화 학습(RL)을 사용합니다.”

로봇이 작업에서 벗어나는 것을 방지하기 위해 101개의 서로 다른 명령에서만 동작을 선택하도록 훈련됩니다. Google은 PaLM-SayCan이 주방에 적응하도록 훈련시켰습니다. PaLM-SayCan은 간식과 음료를 받고 간단한 청소 작업을 수행할 수 있습니다. 연구자들은 LLM이 로봇이 추상적인 지시가 주어지면 더 복잡한 작업을 안전하게 수행하도록 하는 첫 번째 단계라고 생각합니다.

“많은 실제 로봇 작업에 대한 우리의 실험은 높은 성공률로 장기적이고 추상적인 자연 언어 지침을 계획하고 완료할 수 있는 능력을 보여줍니다. 우리는 PaLM-SayCan의 해석 가능성이 실제 사용자와 로봇의 안전한 상호 작용을 가능하게 한다고 믿습니다.”라고 결론을 내렸습니다. ®