기초 모델(FM)을 구축하려면 방대한 양의 데이터에 대해 수백억에서 수천억 개의 매개변수가 포함된 모델을 교육하기 위해 대규모 클러스터를 구축, 유지 관리 및 최적화해야 합니다. 며칠 또는 몇 주 동안의 모델 교육 진행 과정을 손실하지 않고 오류와 환경 변화를 처리할 수 있는 복원력 있는 환경을 만드는 것은 클러스터 확장, 사전 상태 모니터링, 작업 체크포인트 및 오류나 문제가 발생할 경우 자동으로 교육을 재개하는 기능을 구현해야 하는 운영상의 과제입니다. .

공유하게 되어 기쁩니다. 아마존 세이지메이커 하이퍼팟 이제 대규모 훈련 클러스터 운영과 관련된 획일적인 무거운 작업을 제거하면서 복원력이 뛰어난 훈련 환경을 제공함으로써 수천 개의 가속기가 포함된 훈련 기초 모델을 최대 40% 더 빠르게 활성화할 수 있는 일반 버전이 출시되었습니다. SageMaker HyperPod를 사용하면 기계 학습(ML) 실무자는 하드웨어 오류 문제를 처리할 필요 없이 중단 없이 몇 주, 몇 달 동안 FM을 교육할 수 있습니다.

Stability AI와 같은 고객은 SageMaker HyperPod를 사용하여 Stable Diffusion을 포함한 기반 모델을 교육합니다.

“선도적인 오픈 소스 생성 AI 회사로서 우리의 목표는 현대 AI의 접근성을 극대화하는 것입니다. 우리는 훈련 성과를 최적으로 확장하기 위한 인프라가 필요한 수백억 개의 매개변수로 기반 모델을 구축하고 있습니다. SageMaker HyperPod의 관리형 인프라와 최적화 라이브러리를 사용하면 교육 시간과 비용을 50% 이상 줄일 수 있습니다. 최신 모델을 더 빠르게 구축할 수 있도록 모델 교육의 탄력성과 성능이 더욱 향상되었습니다.”

– Emad Mostaque, Stability AI 창립자 겸 CEO.

하드웨어 오류에 대한 탄력성을 갖춘 FM 개발의 전체 주기를 만들기 위해 SageMaker HyperPod는 클러스터 생성, 클러스터 상태 모니터링, 결함이 있는 노드를 즉시 수리 및 교체하고, 빈번한 체크포인트를 저장하고, 진행 상황을 잃지 않고 자동으로 훈련을 재개하는 데 도움이 됩니다. 또한 SageMaker HyperPod는 다음과 같이 사전 구성되어 있습니다. 아마존 세이지 메이커 다음을 포함한 분산 교육 라이브러리 SageMaker 데이터 병렬 처리 라이브러리(SMDDP) 및 SageMaker 모델 병렬 처리 라이브러리(SMP), 교육 데이터와 모델을 더 작은 청크로 간단하게 분할하고 클러스터 노드 전체에서 병렬로 처리하는 동시에 클러스터의 컴퓨팅 및 네트워크 인프라를 완전히 활용하여 FM 교육 성능을 향상시킵니다. SageMaker HyperPod는 클러스터 및 교육 작업 조정을 위해 Slurm Workload Manager를 통합합니다.

Slurm 워크로드 관리자 개요

슬럼이전에 리소스 관리용 단순 Linux 유틸리티로 알려진 는 분산 컴퓨팅 클러스터에서 작업을 실행하기 위한 작업 스케줄러입니다. 또한 다음을 사용하여 병렬 작업을 실행하기 위한 프레임워크를 제공합니다. NCCL(NVIDIA 집단 커뮤니케이션 라이브러리) or 메시지 전달 인터페이스(MPI) 표준. Slurm은 고성능 컴퓨팅(HPC), 생성적 AI 및 FM 교육 워크로드에서 널리 사용되는 인기 있는 오픈 소스 클러스터 리소스 관리 시스템입니다. SageMaker HyperPod는 몇 분 만에 Slurm 클러스터를 시작하고 실행할 수 있는 간단한 방법을 제공합니다.

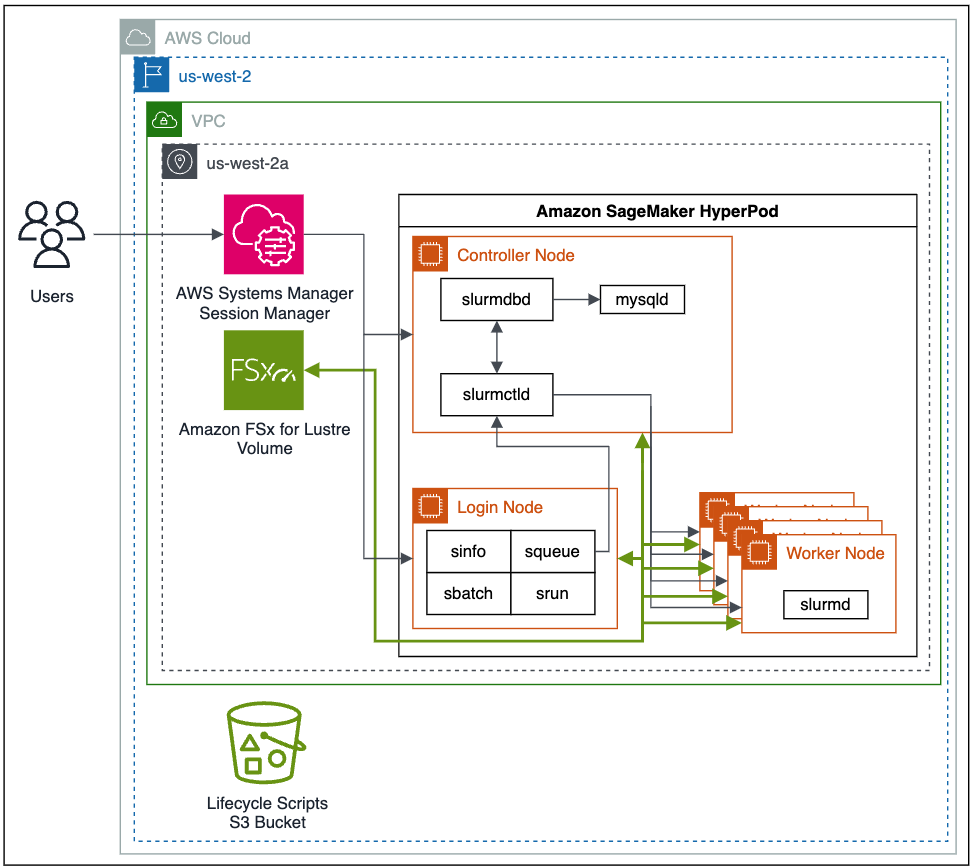

다음은 사용자가 SageMaker HyperPod와 상호 작용하는 방법과 다양한 클러스터 구성 요소가 서로 및 기타 AWS 서비스와 상호 작용하는 방법에 대한 상위 수준 아키텍처 다이어그램입니다. Luster 용 Amazon FSx 및 아마존 단순 스토리지 서비스 (아마존 S3).

Slurm 작업은 명령줄의 명령을 통해 제출됩니다. Slurm 작업을 실행하는 명령은 다음과 같습니다. srun 및 sbatch. 그만큼 srun 명령은 대화형 및 차단 모드에서 훈련 작업을 실행합니다. sbatch 일괄 처리 및 비차단 모드로 실행됩니다. srun 주로 즉각적인 작업을 실행하는 데 사용됩니다. sbatch 나중에 작업을 실행하는 데 사용할 수 있습니다.

추가 Slurm 명령 및 구성에 대한 자세한 내용은 다음을 참조하세요. Slurm 워크로드 관리자 문서.

자동 재개 및 복구 기능

SageMaker HyperPod의 새로운 기능 중 하나는 작업을 자동으로 재개하는 기능입니다. 이전에는 교육 또는 미세 조정 작업 실행 중에 작업자 노드가 실패하면 작업 상태를 확인하고 최신 체크포인트에서 작업을 다시 시작하며 전체 실행 동안 작업을 계속 모니터링하는 것은 사용자의 몫이었습니다. 훈련 작업이나 미세 조정 작업을 한 번에 며칠, 몇 주, 심지어 몇 달 동안 실행해야 하는 경우 작업을 모니터링하고 유지하기 위해 주기를 소비해야 하는 사용자의 추가 관리 오버헤드로 인해 비용이 많이 듭니다. 노드 충돌뿐만 아니라 값비싼 가속 컴퓨팅 인스턴스의 유휴 시간 비용도 발생합니다.

SageMaker HyperPod는 자동화된 상태 확인, 노드 교체 및 작업 복구를 사용하여 작업 복원성을 해결합니다. SageMaker HyperPod의 Slurm 작업은 SageMaker 사용자 지정 Slurm 플러그인을 사용하여 모니터링됩니다. SPANK 프레임워크. 훈련 작업이 실패하면 SageMaker HyperPod는 일련의 상태 확인을 통해 클러스터 상태를 검사합니다. 클러스터에서 결함이 있는 노드가 발견되면 SageMaker HyperPod는 클러스터에서 해당 노드를 자동으로 제거하고 이를 정상 노드로 교체한 후 훈련 작업을 다시 시작합니다. 훈련 작업에서 체크포인트를 사용할 때 중단되거나 실패한 모든 작업은 최신 체크포인트에서 재개될 수 있습니다.

솔루션 개요

SageMaker HyperPod를 배포하려면 먼저 다음을 구성하여 환경을 준비합니다. 아마존 가상 프라이빗 클라우드 (Amazon VPC) 네트워크 및 보안 그룹, FSx for Lustre와 같은 지원 서비스를 VPC에 배포하고 Slurm 수명 주기 스크립트를 S3 버킷에 게시합니다. 그런 다음 SageMaker HyperPod를 배포 및 구성하고 헤드 노드에 연결하여 훈련 작업을 시작합니다.

사전 조건

SageMaker HyperPod를 생성하기 전에 먼저 VPC를 구성하고, FSx for Lustre 파일 시스템을 생성하고, 원하는 클러스터 수명 주기 스크립트로 S3 버킷을 설정해야 합니다. 또한 최신 버전의 AWS 명령 줄 인터페이스 (AWS CLI) 및 CLI 플러그인 설치 AWS 세션 관리자, 능력 AWS 시스템 관리자.

SageMaker HyperPod는 VPC와 완전히 통합됩니다. 새 VPC 생성에 대한 자세한 내용은 다음을 참조하세요. 기본 VPC 생성 or VPC 생성. 리소스 간 최고의 성능으로 원활한 연결을 허용하려면 동일한 리전 및 가용 영역에 모든 리소스를 생성해야 하며, 연결된 보안 그룹 규칙이 클러스터 리소스 간 연결을 허용하는지 확인해야 합니다.

다음으로, 너 Lustre 파일 시스템용 FSx 생성. 이는 모델 교육 전반에 걸쳐 사용할 수 있는 고성능 파일 시스템 역할을 합니다. FSx for Lustre 및 클러스터 보안 그룹이 클러스터 리소스와 FSx for Lustre 파일 시스템 간의 인바운드 및 아웃바운드 통신을 허용하는지 확인하십시오.

새 클러스터 인스턴스와 같은 이벤트가 발생할 때 실행되는 클러스터 수명 주기 스크립트를 설정하려면 S3 버킷을 생성한 다음 기본 수명 주기 스크립트를 복사하고 선택적으로 사용자 지정합니다. 이 예에서는 버킷 접두사에 모든 수명 주기 스크립트를 저장합니다. lifecycle-scripts.

먼저 다음에서 샘플 수명주기 스크립트를 다운로드합니다. GitHub 레포. 원하는 클러스터 동작에 맞게 이를 사용자 정의해야 합니다.

다음으로, 사용자 정의된 수명 주기 스크립트를 저장할 S3 버킷을 생성합니다.

그런 다음 다음을 사용하여 로컬 디렉터리의 기본 수명 주기 스크립트를 원하는 버킷 및 접두사로 복사합니다. aws s3 sync:

마지막으로 클러스터의 헤드 노드에 대한 단순화된 연결을 위해 클라이언트를 설정하려면 다음을 수행해야 합니다. AWS CLI 설치 또는 업데이트 설치하고 AWS 세션 관리자 CLI 플러그인 클러스터를 관리하고 훈련 작업을 실행하기 위한 대화형 터미널 연결을 허용합니다.

사용 가능한 온디맨드 리소스를 사용하거나 SageMaker로 용량 예약을 요청하여 SageMaker HyperPod 클러스터를 생성할 수 있습니다. 용량 예약을 생성하려면 서비스 할당량 대시보드에서 특정 컴퓨팅 인스턴스 유형 및 용량 할당을 예약하는 할당량 증가 요청을 생성합니다.

훈련 클러스터 설정

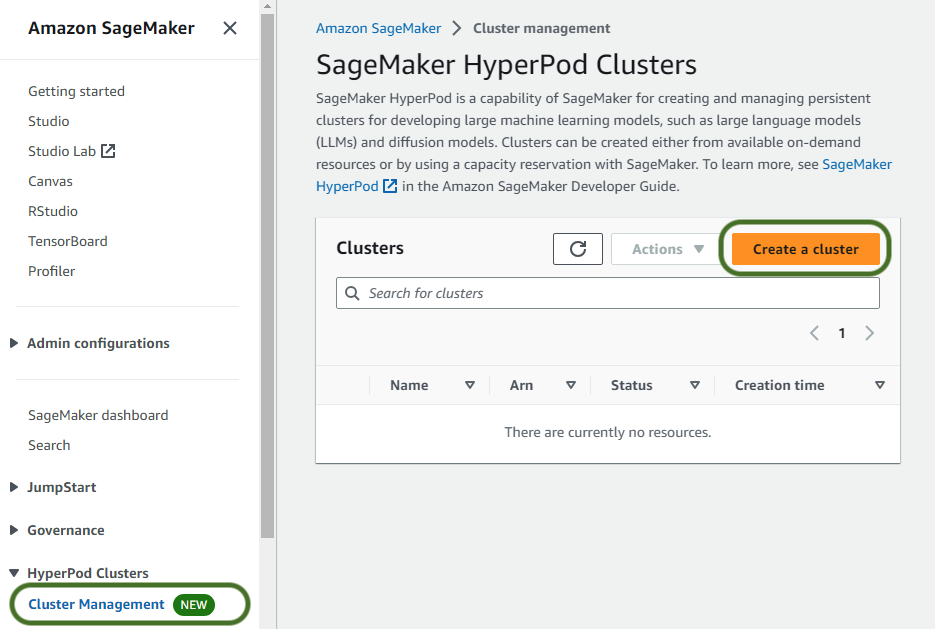

SageMaker HyperPod 클러스터를 생성하려면 다음 단계를 완료하십시오.

- SageMaker 콘솔에서 클러스터 관리 아래에 HyperPod 클러스터 탐색 창에서

- 왼쪽 메뉴에서 클러스터 생성.

- 클러스터 이름과 선택적으로 클러스터 리소스에 적용할 태그를 제공한 후 선택합니다. 다음 보기.

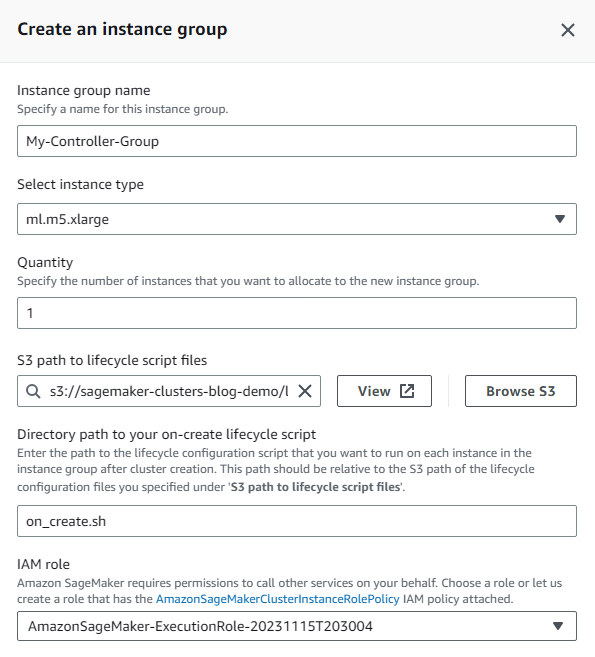

- 선택 인스턴스 그룹 만들기 인스턴스 그룹 이름, 필요한 인스턴스 유형, 원하는 인스턴스 수량, 이전에 클러스터 수명 주기 스크립트를 복사한 S3 버킷 및 접두사 경로를 지정합니다.

클러스터를 관리하고 작업을 제출하는 데 사용되는 컨트롤러 노드와 가속화된 컴퓨팅 인스턴스를 사용하여 훈련 작업을 실행하는 데 사용되는 작업자 노드에 대해 서로 다른 인스턴스 그룹을 갖는 것이 좋습니다. 선택적으로 로그인 노드에 대한 추가 인스턴스 그룹을 구성할 수 있습니다.

- 먼저 클러스터 헤드 노드를 포함할 컨트롤러 인스턴스 그룹을 생성합니다.

- 이 인스턴스 그룹의 경우 AWS 자격 증명 및 액세스 관리 (IAM) 역할을 선택하세요. 새 역할 만들기 인스턴스 그룹의 클러스터 인스턴스가 액세스할 수 있도록 하려는 S3 버킷을 지정합니다.

생성된 역할에는 기본적으로 지정된 버킷에 대한 읽기 전용 액세스 권한이 부여됩니다.

- 왼쪽 메뉴에서 역할 만들기.

- 생성 시 스크립트 프롬프트에서 각 인스턴스 생성 시 실행할 스크립트 이름을 입력합니다. 이 예에서는 생성 시 스크립트가 호출됩니다.

on_create.sh.

- 왼쪽 메뉴에서 찜하기.

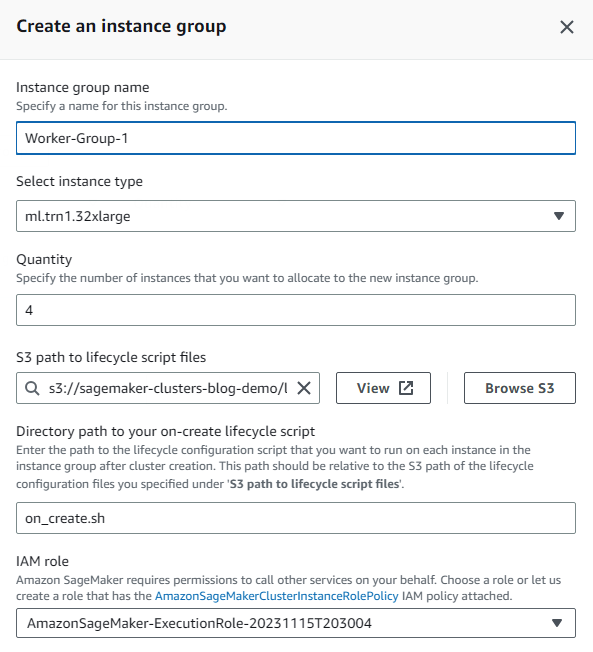

- 왼쪽 메뉴에서 인스턴스 그룹 만들기 작업자 인스턴스 그룹을 생성합니다.

- 원하는 인스턴스 유형 및 수량을 포함하여 요청된 모든 세부 정보를 제공하십시오.

이 예에서는 1.32개의 ml.trnXNUMXxl 가속 인스턴스를 사용하여 훈련 작업을 수행합니다. 이전과 동일한 IAM 역할을 사용하거나 작업자 인스턴스에 대한 역할을 사용자 지정할 수 있습니다. 마찬가지로 이 작업자 인스턴스 그룹에 대해 이전 인스턴스 그룹과 다른 생성 시 수명 주기 스크립트를 사용할 수 있습니다.

- 왼쪽 메뉴에서 다음 보기 계속하려면.

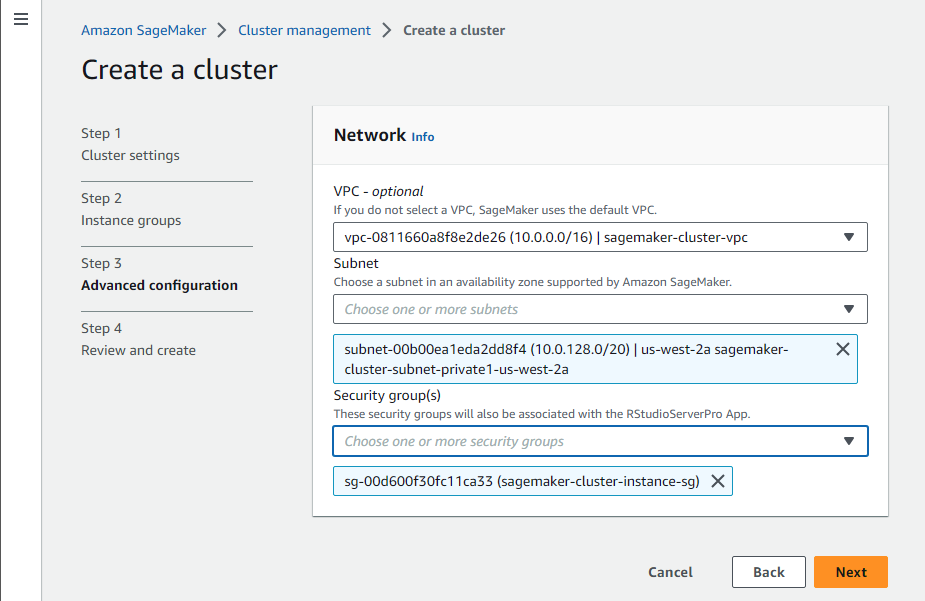

- 클러스터 인스턴스에 대해 원하는 VPC, 서브넷 및 보안 그룹을 선택합니다.

짧은 지연 시간을 보장하기 위해 단일 가용 영역과 서브넷에서 클러스터 인스턴스를 호스팅합니다.

S3 데이터에 자주 액세스하는 경우 잠재적인 데이터 전송 비용을 줄이기 위해 프라이빗 서브넷의 라우팅 테이블과 연결된 VPC 엔드포인트를 생성하는 것이 좋습니다.

- 왼쪽 메뉴에서 다음 보기.

- 클러스터 세부정보 요약을 검토한 후 선택하세요. 문의하기.

또는 AWS CLI를 사용하여 SageMaker HyperPod를 생성하려면 먼저 클러스터 생성에 사용된 JSON 매개변수를 사용자 지정합니다.

그런 다음 다음 명령을 사용하여 제공된 입력을 사용하여 클러스터를 생성합니다.

Llama 2로 첫 번째 훈련 작업 실행

Llama 2 모델의 사용에는 Meta 라이센스가 적용됩니다. 모델 가중치와 토크나이저를 다운로드하려면 다음을 방문하세요. 웹 사이트 액세스를 요청하기 전에 라이선스를 수락하세요. 메타의 Hugging Face 웹사이트.

클러스터가 실행된 후 클러스터 ID, 인스턴스 그룹 이름, 인스턴스 ID를 사용하여 Session Manager에 로그인합니다. 클러스터 세부정보를 보려면 다음 명령어를 사용하세요.

응답의 클러스터 ARN 내에 포함된 클러스터 ID를 기록해 두십시오.

다음 명령을 사용하여 클러스터에 로그인하는 데 필요한 인스턴스 그룹 이름과 인스턴스 ID를 검색합니다.

다음 사항을 기록해 두십시오. InstanceGroupName 그리고 InstanceId 응답에서 이는 Session Manager를 사용하여 인스턴스에 연결하는 데 사용됩니다.

이제 세션 관리자를 사용하여 헤드 노드 또는 로그인 노드 중 하나에 로그인하고 훈련 작업을 실행합니다.

다음으로 환경을 준비하고 Llama 2와 RedPajama 데이터 세트를 다운로드하겠습니다. 전체 코드와 이에 대한 단계별 연습을 보려면 다음 지침을 따르세요. AWSome 분산 교육 GitHub 레포.

다음에 자세히 설명된 단계를 따르세요. 2.test_cases/8.neuronx-nemo-megatron/README.md 파일. 환경 준비, 모델 준비, 데이터 세트 다운로드 및 토큰화, 모델 사전 컴파일 단계를 수행한 후 6.pretrain-model.sh 스크립트와 sbatch SageMaker HyperPod의 자동 재개 기능을 활용할 수 있는 매개변수를 포함하는 작업 제출 명령입니다.

편집 sbatch 다음과 같이 표시됩니다.

작품을 제출한 후, 당신은 JobID 다음 코드를 사용하여 작업 상태를 확인하는 데 사용할 수 있습니다.

또한 다음 코드를 사용하여 작업 출력 로그를 따라 작업을 모니터링할 수 있습니다.

정리

SageMaker HyperPod 클러스터를 삭제하려면 SageMaker 콘솔을 사용하거나 다음 AWS CLI 명령을 사용하십시오.

결론

이 게시물에서는 AWS 환경을 준비하고, 첫 번째 SageMaker HyperPod 클러스터를 배포하고, 7억 매개변수 Llama 2 모델을 훈련하는 방법을 보여주었습니다. SageMaker HyperPod는 현재 미주(버지니아 북부, 오하이오, 오레곤), 아시아 태평양(싱가포르, 시드니, 도쿄), 유럽(프랑크푸르트, 아일랜드, 스톡홀름) 지역에서 정식 출시됩니다. SageMaker 콘솔, AWS CLI 및 AWS SDK를 통해 배포할 수 있으며 p4d, p4de, p5, trn1, inf2, g5, c5, c5n, m5 및 t3 인스턴스 제품군을 지원합니다.

SageMaker HyperPod에 대해 자세히 알아보려면 다음을 방문하세요. 아마존 세이지메이커 하이퍼팟.

저자 소개

브래드 도란 Amazon Web Services의 수석 기술 계정 관리자로 생성 AI에 중점을 두고 있습니다. 그는 디지털 네이티브 비즈니스 시장 부문에서 생성 AI 고객의 엔지니어링 과제를 해결하는 일을 담당하고 있습니다. 그는 인프라 및 소프트웨어 개발 경력을 갖고 있으며 현재 인공 지능 및 기계 학습 분야에서 박사 과정과 연구를 진행하고 있습니다.

브래드 도란 Amazon Web Services의 수석 기술 계정 관리자로 생성 AI에 중점을 두고 있습니다. 그는 디지털 네이티브 비즈니스 시장 부문에서 생성 AI 고객의 엔지니어링 과제를 해결하는 일을 담당하고 있습니다. 그는 인프라 및 소프트웨어 개발 경력을 갖고 있으며 현재 인공 지능 및 기계 학습 분야에서 박사 과정과 연구를 진행하고 있습니다.

케이타 와타나베 Amazon Web Services의 수석 GenAI 전문가 솔루션 설계자로서 Slurm 및 Kubernetes와 같은 OSS 프로젝트를 사용하여 기계 학습 솔루션을 개발하는 데 도움을 줍니다. 그의 배경은 기계 학습 연구 및 개발입니다. AWS에 합류하기 전에 Keita는 전자상거래 업계에서 제품 검색을 위한 이미지 검색 시스템을 개발하는 연구 과학자로 일했습니다. Keita는 도쿄대학교에서 과학 박사 학위를 취득했습니다.

케이타 와타나베 Amazon Web Services의 수석 GenAI 전문가 솔루션 설계자로서 Slurm 및 Kubernetes와 같은 OSS 프로젝트를 사용하여 기계 학습 솔루션을 개발하는 데 도움을 줍니다. 그의 배경은 기계 학습 연구 및 개발입니다. AWS에 합류하기 전에 Keita는 전자상거래 업계에서 제품 검색을 위한 이미지 검색 시스템을 개발하는 연구 과학자로 일했습니다. Keita는 도쿄대학교에서 과학 박사 학위를 취득했습니다.

저스틴 퍼틀 Amazon Web Services의 수석 솔루션 아키텍트입니다. 그는 정기적으로 생성 AI 고객에게 인프라 설계, 배포 및 확장에 관해 조언합니다. 그는 re:Invent를 비롯한 AWS 컨퍼런스와 기타 AWS 이벤트에서 정기적으로 연설하고 있습니다. Justin은 텍사스 대학교 오스틴에서 경영 정보 시스템 학사 학위를, 시애틀 대학교에서 소프트웨어 엔지니어링 석사 학위를 취득했습니다.

저스틴 퍼틀 Amazon Web Services의 수석 솔루션 아키텍트입니다. 그는 정기적으로 생성 AI 고객에게 인프라 설계, 배포 및 확장에 관해 조언합니다. 그는 re:Invent를 비롯한 AWS 컨퍼런스와 기타 AWS 이벤트에서 정기적으로 연설하고 있습니다. Justin은 텍사스 대학교 오스틴에서 경영 정보 시스템 학사 학위를, 시애틀 대학교에서 소프트웨어 엔지니어링 석사 학위를 취득했습니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/introducing-amazon-sagemaker-hyperpod-to-train-foundation-models-at-scale/

- :이다

- :어디

- $UP

- 1

- 100

- 12

- 14

- 24

- 7

- a

- 능력

- 소개

- 가속 된

- 가속기

- 수락

- ACCESS

- 접근성

- 액세스

- 계정

- 가로질러

- 또한

- 추가

- 구애

- 관리

- 관리

- 이점

- 후

- AI

- All

- 배당

- 수

- 수

- 또한

- 아마존

- 아마존 세이지 메이커

- Amazon Web Services

- 미주

- 금액

- an

- 및

- 어떤

- 신청

- 건축

- 있군요

- 발생

- 인조의

- 인공 지능

- 인공 지능과 기계 학습

- AS

- 아시아

- 아시아 태평양

- 관련

- At

- 오스틴

- 자동화

- 자동적으로

- 유효성

- 가능

- AWS

- 배경

- BE

- 된다

- 전에

- 행동

- 사이에

- 수십억

- 블로킹

- 빌드

- 건물

- 사업

- by

- 라는

- CAN

- 기능

- 능력

- 생산 능력

- 대표 이사

- 도전

- 과제

- 변경

- 검사

- 확인하는 것이 좋다.

- 왼쪽 메뉴에서

- 클라이언트

- 클러스터

- 암호

- 집단적인

- 제공

- 의사 소통

- 커뮤니케이션

- 회사

- 완전한

- 구성 요소들

- 계산

- 컴퓨팅

- 회의

- 구성

- 구성

- 연결하기

- 연결

- 연결

- 콘솔에서

- 계속

- 제어 장치

- 비용

- 값 비싼

- 비용

- 만들

- 만들기

- 창조

- 현재

- 관습

- 고객

- 사용자 정의

- 사용자 정의

- 주기

- 주기

- 계기반

- 데이터

- 일

- 거래

- 태만

- 도

- 배포

- 배포

- 배치

- 설계

- 원하는

- 상세한

- 세부설명

- 개발

- 개발

- 개발

- 다른

- 방송

- 디지털

- 붕괴

- 분산

- 분산 컴퓨팅

- 분산 교육

- 다운로드

- 두

- ...동안

- 마다

- 전자 상거래

- 중

- 제거

- 가능

- 종점

- 엔지니어링

- 확인

- 전체의

- 환경

- 환경

- 세우다

- 유럽

- 조차

- 이벤트

- 이벤트

- 예

- 흥분한

- 비싼

- 여분의

- 페이스메이크업

- 실패한

- 실패

- 고장

- 실패

- 가족

- 빠른

- 결함

- 특색

- 특징

- 입양 부모로서의 귀하의 적합성을 결정하기 위해 미국 이민국에

- 먼저,

- 집중

- 따라

- 수행원

- 럭셔리

- 전에

- 발견

- Foundation

- 설립자

- 설립자 겸 CEO

- 사

- 뼈대

- 프랑크푸르트

- 빈번한

- 자주

- 에

- 가득 찬

- 충분히

- 일반적으로

- 생성

- 생성적인

- 제너레이티브 AI

- 얻을

- GitHub의

- 골

- 가는

- 통치되는

- 부여

- 그룹

- 여러 떼

- 핸들

- 하드웨어

- 있다

- 데

- he

- 머리

- 치유

- 건강

- 건강은 물론, 경제성까지!

- 무거운

- 무거운 리프팅

- 도움이

- 높은

- 고수준

- 고성능

- 최고

- 고도로

- 그의

- 보유

- 주인

- 방법

- How To

- HPC

- HTML

- HTTP

- HTTPS

- 수백

- ID

- 통합 인증

- 유휴

- if

- 영상

- 즉시

- 구현

- 개선

- in

- 포함

- 포함

- 포함

- 증가

- 산업

- 정보

- 정보 시스템

- 인프라

- 입력

- 설치

- 설치

- 예

- 명령

- 통합 된

- 통합

- 인텔리전스

- 상호 작용하는

- 대화형

- 인터페이스

- 중단 된

- 으로

- 소개

- 참여

- 아일랜드

- 문제

- IT

- 일

- 작업

- 가입

- JPG

- JSON

- Justin

- 알려진

- 넓은

- 대규모

- 숨어 있음

- 후에

- 최근

- 지도

- 배우다

- 배우기

- 도서관

- 도서관

- 특허

- wifecycwe

- 리프팅

- 처럼

- 라인

- 리눅스

- 야마

- 지방의

- 기록

- 로그인

- 보기

- 같이

- 지는

- 낮은

- 기계

- 기계 학습

- 유지하다

- 유지 보수

- 확인

- 제작

- 유튜브 영상을 만드는 것은

- 관리

- 구축

- 매니저

- 시장

- 석사

- 문제

- 극대화하다

- 메타

- 회의록

- ML

- 모드

- 모델

- 모델

- 현대

- 모니터

- 모니터링

- 모니터링

- 개월

- 배우기

- 대개

- name

- 출신

- 카테고리

- 필요

- 필요

- 필요

- 네트워크

- 신제품

- 새로운 기능

- 노드

- 노드

- 주의

- 지금

- 엔비디아

- of

- 오하이오

- on

- 온디맨드

- ONE

- 열 수

- 오픈 소스

- 운영

- 운영

- 최적화

- 최적화

- or

- 오케스트레이션

- 오레곤

- 우리

- 기타

- 우리의

- 출력

- 위에

- 태평양

- 빵

- 평행

- 매개 변수

- 매개 변수

- 통과

- 통로

- 수행

- 성능

- 박사 학위

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 플러그인

- 인기 문서

- 게시하다

- 가능성

- Prepare

- 너무 이른

- 이전에

- 교장

- 이전에

- 사설

- 사전

- 진행

- 처리

- 프로덕트

- 진행

- 프로젝트

- 제공

- 제공

- 제공

- 출판

- 양

- RE

- 추천

- 회복

- 감소

- 참조

- 지방

- 지역

- 정규병

- 규칙적으로

- 제거

- 수리

- 교체

- 바꿔 놓음

- 의뢰

- 필요

- 필요

- 연구

- 연구 및 개발

- 예약

- 리저브

- 탄력

- 의지

- 제품 자료

- 응답

- 책임

- 이력서

- 직위별

- 라우팅

- 규칙

- 달리기

- 달리는

- 실행

- 현자

- 같은

- 찜하기

- 규모

- 스케일링

- 과학

- 과학자

- 스크립트

- 스크립트

- SDK

- 원활한

- 검색

- 시애틀

- 보안

- 참조

- 분절

- 연장자

- 서브

- 서비스

- 서비스

- 세션

- 세트

- 공유

- 영상을

- 보여

- 비슷하게

- 단순, 간단, 편리

- 단순화

- 싱가포르

- 단일

- 작은

- 소프트웨어

- 소프트웨어 개발

- 소프트웨어 공학

- 솔루션

- 해결

- 출처

- Speaker

- 전문가

- 구체적인

- 지정

- 지출

- 분열

- 안정

- 안정된

- 기준

- 스타트

- 최첨단

- Status

- 단계

- 저장

- 저장

- 똑 바른

- 연구

- 제출

- 제출

- 제출

- 서브넷

- 이러한

- 소송

- 스위트

- 개요

- SUPPORT

- 지원

- 확인

- 시드니

- 동조.

- 체계

- 시스템은

- 테이블

- 받아

- 테크니컬

- 수십

- 단말기

- 텍사스

- 보다

- 그

- XNUMXD덴탈의

- 그들의

- 그들

- 그때

- Bowman의

- 그들

- 이

- 수천

- 을 통하여

- 도처에

- 시간

- 에

- 오늘

- 토큰 화하다

- 도쿄

- Train

- 트레이닝

- 이전

- 유형

- 유형

- 아래에

- 대학

- 도쿄 대학

- 업데이트

- 사용

- 익숙한

- 사용자

- 사용자

- 사용

- 사용

- 유틸리티

- 활용

- 여러

- 거대한

- 버전

- 를 통해

- 관측

- 버지니아의

- 온라인

- 방문

- 연습

- 였다

- 방법..

- we

- 웹

- 웹 서비스

- 주

- 잘

- 언제

- 어느

- 동안

- 크게

- 위키 백과

- 의지

- 과

- 이내

- 없이

- 일

- 노동자

- 겠지

- 자신의

- 너의

- 제퍼 넷