T오 무사히 미래에 강력한 범용 인공 지능을 배포하려면 기계 학습 모델이 인간의 의도에 따라 작동하도록 보장해야 합니다. 이 도전 과제는 다음과 같이 알려졌습니다. 정렬 문제.

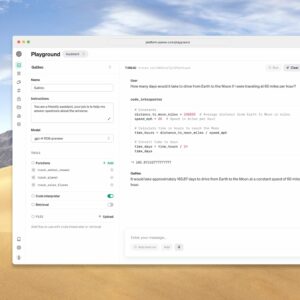

정렬 문제에 대한 확장 가능한 솔루션은 모델 출력을 사람이 평가하기 어렵거나 시간이 많이 걸리는 작업에 적용되어야 합니다. 확장 가능한 정렬 기술을 테스트하기 위해 다음 샘플과 같이 전체 책을 요약하는 모델을 훈련했습니다.[1] 우리 모델은 먼저 책의 작은 부분을 요약한 다음 해당 요약을 더 높은 수준의 요약으로 요약하는 방식으로 작동합니다.

우리의 최고의 모델은 GPT-3에서 미세 조정되었으며 전체 책에 대한 합리적인 요약을 생성하며 때로는 사람이 작성한 요약의 평균 품질과도 일치합니다. 인간으로부터 6/7 등급(사람이 작성한 평균 요약과 유사)을 달성합니다. 책을 5% 읽었고 5/7 등급은 15%였습니다. 우리 모델은 또한 다음과 같은 분야에서 최첨단 결과를 달성합니다. BookSum 데이터세트 책 길이의 요약을 위해. 제로샷 질의 응답 모델은 우리 모델의 요약을 사용하여 경쟁력 있는 결과를 얻을 수 있습니다. NarrativeQA 데이터 세트 책 길이의 질문 답변을 위해.[2]

우리의 접근 방식: 인간 피드백과 재귀적 작업 분해를 통한 강화 학습 결합

텍스트를 요약하는 작업을 생각해 보세요. 크기가 큰 사전 훈련된 모델은 요약을 잘 하지 못합니다.. 과거에 우리는 다음을 사용하여 모델을 훈련하는 것을 발견했습니다. 사람의 피드백을 통한 강화 학습 짧은 게시물과 기사에 대한 인간의 선호도에 따라 모델 요약을 정렬하는 데 도움이 되었습니다. 하지만 책 전체의 요약을 판단하려면 사람이 책 전체를 읽어야 하고 많은 시간이 걸리기 때문에 직접적으로 판단하려면 많은 노력이 필요합니다.

이 문제를 해결하기 위해 우리는 추가로 다음을 사용합니다. 재귀 작업 분해: 절차적으로 어려운 작업을 더 쉬운 작업으로 나눕니다. 이 경우 긴 텍스트를 요약하여 여러 개의 짧은 부분을 요약합니다. 엔드투엔드 훈련 절차와 비교하여 재귀적 작업 분해에는 다음과 같은 장점이 있습니다.

- 분해를 사용하면 원본 텍스트를 읽는 대신 책의 작은 부분에 대한 요약을 사용하여 인간이 모델 요약을 더 빠르게 평가할 수 있습니다.

- 요약 작성 과정을 추적하는 것이 더 쉽습니다. 예를 들어, 요약의 특정 이벤트가 원본 텍스트에서 발생하는 위치를 추적할 수 있습니다. 직접 확인해보세요 우리의 요약 탐색기!

- 우리의 방법은 우리가 사용하는 변환기 모델의 컨텍스트 길이에 제한되지 않고 길이가 무제한인 책을 요약하는 데 사용할 수 있습니다.

우리가 이 일을 하는 이유

T그의 일은 우리의 일부이다 지속적으로 연구 첨단 AI 시스템을 정렬하는 것이 핵심입니다. 우리의 미션. 점점 더 복잡한 작업을 수행하도록 모델을 훈련함에 따라 인간이 모델의 결과를 정보에 근거하여 평가하는 것이 점점 더 어려워질 것입니다. 이로 인해 이러한 모델을 배포할 때 부정적인 결과를 초래할 수 있는 모델 출력의 미묘한 문제를 감지하기가 더 어려워집니다. 따라서 우리는 모델의 기능이 향상됨에 따라 모델을 평가하는 능력도 향상되기를 원합니다.

이 문제에 대한 우리의 현재 접근 방식은 다음과 같습니다. 인간이 다른 모델의 지원을 사용하여 기계 학습 모델 결과를 평가할 수 있도록 지원. 이 경우 책 요약을 평가하기 위해 우리는 모델로 작성된 개별 장 요약을 인간에게 부여하여 원본 텍스트를 읽는 것에 비해 이러한 요약을 평가할 때 시간을 절약합니다. 도서 요약에 대한 우리의 진전은 스케일링 정렬 기술에 대한 최초의 대규모 경험적 작업입니다.

앞으로 우리는 인공 일반 지능을 정렬하는 데 필요한 기술을 찾는 것을 목표로 인간이 모델 동작을 평가하는 데 도움을 줄 수 있는 더 나은 방법을 연구하고 있습니다.

우리는 항상 우리와 함께할 더 재능 있는 사람들을 찾고 있습니다. 그러니 이 일에 관심이 있으시면 부디 우리 팀에 합류하려면 신청하세요!

- 10

- 11

- 28

- 67

- 7

- 77

- 84

- 9

- 소개

- 행동

- 주소

- 많은

- 장점

- AI

- 접근

- 기사

- 인조의

- 인공 지능

- 평균

- 가

- 존재

- BEST

- 도서

- 기능

- 도전

- 장

- 비교

- 복잡한

- 제어

- 핵심

- 수

- Current

- 데이터

- 배포

- 효과

- 능력을 키우다

- 이벤트

- 예

- 피드백

- 먼저,

- 수행원

- 앞으로

- 발견

- 미래

- 일반

- 골

- 좋은

- HTTPS

- 사람의

- 인간

- 증가

- 개인

- 인텔리전스

- 이해

- IT

- 어울리다

- 키

- 알려진

- 넓은

- 리드

- 배우기

- 긴

- 찾고

- 기계

- 기계 학습

- 제작

- 유튜브 영상을 만드는 것은

- 어울리는

- 매질

- Mission

- 모델

- 모델

- 배우기

- 기타

- 서

- 사람들

- 조각

- 게시물

- 강한

- 문제

- 문제

- 방법

- 목적

- 품질

- 문제

- 빨리

- 평가

- RE

- 읽기

- 공개

- 연구

- 결과

- 확장성

- 규모

- 스케일링

- 선택된

- 짧은

- 비슷한

- 작은

- So

- 해결책

- 최첨단

- 시스템은

- 재능

- 작업

- 기법

- test

- 소스

- 시간

- 시간이 많이 걸리는

- 트레이닝

- us

- 사용

- W3

- 누구

- 창

- 작업

- 일하는

- 일