우리는 생성적 AI가 시간이 지남에 따라 우리가 알고 있는 거의 모든 고객 경험을 변화시킬 수 있는 잠재력을 갖고 있다고 믿습니다. adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy, LexisNexis Legal & Professional 등 AWS에서 생성적 AI 애플리케이션을 시작하는 회사의 수는 상당하며 빠르게 구축되고 있습니다. Perplexity AI와 같은 혁신적인 스타트업은 생성 AI를 위해 AWS에 올인하고 있습니다. Anthropic과 같은 선도적인 AI 회사는 미션 크리티컬 워크로드를 위한 기본 클라우드 공급자이자 미래 모델을 교육할 장소로 AWS를 선택했습니다. 그리고 Accenture와 같은 글로벌 서비스 및 솔루션 제공업체는 사내 개발자에게 다음과 같은 역량을 부여하면서 맞춤형 생성 AI 애플리케이션의 이점을 누리고 있습니다. 아마존 코드위스퍼러.

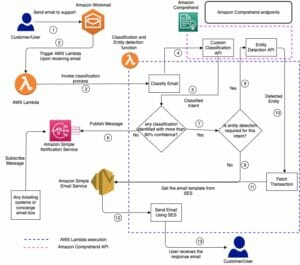

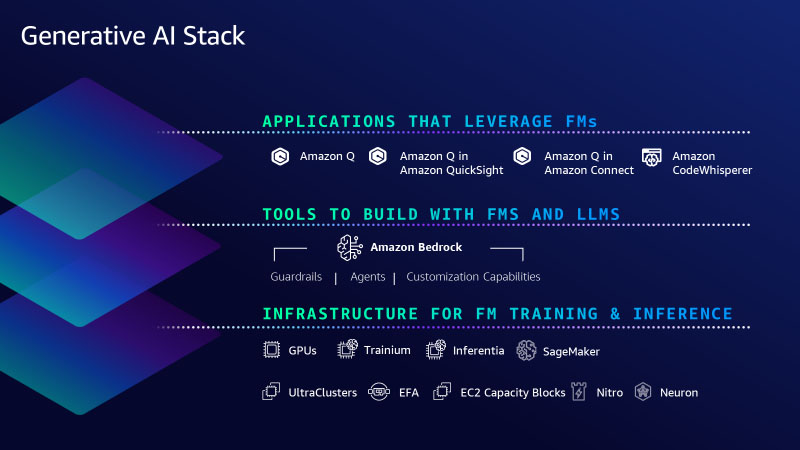

이러한 고객이 AWS를 선택하는 이유는 AWS가 항상 해왔던 일, 즉 고객 경험과 비즈니스를 변화시킬 수 있는 복잡하고 값비싼 기술을 도입하고 모든 규모와 기술적 능력을 갖춘 고객을 위해 이를 민주화하는 데 중점을 두고 있기 때문입니다. 이를 위해 우리는 생성 AI 스택의 세 가지 계층에 걸쳐 가장 포괄적인 기능 세트를 제공하기 위해 투자하고 빠르게 혁신하고 있습니다. 맨 아래 계층은 LLM(대형 언어 모델) 및 기타 FM(기본 모델)을 교육하고 추론 또는 예측을 생성하는 인프라입니다. 중간 계층에서는 고객이 AWS 서비스에서 기대하는 것과 동일한 보안, 액세스 제어 및 기타 기능을 갖춘 생성적 AI 애플리케이션을 구축하고 확장하는 데 필요한 모든 모델과 도구에 쉽게 액세스할 수 있습니다. 그리고 최상위 계층에서 우리는 생성적 AI 기반 코딩과 같은 핵심 영역에서 판도를 바꾸는 애플리케이션에 투자해 왔습니다. 고객은 고객에게 선택권을 제공하고 모든 계층에 걸쳐 폭넓고 깊이 있는 기능을 제공할 뿐만 아니라 우리의 데이터 우선 접근 방식을 높이 평가하고 우리가 처음부터 엔터프라이즈를 통해 모든 것을 구축했다는 신뢰를 표합니다. 보안 및 개인 정보 보호 등급.

이번 주에 우리는 고객이 비즈니스에서 생성 AI를 쉽고 실용적으로 사용할 수 있도록 스택의 세 가지 계층 모두에 걸쳐 많은 중요한 새로운 기능을 발표하면서 큰 진전을 이루었습니다.

스택의 최하위 계층: AWS Trainium2는 생성 AI를 위한 최첨단 클라우드 인프라를 제공하는 최신 추가 제품입니다.

스택의 맨 아래 계층은 LLM 및 기타 FM을 교육하고 실행하는 데 필요한 인프라(컴퓨팅, 네트워킹, 프레임워크, 서비스)입니다. AWS는 혁신을 통해 ML을 위한 최첨단 인프라를 제공합니다. AWS는 NVIDIA와의 오랜 협력을 통해 12년 전 최초로 GPU를 클라우드에 도입했으며, 가장 최근에는 P100 인스턴스에서 NVIDIA H5 GPU를 사용할 수 있게 만든 최초의 주요 클라우드 제공업체였습니다. 우리는 최첨단 가상화 시스템(AWS Nitro)의 가격 대비 성능 이점, Elastic Fabric Adapter(EFA)를 통한 강력한 페타비트 규모 네트워킹, Amazon EC2 UltraClusters(가용 영역에 공동 배치되고 대규모 ML 훈련을 위해 최대 3,200Gbps를 제공할 수 있는 비차단 네트워크에 상호 연결된 수천 개의 가속화된 인스턴스)를 사용하여 클러스터링을 확장합니다. 또한 우리는 ML용 Amazon EC2 용량 블록을 통해 모든 고객이 생성적 AI를 위한 매우 인기 있는 GPU 컴퓨팅 용량에 더 쉽게 액세스할 수 있도록 만들고 있습니다. 이는 고객이 향후 사용을 위해 GPU를 예약할 수 있는 업계 최초이자 유일한 소비 모델입니다(최대 500개). 짧은 기간의 ML 워크로드를 위해 EC2 UltraClusters에 배포됨.

몇 년 전, 우리는 가격 성능의 한계를 계속 뛰어넘기 위해서는 실리콘까지 혁신해야 한다는 것을 깨닫고 자체 칩에 투자하기 시작했습니다. 특히 ML의 경우 특별히 제작된 추론 칩인 AWS Inferentia로 시작했습니다. 현재 우리는 수천억 개의 매개변수가 포함된 모델을 갖춘 대규모 생성 AI 애플리케이션에 특별히 최적화된 Amazon EC2 Inf2 인스턴스를 갖춘 2세대 AWS Inferentia를 사용하고 있습니다. Inf1 인스턴스는 클라우드에서 가장 저렴한 추론 비용을 제공하는 동시에 Inf12 인스턴스에 비해 최대 2배 더 높은 처리량과 최대 2배 더 낮은 지연 시간을 제공합니다. 최대 2개의 Inferentia2 칩으로 구동되는 InfXNUMX는 가속기 간 고속 연결이 가능한 유일한 추론 최적화 ECXNUMX 인스턴스이므로 고객은 초대형 모델을 배포하여 성능이나 대기 시간을 희생하지 않고도 더 빠르고 효율적으로(저렴한 비용으로) 추론을 실행할 수 있습니다. 여러 액셀러레이터에 걸쳐 Adobe, Deutsche Telekom 및 Leonardo.ai와 같은 고객은 초기에 훌륭한 결과를 보았고 InfXNUMX에서 대규모로 모델을 배포하게 된 것을 기쁘게 생각합니다.

훈련 측면에서, AWS의 특별히 구축된 ML 훈련 칩인 AWS Trainium으로 구동되는 Trn1 인스턴스는 EFA 네트워킹으로 연결된 여러 서버에 훈련을 배포하도록 최적화되어 있습니다. Ricoh와 같은 고객은 단 며칠 만에 수십억 개의 매개변수를 사용하여 일본 LLM을 교육했습니다. Databricks는 대규모 딥 러닝 모델을 교육하기 위해 Trainium 기반 인스턴스를 통해 가격 대비 성능을 최대 40% 향상시키고 있습니다. 그러나 매주 새롭고 더 유능한 모델이 출시되면서 우리는 계속해서 성능과 규모의 한계를 뛰어넘고 있으며, 이를 발표하게 되어 기쁘게 생각합니다. AWS Trainium2, 수천억에서 수조 개의 매개변수가 있는 훈련 모델에 대해 훨씬 더 나은 가격 성능을 제공하도록 설계되었습니다.. Trainium2는 2세대 Trainium보다 최대 65배 빠른 훈련 성능을 제공해야 하며, EC300 UltraClusters에서 사용할 경우 최대 2엑사플롭스의 집계 컴퓨팅을 제공해야 합니다. 이는 고객이 몇 달이 아닌 몇 주 만에 2억 개의 매개변수 LLM을 교육할 수 있음을 의미합니다. Trainium2의 성능, 규모 및 에너지 효율성은 Anthropic이 AWS에서 모델을 훈련하기로 선택한 이유 중 일부이며 향후 모델에 Trainium2024를 사용할 것입니다. 그리고 우리는 Trainium과 Inferentia 모두를 통해 지속적인 혁신을 위해 Anthropic과 협력하고 있습니다. 우리는 XNUMX년에 첫 번째 TrainiumXNUMX 인스턴스를 고객에게 제공할 것으로 예상합니다.

또한 우리는 ML 실리콘용 소프트웨어 도구 체인을 두 배로 늘려 왔으며, 특히 고객이 Trainium 및 Inferentia에서 최대 성능을 얻을 수 있도록 돕는 소프트웨어 개발 키트(SDK)인 AWS Neuron을 발전시켰습니다. 2019년에 Neuron을 출시한 이후 우리는 컴파일러 및 프레임워크 기술에 상당한 투자를 해 왔으며 현재 Neuron은 Meta의 Llama 2, Databricks의 MPT, Stability AI의 Stable Diffusion을 포함하여 공개적으로 사용 가능한 가장 인기 있는 모델을 다수 지원합니다. 인기 모델 저장소 Hugging Face의 상위 93개 모델 중 100개. Neuron은 PyTorch 및 TensorFlow와 같은 인기 있는 ML 프레임워크에 연결되며 JAX에 대한 지원은 내년 초에 제공될 예정입니다. 고객들은 Neuron을 통해 단 몇 줄의 코드만으로 기존 모델 교육 및 추론 파이프라인을 Trainium 및 Inferentia로 쉽게 전환할 수 있었다고 말합니다.

최고의 ML 칩, 초고속 네트워킹, 가상화 및 대규모 클러스터 선택의 이와 동일한 조합을 제공하는 다른 곳은 없습니다. 따라서 AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway 및 Stability AI와 같이 가장 잘 알려진 생성 AI 스타트업 중 일부가 AWS에서 실행되는 것은 놀라운 일이 아닙니다. 그러나 이 컴퓨팅을 효과적으로 활용하여 LLM 및 기타 FM을 효율적이고 비용 효율적으로 구축, 교육 및 실행하려면 여전히 올바른 도구가 필요합니다. 그리고 이러한 스타트업 중 상당수는 아마존 세이지 메이커 대답입니다. 새로운 독점 모델을 처음부터 구축하고 교육하든, 공개적으로 사용 가능한 많은 모델 중 하나로 시작하든 교육은 복잡하고 비용이 많이 드는 작업입니다. 또한 이러한 모델을 비용 효율적으로 실행하는 것도 쉽지 않습니다. 고객은 대량의 데이터를 확보하고 준비해야 합니다. 여기에는 일반적으로 데이터 정리, 중복 제거, 강화 및 변환 등 많은 수동 작업이 포함됩니다. 그런 다음 GPU/가속기의 대규모 클러스터를 생성 및 유지 관리하고, 클러스터 전체에 모델 훈련을 효율적으로 배포하는 코드를 작성하고, 모델을 자주 검사하고, 일시 중지하고, 검사 및 최적화하고, 클러스터의 하드웨어 문제를 수동으로 개입하고 해결해야 합니다. 이러한 과제 중 상당수는 새로운 것이 아니며 모델 교육 및 배포와 관련된 많은 장벽을 허물고 개발자에게 훨씬 더 쉬운 방법을 제공하기 위해 21년 전에 SageMaker를 출시한 이유 중 일부입니다. 수만 명의 고객이 Amazon SageMaker를 사용하고 있으며 LG AI Research, Perplexity AI, AI180, Hugging Face, Stability AI 등 점점 더 많은 고객이 SageMaker에서 LLM 및 기타 FM을 교육하고 있습니다. 최근에 Technology Innovation Institute(인기 있는 Falcon LLM의 창시자)는 SageMaker에서 공개적으로 사용 가능한 가장 큰 모델인 Falcon XNUMXB를 교육했습니다. 모델 크기와 복잡성이 커짐에 따라 SageMaker의 범위도 커졌습니다.

수년에 걸쳐 우리는 자동 모델 튜닝, 분산 교육, 유연한 모델 배포 옵션, ML OP용 도구, 데이터 준비용 도구, 기능 저장소, 노트북, 원활한 통합 등 획기적인 380개 이상의 기능을 Amazon SageMaker에 추가했습니다. ML 수명주기 전반에 걸친 인간 참여형 평가와 책임 있는 AI를 위한 내장 기능을 갖추고 있습니다. 우리는 SageMaker 고객이 LLM 및 기타 FM을 포함한 모든 모델에 대해 추론을 계속 구축, 교육 및 실행할 수 있도록 빠르게 혁신하고 있습니다. 그리고 우리는 고객이 두 가지 새로운 기능을 통해 대규모 모델을 교육하고 배포하는 것을 더욱 쉽고 비용 효율적으로 만들고 있습니다. 첫째, 훈련을 단순화하기 위해 우리는 소개 아마존 세이지메이커 하이퍼팟 대규모 내결함성 분산 교육에 필요한 더 많은 프로세스를 자동화합니다. (예: 분산 교육 라이브러리 구성, 수천 개의 가속기에 걸쳐 교육 워크로드 확장, 잘못된 인스턴스 감지 및 복구) 교육 속도를 최대 40%까지 향상시킵니다. 결과적으로 Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid 등과 같은 고객은 SageMaker HyperPod를 사용하여 모델을 구축, 교육 또는 발전시키고 있습니다. 두번째, 지연 시간을 줄이면서 추론을 더욱 비용 효과적으로 수행할 수 있는 새로운 기능을 도입합니다. 이제 SageMaker는 고객이 동일한 인스턴스에 여러 모델을 배포하여 컴퓨팅 리소스를 공유할 수 있도록 지원하여 추론 비용을 평균 50% 절감합니다. 또한 SageMaker는 추론 요청을 처리하는 인스턴스를 적극적으로 모니터링하고 사용 가능한 인스턴스에 따라 요청을 지능적으로 라우팅하여 평균적으로 20% 더 낮은 추론 지연 시간을 달성합니다. Conjecture, Salesforce 및 Slack은 이러한 추론 최적화로 인해 이미 호스팅 모델에 SageMaker를 사용하고 있습니다.

스택의 중간 계층: Amazon Bedrock은 새로운 모델과 새로운 기능을 추가하여 고객이 생성 AI 애플리케이션을 더욱 쉽게 안전하게 구축하고 확장할 수 있도록 지원합니다.

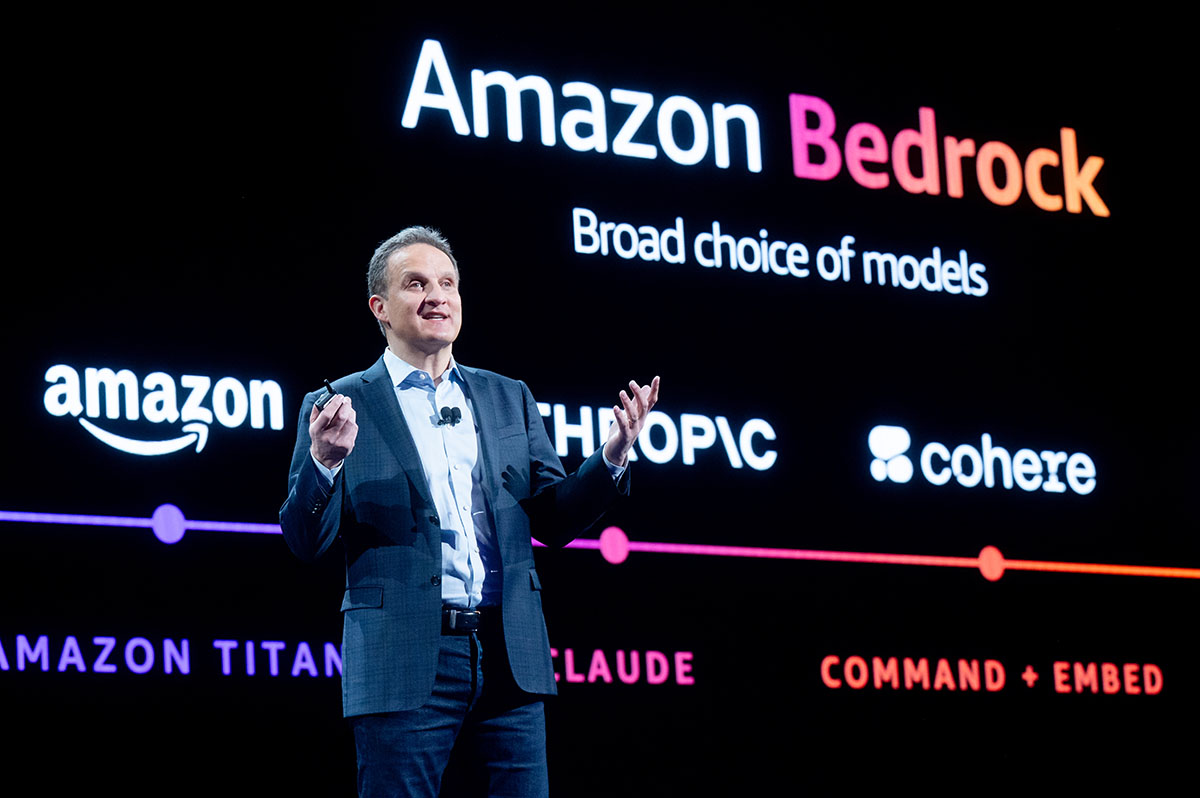

많은 고객이 자체 LLM 및 기타 FM을 구축하거나 공개적으로 사용 가능한 옵션을 다양하게 발전시키겠지만, 많은 고객은 이를 위해 리소스와 시간을 소비하고 싶어하지 않습니다. 이들에게 스택의 중간 계층은 이러한 모델을 서비스로 제공합니다. 여기서 우리의 솔루션은, 아마존 기반암를 통해 고객은 Anthropic, Stability AI, Meta, Cohere, AI21 및 Amazon의 업계 최고의 모델 중에서 선택하고, 자체 데이터로 이를 사용자 정의하고, 이전에 사용했던 것과 동일한 주요 보안, 액세스 제어 및 기능을 모두 활용할 수 있습니다. AWS에서는 모두 관리형 서비스를 통해 이루어집니다. 우리는 XNUMX월 말에 Amazon Bedrock을 정식 출시했으며 고객 반응은 매우 긍정적이었습니다. 전 세계와 거의 모든 업계의 고객이 Amazon Bedrock을 사용하게 되어 기쁘게 생각합니다. adidas는 개발자가 "시작" 정보부터 심층적인 기술 질문에 이르기까지 모든 것에 대해 빠른 답변을 얻을 수 있도록 지원합니다. Booking.com은 생성 AI를 사용하여 모든 고객을 위한 맞춤형 여행 추천을 작성할 계획입니다. Bridgewater Associates는 차트 생성, 재무 지표 계산 및 결과 요약을 지원하는 LLM 기반 투자 분석 도우미를 개발하고 있습니다. Carrier는 고객이 에너지 소비를 줄이고 탄소 배출을 줄일 수 있도록 보다 정확한 에너지 분석과 통찰력을 제공하고 있습니다. Clariant는 R&D 프로세스를 가속화하고 영업팀의 회의 준비를 지원하며 고객 이메일을 자동화할 수 있도록 내부 생성 AI 챗봇을 통해 팀원의 역량을 강화하고 있습니다. GoDaddy는 생성 AI를 사용하여 웹사이트를 구축하고 공급업체를 찾고 고객과 연결하는 등 고객이 온라인에서 쉽게 비즈니스를 설정할 수 있도록 지원하고 있습니다. Lexis Nexis Legal & Professional은 Lexis+ AI 대화형 검색, 요약, 문서 초안 작성 및 분석 기능을 통해 변호사의 법률 업무를 혁신하고 생산성을 높이고 있습니다. Nasdaq은 의심스러운 거래에 대한 조사 작업 흐름을 자동화하고 금융 범죄 방지 및 감시 역량을 강화하는 데 도움을 주고 있습니다. 이 모든 것, 그리고 더 많은 다양한 생성 AI 애플리케이션이 AWS에서 실행되고 있습니다.

Amazon Bedrock의 모멘텀에 대해 기대하고 있지만 아직은 초기 단계입니다. 고객과 협력하면서 우리가 확인한 것은 모든 사람이 빠르게 움직이고 있지만 생성 AI의 진화는 거의 매일 발생하는 새로운 옵션과 혁신을 통해 빠른 속도로 계속되고 있다는 것입니다. 고객은 다양한 사용 사례나 다양한 데이터 세트에 더 잘 작동하는 다양한 모델이 있다는 것을 알고 있습니다. 일부 모델은 요약에 적합하고, 다른 모델은 추론 및 통합에 적합하며, 또 다른 모델은 정말 멋진 언어 지원을 제공합니다. 그리고 이미지 생성, 검색 사용 사례 등이 있으며 모두 독점 모델과 누구나 공개적으로 사용할 수 있는 모델에서 나옵니다. 그리고 알 수 없는 것이 너무 많은 시대에는 적응 능력이 아마도 가장 귀중한 도구일 것입니다. 모든 것을 지배하는 하나의 모델은 없을 것입니다. 그리고 확실히 모든 사람이 사용하는 모델을 제공하는 하나의 기술 회사가 아닙니다. 고객은 다양한 모델을 시험해 봐야 합니다. 동일한 사용 사례 내에서 둘 사이를 전환하거나 결합할 수 있어야 합니다. 이는 그들이 모델 제공자를 실제로 선택해야 함을 의미합니다(지난 10일간의 사건을 통해 더욱 명확해졌습니다). 이것이 우리가 Amazon Bedrock을 발명한 이유이고, 이것이 고객에게 그토록 깊은 반향을 불러일으키는 이유이며, API 호출처럼 쉽게 다양한 모델을 구축(및 전환)할 수 있도록 지속적으로 혁신하고 빠르게 반복하고 최신 기술을 적용하는 이유입니다. 모든 개발자의 손에 모델 맞춤화를 제공하고 고객을 안전하게 보호하고 데이터를 비공개로 유지합니다. 고객이 생성 AI 애플리케이션을 더욱 쉽게 구축하고 확장할 수 있게 해주는 몇 가지 새로운 기능을 소개하게 되어 기쁘게 생각합니다.

- Anthropic Claude 2.1, Meta Llama 2 70B 및 Amazon Titan 제품군 추가로 모델 선택 범위가 확대되었습니다. 초기에도 고객은 다양한 목적에 어떤 모델을 사용할지 결정하기 위해 다양한 모델을 학습하고 실험하고 있습니다. 그들은 최신 모델을 쉽게 시험해 볼 수 있기를 원하고 어떤 기능과 기능이 자신의 사용 사례에 가장 적합한 결과와 비용 특성을 제공하는지 테스트할 수 있기를 원합니다. Amazon Bedrock을 사용하면 고객은 새 모델에서 단 한 번의 API 호출만 하면 됩니다. 고객이 지난 몇 달 동안 경험한 가장 인상적인 결과 중 일부는 다음과 같은 LLM에서 나왔습니다. Anthropic의 클로드 모델는 높은 수준의 신뢰성과 예측 가능성을 유지하면서 정교한 대화 및 콘텐츠 생성부터 복잡한 추론까지 광범위한 작업에 탁월합니다. 고객들은 Claude가 다른 FM에 비해 유해한 출력을 생성할 가능성이 훨씬 적고, 대화하기 쉽고, 조종이 용이하므로 개발자가 더 적은 노력으로 원하는 출력을 얻을 수 있다고 보고합니다. Anthropic의 최첨단 모델인 Claude 2는 GRE 읽기 및 쓰기 시험에서 90번째 백분위수 이상의 점수를 얻었으며 마찬가지로 정량적 추론에서도 마찬가지입니다. 그리고 이제 새로 출시된 Claude 2.1 모델을 Amazon Bedrock에서 사용할 수 있습니다. Claude 2.1은 업계 최고의 200K 토큰 컨텍스트 창(Claude 2 컨텍스트의 2.0배), 환각 비율 감소, 매우 긴 컨텍스트 길이에서도 정확성의 대폭 향상 등 기업을 위한 핵심 기능을 제공합니다. Claude 2.1에는 최종 사용자에게 더 나은 경험을 제공하는 모델 지침인 개선된 시스템 프롬프트도 포함되어 있으며 프롬프트 및 완료 비용도 25% 절감됩니다.

Meta의 공개적으로 사용 가능한 Llama 2 모델의 관리형 버전을 사용하려는 점점 더 많은 고객을 위해 Amazon Bedrock은 Llama 2 13B를 제공합니다. Llama 2 70B를 추가합니다. Llama 2 70B는 언어 모델링, 텍스트 생성, 대화 시스템과 같은 대규모 작업에 적합합니다. 공개적으로 사용 가능한 Llama 모델은 30천만 번 이상 다운로드되었으며 고객은 Amazon Bedrock이 인프라에 대해 걱정하거나 팀에 깊은 ML 전문 지식을 보유할 필요가 없는 관리형 서비스의 일부로 이를 제공한다는 점을 좋아합니다. 또한 이미지 생성을 위해 Stability AI는 널리 사용되는 텍스트-이미지 모델 제품군을 제공합니다. Stable Diffusion XL 1.0(SDXL 1.0)은 이들 중 가장 발전된 버전으로, 이제 Amazon Bedrock에서 일반적으로 사용할 수 있습니다.. 이 인기 있는 이미지 모델의 최신 버전은 정확도가 향상되고 사실적이며 해상도가 높아졌습니다.

고객들도 이용하고 있다 아마존 타이탄 다양한 사용 사례에 뛰어난 경제성과 함께 강력한 기능을 제공하기 위해 AWS에서 생성하고 사전 훈련한 모델입니다. Amazon은 비즈니스 전반에 걸쳐 사용하는 기술인 ML 및 AI 분야에서 25년의 실적을 보유하고 있으며 모델 구축 및 배포에 대해 많은 것을 배웠습니다. 우리는 모델을 훈련하는 방법과 이를 위해 사용할 데이터를 신중하게 선택했습니다. 우리는 우리 모델이나 그 결과물이 다른 사람의 저작권을 침해한다는 주장에 대해 고객을 면책합니다. 우리는 올해 XNUMX월에 첫 번째 Titan 모델을 출시했습니다. 타이탄 텍스트 라이트—현재 일반적으로 사용 가능—챗봇, 텍스트 요약, 카피라이팅과 같은 사용 사례를 위한 간결하고 비용 효율적인 모델이며, 세부 조정도 필요합니다. Titan Text Express—현재 일반 공급 가능—더 광범위하며 개방형 텍스트 생성 및 대화 채팅과 같은 광범위한 텍스트 기반 작업에 사용할 수 있습니다. 우리는 고객이 사용 사례 및 비즈니스 요구 사항에 따라 정확성, 성능 및 비용을 최적화할 수 있는 기능을 제공하기 위해 이러한 텍스트 모델 옵션을 제공합니다. Nexxiot, PGA Tour 및 Ryanair와 같은 고객은 두 가지 Titan Text 모델을 사용하고 있습니다. 또한 검색 사용 사례 및 개인화를 위한 임베딩 모델인 Titan Text Embeddings도 있습니다. Nasdaq과 같은 고객은 Titan Text Embeddings를 사용하여 Nasdaq IR Insight의 기능을 향상시켜 지속 가능성, 법률 및 회계 팀을 위한 9,000개 이상의 글로벌 기업 문서에서 통찰력을 생성하는 훌륭한 결과를 확인하고 있습니다. 그리고 우리는 시간이 지남에 따라 Titan 제품군에 더 많은 모델을 계속 추가할 것입니다. 새로운 임베딩 모델인 Titan Multimodal Embeddings을 소개합니다., 이미지와 텍스트(또는 둘의 조합)를 입력으로 사용하여 사용자를 위한 다중 모드 검색 및 추천 경험을 제공합니다. 그리고 우리는 새로운 텍스트-이미지 모델인 Amazon Titan Image Generator 소개. Titan Image Generator를 사용하면 광고, 전자 상거래, 미디어 및 엔터테인먼트와 같은 업계의 고객이 텍스트 입력을 사용하여 사실적인 스튜디오 품질의 이미지를 대량으로 저렴한 비용으로 생성할 수 있습니다. 우리는 고객이 Titan 모델에 어떻게 반응하는지 기대하고 있으며 앞으로도 계속 혁신할 것이라고 기대하실 수 있습니다.

- 독점 데이터를 사용하여 생성 AI 애플리케이션을 안전하게 맞춤화할 수 있는 새로운 기능: Amazon Bedrock의 가장 중요한 기능 중 하나는 모델을 사용자 정의하는 것이 얼마나 쉬운가입니다. 생성 AI가 핵심 차별화 요소인 데이터를 만나는 지점이기 때문에 이는 고객에게 정말 흥미로운 일이 됩니다. 그러나 데이터를 안전하게 유지하고, 데이터를 지속적으로 제어하고, 모델 개선 사항을 비공개로 유지하는 것이 정말 중요합니다. 이를 수행할 수 있는 몇 가지 방법이 있으며 Amazon Bedrock은 여러 모델에 걸쳐 가장 광범위한 사용자 정의 옵션을 제공합니다. 첫 번째는 미세 조정입니다. Amazon Bedrock에서 모델을 미세 조정하는 것은 쉽습니다. 모델을 선택하기만 하면 Amazon Bedrock이 해당 모델의 복사본을 만듭니다. 그런 다음 Amazon Simple Storage Service(Amazon S3)에 저장한 몇 가지 레이블이 지정된 예(예: 일련의 좋은 질문-답변 쌍)를 가리키면 Amazon Bedrock이 "점증적으로 훈련"합니다(복사된 모델에 새 정보를 추가). 이러한 예를 바탕으로 더 관련성이 높고 맞춤화된 응답을 제공하는 더 정확하고 비공개적인 미세 조정 모델이 탄생했습니다. Cohere Command, Meta Llama 2, Amazon Titan Text(Lite 및 Express), Amazon Titan Multimodal Embeddings 및 Amazon Titan Image Generator의 미리 보기에 대한 미세 조정이 일반적으로 제공된다는 소식을 발표하게 되어 기쁘게 생각합니다. 그리고 Anthropic과의 협력을 통해 AWS 고객에게 모델 사용자 정의 및 최첨단 모델 Claude의 미세 조정을 위한 고유한 기능에 대한 조기 액세스를 곧 제공할 예정입니다.

비즈니스에 맞게 LLM 및 기타 FM을 사용자 정의하는 두 번째 기술은 검색 증강 생성(RAG)입니다. 이를 통해 문서 저장소, 데이터베이스 및 API를 포함한 여러 소스의 데이터로 프롬프트를 강화하여 모델의 응답을 사용자 정의할 수 있습니다. 지난 XNUMX월, 우리는 RAG 기능인 Amazon Bedrock용 지식 베이스를 도입했습니다. 이 기능은 모델을 독점 데이터 소스에 안전하게 연결하여 더 많은 정보로 프롬프트를 보완함으로써 애플리케이션이 보다 관련성이 높고 상황에 맞으며 정확한 응답을 제공할 수 있도록 해줍니다. 기술 자료 이제 전체 RAG 워크플로우를 수행하는 API와 함께 일반 공급됩니다. 프롬프트를 보강하는 데 필요한 텍스트를 가져오는 것부터 모델에 프롬프트를 보내는 것, 응답을 반환하는 것까지. 기술 자료는 Amazon OpenSearch Service 및 Pinecone 및 Redis Enterprise Cloud(Amazon Aurora 및 MongoDB 벡터 지원 예정)와 같은 기타 널리 사용되는 데이터베이스를 포함하여 모델이 RAG에 대한 이 데이터에 액세스하는 데 사용하는 데이터의 수치 표현(임베딩)을 저장하는 벡터 기능을 갖춘 데이터베이스를 지원합니다. 곧).

Amazon Bedrock에서 모델을 사용자 정의할 수 있는 세 번째 방법은 지속적인 사전 교육을 이용하는 것입니다. 이 방법을 사용하면 모델은 도메인별 언어 및 용어를 학습하기 위해 일반적인 언어 이해를 위한 원래의 사전 훈련을 기반으로 구축됩니다. 이 접근 방식은 레이블이 지정되지 않은 도메인별 정보를 많이 보유하고 있으며 LLM이 자신의 세계(및 비즈니스)에 고유한 언어, 구문, 약어, 개념, 정의 및 전문 용어를 이해할 수 있도록 하려는 고객을 위한 것입니다. 상당히 적은 양의 데이터를 사용하는 미세 조정과 달리 대규모 데이터 세트(예: 수천 개의 텍스트 문서)에 대해 지속적인 사전 학습이 수행됩니다. 이제 Amazon Bedrock에서 Titan Text Lite 및 Titan Text Express용 사전 훈련 기능을 사용할 수 있습니다.

- 일반 가용성 Amazon Bedrock용 에이전트 시스템, 데이터 소스 및 회사 지식을 사용하여 다단계 작업을 실행하는 데 도움이 됩니다. LLM은 대화를 나누고 콘텐츠를 생성하는 데 능숙하지만 고객은 애플리케이션에서 다음과 같은 기능을 수행할 수 있기를 원합니다. do 조치를 취하고, 문제를 해결하고, 다양한 시스템과 상호 작용하여 여행 예약, 보험금 청구, 교체 부품 주문과 같은 다단계 작업을 완료하는 등의 작업도 가능합니다. 그리고 Amazon Bedrock이 이 과제를 해결하는 데 도움을 줄 수 있습니다. 에이전트를 통해 개발자는 모델을 선택하고 "당신은 쾌활한 고객 서비스 에이전트입니다" 및 "재고 시스템에서 제품 가용성을 확인하십시오"와 같은 몇 가지 기본 지침을 작성하고 선택한 모델을 올바른 데이터 소스 및 엔터프라이즈 시스템(예: CRM)으로 지정합니다. 또는 ERP 애플리케이션), 몇 가지 AWS Lambda 함수를 작성하여 API를 실행합니다(예: ERP 인벤토리에서 항목의 가용성 확인). Amazon Bedrock은 자동으로 요청을 분석하고 선택한 모델의 추론 기능을 사용하여 요청을 논리적 순서로 분류하여 필요한 정보, 호출할 API, 단계를 완료하거나 작업을 해결하기 위해 호출할 시기를 결정합니다. 이제 정식 출시되어 상담원은 제품 가용성에 대한 고객 질문에 답변하는 것부터 주문을 받는 것까지 대부분의 비즈니스 작업을 계획하고 수행할 수 있으며, 개발자는 기계 학습, 엔지니어 프롬프트, 모델 교육 또는 시스템 수동 연결에 익숙할 필요가 없습니다. Bedrock은 이 모든 작업을 안전하고 비공개적으로 수행하며 Druva 및 Athene과 같은 고객은 이미 이를 사용하여 생성 AI 애플리케이션 개발의 정확성과 속도를 향상시키고 있습니다.

- 도입 Amazon Bedrock용 가드레일 따라서 사용 사례 요구 사항과 책임 있는 AI 정책에 따라 보호 조치를 적용할 수 있습니다. 고객은 AI 애플리케이션과의 상호 작용이 안전한지 확인하고, 유해하거나 공격적인 언어를 피하고, 비즈니스와 관련성을 유지하고, 책임감 있는 AI 정책을 준수하기를 원합니다. 가드레일을 사용하면 고객은 피해야 할 주제를 지정할 수 있으며, Amazon Bedrock은 제한된 범주에 속하는 질문에 대해 승인된 응답만 사용자에게 제공합니다. 예를 들어, 투자 조언 제공을 피하고 부적절한 콘텐츠(예: 증오심 표현 및 폭력)를 제거하도록 온라인 뱅킹 애플리케이션을 설정할 수 있습니다. 2024년 초에는 고객이 모델 응답에서 개인 식별 정보(PII)를 수정할 수도 있습니다. 예를 들어, 고객이 콜센터 상담원과 상호 작용한 후 기록 보관을 위해 고객 서비스 대화가 요약되는 경우가 많으며, 가드레일은 해당 요약에서 PII를 제거할 수 있습니다. Guardrails는 Amazon Bedrock의 모델(미세 조정 모델 포함) 및 Amazon Bedrock용 에이전트와 함께 사용할 수 있으므로 고객은 모든 생성 AI 애플리케이션에 일관된 수준의 보호를 제공할 수 있습니다.

스택의 최상위 계층: 지속적인 혁신을 통해 더 많은 사용자가 제너레이티브 AI에 액세스할 수 있게 되었습니다.

스택의 최상위 계층에는 직장에서 생성적 AI를 활용할 수 있도록 LLM 및 기타 FM을 활용하는 애플리케이션이 있습니다. 생성 AI가 이미 판도를 바꾸고 있는 분야 중 하나는 코딩입니다. 작년에 우리는 거의 실시간으로 코드 제안 및 권장 사항을 생성하여 애플리케이션을 더 빠르고 안전하게 구축하는 데 도움이 되는 Amazon CodeWhisperer를 출시했습니다. Accenture, Boeing, Bundesliga, The Cigna Group, Kone 및 Warner Music Group과 같은 고객은 CodeWhisperer를 사용하여 개발자 생산성을 높이고 있으며 Accenture는 최대 50,000명의 소프트웨어 개발자와 IT 전문가가 Amazon CodeWhisperer를 사용할 수 있도록 지원하고 있습니다. 우리는 가능한 한 많은 개발자가 생성 AI의 생산성 이점을 얻을 수 있기를 원합니다. 이것이 바로 CodeWhisperer가 모든 개인에게 무료로 권장 사항을 제공하는 이유입니다.

그러나 AI 코딩 도구는 개발자의 삶을 더 쉽게 만드는 데 많은 도움이 되지만 내부 코드 베이스, 내부 API, 라이브러리, 패키지 및 클래스에 대한 지식이 부족하여 생산성 이점이 제한됩니다. 이에 대해 생각하는 한 가지 방법은 새로운 개발자를 고용하면 그들이 세계 최고 수준이라 할지라도 모범 사례와 코드를 이해하기 전까지는 회사에서 그다지 생산적이지 않을 것이라는 것입니다. 오늘날의 AI 기반 코딩 도구는 신입 개발자와 같습니다. 이를 돕기 위해 우리는 최근 새로운 기능을 미리 선보였습니다. 사용자 정의 기능 고객의 내부 코드 베이스를 안전하게 활용하여 보다 관련성이 높고 유용한 코드 권장 사항을 제공하는 Amazon CodeWhisperer에서. 이 기능을 통해 CodeWhisperer는 다음 분야의 전문가입니다. your 코드를 작성하고 더 많은 시간을 절약할 수 있도록 관련성이 높은 권장 사항을 제공합니다. 글로벌 디지털 엔지니어링 및 기업 현대화 회사인 Percious와 함께 수행한 연구에서 우리는 사용자 정의를 통해 개발자가 CodeWhisperer의 일반 기능보다 최대 28% 더 빠르게 작업을 완료하는 데 도움이 된다는 사실을 발견했습니다. 이제 의료 기술 회사의 개발자는 CodeWhisperer에게 "고객 ID와 관련된 MRI 이미지를 가져와서 이미지 분류기를 통해 실행"하여 이상 현상을 감지하도록 요청할 수 있습니다. CodeWhisperer는 코드 베이스에 액세스할 수 있기 때문에 MRI 이미지 및 고객 ID의 가져오기 위치를 포함하는 훨씬 더 관련성 있는 제안을 제공할 수 있습니다. CodeWhisperer는 사용자 정의를 완전히 비공개로 유지하며 기본 FM은 이를 교육에 사용하지 않아 고객의 귀중한 지적 재산을 보호합니다. AWS는 모든 사람에게 이와 같은 기능을 제공하는 유일한 주요 클라우드 제공업체입니다.

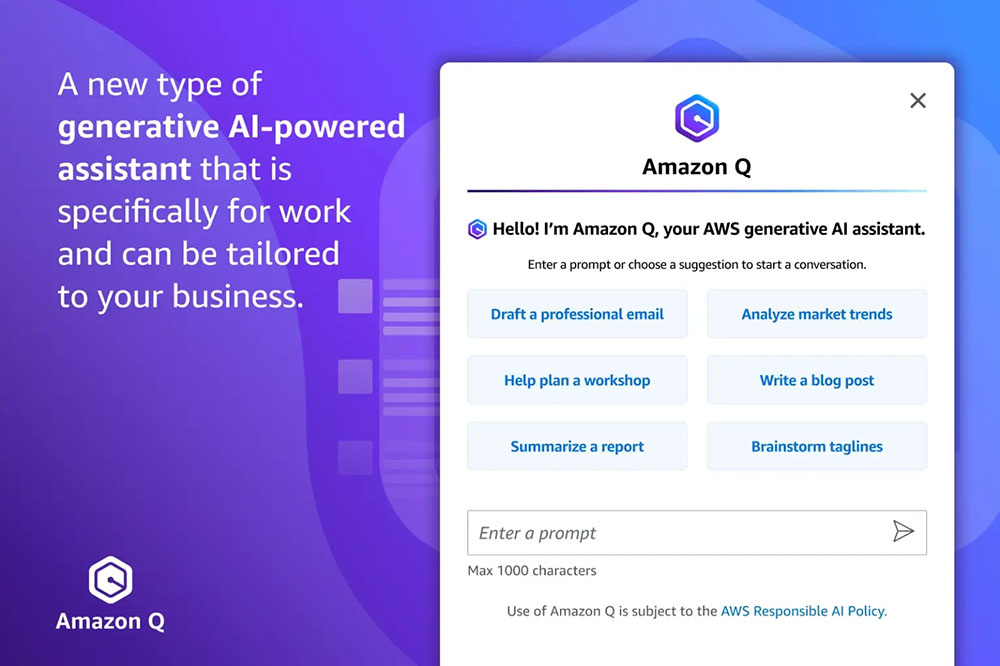

도입 아마존Q, 업무에 최적화된 생성적 AI 기반 비서

생성적 AI를 직접 사용하는 사람은 개발자뿐만이 아닙니다. 수백만 명의 사람들이 생성적 AI 채팅 애플리케이션을 사용하고 있습니다. 이 분야에서 초기 공급자가 수행한 작업은 소비자에게 흥미롭고 매우 유용하지만 많은 면에서 직장에서 제대로 작동하지 않습니다. 그들의 일반적인 지식과 능력은 훌륭하지만 귀하의 회사, 데이터, 고객, 운영 또는 비즈니스를 알지 못합니다. 그것은 그들이 당신을 도울 수 있는 정도를 제한합니다. 그들은 또한 귀하가 어떤 일을 하는지, 누구와 함께 일하는지, 어떤 정보를 사용하는지, 무엇에 액세스할 수 있는지 등 귀하의 역할에 대해 많이 알지 못합니다. 이러한 제한 사항은 이러한 보조자가 회사의 개인 정보에 액세스할 수 없고 회사에서 이러한 액세스 권한을 부여하는 데 필요한 데이터 개인 정보 보호 및 보안 요구 사항을 충족하도록 설계되지 않았기 때문에 이해할 수 있습니다. 사후에 보안을 강화하고 그것이 잘 작동할 것이라고 기대하는 것은 어렵습니다. 우리는 모든 조직의 모든 사람이 일상 업무에서 생성 AI를 안전하게 사용할 수 있도록 하는 더 나은 방법이 있다고 생각합니다.

W소개하게 되어 기쁘게 생각합니다 Amazon Q는 업무용으로 특별히 제작되었으며 비즈니스에 맞게 맞춤화할 수 있는 새로운 유형의 생성적 AI 기반 비서입니다. Q는 긴급한 질문에 대한 빠르고 관련성 있는 답변을 얻고, 문제를 해결하고, 콘텐츠를 생성하고, 회사의 정보 저장소, 코드 및 엔터프라이즈 시스템에 있는 데이터와 전문 지식을 사용하여 조치를 취하는 데 도움을 줄 수 있습니다. Amazon Q와 채팅하면 작업을 간소화하고 의사 결정 속도를 높이며 직장에서 창의성과 혁신을 촉발하는 데 도움이 되는 즉각적이고 관련성 있는 정보와 조언이 제공됩니다. Amazon Q는 안전하고 비공개적으로 구축되었으며 기존 자격 증명, 역할 및 권한을 이해하고 존중하며 이 정보를 사용하여 상호 작용을 개인화할 수 있습니다. 사용자가 Q 없이 특정 데이터에 액세스할 수 있는 권한이 없으면 Q를 사용하여 해당 데이터에 액세스할 수도 없습니다. 우리는 처음부터 엄격한 기업 고객의 요구 사항을 충족하도록 Amazon Q를 설계했습니다. 고객의 콘텐츠 중 어떤 것도 기본 모델을 개선하는 데 사용되지 않습니다.

Amazon Q는 전문 비서입니다. AWS 기반 구축을 위해: AWS에서 애플리케이션과 워크로드를 구축, 배포 및 운영하는 방식을 혁신할 수 있도록 17년간의 AWS 지식과 경험을 바탕으로 Amazon Q를 교육했습니다. Amazon Q에는 AWS Management Console 및 설명서, IDE(CodeWhisperer를 통해), Slack 또는 기타 채팅 앱의 팀 채팅방에 채팅 인터페이스가 있습니다. Amazon Q는 새로운 AWS 기능을 탐색하고, 더 빠르게 시작하고, 익숙하지 않은 기술을 배우고, 솔루션 설계, 문제 해결, 업그레이드 등을 수행하는 데 도움을 줄 수 있습니다. Amazon Q는 잘 설계된 AWS 패턴, 모범 사례, 문서 및 솔루션 구현 분야의 전문가입니다. 새로운 AWS 전문 보조원으로 수행할 수 있는 작업의 몇 가지 예는 다음과 같습니다.

- AWS 기능, 서비스 및 솔루션에 대한 명확한 답변과 지침을 얻으십시오. Amazon Q에 "Amazon Bedrock용 에이전트에 대해 알려주세요"라고 요청하면 Q가 기능에 대한 설명과 관련 자료에 대한 링크를 제공합니다. 또한 AWS 서비스 작동 방식(예: "DynamoDB 테이블의 확장 제한은 무엇입니까?", "Redshift 관리형 스토리지란 무엇입니까?")이나 다양한 솔루션을 가장 잘 설계하는 방법(예: "이벤트 중심 아키텍처 구축을 위한 모범 사례는 무엇입니까?"). 그리고 Amazon Q는 간결한 답변을 모아 항상 출처를 인용(및 링크)합니다.

- 귀하의 사용 사례에 가장 적합한 AWS 서비스를 선택하고 빠르게 시작하십시오. Amazon Q에 문의하세요. “AWS에서 웹 앱을 구축하는 방법은 무엇입니까? ” 그리고 다음과 같은 잠재적인 서비스 목록을 제공합니다. AWS 증폭, AWS 람다및 Amazon EC2 각각의 장점과 함께. 여기에서 Q가 요구 사항, 기본 설정 및 제약 조건을 이해하도록 도와 옵션 범위를 좁힐 수 있습니다(예: "컨테이너를 사용하려면 이들 중 어느 것이 가장 좋을까요?" 또는 "관계형 데이터베이스를 사용해야 할까요, 비관계형 데이터베이스를 사용해야 할까요?") "). "어떻게 시작하나요?"로 마무리하세요. Amazon Q에서는 몇 가지 기본 단계를 간략하게 설명하고 추가 리소스를 안내해 드립니다.

- 컴퓨팅 리소스 최적화: Amazon Q는 Amazon EC2 인스턴스를 선택하는 데 도움을 줄 수 있습니다. "최고 성능의 게임 앱에 대한 비디오 인코딩 워크로드를 배포하는 데 적합한 EC2 인스턴스를 찾도록 도와주세요"라고 요청하면 Q는 각 제안에 대한 이유와 함께 인스턴스 제품군 목록을 제공합니다. 또한 워크로드에 가장 적합한 선택을 찾는 데 도움이 되는 후속 질문을 얼마든지 할 수 있습니다.

- 코드 디버깅, 테스트 및 최적화에 대한 지원을 받으세요. IDE에서 코딩하는 동안 오류가 발생하면 Amazon Q에 "내 코드에 IO 오류가 있습니다. 수정 사항을 제공할 수 있습니까?"라고 말하여 도움을 요청할 수 있습니다. 그러면 Q가 코드를 생성해 줄 것입니다. 제안이 마음에 들면 Amazon Q에 애플리케이션에 수정 사항을 추가하도록 요청할 수 있습니다. Amazon Q는 IDE에 있으므로 작업 중인 코드를 이해하고 수정 사항을 삽입할 위치를 알고 있습니다. Amazon Q는 코드에 삽입하여 실행할 수 있는 단위 테스트(“선택한 함수에 대한 단위 테스트 작성”)를 생성할 수도 있습니다. 마지막으로 Amazon Q는 더 높은 성능을 위해 코드를 최적화하는 방법을 알려줄 수 있습니다. Q에게 "선택한 DynamoDB 쿼리 최적화"를 요청하면 코드에 대한 이해를 바탕으로 한 번의 클릭으로 구현할 수 있는 관련 코드와 함께 수정해야 할 사항에 대한 자연어 제안을 제공합니다.

- 문제 진단 및 해결: AWS Management Console에서 EC2 권한 오류 또는 Amazon S3 구성 오류와 같은 문제가 발생하는 경우 "Amazon Q로 문제 해결" 버튼을 누르기만 하면 오류 유형 및 오류가 있는 서비스에 대한 정보를 사용할 수 있습니다. 수정 사항에 대한 제안을 제공합니다. Amazon Q에 네트워크 문제 해결을 요청할 수도 있습니다(예: "SSH를 사용하여 EC2 인스턴스에 연결할 수 없는 이유는 무엇입니까?"). 그러면 Q는 엔드투엔드 구성을 분석하고 진단을 제공합니다(예: "이 인스턴스는 프라이빗 서브넷에 있는 것으로 보이므로 퍼블릭 접근성을 설정해야 할 수도 있습니다.")

- 즉시 새로운 코드 기반을 구축하세요. IDE에서 Amazon Q와 채팅하면 소프트웨어 구축에 대한 전문 지식과 코드에 대한 이해가 결합되어 강력한 결합이 됩니다! 이전에는 다른 사람에게서 프로젝트를 인수했거나 팀에 처음 합류한 경우 코드와 문서를 수동으로 검토하여 작동 방식과 기능을 이해하는 데 몇 시간을 소비해야 할 수도 있었습니다. 이제 Amazon Q는 IDE의 코드를 이해하므로 Amazon Q에 코드 설명을 요청하면("이 애플리케이션의 기능과 작동 방식에 대한 설명 제공") Q가 어떤 서비스가 작동하는지와 같은 세부 정보를 제공합니다. 코드 사용 및 다양한 기능의 기능(예: Q는 "이 애플리케이션은 Python Flask 및 AWS Lambda를 사용하여 기본 지원 티켓 시스템을 구축하고 있습니다."와 같이 대답하고 계속해서 각 핵심 기능, 구현 방법, 그리고 훨씬 더).

- 기능 백로그를 더 빠르게 삭제하세요. Amazon Q에 애플리케이션에 기능을 추가하는 전체 프로세스의 대부분을 안내하고 자동화하도록 요청할 수도 있습니다. 아마존 코드카탈리스트, 팀을 위한 통합 소프트웨어 개발 서비스입니다. 이렇게 하려면 팀 동료와 마찬가지로 문제 목록에서 Q에 백로그 작업을 할당하면 됩니다. 그러면 Q는 기능을 구축하고 구현하는 방법에 대한 단계별 계획을 생성합니다. 계획을 승인하면 Q는 코드를 작성하고 코드 검토를 통해 제안된 변경 사항을 제시합니다. 재작업(필요한 경우)을 요청하고 승인 및/또는 배포할 수 있습니다!

- 짧은 시간 안에 코드를 업그레이드하세요. 대부분의 개발자는 실제로 새 코드를 작성하고 새 애플리케이션을 구축하는 데 시간의 일부만 소비합니다. 그들은 유지 관리 및 업그레이드와 같이 고통스럽고 지루한 영역에 훨씬 더 많은 주기를 소비합니다. 언어 버전 업그레이드를 받으세요. 업그레이드하는 데 몇 달, 심지어 몇 년이 걸리고 개발자 시간이 수천 시간이 걸리기 때문에 많은 고객이 이전 버전의 Java를 계속 사용하고 있습니다. 이를 미루면 실제 비용과 위험이 따릅니다. 즉, 성능 향상을 놓치고 보안 문제에 취약해집니다. 우리는 Amazon Q가 여기서 게임 체인저가 될 수 있다고 생각하며, Amazon Q 코드 변환, 이러한 무거운 작업을 많이 제거하고 애플리케이션을 업그레이드하는 데 걸리는 시간을 며칠에서 몇 분으로 줄일 수 있는 기능입니다. IDE에서 업데이트하려는 코드를 열고 Amazon Q에 코드를 "/변환"하도록 요청하면 됩니다. Amazon Q는 애플리케이션의 전체 소스 코드를 분석하고 대상 언어 및 버전으로 코드를 생성하고 테스트를 실행하여 최신 언어 버전의 보안 및 성능 향상을 실현할 수 있도록 도와줍니다. 최근 Amazon 개발자로 구성된 소규모 팀이 Amazon Q Code Transformation을 사용하여 단 이틀 만에 1,000개의 프로덕션 애플리케이션을 Java 8에서 Java 17로 업그레이드했습니다. 신청당 평균 소요시간은 10분 미만이었습니다. 현재 Amazon Q 코드 변환은 Java 8 또는 Java 11에서 Java 17로 Java 언어 업그레이드를 수행합니다. 다음으로(그리고 곧) .NET Framework를 크로스 플랫폼 .NET으로 변환하는 기능이 제공될 예정입니다(향후 더 많은 변환 예정). .

Amazon Q는 귀하의 비즈니스 전문가입니다: Amazon Q를 비즈니스 데이터, 정보 및 시스템에 연결하여 모든 것을 종합하고 맞춤형 지원을 제공하여 사람들이 문제를 해결하고, 콘텐츠를 생성하고, 비즈니스와 관련된 조치를 취하도록 도울 수 있습니다. Amazon Q를 비즈니스에 도입하는 것은 쉽습니다. Amazon S40, Microsoft 3, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive 및 Zendesk와 같은 널리 사용되는 엔터프라이즈 시스템에 대한 365개 이상의 기본 제공 커넥터가 있습니다. 또한 내부 인트라넷, 위키, 실행 서적에 연결할 수 있으며 Amazon Q SDK를 사용하면 원하는 내부 애플리케이션에 대한 연결을 구축할 수 있습니다. 이러한 리포지토리에 Amazon Q를 지정하면 비즈니스가 "증가"되어 회사를 독특하게 만드는 의미론적 정보를 캡처하고 이해하게 됩니다. 그런 다음 회사 전체의 직원이 대화형 인터페이스와 상호 작용할 수 있도록 친숙하고 간단한 Amazon Q 웹 애플리케이션을 얻습니다. 또한 Amazon Q는 자격 증명 공급자에 연결하여 사용자, 사용자의 역할 및 액세스가 허용된 시스템을 이해하므로 사용자는 자세하고 미묘한 질문을 하고 볼 수 있는 권한이 있는 정보만 포함된 맞춤형 결과를 얻을 수 있습니다. Amazon Q는 제공하는 자료와 지식에 정확하고 충실한 답변과 통찰력을 생성하며 민감한 주제를 제한하거나 키워드를 차단하거나 부적절한 질문과 답변을 필터링할 수 있습니다. 다음은 비즈니스의 새로운 전문 비서로 수행할 수 있는 작업에 대한 몇 가지 예입니다.

- 비즈니스 데이터 및 정보를 기반으로 명확하고 관련성이 높은 답변을 얻으세요. 직원들은 이전에 모든 종류의 소스에서 검색해야 했던 모든 것에 대해 Amazon Q에 물어볼 수 있습니다. "로고 사용에 대한 최신 지침은 무엇입니까?" 또는 "회사 신용카드를 신청하려면 어떻게 해야 합니까?"라고 질문하면 Amazon Q가 찾은 모든 관련 콘텐츠를 종합하여 빠른 답변과 관련 링크를 제공합니다. 소스(예: 브랜드 포털 및 로고 저장소, 회사 T&E 정책 및 카드 애플리케이션)

- 일상적인 커뮤니케이션을 간소화합니다. 요청만 하면 Amazon Q에서 콘텐츠를 생성하고(“이 문서에 설명된 제품을 알리는 블로그 게시물과 3개의 소셜 미디어 헤드라인 생성”) 요약을 생성하고(“작업 항목의 글머리 기호 목록이 포함된 회의 기록 요약 작성”)을 생성할 수 있습니다. ), 이메일 업데이트를 제공하고(“인도 고객을 위한 XNUMX분기 교육 프로그램을 강조하는 이메일 초안 작성”) 회의 구성을 돕습니다(“최신 고객 만족도 보고서에 관해 이야기할 회의 안건 만들기”).

- 작업 완료: Amazon Q는 직원이 티켓 제출과 같은 반복적인 작업에 소비하는 시간을 줄여 특정 작업을 완료하는 데 도움을 줄 수 있습니다. Amazon Q에게 "Slack의 새로운 가격 제안에 대한 고객 피드백 요약"을 요청한 다음 Q에게 해당 정보를 가져오고 Jira에서 티켓을 열어 마케팅 팀에 업데이트하도록 요청하세요. Q에게 "이 통화 기록 요약"을 요청한 다음 "Salesforce에서 고객 A에 대한 새 사례 열기"를 요청할 수 있습니다. Amazon Q는 Zendesk 및 Service Now와 같은 다른 널리 사용되는 작업 자동화 도구를 지원합니다.

Amazon Q는 Amazon QuickSight에 있습니다. 와 QuickSight의 Amazon Q, AWS의 비즈니스 인텔리전스 서비스를 통해 사용자는 대시보드에 "지난달 주문량이 왜 증가했나요?"와 같은 질문을 할 수 있습니다. 증가에 영향을 미친 요인에 대한 시각화 및 설명을 얻을 수 있습니다. 또한 분석가는 Amazon Q를 사용하여 "월별 지역별 매출을 누적 막대 차트로 표시"와 같은 간단한 프롬프트를 통해 대시보드를 구축하는 데 걸리는 시간을 며칠에서 몇 분으로 줄일 수 있습니다. Q는 해당 다이어그램을 가지고 바로 돌아오며 이를 쉽게 대시보드에 추가하거나 Q와 추가 채팅을 통해 시각화를 개선할 수 있습니다(예: "막대형 차트를 Sankey 다이어그램으로 변경" 또는 "지역 대신 국가 표시"). 또한 QuickSight의 Amazon Q를 사용하면 기존 대시보드를 더 쉽게 사용하여 비즈니스 이해관계자에게 알리고, 주요 통찰력을 추출하고, 데이터 스토리를 사용하여 의사결정을 단순화할 수 있습니다. 예를 들어, 사용자는 Amazon Q에 "고위 리더십과 함께 비즈니스 검토를 위해 지난 한 달 동안 비즈니스가 어떻게 변화했는지에 대한 스토리를 작성하세요"라고 요청할 수 있으며, 몇 초 만에 Amazon Q는 시각적으로 설득력 있고 설득력 있는 데이터 기반 스토리를 제공합니다. 완전히 사용자 정의 가능합니다. 이러한 스토리는 조직 전체에서 안전하게 공유되어 이해관계자를 조정하고 더 나은 결정을 내리는 데 도움이 됩니다.

Amazon Q는 Amazon Connect에 있습니다. 당사의 연락 센터 서비스인 Amazon Connect에서 Amazon Q는 고객 서비스 상담원이 더 나은 고객 서비스를 제공하도록 돕습니다. Amazon Q는 상담원이 고객을 위한 정보를 얻기 위해 일반적으로 사용하는 지식 리포지토리를 활용합니다. 그런 다음 상담원은 Connect에서 직접 Amazon Q와 채팅하여 문서를 직접 검색할 필요 없이 고객 요청에 더 빠르게 응답하는 데 도움이 되는 답변을 얻을 수 있습니다. 그리고 초고속 답변을 위해 Amazon Q와 채팅하는 것은 훌륭하지만 고객 서비스에서는 너무 빠른 것은 없습니다. 그렇기 때문에 아마존 Q 인 커넥트 상담원과의 실시간 고객 대화를 프롬프트로 전환하고 자동으로 상담원에게 가능한 응답, 제안 조치 및 리소스 링크를 제공합니다. 예를 들어, Amazon Q는 고객이 예약을 변경하기 위해 렌터카 회사에 연락하는 것을 감지하고, 회사의 변경 수수료 정책이 어떻게 적용되는지 신속하게 전달하기 위해 에이전트에 대한 응답을 생성하고, 업데이트에 필요한 단계를 에이전트에게 안내할 수 있습니다. 예약.

Amazon Q는 AWS 공급망에 속합니다(출시 예정): 공급망 통찰력 서비스인 AWS Supply Chain에서 Amazon Q는 공급 및 수요 계획자, 재고 관리자 및 거래 파트너가 잠재적인 재고 부족 또는 재고 과잉 위험을 요약 및 강조하여 공급망을 최적화하고 문제 해결을 위한 시나리오를 시각화하는 데 도움을 줍니다. 사용자는 공급망 데이터에 대해 Amazon Q에 "무엇", "왜" 및 "만약"에 대한 질문을 하고 복잡한 시나리오와 다양한 공급망 결정 간의 균형을 통해 채팅할 수 있습니다. 예를 들어, 고객이 "배송 지연의 원인은 무엇이며, 배송 속도를 높이려면 어떻게 해야 합니까?"라고 질문할 수 있습니다. 이에 Amazon Q는 “귀하의 주문 중 90%가 동부 해안에 있는데, 남동부의 큰 폭풍으로 인해 24시간 지연이 발생하고 있습니다. 마이애미가 아닌 뉴욕 항구로 배송하면 배송이 빨라지고 비용이 50% 절감됩니다.”

우리 고객은 생성 AI를 빠르게 채택하고 있습니다. AWS에서 획기적인 모델을 훈련하고, Amazon Bedrock을 사용하여 기록적인 속도로 생성 AI 애플리케이션을 개발하고 있으며, Amazon Q와 같은 획기적인 애플리케이션을 조직 전반에 배포하고 있습니다. 최근 발표된 AWS 고객에게 스택의 모든 계층에 더 많은 성능, 선택권 및 혁신을 제공합니다. re:Invent에서 제공하는 모든 기능의 결합된 영향은 흥미롭고 의미 있는 목표를 달성하기 위한 중요한 이정표입니다. 우리는 규모와 기술 능력에 관계없이 모든 고객이 제너레이티브 AI에 액세스할 수 있도록 만들고 있습니다. 가능합니다.

제품 자료

저자에 관하여

스와미 시바수브라마니아어 AWS의 데이터 및 기계 학습 담당 부사장입니다. 이 역할에서 Swami는 모든 AWS 데이터베이스, 분석, AI 및 기계 학습 서비스를 감독합니다. 그의 팀의 임무는 조직이 데이터를 저장, 액세스, 분석, 시각화 및 예측할 수 있는 완전한 종단 간 데이터 솔루션으로 작동하도록 돕는 것입니다.

스와미 시바수브라마니아어 AWS의 데이터 및 기계 학습 담당 부사장입니다. 이 역할에서 Swami는 모든 AWS 데이터베이스, 분석, AI 및 기계 학습 서비스를 감독합니다. 그의 팀의 임무는 조직이 데이터를 저장, 액세스, 분석, 시각화 및 예측할 수 있는 완전한 종단 간 데이터 솔루션으로 작동하도록 돕는 것입니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :있다

- :이다

- :아니

- :어디

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- 능력

- 능력

- 할 수 있는

- 소개

- 위의

- 가속

- 가속 된

- 가속기

- Accenture

- ACCESS

- 접근성

- 얻기 쉬운

- 회계

- 정확한

- 얻다

- 가로질러

- 동작

- 행위

- 활발히

- 실제로

- 각색하다

- 더하다

- 추가

- 첨가

- 또한

- 추가

- 또한

- 추가

- 추가

- 아디다스

- 어도비 벽돌

- 채택

- 많은

- 전진하는

- 이점

- 장점

- 광고

- 조언

- 후

- 반대

- 의사 일정

- 에이전트

- 자치령 대표

- 골재

- ...전에

- AI

- AI 및 머신 러닝

- 인공 지능 봇봇

- 인공 지능 연구

- AI 기반

- 일직선으로하다

- All

- 수

- 수

- 따라

- 이미

- 또한

- 항상

- 아마존

- 아마존 코드위스퍼러

- Amazon EC2

- 아마존 오픈서치 서비스

- 아마존 퀵 사이트

- 아마존 세이지 메이커

- Amazon Web Services

- 양

- 금액

- an

- 분석

- 분석자

- 애널리스트

- 분석

- 분석하다

- 복수

- 및

- 알리다

- 알림

- 발표

- 이상

- 답변

- 답변

- 인류

- 어떤

- 누군가

- 아무것도

- API를

- API

- 앱

- 등장하다

- 어플리케이션

- 어플리케이션

- 신청

- 감사

- 접근

- 승인

- 인가 된

- 앱

- Apr

- 있군요

- 지역

- 지역

- 틀림없이

- 약

- AS

- 문의

- 원조

- 조수

- 비서

- 관련

- 관계

- At

- 증가하다

- 증강 된

- 증강

- 오로라

- 허가

- 자동화

- 오토마타

- Automatic

- 자동적으로

- 자동화

- 자동차

- 유효성

- 가능

- 평균

- 피하기

- 떨어져

- AWS

- AWS 인 페렌 시아

- AWS 람다

- AWS 관리 콘솔

- 뒤로

- 은행

- 바

- 장벽

- 기지

- 기반으로

- 기본

- BE

- 때문에

- 된다

- 된

- 시작

- 믿으세요

- 혜택

- BEST

- 모범 사례

- 더 나은

- 사이에

- 큰

- 억원

- 수십억

- 블록

- 블록

- 블로그

- 보잉

- 볼트

- 예약

- Booking.com

- 도서

- 두

- 바닥

- 경계

- 상표

- 흩어져

- 휴식

- 가져

- 가져

- 빌드

- 건물

- 빌드

- 내장

- 내장

- 사업

- 비즈니스 인텔리전스

- 사업

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- 단추

- by

- 전화

- 콜센터

- CAN

- 얻을 수 있습니다

- 기능

- 능력

- 수

- 생산 능력

- 캡처

- 자동차

- 탄소

- 탄소 배출

- 카드

- 면밀히

- 케이스

- 가지 경우

- 카테고리

- 일으키는

- 센터

- 어떤

- 확실히

- 체인

- 도전

- 과제

- 이전 단계로 돌아가기

- 변경

- 체인저

- 변경

- 변화

- 특성

- 거래차트

- 차트

- 대화방

- 채팅 봇

- 잡담

- 채팅

- 검사

- 칩

- 칩

- 선택

- 왼쪽 메뉴에서

- 선택

- 선택

- 주장

- 수업

- 청소관련

- 선명한

- 클릭

- 클라우드

- 클라우드 인프라

- 클러스터

- 클러스터링

- 연안

- 암호

- 코드베이스

- 코드 검토

- 코딩

- 협력

- 협동

- COM

- 결합

- 결합

- 결합 된

- 결합

- 왔다

- 제공

- 오는

- COMING SOON

- 소통

- 커뮤니케이션

- 기업

- 회사

- 회사

- 비교

- 강요하는

- 완전한

- 완전히

- 복잡한

- 복잡성

- 포괄적 인

- 계산

- 개념

- 구성

- 구성

- 어림짐작

- 연결하기

- 연결

- 연결

- 입/출력 라인

- 커넥트

- 일관된

- 콘솔에서

- 제약

- 소비자

- 소비

- CONTACT

- 연락 센터

- 용기

- 함유량

- 컨텐츠 생성

- 문맥

- 문맥

- 계속

- 계속

- 계속

- 지속

- 제어

- 컨트롤

- 대화

- 이야기 잘하는

- 대화

- 저작권

- 카피 라이팅

- 핵심

- 비용

- 비용 효율적인

- 비용

- 국가

- 콕스

- 만들

- 만든

- 창의력

- 크리에이터

- 신용

- 크레디트 카드

- 범죄

- CRM

- 고객

- 고객 경험

- 고객 만족

- 고객 센터

- 고객

- 맞춤형

- 사용자 정의

- 사용자 정의

- 사용자 정의

- 절단

- 주기

- 매일

- 계기반

- 대시 보드

- 데이터

- 데이터 준비

- 데이터 프라이버시

- 데이터 프라이버시 및 보안

- 데이터 세트

- 데이터 중심

- 데이터베이스

- 데이터베이스

- 일

- 매일

- 일

- 의사 결정

- 결정

- 깊은

- 깊은 학습

- 깊이

- 정의

- 도

- 지연

- 배달하다

- 배송

- 배달

- 제공

- 수요

- 민주화

- 의존

- 배포

- 배포

- 배치

- 전개

- 깊이

- 설명

- 기술 된

- 설명

- 설계

- 원하는

- 상세한

- 세부설명

- 검색

- 결정

- 도이체 텔레콤

- 개발자

- 개발자

- 개발

- 개발

- 진단

- 다이얼로그

- 대화

- DID

- 다른

- 방송

- 디지털

- 직접

- 배포하다

- 분산

- 분산 교육

- 배포

- do

- 문서

- 선적 서류 비치

- 서류

- 하지

- 하지 않습니다

- 하기

- 한

- 말라

- 급회전

- 아래 (down)

- 드라이브

- 두

- 중복

- 지속

- e

- 전자 상거래

- 마다

- 초기의

- 쉽게

- 용이하게

- 동쪽

- 쉽게

- 경제적

- 판

- 효과적으로

- 효율성

- 효율적으로

- 노력

- 중

- 그렇지 않으면

- 이메일

- 이메일

- 배출

- 직원

- 능력을 키우다

- 힘을 실어

- 가능

- 가능

- 부호화

- end

- 끝으로 종료

- 에너지

- 에너지 소비

- 기사

- 엔지니어링

- 강화

- 향상

- 우리의 영적인 행로를

- Enterprise

- 엔터프라이즈 급

- 기업

- 엔터테인먼트

- 전체의

- 봉투

- 대

- ERP

- 오류

- 오류

- 평가

- 조차

- 이벤트

- EVER

- 모든

- 사람

- 모두

- 진화

- 진화시키다

- 예

- 예

- 흥분한

- 흥미 진진한

- 실행

- 행정부

- 현존하는

- 널찍한

- 기대

- 신속히 처리하다

- 비싼

- 경험

- 경험

- 체험

- 전문가

- 전문적 지식

- 설명

- 탐험

- 급행

- 구조

- 페이스메이크업

- 사실

- 요인

- 꽤

- 충실한

- 떨어지다

- 익숙한

- 가족

- 가족

- FAST

- 빠른

- 결함

- 특색

- 특징

- 보수

- 피드백

- 를

- 철하기

- 필터링

- 최종적으로

- 금융

- Find

- 발견

- finds

- 끝

- 마무리

- 먼저,

- 수정

- 융통성있는

- 집중

- 따라

- 럭셔리

- 소비자 용

- 앞으로

- 발견

- Foundation

- 사

- 분수

- 뼈대

- 프레임 워크

- 무료

- 자주

- 친절한

- 에

- 기능

- 추가

- 미래

- 경기

- 게임 체인저

- 노름

- 일반

- 일반적으로

- 생성

- 생성

- 생성

- 세대

- 생성적인

- 제너레이티브 AI

- 발전기

- 얻을

- 점점

- 주기

- 글로벌

- 글로벌 디지털

- Go

- 골

- 가는

- 좋은

- 구글

- GPU

- GPU

- 큰

- 육로

- 획기적인

- 그룹

- 성장하는

- 성장한

- 지도

- 안내

- 가이드 라인

- 했다

- 손

- 무슨 일이

- 하드

- 하드웨어

- 해로운

- 미워

- 있다

- 데

- 헤드 라인

- 건강 관리

- 무거운

- 무거운 리프팅

- 도움

- 도움이

- 도움이

- 여기에서 지금 확인해 보세요.

- 높은

- 더 높은

- 최고

- 강조

- 고도로

- 고용

- 그의

- 호스팅

- 진료 시간

- 방법

- How To

- 그러나

- HTTPS

- 수백

- i

- ID

- 정체성

- 통합 인증

- 식별자

- if

- 영상

- 형상

- 즉시

- 영향

- 구현

- 구현

- 구현

- import

- 중대한

- 인상

- 개선

- 개선하는

- 개량

- in

- 포함

- 포함

- 포함

- 증가

- 증가

- 증가

- 표시

- 개인

- 산업

- 산업

- 업계 최고의

- 영향을받은

- 정보

- 통보

- 정보

- 인프라

- 받아 들여 쓰다

- 혁신

- 혁신

- 혁신

- 혁신적인

- 입력

- 입력

- 통찰력

- 통찰력

- 예

- 를 받아야 하는 미국 여행자

- 학회

- 명령

- 보험

- 완성

- 지적인

- 지적 재산권

- 인텔리전스

- 의도하다

- 상호 작용하는

- 상호 작용

- 인터렉티브

- 상호 연결된

- 인터페이스

- 내부의

- 개입하다

- 으로

- 소개

- 소개

- 소개

- 발명

- 목록

- 사다

- 조사

- 투자

- 투자

- 투자

- 참여

- 문제

- IT

- 그

- 일본제

- 특수 용어

- 자바

- JPG

- 다만

- 딱 하나만

- 유지

- 유지

- 유지

- 키

- 주요 분야

- 키워드

- 키트(SDK)

- 알아

- 지식

- 알고있다

- 실험실

- 결핍

- 언어

- 넓은

- 대규모

- 가장 큰

- 성

- 작년

- 늦은

- 숨어 있음

- 최근

- 시작

- 진수

- 변호사

- 층

- 레이어

- Leadership

- 지도

- 배우다

- 배운

- 배우기

- 이용약관

- 적게

- 수

- 레벨

- 이점

- 레버리지

- 렉시 스 넥시 스

- LG

- 도서관

- wifecycwe

- 리프팅

- 처럼

- 아마도

- 한계

- 제한된

- 제한

- 라인

- LINK

- 모래밭

- 명부

- 살고있다

- 삶

- 야마

- LLM

- 위치한

- 위치

- 논리

- 심벌 마크

- 긴

- 오랫동안 서있는

- 롯

- 애정

- 낮은

- 절감

- 가장 낮은

- 기계

- 기계 학습

- 만든

- 유지하다

- 유지 보수

- 유지

- 주요한

- 확인

- 제작

- 유튜브 영상을 만드는 것은

- 관리

- 구축

- 관리자

- 조작

- 수작업

- 수동으로

- .

- 마케팅

- 자료

- 재료

- 최고

- XNUMX월..

- me

- 의미있는

- 방법

- 미디어

- 소개

- 회의

- 회의

- 만족

- 회원

- 호수

- 메타

- 방법

- 마이애미

- Microsoft

- 중간

- 수도

- 획기적 사건

- 회의록

- 미스...

- Mission

- ML

- 모델

- 모델링

- 모델

- 기세

- MongoDB의

- 모니터

- 달

- 개월

- 배우기

- 가장

- 가장 인기 많은

- 움직이는

- MRI

- 많은

- 여러

- 음악

- 절대로 필요한 것

- my

- name

- 폭이 좁은

- 나스닥

- 자연의

- 가까운

- 필요한

- 필요

- 필요

- 필요

- 그물

- 네트워크

- 네트워킹

- 신제품

- 뉴욕

- 새로운

- 다음 것

- 니트로

- 아니

- 지금

- 번호

- 엔비디아

- of

- 오프

- 공격

- 제공

- 제공

- 제공

- 자주

- 이전

- on

- 일단

- ONE

- 사람

- 온라인

- 온라인 뱅킹

- 만

- 열 수

- 운영

- 행정부

- 최적화

- 최적화

- 최적화

- 옵션

- or

- 명령

- 조직

- 조직

- 실물

- 기타

- 기타

- 우리의

- 아웃

- 개요

- 출력

- 출력

- 위에

- 공급 과다

- 압도적으로

- 자신의

- 평화

- 패키지

- 아픈

- 쌍

- 매개 변수

- 매개 변수

- 부품

- 파트너

- 부품

- 과거

- 패턴

- 중지

- 사람들

- 용

- 수행

- 성능

- 수행

- 수행하다

- 허가

- 권한

- 사람

- 개인

- 개인

- 몸소

- PGA 투어

- 구문

- 장소

- 계획

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- ...을 더한

- 포인트 적립

- 정책

- 인기 문서

- 긍정적인

- 가능한

- 게시하다

- 가능성

- 힘

- powered

- 강한

- 실용적인

- 거의

- 사례

- 정확한

- 예측

- 예측

- 환경 설정

- 준비

- Prepare

- 제시

- 대통령

- 키를 눌러

- 키를 눌러

- 시사

- 이전에

- 가격

- 가격

- 일차

- 개인 정보 보호

- 개인 정보 및 보안

- 사설

- 개인 정보

- 문제

- 문제

- 방법

- 프로세스

- 처리

- 생산

- 프로덕트

- 생산

- 생산적인

- 생산력

- 링크를

- 전문가

- 프로그램

- 프로젝트

- 프롬프트

- 재산

- 소유권

- 보호

- 보호

- 제공

- 공급자

- 제공

- 제공

- 제공

- 공개

- 공개적으로

- 목적

- 푸시

- 미는

- 놓다

- 입고

- Python

- 파이 토치

- Q3

- 정량적 인

- 문제

- 문의

- 빠른

- 빨리

- 아주

- R&D

- 범위

- 빠른

- 빠르게

- 거주비용

- RE

- 읽기

- 현실

- 실시간

- 현실적인

- 실현

- 깨달은

- 정말

- 수확

- 이유

- 최근에

- 추천

- 추천

- 기록

- 감소

- 감소

- 감소

- 수정하다

- 지방

- 출시

- 관련된

- 신뢰성

- 유적

- 제거

- 제거

- 수리

- 반복적 인

- 바꿔 놓음

- 댓글

- 신고

- 저장소

- 의뢰

- 요청

- 필수

- 요구조건 니즈

- 연구

- 예약

- 리저브

- 분해능

- 공명하다

- 제품 자료

- 점

- 응답

- 응답

- 응답

- 응답

- 책임

- 얽매다

- 한정된

- 결과

- 결과

- 반환

- 리뷰

- 리뷰

- 연락해주세요

- 위험

- 직위별

- 역할

- 객실

- 노선

- 통치

- 달리기

- 달리는

- 통로

- 희생하는

- 가장 안전한 따뜻함

- 보호

- 안전하게

- 현자

- 판매

- 영업

- 같은

- 만족도

- 찜하기

- 속담

- 규모

- 스케일링

- 시나리오

- 범위

- 할퀴다

- SDK

- 원활한

- 검색

- 둘째

- 두 번째 세대

- 초

- 안전해야합니다.

- 안전하게

- 보안

- 참조

- 보고

- 본

- 고르다

- 선택된

- 선택

- 전송

- 연장자

- 고위 리더십

- 민감한

- XNUMX월

- 순서

- 연속

- 서버

- 서비스

- 서비스

- 세트

- 설정

- 몇몇의

- 공유

- 공유

- 배

- 짧은

- 영상을

- 측면

- 상당한

- 규소

- 비슷하게

- 단순, 간단, 편리

- 단순화

- 간단히

- 이후

- SIX

- 크기

- 느슨하게

- 작은

- So

- 사회적

- 소셜 미디어

- 소프트웨어

- 소프트웨어 개발자

- 소프트웨어 개발

- 소프트웨어 개발 키트

- 해결책

- 솔루션

- 풀다

- 일부

- 어떤 사람

- 무언가

- 곧

- 정교한

- 출처

- 소스 코드

- 지우면 좋을거같음 . SM

- 남동

- 스페이스 버튼

- 불꽃

- 구체적으로

- 연설

- 속도

- 지출

- 안정

- 안정된

- 스택

- 쌓인

- 이해 관계자

- 시작

- 시작 중

- 신생

- 최첨단

- 유지

- 단계

- 단계

- 아직도

- 저장

- 저장

- 상점

- 이야기

- 폭풍

- 이야기

- 유선

- 강하게 하다

- 절박한

- 구조

- 교육과정

- 서브넷

- 실질적인

- 이러한

- 적당한

- 스위트

- 요약

- 개요

- 감독자

- 보충

- 공급 업체

- 공급

- 수요와 공급

- 공급망

- SUPPORT

- 지원

- 확인

- 놀라운

- 감시

- 의심 많은

- 지속 가능성

- 스위치

- 합성하다

- 체계

- 시스템은

- 테이블

- 맞춤형

- 받아

- 소요

- 복용

- 이야기

- 목표

- 태스크

- 작업

- 팀

- 참여 연구원

- 팀

- 테크니컬

- 기술

- 기법

- 기술

- Technology

- 기술 혁신

- 이야기

- 이야기

- 안색

- 수십

- 텐서 흐름

- 술어

- test

- 지원

- 테스트

- 본문

- 보다

- 그

- XNUMXD덴탈의

- 미래

- 세계

- 그들의

- 그들

- 그들 자신

- 그때

- 그곳에.

- Bowman의

- 그들

- 맡은 일

- 일

- 생각

- 제삼

- 이

- 올해

- 그

- 수천

- 세

- 을 통하여

- 도처에

- 처리량

- 표

- 티켓

- 시간

- 시대

- 타이탄

- 에

- 오늘

- 오늘의

- 함께

- 토큰

- 너무

- 했다

- 수단

- 검색을

- 상단

- 이상의 주제

- 둘러보기

- 방향

- 에 대한

- 선로

- 실적 기록

- 트레이딩

- Train

- 훈련 된

- 트레이닝

- 거래 내역

- 성적 증명서

- 변환

- 변환

- 변환

- 변화

- 여행

- 수조

- 여행

- 진정으로

- 믿어

- 시도

- 노력

- 동조

- 결국

- 두

- 유형

- 일반적으로

- 밑에 있는

- 이해

- 이해할 수있는

- 이해

- 이해한다

- 생소한

- 통일

- 유일한

- 단위

- 같지 않은

- 까지

- 업데이트

- 업데이트

- 업그레이드

- 업그레이드

- us

- 용법

- 사용

- 유스 케이스

- 익숙한

- 사용자

- 사용자

- 사용

- 사용

- 가치 있는

- 종류

- 여러

- 버전

- 버전

- 대

- 대단히

- 를 통해

- 바이스

- 부통령

- Video

- 폭력

- 사실상

- 심상

- 시각화

- 시각

- 볼륨

- 취약

- 필요

- Warner

- 워너 뮤직 그룹

- 였다

- 웨이브

- 방법..

- 방법

- we

- 웹

- 웹 응용 프로그램

- 웹 서비스

- 웹 사이트

- 주

- 주

- 환영

- 잘

- 잘 알려진

- 했다

- 뭐

- 언제

- 여부

- 어느

- 동안

- 누구

- why

- 넓은

- 넓은 범위

- 넓은

- 의지

- 창

- 과

- 이내

- 없이

- 작업

- 일

- 워크 플로우

- 일하는

- 일

- 세계

- 세계적 수준의

- 걱정

- 가치

- 겠지

- 쓰다

- 코드 작성

- 쓰기

- year

- 년

- 요크

- 자신의

- 너의

- 젠 데스크

- 제퍼 넷