Fraudedetectie is een belangrijk probleem dat toepassingen heeft in de financiële dienstverlening, sociale media, e-commerce, gaming en andere industrieën. Dit bericht presenteert een implementatie van een oplossing voor fraudedetectie met behulp van het Relational Graph Convolutional Network (RGCN) -model om de waarschijnlijkheid te voorspellen dat een transactie frauduleus is via zowel de transductieve als de inductieve inferentiemodus. U kunt onze implementatie inzetten op een Amazon Sage Maker endpoint als een real-time oplossing voor fraudedetectie, zonder dat er externe grafiekopslag of orkestratie nodig is, waardoor de implementatiekosten van het model aanzienlijk worden verlaagd.

Bedrijven die op zoek zijn naar een volledig beheerde AWS AI-service voor fraudedetectie, kunnen ook gebruikmaken van Amazone fraude detector, die u kunt gebruiken om verdachte online betalingen te identificeren, fraude met nieuwe accounts op te sporen, misbruik van proef- en loyaliteitsprogramma's te voorkomen of detectie van accountovernames te verbeteren.

Overzicht oplossingen

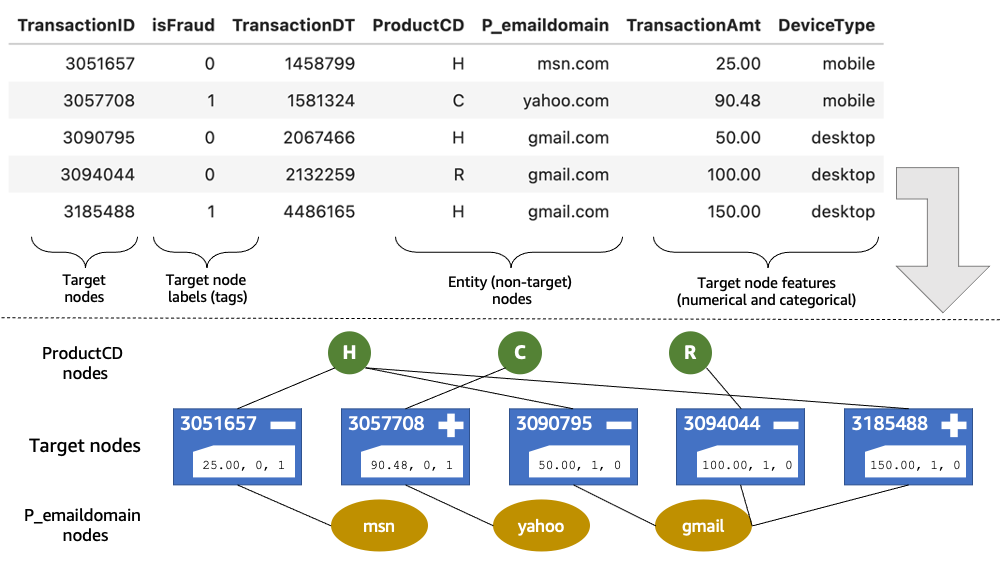

Het volgende diagram beschrijft een voorbeeld van een financieel transactienetwerk dat verschillende soorten informatie bevat. Elke transactie bevat informatie zoals apparaat-ID's, Wi-Fi-ID's, IP-adressen, fysieke locaties, telefoonnummers en meer. We vertegenwoordigen de transactiedatasets door middel van een heterogene grafiek die verschillende soorten knooppunten en randen bevat. Vervolgens wordt het fraudedetectieprobleem behandeld als een knooppuntclassificatietaak op deze heterogene grafiek.

Graph neurale netwerken (GNN's) zijn veelbelovend gebleken bij het aanpakken van fraudedetectieproblemen en presteren beter dan populaire gesuperviseerde leermethoden zoals gradiënt-versterkte beslissingsbomen of volledig verbonden feed-forward-netwerken op benchmarking-datasets. In een typische opstelling voor fraudedetectie wordt tijdens de trainingsfase een GNN-model getraind op een reeks gelabelde transacties. Elke trainingstransactie wordt voorzien van een binair label dat aangeeft of het frauduleus is. Dit getrainde model kan vervolgens worden gebruikt om frauduleuze transacties op te sporen tussen een reeks niet-gelabelde transacties tijdens de inferentiefase. Er zijn twee verschillende manieren van gevolgtrekking: transductieve gevolgtrekking vs. inductieve gevolgtrekking (waarover we later in dit bericht meer zullen vertellen).

Op GNN gebaseerde modellen, zoals RGCN, kunnen profiteren van topologische informatie, waarbij zowel de grafiekstructuur als kenmerken van knooppunten en randen worden gecombineerd om een zinvolle weergave te leren die kwaadaardige transacties onderscheidt van legitieme transacties. RGCN kan effectief leren om verschillende soorten knooppunten en randen (relaties) weer te geven via heterogene inbedding van grafieken. In het voorgaande diagram wordt elke transactie gemodelleerd als een doelknooppunt en worden verschillende entiteiten die aan elke transactie zijn gekoppeld, gemodelleerd als niet-doelknooppunttypen, zoals ProductCD en P_emaildomain. Aan doelknooppunten zijn numerieke en categorische functies toegewezen, terwijl andere knooppunttypen geen kenmerken hebben. Het RGCN-model leert een inbedding voor elk niet-doelknooppunttype. Voor de inbedding van een doelknooppunt wordt een convolutionele bewerking gebruikt om de inbedding te berekenen met behulp van de kenmerken en buurtinbeddingen. In de rest van het bericht gebruiken we de termen GNN en RGCN door elkaar.

Het is de moeite waard om op te merken dat alternatieve strategieën, zoals het behandelen van de niet-doelentiteiten als kenmerken en ze in één keer coderen, vaak onhaalbaar zijn vanwege de grote kardinaliteiten van deze entiteiten. Omgekeerd stelt het GNN-model door ze te coderen als grafiekentiteiten in staat te profiteren van de impliciete topologie in de entiteitsrelaties. Transacties die bijvoorbeeld een telefoonnummer delen met bekende frauduleuze transacties, zijn waarschijnlijk ook frauduleus.

De grafische weergave die door GNN's wordt gebruikt, zorgt voor enige complexiteit bij de implementatie ervan. Dit geldt met name voor toepassingen zoals fraudedetectie, waarbij de weergave van de grafiek tijdens inferentie kan worden uitgebreid met nieuw toegevoegde knooppunten die overeenkomen met entiteiten die niet bekend zijn tijdens modeltraining. Dit inferentiescenario wordt meestal aangeduid als inductieve modus. In tegenstelling tot, transductieve modus is een scenario dat ervan uitgaat dat de grafiekrepresentatie die tijdens modeltraining is gemaakt, niet zal veranderen tijdens inferentie. GNN-modellen worden vaak geëvalueerd in transductieve modus door grafische weergaven te construeren uit een gecombineerde set trainings- en testvoorbeelden, terwijl testlabels worden gemaskeerd tijdens back-propagation. Dit zorgt ervoor dat de weergave van de grafiek statisch is en dat het GNN-model geen implementatie van bewerkingen vereist om de grafiek uit te breiden met nieuwe knooppunten tijdens inferentie. Helaas kan er niet worden uitgegaan van een statische grafiekrepresentatie bij het detecteren van frauduleuze transacties in een real-world setting. Daarom is ondersteuning voor inductieve inferentie vereist bij het inzetten van GNN-modellen voor fraudedetectie in productieomgevingen.

Daarnaast is het in real time opsporen van frauduleuze transacties cruciaal, vooral in businesscases waarbij er maar één kans is om illegale activiteiten te stoppen. Zo kunnen frauduleuze gebruikers zich slechts één keer kwaadaardig gedragen met een account en daarna nooit meer hetzelfde account gebruiken. Realtime inferentie op GNN-modellen introduceert extra complexiteit in de implementatie. Het is vaak nodig om subgraaf-extractiebewerkingen te implementeren om real-time inferentie te ondersteunen. De subgraaf-extractiebewerking is nodig om de inferentielatentie te verminderen wanneer de weergave van de grafiek groot is en het uitvoeren van inferentie op de hele grafiek onbetaalbaar wordt. Een algoritme voor real-time inductieve inferentie met een RGCN-model werkt als volgt:

- Gegeven een batch transacties en een getraind RGCN-model, breidt u de grafische weergave uit met entiteiten uit de batch.

- Wijs inbeddingsvectoren van nieuwe niet-doelknooppunten toe aan de gemiddelde inbeddingsvector van hun respectieve knooppunttype.

- Extraheer een subgraaf veroorzaakt door k-hop out-buurt van de doelknooppunten van de batch.

- Voer gevolgtrekkingen uit op de subgrafiek en retourneer voorspellingsscores voor de doelknooppunten van de batch.

- Schoon de grafiekweergave op door nieuw toegevoegde knooppunten te verwijderen (deze stap zorgt ervoor dat de geheugenvereiste voor modelinferentie constant blijft).

De belangrijkste bijdrage van dit bericht is het presenteren van een RGCN-model dat het real-time inductieve inferentie-algoritme implementeert. U kunt onze RGCN-implementatie inzetten op een SageMaker-eindpunt als een realtime oplossing voor fraudedetectie. Onze oplossing vereist geen externe grafische opslag of orkestratie en verlaagt de implementatiekosten van het RGCN-model voor fraudedetectietaken aanzienlijk. Het model implementeert ook de transductieve inferentiemodus, waardoor we experimenten kunnen uitvoeren om modelprestaties in inductieve en transductieve modi te vergelijken. De modelcode en notitieboekjes met experimenten zijn toegankelijk via de AWS-voorbeelden GitHub-repo.

Dit bericht bouwt voort op het bericht Bouw een op GNN gebaseerde realtime fraudedetectieoplossing met Amazon SageMaker, Amazon Neptune en de Deep Graph Library. Het vorige bericht bouwde een op RGCN gebaseerde real-time oplossing voor fraudedetectie met behulp van SageMaker, Amazone NeptunusEn Diepe grafiekenbibliotheek (DGL). De eerdere oplossing gebruikte een Neptune-database als externe grafiekopslag, vereist AWS Lambda voor orkestratie voor real-time gevolgtrekking, en omvatte alleen experimenten in transductieve modus.

Het RGCN-model dat in dit bericht is geïntroduceerd, implementeert alle bewerkingen van het real-time inductieve inferentie-algoritme met alleen de DGL als afhankelijkheid, en vereist geen externe grafiekopslag of orkestratie voor implementatie.

We evalueren eerst de prestaties van het RGCN-model in transductieve en inductieve modi op een benchmarkdataset. Zoals verwacht zijn de modelprestaties in inductieve modus iets lager dan in transductieve modus. We bestuderen ook het effect van hyperparameter k op modelprestaties. De hyperparameter k bepaalt het aantal hops dat wordt uitgevoerd om een subgrafiek te extraheren in stap 3 van het real-time inferentie-algoritme. Hogere waarden van k zal grotere subgrafieken produceren en kan leiden tot betere inferentieprestaties ten koste van een hogere latentie. Als zodanig voeren we ook timing-experimenten uit om de haalbaarheid van het RGCN-model voor een real-time toepassing te evalueren.

dataset

We maken gebruik van de IEEE-CIS-fraudegegevensset, dezelfde dataset die werd gebruikt in de vorige post. De dataset bevat meer dan 590,000 transactierecords met een binair fraudelabel (de isFraud kolom). De gegevens zijn opgesplitst in twee tabellen: transactie en identiteit. Niet alle transactierecords hebben echter overeenkomstige identiteitsinformatie. We voegen ons bij de twee tafels aan de TransactionID kolom, waardoor we in totaal 144,233 transactierecords hebben. We sorteren de tabel op transactietijdstempel (de TransactionDT kolom) en creëer een 80/20 procentuele verdeling over de tijd, wat resulteert in respectievelijk 115,386 en 28,847 transacties voor training en testen.

Voor meer details over de dataset en hoe deze te formatteren om te voldoen aan de invoervereiste van de DGL, zie Detectie van fraude in heterogene netwerken met Amazon SageMaker en Deep Graph Library.

Grafiek constructie

We maken gebruik van de TransactionID kolom om doelknooppunten te genereren. We gebruiken de volgende kolommen om 11 soorten niet-doelknooppunten te genereren:

card1doorcard6ProductCDaddr1enaddr2P_emaildomainenR_emaildomain

We gebruiken 38 kolommen als categorische kenmerken van doelknooppunten:

M1doorM9DeviceTypeenDeviceInfoid_12doorid_38

We gebruiken 382 kolommen als numerieke kenmerken van doelknooppunten:

TransactionAmtdist1endist2id_01doorid_11C1doorC14D1doorD15V1doorV339

Onze grafiek, opgebouwd uit de trainingstransacties, bevat 217,935 knooppunten en 2,653,878 randen.

Hyperparameters

Andere parameters zijn ingesteld om overeen te komen met de parameters die in het vorige zijn vermeld post. Het volgende fragment illustreert het trainen van het RGCN-model in transductieve en inductieve modi:

Inductieve versus transductieve modus

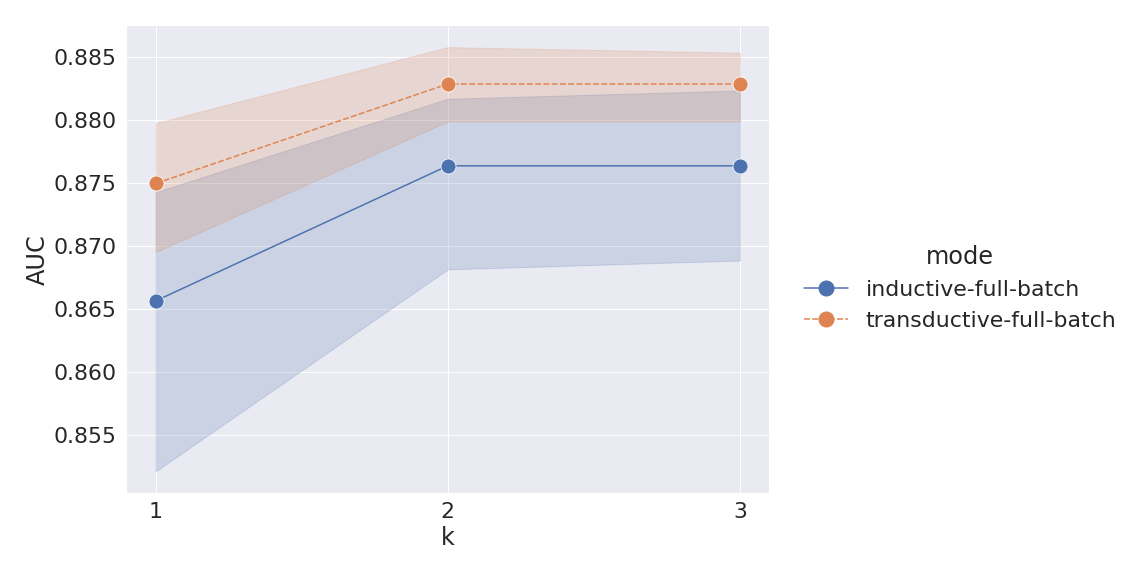

We voeren vijf proeven uit voor inductieve en vijf proeven voor transductieve modus. Voor elke proef trainen we een RGCN-model en slaan het op schijf op, waarbij we 10 modellen verkrijgen. We evalueren elk model op testvoorbeelden terwijl we het aantal hops verhogen (parameter k) gebruikt om een subgrafiek te extraheren voor gevolgtrekking, instelling k tot 1, 2 en 3. We voorspellen op alle testvoorbeelden tegelijk en berekenen de ROC AUC-score voor elke proef. De volgende grafiek toont de gemiddelde en 95% betrouwbaarheidsintervallen van AUC-scores.

We kunnen zien dat de prestaties in de transductieve modus iets hoger zijn dan in de inductieve modus. Voor k=2, gemiddelde AUC-scores voor inductieve en transductieve modi zijn respectievelijk 0.876 en 0.883. Dit wordt verwacht omdat het RGCN-model inbeddingen van alle entiteitsknooppunten in transductieve modus kan leren, inclusief die in de testset. In de inductieve modus kan het model daarentegen alleen de inbedding van entiteitsknooppunten leren die aanwezig zijn in de trainingsvoorbeelden, en daarom moeten sommige knooppunten tijdens de gevolgtrekking gemiddeld worden gevuld. Tegelijkertijd is de prestatiedaling tussen transductieve en inductieve modi niet significant, en zelfs in inductieve modus behaalt het RGCN-model goede prestaties met een AUC van 0.876. We zien ook dat de modelprestaties niet verbeteren voor waarden van k>2. Dit impliceert die instelling k=2 zou een voldoende grote subgraaf extraheren tijdens inferentie, wat resulteert in optimale prestaties. Deze waarneming wordt ook bevestigd door ons volgende experiment.

Het is ook vermeldenswaard dat, voor de transductieve modus, de AUC van ons model van 0.883 hoger is dan de overeenkomstige AUC van 0.870 gerapporteerd in de vorige post. We gebruiken meer kolommen als numerieke en categorische kenmerken van doelknooppunten, wat de hogere AUC-score kan verklaren. We merken ook op dat de experimenten in het vorige bericht slechts één proef hebben uitgevoerd.

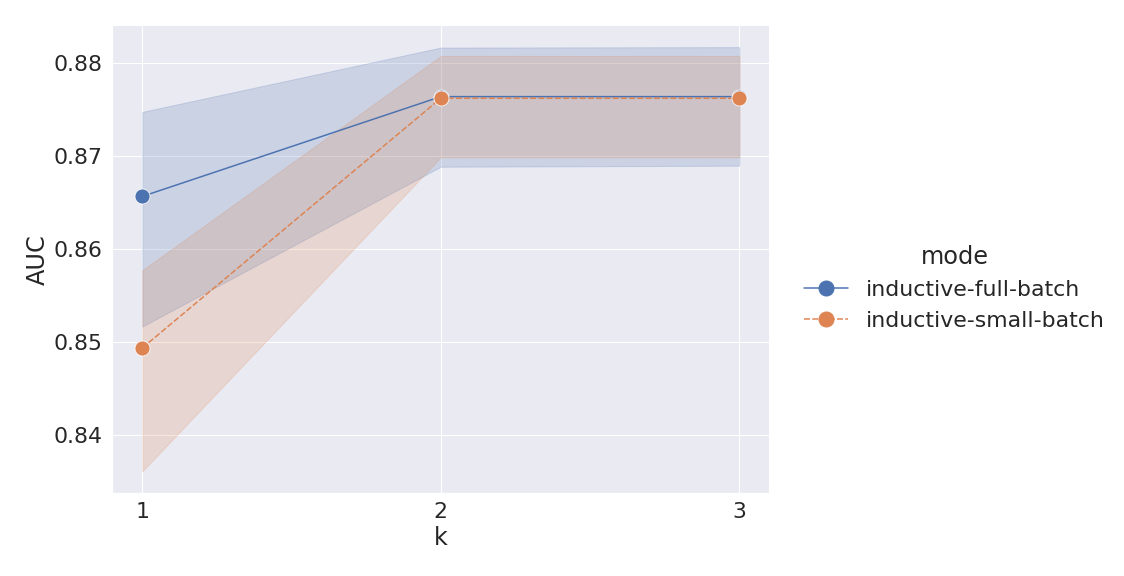

Gevolgtrekking op een kleine batch

Voor dit experiment evalueren we het RGCN-model in een kleine batch-inferentie-instelling. We gebruiken vijf modellen die in het vorige experiment in inductieve modus zijn getraind. We vergelijken de prestaties van deze modellen bij het voorspellen in twee instellingen: volledige en kleine batch-inferentie. Voor volledige batchinferentie voorspellen we op de hele testset, zoals in het vorige experiment is gedaan. Voor deductie van kleine batches voorspellen we in kleine batches door de testset op te delen in 28 batches van gelijke grootte met ongeveer 1,000 transacties in elke batch. We berekenen AUC-scores voor beide instellingen met verschillende waarden van k. De volgende grafiek toont de gemiddelde en 95% betrouwbaarheidsintervallen voor instellingen voor volledige en kleine batch-inferentie.

We observeren die prestatie voor kleine batch-inferentie wanneer k=1 is lager dan voor volledige batch. De prestaties van kleine batch-inferenties komen echter overeen met de volledige batch wanneer k>1. Dit kan worden toegeschreven aan het feit dat er veel kleinere subgrafieken worden geëxtraheerd voor kleine batches. We bevestigen dit door de grootte van subgrafieken te vergelijken met de grootte van de volledige grafiek die is samengesteld uit de trainingstransacties. We vergelijken grafiekgroottes in termen van aantal knooppunten. Voor k=1, de gemiddelde grootte van de subgrafiek voor kleine batchgevolgtrekkingen is minder dan 2% van de trainingsgrafiek. En voor volledige batchgevolgtrekking wanneer k=1, de subgraafgrootte is 22%. Wanneer k=2, subgraafgroottes voor kleine en volledige batchgevolgtrekking zijn respectievelijk 54% en 64%. Ten slotte bereiken subgraafgroottes voor beide inferentie-instellingen 100% voor k=3. Met andere woorden wanneer k>1, wordt de subgrafiek voor een kleine batch voldoende groot, waardoor deductie van kleine batches dezelfde prestaties kan bereiken als deductie van volledige batches.

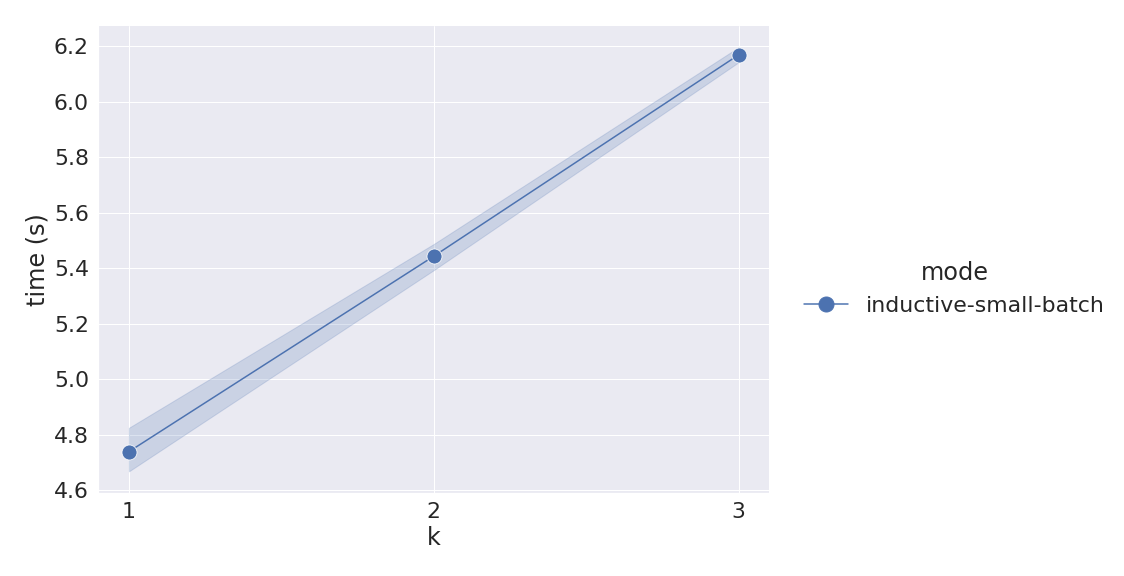

We registreren ook de voorspellingslatentie voor elke batch. We voeren onze experimenten uit op een ml.r5.12xlarge-instantie, maar u kunt een kleinere instantie met 64 GB geheugen gebruiken om dezelfde experimenten uit te voeren. De volgende grafiek toont de gemiddelde en 95% betrouwbaarheidsintervallen van voorspellingslatenties voor kleine batches voor verschillende waarden van k.

De latentie omvat alle vijf stappen van het real-time inductieve inferentie-algoritme. We zien dat wanneer k=2, het voorspellen van 1,030 transacties duurt gemiddeld 5.4 seconden, wat resulteert in een verwerkingscapaciteit van 190 transacties per seconde. Dit bevestigt dat de implementatie van het RGCN-model geschikt is voor real-time fraudedetectie. We merken ook op dat de vorige post leverden geen harde latentiewaarden voor hun implementatie.

Conclusie

Het RGCN-model dat met dit bericht is uitgebracht, implementeert het algoritme voor real-time inductieve gevolgtrekking en vereist geen externe grafische opslag of orkestratie. De parameter k in stap 3 van het algoritme specificeert het aantal uitgevoerde hops om de subgrafiek voor gevolgtrekking te extraheren, en resulteert in een wisselwerking tussen modelnauwkeurigheid en voorspellingslatentie. Wij gebruikten de IEEE-CIS-fraudegegevensset in onze experimenten, en empirisch gevalideerd dat de optimale waarde van parameter k voor deze dataset is 2, met een AUC-score van 0.876 en een voorspellingslatentie van minder dan 6 seconden per 1,000 transacties.

Dit bericht bood een stapsgewijs proces voor het trainen en evalueren van een RGCN-model voor realtime fraudedetectie. De meegeleverde modelklasse implementeert methoden voor de gehele levenscyclus van het model, inclusief serialisatie- en deserialisatiemethoden. Hierdoor kan het model worden gebruikt voor real-time fraudedetectie. U kunt het model trainen als een PyTorch SageMaker-schatter en het vervolgens implementeren op een SageMaker-eindpunt door het volgende te gebruiken notitieboekje als sjabloon. Het eindpunt kan fraude op kleine batches ruwe transacties in realtime voorspellen. Je kan ook gebruiken Amazon SageMaker Inferentie-aanbeveler om het beste instantietype en de beste configuratie voor het inferentie-eindpunt te selecteren op basis van uw workloads.

Voor meer informatie over dit onderwerp en de implementatie raden we u aan om onze scripts zelf te verkennen en te testen. U hebt toegang tot de notebooks en gerelateerde modelklassecode vanuit de AWS-voorbeelden GitHub-repo.

Over de auteurs

Dmitri Bespalov is een Senior Applied Scientist bij het Amazon Machine Learning Solutions Lab, waar hij AWS-klanten in verschillende sectoren helpt om hun AI- en cloudadoptie te versnellen.

Dmitri Bespalov is een Senior Applied Scientist bij het Amazon Machine Learning Solutions Lab, waar hij AWS-klanten in verschillende sectoren helpt om hun AI- en cloudadoptie te versnellen.

Ryan merk is Applied Scientist bij het Amazon Machine Learning Solutions Lab. Hij heeft specifieke ervaring met het toepassen van machine learning op problemen in de zorg en life sciences. In zijn vrije tijd leest hij graag geschiedenis en sciencefiction.

Ryan merk is Applied Scientist bij het Amazon Machine Learning Solutions Lab. Hij heeft specifieke ervaring met het toepassen van machine learning op problemen in de zorg en life sciences. In zijn vrije tijd leest hij graag geschiedenis en sciencefiction.

Yanjun Qi is Senior Applied Science Manager bij het Amazon Machine Learning Solution Lab. Ze innoveert en past machine learning toe om AWS-klanten te helpen hun AI- en cloudadoptie te versnellen.

Yanjun Qi is Senior Applied Science Manager bij het Amazon Machine Learning Solution Lab. Ze innoveert en past machine learning toe om AWS-klanten te helpen hun AI- en cloudadoptie te versnellen.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- in staat

- Over

- misbruik

- versnellen

- toegang

- geraadpleegde

- Account

- nauwkeurigheid

- Bereikt

- het bereiken van

- over

- activiteiten

- toegevoegd

- toevoeging

- Extra

- adressen

- Adoptie

- Voordeel

- AI

- algoritme

- Alles

- toestaat

- alternatief

- Amazone

- Amazon machinaal leren

- Amazone Neptunus

- Amazon Sage Maker

- onder

- en

- Aanvraag

- toepassingen

- toegepast

- Het toepassen van

- ongeveer

- reeks

- toegewezen

- geassocieerd

- uitgegaan van

- aangevuld

- gemiddelde

- AWS

- gebaseerde

- omdat

- wordt

- wezen

- criterium

- benchmarking

- BEST

- Betere

- tussen

- merk

- bouw

- bouwt

- bebouwd

- bedrijfsdeskundigen

- dragen

- gevallen

- kans

- verandering

- klasse

- classificatie

- Cloud

- cloud adoptie

- code

- Kolom

- columns

- gecombineerde

- combineren

- vergelijken

- vergelijken

- ingewikkeldheid

- Berekenen

- Gedrag

- vertrouwen

- Configuratie

- Bevestigen

- BEVESTIGD

- gekoppeld blijven

- constante

- construeren

- bouw

- bevat

- contrast

- bijdrage

- controles

- Overeenkomend

- Kosten

- en je merk te creëren

- creëert

- cruciaal

- Klanten

- gegevens

- Database

- datasets

- beslissing

- deep

- Standaard

- gedefinieerd

- Afhankelijkheid

- implementeren

- het inzetten

- inzet

- gegevens

- Opsporing

- apparaat

- Leuk vinden

- DEED

- anders

- bespreken

- Nee

- Val

- gedurende

- elk

- ecommerce

- effect

- effectief

- maakt

- waardoor

- aanmoedigen

- Endpoint

- waarborgt

- Geheel

- entiteiten

- entiteit

- omgevingen

- vooral

- schatten

- geëvalueerd

- evalueren

- Zelfs

- Alle

- voorbeeld

- voorbeelden

- verwacht

- duur

- ervaring

- experiment

- Verklaren

- Verken

- verlengen

- extern

- extract

- Voordelen

- Fictie

- Tot slot

- financieel

- financiële diensten

- Voornaam*

- volgend

- volgt

- formaat

- bedrog

- fraude detectie

- frauduleus

- Gratis

- oppompen van

- vol

- geheel

- gaming

- voortbrengen

- krijgen

- GitHub

- goed

- diagram

- groot

- Hard

- gezondheidszorg

- hulp

- helpt

- hoger

- geschiedenis

- Hoe

- How To

- Echter

- HTML

- HTTPS

- identificeren

- Identiteit

- Onwettig

- uitvoeren

- uitvoering

- uitvoering

- gereedschap

- importeren

- belangrijk

- verbeteren

- in

- Anders

- inclusief

- omvat

- Inclusief

- meer

- industrieën

- informatie

- invoer

- instantie

- geïntroduceerd

- Introduceert

- IP

- IP adressen

- IT

- mee

- sleutel

- bekend

- laboratorium

- label

- labels

- Groot

- groter

- Wachttijd

- leiden

- LEARN

- leren

- Bibliotheek

- Life

- Bio

- levenscyclus van uw product

- Waarschijnlijk

- laden

- locaties

- op zoek

- Loyaliteit

- loyaliteitsprogramma

- machine

- machine learning

- manager

- Match

- zinvolle

- Media

- Geheugen

- methoden

- ML

- Mode

- model

- modellen

- modi

- meer

- noodzakelijk

- Neptunus

- netwerk

- netwerken

- neurale netwerken

- New

- volgende

- knooppunt

- knooppunten

- aantal

- nummers

- waarnemen

- het verkrijgen van

- EEN

- online.

- online betalingen

- operatie

- Operations

- optimale

- orkestratie

- Overige

- beter dan

- het te bezitten.

- panda's

- parameter

- parameters

- voorbij

- betalingen

- percentage

- Uitvoeren

- prestatie

- uitvoerend

- fase

- phone

- Fysiek

- Plato

- Plato gegevensintelligentie

- PlatoData

- Populair

- Post

- voorspellen

- het voorspellen van

- voorspelling

- presenteren

- cadeautjes

- voorkomen

- vorig

- Voorafgaand

- probleem

- problemen

- produceren

- productie

- Programma

- belofte

- zorgen voor

- mits

- pytorch

- Qi

- Rauw

- bereiken

- lezing

- vast

- echte wereld

- real-time

- record

- archief

- verminderen

- vermindert

- vermindering

- verwezen

- verwant

- betrekkingen

- Relaties

- uitgebracht

- het verwijderen van

- gemeld

- vertegenwoordigen

- vertegenwoordiging

- vereisen

- nodig

- vereiste

- degenen

- REST

- verkregen

- Resultaten

- terugkeer

- lopen

- Ryan

- sagemaker

- SageMaker Inferentie

- dezelfde

- Bespaar

- scenario

- Wetenschap

- Science Fiction

- WETENSCHAPPEN

- Wetenschapper

- scripts

- Tweede

- seconden

- senior

- service

- Diensten

- reeks

- het instellen van

- settings

- setup

- verscheidene

- Delen

- getoond

- Shows

- aanzienlijke

- aanzienlijk

- single

- Maat

- maten

- Klein

- kleinere

- So

- Social

- social media

- oplossing

- Oplossingen

- sommige

- specifiek

- snelheid

- spleet

- splits

- Stap voor

- Stappen

- stoppen

- mediaopslag

- strategieën

- structuur

- Studie

- subgraaf

- subgrafieken

- dergelijk

- Pak

- geschikt

- ondersteuning

- verdacht

- tafel

- Nemen

- overnemen

- neemt

- doelwit

- Taak

- taken

- sjabloon

- termen

- proef

- Testen

- De

- De grafiek

- hun

- daarbij

- daarom

- Door

- doorvoer

- niet de tijd of

- tijdstempel

- timing

- naar

- ook

- onderwerp

- Totaal

- Trainen

- getraind

- Trainingen

- transactie

- Transacties

- behandelen

- Bomen

- proces

- proeven

- waar

- types

- typisch

- us

- .

- gebruikers

- doorgaans

- gevalideerd

- waarde

- Values

- via

- welke

- en

- Wi-fi

- wil

- zonder

- woorden

- waard

- zou

- You

- Your

- zephyrnet