Als Joe Biden een slimme en volkse AI-chatbot wil die vragen voor hem beantwoordt, zal zijn campagneteam geen gebruik kunnen maken van Claude, de ChatGPT-concurrent van Anthropic, zo maakte het bedrijf vandaag bekend.

“We staan niet toe dat kandidaten Claude gebruiken om chatbots te bouwen die kunnen doen alsof ze hen zijn, en we staan niet toe dat iemand Claude gebruikt voor gerichte politieke campagnes”, zegt het bedrijf. aangekondigd. Schendingen van dit beleid zullen worden beantwoord met waarschuwingen en uiteindelijk met opschorting van de toegang tot de diensten van Anthropic.

Anthropic's publieke verwoording van zijn ‘verkiezingsmisbruik’-beleid komt omdat het potentieel van AI om op grote schaal valse en misleidende informatie, afbeeldingen en video’s te genereren, toeneemt. wereldwijd alarmbellen doen rinkelen.

Meta geïmplementeerde regels rhet beperken van het gebruik van haar AI-instrumenten in de politiek afgelopen herfst, en OpenAI heeft een soortgelijk beleid.

Anthropic zei dat zijn politieke bescherming in drie hoofdcategorieën valt: het ontwikkelen en handhaven van beleid met betrekking tot verkiezingskwesties, het evalueren en testen van modellen tegen mogelijk misbruik, en het verwijzen van gebruikers naar nauwkeurige steminformatie.

Antropische Aanvaardbaar gebruik beleid– waar alle gebruikers ogenschijnlijk mee instemmen voordat ze Claude benaderen – verbiedt het gebruik van zijn AI-tools voor politieke campagnes en lobbyinspanningen. Het bedrijf zei dat er waarschuwingen en opschortingen van diensten zullen zijn voor overtreders, met een menselijk beoordelingsproces.

Het bedrijf voert ook rigoureuze ‘red-teaming’ van zijn systemen uit: agressieve, gecoördineerde pogingen van bekende partners om Claude te ‘jailbreaken’ of anderszins voor snode doeleinden te gebruiken.

“We testen hoe ons systeem reageert op prompts die ons beleid voor acceptabel gebruik schenden, [bijvoorbeeld] prompts die informatie vragen over tactieken voor het onderdrukken van kiezers”, legt Anthropic uit. Bovendien zei het bedrijf dat het een reeks tests heeft ontwikkeld om ‘politieke gelijkheid’ te garanderen: een vergelijkende vertegenwoordiging van kandidaten en onderwerpen.

In de Verenigde Staten, antropisch werkt samen met TurboVote om kiezers te helpen met betrouwbare informatie in plaats van de generatieve AI-tool te gebruiken.

“Als een in de VS gevestigde gebruiker om steminformatie vraagt, biedt een pop-up de gebruiker de mogelijkheid om doorgestuurd te worden naar TurboVote, een hulpbron van de onpartijdige organisatie Democracy Works”, legt Anthropic uit, een oplossing die “over de hele wereld zal worden ingezet”. komende weken” – met plannen om soortgelijke maatregelen in andere landen toe te voegen.

As decoderen eerder gemeldOpenAI, het bedrijf achter ChatGPT, onderneemt soortgelijke stappen en stuurt gebruikers door naar de niet-partijgebonden website CanIVote.org.

De inspanningen van Anthropic sluiten aan bij een bredere beweging binnen de technologie-industrie om de uitdagingen aan te pakken die AI voor democratische processen met zich meebrengt. Zo heeft de Amerikaanse Federal Communications Commission onlangs het gebruik van door AI gegenereerde informatie verboden deepfake-stemmen in robocalls, een besluit dat de urgentie onderstreept van het reguleren van de toepassing van AI in de politieke sfeer.

Net als Facebook heeft Microsoft dat ook gedaan aangekondigde initiatieven om misleidende, door AI gegenereerde politieke advertenties te bestrijden, door ‘Content Credentials as a Service’ te introduceren en een verkiezingscommunicatiehub te lanceren.

Wat betreft kandidaten die AI-versies van zichzelf maken, heeft OpenAI de specifieke use case al moeten aanpakken. Het bedrijf opgeschort het account van een ontwikkelaar nadat hij erachter kwam dat ze een bot hadden gemaakt die de hoopvolle presidentsvertegenwoordiger Dean Phillips nabootste. De stap kwam nadat een petitie over AI-misbruik in politieke campagnes was geïntroduceerd door de non-profitorganisatie Public Citizen, waarin de toezichthouder werd gevraagd generatieve AI in politieke campagnes te verbieden.

Anthropic weigerde verder commentaar en OpenAI reageerde niet op een vraag van decoderen.

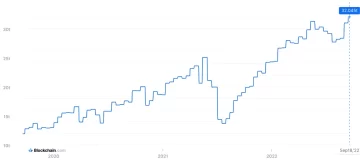

Blijf op de hoogte van cryptonieuws, ontvang dagelijkse updates in je inbox.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://decrypt.co/217937/anthropic-claude-ai-chatbot-politics-elections-campaign-deepfake-rules