Klanten uit de gezondheidszorg en life sciences (HCLS) adopteren generatieve AI als hulpmiddel om meer uit hun data te halen. Gebruiksvoorbeelden zijn onder meer het samenvatten van documenten om lezers te helpen zich te concentreren op de belangrijkste punten van een document en het transformeren van ongestructureerde tekst in gestandaardiseerde formaten om belangrijke kenmerken te benadrukken. Met unieke dataformaten en strikte wettelijke vereisten zijn klanten op zoek naar keuzes om het meest performante en kosteneffectieve model te selecteren, evenals de mogelijkheid om de noodzakelijke aanpassingen (fine-tuning) uit te voeren die passen bij hun zakelijke gebruiksscenario. In dit bericht begeleiden we u bij het implementeren van een Falcon Large Language Model (LLM) met behulp van Amazon SageMaker JumpStart en het model gebruiken om lange documenten samen te vatten met LangChain en Python.

Overzicht oplossingen

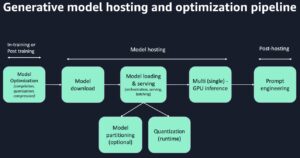

Amazon Sage Maker is gebouwd op de twintig jaar ervaring van Amazon met het ontwikkelen van real-world ML-applicaties, waaronder productaanbevelingen, personalisatie, intelligent winkelen, robotica en spraakgestuurde apparaten. SageMaker is een beheerde service die in aanmerking komt voor HIPAA en die tools biedt waarmee datawetenschappers, ML-ingenieurs en bedrijfsanalisten kunnen innoveren met ML. Binnen SageMaker is dat zo Amazon SageMaker Studio, een geïntegreerde ontwikkelomgeving (IDE), speciaal gebouwd voor collaboratieve ML-workflows, die op hun beurt een breed scala aan snelstartoplossingen en vooraf getrainde ML-modellen bevatten in een geïntegreerde hub genaamd SageMaker JumpStart. Met SageMaker JumpStart kunt u vooraf getrainde modellen, zoals de Falcon LLM, met vooraf gebouwde voorbeeldnotebooks en SDK-ondersteuning gebruiken om te experimenteren met deze krachtige transformatormodellen en deze in te zetten. U kunt SageMaker Studio en SageMaker JumpStart gebruiken om uw eigen generatieve model in uw AWS-account te implementeren en te bevragen.

U kunt er ook voor zorgen dat de payloadgegevens van de gevolgtrekking uw VPC niet verlaten. U kunt modellen inrichten als eindpunten met één tenant en deze implementeren met netwerkisolatie. Bovendien kunt u de geselecteerde reeks modellen samenstellen en beheren die aan uw eigen beveiligingsvereisten voldoen door gebruik te maken van de privé-modelhub-mogelijkheid binnen SageMaker JumpStart en de goedgekeurde modellen daarin op te slaan. SageMaker is in scope voor HIPAA BAA, SOC123 en HITRUST CSF.

De Falcon LLM is een groot taalmodel, getraind door onderzoekers van het Technology Innovation Institute (TII) op meer dan 1 biljoen tokens met behulp van AWS. Falcon heeft veel verschillende variaties, met als twee hoofdbestanddelen Falcon 40B en Falcon 7B, die respectievelijk 40 miljard en 7 miljard parameters bevatten, met verfijnde versies die zijn getraind voor specifieke taken, zoals het volgen van instructies. Falcon presteert goed bij een verscheidenheid aan taken, waaronder het samenvatten van teksten, sentimentanalyse, het beantwoorden van vragen en het voeren van gesprekken. Dit bericht biedt een walkthrough die u kunt volgen om de Falcon LLM in uw AWS-account te implementeren, met behulp van een beheerde notebookinstantie via SageMaker JumpStart om te experimenteren met tekstsamenvatting.

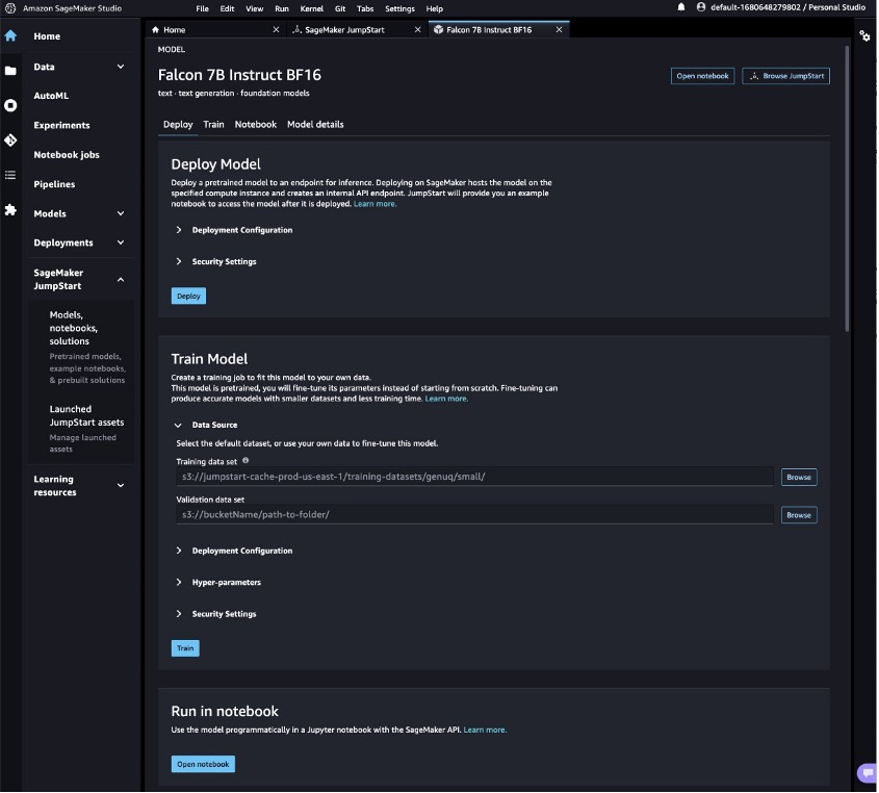

De SageMaker JumpStart-modelhub bevat complete notebooks om elk model te implementeren en te bevragen. Op het moment van schrijven zijn er zes versies van Falcon beschikbaar in de SageMaker JumpStart-modelhub: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 en Falcon 7B BF16. Dit bericht maakt gebruik van het Falcon 7B Instruct-model.

In de volgende secties laten we zien hoe u aan de slag kunt gaan met het samenvatten van documenten door Falcon 7B op SageMaker Jumpstart te implementeren.

Voorwaarden

Voor deze tutorial heb je een AWS-account met een SageMaker-domein nodig. Als u nog geen SageMaker-domein heeft, raadpleegt u Aan boord van Amazon SageMaker Domain om er een te maken.

Implementeer Falcon 7B met SageMaker JumpStart

Voer de volgende stappen uit om uw model te implementeren:

- Navigeer naar uw SageMaker Studio-omgeving vanuit de SageMaker-console.

- Binnen de IO, onder SageMaker JumpStart in het navigatievenster, kies Modellen, notebooks, oplossingen.

- Implementeer het Falcon 7B Instruct-model op een eindpunt voor gevolgtrekking.

Hierdoor wordt de modelkaart voor het Falcon 7B Instruct BF16-model geopend. Op deze pagina vindt u de Implementeren or Trainen opties en koppelingen om de voorbeeldnotitieboekjes in SageMaker Studio te openen. In dit bericht wordt het voorbeeldnotitieboekje van SageMaker JumpStart gebruikt om het model te implementeren.

- Kies Notitieblok openen.

- Voer de eerste vier cellen van de notebook uit om het Falcon 7B Instruct-eindpunt te implementeren.

U kunt uw geïmplementeerde JumpStart-modellen zien op de JumpStart-middelen gelanceerd pagina.

- In het navigatievenster, onder SageMaker-startpagina, kiezen JumpStart-middelen gelanceerd.

- Kies de Eindpunten modelleren tabblad om de status van uw eindpunt te bekijken.

Nu het Falcon LLM-eindpunt is geïmplementeerd, bent u klaar om het model te bevragen.

Voer uw eerste query uit

Voer de volgende stappen uit om een query uit te voeren:

- Op de Dien in menu, kies New en Notitieboek om een nieuw notitieboek te openen.

U kunt ook het ingevulde notitieboekje downloaden hier.

- Selecteer de afbeelding, de kernel en het exemplaartype wanneer daarom wordt gevraagd. Voor dit bericht kiezen we de Data Science 3.0-image, Python 3-kernel en ml.t3.medium-instantie.

- Importeer de Boto3- en JSON-modules door de volgende twee regels in de eerste cel in te voeren:

- Media Shift + Enter om de cel te laten draaien.

- Vervolgens kunt u een functie definiëren die uw eindpunt aanroept. Deze functie neemt een woordenboekpayload en gebruikt deze om de SageMaker-runtimeclient aan te roepen. Vervolgens deserialiseert het het antwoord en drukt de invoer en de gegenereerde tekst af.

De payload bevat de prompt als invoer, samen met de gevolgtrekkingsparameters die aan het model worden doorgegeven.

- U kunt deze parameters gebruiken met de prompt om de uitvoer van het model af te stemmen op uw gebruiksscenario:

Query met een samenvattingsprompt

Dit bericht maakt gebruik van een voorbeeld van een onderzoekspaper om de samenvatting aan te tonen. Het voorbeeldtekstbestand gaat over automatische tekstsamenvatting in de biomedische literatuur. Voer de volgende stappen uit:

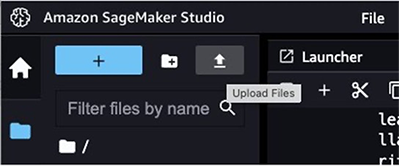

- Downloaden de PDF en kopieer de tekst naar een bestand met de naam

document.txt. - Kies in SageMaker Studio het uploadpictogram en upload het bestand naar uw SageMaker Studio-instantie.

Out-of-the-box biedt de Falcon LLM ondersteuning voor tekstsamenvatting.

- Laten we een functie maken die snelle technische technieken gebruikt om samen te vatten

document.txt:

U zult merken dat er voor langere documenten een foutmelding verschijnt: Falcon heeft, net als alle andere LLM's, een limiet op het aantal tokens dat als invoer wordt doorgegeven. We kunnen deze limiet omzeilen met behulp van de verbeterde samenvattingsmogelijkheden van LangChain, waardoor een veel grotere input aan de LLM kan worden doorgegeven.

Importeer en voer een samenvattingsketen uit

LangChain is een open-source softwarebibliotheek waarmee ontwikkelaars en datawetenschappers snel aangepaste generatieve applicaties kunnen bouwen, afstemmen en implementeren zonder complexe ML-interacties te beheren, die vaak worden gebruikt om veel van de algemene gebruiksscenario's voor generatieve AI-taalmodellen in slechts een paar regels code. De ondersteuning van LangChain voor AWS-services omvat ondersteuning voor SageMaker-eindpunten.

LangChain biedt een toegankelijke interface voor LLM's. De functies omvatten tools voor prompt-templates en prompt-chaining. Deze ketens kunnen worden gebruikt om tekstdocumenten die langer zijn dan wat het taalmodel ondersteunt, in één oproep samen te vatten. U kunt een kaartverkleiningsstrategie gebruiken om lange documenten samen te vatten door deze op te splitsen in hanteerbare stukken, ze samen te vatten en te combineren (en indien nodig opnieuw samen te vatten).

- Laten we LangChain installeren om te beginnen:

- Importeer de relevante modules en deel het lange document op in stukjes:

- Om LangChain effectief te laten werken met Falcon, moet u de standaard inhoudshandlerklassen definiëren voor geldige invoer en uitvoer:

- U kunt aangepaste aanwijzingen definiëren als

PromptTemplateobjecten, het belangrijkste voertuig voor het vragen met LangChain, voor de samenvattingsbenadering met kaartverkleining. Dit is een optionele stap omdat toewijzings- en combinatieprompts standaard worden geleverd als de parameters binnen de aanroep om de samenvattingsketen te laden (load_summarize_chain) zijn niet gedefinieerd.

- LangChain ondersteunt LLM's die worden gehost op SageMaker-inferentie-eindpunten, dus in plaats van de AWS Python SDK te gebruiken, kunt u de verbinding initialiseren via LangChain voor betere toegankelijkheid:

- Ten slotte kunt u een samenvattingsketen laden en een samenvatting van de invoerdocumenten uitvoeren met behulp van de volgende code:

Omdat de verbose parameter is ingesteld op True, ziet u alle tussenresultaten van de kaartverkleiningsaanpak. Dit is handig als u de volgorde van de gebeurtenissen wilt volgen om tot een definitieve samenvatting te komen. Met deze kaartverkleinende aanpak kunt u documenten effectief veel langer samenvatten dan normaal is toegestaan door de maximale invoertokenlimiet van het model.

Opruimen

Nadat u klaar bent met het gebruik van het inferentie-eindpunt, is het belangrijk om dit te verwijderen om te voorkomen dat u onnodige kosten maakt via de volgende coderegels:

Andere funderingsmodellen gebruiken in SageMaker JumpStart

Het gebruik van andere basismodellen die beschikbaar zijn in SageMaker JumpStart voor het samenvatten van documenten vereist minimale overhead bij het opzetten en implementeren. LLM's variëren af en toe afhankelijk van de structuur van invoer- en uitvoerformaten, en naarmate nieuwe modellen en kant-en-klare oplossingen aan SageMaker JumpStart worden toegevoegd, moet u, afhankelijk van de taakimplementatie, mogelijk de volgende codewijzigingen aanbrengen:

- Als u samenvattingen uitvoert via de

summarize()methode (de methode zonder LangChain te gebruiken), moet u mogelijk de JSON-structuur van depayloadparameter, evenals de verwerking van de responsvariabele in dequery_endpoint()functie - Als u samenvattingen uitvoert via LangChain's

load_summarize_chain()methode, moet u mogelijk deContentHandlerTextSummarizationklasse, in het bijzonder detransform_input()entransform_output()functies, om de lading die de LLM verwacht en de output die de LLM retourneert correct af te handelen

Funderingsmodellen variëren niet alleen in factoren zoals inferentiesnelheid en kwaliteit, maar ook in invoer- en uitvoerformaten. Raadpleeg de relevante informatiepagina van de LLM over de verwachte input en output.

Conclusie

Het Falcon 7B Instruct-model is beschikbaar op de SageMaker JumpStart-modelhub en presteert in een aantal gebruiksscenario's. Dit bericht demonstreerde hoe u uw eigen Falcon LLM-eindpunt in uw omgeving kunt implementeren met behulp van SageMaker JumpStart en uw eerste experimenten kunt doen vanuit SageMaker Studio, zodat u snel een prototype van uw modellen kunt maken en naadloos kunt overstappen naar een productieomgeving. Met Falcon en LangChain kunt u lange documenten op het gebied van de gezondheidszorg en de levenswetenschappen effectief op schaal samenvatten.

Voor meer informatie over het werken met generatieve AI op AWS, zie Aankondiging van nieuwe tools voor bouwen met generatieve AI op AWS. U kunt beginnen met experimenteren en proofs of concept voor documentsamenvattingen bouwen voor uw op gezondheidszorg en biowetenschappen gerichte GenAI-toepassingen met behulp van de methode die in dit bericht wordt beschreven. Wanneer Amazonebodem algemeen beschikbaar is, zullen we een vervolgpost publiceren waarin wordt getoond hoe u documentsamenvatting kunt implementeren met behulp van Amazon Bedrock en LangChain.

Over de auteurs

Johannes Kitaoka is oplossingsarchitect bij Amazon Web Services. John helpt klanten bij het ontwerpen en optimaliseren van AI/ML-workloads op AWS om hen te helpen hun bedrijfsdoelen te bereiken.

Johannes Kitaoka is oplossingsarchitect bij Amazon Web Services. John helpt klanten bij het ontwerpen en optimaliseren van AI/ML-workloads op AWS om hen te helpen hun bedrijfsdoelen te bereiken.

Josh Famestad is oplossingsarchitect bij Amazon Web Services. Josh werkt samen met klanten uit de publieke sector om cloudgebaseerde benaderingen te ontwikkelen en uit te voeren om zakelijke prioriteiten te verwezenlijken.

Josh Famestad is oplossingsarchitect bij Amazon Web Services. Josh werkt samen met klanten uit de publieke sector om cloudgebaseerde benaderingen te ontwikkelen en uit te voeren om zakelijke prioriteiten te verwezenlijken.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- : heeft

- :is

- :niet

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- vermogen

- SAMENVATTING

- Accepteert

- de toegankelijkheid

- beschikbaar

- Account

- Bereiken

- toegevoegd

- De goedkeuring van

- weer

- AI

- AI / ML

- Alles

- toegestaan

- Het toestaan

- toestaat

- naast

- al

- ook

- Amazone

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analyse

- analisten

- en

- dier

- dieren

- Aanvraag

- toepassingen

- nadering

- benaderingen

- goedgekeurd

- ZIJN

- rond

- AS

- At

- attributen

- Automatisch

- Beschikbaar

- vermijd

- AWS

- gebaseerde

- BE

- omdat

- beginnen

- gelooft

- Miljard

- biomedische

- lichaam

- pin

- Box camera's

- Breken

- Breaking

- bouw

- Gebouw

- bebouwd

- bedrijfsdeskundigen

- maar

- by

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- CAN

- Kan krijgen

- mogelijkheden

- bekwaamheid

- kaart

- geval

- gevallen

- Cellen

- keten

- ketens

- verandering

- Wijzigingen

- keuzes

- Kies

- het kiezen van

- klasse

- klassen

- klant

- Cloud

- code

- samenwerkend

- combineren

- combineren

- Gemeen

- algemeen

- vergeleken

- compleet

- Voltooid

- complex

- bestaat uit

- concept

- beknopt

- versterken

- troosten

- bevatten

- content

- kostenefficient

- Kosten

- en je merk te creëren

- gewoonte

- Klanten

- maatwerk

- gegevens

- data science

- decennia

- Standaard

- bepalen

- leveren

- tonen

- gedemonstreerd

- Afhankelijk

- implementeren

- ingezet

- het inzetten

- inzet

- Design

- ontwikkelaars

- het ontwikkelen van

- Ontwikkeling

- systemen

- anders

- do

- document

- documenten

- Nee

- domein

- Dont

- beneden

- Download

- elk

- aarde

- effectief

- in staat stellen

- Endpoint

- Engineering

- Ingenieurs

- verbeterde

- verzekeren

- het invoeren van

- Milieu

- fout

- EVENTS

- voorbeeld

- uitvoeren

- verwacht

- verwacht

- ervaring

- experiment

- experimenten

- Gezicht

- factoren

- vals

- Voordelen

- weinig

- Dien in

- finale

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- geschikt

- Focus

- volgen

- volgend

- Voor

- Foundation

- vier

- oppompen van

- functie

- functies

- Bovendien

- algemeen

- voortbrengen

- gegenereerde

- generatief

- generatieve AI

- krijgen

- Doelen

- meer

- handvat

- Behandeling

- Hebben

- gezondheidszorg

- hulp

- helpt

- Markeer

- gehost

- Hoe

- How To

- HTML

- HTTPS

- Naaf

- ICON

- if

- beeld

- uitvoeren

- uitvoering

- importeren

- belangrijk

- in

- omvatten

- omvat

- Inclusief

- informatie

- innoveren

- Innovatie

- invoer

- ingangen

- installeren

- instantie

- verkrijgen in plaats daarvan

- Instituut

- instructies

- geïntegreerde

- Intelligent

- interacties

- Interface

- in

- isolatie

- IT

- HAAR

- John

- json

- voor slechts

- sleutel

- taal

- Groot

- groter

- gelanceerd

- Verlof

- Bibliotheek

- Life

- Bio

- LIMIT

- lijnen

- links

- literatuur

- LLM

- laden

- lang

- langer

- op zoek

- Hoofd

- maken

- beheer

- handelbaar

- beheerd

- beheren

- veel

- in kaart brengen

- maximaal

- Mei..

- Medium

- Menu

- methode

- minimaal

- ML

- model

- modellen

- wijzigen

- Modules

- meer

- meest

- veel

- Navigatie

- noodzakelijk

- Noodzaak

- nodig

- netwerk

- New

- NIH

- normaal

- notitieboekje

- Merk op..

- aantal

- objecten

- of

- on

- EEN

- Slechts

- open

- open source

- Open source software

- Optimaliseer

- Opties

- Overige

- geschetst

- uitgang

- over

- het te bezitten.

- pagina

- brood

- Papier

- parameter

- parameters

- voorbij

- Uitvoeren

- uitvoerend

- presteert

- Personalisatie

- Plato

- Plato gegevensintelligentie

- PlatoData

- punten

- Post

- krachtige

- prints

- privaat

- Product

- productie

- bewijzen

- prototype

- zorgen voor

- mits

- biedt

- voorziening

- publiek

- publiceren

- Python

- kwaliteit

- vraag

- snel

- snel

- lezers

- klaar

- echte wereld

- aanbevelingen

- verwijzen

- regelgevers

- relevante

- Voorwaarden

- vereist

- onderzoek

- onderzoekers

- respectievelijk

- antwoord

- terugkeer

- robotica

- lopen

- sagemaker

- SageMaker Inferentie

- Scale

- Wetenschap

- WETENSCHAPPEN

- wetenschappers

- omvang

- sdk

- naadloos

- secties

- sector

- veiligheid

- zien

- gekozen

- ZELF

- sentiment

- Volgorde

- service

- Diensten

- reeks

- het instellen van

- Winkelen

- Bermuda's

- tonen

- single

- ZES

- So

- Software

- Oplossingen

- specifiek

- specifiek

- snelheid

- begin

- gestart

- Status

- Stap voor

- Stappen

- bewaartemperatuur

- Strategie

- Streng

- structuur

- studio

- dergelijk

- samenvatten

- OVERZICHT

- ondersteuning

- steunen

- neemt

- Taak

- taken

- technieken

- Technologie

- Technologie Innovatie

- tekst

- neem contact

- dat

- De

- hun

- Ze

- harte

- Er.

- Deze

- dit

- Door

- naar

- samen

- teken

- tokens

- tools

- tools

- getraind

- transformator

- transformeren

- overgang

- Triljoen

- waar

- BEURT

- zelfstudie

- twee

- type dan:

- onbepaald

- unieke

- onnodig

- Uploaden

- .

- use case

- gebruikt

- toepassingen

- gebruik

- variabele

- variëteit

- voertuig

- versies

- via

- Bekijk

- lopen

- walkthrough

- we

- web

- webservices

- GOED

- Wat

- wanneer

- welke

- breed

- wil

- Met

- binnen

- zonder

- Mijn werk

- workflows

- werkzaam

- Bedrijven

- schrijven

- het schrijven van

- You

- Your

- zephyrnet