De acceptatie van kunstmatige intelligentie (AI) versnelt in alle sectoren en gebruiksscenario's. Recente wetenschappelijke doorbraken op het gebied van deep learning (DL), grote taalmodellen (LLM's) en generatieve AI stellen klanten in staat geavanceerde, ultramoderne oplossingen te gebruiken met bijna mensachtige prestaties. Deze complexe modellen vereisen vaak hardwareversnelling omdat het niet alleen snellere training mogelijk maakt, maar ook snellere gevolgtrekkingen bij het gebruik van diepe neurale netwerken in realtime toepassingen. Het grote aantal parallelle verwerkingskernen van GPU's maakt ze zeer geschikt voor deze DL-taken.

Naast het aanroepen van modellen omvatten deze DL-toepassingen echter vaak voorverwerking of naverwerking in een gevolgtrekkingspijplijn. Invoerafbeeldingen voor een gebruiksscenario voor objectdetectie moeten bijvoorbeeld mogelijk worden vergroot of bijgesneden voordat ze worden aangeboden aan een computer vision-model, of tokenisatie van tekstinvoer voordat ze in een LLM worden gebruikt. NVIDIA Triton is een open-source inferentieserver waarmee gebruikers dergelijke inferentiepijplijnen kunnen definiëren als een ensemble van modellen in de vorm van een Directed Acyclic Graph (DAG). Het is ontworpen om modellen op schaal uit te voeren op zowel CPU als GPU. Amazon Sage Maker ondersteunt de naadloze implementatie van Triton, waardoor u de functies van Triton kunt gebruiken en tegelijkertijd kunt profiteren van SageMaker-mogelijkheden: een beheerde, beveiligde omgeving met integratie van MLOps-tools, automatisch schalen van gehoste modellen en meer.

AWS heeft, in zijn toewijding om klanten te helpen de hoogste besparing te realiseren, voortdurend geïnnoveerd, niet alleen op het gebied van prijs opties en proactieve diensten voor kostenoptimalisatie, maar ook bij het lanceren van kostenbesparende functies zoals eindpunten met meerdere modellen (MME's). MME's zijn een kosteneffectieve oplossing voor het inzetten van een groot aantal modellen met behulp van dezelfde vloot van bronnen en een gedeelde serveercontainer om al uw modellen te hosten. In plaats van meerdere eindpunten met één model te gebruiken, kunt u uw hostingkosten verlagen door meerdere modellen te implementeren, terwijl u slechts voor één enkele inferentieomgeving betaalt. Bovendien verminderen MME's de implementatieoverhead omdat SageMaker het laden van modellen in het geheugen beheert en deze schaalt op basis van de verkeerspatronen naar uw eindpunt.

In dit bericht laten we zien hoe u meerdere deep learning-ensemble-modellen kunt uitvoeren op een GPU-instantie met een SageMaker MME. Om dit voorbeeld te volgen, kunt u de code op het publiek vinden SageMaker voorbeelden repository.

Hoe SageMaker MME's met GPU werken

Met MME's host één enkele container meerdere modellen. SageMaker beheert de levenscyclus van modellen die op de MME worden gehost door ze in het geheugen van de container te laden en te verwijderen. In plaats van alle modellen naar de eindpuntinstantie te downloaden, laadt SageMaker de modellen dynamisch en slaat deze op in de cache zodra ze worden aangeroepen.

Wanneer een aanroepverzoek voor een bepaald model wordt gedaan, doet SageMaker het volgende:

- Het routert de aanvraag eerst naar de eindpuntinstantie.

- Als het model nog niet is geladen, wordt het modelartefact gedownload Amazon eenvoudige opslagservice (Amazon S3) naar die instantie Amazon elastische blokopslag volume (Amazon EBS).

- Het laadt het model naar het geheugen van de container op de GPU-versnelde rekeninstantie. Als het model al in het geheugen van de container is geladen, gaat de aanroep sneller omdat er geen verdere stappen nodig zijn.

Wanneer een extra model moet worden geladen en het geheugengebruik van de instance hoog is, zal SageMaker ongebruikte modellen uit de container van die instance verwijderen om ervoor te zorgen dat er voldoende geheugen is. Deze ongeladen modellen blijven op het EBS-volume van de instantie staan, zodat ze later in het geheugen van de container kunnen worden geladen, waardoor het niet meer nodig is om ze opnieuw uit de S3-bucket te downloaden. Als het opslagvolume van de instantie echter zijn capaciteit bereikt, verwijdert SageMaker de ongebruikte modellen van het opslagvolume. In gevallen waarin de MME veel aanroepverzoeken ontvangt en er extra instanties (of een beleid voor automatisch schalen) aanwezig zijn, routeert SageMaker enkele verzoeken naar andere instanties in het inferentiecluster om tegemoet te komen aan het grote verkeer.

Dit biedt niet alleen een kostenbesparend mechanisme, maar stelt u ook in staat om dynamisch nieuwe modellen in te zetten en oude af te schaffen. Om een nieuw model toe te voegen, uploadt u het naar de S3-bucket waarvoor de MME is geconfigureerd om het te gebruiken en aan te roepen. Als u een model wilt verwijderen, stopt u met het verzenden van verzoeken en verwijdert u het uit de S3-bucket. Voor het toevoegen van modellen of het verwijderen ervan uit een MME is het niet nodig om het eindpunt zelf bij te werken!

Triton-ensembles

Het Triton-modellenensemble vertegenwoordigt een pijplijn die bestaat uit één model, voor- en naverwerkingslogica, en de verbinding van invoer- en uitvoertensoren daartussen. Eén enkel gevolgtrekkingsverzoek aan een ensemble activeert de uitvoering van de gehele pijplijn als een reeks stappen met behulp van de ensembleplanner. De planner verzamelt de uitvoertensors in elke stap en levert deze als invoertensors voor andere stappen volgens de specificatie. Ter verduidelijking: het ensemblemodel wordt vanuit een extern perspectief nog steeds gezien als één enkel model.

Triton-server architectuur omvat een model opslagplaats: een op een bestandssysteem gebaseerde opslagplaats van de modellen die Triton beschikbaar zal stellen voor gevolgtrekking. Triton heeft toegang tot modellen vanaf een of meer lokaal toegankelijke bestandspaden of vanaf externe locaties zoals Amazon S3.

Elk model in een modelrepository moet een modelconfiguratie bevatten die vereiste en optionele informatie over het model biedt. Meestal wordt deze configuratie geleverd in een config.pbtxt bestand gespecificeerd als ModelConfig-protobuf. Een minimale modelconfiguratie moet het platform of de backend (zoals PyTorch of TensorFlow) specificeren, de max_batch_size eigenschap, en de invoer- en uitvoertensoren van het model.

Triton op SageMaker

SageMaker maakt modelimplementatie mogelijk met behulp van de Triton-server met aangepaste code. Deze functionaliteit is beschikbaar via het beheerde SageMaker Triton Inference Server-containers. Deze containers ondersteunen algemene machine leaning (ML)-frameworks (zoals TensorFlow, ONNX en PyTorch, evenals aangepaste modelformaten) en nuttige omgevingsvariabelen waarmee u de prestaties op SageMaker kunt optimaliseren. Het gebruik van SageMaker Deep Learning Containers (DLC)-images wordt aanbevolen omdat deze worden onderhouden en regelmatig worden bijgewerkt met beveiligingspatches.

Oplossingsoverzicht

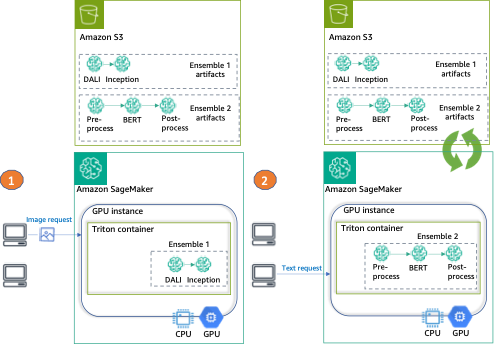

Voor dit bericht implementeren we twee verschillende soorten ensembles op een GPU-instantie, met behulp van Triton en een enkel SageMaker-eindpunt.

Het eerste ensemble bestaat uit twee modellen: een DALI-model voor beeldvoorverwerking en een TensorFlow Inception v3-model voor daadwerkelijke gevolgtrekking. Het pijplijnensemble neemt gecodeerde afbeeldingen als invoer, die moeten worden gedecodeerd, vergroot of verkleind tot een resolutie van 299 x 299 en genormaliseerd. Deze voorverwerking wordt afgehandeld door het DALI-model. DALI is een open source bibliotheek voor algemene beeld- en spraakvoorverwerkingstaken zoals decodering en gegevensvergroting. Aanvang v3 is een beeldherkenningsmodel dat bestaat uit symmetrische en asymmetrische convoluties, en gemiddelde en maximale pooling van volledig verbonden lagen (en daarom perfect voor GPU-gebruik).

Het tweede ensemble transformeert ruwe natuurlijke taalzinnen in inbeddingen en bestaat uit drie modellen. Eerst wordt een voorverwerkingsmodel toegepast op de tokenisatie van invoertekst (geïmplementeerd in Python). Dan maken wij gebruik van een voorgetrainde BERT-model (zonder behuizing). van het Knuffelen Gezicht Model Hub om token-inbedding te extraheren. BERT is een Engelstalig model dat is getraind met behulp van een Masked Language Modeling (MLM)-doelstelling. Ten slotte passen we een naverwerkingsmodel toe waarbij de onbewerkte token-insluitingen uit de vorige stap worden gecombineerd tot zinsinsluitingen.

Nadat we Triton hebben geconfigureerd om deze ensembles te gebruiken, laten we zien hoe u de SageMaker MME configureert en uitvoert.

Ten slotte geven we een voorbeeld van elke ensemble-aanroep, zoals te zien is in het volgende diagram:

- Stel 1 – Roep het eindpunt aan met een afbeelding en geef DALI-Inception op als doelensemble

- Stel 2 – Roep hetzelfde eindpunt aan, dit keer met tekstinvoer en het opvragen van het preprocess-BERT-postprocess ensemble

Stel de omgeving in

Eerst zetten we de benodigde omgeving op. Dit omvat het bijwerken van AWS-bibliotheken (zoals Boto3 en SageMaker-SDK) en het installeren van de afhankelijkheden die nodig zijn om onze ensembles te verpakken en gevolgtrekkingen uit te voeren met Triton. We gebruiken ook de standaarduitvoeringsrol van SageMaker SDK. We gebruiken deze rol om SageMaker toegang te geven tot Amazon S3 (waar onze modelartefacten zijn opgeslagen) en de containerregister (waarvandaan de NVIDIA Triton-afbeelding zal worden gebruikt). Zie de volgende code:

Ensembles voorbereiden

In deze volgende stap bereiden we de twee ensembles voor: de TensorFlow (TF) Inception met DALI-voorverwerking en BERT met Python-voorverwerking en naverwerking.

Dit omvat het downloaden van de vooraf getrainde modellen, het leveren van de Triton-configuratiebestanden en het verpakken van de artefacten die in Amazon S3 moeten worden opgeslagen voordat ze worden geïmplementeerd.

Bereid het TF- en DALI-ensemble voor

Eerst bereiden we de mappen voor voor het opslaan van onze modellen en configuraties: voor de TF Inception (inception_graphdef), voor DALI-voorbewerking (dali), en voor het ensemble (ensemble_dali_inception). Omdat Triton modelversiebeheer ondersteunt, voegen we ook de modelversie toe aan het mappad (aangegeven als 1 omdat we maar één versie hebben). Voor meer informatie over het Triton-versiebeleid raadpleegt u Versiebeleid. Vervolgens downloaden we het Inception v3-model, pakken het uit en kopiëren het naar het inception_graphdef modelmap. Zie de volgende code:

Nu configureren we Triton om onze ensemble-pijplijn te gebruiken. In een config.pbtxt -bestand specificeren we de vormen en typen van de invoer- en uitvoertensor, en de stappen die de Triton-planner moet nemen (DALI-voorverwerking en het Inception-model voor beeldclassificatie):

Vervolgens configureren we elk van de modellen. Eerst de modelconfiguratie voor DALI-backend:

Vervolgens de modelconfiguratie voor TensorFlow Inception v3 die we eerder hebben gedownload:

Omdat dit een classificatiemodel is, moeten we ook de Inception-modellabels kopiëren naar het inception_graphdef map in de modelrepository. Deze labels omvatten 1,000 klassenlabels van de IMAGEnet gegevensset.

Vervolgens configureren en serialiseren we de DALI-pijplijn die onze voorverwerking naar bestanden zal afhandelen. De voorbewerking omvat het lezen van de afbeelding (met behulp van CPU), decodering (versneld met behulp van GPU) en het vergroten of verkleinen en normaliseren van de afbeelding.

Ten slotte verpakken we de artefacten samen en uploaden ze als één object naar Amazon S3:

Bereid het TensorRT- en Python-ensemble voor

Voor dit voorbeeld gebruiken we een vooraf getraind model uit de transformatoren bibliotheek.

U kunt alle modellen (preprocess en postprocess, samen met config.pbtxt bestanden) in de map ensemble_hf. Onze bestandssysteemstructuur omvat vier mappen (drie voor de individuele modelstappen en één voor het ensemble) en hun respectieve versies:

In het map werkruimte, bieden we twee scripts: het eerste dat het model naar ONNX-formaat converteert (onnx_exporter.py) en het TensorRT-compilatiescript (genereer_model_trt.sh).

Triton ondersteunt native de TensorRT-runtime, waardoor u eenvoudig een TensorRT-engine kunt implementeren, waardoor u kunt optimaliseren voor een geselecteerde GPU-architectuur.

Om er zeker van te zijn dat we de TensorRT-versie en afhankelijkheden gebruiken die compatibel zijn met die in onze Triton-container, compileren we het model met behulp van de overeenkomstige versie van NVIDIA's PyTorch-containerimage:

Vervolgens kopiëren we de modelartefacten naar de map die we eerder hebben gemaakt en voegen we een versie toe aan het pad:

We gebruiken een Conda-pakket om een Conda-omgeving te genereren die de Triton Python-backend zal gebruiken bij voor- en nabewerking:

Ten slotte uploaden we de modelartefacten naar Amazon S3:

Voer ensembles uit op een SageMaker MME GPU-instantie

Nu onze ensemble-artefacten zijn opgeslagen in Amazon S3, kunnen we de SageMaker MME configureren en starten.

We beginnen met het ophalen van de containerimage-URI voor de Triton DLC-afbeelding dat past bij de één in onze regio containerregister (en wordt gebruikt voor het compileren van het TensorRT-model):

Vervolgens maken we het model in SageMaker. In de create_model verzoek beschrijven we de te gebruiken container en de locatie van modelartefacten, en specificeren we met behulp van de Mode parameter dat dit een multimodel is.

Om onze ensembles te hosten, creëren we een eindpuntconfiguratie met de create_endpoint_config API-aanroep en maak vervolgens een eindpunt met de create_endpoint API. SageMaker implementeert vervolgens alle containers die u voor het model hebt gedefinieerd in de hostingomgeving.

Hoewel we in dit voorbeeld één instantie instellen om ons model te hosten, ondersteunen SageMaker MME's volledig het instellen van een beleid voor automatisch schalen. Voor meer informatie over deze functie, zie Voer meerdere deep learning-modellen uit op GPU met Amazon SageMaker multi-model endpoints.

Maak verzoekpayloads en roep de MME voor elk model aan

Nadat onze real-time MME is geïmplementeerd, is het tijd om ons eindpunt aan te roepen met elk van de modelensembles die we hebben gebruikt.

Eerst creëren we een payload voor het DALI-Inception-ensemble. Wij gebruiken de shiba_inu_dog.jpg afbeelding uit de openbare dataset van SageMaker met afbeeldingen van huisdieren. We laden de afbeelding als een gecodeerde reeks bytes om te gebruiken in de DALI-backend (voor meer informatie, zie Voorbeelden van beelddecoder).

Met onze gecodeerde afbeelding en payload gereed, roepen we het eindpunt aan.

Merk op dat we ons doelensemble specificeren als de model_tf_dali.tar.gz artefact. De parameter TargetModel onderscheidt MME's van eindpunten met één model en stelt ons in staat het verzoek naar het juiste model te sturen.

Het antwoord bevat metagegevens over de aanroep (zoals modelnaam en versie) en het daadwerkelijke gevolgtrekkingsantwoord in het gegevensgedeelte van het uitvoerobject. In dit voorbeeld krijgen we een array van 1,001 waarden, waarbij elke waarde de waarschijnlijkheid is van de klasse waartoe de afbeelding behoort (1,000 klassen en 1 extra voor anderen).

Vervolgens roepen we opnieuw onze MME aan, maar deze keer richten we ons op het tweede ensemble. Hier zijn de gegevens slechts twee eenvoudige tekstzinnen:

Om de communicatie met Triton te vereenvoudigen, biedt het Triton-project er verschillende client bibliotheken. We gebruiken die bibliotheek om de payload in ons verzoek voor te bereiden:

Nu zijn we klaar om het eindpunt aan te roepen; deze keer is het doelmodel het model_trt_python.tar.gz samen:

Het antwoord zijn de zinsinsluitingen die kunnen worden gebruikt in een verscheidenheid aan toepassingen voor natuurlijke taalverwerking (NLP).

Opruimen

Ten slotte ruimen en verwijderen we het eindpunt, de eindpuntconfiguratie en het model:

Conclusie

In dit bericht hebben we laten zien hoe u een SageMaker MME met Triton-ensembles kunt configureren, implementeren en aanroepen op een GPU-versnelde instantie. We hebben twee ensembles gehost op één enkele realtime inferentieomgeving, waardoor onze kosten met 50% zijn gedaald (voor een g4dn.4xlarge-instantie, die een jaarlijkse besparing van meer dan $ 13,000 vertegenwoordigt). Hoewel dit voorbeeld slechts twee pijplijnen gebruikte, kunnen SageMaker MME's duizenden modelensembles ondersteunen, waardoor het een buitengewoon kostenbesparingsmechanisme is. Bovendien kunt u de dynamische mogelijkheid van SageMaker MME's gebruiken om modellen te laden (en te ontladen) om de operationele overhead van het beheren van modelimplementaties in productie te minimaliseren.

Over de auteurs

Saurabh Trikande is Senior Product Manager voor Amazon SageMaker Inference. Hij heeft een passie voor het werken met klanten en wordt gemotiveerd door het doel om machine learning te democratiseren. Hij richt zich op kernuitdagingen met betrekking tot het inzetten van complexe ML-applicaties, multi-tenant ML-modellen, kostenoptimalisaties en het toegankelijker maken van de inzet van deep learning-modellen. In zijn vrije tijd houdt Saurabh van wandelen, leren over innovatieve technologieën, TechCrunch volgen en tijd doorbrengen met zijn gezin.

Saurabh Trikande is Senior Product Manager voor Amazon SageMaker Inference. Hij heeft een passie voor het werken met klanten en wordt gemotiveerd door het doel om machine learning te democratiseren. Hij richt zich op kernuitdagingen met betrekking tot het inzetten van complexe ML-applicaties, multi-tenant ML-modellen, kostenoptimalisaties en het toegankelijker maken van de inzet van deep learning-modellen. In zijn vrije tijd houdt Saurabh van wandelen, leren over innovatieve technologieën, TechCrunch volgen en tijd doorbrengen met zijn gezin.

Nikhil Kulkarni is een softwareontwikkelaar met AWS Machine Learning, gericht op het performanter maken van machine learning-workloads in de cloud, en is mede-maker van AWS Deep Learning Containers voor training en gevolgtrekking. Hij heeft een passie voor gedistribueerde Deep Learning Systems. Buiten zijn werk leest hij graag boeken, speelt hij met gitaar en maakt hij pizza.

Nikhil Kulkarni is een softwareontwikkelaar met AWS Machine Learning, gericht op het performanter maken van machine learning-workloads in de cloud, en is mede-maker van AWS Deep Learning Containers voor training en gevolgtrekking. Hij heeft een passie voor gedistribueerde Deep Learning Systems. Buiten zijn werk leest hij graag boeken, speelt hij met gitaar en maakt hij pizza.

Uri Rosenberg is de AI & ML Specialist Technical Manager voor Europa, het Midden-Oosten en Afrika. Uri is gevestigd in Israël en werkt eraan om zakelijke klanten in staat te stellen ML-workloads op schaal te ontwerpen, bouwen en exploiteren. In zijn vrije tijd houdt hij van fietsen, backpacken en backpropagatie.

Uri Rosenberg is de AI & ML Specialist Technical Manager voor Europa, het Midden-Oosten en Afrika. Uri is gevestigd in Israël en werkt eraan om zakelijke klanten in staat te stellen ML-workloads op schaal te ontwerpen, bouwen en exploiteren. In zijn vrije tijd houdt hij van fietsen, backpacken en backpropagatie.

Eliuth Triana Isaza is een Developer Relations Manager in het NVIDIA-AWS-team. Hij verbindt productleiders, ontwikkelaars en wetenschappers van Amazon en AWS met NVIDIA-technologen en productleiders om Amazon ML/DL-workloads, EC2-producten en AWS AI-services te versnellen. Daarnaast is Eliuth een gepassioneerd mountainbiker, skiër en pokerspeler.

Eliuth Triana Isaza is een Developer Relations Manager in het NVIDIA-AWS-team. Hij verbindt productleiders, ontwikkelaars en wetenschappers van Amazon en AWS met NVIDIA-technologen en productleiders om Amazon ML/DL-workloads, EC2-producten en AWS AI-services te versnellen. Daarnaast is Eliuth een gepassioneerd mountainbiker, skiër en pokerspeler.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. Automotive / EV's, carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- BlockOffsets. Eigendom voor milieucompensatie moderniseren. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/deploy-thousands-of-model-ensembles-with-amazon-sagemaker-multi-model-endpoints-on-gpu-to-minimize-your-hosting-costs/

- : heeft

- :is

- :niet

- :waar

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 14

- 16

- 22

- 224

- 23

- 7

- 8

- a

- vermogen

- Over

- versnellen

- versneld

- versnellen

- toegang

- beschikbaar

- accommoderen

- Volgens

- Bereiken

- over

- daadwerkelijk

- acyclische

- toevoegen

- toe te voegen

- toevoeging

- Extra

- Daarnaast

- Adoptie

- vergevorderd

- Afrika

- weer

- AI

- AI-diensten

- Alles

- Het toestaan

- langs

- al

- ook

- Hoewel

- Amazone

- Amazon Sage Maker

- Amazon Web Services

- an

- en

- api

- Aanvraag

- toepassingen

- toegepast

- Solliciteer

- nadering

- architectuur

- ZIJN

- reeks

- AS

- At

- auto

- Automatisch

- Beschikbaar

- gemiddelde

- AWS

- AWS-machine learning

- backend

- baseren

- gebaseerde

- BE

- omdat

- geweest

- vaardigheden

- wezen

- behoort

- profiteren

- tussen

- Blok

- Boeken

- zowel

- doorbraken

- bouw

- maar

- by

- Bellen

- CAN

- Inhoud

- geval

- gevallen

- centraal

- uitdagingen

- klasse

- klassen

- classificatie

- Cloud

- TROS

- code

- COM

- gecombineerde

- Gemeen

- Communicatie

- verenigbaar

- complex

- Berekenen

- computer

- Computer visie

- Configuratie

- geconfigureerd

- gekoppeld blijven

- versterken

- verbindt

- bestaat uit

- Containers

- containers

- doorlopend

- controles

- converteren

- Kern

- Overeenkomend

- Kosten

- kostenbesparingen

- kostenefficient

- Kosten

- en je merk te creëren

- aangemaakt

- gewoonte

- Klanten

- DAG

- gegevens

- decodering

- toewijding

- deep

- diepgaand leren

- Standaard

- bepalen

- gedefinieerd

- Democratiserend

- afhankelijkheden

- implementeren

- ingezet

- het inzetten

- inzet

- implementaties

- ontplooit

- beschrijven

- Design

- ontworpen

- Opsporing

- Ontwikkelaar

- ontwikkelaars

- anders

- directe

- directories

- verdeeld

- havenarbeider

- doet

- Nee

- Download

- downloads

- dynamisch

- dynamisch

- elk

- Vroeger

- gemakkelijk

- oosten

- anders

- machtigen

- in staat stellen

- maakt

- Endpoint

- Motor

- Engels

- genoeg

- verzekeren

- Enterprise

- Geheel

- Milieu

- Europa

- voorbeeld

- voorbeelden

- uitvoering

- uitgebreid

- extern

- extra

- extract

- buitengewoon

- Gezicht

- familie

- sneller

- Kenmerk

- Voordelen

- Dien in

- Bestanden

- Tot slot

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- VLOOT

- Vlotter

- richt

- gericht

- volgen

- volgend

- Voor

- formulier

- formaat

- vier

- frameworks

- oppompen van

- geheel

- functionaliteit

- verder

- Bovendien

- voortbrengen

- generatief

- generatieve AI

- krijgen

- doel

- GPU

- diagram

- handvat

- Hardware

- Hebben

- he

- hulp

- hier

- Hoge

- hoogst

- zijn

- gastheer

- gehost

- Hosting

- hosting kosten

- hosts

- Hoe

- How To

- Echter

- HTML

- http

- HTTPS

- i

- if

- beeld

- Afbeeldingsclassificatie

- Beeldherkenning

- afbeeldingen

- geïmplementeerd

- importeren

- in

- begin

- omvatten

- omvat

- individueel

- industrieën

- informatie

- innovatieve

- innovatieve technologieën

- invoer

- ingangen

- installeren

- instantie

- verkrijgen in plaats daarvan

- integratie

- Intelligentie

- in

- ingeroepen

- Israël

- IT

- HAAR

- jpg

- json

- voor slechts

- sleutel

- Soort

- labels

- taal

- Groot

- later

- lancering

- lancering

- Legkippen

- leiders

- LEARN

- leren

- laten

- bibliotheken

- Bibliotheek

- levenscyclus van uw product

- als

- LLM

- laden

- het laden

- ladingen

- plaatselijk

- plaats

- locaties

- logica

- machine

- machine learning

- gemaakt

- maken

- MERKEN

- maken

- beheerd

- manager

- beheert

- beheren

- veel

- Maskers

- max

- mechanisme

- Geheugen

- Metadata

- Midden

- Midden-Oosten

- macht

- minimaal

- gemengd

- ML

- MLops

- Mode

- model

- modellering

- modellen

- meer

- gemotiveerde

- Berg

- meervoudig

- Dan moet je

- naam

- Naturel

- Natural Language Processing

- Noodzaak

- nodig

- behoeften

- netwerken

- neurale netwerken

- New

- volgende

- nlp

- geen

- aantal

- numpy

- Nvidia

- object

- Objectdetectie

- doel van de persoon

- of

- vaak

- Oud

- on

- EEN

- degenen

- Slechts

- open source

- besturen

- operationele

- Optimaliseer

- optimaliseren

- or

- Overige

- onze

- uit

- uitgang

- buiten

- over

- Pakken

- pakket

- verpakking

- Parallel

- parameter

- parameters

- deel

- bijzonder

- hartstochtelijk

- Patches

- pad

- patronen

- het betalen van

- prestatie

- PHP

- pijpleiding

- Pizza

- plaats

- plan

- platform

- Plato

- Plato gegevensintelligentie

- PlatoData

- speler

- poker

- beleidsmaatregelen

- Post

- Voorbereiden

- vorig

- Proactieve

- verwerking

- Product

- product manager

- productie

- Producten

- project

- eigendom

- Proto

- zorgen voor

- mits

- biedt

- het verstrekken van

- publiek

- Python

- pytorch

- verhogen

- Rauw

- Bereikt

- lezing

- klaar

- real-time

- ontvangt

- recent

- erkenning

- aanbevolen

- verminderen

- Gereduceerd

- regio

- register

- regelmatig

- verwant

- betrekkingen

- blijven

- vanop

- het verwijderen van

- bewaarplaats

- vertegenwoordigt

- te vragen

- verzoeken

- vereisen

- nodig

- Resolutie

- Resources

- degenen

- antwoord

- terugkeer

- Retourneren

- RGB

- rechts

- Rol

- wegen

- lopen

- sagemaker

- SageMaker Inferentie

- dezelfde

- besparing

- Bespaar geld

- Scale

- scaling

- wetenschappelijk

- wetenschappers

- scripts

- sdk

- naadloos

- Tweede

- Beveiligde

- veiligheid

- zien

- gezien

- gekozen

- verzending

- senior

- zin

- -Series

- Diensten

- serveer-

- reeks

- het instellen van

- verscheidene

- Vorm

- vormen

- gedeeld

- tonen

- vertoonde

- Eenvoudig

- vereenvoudigen

- single

- Maat

- So

- Software

- oplossing

- Oplossingen

- sommige

- specialist

- specificatie

- gespecificeerd

- toespraak

- Uitgaven

- begin

- state-of-the-art

- Stap voor

- Stappen

- Still

- stop

- mediaopslag

- opgeslagen

- bewaartemperatuur

- structuur

- dergelijk

- ondersteuning

- steunen

- zeker

- system

- Systems

- Nemen

- neemt

- doelwit

- taken

- team

- TechCrunch

- Technisch

- Technologies

- technologen

- tensorflow

- dat

- De

- hun

- Ze

- harte

- Er.

- daarbij

- daarom

- Deze

- ze

- dit

- die

- duizenden kosten

- drie

- Door

- niet de tijd of

- naar

- samen

- teken

- tokenization

- tools

- verkeer

- getraind

- Trainingen

- transformaties

- Triton

- twee

- types

- typisch

- typisch

- ongebruikt

- bijgewerkt

- bijwerken

- us

- Gebruik

- .

- use case

- gebruikt

- gebruikers

- gebruik

- waarde

- Values

- variëteit

- versie

- versies

- Bekijk

- visie

- volume

- willen

- was

- we

- web

- webservices

- GOED

- Wat

- wanneer

- welke

- en

- wil

- Met

- Mijn werk

- werkzaam

- Bedrijven

- jaar-

- You

- Your

- zephyrnet