Nepnieuws, gedefinieerd als nieuws dat valse, verzonnen of opzettelijk misleidende informatie overbrengt of bevat, bestaat al sinds de opkomst van de boekdrukkunst. De snelle verspreiding van nepnieuws en desinformatie online is niet alleen misleidend voor het publiek, maar kan ook een diepgaande impact hebben op de samenleving, de politiek, de economie en de cultuur. Voorbeelden zijn onder meer:

- Het kweken van wantrouwen in de media

- Het democratisch proces ondermijnen

- Het verspreiden van valse of in diskrediet gebrachte wetenschap (bijvoorbeeld de anti-vax-beweging)

Vooruitgang op het gebied van kunstmatige intelligentie (AI) en machine learning (ML) heeft het ontwikkelen van tools voor het creëren en delen van nepnieuws nog eenvoudiger gemaakt. Vroege voorbeelden zijn onder meer geavanceerde sociale bots en geautomatiseerde accounts die de eerste fase van het verspreiden van nepnieuws een impuls geven. Over het algemeen is het voor het publiek niet triviaal om te bepalen of dergelijke accounts mensen of bots zijn. Bovendien zijn sociale bots geen illegale tools, en veel bedrijven kopen ze legaal aan als onderdeel van hun marketingstrategie. Daarom is het niet eenvoudig om het gebruik van sociale bots systematisch aan banden te leggen.

Recente ontdekkingen op het gebied van generatieve AI maken het mogelijk om met behulp van grote taalmodellen (LLM’s) in een ongekend tempo tekstuele inhoud te produceren. LLM's zijn generatieve AI-tekstmodellen met meer dan 1 miljard parameters, en ze worden gefaciliteerd bij de synthese van tekst van hoge kwaliteit.

In dit bericht onderzoeken we hoe u LLM's kunt gebruiken om het veelvoorkomende probleem van het detecteren van nepnieuws aan te pakken. We suggereren dat LLM's voldoende gevorderd zijn voor deze taak, vooral als er verbeterde prompttechnieken zijn zoals Keten-van-gedachte en Reageer worden gebruikt in combinatie met hulpmiddelen voor het ophalen van informatie.

We illustreren dit door het maken van een LangChain applicatie die bij een nieuwsbericht de gebruiker in natuurlijke taal laat weten of het artikel waar of nep is. De oplossing maakt ook gebruik van Amazonebodem, een volledig beheerde service die basismodellen (FM's) van Amazon en externe modelaanbieders toegankelijk maakt via de AWS-beheerconsole en API's.

LLM's en nepnieuws

Het fenomeen nepnieuws begon zich snel te ontwikkelen met de komst van internet en meer specifiek sociale media (Nielsen et al., 2017). Op sociale media kan nepnieuws snel worden gedeeld in het netwerk van een gebruiker, waardoor het publiek zich de verkeerde collectieve mening kan vormen. Bovendien propageren mensen nepnieuws vaak impulsief, waarbij ze de feitelijkheid van de inhoud negeren als het nieuws resoneert met hun persoonlijke normen (Tsipursky et al. 2018). Onderzoek in de sociale wetenschappen heeft gesuggereerd dat cognitieve bias (bevestigingsbias, bandwagon-effect en keuze-ondersteunende bias) een van de meest cruciale factoren is bij het nemen van irrationele beslissingen in termen van zowel de creatie als de consumptie van nepnieuws.Kim, et al., 2021). Dit impliceert ook dat nieuwsconsumenten informatie alleen delen en consumeren in de richting van het versterken van hun overtuigingen.

De kracht van generatieve AI om in een ongekend tempo tekstuele en rijke inhoud te produceren, verergert het nepnieuwsprobleem. Een voorbeeld dat het vermelden waard is, is deepfake-technologie: het combineren van verschillende afbeeldingen op een originele video en het genereren van een andere video. Naast de bedoelingen van desinformatie die menselijke actoren met zich meebrengen, voegen LLM's een geheel nieuwe reeks uitdagingen toe:

- Feitelijke fouten – LLM's lopen een verhoogd risico feitelijke fouten te bevatten vanwege de aard van hun opleiding en hun vermogen om creatief te zijn bij het genereren van de volgende woorden in een zin. LLM-training is gebaseerd op het herhaaldelijk presenteren van een model met onvolledige invoer, en vervolgens het gebruik van ML-trainingstechnieken totdat het de hiaten correct opvult, waardoor de taalstructuur en een op taal gebaseerd wereldmodel worden geleerd. Hoewel LLM's geweldige patroonmatchers en recombineerders zijn (“stochastische papegaaien”), falen ze dus bij een aantal eenvoudige taken die logisch redeneren of wiskundige deductie vereisen, en kunnen ze antwoorden hallucineren. Bovendien is temperatuur een van de LLM-invoerparameters die het gedrag van het model bepaalt bij het genereren van het volgende woord in een zin. Door een hogere temperatuur te selecteren, gebruikt het model een woord met een lagere waarschijnlijkheid, wat een meer willekeurige reactie oplevert.

- Lang – Gegenereerde teksten zijn vaak lang en missen een duidelijk gedefinieerde granulariteit voor individuele feiten.

- Gebrek aan factchecking – Er zijn geen gestandaardiseerde tools beschikbaar voor factchecking tijdens het proces van tekstgeneratie.

Over het geheel genomen heeft de combinatie van de menselijke psychologie en de beperkingen van AI-systemen een perfecte storm veroorzaakt voor de verspreiding van nepnieuws en desinformatie online.

Overzicht oplossingen

LLM's demonstreren uitstekende capaciteiten op het gebied van het genereren van talen, het begrijpen ervan en het leren in enkele slagen. Ze zijn getraind in een enorm corpus aan tekst van internet, waarbij de kwaliteit en nauwkeurigheid van de geëxtraheerde natuurlijke taal mogelijk niet gegarandeerd is.

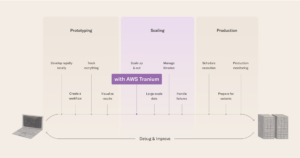

In dit bericht bieden we een oplossing om nepnieuws te detecteren op basis van zowel Chain-of-Thought als Re-Act (Reasoning and Acting)-aanpak. Eerst bespreken we deze twee snelle engineeringtechnieken, daarna laten we hun implementatie zien met behulp van LangChain en Amazon Bedrock.

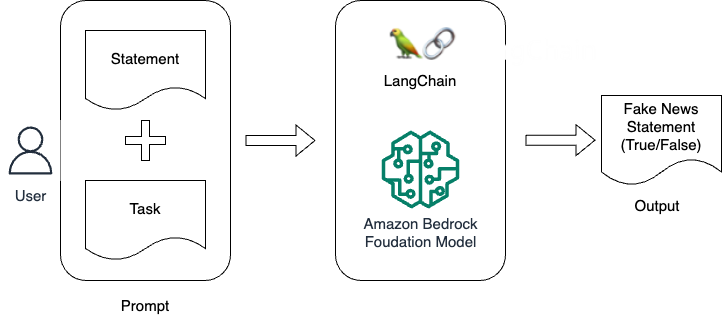

Het volgende architectuurdiagram schetst de oplossing voor onze nepnieuwsdetector.

Architectuurdiagram voor detectie van nepnieuws.

We gebruiken een subset van de FEVER-gegevensset met een verklaring en de grondwaarheid over de verklaring die onjuiste, ware of niet-verifieerbare beweringen aangeeft (Thorne J. et al., 2018).

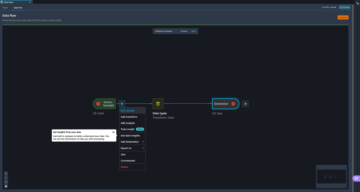

De workflow kan worden opgesplitst in de volgende stappen:

- De gebruiker selecteert een van de uitspraken om te controleren of deze nep of waar is.

- De verklaring en de taak voor het detecteren van nepnieuws zijn opgenomen in de prompt.

- De prompt wordt doorgegeven aan LangChain, die de FM in Amazon Bedrock aanroept.

- Amazon Bedrock retourneert een antwoord op het gebruikersverzoek met de verklaring Waar of Niet waar.

In dit bericht gebruiken we het Claude v2-model van Anthrophic (anthropic.claude-v2). Claude is een generatieve LLM gebaseerd op Anthropic's onderzoek naar het creëren van betrouwbare, interpreteerbare en stuurbare AI-systemen. Gemaakt met behulp van technieken zoals constitutionele AI en onschadelijkheidstraining, blinkt Claude uit in doordachte dialoog, het creëren van inhoud, complex redeneren, creativiteit en codering. Door Amazon Bedrock en onze oplossingsarchitectuur te gebruiken, hebben we echter ook de flexibiliteit om te kiezen uit andere FM's die door ons worden aangeboden Amazone, AI21labs, Samenhangen en Stabiliteit.ai.

U vindt de implementatiedetails in de volgende secties. De broncode is beschikbaar in de GitHub-repository.

Voorwaarden

Voor deze tutorial heb je een bash-terminal nodig met Python 3.9 of hoger geïnstalleerd op Linux, Mac of een Windows-subsysteem voor Linux en een AWS-account.

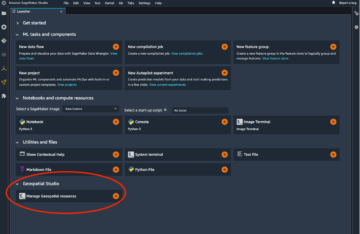

We raden ook aan om ofwel een Amazon SageMaker Studio notitieboekje, een AWS-Cloud9 bijvoorbeeld, of een Amazon Elastic Compute-cloud (Amazon EC2) instantie.

Implementeer nepnieuwsdetectie met behulp van de Amazon Bedrock API

De oplossing maakt gebruik van de Amazon Bedrock API, die toegankelijk is via de AWS-opdrachtregelinterface (AWS CLI), de AWS SDK voor Python (Boto3)of een Amazon Sage Maker notitieboekje. Verwijs naar de Amazon Bedrock-gebruikershandleiding voor meer informatie. Voor dit bericht gebruiken we de Amazon Bedrock API via de AWS SDK voor Python.

Zet de Amazon Bedrock API-omgeving op

Voer de volgende stappen uit om uw Amazon Bedrock API-omgeving in te stellen:

- Download de nieuwste Boto3 of upgrade deze:

- Zorg ervoor dat u de AWS-inloggegevens configureert met behulp van de

aws configurecommando of geef ze door aan de Boto3-client. - Installeer de nieuwste versie van LangChain:

U kunt nu uw installatie testen met behulp van het volgende Python-shellscript. Het script instantiëert de Amazon Bedrock-client met behulp van Boto3. Vervolgens bellen we met de list_foundation_models API om de lijst met funderingsmodellen op te halen die beschikbaar zijn voor gebruik.

Nadat je de voorgaande opdracht succesvol hebt uitgevoerd, zou je de lijst met FM's van Amazon Bedrock moeten krijgen.

LangChain als snelle ketenoplossing

Om nepnieuws voor een bepaalde zin te detecteren, volgen we het zero-shot Chain-of-Thought-redeneringsproces (Wei J. et al., 2022), dat uit de volgende stappen bestaat:

- In eerste instantie probeert het model een verklaring af te leggen over het gevraagde nieuws.

- Het model creëert een lijst met opsommingstekens van beweringen.

- Voor elke bewering bepaalt het model of de bewering waar of onwaar is. Merk op dat bij gebruik van deze methodologie het model uitsluitend vertrouwt op zijn interne kennis (gewichten berekend in de pre-trainingsfase) om tot een oordeel te komen. De informatie wordt op dit moment niet geverifieerd aan de hand van externe gegevens.

- Gegeven de feiten antwoordt het model WAAR of ONWAAR voor de gegeven uitspraak in de prompt.

Om deze stappen te bereiken, gebruiken we LangChain, een raamwerk voor het ontwikkelen van applicaties die worden aangedreven door taalmodellen. Met dit raamwerk kunnen we de FM’s uitbreiden door verschillende componenten aan elkaar te koppelen om geavanceerde gebruiksscenario’s te creëren. In deze oplossing gebruiken we de ingebouwde Eenvoudige sequentiële keten in LangChain om een eenvoudige sequentiële keten te creëren. Dit is erg handig, omdat we de output van de ene keten kunnen gebruiken als input voor een andere keten.

Amazon Bedrock is geïntegreerd met LangChain, dus je hoeft het alleen maar te instantiëren door de model_id bij het instantiëren van het Amazon Bedrock-object. Indien nodig kunnen de modelinferentieparameters worden verstrekt via de model_kwargs betoog, zoals:

- maxTokenCount – Het maximale aantal tokens in het gegenereerde antwoord

- stopSequences – De stopvolgorde die door het model wordt gebruikt

- temperatuur- – Een waarde tussen 0 en 1, waarbij 0 het meest deterministisch is en 1 het meest creatief

- top – Een waarde die varieert tussen 0 en 1 en wordt gebruikt om de keuzes van tokens te controleren op basis van de waarschijnlijkheid van de mogelijke keuzes

Als dit de eerste keer is dat u een basismodel van Amazon Bedrock gebruikt, zorg er dan voor dat u toegang tot het model aanvraagt door een keuze te maken uit de lijst met modellen op de Toegang tot modellen pagina op de Amazon Bedrock-console, in ons geval claude-v2 van Anthropic.

De volgende functie definieert de Chain-of-Thought-promptketen die we eerder noemden voor het detecteren van nepnieuws. De functie neemt het Amazon Bedrock-object (llm) en de gebruikersprompt (q) als argumenten. LangChain's Promptsjabloon functionaliteit wordt hier gebruikt om een recept voor het genereren van aanwijzingen vooraf te definiëren.

De volgende code roept de functie aan die we eerder hebben gedefinieerd en biedt het antwoord. De verklaring luidt TRUE or FALSE. TRUE betekent dat de verstrekte verklaring correcte feiten bevat, en FALSE betekent dat de verklaring minstens één onjuist feit bevat.

Een voorbeeld van een instructie en modelantwoord wordt gegeven in de volgende uitvoer:

ReAct en hulpmiddelen

In het voorgaande voorbeeld heeft het model correct vastgesteld dat de bewering onwaar is. Het opnieuw indienen van de vraag toont echter aan dat het model niet in staat is de juistheid van feiten te onderscheiden. Het model beschikt niet over de tools om de waarheidsgetrouwheid van uitspraken buiten zijn eigen trainingsgeheugen te verifiëren, dus daaropvolgende uitvoeringen van dezelfde prompt kunnen ertoe leiden dat valse uitspraken ten onrechte als waar worden bestempeld. In de volgende code ziet u een andere uitvoering van hetzelfde voorbeeld:

Eén techniek om de waarheidsgetrouwheid te garanderen is ReAct. Reageer (Yao S. et al., 2023) is een snelle techniek die het basismodel uitbreidt met de actieruimte van een agent. In dit bericht, evenals in het ReAct-artikel, implementeert de actieruimte het ophalen van informatie met behulp van zoek-, opzoek- en voltooi-acties vanuit een eenvoudige Wikipedia-web-API.

De reden achter het gebruik van ReAct in vergelijking met Chain-of-Thought is het gebruik van externe kennisverzameling om het basismodel uit te breiden om te detecteren of een bepaald nieuwsstuk nep of waar is.

In dit bericht gebruiken we LangChain's implementatie van ReAct via de agent ZERO_SHOT_REACT_DESCRIPTION. We passen de vorige functie aan om ReAct te implementeren en Wikipedia te gebruiken door de load_tools-functie van de langchain.agents.

We moeten ook het Wikipedia-pakket installeren:

!pip install Wikipedia

Hieronder staat de nieuwe code:

Het volgende is de uitvoer van de voorgaande functie, gegeven dezelfde instructie die eerder werd gebruikt:

Opruimen

Om kosten te besparen, verwijdert u alle resources die u als onderdeel van de zelfstudie hebt geïmplementeerd. Als u AWS Cloud9 of een EC2-instantie hebt gestart, kunt u deze verwijderen via de console of met behulp van de AWS CLI. Op dezelfde manier kunt u het SageMaker-notebook verwijderen dat u mogelijk via de SageMaker-console hebt gemaakt.

Beperkingen en aanverwant werk

Het gebied van nepnieuwsdetectie wordt actief onderzocht in de wetenschappelijke gemeenschap. In dit bericht hebben we Chain-of-Thought- en ReAct-technieken gebruikt en bij het evalueren van de technieken hebben we ons alleen gericht op de nauwkeurigheid van de prompt-techniekclassificatie (of een bepaalde bewering waar of onwaar is). Daarom hebben we geen rekening gehouden met andere belangrijke aspecten, zoals de snelheid van de reactie, en hebben we de oplossing ook niet uitgebreid naar aanvullende kennisbankbronnen naast Wikipedia.

Hoewel dit bericht zich concentreerde op twee technieken, Chain-of-Thought en ReAct, is er in een uitgebreid oeuvre onderzocht hoe LLM's nepnieuws kunnen detecteren, elimineren of beperken. Lee et al. heeft het gebruik voorgesteld van een encoder-decodermodel dat gebruik maakt van NER (named Entity Recognition) om de genoemde entiteiten te maskeren om ervoor te zorgen dat het gemaskeerde token daadwerkelijk de kennis gebruikt die in het taalmodel is gecodeerd. Chern et al. heeft FacTool ontwikkeld, dat Chain-of-Thought-principes gebruikt om claims uit de prompt te halen en vervolgens relevant bewijsmateriaal voor de claims te verzamelen. De LLM beoordeelt vervolgens de feitelijkheid van de claim op basis van de opgehaalde lijst met bewijzen. Du E. et al. presenteert een complementaire aanpak waarbij meerdere LLM's hun individuele antwoorden en redeneerprocessen gedurende meerdere rondes voorstellen en bespreken om tot een gemeenschappelijk eindantwoord te komen.

Op basis van de literatuur zien we dat de effectiviteit van LLM’s bij het detecteren van nepnieuws toeneemt wanneer de LLM’s worden uitgebreid met externe kennis en gespreksmogelijkheden met meerdere agenten. Deze benaderingen zijn echter computationeel complexer omdat ze meerdere modelaanroepen en -interacties, langere prompts en langdurige netwerklaagaanroepen vereisen. Uiteindelijk vertaalt deze complexiteit zich in hogere totale kosten. We raden u aan de kosten-prestatieverhouding te beoordelen voordat u vergelijkbare oplossingen in productie implementeert.

Conclusie

In dit bericht hebben we ons verdiept in hoe we LLM's kunnen gebruiken om het heersende probleem van nepnieuws aan te pakken, wat tegenwoordig een van de grootste uitdagingen van onze samenleving is. We zijn begonnen met het schetsen van de uitdagingen die nepnieuws met zich meebrengt, met de nadruk op het potentieel ervan om het publieke sentiment te beïnvloeden en maatschappelijke ontwrichtingen te veroorzaken.

Vervolgens introduceerden we het concept van LLM’s als geavanceerde AI-modellen die zijn getraind op een aanzienlijke hoeveelheid gegevens. Dankzij deze uitgebreide training beschikken deze modellen over een indrukwekkend taalbegrip, waardoor ze mensachtige teksten kunnen produceren. Met deze capaciteit hebben we laten zien hoe LLM’s kunnen worden ingezet in de strijd tegen nepnieuws door gebruik te maken van twee verschillende prompttechnieken: Chain-of-Thought en ReAct.

We onderstreepten hoe LLM's diensten voor factchecking op een ongeëvenaarde schaal kunnen faciliteren, gezien hun vermogen om grote hoeveelheden tekst snel te verwerken en analyseren. Dit potentieel voor realtime analyse kan leiden tot vroegtijdige detectie en beheersing van nepnieuws. We hebben dit geïllustreerd door een Python-script te maken dat, gegeven een verklaring, aan de gebruiker duidelijk maakt of het artikel waar of nep is, in natuurlijke taal.

We sloten af met het onderstrepen van de beperkingen van de huidige aanpak en sloten af met een hoopvolle noot, waarbij we benadrukten dat LLM’s, met de juiste waarborgen en voortdurende verbeteringen, onmisbare instrumenten kunnen worden in de strijd tegen nepnieuws.

We zouden graag van je horen. Laat ons weten wat je ervan vindt in het opmerkingengedeelte of gebruik het problemenforum de GitHub-repository.

Disclaimer: de code in dit bericht is uitsluitend bedoeld voor educatieve en experimentele doeleinden. Er mag niet op worden vertrouwd om nepnieuws of verkeerde informatie in echte productiesystemen op te sporen. Er worden geen garanties gegeven over de juistheid of volledigheid van de detectie van nepnieuws met behulp van deze code. Gebruikers moeten voorzichtig zijn en due diligence uitvoeren voordat ze deze technieken in gevoelige toepassingen gebruiken.

Ga naar om aan de slag te gaan met Amazon Bedrock Amazon Bedrock-console.

Over de auteurs

Anamaria Todor is een Principal Solutions Architect gevestigd in Kopenhagen, Denemarken. Ze zag haar eerste computer toen ze vier jaar oud was en heeft sindsdien computerwetenschappen, videogames en techniek nooit meer losgelaten. Ze heeft in verschillende technische rollen gewerkt, van freelancer, full-stack ontwikkelaar tot data engineer, technisch leider en CTO, bij verschillende bedrijven in Denemarken, met de nadruk op de gaming- en reclame-industrie. Ze werkt al meer dan 4 jaar bij AWS als Principal Solutions Architect, waarbij ze zich voornamelijk richt op life sciences en AI/ML. Anamaria heeft een bachelordiploma in toegepaste techniek en computerwetenschappen, een masterdiploma in computerwetenschappen en meer dan 3 jaar AWS-ervaring. Als ze niet aan het werk is of videogames speelt, coacht ze meisjes en vrouwelijke professionals in het begrijpen en vinden van hun weg door technologie.

Anamaria Todor is een Principal Solutions Architect gevestigd in Kopenhagen, Denemarken. Ze zag haar eerste computer toen ze vier jaar oud was en heeft sindsdien computerwetenschappen, videogames en techniek nooit meer losgelaten. Ze heeft in verschillende technische rollen gewerkt, van freelancer, full-stack ontwikkelaar tot data engineer, technisch leider en CTO, bij verschillende bedrijven in Denemarken, met de nadruk op de gaming- en reclame-industrie. Ze werkt al meer dan 4 jaar bij AWS als Principal Solutions Architect, waarbij ze zich voornamelijk richt op life sciences en AI/ML. Anamaria heeft een bachelordiploma in toegepaste techniek en computerwetenschappen, een masterdiploma in computerwetenschappen en meer dan 3 jaar AWS-ervaring. Als ze niet aan het werk is of videogames speelt, coacht ze meisjes en vrouwelijke professionals in het begrijpen en vinden van hun weg door technologie.

Marcel Castro is een Senior Solutions Architect gevestigd in Oslo, Noorwegen. In zijn rol helpt Marcel klanten met architectuur, ontwerp en ontwikkeling van een voor de cloud geoptimaliseerde infrastructuur. Hij is lid van het AWS Generative AI Ambassador-team met als doel EMEA-klanten te begeleiden en te ondersteunen op hun generatieve AI-reis. Hij heeft een doctoraat in computerwetenschappen uit Zweden en een master- en bachelordiploma in elektrotechniek en telecommunicatie uit Brazilië.

Marcel Castro is een Senior Solutions Architect gevestigd in Oslo, Noorwegen. In zijn rol helpt Marcel klanten met architectuur, ontwerp en ontwikkeling van een voor de cloud geoptimaliseerde infrastructuur. Hij is lid van het AWS Generative AI Ambassador-team met als doel EMEA-klanten te begeleiden en te ondersteunen op hun generatieve AI-reis. Hij heeft een doctoraat in computerwetenschappen uit Zweden en een master- en bachelordiploma in elektrotechniek en telecommunicatie uit Brazilië.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- : heeft

- :is

- :niet

- :waar

- $ 100 miljoen

- $UP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21

- 26%

- 27

- 32

- 36

- 7

- 9

- a

- vermogen

- Over

- boven

- AC

- academische

- academisch onderzoek

- Academy

- toegang

- geraadpleegde

- beschikbaar

- Account

- accounts

- nauwkeurigheid

- Bereiken

- prestaties

- over

- waarnemend

- Actie

- acties

- actief

- actoren

- werkelijk

- toevoegen

- toevoeging

- Extra

- vergevorderd

- komst

- ADVERTISING

- weer

- tegen

- Agent

- agenten

- AI

- AI-modellen

- AI-systemen

- AI / ML

- AL

- Alles

- toestaat

- alleen

- ook

- Hoewel

- Amazone

- Amazon EC2

- Amazon Web Services

- Ambassadeur

- Amerikaans

- onder

- hoeveelheden

- an

- analyse

- analyseren

- Oude

- en

- Jaarlijks

- Nog een

- beantwoorden

- antwoorden

- antropisch

- elke

- api

- APIs

- komt naar voren

- Aanvraag

- toepassingen

- toegepast

- benoemd

- nadering

- benaderingen

- ongeveer

- architectuur

- ZIJN

- argument

- argumenten

- rond

- dit artikel

- kunstmatig

- kunstmatige intelligentie

- Kunstmatige intelligentie (AI)

- Kunst

- AS

- aspecten

- Het beoordelen

- assessments

- veronderstellingen

- verzekerd

- astronomie

- At

- pogingen

- vergroten

- aangevuld

- augments

- geautomatiseerde

- Beschikbaar

- Bekroond

- AWS

- AWS-Cloud9

- baseren

- gebaseerde

- slaan

- Strijd

- BE

- omdat

- worden

- worden

- geweest

- vaardigheden

- gedrag

- achter

- wezen

- overtuigingen

- behalve

- tussen

- Verder

- vooringenomenheid

- Miljard

- biologie

- biomedische

- lichaam

- zowel

- bots

- Brazilië

- brengen

- Kapot

- ingebouwd

- zakenman

- maar

- by

- Bellen

- oproepen

- CAN

- mogelijkheden

- bekwaamheid

- Inhoud

- geval

- gevallen

- Veroorzaken

- voorzichtigheid

- Eeuw

- keten

- ketens

- uitdagingen

- chang

- controle

- chemie

- Chinese

- keuzes

- Kies

- aanspraak maken op

- vorderingen

- klasse

- classificatie

- duidelijk

- klant

- Sluiten

- Cloud9

- coaching

- code

- codering

- cognitieve

- verzamelen

- Collective

- College

- COLUMBIA

- combinatie van

- opmerkingen

- Gemeen

- algemeen

- gemeenschap

- Bedrijven

- vergelijking

- complementair

- compleet

- complex

- ingewikkeldheid

- componenten

- samengesteld

- Berekenen

- computer

- Computer Science

- concept

- gesloten

- Bevestigen

- bevestiging

- samenwerking

- bijgevolg

- beschouwd

- consequent

- bestaat uit

- troosten

- consumeren

- Consumenten

- consumptie

- Insluiting

- bevat

- content

- content creatie

- doorlopend

- bijdrage

- onder controle te houden

- controles

- Gesprek

- te corrigeren

- correct

- Kosten

- Kosten

- kon

- landen

- Land

- en je merk te creëren

- aangemaakt

- creëert

- Wij creëren

- het aanmaken

- Creatieve

- creativiteit

- Geloofsbrieven

- CTO

- Culture

- beteugelen

- Actueel

- Klanten

- gegevens

- debat

- beslissingen

- gedefinieerd

- definieert

- Mate

- democratisch

- gedemonstreerd

- demonstreert

- demonstrating

- Denemarken

- afdeling

- ingezet

- het inzetten

- Design

- gegevens

- opsporen

- Opsporing

- Bepalen

- bepaalt

- ontwikkelde

- Ontwikkelaar

- het ontwikkelen van

- Ontwikkeling

- ontwikkelingen

- Dialoog

- anders

- ijver

- richting

- bespreken

- disinformatie

- Display

- verstoringen

- onderscheiden

- wantrouwen

- dokter

- doet

- Nee

- beneden

- dr

- rit

- twee

- gedurende

- e

- E & T

- elk

- Vroeger

- Vroeg

- verdienen

- verdiend

- aarde

- gemakkelijker

- En het is heel gemakkelijk

- Economie

- economie

- onderwijs

- opvoeders

- effect

- effectiviteit

- beide

- elimineren

- elders

- EMEA

- opkomst

- nadruk

- waardoor

- afgelopen

- ingenieur

- Engineering

- uitbreidingen

- verzekeren

- het invoeren van

- entiteiten

- entiteit

- Milieu

- gelijkheid

- fouten

- vooral

- gevestigd

- evalueren

- Zelfs

- EVENTS

- evoluerende

- voorbeeld

- voorbeelden

- uitsluitend

- Oefening

- ervaring

- Verklaren

- Verken

- Nagegaan

- uitgebreid

- extern

- extract

- vergemakkelijken

- vergemakkelijkt

- feit

- factoren

- feiten

- FAIL

- nep

- nep-nieuws

- vals

- beroemd

- vrouw

- veld-

- vechten

- fills

- finale

- financieel

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- het vinden van

- afmaken

- Voornaam*

- eerste keer

- Flexibiliteit

- gericht

- richt

- gericht

- volgen

- volgend

- Voor

- formulier

- formeel

- Forum

- Foundation

- fundamentele

- Opgericht

- Achtergrond

- oppompen van

- fu

- geheel

- functie

- functionaliteit

- Spellen

- gaming

- hiaten

- Geslacht

- Geslachtsgelijkheid

- Algemeen

- voortbrengen

- gegenereerde

- het genereren van

- generatie

- generatief

- generatieve AI

- krijgen

- meisjes

- GitHub

- gegeven

- Go

- doel

- groot

- Ground

- garanties

- HAD

- harnas

- Hebben

- he

- horen

- hulp

- helpt

- haar

- hier

- hoogwaardige

- hoger

- highlights

- zeer

- zijn

- geschiedenis

- houdt

- eren en respecteren

- hoopvol

- behuizing

- Hoe

- How To

- Echter

- HTML

- http

- HTTPS

- menselijk

- i

- IBM

- geïdentificeerd

- if

- Onwettig

- illustreren

- afbeeldingen

- Impact

- uitvoeren

- uitvoering

- gereedschap

- importeren

- belangrijk

- indrukwekkend

- verbeterd

- in

- onvermogen

- omvatten

- omvat

- Inclusief

- Incorporated

- omvat

- meer

- Verhoogt

- geeft aan

- individueel

- industrieën

- informatie

- informeert

- Infrastructuur

- eerste

- invoer

- binnen

- installeren

- geïnstalleerd

- instantie

- Instituut

- instellingen

- geïntegreerde

- Intelligentie

- aandachtig

- interacties

- intern

- Internet

- in

- geïntroduceerd

- oproept

- betrokken zijn

- kwestie

- problemen

- IT

- HAAR

- jpg

- json

- rechters

- kenneth

- blijven

- kennis

- bekend

- Gebrek

- taal

- Groot

- Laat

- laatste

- Latijns

- gelanceerd

- lagen

- leiden

- leidend

- leren

- minst

- wettelijk

- laten

- Life

- Bio

- als

- beperkingen

- Lijn

- links

- linux

- Lijst

- opgesomd

- literatuur

- LLM

- logisch

- langer

- lookup

- liefde

- Mac

- machine

- machine learning

- gemaakt

- voornamelijk

- onderhoudt

- groot

- maken

- MERKEN

- maken

- beheerd

- management

- veel

- Marketing

- maskeren

- master's

- wiskundig

- wiskunde

- maximaal

- Mei..

- middel

- betekende

- Media

- medisch

- geneeskunde

- lid

- Leden

- Geheugen

- vermeld

- Methodologie

- Michigan

- miljoen

- mijnen

- Desinformatie

- misleidend

- MIT

- Verzachten

- mengen

- ML

- model

- modellen

- wijzigen

- meer

- meest

- beweging

- meervoudig

- my

- Genoemd

- NASA

- nationaal

- Naturel

- NATUUR

- Noodzaak

- nodig

- netwerk

- nooit

- New

- nieuws

- volgende

- geen

- Nobel laureaat

- normen

- Noorwegen

- opvallend

- notitieboekje

- nu

- aantal

- object

- observatie

- oktober

- of

- aangeboden

- vaak

- Oud

- on

- EEN

- online.

- Slechts

- Operations

- Advies

- or

- bestellen

- origineel

- Overige

- anders-

- onze

- outlines

- schetsen

- uitgang

- uitstekend

- over

- totaal

- het te bezitten.

- eigendom

- Tempo

- pakket

- pagina

- paginas

- Papier

- parameters

- deel

- passeren

- voorbij

- Voorbijgaand

- Octrooien

- pad

- Patronen

- Mensen

- Uitvoeren

- persoonlijk

- fase

- phd

- een fenomeen

- filosofie

- Fysica

- stuk

- centraal

- Plato

- Plato gegevensintelligentie

- PlatoData

- spelen

- punt

- politiek

- mogelijk

- Post

- potentieel

- energie

- aangedreven

- gepresenteerd

- cadeautjes

- pers

- heersend

- vorig

- die eerder

- in de eerste plaats

- Principal

- principes

- het drukken

- Drukpers

- Voorafgaand

- prijzen

- probleem

- processen

- produceren

- productie

- professionals

- diepgaand

- Programma

- voorstellen

- voorgestelde

- zorgen voor

- mits

- providers

- biedt

- het verstrekken van

- Psychologie

- publiek

- inkomsten

- doeleinden

- Python

- kwaliteit

- hoeveelheid

- snel

- Radio

- willekeurige

- ranges

- gerangschikt

- snel

- snel

- verhouding

- bereiken

- Reageren

- echte wereld

- real-time

- reden

- ontvangen

- ontvangen

- recept

- erkenning

- adviseren

- verwijzen

- verwijst

- verwant

- relatief

- relevante

- betrouwbaar

- HERHAALDELIJK

- bewaarplaats

- te vragen

- vereisen

- nodig

- onderzoek

- resoneert

- Resources

- Reageren

- antwoord

- reacties

- verantwoordelijk

- terugkeer

- Retourneren

- Rijk

- Risico

- Rol

- rollen

- rondes

- lopen

- lopend

- loopt

- s

- waarborgen

- sagemaker

- dezelfde

- Bespaar

- zagen

- Scale

- School

- School of Engineering

- Wetenschap

- WETENSCHAPPEN

- wetenschappelijk

- wetenschappers

- script

- sdk

- Ontdek

- sectie

- secties

- zien

- selecteren

- senior

- gevoelig

- zin

- sentiment

- Volgorde

- service

- Diensten

- reeks

- setup

- Delen

- gedeeld

- Aandelen

- delen

- ze

- Shell

- moet

- tonen

- gelijk

- evenzo

- Eenvoudig

- sinds

- zus

- So

- Social

- social media

- maatschappelijk

- Maatschappij

- oplossing

- Oplossingen

- sommige

- bron

- broncode

- bronnen

- Tussenruimte

- overspannen

- specifiek

- snelheid

- verspreiden

- verspreiding

- Stadium

- standaard

- stanford

- Stanford University

- gestart

- Statement

- verklaringen

- Staten

- Stappen

- stop

- Storm

- Strategie

- versterking

- structuur

- Leerlingen

- Studie

- volgend

- wezenlijk

- Met goed gevolg

- dergelijk

- stel

- OVERZICHT

- overbelasten

- ondersteuning

- zeker

- Zwaaien

- Zweden

- snel

- synthese

- Systems

- aanpakken

- Nemen

- neemt

- Taak

- taken

- team

- Technisch

- techniek

- technieken

- technologisch

- Technologie

- telecommunicatie

- sjabloon

- terminal

- termen

- proef

- tekst

- tekstueel

- dat

- De

- de informatie

- De Bron

- de wereld

- hun

- Ze

- harte

- Er.

- daarbij

- daarom

- Deze

- ze

- denken

- van derden

- dit

- die

- gedachte

- Door

- overal

- BINDEN

- niet de tijd of

- tijdlijn

- naar

- samen

- teken

- tokens

- tools

- getraind

- Trainingen

- waar

- waarheid

- zelfstudie

- twee

- Tenslotte

- onderstreepte

- begrip

- United

- Verenigde Staten

- Universiteiten

- universiteit-

- ongeëvenaard

- zonder precedent

- tot

- upgrade

- op

- us

- .

- gebruikt

- Gebruiker

- gebruikers

- toepassingen

- gebruik

- Gebruik makend

- waarde

- divers

- groot

- Vonnis

- geverifieerd

- controleren

- versie

- zeer

- via

- Video

- video games

- Bezoek

- was

- we

- web

- webservices

- GOED

- Wat

- wanneer

- of

- welke

- en

- WIE

- geheel

- Waarom

- Wikipedia

- wil

- ruiten

- Met

- binnen

- vrouw

- Dames

- Won

- Woord

- woorden

- Mijn werk

- werkte

- workflow

- werkzaam

- wereld

- waard

- Verkeerd

- jaar

- You

- Your

- zephyrnet