Grote taalmodellen (LLM's) kunnen met hun brede kennis mensachtige teksten over vrijwel elk onderwerp genereren. Hun training in enorme datasets beperkt echter ook hun bruikbaarheid voor gespecialiseerde taken. Zonder voortdurend leren blijven deze modellen zich niet bewust van nieuwe gegevens en trends die na hun initiële training naar voren komen. Bovendien kunnen de kosten voor het opleiden van nieuwe LLM's voor veel bedrijfsomgevingen onbetaalbaar blijken. Het is echter mogelijk om een modelantwoord te vergelijken met de oorspronkelijke gespecialiseerde inhoud, waardoor de noodzaak wordt vermeden om een nieuw LLM-model te trainen met behulp van Retrieval-Augmented Generation (RAG).

RAG ondersteunt LLM's door hen de mogelijkheid te geven externe kennis op te halen en te integreren. In plaats van uitsluitend te vertrouwen op hun vooraf getrainde kennis, stelt RAG modellen in staat gegevens uit documenten, databases en meer te halen. Het model integreert deze externe informatie vervolgens vakkundig in de gegenereerde tekst. Door contextrelevante gegevens te verzamelen, kan het model weloverwogen, actuele antwoorden bieden die zijn afgestemd op uw gebruiksscenario. De kennisvergroting verkleint ook de kans op hallucinaties en onnauwkeurige of onzinnige teksten. Met RAG worden basismodellen aanpasbare experts die evolueren naarmate uw kennisbasis groeit.

Vandaag zijn we verheugd om drie generatieve AI-demo's te onthullen, onder licentie MIT-0-licentie:

- Amazon Kendra met fundamentele LLM – Maakt gebruik van de diepgaande zoekmogelijkheden van Amazon Kendra gecombineerd met de uitgebreide kennis van LLM's. Deze integratie biedt nauwkeurige en contextbewuste antwoorden op complexe vragen door gebruik te maken van een breed scala aan bronnen.

- Inbeddingsmodel met fundamentele LLM – Combineert de kracht van inbedding (een techniek om semantische betekenissen van woorden en zinnen vast te leggen) met de enorme kennisbasis van LLM's. Deze synergie maakt nauwkeurigere onderwerpmodellering, inhoudsaanbeveling en semantische zoekmogelijkheden mogelijk.

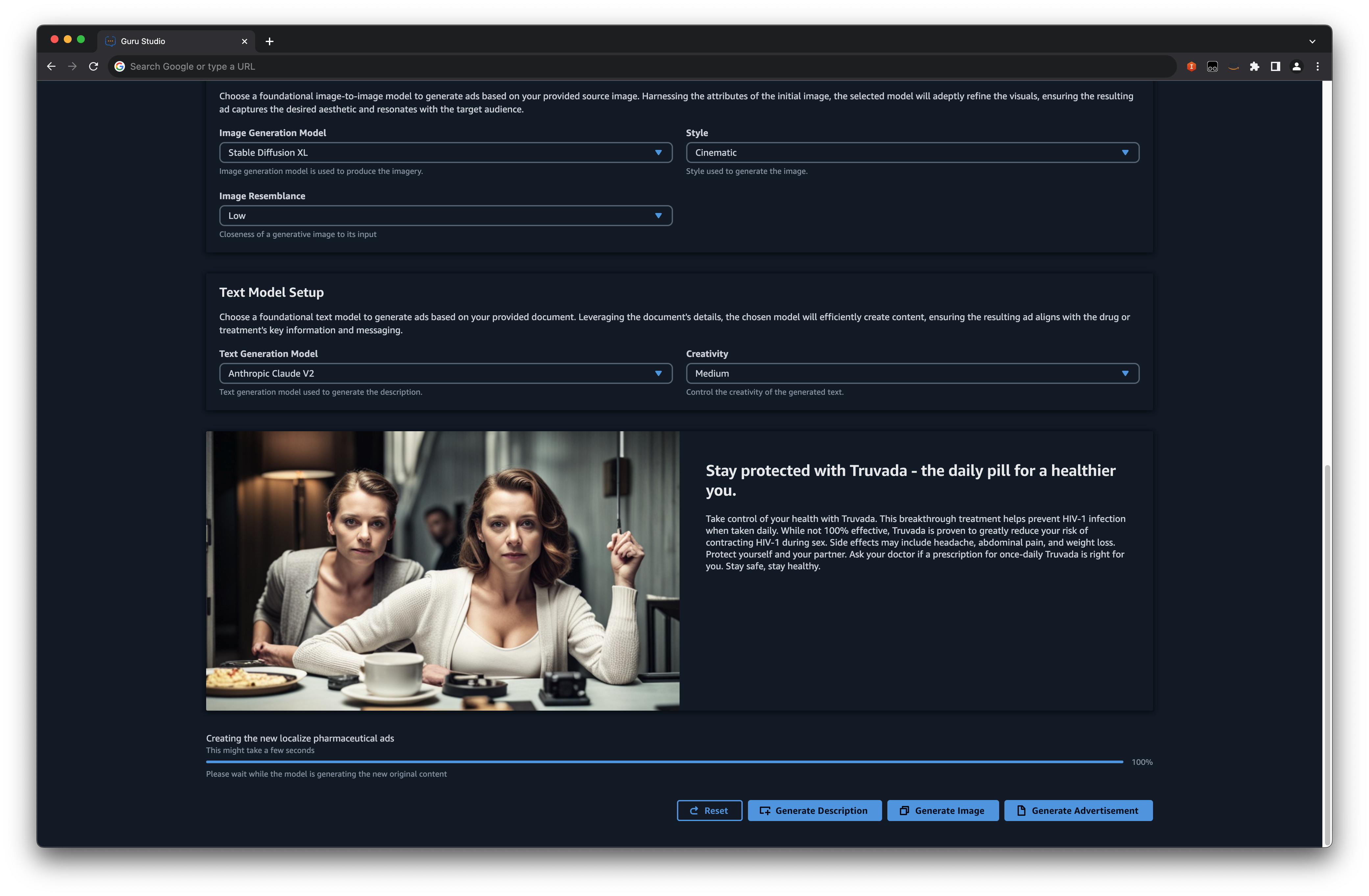

- Foundation Models Pharma Advertentiegenerator – Een gespecialiseerde toepassing op maat voor de farmaceutische industrie. Deze tool maakt gebruik van de generatieve mogelijkheden van fundamentele modellen en creëert overtuigende en conforme farmaceutische advertenties, waardoor de inhoud voldoet aan de industrienormen en -regelgeving.

Deze demo's kunnen naadloos worden geïmplementeerd in uw AWS-account en bieden fundamentele inzichten en begeleiding bij het gebruik van AWS-services om een ultramoderne LLM generatieve AI-vraag- en antwoordbot en het genereren van inhoud te creëren.

In dit bericht onderzoeken we hoe RAG in combinatie met Amazon Kendra of aangepaste insluitingen deze uitdagingen kan overwinnen en verfijnde antwoorden kan bieden op vragen in natuurlijke taal.

Overzicht oplossingen

Door deze oplossing te gebruiken, kunt u de volgende voordelen behalen:

- Verbeterde toegang tot informatie – Met RAG kunnen modellen informatie uit grote externe bronnen halen, wat vooral nuttig kan zijn als de kennis van het vooraf getrainde model verouderd of onvolledig is.

- Schaalbaarheid – In plaats van een model te trainen op alle beschikbare gegevens, stelt RAG modellen in staat om relevante informatie on-the-fly op te halen. Dit betekent dat zodra nieuwe gegevens beschikbaar komen, deze aan de ophaaldatabase kunnen worden toegevoegd zonder dat het hele model opnieuw hoeft te worden getraind.

- geheugen efficiëntie – LLM's vereisen aanzienlijk geheugen om parameters op te slaan. Met RAG kan het model kleiner zijn omdat het niet alle details hoeft te onthouden; het kan ze ophalen wanneer dat nodig is.

- Dynamische kennisupdate – In tegenstelling tot conventionele modellen met een vast kenniseindpunt kan de externe database van RAG regelmatig worden bijgewerkt, waardoor het model toegang krijgt tot actuele informatie. De ophaalfunctie kan worden afgestemd op verschillende taken. Een medisch-diagnostische taak kan bijvoorbeeld gegevens uit medische tijdschriften halen, waardoor het model deskundige en relevante inzichten oplevert.

- Vermindering van bias – De mogelijkheid om te putten uit een goed samengestelde database biedt de mogelijkheid om vooroordelen te minimaliseren door te zorgen voor evenwichtige en onpartijdige externe bronnen.

Voordat je ingaat op de integratie van Amazon Kendra met fundamentele LLM's, is het van cruciaal belang dat je jezelf uitrust met de nodige tools en systeemvereisten. Het hebben van de juiste configuratie is de eerste stap naar een naadloze implementatie van de demo’s.

Voorwaarden

Je moet de volgende voorwaarden hebben:

Hoewel het mogelijk is om de infrastructuur die in deze tutorial wordt beschreven vanaf uw lokale computer in te stellen en te implementeren, AWS-Cloud9 biedt een handig alternatief. Vooraf uitgerust met tools zoals AWS CLI, AWS CDK en Docker, kan AWS Cloud9 functioneren als uw implementatiewerkstation. Om deze service eenvoudig te gebruiken de omgeving opzetten via de AWS Cloud9-console.

Laten we, nu de vereisten uit de weg zijn, eens duiken in de functies en mogelijkheden van Amazon Kendra met fundamentele LLM's.

Amazon Kendra met fundamentele LLM

Amazon Kendra is een geavanceerde zoekservice voor ondernemingen, uitgebreid met machine learning (ML), die kant-en-klare semantische zoekmogelijkheden biedt. Door gebruik te maken van natuurlijke taalverwerking (NLP) begrijpt Amazon Kendra zowel de inhoud van documenten als de onderliggende bedoeling van gebruikersvragen, en positioneert het als een hulpmiddel voor het ophalen van inhoud voor op RAG gebaseerde oplossingen. Door de uiterst nauwkeurige zoekinhoud van Kendra als RAG-payload te gebruiken, kunt u betere LLM-reacties krijgen. Het gebruik van Amazon Kendra in deze oplossing maakt ook gepersonaliseerd zoeken mogelijk door antwoorden te filteren op basis van de toegangsrechten van de eindgebruiker tot inhoud.

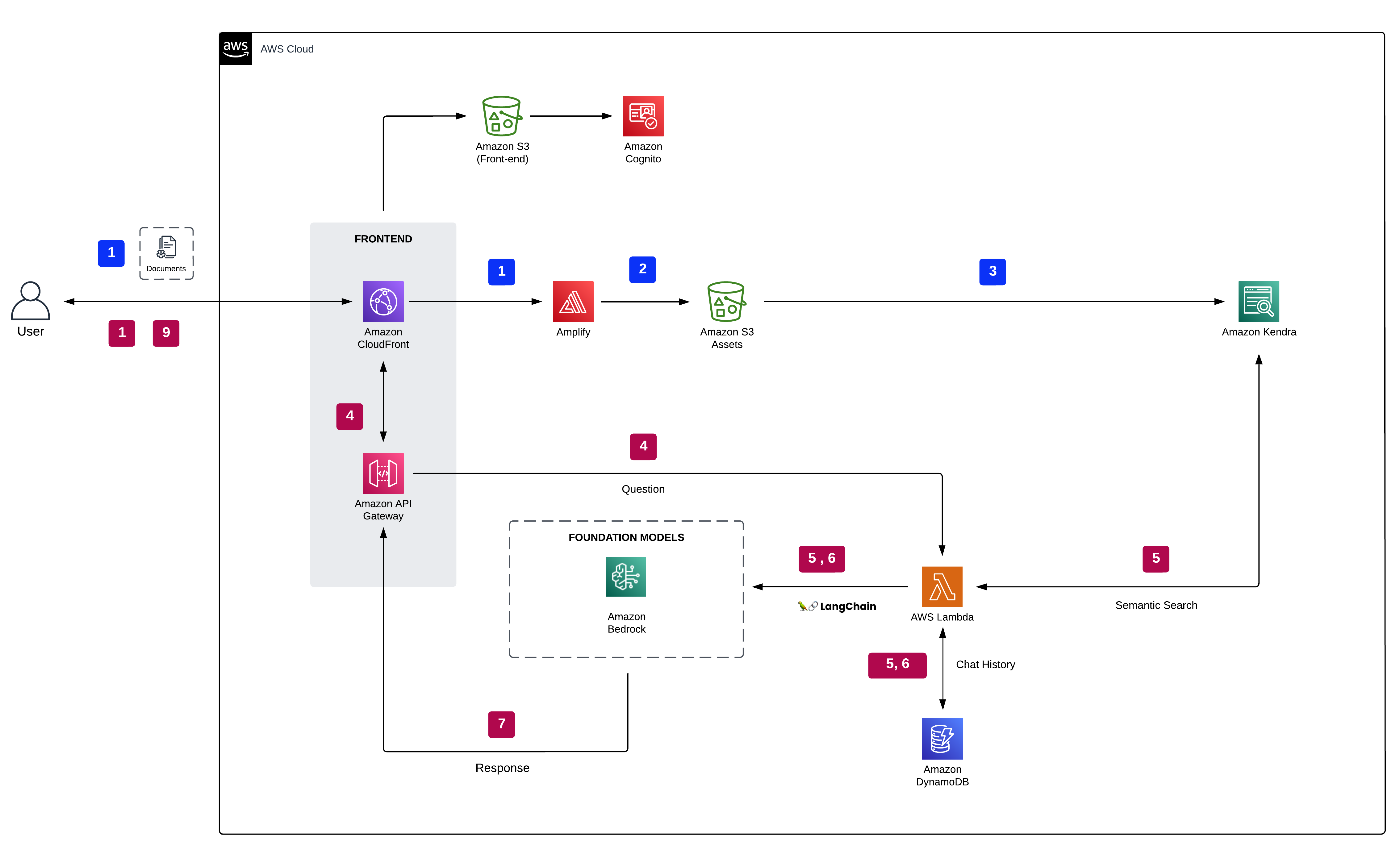

Het volgende diagram toont de architectuur van een generatieve AI-toepassing met behulp van de RAG-aanpak.

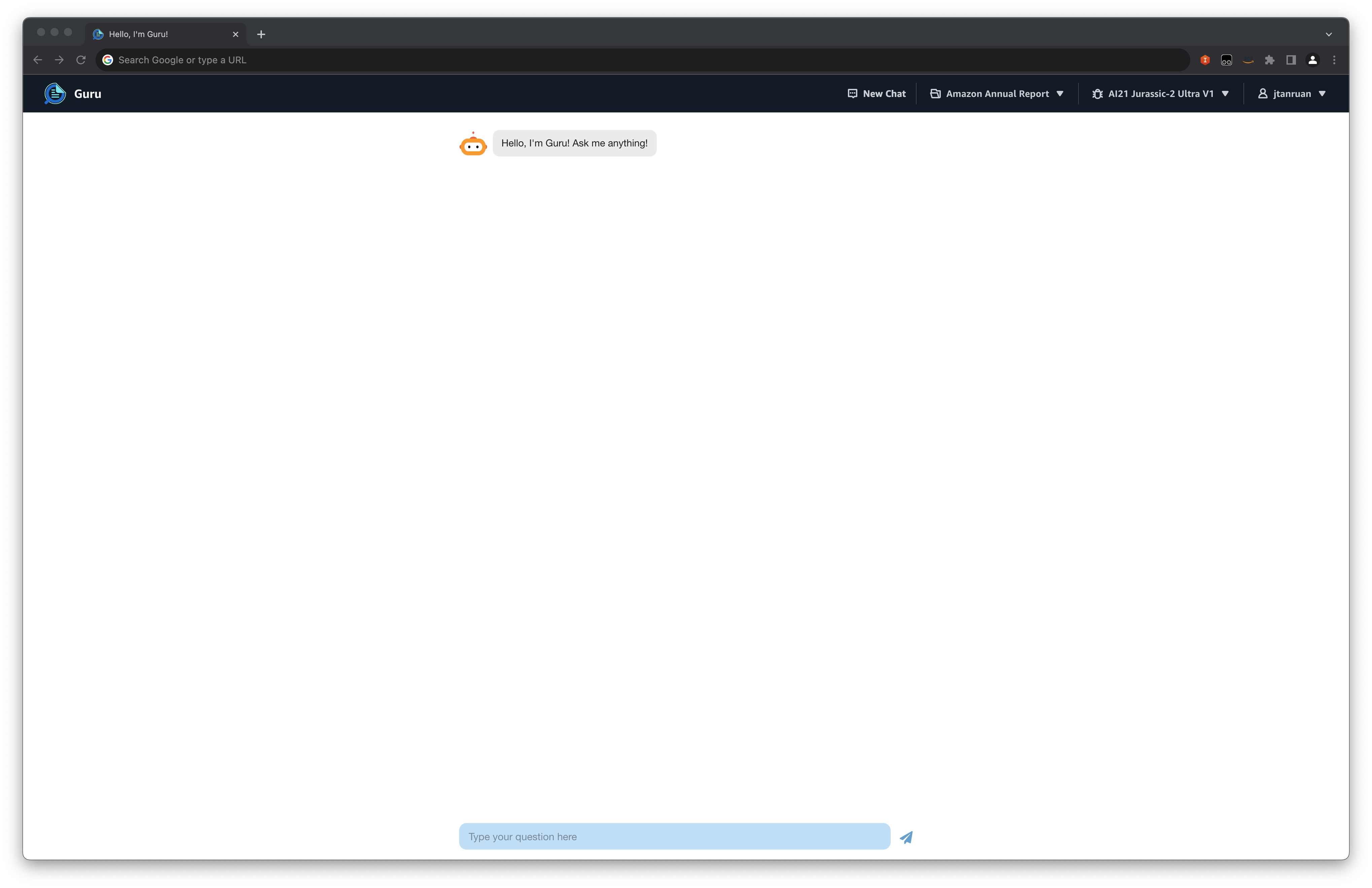

Documenten worden door Amazon Kendra verwerkt en geïndexeerd via de Eenvoudige opslagservice van Amazon (Amazon S3) aansluiting. Klantverzoeken en contextuele gegevens van Amazon Kendra worden doorgestuurd naar een Amazonebodem funderingsmodel. Met de demo kun je kiezen tussen de Titan-, AI21-Jurassic- en Anthropic-Claude-modellen van Amazon, ondersteund door Amazon Bedrock. De gespreksgeschiedenis wordt opgeslagen in Amazon DynamoDB, waardoor de LLM extra context krijgt om reacties te genereren.

We hebben deze demo aangeboden in de GitHub repo. Raadpleeg de implementatie-instructies in het leesmij-bestand om het in uw AWS-account te implementeren.

De volgende stappen schetsen het proces wanneer een gebruiker interactie heeft met de generatieve AI-app:

- De gebruiker logt in op de webapp, geverifieerd door Amazon Cognito.

- De gebruiker uploadt een of meer documenten naar Amazon S3.

- De gebruiker voert een Amazon Kendra-synchronisatietaak uit om S3-documenten in de Amazon Kendra-index op te nemen.

- De vraag van de gebruiker wordt doorgestuurd via een beveiligde WebSocket API die wordt gehost op Amazon API-gateway ondersteund door een AWS Lambda functie.

- De Lambda-functie, mogelijk gemaakt door de LangChain framework – een veelzijdige tool die is ontworpen voor het maken van applicaties die worden aangestuurd door AI-taalmodellen – maakt verbinding met het Amazon Bedrock-eindpunt om de vraag van de gebruiker opnieuw te formuleren op basis van de chatgeschiedenis. Na herformulering wordt de vraag doorgestuurd naar Amazon Kendra met behulp van de Retrieve API. Als reactie hierop geeft de Amazon Kendra-index zoekresultaten weer, met fragmenten uit relevante documenten die afkomstig zijn uit de door het bedrijf verwerkte gegevens.

- De vraag van de gebruiker wordt samen met de uit de index opgehaalde gegevens als context in de LLM-prompt verzonden. Het antwoord van de LLM wordt opgeslagen als chatgeschiedenis binnen DynamoDB.

- Ten slotte wordt het antwoord van de LLM teruggestuurd naar de gebruiker.

Workflow voor documentindexering

Hieronder volgt de procedure voor het verwerken en indexeren van documenten:

- Gebruikers dienen documenten in via de gebruikersinterface (UI).

- Documenten worden overgebracht naar een S3-bucket met behulp van de AWS versterken API.

- Amazon Kendra indexeert nieuwe documenten in de S3-bucket via de Amazon Kendra S3-connector.

Voordelen

De volgende lijst benadrukt de voordelen van deze oplossing:

- Ophalen op ondernemingsniveau – Amazon Kendra is ontworpen voor enterprise search, waardoor het geschikt is voor organisaties met grote hoeveelheden gestructureerde en ongestructureerde gegevens.

- Semantisch begrip – De ML-mogelijkheden van Amazon Kendra zorgen ervoor dat het ophalen gebaseerd is op diepgaand semantisch begrip en niet alleen op trefwoordovereenkomsten.

- Schaalbaarheid – Amazon Kendra kan omgaan met grootschalige gegevensbronnen en biedt snelle en relevante zoekresultaten.

- Flexibiliteit – Het fundamentele model kan antwoorden genereren op basis van een breed scala aan contexten, waardoor het systeem veelzijdig blijft.

- Integratiemogelijkheden – Amazon Kendra kan worden geïntegreerd met verschillende AWS-services en gegevensbronnen, waardoor het kan worden aangepast aan verschillende organisatorische behoeften.

Inbeddingsmodel met fundamentele LLM

An inbedding is een numerieke vector die de kernessentie van diverse gegevenstypen vertegenwoordigt, waaronder tekst, afbeeldingen, audio en documenten. Deze weergave legt niet alleen de intrinsieke betekenis van de gegevens vast, maar past deze ook aan voor een breed scala aan praktische toepassingen. Embedding-modellen, een tak van ML, transformeren complexe gegevens, zoals woorden of zinsdelen, in continue vectorruimten. Deze vectoren grijpen inherent de semantische verbindingen tussen gegevens aan, waardoor diepere en meer inzichtelijke vergelijkingen mogelijk zijn.

RAG combineert naadloos de sterke punten van fundamentele modellen, zoals transformatoren, met de precisie van inbedding om enorme databases te doorzoeken op zoek naar relevante informatie. Wanneer het systeem een zoekopdracht ontvangt, gebruikt het inbedding om relevante secties uit een uitgebreide hoeveelheid gegevens te identificeren en te extraheren. Het fundamentele model formuleert vervolgens een contextueel nauwkeurig antwoord op basis van deze geëxtraheerde informatie. Dankzij deze perfecte synergie tussen het ophalen van gegevens en het genereren van antwoorden kan het systeem grondige antwoorden bieden, voortbouwend op de enorme kennis die is opgeslagen in uitgebreide databases.

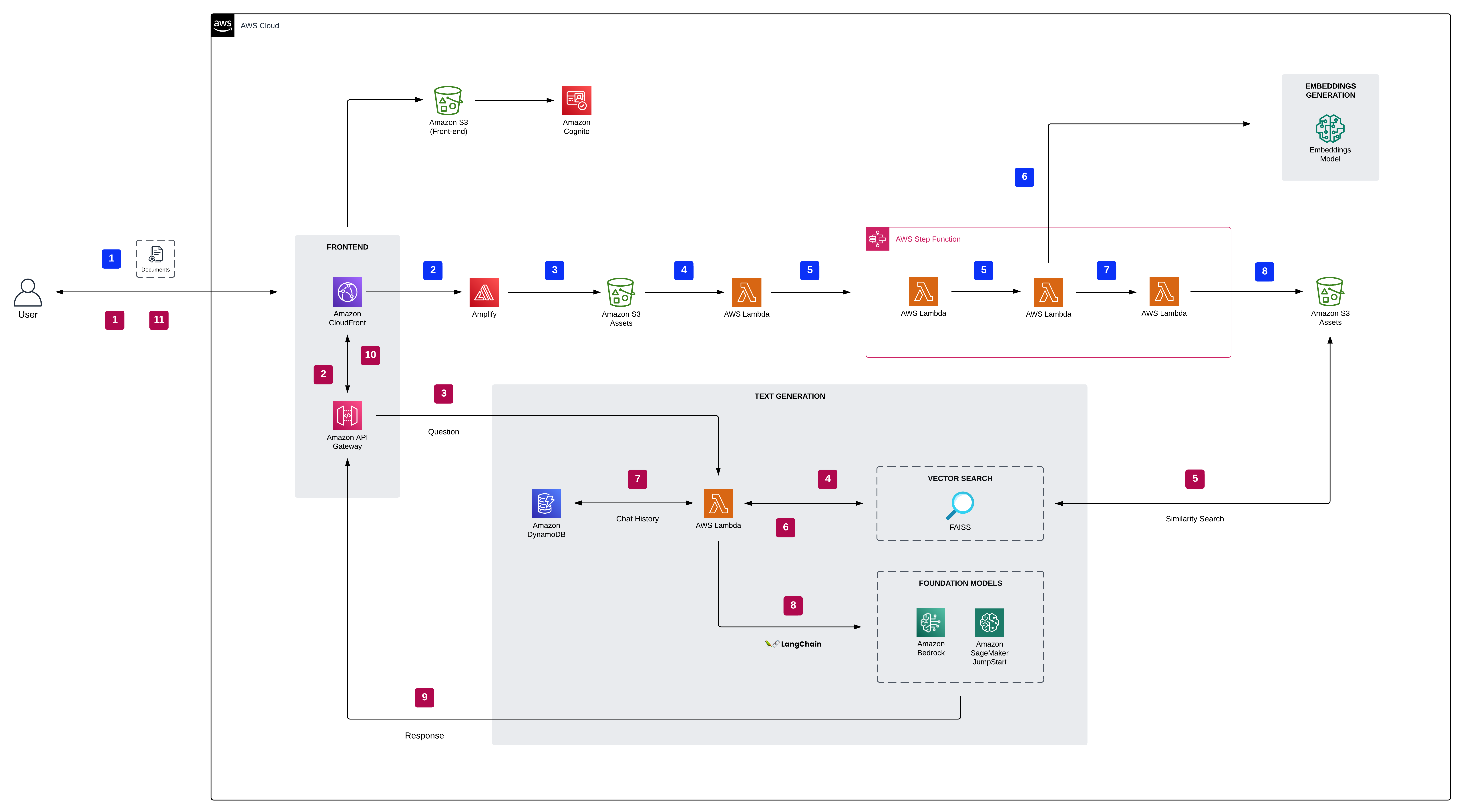

In de architecturale lay-out worden gebruikers, op basis van hun UI-selectie, naar de Amazon Bedrock of Amazon SageMaker JumpStart funderingsmodellen. Documenten worden verwerkt en vectorinbeddingen worden geproduceerd door het inbeddingsmodel. Deze insluitingen worden vervolgens geïndexeerd met behulp van FAISS om efficiënt semantisch zoeken mogelijk te maken. Gespreksgeschiedenissen worden bewaard in DynamoDB, waardoor de context voor de LLM wordt verrijkt om antwoorden te formuleren.

Het volgende diagram illustreert de oplossingsarchitectuur en workflow.

We hebben deze demo aangeboden in de GitHub repo. Raadpleeg de implementatie-instructies in het leesmij-bestand om het in uw AWS-account te implementeren.

Inbeddingsmodel

De verantwoordelijkheden van het inbeddingsmodel zijn als volgt:

- Dit model is verantwoordelijk voor het omzetten van tekst (zoals documenten of passages) in dichte vectorrepresentaties, algemeen bekend als inbedding.

- Deze inbedding legt de semantische betekenis van de tekst vast, waardoor efficiënte en semantisch betekenisvolle vergelijkingen tussen verschillende stukken tekst mogelijk zijn.

- Het inbeddingsmodel kan worden getraind op hetzelfde uitgebreide corpus als het fundamentele model, of kan worden gespecialiseerd voor specifieke domeinen.

Vraag-en-antwoordworkflow

De volgende stappen beschrijven de workflow van het beantwoorden van vragen over documenten:

- De gebruiker logt in op de webapp die is geverifieerd door Amazon Cognito.

- De gebruiker uploadt een of meer documenten naar Amazon S3.

- Bij documentoverdracht activeert een S3-gebeurtenismelding een Lambda-functie, die vervolgens het eindpunt van het SageMaker-insluitingsmodel aanroept om insluitingen voor het nieuwe document te genereren. Het embeddingsmodel zet de vraag om in een dichte vectorrepresentatie (embedding). Het resulterende vectorbestand wordt veilig opgeslagen in de S3-bucket.

- De FAISS-retriever vergelijkt deze vraaginbedding met de inbedding van alle documenten of passages in de database om de meest relevante passages te vinden.

- De passages worden, samen met de vraag van de gebruiker, gegeven als context voor het fundamentele model. De Lambda-functie maakt gebruik van de LangChain-bibliotheek en maakt verbinding met het Amazon Bedrock- of SageMaker JumpStart-eindpunt met een contextrijke query.

- Het antwoord van de LLM wordt opgeslagen in DynamoDB, samen met de zoekopdracht van de gebruiker, de tijdstempel, een unieke identificatie en andere willekeurige identificatiegegevens voor het item, zoals de vraagcategorie. Door de vraag en het antwoord als afzonderlijke items op te slaan, kan de Lambda-functie eenvoudig de gespreksgeschiedenis van een gebruiker opnieuw creëren op basis van het tijdstip waarop vragen werden gesteld.

- Ten slotte wordt het antwoord teruggestuurd naar de gebruiker via een HTTPs-verzoek via het API Gateway WebSocket API-integratieantwoord.

Voordelen

In de volgende lijst worden de voordelen van deze oplossing beschreven:

- Semantisch begrip – Het inbeddingsmodel zorgt ervoor dat de retriever passages selecteert op basis van diepgaand semantisch begrip, en niet alleen op trefwoordovereenkomsten.

- Schaalbaarheid – Inbedding maakt efficiënte gelijkenisvergelijkingen mogelijk, waardoor het mogelijk wordt om snel door enorme databases met documenten te zoeken.

- Flexibiliteit – Het fundamentele model kan antwoorden genereren op basis van een breed scala aan contexten, waardoor het systeem veelzijdig blijft.

- Aanpasbaarheid van domeinen – Het embeddingsmodel kan worden getraind of verfijnd voor specifieke domeinen, waardoor het systeem kan worden aangepast voor verschillende toepassingen.

Foundation Models Pharma Advertentiegenerator

In de snelle farmaceutische industrie van vandaag is efficiënt en gelokaliseerd adverteren belangrijker dan ooit. Dit is waar een innovatieve oplossing in het spel komt, waarbij de kracht van generatieve AI wordt gebruikt om gelokaliseerde farmaceutische advertenties te maken op basis van bronafbeeldingen en pdf's. Deze aanpak versnelt niet alleen het proces voor het genereren van advertenties, maar stroomlijnt ook het proces van medische juridische beoordeling (MLR). MLR is een rigoureus beoordelingsmechanisme waarbij medische, juridische en regelgevende teams promotiemateriaal nauwgezet evalueren om de nauwkeurigheid, wetenschappelijke onderbouwing en naleving van de regelgeving te garanderen. Traditionele methoden voor het maken van inhoud kunnen omslachtig zijn en vereisen vaak handmatige aanpassingen en uitgebreide beoordelingen om afstemming op regionale naleving en relevantie te garanderen. Met de komst van generatieve AI kunnen we nu echter het maken van advertenties automatiseren die echt resoneren met het lokale publiek, en dit alles terwijl we strenge normen en richtlijnen handhaven.

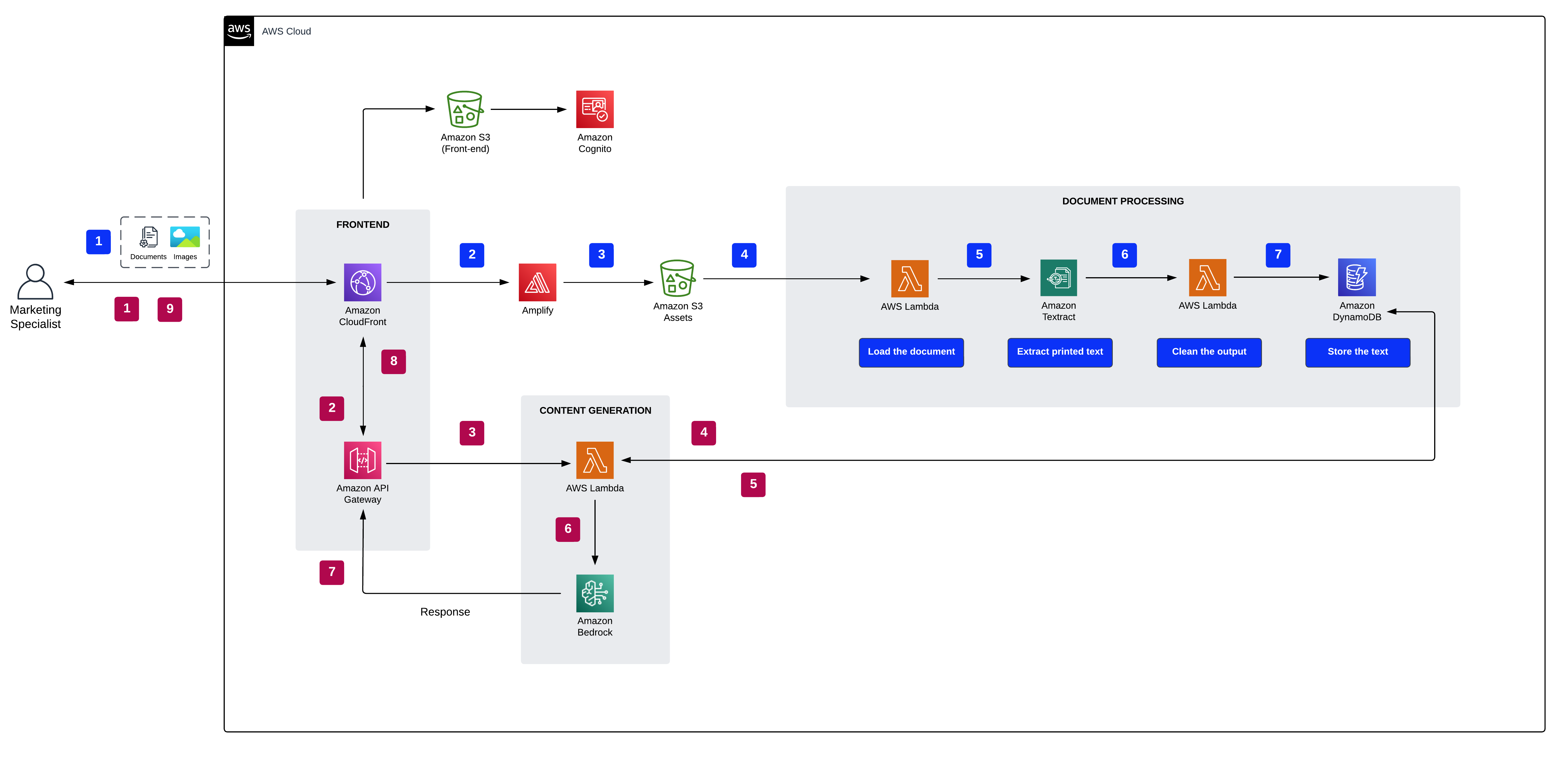

Het volgende diagram illustreert de oplossingsarchitectuur.

In de architecturale lay-out worden gebruikers, op basis van hun geselecteerde model en advertentievoorkeuren, naadloos naar de Amazon Bedrock-basismodellen geleid. Deze gestroomlijnde aanpak zorgt ervoor dat nieuwe advertenties precies volgens de gewenste configuratie worden gegenereerd. Als onderdeel van het proces worden documenten efficiënt afgehandeld door Amazon T-extract, waarbij de resulterende tekst veilig wordt opgeslagen in DynamoDB. Een opvallend kenmerk is het modulaire ontwerp voor het genereren van afbeeldingen en tekst, waardoor u de flexibiliteit krijgt om elk onderdeel indien nodig onafhankelijk te regenereren.

We hebben deze demo aangeboden in de GitHub repo. Raadpleeg de implementatie-instructies in het leesmij-bestand om het in uw AWS-account te implementeren.

Werkstroom voor het genereren van inhoud

De volgende stappen schetsen het proces voor het genereren van inhoud:

- De gebruiker kiest zijn document, bronafbeelding, advertentieplaatsing, taal en afbeeldingsstijl.

- Veilige toegang tot de webapplicatie wordt verzekerd via Amazon Cognito-authenticatie.

- De frontend van de webapplicatie wordt gehost via Amplify.

- Een WebSocket API, beheerd door API Gateway, faciliteert gebruikersverzoeken. Deze verzoeken worden geverifieerd via AWS Identiteits- en toegangsbeheer (IK BEN).

- Integratie met Amazon Bedrock omvat de volgende stappen:

- Een Lambda-functie maakt gebruik van de LangChain-bibliotheek om verbinding te maken met het Amazon Bedrock-eindpunt met behulp van een contextrijke query.

- Het fundamentele tekst-naar-tekstmodel maakt een contextueel passende advertentie op basis van de gegeven context en instellingen.

- Het basismodel tekst-naar-afbeelding creëert een afbeelding op maat, beïnvloed door de bronafbeelding, de gekozen stijl en de locatie.

- De gebruiker ontvangt het antwoord via een HTTPS-verzoek via de geïntegreerde API Gateway WebSocket API.

Workflow voor document- en beeldverwerking

Hieronder volgt de procedure voor het verwerken van documenten en afbeeldingen:

- De gebruiker uploadt middelen via de opgegeven gebruikersinterface.

- De Amplify API brengt de documenten over naar een S3-bucket.

- Nadat het item is overgedragen naar Amazon S3, vindt een van de volgende acties plaats:

- Als het een document is, gebruikt een Lambda-functie Amazon Textract om tekst te verwerken en te extraheren voor het genereren van advertenties.

- Als het een afbeelding is, converteert de Lambda-functie deze naar het base64-formaat, geschikt voor het Stable Diffusion-model om een nieuwe afbeelding van de bron te maken.

- De geëxtraheerde tekst of base64-afbeeldingsreeks wordt veilig opgeslagen in DynamoDB.

Voordelen

De volgende lijst beschrijft de voordelen van deze oplossing:

- Efficiënt – Het gebruik van generatieve AI versnelt het advertentiegeneratieproces aanzienlijk, waardoor handmatige aanpassingen niet meer nodig zijn.

- Naleving van naleving – De oplossing zorgt ervoor dat gegenereerde advertenties voldoen aan specifieke richtlijnen en voorschriften, zoals de marketingrichtlijnen van de FDA.

- Kostenefficient – Door het maken van op maat gemaakte advertenties te automatiseren, kunnen bedrijven de kosten die gepaard gaan met de productie en revisies van advertenties aanzienlijk verlagen.

- Gestroomlijnd MLR-proces – De oplossing vereenvoudigt het MLR-proces, vermindert wrijvingspunten en zorgt voor soepelere beoordelingen.

- Gelokaliseerde resonantie – Generatieve AI produceert advertenties die resoneren met het lokale publiek, waardoor relevantie en impact in verschillende regio’s wordt gegarandeerd.

- normalisering – De oplossing handhaaft de noodzakelijke normen en richtlijnen, waardoor consistentie tussen alle gegenereerde advertenties wordt gegarandeerd.

- Schaalbaarheid – De AI-gestuurde aanpak kan enorme databases met bronafbeeldingen en pdf’s verwerken, waardoor het mogelijk wordt om op grote schaal advertenties te genereren.

- Minder handmatige tussenkomst – De automatisering vermindert de noodzaak van menselijke tussenkomst, minimaliseert fouten en zorgt voor consistentie.

U kunt de infrastructuur in deze tutorial implementeren vanaf uw lokale computer of u kunt AWS Cloud9 gebruiken als uw implementatiewerkstation. AWS Cloud9 wordt vooraf geladen met de AWS CLI, AWS CDK en Docker. Als u kiest voor AWS Cloud9, de omgeving creëren van het AWS Cloud9-console.

Opruimen

Om onnodige kosten te voorkomen, ruimt u alle infrastructuur op die is gemaakt via de AWS CloudFormation-console of door de volgende opdracht op uw werkstation uit te voeren:

Vergeet bovendien niet om alle SageMaker-eindpunten te stoppen die u via de SageMaker-console hebt geïnitieerd. Houd er rekening mee dat het verwijderen van een Amazon Kendra-index niet de originele documenten uit uw opslag verwijdert.

Conclusie

Generatieve AI, belichaamd door LLM's, luidt een paradigmaverschuiving in in de manier waarop we toegang krijgen tot informatie en deze genereren. Deze modellen zijn weliswaar krachtig, maar worden vaak beperkt door de beperkingen van hun trainingsgegevens. RAG gaat deze uitdaging aan en zorgt ervoor dat de enorme kennis binnen deze modellen consistent wordt doordrenkt met relevante, actuele inzichten.

Onze op RAG gebaseerde demo's vormen hiervan een tastbaar bewijs. Ze laten de naadloze synergie zien tussen Amazon Kendra, vectorinbedding en LLM's, waardoor een systeem ontstaat waarin informatie niet alleen enorm is, maar ook accuraat en actueel. Terwijl u zich in deze demo's verdiept, ontdekt u uit de eerste hand het transformatiepotentieel van het samenvoegen van vooraf opgeleide kennis met de dynamische mogelijkheden van RAG, wat resulteert in resultaten die zowel betrouwbaar zijn als afgestemd op bedrijfsinhoud.

Hoewel generatieve AI, aangedreven door LLM's, een nieuwe manier opent om informatie-inzichten te verkrijgen, moeten deze inzichten betrouwbaar zijn en beperkt blijven tot bedrijfsinhoud met behulp van de RAG-aanpak. Met deze op RAG gebaseerde demo's beschikt u over inzichten die accuraat en actueel zijn. De kwaliteit van deze inzichten is afhankelijk van de semantische relevantie, die mogelijk wordt gemaakt door het gebruik van Amazon Kendra en vectorinbedding.

Als u er klaar voor bent om de kracht van generatieve AI verder te verkennen en te benutten, zijn dit uw volgende stappen:

- Doe mee met onze demo's – De praktijkervaring is van onschatbare waarde. Ontdek de functionaliteiten, begrijp de integraties en maak uzelf vertrouwd met de interface.

- Verdiep je kennis – Maak gebruik van de beschikbare middelen. AWS biedt diepgaande documentatie, tutorials en community-ondersteuning om u te helpen bij uw AI-reis.

- Start een proefproject – Overweeg om te beginnen met een kleinschalige implementatie van generatieve AI in uw onderneming. Dit geeft inzicht in de bruikbaarheid en het aanpassingsvermogen van het systeem binnen uw specifieke context.

Raadpleeg het volgende voor meer informatie over generatieve AI-toepassingen op AWS:

Vergeet niet dat het landschap van AI voortdurend evolueert. Blijf op de hoogte, blijf nieuwsgierig en wees altijd bereid om je aan te passen en te innoveren.

Over de Auteurs

Jin Tan Ruan is een Prototyping Developer binnen het AWS Industries Prototyping and Customer Engineering (PACE) team, gespecialiseerd in NLP en generatieve AI. Met een achtergrond in softwareontwikkeling en negen AWS-certificeringen brengt Jin een schat aan ervaring mee om AWS-klanten te helpen bij het materialiseren van hun AI/ML- en generatieve AI-visies met behulp van het AWS-platform. Hij heeft een masterdiploma in computerwetenschappen en software-engineering behaald aan de Universiteit van Syracuse. Buiten zijn werk speelt Jin graag videogames en dompelt hij zich onder in de spannende wereld van horrorfilms.

Jin Tan Ruan is een Prototyping Developer binnen het AWS Industries Prototyping and Customer Engineering (PACE) team, gespecialiseerd in NLP en generatieve AI. Met een achtergrond in softwareontwikkeling en negen AWS-certificeringen brengt Jin een schat aan ervaring mee om AWS-klanten te helpen bij het materialiseren van hun AI/ML- en generatieve AI-visies met behulp van het AWS-platform. Hij heeft een masterdiploma in computerwetenschappen en software-engineering behaald aan de Universiteit van Syracuse. Buiten zijn werk speelt Jin graag videogames en dompelt hij zich onder in de spannende wereld van horrorfilms.

Aravind Kodandaramaiah is een Senior Prototyping full-stack oplossingsbouwer binnen het AWS Industries Prototyping and Customer Engineering (PACE) team. Hij richt zich op het helpen van AWS-klanten om innovatieve ideeën om te zetten in oplossingen met meetbare en prachtige resultaten. Hij heeft een passie voor een reeks onderwerpen, waaronder cloudbeveiliging, DevOps en AI/ML, en is meestal bezig met het sleutelen aan deze technologieën.

Aravind Kodandaramaiah is een Senior Prototyping full-stack oplossingsbouwer binnen het AWS Industries Prototyping and Customer Engineering (PACE) team. Hij richt zich op het helpen van AWS-klanten om innovatieve ideeën om te zetten in oplossingen met meetbare en prachtige resultaten. Hij heeft een passie voor een reeks onderwerpen, waaronder cloudbeveiliging, DevOps en AI/ML, en is meestal bezig met het sleutelen aan deze technologieën.

Arjun Shakdher is een ontwikkelaar in het AWS Industries Prototyping (PACE)-team met een passie voor het integreren van technologie in de structuur van het leven. Met een masterdiploma van de Purdue University draait Arjun's huidige rol om het ontwerpen en bouwen van geavanceerde prototypes die een scala aan domeinen bestrijken, waarbij momenteel prominent de domeinen van AI/ML en IoT aan bod komen. Wanneer je niet ondergedompeld bent in code en digitale landschappen, zul je zien dat Arjun zich overgeeft aan de wereld van koffie, de ingewikkelde mechanismen van de tijdmeting onderzoekt of geniet van de kunst van auto's.

Arjun Shakdher is een ontwikkelaar in het AWS Industries Prototyping (PACE)-team met een passie voor het integreren van technologie in de structuur van het leven. Met een masterdiploma van de Purdue University draait Arjun's huidige rol om het ontwerpen en bouwen van geavanceerde prototypes die een scala aan domeinen bestrijken, waarbij momenteel prominent de domeinen van AI/ML en IoT aan bod komen. Wanneer je niet ondergedompeld bent in code en digitale landschappen, zul je zien dat Arjun zich overgeeft aan de wereld van koffie, de ingewikkelde mechanismen van de tijdmeting onderzoekt of geniet van de kunst van auto's.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :is

- :niet

- :waar

- $UP

- 100

- 150

- 7

- a

- vermogen

- Over

- versnelt

- toegang

- Volgens

- Account

- nauwkeurigheid

- accuraat

- over

- acties

- Ad

- aanpassen

- aanpast

- toegevoegd

- adressen

- aanhangen

- aanpassingen

- De goedkeuring van

- advertenties

- vergevorderd

- Voordeel

- voordelen

- komst

- ADVERTISING

- Na

- AI

- AI / ML

- Steun

- opstelling

- Alles

- toelaten

- Het toestaan

- toestaat

- bijna

- langs

- ook

- alternatief

- altijd

- Amazone

- Amazon Cognito

- Amazon Kendra

- Amazon T-extract

- Amazon Web Services

- hoeveelheden

- versterken

- an

- en

- beantwoorden

- antwoorden

- elke

- api

- gebruiken

- Aanvraag

- toepassingen

- nadering

- passend

- bouwkundig

- architectuur

- ZIJN

- rond

- reeks

- kunstenaarstalent

- AS

- aanwinst

- Activa

- helpen

- geassocieerd

- hoorzittingen

- audio

- geverifieerd

- authenticatie

- automatiseren

- automatiseren

- Automatisering

- Beschikbaar

- vermijd

- het vermijden van

- AWS

- AWS-Cloud9

- AWS CloudFormatie

- terug

- met een rug

- achtergrond

- steun

- baseren

- gebaseerde

- BE

- omdat

- worden

- wordt

- betekent

- Betere

- tussen

- Verder

- vooroordelen

- blending

- lichaam

- Bot

- zowel

- Tak

- Brengt

- breed

- bouwer

- Gebouw

- maar

- by

- oproepen

- CAN

- Kan krijgen

- mogelijkheden

- vangen

- captures

- geval

- Categorie

- certificeringen

- uitdagen

- uitdagingen

- Kies

- uitgekozen

- schoon

- Cloud

- Cloud Security

- Cloud9

- code

- Koffie

- gecombineerde

- combines

- komt

- algemeen

- gemeenschap

- Bedrijven

- vergelijkingen

- complex

- nakoming

- compliant

- bestanddeel

- begrijpt

- computer

- Computer Science

- Configuratie

- Verbinden

- aansluitingen

- verbindt

- Overwegen

- consistent

- troosten

- permanent

- content

- Inhoud genereren

- content creatie

- verband

- contexten

- contextual

- voortgezet

- doorlopend

- gemakkelijk

- conventioneel

- Gesprek

- het omzetten van

- Kern

- Kosten

- Kosten

- ambachtelijke

- en je merk te creëren

- aangemaakt

- creëert

- Wij creëren

- het aanmaken

- cruciaal

- hinderlijk

- nieuwsgierig

- Actueel

- gewoonte

- klant

- Klanten

- op het randje

- gegevens

- Database

- databanken

- datasets

- Datum

- deep

- diepere

- Mate

- heerlijk

- demonstratie

- Demos

- afhankelijk

- implementeren

- ingezet

- het inzetten

- inzet

- beschrijven

- Design

- ontworpen

- gewenste

- vernietigen

- gedetailleerd

- gegevens

- Ontwikkelaar

- Ontwikkeling

- diagnostisch

- anders

- Verspreiding

- digitaal

- gerichte

- displays

- onderscheiden

- duiken

- diversen

- duiken

- havenarbeider

- document

- documentatie

- documenten

- Nee

- domeinen

- trekken

- tekening

- gedreven

- dynamisch

- gemakkelijk

- doeltreffendheid

- doeltreffend

- efficiënt

- beide

- elimineren

- inbedding

- te voorschijn komen

- telt

- gemachtigd

- machtigt

- in staat stellen

- ingeschakeld

- maakt

- waardoor

- einde

- Endpoint

- Engineering

- verbeterde

- verrijkende

- verzekeren

- verzekerd

- waarborgt

- zorgen

- Enterprise

- Geheel

- uitgerust

- fouten

- vooral

- essentie

- schatten

- Event

- OOIT

- ontwikkelen

- evoluerende

- voorbeeld

- opgewonden

- expansieve

- ervaring

- expert

- deskundigen

- Verken

- Verkennen

- uitgebreid

- extern

- extract

- stof

- vergemakkelijkt

- vertrouwd raken

- fast-paced

- FB

- uitvoerbaar

- Kenmerk

- Voordelen

- Met

- Dien in

- filtering

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- Flexibiliteit

- richt

- volgend

- volgt

- Voor

- formaat

- gevonden

- Foundation

- wrijving

- oppompen van

- voor

- Voorkant

- vol

- Volledige stapel

- functie

- functionaliteiten

- verder

- Bovendien

- Krijgen

- met het verkrijgen van

- Spellen

- poort

- voortbrengen

- gegenereerde

- generatie

- generatief

- generatieve AI

- generator

- krijgen

- gegeven

- Vrijgevigheid

- toekenning

- grijpen

- Groeit

- garantie

- leiding

- geleide

- richtlijnen

- handvat

- hands-on

- harnas

- Benutten

- Hebben

- met

- he

- het helpen van

- herauten

- hier

- highlights

- zichzelf

- geschiedenissen

- geschiedenis

- bezit

- houdt

- verschrikking

- gehost

- Hoe

- Echter

- HTML

- http

- HTTPS

- menselijk

- ideeën

- identificatie

- identifiers

- identificeren

- Identiteit

- if

- illustreert

- beeld

- afbeeldingen

- ondergedompeld

- Impact

- uitvoering

- in

- diepgaande

- onnauwkeurig

- omvat

- Inclusief

- nemen

- onafhankelijk

- index

- geïndexeerd

- indexen

- industrieën

- -industrie

- industriestandaarden

- beïnvloed

- informatie

- op de hoogte

- Infrastructuur

- inherent

- eerste

- geïnitieerd

- innoveren

- innovatieve

- inzichtelijke

- inzichten

- verkrijgen in plaats daarvan

- instructies

- geïntegreerde

- integreert

- integratie

- integraties

- aandachtig

- wisselwerking

- Interface

- tussenkomst

- in

- intrinsiek

- onschatbaar

- iot

- IT

- artikelen

- HAAR

- Jobomschrijving:

- jpg

- voor slechts

- kennis

- bekend

- Landschap

- taal

- Groot

- grootschalig

- Layout

- leren

- Juridisch

- Laten we

- Bibliotheek

- Erkend

- Life

- als

- waarschijnlijkheid

- Beperkt

- grenzen

- Lijst

- LLM

- lokaal

- plaats

- machine

- machine learning

- onderhoudt

- maken

- beheerd

- handboek

- veel

- Marketing

- massief

- master's

- lucifers

- materieel

- betekenis

- zinvolle

- betekenissen

- middel

- mechanica

- mechanisme

- medisch

- Geheugen

- alleen

- samenvoegingen

- samen te voegen

- methoden

- minutieus

- minimaliseren

- verzachting

- ML

- model

- modellering

- modellen

- modulaire

- meer

- meest

- Films

- Dan moet je

- Naturel

- Natural Language Processing

- noodzakelijk

- Noodzaak

- nodig

- nodig

- behoeften

- New

- volgende

- negen

- nlp

- notificatie

- nu

- of

- het aanbieden van

- Aanbod

- vaak

- on

- EEN

- Slechts

- opent

- or

- organisatorische

- organisaties

- origineel

- Overige

- onze

- uit

- resultaten

- schets

- uitgangen

- buiten

- over

- Overwinnen

- Tempo

- paradigma

- parameters

- deel

- hartstochtelijk

- permissies

- Gepersonaliseerde

- Pharma

- Farmaceutisch

- zinnen

- stukken

- piloot

- pilootproject

- plaats

- plaatsing

- platform

- Plato

- Plato gegevensintelligentie

- PlatoData

- Spelen

- spelen

- punten

- positionering

- mogelijk

- Post

- potentieel

- energie

- aangedreven

- krachtige

- PRAKTISCH

- nauwkeurig

- Precies

- precisie

- voorkeuren

- vereisten

- dadelijk

- procedures

- Verwerkt

- verwerking

- geproduceerd

- produceert

- productie

- project

- promotionele

- prototypes

- prototyping

- Bewijzen

- zorgen voor

- mits

- biedt

- het verstrekken van

- kwaliteit

- queries

- vraag

- Contact

- Quick

- snel

- reeks

- klaar

- rijken

- ontvangt

- ontvangende

- Aanbeveling

- verminderen

- vermindert

- vermindering

- verwijzen

- verfijnd

- regionaal

- regio

- regelmatig

- reglement

- regelgevers

- Regulatory Compliance

- relevantie

- relevante

- te vertrouwen

- blijven

- stoffelijk overschot

- niet vergeten

- verwijderen

- herformuleren

- vertegenwoordiging

- vertegenwoordigt

- te vragen

- verzoeken

- vereisen

- nodig

- Voorwaarden

- resonator

- Resources

- antwoord

- reacties

- verantwoordelijkheden

- verantwoordelijk

- resultante

- verkregen

- Resultaten

- beoordelen

- Recensies

- revisies

- draait

- rechts

- streng

- Rol

- lopend

- loopt

- sagemaker

- dezelfde

- gered

- Wetenschap

- wetenschappelijk

- naadloos

- naadloos

- Ontdek

- secties

- beveiligen

- vast

- veiligheid

- gekozen

- selectie

- senior

- verzonden

- service

- Diensten

- reeks

- settings

- setup

- verschuiving

- showcase

- Shows

- Ziften

- aanzienlijke

- aanzienlijk

- Eenvoudig

- eenvoudigweg

- kleinere

- gladder

- Software

- software development

- software engineering

- uitsluitend

- oplossing

- Oplossingen

- bron

- source

- bronnen

- Sourcing XNUMX

- ruimten

- span

- gespecialiseerde

- gespecialiseerd

- specifiek

- gespecificeerd

- stabiel

- stack

- normen

- Start

- state-of-the-art

- blijven

- Stap voor

- Stappen

- stop

- mediaopslag

- shop

- opgeslagen

- bewaartemperatuur

- gestroomlijnd

- sterke punten

- Draad

- streng

- gestructureerde

- stijl

- voorleggen

- dergelijk

- geschikt

- ondersteuning

- ondersteunde

- synergie

- system

- op maat gemaakt

- Nemen

- neemt

- tastbaar

- Taak

- taken

- team

- teams

- techniek

- Technologies

- Technologie

- testament

- tekst

- neem contact

- dat

- De

- Het landschap

- De Bron

- de wereld

- hun

- Ze

- harte

- daarbij

- Deze

- ze

- dit

- drie

- opwindend

- Door

- niet de tijd of

- actuele

- tijdstempel

- Titan

- naar

- vandaag

- tools

- tools

- onderwerp

- onderwerpen

- in de richting van

- traditioneel

- Trainen

- getraind

- Trainingen

- overdracht

- overgedragen

- transfers

- Transformeren

- transformationele

- transformers

- Trends

- echt

- betrouwbaar

- BEURT

- zelfstudie

- tutorials

- types

- ui

- ondergaan

- die ten grondslag liggen

- begrijpen

- begrip

- unieke

- universiteit-

- anders

- onnodig

- onthullen

- up-to-date

- bijwerken

- bijgewerkt

- updates

- handhaving

- op

- .

- use case

- Gebruiker

- User Interface

- gebruikers

- toepassingen

- gebruik

- doorgaans

- maakt gebruik van

- Gebruik makend

- divers

- groot

- veelzijdig

- via

- Video

- video games

- visies

- Manier..

- we

- Rijkdom

- web

- web applicatie

- webservices

- WebSocket

- waren

- wanneer

- welke

- en

- WIE

- breed

- Grote range

- wil

- Met

- binnen

- zonder

- woorden

- Mijn werk

- workflow

- werkstation

- wereld

- You

- Your

- jezelf

- zephyrnet